Betydningen av datavarehus og analyser utført på datavarehusplattformer har økt jevnt og trutt gjennom årene, med mange virksomheter som kommer til å stole på disse systemene som oppdragskritiske for både kortsiktig operasjonell beslutningstaking og langsiktig strategisk planlegging. Tradisjonelt oppdateres datavarehus i batch-sykluser, for eksempel månedlig, ukentlig eller daglig, slik at virksomheter kan hente ulike innsikter fra dem.

Mange organisasjoner innser at datainntak nesten i sanntid sammen med avanserte analyser åpner for nye muligheter. Et finansinstitutt kan for eksempel forutsi om en kredittkorttransaksjon er uredelig ved å kjøre et program for oppdagelse av anomalier i nesten sanntidsmodus i stedet for i batchmodus.

I dette innlegget viser vi hvordan Amazon RedShift kan levere spådommer for strømming og maskinlæring (ML) på én plattform.

Amazon Redshift er et raskt, skalerbart, sikkert og fullt administrert skydatavarehus som gjør det enkelt og kostnadseffektivt å analysere alle dataene dine ved hjelp av standard SQL.

Amazon Redshift ML gjør det enkelt for dataanalytikere og databaseutviklere å lage, trene og bruke ML-modeller ved å bruke kjente SQL-kommandoer i Amazon Redshift-datavarehus.

Vi er glade for å lansere Amazon Redshift Streaming-inntak forum Amazon Kinesis datastrømmer og Amazon administrerte strømming for Apache Kafka (Amazon MSK), som lar deg innta data direkte fra en Kinesis-datastrøm eller Kafka-emne uten å måtte sette inn dataene Amazon enkel lagringstjeneste (Amazon S3). Amazon Redshift streaming-inntak lar deg oppnå lav ventetid i størrelsesorden sekunder mens du inntar hundrevis av megabyte med data i datavarehuset ditt.

Dette innlegget demonstrerer hvordan Amazon Redshift, skydatavarehuset lar deg bygge nesten sanntids ML-spådommer ved å bruke Amazon Redshift-streaming-inntak og Redshift ML-funksjoner med kjent SQL-språk.

Løsningsoversikt

Ved å følge trinnene som er skissert i dette innlegget, vil du kunne sette opp en produsent streamer-applikasjon på en Amazon Elastic Compute Cloud (Amazon EC2)-forekomst som simulerer kredittkorttransaksjoner og skyver data til Kinesis Data Streams i sanntid. Du setter opp en Amazon Redshift Streaming Ingestion materialisert visning på Amazon Redshift, der strømmedata mottas. Du trener og bygger en Redshift ML-modell for å generere sanntidsslutninger mot strømmedataene.

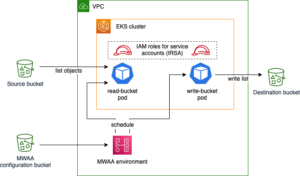

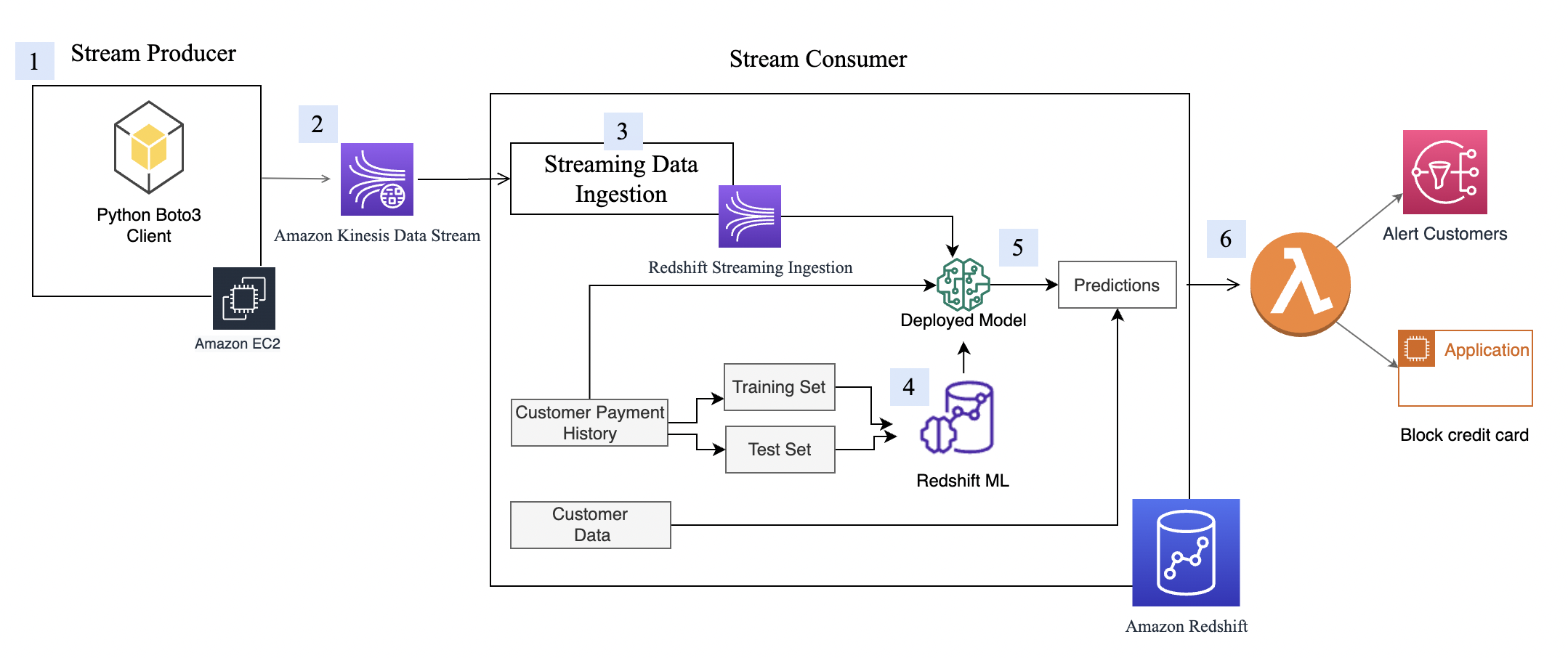

Følgende diagram illustrerer arkitekturen og prosessflyten.

Trinn-for-trinn prosessen er som følger:

- EC2-forekomsten simulerer en kredittkorttransaksjonsapplikasjon, som setter inn kredittkorttransaksjoner i Kinesis-datastrømmen.

- Datastrømmen lagrer innkommende kredittkorttransaksjonsdata.

- En Amazon Redshift Streaming Ingestion materialisert visning opprettes på toppen av datastrømmen, som automatisk inntar streamingdata til Amazon Redshift.

- Du bygger, trener og distribuerer en ML-modell ved å bruke Redshift ML. Redshift ML-modellen trenes ved å bruke historiske transaksjonsdata.

- Du transformerer strømmedataene og genererer ML-spådommer.

- Du kan varsle kunder eller oppdatere applikasjonen for å redusere risikoen.

Denne gjennomgangen bruker strømmedata for kredittkorttransaksjoner. Kredittkorttransaksjonsdataene er fiktive og er basert på en simulator. Kundedatasettet er også fiktivt og genereres med noen tilfeldige datafunksjoner.

Forutsetninger

- Lag en Amazon Redshift-klynge.

- Konfigurer klyngen til å bruke Redshift ML.

- Opprett an AWS identitets- og tilgangsadministrasjon (IAM) bruker.

- Oppdater IAM-rollen knyttet til Redshift-klyngen for å inkludere tillatelser for å få tilgang til Kinesis-datastrømmen. For mer informasjon om den nødvendige policyen, se Komme i gang med strømming.

- Lag en m5.4xlarge EC2-forekomst. Vi testet Producer-applikasjonen med m5.4xlarge-forekomst, men du står fritt til å bruke andre forekomsttyper. Når du oppretter forekomsten, bruk amzn2-ami-kernel-5.10-hvm-2.0.20220426.0-x86_64-gp2 AMI.

- For å være sikker på at Python3 er installert i EC2-forekomsten, kjør følgende kommando for å bekrefte Python-versjonen din (merk at datautvinningsskriptet bare fungerer på Python 3):

- Installer følgende avhengige pakker for å kjøre simulatorprogrammet:

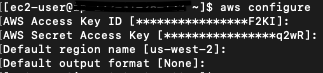

- Konfigurer Amazon EC2 ved å bruke variablene som AWS-legitimasjon generert for IAM-bruker opprettet i trinn 3 ovenfor. Følgende skjermbilde viser et eksempel på bruk av aws konfigurere.

Sett opp Kinesis Data Streams

Amazon Kinesis Data Streams er en massivt skalerbar og holdbar datastrømmetjeneste i sanntid. Den kan kontinuerlig fange opp gigabyte med data per sekund fra hundretusenvis av kilder, for eksempel nettstedsklikkstrømmer, databasehendelsesstrømmer, økonomiske transaksjoner, feeds for sosiale medier, IT-logger og stedssporingshendelser. Dataene som samles inn er tilgjengelige på millisekunder for å muliggjøre brukstilfeller for sanntidsanalyse som sanntidsdashboard, sanntidsavviksdeteksjon, dynamisk prissetting og mer. Vi bruker Kinesis Data Streams fordi det er en serverløs løsning som kan skaleres basert på bruk.

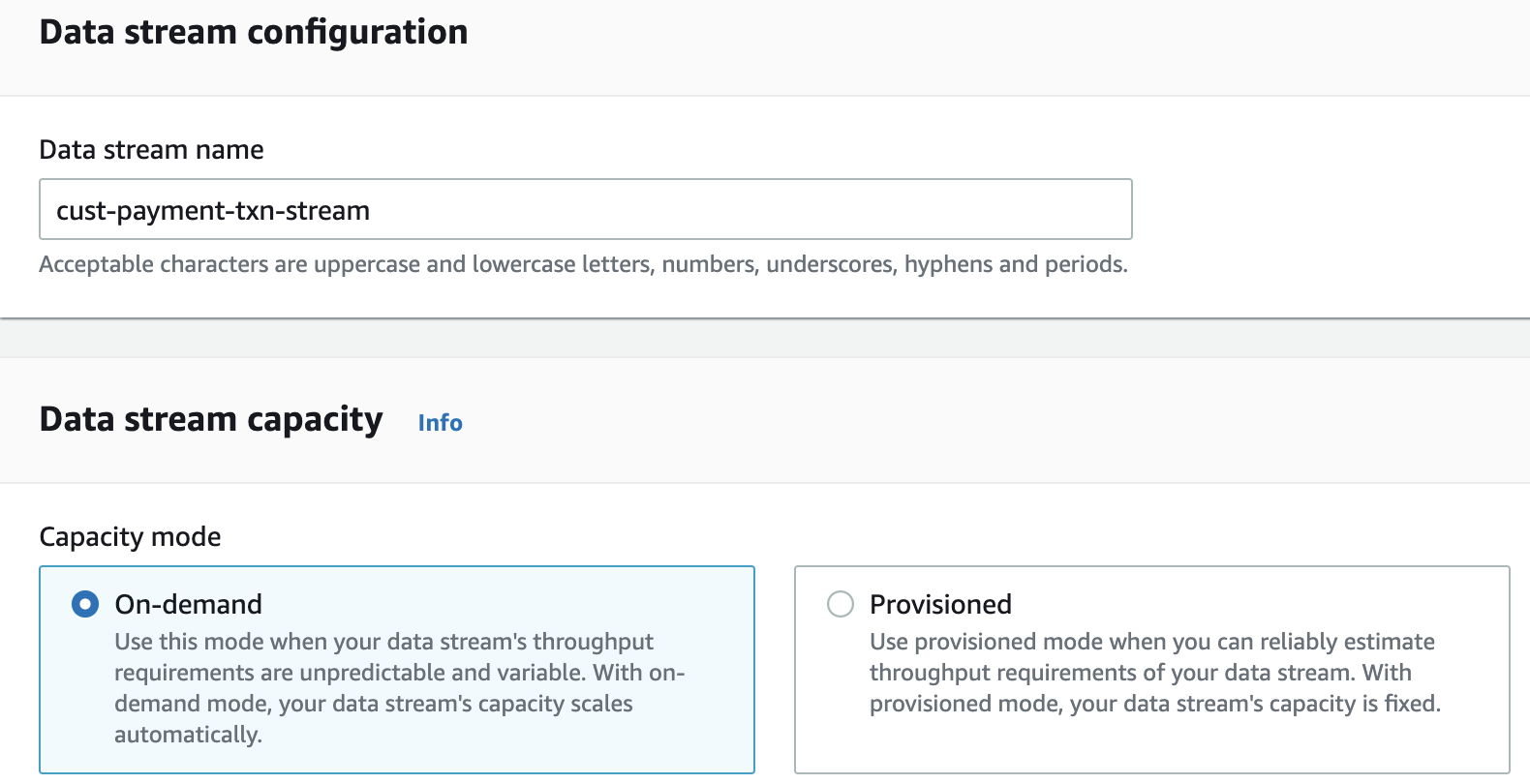

Lag en Kinesis-datastrøm

Først må du opprette en Kinesis-datastrøm for å motta strømmedataene:

- På Amazon Kinesis-konsollen velger du Datastrømmer i navigasjonsruten.

- Velg Lag datastrøm.

- Til Navn på datastrøm, Tast inn

cust-payment-txn-stream. - Til Kapasitetsmodus, plukke ut På etterspørsel.

- For resten av alternativene, velg standardalternativene og følg instruksjonene for å fullføre oppsettet.

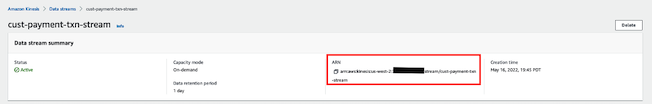

- Registrer ARN for den opprettede datastrømmen som skal brukes i neste avsnitt når du definerer IAM-policyen din.

Sett opp tillatelser

For at en strømmeapplikasjon skal kunne skrive til Kinesis Data Streams, må applikasjonen ha tilgang til Kinesis. Du kan bruke følgende policyerklæring for å gi simulatorprosessen som du konfigurerer i neste seksjon tilgang til datastrømmen. Bruk ARN for datastrømmen du lagret i forrige trinn.

Konfigurer strømprodusenten

Før vi kan konsumere strømmedata i Amazon Redshift, trenger vi en strømmedatakilde som skriver data til Kinesis-datastrømmen. Dette innlegget bruker en spesialbygd datagenerator og AWS SDK for Python (Boto3) å publisere dataene til datastrømmen. For installasjonsinstruksjoner, se Produsentsimulator. Denne simulatorprosessen publiserer strømmedata til datastrømmen opprettet i forrige trinn (cust-payment-txn-stream).

Konfigurer strømforbrukeren

Denne delen snakker om å konfigurere strømforbrukeren (Amazon Redshift streaming-inntaksvisning).

Amazon Redshift Streaming Ingestion gir lav latens, høyhastighets inntak av strømmedata fra Kinesis Data Streams til en Amazon Redshift materialisert visning. Du kan konfigurere Amazon Redshift-klyngen til å aktivere strømming og lage en materialisert visning med automatisk oppdatering ved hjelp av SQL-setninger, som beskrevet i Opprette materialiserte visninger i Amazon Redshift. Den automatiske materialiserte oppdateringsprosessen vil ta inn strømmedata med hundrevis av megabyte data per sekund fra Kinesis Data Streams til Amazon Redshift. Dette resulterer i rask tilgang til eksterne data som raskt oppdateres.

Etter å ha opprettet den materialiserte visningen, kan du få tilgang til dataene dine fra datastrømmen ved hjelp av SQL og forenkle datapipelines ved å lage materialiserte visninger direkte på toppen av strømmen.

Fullfør følgende trinn for å konfigurere en Amazon Redshift-streaming materialisert visning:

- På IAM-konsollen velger du policyer i navigasjonsruten.

- Velg Opprett policy.

- Opprett en ny IAM-policy kalt

KinesisStreamPolicy. For definisjonen av strømmepolicy, se Komme i gang med strømming. - Velg i navigasjonsruten Roller.

- Velg Opprett rolle.

- Plukke ut AWS-tjeneste Og velg Redshift og Redshift kan tilpasses.

- Opprett en ny rolle kalt

redshift-streaming-roleog legg ved policyenKinesisStreamPolicy. - Opprett et eksternt skjema for å kartlegge til Kinesis Data Streams:

Nå kan du lage en materialisert visning for å konsumere strømdataene. Du kan bruke SUPER-datatypen til å lagre nyttelasten som den er, i JSON-format, eller bruke Amazon Redshift JSON-funksjoner for å analysere JSON-dataene i individuelle kolonner. For dette innlegget bruker vi den andre metoden fordi skjemaet er godt definert.

- Opprett den materialiserte visningen for strømming

cust_payment_tx_stream. Ved å spesifisere AUTO OPPDATERING JA i følgende kode, kan du aktivere automatisk oppdatering av streaming-inntaksvisningen, noe som sparer tid ved å unngå å bygge datapipelines:

Legg merke til at json_extract_path_text har en lengdebegrensning på 64 KB. From_varbye filtrerer også poster større enn 65KB.

- Oppdater dataene.

Amazon Redshift-streaming-materialisert visning oppdateres automatisk av Amazon Redshift for deg. På denne måten trenger du ikke bekymre deg for ustabile data. Med materialisert visning automatisk oppdatering lastes data automatisk inn i Amazon Redshift når de blir tilgjengelige i strømmen. Hvis du velger å utføre denne operasjonen manuelt, bruk følgende kommando:

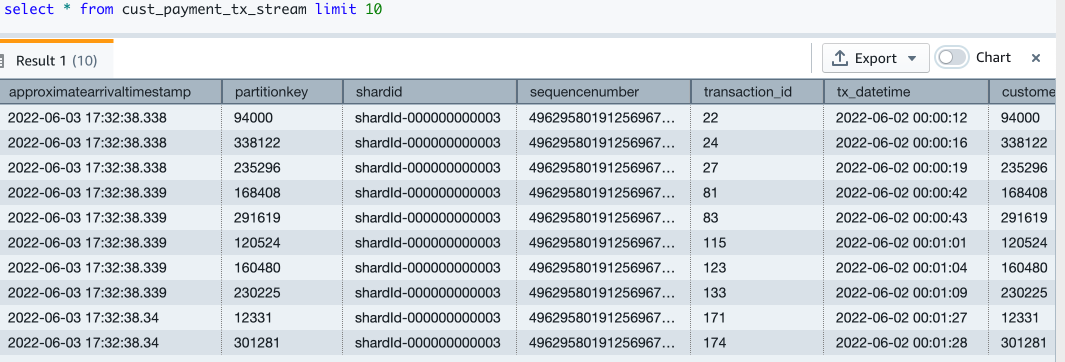

- La oss nå spørre den materialiserte streamingvisningen for å se eksempeldata:

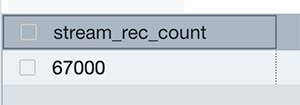

- La oss sjekke hvor mange poster som er i strømmevisningen nå:

Nå er du ferdig med å sette opp Amazon Redshift-streaming-inntaksvisningen, som kontinuerlig oppdateres med innkommende kredittkorttransaksjonsdata. I oppsettet mitt ser jeg at rundt 67,000 XNUMX poster har blitt trukket inn i strømmingsvisningen på det tidspunktet da jeg kjørte spørringen om antall utvalgte. Dette nummeret kan være annerledes for deg.

Rødforskyvning ML

Med Redshift ML kan du ta med en forhåndstrent ML-modell eller bygge en naturlig. For mer informasjon, se Bruker maskinlæring i Amazon Redshift.

I dette innlegget trener og bygger vi en ML-modell ved hjelp av et historisk datasett. Dataene inneholder en tx_fraud felt som flagger en historisk transaksjon som uredelig eller ikke. Vi bygger en overvåket ML-modell ved å bruke Redshift Auto ML, som lærer av dette datasettet og forutsier innkommende transaksjoner når disse kjøres gjennom prediksjonsfunksjonene.

I de følgende avsnittene viser vi hvordan du setter opp det historiske datasettet og kundedataene.

Last inn det historiske datasettet

Den historiske tabellen har flere felt enn det strømmedatakilden har. Disse feltene inneholder kundens siste forbruk og terminalrisikoscore, som antall uredelige transaksjoner beregnet ved å transformere strømmedata. Det er også kategoriske variabler som helgetransaksjoner eller natttransaksjoner.

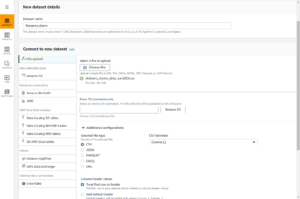

For å laste de historiske dataene, kjør kommandoene ved å bruke Amazon Redshift spørreredaktør.

Opprett transaksjonshistorikktabellen med følgende kode. DDL kan også finnes på GitHub.

La oss sjekke hvor mange transaksjoner som er lastet inn:

Sjekk trenden for månedlige svindel og transaksjoner uten svindel:

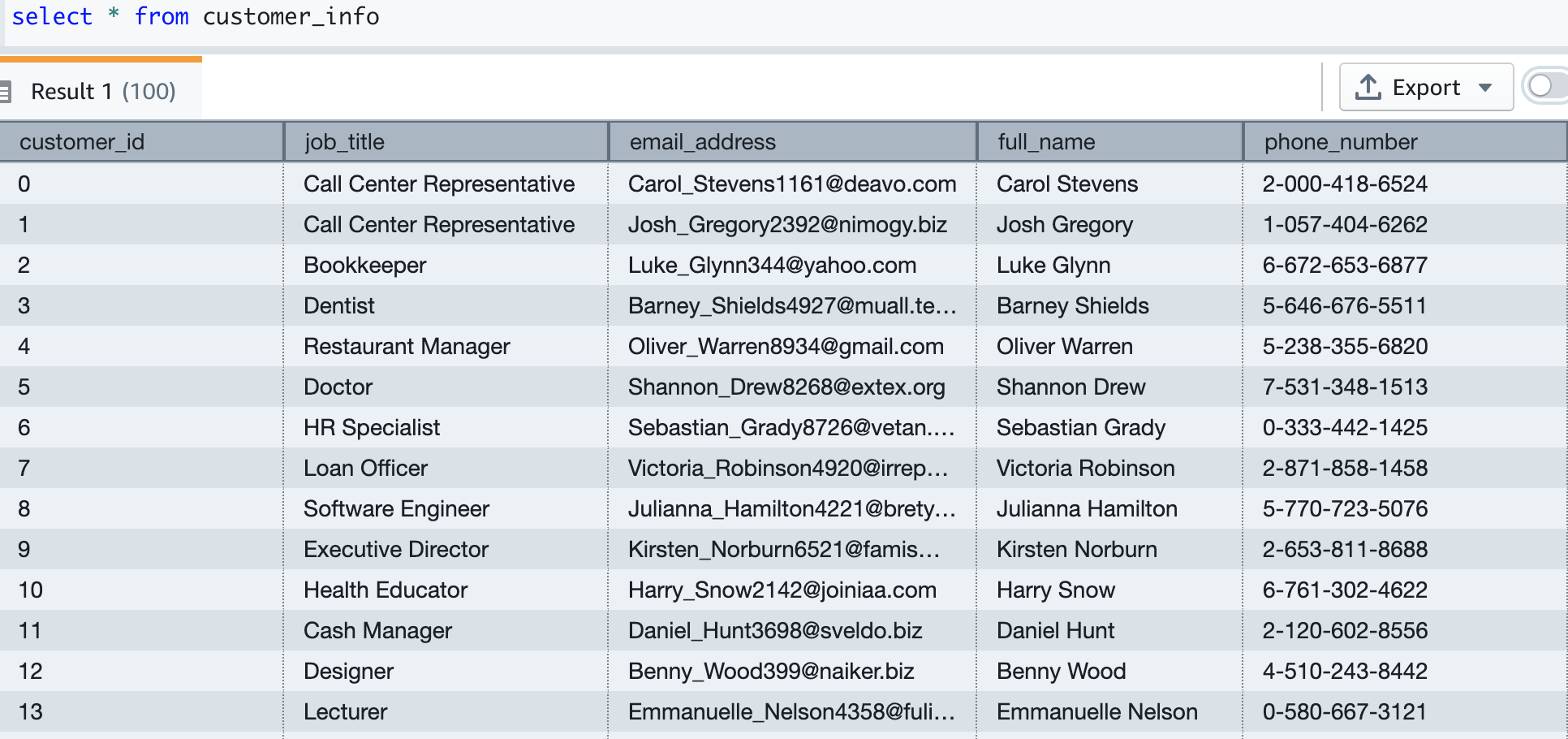

Opprett og last inn kundedata

Nå lager vi kundetabellen og laster inn data, som inneholder e-post og telefonnummer til kunden. Følgende kode oppretter tabellen, laster dataene og prøver tabellen. Tabellen DDL er tilgjengelig på GitHub.

Våre testdata har rundt 5,000 kunder. Følgende skjermbilde viser eksempler på kundedata.

Bygg en ML-modell

Vår historiske korttransaksjonstabell har 6 måneder med data, som vi nå bruker til å trene og teste ML-modellen.

Modellen tar følgende felt som input:

Vi får tx_fraud som utgang.

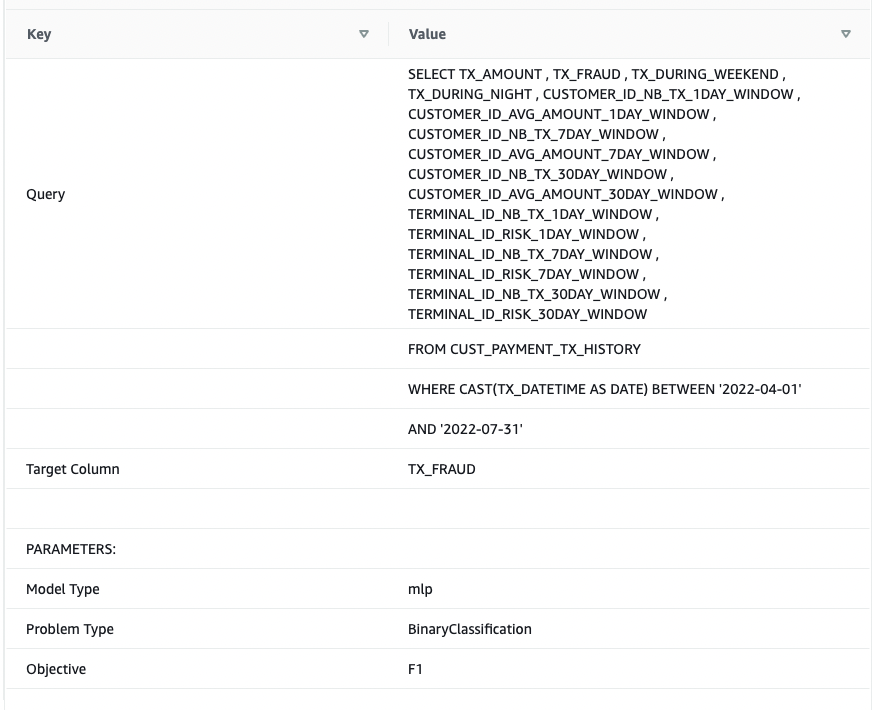

Vi deler disse dataene inn i opplærings- og testdatasett. Transaksjoner fra 2022-04-01 til 2022-07-31 er for treningssettet. Transaksjoner fra 2022-08-01 til 2022-09-30 brukes til testsettet.

La oss lage ML-modellen ved å bruke den velkjente SQL-en CREATE MODEL statement. Vi bruker en grunnleggende form for Redshift ML-kommandoen. Følgende metode bruker Amazon SageMaker Autopilot, som utfører dataforberedelse, funksjonsutvikling, modellvalg og opplæring automatisk for deg. Oppgi navnet på S3-bøtten som inneholder koden.

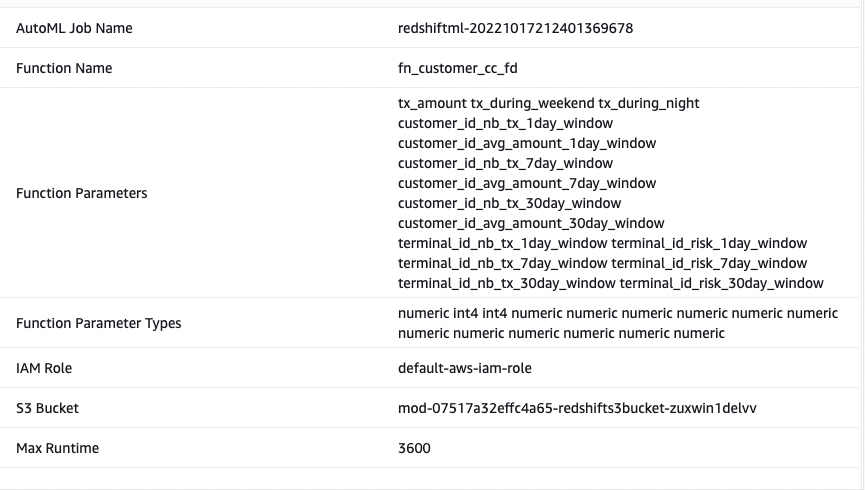

Jeg kaller ML-modellen som Cust_cc_txn_fd, og prediksjonsfunksjonen som fn_customer_cc_fd. FROM-leddet viser inngangskolonnene fra den historiske tabellen public.cust_payment_tx_history. Målparameteren er satt til tx_fraud, som er målvariabelen vi prøver å forutsi. IAM_Role er satt til standard fordi klyngen er konfigurert med denne rollen; hvis ikke, må du gi din Amazon Redshift-klynge IAM-rolle ARN. Jeg stiller inn max_runtime til 3,600 sekunder, som er tiden vi gir til SageMaker for å fullføre prosessen. Redshift ML distribuerer den beste modellen som er identifisert i denne tidsrammen.

Avhengig av kompleksiteten til modellen og mengden data, kan det ta litt tid før modellen er tilgjengelig. Hvis du finner ut at modellvalget ditt ikke er fullført, øk verdien for max_runtime. Du kan angi en maksverdi på 9999.

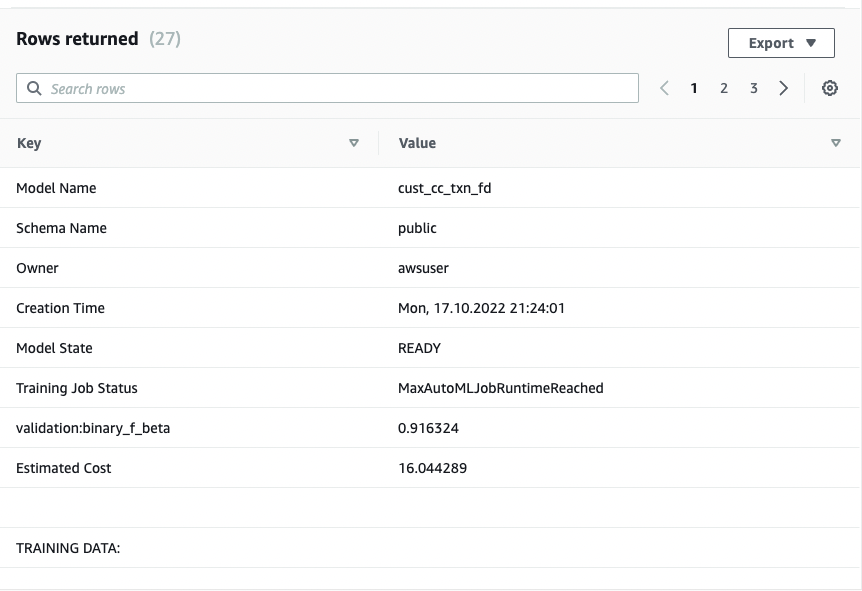

CREATE MODEL-kommandoen kjøres asynkront, noe som betyr at den kjører i bakgrunnen. Du kan bruke VIS MODELL kommando for å se statusen til modellen. Når statusen vises som Klar, betyr det at modellen er opplært og distribuert.

Følgende skjermbilder viser produksjonen vår.

Fra utgangen ser jeg at modellen har blitt korrekt gjenkjent som BinaryClassification, og F1 er valgt som mål. De F1-poengsum er en beregning som tar hensyn til begge presisjon og tilbakekalling. Den returnerer en verdi mellom 1 (perfekt presisjon og gjenkalling) og 0 (lavest mulig poengsum). I mitt tilfelle er det 0.91. Jo høyere verdi, jo bedre modellytelse.

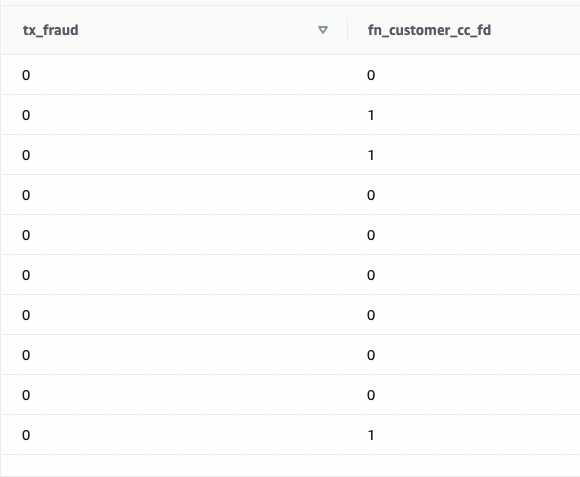

La oss teste denne modellen med testdatasettet. Kjør følgende kommando, som henter eksempelspådommer:

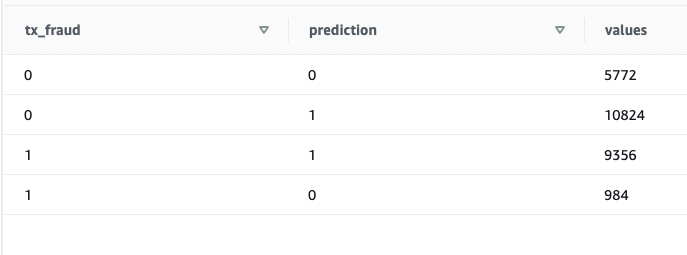

Vi ser at noen verdier stemmer og noen ikke. La oss sammenligne spådommer med grunnsannheten:

Vi validerte at modellen fungerer og at F1-poengsummen er god. La oss gå videre til å generere spådommer om strømmedata.

Forutsi uredelige transaksjoner

Fordi Redshift ML-modellen er klar til bruk, kan vi bruke den til å kjøre spådommene mot inntak av strømmedata. Det historiske datasettet har flere felt enn det vi har i strømmingsdatakilden, men de er bare siste- og frekvensmålinger rundt kunden og terminalrisikoen for en uredelig transaksjon.

Vi kan bruke transformasjonene på toppen av strømmedataene veldig enkelt ved å bygge inn SQL i visningene. Opprett første visning, som samler strømmedata på kundenivå. Deretter oppretter du andre visning, som samler strømmedata på terminalnivå, og tredje syn, som kombinerer innkommende transaksjonsdata med kunde- og terminalaggregerte data og kaller prediksjonsfunksjonen på ett sted. Koden for den tredje visningen er som følger:

Kjør en SELECT-setning på visningen:

Når du kjører SELECT-setningen gjentatte ganger, går de siste kredittkorttransaksjonene gjennom transformasjoner og ML-spådommer i nesten sanntid.

Dette demonstrerer kraften til Amazon Redshift – med brukervennlige SQL-kommandoer kan du transformere strømmedata ved å bruke komplekse vindusfunksjoner og bruke en ML-modell for å forutsi uredelige transaksjoner i ett trinn, uten å bygge komplekse datapipelines eller bygge og administrere ekstra infrastruktur.

Utvid løsningen

Fordi datastrømmene inn og ML-spådommene lages i nesten sanntid, kan du bygge forretningsprosesser for å varsle kunden ved å bruke Amazon enkel varslingstjeneste (Amazon SNS), eller du kan låse kundens kredittkortkonto i et operasjonssystem.

Dette innlegget går ikke inn på detaljene i disse operasjonene, men hvis du er interessert i å lære mer om å bygge hendelsesdrevne løsninger ved å bruke Amazon Redshift, se følgende GitHub repository.

Rydd opp

For å unngå fremtidige kostnader, slett ressursene som ble opprettet som en del av dette innlegget.

konklusjonen

I dette innlegget demonstrerte vi hvordan du setter opp en Kinesis-datastrøm, konfigurerer en produsent og publiserer data til strømmer, og deretter oppretter en Amazon Redshift Streaming Ingestion-visning og spør etter dataene i Amazon Redshift. Etter at dataene var i Amazon Redshift-klyngen, demonstrerte vi hvordan man trener en ML-modell og bygger en prediksjonsfunksjon og bruker den mot strømmedataene for å generere spådommer nesten sanntid.

Hvis du har tilbakemeldinger eller spørsmål, vennligst legg igjen dem i kommentarfeltet.

Om forfatterne

Bhanu Pittampally er en Analytics Specialist Solutions Architect basert i Dallas. Han har spesialisert seg på å bygge analytiske løsninger. Hans bakgrunn er fra datavarehus – arkitektur, utvikling og administrasjon. Han har vært i data- og analysefeltet i over 15 år.

Bhanu Pittampally er en Analytics Specialist Solutions Architect basert i Dallas. Han har spesialisert seg på å bygge analytiske løsninger. Hans bakgrunn er fra datavarehus – arkitektur, utvikling og administrasjon. Han har vært i data- og analysefeltet i over 15 år.

Praveen Kadipikonda er en Senior Analytics Specialist Solutions Architect hos AWS basert i Dallas. Han hjelper kunder med å bygge effektive, effektive og skalerbare analytiske løsninger. Han har jobbet med å bygge databaser og datavarehusløsninger i over 15 år.

Praveen Kadipikonda er en Senior Analytics Specialist Solutions Architect hos AWS basert i Dallas. Han hjelper kunder med å bygge effektive, effektive og skalerbare analytiske løsninger. Han har jobbet med å bygge databaser og datavarehusløsninger i over 15 år.

Ritesh Kumar Sinha er en Analytics Specialist Solutions Architect basert i San Francisco. Han har hjulpet kunder med å bygge skalerbare datavarehus- og big data-løsninger i over 16 år. Han elsker å designe og bygge effektive ende-til-ende-løsninger på AWS. På fritiden elsker han å lese, gå og gjøre yoga.

Ritesh Kumar Sinha er en Analytics Specialist Solutions Architect basert i San Francisco. Han har hjulpet kunder med å bygge skalerbare datavarehus- og big data-løsninger i over 16 år. Han elsker å designe og bygge effektive ende-til-ende-løsninger på AWS. På fritiden elsker han å lese, gå og gjøre yoga.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- Platoblokkkjede. Web3 Metaverse Intelligence. Kunnskap forsterket. Tilgang her.

- kilde: https://aws.amazon.com/blogs/big-data/near-real-time-fraud-detection-using-amazon-redshift-streaming-ingestion-with-amazon-kinesis-data-streams-and-amazon-redshift-ml/

- 000

- 000 kunder

- 1

- 10

- 100

- 11

- 15 år

- 67

- 7

- 9

- a

- I stand

- Om oss

- ovenfor

- adgang

- Logg inn

- Oppnå

- Handling

- Ytterligere

- administrasjon

- avansert

- Etter

- mot

- Varsle

- Alle

- tillater

- Amazon

- Amazon EC2

- Amazon Kinesis

- beløp

- analytikere

- analytisk

- analytics

- analysere

- og

- anomali påvisning

- Apache

- Søknad

- Påfør

- påføring

- arkitektur

- rundt

- feste

- auto

- Automatisk

- automatisk

- tilgjengelig

- unngå

- AWS

- bakgrunn

- basert

- grunnleggende

- fordi

- blir

- BEST

- Bedre

- mellom

- Stor

- Store data

- bringe

- bygge

- Bygning

- virksomhet

- forretningsprosesser

- bedrifter

- ring

- som heter

- Samtaler

- fangst

- kort

- saken

- saker

- karakter

- avgifter

- sjekk

- Velg

- City

- Cloud

- Cluster

- kode

- kolonner

- skurtreskerne

- kommer

- kommentarer

- sammenligne

- fullføre

- fullført

- komplekse

- kompleksitet

- Beregn

- anser

- Konsoll

- forbruke

- forbruker

- inneholder

- kostnadseffektiv

- kunne

- skape

- opprettet

- skaper

- Opprette

- Credentials

- kreditt

- kredittkort

- kunde

- kunde Data

- Kunder

- sykluser

- daglig

- Dallas

- dato

- Dataklargjøring

- datalager

- datavarehus

- Database

- databaser

- datasett

- Dato

- Beslutningstaking

- Misligholde

- definere

- leverer

- demonstrert

- avhengig

- utplassere

- utplassert

- Distribueres

- beskrevet

- utforming

- detaljer

- Gjenkjenning

- utviklere

- Utvikling

- forskjellig

- direkte

- ikke

- gjør

- ikke

- dow

- dynamisk

- lett

- lett-å-bruke

- effekt

- effektiv

- emalje

- muliggjøre

- muliggjør

- ende til ende

- Ingeniørarbeid

- Enter

- Eter (ETH)

- Event

- hendelser

- eksempel

- opphisset

- utvendig

- utdrag

- f1

- kjent

- FAST

- Trekk

- Egenskaper

- tilbakemelding

- felt

- Felt

- filtre

- finansiell

- Finn

- flagg

- flyten

- følge

- etter

- følger

- skjema

- format

- funnet

- RAMME

- Francisco

- svindel

- svindeloppdagelse

- Gratis

- Frekvens

- fra

- fullt

- funksjon

- funksjoner

- framtid

- generere

- generert

- genererer

- generator

- få

- Gi

- Go

- god

- innvilge

- Ground

- Gruppe

- å ha

- hjulpet

- hjelper

- høyere

- Uthev

- historisk

- historie

- Hvordan

- Hvordan

- HTML

- HTTPS

- Hundrevis

- IAM

- identifisert

- Identitet

- betydning

- in

- inkludere

- Innkommende

- Øke

- økende

- individuelt

- informasjon

- Infrastruktur

- inngang

- Setter inn

- innsikt

- installere

- f.eks

- Institute

- instruksjoner

- interessert

- IT

- bli medlem

- JSON

- Kafka

- Kinesis datastrømmer

- Språk

- større

- Ventetid

- siste

- lansere

- læring

- Permisjon

- Lengde

- Nivå

- BEGRENSE

- begrensning

- laste

- laster

- langsiktig

- Lav

- maskin

- maskinlæring

- laget

- gjøre

- GJØR AT

- fikk til

- administrerende

- manuelt

- mange

- kart

- massivt

- matchende

- matplotlib

- max

- midler

- Media

- metode

- metrisk

- Metrics

- Minske

- ML

- Mote

- modell

- modeller

- månedlig

- måneder

- mer

- mest

- flytte

- navn

- Navigasjon

- Trenger

- behov

- Ny

- neste

- varsling

- Antall

- følelsesløs

- Målet

- ONE

- åpner

- drift

- operasjonell

- Drift

- Muligheter

- alternativer

- rekkefølge

- organisasjoner

- Annen

- skissert

- pakker

- pandaer

- brød

- parameter

- del

- perfekt

- utføre

- ytelse

- utfører

- tillatelser

- telefon

- Sted

- planlegging

- plattform

- Plattformer

- plato

- Platon Data Intelligence

- PlatonData

- vær så snill

- Politikk

- politikk

- mulig

- Post

- makt

- Precision

- forutsi

- prediksjon

- Spådommer

- spår

- forrige

- prising

- prosess

- Prosesser

- produsent

- program

- gi

- gir

- offentlig

- publisere

- Python

- spørsmål

- raskt

- tilfeldig

- Lesning

- klar

- ekte

- sanntids

- sanntidsdata

- realisere

- motta

- mottatt

- nylig

- gjenkjent

- poster

- GJENTATTE GANGER

- erstatte

- påkrevd

- ressurs

- Ressurser

- REST

- Resultater

- avkastning

- Risiko

- Rolle

- Kjør

- rennende

- sagemaker

- San

- San Fransisco

- skalerbar

- Skala

- skjermbilder

- SDK

- sjøfødt

- Sekund

- sekunder

- Seksjon

- seksjoner

- sikre

- valgt

- utvalg

- server~~POS=TRUNC

- tjeneste

- sett

- innstilling

- innstillinger

- oppsett

- kortsiktig

- Vis

- Viser

- Enkelt

- forenkle

- simulator

- So

- selskap

- sosiale medier

- løsning

- Solutions

- noen

- kilde

- Kilder

- spesialist

- spesialisert

- bruke

- splittet

- SQL

- Scene

- Standard

- startet

- Tilstand

- Uttalelse

- uttalelser

- status

- Trinn

- Steps

- lagring

- oppbevare

- butikker

- Strategisk

- stream

- streaming

- streaming tjeneste

- bekker

- slik

- Super

- system

- Systemer

- bord

- Ta

- tar

- Snakker

- Target

- terminal

- test

- De

- Tredje

- tusener

- Gjennom

- tid

- tidsstempel

- til

- topp

- Tema

- tradisjonelt

- Tog

- trent

- Kurs

- Transaksjonen

- transaksjonell

- Transaksjoner

- Transform

- transformasjoner

- transformere

- Trend

- Oppdater

- oppdatert

- bruk

- bruke

- Bruker

- validert

- verdi

- Verdier

- ulike

- Verity

- versjon

- Se

- visninger

- walking

- walkthrough

- Warehouse

- lager

- Nettsted

- helg

- ukentlig

- Hva

- hvilken

- mens

- Wikipedia

- vil

- uten

- arbeidet

- arbeid

- virker

- skrive

- år

- yoga

- Din

- zephyrnet