Die Bedeutung von Data Warehouses und Analysen, die auf Data Warehouse-Plattformen durchgeführt werden, hat im Laufe der Jahre stetig zugenommen, und viele Unternehmen verlassen sich auf diese Systeme, da sie sowohl für die kurzfristige operative Entscheidungsfindung als auch für die langfristige strategische Planung geschäftskritisch sind. Herkömmlicherweise werden Data Warehouses in Stapelzyklen aktualisiert, beispielsweise monatlich, wöchentlich oder täglich, damit Unternehmen daraus verschiedene Erkenntnisse ableiten können.

Viele Unternehmen erkennen, dass die Datenerfassung nahezu in Echtzeit zusammen mit erweiterten Analysen neue Möglichkeiten eröffnet. Beispielsweise kann ein Finanzinstitut vorhersagen, ob eine Kreditkartentransaktion betrügerisch ist, indem es ein Programm zur Erkennung von Anomalien nahezu in Echtzeit und nicht im Batch-Modus ausführt.

In diesem Beitrag zeigen wir wie Amazon RedShift kann Streaming-Aufnahme und Vorhersagen für maschinelles Lernen (ML) auf einer Plattform liefern.

Amazon Redshift ist ein schnelles, skalierbares, sicheres und vollständig verwaltetes Cloud Data Warehouse, mit dem Sie alle Ihre Daten einfach und kostengünstig mit Standard-SQL analysieren können.

Amazon Redshift ML erleichtert Datenanalysten und Datenbankentwicklern das Erstellen, Trainieren und Anwenden von ML-Modellen mit vertrauten SQL-Befehlen in Amazon Redshift Data Warehouses.

Wir freuen uns auf den Start Amazon Redshift-Streaming-Aufnahme für Amazon Kinesis-Datenströme und Amazon Managed Streaming für Apache Kafka (Amazon MSK), mit dem Sie Daten direkt aus einem Kinesis-Datenstrom oder Kafka-Thema aufnehmen können, ohne die Daten bereitstellen zu müssen Amazon Simple Storage-Service (Amazon S3). Amazon Redshift Streaming Ingestion ermöglicht Ihnen eine geringe Latenz in der Größenordnung von Sekunden zu erreichen, während Hunderte von Megabyte an Daten in Ihr Data Warehouse aufgenommen werden.

Dieser Beitrag zeigt, wie Sie mit Amazon Redshift, dem Cloud Data Warehouse, ML-Prognosen nahezu in Echtzeit erstellen können, indem Sie Amazon Redshift-Streaming-Ingestion und Redshift ML-Funktionen mit vertrauter SQL-Sprache verwenden.

Lösungsüberblick

Indem Sie die in diesem Beitrag beschriebenen Schritte befolgen, können Sie eine Produzenten-Streamer-Anwendung auf einem einrichten Amazon Elastic Compute-Cloud (Amazon EC2)-Instanz, die Kreditkartentransaktionen simuliert und Daten in Echtzeit an Kinesis Data Streams überträgt. Sie richten eine materialisierte Amazon Redshift Streaming Ingestion-Ansicht auf Amazon Redshift ein, in der Streaming-Daten empfangen werden. Sie trainieren und erstellen ein Redshift ML-Modell, um Echtzeit-Inferenzen für die Streaming-Daten zu generieren.

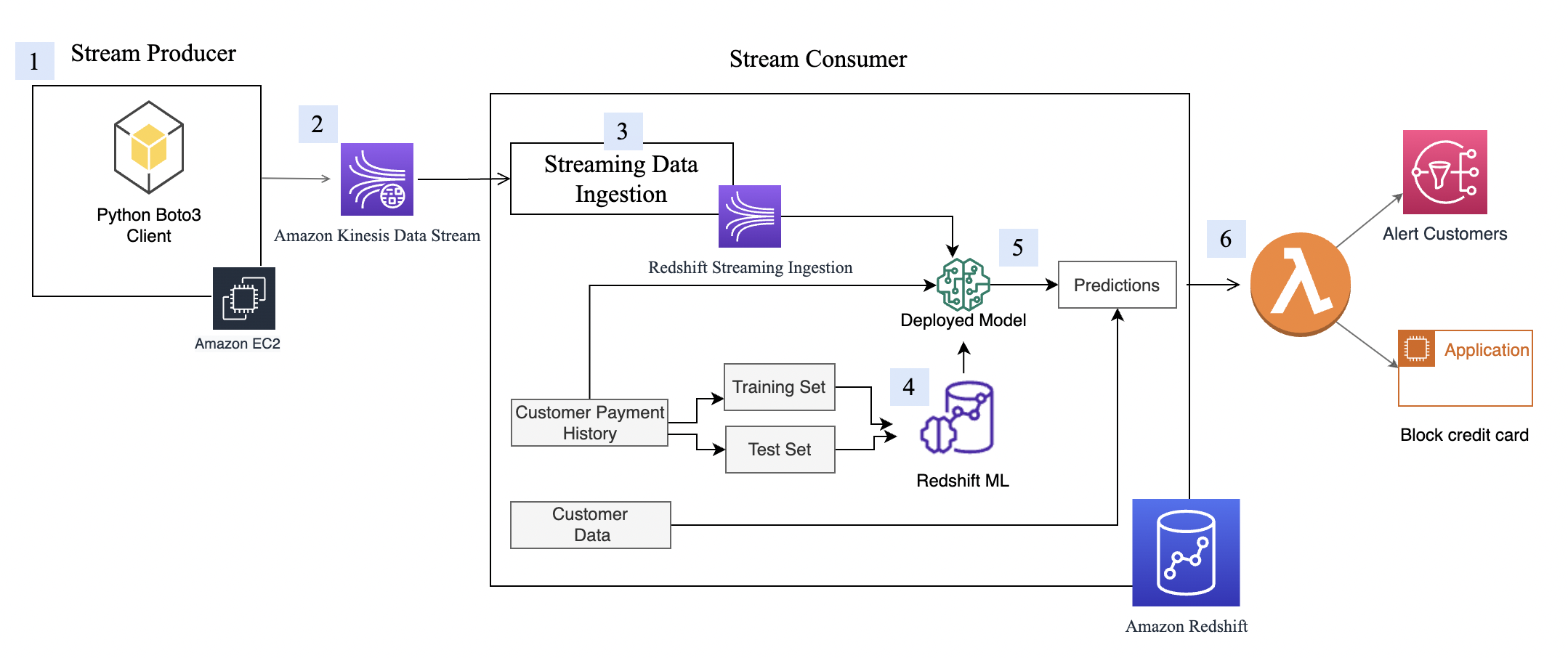

Das folgende Diagramm veranschaulicht die Architektur und den Prozessablauf.

Der Schritt-für-Schritt-Prozess ist wie folgt:

- Die EC2-Instance simuliert eine Kreditkartentransaktionsanwendung, die Kreditkartentransaktionen in den Kinesis-Datenstrom einfügt.

- Der Datenstrom speichert die eingehenden Kreditkartentransaktionsdaten.

- Über dem Datenstrom wird eine materialisierte Amazon Redshift Streaming Ingestion-Ansicht erstellt, die Streaming-Daten automatisch in Amazon Redshift aufnimmt.

- Sie erstellen, trainieren und implementieren ein ML-Modell mit Redshift ML. Das Redshift ML-Modell wird mit historischen Transaktionsdaten trainiert.

- Sie transformieren die Streaming-Daten und generieren ML-Vorhersagen.

- Sie können Kunden benachrichtigen oder die Anwendung aktualisieren, um das Risiko zu mindern.

Diese exemplarische Vorgehensweise verwendet Streamingdaten für Kreditkartentransaktionen. Die Kreditkartentransaktionsdaten sind fiktiv und basieren auf a Simulator. Der Kundendatensatz ist ebenfalls fiktiv und wird mit einigen zufälligen Datenfunktionen generiert.

Voraussetzungen:

- Erstellen Sie einen Amazon Redshift-Cluster.

- Konfigurieren Sie den Cluster für die Verwendung von Redshift ML.

- Erstellen an AWS Identity and Access Management and (IAM) Benutzer.

- Aktualisieren Sie die dem Redshift-Cluster zugeordnete IAM-Rolle, um Berechtigungen für den Zugriff auf den Kinesis-Datenstrom einzuschließen. Weitere Informationen zu den erforderlichen Richtlinien finden Sie unter Erste Schritte mit der Streamingaufnahme.

- Erstellen Sie eine m5.4xlarge EC2-Instance. Wir haben die Producer-Anwendung mit der m5.4xlarge-Instance getestet, aber Sie können auch andere Instance-Typen verwenden. Verwenden Sie beim Erstellen der Instanz die amzn2-ami-kernel-5.10-hvm-2.0.20220426.0-x86_64-gp2 Freund.

- Um sicherzustellen, dass Python3 in der EC2-Instanz installiert ist, führen Sie den folgenden Befehl aus, um Ihre Python-Version zu überprüfen (beachten Sie, dass das Datenextraktionsskript nur auf Python 3 funktioniert):

- Installieren Sie die folgenden abhängigen Pakete, um das Simulatorprogramm auszuführen:

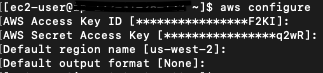

- Konfigurieren Sie Amazon EC2 mit den Variablen wie AWS-Anmeldeinformationen, die für den in Schritt 3 oben erstellten IAM-Benutzer generiert wurden. Der folgende Screenshot zeigt ein Beispiel mit aws konfigurieren.

Richten Sie Kinesis Data Streams ein

Amazon Kinesis Data Streams ist ein massiv skalierbarer und langlebiger Daten-Streaming-Service in Echtzeit. Es kann kontinuierlich Gigabyte an Daten pro Sekunde aus Hunderttausenden von Quellen erfassen, z. B. Website-Clickstreams, Datenbankereignisströme, Finanztransaktionen, Social-Media-Feeds, IT-Protokolle und Standortverfolgungsereignisse. Die gesammelten Daten sind in Millisekunden verfügbar, um Anwendungsfälle für Echtzeitanalysen wie Echtzeit-Dashboards, Echtzeit-Anomalieerkennung, dynamische Preisgestaltung und mehr zu ermöglichen. Wir verwenden Kinesis Data Streams, weil es sich um eine serverlose Lösung handelt, die je nach Nutzung skaliert werden kann.

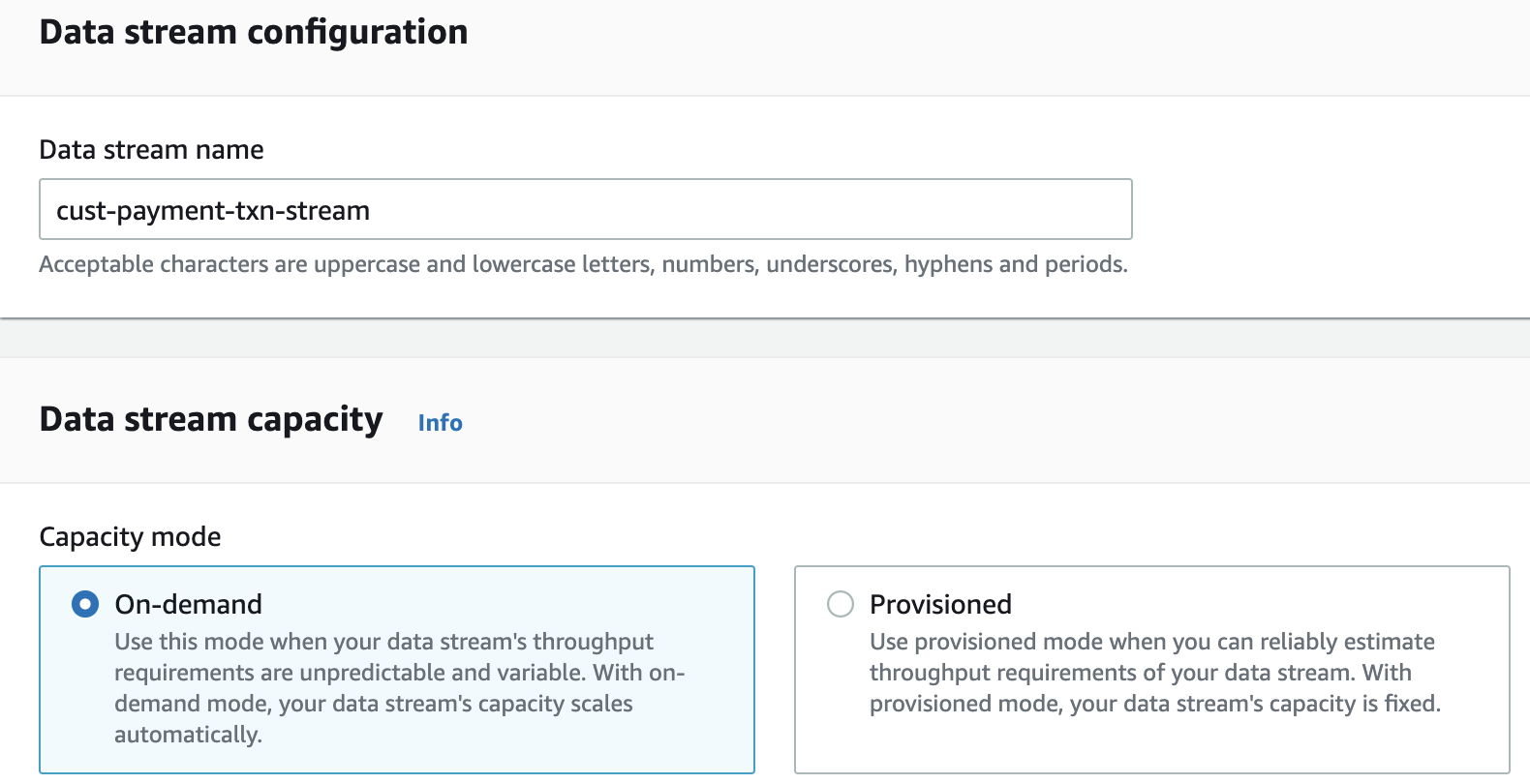

Erstellen Sie einen Kinesis-Datenstrom

Zuerst müssen Sie einen Kinesis-Datenstrom erstellen, um die Streaming-Daten zu empfangen:

- Wählen Sie in der Amazon Kinesis-Konsole aus Datenströme im Navigationsbereich.

- Auswählen Datenstrom erstellen.

- Aussichten für Name des Datenstroms, eingeben

cust-payment-txn-stream. - Aussichten für KapazitätsmodusWählen Auf Nachfrage.

- Wählen Sie für die restlichen Optionen die Standardoptionen und befolgen Sie die Anweisungen, um die Einrichtung abzuschließen.

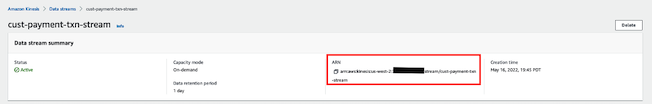

- Erfassen Sie den ARN für den erstellten Datenstrom, der im nächsten Abschnitt beim Definieren Ihrer IAM-Richtlinie verwendet werden soll.

Berechtigungen einrichten

Damit eine Streaming-Anwendung in Kinesis Data Streams schreiben kann, muss die Anwendung Zugriff auf Kinesis haben. Sie können die folgende Richtlinienanweisung verwenden, um dem Simulatorprozess, den Sie im nächsten Abschnitt einrichten, Zugriff auf den Datenstrom zu gewähren. Verwenden Sie den ARN des Datenstroms, den Sie im vorherigen Schritt gespeichert haben.

Konfigurieren Sie den Stream-Produzenten

Bevor wir Streaming-Daten in Amazon Redshift nutzen können, benötigen wir eine Streaming-Datenquelle, die Daten in den Kinesis-Datenstrom schreibt. Dieser Beitrag verwendet einen benutzerdefinierten Datengenerator und die AWS SDK für Python (Boto3) um die Daten im Datenstrom zu veröffentlichen. Anweisungen zur Einrichtung finden Sie unter Produzenten-Simulator. Dieser Simulatorprozess veröffentlicht Streaming-Daten in dem im vorherigen Schritt erstellten Datenstrom (cust-payment-txn-stream).

Konfigurieren Sie den Stream-Consumer

In diesem Abschnitt geht es um die Konfiguration des Stream-Consumers (die Amazon Redshift-Streaming-Erfassungsansicht).

Amazon Redshift Streaming Ingestion ermöglicht die schnelle Aufnahme von Streaming-Daten aus Kinesis Data Streams mit geringer Latenz in eine materialisierte Amazon Redshift-Ansicht. Sie können Ihren Amazon Redshift-Cluster konfigurieren, um die Streaming-Aufnahme zu ermöglichen und eine materialisierte Ansicht mit automatischer Aktualisierung zu erstellen, indem Sie SQL-Anweisungen verwenden, wie in beschrieben Erstellen von materialisierten Ansichten in Amazon Redshift. Der automatische Aktualisierungsprozess der materialisierten Ansicht nimmt Streaming-Daten mit Hunderten von Megabyte an Daten pro Sekunde von Kinesis Data Streams in Amazon Redshift auf. Dies führt zu einem schnellen Zugriff auf externe Daten, die schnell aktualisiert werden.

Nachdem Sie die materialisierte Ansicht erstellt haben, können Sie mithilfe von SQL auf Ihre Daten aus dem Datenstrom zugreifen und Ihre Datenpipelines vereinfachen, indem Sie materialisierte Ansichten direkt über dem Stream erstellen.

Führen Sie die folgenden Schritte aus, um eine materialisierte Amazon Redshift-Streaming-Ansicht zu konfigurieren:

- Wählen Sie in der IAM-Konsole Richtlinien im Navigationsbereich aus.

- Auswählen Richtlinie erstellen.

- Erstellen Sie eine neue IAM-Richtlinie mit dem Namen

KinesisStreamPolicy. Informationen zur Streaming-Richtliniendefinition finden Sie unter Erste Schritte mit der Streamingaufnahme. - Wählen Sie im Navigationsbereich Rollen.

- Wählen Sie Rolle erstellen.

- Auswählen AWS-Service und wählen Sie Redshift und Redshift anpassbar.

- Erstellen Sie eine neue Rolle mit dem Namen

redshift-streaming-roleund fügen Sie die Police beiKinesisStreamPolicy. - Erstellen Sie ein externes Schema, um es Kinesis Data Streams zuzuordnen:

Jetzt können Sie eine materialisierte Ansicht erstellen, um die Stream-Daten zu nutzen. Sie können den SUPER-Datentyp verwenden, um die Nutzdaten unverändert im JSON-Format zu speichern, oder Amazon Redshift-JSON-Funktionen verwenden, um die JSON-Daten in einzelne Spalten zu parsen. Für diesen Beitrag verwenden wir die zweite Methode, da das Schema gut definiert ist.

- Erstellen Sie die materialisierte Ansicht für die Streamingaufnahme

cust_payment_tx_stream. Durch Angabe von AUTO REFRESH YES im folgenden Code können Sie die automatische Aktualisierung der Streamingaufnahmeansicht aktivieren, was Zeit spart, indem das Erstellen von Datenpipelines vermieden wird:

Beachten Sie, dass json_extract_path_text hat eine Längenbeschränkung von 64 KB. Auch from_varbye filtert Datensätze, die größer als 65 KB sind.

- Aktualisieren Sie die Daten.

Die materialisierte Streaming-Ansicht von Amazon Redshift wird automatisch von Amazon Redshift für Sie aktualisiert. Auf diese Weise müssen Sie sich keine Gedanken über veraltete Daten machen. Mit der automatischen Aktualisierung der materialisierten Ansicht werden Daten automatisch in Amazon Redshift geladen, sobald sie im Stream verfügbar sind. Wenn Sie diesen Vorgang manuell ausführen möchten, verwenden Sie den folgenden Befehl:

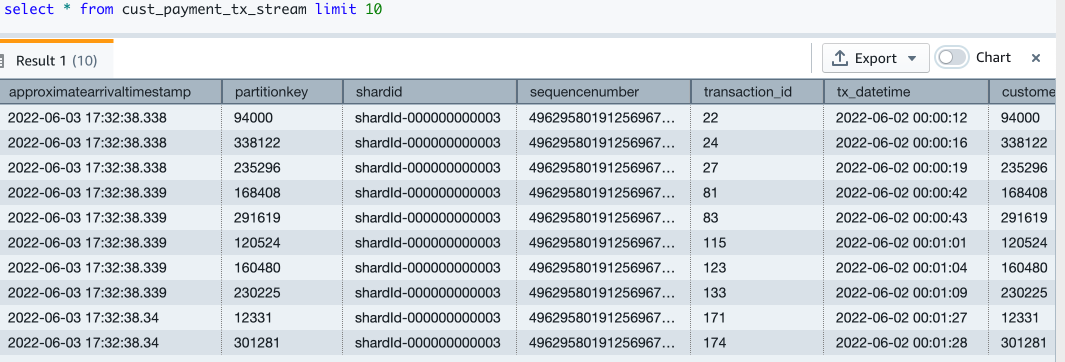

- Lassen Sie uns nun die materialisierte Streaming-Ansicht abfragen, um Beispieldaten anzuzeigen:

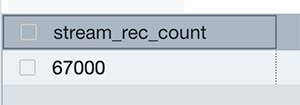

- Lassen Sie uns überprüfen, wie viele Datensätze sich jetzt in der Streaming-Ansicht befinden:

Jetzt haben Sie die Einrichtung der Amazon Redshift-Streaming-Aufnahmeansicht abgeschlossen, die kontinuierlich mit eingehenden Kreditkartentransaktionsdaten aktualisiert wird. In meinem Setup sehe ich, dass zu dem Zeitpunkt, als ich meine Select-Count-Abfrage ausführte, etwa 67,000 Datensätze in die Streaming-Ansicht gezogen wurden. Diese Nummer kann bei Ihnen anders sein.

Rotverschiebung ML

Mit Redshift ML können Sie ein vortrainiertes ML-Modell verwenden oder eines nativ erstellen. Weitere Informationen finden Sie unter Verwenden von maschinellem Lernen in Amazon Redshift.

In diesem Beitrag trainieren und erstellen wir ein ML-Modell mit einem historischen Datensatz. Die Daten enthalten a tx_fraud Feld, das eine historische Transaktion als betrügerisch kennzeichnet oder nicht. Wir erstellen ein überwachtes ML-Modell mit Redshift Auto ML, das aus diesem Datensatz lernt und eingehende Transaktionen vorhersagt, wenn diese die Vorhersagefunktionen durchlaufen.

In den folgenden Abschnitten zeigen wir, wie Sie den historischen Datensatz und die Kundendaten einrichten.

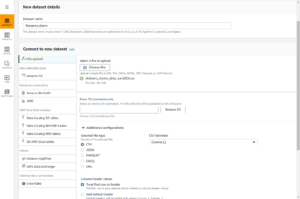

Laden Sie den historischen Datensatz

Die Verlaufstabelle hat mehr Felder als die Streaming-Datenquelle. Diese Felder enthalten die letzten Ausgaben des Kunden und den Endrisikowert, wie z. B. die Anzahl betrügerischer Transaktionen, die durch Umwandlung von Streaming-Daten berechnet wurden. Es gibt auch kategoriale Variablen wie Wochenendtransaktionen oder Nachttransaktionen.

Um die historischen Daten zu laden, führen Sie die Befehle mit der aus Amazon Redshift-Abfrageeditor.

Erstellen Sie die Transaktionsverlaufstabelle mit dem folgenden Code. Die DDL finden Sie auch unter GitHub.

Lassen Sie uns überprüfen, wie viele Transaktionen geladen werden:

Überprüfen Sie den monatlichen Trend zu betrügerischen und nicht betrügerischen Transaktionen:

Kundendaten erstellen und laden

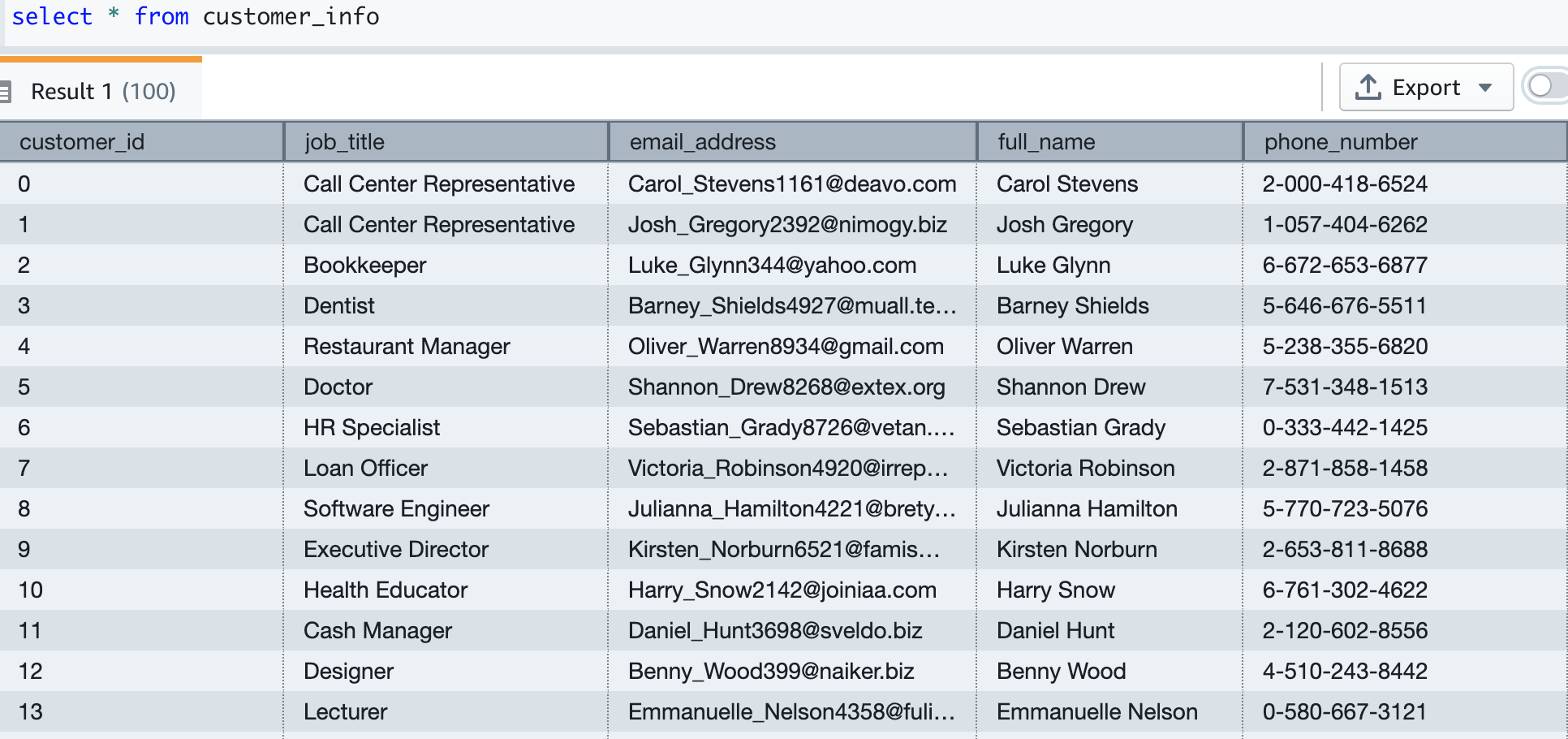

Jetzt erstellen wir die Kundentabelle und laden Daten, die die E-Mail und Telefonnummer des Kunden enthalten. Der folgende Code erstellt die Tabelle, lädt die Daten und testet die Tabelle. Die Tabellen-DDL ist verfügbar unter GitHub.

Unsere Testdaten haben etwa 5,000 Kunden. Der folgende Screenshot zeigt beispielhafte Kundendaten.

Erstellen Sie ein ML-Modell

Unsere historische Kartentransaktionstabelle enthält Daten aus 6 Monaten, die wir jetzt zum Trainieren und Testen des ML-Modells verwenden.

Das Modell verwendet die folgenden Felder als Eingabe:

Wir bekommen tx_fraud als Ausgabe.

Wir teilen diese Daten in Trainings- und Testdatensätze auf. Transaktionen von 2022 bis 04 gelten für das Trainingsset. Für das Testset werden Transaktionen vom 01 bis 2022 verwendet.

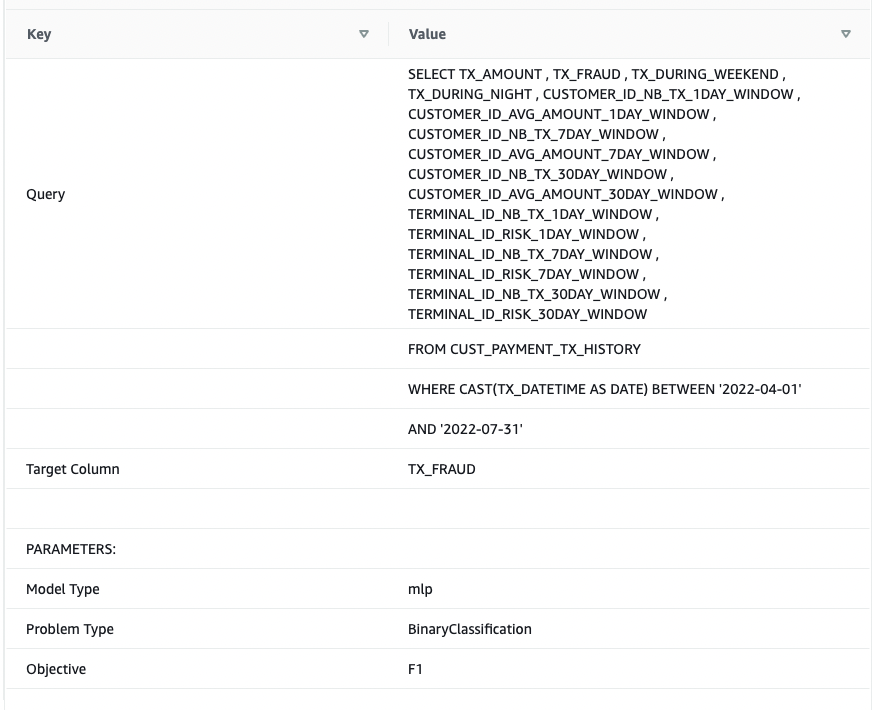

Lassen Sie uns das ML-Modell mit dem vertrauten SQL erstellen CREATE MODEL-Anweisung. Wir verwenden eine Grundform des Redshift ML-Befehls. Die folgende Methode verwendet Amazon SageMaker-Autopilot, das die Datenvorbereitung, das Feature-Engineering, die Modellauswahl und das Training automatisch für Sie durchführt. Geben Sie den Namen Ihres S3-Buckets an, der den Code enthält.

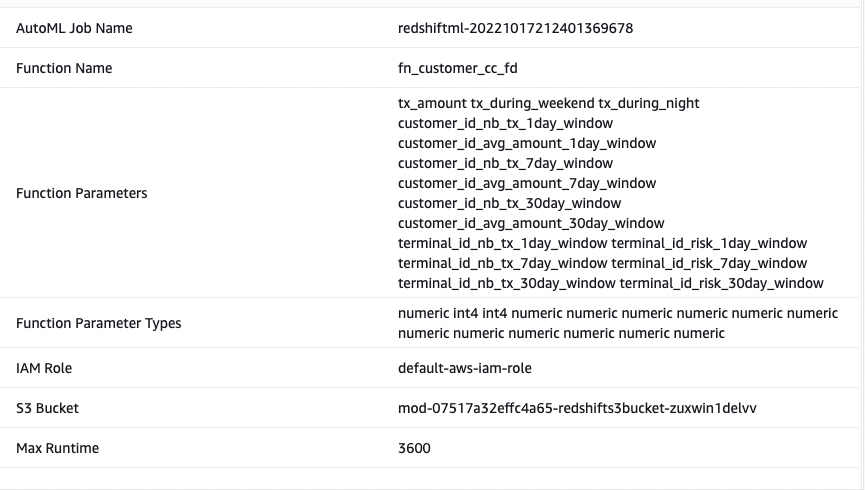

Ich nenne das ML-Modell als Cust_cc_txn_fd, und die Vorhersagefunktion als fn_customer_cc_fd. Die FROM-Klausel zeigt die Eingabespalten aus der historischen Tabelle public.cust_payment_tx_history. Der Zielparameter wird auf gesetzt tx_fraud, das ist die Zielvariable, die wir vorherzusagen versuchen. IAM_Role ist auf Standard gesetzt, weil der Cluster mit dieser Rolle konfiguriert ist; Wenn nicht, müssen Sie den ARN Ihrer Amazon Redshift-Cluster-IAM-Rolle angeben. Ich setze die max_runtime auf 3,600 Sekunden, das ist die Zeit, die wir SageMaker geben, um den Vorgang abzuschließen. Redshift ML setzt das beste Modell ein, das in diesem Zeitrahmen identifiziert wurde.

Je nach Komplexität des Modells und Datenmenge kann es einige Zeit dauern, bis das Modell verfügbar ist. Wenn Sie feststellen, dass Ihre Modellauswahl nicht vollständig ist, erhöhen Sie den Wert für max_runtime. Sie können einen Maximalwert von 9999 festlegen.

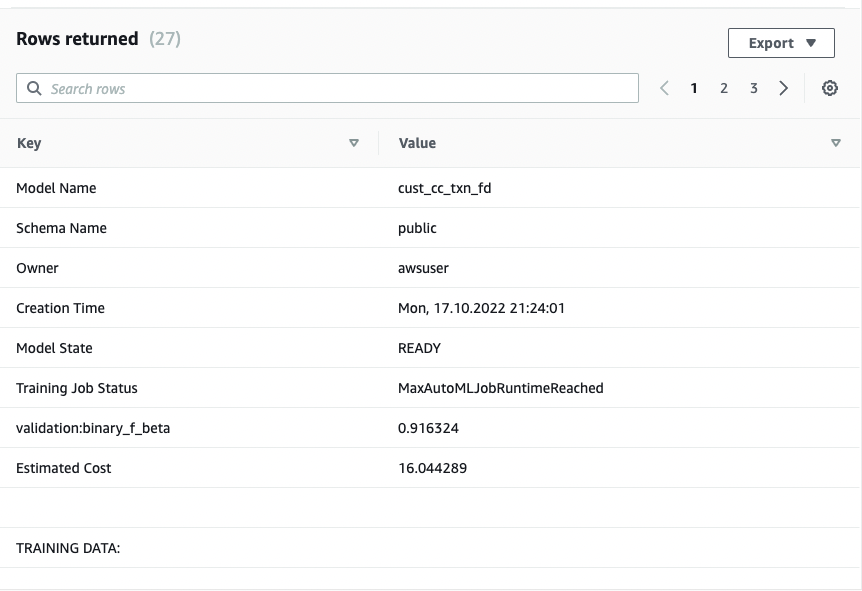

Der Befehl CREATE MODEL wird asynchron ausgeführt, d. h. er läuft im Hintergrund. Du kannst den ... benutzen MODELL ANZEIGEN Befehl, um den Status des Modells anzuzeigen. Wenn der Status als Bereit angezeigt wird, bedeutet dies, dass das Modell trainiert und bereitgestellt wurde.

Die folgenden Screenshots zeigen unsere Ausgabe.

Aus der Ausgabe sehe ich, dass das Modell korrekt als erkannt wurde BinaryClassification, und F1 wurde als Ziel ausgewählt. Die F1-Punktzahl ist eine Metrik, die beides berücksichtigt Präzision und Erinnerung. Es gibt einen Wert zwischen 1 (perfekte Präzision und Erinnerung) und 0 (niedrigstmögliche Punktzahl) zurück. Bei mir sind es 0.91. Je höher der Wert, desto besser die Modellleistung.

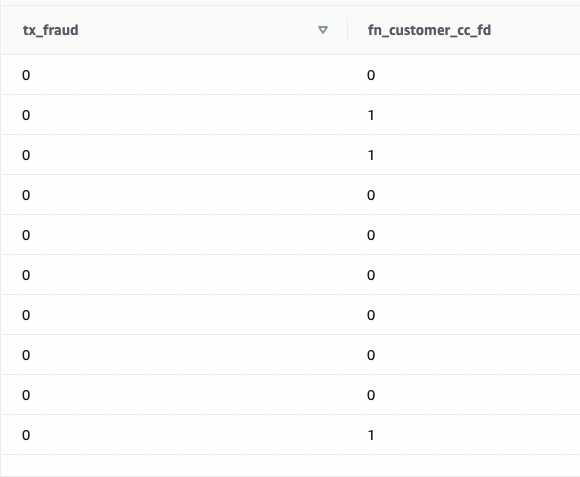

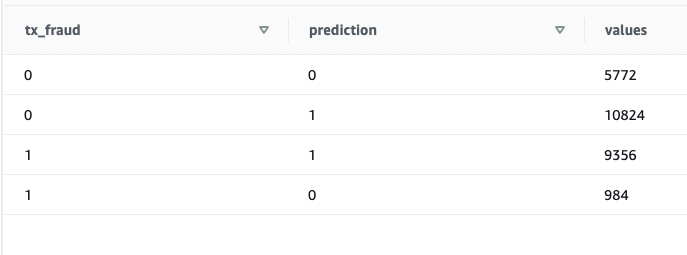

Lassen Sie uns dieses Modell mit dem Testdatensatz testen. Führen Sie den folgenden Befehl aus, der Beispielvorhersagen abruft:

Wir sehen, dass einige Werte übereinstimmen und andere nicht. Vergleichen wir Vorhersagen mit der Wahrheit:

Wir haben bestätigt, dass das Modell funktioniert und die F1-Punktzahl gut ist. Fahren wir mit dem Generieren von Vorhersagen für Streaming-Daten fort.

Sagen Sie betrügerische Transaktionen voraus

Da das Redshift ML-Modell einsatzbereit ist, können wir es verwenden, um die Vorhersagen für die Aufnahme von Streaming-Daten auszuführen. Das historische Dataset hat mehr Felder als wir in der Streaming-Datenquelle haben, aber es handelt sich lediglich um Aktualitäts- und Häufigkeitsmetriken rund um das Kunden- und Terminalrisiko für eine betrügerische Transaktion.

Wir können die Transformationen sehr einfach auf die Streaming-Daten anwenden, indem wir die SQL in die Ansichten einbetten. Erstellen Sie die Erster Blick, das Streaming-Daten auf Kundenebene aggregiert. Erstellen Sie dann die zweite Ansicht, das Streaming-Daten auf Terminalebene aggregiert, und die dritte Ansicht, das eingehende Transaktionsdaten mit aggregierten Kunden- und Terminaldaten kombiniert und die Vorhersagefunktion an einem Ort aufruft. Der Code für die dritte Ansicht lautet wie folgt:

Führen Sie eine SELECT-Anweisung für die Ansicht aus:

Wenn Sie die SELECT-Anweisung wiederholt ausführen, durchlaufen die neuesten Kreditkartentransaktionen nahezu in Echtzeit Transformationen und ML-Vorhersagen.

Dies demonstriert die Leistungsfähigkeit von Amazon Redshift – mit benutzerfreundlichen SQL-Befehlen können Sie Streaming-Daten transformieren, indem Sie komplexe Fensterfunktionen anwenden und ein ML-Modell anwenden, um betrügerische Transaktionen in einem Schritt vorherzusagen, ohne komplexe Datenpipelines zu erstellen oder zu erstellen und zu verwalten zusätzliche Infrastruktur.

Erweitern Sie die Lösung

Da die Datenströme und ML-Vorhersagen nahezu in Echtzeit erfolgen, können Sie Geschäftsprozesse zur Benachrichtigung Ihrer Kunden erstellen Amazon Simple Notification Service (Amazon SNS) oder Sie sperren das Kreditkartenkonto des Kunden in einem laufenden System.

Dieser Beitrag geht nicht auf die Details dieser Vorgänge ein, aber wenn Sie daran interessiert sind, mehr über das Erstellen ereignisgesteuerter Lösungen mit Amazon Redshift zu erfahren, lesen Sie Folgendes GitHub-Repository.

Aufräumen

Um zukünftige Gebühren zu vermeiden, löschen Sie die Ressourcen, die im Rahmen dieses Beitrags erstellt wurden.

Zusammenfassung

In diesem Beitrag haben wir gezeigt, wie Sie einen Kinesis-Datenstream einrichten, einen Produzenten konfigurieren und Daten in Streams veröffentlichen und dann eine Amazon Redshift Streaming Ingestion-Ansicht erstellen und die Daten in Amazon Redshift abfragen. Nachdem sich die Daten im Amazon Redshift-Cluster befanden, zeigten wir, wie man ein ML-Modell trainiert, eine Vorhersagefunktion erstellt und sie auf die Streaming-Daten anwendet, um Vorhersagen nahezu in Echtzeit zu generieren.

Wenn Sie Feedback oder Fragen haben, hinterlassen Sie diese bitte in den Kommentaren.

Über die Autoren

Bhanu Pittampally ist ein Analytics Specialist Solutions Architect mit Sitz in Dallas. Er ist spezialisiert auf den Aufbau analytischer Lösungen. Sein Hintergrund liegt in Data Warehouses – Architektur, Entwicklung und Verwaltung. Er ist seit über 15 Jahren im Bereich Daten und Analytik tätig.

Bhanu Pittampally ist ein Analytics Specialist Solutions Architect mit Sitz in Dallas. Er ist spezialisiert auf den Aufbau analytischer Lösungen. Sein Hintergrund liegt in Data Warehouses – Architektur, Entwicklung und Verwaltung. Er ist seit über 15 Jahren im Bereich Daten und Analytik tätig.

Praveen Kadipikonda ist Senior Analytics Specialist Solutions Architect bei AWS mit Sitz in Dallas. Er hilft Kunden beim Aufbau effizienter, leistungsfähiger und skalierbarer Analyselösungen. Er arbeitet seit über 15 Jahren mit dem Aufbau von Datenbanken und Data-Warehouse-Lösungen.

Praveen Kadipikonda ist Senior Analytics Specialist Solutions Architect bei AWS mit Sitz in Dallas. Er hilft Kunden beim Aufbau effizienter, leistungsfähiger und skalierbarer Analyselösungen. Er arbeitet seit über 15 Jahren mit dem Aufbau von Datenbanken und Data-Warehouse-Lösungen.

Ritesh Kumar Sinha ist ein Analytics Specialist Solutions Architect mit Sitz in San Francisco. Seit über 16 Jahren unterstützt er Kunden beim Aufbau skalierbarer Data-Warehousing- und Big-Data-Lösungen. Er liebt es, effiziente End-to-End-Lösungen auf AWS zu entwerfen und zu erstellen. In seiner Freizeit liebt er es zu lesen, spazieren zu gehen und Yoga zu machen.

Ritesh Kumar Sinha ist ein Analytics Specialist Solutions Architect mit Sitz in San Francisco. Seit über 16 Jahren unterstützt er Kunden beim Aufbau skalierbarer Data-Warehousing- und Big-Data-Lösungen. Er liebt es, effiziente End-to-End-Lösungen auf AWS zu entwerfen und zu erstellen. In seiner Freizeit liebt er es zu lesen, spazieren zu gehen und Yoga zu machen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/big-data/near-real-time-fraud-detection-using-amazon-redshift-streaming-ingestion-with-amazon-kinesis-data-streams-and-amazon-redshift-ml/

- 000

- 000-Kunden

- 1

- 10

- 100

- 11

- 15 Jahre

- 67

- 7

- 9

- a

- Fähig

- Über uns

- oben

- Zugang

- Konto

- Erreichen

- Action

- Zusätzliche

- Verwaltung

- advanced

- Nach der

- gegen

- Aufmerksam

- Alle

- erlaubt

- Amazon

- Amazon EC2

- Amazon Kinesis

- Betrag

- Business Analysten

- Analytisch

- Analytik

- analysieren

- und

- Anomalieerkennung

- Apache

- Anwendung

- Jetzt bewerben

- Anwendung

- Architektur

- um

- anhängen

- Auto

- automatische

- Im Prinzip so, wie Sie es von Google Maps kennen.

- verfügbar

- Vermeidung von

- AWS

- Hintergrund

- basierend

- basic

- weil

- wird

- BESTE

- Besser

- zwischen

- Big

- Big Data

- bringen

- bauen

- Building

- Geschäft

- Geschäftsprozesse

- Unternehmen

- rufen Sie uns an!

- namens

- Aufrufe

- Erfassung

- Karte

- Häuser

- Fälle

- Charakter

- Gebühren

- aus der Ferne überprüfen

- Auswählen

- Stadt

- Cloud

- Cluster

- Code

- Spalten

- vereint

- Kommen

- Bemerkungen

- vergleichen

- abschließen

- Abschluss

- Komplex

- Komplexität

- Berechnen

- überlegt

- Konsul (Console)

- verbrauchen

- Verbraucher

- enthält

- kostengünstiger

- könnte

- erstellen

- erstellt

- schafft

- Erstellen

- Referenzen

- Kredit

- Kreditkarte

- Kunde

- Kundendaten

- Kunden

- Zyklen

- Unterricht

- Dallas

- technische Daten

- Datenaufbereitung

- Data Warehouse

- Data Warehouse

- Datenbase

- Datenbanken

- Datensätze

- Datum

- Decision Making

- Standard

- Definition

- Übergeben

- weisen nach, dass

- abhängig

- einsetzen

- Einsatz

- setzt ein

- beschrieben

- Design

- Details

- Entdeckung

- Entwickler

- Entwicklung

- anders

- Direkt

- Tut nicht

- Dabei

- Nicht

- dow

- dynamisch

- leicht

- einfach zu bedienende

- bewirken

- effizient

- ermöglichen

- ermöglicht

- End-to-End

- Entwicklung

- Enter

- Äther (ETH)

- Event

- Veranstaltungen

- Beispiel

- aufgeregt

- extern

- Extraktion

- f1

- vertraut

- FAST

- Merkmal

- Eigenschaften

- Feedback

- Feld

- Felder

- Filter

- Revolution

- Finden Sie

- Fahnen

- Fluss

- folgen

- Folgende

- folgt

- unten stehende Formular

- Format

- gefunden

- FRAME

- Francisco cisco~~POS=HEADCOMP

- Betrug

- Betrugserkennung

- Frei

- Frequenz

- für

- voll

- Funktion

- Funktionen

- Zukunft

- erzeugen

- erzeugt

- Erzeugung

- Generator

- bekommen

- ABSICHT

- Go

- gut

- gewähren

- Boden

- Gruppe an

- mit

- dazu beigetragen,

- hilft

- höher

- Hervorheben

- historisch

- Geschichte

- Ultraschall

- Hilfe

- HTML

- HTTPS

- hunderte

- IAM

- identifiziert

- Identitätsschutz

- Bedeutung

- in

- das

- Eingehende

- Erhöhung

- zunehmend

- Krankengymnastik

- Information

- Infrastruktur

- Eingabe

- Einsätze

- Einblicke

- installieren

- Instanz

- Institut

- Anleitung

- interessiert

- IT

- join

- JSON

- kafka

- Kinesis-Datenströme

- Sprache

- größer

- Latency

- neueste

- starten

- lernen

- Verlassen

- Länge

- Niveau

- LIMIT

- Einschränkung

- Belastung

- Belastungen

- langfristig

- Sneaker

- Maschine

- Maschinelles Lernen

- gemacht

- um

- MACHT

- verwaltet

- flächendeckende Gesundheitsprogramme

- manuell

- viele

- Karte

- massiv

- Abstimmung

- Matplotlib

- max

- Mittel

- Medien

- Methode

- Metrisch

- Metrik

- Mildern

- ML

- Model

- Modell

- für

- monatlich

- Monat

- mehr

- vor allem warme

- schlauer bewegen

- Name

- Navigation

- Need

- Bedürfnisse

- Neu

- weiter

- Benachrichtigung

- Anzahl

- numpig

- Ziel

- EINEM

- öffnet

- Betrieb

- Betriebs-

- Einkauf & Prozesse

- Entwicklungsmöglichkeiten

- Optionen

- Auftrag

- Organisationen

- Andere

- skizzierte

- Pakete

- Pandas

- Brot

- Parameter

- Teil

- perfekt

- ausführen

- Leistung

- führt

- Berechtigungen

- Telefon

- Ort

- Planung

- Plattform

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Bitte

- Politik durchzulesen

- Datenschutzrichtlinien

- möglich

- Post

- Werkzeuge

- Präzision

- vorhersagen

- Prognose

- Prognosen

- sagt voraus,

- früher

- gebühr

- Prozessdefinierung

- anpassen

- Hersteller

- Programm

- die

- bietet

- Öffentlichkeit

- veröffentlichen

- Python

- Fragen

- schnell

- zufällig

- Lesebrillen

- bereit

- echt

- Echtzeit

- Echtzeitdaten

- Realisierung

- erhalten

- Received

- kürzlich

- anerkannt

- Aufzeichnungen

- WIEDERHOLT

- ersetzen

- falls angefordert

- Ressourcen

- Downloads

- REST

- Die Ergebnisse

- Rückgabe

- Risiko

- Rollen

- Führen Sie

- Laufen

- sagemaker

- San

- San Francisco

- skalierbaren

- Skalieren

- Screenshots

- Sdk

- Seeschneur

- Zweite

- Sekunden

- Abschnitt

- Abschnitte

- Verbindung

- ausgewählt

- Auswahl

- Serverlos

- kompensieren

- Einstellung

- Einstellungen

- Setup

- kurzfristig

- erklären

- Konzerte

- Einfacher

- vereinfachen

- Simulator

- So

- Social Media

- Social Media

- Lösung

- Lösungen

- einige

- Quelle

- Quellen

- Spezialist

- spezialisiert

- verbringen

- gespalten

- SQL

- Stufe

- Standard

- begonnen

- Bundesstaat

- Erklärung

- Aussagen

- Status

- Schritt

- Shritte

- storage

- speichern

- Läden

- Strategisch

- Strom

- Streaming

- Streaming-Service

- Ströme

- so

- Super

- System

- Systeme und Techniken

- Tabelle

- Nehmen

- nimmt

- Gespräche

- Target

- Terminal

- Test

- Das

- Dritte

- Tausende

- Durch

- Zeit

- Zeitstempel

- zu

- Top

- Thema

- traditionell

- Training

- trainiert

- Ausbildung

- Transaktion

- Transaktion

- Transaktionen

- Transformieren

- Transformationen

- Transformieren

- Trend

- Aktualisierung

- aktualisiert

- Anwendungsbereich

- -

- Mitglied

- validiert

- Wert

- Werte

- verschiedene

- Wahrheit

- Version

- Anzeigen

- Ansichten

- Gehen

- Walkthrough

- Warehouse

- Lagerung

- Webseite

- Wochenende

- wöchentlich

- Was

- welche

- während

- Wikipedia

- werden wir

- ohne

- gearbeitet

- arbeiten,

- Werk

- schreiben

- Jahr

- Yoga

- Ihr

- Zephyrnet