Важливість сховищ даних і аналітики, що виконується на платформах сховищ даних, неухильно зростає протягом багатьох років, і багато компаній починають покладатися на ці системи як на критично важливу роль як для прийняття короткострокових операційних рішень, так і для довгострокового стратегічного планування. Традиційно сховища даних оновлюються в пакетних циклах, наприклад, щомісяця, щотижня або щодня, щоб компанії могли отримувати з них різноманітну інформацію.

Багато організацій усвідомлюють, що прийом даних майже в реальному часі разом із розширеною аналітикою відкриває нові можливості. Наприклад, фінансова установа може передбачити, чи є транзакція кредитної картки шахрайською, запустивши програму виявлення аномалій у режимі майже в реальному часі, а не в пакетному режимі.

У цій публікації ми покажемо, як це зробити Амазонська червона зміна може надавати потокове передавання даних і прогнози машинного навчання (ML) на одній платформі.

Amazon Redshift — це швидке, масштабоване, безпечне та повністю кероване хмарне сховище даних, яке дозволяє легко та економічно ефективно аналізувати всі ваші дані за допомогою стандартного SQL.

Amazon Redshift ML дозволяє аналітикам даних і розробникам баз даних легко створювати, навчати та застосовувати моделі ML за допомогою знайомих команд SQL у сховищах даних Amazon Redshift.

Ми раді запуску Amazon Redshift Streaming Ingesting та цінності Потоки даних Amazon Kinesis та Amazon керував потоковим передаванням для Apache Kafka (Amazon MSK), який дає змогу отримувати дані безпосередньо з потоку даних Kinesis або теми Kafka без необхідності впорядковувати дані в Служба простого зберігання Amazon (Amazon S3). Потокова передача Amazon Redshift дозволяє досягти низької затримки в секундах, надаючи сотні мегабайт даних у ваше сховище даних.

Ця публікація демонструє, як Amazon Redshift, хмарне сховище даних, дозволяє створювати прогнози ML майже в реальному часі за допомогою потокового прийому Amazon Redshift і функцій Redshift ML зі знайомою мовою SQL.

Огляд рішення

Дотримуючись кроків, описаних у цій публікації, ви зможете налаштувати програму виробника стримера на Обчислювальна хмара Amazon Elastic (Amazon EC2), який імітує транзакції кредитної картки та надсилає дані до Kinesis Data Streams у режимі реального часу. Ви налаштували матеріалізоване подання Amazon Redshift Streaming Ingestion на Amazon Redshift, де приймаються потокові дані. Ви тренуєте та створюєте модель Redshift ML для створення висновків у реальному часі на основі потокових даних.

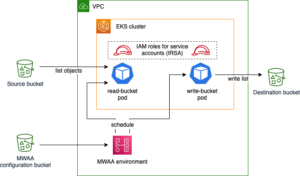

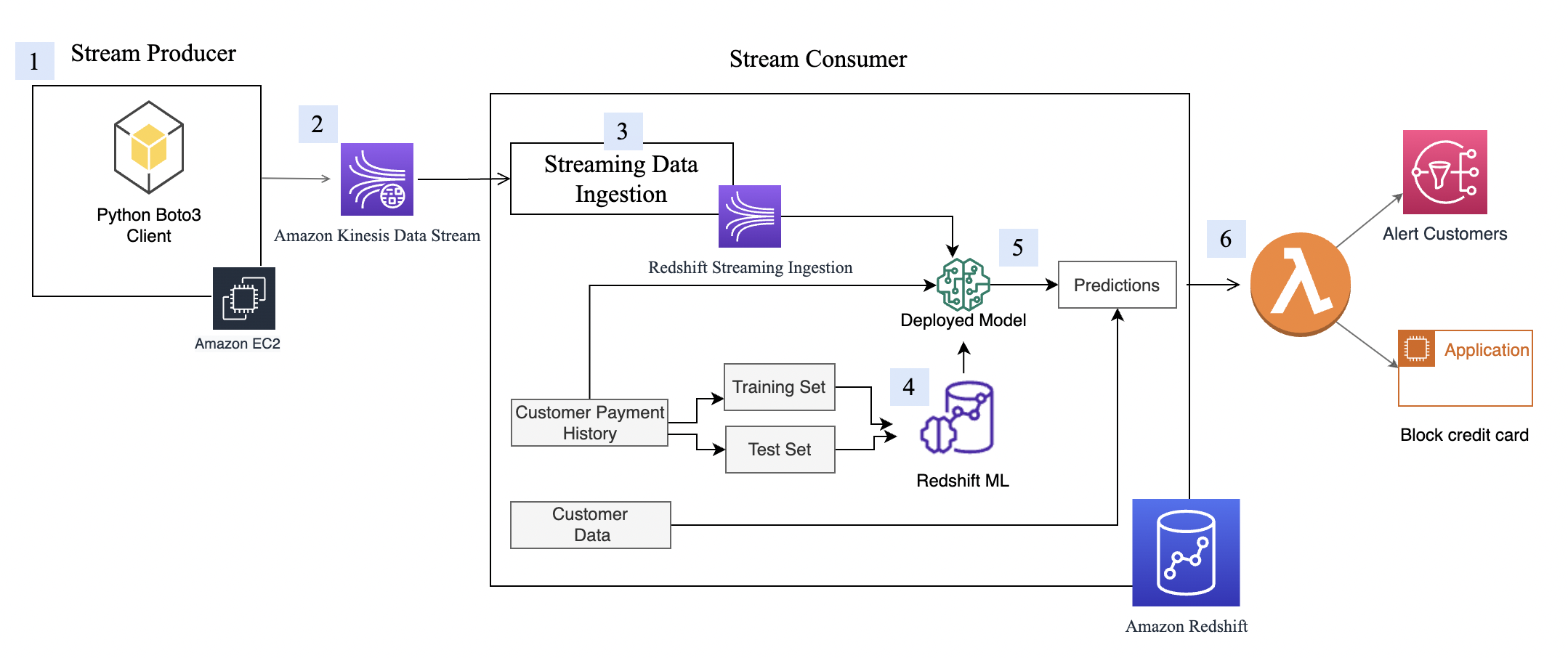

Наступна діаграма ілюструє архітектуру та процес.

Покроковий процес такий:

- Екземпляр EC2 імітує програму транзакцій кредитної картки, яка вставляє транзакції кредитної картки в потік даних Kinesis.

- Потік даних зберігає вхідні дані транзакцій кредитної картки.

- Поверх потоку даних створюється матеріалізоване подання Amazon Redshift Streaming Ingestion, яке автоматично надсилає потокові дані в Amazon Redshift.

- Ви створюєте, тренуєте та розгортаєте модель ML за допомогою Redshift ML. Модель Redshift ML навчається з використанням історичних даних транзакцій.

- Ви перетворюєте потокові дані та створюєте прогнози ML.

- Ви можете сповістити клієнтів або оновити програму, щоб зменшити ризик.

У цьому покроковому керівництві використовуються потокові дані транзакцій кредитної картки. Дані транзакцій кредитної картки є фіктивними та базуються на a симулятор. Набір даних клієнта також є фіктивним і генерується за допомогою деяких функцій випадкових даних.

Передумови

- Створіть кластер Amazon Redshift.

- Налаштуйте кластер на використання Redshift ML.

- Створювати an Управління ідентифікацією та доступом AWS (IAM).

- Оновіть роль IAM, приєднану до кластера Redshift, щоб включити дозволи на доступ до потоку даних Kinesis. Додаткову інформацію про необхідну політику див Початок роботи з трансляцією.

- Створіть екземпляр m5.4xlarge EC2. Ми протестували програму Producer з примірником m5.4xlarge, але ви можете використовувати інший тип примірника. Під час створення екземпляра використовуйте amzn2-ami-kernel-5.10-hvm-2.0.20220426.0-x86_64-gp2 AMI.

- Щоб переконатися, що Python3 інстальовано в примірнику EC2, виконайте таку команду, щоб перевірити вашу версію Python (зверніть увагу, що сценарій вилучення даних працює лише на Python 3):

- Установіть наступні залежні пакунки для запуску програми симулятора:

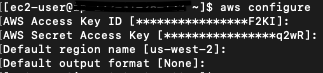

- Налаштуйте Amazon EC2 за допомогою таких змінних, як облікові дані AWS, створені для користувача IAM, створеного на кроці 3 вище. На наступному знімку екрана показано приклад використання налаштування окон.

Налаштуйте потоки даних Kinesis

Amazon Kinesis Data Streams — це широкомасштабована та довговічна служба потокової передачі даних у реальному часі. Він може безперервно отримувати гігабайти даних за секунду із сотень тисяч джерел, таких як потоки кліків веб-сайтів, потоки подій бази даних, фінансові транзакції, канали соціальних мереж, ІТ-журнали та події відстеження місцезнаходження. Зібрані дані доступні за мілісекунди, що дозволяє використовувати аналітику в реальному часі, наприклад, інформаційні панелі в реальному часі, виявлення аномалій у реальному часі, динамічне ціноутворення тощо. Ми використовуємо Kinesis Data Streams, оскільки це безсерверне рішення, яке може масштабуватися залежно від використання.

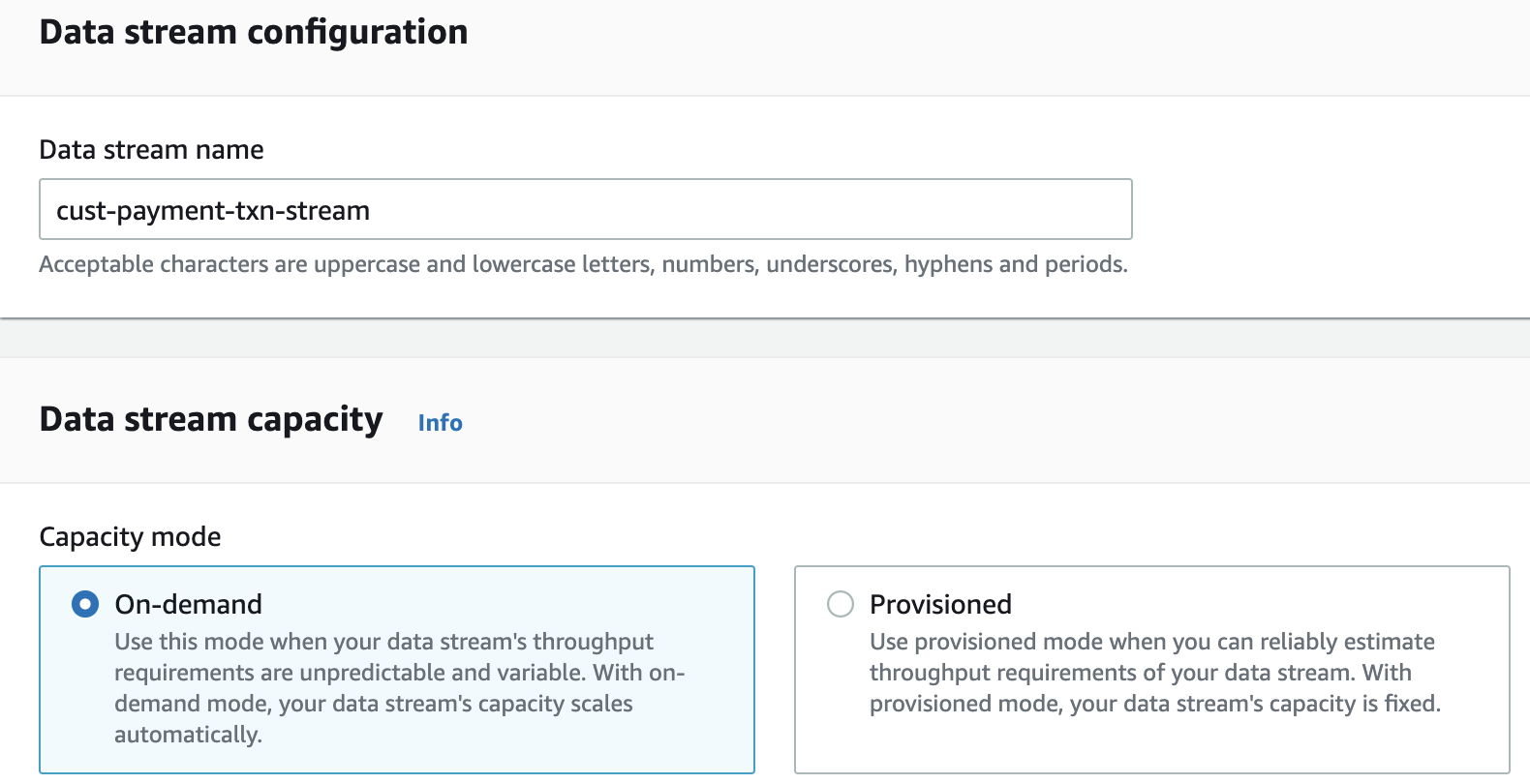

Створіть потік даних Kinesis

По-перше, вам потрібно створити потік даних Kinesis для отримання потокових даних:

- На консолі Amazon Kinesis виберіть Потоки даних у навігаційній панелі.

- Вибирати Створити потік даних.

- для Назва потоку даних, введіть

cust-payment-txn-stream. - для Режим ємностівиберіть На вимогу.

- Для решти параметрів виберіть параметри за замовчуванням і дотримуйтесь підказок, щоб завершити налаштування.

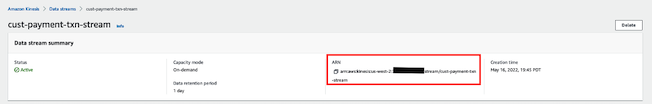

- Захопіть ARN для створеного потоку даних, щоб використовувати його в наступному розділі під час визначення політики IAM.

Налаштуйте дозволи

Щоб програма для потокового передавання записувала в Kinesis Data Streams, програма повинна мати доступ до Kinesis. Ви можете використати наведену нижче заяву політики, щоб надати процесу симулятора, який ви налаштували в наступному розділі, доступ до потоку даних. Використовуйте ARN потоку даних, який ви зберегли на попередньому кроці.

Налаштуйте виробника потоку

Перш ніж ми зможемо використовувати потокові дані в Amazon Redshift, нам потрібне джерело потокових даних, яке записує дані в потік даних Kinesis. У цьому дописі використовується спеціальний генератор даних і AWS SDK для Python (Boto3) щоб опублікувати дані в потоці даних. Інструкції з налаштування див Симулятор продюсера. Цей процес симулятора публікує потокові дані в потік даних, створений на попередньому кроці (cust-payment-txn-stream).

Налаштуйте споживача потоку

У цьому розділі йдеться про налаштування споживача потоку (перегляд передавання потокових даних Amazon Redshift).

Amazon Redshift Streaming Ingestion забезпечує низьку затримку та високу швидкість надсилання потокових даних із Kinesis Data Streams у матеріалізоване подання Amazon Redshift. Ви можете налаштувати свій кластер Amazon Redshift, щоб увімкнути потокове передавання та створити матеріалізоване подання з автоматичним оновленням за допомогою операторів SQL, як описано в розділі Створення матеріалізованих представлень у Amazon Redshift. Процес автоматичного оновлення матеріалізованого перегляду завантажуватиме потокові дані зі швидкістю сотні мегабайт даних на секунду з Kinesis Data Streams в Amazon Redshift. Це забезпечує швидкий доступ до зовнішніх даних, які швидко оновлюються.

Після створення матеріалізованого представлення ви можете отримати доступ до своїх даних із потоку даних за допомогою SQL і спростити конвеєри даних, створивши матеріалізовані представлення безпосередньо поверх потоку.

Виконайте такі кроки, щоб налаштувати матеріалізоване подання потокової передачі Amazon Redshift:

- На консолі IAM виберіть політики на навігаційній панелі.

- Вибирати Створити політику.

- Створіть нову політику IAM під назвою

KinesisStreamPolicy. Визначення політики потокової передачі див Початок роботи з трансляцією. - На панелі навігації виберіть Ролі.

- Виберіть Створити роль.

- Select Сервіс AWS І вибирай Redshift і Redshift можна налаштувати.

- Створіть нову роль під назвою

redshift-streaming-roleта прикріпити полісKinesisStreamPolicy. - Створіть зовнішню схему для зіставлення з потоками даних Kinesis:

Тепер ви можете створити матеріалізоване представлення для споживання даних потоку. Ви можете використовувати тип даних SUPER, щоб зберігати корисне навантаження як є, у форматі JSON, або використовувати функції Amazon Redshift JSON для аналізу даних JSON на окремі стовпці. Для цієї публікації ми використовуємо другий метод, оскільки схема чітко визначена.

- Створіть матеріалізоване представлення потокового прийому

cust_payment_tx_stream. Вказавши AUTO REFRESH YES у наведеному нижче коді, ви можете ввімкнути автоматичне оновлення перегляду передавання потокових даних, що економить час, уникаючи створення конвеєрів даних:

Зверніть увагу, що json_extract_path_text має обмеження довжини 64 КБ. Також from_varbye фільтрує записи розміром більше 65 Кб.

- Оновіть дані.

Матеріалізоване подання потокової передачі Amazon Redshift автоматично оновлюється за допомогою Amazon Redshift. Таким чином, вам не потрібно турбуватися про застарілі дані. Завдяки автоматичному оновленню матеріалізованого перегляду дані автоматично завантажуються в Amazon Redshift, коли вони стають доступними в потоці. Якщо ви вирішили виконати цю операцію вручну, скористайтеся такою командою:

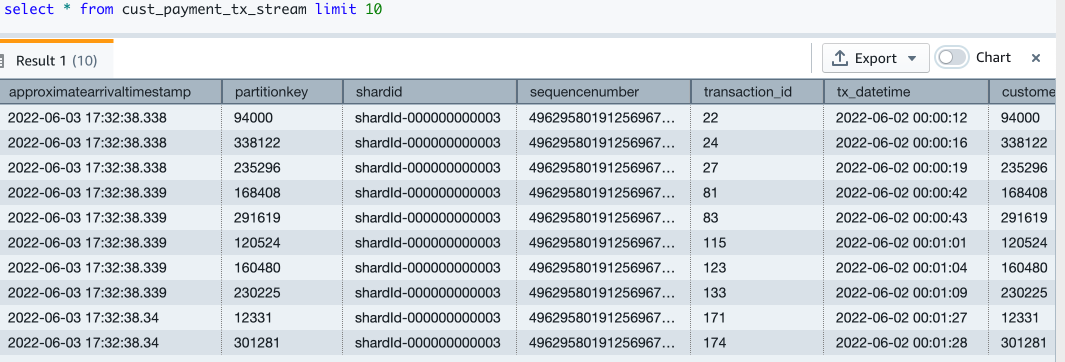

- Тепер давайте запитаємо потокове матеріалізоване представлення, щоб побачити зразки даних:

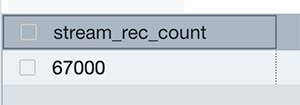

- Давайте зараз перевіримо, скільки записів у режимі потокового перегляду:

Тепер ви завершили налаштування перегляду передавання потокових даних Amazon Redshift, який постійно оновлюється вхідними даними транзакцій кредитної картки. У моїх налаштуваннях я бачу, що близько 67,000 XNUMX записів було затягнуто в режим потокового перегляду в той час, коли я запускав мій запит підрахунку вибору. Це число може бути іншим для вас.

Червоне зміщення ML

За допомогою Redshift ML ви можете отримати попередньо навчену модель ML або створити її нативно. Для отримання додаткової інформації див Використання машинного навчання в Amazon Redshift.

У цій публікації ми навчаємося та створюємо модель ML, використовуючи історичний набір даних. Дані містять a tx_fraud поле, яке позначає історичну транзакцію як шахрайську чи ні. Ми створюємо контрольовану модель ML за допомогою Redshift Auto ML, яка вивчає цей набір даних і передбачає вхідні транзакції, коли вони запускаються за допомогою функцій прогнозування.

У наступних розділах ми покажемо, як налаштувати набір історичних даних і дані клієнтів.

Завантажте набір історичних даних

Таблиця історії містить більше полів, ніж джерело потокових даних. Ці поля містять останні витрати клієнта та оцінку термінального ризику, як-от кількість шахрайських транзакцій, обчислених шляхом перетворення потокових даних. Існують також категоріальні змінні, такі як транзакції у вихідні дні або нічні транзакції.

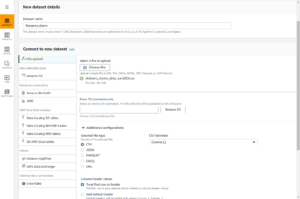

Щоб завантажити історичні дані, виконайте команди за допомогою Редактор запитів Amazon Redshift.

Створіть таблицю історії транзакцій за допомогою наступного коду. DDL також можна знайти на GitHub.

Давайте перевіримо, скільки транзакцій завантажено:

Перевірте місячну тенденцію шахрайства та транзакцій, не пов’язаних із шахрайством:

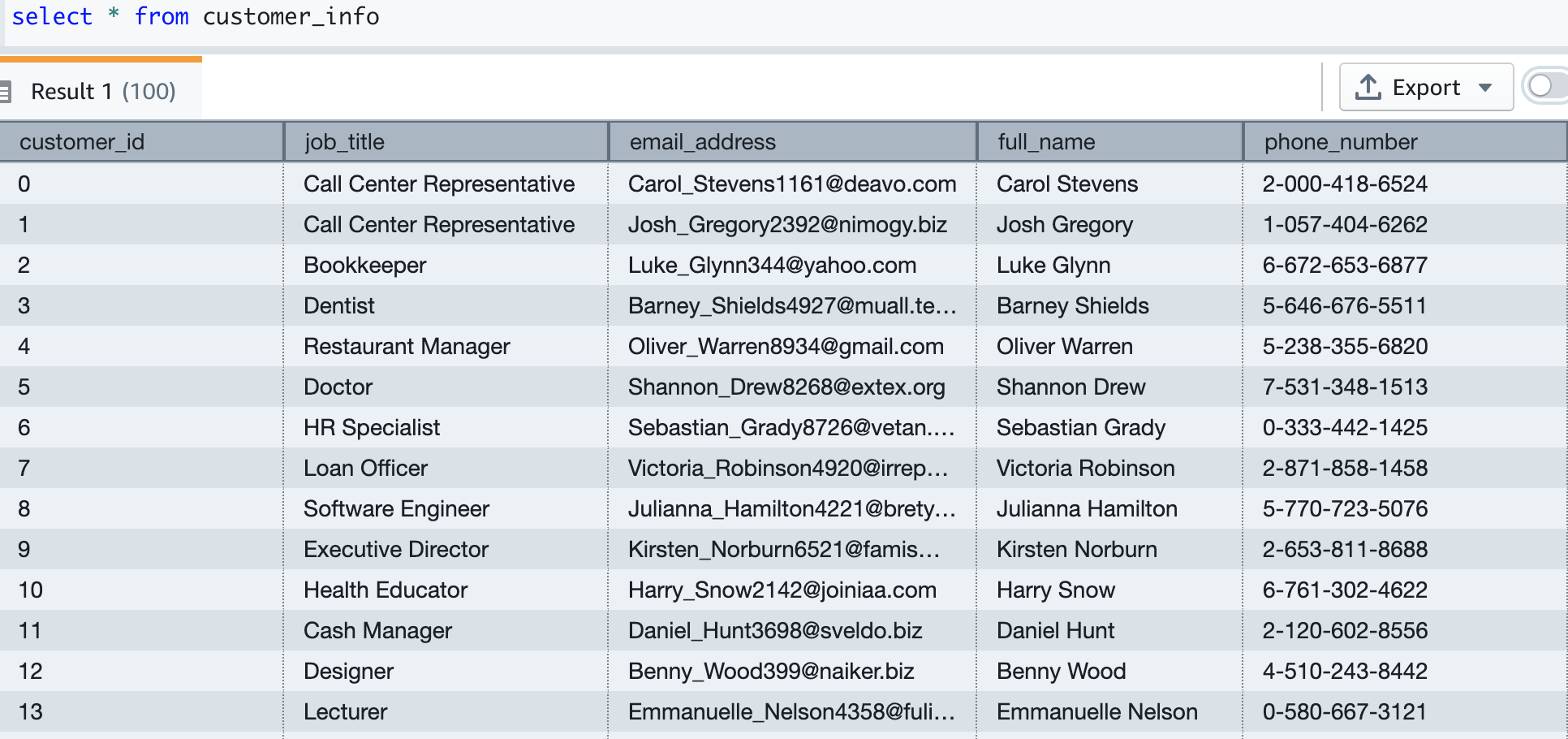

Створення та завантаження даних клієнтів

Тепер ми створюємо таблицю клієнтів і завантажуємо дані, які містять адресу електронної пошти та номер телефону клієнта. Наведений нижче код створює таблицю, завантажує дані та робить вибірку таблиці. Таблиця DDL доступна на GitHub.

Наші тестові дані налічують близько 5,000 клієнтів. На наступному знімку екрана показано зразки даних клієнта.

Побудуйте модель ML

Наша історична таблиця карткових операцій містить дані за 6 місяців, які ми зараз використовуємо для навчання та тестування моделі ML.

Модель приймає такі поля як вхідні дані:

Ми отримуємо tx_fraud як вихід.

Ми розділили ці дані на навчальні та тестові набори даних. Трансакції з 2022 по 04 стосуються навчального набору. Для тестового набору використовуються транзакції з 01 по 2022.

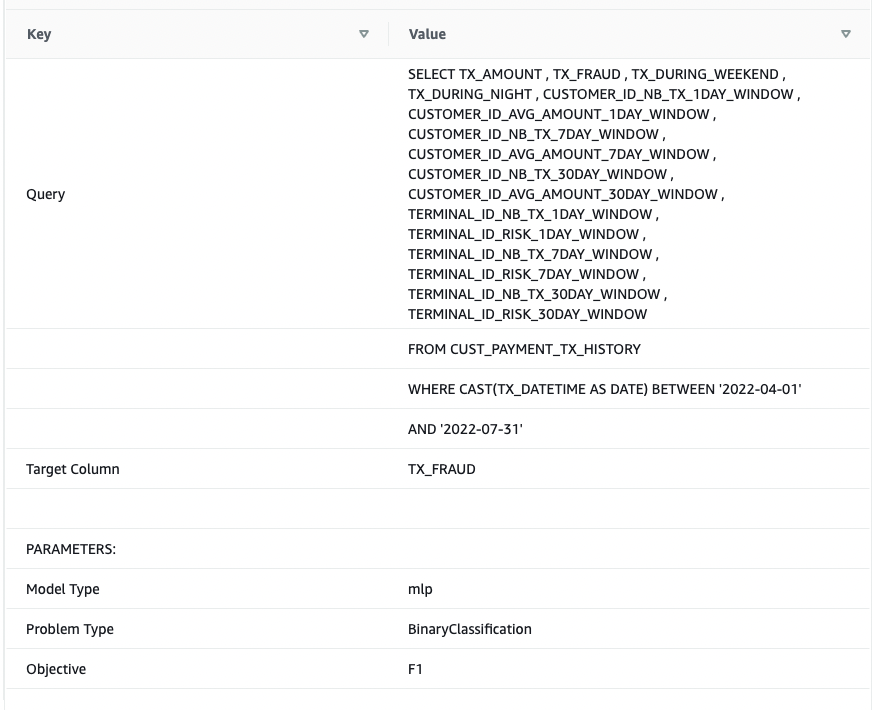

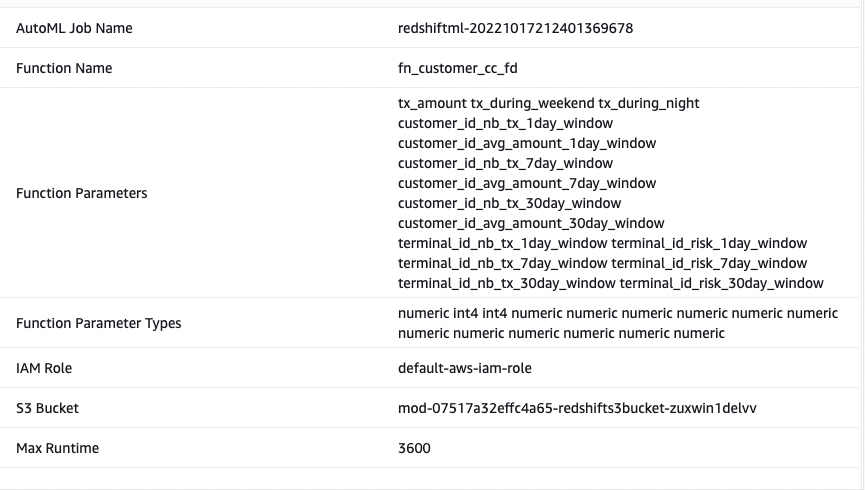

Давайте створимо модель ML за допомогою знайомого SQL Оператор CREATE MODEL. Ми використовуємо базову форму команди Redshift ML. Використовується наступний метод Автопілот Amazon SageMaker, який виконує підготовку даних, розробку функцій, вибір моделі та навчання автоматично для вас. Укажіть назву сегмента S3, що містить код.

Я називаю модель ML as Cust_cc_txn_fd, а функція передбачення як fn_customer_cc_fd. Речення FROM показує вхідні стовпці з історичної таблиці public.cust_payment_tx_history. Цільовий параметр встановлено на tx_fraud, яка є цільовою змінною, яку ми намагаємося передбачити. IAM_Role встановлено за замовчуванням, оскільки кластер налаштовано з цією роллю; якщо ні, ви повинні надати свою роль IAM у кластері Amazon Redshift ARN. Я встановив max_runtime до 3,600 секунд, тобто час, який ми даємо SageMaker для завершення процесу. Redshift ML розгортає найкращу модель, визначену за цей період часу.

Залежно від складності моделі та обсягу даних може знадобитися деякий час, перш ніж модель стане доступною. Якщо ви виявите, що вибір моделі не завершується, збільште значення для max_runtime. Ви можете встановити максимальне значення 9999.

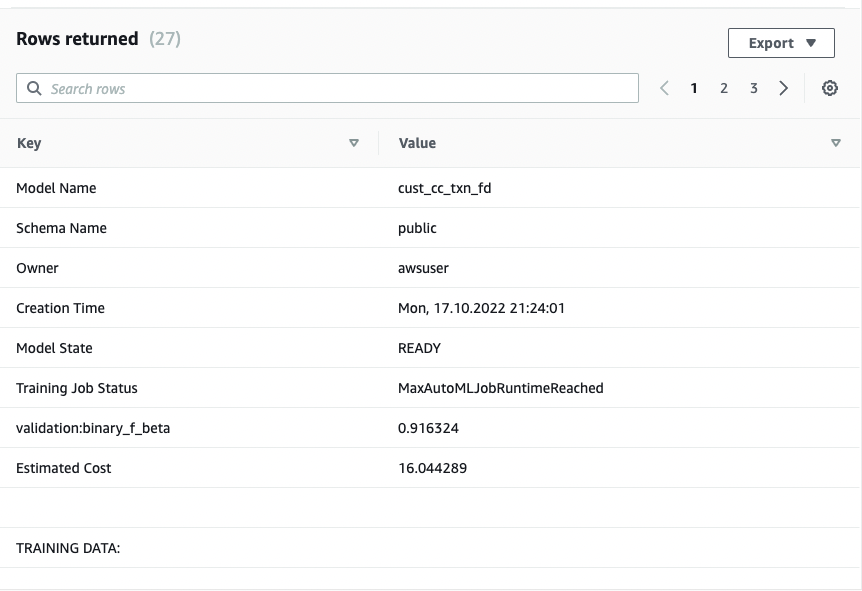

Команда CREATE MODEL виконується асинхронно, що означає, що вона працює у фоновому режимі. Ви можете використовувати ПОКАЗАТЬ МОДЕЛЬ команда, щоб побачити статус моделі. Коли статус відображається як Ready, це означає, що модель навчена та розгорнута.

Наступні знімки екрана показують наш результат.

З виведених даних я бачу, що модель правильно розпізнано як BinaryClassification, і F1 було обрано як ціль. The F1 бал це показник, який враховує обидва точність і відкликання. Він повертає значення від 1 (ідеальна точність і запам’ятовування) до 0 (найнижча можлива оцінка). У моєму випадку це 0.91. Чим вище значення, тим краща продуктивність моделі.

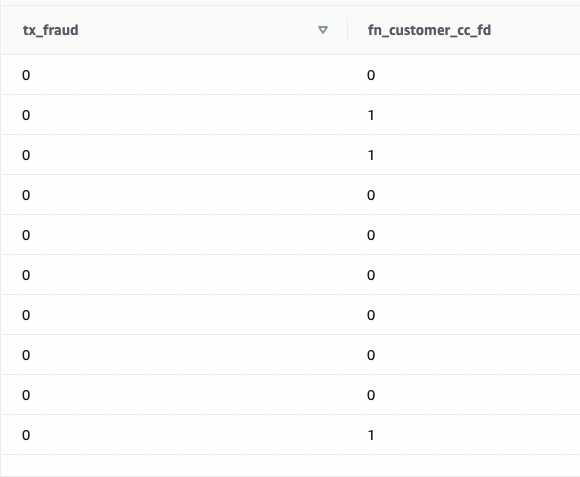

Давайте перевіримо цю модель за допомогою тестового набору даних. Виконайте таку команду, яка отримує вибіркові прогнози:

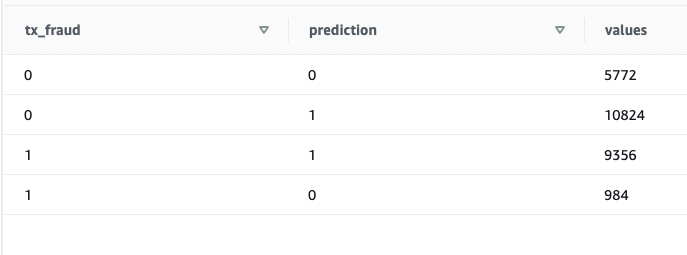

Ми бачимо, що деякі значення збігаються, а деякі ні. Давайте порівняємо прогнози з основною правдою:

Ми підтвердили, що модель працює, а оцінка Формули-1 хороша. Давайте перейдемо до створення прогнозів на потокових даних.

Передбачте шахрайські операції

Оскільки модель Redshift ML готова до використання, ми можемо використовувати її для виконання прогнозів проти прийому потокових даних. Історичний набір даних має більше полів, ніж те, що ми маємо в джерелі потокових даних, але це лише метрики нещодавності та частоти щодо клієнта та ризику терміналу для шахрайської транзакції.

Ми можемо дуже легко застосувати перетворення поверх потокових даних, вставивши SQL у представлення. Створіть перший погляд, який агрегує потокові дані на рівні клієнта. Потім створіть другий вид, який агрегує потокові дані на рівні терміналу, і третій погляд, який об’єднує вхідні транзакційні дані з агрегованими даними клієнтів і терміналів і викликає функцію прогнозування в одному місці. Код для третього перегляду виглядає наступним чином:

Виконайте інструкцію SELECT для подання:

Коли ви багаторазово виконуєте оператор SELECT, останні транзакції кредитної картки проходять трансформації та прогнози машинного навчання майже в реальному часі.

Це демонструє потужність Amazon Redshift — за допомогою простих у використанні команд SQL ви можете перетворювати потокові дані, застосовуючи складні віконні функції, і застосовувати модель ML для прогнозування шахрайських транзакцій за один крок, без створення складних конвеєрів даних або створення й керування ними. додаткова інфраструктура.

Розгорніть рішення

Оскільки потоки даних і передбачення ML створюються майже в реальному часі, ви можете будувати бізнес-процеси для сповіщення клієнтів за допомогою Служба простих сповіщень Amazon (Amazon SNS), або ви можете заблокувати рахунок кредитної картки клієнта в операційній системі.

У цій публікації не розглядаються подробиці цих операцій, але якщо ви хочете дізнатися більше про створення керованих подіями рішень за допомогою Amazon Redshift, зверніться до наступного GitHub сховище.

Прибирати

Щоб уникнути майбутніх витрат, видаліть ресурси, створені в рамках цієї публікації.

Висновок

У цій публікації ми продемонстрували, як налаштувати потік даних Kinesis, налаштувати продюсера та опублікувати дані в потоках, а потім створити представлення Amazon Redshift Streaming Ingestion і запитати дані в Amazon Redshift. Після того, як дані були в кластері Amazon Redshift, ми продемонстрували, як навчити модель ML і створити функцію прогнозування та застосувати її до потокових даних для створення прогнозів майже в реальному часі.

Якщо у вас є відгуки чи запитання, залишайте їх у коментарях.

Про авторів

Бхану Піттампалі є архітектором аналітичних рішень, який працює в Далласі. Він спеціалізується на створенні аналітичних рішень. Його досвід роботи в сховищах даних — архітектурі, розробці та адмініструванні. Він працює у сфері даних та аналітики понад 15 років.

Бхану Піттампалі є архітектором аналітичних рішень, який працює в Далласі. Він спеціалізується на створенні аналітичних рішень. Його досвід роботи в сховищах даних — архітектурі, розробці та адмініструванні. Він працює у сфері даних та аналітики понад 15 років.

Правін Кадіпіконда є старшим спеціалістом із аналітики, архітектором рішень в AWS, що знаходиться в Далласі. Він допомагає клієнтам створювати ефективні, ефективні та масштабовані аналітичні рішення. Він працював над створенням баз даних і рішень для сховищ даних понад 15 років.

Правін Кадіпіконда є старшим спеціалістом із аналітики, архітектором рішень в AWS, що знаходиться в Далласі. Він допомагає клієнтам створювати ефективні, ефективні та масштабовані аналітичні рішення. Він працював над створенням баз даних і рішень для сховищ даних понад 15 років.

Ритеш Кумар Сінха є архітектором аналітичних рішень із Сан-Франциско. Понад 16 років він допомагав клієнтам створювати масштабовані сховища даних і рішення для великих даних. Він любить проектувати та створювати ефективні наскрізні рішення на AWS. У вільний час він любить читати, гуляти та займатися йогою.

Ритеш Кумар Сінха є архітектором аналітичних рішень із Сан-Франциско. Понад 16 років він допомагав клієнтам створювати масштабовані сховища даних і рішення для великих даних. Він любить проектувати та створювати ефективні наскрізні рішення на AWS. У вільний час він любить читати, гуляти та займатися йогою.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- Платоблокчейн. Web3 Metaverse Intelligence. Розширені знання. Доступ тут.

- джерело: https://aws.amazon.com/blogs/big-data/near-real-time-fraud-detection-using-amazon-redshift-streaming-ingestion-with-amazon-kinesis-data-streams-and-amazon-redshift-ml/

- 000

- 000 клієнтів

- 1

- 10

- 100

- 11

- 15 роки

- 67

- 7

- 9

- a

- Здатний

- МЕНЮ

- вище

- доступ

- рахунки

- Achieve

- дію

- Додатковий

- адміністрація

- просунутий

- після

- проти

- Оповіщення

- ВСІ

- дозволяє

- Amazon

- Amazon EC2

- Амазонський кінезіс

- кількість

- аналітики

- Аналітичний

- аналітика

- аналізувати

- та

- виявлення аномалії

- Apache

- додаток

- Застосовувати

- Застосування

- архітектура

- навколо

- приєднувати

- автоматичний

- автоматичний

- автоматично

- доступний

- уникає

- AWS

- фон

- заснований

- основний

- оскільки

- стає

- КРАЩЕ

- Краще

- між

- Великий

- Великий даних

- приносити

- будувати

- Створюємо

- бізнес

- ділові процеси

- підприємства

- call

- званий

- Виклики

- захоплення

- карта

- випадок

- випадків

- характер

- вантажі

- перевірка

- Вибирати

- Місто

- хмара

- кластер

- код

- Колони

- комбінати

- майбутній

- коментарі

- порівняти

- повний

- завершення

- комплекс

- складність

- обчислення

- вважає

- Консоль

- споживати

- споживач

- містить

- рентабельним

- може

- створювати

- створений

- створює

- створення

- Повноваження

- кредит

- кредитна картка

- клієнт

- дані про клієнтів

- Клієнти

- циклів

- щодня

- Даллас

- дані

- Підготовка даних

- сховище даних

- сховища даних

- Database

- базами даних

- набори даних

- Дата

- Прийняття рішень

- дефолт

- визначаючи

- доставляти

- продемонстрований

- залежний

- розгортання

- розгорнути

- розгортає

- описаний

- дизайн

- деталі

- Виявлення

- розробників

- розробка

- різний

- безпосередньо

- Ні

- справи

- Не знаю

- вниз

- динамічний

- легко

- легкий у використанні

- ефект

- ефективний

- включіть

- дозволяє

- кінець в кінець

- Машинобудування

- Що натомість? Створіть віртуальну версію себе у

- Ефір (ETH)

- Event

- Події

- приклад

- збуджений

- зовнішній

- видобуток

- f1

- знайомий

- ШВИДКО

- особливість

- риси

- зворотний зв'язок

- поле

- Поля

- Фільтри

- фінансовий

- знайти

- прапори

- потік

- стежити

- після

- слідує

- форма

- формат

- знайдений

- FRAME

- Франциско

- шахрайство

- виявлення шахрайства

- Безкоштовна

- частота

- від

- повністю

- функція

- Функції

- майбутнє

- породжувати

- генерується

- породжує

- generator

- отримати

- Давати

- Go

- добре

- надавати

- Земля

- Group

- має

- допоміг

- допомагає

- вище

- Виділіть

- історичний

- історія

- Як

- How To

- HTML

- HTTPS

- Сотні

- IAM

- ідентифікований

- Особистість

- значення

- in

- включати

- Вхідний

- Augmenter

- зростаючий

- індивідуальний

- інформація

- Інфраструктура

- вхід

- Вставки

- розуміння

- встановлювати

- екземпляр

- Інститут

- інструкції

- зацікавлений

- IT

- приєднатися

- json

- кафка

- Потоки даних Kinesis

- мова

- більше

- Затримка

- останній

- запуск

- вивчення

- Залишати

- довжина

- рівень

- МЕЖА

- обмеження

- загрузка

- вантажі

- довгостроковий

- низький

- машина

- навчання за допомогою машини

- made

- зробити

- РОБОТИ

- вдалося

- управління

- вручну

- багато

- карта

- масово

- узгодження

- matplotlib

- Макс

- засоби

- Медіа

- метод

- метрика

- Метрика

- Пом'якшити

- ML

- режим

- модель

- Моделі

- щомісячно

- місяців

- більше

- найбільш

- рухатися

- ім'я

- навігація

- Необхідність

- потреби

- Нові

- наступний

- сповіщення

- номер

- нумпі

- мета

- ONE

- Відкриється

- операція

- оперативний

- операції

- Можливості

- Опції

- порядок

- організації

- Інше

- викладені

- пакети

- панди

- pane

- параметр

- частина

- ідеальний

- виконувати

- продуктивність

- виступає

- Дозволи

- телефон

- місце

- планування

- платформа

- Платформи

- plato

- Інформація про дані Платона

- PlatoData

- будь ласка

- Політика

- політика

- це можливо

- пошта

- влада

- Точність

- передбачати

- прогноз

- Прогнози

- Прогнози

- попередній

- ціни без прихованих комісій

- процес

- процеси

- виробник

- програма

- забезпечувати

- забезпечує

- громадськість

- публікувати

- Python

- питань

- швидко

- випадковий

- читання

- готовий

- реальний

- реального часу

- дані в режимі реального часу

- розуміючи,

- отримати

- отримано

- останній

- визнаний

- облік

- ПОВТОРНО

- замінювати

- вимагається

- ресурс

- ресурси

- REST

- результати

- Умови повернення

- Risk

- Роль

- прогін

- біг

- мудрець

- Сан -

- Сан Франциско

- масштабовані

- шкала

- скріншоти

- Sdk

- морський народжений

- другий

- seconds

- розділ

- розділам

- безпечний

- обраний

- вибір

- Без сервера

- обслуговування

- комплект

- установка

- налаштування

- установка

- короткий термін

- Показувати

- Шоу

- простий

- спростити

- симулятор

- So

- соціальна

- соціальні медіа

- рішення

- Рішення

- деякі

- Source

- Джерела

- спеціаліст

- спеціалізується

- витрачати

- розкол

- SQL

- Стажування

- standard

- почалася

- стан

- Заява

- заяви

- Статус

- Крок

- заходи

- зберігання

- зберігати

- магазинів

- Стратегічний

- потік

- потоковий

- Потокове сервіс

- потоки

- такі

- Super

- система

- Systems

- таблиця

- Приймати

- приймає

- Переговори

- Мета

- термінал

- тест

- Команда

- третій

- тисячі

- через

- час

- відмітка часу

- до

- топ

- тема

- традиційно

- поїзд

- навчений

- Навчання

- угода

- транзакційний

- Transactions

- Перетворення

- перетворень

- перетворення

- Trend

- Оновити

- оновлений

- Використання

- використання

- користувач

- підтверджено

- значення

- Цінності

- різний

- Вірність

- версія

- вид

- думки

- ходьба

- покрокове керівництво

- Склад

- Складування

- веб-сайт

- уїк-енд

- тижні

- Що

- який

- в той час як

- Вікіпедія

- волі

- без

- працював

- робочий

- працює

- запис

- років

- йога

- вашу

- зефірнет