Znaczenie hurtowni danych i analiz przeprowadzanych na platformach hurtowni danych stale rośnie na przestrzeni lat, a wiele firm zaczyna polegać na tych systemach jako o znaczeniu krytycznym zarówno dla podejmowania krótkoterminowych decyzji operacyjnych, jak i długoterminowego planowania strategicznego. Tradycyjnie hurtownie danych są odświeżane w cyklach wsadowych, na przykład co miesiąc, co tydzień lub codziennie, dzięki czemu firmy mogą czerpać z nich różne spostrzeżenia.

Wiele organizacji zdaje sobie sprawę, że pozyskiwanie danych w czasie zbliżonym do rzeczywistego wraz z zaawansowaną analizą otwiera nowe możliwości. Na przykład instytut finansowy może przewidzieć, czy transakcja kartą kredytową jest oszukańcza, uruchamiając program do wykrywania anomalii w trybie zbliżonym do rzeczywistego, a nie w trybie wsadowym.

W tym poście pokazujemy, jak to zrobić Amazonka Przesunięcie ku czerwieni może dostarczać prognozy przetwarzania strumieniowego i uczenia maszynowego (ML) na jednej platformie.

Amazon Redshift to szybka, skalowalna, bezpieczna iw pełni zarządzana hurtownia danych w chmurze, dzięki której analiza wszystkich danych przy użyciu standardowego SQL jest prosta i opłacalna.

Amazon Redshift ML ułatwia analitykom danych i programistom baz danych tworzenie, trenowanie i stosowanie modeli ML przy użyciu znanych poleceń SQL w hurtowniach danych Amazon Redshift.

Nie możemy się doczekać premiery Przetwarzanie strumieniowe Amazon Redshift dla Strumienie danych Amazon Kinesis i Przesyłanie strumieniowe zarządzane przez Amazon dla Apache Kafka (Amazon MSK), który umożliwia pobieranie danych bezpośrednio ze strumienia danych Kinesis lub tematu Kafki bez konieczności umieszczania danych w Usługa Amazon Simple Storage (Amazon S3). Przetwarzanie strumieniowe Amazon Redshift pozwala osiągnąć niskie opóźnienia rzędu kilku sekund podczas przetwarzania setek megabajtów danych do hurtowni danych.

W tym poście pokazano, jak Amazon Redshift, magazyn danych w chmurze, umożliwia tworzenie prognoz ML w czasie zbliżonym do rzeczywistego przy użyciu przetwarzania strumieniowego Amazon Redshift i funkcji Redshift ML w znanym języku SQL.

Omówienie rozwiązania

Wykonując czynności opisane w tym poście, będziesz mógł skonfigurować aplikację streamera producenta na urządzeniu Elastyczna chmura obliczeniowa Amazon (Amazon EC2), która symuluje transakcje kartą kredytową i przesyła dane do Kinesis Data Streams w czasie rzeczywistym. Skonfigurowałeś zmaterializowany widok Amazon Redshift Streaming Ingestion na Amazon Redshift, gdzie odbierane są dane przesyłane strumieniowo. Trenujesz i budujesz model Redshift ML, aby generować wnioski w czasie rzeczywistym na podstawie danych przesyłanych strumieniowo.

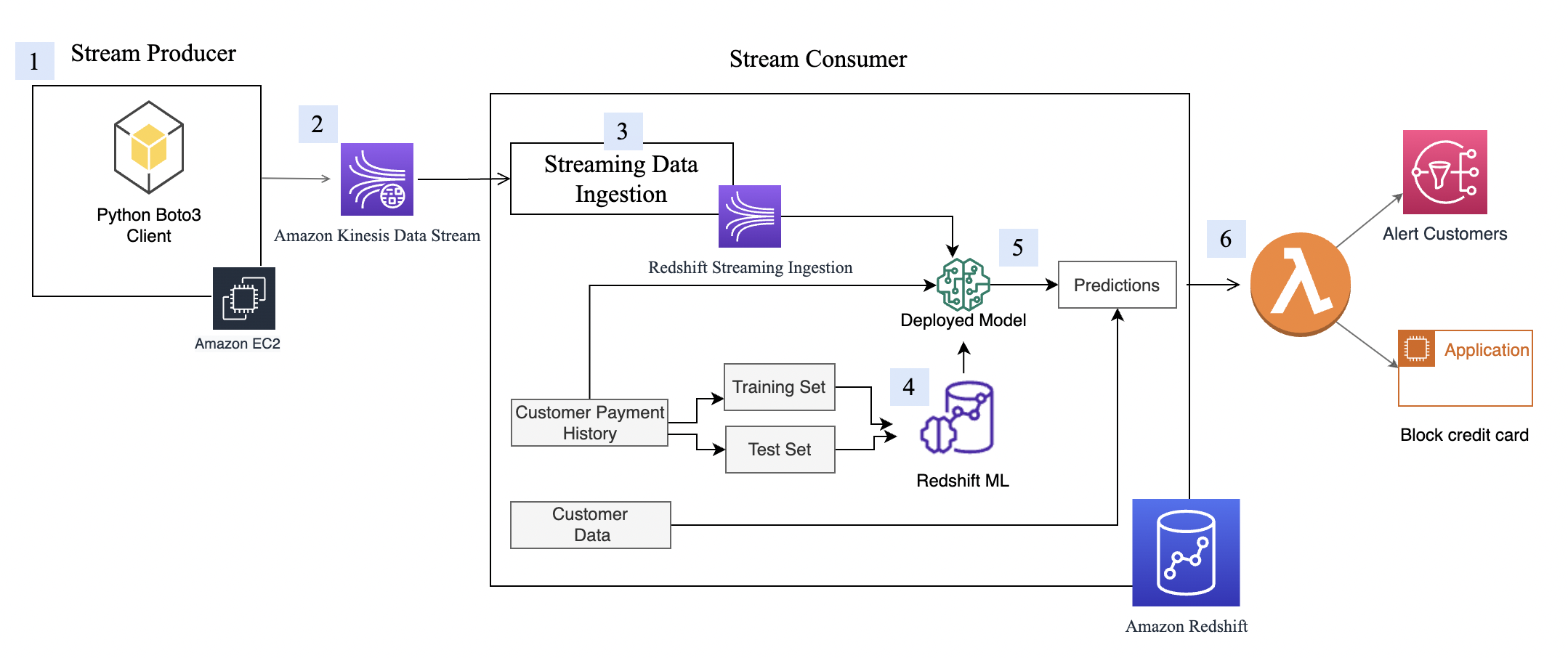

Poniższy diagram ilustruje architekturę i przebieg procesu.

Proces krok po kroku wygląda następująco:

- Instancja EC2 symuluje aplikację do transakcji kartą kredytową, która wstawia transakcje kartą kredytową do strumienia danych Kinesis.

- Strumień danych przechowuje przychodzące dane transakcji kartą kredytową.

- Widok zmaterializowany Amazon Redshift Streaming Ingestion jest tworzony na górze strumienia danych, który automatycznie przetwarza dane przesyłane strumieniowo do Amazon Redshift.

- Budujesz, trenujesz i wdrażasz model ML za pomocą Redshift ML. Model Redshift ML jest szkolony przy użyciu historycznych danych transakcyjnych.

- Przekształcasz dane przesyłane strumieniowo i generujesz prognozy ML.

- Możesz ostrzegać klientów lub aktualizować aplikację, aby ograniczyć ryzyko.

W tym instruktażu są używane dane przesyłania strumieniowego transakcji kartą kredytową. Dane transakcji kartą kredytową są fikcyjne i opierają się na symulator. Zbiór danych klientów jest również fikcyjny i jest generowany za pomocą niektórych funkcji danych losowych.

Wymagania wstępne

- Utwórz klaster Amazon Redshift.

- Skonfiguruj klaster do używania Redshift ML.

- Stwórz an AWS Zarządzanie tożsamością i dostępem (IAM) użytkownik.

- Zaktualizuj rolę IAM dołączoną do klastra Redshift, aby obejmowała uprawnienia dostępu do strumienia danych Kinesis. Aby uzyskać więcej informacji na temat wymaganych zasad, zobacz Pierwsze kroki z przetwarzaniem strumieniowym.

- Utwórz instancję m5.4xlarge EC2. Testowaliśmy aplikację Producer z instancją m5.4xlarge, ale możesz użyć innego typu instancji. Podczas tworzenia instancji użyj amzn2-ami-kernel-5.10-hvm-2.0.20220426.0-x86_64-gp2 JESTEM.

- Aby upewnić się, że Python3 jest zainstalowany w instancji EC2, uruchom następujące polecenie, aby zweryfikować swoją wersję Pythona (pamiętaj, że skrypt ekstrakcji danych działa tylko w Pythonie 3):

- Zainstaluj następujące pakiety zależne, aby uruchomić program symulatora:

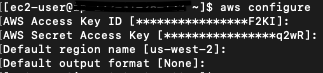

- Skonfiguruj Amazon EC2 przy użyciu zmiennych, takich jak poświadczenia AWS wygenerowane dla użytkownika IAM utworzonego w kroku 3 powyżej. Poniższy zrzut ekranu pokazuje przykład użycia konfiguracja aws.

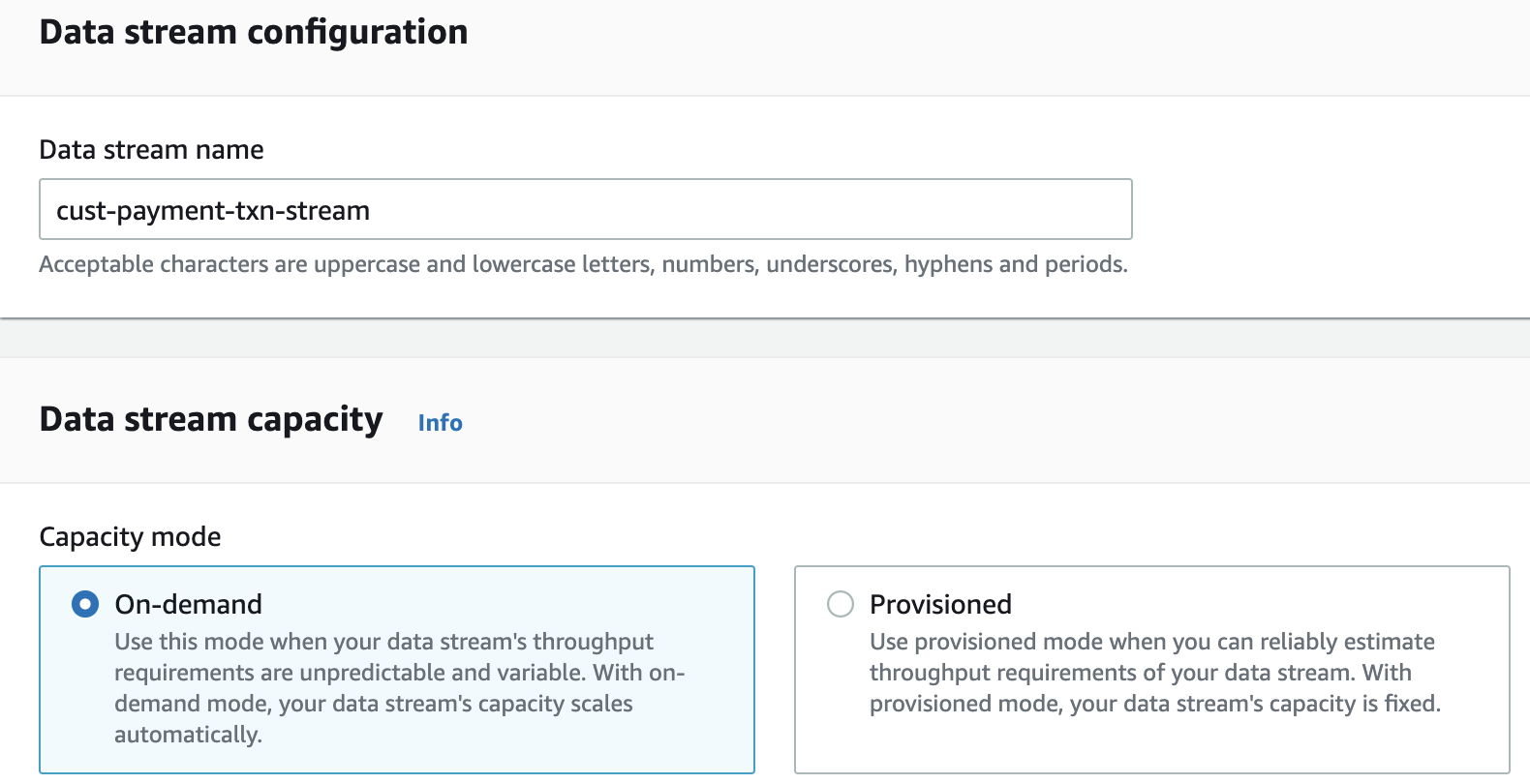

Skonfiguruj strumienie danych Kinesis

Amazon Kinesis Data Streams to wysoce skalowalna i trwała usługa przesyłania strumieniowego danych w czasie rzeczywistym. Może w sposób ciągły przechwytywać gigabajty danych na sekundę z setek tysięcy źródeł, takich jak strumienie kliknięć w witrynach internetowych, strumienie zdarzeń w bazach danych, transakcje finansowe, kanały mediów społecznościowych, dzienniki IT i zdarzenia śledzenia lokalizacji. Zebrane dane są dostępne w ciągu milisekund, aby umożliwić analizy w czasie rzeczywistym, takie jak pulpity nawigacyjne w czasie rzeczywistym, wykrywanie anomalii w czasie rzeczywistym, dynamiczne ustalanie cen i inne. Używamy strumieni danych Kinesis, ponieważ jest to rozwiązanie bezserwerowe, które można skalować w zależności od użycia.

Utwórz strumień danych Kinesis

Najpierw musisz utworzyć strumień danych Kinesis, aby odbierać dane przesyłane strumieniowo:

- Na konsoli Amazon Kinesis wybierz Strumienie danych w okienku nawigacji.

- Dodaj Utwórz strumień danych.

- W razie zamówieenia projektu Nazwa strumienia danych, wchodzić

cust-payment-txn-stream. - W razie zamówieenia projektu Tryb pojemności, Wybierz Na żądanie.

- W przypadku pozostałych opcji wybierz opcje domyślne i postępuj zgodnie z instrukcjami, aby zakończyć konfigurację.

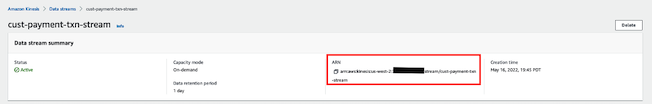

- Przechwyć ARN dla utworzonego strumienia danych, aby użyć go w następnej sekcji podczas definiowania zasad IAM.

Skonfiguruj uprawnienia

Aby aplikacja strumieniowa mogła zapisywać w strumieniach danych Kinesis, aplikacja musi mieć dostęp do Kinesis. Możesz użyć następującej instrukcji zasad, aby przyznać procesowi symulatora skonfigurowanemu w następnej sekcji dostęp do strumienia danych. Użyj ARN strumienia danych zapisanego w poprzednim kroku.

Skonfiguruj producenta strumienia

Zanim będziemy mogli korzystać z danych przesyłanych strumieniowo w Amazon Redshift, potrzebujemy źródła danych przesyłanych strumieniowo, które zapisuje dane w strumieniu danych Kinesis. Ten post używa niestandardowego generatora danych i AWS SDK dla Pythona (Boto3) opublikować dane w strumieniu danych. Aby uzyskać instrukcje dotyczące konfiguracji, patrz Symulator producenta. Ten proces symulatora publikuje dane przesyłane strumieniowo do strumienia danych utworzonego w poprzednim kroku (cust-payment-txn-stream).

Skonfiguruj konsumenta strumienia

W tej sekcji omówiono konfigurowanie konsumenta strumienia (widok pozyskiwania przesyłania strumieniowego Amazon Redshift).

Usługa Amazon Redshift Streaming Ingestion zapewnia szybkie przetwarzanie danych przesyłanych strumieniowo ze strumieni danych Kinesis do zmaterializowanego widoku Amazon Redshift z niskimi opóźnieniami. Możesz skonfigurować swój klaster Amazon Redshift, aby umożliwić przetwarzanie strumieniowe i utworzyć zmaterializowany widok z automatycznym odświeżaniem, używając instrukcji SQL, jak opisano w Tworzenie zmaterializowanych widoków w Amazon Redshift. Proces automatycznego odświeżania zmaterializowanego widoku będzie pobierał dane przesyłane strumieniowo z szybkością setek megabajtów danych na sekundę ze strumieni danych Kinesis do Amazon Redshift. Powoduje to szybki dostęp do danych zewnętrznych, które są szybko odświeżane.

Po utworzeniu widoku zmaterializowanego można uzyskiwać dostęp do danych ze strumienia danych za pomocą języka SQL i uprościć potoki danych, tworząc widoki zmaterializowane bezpośrednio na górze strumienia.

Wykonaj następujące kroki, aby skonfigurować zmaterializowany widok przesyłania strumieniowego Amazon Redshift:

- W konsoli IAM wybierz zasady w okienku nawigacji.

- Dodaj Utwórz politykę.

- Utwórz nową politykę IAM o nazwie

KinesisStreamPolicy. Aby zapoznać się z definicją zasad przesyłania strumieniowego, zobacz Pierwsze kroki z przetwarzaniem strumieniowym. - W okienku nawigacji wybierz role.

- Wybierz Utwórz rolę.

- Wybierz Usługa AWS i wybierz Konfigurowalne przesunięcie ku czerwieni i przesunięcie ku czerwieni.

- Utwórz nową rolę o nazwie

redshift-streaming-rolei dołącz polisęKinesisStreamPolicy. - Utwórz zewnętrzny schemat do mapowania na strumienie danych Kinesis:

Teraz możesz utworzyć zmaterializowany widok, aby korzystać z danych strumienia. Możesz użyć typu danych SUPER, aby zapisać ładunek w takiej postaci, w jakiej jest, w formacie JSON, lub użyć funkcji Amazon Redshift JSON, aby przeanalizować dane JSON w poszczególnych kolumnach. W tym poście używamy drugiej metody, ponieważ schemat jest dobrze zdefiniowany.

- Utwórz zmaterializowany widok przetwarzania strumieniowego

cust_payment_tx_stream. Określając AUTO ODŚWIEŻANIE TAK w poniższym kodzie, możesz włączyć automatyczne odświeżanie widoku przetwarzania strumieniowego, co oszczędza czas, unikając tworzenia potoków danych:

Należy pamiętać, że json_extract_path_text ma ograniczenie długości do 64 KB. Również from_varbye filtruje rekordy większe niż 65 KB.

- Odśwież dane.

Zmaterializowany widok przesyłania strumieniowego Amazon Redshift jest automatycznie odświeżany przez Amazon Redshift. W ten sposób nie musisz się martwić o nieaktualność danych. Dzięki automatycznemu odświeżaniu widoku zmaterializowanego dane są automatycznie ładowane do Amazon Redshift, gdy stają się dostępne w strumieniu. Jeśli zdecydujesz się ręcznie wykonać tę operację, użyj następującego polecenia:

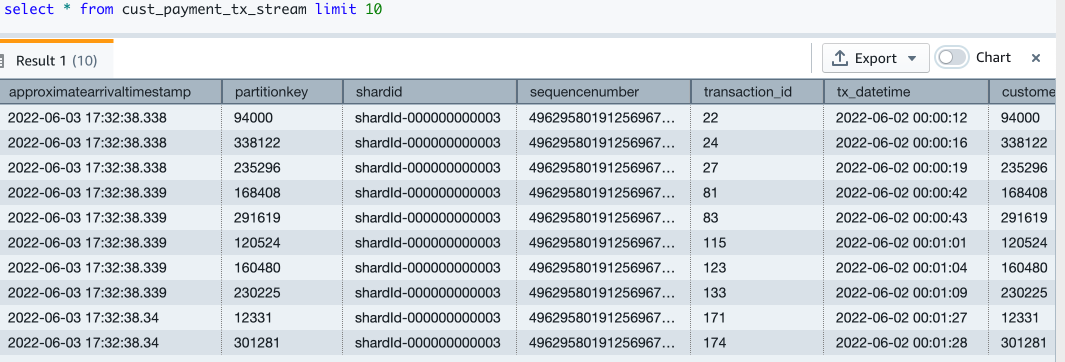

- Teraz przeprowadźmy zapytanie do strumieniowego widoku zmaterializowanego, aby zobaczyć przykładowe dane:

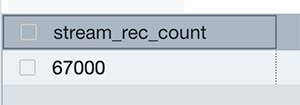

- Sprawdźmy teraz, ile rekordów znajduje się w widoku przesyłania strumieniowego:

Teraz zakończyłeś konfigurowanie widoku przetwarzania strumieniowego Amazon Redshift, który jest stale aktualizowany o przychodzące dane transakcji kartą kredytową. W mojej konfiguracji widzę, że około 67,000 XNUMX rekordów zostało wciągniętych do widoku przesyłania strumieniowego w czasie, gdy uruchomiłem moje zapytanie zliczania wyboru. Ta liczba może być dla Ciebie inna.

Przesunięcie ku czerwieni ML

Dzięki Redshift ML możesz wprowadzić wstępnie wytrenowany model ML lub zbudować go natywnie. Aby uzyskać więcej informacji, patrz Wykorzystanie uczenia maszynowego w Amazon Redshift.

W tym poście trenujemy i budujemy model ML przy użyciu historycznego zestawu danych. Dane zawierają A tx_fraud pole oznaczające historyczną transakcję jako oszukańczą lub nie. Budujemy nadzorowany model ML za pomocą Redshift Auto ML, który uczy się z tego zestawu danych i przewiduje transakcje przychodzące, gdy są one uruchamiane przez funkcje przewidywania.

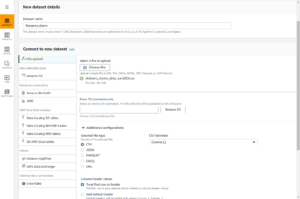

W poniższych sekcjach pokazujemy, jak skonfigurować zestaw danych historycznych i dane klientów.

Załaduj zestaw danych historycznych

Tabela historyczna zawiera więcej pól niż źródło danych przesyłanych strumieniowo. Pola te zawierają ostatnie wydatki klienta i ocenę ryzyka terminala, na przykład liczbę nieuczciwych transakcji obliczoną przez transformację danych przesyłanych strumieniowo. Istnieją również zmienne kategoryczne, takie jak transakcje weekendowe lub transakcje nocne.

Aby załadować dane historyczne, uruchom polecenia za pomocą Edytor zapytań Amazon Redshift.

Utwórz tabelę historii transakcji z następującym kodem. DDL można również znaleźć na GitHub.

Sprawdźmy, ile transakcji jest załadowanych:

Sprawdź miesięczny trend oszustw i transakcji niezwiązanych z oszustwami:

Twórz i ładuj dane klientów

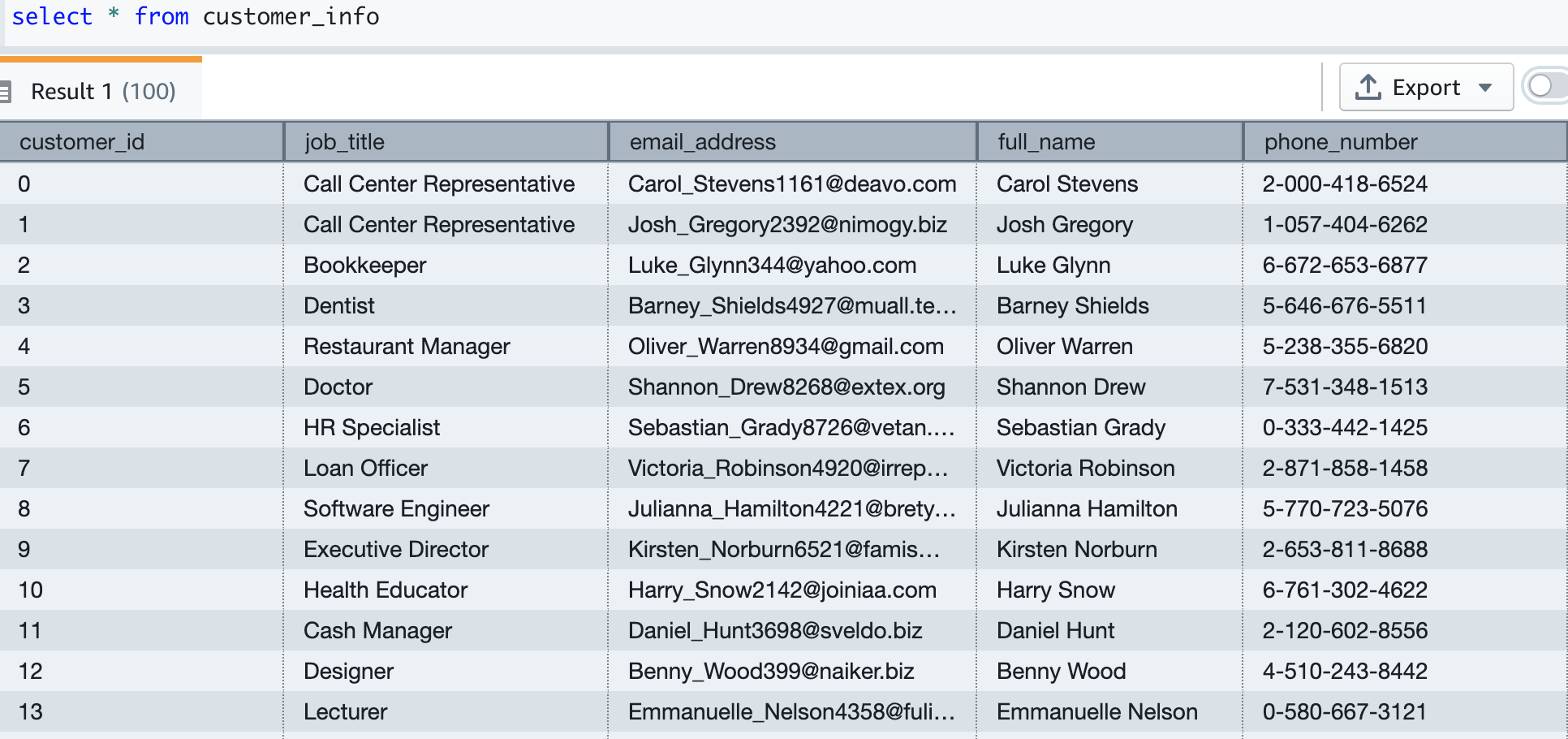

Teraz tworzymy tabelę klientów i ładujemy dane, które zawierają adres e-mail i numer telefonu klienta. Poniższy kod tworzy tabelę, ładuje dane i próbkuje tabelę. Tabela DDL jest dostępna na GitHub.

Nasze dane testowe obejmują około 5,000 klientów. Poniższy zrzut ekranu przedstawia przykładowe dane klienta.

Zbuduj model ML

Nasza tabela historycznych transakcji kartowych zawiera dane z 6 miesięcy, których teraz używamy do trenowania i testowania modelu ML.

Model przyjmuje następujące pola jako dane wejściowe:

Dostajemy tx_fraud jako wyjście.

Podzieliliśmy te dane na treningowe i testowe zestawy danych. Transakcje od 2022-04-01 do 2022-07-31 dotyczą zbioru uczącego. Dla zestawu testowego używane są transakcje od 2022-08-01 do 2022-09-30.

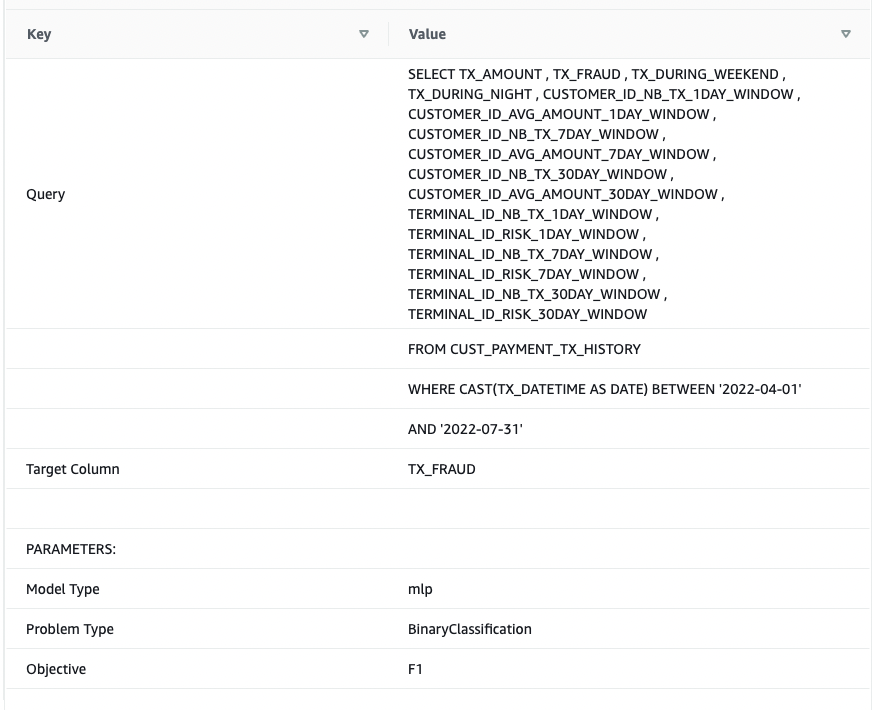

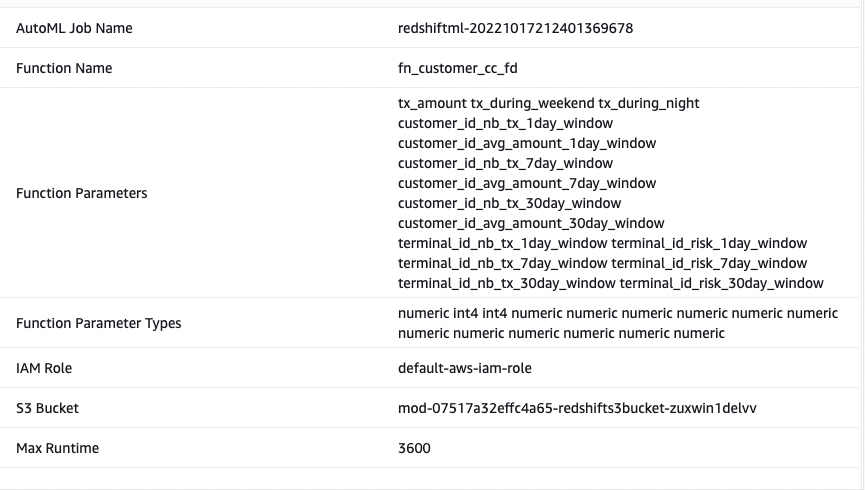

Stwórzmy model ML przy użyciu znanego języka SQL Instrukcja UTWÓRZ MODEL. Używamy podstawowej formy polecenia Redshift ML. Stosuje się następującą metodę Autopilot Amazon SageMaker, która automatycznie wykonuje przygotowanie danych, inżynierię funkcji, wybór modelu i szkolenie. Podaj nazwę zasobnika S3 zawierającego kod.

Nazywam model ML jako Cust_cc_txn_fd, a funkcja przewidywania jako fn_customer_cc_fd. Klauzula FROM pokazuje kolumny wejściowe z tabeli historycznej public.cust_payment_tx_history. Parametr docelowy jest ustawiony na tx_fraud, która jest zmienną docelową, którą próbujemy przewidzieć. IAM_Role jest ustawiona na wartość domyślną, ponieważ klaster jest skonfigurowany z tą rolą; jeśli nie, musisz podać swoją rolę IAM w klastrze Amazon Redshift ARN. Ustawiłem max_runtime do 3,600 sekund, czyli czasu, jaki dajemy SageMakerowi na ukończenie procesu. Redshift ML wdraża najlepszy model zidentyfikowany w tym przedziale czasowym.

W zależności od złożoności modelu i ilości danych udostępnienie modelu może zająć trochę czasu. Jeśli okaże się, że wybór modelu nie jest kompletny, zwiększ wartość dla max_runtime. Możesz ustawić maksymalną wartość 9999.

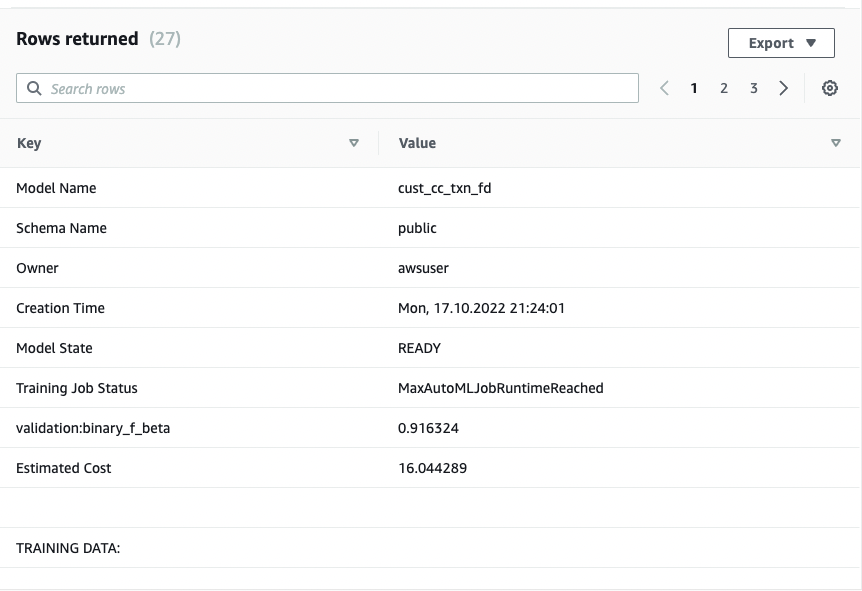

Polecenie CREATE MODEL jest uruchamiane asynchronicznie, co oznacza, że działa w tle. Możesz użyć POKAŻ MODEL polecenie, aby zobaczyć stan modelu. Gdy stan jest wyświetlany jako gotowy, oznacza to, że model został przeszkolony i wdrożony.

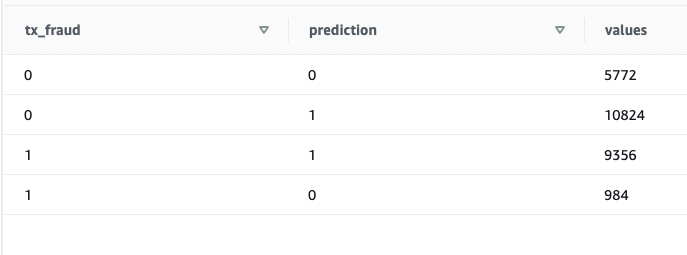

Poniższe zrzuty ekranu przedstawiają nasze wyniki.

Z danych wyjściowych widzę, że model został poprawnie rozpoznany jako BinaryClassification, a jako cel wybrano F1. The Wynik F1 jest metryką, która uwzględnia oba elementy precyzja i przypomnienie. Zwraca wartość od 1 (doskonała precyzja i pamięć) do 0 (najniższy możliwy wynik). W moim przypadku jest to 0.91. Im wyższa wartość, tym lepsza wydajność modelu.

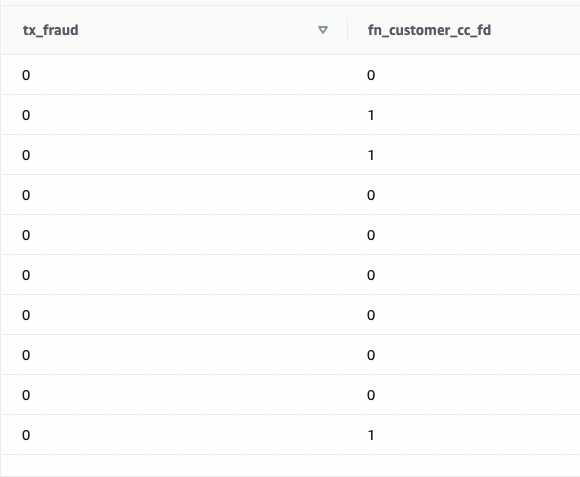

Przetestujmy ten model za pomocą testowego zestawu danych. Uruchom następującą komendę, która pobierze przykładowe prognozy:

Widzimy, że niektóre wartości są zgodne, a niektóre nie. Porównajmy przewidywania z podstawową prawdą:

Potwierdziliśmy, że model działa, a wynik F1 jest dobry. Przejdźmy do generowania prognoz dotyczących danych przesyłanych strumieniowo.

Przewiduj oszukańcze transakcje

Ponieważ model Redshift ML jest gotowy do użycia, możemy go użyć do uruchomienia prognoz dotyczących pozyskiwania danych przesyłanych strumieniowo. Zbiór danych historycznych zawiera więcej pól niż to, co mamy w źródle danych przesyłanych strumieniowo, ale są to tylko metryki aktualności i częstotliwości wokół klienta i ryzyka terminala w przypadku oszukańczej transakcji.

Możemy bardzo łatwo zastosować transformacje na przesyłanych strumieniowo danych, osadzając SQL w widokach. Utwórz pierwszy widok, która agreguje dane przesyłane strumieniowo na poziomie klienta. Następnie utwórz drugi widok, który agreguje dane przesyłane strumieniowo na poziomie terminala, oraz trzeci widok, który łączy przychodzące dane transakcyjne z zagregowanymi danymi klientów i terminali oraz wywołuje funkcję przewidywania w jednym miejscu. Kod trzeciego widoku jest następujący:

Uruchom instrukcję SELECT w widoku:

Gdy wielokrotnie uruchamiasz instrukcję SELECT, najnowsze transakcje kartą kredytową przechodzą transformacje i prognozy ML w czasie zbliżonym do rzeczywistego.

Pokazuje to potęgę Amazon Redshift — dzięki łatwym w użyciu poleceniom SQL możesz przekształcać przesyłane strumieniowo dane, stosując złożone funkcje okien i stosować model ML do przewidywania nieuczciwych transakcji w jednym kroku, bez tworzenia skomplikowanych potoków danych lub tworzenia i zarządzania dodatkowa infrastruktura.

Rozwiń rozwiązanie

Ponieważ strumienie danych i prognozy ML są tworzone w czasie zbliżonym do rzeczywistego, możesz budować procesy biznesowe do ostrzegania klientów za pomocą Usługa prostego powiadomienia Amazon (Amazon SNS) lub możesz zablokować konto karty kredytowej klienta w systemie operacyjnym.

Ten post nie zawiera szczegółów tych operacji, ale jeśli chcesz dowiedzieć się więcej o budowaniu rozwiązań opartych na zdarzeniach przy użyciu Amazon Redshift, zapoznaj się z poniższym Repozytorium GitHub.

Sprzątać

Aby uniknąć naliczania przyszłych opłat, usuń zasoby utworzone w ramach tego wpisu.

Wnioski

W tym poście pokazaliśmy, jak skonfigurować strumień danych Kinesis, skonfigurować producenta i publikować dane w strumieniach, a następnie utworzyć widok Amazon Redshift Streaming Ingestion i wysłać zapytanie do danych w Amazon Redshift. Gdy dane znalazły się w klastrze Amazon Redshift, zademonstrowaliśmy, jak wytrenować model uczenia maszynowego i zbudować funkcję przewidywania oraz zastosować ją do danych przesyłanych strumieniowo w celu generowania prognoz w czasie zbliżonym do rzeczywistego.

Jeśli masz jakieś uwagi lub pytania, zostaw je w komentarzach.

O autorach

Bhanu Pittampally’ego jest Architektem Rozwiązań Specjalistycznych ds. Analiz z siedzibą w Dallas. Specjalizuje się w budowaniu rozwiązań analitycznych. Ma doświadczenie w hurtowniach danych — architekturze, programowaniu i administracji. Z branżą danych i analityki związany od ponad 15 lat.

Bhanu Pittampally’ego jest Architektem Rozwiązań Specjalistycznych ds. Analiz z siedzibą w Dallas. Specjalizuje się w budowaniu rozwiązań analitycznych. Ma doświadczenie w hurtowniach danych — architekturze, programowaniu i administracji. Z branżą danych i analityki związany od ponad 15 lat.

Praveen Kadipikonda jest starszym architektem ds. rozwiązań analitycznych w firmie AWS z siedzibą w Dallas. Pomaga klientom budować wydajne, wydajne i skalowalne rozwiązania analityczne. Od ponad 15 lat zajmuje się budowaniem baz danych i rozwiązań hurtowni danych.

Praveen Kadipikonda jest starszym architektem ds. rozwiązań analitycznych w firmie AWS z siedzibą w Dallas. Pomaga klientom budować wydajne, wydajne i skalowalne rozwiązania analityczne. Od ponad 15 lat zajmuje się budowaniem baz danych i rozwiązań hurtowni danych.

Ritesh Kumar Sinha jest Architektem Rozwiązań Specjalistycznych ds. Analiz z siedzibą w San Francisco. Od ponad 16 lat pomaga klientom budować skalowalne hurtownie danych i rozwiązania Big Data. Uwielbia projektować i budować wydajne rozwiązania end-to-end na AWS. W wolnym czasie uwielbia czytać, spacerować i uprawiać jogę.

Ritesh Kumar Sinha jest Architektem Rozwiązań Specjalistycznych ds. Analiz z siedzibą w San Francisco. Od ponad 16 lat pomaga klientom budować skalowalne hurtownie danych i rozwiązania Big Data. Uwielbia projektować i budować wydajne rozwiązania end-to-end na AWS. W wolnym czasie uwielbia czytać, spacerować i uprawiać jogę.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/big-data/near-real-time-fraud-detection-using-amazon-redshift-streaming-ingestion-with-amazon-kinesis-data-streams-and-amazon-redshift-ml/

- 000

- Klienci 000

- 1

- 10

- 100

- 11

- 15 roku

- 67

- 7

- 9

- a

- Zdolny

- O nas

- powyżej

- dostęp

- Konto

- Osiągać

- Działania

- Dodatkowy

- administracja

- zaawansowany

- Po

- przed

- Alarm

- Wszystkie kategorie

- pozwala

- Amazonka

- Amazon EC2

- Amazonka Kinesis

- ilość

- analitycy

- Analityczny

- analityka

- w czasie rzeczywistym sprawiają,

- i

- wykrywanie anomalii

- Apache

- Zastosowanie

- Aplikuj

- Stosowanie

- architektura

- na około

- dołączać

- samochód

- automatycznie

- automatycznie

- dostępny

- unikając

- AWS

- tło

- na podstawie

- podstawowy

- bo

- staje się

- BEST

- Ulepsz Swój

- pomiędzy

- Duży

- Big Data

- przynieść

- budować

- Budowanie

- biznes

- procesów biznesowych

- biznes

- wezwanie

- nazywa

- Połączenia

- zdobyć

- karta

- walizka

- Etui

- charakter

- Opłaty

- ZOBACZ

- Dodaj

- Miasto

- Chmura

- Grupa

- kod

- kolumny

- kombajny

- przyjście

- komentarze

- porównać

- kompletny

- wypełniając

- kompleks

- kompleksowość

- obliczać

- rozważa

- Konsola

- konsumować

- konsument

- zawiera

- opłacalne

- mógłby

- Stwórz

- stworzony

- tworzy

- Tworzenie

- Listy uwierzytelniające

- kredyt

- Karta kredytowa

- klient

- dane klienta

- Klientów

- Cykle

- codziennie

- Dallas

- dane

- Przygotowywanie danych

- hurtownia danych

- magazyn danych

- Baza danych

- Bazy danych

- zbiory danych

- Data

- Podejmowanie decyzji

- Domyślnie

- definiowanie

- dostarczyć

- wykazać

- zależny

- rozwijać

- wdrażane

- wdraża się

- opisane

- Wnętrze

- detale

- Wykrywanie

- deweloperzy

- oprogramowania

- różne

- bezpośrednio

- Nie

- robi

- nie

- dow

- dynamiczny

- z łatwością

- łatwy w użyciu

- efekt

- wydajny

- umożliwiać

- Umożliwia

- koniec końców

- Inżynieria

- Wchodzę

- Eter (ETH)

- wydarzenie

- wydarzenia

- przykład

- podniecony

- zewnętrzny

- ekstrakcja

- f1

- znajomy

- FAST

- Cecha

- Korzyści

- informacja zwrotna

- pole

- Łąka

- filtry

- budżetowy

- Znajdź

- Flagi

- pływ

- obserwuj

- następujący

- następujący sposób

- Nasz formularz

- format

- znaleziono

- FRAME

- Francisco

- oszustwo

- wykrywanie oszustw

- Darmowy

- Częstotliwość

- od

- w pełni

- funkcjonować

- Funkcje

- przyszłość

- Generować

- wygenerowane

- generujący

- generator

- otrzymać

- Dać

- Go

- dobry

- przyznać

- Ziemia

- Zarządzanie

- mający

- pomógł

- pomaga

- wyższy

- Atrakcja

- historyczny

- historia

- W jaki sposób

- How To

- HTML

- HTTPS

- Setki

- IAM

- zidentyfikowane

- tożsamość

- znaczenie

- in

- zawierać

- Przybywający

- Zwiększać

- wzrastający

- indywidualny

- Informacja

- Infrastruktura

- wkład

- Wkłady

- spostrzeżenia

- zainstalować

- przykład

- Instytut

- instrukcje

- zainteresowany

- IT

- przystąpić

- json

- kafka

- Strumienie danych kinezy

- język

- większe

- Utajenie

- firmy

- uruchomić

- nauka

- Pozostawiać

- Długość

- poziom

- LIMIT

- ograniczenie

- załadować

- masa

- długoterminowy

- niski

- maszyna

- uczenie maszynowe

- zrobiony

- robić

- WYKONUJE

- zarządzane

- zarządzający

- ręcznie

- wiele

- mapa

- masywnie

- dopasowywanie

- matplotlib

- max

- znaczy

- Media

- metoda

- metryczny

- Metryka

- Złagodzić

- ML

- Moda

- model

- modele

- miesięcznie

- miesięcy

- jeszcze

- większość

- ruch

- Nazwa

- Nawigacja

- Potrzebować

- wymagania

- Nowości

- Następny

- powiadomienie

- numer

- tępy

- cel

- ONE

- otwiera

- działanie

- operacyjny

- operacje

- Szanse

- Opcje

- zamówienie

- organizacji

- Inne

- opisane

- Pakiety

- pandy

- chleb

- parametr

- część

- doskonały

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonuje

- uprawnienia

- telefon

- Miejsce

- planowanie

- Platforma

- Platformy

- plato

- Analiza danych Platona

- PlatoDane

- Proszę

- polityka

- polityka

- możliwy

- Post

- power

- Detaliczność

- przewidzieć

- przepowiednia

- Przewidywania

- Prognozy

- poprzedni

- wycena

- wygląda tak

- procesów

- producent

- Program

- zapewniać

- zapewnia

- publiczny

- publikować

- Python

- pytania

- szybko

- przypadkowy

- Czytający

- gotowy

- real

- w czasie rzeczywistym

- dane w czasie rzeczywistym

- zrealizowanie

- otrzymać

- Odebrane

- niedawny

- uznane

- dokumentacja

- WIELOKROTNIE

- obsługi produkcji rolnej, która zastąpiła

- wymagany

- Zasób

- Zasoby

- REST

- Efekt

- powraca

- Ryzyko

- Rola

- run

- bieganie

- sagemaker

- San

- San Francisco

- skalowalny

- Skala

- screeny

- Sdk

- poroże morskie

- druga

- sekund

- Sekcja

- działy

- bezpieczne

- wybrany

- wybór

- Bezserwerowe

- usługa

- zestaw

- ustawienie

- w panelu ustawień

- ustawienie

- krótkoterminowy

- pokazać

- Targi

- Prosty

- upraszczać

- symulator

- So

- Obserwuj Nas

- Media społecznościowe

- rozwiązanie

- Rozwiązania

- kilka

- Źródło

- Źródła

- specjalista

- specjalizuje się

- wydać

- dzielić

- SQL

- STAGE

- standard

- rozpoczęty

- Stan

- Zestawienie sprzedaży

- oświadczenia

- Rynek

- Ewolucja krok po kroku

- Cel

- przechowywanie

- sklep

- sklep

- Strategiczny

- strumień

- Streaming

- Usługa transmisji strumieniowej

- Strumienie

- taki

- Wspaniały

- system

- systemy

- stół

- Brać

- trwa

- Rozmowy

- cel

- terminal

- test

- Połączenia

- Trzeci

- tysiące

- Przez

- czas

- znak czasu

- do

- Top

- aktualny

- tradycyjnie

- Pociąg

- przeszkolony

- Trening

- transakcja

- transakcyjny

- transakcje

- Przekształcać

- przemiany

- transformatorowy

- Trend

- Aktualizacja

- zaktualizowane

- Stosowanie

- posługiwać się

- Użytkownik

- zatwierdzony

- wartość

- Wartości

- różnorodny

- Prawda

- wersja

- Zobacz i wysłuchaj

- widoki

- chodzący

- solucja

- Magazyn

- Magazynowanie

- Strona internetowa

- weekend

- tygodniowy

- Co

- który

- Podczas

- Wikipedia

- będzie

- bez

- pracował

- pracujący

- działa

- napisać

- lat

- Joga

- Twój

- zefirnet