Що таке векторні вбудовування?

Векторні вбудовування — це числові представлення, які фіксують зв’язки та значення слів, фраз та інших типів даних. За допомогою векторних вставок основні характеристики або ознаки об’єкта перетворюються на стислий упорядкований масив чисел, допомагаючи комп’ютерам швидко отримувати інформацію. Подібні точки даних згруповуються ближче одна до одної після перетворення в точки в багатовимірному просторі.

Використовується в широкому діапазоні програм, особливо в обробці природної мови (НЛП) і машинне навчання (ML), векторні вбудовування допомагають маніпулювати та обробляти дані для таких завдань, як порівняння подібності, кластеризація та класифікація. Наприклад, під час перегляду текстових даних такі слова, як як та кошеня передають подібні значення, незважаючи на відмінності в їх буквеному складі. Ефективний семантичний пошук спирається на точні представлення, які адекватно фіксують цю семантичну подібність між термінами.

[Вбудоване вміст]

Вбудовування та вектори – це одне й те саме?

Умови вектори та вбудовування можуть використовуватись як взаємозамінні в контексті векторних вкладень. Вони обидва посилаються на представлення числових даних, у яких кожен точка даних представлений як вектор у просторі великої розмірності.

Вектор відноситься до масиву чисел із визначеною розмірністю, тоді як векторні вбудовування використовують ці вектори для представлення точок даних у безперервному просторі.

Ця стаття є частиною

Вбудовування означає представлення даних у вигляді векторів для захоплення важливої інформації, семантичних зв’язків, контекстних якостей або організованого представлення даних, отриманих за допомогою навчальних алгоритмів або моделі машинного навчання.

Види векторних вкладень

Векторні вбудовування бувають різних форм, кожна з яких має окрему функцію для представлення різних типів даних. Нижче наведено деякі поширені типи векторних вставок:

- Вкладання слів. Вбудовування слів — це векторне представлення окремих слів у безперервному просторі. Вони часто використовуються для захоплення семантичних зв’язків між словами в таких завданнях, як аналіз настроїв, мовний переклад і подібність слів.

- Вкладання речень. Векторні представлення повних речень називаються вкладеннями речень. Вони корисні для таких завдань, як аналіз настроїв, категоризація тексту та пошук інформації, оскільки вони вловлюють зміст і контекст речення.

- Вбудовані документи. Вбудовані документи — це векторні зображення цілих документів, наприклад статей або звітів. Зазвичай використовуються в таких завданнях, як подібність документів, кластеризація та рекомендаційні системи, вони фіксують загальне значення та зміст документа.

- Вектори профілю користувача. Це векторні зображення вподобань, дій або рис користувача. Вони використовуються в сегментація клієнтів, персоналізовані системи рекомендацій і цільова реклама для збору даних про користувачів.

- Векторні зображення. Це векторне представлення візуальних елементів, таких як зображення або відеокадри. Вони використовуються в таких завданнях, як розпізнавання об'єктів, пошук зображень і системи рекомендацій на основі вмісту для захоплення візуальних особливостей.

- Продуктові вектори. Представляючи продукти або елементи як вектори, вони використовуються в пошуках продуктів, класифікації продуктів і системах рекомендацій для збору ознак і схожості між продуктами.

- Вектори профілю користувача. Вектори профілю користувача представляють уподобання, дії або риси користувача. Вони використовуються в сегментації користувачів, персоналізованих системах рекомендацій і цільова реклама для збору даних про користувача.

Як створюються векторні вкладення?

Векторні вбудовування генеруються за допомогою підходу ML, який навчає модель перетворювати дані на числові вектори. Як правило, глибокий згорткова нейронна мережа використовується для навчання цих типів моделей. Отримані вбудовування часто є щільними — усі значення ненульові — і мають велику розмірність — до 2,000 вимірів. Популярні моделі, такі як Word2Vec, GLoVE і БЕРТ перетворювати слова, фрази чи абзаци у векторні вбудовані текстові дані.

У процесі зазвичай беруть участь такі кроки:

- Зберіть великий набір даних. Складається набір даних, що фіксує конкретну категорію даних, для якої призначено вбудовування — незалежно від того, чи це стосується тексту чи зображень.

- Попередньо обробіть дані. Залежно від типу даних проводиться очищення, підготовка та попередня обробка даних передбачає усунення шуму, зміну розміру фотографій, нормалізацію тексту та виконання додаткових операцій.

- Тренуйте модель. Для визначення зв’язків і шаблонів у даних модель навчається за допомогою набору даних. Щоб зменшити розбіжність між цільовим і прогнозованим векторами, параметри попередньо навченої моделі змінюються на етапі навчання.

- Створення векторних вставок. Після навчання модель може перетворювати нові дані в числові вектори, представляючи змістовне та структуроване представлення, яке ефективно інкапсулює семантичну інформацію вихідних даних.

Векторні вбудовування можна робити для широкого діапазону типів даних, включаючи дані часових рядів, текст, зображення, аудіо, тривимірні (3D) моделі і відео. Через спосіб формування вкладень об’єкти зі схожою семантикою матимуть вектори у векторному просторі, близькі один до одного.

Де зберігаються векторні вкладення?

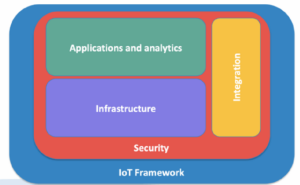

Векторні вбудовування зберігаються в спеціалізованих базах даних, відомих як векторні бази даних. Ці бази даних є багатовимірними математичними представленнями характеристик даних. На відміну від стандартних скалярних баз даних або незалежних векторних індексів, векторні бази даних забезпечують певну ефективність для зберігання та отримання векторних вбудованих даних у масштабі. Вони дають змогу ефективно зберігати та отримувати величезні обсяги даних для функцій векторного пошуку.

Векторні бази даних включають кілька ключових компонентів, включаючи продуктивність і відмовостійкість. Щоб переконатися, що векторні бази даних є відмовостійкими, реплікація та заточування використовуються техніки. Реплікація — це процес створення копій даних на численних вузлах, тоді як шардинг — це процес поділу даних на кілька вузлів. Це забезпечує відмовостійкість і безперебійну продуктивність, навіть якщо вузол виходить з ладу.

Векторні бази даних ефективні в машинному навчанні та штучному інтелекті (AI), оскільки вони спеціалізуються на управлінні неструктуровані та напівструктуровані дані.

Застосування векторних вкладень

Існує кілька застосувань векторного вбудовування в різних галузях. Загальні застосування векторних вставок включають наступне:

- Рекомендаційні системи. Векторні вбудовування відіграють вирішальну роль у системах рекомендацій гігантів галузі, зокрема Netflix і Amazon. Ці вбудовування дозволяють організаціям обчислювати подібність між користувачами та елементами, перетворюючи налаштування користувача та характеристики предметів у вектори. Цей процес допомагає надавати персоналізовані пропозиції, адаптовані до індивідуальних смаків користувачів.

- Пошукові системи. Пошукові системи широко використовуйте векторні вбудовування для підвищення ефективності та ефективності пошуку інформації. Оскільки векторні вставки виходять за рамки відповідності ключових слів, вони допомагають пошуковим системам інтерпретувати значення слів і речень. Навіть якщо точні фрази не збігаються, пошукові системи все одно можуть знаходити та отримувати документи чи іншу контекстуально релевантну інформацію, моделюючи слова як вектори в семантичному просторі.

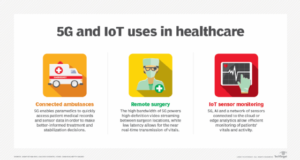

- Чат-боти та системи запитань. Допомога щодо вбудовування векторів чат-боти та генеративні системи відповідей на запитання на основі ШІ у розумінні та створенні людських відповідей. Вловлюючи контекст і значення тексту, вбудовування допомагає чат-ботам відповідати на запити користувачів осмислено та логічно. Наприклад, мовні моделі та чат-боти ШІ в тому числі GPT-4 і процесори зображень, такі як Dall-E2, набули величезної популярності завдяки створенню людських розмов і відповідей.

- Виявлення шахрайства та виявлення викидів. Вбудовування векторів можна використовувати для виявлення аномалій або шахрайських дій шляхом оцінки подібності між векторами. Незвичайні шаблони ідентифікуються шляхом оцінки відстані між вбудованими елементами та точного визначення чужинці.

- Попередня обробка даних. Перетворювати необроблені дані у формат, який підходить для ML і моделі глибокого навчання, вбудовування використовуються в діяльності з попередньої обробки даних. Вбудовування слів, наприклад, використовується для представлення слів як векторів, що полегшує обробку та аналіз текстових даних.

- Одноразове та нульове навчання. Одноразове та нульове навчання — це підходи векторного вбудовування, які допомагають моделям машинного навчання передбачати результати для нових класів, навіть якщо вони надаються з обмеженими даними з мітками. Моделі можуть узагальнювати та генерувати прогнози навіть з невеликою кількістю екземплярів навчання, використовуючи семантичну інформацію, включену у вбудовування.

- Семантична подібність і кластеризація. Вбудовування векторів полегшує оцінку того, наскільки схожі два об’єкти у багатовимірному середовищі. Це дає змогу виконувати такі операції, як обчислення семантичної подібності, кластеризація та збирання пов’язаних речей на основі їх вбудованих елементів.

Які речі можна вставляти?

Багато різних видів об’єктів і типів даних можна представити за допомогою векторних вставок. Поширені типи речей, які можна вбудовувати, включають наступне:

текст

Слова, фрази або документи представлені у вигляді векторів за допомогою вбудованих текстів. Завдання НЛП, включаючи аналіз настроїв, семантичний пошук і мовний переклад, часто використовують вбудовування.

Універсальний кодувальник речень є однією з найпопулярніших моделей вбудовування з відкритим кодом, і він може ефективно кодувати окремі речення та цілі фрагменти тексту.

зображень

Вбудовані зображення фіксують і представляють візуальні характеристики зображень як вектори. Варіанти їх використання включають ідентифікацію об’єктів, класифікацію зображень і зворотний пошук зображень, часто відомий як пошук за зображенням.

Вбудовування зображень також можна використовувати для забезпечення можливостей візуального пошуку. Витягуючи вбудовані зображення із зображень бази даних, користувач може порівнювати вбудовані зображення запиту з вбудованими фотографіями бази даних, щоб знайти візуально подібні збіги. Це зазвичай використовується в e-commerce програми, де користувачі можуть шукати товари, завантажуючи фотографії схожих продуктів.

Google Lens – це програма для пошуку зображень, яка порівнює фотографії камери з візуально подібними продуктами. Наприклад, його можна використовувати для підбору інтернет-продуктів, схожих на пару кросівок або предмет одягу.

аудіо

Вбудовані аудіо — це векторне представлення аудіосигналів. Векторні вбудовування фіксують звукові властивості, дозволяючи системам ефективніше інтерпретувати аудіодані. Наприклад, вбудовування аудіо можна використовувати для музичних рекомендацій, класифікації жанрів, пошуку схожості звуку, розпізнавання мовлення та перевірки мовця.

Хоча штучний інтелект використовується для різних типів вбудовування, ШІ аудіо приділяється менше уваги, ніж ШІ тексту чи зображення. Google Speech-to-Text і OpenAI Whisper – це програми для вбудовування аудіо, які використовуються в таких організаціях, як кол-центри, медичні технології, програми доступності та перетворення мови в текст.

діаграми

Вбудовані графи використовують вектори для представлення вузлів і ребер у графі. Вони є використовується в задачах, пов'язаних з аналітикою графів такі як передбачення посилань, визнання спільноти та системи рекомендацій.

Кожен вузол представляє сутність, наприклад людину, веб-сторінку або продукт, а кожне ребро символізує зв’язок або зв’язок, який існує між цими сутностями. Ці векторні вставки можуть досягти будь-чого, починаючи від рекомендації друзів соціальні мережі для виявлення проблем кібербезпеки.

Дані часових рядів і 3D-моделі

Вбудовані часові ряди фіксують часові шаблони в послідовних даних. Вони використовуються в Інтернет речей програми, фінансові дані та дані датчиків для діяльності, включаючи виявлення аномалій, прогнозування часових рядів та ідентифікація шаблону.

Геометричні аспекти 3D-об’єктів також можна виразити як вектори за допомогою вбудовування 3D-моделі. Вони застосовуються в таких завданнях, як 3D-реконструкція, виявлення об’єктів і зіставлення форм.

молекули

Вбудовані молекули представляють хімічні сполуки як вектори. Вони використовуються для відкриття ліків, пошуку хімічної подібності та прогнозування молекулярних властивостей. Ці вбудовування також використовуються в обчислювальній хімії та розробці ліків для фіксації структурних і хімічних особливостей молекул.

Що таке Word2Vec?

Word2Vec — це популярний підхід до вбудовування вектора слів у НЛП. Word2Vec, створений Google, призначений для представлення слів у вигляді щільних векторів у безперервному векторному просторі. Він може розпізнавати контекст слова в документі та зазвичай використовується в завданнях НЛП, таких як категоризація тексту, аналіз настроїв і машинний переклад щоб допомогти машинам ефективніше розуміти та обробляти природну мову.

Word2Vec базується на принципі, згідно з яким слова зі схожими значеннями повинні мати подібні векторні представлення, що дозволяє моделі фіксувати семантичні зв’язки між словами.

Word2Vec має дві основні архітектури, CBOW (Continuous Bag of Words) і Skip-Gram:

- CBOW. Ця архітектура передбачає цільове слово на основі контекстних слів. Модель отримує контекст або навколишні слова, і їй доручається передбачити цільове слово в центрі. Наприклад, у реченні «Швидка бура лисиця перестрибує ледачого собаку» CBOW використовує контекст або навколишні слова, щоб передбачити лисиця як цільове слово.

- Скіп-Грам. На відміну від CBOW, архітектура Skip-Gram передбачає контекстні слова на основі цільового слова. Моделі дається цільове слово, і її просять передбачити умови навколишнього контексту. Візьмемо вище приклад речення «Швидка бура лисиця перестрибує ледачого собаку», skip-gram візьме цільове слово лисиця і знайдіть такі контекстні слова, як «The», «quick», «brown», «jumps», «over», «the», «lazy» та «dog».

Багато компаній починають використовувати генеративний ШІ, демонструючи його руйнівний потенціал. Вивчити як розвивається генеративний ШІ, у якому напрямку він рухатиметься в майбутньому та які проблеми можуть виникнути.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- джерело: https://www.techtarget.com/searchenterpriseai/definition/vector-embeddings

- : має

- :є

- :де

- $UP

- 000

- 1

- 26

- 27

- 31

- 360

- 3d

- 40

- 43

- a

- вище

- доступність

- виконувати

- через

- дії

- діяльності

- Додатковий

- адекватно

- реклама

- після

- AI

- Aid

- посібник

- алгоритми

- ВСІ

- Також

- Amazon

- an

- аналіз

- та

- виявлення аномалії

- Інший

- будь-який

- додаток

- застосування

- прикладної

- підхід

- підходи

- відповідний

- додатка

- архітектура

- ЕСТЬ

- виникати

- масив

- стаття

- статті

- штучний

- штучний інтелект

- AS

- аспекти

- зібраний

- Оцінювання

- At

- увагу

- аудіо

- сумка

- Мішок слів

- заснований

- основний

- BE

- оскільки

- початок

- буття

- між

- За

- обидва

- коричневий

- підприємства

- by

- обчислювати

- call

- званий

- кімната

- CAN

- можливості

- потужність

- захоплення

- захопивши

- проведення

- випадків

- Категорія

- Центр

- Центри

- проблеми

- змінилися

- характеристика

- chatbots

- хімічний

- хімія

- класів

- класифікація

- Очищення

- близько

- ближче

- одяг

- Кластеризація

- COM

- Приходити

- загальний

- зазвичай

- співтовариство

- порівняти

- порівняння

- повний

- Компоненти

- склад

- осягнути

- обчислювальна

- комп'ютери

- обчислення

- лаконічний

- зв'язку

- зміст

- контекст

- контекстуальний

- безперервний

- розмови

- конвертувати

- copies

- створений

- вирішальне значення

- Кібербезпека

- дані

- точки даних

- набір даних

- Database

- базами даних

- глибокий

- глибоке навчання

- певний

- визначення

- доставка

- демонстрація

- щільний

- Залежно

- призначений

- Незважаючи на

- виявляти

- Виявлення

- розробка

- Відмінності

- різний

- Розмір

- розміри

- напрям

- відкрити

- відкриття

- руйнівний

- відстань

- чіткий

- do

- документ

- документація

- Пес

- Дон

- наркотик

- розробка ліків

- виявлення наркотиків

- під час

- кожен

- легше

- край

- Ефективний

- фактично

- ефективність

- Ефективність

- ефективність

- продуктивно

- усуваючи

- вбудований

- вбудовування

- обійняти

- включіть

- дозволяє

- інкапсулює

- Двигуни

- забезпечувати

- юридичні особи

- суб'єкта

- Навколишнє середовище

- особливо

- істотний

- Ефір (ETH)

- оцінки

- Навіть

- все

- досліджувати

- приклад

- існує

- виражений

- висловлюючи

- широко

- полегшує

- зазнає невдачі

- риси

- фінансовий

- фінансові дані

- знайти

- після

- для

- форма

- формат

- сформований

- форми

- лисиця

- шахрайський

- часто

- свіжий

- друзі

- від

- функція

- Функції

- майбутнє

- отримала

- збирати

- калібр

- Загальне

- породжувати

- генерується

- генеративний

- Генеративний ШІ

- жанр

- гіганти

- даний

- рукавичка

- Go

- графік

- Мати

- допомога

- корисний

- допомогу

- Високий

- Як

- HTTPS

- величезний

- ICON

- Ідентифікація

- ідентифікований

- ідентифікувати

- if

- зображення

- Пошук зображень

- зображень

- величезний

- удосконалювати

- in

- включати

- включені

- У тому числі

- незалежний

- покажчики

- індивідуальний

- промисловості

- промисловість

- інформація

- Запити

- всередині

- екземпляр

- випадки

- Інтелект

- призначених

- інтернет

- в

- залучений

- включає в себе

- питання

- IT

- пунктів

- ЙОГО

- скачки

- ключ

- відомий

- мова

- великий

- вчений

- вивчення

- об'єктив

- менше

- дозволяти

- лист

- здавати

- обмеженою

- LINK

- зв'язку

- логічний

- шукати

- машина

- навчання за допомогою машини

- Машинки для перманенту

- made

- зробити

- РОБОТИ

- управління

- манера

- матч

- сірники

- узгодження

- математичний

- сенс

- значущим

- значення

- медичний

- може бути

- ML

- модель

- моделювання

- Моделі

- молекулярний

- більше

- найбільш

- Найбільш популярний

- музика

- Природний

- Природна мова

- Обробка природних мов

- Netflix

- Нейронний

- Нові

- nlp

- вузол

- вузли

- шум

- номер

- номера

- численний

- об'єкт

- Виявлення об'єктів

- об'єкти

- of

- пропонувати

- часто

- on

- ONE

- відкрити

- з відкритим вихідним кодом

- операції

- or

- організації

- Організований

- оригінал

- Інше

- з

- Результати

- чуже

- над

- сторінка

- пара

- параметри

- частина

- Викрійки

- моделі

- продуктивність

- людина

- Персоналізовані

- фаза

- фотографії

- фрази

- картина

- фотографії

- частина

- plato

- Інформація про дані Платона

- PlatoData

- Play

- точок

- популярний

- популярність

- це можливо

- потенціал

- необхідність

- передбачати

- передвіщений

- прогнозування

- прогноз

- Прогнози

- Прогнози

- переваги

- підготовка

- принцип

- процес

- обробка

- процесори

- виробництво

- Product

- Production

- Продукти

- профіль

- властивості

- власність

- забезпечувати

- забезпечує

- якості

- Швидко

- діапазон

- швидко

- RE

- отримано

- визнання

- визнавати

- Рекомендація

- рекомендації

- рекомендуючи

- зменшити

- послатися

- відноситься

- пов'язаний

- Відносини

- доречний

- копіювання

- Звіти

- представляти

- подання

- представлений

- представляє

- представляє

- Реагувати

- відповіді

- в результаті

- пошук

- зворотний

- Роль

- s

- то ж

- шкала

- Пошук

- Пошукові системи

- пошук

- Грати короля карти - безкоштовно Nijumi логічна гра гри

- розділ

- сегментація

- смисловий

- семантика

- датчик

- пропозиція

- настрій

- Серія

- комплект

- набори

- кілька

- заточування

- Повинен

- показ

- сигнали

- значний

- аналогічний

- схожість

- з

- невеликий

- Кросівки

- деякі

- Source

- Простір

- Гучномовець

- спеціалізуватися

- спеціалізований

- конкретний

- мова

- Розпізнавання мови

- мовлення в текст

- standard

- заходи

- Як і раніше

- зберігати

- зберігати

- структурний

- структурований

- такі

- поставляється

- Навколо

- символізує

- Systems

- T

- з урахуванням

- Приймати

- взяття

- Мета

- цільове

- завдання

- методи

- Технологія

- terms

- текст

- ніж

- Що

- Команда

- Майбутнє

- їх

- Ці

- вони

- річ

- речі

- це

- ті

- через

- час

- Часовий ряд

- до

- разом

- терпимість

- поїзд

- навчений

- Навчання

- поїзда

- Перетворення

- Переклад

- ПЕРЕГЛЯД

- два

- тип

- Типи

- типово

- Uncommon

- розуміння

- безперебійний

- Universal

- на відміну від

- Завантаження

- використання

- використовуваний

- користувач

- користувачі

- використовує

- використання

- Цінності

- різноманітність

- різний

- перевірка

- через

- Відео

- візуальний

- візуально

- шлях..

- Web

- Що

- Що таке

- коли

- в той час як

- Чи

- який

- в той час як

- Шепіт

- всі

- широкий

- Широкий діапазон

- волі

- з

- слово

- слова

- YouTube

- зефірнет

- Zero-Shot Навчання