Tässä viestissä osoitamme, kuinka käyttää hermoarkkitehtuurihakuun (NAS) perustuvaa rakenteellista karsimista hienosäädetyn BERT-mallin pakkaamiseen mallin suorituskyvyn parantamiseksi ja päättelyaikojen lyhentämiseksi. Valmiiksi koulutetut kielimallit (PLM) ovat nopeassa kaupallisessa ja yrityskäytössä tuottavuustyökalujen, asiakaspalvelun, haun ja suositusten, liiketoimintaprosessien automatisoinnin ja sisällöntuotannon aloilla. PLM-päätepäätepisteiden käyttöönottoon liittyy tyypillisesti korkeampi latenssi ja korkeammat infrastruktuurikustannukset laskentavaatimuksista johtuen ja laskennallinen tehokkuus parametrien suuren määrän vuoksi. PLM:n karsiminen vähentää mallin kokoa ja monimutkaisuutta säilyttäen samalla sen ennustamisominaisuudet. Karsitetut PLM:t saavuttavat pienemmän muistitilan ja pienemmän latenssin. Osoitamme, että karsimalla PLM:ää ja vaihtamalla pois parametrien lukumäärä ja validointivirhe tietylle kohdetehtävälle, ja pystymme saavuttamaan nopeammat vasteajat verrattuna perus-PLM-malliin.

Monitavoiteoptimointi on päätöksenteon osa-alue, joka optimoi useamman kuin yhden tavoitefunktion, kuten muistinkulutuksen, harjoitusajan ja laskentaresurssit, optimoitavaksi samanaikaisesti. Rakenneleikkaus on tekniikka, jolla pienennetään PLM:n kokoa ja laskennallisia vaatimuksia karsimalla kerroksia tai hermosoluja/solmuja samalla kun pyritään säilyttämään mallin tarkkuus. Poistamalla kerroksia rakenteellisella karsimisella saavutetaan korkeammat pakkausnopeudet, mikä johtaa laitteistoystävälliseen rakenteelliseen harvuuteen, joka lyhentää ajo- ja vasteaikoja. Rakenteellisen karsintatekniikan soveltaminen PLM-malliin johtaa kevyempään malliin, jolla on pienempi muistitila, joka, kun se isännöidään päätepisteenä SageMakerissa, tarjoaa paremman resurssitehokkuuden ja pienemmät kustannukset verrattuna alkuperäiseen hienosäädettyyn PLM:ään.

Tässä viestissä kuvattuja käsitteitä voidaan soveltaa sovelluksiin, jotka käyttävät PLM-ominaisuuksia, kuten suositusjärjestelmiä, mielipideanalyysiä ja hakukoneita. Erityisesti voit käyttää tätä lähestymistapaa, jos sinulla on omistettu koneoppimis- (ML) ja datatiederyhmiä, jotka hienosäätävät omia PLM-mallejaan käyttämällä verkkotunnuskohtaisia tietojoukkoja ja ottavat käyttöön suuren määrän päättelypäätepisteitä käyttämällä Amazon Sage Maker. Yksi esimerkki on online-jälleenmyyjä, joka käyttää useita päätelmäpäätepisteitä tekstiyhteenvetoon, tuoteluettelon luokitteluun ja tuotepalautteen mielialan luokitteluun. Toinen esimerkki voi olla terveydenhuollon tarjoaja, joka käyttää PLM-päätelmäpäätepisteitä kliinisten asiakirjojen luokitteluun, nimettyjen entiteettien tunnistamiseen lääketieteellisistä raporteista, lääketieteellisistä chatboteista ja potilaiden riskien kerrostamiseen.

Ratkaisun yleiskatsaus

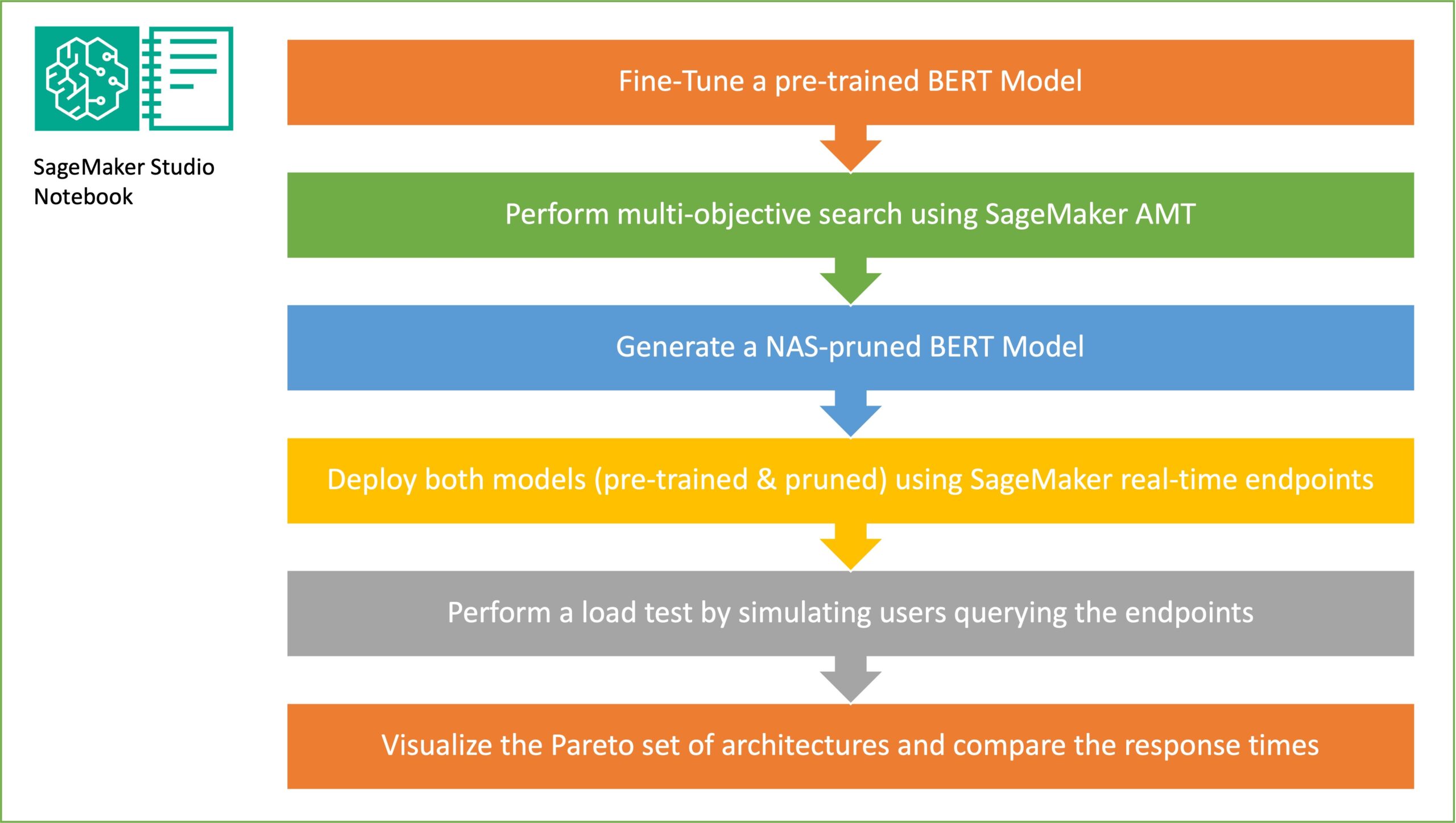

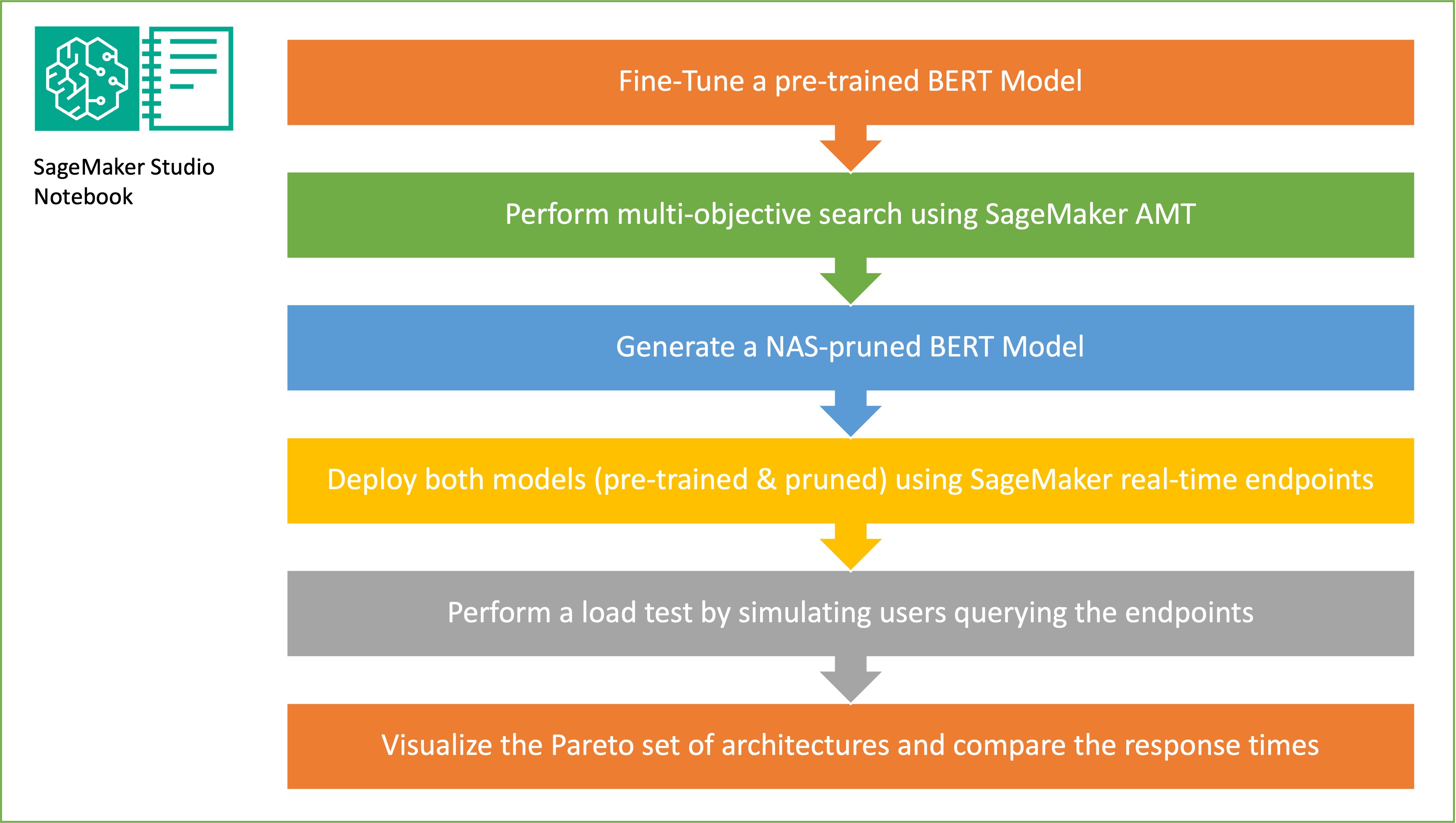

Tässä osiossa esittelemme yleisen työnkulun ja selitämme lähestymistavan. Ensin käytämme an Amazon SageMaker Studio muistikirja hienosäätää esikoulutetun BERT-mallin kohdetehtävässä verkkotunnuskohtaisen tietojoukon avulla. BERTI (Bidirectional Encoder Representations from Transformers) on valmiiksi koulutettu kielimalli, joka perustuu muuntajan arkkitehtuuri käytetään luonnollisen kielen käsittelyyn (NLP). Neuralarchitektuurihaku (NAS) on keino automatisoida keinotekoisten hermoverkkojen suunnittelua, ja se liittyy läheisesti hyperparametrien optimointiin, joka on laajalti käytetty lähestymistapa koneoppimisen alalla. NAS:n tavoitteena on löytää optimaalinen arkkitehtuuri tietylle ongelmalle etsimällä laajasta ehdokasarkkitehtuurijoukosta käyttämällä tekniikoita, kuten gradienttivapaata optimointia tai optimoimalla haluttuja mittareita. Arkkitehtuurin suorituskykyä mitataan tyypillisesti mittareilla, kuten validointihäviöllä. SageMaker automaattinen mallin viritys (AMT) automatisoi ikävän ja monimutkaisen prosessin löytää ML-mallin hyperparametrien optimaaliset yhdistelmät, jotka tuottavat parhaan mallin suorituskyvyn. AMT käyttää älykkäitä hakualgoritmeja ja iteratiivisia arvioita käyttämällä määrittämiäsi hyperparametreja. Se valitsee hyperparametriarvot, jotka luovat mallin, joka toimii parhaiten suoritusmittareilla, kuten tarkkuudella ja F-1-pisteillä mitattuna.

Tässä viestissä kuvattu hienosäätömenetelmä on yleinen ja sitä voidaan soveltaa mihin tahansa tekstipohjaiseen tietojoukkoon. BERT PLM:lle määritetty tehtävä voi olla tekstipohjainen tehtävä, kuten tunneanalyysi, tekstin luokittelu tai Q&A. Tässä esittelyssä kohdetehtävä on binäärinen luokitteluongelma, jossa BERT:n avulla tunnistetaan tekstinpätkäparien kokoelmasta koostuvasta tietojoukosta, voidaanko yhden tekstifragmentin merkitys päätellä toisesta fragmentista. Käytämme Tunnistetaan tekstin aiheuttama tietoaineisto GLUE-benchmarking-sarjasta. Suoritamme monitavoitehaun SageMaker AMT:n avulla tunnistaaksemme aliverkot, jotka tarjoavat optimaalisen kompromissin parametrien määrän ja kohdetehtävän ennustetarkkuuden välillä. Kun suoritamme usean tavoitteen haun, aloitamme tarkkuuden ja parametrien määrän määrittelemisellä tavoitteiksi, joita pyrimme optimoimaan.

BERT PLM -verkossa voi olla modulaarisia, itsenäisiä aliverkkoja, jotka mahdollistavat mallin erikoisominaisuuksien, kuten kielen ymmärtämisen ja tiedon esittämisen. BERT PLM käyttää monipäistä itsehuomio-aliverkkoa ja syöte-aliverkkoa. Monipäinen itsehuomiokerros antaa BERT:lle mahdollisuuden yhdistää yksittäisen sekvenssin eri paikat voidakseen laskea sekvenssin esityksen sallimalla useiden päiden huolehtia useista kontekstisignaaleista. Syöttö on jaettu useisiin aliavaruuksiin ja itsehuomiota sovelletaan kuhunkin alitilaan erikseen. Muuntaja-PLM:n useat päät mahdollistavat sen, että malli voi yhdessä käsitellä tietoa eri esitysaliavaruuksista. Forward-aliverkko on yksinkertainen hermoverkko, joka ottaa lähdön monipäisestä itsehuomio-aliverkosta, käsittelee tiedot ja palauttaa lopulliset kooderiesitykset.

Satunnaisen aliverkon otannan tavoitteena on kouluttaa pienempiä BERT-malleja, jotka pystyvät suoriutumaan riittävän hyvin kohdetehtävissä. Otamme näytteen 100 satunnaisesta aliverkosta hienosäädetystä BERT-perusmallista ja arvioimme 10 verkkoa samanaikaisesti. Koulutetut aliverkot arvioidaan objektiivisten mittareiden osalta ja lopullinen malli valitaan objektiivisten mittareiden välillä löydettyjen kompromissien perusteella. Visualisoimme Pareto edessä näytteitetyille aliverkoille, jotka sisältävät karsitun mallin, joka tarjoaa optimaalisen kompromissin mallin tarkkuuden ja mallin koon välillä. Valitsemme ehdokasaliverkon (NAS-karsittu BERT-malli) mallin koon ja mallin tarkkuuden perusteella, joista olemme valmiita vaihtamaan. Seuraavaksi isännöimme päätepisteitä, esikoulutettua BERT-perusmallia ja NAS-karsittua BERT-mallia SageMakerin avulla. Kuormitustestauksen suorittamiseen käytämme heinäsirkka, avoimen lähdekoodin kuormitustestaustyökalu, jonka voit toteuttaa Pythonilla. Suoritamme kuormitustestauksen molemmissa päätepisteissä käyttämällä Locustia ja visualisoimme tulokset Pareto-rintamalla havainnollistamaan molempien mallien vasteaikojen ja tarkkuuden välistä kompromissia. Seuraava kaavio tarjoaa yleiskatsauksen tässä viestissä selitetystä työnkulusta.

Edellytykset

Tätä virkaa varten vaaditaan seuraavat edellytykset:

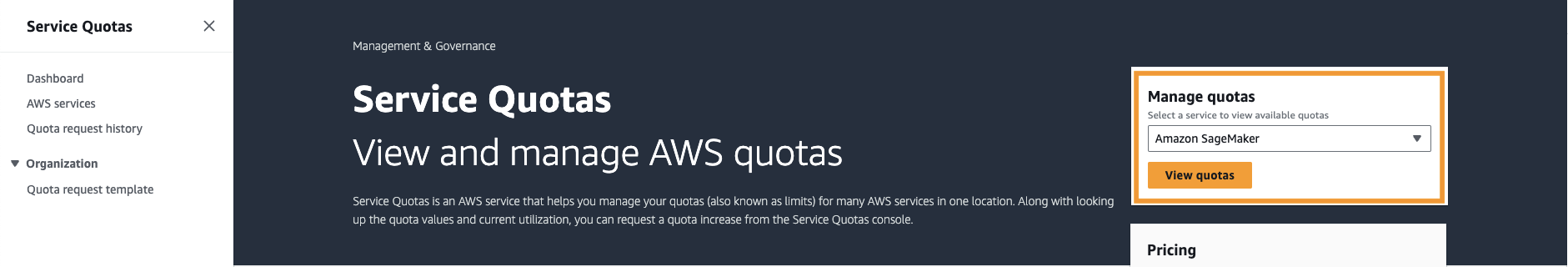

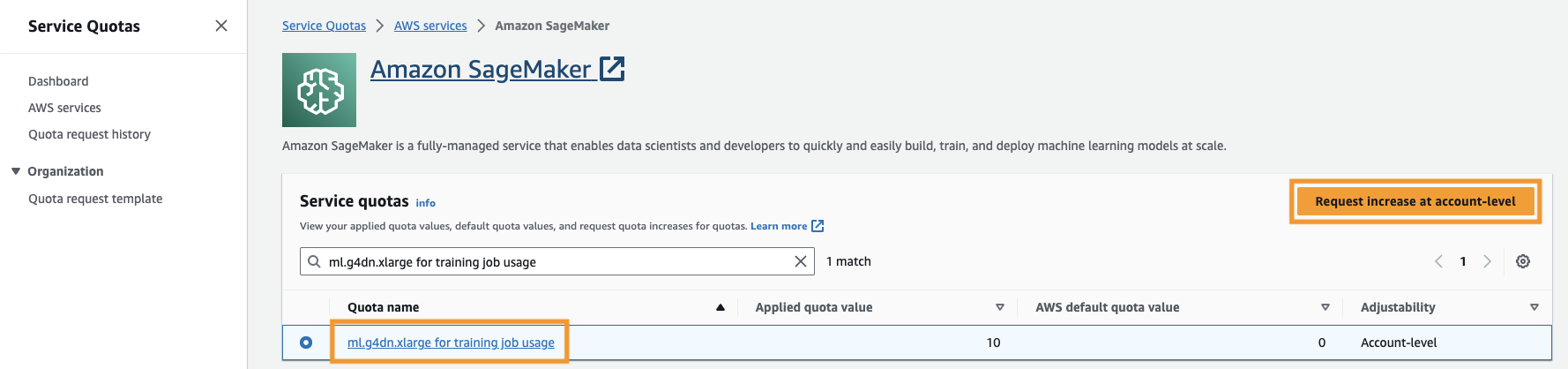

Sinun on myös lisättävä palvelukiintiö päästäksesi vähintään kolmeen ml.g4dn.xlarge-instanssiin SageMakerissa. Ilmentymätyyppi ml.g4dn.xlarge on kustannustehokas GPU-instanssi, jonka avulla voit ajaa PyTorchia natiivisti. Voit kasvattaa palvelukiintiötä suorittamalla seuraavat vaiheet:

- Siirry konsolissa kohtaan Palvelukiintiöt.

- varten Hallitse kiintiöitä, valitse Amazon Sage Maker, valitse sitten Näytä kiintiöt.

- Etsi "ml-g4dn.xlarge for training job use use" ja valitse kiintiökohta.

- Valita Pyydä korotusta tilitasolla.

- varten Kasvata kiintiön arvoa, anna arvo 5 tai suurempi.

- Valita Pyydä.

Pyydetty kiintiön hyväksyntä saattaa kestää jonkin aikaa tilin käyttöoikeuksista riippuen.

- Avaa SageMaker Studio SageMaker-konsolista.

- Valita Järjestelmän pääte varten Apuohjelmat ja tiedostot.

- Suorita seuraava komento kloonataksesi GitHub repo SageMaker Studio -esiintymään:

- Navigoida johonkin

amazon-sagemaker-examples/hyperparameter_tuning/neural_architecture_search_llm. - Avaa tiedosto

nas_for_llm_with_amt.ipynb. - Määritä ympäristö käyttämällä

ml.g4dn.xlargeja valitse valita.

Aseta esikoulutettu BERT-malli

Tässä osiossa tuomme Recognizing Textual Entailment -tietojoukon tietojoukkokirjastosta ja jaamme tietojoukon koulutus- ja validointijoukoiksi. Tämä tietojoukko koostuu lausepareista. BERT PLM:n tehtävänä on tunnistaa kahden tekstifragmentin perusteella, voidaanko toisen tekstikatkelman merkitys päätellä toisesta fragmentista. Seuraavassa esimerkissä voimme päätellä ensimmäisen lauseen merkityksen toisesta lauseesta:

Lataamme tekstintunnistusta koskevan tietojoukon tiedostosta lIIMA benchmarking-sarjan kautta tietojoukkokirjasto Hugging Facesta harjoituskäsikirjoituksessamme (./training.py). Jaoimme alkuperäisen harjoitustietojoukon GLUEsta koulutus- ja validointijoukoksi. Lähestymistapassamme hienosäädämme BERT-perusmallia käyttämällä koulutustietojoukkoa, minkä jälkeen suoritamme usean tavoitteen haun tunnistaaksemme joukon aliverkkoja, jotka tasapainottavat optimaalisesti tavoitemittareiden välillä. Käytämme harjoitustietoaineistoa yksinomaan BERT-mallin hienosäätöön. Käytämme kuitenkin validointitietoja usean tavoitteen hakuun mittaamalla tarkkuutta pitoajan validointitietojoukossa.

Hienosäädä BERT PLM käyttämällä verkkotunnuskohtaista tietojoukkoa

Raaka BERT-mallin tyypillisiä käyttötapauksia ovat seuraavan lauseen ennustaminen tai maskikielimallinnus. Jotta voisimme käyttää BERT-perusmallia loppupään tehtäviin, kuten tekstintunnistukseen, meidän on hienosäädettävä mallia edelleen käyttämällä verkkotunnuskohtaista tietojoukkoa. Voit käyttää hienosäädettyä BERT-mallia tehtäviin, kuten sekvenssiluokitukseen, kysymyksiin vastaamiseen ja merkkien luokitteluun. Tässä demossa käytämme kuitenkin hienosäädettyä mallia binääriluokitukseen. Hienosäädämme esikoulutettua BERT-mallia aiemmin laatimallamme harjoitustietojoukolla käyttämällä seuraavia hyperparametreja:

Tallennamme mallikoulutuksen tarkistuspisteen an Amazonin yksinkertainen tallennuspalvelu (Amazon S3) ämpäri, jotta malli voidaan ladata NAS-pohjaisen moniobjektiivihaun aikana. Ennen kuin harjoitamme mallia, määritämme mittarit, kuten epookki, harjoitushäviö, parametrien lukumäärä ja validointivirhe:

Kun hienosäätöprosessi alkaa, harjoitustyö kestää noin 15 minuuttia.

Valitse aliverkostot ja visualisoi tulokset suorittamalla usean kohteen haku

Seuraavassa vaiheessa suoritamme moniobjektiivisen haun hienosäädetylle BERT-perusmallille ottamalla näytteitä satunnaisista aliverkoista SageMaker AMT:n avulla. Päästäksemme aliverkkoon superverkon sisällä (hienoviritetty BERT-malli), peitämme kaikki PLM:n komponentit, jotka eivät ole osa aliverkkoa. Superverkon peittäminen aliverkkojen löytämiseksi PLM:stä on tekniikka, jota käytetään eristämään ja tunnistamaan mallin käyttäytymismalleja. Huomaa, että Hugging Face -muuntajat tarvitsevat piilotetun koon ollakseen monikertainen päiden lukumäärästä. Muuntajan PLM:n piilotettu koko ohjaa piilotilavektoriavaruuden kokoa, mikä vaikuttaa mallin kykyyn oppia monimutkaisia esityksiä ja kuvioita tiedossa. BERT PLM:ssä piilotilavektori on kiinteän kokoinen (768). Emme voi muuttaa piilotettua kokoa, ja siksi päiden lukumäärän on oltava [1, 3, 6, 12].

Toisin kuin yhden tavoitteen optimoinnissa, monen tavoitteen asetuksissa meillä ei yleensä ole yhtä ratkaisua, joka optimoi kaikki tavoitteet samanaikaisesti. Sen sijaan pyrimme keräämään joukon ratkaisuja, jotka hallitsevat kaikkia muita ratkaisuja ainakin yhdessä tavoitteessa (kuten validointivirhe). Nyt voidaan aloittaa monitavoitehaku AMT:n kautta asettamalla mittarit, joita haluamme vähentää (validointivirhe ja parametrien määrä). Satunnaiset aliverkot määritellään parametrilla max_jobs ja samanaikaisten töiden määrä määritellään parametrilla max_parallel_jobs. Koodi mallin tarkistuspisteen lataamiseksi ja aliverkon arvioimiseksi on saatavilla osoitteessa evaluate_subnetwork.py skriptejä.

AMT-viritystyö kestää noin 2 tuntia ja 20 minuuttia. Kun AMT-viritystyö on suoritettu onnistuneesti, jäsennämme työn historian ja keräämme aliverkon konfiguraatiot, kuten päiden lukumäärän, kerrosten lukumäärän, yksiköiden lukumäärän ja vastaavat mittarit, kuten validointivirheen ja parametrien lukumäärän. Seuraava kuvakaappaus näyttää yhteenvedon onnistuneesta AMT-viritintyöstä.

Seuraavaksi visualisoimme tulokset käyttämällä Pareto-joukkoa (tunnetaan myös nimellä Pareto Frontier tai Pareto-optimaalinen joukko), joka auttaa meitä tunnistamaan optimaaliset aliverkkojen joukot, jotka hallitsevat kaikkia muita aliverkkoja tavoitemittarissa (validointivirhe):

Ensin keräämme tiedot AMT-viritystyöstä. Sitten piirrämme Pareto-joukon käyttämällä matplotlob.pyplot parametrien lukumäärä x-akselilla ja validointivirhe y-akselilla. Tämä tarkoittaa, että kun siirrymme Pareto-joukon aliverkosta toiseen, meidän on joko uhrattava suorituskyky tai mallin koko, mutta parannettava toista. Viime kädessä Pareto-sarja tarjoaa meille joustavuuden valita mieltymyksiimme parhaiten sopiva aliverkko. Voimme päättää, kuinka paljon haluamme pienentää verkostomme kokoa ja kuinka paljon suorituskykyä olemme valmiita uhraamaan.

Ota käyttöön hienosäädetty BERT-malli ja NAS-optimoitu aliverkkomalli SageMakerin avulla

Seuraavaksi otamme käyttöön Pareto-sarjamme suurimman mallin, joka johtaa pienimpään suorituskyvyn heikkenemiseen SageMaker-päätepiste. Paras malli on se, joka tarjoaa optimaalisen kompromissin validointivirheen ja parametrien lukumäärän välillä käyttötapauksessamme.

Mallivertailu

Otimme valmiiksi koulutetun BERT-perusmallin, hienosäädimme sitä verkkotunnuskohtaisella tietojoukolla, suoritimme NAS-haun hallitsevien aliverkkojen tunnistamiseksi objektiivisten mittareiden perusteella ja otimme karsitun mallin käyttöön SageMaker-päätepisteessä. Lisäksi otimme valmiiksi koulutetun BERT-perusmallin ja otimme perusmallin käyttöön toisessa SageMaker-päätepisteessä. Seuraavaksi juoksimme kuormitustestaus käyttämällä Locustia molemmissa päätepisteissä ja arvioinut suorituskykyä vasteajan suhteen.

Ensin tuomme tarvittavat Locust- ja Boto3-kirjastot. Sitten rakennamme pyynnön metatiedot ja kirjaamme aloitusajan käytettäväksi kuormitustestauksessa. Sitten hyötykuorma välitetään SageMaker-päätepisteen kutsusovellusliittymälle BotoClient-sovelluksen kautta todellisten käyttäjien pyyntöjen simuloimiseksi. Käytämme Locustia synnyttämään useita virtuaalisia käyttäjiä lähettämään pyyntöjä rinnakkain ja mittaamaan päätepisteen suorituskykyä kuormituksen alaisena. Testit suoritetaan lisäämällä käyttäjien määrää kummallekin päätepisteelle, vastaavasti. Kun testit on suoritettu, Locust tulostaa pyyntötilastojen CSV-tiedoston jokaiselle käyttöönotetulle mallille.

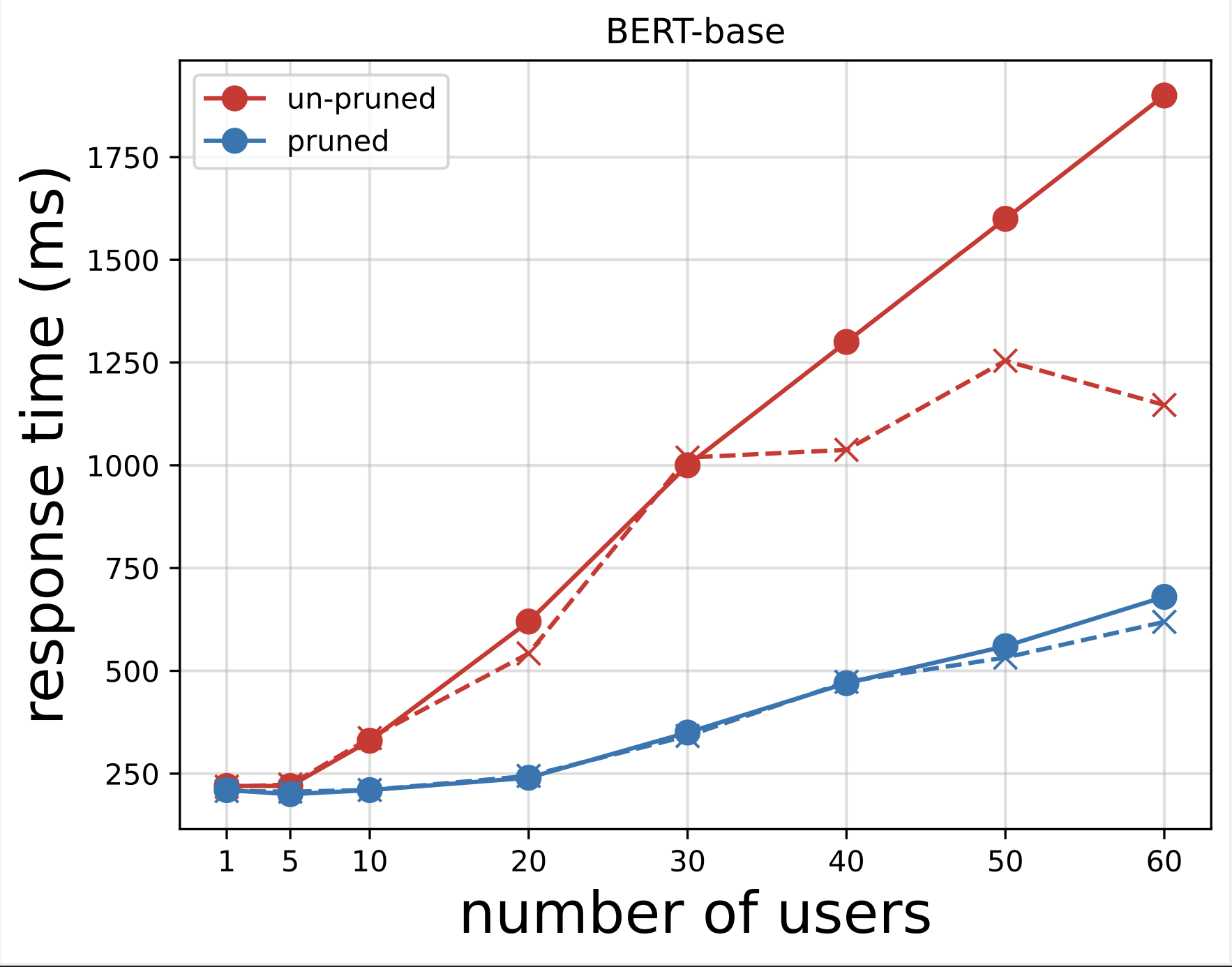

Seuraavaksi luomme vasteaikakaaviot CSV-tiedostoista, jotka on ladattu Locust-testien suorittamisen jälkeen. Vasteajan ja käyttäjien lukumäärän kuvaajan tarkoituksena on analysoida kuormitustestauksen tuloksia visualisoimalla mallin päätepisteiden vasteajan vaikutus. Seuraavassa kaaviossa voimme nähdä, että NAS-karsittu mallin päätepiste saavuttaa lyhyemmän vasteajan verrattuna BERT-perusmallin päätepisteeseen.

Toisessa kaaviossa, joka on ensimmäisen kaavion jatke, havaitsemme, että noin 70 käyttäjän jälkeen SageMaker alkaa kuristaa BERT-perusmallin päätepistettä ja tekee poikkeuksen. NAS-karsitussa mallin päätepisteessä kuristus tapahtuu kuitenkin 90–100 käyttäjän välillä ja pienemmällä vasteajalla.

Näistä kahdesta kaaviosta huomaamme, että karsitulla mallilla on nopeampi vasteaika ja se skaalautuu paremmin kuin karsimaton malli. Kun skaalaamme päättelypäätepisteiden määrää, kuten käyttäjille, jotka ottavat käyttöön suuren määrän päättelypäätepisteitä PLM-sovelluksiinsa, kustannusedut ja suorituskyvyn paraneminen alkavat olla melko merkittäviä.

Puhdistaa

Voit poistaa SageMaker-päätepisteet hienosäädetystä BERT-perusmallista ja NAS-karsitusta mallista suorittamalla seuraavat vaiheet:

- Valitse SageMaker-konsolissa Päättely ja Endpoints navigointipaneelissa.

- Valitse päätepiste ja poista se.

Vaihtoehtoisesti voit suorittaa seuraavat komennot SageMaker Studio -muistikirjasta antamalla päätepisteiden nimet:

Yhteenveto

Tässä viestissä keskustelimme siitä, kuinka NAS:ia käytetään hienosäädetyn BERT-mallin karsimiseen. Koulutimme ensin BERT-perusmallin käyttämällä verkkotunnuskohtaisia tietoja ja otimme sen käyttöön SageMaker-päätepisteessä. Teimme monitavoitehaun hienosäädetylle BERT-perusmallille käyttämällä kohdetehtävää SageMaker AMT:tä. Visualisoimme Pareto-rintaman ja valitsimme Paretolle optimaalisen NAS-karsitun BERT-mallin ja otimme mallin käyttöön toiseen SageMaker-päätepisteeseen. Suoritimme kuormitustestauksen Locustilla simuloidaksemme käyttäjiä, jotka kyselevät sekä päätepisteitä, että mittasimme ja tallensimme vasteajat CSV-tiedostoon. Piirimme molempien mallien vasteajan vs. käyttäjien lukumäärän.

Havaitsimme, että karsittu BERT-malli toimi huomattavasti paremmin sekä vasteajassa että ilmentymän kuristuskynnyksessä. Päätimme, että NAS-karsittu malli oli kestävämpi päätepisteen lisääntyneelle kuormitukselle ja säilytti lyhyemmän vasteajan, vaikka useammat käyttäjät rasittivat järjestelmää verrattuna BERT-perusmalliin. Voit soveltaa tässä viestissä kuvattua NAS-tekniikkaa mihin tahansa suureen kielimalliin löytääksesi karsitun mallin, joka pystyy suorittamaan kohdetehtävän huomattavasti pienemmällä vasteajalla. Voit optimoida lähestymistapaa edelleen käyttämällä latenssia parametrina validointihäviön lisäksi.

Vaikka käytämme NAS:ia tässä viestissä, kvantisointi on toinen yleinen lähestymistapa, jota käytetään PLM-mallien optimointiin ja pakkaamiseen. Kvantisointi vähentää painotusten ja aktivointien tarkkuutta koulutetussa verkossa 32-bittisestä liukulukusta pienempiin bittileveyksiin, kuten 8-bittisiin tai 16-bittisiin kokonaislukuihin, mikä johtaa pakattuun malliin, joka tuottaa nopeamman päättelyn. Kvantisointi ei vähennä parametrien määrää; sen sijaan se heikentää olemassa olevien parametrien tarkkuutta saadakseen pakatun mallin. NAS-karsiminen poistaa redundantit verkot PLM:stä, mikä luo harvaan mallin, jossa on vähemmän parametreja. Tyypillisesti NAS-karsimista ja kvantisointia käytetään yhdessä suurten PLM:ien pakkaamiseen mallin tarkkuuden ylläpitämiseksi, validointihäviöiden vähentämiseksi ja suorituskyvyn parantamiseksi sekä mallin koon pienentämiseksi. Muita yleisesti käytettyjä tekniikoita PLM:ien koon pienentämiseksi ovat tiedon tislaus, matriisifaktorointija tislauskaskadit.

Blogitekstissä ehdotettu lähestymistapa sopii tiimeille, jotka käyttävät SageMakeria mallien kouluttamiseen ja hienosäätämiseen verkkotunnuskohtaisten tietojen avulla ja päätepisteiden käyttöönottamiseksi päätelmien luomiseksi. Jos etsit täysin hallittua palvelua, joka tarjoaa valikoiman tehokkaita perusmalleja, joita tarvitaan luovien tekoälysovellusten rakentamiseen, harkitse Amazonin kallioperä. Jos etsit valmiiksi koulutettuja avoimen lähdekoodin malleja monenlaisiin yrityskäyttötapauksiin ja haluat käyttää ratkaisumalleja ja esimerkkimuistikirjoja, harkitse Amazon SageMaker JumpStart. Esikoulutettu versio Hugging Face BERT -peruskotelomallista, jota käytimme tässä viestissä, on saatavana myös SageMaker JumpStartista.

Tietoja Tekijät

Aparajithan Vaidyanathan on johtava yritysratkaisujen arkkitehti AWS:ssä. Hän on pilviarkkitehti, jolla on yli 24 vuoden kokemus yritys-, suur- ja hajautettujen ohjelmistojärjestelmien suunnittelusta ja kehittämisestä. Hän on erikoistunut generatiiviseen tekoälyyn ja koneoppimisen tietotekniikkaan. Hän on intohimoinen maratonjuoksija ja hänen harrastuksiaan ovat vaellus, pyöräily ja ajanvietto vaimonsa ja kahden pojan kanssa.

Aparajithan Vaidyanathan on johtava yritysratkaisujen arkkitehti AWS:ssä. Hän on pilviarkkitehti, jolla on yli 24 vuoden kokemus yritys-, suur- ja hajautettujen ohjelmistojärjestelmien suunnittelusta ja kehittämisestä. Hän on erikoistunut generatiiviseen tekoälyyn ja koneoppimisen tietotekniikkaan. Hän on intohimoinen maratonjuoksija ja hänen harrastuksiaan ovat vaellus, pyöräily ja ajanvietto vaimonsa ja kahden pojan kanssa.

Aaron Klein on AWS:n Sr Applied Scientist, joka työskentelee syvien hermoverkkojen automatisoitujen koneoppimismenetelmien parissa.

Aaron Klein on AWS:n Sr Applied Scientist, joka työskentelee syvien hermoverkkojen automatisoitujen koneoppimismenetelmien parissa.

Jacek Golebiowski on Sr Applied Scientist AWS:ssä.

Jacek Golebiowski on Sr Applied Scientist AWS:ssä.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- PlatoData.Network Vertical Generatiivinen Ai. Vahvista itseäsi. Pääsy tästä.

- PlatoAiStream. Web3 Intelligence. Tietoa laajennettu. Pääsy tästä.

- PlatoESG. hiili, CleanTech, energia, ympäristö, Aurinko, Jätehuolto. Pääsy tästä.

- PlatonHealth. Biotekniikan ja kliinisten kokeiden älykkyys. Pääsy tästä.

- Lähde: https://aws.amazon.com/blogs/machine-learning/reduce-inference-time-for-bert-models-using-neural-architecture-search-and-sagemaker-automated-model-tuning/

- :on

- :On

- :ei

- :missä

- ][s

- $ YLÖS

- 1

- 10

- 100

- 11

- 12

- 13

- 15%

- 17

- 19

- 20

- 26

- 30

- 31

- 320

- 7

- 70

- 72

- 8

- 9

- a

- kyky

- pystyy

- pääsy

- Tili

- tarkkuus

- Saavuttaa

- päästään

- aktivoinnit

- Lisäksi

- Hyväksyminen

- Jälkeen

- AI

- tavoitteena

- Tähtäimessä

- algoritmit

- Kaikki

- sallia

- Salliminen

- mahdollistaa

- Myös

- Amazon

- Amazon Web Services

- määrä

- an

- analyysi

- Analytics

- analysoida

- ja

- Toinen

- puhelinvastaaja

- Kaikki

- api

- sovellukset

- sovellettu

- käyttää

- Hakeminen

- lähestymistapa

- hyväksyminen

- suunnilleen

- arkkitehtuuri

- OVAT

- ALUE

- alueet

- perustelut

- noin

- keinotekoinen

- keinotekoiset hermoverkot

- AS

- kunnianhimoinen

- osoitettu

- liittyvä

- At

- yrittää

- käydä

- Automatisoitu

- automatisoitu koneoppiminen

- automaatti

- automaattisesti

- automatisointi

- Automaatio

- saatavissa

- AWS

- Akseli

- Balance

- pohja

- perustua

- BE

- tulevat

- ennen

- käyttäytyminen

- benchmarking

- Hyödyt

- PARAS

- Paremmin

- välillä

- Bitti

- elin

- sekä

- rakentaa

- liiketoiminta

- Liiketoimintaprosessi

- Liiketoimintaprosessien automatisointi

- mutta

- by

- CAN

- ehdokkaat

- kyvyt

- tapaus

- tapauksissa

- luettelo

- muuttaa

- Kaavio

- Kaaviot

- chatbots

- valinta

- Valita

- valittu

- luokka

- luokittelu

- Kliininen

- tarkasti

- pilvi

- koodi

- kerätä

- kokoelma

- yhdistelmät

- kaupallinen

- Yhteinen

- yleisesti

- verrattuna

- täydellinen

- Valmistunut

- monimutkainen

- monimutkaisuus

- osat

- laskennallinen

- Laskea

- käsitteet

- päätökseen

- Harkita

- muodostuu

- Console

- rajoitteet

- rakentaa

- kulutus

- sisältää

- pitoisuus

- sisällön luominen

- tausta

- jatkaa

- kontrasti

- valvonta

- vastaava

- Hinta

- kustannukset

- laskea

- luoda

- luo

- luominen

- asiakas

- Asiakaspalvelu

- tiedot

- tietojenkäsittely

- aineistot

- treffiaika

- päättää

- Päätöksenteko

- omistautunut

- syvä

- syvät hermoverkot

- määritellä

- määritelty

- määrittelemällä

- esittely

- osoittaa

- Riippuen

- sijoittaa

- käyttöön

- levityspinnalta

- lauennut

- on kuvattu

- Malli

- suunnittelu

- haluttu

- kehittämällä

- eri

- keskusteltiin

- jaettu

- asiakirja

- ei

- hallitseva

- hallita

- Dont

- kaksi

- aikana

- e

- kukin

- tehokkuus

- tehokas

- myöskään

- päätepiste

- päätepisteet

- Tekniikka

- Moottorit

- tarpeeksi

- enter

- yritys

- yrityksen käyttöönotto

- Enterprise-ratkaisut

- kokonaisuus

- merkintä

- ympäristö

- aikakausi

- virhe

- Eetteri (ETH)

- arvioida

- arvioitu

- arvioinnit

- Jopa

- Tapahtumat

- esimerkki

- Paitsi

- poikkeus

- yksinomaan

- olemassa

- experience

- Selittää

- selitti

- laajentaminen

- Kasvot

- väärä

- nopeampi

- Ominaisuudet

- palaute

- vähemmän

- ala

- filee

- Asiakirjat

- lopullinen

- Löytää

- löytäminen

- Etunimi

- kiinteä

- Joustavuus

- kelluva

- jälkeen

- Jalanjälki

- varten

- löytyi

- perusta

- alkaen

- etuosa

- Raja

- täysin

- toiminto

- edelleen

- tuottaa

- synnyttää

- generatiivinen

- Generatiivinen AI

- saada

- tietty

- tavoite

- GPU

- harmaa

- tapahtuu

- Olla

- he

- pää

- päät

- terveydenhuollon

- auttaa

- kätketty

- suorituskykyinen

- korkeampi

- retkeily

- hänen

- historia

- Harrastukset

- isäntä

- isännöi

- TUNTIA

- Miten

- Miten

- Kuitenkin

- HTML

- http

- HTTPS

- HalaaKasvot

- Hyperparametrien optimointi

- Hyperparametrien viritys

- i

- tunnistaa

- IDX

- if

- valaista

- Vaikutus

- Vaikutukset

- toteuttaa

- tuoda

- parantaa

- parani

- parannus

- parantaminen

- in

- sisältää

- Kasvaa

- kasvoi

- lisää

- tiedot

- Infrastruktuuri

- panos

- esimerkki

- tapauksia

- sen sijaan

- Älykäs

- tulee

- IT

- SEN

- Job

- Työpaikat

- jpg

- json

- tuntemus

- tunnettu

- Kieli

- suuri

- laaja

- suurin

- Viive

- kerros

- kerrokset

- Liidit

- OPPIA

- oppiminen

- vähiten

- antaa

- kirjastot

- Kirjasto

- linja

- kuormitus

- log

- hakkuu

- näköinen

- pois

- tappiot

- alentaa

- kone

- koneoppiminen

- ylläpitää

- ylläpitäminen

- mies

- onnistui

- Maraton

- naamio

- matplotlib

- maksimi

- Saattaa..

- merkitys

- mitata

- mitattu

- mittaus

- lääketieteellinen

- Tavata

- Muisti

- Metadata

- menetelmät

- metrinen

- Metrics

- ehkä

- minimoida

- pöytäkirja

- ML

- malli

- mallintaminen

- mallit

- modulaarinen

- lisää

- liikkua

- paljon

- moninkertainen

- täytyy

- nimi

- nimetty

- nimet

- klo

- Luonnollinen

- Luonnollinen kieli

- Luonnollinen kielen käsittely

- Navigoida

- suunnistus

- välttämätön

- Tarve

- tarvitaan

- tarpeet

- verkko

- verkot

- hermo-

- neuroverkkomallien

- hermoverkkoihin

- seuraava

- NLP

- Ei eristetty

- huomata

- muistikirja

- kannettavat tietokoneet

- nyt

- numero

- objekti

- tavoite

- tavoitteet

- tarkkailla

- Havaittu

- of

- pois

- kampanja

- Tarjoukset

- on

- ONE

- verkossa

- online-jälleenmyyjä

- vain

- avata

- avoimen lähdekoodin

- optimaalinen

- optimointi

- Optimoida

- optimoitu

- Optimismi

- optimoimalla

- or

- tilata

- alkuperäinen

- Muut

- meidän

- ulos

- ulostulo

- lähdöt

- yli

- yleinen

- yleiskatsaus

- oma

- paria

- lasi

- Parallel

- parametri

- parametrit

- Pareto

- osa

- Hyväksytty

- polku

- potilas

- kuviot

- suorittaa

- suorituskyky

- suoritettu

- esittävä

- suorittaa

- Oikeudet

- Platon

- Platonin tietotieto

- PlatonData

- Kohta

- pistettä

- kantoja

- Kirje

- Tarkkuus

- ennustus

- ennustavan

- Predictor

- mieltymykset

- valmis

- edellytyksiä

- esittää

- aiemmin

- Pääasiallinen

- Ongelma

- prosessi

- Prosessien automatisointi

- Prosessit

- käsittely

- Tuotteet

- tuottavuus

- Tuottavuustyökalut

- ehdotettu

- toimittaja

- tarjoaa

- tarjoamalla

- vetämällä

- Vetää

- tarkoitus

- tarkoituksiin

- Python

- pytorch

- Kysymyksiä ja vastauksia

- kysymys

- melko

- satunnainen

- alue

- nopea

- Hinnat

- raaka

- todellinen

- tunnustaminen

- tunnistaa

- tunnustaa

- Suositus

- suosituksia

- ennätys

- kirjataan

- punainen

- vähentää

- Vähentynyt

- vähentää

- regressio

- liittyvä

- Poistaa

- poistamalla

- Raportit

- edustus

- pyyntö

- pyysi

- pyynnöt

- tarvitaan

- vaatimukset

- kimmoisa

- resurssi

- Esittelymateriaalit

- vastaavasti

- vastaus

- tulokset

- jälleenmyyjä

- säilyttäen

- Tuotto

- ratsastus

- Riski

- RIVI

- ajaa

- juoksija

- juoksu

- toimii

- s

- uhrata

- sagemaker

- SageMaker-johtopäätös

- Säästä

- Asteikko

- asteikot

- tiede

- Tiedemies

- pisteet

- käsikirjoitus

- Haku

- Hakukoneet

- haku

- Toinen

- Osa

- nähdä

- valita

- valittu

- SELF

- lähettää

- tuomita

- näkemys

- Järjestys

- palvelu

- Palvelut

- Istunto

- setti

- Setit

- asetus

- Näytä

- signaalit

- merkittävästi

- Yksinkertainen

- samanaikainen

- samanaikaisesti

- single

- Koko

- pienempiä

- So

- Tuotteemme

- ratkaisu

- Ratkaisumme

- jonkin verran

- lähde

- Tila

- Kutea

- erikoistunut

- erikoistunut

- erityinen

- erityisesti

- menot

- jakaa

- Alkaa

- alkaa

- Osavaltio

- tilasto

- Vaihe

- Askeleet

- Levytila

- rakenteellinen

- jäsennelty

- studio

- merkittävä

- onnistunut

- Onnistuneesti

- niin

- sopiva

- sviitti

- YHTEENVETO

- järjestelmä

- järjestelmät

- T

- ottaa

- vie

- Kohde

- Tehtävä

- tehtävät

- tiimit

- tekniikka

- tekniikat

- malleja

- ehdot

- Testaus

- testit

- teksti

- Tekstiluokitus

- teksti-

- kuin

- että

- -

- heidän

- sitten

- Siellä.

- siksi

- Nämä

- tätä

- kolmella

- kynnys

- Kautta

- aika

- kertaa

- että

- yhdessä

- symbolinen

- otti

- työkalu

- työkalut

- kauppaa

- kaupankäynti

- Juna

- koulutettu

- koulutus

- muuntaja

- muuntajat

- totta

- yrittää

- kaksi

- tyyppi

- tyypit

- tyypillinen

- tyypillisesti

- Lopulta

- varten

- saava

- ymmärtäminen

- yksiköt

- us

- käyttää

- käyttölaukku

- käytetty

- käyttäjä

- Käyttäjät

- käyttötarkoituksiin

- käyttämällä

- validointi

- arvo

- arvot

- versio

- kautta

- Virtual

- havainnollistaa

- vs

- haluta

- oli

- we

- verkko

- verkkopalvelut

- HYVIN

- kun

- onko

- joka

- vaikka

- KUKA

- leveä

- Laaja valikoima

- laajalti

- vaimo

- wikipedia

- tulee

- halukas

- with

- sisällä

- Referenssit

- työnkulku

- työskentely

- X

- vuotta

- tuotto

- te

- Sinun

- zephyrnet