Wir alle möchten, dass sich unsere idealen menschlichen Werte in unseren Technologien widerspiegeln. Wir erwarten, dass Technologien wie künstliche Intelligenz (KI) uns nicht anlügen, nicht diskriminieren und für uns und unsere Kinder sicher sind. Dennoch sehen sich viele KI-Entwickler derzeit mit Gegenreaktionen wegen der Vorurteile, Ungenauigkeiten und problematischen Datenpraktiken konfrontiert, die in ihren Modellen aufgedeckt werden. Diese Probleme erfordern mehr als eine technische, algorithmische oder KI-basierte Lösung. In der Realität ist ein ganzheitlicher, soziotechnischer Ansatz erforderlich.

Die Mathematik zeigt eine starke Wahrheit

Alle Vorhersagemodelle, einschließlich KI, sind genauer, wenn sie vielfältige menschliche Intelligenz und Erfahrung einbeziehen. Dies ist keine Meinung; es hat empirische Gültigkeit. Bedenke die Diversity-Vorhersagesatz. Einfach ausgedrückt: Wenn die Vielfalt in einer Gruppe groß ist, ist der Fehler der Menge gering – was das Konzept der „Weisheit der Menge“ unterstützt. In einer einflussreichen Studie wurde gezeigt, dass verschiedene Gruppen von Problemlösern mit geringen Fähigkeiten Gruppen von Problemlösern mit hohen Fähigkeiten übertreffen können (Hong & Page, 2004).

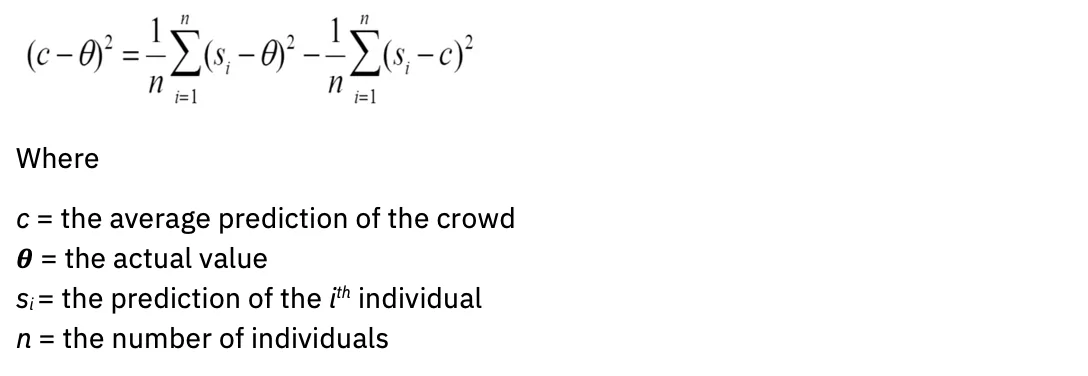

In mathematischer Sprache: Je größer Ihre Varianz, desto standardisierter ist Ihr Mittelwert. Die Gleichung sieht so aus:

A weiter studieren lieferte weitere Berechnungen, die die statistischen Definitionen einer weisen Menge verfeinern, einschließlich der Unkenntnis der Vorhersagen anderer Mitglieder und der Einbeziehung derjenigen mit maximal unterschiedlich (negativ korrelierte) Vorhersagen oder Urteile. Es ist also nicht nur die Menge, sondern auch die Vielfalt, die die Vorhersagen verbessert. Wie könnte sich diese Erkenntnis auf die Bewertung von KI-Modellen auswirken?

Modell(un)genauigkeit

Um einen gängigen Aphorismus zu zitieren: Alle Modelle sind falsch. Dies gilt in den Bereichen Statistik, Wissenschaft und KI. Modelle, die mit mangelnder Fachkenntnis erstellt wurden, können dazu führen falsch Ausgänge.

Heutzutage bestimmt eine kleine homogene Gruppe von Menschen, welche Daten zum Trainieren generativer KI-Modelle verwendet werden sollen, die aus Quellen stammen, in denen Englisch bei weitem überrepräsentiert ist. „Für die meisten der über 6,000 Sprachen der Welt reichen die verfügbaren Textdaten nicht aus, um ein groß angelegtes Grundlagenmodell zu trainieren“ (aus „Zu Chancen und Risiken von Stiftungsmodellen“, Bommasani et al., 2022).

Darüber hinaus werden die Modelle selbst aus begrenzten Architekturen erstellt: „Fast alle hochmodernen NLP-Modelle werden jetzt von einem der wenigen Basismodelle wie BERT, RoBERTa, BART, T5 usw. angepasst. Während diese Homogenisierung zu Ergebnissen führt.“ extrem hohe Hebelwirkung (jede Verbesserung der Grundmodelle kann zu unmittelbaren Vorteilen im gesamten NLP führen), es ist auch eine Belastung; Alle KI-Systeme könnten die gleichen problematischen Tendenzen einiger weniger Basismodelle erben (Bommasani et al.) "

Damit generative KI die vielfältigen Gemeinschaften, denen sie dient, besser widerspiegeln kann, muss eine weitaus größere Vielfalt menschlicher Daten in Modellen dargestellt werden.

Die Bewertung der Modellgenauigkeit geht Hand in Hand mit der Bewertung der Verzerrung. Wir müssen uns fragen: Was ist der Zweck des Modells und für wen ist es optimiert? Überlegen Sie beispielsweise, wer am meisten von Inhaltsempfehlungsalgorithmen und Suchmaschinenalgorithmen profitiert. Stakeholder können sehr unterschiedliche Interessen und Ziele haben. Algorithmen und Modelle erfordern Ziele oder Proxys für den Bayes-Fehler: den minimalen Fehler, den ein Modell verbessern muss. Bei diesem Stellvertreter handelt es sich häufig um eine Person, beispielsweise einen Fachexperten mit Fachkenntnissen.

Eine sehr menschliche Herausforderung: Risikoabschätzung vor der Modellbeschaffung oder -entwicklung

Neue KI-Vorschriften und Aktionspläne unterstreichen zunehmend die Bedeutung algorithmischer Folgenabschätzungsformulare. Das Ziel dieser Formulare besteht darin, wichtige Informationen über KI-Modelle zu erfassen, damit Governance-Teams ihre Risiken bewerten und angehen können, bevor sie sie einsetzen. Typische Fragen sind:

- Was ist der Anwendungsfall Ihres Modells?

- Welche Risiken bestehen bei unterschiedlichen Auswirkungen?

- Wie beurteilen Sie die Fairness?

- Wie machen Sie Ihr Modell erklärbar?

Obwohl sie mit guten Absichten entwickelt wurden, besteht das Problem darin, dass die meisten Besitzer von KI-Modellen nicht wissen, wie sie die Risiken für ihren Anwendungsfall bewerten sollen. Ein häufiger Refrain könnte lauten: „Wie könnte mein Modell unfair sein, wenn es keine personenbezogenen Daten (PII) erfasst?“ Folglich werden die Formulare selten mit der nötigen Sorgfalt ausgefüllt, damit Governance-Systeme Risikofaktoren genau kennzeichnen können.

Dadurch wird der soziotechnische Charakter der Lösung unterstrichen. Einem Modelleigentümer – einer Einzelperson – kann nicht einfach eine Liste mit Kontrollkästchen vorgelegt werden, um zu bewerten, ob ihr Anwendungsfall Schaden anrichten wird. Stattdessen ist es erforderlich, dass Gruppen von Menschen mit sehr unterschiedlichen Lebenserfahrungen in Gemeinschaften zusammenkommen, die psychologische Sicherheit bieten, um schwierige Gespräche über unterschiedliche Auswirkungen zu führen.

Wir begrüßen breitere Perspektiven für vertrauenswürdige KI

IBM® glaubt an einen „Client Zero“-Ansatz und setzt die Empfehlungen und Systeme um, die es für seine eigenen Kunden in Beratungs- und produktorientierten Lösungen geben würde. Dieser Ansatz erstreckt sich auch auf ethische Praktiken, weshalb IBM ein Trustworthy AI Center of Excellence (COE) geschaffen hat.

Wie oben erläutert, ist die Vielfalt der Erfahrungen und Fähigkeiten von entscheidender Bedeutung, um die Auswirkungen von KI richtig bewerten zu können. Aber die Aussicht auf die Teilnahme an einem Kompetenzzentrum könnte in einem Unternehmen voller KI-Innovatoren, Experten und angesehener Ingenieure einschüchternd sein, daher ist die Pflege einer Gemeinschaft psychologischer Sicherheit erforderlich. IBM kommuniziert dies deutlich mit den Worten: „Interessiert an KI? Interessiert an KI-Ethik? An diesem Tisch haben Sie Platz.“

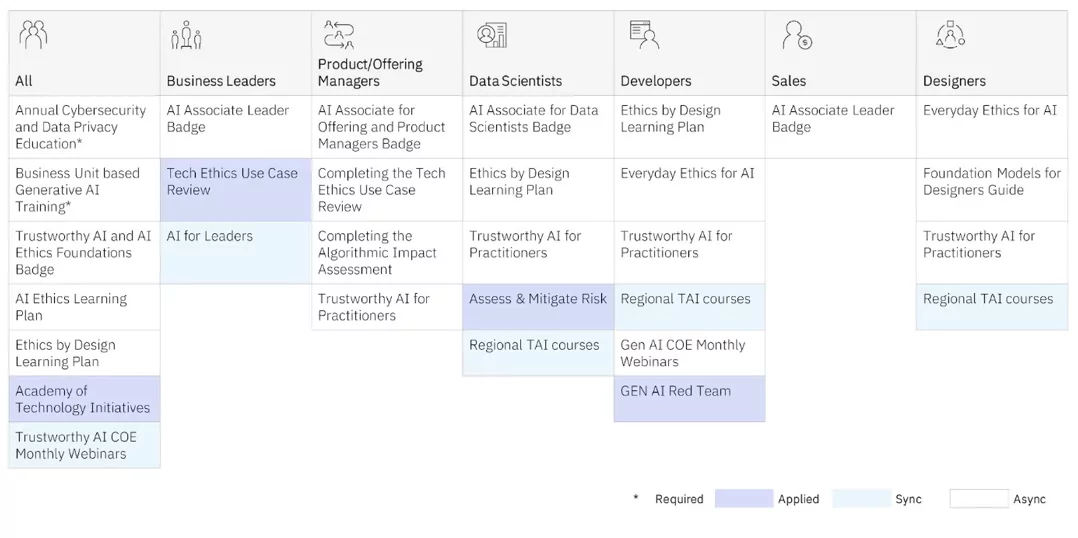

Das COE bietet Schulungen in KI-Ethik für Praktiker aller Ebenen an. Es werden sowohl synchrones Lernen (Lehrer und Schüler im Unterricht) als auch asynchrone (selbstgesteuerte) Programme angeboten.

Aber es sind die COE's angewandt Schulungen, die unseren Praktikern die tiefsten Einblicke vermitteln, während sie mit globalen, vielfältigen, multidisziplinären Teams an realen Projekten arbeiten, um unterschiedliche Auswirkungen besser zu verstehen. Sie nutzen auch Design-Thinking-Frameworks von IBM Design für KI Die Gruppe verwendet diese Methode intern und mit Kunden, um die unbeabsichtigten Auswirkungen von KI-Modellen zu bewerten und dabei diejenigen im Auge zu behalten, die oft an den Rand gedrängt werden. (Siehe Sylvia Duckworths Rad der Macht und Privilegien (Beispiele dafür, wie persönliche Merkmale zusammenwirken, um Menschen zu privilegieren oder zu marginalisieren.) IBM spendete auch viele der Frameworks an die Open-Source-Community Ethisch gestalten.

Nachfolgend finden Sie einige Berichte, die IBM zu diesen Projekten öffentlich veröffentlicht hat:

Um wichtige Erkenntnisse über die Leistung Ihres KI-Modells zu gewinnen, sind automatisierte KI-Modell-Governance-Tools erforderlich. Beachten Sie jedoch, dass es optimal ist, das Risiko rechtzeitig zu erfassen, bevor Ihr Modell entwickelt wurde und in Produktion geht. Indem Sie Gemeinschaften verschiedener, multidisziplinärer Praktiker schaffen, die einen sicheren Raum für schwierige Gespräche über unterschiedliche Auswirkungen bieten, können Sie Ihre Reise zur Operationalisierung Ihrer Prinzipien und zur verantwortungsvollen Entwicklung von KI beginnen.

In der Praxis sollten Sie bei der Einstellung von KI-Experten bedenken, dass weit über 70 % des Aufwands bei der Erstellung von Modellen in der Kuratierung der richtigen Daten besteht. Sie möchten Leute einstellen, die wissen, wie man repräsentative Daten sammelt, die aber auch mit Einwilligung erhoben werden. Sie möchten außerdem, dass Menschen, die sich auskennen, eng mit Fachexperten zusammenarbeiten, um sicherzustellen, dass sie den richtigen Ansatz verfolgen. Es ist von entscheidender Bedeutung, sicherzustellen, dass diese Praktiker über die emotionale Intelligenz verfügen, um die Herausforderung einer verantwortungsvollen Kuratierung von KI mit Bescheidenheit und Urteilsvermögen anzugehen. Wir müssen bewusst lernen, wie und wann KI-Systeme die Ungleichheit ebenso verschärfen können, wie sie die menschliche Intelligenz steigern können.

Erfinden Sie die Art und Weise, wie Ihr Unternehmen mit KI funktioniert, neu

War dieser Artikel hilfreich?

JaNein

Mehr von Künstliche Intelligenz

IBM Newsletter

Erhalten Sie unsere Newsletter und Themenaktualisierungen, die die neuesten Gedanken und Einblicke in neue Trends liefern.

Abonniere jetzt

Weitere Newsletter

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://www.ibm.com/blog/why-we-need-diverse-multidisciplinary-coes-for-model-risk/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 000

- 1

- 16

- 2022

- 2024

- 23

- 25

- 28

- 29

- 30

- 300

- 32

- 39

- 40

- 400

- 65

- 7

- 9

- a

- Fähigkeit

- LiveBuzz

- oben

- AC

- beschleunigen

- Genauigkeit

- genau

- genau

- über

- Action

- angepasst

- Adresse

- eingestehen

- adoptieren

- Marketings

- Beratung

- beeinflussen

- Agenten

- AI

- KI-Modelle

- KI-Systeme

- Ziel

- AL

- algorithmisch

- Algorithmen

- Alle

- ebenfalls

- immer

- amp

- an

- Analytik

- und

- jedem

- Anwendung

- Anwendungen

- Ansatz

- SIND

- Bereiche

- Artikel

- künstlich

- künstliche Intelligenz

- Künstliche Intelligenz (AI)

- AS

- fragen

- beurteilen

- Beurteilung

- Bewertung

- Assistenten

- Unterstützung

- At

- Audio-

- vermehren

- Autor

- verfügbar

- vermeiden

- Zurück

- Balancing

- BE

- war

- Bevor

- beginnen

- Sein

- glaubt,

- Vorteile

- Besser

- Beyond

- vorspannen

- Vorurteile

- Blog

- Blogs

- Blau

- Boston

- beide

- breiteres

- Building

- Geschäft

- Geschäftsfunktionen

- Unternehmen

- aber

- Taste im nun erscheinenden Bestätigungsfenster nun wieder los.

- by

- CAN

- Erfassung

- Capturing

- Kohlenstoff

- Karte

- Karten

- österreichische Unternehmen

- Häuser

- CAT

- Kategorie

- Verursachen

- Center

- Kompetenzzentrum

- Hauptgeschäftsstelle

- sicher

- challenges

- Charakteristik

- Chatbots

- aus der Ferne überprüfen

- der

- weltweit

- Kreise

- CIS

- Klasse

- Kunden

- eng

- Cloud

- Farbe

- Kombination

- Kommen

- gemeinsam

- Communities

- community

- Unternehmen

- Unternehmen

- Abgeschlossene Verkäufe

- konzept

- Zustimmung

- Folglich

- Geht davon

- Consulting

- Container

- fortsetzen

- Gespräche

- Kernbereich

- und beseitigen Muskelschwäche

- korreliert

- Kosten

- könnte

- erstellt

- Erstellen

- Schöpfer

- kritischem

- Menschenmenge

- CSS

- kuratieren

- Zur Zeit

- Original

- Kunde

- Customer Experience

- Kunden

- technische Daten

- Datum

- Entscheidungen

- tiefsten

- Standard

- Definitionen

- Übergeben

- zeigt

- Bereitstellen

- Beschreibung

- Design

- Design Thinking

- entworfen

- Bestimmen

- entwickeln

- entwickelt

- anders

- schwer

- digital

- Digitale Transformation

- disparat

- Distinguished

- verschieden

- Diversität

- do

- Domain

- gespendet

- gezogen

- Antrieb

- E & T

- Effekten

- Anstrengung

- eliminieren

- Einbettung

- umarmen

- aufstrebenden

- Mitarbeiter

- ermöglichen

- Eingriff

- Motor

- Ingenieure

- Englisch

- genug

- Gewährleistung

- Enter

- Fehler

- etc

- Äther (ETH)

- ethisch

- Ethik

- bewerten

- Auswerten

- Auswertung

- Sogar

- Jedes

- überall

- verschärfen

- Beispiel

- Beispiele

- Exzellenz

- Beenden

- erwarten

- ERFAHRUNGEN

- Erfahrungen

- Experte

- Expertise

- Experten

- erklärt

- ausgesetzt

- erweitert

- äußerst

- Facebook Messenger

- erleichtern

- zugewandt

- Faktoren

- Fairness

- falsch

- weit

- FAST

- wenige

- Finden Sie

- Setzen Sie mit Achtsamkeit

- folgen

- Folgende

- Schriftarten

- Aussichten für

- Vordergrund

- Formen

- Foundation

- Gerüste

- für

- Materials des

- Funktionen

- sammeln

- gesammelt

- Sammlung

- generativ

- Generative KI

- Generator

- bekommen

- gegeben

- gibt

- Global

- Kundenziele

- Ziele

- Goes

- gut

- Governance

- Grammatik

- sehr

- Gitter

- Gruppe an

- Gruppen

- Wachstum

- Guide

- schaden

- Haben

- Überschrift

- hören

- Höhe

- Hilfe

- hilfreich

- GUTE

- ihm

- Verleih

- Verleih

- seine

- hält

- ganzheitliche

- Startseite

- Ultraschall

- Hilfe

- HTTPS

- human

- menschliche Intelligenz

- Demut

- Hybrid

- Hybride wolke

- i

- KRANK

- IBM

- ICO

- ICON

- ideal

- identifiziert

- if

- Unwissenheit

- Image

- unmittelbar

- Impact der HXNUMXO Observatorien

- Einfluss hat

- implementieren

- Umsetzung

- Bedeutung

- wichtig

- zu unterstützen,

- Verbesserungen

- verbessert

- in

- das

- Einschließlich

- Aufnahme

- integrieren

- zunehmend

- inkremental

- Index

- Energiegewinnung

- Einflussreich

- Information

- Innovation

- Innovatoren

- Varianten des Eingangssignals:

- Einblick

- Einblicke

- sofort

- beantragen müssen

- Institut

- Versicherung

- VERSICHERUNGEN

- Intelligenz

- Intelligent

- Absicht

- Vorsätzlich

- Absichten

- interessiert

- Interessen

- innen

- schneiden

- Intervention

- einschüchternd

- innere

- isn

- Problem

- Probleme

- IT

- SEINE

- Januar

- join

- Karriere

- Reise

- jpg

- nur

- Aufbewahrung

- Wesentliche

- Wissen

- bekannt

- Mangel

- Sprache

- Sprachen

- grosse

- großflächig

- neueste

- führen

- Führer

- Leadership

- lernen

- lassen

- Niveau

- Hebelwirkung

- Haftung

- Lüge

- Gefällt mir

- Limitiert

- Liste

- aus einer regionalen

- lokal

- SIEHT AUS

- um

- Making

- Management

- manuell

- viele

- Mathe

- mathematisch

- Materie

- max-width

- Kann..

- me

- bedeuten

- Triff

- Messenger

- könnte

- Min.

- Geist / Bewusstsein

- Minimum

- Minuten

- Mobil

- Modell

- für

- Modernisierung

- mehr

- vor allem warme

- schlauer bewegen

- viel

- multidisziplinär

- sollen

- my

- Natur

- Menü

- notwendig,

- Need

- erforderlich

- Bedürfnisse

- negativ

- Neu

- neue Produkte

- Newsletter

- Nlp

- nicht

- beachten

- nichts

- jetzt an

- und viele

- of

- WOW!

- bieten

- angeboten

- Angebote

- vorgenommen,

- on

- EINEM

- Open-Source-

- Meinung

- Entwicklungsmöglichkeiten

- optimal

- optimiert

- or

- Organisationen

- Andere

- UNSERE

- Übertreffen

- Ausgänge

- übrig

- besitzen

- Besitzer

- Seite

- teilnehmend

- passieren

- Personen

- Durchführung

- person

- persönliche

- Persönlich

- Perspektiven

- PHP

- pii

- Pläne

- Plato

- Datenintelligenz von Plato

- PlatoData

- Plugin

- Datenschutzrichtlinien

- Position

- Post

- Potenzial

- potentielle Kunden

- Werkzeuge

- größte treibende

- Praxis

- Praktiken

- Prognose

- Prognosen

- prädiktive

- primär

- Grundsätze

- Priorität einräumen

- Privileg

- Aufgabenstellung:

- Beschaffung

- produziert

- Produktion

- PRODUKTIVITÄT

- Produkte

- Programme

- Projekte

- richtig

- Aussicht

- vorausgesetzt

- Bereitstellung

- Proxies

- Stellvertreter

- psychologisch

- öffentlich

- veröffentlicht

- setzen

- Fragen

- schnell

- Angebot!

- selten

- Bereitschaft

- Lesebrillen

- echt

- Realität

- erkennen

- Empfehlungen

- Reduzierung

- verfeinern

- reflektieren

- reflektiert

- Vorschriften

- Meldungen

- Vertreter

- vertreten

- Zugriffe

- erfordern

- falls angefordert

- Forschungsprojekte

- reagiert

- für ihren Verlust verantwortlich.

- verantwortungsbewusst

- ansprechbar

- Einnahmen

- Umsatzwachstum

- Recht

- Risiko

- Risikofaktoren

- Risiken

- Straße

- Roboter

- Safe

- Sicherheit

- Said

- gleich

- sagen

- Skalieren

- Skalierung

- Wissenschaft

- Bildschirm

- Skripte

- Suche

- Suchmaschine

- Verbindung

- sehen

- seo

- dient

- Einstellungen

- sollte

- gezeigt

- einfach

- am Standort

- locker

- klein

- smart

- Intelligente Lautsprecher

- SMS

- So

- Lösung

- Lösungen

- einige

- Quellen

- Raumfahrt

- Lautsprecher

- Sponsored

- Quadrate

- Stakeholder

- Standard

- Anfang

- State-of-the-art

- statistisch

- Statistiken

- Die Kursteilnehmer

- Studie

- Fach

- Abonnieren

- so

- Support

- Unterstützung

- SVG

- Systeme und Techniken

- T

- Tabelle

- Einnahme

- Ziele

- Lehrer

- Teams

- Technische

- Technologies

- Tertiär-

- Text

- als

- dank

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- die Welt

- ihr

- Sie

- Thema

- sich

- Diese

- vom Nutzer definierten

- think

- Denken

- fehlen uns die Worte.

- diejenigen

- dachte

- Gedankenführung

- nach drei

- Durch

- Zeit

- Titel

- zu

- gemeinsam

- Werkzeuge

- Top

- Thema

- zäh

- Training

- Ausbildung

- Transformation

- Trends

- was immer dies auch sein sollte.

- vertrauenswürdig

- XNUMX

- tippe

- typisch

- verstehen

- unfair

- einzigartiges

- Entriegelung

- Updates

- auf

- URL

- us

- -

- Anwendungsfall

- verwendet

- Verwendung

- Wert

- Werte

- Vielfalt

- Variieren

- sehr

- Assistent

- Volumen

- W

- wollen

- wurde

- we

- GUT

- Was

- Was ist

- wann

- ob

- welche

- während

- WHO

- wem

- warum

- weit

- breiter

- werden wir

- Weisheit

- WISE

- mit

- Word

- WordPress

- Arbeiten

- Werk

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- würde

- geschrieben

- Falsch

- noch

- U

- Ihr

- Zephyrnet