Wir glauben, dass generative KI im Laufe der Zeit das Potenzial hat, praktisch jedes Kundenerlebnis, das wir kennen, zu verändern. Die Zahl der Unternehmen, die generative KI-Anwendungen auf AWS einführen, ist beträchtlich und wächst schnell, darunter adidas, Booking.com, Bridgewater Associates, Clariant, Cox Automotive, GoDaddy und LexisNexis Legal & Professional, um nur einige zu nennen. Innovative Startups wie Perplexity AI setzen voll auf AWS für generative KI. Führende KI-Unternehmen wie Anthropic haben AWS als ihren primären Cloud-Anbieter für geschäftskritische Workloads und als Ort zum Trainieren ihrer zukünftigen Modelle ausgewählt. Und globale Dienstleistungs- und Lösungsanbieter wie Accenture profitieren von den Vorteilen maßgeschneiderter generativer KI-Anwendungen, indem sie ihre internen Entwickler damit ausstatten Amazon Code Whisperer.

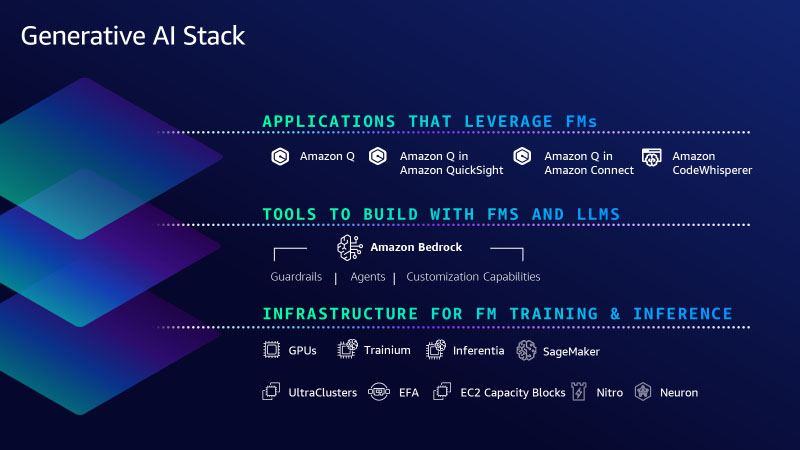

Diese Kunden entscheiden sich für AWS, weil wir uns darauf konzentrieren, das zu tun, was wir schon immer getan haben: komplexe und teure Technologie, die Kundenerlebnisse und Unternehmen verändern kann, zu demokratisieren und sie für Kunden aller Größen und technischen Fähigkeiten zu demokratisieren. Zu diesem Zweck investieren wir und entwickeln schnell Innovationen, um die umfassendsten Funktionen auf allen drei Ebenen des generativen KI-Stacks bereitzustellen. Die unterste Ebene ist die Infrastruktur zum Trainieren von Large Language Models (LLMs) und anderen Foundation Models (FMs) und zum Erstellen von Schlussfolgerungen oder Vorhersagen. Die mittlere Ebene bietet einfachen Zugriff auf alle Modelle und Tools, die Kunden benötigen, um generative KI-Anwendungen mit der gleichen Sicherheit, Zugriffskontrolle und anderen Funktionen zu erstellen und zu skalieren, die Kunden von einem AWS-Service erwarten. Und auf der obersten Ebene haben wir in bahnbrechende Anwendungen in Schlüsselbereichen wie der generativen KI-basierten Codierung investiert. Kunden bieten ihnen nicht nur Auswahl und – wie sie es von uns erwarten – eine breite und tiefe Leistungsfähigkeit auf allen Ebenen, sondern schätzen auch unseren datenorientierten Ansatz und vertrauen darauf, dass wir alles von Grund auf mit unternehmensorientierten Lösungen aufgebaut haben. erstklassige Sicherheit und Privatsphäre.

Diese Woche haben wir einen großen Schritt nach vorne gemacht und viele bedeutende neue Funktionen auf allen drei Ebenen des Stacks angekündigt, um es unseren Kunden einfach und praktisch zu machen, generative KI umfassend in ihren Unternehmen einzusetzen.

Unterste Ebene des Stapels: AWS Trainium2 ist die neueste Ergänzung zur Bereitstellung der fortschrittlichsten Cloud-Infrastruktur für generative KI

Die unterste Ebene des Stapels ist die Infrastruktur – Rechenleistung, Netzwerk, Frameworks, Dienste –, die zum Trainieren und Betreiben von LLMs und anderen FMs erforderlich ist. AWS führt Innovationen ein, um die fortschrittlichste Infrastruktur für ML anzubieten. Durch unsere langjährige Zusammenarbeit mit NVIDIA war AWS vor mehr als 12 Jahren der erste Anbieter, der GPUs in die Cloud brachte, und zuletzt waren wir der erste große Cloud-Anbieter, der NVIDIA H100-GPUs mit unseren P5-Instanzen verfügbar machte. Wir investieren weiterhin in einzigartige Innovationen, die AWS zur besten Cloud für den Betrieb von GPUs machen, einschließlich der Preis-Leistungs-Vorteile des fortschrittlichsten Virtualisierungssystems (AWS Nitro), leistungsstarker Netzwerke im Petabit-Bereich mit Elastic Fabric Adapter (EFA) und Hyper- Skalieren Sie Clustering mit Amazon EC2 UltraClusters (Tausende beschleunigte Instanzen, die in einer Availability Zone untergebracht und in einem nicht blockierenden Netzwerk miteinander verbunden sind, das bis zu 3,200 Gbit/s für groß angelegtes ML-Training liefern kann). Mit Amazon EC2 Capacity Blocks für ML erleichtern wir außerdem jedem Kunden den Zugriff auf die begehrte GPU-Rechenkapazität für generative KI – das erste und einzige Verbrauchsmodell in der Branche, das es Kunden ermöglicht, GPUs für die zukünftige Nutzung zu reservieren (bis zu 500). bereitgestellt in EC2 UltraClustern) für kurzzeitige ML-Workloads.

Vor einigen Jahren wurde uns klar, dass wir Innovationen bis hin zum Silizium benötigen, um die Grenzen des Preis-Leistungs-Verhältnisses weiter zu verbessern, und begannen, in unsere eigenen Chips zu investieren. Speziell für ML haben wir mit AWS Inferentia begonnen, unserem speziell entwickelten Inferenzchip. Heute befinden wir uns in der zweiten Generation von AWS Inferentia mit Amazon EC2 Inf2-Instanzen, die speziell für groß angelegte generative KI-Anwendungen mit Modellen optimiert sind, die Hunderte Milliarden Parameter enthalten. Inf2-Instanzen bieten die niedrigsten Kosten für Inferenz in der Cloud und bieten gleichzeitig einen bis zu viermal höheren Durchsatz und eine bis zu zehnmal geringere Latenz im Vergleich zu Inf1-Instanzen. Angetrieben von bis zu 12 Inferentia2-Chips sind Inf2 die einzigen inferenzoptimierten EC2-Instanzen, die über eine Hochgeschwindigkeitskonnektivität zwischen Beschleunigern verfügen, sodass Kunden Inferenzen schneller und effizienter (zu geringeren Kosten) ausführen können, ohne durch die Verteilung extrem großer Modelle Einbußen bei der Leistung oder Latenz hinnehmen zu müssen über mehrere Beschleuniger hinweg. Kunden wie Adobe, Deutsche Telekom und Leonardo.ai haben großartige erste Ergebnisse erzielt und freuen sich darauf, ihre Modelle im großen Maßstab auf Inf2 bereitzustellen.

Auf der Trainingsseite sind Trn1-Instanzen, die auf dem speziell entwickelten ML-Trainingschip von AWS, AWS Trainium, basieren, für die Verteilung des Trainings auf mehrere Server optimiert, die mit einem EFA-Netzwerk verbunden sind. Kunden wie Ricoh haben in nur wenigen Tagen ein japanisches LLM mit Milliarden von Parametern trainiert. Databricks erzielt mit Trainium-basierten Instanzen ein bis zu 40 % besseres Preis-Leistungs-Verhältnis zum Trainieren umfangreicher Deep-Learning-Modelle. Aber da praktisch jede Woche neue, leistungsfähigere Modelle auf den Markt kommen, verschieben wir weiterhin die Grenzen in Bezug auf Leistung und Skalierbarkeit, und wir freuen uns, dies bekannt zu geben AWS Trainium2, entwickelt, um ein noch besseres Preis-Leistungs-Verhältnis für Trainingsmodelle mit Hunderten von Milliarden bis Billionen Parametern zu bieten. Trainium2 sollte eine bis zu viermal schnellere Trainingsleistung als Trainium der ersten Generation liefern und bei Verwendung in EC2-UltraClustern bis zu 65 Exaflops an Gesamtrechenleistung liefern. Dies bedeutet, dass Kunden in der Lage sein werden, ein LLM mit 300 Milliarden Parametern in Wochen statt in Monaten zu trainieren. Die Leistung, Skalierbarkeit und Energieeffizienz von Trainium2 sind einige der Gründe, warum Anthropic sich dafür entschieden hat, seine Modelle auf AWS zu trainieren, und Trainium2 für seine zukünftigen Modelle verwenden wird. Und wir arbeiten mit Anthropic an weiteren Innovationen mit Trainium und Inferentia zusammen. Wir gehen davon aus, dass unsere ersten Trainium2-Instanzen im Jahr 2024 für Kunden verfügbar sein werden.

Wir haben auch die Software-Toolkette für unser ML-Silizium verdoppelt, insbesondere durch die Weiterentwicklung von AWS Neuron, dem Software Development Kit (SDK), das Kunden dabei hilft, die maximale Leistung von Trainium und Inferentia zu erzielen. Seit der Einführung von Neuron im Jahr 2019 haben wir erheblich in Compiler- und Framework-Technologien investiert, und heute unterstützt Neuron viele der beliebtesten öffentlich verfügbaren Modelle, darunter Llama 2 von Meta, MPT von Databricks und Stable Diffusion von Stability AI 93 der 100 besten Modelle im beliebten Model-Repository Hugging Face. Neuron lässt sich in beliebte ML-Frameworks wie PyTorch und TensorFlow integrieren und die Unterstützung für JAX kommt Anfang nächsten Jahres. Kunden erzählen uns, dass Neuron es ihnen leicht gemacht hat, ihre bestehenden Modelltrainings- und Inferenzpipelines mit nur wenigen Codezeilen auf Trainium und Inferentia umzustellen.

Niemand sonst bietet diese Kombination aus den besten ML-Chips, superschnellem Netzwerk, Virtualisierung und Hyperscale-Clustern. Daher ist es nicht verwunderlich, dass einige der bekanntesten generativen KI-Startups wie AI21 Labs, Anthropic, Hugging Face, Perplexity AI, Runway und Stability AI auf AWS laufen. Sie benötigen jedoch immer noch die richtigen Tools, um diese Rechenleistung effektiv zu nutzen und LLMs und andere FMs effizient und kostengünstig zu erstellen, zu trainieren und zu betreiben. Und für viele dieser Startups Amazon Sage Maker ist die Antwort. Unabhängig davon, ob Sie ein neues, proprietäres Modell von Grund auf erstellen und trainieren oder mit einem der vielen beliebten öffentlich verfügbaren Modelle beginnen, ist die Schulung ein komplexes und kostspieliges Unterfangen. Es ist auch nicht einfach, diese Modelle wirtschaftlich zu betreiben. Kunden müssen große Datenmengen beschaffen und aufbereiten. Dies erfordert in der Regel viel manuelle Arbeit zum Bereinigen von Daten, zum Entfernen von Duplikaten sowie zum Anreichern und Transformieren der Daten. Dann müssen sie große Cluster von GPUs/Beschleunigern erstellen und warten, Code schreiben, um das Modelltraining effizient auf Cluster zu verteilen, das Modell häufig überprüfen, anhalten, prüfen und optimieren sowie manuell eingreifen und Hardwareprobleme im Cluster beheben. Viele dieser Herausforderungen sind nicht neu, sie sind einige der Gründe, warum wir SageMaker vor sechs Jahren auf den Markt gebracht haben – um die vielen Hindernisse bei der Modellschulung und -bereitstellung abzubauen und Entwicklern einen viel einfacheren Weg zu bieten. Zehntausende Kunden nutzen Amazon SageMaker, und immer mehr von ihnen wie LG AI Research, Perplexity AI, AI21, Hugging Face und Stability AI schulen LLMs und andere FMs auf SageMaker. Erst kürzlich hat das Technology Innovation Institute (Entwickler der beliebten Falcon LLMs) das größte öffentlich verfügbare Modell – Falcon 180B – auf SageMaker trainiert. Mit zunehmender Modellgröße und -komplexität ist auch der Umfang von SageMaker gewachsen.

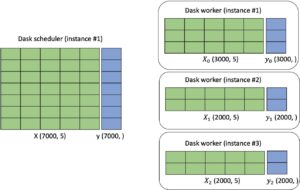

Im Laufe der Jahre haben wir Amazon SageMaker um mehr als 380 bahnbrechende Funktionen und Fähigkeiten erweitert, darunter automatische Modelloptimierung, verteiltes Training, flexible Modellbereitstellungsoptionen, Tools für ML-OPs, Tools zur Datenvorbereitung, Feature Stores, Notebooks und nahtlose Integration mit Human-in-the-Loop-Bewertungen über den gesamten ML-Lebenszyklus und integrierten Funktionen für verantwortungsvolle KI. Wir entwickeln weiterhin schnell Innovationen, um sicherzustellen, dass SageMaker-Kunden weiterhin Inferenzen für alle Modelle erstellen, trainieren und ausführen können – einschließlich LLMs und anderer FMs. Und wir machen es für Kunden noch einfacher und kostengünstiger, große Modelle mit zwei neuen Funktionen zu trainieren und bereitzustellen. Erstens, um das Training zu vereinfachen Einführung Amazon SageMaker HyperPod Dadurch werden mehr Prozesse automatisiert, die für ein hoch angelegtes fehlertolerantes verteiltes Training erforderlich sind (z. B. Konfiguration verteilter Schulungsbibliotheken, Skalierung der Schulungsarbeitslasten über Tausende von Beschleunigern, Erkennung und Reparatur fehlerhafter Instanzen), wodurch die Schulung um bis zu 40 % beschleunigt wird. Aus diesem Grund verwenden Kunden wie Perplexity AI, Hugging Face, Stability, Hippocratic, Alkaid und andere SageMaker HyperPod, um Modelle zu erstellen, zu trainieren oder weiterzuentwickeln. Zweite, Wir führen neue Funktionen ein, um Inferenz kostengünstiger zu machen und gleichzeitig die Latenz zu reduzieren. SageMaker hilft Kunden jetzt dabei, mehrere Modelle auf derselben Instanz bereitzustellen, sodass sie Rechenressourcen gemeinsam nutzen können – wodurch die Inferenzkosten (im Durchschnitt) um 50 % gesenkt werden. SageMaker überwacht außerdem aktiv Instanzen, die Inferenzanfragen verarbeiten, und leitet Anfragen intelligent weiter, je nachdem, welche Instanzen verfügbar sind – wodurch eine durchschnittlich 20 % geringere Inferenzlatenz erreicht wird. Aufgrund dieser Inferenzoptimierungen nutzen Conjecture, Salesforce und Slack SageMaker bereits für Hosting-Modelle.

Mittlere Schicht des Stacks: Amazon Bedrock fügt neue Modelle hinzu und eine Reihe neuer Funktionen machen es für Kunden noch einfacher, generative KI-Anwendungen sicher zu erstellen und zu skalieren

Während eine Reihe von Kunden ihre eigenen LLMs und andere FMs erstellen oder eine beliebige Anzahl der öffentlich verfügbaren Optionen weiterentwickeln, werden viele nicht die Ressourcen und die Zeit dafür aufwenden wollen. Für sie bietet die mittlere Schicht des Stacks diese Modelle als Service an. Unsere Lösung hier, Amazonas Grundgesteinermöglicht es Kunden, aus branchenführenden Modellen von Anthropic, Stability AI, Meta, Cohere, AI21 und Amazon zu wählen, sie mit ihren eigenen Daten anzupassen und alle führenden Sicherheits-, Zugriffskontroll- und Funktionsfunktionen zu nutzen, die sie gewohnt sind in AWS – alles über einen verwalteten Service. Wir haben Amazon Bedrock Ende September allgemein verfügbar gemacht und die Kundenresonanz war überwältigend positiv. Kunden aus der ganzen Welt und aus praktisch allen Branchen sind begeistert, Amazon Bedrock zu nutzen. adidas ermöglicht es Entwicklern, schnelle Antworten auf alles zu erhalten, von Informationen zu den ersten Schritten bis hin zu tiefergehenden technischen Fragen. Booking.com beabsichtigt, generative KI zu nutzen, um für jeden Kunden maßgeschneiderte Reiseempfehlungen zu verfassen. Bridgewater Associates entwickelt einen LLM-gestützten Investment-Analysten-Assistenten, der dabei hilft, Diagramme zu erstellen, Finanzindikatoren zu berechnen und Ergebnisse zusammenzufassen. Carrier macht Kunden präzisere Energieanalysen und Erkenntnisse zugänglich, damit sie den Energieverbrauch und den COXNUMX-Ausstoß senken können. Clariant unterstützt seine Teammitglieder mit einem internen generativen KI-Chatbot, um Forschungs- und Entwicklungsprozesse zu beschleunigen, Vertriebsteams bei der Vorbereitung von Besprechungen zu unterstützen und Kunden-E-Mails zu automatisieren. GoDaddy hilft Kunden dabei, ihre Geschäfte einfach online einzurichten, indem es generative KI nutzt, um ihre Websites zu erstellen, Lieferanten zu finden, mit Kunden in Kontakt zu treten und vieles mehr. Lexis Nexis Legal & Professional verändert die juristische Arbeit von Anwälten und steigert ihre Produktivität mit den Funktionen für Konversationssuche, Zusammenfassung sowie Dokumentenerstellung und -analyse von Lexis+ AI. Nasdaq trägt dazu bei, Ermittlungsabläufe bei verdächtigen Transaktionen zu automatisieren und ihre Fähigkeiten zur Bekämpfung von Finanzkriminalität und Überwachung zu stärken. All diese – und viele weitere – vielfältigen generativen KI-Anwendungen laufen auf AWS.

Wir freuen uns über die Dynamik von Amazon Bedrock, aber es steht noch am Anfang. Was wir bei der Zusammenarbeit mit Kunden gesehen haben, ist, dass sich alle schnell bewegen, die Entwicklung der generativen KI jedoch rasant voranschreitet und praktisch täglich neue Optionen und Innovationen entstehen. Kunden stellen fest, dass es unterschiedliche Modelle gibt, die für unterschiedliche Anwendungsfälle oder auf unterschiedlichen Datensätzen besser funktionieren. Einige Modelle eignen sich hervorragend zum Zusammenfassen, andere eignen sich hervorragend zum Denken und Integrieren und wieder andere bieten eine wirklich hervorragende Sprachunterstützung. Und dann gibt es noch die Bildgenerierung, Suchanwendungsfälle und mehr – alles basierend sowohl auf proprietären Modellen als auch auf Modellen, die für jedermann öffentlich zugänglich sind. Und in Zeiten, in denen so vieles unerkennbar ist, ist die Fähigkeit zur Anpassung wohl das wertvollste überhaupt. Es wird kein Modell geben, das sie alle beherrscht. Und sicherlich nicht nur ein Technologieunternehmen, das die Modelle bereitstellt, die jeder nutzt. Kunden müssen verschiedene Modelle ausprobieren. Sie müssen in der Lage sein, zwischen ihnen zu wechseln oder sie innerhalb desselben Anwendungsfalls zu kombinieren. Das bedeutet, dass sie eine echte Auswahl an Modellanbietern benötigen (was die Ereignisse der letzten 10 Tage noch deutlicher gemacht haben). Das ist der Grund, warum wir Amazon Bedrock erfunden haben, warum es bei den Kunden so großen Anklang findet und warum wir weiterhin innovativ sind und schnell iterieren, um das Erstellen mit (und den Wechsel zwischen) einer Reihe von Modellen so einfach wie einen API-Aufruf zu machen, und setzen dabei die neuesten Techniken ein für die Modellanpassung in den Händen aller Entwickler und sorgen dafür, dass die Kunden sicher und ihre Daten vertraulich bleiben. Wir freuen uns, mehrere neue Funktionen vorstellen zu können, die es Kunden noch einfacher machen, generative KI-Anwendungen zu erstellen und zu skalieren:

- Erweiterung der Modellauswahl mit Anthropic Claude 2.1, Meta Llama 2 70B und Ergänzungen zur Amazon Titan-Familie. In diesen frühen Tagen lernen und experimentieren Kunden noch mit verschiedenen Modellen, um herauszufinden, welche sie für verschiedene Zwecke verwenden möchten. Sie möchten die neuesten Modelle problemlos ausprobieren und auch testen können, welche Fähigkeiten und Funktionen ihnen für ihre Anwendungsfälle die besten Ergebnisse und Kostenmerkmale bieten. Mit Amazon Bedrock sind Kunden immer nur einen API-Aufruf von einem neuen Modell entfernt. Einige der beeindruckendsten Ergebnisse, die Kunden in den letzten Monaten erzielt haben, stammen von LLMs wie Das Claude-Modell von Anthropic, das ein breites Aufgabenspektrum von anspruchsvollen Dialogen und der Generierung von Inhalten bis hin zu komplexen Argumenten beherrscht und dabei ein hohes Maß an Zuverlässigkeit und Vorhersehbarkeit beibehält. Kunden berichten, dass Claude im Vergleich zu anderen FMs viel weniger wahrscheinlich schädliche Ausgaben erzeugt, einfacher zu kommunizieren ist und besser steuerbar ist, sodass Entwickler ihre gewünschten Ausgaben mit weniger Aufwand erzielen können. Das hochmoderne Modell von Anthropic, Claude 2, erreicht bei den GRE-Prüfungen zum Lesen und Schreiben und in ähnlicher Weise beim quantitativen Denken über dem 90. Perzentil. Und Jetzt ist das neu veröffentlichte Claude 2.1-Modell bei Amazon Bedrock erhältlich. Claude 2.1 bietet wichtige Funktionen für Unternehmen wie ein branchenführendes 200K-Token-Kontextfenster (zweimal so viel Kontext wie Claude 2), reduzierte Halluzinationsraten und erhebliche Verbesserungen der Genauigkeit, selbst bei sehr langen Kontextlängen. Claude 2.0 enthält außerdem verbesserte Systemeingabeaufforderungen – Musteranweisungen, die den Endbenutzern ein besseres Erlebnis bieten – und reduziert gleichzeitig die Kosten für Eingabeaufforderungen und Vervollständigungen um 2.1 %.

Für eine wachsende Zahl von Kunden, die eine verwaltete Version des öffentlich verfügbaren Llama 2-Modells von Meta verwenden möchten, bietet Amazon Bedrock Llama 2 13B und an Wir fügen Llama 2 70B hinzu. Llama 2 70B eignet sich für umfangreiche Aufgaben wie Sprachmodellierung, Textgenerierung und Dialogsysteme. Die öffentlich verfügbaren Llama-Modelle wurden mehr als 30 Millionen Mal heruntergeladen und Kunden lieben es, dass Amazon Bedrock sie als Teil eines verwalteten Dienstes anbietet, bei dem sie sich keine Gedanken über die Infrastruktur machen müssen oder über umfassende ML-Expertise in ihren Teams verfügen müssen. Darüber hinaus bietet Stability AI für die Bildgenerierung eine Reihe beliebter Text-zu-Bild-Modelle. Stable Diffusion XL 1.0 (SDXL 1.0) ist das fortschrittlichste davon und jetzt allgemein bei Amazon Bedrock erhältlich. Die neueste Ausgabe dieses beliebten Bildmodells verfügt über eine höhere Genauigkeit, einen besseren Fotorealismus und eine höhere Auflösung.

Kunden nutzen es auch Amazonas-Titan Modelle, die von AWS erstellt und vorab trainiert werden, um leistungsstarke Funktionen mit großer Wirtschaftlichkeit für eine Vielzahl von Anwendungsfällen bereitzustellen. Amazon kann auf eine 25-jährige Erfolgsgeschichte im Bereich ML und KI zurückblicken – Technologien, die wir in unseren Unternehmen einsetzen – und wir haben viel über die Erstellung und Bereitstellung von Modellen gelernt. Wir haben sorgfältig ausgewählt, wie wir unsere Modelle trainieren und welche Daten wir dafür verwenden. Wir stellen Kunden von Ansprüchen frei, dass unsere Modelle oder ihre Ergebnisse das Urheberrecht anderer verletzen. Im April dieses Jahres haben wir unsere ersten Titan-Modelle vorgestellt. Titan Text Lite– jetzt allgemein verfügbar– ist ein prägnantes, kostengünstiges Modell für Anwendungsfälle wie Chatbots, Textzusammenfassung oder Texterstellung, und es ist auch fesselnd für die Feinabstimmung. Titan Text Express – jetzt auch allgemein verfügbar– ist umfangreicher und kann für ein breiteres Spektrum textbasierter Aufgaben verwendet werden, wie z. B. die Generierung von offenem Text und Konversationschat. Wir bieten diese Textmodelloptionen an, um Kunden die Möglichkeit zu geben, je nach Anwendungsfall und Geschäftsanforderungen Genauigkeit, Leistung und Kosten zu optimieren. Kunden wie Nexxiot, PGA Tour und Ryanair nutzen unsere beiden Titan Text-Modelle. Wir haben auch ein Einbettungsmodell, Titan Text Embeddings, für Suchanwendungsfälle und Personalisierung. Kunden wie Nasdaq erzielen großartige Ergebnisse mit Titan Text Embeddings, um die Funktionen von Nasdaq IR Insight zu verbessern und Erkenntnisse aus Dokumenten von über 9,000 globalen Unternehmen für Nachhaltigkeits-, Rechts- und Buchhaltungsteams zu generieren. Und wir werden die Titan-Familie im Laufe der Zeit um weitere Modelle erweitern. Wir führen ein neues Einbettungsmodell ein: Titan Multimodal Embeddings, um multimodale Such- und Empfehlungserlebnisse für Benutzer zu ermöglichen, die Bilder und Text (oder eine Kombination aus beiden) als Eingaben verwenden. Und wir sind Einführung eines neuen Text-zu-Bild-Modells, Amazon Titan Image Generator. Mit Titan Image Generator können Kunden aus Branchen wie Werbung, E-Commerce sowie Medien und Unterhaltung mithilfe einer Texteingabe realistische Bilder in Studioqualität in großen Mengen und zu geringen Kosten generieren. Wir sind gespannt darauf, wie die Kunden auf Titan Models reagieren, und Sie können davon ausgehen, dass wir hier weiterhin Innovationen hervorbringen werden.

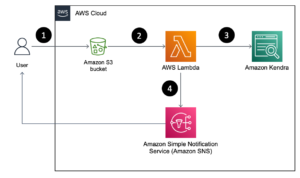

- Neue Funktionen zur sicheren Anpassung Ihrer generativen KI-Anwendung mit Ihren proprietären Daten: Eine der wichtigsten Funktionen von Amazon Bedrock ist die einfache Anpassung eines Modells. Das wird für Kunden wirklich spannend, denn hier trifft generative KI auf ihr zentrales Unterscheidungsmerkmal – ihre Daten. Es ist jedoch wirklich wichtig, dass ihre Daten sicher bleiben, dass sie unterwegs die Kontrolle darüber haben und dass Modellverbesserungen für sie privat sind. Es gibt mehrere Möglichkeiten, dies zu tun, und Amazon Bedrock bietet die größte Auswahl an Anpassungsoptionen für mehrere Modelle. Das erste ist die Feinabstimmung. Die Feinabstimmung eines Modells in Amazon Bedrock ist einfach. Sie wählen einfach das Modell aus und Amazon Bedrock erstellt eine Kopie davon. Anschließend verweisen Sie auf einige beschriftete Beispiele (z. B. eine Reihe guter Frage-Antwort-Paare), die Sie im Amazon Simple Storage Service (Amazon S3) speichern, und Amazon Bedrock „trainiert“ schrittweise (erweitert das kopierte Modell mit den neuen Informationen). Anhand dieser Beispiele erhalten Sie ein privates, genauer abgestimmtes Modell, das relevantere, individuellere Antworten liefert. Wir freuen uns, Ihnen mitteilen zu können, dass die Feinabstimmung allgemein für Cohere Command, Meta Llama 2, Amazon Titan Text (Lite und Express), Amazon Titan Multimodal Embeddings und in der Vorschau für Amazon Titan Image Generator verfügbar ist. Und durch unsere Zusammenarbeit mit Anthropic werden wir AWS-Kunden bald frühzeitig Zugang zu einzigartigen Funktionen für die Modellanpassung und Feinabstimmung des hochmodernen Modells Claude bieten.

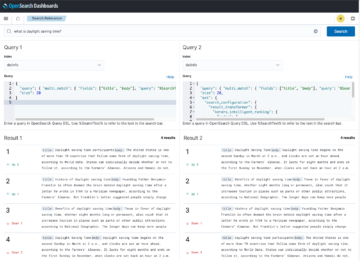

Eine zweite Technik zum Anpassen von LLMs und anderen FMs für Ihr Unternehmen ist Retrieval Augmented Generation (RAG), mit der Sie die Antworten eines Modells anpassen können, indem Sie Ihre Eingabeaufforderungen mit Daten aus mehreren Quellen, einschließlich Dokument-Repositorys, Datenbanken und APIs, ergänzen. Im September haben wir eine RAG-Funktion, Knowledge Bases for Amazon Bedrock, eingeführt, die Modelle sicher mit Ihren proprietären Datenquellen verbindet, um Ihre Eingaben mit mehr Informationen zu ergänzen, damit Ihre Anwendungen relevantere, kontextbezogenere und genauere Antworten liefern. Wissensbasen ist jetzt allgemein mit einer API verfügbar, die den gesamten RAG-Workflow ausführt Vom Abrufen des zur Ergänzung einer Eingabeaufforderung erforderlichen Textes über das Senden der Eingabeaufforderung an das Modell bis hin zur Rückgabe der Antwort. Knowledge Bases unterstützt Datenbanken mit Vektorfunktionen, die numerische Darstellungen Ihrer Daten (Einbettungen) speichern, die Modelle verwenden, um auf diese Daten für RAG zuzugreifen, einschließlich Amazon OpenSearch Service und andere beliebte Datenbanken wie Pinecone und Redis Enterprise Cloud (Amazon Aurora- und MongoDB-Vektorunterstützung folgt). bald).

Die dritte Möglichkeit, Modelle in Amazon Bedrock anzupassen, ist die kontinuierliche Vorschulung. Mit dieser Methode baut das Modell auf seinem ursprünglichen Vortraining für das allgemeine Sprachverständnis auf, um domänenspezifische Sprache und Terminologie zu lernen. Dieser Ansatz richtet sich an Kunden, die über große Bestände an unbeschrifteten, domänenspezifischen Informationen verfügen und ihren LLMs ermöglichen möchten, die Sprache, Phrasen, Abkürzungen, Konzepte, Definitionen und den Fachjargon zu verstehen, der für ihre Welt (und ihr Unternehmen) einzigartig ist. Anders als bei der Feinabstimmung, die eine relativ kleine Datenmenge erfordert, wird das weitere Vortraining für große Datensätze (z. B. Tausende von Textdokumenten) durchgeführt. Jetzt sind in Amazon Bedrock Vortrainingsfunktionen für Titan Text Lite und Titan Text Express verfügbar.

- Allgemeine Verfügbarkeit von Agenten für Amazon Bedrock um bei der Ausführung mehrstufiger Aufgaben mithilfe von Systemen, Datenquellen und Unternehmenswissen zu helfen. LLMs sind großartig darin, Gespräche zu führen und Inhalte zu generieren, aber Kunden möchten, dass ihre Anwendungen dazu in der Lage sind do noch mehr – etwa Maßnahmen ergreifen, Probleme lösen und mit einer Reihe von Systemen interagieren, um mehrstufige Aufgaben wie die Buchung von Reisen, die Einreichung von Versicherungsansprüchen oder die Bestellung von Ersatzteilen zu erledigen. Und Amazon Bedrock kann bei dieser Herausforderung helfen. Bei Agenten wählen Entwickler ein Modell aus, schreiben ein paar grundlegende Anweisungen wie „Sie sind ein fröhlicher Kundendienstmitarbeiter“ und „Überprüfen Sie die Produktverfügbarkeit im Bestandssystem“ und verweisen das ausgewählte Modell auf die richtigen Datenquellen und Unternehmenssysteme (z. B. CRM). oder ERP-Anwendungen) und schreiben Sie einige AWS Lambda-Funktionen, um die APIs auszuführen (z. B. die Verfügbarkeit eines Artikels im ERP-Bestand prüfen). Amazon Bedrock analysiert die Anfrage automatisch und zerlegt sie mithilfe der Argumentationsfunktionen des ausgewählten Modells in eine logische Reihenfolge, um zu bestimmen, welche Informationen benötigt werden, welche APIs aufgerufen werden müssen und wann sie aufgerufen werden müssen, um einen Schritt abzuschließen oder eine Aufgabe zu lösen. Jetzt allgemein verfügbar, können Agenten die meisten Geschäftsaufgaben planen und ausführen – von der Beantwortung von Kundenfragen zu Ihrer Produktverfügbarkeit bis zur Annahme ihrer Bestellungen – und Entwickler müssen nicht mit maschinellem Lernen vertraut sein, Eingabeaufforderungen erstellen, Modelle trainieren oder Systeme manuell verbinden. Und Bedrock macht das alles sicher und privat, und Kunden wie Druva und Athene nutzen sie bereits, um die Genauigkeit und Geschwindigkeit der Entwicklung ihrer generativen KI-Anwendungen zu verbessern.

- Introducing... Leitplanken für Amazon Bedrock So können Sie Schutzmaßnahmen basierend auf Ihren Anwendungsfallanforderungen und verantwortungsvollen KI-Richtlinien anwenden. Kunden möchten sicher sein, dass die Interaktionen mit ihren KI-Anwendungen sicher sind, giftige oder anstößige Sprache vermeiden, für ihr Unternehmen relevant bleiben und sich an ihre verantwortungsvollen KI-Richtlinien halten. Mit Leitplanken können Kunden Themen festlegen, die sie vermeiden möchten, und Amazon Bedrock stellt Benutzern nur genehmigte Antworten auf Fragen bereit, die in diese eingeschränkten Kategorien fallen. Beispielsweise kann eine Online-Banking-Anwendung eingerichtet werden, um Anlageberatung zu vermeiden und unangemessene Inhalte (wie Hassreden und Gewalt) zu entfernen. Ab Anfang 2024 können Kunden auch personenbezogene Daten (PII) in Musterantworten schwärzen. Nachdem ein Kunde beispielsweise mit einem Call-Center-Mitarbeiter interagiert, wird das Kundendienstgespräch häufig zur Aufbewahrung von Aufzeichnungen zusammengefasst, und Leitplanken können personenbezogene Daten aus diesen Zusammenfassungen entfernen. Guardrails können modellübergreifend in Amazon Bedrock (einschließlich fein abgestimmter Modelle) und mit Agents für Amazon Bedrock verwendet werden, sodass Kunden ein einheitliches Schutzniveau für alle ihre generativen KI-Anwendungen bieten können.

Oberste Ebene des Stapels: Kontinuierliche Innovation macht generative KI für mehr Benutzer zugänglich

Auf der obersten Ebene des Stapels befinden sich Anwendungen, die LLMs und andere FMs nutzen, sodass Sie die Vorteile generativer KI bei der Arbeit nutzen können. Ein Bereich, in dem generative KI bereits das Spiel verändert, ist die Codierung. Letztes Jahr haben wir Amazon CodeWhisperer eingeführt, mit dem Sie Anwendungen schneller und sicherer erstellen können, indem Codevorschläge und -empfehlungen nahezu in Echtzeit generiert werden. Kunden wie Accenture, Boeing, Bundesliga, The Cigna Group, Kone und Warner Music Group nutzen CodeWhisperer, um die Entwicklerproduktivität zu steigern – und Accenture unterstützt bis zu 50,000 seiner Softwareentwickler und IT-Experten mit Amazon CodeWhisperer. Wir möchten, dass möglichst viele Entwickler von den Produktivitätsvorteilen generativer KI profitieren können. Deshalb bietet CodeWhisperer allen Einzelpersonen kostenlose Empfehlungen an.

Obwohl KI-Codierungstools zwar viel dazu beitragen, das Leben von Entwicklern zu erleichtern, werden ihre Produktivitätsvorteile durch mangelnde Kenntnisse über interne Codebasen, interne APIs, Bibliotheken, Pakete und Klassen begrenzt. Eine Möglichkeit, darüber nachzudenken: Wenn Sie einen neuen Entwickler einstellen, selbst wenn dieser erstklassig ist, wird er in Ihrem Unternehmen erst dann so produktiv sein, wenn er Ihre Best Practices und Ihren Code versteht. Die heutigen KI-gestützten Codierungstools ähneln dem neu eingestellten Entwickler. Um dabei zu helfen, haben wir kürzlich eine Vorschau auf eine neue Vorschau gegeben Anpassungsfähigkeit in Amazon CodeWhisperer, der die interne Codebasis eines Kunden sicher nutzt, um relevantere und nützlichere Codeempfehlungen bereitzustellen. Mit dieser Fähigkeit ist CodeWhisperer ein Experte Ihre Code und liefert Empfehlungen, die relevanter sind, um noch mehr Zeit zu sparen. In einer Studie, die wir mit Persistent, einem globalen Unternehmen für digitales Engineering und Unternehmensmodernisierung, durchgeführt haben, haben wir herausgefunden, dass Anpassungen Entwicklern helfen, Aufgaben bis zu 28 % schneller zu erledigen als mit den allgemeinen Funktionen von CodeWhisperer. Jetzt kann ein Entwickler eines Gesundheitstechnologieunternehmens CodeWhisperer bitten, „mit der Kunden-ID verknüpfte MRT-Bilder zu importieren und sie durch den Bildklassifizierer laufen zu lassen“, um Anomalien zu erkennen. Da CodeWhisperer Zugriff auf die Codebasis hat, kann es viel relevantere Vorschläge liefern, darunter die Importorte der MRT-Bilder und Kunden-IDs. CodeWhisperer hält Anpassungen vollständig privat und das zugrunde liegende FM verwendet sie nicht für Schulungen, wodurch das wertvolle geistige Eigentum der Kunden geschützt wird. AWS ist der einzige große Cloud-Anbieter, der eine solche Funktion jedem bietet.

Introducing... Amazon Q, der generative KI-gestützte Assistent, maßgeschneidert für die Arbeit

Entwickler sind sicherlich nicht die einzigen, die generative KI ausprobieren – Millionen von Menschen nutzen generative KI-Chat-Anwendungen. Was die ersten Anbieter in diesem Bereich getan haben, ist aufregend und äußerst nützlich für Verbraucher, aber in vielerlei Hinsicht „funktionieren“ sie bei der Arbeit nicht ganz. Ihr Allgemeinwissen und ihre Fähigkeiten sind großartig, aber sie kennen Ihr Unternehmen, Ihre Daten, Ihre Kunden, Ihre Abläufe oder Ihr Unternehmen nicht. Das schränkt ein, wie sehr sie Ihnen helfen können. Sie wissen auch nicht viel über Ihre Rolle – welche Arbeit Sie erledigen, mit wem Sie zusammenarbeiten, welche Informationen Sie verwenden und worauf Sie Zugriff haben. Diese Einschränkungen sind verständlich, da diese Assistenten keinen Zugriff auf die privaten Informationen Ihres Unternehmens haben und nicht darauf ausgelegt sind, die Datenschutz- und Sicherheitsanforderungen zu erfüllen, die Unternehmen für diesen Zugriff benötigen. Es ist schwierig, die Sicherheit im Nachhinein zu verbessern und zu erwarten, dass sie gut funktioniert. Wir glauben, dass wir einen besseren Weg haben, der es jeder Person in jeder Organisation ermöglicht, generative KI sicher in ihrer täglichen Arbeit einzusetzen.

WWir freuen uns, Ihnen das vorzustellen Amazon Q, ein neuartiger generativer KI-gestützter Assistent, der speziell für die Arbeit entwickelt wurde und auf Ihr Unternehmen zugeschnitten werden kann. Q kann Ihnen helfen, schnelle und relevante Antworten auf dringende Fragen zu erhalten, Probleme zu lösen, Inhalte zu generieren und Maßnahmen zu ergreifen, indem Sie die Daten und das Fachwissen nutzen, das in den Informationsspeichern, Codes und Unternehmenssystemen Ihres Unternehmens enthalten ist. Wenn Sie mit Amazon Q chatten, erhalten Sie sofort relevante Informationen und Ratschläge, um Aufgaben zu rationalisieren, die Entscheidungsfindung zu beschleunigen und Kreativität und Innovation am Arbeitsplatz anzuregen. Wir haben Amazon Q so konzipiert, dass es sicher und privat ist. Es kann Ihre vorhandenen Identitäten, Rollen und Berechtigungen verstehen und respektieren und diese Informationen zur Personalisierung seiner Interaktionen verwenden. Wenn ein Benutzer ohne Q keine Berechtigung zum Zugriff auf bestimmte Daten hat, kann er auch mit Q nicht darauf zugreifen. Wir haben Amazon Q so konzipiert, dass es vom ersten Tag an die strengen Anforderungen unserer Unternehmenskunden erfüllt – keine ihrer Inhalte werden zur Verbesserung der zugrunde liegenden Modelle verwendet.

Amazon Q ist Ihr kompetenter Assistent zum Aufbau auf AWS: Wir haben Amazon Q auf der Grundlage von 17 Jahren AWS-Wissen und -Erfahrung geschult, damit es die Art und Weise verändern kann, wie Sie Anwendungen und Workloads auf AWS erstellen, bereitstellen und betreiben. Amazon Q verfügt über eine Chat-Schnittstelle in der AWS-Managementkonsole und -Dokumentation, Ihrer IDE (über CodeWhisperer) und Ihren Team-Chatrooms auf Slack oder anderen Chat-Apps. Amazon Q kann Ihnen helfen, neue AWS-Funktionen zu erkunden, schneller zu starten, unbekannte Technologien zu erlernen, Lösungen zu entwickeln, Fehler zu beheben, Upgrades durchzuführen und vieles mehr – es ist ein Experte für gut strukturierte AWS-Muster, Best Practices, Dokumentation und Lösungsimplementierungen. Hier sind einige Beispiele dafür, was Sie mit Ihrem neuen AWS-Expertenassistenten tun können:

- Erhalten Sie klare Antworten und Anleitungen zu AWS-Funktionen, -Services und -Lösungen: Bitten Sie Amazon Q um „Erzählen Sie mir etwas über Agents für Amazon Bedrock“, und Q gibt Ihnen eine Beschreibung der Funktion sowie Links zu relevanten Materialien. Sie können Amazon Q auch praktisch jede Frage dazu stellen, wie ein AWS-Service funktioniert (z. B. „Was sind die Skalierungsgrenzen für eine DynamoDB-Tabelle?“ „Was ist Redshift Managed Storage?“) oder wie man eine beliebige Anzahl von Lösungen am besten entwirft ( „Was sind die Best Practices für den Aufbau ereignisgesteuerter Architekturen?“). Und Amazon Q wird prägnante Antworten zusammentragen und seine Quellen immer zitieren (und verlinken).

- Wählen Sie den besten AWS-Service für Ihren Anwendungsfall und legen Sie schnell los: Fragen Sie Amazon: „Wie kann ich eine Web-App auf AWS erstellen?“ ” und es wird eine Liste potenzieller Dienste wie bereitgestellt AWS verstärken, AWS Lambda und Amazon EC2 mit den Vorteilen jedes einzelnen. Von dort aus können Sie die Optionen eingrenzen, indem Sie Q helfen, Ihre Anforderungen, Vorlieben und Einschränkungen zu verstehen (z. B. „Welche davon wäre am besten, wenn ich Container verwenden möchte?“ oder „Soll ich eine relationale oder nicht relationale Datenbank verwenden?“). “). Beenden Sie mit „Wie fange ich an?“ und Amazon Q erläutert einige grundlegende Schritte und weist Sie auf zusätzliche Ressourcen hin.

- Optimieren Sie Ihre Rechenressourcen: Amazon Q kann Ihnen bei der Auswahl von Amazon EC2-Instances helfen. Wenn Sie ihn fragen: „Helfen Sie mir, die richtige EC2-Instanz zu finden, um einen Videokodierungs-Workload für meine Gaming-App mit der höchsten Leistung bereitzustellen“, erhalten Sie von Q eine Liste der Instanzfamilien mit Begründungen für jeden Vorschlag. Und Sie können beliebig viele Folgefragen stellen, um die beste Wahl für Ihre Arbeitsbelastung zu finden.

- Erhalten Sie Unterstützung beim Debuggen, Testen und Optimieren Ihres Codes: Wenn beim Codieren in Ihrer IDE ein Fehler auftritt, können Sie Amazon Q um Hilfe bitten, indem Sie sagen: „Mein Code weist einen E/A-Fehler auf. Können Sie eine Lösung bereitstellen?“ und Q generiert den Code für Sie. Wenn Ihnen der Vorschlag gefällt, können Sie Amazon Q bitten, den Fix zu Ihrer Anwendung hinzuzufügen. Da sich Amazon Q in Ihrer IDE befindet, versteht es den Code, an dem Sie arbeiten, und weiß, wo der Fix eingefügt werden muss. Amazon Q kann auch Unit-Tests erstellen („Komponententests für die ausgewählte Funktion schreiben“), die es in Ihren Code einfügen und von Ihnen ausführen kann. Schließlich kann Ihnen Amazon Q Wege aufzeigen, wie Sie Ihren Code für eine höhere Leistung optimieren können. Bitten Sie Q, „meine ausgewählte DynamoDB-Abfrage zu optimieren“, und es nutzt sein Verständnis Ihres Codes, um einen Vorschlag in natürlicher Sprache zu liefern, was behoben werden muss, zusammen mit dem zugehörigen Code, den Sie mit einem Klick implementieren können.

- Probleme diagnostizieren und beheben: Wenn Sie in der AWS-Managementkonsole auf Probleme stoßen, wie z. B. EC2-Berechtigungsfehler oder Amazon S3-Konfigurationsfehler, können Sie einfach auf die Schaltfläche „Fehlerbehebung mit Amazon Q“ klicken, und die AWS-Managementkonsole nutzt ihr Verständnis des Fehlertyps und des Dienstes, bei dem sich der Fehler befindet um Ihnen Lösungsvorschläge zu unterbreiten. Sie können Amazon Q sogar bitten, Fehler in Ihrem Netzwerk zu beheben (z. B. „Warum kann ich über SSH keine Verbindung zu meiner EC2-Instanz herstellen?“). Q analysiert dann Ihre End-to-End-Konfiguration und stellt eine Diagnose bereit (z. B. „Diese Instanz „scheint sich in einem privaten Subnetz zu befinden, daher muss möglicherweise eine öffentliche Zugänglichkeit hergestellt werden“).

- Steigen Sie im Handumdrehen auf eine neue Codebasis ein: Wenn Sie in Ihrer IDE mit Amazon Q chatten, kombiniert Amazon Q sein Fachwissen im Erstellen von Software mit einem Verständnis Ihres Codes – eine leistungsstarke Kombination! Wenn Sie früher ein Projekt von jemand anderem übernommen haben oder neu im Team waren, mussten Sie möglicherweise Stunden damit verbringen, den Code und die Dokumentation manuell zu überprüfen, um zu verstehen, wie es funktioniert und was es bewirkt. Da Amazon Q nun den Code in Ihrer IDE versteht, können Sie Amazon Q einfach bitten, den Code zu erklären („Geben Sie mir eine Beschreibung dessen, was diese Anwendung tut und wie sie funktioniert“), und Q wird Ihnen Details geben, z. B. welche Dienste die Code verwendet und was verschiedene Funktionen tun (z. B. könnte Q mit etwas antworten wie: „Diese Anwendung baut ein grundlegendes Support-Ticket-System mit Python Flask und AWS Lambda auf“ und beschreibt anschließend jede seiner Kernfunktionen, wie sie implementiert sind, und vieles mehr).

- Beseitigen Sie Ihren Funktionsrückstand schneller: Sie können Amazon Q sogar bitten, Sie durch den End-to-End-Prozess des Hinzufügens einer Funktion zu Ihrer Anwendung zu führen und einen Großteil davon zu automatisieren Amazon CodeCatalyst, unser einheitlicher Softwareentwicklungsservice für Teams. Dazu weisen Sie Q einfach eine Backlog-Aufgabe aus Ihrer Problemliste zu – genau wie Sie es einem Teamkollegen tun würden – und Q erstellt einen Schritt-für-Schritt-Plan für die Erstellung und Implementierung der Funktion. Sobald Sie den Plan genehmigen, schreibt Q den Code und präsentiert Ihnen die vorgeschlagenen Änderungen als Codeüberprüfung. Sie können eine Nacharbeit anfordern (falls erforderlich), genehmigen und/oder bereitstellen!

- Aktualisieren Sie Ihren Code in einem Bruchteil der Zeit: Tatsächlich verbringen die meisten Entwickler nur einen Bruchteil ihrer Zeit damit, neuen Code zu schreiben und neue Anwendungen zu erstellen. Sie verbringen einen Großteil ihrer Zyklen mit schmerzhaften, mühsamen Bereichen wie Wartung und Upgrades. Nehmen Sie Sprachversions-Upgrades in Anspruch. Eine große Anzahl von Kunden verwendet weiterhin ältere Java-Versionen, da das Upgrade Monate oder sogar Jahre und Tausende von Stunden Entwicklerzeit in Anspruch nehmen wird. Dies aufzuschieben birgt echte Kosten und Risiken – Sie verpassen Leistungsverbesserungen und sind anfällig für Sicherheitsprobleme. Wir glauben, dass Amazon Q hier bahnbrechend sein kann, und sind begeistert Amazon Q-Code-Transformation, eine Funktion, die Ihnen einen Großteil dieser schweren Arbeit abnehmen und die Zeit für die Aktualisierung von Anwendungen von Tagen auf Minuten verkürzen kann. Öffnen Sie einfach den Code, den Sie aktualisieren möchten, in Ihrer IDE und bitten Sie Amazon Q, Ihren Code „/transformieren“ zu lassen. Amazon Q analysiert den gesamten Quellcode der Anwendung, generiert den Code in der Zielsprache und -version und führt Tests durch, um Ihnen dabei zu helfen, die Sicherheits- und Leistungsverbesserungen der neuesten Sprachversionen zu realisieren. Kürzlich nutzte ein sehr kleines Team von Amazon-Entwicklern Amazon Q Code Transformation, um in nur zwei Tagen 1,000 Produktionsanwendungen von Java 8 auf Java 17 zu aktualisieren. Die durchschnittliche Zeit pro Anwendung betrug weniger als 10 Minuten. Heute führt Amazon Q Code Transformation Java-Sprach-Upgrades von Java 8 oder Java 11 auf Java 17 durch. Als nächstes (und bald) kommt die Möglichkeit, .NET Framework in plattformübergreifendes .NET umzuwandeln (wobei in Zukunft noch weitere Transformationen folgen werden). .

Amazon Q ist Ihr Business-Experte: Sie können Amazon Q mit Ihren Geschäftsdaten, Informationen und Systemen verbinden, sodass es alles zusammenfassen und maßgeschneiderte Unterstützung bieten kann, um Menschen bei der Lösung von Problemen, der Generierung von Inhalten und der Durchführung von Maßnahmen zu unterstützen, die für Ihr Unternehmen relevant sind. Es ist ganz einfach, Amazon Q in Ihr Unternehmen zu integrieren. Es verfügt über mehr als 40 integrierte Konnektoren zu gängigen Unternehmenssystemen wie Amazon S3, Microsoft 365, Salesforce, ServiceNow, Slack, Atlassian, Gmail, Google Drive und Zendesk. Es kann auch eine Verbindung zu Ihrem internen Intranet, Wikis und Laufbüchern herstellen, und mit dem Amazon Q SDK können Sie eine Verbindung zu jeder gewünschten internen Anwendung aufbauen. Richten Sie Amazon Q auf diese Repositories, und es wird Ihr Unternehmen „ankurbeln“ und die semantischen Informationen erfassen und verstehen, die Ihr Unternehmen einzigartig machen. Anschließend erhalten Sie Ihre eigene benutzerfreundliche und einfache Amazon Q-Webanwendung, sodass Mitarbeiter in Ihrem gesamten Unternehmen mit der Konversationsschnittstelle interagieren können. Amazon Q stellt außerdem eine Verbindung zu Ihrem Identitätsanbieter her, um einen Benutzer, seine Rolle und die Systeme, auf die er zugreifen darf, zu verstehen, sodass Benutzer detaillierte, differenzierte Fragen stellen und maßgeschneiderte Ergebnisse erhalten können, die nur Informationen enthalten, zu deren Anzeige sie berechtigt sind. Amazon Q generiert Antworten und Erkenntnisse, die genau und dem von Ihnen bereitgestellten Material und Wissen entsprechen, und Sie können sensible Themen einschränken, Schlüsselwörter blockieren oder unangemessene Fragen und Antworten herausfiltern. Hier sind einige Beispiele dafür, was Sie mit dem neuen Expertenassistenten Ihres Unternehmens tun können:

- Erhalten Sie klare, äußerst relevante Antworten basierend auf Ihren Geschäftsdaten und -informationen: Mitarbeiter können bei Amazon Q nach allem fragen, wonach sie zuvor in allen möglichen Quellen suchen mussten. Fragen Sie „Was sind die neuesten Richtlinien für die Verwendung von Logos?“ oder „Wie beantrage ich eine Firmenkreditkarte?“ und Amazon Q fasst alle gefundenen relevanten Inhalte zusammen und liefert schnelle Antworten sowie Links zu relevanten Themen Quellen (z. B. Markenportale und Logo-Repositories, T&E-Richtlinien des Unternehmens und Kartenanwendungen).

- Optimieren Sie die tägliche Kommunikation: Fragen Sie einfach nach, und Amazon Q kann Inhalte generieren („Erstellen Sie einen Blog-Beitrag und drei Social-Media-Schlagzeilen, in denen das in dieser Dokumentation beschriebene Produkt angekündigt wird“), Executive Summarys erstellen („Schreiben Sie eine Zusammenfassung unseres Besprechungsprotokolls mit einer Aufzählung von Aktionspunkten“). ), E-Mail-Updates bereitstellen („Entwerfen Sie eine E-Mail, in der unsere Q3-Schulungsprogramme für Kunden in Indien hervorgehoben werden“) und helfen Sie bei der Strukturierung von Besprechungen („Erstellen Sie eine Besprechungsagenda, um über den neuesten Kundenzufriedenheitsbericht zu sprechen“).

- Erledige Aufgaben: Amazon Q kann dabei helfen, bestimmte Aufgaben zu erledigen und so die Zeit reduzieren, die Mitarbeiter für sich wiederholende Arbeiten wie das Einreichen von Tickets aufwenden. Bitten Sie Amazon Q, „Kundenfeedback zum neuen Preisangebot in Slack zusammenzufassen“ und fordern Sie dann Q auf, diese Informationen zu übernehmen und ein Ticket in Jira zu eröffnen, um das Marketingteam auf den neuesten Stand zu bringen. Sie können Q bitten, „dieses Anrufprotokoll zusammenzufassen“ und dann „einen neuen Fall für Kunde A in Salesforce zu eröffnen“. Amazon Q unterstützt andere beliebte Arbeitsautomatisierungstools wie Zendesk und Service Now.

Amazon Q ist in Amazon QuickSight: Mit der Amazon Q in QuickSight, dem Business-Intelligence-Dienst von AWS, können Benutzer ihren Dashboards Fragen stellen wie „Warum ist die Anzahl der Bestellungen im letzten Monat gestiegen?“ und erhalten Sie Visualisierungen und Erklärungen der Faktoren, die den Anstieg beeinflusst haben. Und Analysten können Amazon Q verwenden, um die Zeit, die sie zum Erstellen von Dashboards benötigen, von Tagen auf Minuten zu reduzieren, indem sie eine einfache Eingabeaufforderung wie „Zeigen Sie mir die Umsätze nach Region und Monat als gestapeltes Balkendiagramm“ anzeigen. Q kommt sofort mit diesem Diagramm zurück, und Sie können es ganz einfach zu einem Dashboard hinzufügen oder weiter mit Q chatten, um die Visualisierung zu verfeinern (z. B. „Ändern Sie das Balkendiagramm in ein Sankey-Diagramm“ oder „Zeigen Sie Länder statt Regionen“). Amazon Q in QuickSight macht es außerdem einfacher, vorhandene Dashboards zu nutzen, um Geschäftsinteressenten zu informieren, wichtige Erkenntnisse zu gewinnen und die Entscheidungsfindung mithilfe von Datengeschichten zu vereinfachen. Beispielsweise können Benutzer Amazon Q auffordern, „eine Geschichte darüber zu erstellen, wie sich das Unternehmen im letzten Monat verändert hat, um eine Geschäftsbewertung mit der Geschäftsleitung vorzunehmen“, und in Sekundenschnelle liefert Amazon Q eine datengesteuerte Geschichte, die visuell überzeugend ist vollständig anpassbar. Diese Geschichten können im gesamten Unternehmen sicher geteilt werden, um Stakeholder zu koordinieren und bessere Entscheidungen zu treffen.

Amazon Q ist in Amazon Connect: In Amazon Connect, unserem Contact-Center-Service, hilft Amazon Q Ihren Kundendienstmitarbeitern, einen besseren Kundenservice zu bieten. Amazon Q nutzt die Wissensrepositorys, die Ihre Agenten normalerweise verwenden, um Informationen für Kunden zu erhalten. Anschließend können Agenten direkt in Connect mit Amazon Q chatten, um Antworten zu erhalten, die ihnen helfen, schneller auf Kundenanfragen zu reagieren, ohne selbst die Dokumentation durchsuchen zu müssen. Und während es großartig ist, mit Amazon Q zu chatten, um superschnelle Antworten zu erhalten, gibt es im Kundenservice kein zu schnelles Thema. Deshalb Amazon Q In Connect verwandelt ein Live-Kundengespräch mit einem Agenten in eine Eingabeaufforderung und stellt dem Agenten automatisch mögliche Antworten, vorgeschlagene Aktionen und Links zu Ressourcen zur Verfügung. Amazon Q kann beispielsweise erkennen, dass ein Kunde eine Autovermietungsfirma kontaktiert, um seine Reservierung zu ändern, eine Antwort für den Agenten generieren, um schnell mitzuteilen, wie die Änderungsgebührenrichtlinien des Unternehmens gelten, und den Agenten durch die Schritte führen, die er zur Aktualisierung benötigt Reservierung.

Amazon Q ist in der AWS Supply Chain (in Kürze erhältlich): In AWS Supply Chain, unserem Supply-Chain-Insights-Service, hilft Amazon Q Angebots- und Nachfrageplanern, Bestandsmanagern und Handelspartnern, ihre Lieferkette zu optimieren, indem es potenzielle Fehlbestände oder Überbestände zusammenfasst und hervorhebt und Szenarien zur Lösung des Problems visualisiert. Benutzer können Amazon Q „Was“, „Warum“ und „Was wäre wenn“-Fragen zu ihren Lieferkettendaten stellen und durch komplexe Szenarien und die Kompromisse zwischen verschiedenen Lieferkettenentscheidungen chatten. Ein Kunde könnte sich beispielsweise fragen: „Was verursacht die Verzögerung bei meinen Lieferungen und wie kann ich die Abläufe beschleunigen?“ worauf Amazon Q antworten könnte: „90 % Ihrer Bestellungen gehen an die Ostküste, und ein großer Sturm im Südosten verursacht eine Verzögerung von 24 Stunden.“ Wenn Sie zum Hafen von New York statt nach Miami versenden, beschleunigen Sie die Lieferungen und senken die Kosten um 50 %.“

Unsere Kunden führen generative KI schnell ein – sie trainieren bahnbrechende Modelle auf AWS, sie entwickeln generative KI-Anwendungen in Rekordgeschwindigkeit mit Amazon Bedrock und sie stellen bahnbrechende Anwendungen wie Amazon Q in ihren Organisationen bereit. Mit unseren neuesten Ankündigungen, AWS bietet Kunden noch mehr Leistung, Auswahl und Innovation auf jeder Ebene des Stacks. Die kombinierte Wirkung aller Fähigkeiten, die wir bei re:Invent bereitstellen, markiert einen wichtigen Meilenstein auf dem Weg zu einem spannenden und bedeutungsvollen Ziel: Wir machen generative KI für Kunden aller Größen und technischen Fähigkeiten zugänglich, damit sie alles neu erfinden und transformieren können ist möglich.

Downloads

Über den Autor

Swami Sivasubramanian ist Vizepräsident für Daten und maschinelles Lernen bei AWS. In dieser Rolle beaufsichtigt Swami alle AWS-Datenbank-, Analyse- und KI- und maschinellen Lerndienste. Die Mission seines Teams besteht darin, Organisationen dabei zu helfen, ihre Daten mit einer vollständigen End-to-End-Datenlösung zum Speichern, Zugreifen, Analysieren, Visualisieren und Vorhersagen zu nutzen.

Swami Sivasubramanian ist Vizepräsident für Daten und maschinelles Lernen bei AWS. In dieser Rolle beaufsichtigt Swami alle AWS-Datenbank-, Analyse- und KI- und maschinellen Lerndienste. Die Mission seines Teams besteht darin, Organisationen dabei zu helfen, ihre Daten mit einer vollständigen End-to-End-Datenlösung zum Speichern, Zugreifen, Analysieren, Visualisieren und Vorhersagen zu nutzen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 300

- 35%

- 40

- 50

- 500

- 65

- 8

- 9

- a

- Fähigkeiten

- Fähigkeit

- Fähig

- Über Uns

- oben

- beschleunigen

- beschleunigt

- Beschleuniger

- Accenture

- Zugang

- Zugänglichkeit

- zugänglich

- Buchhaltung

- Genauigkeit

- genau

- erwerben

- über

- Action

- Aktionen

- aktiv

- berührt das Schneidwerkzeug

- automatisch

- hinzufügen

- hinzugefügt

- Hinzufügen

- Zusatz

- Zusätzliche

- zusätzlich

- Zugänge

- Fügt

- Adidas

- Adobe

- Die Annahme

- advanced

- Vorrückend

- Vorteil

- Vorteilen

- Marketings

- Beratung

- Nach der

- gegen

- Veranstaltungen

- Makler

- Agenten

- Aggregat

- vor

- AI

- KI & Maschinelles Lernen

- AI Chatbot

- ai Forschung

- AI-powered

- ausrichten

- Alle

- erlauben

- erlaubt

- entlang

- bereits

- ebenfalls

- immer

- Amazon

- Amazon Code Whisperer

- Amazon EC2

- Amazon QuickSight

- Amazon Sage Maker

- Amazon Web Services

- Betrag

- Beträge

- an

- Analyse

- Analytiker

- Business Analysten

- Analytik

- analysieren

- Analysen

- und

- Bekannt geben

- Ankündigungen

- Ankündigung

- beantworten

- Antworten

- Anthropisch

- jedem

- jemand

- etwas

- Bienen

- APIs

- App

- erscheint

- Anwendung

- Anwendungen

- Bewerben

- schätzen

- Ansatz

- genehmigen

- genehmigt

- Apps

- April

- SIND

- Bereich

- Bereiche

- wohl

- um

- AS

- fragen

- Hilfe

- Assistentin

- Assistenten

- damit verbundenen

- Mitarbeiter

- At

- Atlassian

- vermehren

- Augmented

- Augmentationen

- Aurora

- zugelassen

- automatisieren

- Automatisches Erfassen:

- automatische

- Im Prinzip so, wie Sie es von Google Maps kennen.

- Automation

- Automobilindustrie

- Verfügbarkeit

- verfügbar

- durchschnittlich

- vermeiden

- ein Weg

- AWS

- AWS-Inferenz

- AWS Lambda

- AWS-Managementkonsole

- Zurück

- Bankinggg

- Bar

- Barrieren

- Base

- basierend

- basic

- BE

- weil

- wird

- war

- begann

- Glauben

- Vorteile

- BESTE

- Best Practices

- Besser

- zwischen

- Big

- Milliarde

- Milliarden

- Blockieren

- Blockiert

- Blog

- Boeing

- Bolt

- Buchung

- Booking.com

- Bücher

- beide

- Boden

- Grenzen

- Marke

- Break

- geht kaputt

- bringen

- Bringing

- bauen

- Building

- baut

- erbaut

- eingebaut

- Geschäft

- Business Intelligence

- Unternehmen

- aber

- Taste im nun erscheinenden Bestätigungsfenster nun wieder los.

- by

- rufen Sie uns an!

- Call-Center

- CAN

- Kann bekommen

- Fähigkeiten

- capability

- fähig

- Kapazität

- Capturing

- Auto

- Kohlenstoff

- Kohlenstoff-Emissionen

- Karte

- vorsichtig

- Häuser

- Fälle

- Kategorien

- verursacht

- Center

- sicher

- sicherlich

- Kette

- challenges

- Herausforderungen

- Übernehmen

- geändert

- Changer

- Änderungen

- Ändern

- Charakteristik

- Chart

- Charts

- Chatrooms

- Chatbot

- Chatbots

- Chat

- aus der Ferne überprüfen

- Chip

- Pommes frites

- Wahl

- Auswählen

- Auswahl

- gewählt

- aus aller Welt

- Unterricht

- Reinigung

- klar

- klicken Sie auf

- Cloud

- Cloud-Infrastruktur

- Cluster

- Clustering

- Küstenregion

- Code

- Codebasis

- Code-Review

- Programmierung

- Zusammenarbeit

- Zusammenarbeit

- COM

- Kombination

- kombinieren

- kombiniert

- vereint

- wie die

- kommt

- Kommen

- Demnächst verfügbar

- mit uns kommunizieren,

- Kommunikation

- Unternehmen

- Unternehmen

- Unternehmen

- verglichen

- zwingend

- abschließen

- uneingeschränkt

- Komplex

- Komplexität

- umfassend

- Berechnen

- Konzepte

- Konfiguration

- konfigurieren

- Vermutung

- Vernetz Dich

- Sie

- Verbindung

- Konnektivität

- Connects

- konsistent

- Konsul (Console)

- Einschränkungen

- KUNDEN

- Verbrauch

- Kontakt

- Contact Center

- Behälter

- Inhalt

- Kontext

- kontextuelle

- fortsetzen

- weiter

- weiter

- fortgesetzt

- Smartgeräte App

- Steuerung

- Gespräch

- Konversations

- Gespräche

- Urheberrecht

- Copywriting

- Kernbereich

- Kosten

- kostengünstiger

- Kosten

- Ländern

- Steuermann

- erstellen

- erstellt

- Kreativität

- Schöpfer

- Kredit

- Kreditkarte

- Verbrechen

- KNACKIG

- CRM

- Cross-Plattform-

- Kunde

- Customer Experience

- Kundenzufriedenheit

- Kundenservice

- Kunden

- anpassbare

- Anpassung

- anpassen

- maßgeschneiderte

- Schneiden

- Zyklen

- Unterricht

- Armaturenbrett

- Dashboards

- technische Daten

- Datenaufbereitung

- Datenschutz

- Datenschutz und Sicherheit

- Datensätze

- datengesteuerte

- Datenbase

- Datenbanken

- Databricks

- Tag

- Täglich, von Tag zu Tag

- Tage

- Decision Making

- Entscheidungen

- tief

- tiefe Lernen

- tiefer

- Definitionen

- Grad

- verzögern

- Übergeben

- Die Lieferungen

- liefern

- liefert

- Demand

- Demokratisierung

- Abhängig

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- Tiefe

- beschreiben

- beschrieben

- Beschreibung

- entworfen

- erwünscht

- detailliert

- Details

- entdecken

- Bestimmen

- Deutsche Telekom.

- Entwickler:in / Unternehmen

- Entwickler

- Entwicklung

- Entwicklung

- Diagnose

- Dialog

- Dialog

- DID

- anders

- Rundfunk

- digital

- Direkt

- verteilen

- verteilt

- verteiltes Training

- verteilen

- do

- Dokument

- Dokumentation

- Unterlagen

- die

- Tut nicht

- Dabei

- erledigt

- Nicht

- Verdoppelung

- nach unten

- Antrieb

- zwei

- Duplikate

- Dauer

- e

- e-commerce

- jeder

- Früh

- einfacher

- leicht

- Osten

- Ostküste

- Einfache

- Wirtschaftskunde

- Ausgabe

- effektiv

- Effizienz

- effizient

- Anstrengung

- entweder

- sonst

- E-Mails

- Emissionen

- Mitarbeiter

- ermächtigen

- Empowerment

- ermöglichen

- ermöglichen

- Codierung

- Begegnung

- Ende

- End-to-End

- Energie

- Energy Consumption

- Energieeffizienz

- Ingenieur

- Entwicklung

- zu steigern,

- Verbesserungen

- bereichernd

- Unternehmen

- Unternehmensqualität

- Unternehmen

- Unterhaltung

- Ganz

- Umschlag

- Era

- ERP

- Fehler

- Fehler

- Äther (ETH)

- Auswertungen

- Sogar

- Veranstaltungen

- ÜBERHAUPT

- Jedes

- jedermann

- alles

- Evolution

- entwickelt sich

- Beispiel

- Beispiele

- aufgeregt

- unterhaltsame Programmpunkte

- ausführen

- Exekutive

- vorhandenen

- expansiv

- erwarten

- beschleunigen

- teuer

- ERFAHRUNGEN

- erfahrensten

- Erfahrungen

- Experte

- Expertise

- Erklären

- ERKUNDEN

- express

- Stoff

- Gesicht

- Tatsache

- Faktoren

- ziemlich

- treu

- Falke

- Fallen

- vertraut

- Familien

- Familie

- FAST

- beschleunigt

- fehlerhaft

- Merkmal

- Eigenschaften

- Gebühr

- Feedback

- wenige

- Einreichung

- Filter

- Endlich

- Revolution

- Finden Sie

- Suche nach

- findet

- Ende

- Fertig

- Vorname

- Fixieren

- flexibel

- konzentriert

- folgen

- Aussichten für

- Für Verbraucher

- vorwärts

- gefunden

- Foundation

- vier

- Fraktion

- Unser Ansatz

- Gerüste

- Frei

- häufig

- freundlich

- für

- Funktionen

- weiter

- Zukunft

- Spiel

- Game-Changer

- Gaming

- Allgemeines

- allgemein

- erzeugen

- erzeugt

- Erzeugung

- Generation

- generativ

- Generative KI

- Generator

- bekommen

- bekommen

- ABSICHT

- Global

- global digital

- gmail

- Go

- Kundenziele

- gehen

- gut

- GPU

- GPUs

- groß

- Boden

- bahnbrechend

- Gruppe an

- persönlichem Wachstum

- gewachsen

- die Vermittlung von Kompetenzen,

- Guide

- Richtlinien

- hätten

- Hände

- Los

- hart

- Hardware

- schädlich

- hassen

- Hassreden

- Haben

- mit

- Schlagzeilen

- Gesundheitswesen

- schwer

- schweres Heben

- Hilfe

- Unternehmen

- hilft

- hier

- GUTE

- höher

- höchste

- Hervorheben

- hoch

- Verleih

- seine

- Hosting

- STUNDEN

- Ultraschall

- Hilfe

- aber

- HTTPS

- hunderte

- i

- ID

- Identitäten

- Identitätsschutz

- ids

- if

- Image

- Bilderzeugung

- Bilder

- unmittelbar

- Impact der HXNUMXO Observatorien

- implementieren

- Realisierungen

- umgesetzt

- importieren

- wichtig

- beeindruckend

- zu unterstützen,

- verbessert

- Verbesserungen

- in

- das

- Dazu gehören

- Einschließlich

- Erhöhung

- hat

- zunehmend

- Anzeigen

- Einzelpersonen

- Branchen

- Energiegewinnung

- branchenführend

- beeinflusst

- Info

- informieren

- Information

- Infrastruktur

- wir innovieren

- innovativ

- Innovation

- Innovationen

- innovativ

- Varianten des Eingangssignals:

- Eingänge

- Einblick

- Einblicke

- Instanz

- Instanzen

- beantragen müssen

- Institut

- Anleitung

- Versicherung

- Integration

- geistigen

- geistiges Eigentum

- Intelligenz

- beabsichtigt

- interagieren

- Interaktionen

- interagiert

- verbunden

- Schnittstelle

- intern

- eingreifen

- in

- einführen

- eingeführt

- Einführung

- Erfunden

- Inventar

- Investieren

- investigativ

- Investitionen

- Investition

- Investments

- beteiligt

- beinhaltet

- Probleme

- IT

- IT-Profis

- SEINE

- Japanisch

- Jargon

- Javac

- jpg

- nur

- nur einer

- Behalten

- Aufbewahrung

- Wesentliche

- Hauptbereiche

- Schlüsselwörter

- Ausrüstung

- Bausatz (SDK)

- Wissen

- Wissen

- kennt

- Labs

- Mangel

- Sprache

- grosse

- großflächig

- höchste

- Nachname

- Letztes Jahr

- Spät

- Latency

- neueste

- ins Leben gerufen

- Start

- Anwälte

- Schicht

- Lagen

- Leadership

- führenden

- LERNEN

- gelernt

- lernen

- Rechtlich

- weniger

- Lasst uns

- Niveau

- Hebelwirkung

- Hebelwirkungen

- LexisNexis

- LG

- Bibliotheken

- Lebenszyklus

- Facelift

- Gefällt mir

- wahrscheinlich

- Einschränkungen

- Limitiert

- Grenzen

- Linien

- LINK

- Links

- Liste

- leben

- Leben

- Lama

- located

- Standorte

- logisch

- Logo

- Lang

- langjährig

- Los

- ich liebe

- Sneaker

- senken

- niedrigste

- Maschine

- Maschinelles Lernen

- gemacht

- halten

- Aufrechterhaltung

- Wartung

- Dur

- um

- MACHT

- Making

- verwaltet

- Management

- Manager

- manuell

- Handarbeit

- manuell

- viele

- Marketing

- Ihres Materials

- Materialien

- maximal

- Kann..

- me

- sinnvoll

- Mittel

- Medien

- Triff

- Treffen

- Tagungen

- Trifft

- Mitglieder

- bloß

- Meta

- Methode

- Miami

- Microsoft

- Microsoft 365

- Mitte

- könnte

- Meilenstein

- Minuten

- verpassen

- Ziel

- ML

- Modell

- Modellieren

- für

- Modernisierung

- Schwung

- MongoDB

- Monitore

- Monat

- Monat

- mehr

- vor allem warme

- Am beliebtesten

- ziehen um

- MRI

- viel

- mehrere

- Musik

- sollen

- my

- Name

- Nasdaq

- Natürliche

- Natürliche Sprache

- In der Nähe von

- notwendig,

- Need

- erforderlich

- benötigen

- Netto-

- Netzwerk

- Vernetzung

- Neu

- New York

- neu

- weiter

- Nitro

- nicht

- Laptops

- jetzt an

- Anzahl

- Nvidia

- of

- WOW!

- Offensive

- bieten

- bieten

- Angebote

- vorgenommen,

- Telefongebühren sparen

- on

- einmal

- EINEM

- Einsen

- Online

- Online-Banking

- einzige

- XNUMXh geöffnet

- betreiben

- Einkauf & Prozesse

- Optimieren

- optimiert

- Optimierung

- Optionen

- or

- Bestellungen

- Organisation

- Organisationen

- Original

- Andere

- Anders

- UNSERE

- skizzieren

- Möglichkeiten für das Ausgangssignal:

- Ausgänge

- übrig

- zu viel lagern

- überwältigend

- besitzen

- Frieden

- Pakete

- schmerzhaft

- Paare

- Parameter

- Parameter

- Teil

- Teile

- passt

- Muster

- Pause

- Personen

- für

- ausführen

- Leistung

- durchgeführt

- führt

- Erlaubnis

- Berechtigungen

- person

- Personalisierung

- personalisieren

- Persönlich

- PGA Tour

- Sätze

- pii

- Ort

- Plan

- Plato

- Datenintelligenz von Plato

- PlatoData

- erfahren

- Points

- Politik durchzulesen

- Beliebt

- positiv

- möglich

- Post

- Potenzial

- Werkzeuge

- angetriebene

- größte treibende

- Praktisch

- praktisch

- Praktiken

- präzise

- vorhersagen

- Prognosen

- Vorlieben

- Vorbereitung

- Danach

- Gegenwart

- Präsident

- Presse

- Drücken

- Vorspann

- vorher

- Preis

- gebühr

- primär

- Datenschutz

- Datenschutz und Sicherheit

- privat

- private Informationen

- Aufgabenstellung:

- Probleme

- Prozessdefinierung

- anpassen

- Verarbeitung

- produziert

- Produkt

- Produktion

- produktiv

- PRODUKTIVITÄT

- Professionell

- Profis

- Programme

- Projekt

- Eingabeaufforderungen

- Resorts

- Eigentums-

- Schutz

- Sicherheit

- die

- Versorger

- Anbieter

- bietet

- Bereitstellung

- Öffentlichkeit

- öffentlich

- Zwecke

- Push

- Schieben

- setzen

- Putting

- Python

- Pytorch

- Q3

- quantitativ

- Frage

- Fragen

- Direkt

- schnell

- ganz

- F&E

- Angebot

- schnell

- schnell

- Honorar

- RE

- Lesebrillen

- echt

- Echtzeit

- realistisch

- realisieren

- realisiert

- wirklich

- Ernten

- Gründe

- kürzlich

- Software Empfehlungen

- Empfehlungen

- Rekord

- Veteran

- Reduziert

- Reduzierung

- verfeinern

- Region

- freigegeben

- relevant

- Zuverlässigkeit

- bleibt bestehen

- entfernen

- Entfernen

- Behebung

- repetitiv

- Ersatz

- antworten

- berichten

- Quelle

- Anforderung

- Zugriffe

- falls angefordert

- Voraussetzungen:

- Forschungsprojekte

- Reservierung

- RESERVE

- Auflösung

- Resoniert

- Downloads

- Umwelt und Kunden

- Reagieren

- reagiert

- Antwort

- Antworten

- für ihren Verlust verantwortlich.

- eine Beschränkung

- eingeschränkt

- Folge

- Die Ergebnisse

- Rückkehr

- Überprüfen

- Überprüfung

- Recht

- Risiken

- Rollen

- Rollen

- Schlafzimmer

- Routen

- Regel

- Führen Sie

- Laufen

- Landebahn

- opfern

- Safe

- Schutzmaßnahmen

- sicher

- sagemaker

- Vertrieb

- salesforce

- gleich

- Zufriedenheit

- Speichern

- sagen

- Skalieren

- Skalierung

- Szenarien

- Umfang

- Partituren

- kratzen

- Sdk

- nahtlos

- Suche

- Zweite

- Zweite Generation

- Sekunden

- Verbindung

- sicher

- Sicherheitdienst

- sehen

- Sehen

- gesehen

- wählen

- ausgewählt

- Auswahl

- Sendung

- Senior

- Führungsposition

- empfindlich

- September

- Reihenfolge

- Modellreihe

- Server

- ServiceNow

- Lösungen

- kompensieren

- Sets

- mehrere

- Teilen

- von Locals geführtes

- Schiff

- Short

- sollte

- Seite

- signifikant

- Silizium

- Ähnlich

- Einfacher

- vereinfachen

- einfach

- da

- SIX

- Größen

- locker

- klein

- So

- Social Media

- Social Media

- Software

- Softwareentwickler

- Software-Entwicklung

- Software-Entwicklungskit

- Lösung

- Lösungen

- LÖSEN

- einige

- Jemand,

- etwas

- Bald

- anspruchsvoll

- Quelle

- Quellcode

- Quellen

- Südosten

- Raumfahrt

- Spark

- speziell

- Rede

- Geschwindigkeit

- verbringen

- Stabilität

- stabil

- Stapel

- gestapelt

- Stakeholder

- begonnen

- Beginnen Sie

- Startups

- State-of-the-art

- bleiben

- Schritt

- Shritte

- Immer noch

- Lagerung

- speichern

- Läden

- Geschichten

- Sturm

- Geschichte

- rationalisieren

- Stärke

- stringent

- Struktur

- Studie

- Subnetz

- wesentlich

- so

- geeignet

- Suite

- zusammenfassen

- ZUSAMMENFASSUNG

- Super

- ergänzen

- Lieferanten

- liefern

- Angebot und Nachfrage

- Supply Chain

- Support

- Unterstützt

- sicher

- überraschend

- Überwachung

- misstrauisch

- Nachhaltigkeit

- Schalter

- synthetisieren

- System

- Systeme und Techniken

- Tabelle

- zugeschnitten

- Nehmen

- nimmt

- Einnahme

- Reden

- Target

- Aufgabe

- und Aufgaben

- Team

- Teammitglieder

- Teams

- Technische

- Technik

- Techniken

- Technologies

- Technologie

- technologische Innovation

- erzählen

- erzählen

- zehn

- Zehn

- Tensorfluss

- Terminologie

- Test

- Testen

- Tests

- Text

- Texterzeugung

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Zukunft

- die Welt

- ihr

- Sie

- sich

- dann

- Dort.

- Diese

- vom Nutzer definierten

- Ding

- think

- Dritte

- fehlen uns die Worte.

- dieses Jahr

- diejenigen

- Tausende

- nach drei

- Durch

- während

- Durchsatz

- Ticket

- Tickets

- Zeit

- mal

- Titan

- zu

- heute

- heutigen

- gemeinsam

- Zeichen

- auch

- nahm

- Werkzeug

- Werkzeuge

- Top

- Themen

- Tour

- gegenüber

- gegenüber

- verfolgen sind

- Trading

- Training

- trainiert

- Ausbildung

- Transaktionen

- Abschrift

- Transformieren

- Transformation

- Transformationen

- Transformieren

- reisen

- Billionen

- Ausflug

- wirklich

- Vertrauen

- versuchen

- Versuch

- Drehungen

- XNUMX

- tippe

- typisch

- zugrunde liegen,

- verstehen

- verständlich

- Verständnis

- versteht

- nicht vertraut

- einheitlich

- einzigartiges

- Alleinstellungsmerkmale

- Einheit

- nicht wie

- bis

- Aktualisierung

- Updates

- mehr Stunden

- Upgrades

- us

- Anwendungsbereich

- -

- Anwendungsfall

- benutzt

- Mitglied

- Nutzer

- verwendet

- Verwendung von

- wertvoll

- Vielfalt

- verschiedene

- Version

- Gegen

- sehr

- Schraubstock

- Vizepräsident:in

- Video

- praktisch

- Visualisierung

- visualisieren

- visuell

- Volumen

- Verwundbar

- wollen

- Warner

- Warner Musikgruppe

- wurde

- Wave

- Weg..

- Wege

- we

- Netz

- Internetanwendung

- Web-Services

- Webseiten

- Woche

- Wochen

- willkommen

- GUT

- bekannt

- waren

- Was

- Was ist

- wann

- ob

- welche

- während

- WHO

- warum

- breit

- Große Auswahl

- breiter

- werden wir

- Fenster

- mit

- .

- ohne

- Arbeiten

- gearbeitet

- Workflows

- arbeiten,

- Werk

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- Weltklasse

- Sorgen

- wert

- würde

- schreiben

- Code schreiben

- Schreiben

- Jahr

- Jahr

- York

- U

- Ihr

- Zendesk

- Zephyrnet