Dieser Beitrag wurde gemeinsam mit Greg Benson, Chefwissenschaftler, verfasst. Aaron Kesler, leitender Produktmanager; und Rich Dill, Enterprise Solutions Architect von SnapLogic.

Viele Kunden bauen generative KI-Apps auf Amazonas Grundgestein und Amazon Code Whisperer um Code-Artefakte basierend auf natürlicher Sprache zu erstellen. Dieser Anwendungsfall zeigt, wie große Sprachmodelle (LLMs) als Übersetzer zwischen menschlichen Sprachen (Englisch, Spanisch, Arabisch usw.) und maschineninterpretierbaren Sprachen (Python, Java, Scala, SQL usw.) fungieren können interne Argumentation. Diese aufkommende Fähigkeit von LLMs hat Softwareentwickler dazu gezwungen, LLMs als Automatisierungs- und UX-Verbesserungstool zu verwenden, das natürliche Sprache in eine domänenspezifische Sprache (DSL) umwandelt: Systemanweisungen, API-Anfragen, Codeartefakte und mehr. In diesem Beitrag zeigen wir Ihnen wie SnapLogic, ein AWS-Kunde, nutzte Amazon Bedrock zur Stromversorgung SnapGPT Produkt durch automatisierte Erstellung dieser komplexen DSL-Artefakte aus menschlicher Sprache.

Wenn Kunden DSL-Objekte aus LLMs erstellen, ist die resultierende DSL entweder eine exakte Replik oder eine Ableitung vorhandener Schnittstellendaten und -schemas, die den Vertrag zwischen der Benutzeroberfläche und der Geschäftslogik im Hintergrunddienst bilden. Dieses Muster ist besonders bei unabhängigen Softwareanbietern (ISVs) und Software as a Service (SaaS) ISVs im Trend, da diese auf einzigartige Weise Konfigurationen durch Code darstellen und das Benutzererlebnis für ihre Kunden vereinfachen möchten. Beispielhafte Anwendungsfälle sind:

Der einfachste Weg, Text-to-Pipeline-Anwendungen mit LLMs auf AWS zu erstellen und zu skalieren, ist die Verwendung von Amazon Bedrock. Amazon Bedrock ist die einfachste Möglichkeit, generative KI-Anwendungen mit Foundation Models (FMs) zu erstellen und zu skalieren. Es handelt sich um einen vollständig verwalteten Dienst, der über eine einzige API Zugriff auf eine Auswahl leistungsstarker Basis-FMs von führender KI bietet, zusammen mit einem breiten Spektrum an Funktionen, die Sie zum Erstellen generativer KI-Anwendungen mit Datenschutz und Sicherheit benötigen. Anthropic, ein KI-Sicherheits- und Forschungslabor, das zuverlässige, interpretierbare und steuerbare KI-Systeme entwickelt, ist eines der führenden KI-Unternehmen, das auf Amazon Bedrock Zugang zu seinem hochmodernen LLM Claude bietet. Claude ist ein LLM, der sich in einer Vielzahl von Aufgaben auszeichnet, von durchdachten Dialogen über die Erstellung von Inhalten bis hin zu komplexen Überlegungen, Kreativität und Codierung. Anthropic bietet sowohl die Modelle Claude als auch Claude Instant an, die alle über Amazon Bedrock erhältlich sind. Claude hat in diesen Text-to-Pipeline-Anwendungen aufgrund seiner verbesserten Denkfähigkeit schnell an Popularität gewonnen, wodurch es sich bei der Lösung mehrdeutiger technischer Probleme hervortun kann. Claude 2 auf Amazon Bedrock unterstützt ein Kontextfenster mit 100,000 Token, was etwa 200 Seiten englischen Textes entspricht. Dies ist eine besonders wichtige Funktion, auf die Sie sich verlassen können, wenn Sie Text-to-Pipeline-Anwendungen erstellen, die komplexe Überlegungen, detaillierte Anweisungen und umfassende Beispiele erfordern.

SnapLogic-Hintergrund

SnapLogic ist ein AWS-Kunde mit der Mission, der Welt Unternehmensautomatisierung zu ermöglichen. Mit der SnapLogic Intelligent Integration Platform (IIP) können Unternehmen eine unternehmensweite Automatisierung realisieren, indem sie ihr gesamtes Ökosystem aus Anwendungen, Datenbanken, Big Data, Maschinen und Geräten, APIs und mehr mit vorgefertigten, intelligenten Konnektoren namens Snaps verbinden. SnapLogic hat kürzlich eine Funktion namens veröffentlicht SnapGPT, das eine Textschnittstelle bereitstellt, über die Sie die gewünschte Integrationspipeline, die Sie erstellen möchten, in einfacher menschlicher Sprache eingeben können. SnapGPT nutzt das Claude-Modell von Anthropic über Amazon Bedrock, um die Erstellung dieser Integrationspipelines als Code zu automatisieren, der dann über die Flaggschiff-Integrationslösung von SnapLogic verwendet wird. Der Weg von SnapLogic zu SnapGPT war jedoch der Höhepunkt langjähriger Tätigkeit im KI-Bereich.

Die KI-Reise von SnapLogic

Im Bereich der Integrationsplattformen ist SnapLogic seit jeher führend und nutzt die transformative Kraft der künstlichen Intelligenz. Im Laufe der Jahre wurde das Engagement des Unternehmens für Innovationen mit KI deutlich, insbesondere wenn wir den Weg zurückverfolgen Iris zu Autolink.

Die bescheidenen Anfänge mit Iris

Im Jahr 2017 stellte SnapLogic Iris vor, einen branchenweit ersten KI-gestützten Integrationsassistenten. Iris wurde entwickelt, um mithilfe von Algorithmen des maschinellen Lernens (ML) die nächsten Schritte beim Aufbau einer Datenpipeline vorherzusagen. Durch die Analyse von Millionen von Metadatenelementen und Datenflüssen konnte Iris den Benutzern intelligente Vorschläge unterbreiten, die Datenintegration demokratisieren und es auch Personen ohne tiefgreifende technische Kenntnisse ermöglichen, komplexe Arbeitsabläufe zu erstellen.

AutoLink: Dynamik aufbauen

Aufbauend auf dem Erfolg und den Erkenntnissen von Iris führte SnapLogic AutoLink ein, eine Funktion, die den Datenzuordnungsprozess weiter vereinfachen soll. Die mühsame Aufgabe, Felder zwischen Quell- und Zielsystemen manuell zuzuordnen, wurde mit AutoLink zum Kinderspiel. Mithilfe von KI hat AutoLink potenzielle Übereinstimmungen automatisch identifiziert und vorgeschlagen. Integrationen, die früher Stunden dauerten, konnten in nur wenigen Minuten ausgeführt werden.

Der generative Sprung mit SnapGPT

Der neueste Vorstoß von SnapLogic in die KI bringt uns SnapGPT, das darauf abzielt, die Integration noch weiter zu revolutionieren. Mit SnapGPT stellt SnapLogic die weltweit erste generative Integrationslösung vor. Dabei geht es nicht nur darum, bestehende Prozesse zu vereinfachen, sondern die Art und Weise, wie Integrationen gestaltet werden, völlig neu zu überdenken. Die Leistungsfähigkeit der generativen KI kann komplette Integrationspipelines von Grund auf erstellen und den Workflow basierend auf den gewünschten Ergebnissen und Dateneigenschaften optimieren.

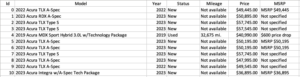

SnapGPT ist für die Kunden von SnapLogic äußerst wirkungsvoll, da sie den Zeitaufwand für die Erstellung ihrer ersten SnapLogic-Pipeline drastisch verkürzen können. Traditionell mussten SnapLogic-Kunden Tage oder Wochen damit verbringen, Integrationspipelines von Grund auf zu konfigurieren. Jetzt können diese Kunden SnapGPT einfach bitten, beispielsweise „eine Pipeline zu erstellen, die alle meine aktiven SFDC-Kunden zu WorkDay verschiebt“. Für diesen Kunden wird automatisch ein funktionierender erster Entwurf einer Pipeline erstellt, wodurch die Entwicklungszeit, die für die Erstellung der Basis seiner Integrationspipeline erforderlich ist, drastisch verkürzt wird. Dadurch kann der Endkunde mehr Zeit damit verbringen, sich auf die tatsächlichen geschäftlichen Auswirkungen zu konzentrieren, anstatt an Konfigurationen einer Integrationspipeline zu arbeiten. Das folgende Beispiel zeigt, wie ein SnapLogic-Kunde eine Beschreibung in die SnapGPT-Funktion eingeben kann, um schnell eine Pipeline in natürlicher Sprache zu generieren.

AWS und SnapLogic haben während der gesamten Produktentwicklung eng zusammengearbeitet und dabei viel gelernt. Der Rest dieses Beitrags konzentriert sich auf die technischen Erkenntnisse, die AWS und SnapLogic im Zusammenhang mit der Verwendung von LLMs für Text-to-Pipeline-Anwendungen gewonnen haben.

Lösungsüberblick

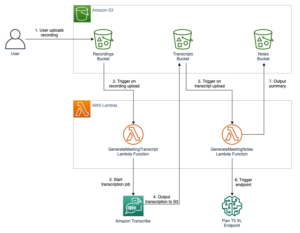

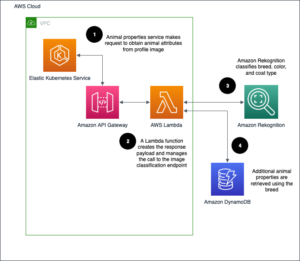

Um dieses Text-to-Pipeline-Problem zu lösen, haben AWS und SnapLogic eine umfassende Lösung entwickelt, die in der folgenden Architektur dargestellt ist.

Eine Anfrage an SnapGPT durchläuft den folgenden Workflow:

- Ein Benutzer übermittelt eine Beschreibung an die Anwendung.

- SnapLogic verwendet einen Retrieval Augmented Generation (RAG)-Ansatz, um relevante Beispiele von SnapLogic-Pipelines abzurufen, die der Anfrage des Benutzers ähneln.

- Diese extrahierten relevanten Beispiele werden mit den Benutzereingaben kombiniert und durchlaufen eine Textvorverarbeitung, bevor sie an Claude auf Amazon Bedrock gesendet werden.

- Claude erstellt ein JSON-Artefakt, das eine SnapLogic-Pipeline darstellt.

- Das JSON-Artefakt ist direkt in die zentrale SnapLogic-Integrationsplattform integriert.

- Die SnapLogic-Pipeline wird dem Benutzer visuell benutzerfreundlich dargestellt.

Durch verschiedene Experimente zwischen AWS und SnapLogic haben wir herausgefunden, dass der schnelle Entwicklungsschritt des Lösungsdiagramms äußerst wichtig für die Generierung hochwertiger Ausgaben für diese Text-zu-Pipeline-Ausgaben ist. Der nächste Abschnitt geht weiter auf einige spezifische Techniken ein, die Claude in diesem Bereich verwendet.

Schnelles Experimentieren

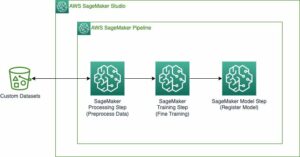

Während der gesamten Entwicklungsphase von SnapGPT stellten AWS und SnapLogic fest, dass die schnelle Iteration der an Claude gesendeten Eingabeaufforderungen eine entscheidende Entwicklungsaufgabe zur Verbesserung der Genauigkeit und Relevanz der Text-zu-Pipeline-Ausgaben in den Ausgaben von SnapLogic war. Durch die Nutzung Amazon SageMaker-Studio Mithilfe interaktiver Notizbücher konnten das Team von AWS und SnapLogic schnell verschiedene Versionen von Eingabeaufforderungen durcharbeiten Boto3 SDK-Verbindung zu Amazon Bedrock. Die Notebook-basierte Entwicklung ermöglichte es den Teams, schnell clientseitige Verbindungen zu Amazon Bedrock herzustellen, textbasierte Beschreibungen neben Python-Code zum Senden von Eingabeaufforderungen an Amazon Bedrock einzubinden und gemeinsame Eingabeaufforderungs-Engineering-Sitzungen abzuhalten, in denen schnell Iterationen zwischen mehreren Personas durchgeführt wurden.

Anthropic Claude fordert technische Methoden

In diesem Abschnitt beschreiben wir einige der iterativen Techniken, die wir verwendet haben, um eine leistungsstarke Eingabeaufforderung basierend auf einer anschaulichen Benutzeranforderung zu erstellen: „Erstellen Sie eine Pipeline, die die BeispielCompany-Datenbank verwendet, die alle aktiven Kunden abruft.“ Beachten Sie, dass es sich bei diesem Beispiel nicht um das Schema handelt, auf dem SnapGPT basiert, sondern nur zur Veranschaulichung einer Text-to-Pipeline-Anwendung dient.

Als Grundlage für unser Prompt-Engineering verwenden wir den folgenden Original-Prompt:

Erstellen Sie eine Pipeline, die die Datenbank „ExampleCompany“ verwendet, die alle aktiven Kunden abruft

Die erwartete Ausgabe ist wie folgt:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Verbesserung Nr. 1: Verwendung der Anmerkungen „Mensch“ und „Assistent“.

Claudes Trainingsverfahren lehrt den FM, den Dialog zwischen einem Menschen und einem Assistenten in seiner unmittelbaren Struktur zu verstehen. Claude-Benutzer können diese Struktur nutzen, indem sie ihre Eingabeaufforderung in Assistant: beenden, was Claude dazu veranlasst, mit der Generierung der Antwort auf eine Anfrage basierend auf dem, was der Mensch gesagt hat, zu beginnen. Beachten Sie, dass Sie bei Verwendung von Claude in der API-Anfrage an Amazon Bedrock die Stoppsequenz „nnHuman:“ verwenden müssen, da Claude so lange Text generiert, bis er zum Stoppen aufgefordert wird. Dadurch wird sichergestellt, dass Sie nur die Antwort des Assistenten erhalten und nicht die vorhergesagte nächste Antwort des Menschen in der Dialogkette. Diese nnHuman- und nnAssistant-Indikatoren tragen nicht nur dazu bei, Claudes Reaktion auf relevante Informationen einzuschränken, sondern tragen auch dazu bei, eine klare Abgrenzung zwischen primären menschlichen Eingaben und Assistentenreaktionen aus anderen Interaktionen zu ermöglichen. Dies ist besonders hilfreich bei einer Eingabeaufforderungseinstellung mit wenigen Schüssen, bei der Sie mehrere Abfragen und Antworten mit Abfragen haben können, die mit „nnHuman“ getaggt sind, und früheren Antworten, die mit „nnAssistant“ getaggt sind. Schauen wir uns die verbesserte Eingabeaufforderung und den damit verbundenen beispielhaften API-Aufruf an Amazon Bedrock über das Boto3 SDK an.

Wir verwenden die folgende Eingabeaufforderung:

Mensch: Erstellen Sie eine Pipeline, die die Datenbank „ExampleCompany“ verwendet, die alle aktiven Kunden abruft

Assistent:

Die Ausgabe ist wie folgt:

Hier ist eine MongoDB-Pipeline zum Abrufen aller aktiven Kunden aus der BeispielCompany-Datenbank:

pipeline = [ { '$match': { 'database': 'ExampleCompany', 'status': 'active' } } ] db.customers.aggregate(pipeline)Die wichtigsten Schritte sind:

– „$match“, um die Dokumente nur nach denen in der BeispielCompany-Datenbank zu filtern, deren Status „aktiv“ ist.

– „db.customers.aggregate()“ führt die Pipeline für die Kundensammlung aus und gibt die gefilterten Ergebnisse zurück.

Dadurch werden alle Kundendokumente aus der BeispielCompany-Datenbank zurückgegeben, bei denen das Statusfeld auf „aktiv“ gesetzt ist.

Beachten Sie, dass Claude in der Ausgabe eine Antwort auf unsere Frage ohne Kontext erfindet. Die Antwort ist möglicherweise hilfreich, bezieht sich jedoch nicht speziell auf das Problem, das wir lösen möchten, da sie nicht mit genügend Kontext versehen ist. Es ist auch wichtig zu beachten, dass Anthropic dieses Menschen- und Assistentenformat benötigt, wenn die Claude-Modelle verwendet werden; Wenn Sie diesen Schritt nicht einschließen, gibt Amazon Bedrock einen Fehler zurück.

Verbesserung Nr. 2: Fügen Sie hyperspezifischen Kontext für Claude hinzu, bevor ihm gesagt wird, was er tun soll

Claude erzielt die beste Leistung, wenn ihm ein guter Kontext darüber gegeben wird, was er erreichen muss und wie er diese Aufgabe erfüllen soll. Hier sind einige Beispiele für Dinge, die Sie als Kontext für Claude angeben sollten, bevor Sie ihm die Aufgabe erteilen:

- Beschreiben Sie die berufliche Funktion, die Claude erfüllen soll. Indem Sie dies tun, bringen Sie Claude dazu, in die Rolle von jemandem zu denken, der in diesem Job arbeitet, oder vielmehr in die Rolle von jemandem, der gerade für diese bestimmte Jobrolle eingestellt wird. Dies wird Claude dabei helfen, die Antwort aus der Perspektive dieser spezifischen Arbeitsrolle zu formulieren, wodurch Halluzinationen und Zufälligkeiten in der Antwort reduziert werden.

- Geben Sie technische Details zum Ausgabeformat an. Foundation-Modelle sind im Allgemeinen gut darin, Aktionen zu verfolgen. Wenn Sie Claude also bitten, die Ausgabe in einem bestimmten Format oder Schema mit einem oder mehreren Beispielen zu generieren, kann Claude die Antwort im richtigen Format liefern und den Bedarf an Filterung und Nachbearbeitung der Ausgabe reduzieren. Das Beispiel in der folgenden Eingabeaufforderung zeigt ein fiktives Schema, das der erwarteten Ausgabe entspricht.

Kombinieren wir diese Vorschläge, um unsere ursprüngliche Aufforderung zu verbessern:

Mensch: Ihre Aufgabe ist es, als Experte für ETL-Pipelines zu fungieren. Ihre Aufgabe besteht insbesondere darin, eine JSON-Darstellung einer ETL-Pipeline zu erstellen, die die an Sie gestellte Benutzeranfrage löst.

Die JSON-Ausgabe sollte dem folgenden Format folgen:

Hier ist Ihre Aufgabe: Erstellen Sie eine Pipeline, die die Datenbank „ExampleCompany“ verwendet, die alle aktiven Kunden abruft

Assistent:

Die Ausgabe ist wie folgt:

Hier ist eine JSON-Darstellung einer ETL-Pipeline zum Abrufen aller aktiven Kunden aus der BeispielCompany-Datenbank:

Diese Pipeline verwendet die Datenbank „ExampleCompany“ und eine SQL-Abfrage, um alle Datensätze aus der Kundentabelle auszuwählen, deren Status „aktiv“ ist.

Durch das Hinzufügen von Kontext ist das Modell nun in der Lage, den größten Teil unserer Antwort zu finden. Es weiß nun, wie die Ausgabe zu strukturieren ist und versteht, dass es zur Lösung der Aufgabe eine SQL-Anweisung schreiben muss. Sie werden jedoch feststellen, dass das Modell die von uns erwartete Nomenklatur „ec_prod.customers“ nicht korrekt verwendet. Raum für Verbesserung! Beachten Sie außerdem, dass Sie in der Praxis deutlich mehr Kontext einbeziehen müssen, als wir in diesem Beispiel bereitgestellt haben, um in Text-to-Pipeline-Anwendungsfällen qualitativ hochwertige Ergebnisse zu erzielen.

Verbesserung Nr. 3: Beispiele in XML-Tags einschließen

Few-Shot-Learning ist eine beliebte Methode, um die Genauigkeit von FMs zu erhöhen, wenn relevante Beispiele vorhanden sind, die den FM bei seiner Aufgabe unterstützen. Dies ist besonders wichtig, wenn Sie in Text-zu-Pipeline-Anwendungen arbeiten, da diese hyperspezifischen Pipeline-Ausgaben normalerweise nicht in einem öffentlichen Datensatz enthalten sind, da sie spezifisch für die Datendarstellung eines einzelnen Kunden sind. Wenn Sie Claude verwenden, können Sie dessen angeborene Kenntnis beliebiger XML-Tags nutzen, um diese Beispiele in einem Few-Shot-Format bereitzustellen. Beachten Sie in der folgenden verbesserten Eingabeaufforderung die Hinzufügung von Beispielen in XML-Tags. Außerdem können Sie mit H und A Abkürzungen für „Mensch“ und „Assistent“ verwenden, um Claude einen Kontext zu geben, ohne den Eindruck zu erwecken, dass es sich dabei um bestimmte Teile des Dialogs handelte, die bereits stattgefunden haben.

Wir verwenden die folgende Eingabeaufforderung:

Mensch: Ihre Aufgabe ist es, als Experte für ETL-Pipelines zu fungieren. Ihre Aufgabe besteht insbesondere darin, eine JSON-Darstellung einer ETL-Pipeline zu erstellen, die die an Sie gestellte Benutzeranfrage löst.

Die JSON-Ausgabe sollte dem folgenden Format folgen:

Hier sind einige Beispiele für Benutzeranfragen und zugehörige JSON-Ausgabeartefakte, die die bereitgestellte Aufgabe korrekt lösen. Stellen Sie sicher, dass Sie dieselbe Nomenklatur verwenden, die in den Beispielen angegeben ist, wenn Sie dieselben Datenbanken verwenden.

H: Fragen Sie die Datenbank „ExampleCompany“ nach aktiven Bestellungen für den Kunden Nr. 1234 ab

A:

Der Grund für diese Abfrage ist, dass der Kunde Nr. 1234 gefiltert wird und wir die Tabelle „Bestellungen“ nach vorhandenen Datensätzen nach dem Filter „aktiv“ durchsuchen.

H: Alle Kunden aus der BeispielCompany-Datenbank entfernen, die im letzten Monat nicht aktiv waren

A:

Der Grund für diese Abfrage ist, dass die Tabelle „ec_prod.customers“ die einzige Tabelle in der Datenbank „ExampleCompany“ ist, die Kundendatensätze enthält.

Hier ist Ihre Aufgabe: Erstellen Sie eine Pipeline, die die Datenbank „ExampleCompany“ verwendet, die alle aktiven Kunden abruft.

Assistent:

Die Ausgabe ist wie folgt:

Hier ist die JSON-Darstellung für eine ETL-Pipeline zum Abrufen aller aktiven Kunden aus der BeispielCompany-Datenbank:

Die Begründung lautet:

Als zu verwendende Datenbank wird die Datenbank „ExampleCompany“ angegeben

Die Tabelle ec_prod.customers enthält die Kundendaten

Das Statusfeld zeigt an, ob ein Kunde aktiv ist, sodass die Abfrage nur nach aktiven Kunden filtert

Dadurch sollten alle aktiven Kundendatensätze aus der BeispielCompany-Datenbank abgerufen werden. Lassen Sie mich wissen, wenn Sie Klarstellungen benötigen oder zusätzliche Anforderungen an die ETL-Pipeline haben!

Die JSON-Ausgabe verfügt nun über die korrekte Datenbanknomenklatur, die Claude aufgrund der von uns bereitgestellten Beispiele verwenden konnte. Durch die Kopplung von menschlichen und Assistentenindikatoren mit XML-Tags kann Claude leichter verstehen, was die Aufgabe und was die Antwort in ähnlichen Beispielen war, mit einer sehr klaren Trennung zwischen mehreren Beispielen mit wenigen Schüssen. Je einfacher es für Claude ist, sie zu verstehen, desto besser und relevanter wird die Antwort sein, wodurch die Wahrscheinlichkeit, dass das Modell halluziniert und zufällige irrelevante Antworten liefert, weiter verringert wird.

Verbesserung Nr. 4: Claude dazu veranlassen, mit der JSON-Generierung mit XML-Tags zu beginnen

Eine kleine Herausforderung bei Text-to-Pipeline-Anwendungen mit FMs besteht darin, dass eine Ausgabe des resultierenden Textes genau analysiert werden muss, damit sie in einer nachgelagerten Anwendung als Code interpretiert werden kann. Eine Möglichkeit, dieses Problem mit Claude zu lösen, besteht darin, das XML-Tag-Verständnis zu nutzen und dies mit einer benutzerdefinierten Stoppsequenz zu kombinieren. In der folgenden Eingabeaufforderung haben wir Claude angewiesen, die Ausgabe einzuschließen XML-Tags. Dann haben wir das hinzugefügt -Tag am Ende der Eingabeaufforderung hinzufügen. Dadurch wird sichergestellt, dass der erste Text, der aus Claude kommt, der Anfang der JSON-Ausgabe ist. Wenn Sie dies nicht tun, antwortet Claude oft mit einem Konversationstext und dann mit der echten Code-Antwort. Indem Sie Claude anweisen, sofort mit der Generierung der Ausgabe zu beginnen, können Sie die Generierung einfach stoppen, wenn Sie den Abschluss sehen Etikett. Dies wird im aktualisierten Boto3-API-Aufruf gezeigt. Die Vorteile dieser Technik sind zweifach. Zunächst können Sie die Codeantwort von Claude genau analysieren. Zweitens können Sie die Kosten senken, da Claude nur Codeausgaben und keinen zusätzlichen Text generiert. Dies reduziert die Kosten bei Amazon Bedrock, da Ihnen jeder Token in Rechnung gestellt wird, der als Ausgabe von allen FMs produziert wird.

Wir verwenden die folgende Eingabeaufforderung:

Mensch: Ihre Aufgabe ist es, als Experte für ETL-Pipelines zu fungieren. Ihre Aufgabe besteht insbesondere darin, eine JSON-Darstellung einer ETL-Pipeline zu erstellen, die die an Sie gestellte Benutzeranfrage löst.

Die JSON-Ausgabe sollte dem folgenden Format folgen:

Hier sind einige Beispiele für Benutzeranfragen und zugehörige JSON-Ausgabeartefakte, die die bereitgestellte Aufgabe korrekt lösen. Stellen Sie sicher, dass Sie dieselbe Nomenklatur verwenden, die in den Beispielen angegeben ist, wenn Sie dieselben Datenbanken verwenden.

H: Fragen Sie die Datenbank „ExampleCompany“ nach aktiven Bestellungen für den Kunden Nr. 1234 ab

A:

Der Grund für diese Abfrage ist, dass der Kunde Nr. 1234 gefiltert wird und wir die Tabelle „Bestellungen“ nach vorhandenen Datensätzen nach dem Filter „aktiv“ durchsuchen.

H: Alle Kunden aus der BeispielCompany-Datenbank entfernen, die im letzten Monat nicht aktiv waren

A:

Der Grund für diese Abfrage ist, dass die Tabelle „ec_prod.customers“ die einzige Tabelle in der Datenbank „ExampleCompany“ ist, die Kundendatensätze enthält.

Denken Sie immer daran, Ihre JSON-Ausgaben einzuschließen Stichworte.

Hier ist Ihre Aufgabe: Erstellen Sie eine Pipeline, die die Datenbank „ExampleCompany“ verwendet, die alle aktiven Kunden abruft.

Assistent:

Wir verwenden den folgenden Code:

body = json.dumps({"prompt": prompt, "stop_sequences": ['nnHuman:', '</json>']})

response = bedrock.invoke_model(

body=body,

modelId='anthropic.claude-v2'

)Die Ausgabe ist wie folgt:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Jetzt sind wir bei der erwarteten Ausgabe angekommen, bei der nur das JSON-Objekt zurückgegeben wird! Durch den Einsatz dieser Methode sind wir in der Lage, ein sofort nutzbares technisches Artefakt zu generieren und gleichzeitig die Kosten der Generierung durch die Reduzierung der Ausgabe-Tokens zu senken.

Zusammenfassung

Um noch heute mit SnapGPT zu beginnen, fordern Sie eine an kostenlose Testversion von SnapLogic or Fordern Sie eine Demo des Produkts an. Wenn Sie diese Konzepte heute für die Erstellung von Anwendungen nutzen möchten, empfehlen wir Ihnen praxisnah experimentieren Verwenden Sie im Abschnitt „Prompt Engineering“ in diesem Beitrag den gleichen Ablauf für einen anderen Anwendungsfall der DSL-Generierung, der zu Ihrem Unternehmen passt, und tauchen Sie tiefer in die Materie ein RAG-Funktionen, die über Amazon Bedrock verfügbar sind.

SnapLogic und AWS konnten erfolgreich zusammenarbeiten, um einen fortschrittlichen Übersetzer zwischen menschlicher Sprache und dem komplexen Schema der SnapLogic-Integrationspipelines auf Basis von Amazon Bedrock zu entwickeln. Während dieser Reise haben wir gesehen, wie die mit Claude generierte Ausgabe in Text-to-Pipeline-Anwendungen mithilfe spezifischer Prompt-Engineering-Techniken verbessert werden kann. AWS und SnapLogic freuen sich, diese Partnerschaft im Bereich generative KI fortzusetzen und freuen sich auf die zukünftige Zusammenarbeit und Innovation in diesem schnelllebigen Bereich.

Über die Autoren

Gregor Benson ist Professor für Informatik an der University of San Francisco und Chefwissenschaftler bei SnapLogic. Er trat 1998 der USF-Abteilung für Informatik bei und unterrichtete Bachelor- und Masterkurse zu den Themen Betriebssysteme, Computerarchitektur, Programmiersprachen, verteilte Systeme und Einführung in die Programmierung. Greg hat Forschungsergebnisse in den Bereichen Betriebssysteme, paralleles Rechnen und verteilte Systeme veröffentlicht. Seit er 2010 zu SnapLogic kam, hat Greg beim Entwurf und der Implementierung mehrerer wichtiger Plattformfunktionen mitgeholfen, darunter Clusterverarbeitung, Big-Data-Verarbeitung, Cloud-Architektur und maschinelles Lernen. Derzeit arbeitet er an generativer KI für die Datenintegration.

Gregor Benson ist Professor für Informatik an der University of San Francisco und Chefwissenschaftler bei SnapLogic. Er trat 1998 der USF-Abteilung für Informatik bei und unterrichtete Bachelor- und Masterkurse zu den Themen Betriebssysteme, Computerarchitektur, Programmiersprachen, verteilte Systeme und Einführung in die Programmierung. Greg hat Forschungsergebnisse in den Bereichen Betriebssysteme, paralleles Rechnen und verteilte Systeme veröffentlicht. Seit er 2010 zu SnapLogic kam, hat Greg beim Entwurf und der Implementierung mehrerer wichtiger Plattformfunktionen mitgeholfen, darunter Clusterverarbeitung, Big-Data-Verarbeitung, Cloud-Architektur und maschinelles Lernen. Derzeit arbeitet er an generativer KI für die Datenintegration.

Aaron Kesler Als Senior Product Manager für KI-Produkte und -Dienste bei SnapLogic nutzt Aaron über zehn Jahre Erfahrung im Produktmanagement, um die Entwicklung von KI-/ML-Produkten voranzutreiben und Dienste im gesamten Unternehmen zu verbreiten. Er ist der Autor des kommenden Buches „What's Your Problem?“ zielt darauf ab, neue Produktmanager durch die Karriere im Produktmanagement zu begleiten. Seine unternehmerische Reise begann mit seinem College-Startup STAK, das später von Carvertise übernommen wurde, wobei Aaron maßgeblich zu seiner Anerkennung als Tech-Startup des Jahres 2015 in Delaware beitrug. Über seine beruflichen Aktivitäten hinaus findet Aaron Freude daran, mit seinem Vater Golf zu spielen, auf seinen Reisen neue Kulturen und Speisen zu entdecken und Ukulele zu üben.

Aaron Kesler Als Senior Product Manager für KI-Produkte und -Dienste bei SnapLogic nutzt Aaron über zehn Jahre Erfahrung im Produktmanagement, um die Entwicklung von KI-/ML-Produkten voranzutreiben und Dienste im gesamten Unternehmen zu verbreiten. Er ist der Autor des kommenden Buches „What's Your Problem?“ zielt darauf ab, neue Produktmanager durch die Karriere im Produktmanagement zu begleiten. Seine unternehmerische Reise begann mit seinem College-Startup STAK, das später von Carvertise übernommen wurde, wobei Aaron maßgeblich zu seiner Anerkennung als Tech-Startup des Jahres 2015 in Delaware beitrug. Über seine beruflichen Aktivitäten hinaus findet Aaron Freude daran, mit seinem Vater Golf zu spielen, auf seinen Reisen neue Kulturen und Speisen zu entdecken und Ukulele zu üben.

Rich Dill ist ein Principal Solutions Architect mit Erfahrung in vielen Spezialgebieten. Eine Erfolgsgeschichte mit plattformübergreifender Unternehmenssoftware und SaaS. Bekannt dafür, Kundeninteressen (die als Stimme des Kunden fungieren) in umsatzgenerierende neue Funktionen und Produkte umzuwandeln. Nachgewiesene Fähigkeit, innovative Produkte auf den Markt zu bringen und Projekte in schnelllebigen Onshore- und Offshore-Umgebungen termingerecht und unter Budget zum Abschluss zu bringen. Eine einfache Art, mich zu beschreiben: der Geist eines Wissenschaftlers, das Herz eines Entdeckers und die Seele eines Künstlers.

Rich Dill ist ein Principal Solutions Architect mit Erfahrung in vielen Spezialgebieten. Eine Erfolgsgeschichte mit plattformübergreifender Unternehmenssoftware und SaaS. Bekannt dafür, Kundeninteressen (die als Stimme des Kunden fungieren) in umsatzgenerierende neue Funktionen und Produkte umzuwandeln. Nachgewiesene Fähigkeit, innovative Produkte auf den Markt zu bringen und Projekte in schnelllebigen Onshore- und Offshore-Umgebungen termingerecht und unter Budget zum Abschluss zu bringen. Eine einfache Art, mich zu beschreiben: der Geist eines Wissenschaftlers, das Herz eines Entdeckers und die Seele eines Künstlers.

Lehm Elmore ist ein AI/ML Specialist Solutions Architect bei AWS. Nachdem er viele Stunden in einem Materialforschungslabor verbracht hatte, ließ er seinen Hintergrund im Chemieingenieurwesen schnell hinter sich und widmete sich seinem Interesse am maschinellen Lernen. Er hat an ML-Anwendungen in vielen verschiedenen Branchen gearbeitet, vom Energiehandel bis zum Marketing im Gastgewerbe. Clays aktuelle Arbeit bei AWS konzentriert sich darauf, Kunden dabei zu helfen, Softwareentwicklungspraktiken auf ML- und generative KI-Workloads zu übertragen, damit Kunden wiederholbare, skalierbare Lösungen in diesen komplexen Umgebungen erstellen können. In seiner Freizeit fährt Clay gerne Ski, löst Zauberwürfel, liest und kocht.

Lehm Elmore ist ein AI/ML Specialist Solutions Architect bei AWS. Nachdem er viele Stunden in einem Materialforschungslabor verbracht hatte, ließ er seinen Hintergrund im Chemieingenieurwesen schnell hinter sich und widmete sich seinem Interesse am maschinellen Lernen. Er hat an ML-Anwendungen in vielen verschiedenen Branchen gearbeitet, vom Energiehandel bis zum Marketing im Gastgewerbe. Clays aktuelle Arbeit bei AWS konzentriert sich darauf, Kunden dabei zu helfen, Softwareentwicklungspraktiken auf ML- und generative KI-Workloads zu übertragen, damit Kunden wiederholbare, skalierbare Lösungen in diesen komplexen Umgebungen erstellen können. In seiner Freizeit fährt Clay gerne Ski, löst Zauberwürfel, liest und kocht.

Sina Sojoodi ist Technologiemanager, Systemingenieur, Produktleiter, ehemaliger Gründer und Startup-Berater. Er kam im März 2021 als Principal Solutions Architect zu AWS. Sina ist derzeit der leitende Lösungsarchitekt für den ISV-Bereich USA-West. Er arbeitet mit SaaS- und B2B-Softwareunternehmen zusammen, um ihre Geschäfte auf AWS aufzubauen und auszubauen. Vor seiner Tätigkeit bei Amazon war Sina Technologiemanager bei VMware und Pivotal Software (Börsengang 2018, VMware M&A 2020) und hatte mehrere Führungspositionen inne, unter anderem als Gründungsingenieur bei Xtreme Labs (Pivotal-Übernahme 2013). Sina hat die letzten 15 Jahre seiner Berufserfahrung dem Aufbau von Softwareplattformen und -praktiken für Unternehmen, Softwareunternehmen und den öffentlichen Sektor gewidmet. Er ist ein Branchenführer mit einer Leidenschaft für Innovation. Sina hat einen BA von der University of Waterloo, wo er Elektrotechnik und Psychologie studierte.

Sina Sojoodi ist Technologiemanager, Systemingenieur, Produktleiter, ehemaliger Gründer und Startup-Berater. Er kam im März 2021 als Principal Solutions Architect zu AWS. Sina ist derzeit der leitende Lösungsarchitekt für den ISV-Bereich USA-West. Er arbeitet mit SaaS- und B2B-Softwareunternehmen zusammen, um ihre Geschäfte auf AWS aufzubauen und auszubauen. Vor seiner Tätigkeit bei Amazon war Sina Technologiemanager bei VMware und Pivotal Software (Börsengang 2018, VMware M&A 2020) und hatte mehrere Führungspositionen inne, unter anderem als Gründungsingenieur bei Xtreme Labs (Pivotal-Übernahme 2013). Sina hat die letzten 15 Jahre seiner Berufserfahrung dem Aufbau von Softwareplattformen und -praktiken für Unternehmen, Softwareunternehmen und den öffentlichen Sektor gewidmet. Er ist ein Branchenführer mit einer Leidenschaft für Innovation. Sina hat einen BA von der University of Waterloo, wo er Elektrotechnik und Psychologie studierte.

Sandeep Rohilla ist Senior Solutions Architect bei AWS und unterstützt ISV-Kunden in der Region USA West. Er konzentriert sich darauf, Kunden bei der Entwicklung von Lösungen zu unterstützen, die Container und generative KI in der AWS-Cloud nutzen. Sandeeps Leidenschaft liegt darin, die geschäftlichen Probleme der Kunden zu verstehen und ihnen dabei zu helfen, ihre Ziele mithilfe von Technologie zu erreichen. Er kam zu AWS, nachdem er mehr als ein Jahrzehnt als Lösungsarchitekt gearbeitet hatte und seine 17-jährige Erfahrung einbrachte. Sandeep hat einen MSc. in Software Engineering von der University of the West of England in Bristol, Großbritannien.

Sandeep Rohilla ist Senior Solutions Architect bei AWS und unterstützt ISV-Kunden in der Region USA West. Er konzentriert sich darauf, Kunden bei der Entwicklung von Lösungen zu unterstützen, die Container und generative KI in der AWS-Cloud nutzen. Sandeeps Leidenschaft liegt darin, die geschäftlichen Probleme der Kunden zu verstehen und ihnen dabei zu helfen, ihre Ziele mithilfe von Technologie zu erreichen. Er kam zu AWS, nachdem er mehr als ein Jahrzehnt als Lösungsarchitekt gearbeitet hatte und seine 17-jährige Erfahrung einbrachte. Sandeep hat einen MSc. in Software Engineering von der University of the West of England in Bristol, Großbritannien.

Dr. Farooq Sabir ist ein leitender Lösungsarchitekt für künstliche Intelligenz und maschinelles Lernen bei AWS. Er hat einen PhD- und MS-Abschluss in Elektrotechnik von der University of Texas at Austin und einen MS in Informatik vom Georgia Institute of Technology. Er hat über 15 Jahre Berufserfahrung und unterrichtet und betreut auch gerne College-Studenten. Bei AWS hilft er Kunden bei der Formulierung und Lösung ihrer Geschäftsprobleme in den Bereichen Datenwissenschaft, maschinelles Lernen, Computer Vision, künstliche Intelligenz, numerische Optimierung und verwandte Bereiche. Er lebt in Dallas, Texas, und seine Familie liebt es zu reisen und lange Autofahrten zu unternehmen.

Dr. Farooq Sabir ist ein leitender Lösungsarchitekt für künstliche Intelligenz und maschinelles Lernen bei AWS. Er hat einen PhD- und MS-Abschluss in Elektrotechnik von der University of Texas at Austin und einen MS in Informatik vom Georgia Institute of Technology. Er hat über 15 Jahre Berufserfahrung und unterrichtet und betreut auch gerne College-Studenten. Bei AWS hilft er Kunden bei der Formulierung und Lösung ihrer Geschäftsprobleme in den Bereichen Datenwissenschaft, maschinelles Lernen, Computer Vision, künstliche Intelligenz, numerische Optimierung und verwandte Bereiche. Er lebt in Dallas, Texas, und seine Familie liebt es zu reisen und lange Autofahrten zu unternehmen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/how-snaplogic-built-a-text-to-pipeline-application-with-amazon-bedrock-to-translate-business-intent-into-action/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 10

- 100

- 121

- 14

- 15 Jahre

- 15%

- 150

- 17

- 1998

- 200

- 2010

- 2013

- 2015

- 2017

- 2018

- 2020

- 2021

- 31

- 33

- 7

- 8

- 9

- a

- Heinz

- Fähigkeit

- Fähig

- Über Uns

- Zugang

- erreichen

- Genauigkeit

- Erreichen

- erworben

- Erwerb

- über

- Handlung

- Action

- Aktionen

- aktiv

- hinzugefügt

- Zusatz

- Zusätzliche

- advanced

- Vorteil

- Berater

- Advocacy

- Nach der

- AI

- KI-Systeme

- AI-powered

- AI / ML

- gezielt

- Ziel

- Algorithmen

- Alle

- erlaubt

- Zulassen

- erlaubt

- entlang

- neben

- bereits

- ebenfalls

- Amazon

- Amazon Web Services

- Betrag

- an

- Analyse

- und

- beantworten

- Antworten

- Anthropisch

- jedem

- Bienen

- APIs

- Anwendung

- Anwendungen

- gilt

- Ansatz

- Apps

- arabisch

- Architektur

- SIND

- Bereich

- Bereiche

- um

- angekommen

- Kunst

- künstlich

- künstliche Intelligenz

- Künstliche Intelligenz und maschinelles Lernen

- Künstler

- AS

- fragen

- fragen

- Assistentin

- damit verbundenen

- At

- Augmented

- Austin

- Autor

- automatisieren

- Automatisiert

- Im Prinzip so, wie Sie es von Google Maps kennen.

- Automation

- verfügbar

- AWS

- AWS-Kunde

- B2B

- Hintergrund

- Unterstützung

- Base

- basierend

- Baseline

- BE

- Denken Sie

- wurde

- weil

- werden

- war

- Bevor

- begann

- beginnen

- hinter

- Sein

- Vorteile

- BESTE

- Besser

- zwischen

- Beyond

- Big

- Big Data

- buchen

- beide

- bringen

- Bringing

- Brings

- Bristol

- breit

- allgemein

- Haushalt

- bauen

- Building

- baut

- erbaut

- Geschäft

- Auswirkungen auf das Geschäft

- Unternehmen

- aber

- by

- rufen Sie uns an!

- namens

- CAN

- Fähigkeiten

- Karriere

- Häuser

- Fälle

- Centers

- Kette

- challenges

- Chance

- Charakteristik

- berechnet

- chemisch

- Chef

- Wahl

- klar

- eng

- Schließen

- Cloud

- Cluster

- Code

- Programmierung

- arbeitete zusammen

- Zusammenarbeit

- Sammlung

- Hochschule

- kombinieren

- kombiniert

- kommt

- Engagement

- Unternehmen

- Unternehmen

- gezwungen

- Abschluss

- Komplex

- umfassend

- Computer

- Computerwissenschaften

- Computer Vision

- Computing

- Konzepte

- konfigurieren

- Sich zusammenschliessen

- Verbindung

- Verbindungen

- konsequent

- Behälter

- enthält

- Inhalt

- Inhaltserstellung

- Kontext

- fortsetzen

- Vertrag

- Beitrag

- Konversations

- Kochen

- Kernbereich

- und beseitigen Muskelschwäche

- korrekt

- Kosten

- könnte

- Kurse

- erstellen

- erstellt

- Schaffung

- Kreativität

- kritischem

- Strom

- Zur Zeit

- Original

- Kunde

- Kunden

- Schneiden

- innovativ, auf dem neuesten Stand

- Dallas

- technische Daten

- Datenintegration

- Datenverarbeitung

- Datenwissenschaft

- Datenbase

- Datenbanken

- Tage

- Jahrzehnte

- verringern

- gewidmet

- tief

- tiefer

- Delaware

- Demo

- Demokratisierung

- Abteilung

- Derivat

- beschreiben

- Beschreibung

- Design

- entworfen

- Verlangen

- erwünscht

- detailliert

- Details

- Entwickler

- Entwicklung

- Geräte

- Dialog

- anders

- Direkt

- verteilt

- verteilte Systeme

- Tauchen

- do

- Unterlagen

- Tut nicht

- Dabei

- Domains

- Nicht

- nach unten

- Lüftung

- drastisch

- Antrieb

- zwei

- jeder

- einfacher

- einfachste

- leicht

- Ökosystem

- effektiv

- entweder

- Elektrotechnik

- Elemente

- ermöglicht

- Ende

- Ende

- Energie

- Ingenieur

- Entwicklung

- England

- Englisch

- Erweiterung

- genug

- gewährleisten

- sorgt

- Enter

- Unternehmen

- Unternehmenssoftware

- Enterprise-Lösungen

- Unternehmen

- Ganz

- vollständig

- unternehmerisch

- Umgebungen

- gleich

- Äquivalent

- Fehler

- insbesondere

- Äther (ETH)

- Sogar

- offensichtlich

- genau

- Beispiel

- Beispiele

- Excel

- aufgeregt

- Exekutive

- vorhandenen

- erwartet

- erwartet

- ERFAHRUNGEN

- Experte

- Expertise

- Forscher

- Möglichkeiten sondieren

- extra

- äußerst

- Familie

- Schnell - bewegend

- schnelllebig

- Merkmal

- Eigenschaften

- wenige

- Feld

- Felder

- Filter

- Filterung

- Filter

- findet

- Vorname

- Flaggschiff

- Fluss

- Fließt

- Setzen Sie mit Achtsamkeit

- konzentriert

- Fokussierung

- folgen

- Folgende

- folgt

- Lebensmittel

- Aussichten für

- Beutezug

- Vordergrund

- Format

- Formen

- vorwärts

- gefunden

- Foundation

- Gründung

- Francisco cisco~~POS=HEADCOMP

- freundlich

- für

- Erfüllen

- voll

- Funktion

- weiter

- Zukunft

- gewonnen

- allgemein

- erzeugen

- erzeugt

- erzeugt

- Erzeugung

- Generation

- generativ

- Generative KI

- Georgien

- Georgia Institute of Technology

- bekommen

- gif

- gegeben

- Go

- Ziele

- Goes

- gut

- Abschluss

- Wachsen Sie über sich hinaus

- Guide

- hätten

- Pflege

- Nutzen

- Haben

- he

- Herz

- Hilfe

- dazu beigetragen,

- hilfreich

- Unternehmen

- hilft

- hier

- leistungsstark

- hochwertige

- Highlights

- seine

- hält

- Gastgewerbe

- STUNDEN

- Ultraschall

- Hilfe

- aber

- HTML

- HTTPS

- human

- demütig

- identifiziert

- if

- veranschaulichen

- sofort

- Impact der HXNUMXO Observatorien

- schlagkräftig

- implementieren

- wichtig

- zu unterstützen,

- verbessert

- Verbesserung

- in

- das

- inklusive

- Einschließlich

- Erhöhung

- unabhängig

- zeigt

- Anzeigen

- Krankengymnastik

- Branchen

- Energiegewinnung

- Branchenführer

- Information

- angeboren

- innovativ

- Innovation

- Varianten des Eingangssignals:

- Eingänge

- sofortig

- beantragen müssen

- Institut

- Anleitung

- integriert

- Integration

- Integrationen

- Intelligenz

- Intelligent

- Absicht

- Interaktionen

- interaktive

- Interesse

- Schnittstelle

- intern

- in

- eingeführt

- Stellt vor

- einleitend

- IPO

- Isv

- IT

- Iteration

- Iterationen

- SEINE

- Javac

- Job

- beigetreten

- Beitritt

- dank

- Reise

- Freude

- jpg

- JSON

- nur

- Wesentliche

- Wissen

- Wissen

- bekannt

- kennt

- Labor

- Labs

- Sprache

- Sprachen

- grosse

- Nachname

- später

- neueste

- führen

- Führer

- Leadership

- führenden

- Springen

- gelernt

- lernen

- links

- lassen

- Nutzung

- Gefällt mir

- Gleichen

- Logik

- Lang

- aussehen

- Los

- ich liebe

- M & A

- Maschine

- Maschinelles Lernen

- Maschinen

- gemacht

- um

- MACHT

- Making

- verwaltet

- Management

- Manager

- Manager

- Weise

- manuell

- viele

- Mapping

- März

- Markt

- Marketing

- Streichhölzer

- Materialien

- me

- Mentor

- bloß

- Metadaten

- Methode

- Millionen

- Geist / Bewusstsein

- Minuten

- Ziel

- ML

- Modell

- für

- MongoDB

- mehr

- vor allem warme

- schlauer bewegen

- MS

- Multi-Plattform

- mehrere

- my

- Name

- Natürliche

- Natürliche Sprache

- Need

- Bedürfnisse

- Neu

- Neue Funktionen

- neue Produkt

- weiter

- nicht

- beachten

- Laptops

- Notiz..

- jetzt an

- Objekt

- Objekte

- aufgetreten

- of

- Angebote

- vorgenommen,

- on

- einmal

- EINEM

- einzige

- die

- Betriebssysteme

- Optimierung

- Optimierung

- or

- Auftrag

- Bestellungen

- Organisation

- Organisationen

- Original

- Andere

- UNSERE

- Ergebnis

- Möglichkeiten für das Ausgangssignal:

- Ausgänge

- übrig

- Seiten

- Parallel

- besonders

- Partner

- Partnerschaft

- Leidenschaft & KREATIVITÄT

- leidenschaftlich

- passt

- Schnittmuster

- führt

- Perspektive

- Phase

- phd

- Stücke

- Pionier

- Pipeline

- zentrale

- Ort

- Plattform

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Beliebt

- Popularität

- Post

- Potenzial

- möglicherweise

- Werkzeuge

- angetriebene

- Praxis

- Praktiken

- vorhersagen

- vorhergesagt

- früher

- primär

- Principal

- Datenschutz

- Datenschutz und Sicherheit

- Aufgabenstellung:

- Probleme

- Verfahren

- Prozessdefinierung

- anpassen

- Verarbeitung

- Produziert

- produziert

- Produkt

- Produktentwicklung

- Produktmanagement

- Produkt-Manager

- Produkte

- Produkte und Dienstleistungen

- Professionell

- Professor

- Programmierung

- Programmiersprachen

- Projekte

- Eingabeaufforderungen

- zuverlässig

- die

- vorausgesetzt

- bietet

- Bereitstellung

- Psychologie

- Öffentlichkeit

- veröffentlicht

- Veröffentlichte Forschung

- verfolgen

- Python

- Abfragen

- Frage

- schnell

- zufällig

- Zufälligkeit

- Angebot

- Bereich

- schnell

- Lesebrillen

- realisieren

- Reich

- erhalten

- kürzlich

- Anerkennung

- empfehlen

- Rekord

- Aufzeichnungen

- Veteran

- reduziert

- Reduzierung

- in Bezug auf

- Region

- neu denken

- bezogene

- freigegeben

- relevant

- zuverlässig

- verlassen

- merken

- entfernen

- gemacht

- wiederholbar

- antworten

- Darstellung

- Darstellen

- representiert

- Anforderung

- Zugriffe

- erfordern

- falls angefordert

- Voraussetzungen:

- erfordert

- Forschungsprojekte

- Antwort

- Antworten

- REST

- was zu

- Die Ergebnisse

- Rückkehr

- Rückgabe

- revolutionieren

- Reiches

- Recht

- Straße

- Rollen

- Rollen

- Zimmer

- Führen Sie

- läuft

- SaaS

- Sicherheit

- sagemaker

- Said

- gleich

- San

- San Francisco

- Scala

- skalierbaren

- Skalieren

- Zeitplan

- Wissenschaft

- Wissenschaftler

- kratzen

- Sdk

- Suche

- Zweite

- Abschnitt

- Bibliotheken

- Sicherheitdienst

- sehen

- gesehen

- wählen

- Sendung

- Senior

- geschickt

- Reihenfolge

- serviert

- Lösungen

- Dienst

- Sessions

- kompensieren

- Einstellung

- mehrere

- sollte

- erklären

- gezeigt

- Konzerte

- bedeutend

- ähnlich

- Einfacher

- vereinfachen

- Vereinfachung

- einfach

- da

- Single

- klein

- So

- Software

- Software als Service

- Softwareentwickler

- Software-Entwicklung

- Softwareentwicklung

- Lösung

- Lösungen

- LÖSEN

- Auflösung

- einige

- Jemand,

- anspruchsvoll

- Seele

- Quelle

- Raumfahrt

- Spanisch

- überspannend

- Spezialist

- spezifisch

- speziell

- angegeben

- verbringen

- Ausgabe

- SQL

- Anfang

- begonnen

- Anfang

- Erklärung

- Status

- Schritt

- Shritte

- Stoppen

- einfach

- Struktur

- Die Kursteilnehmer

- sucht

- Erfolg

- Unterstützung

- Unterstützt

- vermutet

- sicher

- System

- Systeme und Techniken

- Tabelle

- TAG

- Nehmen

- Target

- Aufgabe

- und Aufgaben

- gelehrt

- Team

- Teams

- Tech

- Tech-Startup

- Technische

- Technik

- Techniken

- Technologie

- erzählen

- zehn

- Texas

- Text

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Der Westen

- die Welt

- ihr

- Sie

- dann

- Diese

- vom Nutzer definierten

- think

- fehlen uns die Worte.

- diejenigen

- Durch

- während

- Zeit

- zu

- heute

- Zeichen

- Tokens

- sagte

- nahm

- Werkzeug

- Spur

- verfolgen sind

- Trading

- traditionell

- Ausbildung

- Transformativ

- Transformationen

- Übersetzen

- reisen

- Reisen

- Trending

- Versuch

- auslösen

- Auslösen

- was immer dies auch sein sollte.

- Wahrer Code

- Versuch

- Drehung

- tippe

- ui

- Uk

- für

- verstehen

- Verständnis

- versteht

- einzigartiges

- Universität

- bis

- enthüllt

- anstehende

- aktualisiert

- auf

- us

- verwendbar

- -

- Anwendungsfall

- benutzt

- Mitglied

- Benutzererfahrung

- Nutzer

- verwendet

- Verwendung von

- gewöhnlich

- ux

- verschiedene

- Anbieter

- sehr

- Seh-

- visuell

- VMware

- Stimme

- wollen

- wurde

- Weg..

- we

- Netz

- Web-Services

- Wochen

- GUT

- waren

- West

- Was

- Was ist

- wann

- welche

- breit

- Große Auswahl

- werden wir

- Fenster

- mit

- ohne

- Arbeiten

- gearbeitet

- Arbeitsablauf.

- Workflows

- arbeiten,

- Werk

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- weltweit

- würde

- schreiben

- XML

- Jahr

- Jahr

- U

- Ihr

- Youtube

- Zephyrnet