Inside the Tech ist eine Blogserie, die unsere begleitet Tech Talks-Podcast. In Folge 20 des Podcasts „The Evolution of Roblox Avatars“ sprach Roblox-CEO David Baszucki mit Senior Director of Engineering Kiran Bhat, Senior Director of Product Mahesh Ramasubramanian und Principal Product Manager Effie Goenawan über das Zukunft der immersiven Kommunikation durch Avatare und die technischen Herausforderungen, die wir lösen, um es anzutreiben. In dieser Ausgabe von Inside the Tech haben wir mit Andrew Portner, Senior Engineering Manager, gesprochen, um mehr über eine dieser technischen Herausforderungen zu erfahren: die Sicherheit bei immersiver Sprachkommunikation und wie die Arbeit des Teams dazu beiträgt, eine sichere und zivile digitale Umgebung für alle zu schaffen unsere Plattform.

Was sind die größten technischen Herausforderungen, denen sich Ihr Team stellt?

Wir legen Wert darauf, unseren Benutzern ein sicheres und positives Erlebnis zu bieten. Sicherheit und Höflichkeit stehen für uns immer im Vordergrund, aber der Umgang damit in Echtzeit kann eine große technische Herausforderung sein. Wann immer es ein Problem gibt, möchten wir es überprüfen und in Echtzeit Maßnahmen ergreifen können. Angesichts unserer Größe ist dies jedoch eine Herausforderung. Um dieses Ausmaß effektiv bewältigen zu können, müssen wir automatisierte Sicherheitssysteme nutzen.

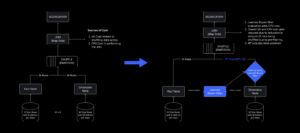

Eine weitere technische Herausforderung, auf die wir uns konzentrieren, ist die Genauigkeit unserer Sicherheitsmaßnahmen für die Moderation. Es gibt zwei Moderationsansätze, um Richtlinienverstöße anzugehen und in Echtzeit genaues Feedback zu geben: reaktive und proaktive Moderation. Für die reaktive Moderation entwickeln wir Modelle für maschinelles Lernen (ML), um verschiedene Arten von Richtlinienverstößen genau zu identifizieren, indem wir auf Berichte von Personen auf der Plattform reagieren. Wir arbeiten proaktiv an der Echtzeiterkennung von Potenzialen Inhalte, die gegen unsere Richtlinien verstoßen, um Benutzer über ihr Verhalten aufzuklären. Das Verstehen des gesprochenen Wortes und die Verbesserung der Audioqualität ist ein komplexer Prozess. Wir sehen bereits Fortschritte, aber unser oberstes Ziel ist es, ein hochpräzises Modell zu haben, das richtlinienverletzendes Verhalten in Echtzeit erkennen kann.

Mit welchen innovativen Ansätzen und Lösungen begegnen wir diesen technischen Herausforderungen?

Wir haben ein End-to-End-ML-Modell entwickelt, das Audiodaten analysieren kann und ein Konfidenzniveau basierend auf der Art der Richtlinienverstöße liefert (z. B. wie wahrscheinlich ist Mobbing, Obszönität usw.). Dieses Modell hat unsere Fähigkeit, bestimmte Berichte automatisch zu schließen, erheblich verbessert. Wir ergreifen Maßnahmen, wenn unser Modell zuversichtlich ist und sicher sein kann, dass es den Menschen übertrifft. Innerhalb weniger Monate nach der Einführung konnten wir mit diesem Modell fast alle englischsprachigen Sprachmissbrauchsberichte moderieren. Wir haben diese Modelle intern entwickelt und sie sind ein Beweis für die Zusammenarbeit zwischen vielen Open-Source-Technologien und unserer eigenen Arbeit bei der Entwicklung der Technologie dahinter.

In Echtzeit zu bestimmen, was angemessen ist, scheint ziemlich komplex zu sein. Wie soll das gehen?

Es wird viel darüber nachgedacht, das System kontextabhängig zu machen. Bevor wir Maßnahmen ergreifen, betrachten wir auch Muster im Laufe der Zeit, damit wir sicher sein können, dass unsere Maßnahmen gerechtfertigt sind. Unsere Richtlinien variieren je nach Alter einer Person, ob sie sich in einem öffentlichen Raum oder einem privaten Chat aufhält, und vielen anderen Faktoren. Wir erforschen neue Wege, um Höflichkeit in Echtzeit zu fördern, und ML steht dabei im Mittelpunkt. Wir haben vor kurzem automatisierte Push-Benachrichtigungen (oder „Nudges“) eingeführt, um Benutzer an unsere Richtlinien zu erinnern. Wir untersuchen auch andere Faktoren wie den Tonfall, um die Absichten einer Person besser zu verstehen und Dinge wie Sarkasmus oder Witze zu unterscheiden. Schließlich bauen wir auch ein mehrsprachiges Modell auf, da manche Leute mehrere Sprachen sprechen oder sogar mitten im Satz die Sprache wechseln. Damit dies möglich ist, benötigen wir ein genaues Modell.

Derzeit konzentrieren wir uns auf die Bekämpfung der häufigsten Formen des Missbrauchs wie Belästigung, Diskriminierung und Schimpfwörter. Diese machen den Großteil der Missbrauchsmeldungen aus. Unser Ziel ist es, in diesen Bereichen einen erheblichen Einfluss zu haben und Branchenstandards dafür zu setzen, wie die Förderung und Aufrechterhaltung eines zivilen Online-Gesprächs aussieht. Wir freuen uns über das Potenzial des Einsatzes von ML in Echtzeit, da wir damit effektiv ein sicheres und ziviles Erlebnis für alle fördern können.

Inwiefern sind die Herausforderungen, die wir bei Roblox lösen, einzigartig? Was können wir zuerst lösen?

Unser Chatten Sie mit Spatial Voice Technologie schafft ein noch intensiveres Erlebnis und ahmt die Kommunikation in der realen Welt nach. Wenn ich zum Beispiel links von jemandem stehe, hört er mich auf seinem linken Ohr. Wir schaffen ein Analogon dazu, wie Kommunikation in der realen Welt funktioniert, und das ist eine Herausforderung, die wir zuerst lösen können.

Da ich selbst Gamer bin, habe ich viel Belästigung und Mobbing im Online-Gaming erlebt. Es handelt sich um ein Problem, das aufgrund der Anonymität der Benutzer und fehlender Konsequenzen oft unkontrolliert bleibt. Allerdings sind die technischen Herausforderungen, denen wir uns dabei stellen, in einigen Bereichen einzigartig im Vergleich zu denen, mit denen andere Plattformen konfrontiert sind. Auf einigen Spieleplattformen sind Interaktionen auf Teamkollegen beschränkt. Roblox bietet vielfältige Möglichkeiten, sich in einem sozialen Umfeld aufzuhalten, das dem wirklichen Leben eher nachempfunden ist. Dank der Fortschritte in der ML und der Echtzeit-Signalverarbeitung sind wir in der Lage, missbräuchliches Verhalten effektiv zu erkennen und zu bekämpfen, was bedeutet, dass wir nicht nur eine realistischere Umgebung haben, sondern auch eine, in der sich jeder sicher fühlt, mit anderen zu interagieren und sich zu vernetzen. Die Kombination aus unserer Technologie, unserer immersiven Plattform und unserem Engagement, Benutzer über unsere Richtlinien aufzuklären, versetzt uns in die Lage, diese Herausforderungen direkt anzugehen.

Was sind einige der wichtigsten Dinge, die Sie bei dieser technischen Arbeit gelernt haben?

Ich habe das Gefühl, eine Menge gelernt zu haben. Ich bin kein ML-Ingenieur. Ich habe hauptsächlich am Front-End im Gaming-Bereich gearbeitet, daher war es enorm wichtig, dass ich tiefer als bisher in die Funktionsweise dieser Modelle eintauchen konnte. Ich hoffe, dass die Maßnahmen, die wir zur Förderung der Höflichkeit ergreifen, zu einem Maß an Empathie in der Online-Community führen, das bisher gefehlt hat.

Eine letzte Erkenntnis ist, dass alles von den von Ihnen eingegebenen Trainingsdaten abhängt. Und damit die Daten korrekt sind, müssen sich die Menschen auf die Bezeichnungen einigen, die zur Kategorisierung bestimmter richtlinienverletzender Verhaltensweisen verwendet werden. Es ist wirklich wichtig, auf der Grundlage hochwertiger Daten zu trainieren, auf die sich alle einigen können. Es ist ein wirklich schwer zu lösendes Problem. Sie beginnen, Bereiche zu erkennen, in denen ML allen anderen weit voraus ist, und dann andere Bereiche, in denen es sich noch in einem frühen Stadium befindet. Es gibt immer noch viele Bereiche, in denen ML immer noch zunimmt, daher ist es wichtig, sich seiner aktuellen Grenzen bewusst zu sein.

Welchem Roblox-Wert entspricht Ihr Team am meisten?

Der Respekt vor der Gemeinschaft ist unser Leitwert in diesem Prozess. Erstens müssen wir uns auf die Verbesserung der Höflichkeit und die Reduzierung von Richtlinienverstößen auf unserer Plattform konzentrieren. Dies hat erhebliche Auswirkungen auf das gesamte Benutzererlebnis. Zweitens müssen wir sorgfältig überlegen, wie wir diese neuen Funktionen einführen. Wir müssen im Modell auf Fehlalarme achten (z. B. fälschlicherweise als Missbrauch markieren) und vermeiden, Benutzer fälschlicherweise zu bestrafen. Die Überwachung der Leistung unserer Modelle und ihrer Auswirkungen auf das Benutzerengagement ist von entscheidender Bedeutung.

Was begeistert Sie am meisten an der Entwicklung von Roblox und Ihrem Team?

Wir haben erhebliche Fortschritte bei der Verbesserung der öffentlichen Sprachkommunikation gemacht, aber es gibt noch viel zu tun. Private Kommunikation ist ein spannendes Gebiet, das es zu erkunden gilt. Ich denke, es gibt eine große Chance, die private Kommunikation zu verbessern, den Benutzern die Möglichkeit zu geben, sich gegenüber engen Freunden auszudrücken, einen Sprachanruf über Erlebnisse oder während eines Erlebnisses zu führen, während sie mit ihren Freunden interagieren. Ich denke, dass es auch eine Möglichkeit gibt, diese Communities mit besseren Tools zu fördern, die es Benutzern ermöglichen, sich selbst zu organisieren, Communities beizutreten, Inhalte zu teilen und Ideen auszutauschen.

Wie skalieren wir unsere Chat-Technologie, um diese wachsenden Communities zu unterstützen, während wir weiter wachsen? Bei vielen Dingen, die wir tun können, kratzen wir gerade erst an der Oberfläche, und ich denke, dass es eine Chance gibt, die Höflichkeit der Online-Kommunikation und Zusammenarbeit in der gesamten Branche auf eine noch nie dagewesene Weise zu verbessern. Mit der richtigen Technologie und den ML-Fähigkeiten sind wir in der einzigartigen Position, die Zukunft der zivilen Online-Kommunikation zu gestalten.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://blog.roblox.com/2024/01/inside-the-tech-solving-for-safety-in-immersive-voice-communication/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 20

- a

- Fähigkeit

- Fähig

- Über Uns

- Missbrauch

- Genauigkeit

- genau

- genau

- über

- Action

- Aktionen

- Adresse

- Adressierung

- Fortschritte

- Nach der

- Alter

- voraus

- Ziel

- ausrichten

- Alle

- erlauben

- fast

- bereits

- ebenfalls

- immer

- an

- analysieren

- und

- Martin

- Anonymität

- jedem

- Ansätze

- angemessen

- SIND

- Bereich

- Bereiche

- um

- AS

- At

- Audio-

- Automatisiert

- Im Prinzip so, wie Sie es von Google Maps kennen.

- Avatare

- vermeiden

- bewusst

- basierend

- BE

- war

- Bevor

- beginnen

- Verhalten

- hinter

- Sein

- Besser

- zwischen

- Big

- Größte

- Blog

- Building

- Schikane

- aber

- by

- rufen Sie uns an!

- CAN

- Fähigkeiten

- vorsichtig

- CEO

- sicher

- challenges

- Herausforderungen

- herausfordernd

- Chance

- Chat

- zivil

- Menu

- eng

- wissend

- Zusammenarbeit

- Kombination

- Engagement

- Kommunikation

- Communities

- community

- Komplex

- Vertrauen

- zuversichtlich

- Vernetz Dich

- Folgen

- Geht davon

- erheblich

- Inhalt

- fortsetzen

- Gespräch

- Paar

- erstellen

- schafft

- Erstellen

- wichtig

- Strom

- technische Daten

- Christian

- Deal

- tiefer

- Abhängig

- hängt

- entdecken

- Entdeckung

- entwickelt

- Entwicklung

- anders

- digital

- Direktor

- Diskriminierung

- unterscheiden

- do

- die

- Dabei

- erledigt

- zwei

- im

- e

- Früh

- Ausgabe

- Erziehung

- effektiv

- sonst

- Empathie

- ermöglichen

- ermöglicht

- Ende

- End-to-End

- Engagement

- Ingenieur

- Entwicklung

- Englisch

- Arbeitsumfeld

- Folge anschauen

- etc

- Sogar

- jedermann

- alles

- Evolution

- aufgeregt

- erregt

- unterhaltsame Programmpunkte

- Ausbau

- ERFAHRUNGEN

- Erfahrungen

- ERKUNDEN

- Möglichkeiten sondieren

- express

- zugewandt

- Faktoren

- falsch

- Eigenschaften

- Feedback

- fühlen

- fühlt sich

- Vorname

- Setzen Sie mit Achtsamkeit

- konzentriert

- Aussichten für

- Formen

- Fördern

- Freunde

- für

- Materials des

- Vorderes Ende

- Zukunft

- Gaming

- gegeben

- Go

- Kundenziele

- Goes

- gehen

- Wachsen Sie über sich hinaus

- persönlichem Wachstum

- führen

- Hand voll

- Griff

- Handling

- Belästigung

- hart

- Haben

- ganzer

- Leitung

- hören

- Herz

- Unternehmen

- hoch

- ein Geschenk

- Ultraschall

- aber

- HTTPS

- riesig

- Humans

- i

- Ideen

- identifizieren

- if

- immersive

- Impact der HXNUMXO Observatorien

- wichtig

- zu unterstützen,

- verbessert

- Verbesserung

- in

- falsch

- Energiegewinnung

- innovativ

- innerhalb

- Instanz

- Absichten

- interagieren

- Interaktionen

- in

- Problem

- IT

- SEINE

- join

- nur

- gerechtfertigt

- Wesentliche

- Etiketten

- Mangel

- fehlt

- Sprachen

- Nachname

- zuletzt

- ins Leben gerufen

- Start

- LERNEN

- gelernt

- lernen

- links

- Niveau

- Hebelwirkung

- Lebensdauer

- Gefällt mir

- wahrscheinlich

- Limitiert

- Grenzen

- aussehen

- suchen

- SIEHT AUS

- Los

- Maschine

- Maschinelles Lernen

- gemacht

- Aufrechterhaltung

- Mehrheit

- um

- Making

- Manager

- viele

- Markierung

- me

- Mittel

- Maßnahmen

- Geist / Bewusstsein

- ML

- Modell

- für

- moderieren

- Mäßigung

- Überwachung

- Monat

- mehr

- vor allem warme

- meist

- viel

- mehrere

- sollen

- my

- mich

- Need

- Neu

- Neue Funktionen

- Normen

- Benachrichtigungen

- of

- Angebote

- vorgenommen,

- on

- EINEM

- Online

- online Spielen

- einzige

- XNUMXh geöffnet

- Open-Source-

- Gelegenheit

- or

- Auftrag

- Andere

- Anders

- UNSERE

- Übertrifft

- übrig

- Gesamt-

- besitzen

- Muster

- Personen

- Leistung

- Plattform

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Podcast

- Politik durchzulesen

- Datenschutzrichtlinien

- Position

- positiv

- möglich

- Potenzial

- Werkzeuge

- präzise

- ziemlich

- Principal

- Priorität einräumen

- privat

- Proaktives Handeln

- Aufgabenstellung:

- Prozessdefinierung

- Verarbeitung

- Produkt

- Produkt-Manager

- PROFANITÄT

- Fortschritt

- prominent

- fördern

- Die Förderung der

- die

- bietet

- Öffentlichkeit

- Push

- setzen

- Versetzt

- Qualität

- Qualitätsdaten

- echt

- wahres Leben

- realen Welt

- Echtzeit

- realistisch

- wirklich

- kürzlich

- Reduzierung

- Meldungen

- reagiert

- Überprüfen

- Recht

- Roblox

- Rollen

- Safe

- Sicherheit

- Sarkasmus

- Skalieren

- Zweite

- sehen

- Sehen

- scheint

- Senior

- Modellreihe

- kompensieren

- Form

- Teilen

- Signal

- signifikant

- bedeutend

- da

- So

- Social Media

- Lösungen

- LÖSEN

- Auflösung

- einige

- Jemand,

- etwas

- Quelle

- Raumfahrt

- räumlich

- sprechen

- gesprochen

- Stufen

- Stehen

- Immer noch

- so

- Support

- sicher

- Oberfläche

- Schalter

- System

- Systeme und Techniken

- angehen

- anpacken

- Nehmen

- Einnahme

- Gespräche

- Team

- Tech

- Technische

- Technologies

- Technologie

- Testament

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Zukunft

- ihr

- sich

- dann

- Dort.

- Diese

- vom Nutzer definierten

- think

- fehlen uns die Worte.

- diejenigen

- dachte

- Durch

- während

- Zeit

- zu

- TONE

- Tonfall

- Werkzeuge

- Top

- Training

- Ausbildung

- Übersetzen

- XNUMX

- tippe

- Typen

- letzte

- verstehen

- Verständnis

- einzigartiges

- us

- benutzt

- Mitglied

- Benutzererfahrung

- Nutzer

- Verwendung von

- Wert

- Vielfalt

- Verstöße

- Stimme

- wollen

- Weg..

- Wege

- we

- waren

- Was

- Was ist

- wann

- ob

- welche

- während

- mit

- .

- Zeuge

- Word

- Arbeiten

- gearbeitet

- arbeiten,

- Werk

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- U

- Ihr

- Zephyrnet