Дослідники продовжують розробляти нові архітектури моделей для поширених завдань машинного навчання (ML). Одним із таких завдань є класифікація зображень, де зображення приймаються як вхідні дані, а модель намагається класифікувати зображення в цілому за допомогою вихідних даних міток об’єктів. Оскільки сьогодні доступно багато моделей, які виконують це завдання класифікації зображень, фахівець з машинного навчання може поставити запитання на зразок: «Яку модель мені слід налаштувати, а потім розгорнути, щоб досягти найкращої продуктивності свого набору даних?» І дослідник ML може поставити запитання на кшталт: «Як я можу згенерувати власне чесне порівняння кількох архітектур моделі з певним набором даних, одночасно контролюючи гіперпараметри навчання та специфікації комп’ютера, наприклад GPU, CPU та RAM?» Перше питання стосується вибору моделі в архітектурі моделі, тоді як останнє питання стосується порівняння навчених моделей із тестовим набором даних.

У цій публікації ви побачите, як Класифікація зображень TensorFlow алгоритм роботи Amazon SageMaker JumpStart може спростити впровадження, необхідні для вирішення цих питань. Разом із деталями реалізації у відповідному приклад блокнота Jupyter, у вас будуть доступні інструменти для виконання вибору моделі шляхом вивчення кордонів Парето, де покращення одного показника продуктивності, наприклад точності, неможливо без погіршення іншого показника, наприклад пропускної здатності.

Огляд рішення

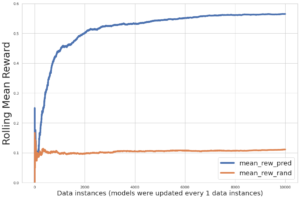

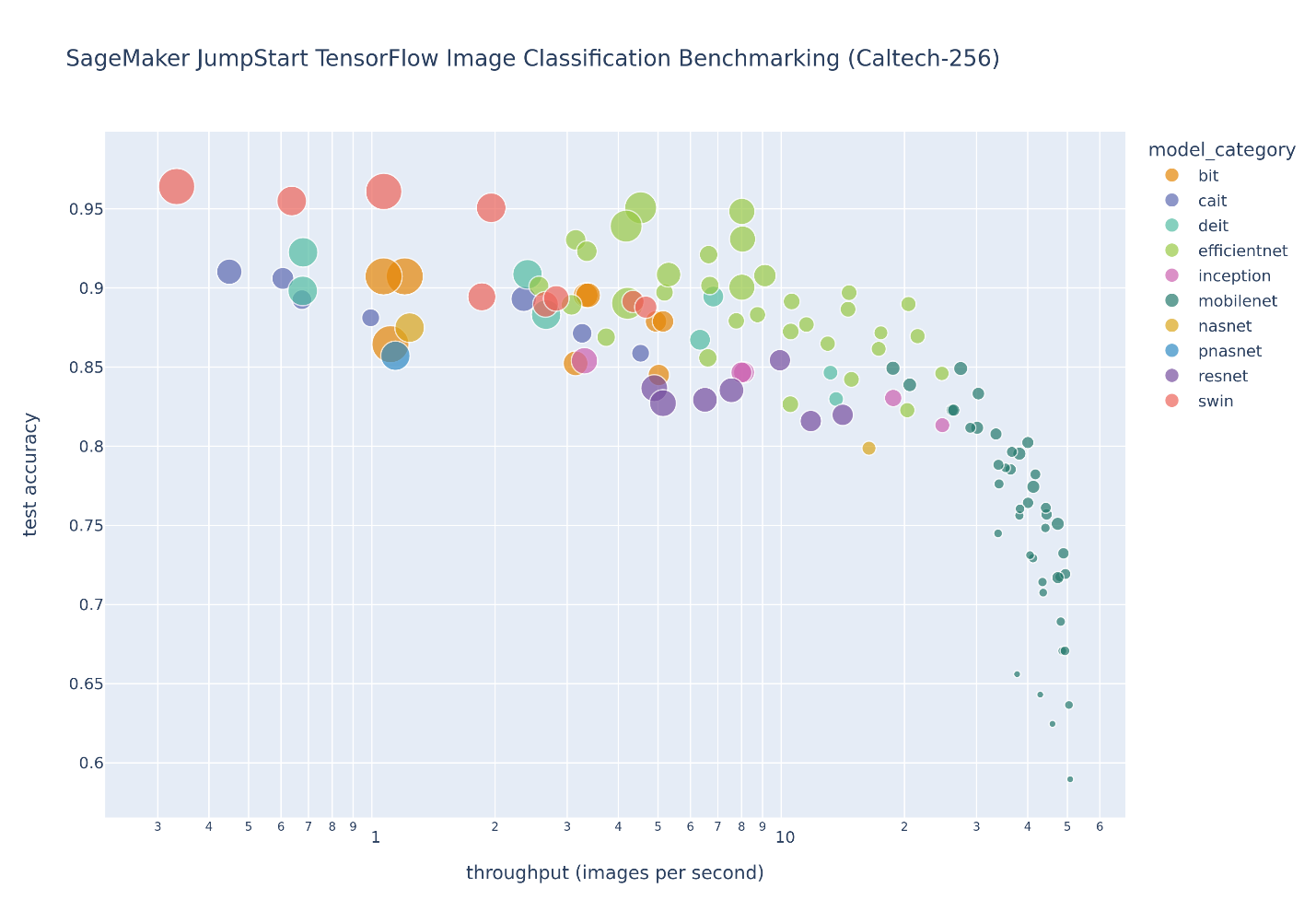

Наступний малюнок ілюструє компроміс вибору моделі для великої кількості моделей класифікації зображень, точно налаштованих на Каліфорнійський технологічний інститут-256 набір даних, який являє собою складний набір із 30,607 256 зображень реального світу, що охоплюють XNUMX категорій об’єктів. Кожна точка представляє окрему модель, розміри точки масштабуються відповідно до кількості параметрів, що входять до складу моделі, а точки позначаються кольором на основі архітектури їх моделі. Наприклад, світло-зелені точки представляють архітектуру EfficientNet; кожна світло-зелена точка є іншою конфігурацією цієї архітектури з унікальними точно налаштованими вимірюваннями продуктивності моделі. На малюнку показано існування межі Парето для вибору моделі, де більша точність замінюється на меншу пропускну здатність. Зрештою, вибір моделі вздовж кордону Парето або набору рішень, ефективних за Парето, залежить від вимог до продуктивності розгортання вашої моделі.

Якщо ви спостерігаєте за цікавою точністю тесту та межами тестової пропускної здатності, набір ефективних рішень за Парето на попередньому малюнку буде виділено в наступну таблицю. Рядки сортуються таким чином, що продуктивність тесту зростає, а точність тесту зменшується.

| Назва моделі | Кількість параметрів | Точність тесту | Перевірте топ-5 точності | Пропускна здатність (зображення/с) | Тривалість за епоху (и) |

| swin-large-patch4-window12-384 | 195.6M | 96.4% | 99.5% | 0.3 | 2278.6 |

| swin-large-patch4-window7-224 | 195.4M | 96.1% | 99.5% | 1.1 | 698.0 |

| ефективнийnet-v2-imagenet21k-ft1k-l | 118.1M | 95.1% | 99.2% | 4.5 | 1434.7 |

| effectivenet-v2-imagenet21k-ft1k-m | 53.5M | 94.8% | 99.1% | 8.0 | 769.1 |

| effectivenet-v2-imagenet21k-m | 53.5M | 93.1% | 98.5% | 8.0 | 765.1 |

| ефективна мережа b5 | 29.0M | 90.8% | 98.1% | 9.1 | 668.6 |

| ефективнийnet-v2-imagenet21k-ft1k-b1 | 7.3M | 89.7% | 97.3% | 14.6 | 54.3 |

| ефективнийnet-v2-imagenet21k-ft1k-b0 | 6.2M | 89.0% | 97.0% | 20.5 | 38.3 |

| ефективнийnet-v2-imagenet21k-b0 | 6.2M | 87.0% | 95.6% | 21.5 | 38.2 |

| mobilenet-v3-large-100-224 | 4.6M | 84.9% | 95.4% | 27.4 | 28.8 |

| mobilenet-v3-large-075-224 | 3.1M | 83.3% | 95.2% | 30.3 | 26.6 |

| mobilenet-v2-100-192 | 2.6M | 80.8% | 93.5% | 33.5 | 23.9 |

| mobilenet-v2-100-160 | 2.6M | 80.2% | 93.2% | 40.0 | 19.6 |

| mobilenet-v2-075-160 | 1.7M | 78.2% | 92.8% | 41.8 | 19.3 |

| mobilenet-v2-075-128 | 1.7M | 76.1% | 91.1% | 44.3 | 18.3 |

| mobilenet-v1-075-160 | 2.0M | 75.7% | 91.0% | 44.5 | 18.2 |

| mobilenet-v1-100-128 | 3.5M | 75.1% | 90.7% | 47.4 | 17.4 |

| mobilenet-v1-075-128 | 2.0M | 73.2% | 90.0% | 48.9 | 16.8 |

| mobilenet-v2-075-96 | 1.7M | 71.9% | 88.5% | 49.4 | 16.6 |

| mobilenet-v2-035-96 | 0.7M | 63.7% | 83.1% | 50.4 | 16.3 |

| mobilenet-v1-025-128 | 0.3M | 59.0% | 80.7% | 50.8 | 16.2 |

У цьому дописі описано, як реалізувати масштабний проект Amazon SageMaker завдання бенчмаркінгу та вибору моделі. По-перше, ми представляємо JumpStart і вбудовані алгоритми класифікації зображень TensorFlow. Потім ми обговорюємо питання впровадження високого рівня, такі як конфігурації гіперпараметрів JumpStart, вилучення показників із Журнали Amazon CloudWatchі запуск асинхронних завдань налаштування гіперпараметрів. Нарешті, ми розглядаємо середовище реалізації та параметризацію, що веде до парето-ефективних рішень у попередній таблиці та малюнку.

Вступ до класифікації зображень JumpStart TensorFlow

JumpStart забезпечує тонке налаштування та розгортання широкого спектру попередньо навчених моделей для популярних завдань машинного навчання одним клацанням миші, а також набір наскрізних рішень, які вирішують типові бізнес-проблеми. Ці функції усувають важку роботу з кожного етапу процесу машинного навчання, спрощуючи розробку високоякісних моделей і скорочуючи час до розгортання. The API JumpStart дозволяють програмним шляхом розгортати та точно налаштовувати широкий вибір попередньо навчених моделей на ваших власних наборах даних.

Концентратор моделі JumpStart забезпечує доступ до великої кількості Моделі класифікації зображень TensorFlow які дозволяють передати навчання та тонке налаштування користувацьких наборів даних. На момент написання цієї статті центр моделей JumpStart містить 135 моделей класифікації зображень TensorFlow у різноманітних популярних архітектурах моделей від Концентратор TensorFlow, щоб включити залишкові мережі (ResNet), MobileNet, EfficientNet, Початок, Нейронна архітектура Пошукові мережі (NASNet), Великий трансфер (BiT), зміщене вікно (Свін) трансформери, Class-Attention in Image Transformers (CaiT) і Ефективні перетворювачі зображень (DeiT).

Архітектура кожної моделі складається з дуже різних внутрішніх структур. Наприклад, моделі ResNet використовують з’єднання пропуску, щоб забезпечити значно глибші мережі, тоді як моделі на основі трансформаторів використовують механізми самоконтролю, які усувають внутрішню локальність операцій згортки на користь більш глобальних сприйнятливих полів. На додаток до різноманітних наборів функцій, які надають ці різні структури, кожна архітектура моделі має кілька конфігурацій, які регулюють розмір, форму та складність моделі в межах цієї архітектури. У результаті в центрі моделей JumpStart доступні сотні унікальних моделей класифікації зображень. У поєднанні з вбудованим перенесенням навчання та сценаріями висновків, які охоплюють багато функцій SageMaker, JumpStart API є чудовою відправною точкою для практиків МЛ, щоб швидко розпочати навчання та розгортати моделі.

Відноситься до Передайте навчання для моделей класифікації зображень TensorFlow в Amazon SageMaker та наступне приклад блокнота щоб дізнатися більше про класифікацію зображень SageMaker TensorFlow, у тому числі про те, як виконувати висновок на попередньо навченій моделі, а також налаштувати попередньо навчену модель на спеціальному наборі даних.

Міркування щодо вибору великомасштабної моделі

Вибір моделі — це процес вибору найкращої моделі з набору моделей-кандидатів. Цей процес можна застосовувати до моделей одного типу з різними вагами параметрів і до моделей різних типів. Приклади вибору моделі між моделями одного типу включають підгонку однієї моделі з різними гіперпараметрами (наприклад, швидкістю навчання) і ранню зупинку, щоб запобігти надмірному підбору ваг моделі до набору даних поїзда. Вибір моделі серед моделей різних типів включає вибір найкращої архітектури моделі (наприклад, Swin проти MobileNet) і вибір найкращої конфігурації моделі в межах однієї архітектури моделі (наприклад, mobilenet-v1-025-128 проти mobilenet-v3-large-100-224).

Міркування, викладені в цьому розділі, дозволяють виконувати всі ці процеси вибору моделі на наборі даних перевірки.

Виберіть конфігурації гіперпараметрів

Класифікація зображень TensorFlow у JumpStart має велику кількість доступних гіперпараметри який може однаково налаштувати поведінку сценарію навчання передачі для всіх архітектур моделі. Ці гіперпараметри стосуються доповнення та попередньої обробки даних, специфікації оптимізатора, елементів керування переобладнанням та індикаторів рівня, що можна навчити. Рекомендується налаштувати значення за замовчуванням цих гіперпараметрів відповідно до вашої програми:

Для цього аналізу та пов’язаного блокнота для всіх гіперпараметрів встановлено значення за замовчуванням, за винятком швидкості навчання, кількості епох і специфікації ранньої зупинки. Швидкість навчання регулюється як a категоріальний параметр по Автоматичне налаштування моделі SageMaker робота. Оскільки кожна модель має унікальні значення гіперпараметрів за замовчуванням, окремий список можливих швидкостей навчання включає швидкість навчання за замовчуванням, а також одну п’яту швидкість навчання за замовчуванням. Це запускає два завдання навчання для одного завдання налаштування гіперпараметрів, і вибирається завдання навчання з найкращою продуктивністю в наборі даних перевірки. Оскільки для кількості епох установлено 10, що перевищує параметр гіперпараметра за замовчуванням, вибране найкраще навчальне завдання не завжди відповідає швидкості навчання за замовчуванням. Нарешті, використовується критерій ранньої зупинки з терпінням або кількістю епох для продовження навчання без покращення у три епохи.

Одне налаштування гіперпараметра за замовчуванням особливо важливо train_only_on_top_layer, де, якщо встановлено True, шари вилучення функцій моделі не налаштовані на наданому навчальному наборі даних. Оптимізатор навчатиме лише параметри у верхньому повністю підключеному шарі класифікації з розмірністю виводу, що дорівнює кількості міток класу в наборі даних. За замовчуванням цей гіперпараметр має значення True, який є параметром, націленим на перенесення навчання на невеликих наборах даних. Можливо, у вас є користувацький набір даних, для якого вилучення ознак із попереднього навчання на наборі даних ImageNet недостатньо. У цих випадках слід встановити train_only_on_top_layer до False. Незважаючи на те, що цей параметр збільшить час навчання, ви отримаєте більш значущі функції для вашої проблеми, що вас цікавить, тим самим підвищивши точність.

Отримайте показники з журналів CloudWatch

Алгоритм класифікації зображень JumpStart TensorFlow надійно реєструє різноманітні показники під час навчання, які доступні для SageMaker Estimator і об'єкти HyperparameterTuner. Конструктор SageMaker Estimator має metric_definitions аргумент ключового слова, який можна використовувати для оцінки навчальної роботи, надаючи список словників із двома ключами: ім’я для назви метрики та Regex для регулярного виразу, який використовується для отримання метрики з журналів. Супутній ноутбук показує деталі реалізації. У наведеній нижче таблиці перераховано доступні показники та пов’язані регулярні вирази для всіх моделей класифікації зображень JumpStart TensorFlow.

| Назва показника | Регулярні вирази |

| кількість параметрів | «- Кількість параметрів: ([0-9\.]+)» |

| кількість параметрів, які можна навчити | «- Кількість параметрів, які можна навчити: ([0-9\.]+)» |

| кількість параметрів, які не підлягають навчанню | «- Кількість параметрів, які не підлягають навчанню: ([0-9\.]+)» |

| метрика набору даних навчання | f”- {метрика}: ([0-9\.]+)” |

| метрика набору даних перевірки | f”- val_{metric}: ([0-9\.]+)” |

| тестова метрика набору даних | f”- Тест {метрика}: ([0-9\.]+)” |

| тривалість поїзда | «- Загальна тривалість навчання: ([0-9\.]+)» |

| тривалість поїзда за епоху | «- Середня тривалість навчання за епоху: ([0-9\.]+)» |

| затримка оцінки тесту | «- Затримка оцінки тесту: ([0-9\.]+)» |

| затримка тесту на вибірку | «- Середня затримка тесту на вибірку: ([0-9\.]+)» |

| тестова пропускна здатність | «- Середня пропускна здатність тесту: ([0-9\.]+)» |

Вбудований сценарій навчання передачі надає різноманітні метрики набору даних навчання, перевірки та тестування в межах цих визначень, представлених значеннями заміни f-рядка. Доступні точні показники залежать від типу класифікації, що виконується. Усі скомпільовані моделі мають a loss метрика, яка представлена втратою перехресної ентропії для задачі бінарної або категоріальної класифікації. Перший використовується, коли є одна мітка класу; останній використовується, якщо є дві або більше міток класу. Якщо є лише одна мітка класу, то такі показники обчислюються, реєструються та вилучаються за допомогою регулярних виразів f-рядка в попередній таблиці: кількість справжніх позитивних результатів (true_pos), кількість помилкових спрацьовувань (false_pos), кількість справжніх негативів (true_neg), кількість помилкових негативів (false_neg), precision, recall, площа під кривою робочої характеристики приймача (ROC) (auc), і площа під кривою точності запам’ятовування (PR) (prc). Подібним чином, якщо існує шість або більше міток класу, топ-5 показників точності (top_5_accuracy) також обчислюється, реєструється та витягується за допомогою попередніх регулярних виразів.

Під час навчання метрики, визначені для SageMaker Estimator надсилаються в журнали CloudWatch. Після завершення навчання ви можете викликати API SageMaker DescribeTrainingJob та огляньте FinalMetricDataList ключ у відповіді JSON:

Цей API вимагає, щоб у запиті було надано лише ім’я завдання, тому після завершення метрики можна буде отримати під час майбутніх аналізів, якщо ім’я навчального завдання належним чином зареєстровано та відновлено. Для цього завдання вибору моделі назви завдань налаштування гіперпараметрів зберігаються, а наступні аналізи повторно підключаються HyperparameterTuner об’єкт із назвою завдання налаштування, видобути найкраще ім’я завдання навчання з підключеного тюнера гіперпараметрів, а потім викликати DescribeTrainingJob API, як описано раніше, щоб отримати показники, пов’язані з найкращою навчальною роботою.

Запуск асинхронних завдань налаштування гіперпараметрів

Зверніться до відповідних ноутбук для деталей впровадження асинхронного запуску завдань налаштування гіперпараметрів, які використовують стандартну бібліотеку Python одночасні ф'ючерси модуль, інтерфейс високого рівня для асинхронного виконання викликів. У цьому рішенні реалізовано кілька міркувань, пов’язаних із SageMaker:

- Кожен обліковий запис AWS пов’язаний з Квоти служби SageMaker. Вам слід переглянути свої поточні ліміти, щоб повністю використовувати свої ресурси, і потенційно вимагати збільшення ліміту ресурсів за потреби.

- Часті виклики API для створення багатьох одночасних завдань налаштування гіперпараметрів можуть перевищувати швидкість Python SDK і створювати виняткові ситуації для обмеження. Вирішенням цього є створення клієнта SageMaker Boto3 із спеціальною конфігурацією повтору.

- Що станеться, якщо у вашому сценарії станеться помилка або сценарій буде зупинено до завершення? Для такого великого вибору моделей або порівняльного дослідження ви можете реєструвати назви завдань налаштування та надавати зручні функції для повторно приєднати завдання налаштування гіперпараметрів які вже існують:

Деталі аналізу та обговорення

Аналіз у цьому дописі виконує перенесення навчання для ідентифікатори моделі в алгоритмі класифікації зображень JumpStart TensorFlow на наборі даних Caltech-256. Усі навчальні завдання виконувалися на навчальному екземплярі SageMaker ml.g4dn.xlarge, який містить один графічний процесор NVIDIA T4.

Тестовий набір даних оцінюється на екземплярі навчання в кінці навчання. Вибір моделі виконується перед оцінкою тестового набору даних, щоб встановити вагові коефіцієнти моделі для епохи з найкращою продуктивністю набору перевірки. Пропускна здатність тесту не оптимізована: для розміру пакета набору даних встановлено стандартний розмір пакета гіперпараметра навчання, який не налаштовано для максимального використання пам’яті GPU; звітна пропускна здатність тесту включає час завантаження даних, оскільки набір даних попередньо не кешується; і розподілений висновок між кількома GPU не використовується. З цих причин ця пропускна здатність є хорошим відносним показником, але фактична пропускна здатність значною мірою залежатиме від ваших конфігурацій розгортання кінцевої точки для навченої моделі.

Незважаючи на те, що центр моделі JumpStart містить багато типів архітектури класифікації зображень, на цій межі Парето домінують окремі моделі Swin, EfficientNet і MobileNet. Моделі Swin більші та відносно точніші, тоді як моделі MobileNet менші, відносно менш точні та підходять для обмежень ресурсів мобільних пристроїв. Важливо зазначити, що ця межа залежить від низки факторів, у тому числі від точного набору даних, що використовується, і вибраних гіперпараметрів тонкого налаштування. Ви можете виявити, що ваш власний набір даних створює інший набір парето-ефективних рішень, і вам може знадобитися довший час навчання з різними гіперпараметрами, наприклад, більше збільшення даних або тонке налаштування не лише верхнього шару класифікації моделі.

Висновок

У цьому дописі ми показали, як виконувати завдання великомасштабного вибору моделі або порівняльного аналізу за допомогою концентратора моделей JumpStart. Це рішення може допомогти вам вибрати найкращу модель для ваших потреб. Ми заохочуємо вас спробувати та вивчити це рішення на власному наборі даних.

посилання

Більше інформації доступно на наступних ресурсах:

Про авторів

Доктор Кайл Ульріх є прикладним науковцем з Вбудовані алгоритми Amazon SageMaker команда. Його дослідницькі інтереси включають масштабовані алгоритми машинного навчання, комп’ютерне бачення, часові ряди, байєсівські непараметричні процеси та процеси Гаусса. Його доктор філософії отримав в Університеті Дьюка, і він опублікував статті в NeurIPS, Cell і Neuron.

Доктор Кайл Ульріх є прикладним науковцем з Вбудовані алгоритми Amazon SageMaker команда. Його дослідницькі інтереси включають масштабовані алгоритми машинного навчання, комп’ютерне бачення, часові ряди, байєсівські непараметричні процеси та процеси Гаусса. Його доктор філософії отримав в Університеті Дьюка, і він опублікував статті в NeurIPS, Cell і Neuron.

Доктор Ашиш Хетан є старшим вченим-прикладником с Вбудовані алгоритми Amazon SageMaker і допомагає розробляти алгоритми машинного навчання. Він отримав ступінь доктора філософії в Університеті Іллінойсу Урбана Шампейн. Він активно досліджує машинне навчання та статистичні висновки та опублікував багато статей на конференціях NeurIPS, ICML, ICLR, JMLR, ACL та EMNLP.

Доктор Ашиш Хетан є старшим вченим-прикладником с Вбудовані алгоритми Amazon SageMaker і допомагає розробляти алгоритми машинного навчання. Він отримав ступінь доктора філософії в Університеті Іллінойсу Урбана Шампейн. Він активно досліджує машинне навчання та статистичні висновки та опублікував багато статей на конференціях NeurIPS, ICML, ICLR, JMLR, ACL та EMNLP.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- Платоблокчейн. Web3 Metaverse Intelligence. Розширені знання. Доступ тут.

- джерело: https://aws.amazon.com/blogs/machine-learning/image-classification-model-selection-using-amazon-sagemaker-jumpstart/

- 10

- 100

- 9

- a

- МЕНЮ

- доступ

- доступною

- рахунки

- точність

- точний

- Achieve

- через

- активний

- доповнення

- адреса

- адреси

- Відрегульований

- Афілійований

- проти

- алгоритм

- алгоритми

- ВСІ

- вже

- хоча

- завжди

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- аналіз

- та

- Інший

- API

- додаток

- прикладної

- відповідним чином

- архітектура

- ПЛОЩА

- аргумент

- асоційований

- приєднувати

- Спроби

- автоматичний

- доступний

- середній

- AWS

- заснований

- Байєсівський

- оскільки

- перед тим

- буття

- КРАЩЕ

- Великий

- вбудований

- бізнес

- Виклики

- кандидат

- випадків

- категорії

- складні

- характеристика

- Вибирати

- клас

- класифікація

- Класифікувати

- клієнт

- комбінований

- загальний

- порівняння

- повний

- Зроблено

- завершення

- складність

- комп'ютер

- Комп'ютерне бачення

- Турбота

- конференції

- конфігурація

- підключений

- Зв'язки

- міркування

- обмеження

- містить

- продовжувати

- управління

- управління

- зручність

- Відповідний

- обкладинка

- створювати

- Поточний

- крива

- виготовлений на замовлення

- дані

- набори даних

- глибше

- дефолт

- залежить

- розгортання

- розгортання

- розгортання

- глибина

- описаний

- description

- деталі

- розвивати

- прилади

- різний

- обговорювати

- розподілений

- Різне

- Ні

- Герцог

- герцогський університет

- під час

- кожен

- Раніше

- Рано

- легше

- ефективний

- або

- усунутий

- включіть

- заохочувати

- заохочувати

- кінець в кінець

- Кінцева точка

- Навколишнє середовище

- епоха

- епохи

- помилка

- Ефір (ETH)

- оцінювати

- оцінюється

- оцінка

- приклад

- Приклади

- Крім

- дослідити

- Дослідження

- вирази

- витяг

- видобуток

- фактори

- ярмарок

- на користь

- особливість

- риси

- Поля

- Рисунок

- в кінці кінців

- знайти

- Перший

- пристосування

- після

- Колишній

- від

- Кордон

- Frontiers

- повністю

- Функції

- майбутнє

- Ф'ючерси

- породжувати

- отримати

- даний

- Глобальний

- добре

- GPU

- Графічні процесори

- великий

- великий

- зелений

- відбувається

- сильно

- допомога

- допомагає

- на вищому рівні

- високоякісний

- вище

- Як

- How To

- HTML

- HTTPS

- Концентратор

- Сотні

- Налаштування гіперпараметрів

- ICLR

- Іллінойс

- зображення

- Класифікація зображень

- IMAGEnet

- зображень

- здійснювати

- реалізація

- реалізовані

- значення

- важливо

- поліпшення

- поліпшення

- in

- включати

- includes

- У тому числі

- Augmenter

- Збільшує

- зростаючий

- індикатори

- інформація

- вхід

- екземпляр

- інтерес

- інтереси

- інтерфейс

- внутрішній

- сутнісний

- вводити

- IT

- робота

- Джобс

- json

- ключ

- ключі

- етикетка

- етикетки

- великий

- масштабний

- більше

- Затримка

- запуски

- запуск

- шар

- шарів

- провідний

- УЧИТЬСЯ

- вивчення

- підйомний

- світло

- МЕЖА

- рамки

- список

- списки

- погрузка

- Довго

- довше

- від

- машина

- навчання за допомогою машини

- Робить

- багато

- Максимізувати

- значущим

- вимірювання

- пам'ять

- метрика

- Метрика

- ML

- Mobile

- мобільні пристрої

- модель

- Моделі

- Модулі

- більше

- множинний

- ім'я

- Імена

- необхідно

- необхідний

- потреби

- мереж

- Нейронний

- NeurIPS

- Нові

- ноутбук

- номер

- Nvidia

- об'єкт

- об'єкти

- спостерігати

- отримувати

- отриманий

- ONE

- операційний

- операції

- оптимізований

- викладені

- власний

- документи

- параметр

- параметри

- приватність

- Терпіння

- виконувати

- продуктивність

- виступає

- plato

- Інформація про дані Платона

- PlatoData

- точка

- точок

- популярний

- це можливо

- пошта

- потенційно

- pr

- запобігати

- попередній

- Проблема

- проблеми

- процес

- процеси

- забезпечувати

- за умови

- забезпечує

- забезпечення

- опублікований

- Python

- питання

- питань

- швидко

- Оперативна пам'ять

- ставка

- ставки

- Реальний світ

- Причини

- зниження

- регулярний

- щодо

- видаляти

- Повідомляється

- представляти

- представлений

- представляє

- запросити

- вимагається

- Вимога

- Вимагається

- дослідження

- дослідник

- дозвіл

- ресурс

- ресурси

- відповідь

- результати

- прогін

- біг

- мудрець

- то ж

- масштабовані

- вчений

- scripts

- Sdk

- Пошук

- розділ

- обраний

- вибирає

- вибір

- старший

- Серія

- обслуговування

- Сесія

- комплект

- набори

- установка

- кілька

- Форма

- Повинен

- Шоу

- Аналогічно

- спростити

- одночасний

- один

- SIX

- Розмір

- розміри

- невеликий

- менше

- So

- рішення

- Рішення

- ВИРІШИТИ

- специфікація

- специфікації

- зазначений

- standard

- почалася

- статистичний

- Крок

- зупинений

- зупинка

- зберігати

- Вивчення

- наступні

- по суті

- такі

- достатній

- підходящий

- таблиця

- цільове

- Завдання

- завдання

- команда

- тензорний потік

- тест

- Команда

- їх

- тим самим

- три

- пропускна здатність

- час

- Часовий ряд

- times

- до

- сьогодні

- разом

- інструменти

- топ

- топ 5

- Усього:

- поїзд

- навчений

- Навчання

- переклад

- Трансформатори

- правда

- Типи

- Зрештою

- при

- створеного

- університет

- Використання

- використання

- використовувати

- використовувати

- перевірка достовірності

- Цінності

- різноманітність

- величезний

- через

- вид

- бачення

- який

- в той час як

- широкий

- волі

- в

- без

- б

- лист

- вашу

- зефірнет