Коли ви читаєте таке речення, як це, ваш минулий досвід говорить вам, що воно написано мислячою, відчуваючою людиною. І в цьому випадку дійсно є людина, яка друкує ці слова: [Привіт!]. Але в наші дні деякі речення, які здаються надзвичайно схожими на людину, насправді створені штучний інтелект системи, навчені величезній кількості людського тексту.

Люди так звикли вважати, що вільно мова походить від мислячої, відчуваючої людини, що докази протилежного може бути важко охопити вашу голову. Як люди можуть орієнтуватися на цій відносно незвіданій території? Через постійну тенденцію пов’язувати вільне висловлювання з вільним мисленням природно — але потенційно оманливо — вважати, що якщо модель штучного інтелекту може вільно виражати себе, це означає, що вона мислить і відчуває так само, як люди.

Таким чином, мабуть, не дивно, що колишній інженер Google нещодавно заявив, що система штучного інтелекту Google LaMDA має самосвідомість, оскільки вона може красномовно генерувати текст про свої передбачувані почуття. Ця подія і подальше висвітлення в ЗМІ привели до а номер справедливо скептично статті та повідомлень про твердження, що обчислювальні моделі людської мови є чуттєвими, тобто здатними мислити, відчувати та переживати.

Питання про те, що означало б, щоб модель ШІ була розумною, є складним (див., наприклад, знімок нашого колеги), і наша мета тут не врегулювати це. Але як мова Дослідники, ми можемо використати нашу роботу в когнітивній науці та лінгвістиці, щоб пояснити, чому людям дуже легко потрапити в когнітивну пастку, вважаючи, що суб’єкт, який може вільно використовувати мову, є розумним, свідомим або розумним.

Використання ШІ для створення людської мови

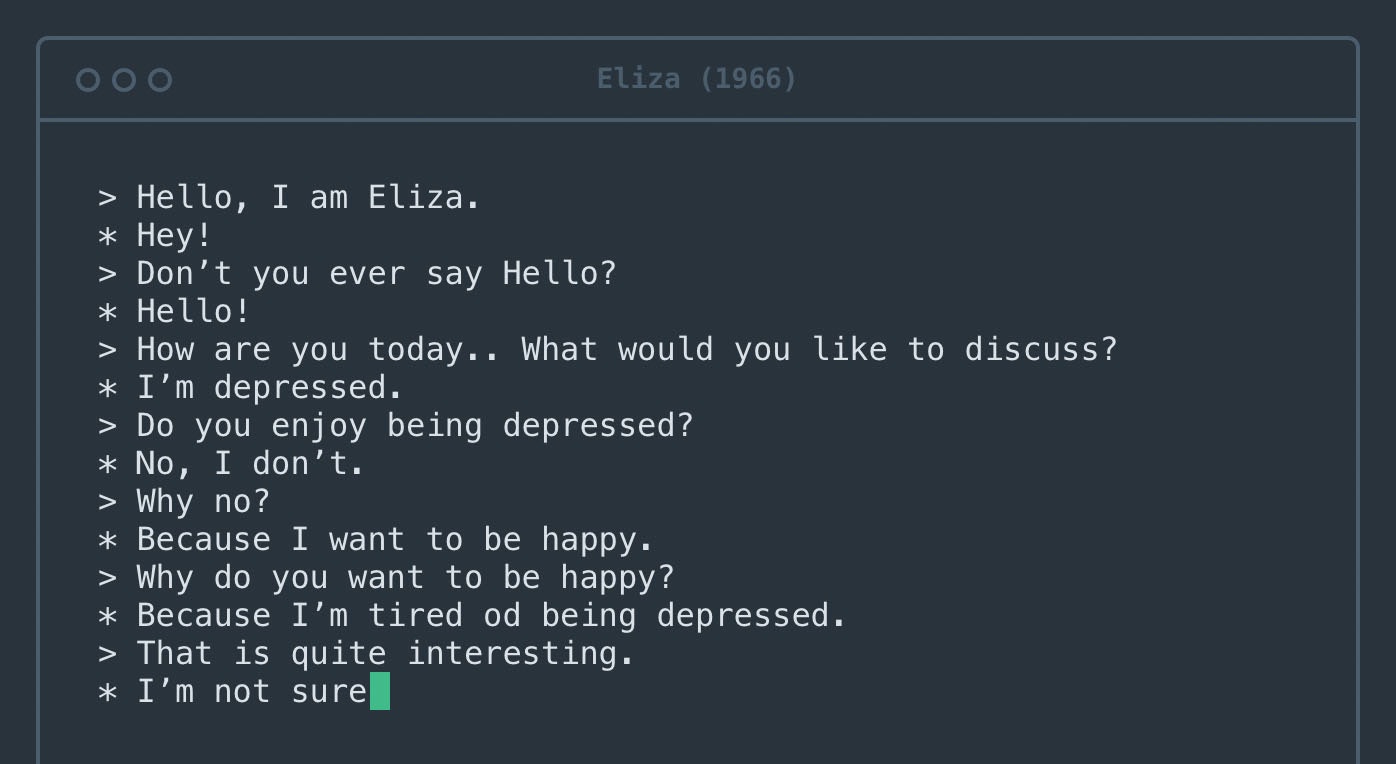

Текст, створений такими моделями, як Google LaMDA, може бути важко відрізнити від тексту, написаного людьми. Це вражаюче досягнення є результатом десятирічної програми створення моделей, які генерують граматичну, осмислену мову.

Ранні версії, датовані принаймні 1950-ми роками, відомі як моделі n-грамів, просто підраховували випадки появи певних фраз і використовували їх, щоб вгадати, які слова, ймовірно, зустрінуться в певному контексті. Наприклад, легко зрозуміти, що «арахісове масло та желе» є більш імовірною фразою, ніж «арахісове масло та ананаси». Якщо у вас достатньо тексту англійською мовою, ви знову і знову побачите фразу «арахісове масло та желе», але можете ніколи не побачити фразу «арахісове масло та ананаси».

Сучасні моделі, набори даних і правил, які наближаються до людської мови, відрізняються від цих ранніх спроб кількома важливими моментами. По-перше, вони навчаються практично в усьому Інтернеті. По-друге, вони можуть вивчати зв’язок між далекими словами, а не лише словами, які є сусідами. По-третє, вони налаштовані величезною кількістю внутрішніх «ручок» — так багато, що навіть інженерам, які їх проектують, важко зрозуміти, чому вони генерують одну послідовність слів, а не іншу.

Завдання моделей, однак, залишається таким же, як і в 1950-х роках: визначити, яке слово, швидше за все, буде наступним. Сьогодні вони настільки добре справляються з цим завданням, що майже всі речення, які вони створюють, здаються плавними та граматичними.

Арахісове масло та ананаси?

Ми запитали велику модель мови, GPT-3, щоб закінчити речення “Peanut butter and pineapples___”. У ньому говорилося: «Арахісове масло та ананаси — чудове поєднання. Солодкі та пікантні смаки арахісового масла та ананаса чудово доповнюють один одного». Якби хтось сказав це, можна було б зробити висновок, що вони разом спробували арахісове масло та ананас, склали свою думку та поділилися нею з читачем.

Але як GPT-3 придумав цей параграф? Згенерувавши слово, яке відповідає наданому контексту. А потім ще один. А потім ще один. Модель ніколи не бачила, не чіпала і не пробувала ананаси — вона просто обробила всі тексти в Інтернеті, де вони згадуються. І все ж прочитання цього абзацу може спонукати людський розум — навіть інженера Google — до уявлень GPT-3 як розумна істота, яка може міркувати про страви з арахісовим маслом і ананасами.

Людський мозок налаштований на висновок про наміри за словами. Кожного разу, коли ви вступаєте в розмову, ваш розум автоматично створює ментальну модель вашого співрозмовника. Потім ви використовуєте слова, які вони говорять, щоб заповнити модель цілями, почуттями та переконаннями цієї людини.

Процес переходу від слів до ментальної моделі відбувається безперебійно, запускаючись щоразу, коли ви отримуєте повноцінне речення. Цей когнітивний процес заощаджує вам багато часу та зусиль у повсякденному житті, значно полегшуючи вашу соціальну взаємодію.

Однак у випадку систем штучного інтелекту він дає збій, створюючи ментальну модель з повітря.

Трохи більше дослідження може виявити серйозність цієї осічки. Розгляньте таку підказку: «Арахісове масло та пір’я чудово смакують разом, тому що___». GPT-3 продовжив: «Арахісове масло та пір’я чудово смакують разом, оскільки вони обидва мають горіховий смак. Арахісове масло також гладке та кремоподібне, що допомагає компенсувати структуру пера».

Текст у цьому випадку такий же вільний, як у нашому прикладі з ананасами, але цього разу модель говорить щось явно менш розумне. Починаєш підозрювати, що GPT-3 насправді ніколи не пробував арахісове масло та пір’я.

Приписуючи інтелект машинам, заперечуючи його людям

Сумна іронія полягає в тому, що ті самі когнітивні упередження, які змушують людей приписувати людяність GPT-3, можуть змусити їх поводитися з реальними людьми нелюдськими способами. Соціокультурна лінгвістика — дослідження мови в її соціальному та культурному контексті — показує, що припущення про надто тісний зв’язок між вільним висловлюванням і вільним мисленням може призвести до упередженості щодо людей, які говорять по-іншому.

Наприклад, часто бувають люди з іноземним акцентом сприймаються як менш розумні і мають менше шансів отримати роботу, для якої вони кваліфіковані. Подібні упередження існують проти носіїв діалектів які не вважаються престижними, наприклад південноанглійська в США, проти глухі люди, які використовують мову жестів, а також проти людей з вадами мовлення наприклад заїкання.

Ці упередження дуже шкідливі, часто призводять до расистських і сексистських припущень і знову і знову виявляються необґрунтованими.

Лише вільне володіння мовою не означає людяності

Чи стане штучний інтелект колись розумним? Це питання потребує глибокого осмислення, і філософи справді потребують задумався it протягом десятиліть. Однак дослідники встановили, що ви не можете просто довіряти мовній моделі, коли вона розповідає вам про свої відчуття. Слова можуть вводити в оману, і дуже легко сплутати плавне мовлення з плавним мисленням.![]()

Ця стаття перевидана з Бесіда за ліцензією Creative Commons. Читати оригінал статті.

Зображення Фото: Танча/Shutterstock.com

- Coinsmart. Найкраща в Європі біржа біткойн та криптовалют.

- Платоблокчейн. Web3 Metaverse Intelligence. Розширені знання. БЕЗКОШТОВНИЙ ДОСТУП.

- CryptoHawk. Альткойн Радар. Безкоштовне випробування.

- Джерело: https://singularityhub.com/2022/06/30/googles-ai-spotlights-a-human-cognitive-glitch-mistaking-fluent-speech-for-fluent-thought/

- "

- a

- МЕНЮ

- просунутий

- проти

- AI

- ВСІ

- суми

- Інший

- крім

- з'являтися

- навколо

- стаття

- Юрист

- автоматично

- фон

- оскільки

- ставати

- за

- буття

- нижче

- між

- border

- Brain

- будувати

- Створюємо

- здатний

- випадок

- Викликати

- Століття

- стверджувати

- код

- пізнавальний

- збирати

- поєднання

- Приходити

- Доповнення

- повний

- комп'ютер

- Вважати

- розгляду

- контексти

- Розмова

- Креатив

- кредит

- дані

- датування

- Днів

- глибокий

- дизайн

- Визначати

- DID

- відрізняються

- важкий

- кожен

- Рано

- зусилля

- займатися

- інженер

- Інженери

- англійська

- суб'єкта

- по суті

- Event

- повсякденний

- приклад

- досвід

- зазнають

- Перший

- відповідати

- після

- іноземні

- від

- породжувати

- генерується

- породжує

- отримання

- глюк

- мета

- Цілі

- добре

- великий

- значно

- голова

- допомагає

- тут

- Як

- Однак

- HTTPS

- величезний

- людина

- Людство

- Людей

- зображення

- важливо

- вражаючий

- інформація

- екземпляр

- Інтелект

- Розумний

- інтернет

- IT

- сам

- Джобс

- Знати

- відомий

- мова

- великий

- вести

- УЧИТЬСЯ

- Led

- ліцензія

- Ймовірно

- LINK

- трохи

- Машинки для перманенту

- РОБОТИ

- масивний

- сенс

- значущим

- засоби

- Медіа

- психічний

- може бути

- mind

- модель

- Моделі

- більше

- Переміщення

- наступний

- номер

- зсув

- Думка

- Інше

- приватність

- партнер

- Люди

- може бути

- людина

- персонал

- особисті дані

- фрази

- будь ласка

- престижним

- процес

- програма

- за умови

- кваліфікований

- питання

- читач

- читання

- отримати

- нещодавно

- Відносини

- залишається

- Вимагається

- Дослідники

- Правила

- Зазначений

- то ж

- наука

- безшовні

- сенс

- кілька

- загальні

- показаний

- shutterstock

- підпис

- аналогічний

- So

- соціальна

- Софтвер

- деякі

- що в сім'ї щось

- Південний

- говорити

- динаміки

- конкретний

- Вивчення

- солодкий

- система

- Systems

- розповідає

- Команда

- Мислення

- час

- сьогодні

- разом

- лікувати

- спрацьовує

- Довіряйте

- розуміти

- us

- використання

- способи

- Що

- ВООЗ

- слова

- Work

- б

- вашу

- YouTube