Як штучний інтелект (AI) розробки висувають технологічний центр, інвестори природно відчувають запах можливостей у повітрі. Вони також відчувають запах щойно надрукованих форм і бюрократичної тяганини регулятора, який тільки й чекає, щоб взяти свій внесок і завадити ревучій машині інновацій ШІ. Але для тих, хто стурбований тим, що дядько Сем може розтрощити галузь новими правилами та обмеженнями, я б сказав, що тут все прямо протилежне: правила можуть врятувати галузь від неї самої. І, як наслідок, більше правил для галузі захищає, а не шкодить інвесторам.

У більшості нових галузей на слово «регулювання» накладено табу. Зараз індустрія ШІ не зовсім нова. Сучасна концепція сягає 1950-х років, і як приватні, так і державні інвестиції в сферу то зростали, то зменшувалися протягом останніх 70 років або близько того. У 1980-х і на початку 1990-х років відбувся а цикл піднесення та падіння в інвестиції в штучний інтелект. Інвестиції японського уряду у 80-х роках поклали початок першому великому комерційному буму ШІ. Однак до 1993 року «понад 300 компаній закрили свої двері», оскільки бульбашка лопнула. Однак сучасні досягнення в обчислювальній потужності та великі мовні моделі (LLM) дали галузі нове життя, і її потенціал приваблює не лише інвесторів, але й регулятори.

Правила ШІ: плутанина інтересів і ризиків

Питання про те, яким має бути або навіть може бути «регулювання штучного інтелекту», є питанням для політиків, політиків і етиків. Інвестори, звичайно, хочуть знати, що це означатиме для їхніх портфелів. Які найбільші ризики? І саме тут закони та нормативні акти можуть забезпечити певний захист і допомогти впоратися з цими ризиками.

Найбільші ризики для інвесторів зводяться до трьох основних проблем, що збігаються: шахрайство, захист інтелектуальної власності та конфіденційність. Звичайно, вже існують закони, які окремо стосуються всіх трьох цих питань. Однак проблема полягає в тому, що штучний інтелект являє собою унікальне складне поєднання всіх трьох ризиків, які без чітких рамок, законів і правил загрожують прогресу всієї галузі.

Найбільш гострою проблемою для інвесторів у цьому списку є шахрайство. Майже кожен може погодитися, що запобігання шахрайству є важливою та життєво важливою роллю регулювання.

Шахрайські мавпи на дроті: два приклади

Два тематичних дослідження показують потенційне майбутнє регулювання штучного інтелекту, ризик шахрайства та нормативні часові рамки, на які інвестори повинні розраховувати. Обидва також є уособленням того, як шахрайство вплине на регулятивні дії, які прийдуть.

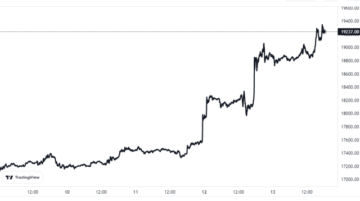

Перший — це світ криптовалют і невзаємозамінних токенів (NFT). Значно новіша індустрія, ніж штучний інтелект, криптопережила неабияку частку бумів і крахів і, що найважливіше, шахрайства. Комісія з цінних паперів і бірж (SEC) і Федеральна торгова комісія (Федеральна торгова комісія) витратили гарне десятиліття, намагаючись з’ясувати, як вписати криптовалюту в свої схеми регулювання. Незважаючи на це, Конгрес ще не ухвалив чіткого законодавства, пов’язаного з криптовалютами деякі спроби.

За цей час численні біржі піднялися та занепали. У 2021 і 2022 роках NFT стали модними втративши 95% своєї вартості, забираючи з собою мільярди доларів інвесторів. Сумно відомий крах FTX і нещодавнє випробування Сема Бенкмана-Фріда було залучено мільярди доларів, використаних шахрайським шляхом.

Друге прикладне дослідження тут стосується кібербезпеки. На відміну від криптографії, існує досить багато встановлених основних законів для галузі. Першими двома «справжніми» законами про кібербезпеку були Закон про комп’ютерне шахрайство та зловживання 1986 року та Закон про всеосяжну боротьбу зі злочинністю 1984 року. Обидва покладалися на креативне та відносно нове розуміння «дротів» (як у телеграфних проводах) і шахрайства через дроти.

Упродовж десятиліть після цього Конгрес прийняв часткові закони щодо кібертем неоднозначні результати. Це призвело до того, що штати почали слабшати. Світ кібербезпеки також є прикладом галузі з глибоко пересічними інтересами, багато з яких не відрізняються від ризиків і регуляторних проблем, з якими стикається індустрія штучного інтелекту. Одним із найпомітніших є конфіденційність. Занепокоєння щодо індивідуальної конфіденційності, яка зазвичай пов’язана з соціальними мережами та Інтернетом речей (IoT), також виникає з моделями навчання ШІ.

Обидва наведені тут приклади є уроками для індустрії ШІ, що швидко розвивається. Середовище криптовалютного світу з високим ризиком, високою винагородою та низьким рівнем регулювання рясніє шахрайством і нестабільністю. Кібербезпека є набагато давнішою та усталеною галуззю, але нормативне середовище все ще неоднозначне, особливо щодо конфіденційності.

Поточний стан нормативно-правових актів ШІ

Отже, щоб отримати уявлення про те, якого з цих шляхів регулювання слід очікувати інвесторам, давайте подивимося на поточне нормативне середовище для штучного інтелекту.

Починаючи з внутрішньої сцени, ну… тут небагато, принаймні законодавчо. Президент Джо Байден, з іншого боку, був зайнятий формуванням регулятивного шляху через добровільну обіцянку та, що нещодавно, і що важливо, знаменний і масштабний виконавчий наказ.

На початку цього року Білий дім оголосив про необов’язкову добровільну зобов’язання «керувати ризиками, пов’язаними з ШІ». Серед тих, хто підписав цю обіцянку, є такі відомі компанії, як Amazon (NASDAQ:AMZN), метаплатформи (NASDAQ:META), алфавіт (NASDAQ:GOOG, NASDAQ:Googl) і OpenAI. Управління науково-технічної політики (OSTP), департамент Білого дому, також опублікувало a «Проект Білля про права на штучний інтелект». Ще одна особливо добровільна структура для безпечного та етичного використання ШІ.

За словами Білого дому, «безпечне та етичне використання штучного інтелекту» вимагає суворого «тестування перед розгортанням» і створюється за допомогою «консультацій із різними спільнотами, зацікавленими сторонами та експертами в галузі для виявлення проблем, ризиків і потенційного впливу системи». Системи штучного інтелекту також повинні мати «[не]залежну оцінку та звітність», щоб переконатися, що вони залишаються безпечними в довгостроковій перспективі.

Розпорядження Байдена про штучний інтелект

Рано вранці 30 жовтня Білий дім оголосив про найповніший нормативний поштовх щодо ШІ. Рушійною силою цих зусиль було a широке розпорядження (і гладкий новий сайт), що охоплює все: від безпеки та безпеки до конфіденційності, громадянських прав тощо. Цей виконавчий наказ базується на згаданій вище добровільній обіцянці та Біллі про права AI, і він переважно зосереджується на тому, що робить більшість виконавчих наказів: мобілізація багатьох департаментів і агенцій виконавчої влади до дії.

Є багато деталей, які необхідно з’ясувати щодо того, як цей виконавчий наказ вплине на галузь, але найважливіші висновки для інвесторів:

1. Регулюючим органам знадобиться чимало часу, щоб розробити ці нові принципи та політику.

2. Будь-які конкретні правила, які випливатимуть із цього EO, базуватимуться на хиткій юридичній основі, доки Конгрес не прийме закони, пов’язані зі штучним інтелектом. Він все ще залежить від добровільного дотримання, за одним великим винятком: Законом про оборонне виробництво (DPA).

Посилання Байдена на DPA є настільки ж примітним, наскільки це викликає збентеження. DPA був єдиним фактично чітким законом, на який посилається EO, який мав потенційно серйозні наслідки. DPA нещодавно використовувався в контексті пандемії Covid-19, але зазвичай пов’язаний із виробництвом у воєнний час. Байден використовує це тут виключно в контексті національної безпеки:

«…наказ вимагатиме, щоб компанії, які розробляють будь-яку базову модель, яка становить серйозний ризик для національної безпеки, національної економічної безпеки чи здоров’я та безпеки національної громадськості, повідомляли федеральний уряд під час навчання моделі та мали ділитися результатами всіх перевірок. тести безпеки команди».

Незрозуміло, на кого поширюється цей «процес перегляду», який підтримує DPA, оскільки інші агенції мають більш конкретні регулятивні обов’язки. Наприклад, Національний інститут стандартів і технологій (NIST) має розробити стандарти безпеки ШІ, а Міністерство внутрішньої безпеки (DHS) полягає в їх застосуванні для критичної інфраструктури. Можливо, що ще важливіше, потрібне роз’яснення щодо того, яке відомство взагалі запроваджуватиме цю політику.

Є один відомий кандидат, якого DPA майже напевно охопить через існуючі оборонні контракти: Palantir (NYSE:PLTR). Оборонні підрядники, які займаються великими даними та дедалі більше зосереджуються на штучному інтелекті, не є підписантом Білого дому добровільна застава. Можливо, це більше пов’язано з консервативно-лібертаріанськими політичними прихильностями голови Palantir Пітера Тіля та його підтримкою колишнього президента Дональда Трампа, ніж з прямою відмовою від подальшого регулювання. Однак це упущення є помітним, оскільки Палантир має великі плани «Захопити весь ринок ШІ».

У сукупності нормативно-правова база, встановлена указом Байдена, є новаторською і змушує Конгрес, так би мовити, створити решту регуляторної палати.

На жаль, ми можемо ще довго чекати, поки законодавці почнуть «заливати бетон».

Що щодо Конгресу?

Виконавчий наказ Білого дому про штучний інтелект містить лише два посилання на Конгрес, але в обох йдеться про заклики до Конгресу прийняти двопартійні закони про штучний інтелект (одне прямо стосувалося прийняття закону про конфіденційність).

За даними Центру правосуддя Бреннана, Конгрес має приблизно 60 законопроектів, пов’язаних зі штучним інтелектом засідаючи в різних комітетах.

Однак на момент написання цієї статті Палата представників щойно завершила узгодження нового спікера Палати і має «більшу рибу для смаження», оскільки наближається черговий кінцевий термін припинення роботи уряду та супутня бюджетна боротьба. Не кажучи вже про спірні законопроекти про допомогу Ізраїлю та Україні та низку інших більш нагальних проблем.

Це залишає два інших джерела для регулювання ШІ: окремі штати США та міжнародні актори. Перша група, що складається лише з кількох із 50 штатів країни, має пройшов клаптик відповідних законів, приділяючи першочергову увагу ШІ та конфіденційності споживачів. На міжнародному рівні Китай є лідером у розбудові a складний і просунутий набір правил ШІ. Комплексна нормативно-правова база Європейського Союзу під простою назвою «Закон ШІ», очікується, що він буде завершений і прийнятий до кінця року.

Правила штучного інтелекту та що чекає в майбутньому

Тож де ж ця галузь, що швидко розвивається, потенційно надзвичайно руйнівна? Чи піде криптовалютний шлях до регулювання, який був насичений шахрайством і нестабільністю? Або повільніший, стабільніший, але все ще неоднорідний шлях кібербезпеки. Що ж, поки що, принаймні в Сполучених Штатах, це, ймовірно, буде суміш двох.

ШІ має руйнівний потенціал і потенціал заробітку, про який криптоіндустрія може тільки мріяти. Проте він також має основний потенціал і корисність, які надає галузь кібербезпеки. Для інвесторів, щоб не звучало надто сенсаційно, для людства це ризикована комбінація.

Існує безліч потенційних застосувань штучного інтелекту в реальному світі, від сільського господарства до оборони, фінансів і охорони здоров’я. Витягування крипто-килимка може позбавити інвесторів їхніх грошей, або хакер може вкрасти гроші з банку, але ризики від аварій ШІ або зловмисної поведінки може бути катастрофічним.

Гіпотетики того, що може піти не так, нескінченні, оскільки штучний інтелект все більше впроваджується в повсякденне життя. Але ми вже бачимо тривожні випадки зловмисного використання ШІ. Нещодавній початок війни Ізраїлю та ХАМАС став причиною потоку дезінформації на платформах соціальних мереж, таких як X, раніше Twitter. Деякі з підроблених зображень, які поширюються в Інтернеті, створені штучним інтелектом, часто створені за допомогою легкодоступних інструментів, таких як генератор зображень Bing. Завдяки постійному вдосконаленню технологій буде важче розпізнавати підроблені зображення та відео.

Ми також стикаємося з ризиками, які колись зустрічалися лише в науковій фантастиці, як-от «шахрайський ШІ». У той час як планувальник їжі зі штучним інтелектом випадково запропонувавши рецепт газоподібного хлору Варто трохи посміятися сьогодні, це було б набагато менш смішним, якби ШІ відповідав, скажімо, за те, щоб велика автоматизована ферма випадково (чи ще гірше, навмисно) забруднила врожай овочів.

Як кажуть: «Правила безпеки написані кров'ю». І нам дійсно не потрібно чекати, поки проллється кров, перш ніж вживати заходів.

Юридично вже є «кувалда» справи проти Google, яка, на думку компанії, буде зруйнувати концепцію генеративного ШІ. Щоб уникнути цієї долі, індустрії потрібно чітко застосувати нормативні акти, які зможуть захистити як громадськість, так і фірми ШІ від юридичного гніву одна одної.

Заради інвесторів і для всіх потрібно посилити регуляторний нагляд за індустрією штучного інтелекту, перш ніж щось піде жахливо не так. Новий виконавчий наказ Білого дому містить дуже вичерпну основу для багатьох питань, пов’язаних зі ШІ, і є хорошим початком. Однак без законів, прийнятих Конгресом, які забезпечать надійну основу для роботи регуляторів, ми отримаємо плутанину регуляторів у стилі криптовалют. Це призведе лише до збентеження учасників ринку та збентеження інвесторів. А оскільки потенціал штучного інтелекту є таким великим і небезпечним, це не те, чого нікому варто хотіти.

Тож ні, правила штучного інтелекту – ні "ворог," як стверджував маніфест одного венчурного капіталіста, вони можуть виступати в якості рейок безпеки, які можуть допомогти захистити галузь та інвесторів від величезного ризику.

Що слід робити інвесторам зараз

Без чітких огорож інвестування у світ штучного інтелекту є ризикованою справою. Інвестори, які не дуже стурбовані впливом цих скасованих разом правил, можуть робити більш ризиковані ставки на безліч стартапів, які намагаються розбагатіти. Або на усталених, але зневажливих п’єсах, таких як Палантир.

Інакше інвесторам було б краще бачити, які компанії «грають у м’яча» з добровільною обіцянкою Білого дому. Або ті, які адаптуються до міжнародних регуляторних змін, що надходять від ЄС і Китаю. Ці компанії, швидше за все, сприймають ці нові правила як щось, з чим вони можуть жити, або те, що вони можуть використати на свою користь.

У будь-якому випадку молоток регулювання в якийсь момент впаде. Було б найкраще для всіх, а не лише для інвесторів, щоб він впав до того, як друга половина вислову «рухайся швидко і ламай речі» зламає індустрію ШІ.

На дату публікації Ендрю Буш займав ДОВГУ позицію на акціях GOOGL і AMZN. Думки, висловлені в цій статті, є думками автора, які підлягають інструкціям щодо публікації InvestorPlace.com.

Ендрю Буш є редактором фінансових новин InvestorPlace і має два ступені з міжнародних відносин. Він працював в освіті, технологічному секторі та аналітиком у консалтинговій фірмі з національної безпеки, розташованій у округу Колумбія.

#Положення #Врятуй #Людство #AI.. #Врятуй #акції

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- джерело: https://cryptoinfonet.com/regulation/we-need-regulation-to-save-humanity-from-ai-and-to-save-ai-stocks/

- : має

- :є

- : ні

- :де

- $UP

- 2021

- 2022

- 30

- 300

- 50

- 60

- 70

- 95%

- a

- МЕНЮ

- зловживання

- доступною

- нещасних випадків

- За

- Діяти

- дію

- дії

- актори

- фактичний

- адреса

- просунутий

- аванси

- Перевага

- Справи

- проти

- агентства

- агентство

- погодившись

- сільське господарство

- AI

- Системи ШІ

- Навчання AI

- Aid

- AIR

- ВСІ

- майже

- Алфавіт

- вже

- Також

- Amazon

- серед

- an

- аналітик

- та

- Ендрю

- оголошений

- Інший

- будь-який

- будь

- Мавпи

- застосування

- ЕСТЬ

- сперечатися

- виникати

- стаття

- штучний

- штучний інтелект

- AS

- асоційований

- At

- залучення

- Автоматизований

- уникнути

- назад

- Банк

- Банкмен-Смажений

- Бій

- BE

- ставати

- було

- перед тим

- поведінка

- буття

- КРАЩЕ

- Bets

- Краще

- біден

- Великий

- Великий даних

- найбільший

- Білл

- мільярди

- Банкноти

- двопартійний

- змішування

- сліпий

- кров

- Bloomberg

- книги

- бум

- обидва

- Перерва

- ламається

- міхур

- бюджет

- будувати

- Створюємо

- Будує

- побудований

- бізнес

- бюсти

- зайнятий

- але

- by

- Виклики

- CAN

- кандидат

- випадок

- Приклади з практики

- тематичне дослідження

- випадків

- Центр

- центральна сцена

- голова

- Зміни

- заряд

- Китай

- громадянський

- Громадянські права

- ясно

- закрито

- колапс

- звалилися

- COM

- Приходити

- майбутній

- комерційний

- комісія

- зазвичай

- спільноти

- Компанії

- компанія

- дотримання

- складний

- всеосяжний

- У складі

- комп'ютер

- обчислення

- обчислювальна потужність

- концепція

- Занепокоєння

- стурбований

- Турбота

- бетон

- спутаний

- Конгрес

- консалтинг

- споживач

- конфіденційність споживачів

- контекст

- продовжувати

- Підрядник

- контрактів

- контроль

- Core

- може

- країни

- курс

- обкладинка

- покритий

- покриття

- COVID-19

- Пандемія COVID-19

- створений

- Креатив

- Злочин

- критичний

- Критична інфраструктура

- урожай

- крипто

- Криптовалюта

- cryptocurrencies

- КриптоІнфонет

- Поточний

- Поточний стан

- Вирізати

- кібер-

- Кібербезпека

- Небезпечний

- дані

- Дата

- на основі постійного струму

- крайній термін

- десятиліття

- десятиліття

- глибокий

- оборони

- безумовно

- відділ

- управління внутрішньої безпеки

- відомства

- залежний

- Незважаючи на

- деталі

- розвивати

- розвивається

- події

- руйнівний

- Різне

- do

- робить

- доларів

- домен

- Внутрішній

- Дональд

- Дональд Трамп

- вниз

- мрія

- водіння

- два

- кожен

- Рано

- легко

- Економічний

- редактор

- Освіта

- зусилля

- або

- кінець

- Нескінченний

- підлягає виконанню

- величезний

- Весь

- Навколишнє середовище

- особливо

- встановлений

- етичний

- EU

- Europa

- Європейська

- оцінка

- Навіть

- повсякденний

- все

- все

- точно

- приклад

- Приклади

- виняток

- обмін

- Біржова комісія

- Біржі

- виконавчий

- розпорядження

- існуючий

- очікуваний

- очікував

- experts

- явно

- виражений

- вираз

- розширення

- облицювання

- ярмарок

- підроблений

- Падати

- далеко

- ферма

- ШВИДКО

- доля

- Федеральний

- Федеральний уряд

- Федеральна торгова комісія

- кілька

- Художня література

- поле

- Рисунок

- завершено

- фінансування

- фінансовий

- фінансові новини

- Фірма

- фірми

- Перший

- риба

- відповідати

- повінь

- Сфокусувати

- фокусується

- для

- Для інвесторів

- Forbes

- Кування

- Колишній

- раніше

- форми

- вперед

- знайдений

- фонд

- Рамки

- каркаси

- шахрайство

- ЗАПОБІГАННЯ ШАХРАЙСТВУ

- від

- FTX

- засоби

- далі

- майбутнє

- Майбутнє ШІ

- генеративний

- generator

- отримати

- даний

- Go

- йде

- добре

- Уряд

- великий

- Земля

- новаторський

- Group

- Зростання

- керівні вказівки

- хакер

- Половина

- забивати

- рука

- жменя

- важче

- шкодити

- Мати

- he

- здоров'я

- охорона здоров'я

- Герой

- допомога

- тут

- високий ризик

- дуже

- тримає

- Батьківщина

- Національна Безопаность

- господар

- ГОДИННИК

- будинок

- палата представників

- Як

- How To

- Однак

- HTTPS

- Людство

- i

- ідея

- ідентифікувати

- if

- зображення

- зображень

- Impact

- Вплив

- impending

- здійснювати

- наслідки

- важливо

- важливо

- in

- Зареєстрований

- все більше і більше

- індивідуальний

- Індивідуально

- промисловості

- промисловість

- промисловості

- Інфраструктура

- інновація

- нестабільність

- Інститут

- інтелектуальний

- інтелектуальна власність

- захист інтелектуальної власності

- Інтелект

- навмисно

- інтереси

- Міжнародне покриття

- на міжнародному рівні

- інтернет

- Інтернет речей

- в

- інвестування

- інвестиції

- Інвестори

- залучений

- КАТО

- Ізраїль

- питання

- IT

- ЙОГО

- сам

- японський

- Джо

- Джо Байден

- просто

- юстиція

- кикстартер

- Знати

- орієнтир

- мова

- великий

- масштабний

- закон

- законодавці

- Законодавство

- Закони та правила

- вести

- провідний

- найменш

- Залишати

- легальний

- Законодавство

- менше

- Уроки

- життя

- як

- Ймовірно

- LINK

- список

- жити

- Довго

- подивитися

- маячить

- машина

- Mainstream

- основний

- зробити

- РОБОТИ

- управляти

- маніфест

- багато

- ринок

- значити

- Медіа

- згадати

- Meta

- МЕТА ПЛАТФОРМИ

- може бути

- Дезінформація

- змішувати

- модель

- Моделі

- сучасний

- гроші

- заробляння грошей

- більше

- ранок

- найбільш

- багато

- повинен

- безліч

- Імена

- Nasdaq

- National

- національна безпека

- навігація

- Необхідність

- необхідний

- потреби

- Нові

- новіший

- новини

- NFT

- nist

- немає

- не замінний

- негібкі лексеми

- НЕЗАМІННІ ТОКЕНИ (NFTS)

- Помітний

- особливо

- зараз

- численний

- NYSE

- жовтень

- of

- від

- Office

- часто

- старший

- on

- один раз

- ONE

- онлайн

- тільки

- OpenAI

- Думки

- Можливість

- протилежний

- or

- порядок

- замовлень

- OSTP

- Інше

- з

- відверто

- над

- Нагляд

- пандемія

- Учасники

- проходити

- Пройшов

- проходить

- Проходження

- Минуле

- шлях

- може бути

- Пітер

- плани

- Платформи

- plato

- Інформація про дані Платона

- PlatoData

- відіграє

- Застава

- точка

- Політика

- політика

- політиків

- політичний

- Політики

- портфелі

- поставлений

- позах

- положення

- потенціал

- потенційно

- влада

- потужний

- президент

- Президент Дональд Трамп

- президент Джо Біден

- пресування

- Попередження

- первинний

- недоторканність приватного життя

- приватний

- Проблема

- Production

- прогрес

- власність

- захист

- захист

- забезпечувати

- забезпечує

- забезпечення

- громадськість

- охорона здоров'я

- Публікація

- опублікований

- Видавничий

- суто

- Штовхати

- put

- питання

- досить

- Лють

- рейки

- швидко

- читання

- Реальний світ

- насправді

- останній

- нещодавно

- рецепт

- червоний

- посилання

- про

- Регулювання

- правила

- регулятор

- Регулятори

- регуляторні

- щодо

- доречний

- Представники

- представляє

- вимагати

- Вимагається

- дослідження

- обов'язки

- REST

- Обмеження

- призвело до

- результати

- Reuters

- Багаті

- верхова їзда

- праві

- суворий

- Risen

- Risk

- ризики

- Ризикований

- Роль

- килим тягнути

- прогін

- s

- сейф

- Безпека

- Безпека та охорона

- користь

- Сем

- Сем Банкмен-Фрід

- зберегти

- бачив

- say

- приказка

- сцена

- схеми

- наука

- Наука і технології

- Наукова фантастика

- SEC

- другий

- сектор

- Securities

- Комісія з цінних паперів і бірж

- безпеку

- побачити

- бачачи

- бачив

- серйозний

- комплект

- Форма

- Поділитись

- загальні

- пролити

- Повинен

- Показувати

- вимикання

- Підписанти

- підписант

- значний

- істотно

- просто

- з

- Сидячий

- слабкий

- Гладкий

- Нюх

- So

- соціальна

- соціальні медіа

- соціальні медіа-платформи

- solid

- деякі

- що в сім'ї щось

- Звучати

- Джерела

- говорити

- Гучномовець

- конкретний

- відпрацьований

- плями

- стабільний

- Стажування

- зацікавлених сторін

- стандартів

- старт

- Стартапи

- стан

- Штати

- залишатися

- Як і раніше

- акції

- Акції

- удар

- Дослідження

- Вивчення

- тема

- підтримка

- Переконайтеся

- система

- Systems

- Приймати

- Takeaways

- взяття

- стрічка

- технології

- технічний сектор

- Технологія

- Тести

- ніж

- Що

- Команда

- Майбутнє

- світ

- їх

- Їх

- Там.

- Ці

- вони

- речі

- це

- У цьому році

- ті

- хоча?

- загрожують

- три

- через

- удар

- час

- під назвою

- до

- сьогодні

- разом

- Жетони

- занадто

- інструменти

- теми

- торгувати

- Навчання

- тривожний

- правда

- козир

- намагається

- два

- типово

- нас

- Ukraine

- незрозуміло

- при

- однозначно

- United

- Сполучені Штати

- на відміну від

- до

- на

- Використання

- використання

- використовуваний

- використання

- утиліта

- різний

- Овочі

- підприємство

- дуже

- через

- Відео

- життєво важливий

- добровільно

- чекати

- Очікування

- хотіти

- війна

- було

- шлях..

- we

- ДОБРЕ

- пішов

- були

- Що

- будь

- коли

- який

- в той час як

- білий

- Білий дім

- ВООЗ

- всі

- волі

- Провід

- Провід в шахрайстві

- з

- в

- без

- слово

- працював

- світ

- світі

- хвилювалися

- гірше

- вартість

- б

- письменник

- лист

- письмовий

- Неправильно

- X

- рік

- років

- ще

- зефірнет