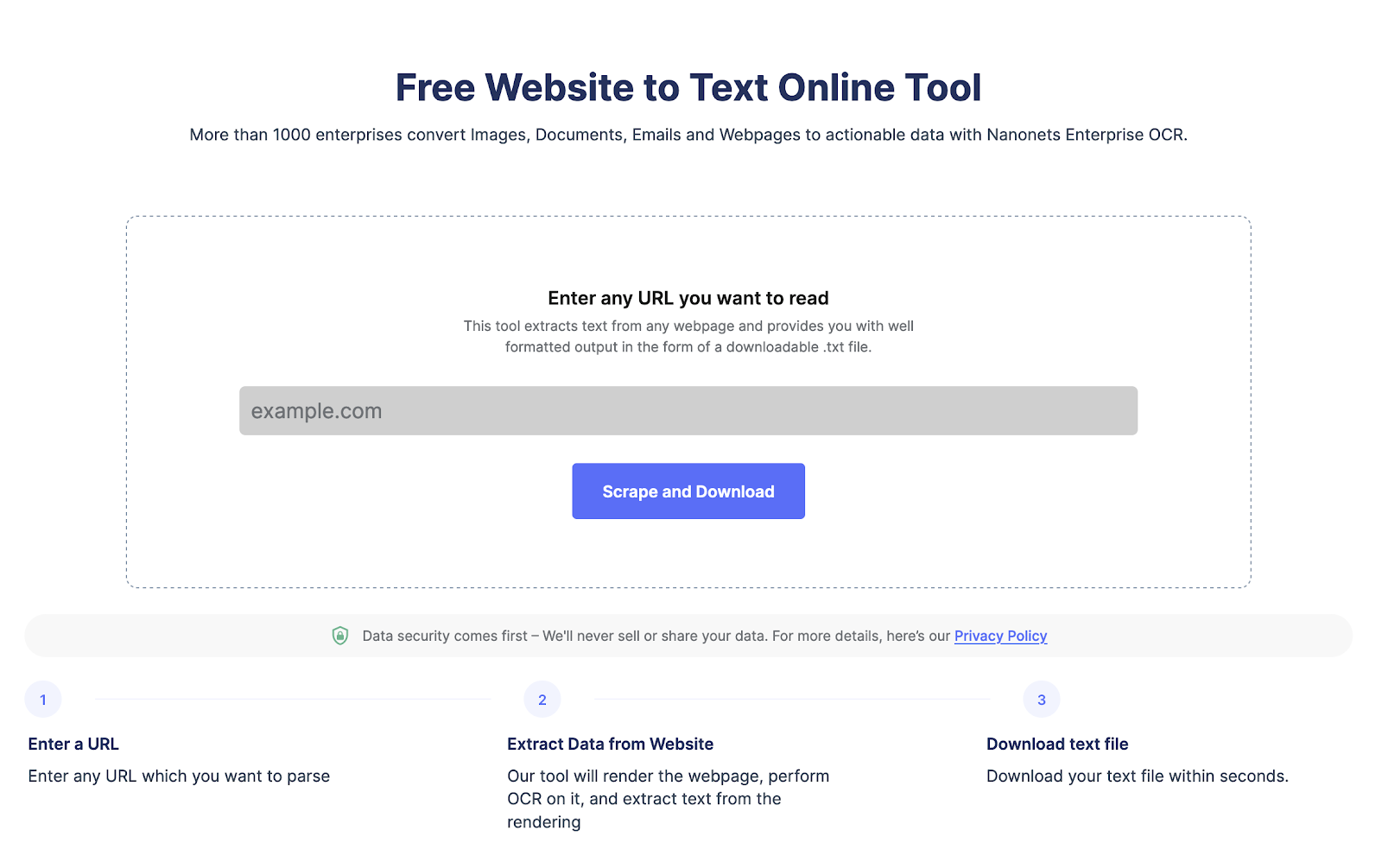

Хочете отримати дані з веб-сторінки?

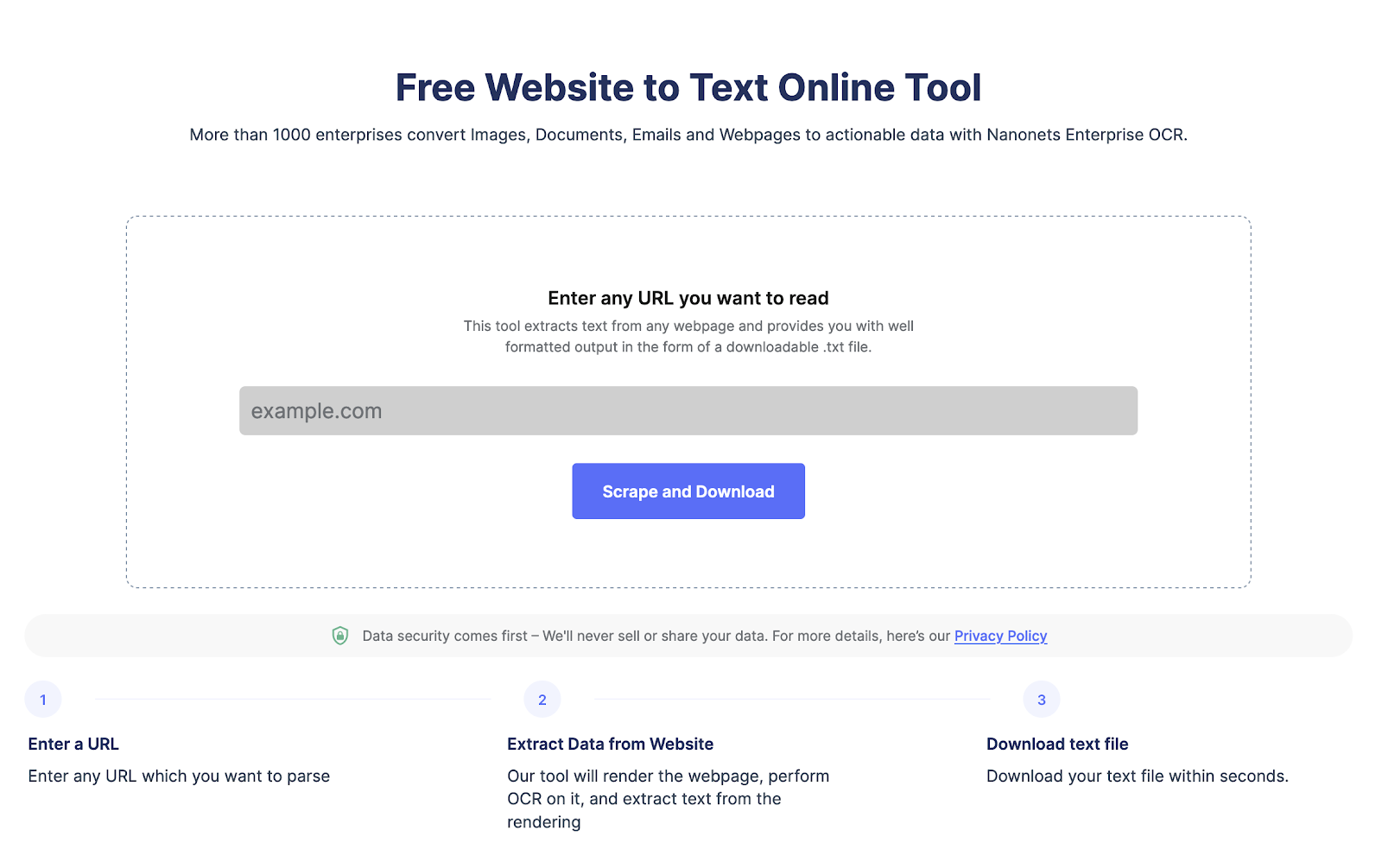

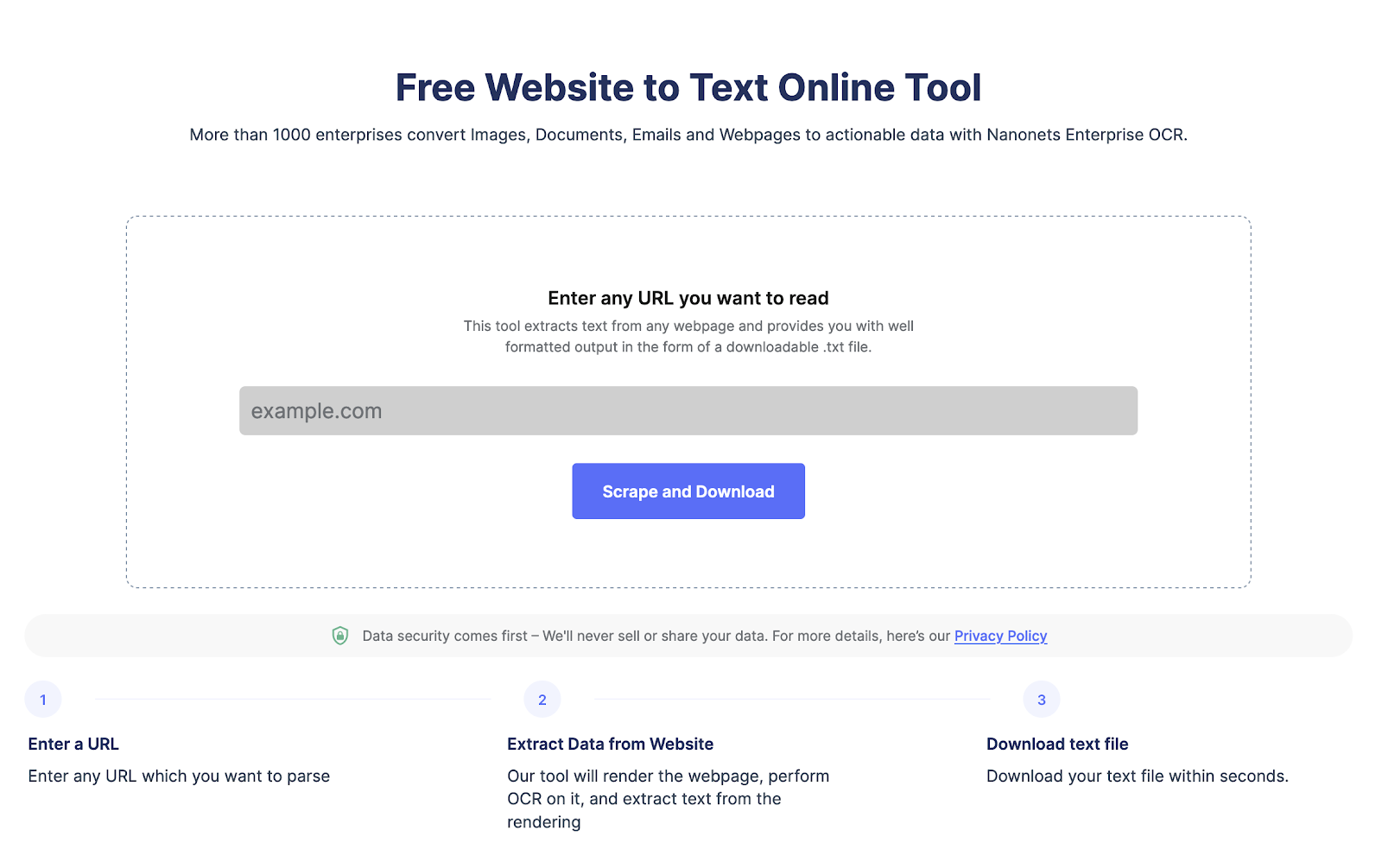

Переходьте до Nanonet скрапер веб-сайту, Додайте URL-адресу та натисніть «Вилучити», щоб миттєво завантажити текст веб-сторінки як файл. Спробуйте безкоштовно зараз.

Що таке Selenium Web Scraping?

Веб-збирання — це процес вилучення даних із веб-сайтів. Це потужна техніка, яка революціонізує збір і аналіз даних. Завдяки величезній кількості онлайн-даних веб-скрейпінг став важливим інструментом для компаній і окремих осіб.

Selenium — це інструмент веб-розробки з відкритим кодом, який використовується для автоматизації функцій веб-перегляду. Він був розроблений у 2004 році та в основному використовується для автоматичного тестування веб-сайтів і програм у різних браузерах, але зараз він став популярним інструментом для веб-збирання. Selenium можна використовувати з кількома мовами програмування, включаючи Python, Java та C#. Він надає надійні API для взаємодії з веб-сторінками, включаючи навігацію, клацання, введення тексту та прокручування.

Веб-збирання Selenium стосується використання інструменту автоматизації браузера Selenium із Python для отримання даних із веб-сайтів. Selenium дозволяє розробникам програмно керувати веб-браузером, тобто вони можуть взаємодіяти з веб-сайтами так, ніби вони люди.

Навіщо використовувати Selenium і Python для веб-збирання?

Python є популярною мовою програмування для веб-скрапінгу, оскільки він має багато бібліотек і фреймворків, які спрощують вилучення даних із веб-сайтів.

Використання Python і Selenium для веб-скрейпінгу має кілька переваг перед іншими методами веб-скрапінгу:

- Динамічні веб-сайти: Динамічні веб-сторінки створюються за допомогою JavaScript або інших мов сценаріїв. Ці сторінки часто містять видимі елементи після того, як сторінка повністю завантажена або коли користувач взаємодіє з ними. Selenium може взаємодіяти з цими елементами, що робить його потужним інструментом для збирання даних із динамічних веб-сторінок.

- Взаємодія з користувачем: Selenium може імітувати взаємодію користувача, як-от клацання, надсилання форм і прокручування. Це дозволяє очищати веб-сайти, які потребують введення користувача, наприклад, форми входу.

- Налагодження: Selenium можна запускати в режимі налагодження, що дає змогу проходити процес збирання та бачити, що робить скребок на кожному кроці. Це корисно для усунення несправностей, коли щось йде не так.

Передумови для веб-збирання за допомогою Selenium:

У вашій системі встановлено Python 3.

Встановлена бібліотека Selenium. Ви можете встановити його за допомогою pip за допомогою такої команди:

pip install SeleniumWebDriver встановлено.

WebDriver — це окремий виконуваний файл, який Selenium використовує для керування браузером. Ось посилання, які я знайшов, щоб завантажити WebDriver для найпопулярніших браузерів:

Крім того, і це найпростіший спосіб, ви також можете встановити WebDriver за допомогою менеджера пакунків, наприклад веб-менеджера драйверів. Це автоматично завантажить і встановить відповідний веб-драйвер для вас. Щоб встановити веб-драйвер-менеджер, ви можете скористатися такою командою:

pip install webdriver-managerВитягніть повний текст із веб-сторінки за лічені секунди!

Переходьте до Nanonet скрапер веб-сайту, Додайте URL-адресу та натисніть «Вилучити», щоб миттєво завантажити текст веб-сторінки як файл. Спробуйте безкоштовно зараз.

Покроковий посібник із веб-збирання Selenium

Крок 1: встановлення та імпорт

Перш ніж почати, ми переконалися, що встановили Selenium і відповідний драйвер. У цьому прикладі ми будемо використовувати драйвер Edge.

from selenium import webdriver

from Selenium.webdriver.common.keys import Keys

from Selenium.webdriver.common.by import ByКрок 2. Встановіть і отримайте доступ до WebDriver

Ми можемо створити новий екземпляр драйвера Edge, запустивши такий код:

driver = webdriver.Edge()Крок 3. Доступ до веб-сайту через Python

Далі нам потрібно отримати доступ до веб-сайту пошукової системи. У цьому випадку ми будемо використовувати Bing.

driver.get("https://www.bing.com")Крок 4. Знайдіть конкретну інформацію, яку ви збираєте

Ми хочемо отримати кількість результатів пошуку для певного імені. Ми можемо зробити це, знайшовши елемент HTML, який містить кількість результатів пошуку

results = driver.find_elements(By.XPATH, "//*[@id='b_tween']/span")Крок 5: Зробіть це разом

Тепер, коли у нас є всі частини, ми можемо об’єднати їх, щоб отримати результати пошуку для конкретного імені.

try:

search_box = driver.find_element(By.NAME, "q")

search_box.clear()

search_box.send_keys("John Doe") # enter your name in the search box

search_box.submit() # submit the search

results = driver.find_elements(By.XPATH, "//*[@id='b_tween']/span")

for result in results:

text = result.text.split()[1] # extract the number of results

print(text)

# save it to a file

with open("results.txt", "w") as f:

f.write(text)

except Exception as e:

print(f"An error occurred: {e}")Крок 6: Збережіть дані

Нарешті, ми можемо зберегти витягнуті дані в текстовому файлі.

з open(“results.txt”, “w”) як f:

f.write(text)Використання проксі з Selenium Wire

Selenium Wire — це бібліотека, яка розширює функціональні можливості Selenium, дозволяючи вам перевіряти та змінювати HTTP-запити та відповіді. Наприклад, його також можна використовувати для легкого налаштування проксі-сервера для вашого Selenium WebDriver

Встановіть селеновий дріт

pip install selenium-wireНалаштуйте проксі

from selenium import webdriver

from Selenium.webdriver.chrome.options import Options

from seleniumwire import webdriver as wiredriver

PROXY_HOST = 'your.proxy.host'

PROXY_PORT = 'your_proxy_port'

chrome_options = Options()

chrome_options.add_argument('--proxy-server=http://{}:{}'.format(PROXY_HOST, PROXY_PORT))

driver = wiredriver.Chrome(options=chrome_options)Використовуйте Selenium Wire для перевірки та зміни запитів.

for request in driver.requests:

if request.response:

print(request.url, request.response.status_code, request.response.headers['Content-Type'])У наведеному вище коді ми переглядаємо всі запити, зроблені WebDriver під час сеансу веб-збирання. Для кожного запиту ми перевіряємо, чи отримано відповідь, і друкуємо URL-адресу, код статусу та тип вмісту відповіді

Використання Selenium для вилучення всіх заголовків із веб-сторінки

Ось приклад коду Python, який використовує Selenium для очищення всіх заголовків веб-сторінки:

from selenium import webdriver

# Initialize the webdriver

driver = webdriver.Chrome()

# Navigate to the webpage

driver.get("https://www.example.com")

# Find all the title elements on the page

title_elements = driver.find_elements_by_tag_name("title")

# Extract the text from each title element

titles = [title.text for title in title_elements]

# Print the list of titles

print(titles)

# Close the webdriver

driver.quit()У цьому прикладі ми спочатку імпортуємо модуль веб-драйвера з Selenium, а потім ініціалізуємо новий екземпляр веб-драйвера Chrome. Ми переходимо до веб-сторінки, яку хочемо отримати, а потім використовуємо метод find_elements_by_tag_name, щоб знайти всі елементи заголовка на сторінці.

Потім ми використовуємо розуміння списку, щоб витягти текст з кожного елемента заголовка та зберегти отриманий список заголовків у змінній під назвою titles. Нарешті, ми друкуємо список заголовків і закриваємо примірник веб-драйвера.

Зауважте, що для роботи цього коду у вашому середовищі Python потрібно встановити пакети веб-драйверів Selenium і Chrome. Ви можете встановити їх за допомогою pip, наприклад:

pip install selenium chromedriver-binaryТакож не забудьте оновити URL-адресу в драйвері. отримати метод вказівки на веб-сторінку, яку ви хочете отримати.

Висновок

Підсумовуючи, веб-скрейпінг за допомогою Selenium є потужним інструментом для отримання даних із веб-сайтів. Це дозволяє вам автоматизувати процес збору даних і може заощадити ваш час і зусилля. Використовуючи Selenium, ви можете взаємодіяти з веб-сайтами так само, як користувач-людина, і витягувати потрібні дані більш ефективно.

Крім того, ви можете використовувати інструменти без коду, такі як Nanonets інструмент скребка веб-сайту щоб легко витягти всі текстові елементи з HTML. Використовувати його можна повністю безкоштовно.

Витягніть текст із будь-якої веб-сторінки одним клацанням миші. Переходьте до Nanonet скрапер веб-сайту, Додайте URL-адресу та натисніть «Вилучити», щоб миттєво завантажити текст веб-сторінки як файл. Спробуйте безкоштовно зараз.

Поширені запитання:

Селен краще ніж BeautifulSoup?

Selenium і BeautifulSoup — це інструменти, які служать різним цілям у веб-збиранні. Хоча Selenium в основному використовується для автоматизації веб-браузерів, BeautifulSoup — це бібліотека Python для аналізу документів HTML і XML.

Selenium краще, ніж BeautifulSoup, коли справа доходить до сканування динамічних веб-сторінок. Динамічні веб-сторінки створюються за допомогою JavaScript або інших мов сценаріїв. Ці сторінки часто містять елементи, які не видно, доки сторінка не буде повністю завантажена або поки користувач не взаємодіє з ними. Selenium може взаємодіяти з цими елементами, що робить його потужним інструментом для збирання даних із динамічних веб-сторінок.

З іншого боку, BeautifulSoup кращий за Selenium під час аналізу документів HTML і XML. BeautifulSoup надає простий і інтуїтивно зрозумілий інтерфейс для аналізу документів HTML і XML і вилучення необхідних даних. Це легка бібліотека, для якої не потрібен веб-браузер, що в деяких випадках робить її швидшою та ефективнішою, ніж Selenium.

Підсумовуючи, чи краще Selenium, ніж BeautifulSoup, залежить від завдання. Якщо вам потрібно отримати дані з динамічних веб-сторінок, то Selenium є кращим вибором. Однак якщо вам потрібно аналізувати документи HTML і XML, то BeautifulSoup є кращим вибором.

Мені використовувати Selenium чи Scrapy?

Selenium в основному використовується для автоматизації веб-браузерів і найкраще підходить для збирання даних із динамічних веб-сторінок. Якщо вам потрібно взаємодіяти з веб-сторінками, які містять елементи, які не видно, доки сторінка не буде повністю завантажена або поки користувач не взаємодіє з ними, тоді Selenium є кращим вибором. Selenium також може взаємодіяти з веб-сторінками, які вимагають автентифікації або інших форм введення користувача.

З іншого боку, Scrapy — це фреймворк веб-збирання на основі Python, розроблений для видалення даних зі структурованих веб-сайтів. Це потужний і гнучкий інструмент, який надає багато функцій для сканування та аналізу веб-сайтів. Його можна використовувати для збирання даних із кількох сторінок або веб-сайтів і виконання складних завдань збирання, таких як переходи за посиланнями та розбиття на сторінки. Scrapy також є більш ефективним, ніж Selenium, щодо ресурсів пам’яті та обробки, що робить його кращим вибором для масштабних проектів веб-збирання.

Чи варто вам використовувати Selenium чи Scrapy, залежить від конкретних вимог вашого проекту веб-збирання. Якщо вам потрібно отримати дані з динамічних веб-сторінок або взаємодіяти з веб-сторінками, які вимагають автентифікації або іншого введення користувача, тоді Selenium є кращим вибором. Однак, якщо вам потрібно отримати дані зі структурованих веб-сайтів або виконати складні завдання збирання, тоді Scrapy стане кращим вибором.

Яка мова найкраща для веб-скопіювання?

Python є однією з найпопулярніших мов для веб-скрапінгу завдяки своїй простоті використання, великому вибору бібліотек і потужним фреймворкам скрапінгу, таким як Scrapy, requests, beautifulSoup і Selenium. Python також простий у вивченні та використанні, що робить його чудовим вибором для початківців

Багато мов програмування можна використовувати для веб-збирання, але деякі краще підходять для цього завдання, ніж інші. Найкраща мова для веб-скопіювання залежить від різних факторів, таких як складність завдання, цільовий веб-сайт і ваші особисті уподобання.

Інші мови, такі як R, JavaScript і PHP, також можна використовувати залежно від конкретних вимог вашого проекту веб-скрапінгу.

Чому селен важливий для веб-збирання?

Selenium є важливим інструментом у веб-збиранні з кількох причин:

Викопування динамічних веб-сторінок: сьогодні багато веб-сайтів використовують динамічний вміст і взаємодії з користувачем для відображення даних. Це означає, що багато вмісту на веб-сайті завантажується через JavaScript або AJAX. Selenium дуже ефективний у скануванні цих динамічних веб-сайтів, оскільки він може взаємодіяти з елементами на сторінці та імітувати взаємодію користувача, наприклад прокручування та клацання. Це полегшує збирання даних із веб-сайтів, які значною мірою залежать від динамічного вмісту. Він найкраще підходить для обробки файлів cookie та сеансів, автоматизованого тестування, сумісності між браузерами та масштабованості:

Чи можна використовувати Selenium і BeautifulSoup разом?

Так, ви можете використовувати їх разом. Selenium в основному взаємодіє з веб-сторінками та імітує взаємодію користувача, наприклад натискання, прокручування та заповнення форм. З іншого боку, BeautifulSoup — це бібліотека Python, яка використовується для аналізу документів HTML і XML і вилучення з них даних. Об’єднавши Selenium і BeautifulSoup, ви можете створити потужний інструмент веб-збирання для взаємодії з веб-сторінками та вилучення з них даних. Selenium може обробляти динамічний вміст і взаємодію з користувачем, тоді як BeautifulSoup може аналізувати HTML і витягувати дані з джерела сторінки.

Однак варто зазначити, що використання обох інструментів разом може потребувати більше ресурсів і повільніше, ніж використання одного. Отже, дуже важливо оцінити вимоги вашого проекту веб-збирання та вибрати правильні інструменти для роботи.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- Платоблокчейн. Web3 Metaverse Intelligence. Розширені знання. Доступ тут.

- джерело: https://nanonets.com/blog/web-scraping-with-selenium/

- :є

- $UP

- 1

- 10

- 7

- a

- вище

- доступ

- через

- Переваги

- ВСІ

- Дозволити

- дозволяє

- аналіз

- та

- Інтерфейси

- відповідний

- додатка

- ЕСТЬ

- AS

- At

- Authentication

- автоматизувати

- Автоматизований

- автоматично

- автоматизація

- Автоматизація

- BE

- оскільки

- ставати

- починати

- КРАЩЕ

- Краще

- Bing

- Box

- браузер

- браузери

- Перегляд

- підприємства

- by

- званий

- CAN

- випадок

- випадків

- перевірка

- вибір

- Вибирати

- Chrome

- клацання

- близько

- код

- Збір

- збір

- COM

- об'єднувати

- об'єднання

- загальний

- сумісність

- повний

- повністю

- комплекс

- складність

- висновок

- містить

- зміст

- контроль

- печиво

- створювати

- створений

- крос-браузер

- дані

- справу

- залежний

- Залежно

- залежить

- призначений

- розвиненою

- розробників

- розробка

- різний

- дисплей

- документація

- DOE

- справи

- скачати

- водій

- під час

- динамічний

- e

- кожен

- простота використання

- легше

- Найпростіший

- легко

- край

- Ефективний

- ефективний

- продуктивно

- зусилля

- елемент

- елементи

- двигун

- Що натомість? Створіть віртуальну версію себе у

- Навколишнє середовище

- помилка

- істотний

- Ефір (ETH)

- оцінювати

- приклад

- Крім

- виняток

- витяг

- витяг даних

- фактори

- швидше

- риси

- філе

- в кінці кінців

- знайти

- Перший

- гнучкий

- після

- для

- форма

- форми

- знайдений

- Рамки

- каркаси

- Безкоштовна

- від

- повністю

- функціональність

- Функції

- отримати

- Go

- великий

- керівництво

- рука

- обробляти

- Обробка

- Мати

- голова

- сильно

- тут

- господар

- Однак

- HTML

- HTTP

- HTTPS

- людина

- i

- імпорт

- важливо

- in

- У тому числі

- осіб

- інформація

- вхід

- встановлювати

- екземпляр

- взаємодіяти

- взаємодія

- Взаємодії

- взаємодіє

- інтерфейс

- інтуїтивний

- IT

- ЙОГО

- Java

- JavaScript

- робота

- Джон

- ДЖОН ДОУ

- тільки один

- ключі

- мова

- мови

- великий

- масштабний

- УЧИТЬСЯ

- libraries

- бібліотека

- легкий

- як

- зв'язку

- список

- серія

- made

- зробити

- РОБОТИ

- Робить

- менеджер

- багато

- сенс

- засоби

- пам'ять

- метод

- режим

- змінювати

- Модулі

- більше

- більш ефективний

- найбільш

- Найбільш популярний

- множинний

- ім'я

- Переміщення

- навігація

- Необхідність

- Нові

- номер

- сталося

- of

- Пропозиції

- on

- ONE

- онлайн

- з відкритим вихідним кодом

- Опції

- Інше

- інші

- пакет

- пакети

- сторінка

- Нумерація сторінок

- приватність

- виконувати

- персонал

- PHP

- частин

- plato

- Інформація про дані Платона

- PlatoData

- точка

- популярний

- потужний

- в першу чергу

- друк

- процес

- обробка

- Програмування

- мови програмування

- проект

- проектів

- забезпечує

- повноваження

- цілей

- Python

- Причини

- отримано

- відноситься

- про

- регулярний

- запросити

- запитів

- вимагати

- Вимога

- ресурсомісткий

- ресурси

- відповідь

- результат

- в результаті

- результати

- революціонізує

- міцний

- прогін

- біг

- s

- зберегти

- масштабованість

- вишкрібання

- прокрутки

- Пошук

- Пошукова система

- вибір

- окремий

- служити

- Сесія

- сесіях

- кілька

- Повинен

- значний

- простий

- So

- деякі

- Source

- конкретний

- Статус

- Крок

- зберігати

- структурований

- Матеріали

- представляти

- такі

- РЕЗЮМЕ

- система

- Мета

- Завдання

- завдання

- методи

- тест

- Тестування

- Що

- Команда

- Їх

- Ці

- речі

- через

- час

- назва

- назви

- до

- сьогодні

- разом

- інструмент

- інструменти

- Оновити

- URL

- використання

- користувач

- користувачі

- різний

- величезний

- через

- видимий

- W

- шлях..

- Web

- веб-браузер

- Веб-браузери

- Веб-розробка

- веб-вискоблювання

- веб-сайт

- веб-сайти

- Що

- Чи

- який

- в той час як

- волі

- Провід

- з

- Work

- вартість

- Неправильно

- XML

- вашу

- зефірнет