Ми віримо, що генеративний штучний інтелект може з часом трансформувати практично всі знайомі клієнти. Кількість компаній, які запускають генеративні програми штучного інтелекту на AWS, є значною та швидко зростає, зокрема adidas, Booking.com, Bridgewater Associates, Clariant, Cox Automotive, GoDaddy та LexisNexis Legal & Professional, і це лише деякі з них. Інноваційні стартапи, такі як Perplexity AI, йдуть ва-банк на AWS для генеративного ШІ. Провідні компанії зі штучного інтелекту, такі як Anthropic, обрали AWS своїм основним хмарним постачальником для критично важливих робочих навантажень і місцем для навчання своїх майбутніх моделей. А глобальні постачальники послуг і рішень, такі як Accenture, отримують переваги персоналізованих генеративних додатків штучного інтелекту, оскільки вони надають своїм власним розробникам можливості Amazon Code Whisperer.

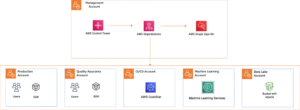

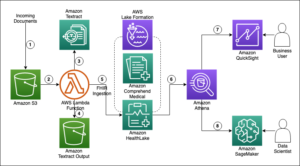

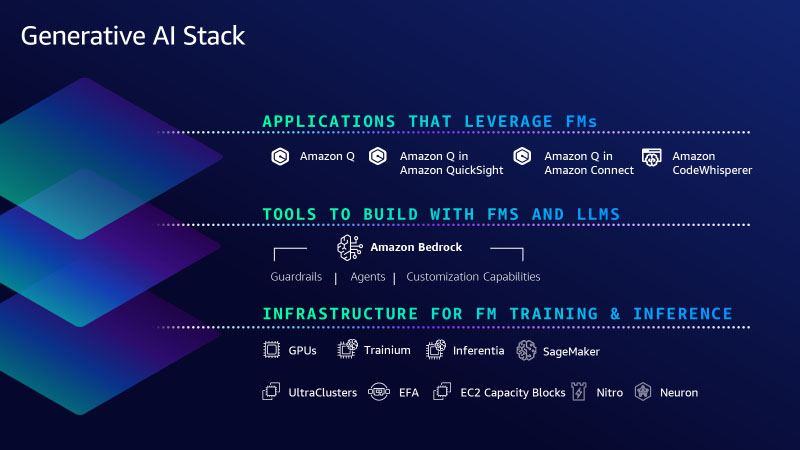

Ці клієнти обирають AWS, тому що ми зосереджені на тому, що робили завжди,—використанні складних і дорогих технологій, які можуть змінити досвід клієнтів і бізнес, і демократизації їх для клієнтів будь-якого розміру та технічних можливостей. Для цього ми інвестуємо та швидко впроваджуємо інновації, щоб забезпечити найповніший набір можливостей на трьох рівнях генеративного стеку AI. Нижній рівень – це інфраструктура для навчання великих мовних моделей (LLM) та інших базових моделей (FM) і створення висновків або прогнозів. Середній рівень — це легкий доступ до всіх моделей та інструментів, необхідних клієнтам для створення та масштабування генеративних додатків штучного інтелекту з тією самою безпекою, контролем доступу та іншими функціями, які клієнти очікують від служби AWS. А на верхньому рівні ми інвестували в додатки, що змінюють правила гри, у таких ключових сферах, як генеративне кодування на основі ШІ. Окрім того, що клієнти пропонують їм вибір і — як вони очікують від нас — широкий і глибинний потенціал на всіх рівнях, клієнти також говорять нам, що вони цінують наш підхід, орієнтований на першочергові дані, і вірять, що ми створили все з нуля на корпоративному рівні. рівень безпеки та конфіденційності.

Цього тижня ми зробили великий крок вперед, оголосивши про багато важливих нових можливостей на всіх трьох рівнях стеку, щоб зробити нашим клієнтам легким і практичним повсюдне використання генеративного ШІ у своєму бізнесі.

Нижній рівень стека: AWS Trainium2 — це останнє доповнення, яке забезпечує найдосконалішу хмарну інфраструктуру для генеративного штучного інтелекту.

Нижній рівень стеку — це інфраструктура — обчислення, мережа, фреймворки, сервіси — необхідна для навчання та запуску LLM та інших FM. AWS впроваджує інновації, щоб запропонувати найсучаснішу інфраструктуру для машинного навчання. Завдяки нашій давній співпраці з NVIDIA AWS була першою, хто переніс графічні процесори в хмару понад 12 років тому, а нещодавно ми були першим великим постачальником хмарних технологій, який зробив доступними графічні процесори NVIDIA H100 з нашими екземплярами P5. Ми продовжуємо інвестувати в унікальні інновації, які роблять AWS найкращою хмарою для роботи графічних процесорів, включаючи переваги ціни та продуктивності найдосконалішої системи віртуалізації (AWS Nitro), потужної петабітної мережі з адаптером Elastic Fabric (EFA) і гіпер- масштабна кластеризація за допомогою Amazon EC2 UltraClusters (тисячі прискорених інстансів, розташованих у зоні доступності та з’єднаних між собою в неблокуючу мережу, яка може надавати до 3,200 Гбіт/с для масового навчання ML). Ми також полегшуємо будь-якому клієнту доступ до високо затребуваної обчислювальної потужності GPU для генеративного штучного інтелекту за допомогою Amazon EC2 Capacity Blocks for ML — першої та єдиної моделі споживання в галузі, яка дозволяє клієнтам резервувати GPU для використання в майбутньому (до 500). розгорнуто в EC2 UltraClusters) для короткочасних робочих навантажень машинного навчання.

Кілька років тому ми зрозуміли, що, щоб продовжувати розвивати цінову ефективність, нам потрібно буде впроваджувати інновації аж до кремнію, і ми почали інвестувати у власні чіпи. Спеціально для машинного навчання ми почали з AWS Inferentia, нашої спеціально створеної мікросхеми логічного висновку. Сьогодні ми працюємо над нашим другим поколінням AWS Inferentia з екземплярами Amazon EC2 Inf2, оптимізованими спеціально для великомасштабних генеративних додатків ШІ з моделями, що містять сотні мільярдів параметрів. Екземпляри Inf2 пропонують найнижчу вартість виводу в хмарі, а також забезпечують до чотирьох разів вищу пропускну здатність і до десяти разів меншу затримку порівняно з екземплярами Inf1. На базі до 12 чіпів Inferentia2 Inf2 — це єдині екземпляри EC2, оптимізовані для логічного висновку, які мають високошвидкісне з’єднання між прискорювачами, завдяки чому клієнти можуть виконувати логічні висновки швидше та ефективніше (з меншою ціною) без шкоди для продуктивності чи затримки шляхом розповсюдження надвеликих моделей. на кількох прискорювачах. Такі клієнти, як Adobe, Deutsche Telekom і Leonardo.ai, бачили чудові ранні результати та раді розгортати свої моделі в Inf2.

Що стосується навчання, екземпляри Trn1 — на базі спеціально розробленого навчального чіпа ML від AWS, AWS Trainium — оптимізовані для розподілу навчання між декількома серверами, підключеними до мережі EFA. Клієнти, такі як Ricoh, навчили японського LLM із мільярдами параметрів за лічені дні. Databricks отримує на 40% кращу ціну-продуктивність завдяки примірникам на основі Trainium для навчання великомасштабних моделей глибокого навчання. Але з новими, потужнішими моделями, які з’являються практично щотижня, ми продовжуємо розширювати межі продуктивності та масштабу, і ми раді оголосити AWS Trainium2, розроблений, щоб забезпечити ще кращу цінову ефективність для навчальних моделей із сотнями мільярдів до трильйонів параметрів. Trainium2 повинен забезпечувати в чотири рази більшу продуктивність навчання, ніж Trainium першого покоління, а при використанні в EC2 UltraClusters повинен забезпечувати до 65 екзафлопс сукупних обчислень. Це означає, що клієнти зможуть навчати LLM із 300 мільярдами параметрів за тижні чи місяці. Продуктивність, масштаб і енергоефективність Trainium2 є одними з причин, чому Anthropic вирішила навчити свої моделі на AWS і використовуватиме Trainium2 для своїх майбутніх моделей. І ми співпрацюємо з Anthropic над продовженням інновацій як з Trainium, так і з Inferentia. Ми очікуємо, що наші перші екземпляри Trainium2 будуть доступні клієнтам у 2024 році.

Ми також подвоювали ланцюжок інструментів програмного забезпечення для нашого ML-процесора, зокрема, вдосконалюючи AWS Neuron, комплект розробки програмного забезпечення (SDK), який допомагає клієнтам отримати максимальну продуктивність від Trainium та Inferentia. З моменту представлення Neuron у 2019 році ми зробили значні інвестиції в технології компілятора та фреймворку, і сьогодні Neuron підтримує багато найпопулярніших загальнодоступних моделей, зокрема Llama 2 від Meta, MPT від Databricks і Stable Diffusion від Stability AI, а також 93 зі 100 найкращих моделей у популярному репозиторії моделей Hugging Face. Neuron підключається до популярних фреймворків ML, таких як PyTorch і TensorFlow, а підтримка JAX з’явиться на початку наступного року. Клієнти повідомляють нам, що Neuron спростив для них перемикання існуючих конвеєрів навчання моделей і висновків на Trainium і Inferentia за допомогою лише кількох рядків коду.

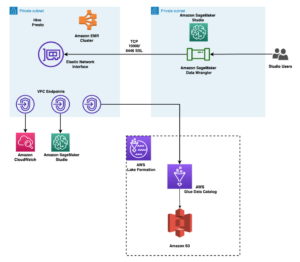

Ніхто інший не пропонує таку ж комбінацію вибору найкращих чіпів ML, надшвидкої мережі, віртуалізації та гіпермасштабованих кластерів. Тому не дивно, що деякі з найвідоміших генеративних AI-стартапів, як-от AI21 Labs, Anthropic, Hugging Face, Perplexity AI, Runway і Stability AI, працюють на AWS. Але вам все одно потрібні правильні інструменти для ефективного використання цих обчислень для створення, навчання та запуску LLM та інших FM ефективних і економічно ефективних. І для багатьох із цих стартапів Amazon SageMaker це відповідь. Незалежно від того, створюєте та навчаєте нову запатентовану модель з нуля чи починаєте з однієї з багатьох популярних загальнодоступних моделей, навчання є складною та дорогою справою. Економічно використовувати ці моделі також нелегко. Клієнти повинні отримати великі обсяги даних і підготувати їх. Зазвичай це передбачає велику кількість ручної роботи з очищення даних, видалення дублікатів, їх збагачення та перетворення. Потім їм доводиться створювати та підтримувати великі кластери графічних процесорів/прискорювачів, писати код для ефективного розподілу навчання моделі між кластерами, часто контролювати, призупиняти, перевіряти та оптимізувати модель, а також вручну втручатися та виправляти апаратні проблеми в кластері. Багато з цих викликів не є новими, це деякі з причин, чому ми запустили SageMaker шість років тому, щоб подолати численні бар’єри, пов’язані з навчанням і розгортанням моделі, і надати розробникам набагато простіший шлях. Десятки тисяч клієнтів використовують Amazon SageMaker, і все більше з них, як-от LG AI Research, Perplexity AI, AI21, Hugging Face і Stability AI, навчають LLM та інших спеціалістів на SageMaker. Нещодавно Інститут технологічних інновацій (творці популярних Falcon LLMs) навчив найбільшу загальнодоступну модель — Falcon 180B — на SageMaker. Зі збільшенням розмірів і складності моделей зростає і сфера застосування SageMaker.

Протягом багатьох років ми додали в Amazon SageMaker понад 380 функцій і можливостей, які змінили правила гри, як-от автоматичне налаштування моделі, розподілене навчання, гнучкі параметри розгортання моделі, інструменти для ML OP, інструменти для підготовки даних, сховища функцій, ноутбуки, бездоганна інтеграція з оцінками, які проводить людина в циклі протягом життєвого циклу машинного навчання, і вбудованими функціями для відповідального ШІ. Ми продовжуємо швидко впроваджувати інновації, щоб переконатися, що клієнти SageMaker можуть продовжувати будувати, навчати та запускати висновки для всіх моделей, включаючи LLM та інші FM. І ми робимо навчання та розгортання великих моделей ще простішим та економічнішим для клієнтів завдяки двом новим можливостям. По-перше, ми спрощуємо навчання введення Amazon SageMaker HyperPod який автоматизує більше процесів, необхідних для високомасштабного відмовостійкого розподіленого навчання (наприклад, налаштування розподілених навчальних бібліотек, масштабування навчальних навантажень на тисячі прискорювачів, виявлення та відновлення несправних екземплярів), прискорення навчання на цілих 40%. У результаті такі клієнти, як Perplexity AI, Hugging Face, Stability, Hippocratic, Alkaid та інші, використовують SageMaker HyperPod для створення, навчання або розвитку моделей. по-друге, ми представляємо нові можливості, щоб зробити висновок більш рентабельним, одночасно зменшуючи затримку. Тепер SageMaker допомагає клієнтам розгортати кілька моделей в одному екземплярі, щоб вони могли спільно використовувати обчислювальні ресурси, зменшуючи вартість висновків на 50% (у середньому). SageMaker також активно відстежує екземпляри, які обробляють запити на висновок, і інтелектуально направляє запити на основі доступних екземплярів, досягаючи на 20% меншої затримки висновку (в середньому). Conjecture, Salesforce і Slack уже використовують SageMaker для розміщення моделей через ці оптимізації висновків.

Середній рівень стека: Amazon Bedrock додає нові моделі та хвилю нових можливостей, що спрощує для клієнтів безпечне створення та масштабування генеративних програм ШІ

Хоча багато клієнтів створюватимуть власні LLM та інші FM або розроблятимуть будь-яку кількість загальнодоступних опцій, багато хто не захоче витрачати на це ресурси та час. Для них середній шар стека пропонує ці моделі як послугу. Наше рішення тут, Amazon Bedrock, дозволяє клієнтам вибирати з провідних у галузі моделей від Anthropic, Stability AI, Meta, Cohere, AI21 і Amazon, налаштовувати їх за допомогою власних даних і використовувати ті самі передові засоби безпеки, засоби контролю доступу та функції, до яких вони звикли. в AWS — все через керовану службу. Ми зробили Amazon Bedrock загальнодоступним наприкінці вересня, і реакція клієнтів була надзвичайно позитивною. Клієнти з усього світу та практично в усіх галузях із задоволенням користуються Amazon Bedrock. adidas дає змогу розробникам швидко отримувати відповіді на будь-яке питання, від інформації про початок роботи до глибших технічних питань. Booking.com має намір використовувати генеративний штучний інтелект для написання індивідуальних рекомендацій щодо подорожей для кожного клієнта. Bridgewater Associates розробляє асистента інвестиційного аналітика на базі LLM, який допоможе створювати діаграми, обчислювати фінансові показники та узагальнювати результати. Компанія Carrier робить доступними для клієнтів точнішу аналітику та аналіз енергії, щоб вони зменшили споживання енергії та викиди вуглецю. Clariant розширює можливості членів своєї команди за допомогою внутрішнього генеративного чат-бота зі штучним інтелектом для прискорення процесів досліджень і розробок, підтримки відділів продажів у підготовці зустрічей і автоматизації електронних листів клієнтів. GoDaddy допомагає клієнтам легко налагодити свій бізнес в Інтернеті за допомогою генеративного штучного інтелекту для створення веб-сайтів, пошуку постачальників, спілкування з клієнтами тощо. Lexis Nexis Legal & Professional трансформує юридичну роботу для юристів і підвищує їхню продуктивність за допомогою можливостей розмовного пошуку, узагальнення, підготовки та аналізу документів Lexis+ AI. Nasdaq допомагає автоматизувати робочі процеси розслідування підозрілих транзакцій і посилити свої можливості боротьби з фінансовими злочинами та стеження. Усі ці та багато інших різноманітних генеративних додатків ШІ працюють на AWS.

Ми в захваті від імпульсу для Amazon Bedrock, але це все ще на початку. Працюючи з клієнтами, ми побачили, що всі рухаються швидко, але еволюція генеративного штучного інтелекту продовжується швидкими темпами з новими опціями та інноваціями, які відбуваються практично щодня. Клієнти знаходять, що існують різні моделі, які краще працюють у різних випадках використання або на різних наборах даних. Деякі моделі чудово підходять для узагальнення, інші чудово підходять для міркування та інтеграції, а треті мають справді чудову підтримку мови. Крім того, є генерація зображень, варіанти використання пошуку та багато іншого — усе це надходить як із запатентованих моделей, так і з моделей, які є загальнодоступними. І в часи, коли є так багато непізнаного, здатність адаптуватися є, мабуть, найціннішим інструментом. Не буде однієї моделі, яка керуватиме всіма. І, звичайно, не одна технологічна компанія, яка надає моделі, якими користуються всі. Клієнтам потрібно спробувати різні моделі. Вони повинні мати можливість перемикатися між ними або поєднувати їх в одному варіанті використання. Це означає, що їм потрібен реальний вибір модельних провайдерів (що події останніх 10 днів зробили ще більш ясними). Ось чому ми винайшли Amazon Bedrock, чому він так глибоко резонує з клієнтами, і чому ми продовжуємо впроваджувати інновації та швидко ітерувати, щоб зробити створення (і переміщення між) цілим рядом моделей таким же простим, як виклик API, застосувавши найновіші методи для налаштування моделі в руках усіх розробників, а також для захисту клієнтів і конфіденційності їхніх даних. Ми раді представити кілька нових можливостей, які спростять для клієнтів створення та масштабування генеративних програм ШІ:

- Розширення вибору моделей завдяки Anthropic Claude 2.1, Meta Llama 2 70B і доповненням до сімейства Amazon Titan. У ці перші дні клієнти все ще вивчають і експериментують з різними моделями, щоб визначити, які вони хочуть використовувати для різних цілей. Вони хочуть мати можливість легко випробувати найновіші моделі, а також перевірити, які можливості та функції дадуть їм найкращі результати та характеристики вартості для їхніх випадків використання. Завдяки Amazon Bedrock клієнтам залишається лише один виклик API, щоб отримати нову модель. Деякі з найбільш вражаючих результатів, які клієнти відчули за останні кілька місяців, отримані від LLMs Модель Клода від Anthropic, який відмінно справляється з широким спектром завдань, починаючи від складних діалогів і генерації вмісту до складних міркувань, зберігаючи при цьому високий ступінь надійності та передбачуваності. Клієнти повідомляють, що Claude набагато рідше виробляє шкідливі результати, з ним легше спілкуватися та краще керувати порівняно з іншими FM, тому розробники можуть отримати бажаний результат з меншими зусиллями. Найсучасніша модель Anthropic, Claude 2, набирає більше 90-го процентиля на іспитах з читання та письма GRE, а також на кількісному міркуванні. І тепер нещодавно випущена модель Claude 2.1 доступна в Amazon Bedrock. Claude 2.1 надає такі ключові можливості для підприємств, як провідне в галузі контекстне вікно токенів розміром 200 тис. (у 2 рази більше контексту, ніж у Claude 2.0), знижений рівень галюцинацій і значне підвищення точності навіть при дуже великій довжині контексту. Claude 2.1 також містить покращені системні підказки – модель інструкцій, які забезпечують кращий досвід для кінцевих користувачів – водночас зменшуючи вартість підказок і завершень на 25%.

Для зростаючої кількості клієнтів, які хочуть використовувати керовану версію загальнодоступної моделі Meta Llama 2, Amazon Bedrock пропонує Llama 2 13B і ми додаємо Llama 2 70B. Llama 2 70B підходить для таких масштабних завдань, як моделювання мови, генерація тексту та діалогові системи. Загальнодоступні моделі Llama було завантажено більше 30 мільйонів разів, і клієнтам подобається те, що Amazon Bedrock пропонує їх як частину керованого сервісу, де їм не потрібно турбуватися про інфраструктуру або мати глибокий досвід ML у своїх командах. Крім того, для створення зображень Stability AI пропонує набір популярних моделей перетворення тексту в зображення. Stable Diffusion XL 1.0 (SDXL 1.0) є найдосконалішим із них, і тепер він загальнодоступний на Amazon Bedrock. Останнє видання цієї популярної моделі зображень має підвищену точність, кращу фотореалістичність і вищу роздільну здатність.

Клієнти також використовують Амазонський титан моделі, створені та попередньо навчені AWS, щоб запропонувати потужні можливості з чудовою економічністю для різноманітних випадків використання. Amazon має 25-річний досвід у сфері машинного навчання та штучного інтелекту — технологій, які ми використовуємо в наших компаніях, — і ми багато чого навчилися про створення та розгортання моделей. Ми ретельно вибрали спосіб навчання наших моделей і дані, які використовуємо для цього. Ми звільняємо клієнтів від претензій про те, що наші моделі чи їхні результати порушують чиїсь авторські права. Ми представили наші перші моделі Titan у квітні цього року. Titan Text Lite— тепер загальнодоступний— є короткою, економічно ефективною моделлю для таких випадків використання, як чат-боти, узагальнення тексту чи копірайтингу, і вона також приваблива для тонкого налаштування. Titan Text Express — тепер також загальнодоступний— є більш розширеним і може використовуватися для ширшого кола текстових завдань, таких як створення відкритого тексту та розмовний чат. Ми пропонуємо ці варіанти текстової моделі, щоб надати клієнтам можливість оптимізувати точність, продуктивність і вартість залежно від їх використання та бізнес-вимог. Такі клієнти, як Nexxiot, PGA Tour і Ryanair, використовують наші дві моделі Titan Text. У нас також є модель вбудовування Titan Text Embeddings для випадків використання пошуку та персоналізації. Клієнти, такі як Nasdaq, бачать чудові результати, використовуючи Titan Text Embeddings для покращення можливостей Nasdaq IR Insight для отримання інформації з документів понад 9,000 глобальних компаній для відділів сталого розвитку, юридичних і бухгалтерських команд. І з часом ми продовжуватимемо додавати нові моделі до сімейства Titan. Ми представляємо нову модель вбудовування Titan Multimodal Embeddings, щоб забезпечити мультимодальний пошук і рекомендації для користувачів, які використовують зображення та текст (або їх комбінацію) як вхідні дані. І ми є Представляємо нову модель перетворення тексту в зображення Amazon Titan Image Generator. За допомогою Titan Image Generator клієнти в таких галузях, як реклама, електронна комерція, засоби масової інформації та розваги, можуть використовувати введення тексту для створення реалістичних зображень студійної якості у великих обсягах і за низьку вартість. Ми в захваті від того, як клієнти реагують на моделі Titan, і ви можете сподіватися, що ми продовжимо впроваджувати інновації.

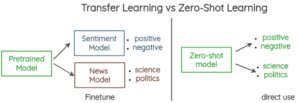

- Нові можливості для безпечного налаштування вашої генеративної програми ШІ за допомогою ваших власних даних: Однією з найважливіших можливостей Amazon Bedrock є те, наскільки легко можна налаштувати модель. Це стає справді захоплюючим для клієнтів, оскільки саме тут генеративний штучний інтелект зустрічається з їхніми основними відмінностями — їхніми даними. Однак дуже важливо, щоб їхні дані залишалися в безпеці, щоб вони мали контроль над ними протягом усього шляху, і щоб вдосконалення моделі були приватними для них. Це можна зробити кількома способами, і Amazon Bedrock пропонує найширший вибір варіантів налаштування для кількох моделей). По-перше, це тонке налаштування. Налаштувати модель в Amazon Bedrock легко. Ви просто вибираєте модель, і Amazon Bedrock створює її копію. Потім ви вказуєте на кілька позначених прикладів (наприклад, серію хороших пар запитання-відповідь), які зберігаєте в Amazon Simple Storage Service (Amazon S3), і Amazon Bedrock «поступово навчається» (доповнює скопійовану модель новою інформацією). на цих прикладах, і результатом є приватна, більш точна налаштована модель, яка забезпечує більш релевантні, індивідуальні відповіді. Ми раді повідомити, що тонке налаштування загальнодоступне для Cohere Command, Meta Llama 2, Amazon Titan Text (Lite та Express), Amazon Titan Multimodal Embeddings і в попередній версії для Amazon Titan Image Generator. І завдяки нашій співпраці з Anthropic незабаром ми надамо клієнтам AWS ранній доступ до унікальних функцій для налаштування моделі та тонкого налаштування її найсучаснішої моделі Claude.

Другий метод налаштування LLM та інших FM для вашого бізнесу — це розширена генерація пошуку (RAG), яка дозволяє налаштовувати відповіді моделі, доповнюючи підказки даними з багатьох джерел, включаючи сховища документів, бази даних і API. У вересні ми запровадили функцію RAG, Бази знань для Amazon Bedrock, яка надійно з’єднує моделі з вашими власними джерелами даних, щоб доповнювати ваші підказки додатковою інформацією, щоб ваші програми надавали релевантніші, контекстуальні та точні відповіді. Бази знань тепер загальнодоступний з API, який виконує весь робочий процес RAG від отримання тексту, необхідного для доповнення підказки, до надсилання підказки моделі та повернення відповіді. Бази знань підтримують бази даних із векторними можливостями, які зберігають числові представлення ваших даних (вбудовування), які моделі використовують для доступу до цих даних для RAG, включаючи Amazon OpenSearch Service та інші популярні бази даних, такі як Pinecone та Redis Enterprise Cloud (з’являється векторна підтримка Amazon Aurora та MongoDB незабаром).

Третій спосіб налаштування моделей в Amazon Bedrock — це постійне попереднє навчання. За допомогою цього методу модель ґрунтується на початковому попередньому навчанні для загального розуміння мови, щоб вивчити предметно-спеціальну мову та термінологію. Цей підхід призначений для клієнтів, які мають велику кількість немаркованої інформації, пов’язаної з певним доменом, і хочуть, щоб їхні магістри магістра права могли розуміти мову, фрази, абревіатури, концепції, визначення та жаргон, унікальний для їхнього світу (і бізнесу). На відміну від тонкого налаштування, яке займає досить невелику кількість даних, постійне попереднє навчання виконується на великих наборах даних (наприклад, тисячі текстових документів). Тепер у Amazon Bedrock доступні можливості попереднього навчання для Titan Text Lite та Titan Text Express.

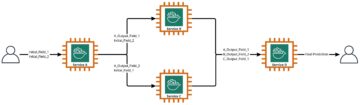

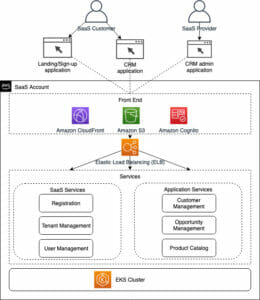

- Загальна доступність Агенти Amazon Bedrock щоб допомогти виконати багатоетапні завдання, використовуючи системи, джерела даних і знання компанії. LLM чудово вміють вести розмови та генерувати вміст, але клієнти хочуть, щоб їхні програми могли це робити do навіть більше, як-от вживати заходів, вирішувати проблеми та взаємодіяти з низкою систем для виконання багатоетапних завдань, таких як бронювання подорожей, подання страхових претензій або замовлення запасних частин. І Amazon Bedrock може допомогти впоратися з цим завданням. За допомогою агентів розробники вибирають модель, пишуть кілька базових інструкцій на зразок «Ви веселий агент з обслуговування клієнтів» і «перевірте наявність продукту в системі інвентаризації», направляєте вибрану модель на потрібні джерела даних і корпоративні системи (наприклад, CRM). або програми ERP), а також напишіть кілька функцій AWS Lambda для виконання API (наприклад, перевірка наявності елемента в інвентарі ERP). Amazon Bedrock автоматично аналізує запит і розбиває його на логічну послідовність, використовуючи можливості аргументації вибраної моделі, щоб визначити, яка інформація потрібна, які API викликати та коли їх викликати, щоб виконати крок або вирішити завдання. Зараз загальнодоступні агенти можуть планувати та виконувати більшість бізнес-завдань — від відповідей на запитання клієнтів про наявність вашого продукту до прийому їхніх замовлень — і розробникам не потрібно знати машинне навчання, підказки інженерів, навчати моделі чи підключати системи вручну. І Bedrock робить усе це безпечно та конфіденційно, і такі клієнти, як Druva та Athene, уже використовують їх для підвищення точності та швидкості розробки своїх генеративних програм ШІ.

- вводячи Огородження для Amazon Bedrock щоб ви могли застосувати запобіжні заходи на основі ваших вимог до сценарію використання та відповідальної політики штучного інтелекту. Клієнти хочуть бути впевненими, що взаємодія з їхніми додатками штучного інтелекту є безпечною, уникають токсичних чи образливих висловлювань, залишаються актуальними для свого бізнесу та відповідають своїй відповідальній політиці штучного інтелекту. За допомогою огорожі клієнти можуть вказувати теми, яких слід уникати, а Amazon Bedrock надаватиме користувачам лише схвалені відповіді на запитання, які належать до цих обмежених категорій. Наприклад, програму онлайн-банкінгу можна налаштувати так, щоб не надавати консультації щодо інвестицій і видаляти неприйнятний вміст (наприклад, ворожі висловлювання та насильство). На початку 2024 року клієнти також зможуть редагувати ідентифікаційну інформацію (PII) у відповідях моделі. Наприклад, після взаємодії клієнта з агентом кол-центру розмова служби підтримки клієнтів часто підсумовується для ведення записів, і огорожі можуть видалити ідентифікаційну інформацію з цих підсумків. Огородження можна використовувати в різних моделях Amazon Bedrock (включно з точно налаштованими моделями) і з агентами для Amazon Bedrock, щоб клієнти могли забезпечити стабільний рівень захисту для всіх своїх генеративних додатків ШІ.

Верхній рівень стеку: постійні інновації роблять генеративний ШІ доступним для більшої кількості користувачів

На верхньому рівні стеку знаходяться програми, які використовують LLM та інші FM, щоб ви могли скористатися перевагами генеративного штучного інтелекту під час роботи. Однією з сфер, де генеративний ШІ вже змінює гру, є кодування. Минулого року ми представили Amazon CodeWhisperer, який допомагає швидше та безпечніше створювати програми, генеруючи пропозиції коду та рекомендації майже в реальному часі. Такі клієнти, як Accenture, Boeing, Bundesliga, The Cigna Group, Kone та Warner Music Group, використовують CodeWhisperer для підвищення продуктивності розробників, а Accenture надає Amazon CodeWhisperer до 50,000 XNUMX своїх розробників програмного забезпечення та ІТ-фахівців. Ми хочемо, щоб якомога більше розробників могли отримати переваги продуктивності генеративного ШІ, тому CodeWhisperer пропонує безкоштовні рекомендації всім.

Однак, незважаючи на те, що інструменти кодування штучного інтелекту значною мірою полегшують життя розробників, переваги їхньої продуктивності обмежені браком знань про внутрішні кодові бази, внутрішні API, бібліотеки, пакети та класи. Один із способів подумати про це: якщо ви наймете нового розробника, навіть якщо він світового рівня, він не буде настільки продуктивним у вашій компанії, доки не зрозуміє ваші найкращі практики та код. Сучасні інструменти кодування на основі штучного інтелекту схожі на нового найнятого розробника. Щоб допомогти з цим, ми нещодавно зробили попередній перегляд нового можливість налаштування в Amazon CodeWhisperer, який безпечно використовує внутрішню кодову базу клієнта, щоб надавати більш відповідні та корисні рекомендації щодо коду. Завдяки цій можливості CodeWhisperer є експертом ваш код і надає рекомендації, які є більш актуальними, щоб заощадити ще більше часу. У дослідженні, проведеному спільно з Persistent, глобальною компанією з цифрової інженерії та модернізації підприємств, ми виявили, що налаштування допомагають розробникам виконувати завдання на 28% швидше, ніж із загальними можливостями CodeWhisperer. Тепер розробник у медичній технологічній компанії може попросити CodeWhisperer «імпортувати зображення МРТ, пов’язані з ідентифікатором клієнта, і запустити їх через класифікатор зображень», щоб виявити аномалії. Оскільки CodeWhisperer має доступ до бази коду, він може надавати набагато більш релевантні пропозиції, які включають місця імпорту зображень МРТ та ідентифікатори клієнтів. CodeWhisperer зберігає конфіденційність налаштувань, і базовий FM не використовує їх для навчання, захищаючи цінну інтелектуальну власність клієнтів. AWS — єдиний великий хмарний постачальник, який пропонує подібні можливості для всіх.

вводячи Amazon Q, генеративний помічник на основі штучного інтелекту, призначений для роботи

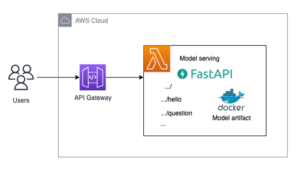

Звісно, розробники не єдині, хто користується генеративним штучним інтелектом — мільйони людей використовують генеративні програми чату AI. Те, що перші постачальники зробили в цьому просторі, є захоплюючим і надзвичайно корисним для споживачів, але багато в чому вони не зовсім «працюють» на роботі. Їхні загальні знання та можливості чудові, але вони не знають вашої компанії, ваших даних, ваших клієнтів, ваших операцій чи вашого бізнесу. Це обмежує те, наскільки вони можуть вам допомогти. Вони також не знають багато про вашу роль — яку роботу ви виконуєте, з ким працюєте, яку інформацію використовуєте та до чого маєте доступ. Ці обмеження зрозумілі, оскільки ці помічники не мають доступу до приватної інформації вашої компанії, і вони не розроблені відповідно до вимог щодо конфіденційності та безпеки даних, які компанії мають надати їм такий доступ. Важко ввімкнути безпеку постфактум і очікувати, що вона працюватиме добре. Ми вважаємо, що у нас є кращий спосіб, який дозволить кожній людині в кожній організації безпечно використовувати генеративний ШІ у своїй повсякденній роботі.

We раді представити Amazon Q, новий тип генеративного помічника на основі штучного інтелекту, який призначений спеціально для роботи та може бути адаптований до вашого бізнесу. Q може допомогти вам швидко отримати релевантні відповіді на нагальні питання, вирішити проблеми, створити вміст і вжити заходів, використовуючи дані та досвід, знайдені в інформаційних сховищах, коді та корпоративних системах вашої компанії. Коли ви спілкуєтеся в чаті з Amazon Q, він миттєво надає доречну інформацію та поради, які допоможуть оптимізувати завдання, пришвидшити прийняття рішень і сприяти творчості та інноваціям у роботі. Ми створили Amazon Q, щоб бути безпечним і конфіденційним, і він може розуміти та поважати ваші наявні особи, ролі та дозволи та використовувати цю інформацію для персоналізації своєї взаємодії. Якщо користувач не має дозволу на доступ до певних даних без Q, він також не зможе отримати доступ до них за допомогою Q. Ми розробили Amazon Q, щоб із першого дня відповідати суворим вимогам корпоративних клієнтів — жоден із їхніх вмістів не використовується для вдосконалення основних моделей.

Amazon Q — ваш експертний помічник для створення на AWS: ми навчили Amazon Q на основі 17-річного досвіду та знань AWS, щоб він міг трансформувати спосіб створення, розгортання та керування програмами та робочими навантаженнями на AWS. Amazon Q має інтерфейс чату в консолі управління AWS і документації, вашу IDE (через CodeWhisperer) і ваші командні чати в Slack або інших програмах для чату. Amazon Q може допомогти вам досліджувати нові можливості AWS, швидше розпочати роботу, вивчити незнайомі технології, архітектурні рішення, усунути неполадки, оновити та багато іншого — це експерт із добре архітектурних шаблонів AWS, найкращих практик, документації та впровадження рішень. Ось кілька прикладів того, що ви можете робити з новим помічником експерта AWS:

- Отримайте чіткі відповіді та вказівки щодо можливостей, послуг і рішень AWS: Попросіть Amazon Q «Розкажіть мені про агентів для Amazon Bedrock», і Q надасть вам опис функції та посилання на відповідні матеріали. Ви також можете задати Amazon Q практично будь-яке запитання про те, як працює служба AWS (наприклад, «Які обмеження масштабування для таблиці DynamoDB?», «Що таке кероване сховище Redshift?») або як найкраще створити будь-яку кількість рішень ( «Які найкращі методи створення архітектур, керованих подіями?» А Amazon Q збиратиме стислі відповіді та завжди цитуватиме (і посилатиметься на) свої джерела.

- Виберіть найкращий сервіс AWS для свого випадку використання та швидко розпочніть: Запитайте Amazon: «Які є способи створити веб-програму на AWS?» ” і надасть список потенційних послуг, таких як AWS Amplify, AWS Lambda та Amazon EC2 з перевагами кожного. Звідти ви можете звузити вибір, допомагаючи Q зрозуміти ваші вимоги, уподобання та обмеження (наприклад, «Що з цього буде найкращим, якщо я хочу використовувати контейнери?» або «Я маю використовувати реляційну чи нереляційну базу даних?» ”). Завершіть "Як мені почати?" а Amazon Q окреслить деякі основні кроки та спрямує вас на додаткові ресурси.

- Оптимізуйте свої обчислювальні ресурси: Amazon Q може допомогти вам вибрати екземпляри Amazon EC2. Якщо ви попросите його «Допоможіть мені знайти потрібний екземпляр EC2 для розгортання робочого навантаження кодування відео для моєї ігрової програми з найвищою продуктивністю», Q надасть вам список сімейств екземплярів із причинами кожної пропозиції. Крім того, ви можете поставити будь-яку кількість додаткових запитань, щоб допомогти знайти найкращий вибір для вашого робочого навантаження.

- Отримайте допомогу з налагодження, тестування та оптимізації коду: Якщо ви зіткнулися з помилкою під час кодування в IDE, ви можете попросити Amazon Q допомогти, сказавши: «У моєму коді є помилка вводу-виведення, чи можете ви надати її виправлення?» і Q згенерує код для вас. Якщо вам подобається пропозиція, ви можете попросити Amazon Q додати виправлення до вашої програми. Оскільки Amazon Q є у вашому IDE, він розуміє код, над яким ви працюєте, і знає, куди вставити виправлення. Amazon Q також може створювати модульні тести («Написати модульні тести для вибраної функції»), які він може вставляти у ваш код і запускати. Нарешті, Amazon Q може підказати вам способи оптимізації коду для підвищення продуктивності. Попросіть Q «Оптимізувати мій вибраний запит DynamoDB», і він використає своє розуміння вашого коду, щоб надати пропозицію природною мовою щодо того, що потрібно виправити, разом із супровідним кодом, який можна застосувати одним клацанням миші.

- Діагностика та усунення несправностей: Якщо ви зіткнулися з проблемами в консолі керування AWS, як-от помилки дозволів EC2 або помилки конфігурації Amazon S3, ви можете просто натиснути кнопку «Усунення несправностей за допомогою Amazon Q», і вона використає своє розуміння типу помилки та сервісу, у якому виявлено помилку. щоб надати вам пропозиції щодо виправлення. Ви навіть можете попросити Amazon Q усунути неполадки вашої мережі (наприклад, «Чому я не можу підключитися до свого екземпляра EC2 за допомогою SSH?»), і Q проаналізує вашу наскрізну конфігурацію та надасть діагноз (наприклад, «Цей екземпляр здається, знаходиться в приватній підмережі, тому може знадобитися встановити публічний доступ”).

- Швидко опрацюйте нову кодову базу: Коли ви спілкуєтеся в чаті з Amazon Q у своєму IDE, він поєднує свій досвід у створенні програмного забезпечення з розумінням вашого коду — потужне поєднання! Раніше, якщо ви брали проект від когось іншого або були новачком у команді, вам, можливо, довелося витрачати години на перегляд коду та документації вручну, щоб зрозуміти, як він працює та що він робить. Тепер, оскільки Amazon Q розуміє код у вашому IDE, ви можете просто попросити Amazon Q пояснити код («Надайте мені опис того, що ця програма робить і як вона працює»), і Q надасть вам деталі, наприклад, які служби код використовує та що роблять різні функції (наприклад, Q може відповісти щось на кшталт: «Ця програма створює базову систему запитів підтримки за допомогою Python Flask і AWS Lambda» і перейти до опису кожної з її основних можливостей, як вони реалізовані, і багато іншого).

- Швидше очистіть відставання функцій: Ви навіть можете попросити Amazon Q провести вас і автоматизувати більшу частину наскрізного процесу додавання функції до вашої програми в Amazon CodeCatalyst, наш уніфікований сервіс розробки програмного забезпечення для команд. Для цього ви просто призначаєте Q невиконане завдання зі свого списку проблем – так само, як ви б зробили це з напарником – і Q генерує покроковий план того, як він буде створювати та впроваджувати функцію. Коли ви затвердите план, Q напише код і представить вам запропоновані зміни як перевірку коду. Ви можете надіслати запит на переробку (за потреби), схвалити та/або розгорнути!

- Оновіть свій код за частку часу: Більшість розробників насправді витрачають лише частину свого часу на написання нового коду та створення нових програм. Вони витрачають набагато більше своїх циклів на болючі, важкі сфери, такі як технічне обслуговування та оновлення. Використовуйте оновлення мовної версії. Велика кількість клієнтів продовжують використовувати старіші версії Java, оскільки для оновлення знадобляться місяці, навіть роки, і тисячі годин часу розробників. Відкладання цього пов’язане з реальними витратами та ризиками — ви втрачаєте покращення продуктивності та стаєте вразливими до проблем безпеки. Ми вважаємо, що Amazon Q може змінити правила гри, і ми раді цьому Перетворення коду Amazon Q, функція, яка може звільнити від важкої роботи та скоротити час, потрібний для оновлення програм, з днів до хвилин. Ви просто відкриваєте код, який хочете оновити, у IDE та просите Amazon Q «/перетворити» ваш код. Amazon Q проаналізує весь вихідний код програми, згенерує код на цільовій мові та версії та виконає тести, допомагаючи вам усвідомити підвищення безпеки та продуктивності останніх мовних версій. Нещодавно дуже невелика команда розробників Amazon використала Amazon Q Code Transformation, щоб оновити 1,000 робочих програм із Java 8 до Java 17 лише за два дні. Середній час на одне застосування становив менше 10 хвилин. Сьогодні Amazon Q Code Transformation виконує оновлення мови Java з Java 8 або Java 11 на Java 17. Далі (і незабаром) з’явиться можливість трансформувати .NET Framework у кросплатформенний .NET (з ще більшою кількістю перетворень у майбутньому) .

Amazon Q — ваш бізнес-експерт: ви можете підключити Amazon Q до ваших бізнес-даних, інформації та систем, щоб він міг синтезувати все та надавати індивідуальну допомогу, щоб допомогти людям вирішувати проблеми, створювати вміст і виконувати дії, які стосуються вашого бізнесу. Перенести Amazon Q у свій бізнес легко. Він має понад 40 вбудованих роз’ємів для таких популярних корпоративних систем, як Amazon S3, Microsoft 365, Salesforce, ServiceNow, Slack, Atlassian, Gmail, Google Drive і Zendesk. Він також може підключатися до вашої внутрішньої інтрамережі, вікі та запускати книги, а за допомогою Amazon Q SDK ви можете створити з’єднання з будь-якою внутрішньою програмою, яку забажаєте. Спрямуйте Amazon Q на ці репозиторії, і він «розвине» ваш бізнес, збираючи та розуміючи семантичну інформацію, яка робить вашу компанію унікальною. Тоді ви отримаєте власну дружню та просту веб-програму Amazon Q, щоб співробітники вашої компанії могли взаємодіяти з розмовним інтерфейсом. Amazon Q також підключається до вашого постачальника ідентифікаційної інформації, щоб зрозуміти користувача, його роль і доступ до яких систем йому дозволено, щоб користувачі могли задавати детальні запитання з нюансами та отримувати індивідуальні результати, які містять лише інформацію, яку вони мають право переглядати. Amazon Q генерує відповіді та аналітичні дані, які є точними та вірними матеріалам і знанням, які ви надаєте, і ви можете обмежити делікатні теми, заблокувати ключові слова або відфільтрувати невідповідні запитання та відповіді. Ось кілька прикладів того, що ви можете зробити з новим помічником-експертом у вашому бізнесі:

- Отримуйте чіткі, надрелевантні відповіді на основі ваших бізнес-даних і інформації: Співробітники можуть запитувати Amazon Q про все, що їм раніше доводилося шукати в усіх джерелах. Запитайте «Які останні вказівки щодо використання логотипу?» або «Як подати заявку на отримання кредитної картки компанії?», і Amazon Q синтезує весь відповідний вміст, який знайде, і повернеться зі швидкими відповідями та посиланнями на відповідні джерела (наприклад, портали брендів і сховища логотипів, політика T&E компанії та програми карток).

- Оптимізуйте повсякденне спілкування: Просто запитайте, і Amazon Q зможе генерувати вміст («Створіть публікацію в блозі та три заголовки в соціальних мережах, які повідомляють про продукт, описаний у цій документації»), створювати резюме («Напишіть резюме стенограми нашої зустрічі з маркірованим списком дій») ), надсилайте оновлення електронною поштою («Створіть електронний лист із описом наших навчальних програм Q3 для клієнтів в Індії») і допомагайте організувати зустрічі («Створіть порядок денний зустрічі, щоб обговорити останній звіт про задоволеність клієнтів»).

- Виконайте завдання: Amazon Q може допомогти виконати певні завдання, зменшивши кількість часу, який працівники витрачають на повторювану роботу, як-от подання квитків. Попросіть Amazon Q «Підсумувати відгук клієнтів про нову цінову пропозицію в Slack», а потім попросіть Q взяти цю інформацію та відкрити заявку в Jira, щоб оновити маркетингову команду. Ви можете попросити Q «Підсумувати цю розшифровку розмови», а потім «Відкрити новий запит для клієнта А в Salesforce». Amazon Q підтримує інші популярні інструменти автоматизації роботи, такі як Zendesk і Service Now.

Amazon Q є в Amazon QuickSight: з Amazon Q у QuickSight, службі бізнес-аналітики AWS, користувачі можуть задавати своїм інформаційним панелям запитання на зразок «Чому кількість замовлень зросла минулого місяця?» та отримати візуалізацію та пояснення факторів, які вплинули на підвищення. Крім того, аналітики можуть використовувати Amazon Q, щоб скоротити час, який їм потрібен для створення інформаційних панелей, з кількох днів до хвилин за допомогою простої підказки на зразок «Покажи мені продажі за регіонами за місяцями у вигляді стовпчастої діаграми». Q повертається разом із цією діаграмою, і ви можете легко додати її на інформаційну панель або спілкуватися далі з Q, щоб покращити візуалізацію (наприклад, «Змінити гістограму на діаграму Санкі» або «Показати країни замість регіонів»). Amazon Q у QuickSight також спрощує використання наявних інформаційних панелей для інформування зацікавлених сторін бізнесу, аналізу ключових ідей і спрощення прийняття рішень за допомогою історій даних. Наприклад, користувачі можуть запропонувати Amazon Q «Створити історію про те, як бізнес змінився за останній місяць для огляду бізнесу разом із вищим керівництвом», і за лічені секунди Amazon Q надасть історію на основі даних, яка є візуально переконливою та повністю настроюється. Цими історіями можна безпечно ділитися в усій організації, щоб допомогти узгодити зацікавлені сторони та прийняти кращі рішення.

Amazon Q є в Amazon Connect: У Amazon Connect, нашій службі контакт-центру, Amazon Q допомагає вашим агентам із обслуговування клієнтів надавати краще обслуговування клієнтів. Amazon Q використовує репозиторії знань, якими зазвичай користуються ваші агенти, щоб отримати інформацію для клієнтів, а потім агенти можуть спілкуватися в чаті з Amazon Q безпосередньо в Connect, щоб отримати відповіді, які допоможуть їм швидше реагувати на запити клієнтів без необхідності самостійно шукати в документації. І хоча спілкуватися в чаті з Amazon Q, щоб отримати надшвидкі відповіді, це чудово, у сфері обслуговування клієнтів не існує такого поняття, як надто швидке. Ось чому Amazon Q In Connect перетворює живу розмову клієнта з агентом на підказку та автоматично надає агенту можливі відповіді, запропоновані дії та посилання на ресурси. Наприклад, Amazon Q може виявити, що клієнт зв’язується з компанією з прокату автомобілів, щоб змінити своє бронювання, створити відповідь для агента, щоб швидко повідомити, як застосовуються політики компанії щодо комісії за зміну, і скерувати агента через кроки, необхідні для оновлення бронювання.

Amazon Q входить до ланцюжка поставок AWS (незабаром): У AWS Supply Chain, нашій службі аналізу ланцюгів поставок, Amazon Q допомагає планувальникам попиту та пропозиції, менеджерам із запасів і торговим партнерам оптимізувати свій ланцюжок поставок, підсумовуючи та висвітлюючи потенційні ризики дефіциту чи надлишку, а також візуалізуючи сценарії вирішення проблеми. Користувачі можуть ставити Amazon Q питання «що», «чому» і «що, якщо» щодо даних про їхній ланцюг поставок і спілкуватися в чаті про складні сценарії та компроміси між різними рішеннями в ланцюжку поставок. Наприклад, клієнт може запитати: «Що спричиняє затримку моїх відправлень і як я можу пришвидшити це?» на що Amazon Q може відповісти: «90% ваших замовлень надходять на східне узбережжя, а сильний шторм на південному сході спричиняє 24-годинну затримку. Якщо ви відправите корабель до порту Нью-Йорка замість Маямі, ви пришвидшите доставку та зменшите витрати на 50%».

Наші клієнти швидко впроваджують генеративний штучний інтелект — вони навчають новаторським моделям на AWS, розробляють генеративні програми штучного інтелекту з рекордною швидкістю за допомогою Amazon Bedrock і розгортають у своїх організаціях такі кардинальні програми, як Amazon Q. З нашими останніми оголошеннями AWS надає клієнтам ще більше продуктивності, вибору та інновацій на кожному рівні стеку. Сукупний вплив усіх можливостей, які ми надаємо в re:Invent, знаменує собою важливу віху на шляху до досягнення захоплюючої та значущої мети: ми робимо генеративний ШІ доступним для клієнтів будь-якого розміру та технічних можливостей, щоб вони могли заново винаходити та трансформувати те, що можливо.

ресурси

Про автора

Свамі Сівасубраманян є віце-президентом з даних і машинного навчання в AWS. На цій посаді Свамі керує всіма службами бази даних AWS, аналітики та AI та машинного навчання. Місія його команди полягає в тому, щоб допомогти організаціям використовувати свої дані для роботи за допомогою повного наскрізного рішення для зберігання, доступу, аналізу, візуалізації та прогнозування.

Свамі Сівасубраманян є віце-президентом з даних і машинного навчання в AWS. На цій посаді Свамі керує всіма службами бази даних AWS, аналітики та AI та машинного навчання. Місія його команди полягає в тому, щоб допомогти організаціям використовувати свої дані для роботи за допомогою повного наскрізного рішення для зберігання, доступу, аналізу, візуалізації та прогнозування.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- джерело: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- : має

- :є

- : ні

- :де

- $UP

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 300

- 35%

- 40

- 50

- 500

- 65

- 8

- 9

- a

- здібності

- здатність

- Здатний

- МЕНЮ

- вище

- прискорювати

- прискорений

- прискорювачі

- Accenture

- доступ

- доступність

- доступною

- бухгалтерський облік

- точність

- точний

- набувати

- через

- дію

- дії

- активно

- насправді

- пристосовувати

- додавати

- доданий

- додати

- доповнення

- Додатковий

- Додатково

- доповнення

- Додає

- Adidas

- саман

- Прийняття

- просунутий

- просування

- Перевага

- Переваги

- реклама

- рада

- після

- проти

- порядок денний

- Агент

- агенти

- сукупність

- назад

- AI

- ШІ та машинне навчання

- AI чат

- ai дослідження

- Можливість

- вирівнювати

- ВСІ

- дозволяти

- дозволяє

- по

- вже

- Також

- завжди

- Amazon

- Amazon Code Whisperer

- Amazon EC2

- Amazon QuickSight

- Amazon SageMaker

- Amazon Web Services

- кількість

- суми

- an

- аналіз

- аналітик

- аналітики

- аналітика

- аналізувати

- аналізи

- та

- Оголосити

- Сповіщення

- Оголошуючи

- відповідь

- Відповіді

- Антропний

- будь-який

- будь

- все

- API

- Інтерфейси

- додаток

- з'являється

- додаток

- застосування

- Застосовувати

- цінувати

- підхід

- схвалювати

- затверджений

- додатка

- квітня

- ЕСТЬ

- ПЛОЩА

- області

- суперечливо

- навколо

- AS

- запитати

- Допомога

- Помічник

- помічники

- асоційований

- партнери

- At

- Atlassian

- збільшення

- збільшено

- збільшує

- Аврора

- уповноважений

- автоматизувати

- автоматизує

- автоматичний

- автоматично

- Автоматизація

- автомобільний

- наявність

- доступний

- середній

- уникнути

- геть

- AWS

- AWS Inferentia

- AWS Lambda

- Консоль управління AWS

- назад

- Banking

- бар

- бар'єри

- база

- заснований

- основний

- BE

- оскільки

- стає

- було

- почалася

- Вірити

- Переваги

- КРАЩЕ

- передового досвіду

- Краще

- між

- Великий

- Мільярд

- мільярди

- Блокувати

- блоки

- Блог

- Boeing

- Болт

- бронювання

- Booking.com

- книги

- обидва

- дно

- Межі

- марка

- Перерва

- ламається

- приносити

- Приведення

- будувати

- Створюємо

- Будує

- побудований

- вбудований

- бізнес

- бізнес-аналітика

- підприємства

- але

- button

- by

- call

- коллцентр

- CAN

- Може отримати

- можливості

- можливості

- здатний

- потужність

- захопивши

- автомобіль

- вуглець

- викиди вуглекислого газу

- карта

- обережно

- випадок

- випадків

- категорії

- викликаючи

- Центр

- певний

- звичайно

- ланцюг

- виклик

- проблеми

- зміна

- змінилися

- Перемикач

- Зміни

- заміна

- характеристика

- Графік

- Чарти

- чати

- Chatbot

- chatbots

- в чаті

- перевірка

- чіп

- Чіпси

- вибір

- Вибирати

- Вибираючи

- вибраний

- претензій

- класів

- Очищення

- ясно

- клацання

- хмара

- інфраструктура хмари

- кластер

- Кластеризація

- Узбережжя

- код

- кодова база

- Перегляд коду

- Кодування

- співробітництво

- співробітництво

- COM

- поєднання

- об'єднувати

- комбінований

- комбінати

- Приходити

- приходить

- майбутній

- Скоро

- спілкуватися

- зв'язку

- Компанії

- компанія

- Компанії

- порівняний

- переконливий

- повний

- повністю

- комплекс

- складність

- всеосяжний

- обчислення

- поняття

- конфігурація

- конфігурування

- припущення

- З'єднуватися

- підключений

- зв'язку

- зв'язок

- з'єднує

- послідовний

- Консоль

- обмеження

- Споживачі

- споживання

- контакт

- контакт-центр

- Контейнери

- зміст

- контекст

- контекстуальний

- продовжувати

- триває

- триває

- триває

- контроль

- управління

- Розмова

- діалоговий

- розмови

- авторське право

- Копірайтинг

- Core

- Коштувати

- рентабельним

- витрати

- країни

- Рульовий

- створювати

- створений

- креативність

- Творці

- кредит

- кредитна картка

- Злочин

- КРІСП

- CRM

- Крос-платформна

- клієнт

- Досвід клієнтів

- Задоволеність клієнтів

- Контакти

- Клієнти

- настроюється

- настройка

- налаштувати

- налаштувати

- Вирізати

- циклів

- щодня

- приладова панель

- інформаційні панелі

- дані

- Підготовка даних

- конфіденційність даних

- Конфіденційність та безпека даних

- набори даних

- керовані даними

- Database

- базами даних

- Збір даних

- день

- з дня на день

- Днів

- Прийняття рішень

- рішення

- глибокий

- глибоке навчання

- глибше

- Визначення

- Ступінь

- затримка

- доставляти

- Поставки

- надання

- постачає

- Попит

- Демократизувати

- Залежно

- розгортання

- розгорнути

- розгортання

- розгортання

- глибина

- описувати

- описаний

- description

- призначений

- бажаний

- докладно

- деталі

- виявляти

- Визначати

- DEUTSCHE TELECOM

- Розробник

- розробників

- розвивається

- розробка

- діагностика

- Діалог

- Діалог

- DID

- різний

- радіомовлення

- цифровий

- безпосередньо

- поширювати

- розподілений

- розподілене навчання

- розповсюдження

- do

- документ

- документація

- документація

- робить

- Ні

- справи

- зроблений

- Не знаю

- подвоєння

- вниз

- управляти

- два

- дублікати

- тривалість

- e

- e-commerce

- кожен

- Рано

- легше

- легко

- Схід

- Східне узбережжя

- легко

- Економіка

- видання

- фактично

- ефективність

- продуктивно

- зусилля

- або

- ще

- повідомлення електронної пошти

- викиди

- співробітників

- уповноважувати

- уповноважують

- включіть

- дозволяє

- кодування

- зіткнення

- кінець

- кінець в кінець

- енергія

- Енергоспоживання

- енергоефективності

- інженер

- Машинобудування

- підвищувати

- Удосконалення

- збагачення

- підприємство

- підприємства

- підприємств

- розваги

- Весь

- конверт

- Епоха

- ERP

- помилка

- помилки

- Ефір (ETH)

- оцінки

- Навіть

- Події

- НІКОЛИ

- Кожен

- все

- все

- еволюція

- еволюціонувати

- приклад

- Приклади

- збуджений

- захоплюючий

- виконувати

- виконавчий

- існуючий

- експансивний

- очікувати

- прискорити

- дорогий

- досвід

- досвідчений

- Досліди

- експерт

- експертиза

- Пояснювати

- дослідити

- експрес

- тканину

- Face

- факт

- фактори

- достатньо

- вірний

- сокіл

- Падати

- знайомий

- сімей

- сім'я

- ШВИДКО

- швидше

- несправний

- особливість

- риси

- плата

- зворотний зв'язок

- кілька

- Подача

- фільтрувати

- в кінці кінців

- фінансовий

- знайти

- виявлення

- знахідки

- кінець

- закінчення

- Перший

- виправляти

- гнучкий

- увагу

- стежити

- для

- Для споживачів

- Вперед

- знайдений

- фонд

- чотири

- фракція

- Рамки

- каркаси

- Безкоштовна

- часто

- дружній

- від

- Функції

- далі

- майбутнє

- гра

- змінювач гри

- азартні ігри

- Загальне

- в цілому

- породжувати

- генерує

- породжує

- покоління

- генеративний

- Генеративний ШІ

- generator

- отримати

- отримання

- Давати

- Глобальний

- глобальний цифровий

- Gmail

- Go

- мета

- буде

- добре

- GPU

- Графічні процесори

- великий

- Земля

- новаторський

- Group

- Зростання

- вирощений

- керівництво

- керівництво

- керівні вказівки

- було

- Руки

- Відбувається

- Жорсткий

- апаратні засоби

- шкідливий

- ненавидіти

- ненависті

- Мати

- має

- Headlines

- охорона здоров'я

- важкий

- важкий підйом

- допомога

- допомогу

- допомагає

- тут

- Високий

- вище

- найвищий

- виділивши

- дуже

- прокат

- його

- хостинг

- ГОДИННИК

- Як

- How To

- Однак

- HTTPS

- Сотні

- i

- ID

- тотожності

- Особистість

- ідентифікатори

- if

- зображення

- генерація зображень

- зображень

- Негайний

- Impact

- здійснювати

- реалізації

- реалізовані

- імпорт

- важливо

- вражаючий

- удосконалювати

- поліпшений

- поліпшення

- in

- включати

- includes

- У тому числі

- Augmenter

- збільшений

- зростаючий

- індикатори

- осіб

- промисловості

- промисловість

- провідний в галузі

- під впливом

- інформація

- повідомити

- інформація

- Інфраструктура

- оновлювати

- інноваційний

- інновація

- інновації

- інноваційний

- вхід

- витрати

- розуміння

- розуміння

- екземпляр

- випадки

- замість

- Інститут

- інструкції

- страхування

- інтеграція

- інтелектуальний

- інтелектуальна власність

- Інтелект

- наміри

- взаємодіяти

- Взаємодії

- взаємодіє

- взаємопов'язані

- інтерфейс

- внутрішній

- втрутитися

- в

- вводити

- введені

- введення

- Винайдений

- інвентаризація

- Invest

- слідчий

- інвестування

- інвестиції

- інвестиції

- залучений

- включає в себе

- питання

- IT

- ІТ-професіонали

- ЙОГО

- японський

- жаргон

- Java

- JPG

- просто

- тільки один

- тримати

- зберігання

- ключ

- Ключові сфери

- ключові слова

- комплект

- Комплект (SDK)

- Знати

- знання

- знає

- Labs

- відсутність

- мова

- великий

- масштабний

- найбільших

- останній

- Минулого року

- Пізно

- Затримка

- останній

- запущений

- запуск

- адвокати

- шар

- шарів

- Керівництво

- провідний

- УЧИТЬСЯ

- вчений

- вивчення

- легальний

- менше

- дозволяє

- рівень

- Важіль

- важелі

- LexisNexis

- LG

- libraries

- Життєвий цикл

- підйомний

- як

- Ймовірно

- недоліки

- обмеженою

- рамки

- ліній

- LINK

- зв'язку

- список

- жити

- Місце проживання

- Лама

- розташований

- місць

- логічний

- логотип

- Довго

- давній

- серія

- любов

- низький

- знизити

- найнижчий

- машина

- навчання за допомогою машини

- made

- підтримувати

- збереження

- обслуговування

- основний

- зробити

- РОБОТИ

- Робить

- вдалося

- управління

- Менеджери

- керівництво

- ручна робота

- вручну

- багато

- Маркетинг

- матеріал

- Матеріали

- максимальний

- Може..

- me

- значущим

- засоби

- Медіа

- Зустрічатися

- засідання

- зустрічі

- відповідає

- члени

- меров

- Meta

- метод

- Майамі

- Microsoft

- Microsoft 365

- Середній

- може бути

- віха

- протокол

- нудьгувати

- Місія

- ML

- модель

- моделювання

- Моделі

- модернізація

- Імпульс

- MongoDB

- монітори

- місяць

- місяців

- більше

- найбільш

- Найбільш популярний

- переміщення

- МРТ

- багато

- множинний

- музика

- повинен

- my

- ім'я

- Nasdaq

- Природний

- Природна мова

- Близько

- необхідно

- Необхідність

- необхідний

- нужденних

- мережу

- мережу

- мережа

- Нові

- Нью-Йорк

- нещодавно

- наступний

- Nitro

- немає

- ноутбуки

- зараз

- номер

- Nvidia

- of

- від

- наступ

- пропонувати

- пропонує

- Пропозиції

- часто

- старший

- on

- один раз

- ONE

- ті,

- онлайн

- онлайн Банкінг

- тільки

- відкрити

- працювати

- операції

- Оптимізувати

- оптимізований

- оптимізуючий

- Опції

- or

- замовлень

- організація

- організації

- оригінал

- Інше

- інші

- наші

- з

- план

- вихід

- виходи

- над

- Зависока

- переважна

- власний

- алюр

- пакети

- хворобливий

- пар

- параметр

- параметри

- частина

- партнери

- частини

- Минуле

- моделі

- пауза

- Люди

- для

- виконувати

- продуктивність

- виконується

- виступає

- дозвіл

- Дозволи

- людина

- Втілення

- Уособлювати

- Особисто

- Тур PGA

- фрази

- пій

- місце

- план

- plato

- Інформація про дані Платона

- PlatoData

- плюс

- точка

- Політика

- популярний

- позитивний

- це можливо

- пошта

- потенціал

- влада

- Харчування

- потужний

- Практичний

- практично

- практики

- необхідність

- передбачати

- Прогнози

- переваги

- підготовка

- Готувати

- представити

- президент

- press

- пресування

- попередній перегляд

- раніше

- price

- ціни без прихованих комісій

- первинний

- недоторканність приватного життя

- Конфіденційність та безпека

- приватний

- приватна інформація

- Проблема

- проблеми

- процес

- процеси

- обробка

- виробляти

- Product

- Production

- продуктивний

- продуктивність

- професійний

- професіонали

- програми

- проект

- підказок

- власність

- власником

- захищає

- захист

- забезпечувати

- Постачальник

- провайдери

- забезпечує

- забезпечення

- громадськість

- публічно

- цілей

- Штовхати

- Натискання

- put

- Поклавши

- Python

- піторх

- Q3

- кількісний

- питання

- питань

- Швидко

- швидко

- досить

- R & D

- діапазон

- швидко

- швидко

- ставки

- RE

- читання

- реальний

- реального часу

- реалістичний

- реалізувати

- зрозумів,

- насправді

- жати

- Причини

- нещодавно

- Рекомендація

- рекомендації

- запис

- зменшити

- Знижений

- зниження

- удосконалювати

- регіон

- випущений

- доречний

- надійність

- залишається

- видаляти

- видалення

- ремонт

- повторювані

- заміна

- відповісти

- звітом

- Сховище

- запросити

- запитів

- вимагається

- Вимога

- дослідження

- бронювання

- Резерв

- дозвіл

- резонує

- ресурси

- повага

- Реагувати

- відповідаючи

- відповідь

- відповіді

- відповідальний

- обмежити

- обмежений

- результат

- результати

- повернення

- огляд

- рецензування

- право

- ризики

- Роль

- ролі

- кімнати

- маршрути

- Правило

- прогін

- біг

- злітно-посадкова смуга

- жертвуючи

- сейф

- гарантії

- безпечно

- мудрець

- продажів

- Salesforce

- то ж

- задоволення

- зберегти

- приказка

- шкала

- Масштабування

- сценарії

- сфера

- безліч

- подряпати

- Sdk

- безшовні

- Пошук

- другий

- Друге покоління

- seconds

- безпечний

- безпечно

- безпеку

- побачити

- бачачи

- бачив

- вибрати

- обраний

- вибір

- відправка

- старший

- вищого керівництва

- чутливий

- Вересень

- Послідовність

- Серія

- сервери

- обслуговування

- ServiceNow

- Послуги

- комплект

- набори

- кілька

- Поділитись

- загальні

- судно

- Короткий

- Повинен

- сторона

- значний

- Кремній

- Аналогічно

- простий

- спростити

- просто

- з

- SIX

- розміри

- слабкий

- невеликий

- So

- соціальна

- соціальні медіа

- Софтвер

- Розробники ПЗ

- розробка програмного забезпечення

- комплект для розробки програмного забезпечення

- рішення

- Рішення

- ВИРІШИТИ

- деякі

- Хтось

- що в сім'ї щось

- Скоро

- складний

- Source

- вихідні

- Джерела

- на південний схід

- Простір

- Іскритися

- конкретно

- мова

- швидкість

- витрачати

- Стабільність

- стабільний

- стек

- укладені

- зацікавлених сторін

- почалася

- Починаючи

- Стартапи

- впроваджений

- залишатися

- Крок

- заходи

- Як і раніше

- зберігання

- зберігати

- магазинів

- історії

- буря

- Історія

- раціоналізувати

- Зміцнювати

- строгий

- структура

- Вивчення

- підмережі

- істотний

- такі

- підходящий

- набір

- підсумовувати

- РЕЗЮМЕ

- Super

- доповнювати

- постачальники

- поставка

- Попит та пропозиція

- ланцюжка поставок

- підтримка

- Опори

- Переконайтеся

- дивно

- спостереження

- підозрілі

- Sustainability

- перемикач

- синтезувати

- система

- Systems

- таблиця

- з урахуванням

- Приймати

- приймає

- взяття

- балаканина

- Мета

- Завдання

- завдання

- команда

- Члени команди

- команди

- технічний

- техніка

- методи

- Технології

- Технологія

- технологічні інновації

- сказати

- говорять

- десять

- тензор

- тензорний потік

- термінологія

- тест

- Тестування

- Тести

- текст

- генерація тексту

- ніж

- Що

- Команда

- Майбутнє

- світ

- їх

- Їх

- самі

- потім

- Там.

- Ці

- вони

- річ

- речі

- думати

- третій

- це

- У цьому році

- ті

- тисячі

- три

- через

- по всьому

- пропускна здатність

- квиток

- квитки

- час

- times

- велетень

- до

- сьогодні

- сьогоднішній

- разом

- знак

- занадто

- прийняли

- інструмент

- інструменти

- топ

- теми

- Тур

- до

- до

- трек

- торгові площі

- поїзд

- навчений

- Навчання

- Transactions

- Розшифровка

- Перетворення

- Перетворення

- перетворень

- перетворення

- подорожувати

- трильйони

- подорож

- по-справжньому

- Довіряйте

- намагатися

- намагається

- повороти

- два

- тип

- типово

- що лежить в основі

- розуміти

- зрозуміло

- розуміння

- розумієш

- незнайомий

- єдиний

- створеного

- унікальні особливості

- блок

- на відміну від

- до

- Оновити

- Updates

- модернізація

- оновлення

- us

- Використання

- використання

- використання випадку

- використовуваний

- користувач

- користувачі

- використовує

- використання

- Цінний

- різноманітність

- різний

- версія

- Проти

- дуже

- через

- віце

- Віцепрезидент

- Відео

- фактично

- візуалізації

- візуалізувати

- візуально

- Обсяги

- Вразливий

- хотіти

- Сигналізатор

- музична група Warner

- було

- хвиля

- шлях..

- способи

- we

- Web

- Веб-додаток

- веб-сервіси

- веб-сайти

- week

- тижня

- ласкаво просимо

- ДОБРЕ

- добре відомі

- були

- Що

- Що таке

- коли

- Чи

- який

- в той час як

- ВООЗ

- чому

- широкий

- Широкий діапазон

- ширше

- волі

- вікно

- з

- в

- без

- Work

- працював

- Робочі процеси

- робочий

- працює

- світ

- Світовий клас

- турбуватися

- вартість

- б

- запис

- написати код

- лист

- рік

- років

- йорк

- ви

- вашу

- Zendesk

- зефірнет