นักวิจัยยังคงพัฒนาโมเดลสถาปัตยกรรมใหม่สำหรับงานแมชชีนเลิร์นนิง (ML) ทั่วไป ภารกิจอย่างหนึ่งคือการจำแนกรูปภาพ ซึ่งรูปภาพจะได้รับการยอมรับเป็นอินพุต และโมเดลจะพยายามจัดประเภทรูปภาพโดยรวมด้วยเอาต์พุตป้ายออบเจกต์ ปัจจุบันมีโมเดลมากมายที่ทำหน้าที่จัดหมวดหมู่รูปภาพ ผู้ปฏิบัติงานด้าน ML อาจถามคำถามเช่น: "โมเดลใดที่ฉันควรปรับแต่งอย่างละเอียดและปรับใช้เพื่อให้ได้ประสิทธิภาพสูงสุดในชุดข้อมูลของฉัน" และนักวิจัย ML อาจถามคำถามเช่น: "ฉันจะสร้างการเปรียบเทียบอย่างเป็นธรรมของฉันเองระหว่างสถาปัตยกรรมแบบจำลองต่างๆ กับชุดข้อมูลที่ระบุในขณะที่ควบคุมไฮเปอร์พารามิเตอร์การฝึกอบรมและข้อมูลจำเพาะของคอมพิวเตอร์ เช่น GPU, CPU และ RAM ได้อย่างไร" คำถามเดิมกล่าวถึงการเลือกแบบจำลองในสถาปัตยกรรมแบบจำลอง ในขณะที่คำถามหลังเกี่ยวข้องกับการเปรียบเทียบแบบจำลองที่ผ่านการฝึกอบรมกับชุดข้อมูลทดสอบ

ในโพสต์นี้ คุณจะเห็นวิธีการ การจำแนกภาพ TensorFlow อัลกอริทึมของ Amazon SageMaker JumpStart สามารถลดความซับซ้อนของการใช้งานที่จำเป็นเพื่อตอบคำถามเหล่านี้ พร้อมกับรายละเอียดการดำเนินการที่เกี่ยวข้อง ตัวอย่างโน๊ตบุ๊ค Jupyterคุณจะมีเครื่องมือที่พร้อมดำเนินการเลือกโมเดลโดยสำรวจขอบเขตพาเรโต ซึ่งการปรับปรุงเมตริกประสิทธิภาพหนึ่งอย่าง เช่น ความแม่นยำ จะไม่สามารถทำได้โดยไม่ทำให้เมตริกอื่นแย่ลง เช่น ปริมาณงาน

ภาพรวมโซลูชัน

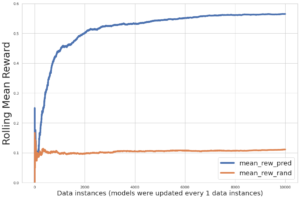

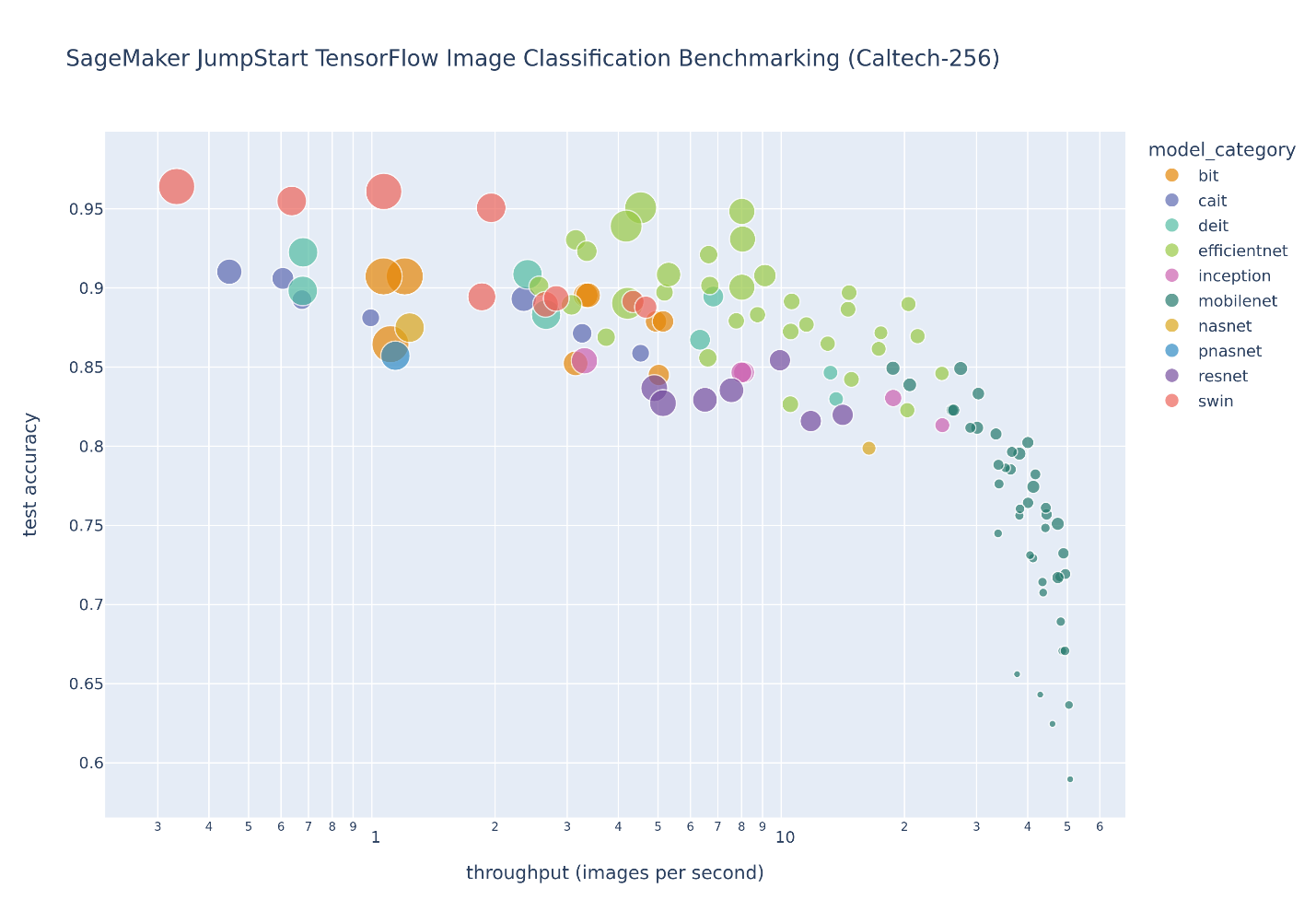

รูปภาพต่อไปนี้แสดงให้เห็นถึงการแลกเปลี่ยนการเลือกโมเดลสำหรับโมเดลการจัดหมวดหมู่รูปภาพจำนวนมากที่ปรับแต่งอย่างละเอียดบน คาลเทค-256 ชุดข้อมูล ซึ่งเป็นชุดที่ท้าทายของภาพจริง 30,607 ภาพ ซึ่งครอบคลุม 256 หมวดหมู่วัตถุ แต่ละจุดแสดงถึงโมเดลเดียว ขนาดพอยต์จะถูกปรับขนาดตามจำนวนพารามิเตอร์ที่ประกอบด้วยโมเดล และจุดต่างๆ จะมีรหัสสีตามสถาปัตยกรรมโมเดล ตัวอย่างเช่น จุดสีเขียวอ่อนแสดงถึงสถาปัตยกรรม EfficientNet จุดสีเขียวอ่อนแต่ละจุดคือการกำหนดค่าที่แตกต่างกันของสถาปัตยกรรมนี้ด้วยการวัดประสิทธิภาพของโมเดลที่ปรับแต่งอย่างละเอียดโดยเฉพาะ รูปแสดงการมีอยู่ของขอบเขตพาเรโตสำหรับการเลือกรุ่น ซึ่งความแม่นยำที่สูงขึ้นจะแลกกับปริมาณงานที่ต่ำกว่า ท้ายที่สุดแล้ว การเลือกโมเดลตามแนวชายแดนพาเรโต หรือชุดโซลูชันที่มีประสิทธิภาพของพาเรโต จะขึ้นอยู่กับข้อกำหนดด้านประสิทธิภาพการปรับใช้โมเดลของคุณ

หากคุณสังเกตเห็นความแม่นยำในการทดสอบและขอบเขตของปริมาณงานทดสอบที่น่าสนใจ ชุดของโซลูชันที่มีประสิทธิภาพแบบพาเรโตจากตัวเลขก่อนหน้านี้จะแยกออกมาในตารางต่อไปนี้ มีการจัดเรียงแถวเพื่อให้ปริมาณงานทดสอบเพิ่มขึ้นและความแม่นยำในการทดสอบลดลง

| ชื่อรุ่น | จำนวนพารามิเตอร์ | ทดสอบความแม่นยำ | ทดสอบความแม่นยำ 5 อันดับแรก | ปริมาณงาน (ภาพ/วินาที) | ระยะเวลาต่อยุค |

| swin-ขนาดใหญ่-patch4-window12-384 | 195.6M | ลด 96.4% | ลด 99.5% | 0.3 | 2278.6 |

| swin-ขนาดใหญ่-patch4-window7-224 | 195.4M | ลด 96.1% | ลด 99.5% | 1.1 | 698.0 |

| ประสิทธิภาพสุทธิ-v2-imagenet21k-ft1k-l | 118.1M | ลด 95.1% | ลด 99.2% | 4.5 | 1434.7 |

| ประสิทธิภาพสุทธิ-v2-imagenet21k-ft1k-m | 53.5M | ลด 94.8% | ลด 99.1% | 8.0 | 769.1 |

| ประสิทธิภาพสุทธิ-v2-imagenet21k-m | 53.5M | ลด 93.1% | ลด 98.5% | 8.0 | 765.1 |

| ประสิทธิภาพเน็ต-b5 | 29.0M | ลด 90.8% | ลด 98.1% | 9.1 | 668.6 |

| ประสิทธิภาพสุทธิ-v2-imagenet21k-ft1k-b1 | 7.3M | ลด 89.7% | ลด 97.3% | 14.6 | 54.3 |

| ประสิทธิภาพสุทธิ-v2-imagenet21k-ft1k-b0 | 6.2M | ลด 89.0% | ลด 97.0% | 20.5 | 38.3 |

| ประสิทธิภาพสุทธิ-v2-imagenet21k-b0 | 6.2M | ลด 87.0% | ลด 95.6% | 21.5 | 38.2 |

| mobilenet-v3-ขนาดใหญ่-100-224 | 4.6M | ลด 84.9% | ลด 95.4% | 27.4 | 28.8 |

| mobilenet-v3-ขนาดใหญ่-075-224 | 3.1M | ลด 83.3% | ลด 95.2% | 30.3 | 26.6 |

| โมบายเน็ต-v2-100-192 | 2.6M | ลด 80.8% | ลด 93.5% | 33.5 | 23.9 |

| โมบายเน็ต-v2-100-160 | 2.6M | ลด 80.2% | ลด 93.2% | 40.0 | 19.6 |

| โมบายเน็ต-v2-075-160 | 1.7M | ลด 78.2% | ลด 92.8% | 41.8 | 19.3 |

| โมบายเน็ต-v2-075-128 | 1.7M | ลด 76.1% | ลด 91.1% | 44.3 | 18.3 |

| โมบายเน็ต-v1-075-160 | 2.0M | ลด 75.7% | ลด 91.0% | 44.5 | 18.2 |

| โมบายเน็ต-v1-100-128 | 3.5M | ลด 75.1% | ลด 90.7% | 47.4 | 17.4 |

| โมบายเน็ต-v1-075-128 | 2.0M | ลด 73.2% | ลด 90.0% | 48.9 | 16.8 |

| โมบายเน็ต-v2-075-96 | 1.7M | ลด 71.9% | ลด 88.5% | 49.4 | 16.6 |

| โมบายเน็ต-v2-035-96 | 0.7M | ลด 63.7% | ลด 83.1% | 50.4 | 16.3 |

| โมบายเน็ต-v1-025-128 | 0.3M | ลด 59.0% | ลด 80.7% | 50.8 | 16.2 |

โพสต์นี้ให้รายละเอียดเกี่ยวกับวิธีการใช้งานขนาดใหญ่ อเมซอน SageMaker งานเปรียบเทียบและคัดเลือกรุ่น ก่อนอื่น เราขอแนะนำ JumpStart และอัลกอริทึมการจัดประเภทอิมเมจในตัวของ TensorFlow จากนั้นเราจะหารือถึงข้อควรพิจารณาในการใช้งานระดับสูง เช่น การกำหนดค่าพารามิเตอร์ JumpStart ไฮเปอร์พารามิเตอร์ การแยกเมตริกจาก บันทึก Amazon CloudWatchและเรียกใช้งานการปรับไฮเปอร์พารามิเตอร์แบบอะซิงโครนัส สุดท้าย เราจะกล่าวถึงสภาพแวดล้อมการใช้งานและการกำหนดพารามิเตอร์ที่นำไปสู่โซลูชันที่มีประสิทธิภาพแบบพาเรโตในตารางและตัวเลขก่อนหน้านี้

รู้เบื้องต้นเกี่ยวกับการจัดประเภทอิมเมจ JumpStart TensorFlow

JumpStart ให้การปรับแต่งแบบละเอียดและการปรับใช้โมเดลที่ได้รับการฝึกอบรมล่วงหน้าที่หลากหลายในงาน ML ที่เป็นที่นิยมในคลิกเดียว ตลอดจนโซลูชันแบบครบวงจรที่คัดสรรมาซึ่งช่วยแก้ปัญหาทางธุรกิจทั่วไป คุณลักษณะเหล่านี้ช่วยขจัดความยุ่งยากออกจากแต่ละขั้นตอนของกระบวนการ ML ทำให้ง่ายต่อการพัฒนาโมเดลคุณภาพสูงและลดเวลาในการปรับใช้ เดอะ JumpStart API ช่วยให้คุณสามารถปรับใช้ทางโปรแกรมและปรับแต่งโมเดลที่ได้รับการฝึกอบรมล่วงหน้าจำนวนมากบนชุดข้อมูลของคุณเอง

ฮับโมเดล JumpStart ให้การเข้าถึงจำนวนมาก แบบจำลองการจำแนกภาพ TensorFlow ที่เปิดใช้งานการถ่ายโอนการเรียนรู้และการปรับแต่งชุดข้อมูลที่กำหนดเอง ในขณะที่เขียนนี้ ฮับโมเดล JumpStart มีโมเดลการจัดประเภทอิมเมจ TensorFlow 135 โมเดลในสถาปัตยกรรมโมเดลยอดนิยมที่หลากหลายจาก ฮับ TensorFlowเพื่อรวมเครือข่ายที่เหลือ (เรสเน็ต), โมบายเน็ต, ประสิทธิภาพเน็ต, จัดตั้งกองทุนเครือข่ายการค้นหาสถาปัตยกรรมประสาท (แนสเน็ต), บิ๊กโอน (นิดหน่อย) เลื่อนหน้าต่าง (swin) ทรานส์ฟอร์มเมอร์, คลาส-ความสนใจในอิมเมจทรานส์ฟอร์เมอร์ส (CAIT) และ Image Transformers ที่มีประสิทธิภาพข้อมูล (เดอิท).

โครงสร้างภายในที่แตกต่างกันอย่างมากประกอบด้วยสถาปัตยกรรมแต่ละรุ่น ตัวอย่างเช่น โมเดล ResNet ใช้การข้ามการเชื่อมต่อเพื่อให้มีเครือข่ายที่ลึกมากขึ้น ในขณะที่โมเดลที่ใช้หม้อแปลงใช้กลไกการสังเกตตนเองที่กำจัดพื้นที่ภายในของการดำเนินการ Convolution เพื่อสนับสนุนฟิลด์ที่เปิดรับทั่วโลกมากขึ้น นอกจากคุณสมบัติที่หลากหลายที่ตั้งค่าโครงสร้างที่แตกต่างกันเหล่านี้แล้ว สถาปัตยกรรมแบบจำลองแต่ละแบบยังมีการกำหนดค่าหลายอย่างที่ปรับขนาด รูปร่าง และความซับซ้อนของแบบจำลองภายในสถาปัตยกรรมนั้น ส่งผลให้มีแบบจำลองการจัดประเภทรูปภาพที่ไม่ซ้ำกันหลายร้อยแบบที่มีอยู่ในฮับแบบจำลอง JumpStart เมื่อรวมกับสคริปต์การเรียนรู้การถ่ายโอนและการอนุมานในตัวที่ครอบคลุมคุณสมบัติ SageMaker มากมาย JumpStart API จึงเป็นจุดเริ่มต้นที่ยอดเยี่ยมสำหรับผู้ปฏิบัติงาน ML เพื่อเริ่มต้นการฝึกอบรมและปรับใช้โมเดลได้อย่างรวดเร็ว

เอ่ยถึง ถ่ายโอนการเรียนรู้สำหรับโมเดลการจัดประเภทรูปภาพ TensorFlow ใน Amazon SageMaker และต่อไปนี้ ตัวอย่างโน๊ตบุ๊ค เพื่อเรียนรู้เกี่ยวกับการจำแนกประเภทภาพ SageMaker TensorFlow ในเชิงลึกยิ่งขึ้น รวมถึงวิธีรันการอนุมานบนโมเดลที่ผ่านการฝึกอบรมมาแล้ว ตลอดจนปรับแต่งโมเดลที่ผ่านการฝึกอบรมล่วงหน้าอย่างละเอียดในชุดข้อมูลที่กำหนดเอง

ข้อควรพิจารณาในการเลือกแบบจำลองขนาดใหญ่

การเลือกนางแบบคือกระบวนการเลือกนางแบบที่ดีที่สุดจากชุดนางแบบที่สมัคร กระบวนการนี้อาจใช้กับโมเดลประเภทเดียวกันที่มีน้ำหนักพารามิเตอร์ต่างกันและในโมเดลประเภทต่างๆ ตัวอย่างของการเลือกโมเดลระหว่างโมเดลประเภทเดียวกัน ได้แก่ การปรับโมเดลเดียวกันให้พอดีด้วยไฮเปอร์พารามิเตอร์ที่แตกต่างกัน (เช่น อัตราการเรียนรู้) และการหยุดก่อนกำหนดเพื่อป้องกันไม่ให้น้ำหนักโมเดลมากเกินไปในชุดข้อมูลรถไฟ การเลือกโมเดลในโมเดลประเภทต่างๆ รวมถึงการเลือกสถาปัตยกรรมโมเดลที่ดีที่สุด (เช่น Swin vs. MobileNet) และการเลือกการกำหนดค่าโมเดลที่ดีที่สุดภายในสถาปัตยกรรมโมเดลเดียว (เช่น mobilenet-v1-025-128 เมื่อเทียบกับ mobilenet-v3-large-100-224).

ข้อควรพิจารณาที่สรุปไว้ในส่วนนี้ช่วยให้กระบวนการเลือกแบบจำลองเหล่านี้ทั้งหมดอยู่บนชุดข้อมูลการตรวจสอบความถูกต้อง

เลือกการกำหนดค่าไฮเปอร์พารามิเตอร์

การจัดหมวดหมู่อิมเมจ TensorFlow ใน JumpStart มีจำนวนมาก ไฮเปอร์พารามิเตอร์ ที่สามารถปรับพฤติกรรมของทรานสเฟอร์เลิร์นนิงสคริปต์ให้เหมือนกันสำหรับสถาปัตยกรรมโมเดลทั้งหมด ไฮเปอร์พารามิเตอร์เหล่านี้เกี่ยวข้องกับการเพิ่มข้อมูลและการประมวลผลล่วงหน้า ข้อกำหนดเฉพาะของเครื่องมือเพิ่มประสิทธิภาพ การควบคุมที่มากเกินไป และตัวบ่งชี้ชั้นที่ฝึกได้ คุณควรปรับค่าเริ่มต้นของไฮเปอร์พารามิเตอร์เหล่านี้ตามความจำเป็นสำหรับแอปพลิเคชันของคุณ:

สำหรับการวิเคราะห์นี้และสมุดบันทึกที่เกี่ยวข้อง ไฮเปอร์พารามิเตอร์ทั้งหมดจะถูกตั้งค่าเป็นค่าเริ่มต้น ยกเว้นอัตราการเรียนรู้ จำนวนยุค และข้อกำหนดการหยุดก่อนกำหนด อัตราการเรียนรู้ถูกปรับเป็น พารามิเตอร์หมวดหมู่ โดย การปรับโมเดลอัตโนมัติของ SageMaker งาน. เนื่องจากแต่ละรุ่นมีค่าไฮเปอร์พารามิเตอร์เริ่มต้นที่ไม่ซ้ำกัน รายการแยกของอัตราการเรียนรู้ที่เป็นไปได้จึงรวมถึงอัตราการเรียนรู้เริ่มต้นและหนึ่งในห้าของอัตราการเรียนรู้เริ่มต้น ซึ่งจะเรียกใช้งานการฝึกอบรมสองงานสำหรับงานปรับแต่งไฮเปอร์พารามิเตอร์เดียว และเลือกงานการฝึกอบรมที่มีประสิทธิภาพการรายงานดีที่สุดในชุดข้อมูลการตรวจสอบความถูกต้อง เนื่องจากจำนวนของยุคถูกตั้งค่าเป็น 10 ซึ่งมากกว่าการตั้งค่าไฮเปอร์พารามิเตอร์เริ่มต้น งานการฝึกอบรมที่ดีที่สุดที่เลือกจึงไม่สอดคล้องกับอัตราการเรียนรู้เริ่มต้นเสมอไป ในที่สุด เกณฑ์การหยุดก่อนกำหนดจะใช้กับความอดทน หรือจำนวนยุคที่ต้องฝึกต่อไปโดยไม่มีการปรับปรุงในสามยุค

การตั้งค่าไฮเปอร์พารามิเตอร์ดีฟอลต์หนึ่งที่มีความสำคัญเป็นพิเศษคือ train_only_on_top_layerที่ไหน ถ้าตั้งค่าเป็น Trueเลเยอร์การแยกคุณลักษณะของโมเดลไม่ได้รับการปรับแต่งอย่างละเอียดในชุดข้อมูลการฝึกอบรมที่ให้มา เครื่องมือเพิ่มประสิทธิภาพจะฝึกเฉพาะพารามิเตอร์ในเลเยอร์การจำแนกประเภทที่เชื่อมต่ออย่างสมบูรณ์บนสุดโดยมีขนาดเอาต์พุตเท่ากับจำนวนป้ายกำกับคลาสในชุดข้อมูล ตามค่าเริ่มต้น ไฮเปอร์พารามิเตอร์นี้ถูกตั้งค่าเป็น Trueซึ่งเป็นการตั้งค่าที่กำหนดเป้าหมายสำหรับการถ่ายโอนการเรียนรู้บนชุดข้อมูลขนาดเล็ก คุณอาจมีชุดข้อมูลแบบกำหนดเองที่การดึงคุณสมบัติจากการฝึกล่วงหน้าในชุดข้อมูล ImageNet นั้นไม่เพียงพอ ในกรณีเหล่านี้ คุณควรตั้งค่า train_only_on_top_layer ไปยัง False. แม้ว่าการตั้งค่านี้จะเพิ่มเวลาในการฝึกฝน แต่คุณจะดึงคุณสมบัติที่มีความหมายมากขึ้นสำหรับปัญหาที่คุณสนใจ ซึ่งจะเป็นการเพิ่มความแม่นยำ

แยกเมตริกจาก CloudWatch Logs

อัลกอริทึมการจัดประเภทภาพ JumpStart TensorFlow บันทึกเมตริกต่างๆ ได้อย่างน่าเชื่อถือในระหว่างการฝึกอบรมที่ SageMaker เข้าถึงได้ Estimator และวัตถุ HyperparameterTuner ตัวสร้างของ SageMaker Estimator มี metric_definitions อาร์กิวเมนต์คำหลัก ซึ่งสามารถใช้ในการประเมินงานการฝึกอบรมโดยจัดเตรียมรายการพจนานุกรมที่มีสองคีย์: ชื่อสำหรับชื่อของเมตริก และ Regex สำหรับนิพจน์ทั่วไปที่ใช้ในการแยกเมตริกจากบันทึก ที่มาพร้อมกับ สมุดบันทึก แสดงรายละเอียดการใช้งาน ตารางต่อไปนี้แสดงเมตริกที่มีอยู่และนิพจน์ทั่วไปที่เกี่ยวข้องสำหรับโมเดลการจัดประเภทอิมเมจ JumpStart TensorFlow ทั้งหมด

| ชื่อเมตริก | นิพจน์ปกติ |

| จำนวนพารามิเตอร์ | “- จำนวนพารามิเตอร์: ([0-9\.]+)” |

| จำนวนพารามิเตอร์ที่สามารถฝึกได้ | “- จำนวนพารามิเตอร์ที่สามารถฝึกได้: ([0-9\.]+)” |

| จำนวนพารามิเตอร์ที่ไม่สามารถฝึกได้ | “- จำนวนพารามิเตอร์ที่ไม่สามารถฝึกได้: ([0-9\.]+)” |

| รถไฟเมตริกชุดข้อมูล | f”- {เมตริก}: ([0-9\.]+)” |

| เมตริกชุดข้อมูลการตรวจสอบความถูกต้อง | f”- val_{เมตริก}: ([0-9\.]+)” |

| ทดสอบชุดข้อมูลเมตริก | f”- ทดสอบ {เมตริก}: ([0-9\.]+)” |

| ระยะเวลารถไฟ | “- ระยะเวลาการฝึกทั้งหมด: ([0-9\.]+)” |

| ระยะเวลารถไฟต่อยุค | “- ระยะเวลาการฝึกโดยเฉลี่ยต่อยุค: ([0-9\.]+)” |

| การทดสอบการประเมินเวลาแฝง | “- เวลาแฝงในการประเมินการทดสอบ: ([0-9\.]+)” |

| ทดสอบเวลาแฝงต่อตัวอย่าง | “- เวลาแฝงการทดสอบเฉลี่ยต่อตัวอย่าง: ([0-9\.]+)” |

| ทดสอบปริมาณงาน | “- ปริมาณการทดสอบเฉลี่ย: ([0-9\.]+)” |

สคริปต์การเรียนรู้การถ่ายโอนในตัวมีเมตริกการฝึก การตรวจสอบ และการทดสอบชุดข้อมูลที่หลากหลายภายในคำจำกัดความเหล่านี้ ซึ่งแสดงด้วยค่าการแทนที่ f-string เมตริกที่แน่นอนที่มีอยู่จะแตกต่างกันไปตามประเภทของการจัดประเภทที่กำลังดำเนินการ โมเดลที่รวบรวมทั้งหมดมี loss เมตริก ซึ่งแสดงด้วยการสูญเสียข้ามเอนโทรปีสำหรับปัญหาการจำแนกประเภทแบบไบนารีหรือแบบหมวดหมู่ อดีตใช้เมื่อมีป้ายกำกับคลาสเดียว ส่วนหลังจะใช้หากมีป้ายกำกับคลาสตั้งแต่สองป้ายขึ้นไป หากมีเพียงป้ายกำกับคลาสเดียว เมตริกต่อไปนี้จะถูกคำนวณ บันทึก และแยกข้อมูลได้ผ่านนิพจน์ทั่วไปของสตริง f ในตารางก่อนหน้า: จำนวนผลบวกจริง (true_pos) จำนวนผลบวกลวง (false_pos) จำนวนของค่าลบจริง (true_neg), จำนวนของการลบเท็จ (false_neg), precision, recall, พื้นที่ใต้เส้นโค้งลักษณะการทำงานของเครื่องรับ (ROC) (auc) และพื้นที่ใต้เส้นโค้งการเรียกคืนความแม่นยำ (PR) (prc). ในทำนองเดียวกัน หากมีป้ายกำกับคลาสตั้งแต่หกป้ายขึ้นไป การวัดความแม่นยำ 5 อันดับแรก (top_5_accuracy) ยังสามารถคำนวณ บันทึก และแยกข้อมูลได้ผ่านนิพจน์ทั่วไปก่อนหน้า

ในระหว่างการฝึกอบรม เมตริกที่ระบุให้กับ SageMaker Estimator จะถูกส่งไปยัง CloudWatch Logs เมื่อการฝึกเสร็จสิ้น คุณสามารถเรียกใช้ SageMaker อธิบายการฝึกอบรมงาน API และตรวจสอบ FinalMetricDataList ป้อนคำตอบ JSON:

API นี้ต้องการเพียงชื่องานที่ต้องระบุในแบบสอบถาม ดังนั้น เมื่อเสร็จสิ้นแล้ว จะสามารถรับเมตริกในการวิเคราะห์ในอนาคตได้ ตราบใดที่ชื่องานการฝึกอบรมได้รับการบันทึกอย่างเหมาะสมและสามารถกู้คืนได้ สำหรับงานการเลือกโมเดลนี้ ชื่องานการปรับแต่งไฮเปอร์พารามิเตอร์จะถูกจัดเก็บและการวิเคราะห์ที่ตามมาจะแนบกลับเข้าไปใหม่ HyperparameterTuner ออบเจกต์ที่กำหนดชื่องานปรับแต่ง แยกชื่องานการฝึกที่ดีที่สุดจากตัวปรับไฮเปอร์พารามิเตอร์ที่แนบมา จากนั้นเรียกใช้ DescribeTrainingJob API ตามที่อธิบายไว้ก่อนหน้านี้เพื่อรับเมตริกที่เกี่ยวข้องกับงานฝึกอบรมที่ดีที่สุด

เรียกใช้งานการปรับไฮเปอร์พารามิเตอร์แบบอะซิงโครนัส

อ้างถึงที่เกี่ยวข้อง สมุดบันทึก สำหรับรายละเอียดการใช้งานเกี่ยวกับการเรียกใช้งานการปรับไฮเปอร์พารามิเตอร์แบบอะซิงโครนัส ซึ่งใช้ไลบรารีมาตรฐานของ Python อนาคตพร้อมกัน โมดูล อินเทอร์เฟซระดับสูงสำหรับการเรียกใช้งานแบบอะซิงโครนัส โซลูชันนี้ใช้การพิจารณาที่เกี่ยวข้องกับ SageMaker หลายประการ:

- บัญชี AWS แต่ละบัญชีเชื่อมโยงกับ โควต้าบริการของ SageMaker. คุณควรดูขีดจำกัดปัจจุบันของคุณเพื่อใช้ทรัพยากรอย่างเต็มที่ และอาจขอเพิ่มขีดจำกัดทรัพยากรได้ตามต้องการ

- การเรียกใช้ API บ่อยครั้งเพื่อสร้างงานปรับแต่งไฮเปอร์พารามิเตอร์พร้อมกันจำนวนมากอาจทำได้ เกินอัตรา Python SDK และส่งข้อยกเว้นการควบคุมปริมาณ. การแก้ปัญหานี้คือการสร้างไคลเอนต์ SageMaker Boto3 ด้วยการกำหนดค่าการลองใหม่แบบกำหนดเอง

- จะเกิดอะไรขึ้นหากสคริปต์ของคุณพบข้อผิดพลาดหรือสคริปต์หยุดทำงานก่อนที่จะเสร็จสิ้น สำหรับการเลือกรุ่นขนาดใหญ่หรือการศึกษาเปรียบเทียบ คุณสามารถบันทึกชื่องานปรับแต่งและจัดเตรียมฟังก์ชันอำนวยความสะดวกให้ ใส่งานปรับแต่งไฮเปอร์พารามิเตอร์อีกครั้ง ที่มีอยู่แล้ว:

รายละเอียดการวิเคราะห์และการอภิปราย

การวิเคราะห์ในโพสต์นี้ดำเนินการโอนการเรียนรู้สำหรับ รหัสรุ่น ในอัลกอริธึมการจำแนกภาพ JumpStart TensorFlow ในชุดข้อมูล Caltech-256 งานการฝึกอบรมทั้งหมดดำเนินการบนอินสแตนซ์การฝึกอบรม SageMaker ml.g4dn.xlarge ซึ่งมี NVIDIA T4 GPU ตัวเดียว

ชุดข้อมูลการทดสอบจะได้รับการประเมินในอินสแตนซ์การฝึกอบรมเมื่อสิ้นสุดการฝึกอบรม การเลือกแบบจำลองจะดำเนินการก่อนการประเมินชุดข้อมูลทดสอบเพื่อตั้งค่าน้ำหนักแบบจำลองเป็นยุคที่มีประสิทธิภาพชุดการตรวจสอบที่ดีที่สุด ปริมาณงานทดสอบไม่ได้รับการปรับให้เหมาะสม: ขนาดแบตช์ชุดข้อมูลถูกตั้งค่าเป็นขนาดแบตช์ไฮเปอร์พารามิเตอร์การฝึกเริ่มต้น ซึ่งไม่ได้ปรับเพื่อเพิ่มการใช้งานหน่วยความจำ GPU สูงสุด ทรูพุตการทดสอบที่รายงานรวมถึงเวลาในการโหลดข้อมูลเนื่องจากชุดข้อมูลไม่ได้แคชไว้ล่วงหน้า และไม่มีการใช้การอนุมานแบบกระจายระหว่าง GPU หลายตัว ด้วยเหตุผลเหล่านี้ ทรูพุตนี้เป็นการวัดสัมพัทธ์ที่ดี แต่ทรูพุตจริงจะขึ้นอยู่กับการกำหนดค่าการปรับใช้ปลายทางการอนุมานสำหรับโมเดลที่ผ่านการฝึกอบรมเป็นอย่างมาก

แม้ว่าฮับโมเดล JumpStart จะมีสถาปัตยกรรมการจัดหมวดหมู่รูปภาพหลายประเภท แต่ขอบเขตพาเรโตนี้ถูกครอบงำด้วยโมเดล Swin, EfficientNet และ MobileNet ที่เลือก โมเดล Swin มีขนาดใหญ่กว่าและค่อนข้างแม่นยำกว่า ในขณะที่โมเดล MobileNet มีขนาดเล็กกว่า ค่อนข้างแม่นยำน้อยกว่า และเหมาะสำหรับข้อจำกัดด้านทรัพยากรของอุปกรณ์เคลื่อนที่ สิ่งสำคัญคือต้องทราบว่าพรมแดนนี้ถูกกำหนดโดยปัจจัยหลายประการ รวมถึงชุดข้อมูลที่ใช้จริงและไฮเปอร์พารามิเตอร์ที่เลือกไว้อย่างละเอียด คุณอาจพบว่าชุดข้อมูลที่กำหนดเองของคุณสร้างชุดโซลูชันที่มีประสิทธิภาพแบบพาเรโตที่แตกต่างกัน และคุณอาจต้องการเวลาฝึกนานขึ้นด้วยไฮเปอร์พารามิเตอร์ที่แตกต่างกัน เช่น การเพิ่มข้อมูลมากขึ้นหรือการปรับแต่งอย่างละเอียดมากกว่าแค่ชั้นการจัดหมวดหมู่บนสุดของโมเดล

สรุป

ในโพสต์นี้ เราได้แสดงวิธีเรียกใช้การเลือกโมเดลขนาดใหญ่หรืองานเปรียบเทียบโดยใช้ฮับโมเดล JumpStart โซลูชันนี้สามารถช่วยคุณเลือกรุ่นที่ดีที่สุดสำหรับความต้องการของคุณ เราขอแนะนำให้คุณลองสำรวจสิ่งนี้ดู ทางออก ในชุดข้อมูลของคุณเอง

อ้างอิง

ข้อมูลเพิ่มเติมสามารถดูได้ที่แหล่งข้อมูลต่อไปนี้:

เกี่ยวกับผู้แต่ง

ดร.ไคล์ อูลริช เป็นนักวิทยาศาสตร์ประยุกต์กับ อัลกอริทึมในตัวของ Amazon SageMaker ทีม. งานวิจัยที่เขาสนใจ ได้แก่ อัลกอริธึมแมชชีนเลิร์นนิงที่ปรับขนาดได้ คอมพิวเตอร์วิทัศน์ อนุกรมเวลา เบส์ที่ไม่ใช่พารามิเตอร์ และกระบวนการเกาส์เซียน ปริญญาเอกของเขามาจาก Duke University และเขาได้ตีพิมพ์บทความใน NeurIPS, Cell และ Neuron

ดร.ไคล์ อูลริช เป็นนักวิทยาศาสตร์ประยุกต์กับ อัลกอริทึมในตัวของ Amazon SageMaker ทีม. งานวิจัยที่เขาสนใจ ได้แก่ อัลกอริธึมแมชชีนเลิร์นนิงที่ปรับขนาดได้ คอมพิวเตอร์วิทัศน์ อนุกรมเวลา เบส์ที่ไม่ใช่พารามิเตอร์ และกระบวนการเกาส์เซียน ปริญญาเอกของเขามาจาก Duke University และเขาได้ตีพิมพ์บทความใน NeurIPS, Cell และ Neuron

ดร. Ashish Khetan เป็นนักวิทยาศาสตร์ประยุกต์อาวุโสด้วย อัลกอริทึมในตัวของ Amazon SageMaker และช่วยพัฒนาอัลกอริธึมการเรียนรู้ของเครื่อง เขาได้รับปริญญาเอกจากมหาวิทยาลัยอิลลินอยส์เออร์บานาแชมเปญ เขาเป็นนักวิจัยเชิงรุกด้านการเรียนรู้ของเครื่องและการอนุมานทางสถิติ และได้ตีพิมพ์บทความจำนวนมากในการประชุม NeurIPS, ICML, ICLR, JMLR, ACL และ EMNLP

ดร. Ashish Khetan เป็นนักวิทยาศาสตร์ประยุกต์อาวุโสด้วย อัลกอริทึมในตัวของ Amazon SageMaker และช่วยพัฒนาอัลกอริธึมการเรียนรู้ของเครื่อง เขาได้รับปริญญาเอกจากมหาวิทยาลัยอิลลินอยส์เออร์บานาแชมเปญ เขาเป็นนักวิจัยเชิงรุกด้านการเรียนรู้ของเครื่องและการอนุมานทางสถิติ และได้ตีพิมพ์บทความจำนวนมากในการประชุม NeurIPS, ICML, ICLR, JMLR, ACL และ EMNLP

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- เพลโตบล็อคเชน Web3 Metaverse ข่าวกรอง ขยายความรู้. เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/image-classification-model-selection-using-amazon-sagemaker-jumpstart/

- 10

- 100

- 9

- a

- เกี่ยวกับเรา

- เข้า

- สามารถเข้าถึงได้

- ลงชื่อเข้าใช้

- ความถูกต้อง

- ถูกต้อง

- บรรลุ

- ข้าม

- คล่องแคล่ว

- นอกจากนี้

- ที่อยู่

- ที่อยู่

- ปรับ

- ในเครือ

- กับ

- ขั้นตอนวิธี

- อัลกอริทึม

- ทั้งหมด

- แล้ว

- แม้ว่า

- เสมอ

- อเมซอน

- อเมซอน SageMaker

- Amazon SageMaker JumpStart

- การวิเคราะห์

- และ

- อื่น

- API

- การใช้งาน

- ประยุกต์

- อย่างเหมาะสม

- สถาปัตยกรรม

- AREA

- อาร์กิวเมนต์

- ที่เกี่ยวข้อง

- แนบ

- ความพยายามในการ

- อัตโนมัติ

- ใช้ได้

- เฉลี่ย

- AWS

- ตาม

- เบย์เซียน

- เพราะ

- ก่อน

- กำลัง

- ที่ดีที่สุด

- ใหญ่

- built-in

- ธุรกิจ

- โทร

- ผู้สมัคร

- กรณี

- หมวดหมู่

- ท้าทาย

- ลักษณะเฉพาะ

- Choose

- ชั้น

- การจัดหมวดหมู่

- แยกประเภท

- ไคลเอนต์

- รวม

- ร่วมกัน

- การเปรียบเทียบ

- สมบูรณ์

- เสร็จ

- เสร็จสิ้น

- ความซับซ้อน

- คอมพิวเตอร์

- วิสัยทัศน์คอมพิวเตอร์

- ความกังวลเกี่ยวกับ

- การประชุม

- องค์ประกอบ

- งานที่เชื่อมต่อ

- การเชื่อมต่อ

- การพิจารณา

- ข้อ จำกัด

- มี

- ต่อ

- การควบคุม

- การควบคุม

- ความสะดวกสบาย

- ตรงกัน

- หน้าปก

- สร้าง

- ปัจจุบัน

- เส้นโค้ง

- ประเพณี

- ข้อมูล

- ชุดข้อมูล

- ลึก

- ค่าเริ่มต้น

- ขึ้นอยู่กับ

- ปรับใช้

- ปรับใช้

- การใช้งาน

- ความลึก

- อธิบาย

- ลักษณะ

- รายละเอียด

- พัฒนา

- อุปกรณ์

- ต่าง

- สนทนา

- กระจาย

- หลาย

- ไม่

- ดยุค

- มหาวิทยาลัยดุ๊ก

- ในระหว่าง

- แต่ละ

- ก่อน

- ก่อน

- ง่ายดาย

- ที่มีประสิทธิภาพ

- ทั้ง

- กำจัด

- ทำให้สามารถ

- ส่งเสริม

- สนับสนุนให้

- จบสิ้น

- ปลายทาง

- สิ่งแวดล้อม

- ยุค

- ยุค

- ความผิดพลาด

- อีเธอร์ (ETH)

- ประเมินค่า

- ประเมิน

- การประเมินผล

- ตัวอย่าง

- ตัวอย่าง

- ยกเว้น

- สำรวจ

- สำรวจ

- การแสดงออก

- สารสกัด

- การสกัด

- ปัจจัย

- ธรรม

- โปรดปราน

- ลักษณะ

- คุณสมบัติ

- สาขา

- รูป

- ในที่สุด

- หา

- ชื่อจริง

- เหมาะสม

- ดังต่อไปนี้

- อดีต

- ราคาเริ่มต้นที่

- ชายแดน

- พรมแดน

- อย่างเต็มที่

- ฟังก์ชั่น

- อนาคต

- ฟิวเจอร์ส

- สร้าง

- ได้รับ

- กำหนด

- เหตุการณ์ที่

- ดี

- GPU

- GPUs

- ยิ่งใหญ่

- มากขึ้น

- สีเขียว

- ที่เกิดขึ้น

- หนัก

- ช่วย

- จะช่วยให้

- ระดับสูง

- ที่มีคุณภาพสูง

- สูงกว่า

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- HTML

- HTTPS

- Hub

- ร้อย

- การปรับแต่งไฮเปอร์พารามิเตอร์

- ไอซีแอลอาร์

- อิลลินอยส์

- ภาพ

- การจำแนกรูปภาพ

- อิมเมจเน็ต

- ภาพ

- การดำเนินการ

- การดำเนินงาน

- การดำเนินการ

- ความสำคัญ

- สำคัญ

- การปรับปรุง

- การปรับปรุง

- in

- ประกอบด้วย

- รวมถึง

- รวมทั้ง

- เพิ่ม

- เพิ่มขึ้น

- ที่เพิ่มขึ้น

- ตัวชี้วัด

- ข้อมูล

- อินพุต

- ตัวอย่าง

- อยากเรียนรู้

- ผลประโยชน์

- อินเตอร์เฟซ

- ภายใน

- แท้จริง

- แนะนำ

- IT

- การสัมภาษณ์

- งาน

- JSON

- คีย์

- กุญแจ

- ฉลาก

- ป้ายกำกับ

- ใหญ่

- ขนาดใหญ่

- ที่มีขนาดใหญ่

- ความแอบแฝง

- การเปิดตัว

- การเปิดตัว

- ชั้น

- ชั้น

- ชั้นนำ

- เรียนรู้

- การเรียนรู้

- facelift

- เบา

- LIMIT

- ขีด จำกัด

- รายการ

- รายการ

- โหลด

- นาน

- อีกต่อไป

- ปิด

- เครื่อง

- เรียนรู้เครื่อง

- การทำ

- หลาย

- เพิ่ม

- มีความหมาย

- วัด

- หน่วยความจำ

- เมตริก

- ตัวชี้วัด

- ML

- ตอบสนอง

- อุปกรณ์มือถือ

- แบบ

- โมเดล

- โมดูล

- ข้อมูลเพิ่มเติม

- หลาย

- ชื่อ

- ชื่อ

- จำเป็น

- จำเป็น

- ความต้องการ

- เครือข่าย

- ประสาท

- ประสาทไอพีเอส

- ใหม่

- สมุดบันทึก

- จำนวน

- Nvidia

- วัตถุ

- วัตถุ

- สังเกต

- ได้รับ

- ที่ได้รับ

- ONE

- การดำเนินงาน

- การดำเนินการ

- การปรับให้เหมาะสม

- ที่ระบุไว้

- ของตนเอง

- เอกสาร

- พารามิเตอร์

- พารามิเตอร์

- ในสิ่งที่สนใจ

- ความอดทน

- รูปแบบไฟล์ PDF

- ดำเนินการ

- การปฏิบัติ

- ดำเนินการ

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- จุด

- จุด

- ยอดนิยม

- เป็นไปได้

- โพสต์

- ที่อาจเกิดขึ้น

- pr

- ป้องกัน

- ก่อน

- ปัญหา

- ปัญหาที่เกิดขึ้น

- กระบวนการ

- กระบวนการ

- ให้

- ให้

- ให้

- การให้

- การตีพิมพ์

- หลาม

- คำถาม

- คำถาม

- อย่างรวดเร็ว

- แรม

- คะแนน

- ราคา

- โลกแห่งความจริง

- เหตุผล

- ลด

- ปกติ

- สัมพัทธ์

- เอาออก

- รายงาน

- แสดง

- เป็นตัวแทนของ

- แสดงให้เห็นถึง

- ขอ

- จำเป็นต้องใช้

- ความต้องการ

- ต้อง

- การวิจัย

- นักวิจัย

- ความละเอียด

- ทรัพยากร

- แหล่งข้อมูล

- คำตอบ

- ผลสอบ

- วิ่ง

- วิ่ง

- sagemaker

- เดียวกัน

- ที่ปรับขนาดได้

- นักวิทยาศาสตร์

- สคริปต์

- SDK

- ค้นหา

- Section

- เลือก

- การเลือก

- การเลือก

- ระดับอาวุโส

- ชุด

- บริการ

- เซสชั่น

- ชุด

- ชุดอุปกรณ์

- การตั้งค่า

- หลาย

- รูปร่าง

- น่า

- แสดงให้เห็นว่า

- เหมือนกับ

- ลดความซับซ้อน

- พร้อมกัน

- เดียว

- หก

- ขนาด

- ขนาด

- เล็ก

- มีขนาดเล็กกว่า

- So

- ทางออก

- โซลูชัน

- แก้

- สเปค

- ข้อกำหนด

- ที่ระบุไว้

- มาตรฐาน

- ข้อความที่เริ่ม

- ทางสถิติ

- ขั้นตอน

- หยุด

- การหยุด

- เก็บไว้

- ศึกษา

- ภายหลัง

- อย่างเป็นจริงเป็นจัง

- อย่างเช่น

- เพียงพอ

- เหมาะสม

- ตาราง

- เป้าหมาย

- งาน

- งาน

- ทีม

- tensorflow

- ทดสอบ

- พื้นที่

- ของพวกเขา

- ดังนั้น

- สาม

- ปริมาณงาน

- เวลา

- อนุกรมเวลา

- ครั้ง

- ไปยัง

- ในวันนี้

- ร่วมกัน

- เครื่องมือ

- ด้านบน

- ชั้น 5

- รวม

- รถไฟ

- ผ่านการฝึกอบรม

- การฝึกอบรม

- โอน

- หม้อแปลง

- จริง

- ชนิด

- ในที่สุด

- ภายใต้

- เป็นเอกลักษณ์

- มหาวิทยาลัย

- การใช้

- ใช้

- นำไปใช้

- ใช้

- การตรวจสอบ

- ความคุ้มค่า

- ความหลากหลาย

- กว้างใหญ่

- ผ่านทาง

- รายละเอียด

- วิสัยทัศน์

- ที่

- ในขณะที่

- กว้าง

- จะ

- ภายใน

- ไม่มี

- จะ

- การเขียน

- ของคุณ

- ลมทะเล