Vi vill alla se våra idealiska mänskliga värden återspeglas i vår teknologi. Vi förväntar oss att teknik som artificiell intelligens (AI) inte ska ljuga för oss, inte diskriminera och vara säker för oss och våra barn att använda. Ändå står många AI-skapare för närvarande inför motreaktioner för de fördomar, felaktigheter och problematiska datapraxis som avslöjas i deras modeller. Dessa problem kräver mer än en teknisk, algoritmisk eller AI-baserad lösning. I verkligheten krävs ett holistiskt, sociotekniskt förhållningssätt.

Matematiken visar en kraftfull sanning

Alla prediktiva modeller, inklusive AI, är mer exakta när de innehåller olika mänsklig intelligens och erfarenhet. Detta är inte en åsikt; den har empirisk giltighet. Överväga mångfaldsprediktionsteorem. Enkelt uttryckt, när mångfalden i en grupp är stor, är skarans fel liten – vilket stöder konceptet ”mängdens visdom”. I en inflytelserik studie visades det att olika grupper av problemlösare med låg förmåga kan överträffa grupper av problemlösare med hög förmåga (Hong & Page, 2004).

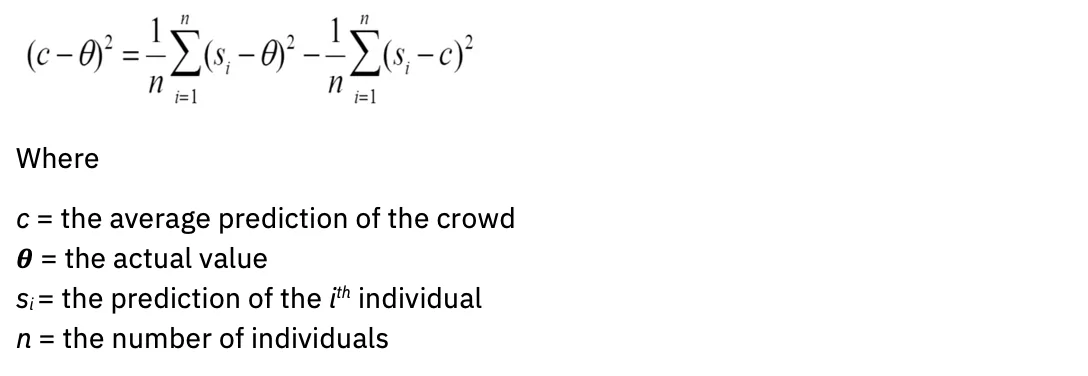

På matematiskt språk: ju större varians du har, desto mer standard är ditt medelvärde. Ekvationen ser ut så här:

A ytterligare studier tillhandahållit fler beräkningar som förfinar de statistiska definitionerna av en klok skara, inklusive okunnighet om andra medlemmars förutsägelser och inkludering av de med maximalt olika (negativt korrelerade) förutsägelser eller bedömningar. Så det är inte bara volym, utan mångfald som förbättrar förutsägelser. Hur kan denna insikt påverka utvärderingen av AI-modeller?

Modellens (o)noggrannhet

För att citera en vanlig aforism, alla modeller har fel. Detta gäller inom områdena statistik, vetenskap och AI. Modeller skapade med brist på domänexpertis kan leda till felaktig utgångar.

Idag bestämmer en liten homogen grupp människor vilken data som ska användas för att träna generativa AI-modeller, som hämtas från källor som kraftigt överrepresenterar engelska. "För de flesta av de över 6,000 XNUMX språken i världen räcker inte tillgänglig textdata för att träna en storskalig grundmodell" (från "Om möjligheter och risker med grundmodeller”, Bommasani et al., 2022).

Dessutom är själva modellerna skapade från begränsade arkitekturer: "Nästan alla toppmoderna NLP-modeller är nu anpassade från en av ett fåtal grundmodeller, såsom BERT, RoBERTa, BART, T5, etc. Även om denna homogenisering producerar extremt hög hävstångseffekt (alla förbättringar i grundmodellerna kan leda till omedelbara fördelar för hela NLP), det är också en skuld; alla AI-system kan ärva samma problematiska fördomar som ett fåtal grundmodeller (Bommasani et al.) "

För att generativ AI bättre ska återspegla de olika samhällen den betjänar, måste en mycket bredare variation av människors data representeras i modeller.

Att utvärdera modellens noggrannhet går hand i hand med att utvärdera bias. Vi måste fråga oss, vad är syftet med modellen och för vem är den optimerad? Tänk till exempel vem som drar mest nytta av innehållsrekommendationsalgoritmer och sökmotoralgoritmer. Intressenter kan ha vitt skilda intressen och mål. Algoritmer och modeller kräver mål eller proxyservrar för Bayes-fel: det minsta fel som en modell måste förbättra. Denna proxy är ofta en person, till exempel en ämnesexpert med domänexpertis.

En mycket mänsklig utmaning: Att bedöma risk före modellupphandling eller utveckling

Nya AI-föreskrifter och handlingsplaner understryker allt mer vikten av algoritmiska konsekvensbedömningsformulär. Målet med dessa formulär är att fånga kritisk information om AI-modeller så att ledningsteam kan bedöma och hantera sina risker innan de implementeras. Typiska frågor inkluderar:

- Vad är din modells användningsfall?

- Vilka är riskerna för olika effekter?

- Hur bedömer du rättvisa?

- Hur gör du för att göra din modell förklarlig?

Även om de är designade med goda avsikter är problemet att de flesta ägare av AI-modeller inte förstår hur de ska utvärdera riskerna för deras användningsfall. En vanlig refräng kan vara: "Hur kan min modell vara orättvis om den inte samlar in personligt identifierbar information (PII)?" Följaktligen fylls formulären sällan i med den omtänksamhet som krävs för att styrsystem ska kunna flagga riskfaktorer korrekt.

Därmed understryks lösningens sociotekniska karaktär. En modellägare – en individ – kan inte bara få en lista med kryssrutor för att utvärdera om deras användningsfall kommer att orsaka skada. Det som i stället krävs är att grupper av människor med vitt skilda erfarenheter från den levande världen samlas i samhällen som erbjuder psykologisk trygghet för att ha svåra samtal om olika effekter.

Välkomna bredare perspektiv för pålitlig AI

IBM® tror på att ta en "klient noll"-strategi och implementera de rekommendationer och system som det skulle göra för sina egna kunder genom konsulttjänster och produktledda lösningar. Detta tillvägagångssätt sträcker sig till etiska metoder, vilket är anledningen till att IBM skapade ett Trustworthy AI Center of Excellence (COE).

Som förklarats ovan är mångfald av erfarenheter och färdigheter avgörande för att korrekt utvärdera effekterna av AI. Men möjligheten att delta i ett Center of Excellence kan vara skrämmande i ett företag som är full av AI-innovatörer, experter och framstående ingenjörer, så det behövs en gemenskap av psykologisk säkerhet. IBM kommunicerar detta tydligt genom att säga: "Intresserad av AI? Intresserad av AI-etik? Du har en plats vid det här bordet."

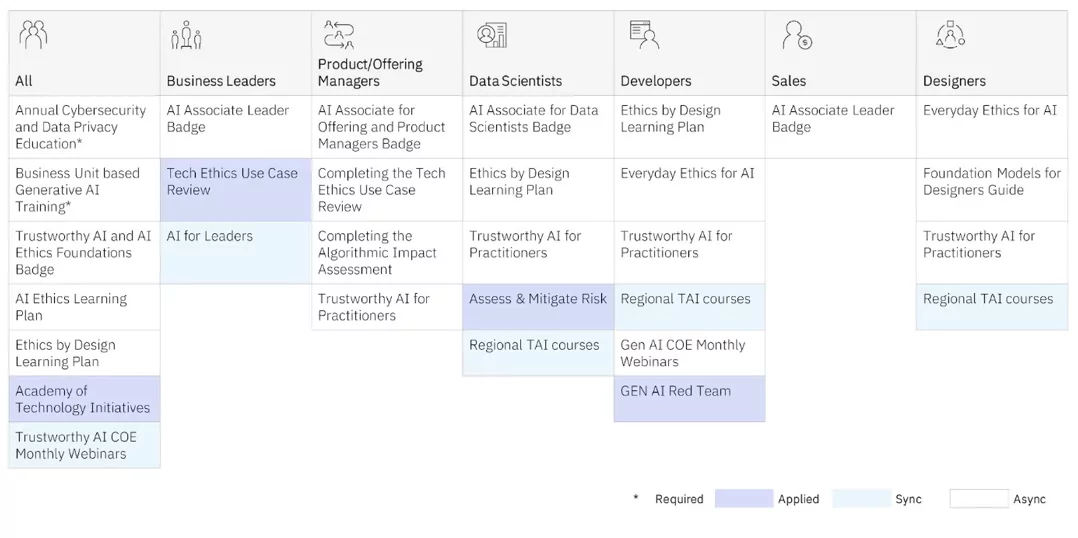

COE erbjuder utbildning i AI-etik till utövare på alla nivåer. Både synkront lärande (lärare och elever i klassmiljöer) och asynkrona (självledda) program erbjuds.

Men det är COE:s tillämpas utbildning som ger våra utövare de djupaste insikterna, eftersom de arbetar med globala, mångsidiga, multidisciplinära team på verkliga projekt för att bättre förstå olika effekter. De utnyttjar också ramverk för designtänkande som IBM:s Design för AI group använder internt och med kunder för att bedöma de oavsiktliga effekterna av AI-modeller, och hålla dem som ofta är marginaliserade i fokus. (Se Sylvia Duckworths Hjulet av makt och privilegier för exempel på hur personliga egenskaper korsas för att privilegiera eller marginalisera människor.) IBM donerade också många av ramverken till öppen källkodsgemenskapen Designa etiskt.

Nedan följer några av de rapporter som IBM har publicerat offentligt om dessa projekt:

Automatiserade verktyg för styrning av AI-modeller krävs för att få viktiga insikter om hur din AI-modell presterar. Men observera, att fånga risker långt innan din modell har utvecklats och är i produktion är optimalt. Genom att skapa gemenskaper av olika, tvärvetenskapliga utövare som erbjuder ett säkert utrymme för människor att ha tuffa samtal om olika effekter, kan du börja din resa mot att operationalisera dina principer och utveckla AI på ett ansvarsfullt sätt.

I praktiken, när du anställer AI-utövare, tänk på att långt över 70 % av arbetet med att skapa modeller är att kurera rätt data. Du vill anställa personer som vet hur man samlar in data som är representativ och som också samlas in med samtycke. Du vill också att personer som vet ska arbeta nära domänexperter för att se till att de har rätt tillvägagångssätt. Att se till att dessa utövare har den känslomässiga intelligensen att ta sig an utmaningen att ansvarsfullt kurera AI med ödmjukhet och urskillning är nyckeln. Vi måste vara avsiktliga med att lära oss hur vi känner igen hur och när AI-system kan förvärra ojämlikhet lika mycket som de kan öka mänsklig intelligens.

Uppfinn på nytt hur ditt företag arbetar med AI

var den här artikeln hjälpsam?

JaNej

Mer från artificiell intelligens

IBMs nyhetsbrev

Få våra nyhetsbrev och ämnesuppdateringar som ger det senaste tankeledarskapet och insikter om nya trender.

Prenumerera nu

Fler nyhetsbrev

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://www.ibm.com/blog/why-we-need-diverse-multidisciplinary-coes-for-model-risk/

- : har

- :är

- :inte

- :var

- $UPP

- 000

- 1

- 16

- 2022

- 2024

- 23

- 25

- 28

- 29

- 30

- 300

- 32

- 39

- 40

- 400

- 65

- 7

- 9

- a

- förmåga

- Om oss

- ovan

- AC

- accelerera

- noggrannhet

- exakt

- exakt

- tvärs

- Handling

- anpassat

- adress

- erkänna

- anta

- reklam

- rådgivning

- påverka

- medel

- AI

- AI-modeller

- AI-system

- Syftet

- AL

- algoritmisk

- algoritmer

- Alla

- också

- alltid

- amp

- an

- analytics

- och

- vilken som helst

- Ansökan

- tillämpningar

- tillvägagångssätt

- ÄR

- områden

- Artikeln

- konstgjord

- artificiell intelligens

- Konstgjord intelligens (AI)

- AS

- be

- bedöma

- bedöma

- bedömning

- assistenter

- bistå

- At

- audio

- förstärka

- Författaren

- tillgänglig

- undvika

- tillbaka

- balansering

- BE

- varit

- innan

- börja

- Där vi får lov att vara utan att konstant prestera,

- tror

- Fördelarna

- Bättre

- Bortom

- förspänning

- förspänner

- Blogg

- bloggar

- Blå

- boston

- båda

- bredare

- Byggnad

- företag

- affärsfunktioner

- företag

- men

- Knappen

- by

- KAN

- fånga

- Fångande

- kol

- kortet

- Kort

- vilken

- Vid

- KATT

- Kategori

- Orsak

- Centrum

- Kompetenscentrum

- centrala

- vissa

- utmanar

- egenskaper

- chatbots

- ta

- barn

- Barn

- cirklar

- CIS

- klass

- klart

- klienter

- nära

- cloud

- färg

- kombination

- kommande

- Gemensam

- samhällen

- samfundet

- Företag

- företag

- Avslutade

- begrepp

- samtycke

- Följaktligen

- Tänk

- rådgivning

- Behållare

- fortsätta

- konversationer

- Kärna

- korrekt

- korrelerade

- Pris

- kunde

- skapas

- Skapa

- skaparna

- kritisk

- folkmassa

- CSS

- organisera

- För närvarande

- beställnings

- kund

- kundupplevelse

- Kunder

- datum

- Datum

- beslut

- djupaste

- Standard

- definitioner

- leverera

- demonstrerar

- utplacera

- beskrivning

- Designa

- designtänkande

- utformade

- Bestämma

- utveckla

- utvecklade

- olika

- svårt

- digital

- digital Transformation

- disparat

- Distingerad

- flera

- Mångfald

- do

- domän

- donerat

- dras

- driv

- E&T

- effekter

- ansträngning

- eliminera

- inbäddning

- omfamna

- smärgel

- anställda

- möjliggöra

- engagerande

- Motor

- Ingenjörer

- Engelska

- tillräckligt

- säkerställa

- ange

- fel

- etc

- Eter (ETH)

- etisk

- etik

- utvärdera

- utvärdering

- utvärdering

- Även

- Varje

- överallt

- förvärra

- exempel

- exempel

- Excellence

- Utgång

- förvänta

- erfarenhet

- Erfarenheter

- expert

- expertis

- experter

- förklarade

- utsatta

- sträcker

- extremt

- facebook messenger

- främja

- vänd

- faktorer

- rättvisa

- falsk

- långt

- SNABB

- få

- hitta

- Fokus

- följer

- efter

- typsnitt

- För

- förgrunden

- former

- fundament

- ramar

- från

- främre

- funktioner

- samla

- samlade ihop

- samla

- generativ

- Generativ AI

- Generatorn

- skaffa sig

- ges

- ger

- Välgörenhet

- Målet

- Mål

- Går

- god

- styrning

- Grammatik

- kraftigt

- Rutnät

- Grupp

- Gruppens

- Tillväxt

- styra

- skada

- Har

- Rubrik

- höra

- höjd

- hjälpa

- hjälp

- Hög

- honom

- hyra

- Anställa

- hans

- innehar

- helhetssyn

- Hem

- Hur ser din drömresa ut

- How To

- HTTPS

- humant

- mänsklig intelligens

- ödmjukhet

- Hybrid

- hybrid moln

- i

- SJUK

- IBM

- ICO

- IKON

- idealisk

- identifierade

- if

- Okunnighet

- bild

- omedelbar

- Inverkan

- Konsekvenser

- genomföra

- genomföra

- vikt

- med Esport

- förbättra

- förbättringar

- förbättrar

- in

- innefattar

- Inklusive

- integration

- införliva

- alltmer

- steg

- index

- industrin

- Inflytelserik

- informationen

- Innovation

- innovatörer

- ingång

- insikt

- insikter

- Omedelbart

- istället

- Institute

- försäkring

- försäkringsbolag

- Intelligens

- Intelligent

- uppsåt

- Avsiktlig

- intentioner

- intresserad

- intressen

- invändigt

- skär

- ingripande

- hotfull

- inneboende

- isn

- fråga

- problem

- IT

- DESS

- Januari

- delta

- Följ med oss

- resa

- jpg

- bara

- hålla

- Nyckel

- Vet

- känd

- Brist

- språk

- Språk

- Large

- storskalig

- senaste

- leda

- ledare

- Ledarskap

- inlärning

- Låt

- Nivå

- Hävstång

- ansvar

- lie

- tycka om

- Begränsad

- Lista

- lokal

- locale

- UTSEENDE

- göra

- Framställning

- ledning

- manuell

- många

- matte

- matematisk

- Materia

- max-bredd

- Maj..

- me

- betyda

- Möt

- Messenger

- kanske

- min

- emot

- minsta

- minuter

- Mobil

- modell

- modeller

- modernisering

- mer

- mest

- flytta

- mycket

- tvärvetenskaplig

- måste

- my

- Natur

- Navigering

- nödvändigt för

- Behöver

- behövs

- behov

- negativt

- Nya

- nya produkter

- nyhetsbrev

- nlp

- Nej

- Notera

- inget

- nu

- talrik

- of

- sänkt

- erbjudanden

- erbjuds

- Erbjudanden

- Ofta

- on

- ONE

- öppen källkod

- Yttrande

- möjligheter

- optimala

- optimerad

- or

- organisationer

- Övriga

- vår

- Överträffa

- utgångar

- över

- egen

- ägare

- sida

- deltagande

- passera

- Personer

- utför

- personen

- personlig

- Personligen

- perspektiv

- PHP

- pii

- planer

- plato

- Platon Data Intelligence

- PlatonData

- plugin

- policy

- placera

- Inlägg

- potentiell

- potentiella klienter

- kraft

- den mäktigaste

- praktiken

- praxis

- förutsägelse

- Förutsägelser

- prediktiva

- primär

- Principerna

- Prioritera

- privilegium

- Problem

- upphandling

- producerar

- Produktion

- produktivitet

- Produkter

- Program

- projekt

- ordentligt

- utsikter

- förutsatt

- tillhandahålla

- proxies

- ombud

- psykologiska

- publicly

- publicerade

- sätta

- frågor

- snabbt

- citera

- sällan

- Beredskap

- Läsning

- verklig

- Verkligheten

- känner igen

- rekommendationer

- reducerande

- förfina

- reflektera

- reflekterad

- föreskrifter

- Rapport

- representativ

- representerade

- förfrågningar

- kräver

- Obligatorisk

- forskning

- reagera

- ansvarig

- ansvarsfullt

- mottaglig

- intäkter

- omsättningstillväxt

- höger

- Risk

- riskfaktorer

- risker

- väg

- robotar

- säker

- Säkerhet

- Nämnda

- Samma

- säger

- Skala

- skalning

- Vetenskap

- screen

- skript

- Sök

- sökmotor

- säkra

- se

- SEO

- serverar

- inställningar

- skall

- visas

- helt enkelt

- webbplats

- slak

- Small

- smarta

- Smarta högtalare

- SMS

- So

- lösning

- Lösningar

- några

- Källor

- Utrymme

- högtalare

- Sponsrade

- kvadrater

- intressenter

- standard

- starta

- state-of-the-art

- statistisk

- statistik

- Studenter

- Läsa på

- ämne

- prenumerera

- sådana

- stödja

- Stödjande

- SVG

- System

- T

- bord

- tar

- mål

- lärare

- lag

- Teknisk

- Tekniken

- tertiär

- text

- än

- tack

- den där

- Smakämnen

- världen

- deras

- Dem

- tema

- sig själva

- Dessa

- de

- tror

- Tänkande

- detta

- de

- trodde

- tanke ledarskap

- tre

- Genom

- tid

- Titel

- till

- tillsammans

- verktyg

- topp

- ämne

- seg

- Tåg

- Utbildning

- Transformation

- Trender

- sann

- trovärdig

- två

- Typ

- typisk

- förstå

- orättvis

- unika

- upplåsning

- Uppdateringar

- på

- URL

- us

- användning

- användningsfall

- användningar

- Använda

- värde

- Värden

- mängd

- varierande

- mycket

- Virtuell

- volym

- W

- vill

- var

- we

- VÄL

- Vad

- Vad är

- när

- om

- som

- medan

- VEM

- vem

- varför

- brett

- bredare

- kommer

- visdom

- KLOK

- med

- ord

- Wordpress

- Arbete

- fungerar

- världen

- skulle

- skriven

- Fel

- ännu

- dig

- Din

- zephyrnet