Generat cu Midjourney

Întreprinderile din fiecare industrie și colț al globului se grăbesc să integreze puterea modelelor de limbaj mari (LLM) precum ChatGPT de la OpenAI, Claude de la Anthropic și Jurassic de la AI12Lab pentru a crește performanța într-o gamă largă de aplicații de afaceri, cum ar fi cercetarea de piață, serviciul pentru clienți , și generarea de conținut.

Cu toate acestea, construirea unei aplicații LLM la scara întreprinderii necesită un set de instrumente și o înțelegere diferită de construirea aplicațiilor tradiționale de învățare automată (ML). Liderii de afaceri și directorii care doresc să păstreze vocea mărcii și calitatea serviciilor de încredere trebuie să dezvolte o înțelegere mai profundă a modului în care funcționează LLM-urile și a avantajelor și dezavantajelor diferitelor instrumente dintr-o stivă de aplicații LLM.

În acest articol, vă vom oferi o introducere esențială a strategiei și instrumentelor de nivel înalt de care veți avea nevoie pentru a crea și a rula o aplicație LLM pentru afacerea dvs.

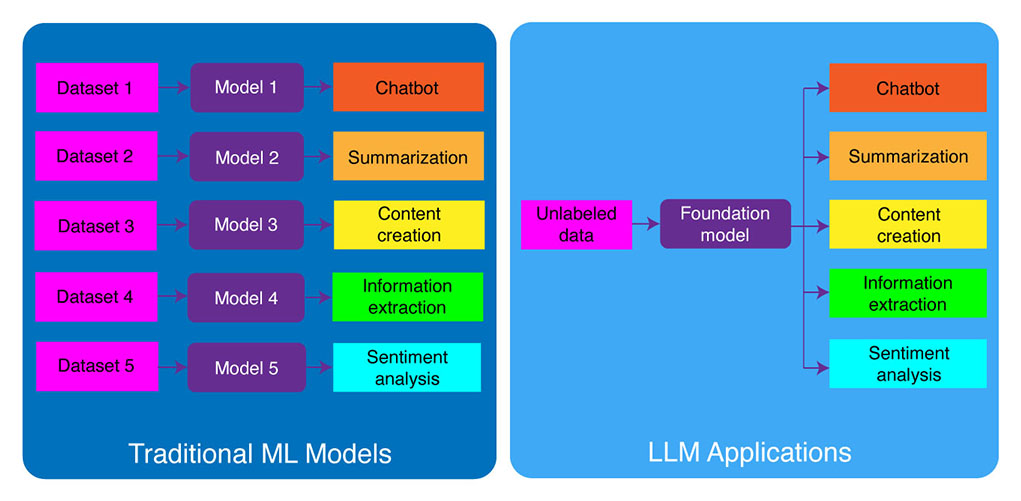

Dezvoltare ML tradițională vs. Aplicații LLM

Modelele tradiționale de învățare automată erau specifice sarcinilor, ceea ce înseamnă că trebuia să construiți un model separat pentru fiecare sarcină diferită. De exemplu, dacă doriți să analizați sentimentul clienților, ar trebui să construiți un model, iar dacă doriți să construiți un chatbot de asistență pentru clienți, ar trebui să construiți un alt model.

Acest proces de construire și antrenare a modelelor ML specifice sarcinii necesită timp și necesită o mulțime de date. Tipul de seturi de date necesare pentru a antrena aceste modele ML diferite ar varia, de asemenea, în funcție de sarcină. Pentru a instrui un model pentru a analiza sentimentul clienților, ai avea nevoie de un set de date de recenzii ale clienților care au fost etichetate cu un sentiment corespunzător (pozitiv, negativ, neutru). Pentru a pregăti un model pentru a construi un chatbot de asistență pentru clienți, veți avea nevoie de un set de date de conversații între clienți și de asistență tehnică.

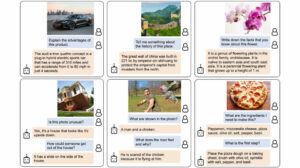

Modelele mari de limbaj au schimbat acest lucru. LLM-urile sunt pre-instruite pe un set masiv de date de text și cod, ceea ce le permite să performeze bine într-o gamă largă de sarcini imediate, inclusiv:

- Rezumat text

- Crearea de conținut

- Traducere

- Extragerea informațiilor

- Răspuns la întrebare

- Analiza sentimentelor

- Relații Clienți

- Ajutor de vanzari

Procesul de dezvoltare a aplicațiilor LLM poate fi împărțit în patru pași esențiali:

- Alegeți un model de fundație potrivit. Este o componentă cheie, care definește performanța aplicației dvs. LLM.

- Personalizați modelul, dacă este necesar. Poate fi necesar să ajustați modelul sau să-l măriți cu o bază de cunoștințe suplimentară pentru a vă satisface nevoile specifice.

- Configurați infrastructura ML. Aceasta include hardware-ul și software-ul necesar pentru a rula aplicația dvs. (adică, semiconductori, cipuri, găzduire în cloud, inferență și implementare).

- Măriți-vă aplicația cu instrumente suplimentare. Aceste instrumente pot ajuta la îmbunătățirea eficienței, performanței și securității aplicației dvs.

Acum, să aruncăm o privire la stiva de tehnologie corespunzătoare.

Dacă acest conținut educațional aprofundat vă este util, abonați-vă la lista noastră de corespondență AI pentru a fi avertizați atunci când lansăm material nou.

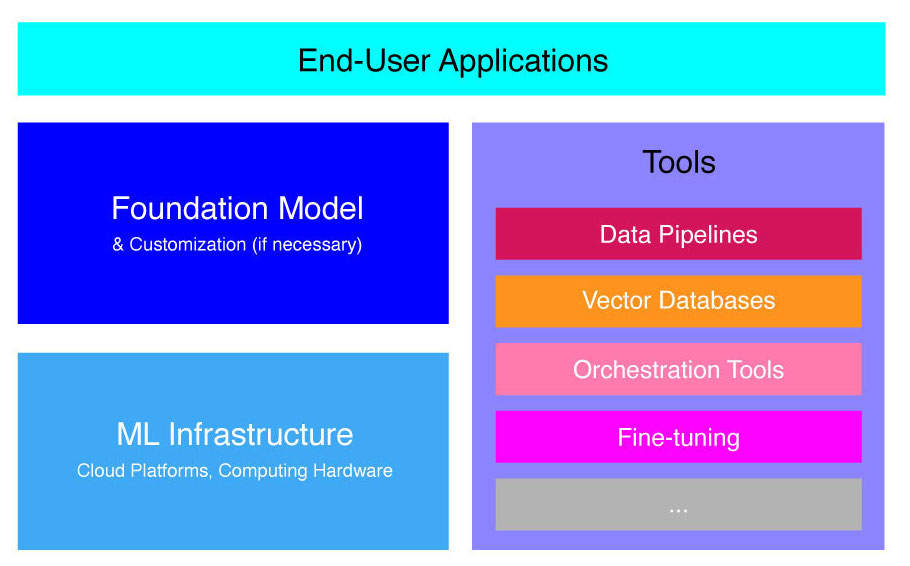

Stiva de aplicații LLM de nivel înalt

Aplicațiile LLM sunt construite pe mai multe componente cheie, inclusiv:

- Un model de fundație, care ar putea necesita personalizare în cazuri specifice de utilizare.

- Infrastructura ML pentru resurse de calcul suficiente prin intermediul platformelor cloud sau al hardware-ului propriu al companiei.

- Instrumente suplimentare, cum ar fi conducte de date, baze de date vectoriale, instrumente de orchestrare, platforme ML de reglare fină, instrumente de monitorizare a performanței modelului etc.

Vă vom prezenta pe scurt aceste componente, astfel încât să puteți înțelege mai bine setul de instrumente necesar pentru a construi și a implementa o aplicație LLM.

Ce sunt modelele de fundație?

Utilizarea unui singur LLM pre-instruit vă poate economisi mult timp și resurse. Cu toate acestea, formarea unui astfel de model de la zero este un proces în timp util și costisitor care depășește capacitățile majorității companiilor, cu excepția câtorva lideri de elită în tehnologie.

Mai multe companii și echipe de cercetare au instruit aceste modele și permit altor companii să le folosească. Exemplele de frunte includ ChatGPT, Claude, Llama, Jurassic și T5. Aceste modele orientate spre public se numesc modele de fundație. Unele dintre ele sunt proprietare și pot fi accesate prin apeluri API contra cost. Altele sunt open-source și pot fi folosite gratuit. Aceste modele sunt antrenate în prealabil pe un set masiv de date textuale neetichetate, permițându-le să îndeplinească o gamă largă de sarcini, de la generarea de copii publicitare creative până la comunicarea cu clienții în limba lor maternă în numele companiei.

Există două tipuri principale de modele de fundație: proprietar și open-source.

Modele proprietare sunt deținute de o singură companie sau organizație și sunt de obicei disponibile doar contra cost. Unele dintre cele mai populare exemple de modele proprietare includ modelele GPT de la OpenAI, modelele Claude de la Anthropic și modelele Jurassic de la AI21 Labs.

Modele open-source sunt de obicei disponibile gratuit pentru oricine dorește să le folosească. Cu toate acestea, unele modele open-source au limitări în ceea ce privește utilizarea lor, cum ar fi: (1) fiind disponibile numai în scopuri de cercetare, (2) fiind disponibile numai pentru utilizare comercială de către companii de o anumită dimensiune. Comunitatea open-source susține că aplicarea unor astfel de restricții nu permite unui model să se califice drept „open-source”. Cu toate acestea, cele mai proeminente exemple de modele de limbaj care pot fi utilizate gratuit includ modelele Llama de la Meta, modelele Falcon de la Institutul de Inovare Tehnologică din Abu Dhabi și modelele StableLM de la Stability AI. Citiți mai multe despre modelele open-source și riscurile asociate aici.

Acum să discutăm mai mulți factori de care trebuie să luați în considerare atunci când alegeți un model de fundație pentru aplicația dvs. LLM.

Alegeți un model de fundație

Selectarea celui mai bun model de bază pentru aplicația dvs. LLM poate fi un proces dificil, dar îl putem împărți în trei pași:

- Alegeți între modele proprietare și open-source. Modelele proprietare sunt de obicei mai mari și mai capabile decât modelele open-source, dar pot fi mai scumpe de utilizat și mai puțin flexibile. În plus, codul nu este la fel de transparent, ceea ce face dificilă depanarea sau depanarea problemelor legate de performanța modelelor proprietare. Modelele open-source, pe de altă parte, primesc de obicei mai puține actualizări și mai puțin suport din partea dezvoltatorilor.

- Alegeti marimea modelului. Modelele mai mari sunt de obicei mai bune la îndeplinirea sarcinilor care necesită multe cunoștințe, cum ar fi răspunsul la întrebări sau generarea de text creativ. Cu toate acestea, modelele mai mari sunt, de asemenea, mai costisitoare din punct de vedere computațional. Puteți începe prin a experimenta modele mai mari, apoi treceți la modele mai mici, atâta timp cât performanța unui model este satisfăcătoare pentru cazul dvs. de utilizare.

- Selectați un anumit model. Puteți începe prin a revizui criteriile de referință generale pentru a lista scurt modelele pentru testare. Apoi, continuați cu testarea diferitelor modele pentru sarcinile specifice aplicației dvs. Pentru evaluarea comparativă personalizată, luați în considerare calculul Scoruri BLEU și ROUGE, valorile care ajută la cuantificarea numărului de corecții necesare textului generat de AI înainte de a lansa rezultatul pentru aplicațiile human-in-the-loop.

Pentru o mai bună înțelegere a diferențelor dintre diferitele modele lingvistice, consultați prezentarea noastră de ansamblu asupra celor mai puternice modele de limbaj (LLM) și vizual (VLM).

După ce ați ales un model de fundație pentru aplicația dvs., vă puteți gândi dacă trebuie să personalizați modelul pentru o performanță și mai bună.

Personalizați un model de fundație

În unele cazuri, este posibil să doriți să personalizați un model de limbaj de bază pentru o performanță mai bună în cazul dvs. de utilizare specific. De exemplu, poate doriți să optimizați pentru un anumit:

- domeniu. Dacă operați în anumite domenii, cum ar fi juridic, financiar sau asistență medicală, vă recomandăm să îmbogățiți vocabularul modelului în acest domeniu, astfel încât să poată înțelege mai bine și să răspundă la interogările utilizatorilor finali.

- Sarcină. De exemplu, dacă doriți ca modelul să genereze campanii de marketing, îi puteți furniza exemple specifice de conținut de marketing de marcă. Acest lucru va ajuta modelul să învețe modelele și stilurile care sunt potrivite pentru compania și publicul dvs.

- Tonul vocii. Dacă aveți nevoie ca modelul să utilizeze un anumit ton al vocii, puteți personaliza modelul pe un set de date care include exemple de mostre lingvistice țintă.

Există trei moduri posibile de a personaliza un model de limbaj de bază:

- Reglaj fin: oferă modelului un set de date etichetat specifice domeniului de aproximativ 100-500 de înregistrări. Greutățile modelului sunt actualizate, ceea ce ar trebui să aibă ca rezultat o performanță mai bună a sarcinilor reprezentate de acest set de date.

- Adaptarea domeniului: furnizează modelului un set de date neetichetat specific domeniului care conține un corp mare de date din domeniul corespunzător. Greutățile modelului sunt, de asemenea, actualizate în acest caz.

- Recuperarea informațiilor: mărește modelul de bază cu cunoștințe în domeniu închis. Modelul nu este reantrenat, iar greutățile modelului rămân aceleași. Cu toate acestea, modelului i se permite să preia informații dintr-o bază de date vectorială care conține date relevante.

Primele două abordări necesită resurse de calcul semnificative pentru a recalifica modelul, ceea ce este de obicei fezabil doar pentru companiile mari cu talentul tehnic adecvat pentru a gestiona personalizarea. Companiile mai mici folosesc de obicei abordarea mai comună de a spori modelul cu cunoștințe de domeniu printr-o bază de date vectorială, pe care o detaliem mai târziu în acest articol, în secțiunea despre instrumentele LLM.

Configurați infrastructura ML

Componenta de infrastructură ML a peisajului LLMOps include platformele cloud, hardware-ul de calcul și alte resurse care sunt necesare pentru implementarea și rularea LLM-urilor. Această componentă este relevantă în special dacă alegeți să utilizați un model open-source sau să personalizați modelul pentru aplicația dvs. În acest caz, este posibil să aveți nevoie de resurse de calcul semnificative pentru a ajusta modelul, dacă este necesar, și pentru a-l rula.

Există o serie de platforme cloud care oferă servicii pentru implementarea LLM-urilor, inclusiv Google Cloud Platform, Amazon Web Services și Microsoft Azure. Aceste platforme oferă o serie de caracteristici care facilitează implementarea și rularea LLM-urilor, inclusiv:

- Modele pre-antrenate care pot fi reglate fin pentru aplicația dumneavoastră specifică

- Infrastructură gestionată care are grijă de hardware-ul și software-ul de bază

- Instrumente și servicii pentru monitorizarea și depanarea LLM-urilor dvs

Cantitatea de resurse de calcul de care aveți nevoie va depinde de dimensiunea și complexitatea modelului dvs., de sarcinile pe care doriți să le efectueze și de amploarea activității de afaceri în care doriți să implementați acest model.

Măriți cu instrumente

Instrumente suplimentare LLM adiacente pot fi utilizate pentru a îmbunătăți și mai mult performanța aplicației dvs. LLM.

Conducte de date

Dacă trebuie să vă folosiți datele în produsul dvs. LLM, conducta de preprocesare a datelor va fi un pilon esențial al noii dvs. stive tehnologice, la fel ca în stiva tradițională de AI pentru întreprinderi. Aceste instrumente includ conectori pentru a asimila date din orice sursă, un strat de transformare a datelor și conectori în aval. Furnizorii de top de date, cum ar fi Databricks și Snowflake, și jucătorii noi, cum ar fi Unstructured, facilitează pentru dezvoltatori să indice corpuri mari și foarte eterogene de date în limbaj natural (de exemplu, mii de PDF-uri, prezentări PowerPoint, jurnale de chat, HTML răzuit, etc.) la un singur punct de acces sau chiar într-un singur document care poate fi utilizat în continuare de aplicațiile LLM.

Baze de date vectoriale

Modelele de limbă mari sunt limitate la procesarea câtorva mii de cuvinte odată, așa că nu pot procesa efectiv documente mari singure. Pentru a valorifica puterea documentelor mari, companiile trebuie să utilizeze baze de date vectoriale.

Bazele de date vectoriale sunt sisteme de stocare care transformă documentele mari pe care le primesc prin conducte de date în vectori gestionabili sau înglobări. Aplicațiile LLM pot interoga apoi aceste baze de date pentru a identifica vectorii potriviți, extragând doar informațiile necesare.

Unele dintre cele mai importante baze de date vectoriale disponibile în prezent sunt Pinecone, Chroma și Weaviate.

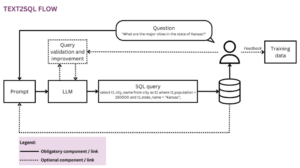

Instrumente de orchestrare

Când un utilizator trimite o interogare la aplicația dvs. LLM, cum ar fi o întrebare pentru serviciul clienți, aplicația trebuie să construiască o serie de solicitări înainte de a trimite această interogare la modelul de limbă. Solicitarea finală către modelul de limbă este de obicei compusă dintr-un șablon prompt codificat de către dezvoltator, exemple de rezultate valide numite exemple cu câteva fotografii, orice informații necesare preluate de la API-uri externe și un set de documente relevante preluate din baza de date vectorială. . Instrumentele de orchestrare de la companii precum LangChain sau LlamaIndex pot ajuta la eficientizarea acestui proces, oferind cadre gata de utilizare pentru gestionarea și executarea solicitărilor.

Reglaj fin

Modelele mari de limbaj instruite pe seturi masive de date pot produce text corect și fluent din punct de vedere gramatical. Cu toate acestea, le poate lipsi precizia în anumite domenii, cum ar fi medicina sau dreptul. Reglarea fină a acestor modele pe seturi de date specifice domeniului le permite să internalizeze caracteristicile unice ale acelor zone, sporind capacitatea lor de a genera text relevant.

Reglarea fină a unui LLM poate fi un proces costisitor pentru companiile mici. Cu toate acestea, soluțiile de la companii precum Weights & Biases și OctoML pot ajuta la o reglare fină simplificată și eficientă. Aceste soluții oferă companiilor o platformă pentru a-și ajusta cursurile LLM fără a fi nevoite să investească în propria infrastructură.

Alte Instrumente

Există multe alte instrumente care pot fi utile pentru construirea și rularea aplicațiilor LLM. De exemplu, este posibil să aveți nevoie de instrumente de etichetare dacă doriți să ajustați modelul cu mostrele de date specifice. De asemenea, este posibil să doriți să implementați instrumente specifice pentru a monitoriza performanța aplicației dvs., deoarece chiar și modificări minore ale modelului de bază sau solicitările clienților pot afecta semnificativ performanța solicitărilor. În cele din urmă, există instrumente care monitorizează siguranța modelului pentru a vă ajuta să evitați promovarea conținutului instigator la ură, recomandări periculoase sau părtiniri. Necesitatea și importanța acestor instrumente diferite vor depinde de cazul dvs. de utilizare specific.

Ce urmează în dezvoltarea aplicațiilor LLM?

Cei patru pași pentru dezvoltarea unui produs LLM pe care i-am discutat aici reprezintă o bază esențială a strategiei generative de inteligență artificială a oricărei întreprinderi care utilizează modele de limbaj mari. Ele sunt importante pe care liderii de afaceri non-tehnici să le înțeleagă, chiar dacă aveți o echipă tehnică care implementează detaliile. Vom publica tutoriale mai detaliate în viitor despre cum să folosim gama largă de instrumente AI generative de pe piață. Deocamdată, poți Aboneaza-te la newsletter-ul nostru pentru a obține cele mai recente actualizări.

Vă place acest articol? Înscrieți-vă pentru mai multe actualizări ale AI pentru întreprinderi.

Vă vom anunța când vom lansa mai multe articole sumare ca acesta.

Legate de

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. Automobile/VE-uri, carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- BlockOffsets. Modernizarea proprietății de compensare a mediului. Accesați Aici.

- Sursa: https://www.topbots.com/llm-product-development-technology-stack/

- :este

- :nu

- :Unde

- $UP

- 1

- a

- capacitate

- Despre Noi

- Abu Dhabi

- acces

- accesate

- activitate

- Ad

- Suplimentar

- În plus,

- adiacent

- AI

- Strategia AI

- permite

- permis

- permite

- de asemenea

- Amazon

- Amazon Web Services

- sumă

- an

- analiza

- și

- O alta

- Antropică

- Orice

- oricine

- api

- API-uri

- aplicație

- Dezvoltare de Aplicații

- aplicatii

- abordare

- abordari

- adecvat

- SUNT

- domenii

- articol

- bunuri

- AS

- asociate

- At

- audiență

- disponibil

- evita

- Azuriu

- de bază

- Pe scurt

- BE

- fost

- înainte

- folosul

- fiind

- analiza comparativă

- valori de referință

- CEL MAI BUN

- Mai bine

- între

- Dincolo de

- distorsiunilor

- a stimula

- Cutie

- marca

- marcă

- Pauză

- scurt

- Spart

- construi

- Clădire

- construit

- afaceri

- Aplicații pentru afaceri

- Lideri de afaceri

- întreprinderi

- dar

- by

- calcularea

- denumit

- apeluri

- Campanii

- CAN

- capacități

- capabil

- pasă

- caz

- cazuri

- sigur

- provocare

- si-a schimbat hainele;

- Modificări

- chatbot

- Chat GPT

- verifica

- Chips

- Alege

- alegere

- ales

- creanțe

- Cloud

- cloud Gazduire

- Platforma Cloud

- cod

- comercial

- Comun

- comunicarea

- comunitate

- Companii

- companie

- Compania

- complexitate

- component

- componente

- compuse

- tehnica de calcul

- Contra

- Lua în considerare

- construi

- conține

- conţinut

- conversații

- copii

- Colț

- corecta

- Corectarea

- Corespunzător

- costisitor

- Creator

- În prezent

- personalizat

- client

- Serviciu clienți

- Relații Clienți

- clienţii care

- personalizare

- personaliza

- Periculos

- de date

- Baza de date

- baze de date

- cărămizi de date

- seturi de date

- Mai adânc

- definire

- În funcție

- implementa

- Implementarea

- desfășurarea

- detaliu

- detaliat

- detalii

- dezvolta

- Dezvoltator

- Dezvoltatorii

- în curs de dezvoltare

- Dezvoltare

- Dhabi

- diferenţele

- diferit

- dificil

- discuta

- discutat

- document

- documente

- Nu

- domeniu

- domenii

- jos

- e

- fiecare

- uşor

- de învăţământ

- în mod eficient

- eficiență

- eficient

- elită

- permițând

- spori

- consolidarea

- îmbogăți

- Afacere

- mai ales

- esenţial

- etc

- Eter (ETH)

- Chiar

- Fiecare

- exemplu

- exemple

- Cu excepția

- executând

- directori

- scump

- extern

- factori

- şoim

- realizabil

- DESCRIERE

- taxă

- puțini

- mai puține

- final

- În cele din urmă

- financiar

- First

- flexibil

- Pentru

- Fundație

- patru

- cadre

- Gratuit

- din

- mai mult

- viitor

- General

- genera

- generator

- generaţie

- generativ

- AI generativă

- obține

- Da

- glob

- Go

- merge

- Google Cloud

- Platforma Google Cloud

- Teren

- mână

- Piese metalice

- valorifica

- Avea

- având în

- de asistență medicală

- ajutor

- aici

- la nivel înalt

- extrem de

- găzduire

- Cum

- Cum Pentru a

- Totuși

- HTML

- HTTPS

- i

- if

- Impactul

- Punere în aplicare a

- importanță

- important

- îmbunătăţi

- in

- în profunzime

- include

- include

- Inclusiv

- industrie

- informații

- Infrastructură

- Inovaţie

- Institut

- integra

- în

- Introducere

- Investi

- IT

- jpg

- doar

- Cheie

- Copil

- Cunoaște

- cunoştinţe

- etichetarea

- Labs

- lipsă

- peisaj

- limbă

- mare

- mai mare

- mai tarziu

- Ultimele

- Cele mai recente actualizări

- Drept

- strat

- Liderii

- conducere

- AFLAȚI

- învăţare

- Legal

- mai puțin

- Pârghie

- pîrghii

- ca

- limitări

- Limitat

- Lamă

- Lung

- Uite

- Lot

- maşină

- masina de învățare

- Principal

- face

- FACE

- administra

- de conducere

- multe

- Piață

- de cercetare de piață

- Marketing

- Campanii de marketing

- piaţă

- masiv

- material

- max-width

- Mai..

- sens

- medicină

- Întâlni

- meta

- Metrici

- Microsoft

- Microsoft Azure

- ar putea

- minor

- ML

- model

- Modele

- monitor

- Monitorizarea

- mai mult

- cele mai multe

- Cel mai popular

- nativ

- Natural

- Limbajul natural

- necesar

- Nevoie

- necesar

- nevoilor

- negativ

- Neutru

- Nou

- Tehnologie nouă

- Stiri lunare via e-mail

- următor

- non tehnic

- acum

- număr

- of

- oferi

- on

- ONE

- cele

- afară

- open-source

- OpenAI

- funcionar

- Optimizați

- or

- orchestrație

- organizație

- Altele

- Altele

- al nostru

- afară

- producție

- Prezentare generală

- propriu

- deţinute

- modele

- efectua

- performanță

- efectuarea

- Stâlp

- conducte

- platformă

- Platforme

- Plato

- Informații despre date Platon

- PlatoData

- jucători

- Punct

- Popular

- pozitiv

- posibil

- putere

- puternic

- Precizie

- Prezentări

- probleme

- proces

- prelucrare

- produce

- Produs

- dezvoltare de produs

- proeminent

- Promovarea

- proprietate

- PROS

- furniza

- furnizori

- furnizează

- furnizarea

- publica

- scopuri

- Punând

- califica

- calitate

- interogări

- întrebare

- Întrebări

- gamă

- Citeste

- a primi

- Recomandări

- înregistrări

- eliberaţi

- eliberarea

- de încredere

- reprezentate

- solicita

- cereri de

- necesita

- Necesită

- cercetare

- Resurse

- Răspunde

- restricții

- rezultat

- revizuirea

- Recenzii

- dreapta

- Riscurile

- Alerga

- funcţionare

- Siguranţă

- acelaşi

- Economisiți

- Scară

- Secțiune

- securitate

- Semiconductori

- sentiment

- distinct

- serie

- serviciu

- Servicii

- set

- câteva

- să

- semna

- semnificativ

- semnificativ

- singur

- Mărimea

- mic

- mai mici

- So

- Software

- soluţii

- unele

- Sursă

- specific

- Stabilitate

- stivui

- Începe

- şedere

- paşi

- Încă

- depozitare

- Strategie

- simplifica

- raționalizate

- stiluri

- astfel de

- suficient

- REZUMAT

- a sustine

- sisteme

- Lua

- ia

- TRAINERI

- Ţintă

- Sarcină

- sarcini

- echipă

- echipe

- tech

- Tehnic

- suport tehnic

- Tehnologia

- inovația tehnologică

- șablon

- Testarea

- decât

- acea

- Viitorul

- lor

- Lor

- apoi

- Acolo.

- Acestea

- ei

- acest

- aceste

- mii

- trei

- Prin

- timp

- consumă timp

- la

- TONE

- Tonul vocii

- Toolkit

- Unelte

- top

- TOPBOTS

- tradiţional

- Tren

- dresat

- Pregătire

- Transforma

- Transformare

- transparent

- tutoriale

- Două

- Tipuri

- tipic

- care stau la baza

- înţelege

- înţelegere

- unic

- caracteristici unice

- actualizat

- actualizări

- utilizare

- carcasa de utilizare

- utilizat

- Utilizator

- obișnuit

- diverse

- de

- Voce

- vs

- vrea

- dorit

- vrea

- modalități de

- we

- web

- servicii web

- BINE

- au fost

- cand

- dacă

- care

- OMS

- larg

- Gamă largă

- voi

- cu

- fără

- cuvinte

- Apartamente

- ar

- tu

- Ta

- zephyrnet