Inside the Tech é uma série de blogs que acompanha nosso Podcast de palestras sobre tecnologia. No episódio 20 do podcast, The Evolution of Roblox Avatars, o CEO da Roblox, David Baszucki, conversou com o Diretor Sênior de Engenharia Kiran Bhat, o Diretor Sênior de Produto Mahesh Ramasubramanian e o Gerente Principal de Produto Effie Goenawan, sobre o futuro da comunicação imersiva através de avatares e dos desafios técnicos que estamos resolvendo para potencializá-lo. Nesta edição do Inside the Tech, conversamos com o gerente sênior de engenharia, Andrew Portner, para saber mais sobre um desses desafios técnicos, a segurança na comunicação imersiva de voz, e como o trabalho da equipe está ajudando a promover um ambiente digital seguro e civil para todos. nossa plataforma.

Quais são os maiores desafios técnicos que sua equipe está enfrentando?

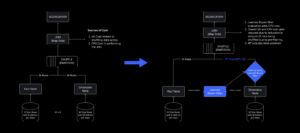

Priorizamos manter uma experiência segura e positiva para nossos usuários. Segurança e civilidade são sempre prioridade para nós, mas lidar com isso em tempo real pode ser um grande desafio técnico. Sempre que há um problema, queremos poder analisá-lo e tomar medidas em tempo real, mas isto é um desafio dada a nossa escala. Para lidar com esta escala de forma eficaz, precisamos de utilizar sistemas de segurança automatizados.

Outro desafio técnico no qual estamos focados é a precisão das nossas medidas de segurança para moderação. Existem duas abordagens de moderação para resolver violações de políticas e fornecer feedback preciso em tempo real: moderação reativa e proativa. Para moderação reativa, estamos desenvolvendo modelos de aprendizado de máquina (ML) para identificar com precisão diferentes tipos de violações de políticas, que funcionam respondendo a denúncias de pessoas na plataforma. Proativamente, estamos trabalhando na detecção em tempo real de potenciais conteúdo que viola nossas políticas, educando os usuários sobre seu comportamento. Compreender a palavra falada e melhorar a qualidade do áudio é um processo complexo. Já estamos vendo progressos, mas nosso objetivo final é ter um modelo altamente preciso que possa detectar comportamentos que violam políticas em tempo real.

Quais são algumas das abordagens e soluções inovadoras que estamos usando para enfrentar esses desafios técnicos?

Desenvolvemos um modelo de ML ponta a ponta que pode analisar dados de áudio e fornecer um nível de confiança com base no tipo de violação da política (por exemplo, qual a probabilidade de bullying, palavrões, etc.). Este modelo melhorou significativamente a nossa capacidade de fechar automaticamente determinados relatórios. Agimos quando nosso modelo está confiante e podemos ter certeza de que supera os humanos. Poucos meses após o lançamento, conseguimos moderar quase todas as denúncias de abuso de voz em inglês com este modelo. Desenvolvemos esses modelos internamente e é uma prova da colaboração entre muitas tecnologias de código aberto e nosso próprio trabalho para criar a tecnologia por trás delas.

Determinar o que é apropriado em tempo real parece bastante complexo. Como isso funciona?

Há muita reflexão para tornar o sistema contextualmente consciente. Também analisamos os padrões ao longo do tempo antes de agirmos, para termos a certeza de que as nossas ações são justificadas. Nossas políticas variam de acordo com a idade da pessoa, se ela está em um espaço público ou em um bate-papo privado e muitos outros fatores. Estamos explorando novas maneiras de promover a civilidade em tempo real e o ML está no centro disso. Recentemente, lançamos notificações push automatizadas (ou “nudges”) para lembrar os usuários de nossas políticas. Também estamos analisando outros fatores, como o tom de voz, para entender melhor as intenções de uma pessoa e distinguir coisas como sarcasmo ou piadas. Por último, também estamos construindo um modelo multilíngue, já que algumas pessoas falam vários idiomas ou até trocam de idioma no meio de uma frase. Para que tudo isso seja possível, precisamos ter um modelo preciso.

Atualmente, estamos focados em abordar as formas mais proeminentes de abuso, como assédio, discriminação e palavrões. Estes constituem a maioria dos relatos de abuso. Nosso objetivo é ter um impacto significativo nessas áreas e definir as normas do setor sobre como é promover e manter uma conversa civilizada online. Estamos entusiasmados com o potencial do uso do ML em tempo real, pois ele nos permite promover efetivamente uma experiência segura e civilizada para todos.

Como os desafios que estamos resolvendo na Roblox são únicos? O que podemos resolver primeiro?

Nosso Converse com voz espacial a tecnologia cria uma experiência mais envolvente, imitando a comunicação do mundo real. Por exemplo, se eu estiver à esquerda de alguém, essa pessoa me ouvirá no ouvido esquerdo. Estamos criando um análogo de como a comunicação funciona no mundo real e este é um desafio que estamos em condições de resolver primeiro.

Como jogador, testemunhei muito assédio e intimidação em jogos online. É um problema que muitas vezes não é controlado devido ao anonimato do usuário e à falta de consequências. No entanto, os desafios técnicos que estamos enfrentando em relação a isso são exclusivos dos que outras plataformas enfrentam em algumas áreas. Em algumas plataformas de jogos, as interações são limitadas aos colegas de equipe. Roblox oferece uma variedade de maneiras de participar de um ambiente social que imita mais a vida real. Com os avanços no ML e no processamento de sinais em tempo real, somos capazes de detectar e abordar com eficácia o comportamento abusivo, o que significa que não somos apenas um ambiente mais realista, mas também um ambiente onde todos se sentem seguros para interagir e se conectar com outras pessoas. A combinação da nossa tecnologia, da nossa plataforma imersiva e do nosso compromisso em educar os utilizadores sobre as nossas políticas coloca-nos em posição de enfrentar estes desafios de frente.

Quais são algumas das principais coisas que você aprendeu ao fazer esse trabalho técnico?

Sinto que aprendi muito. Não sou um engenheiro de ML. Trabalhei principalmente no front-end de jogos, então poder me aprofundar mais sobre como esses modelos funcionam tem sido enorme. A minha esperança é que as ações que estamos a tomar para promover a civilidade se traduzam num nível de empatia que tem faltado na comunidade online.

Um último aprendizado é que tudo depende dos dados de treinamento que você insere. E para que os dados sejam precisos, os humanos precisam concordar com os rótulos usados para categorizar certos comportamentos que violam as políticas. É muito importante treinar com dados de qualidade com os quais todos possam concordar. É um problema muito difícil de resolver. Você começa a ver áreas onde o ML está muito à frente de todo o resto, e depois outras áreas onde ainda está nos estágios iniciais. Ainda existem muitas áreas onde o BC ainda está crescendo, por isso é fundamental estar ciente dos seus limites atuais.

Com qual valor Roblox sua equipe mais se alinha?

Respeitar a comunidade é o nosso valor norteador ao longo deste processo. Primeiro, precisamos de nos concentrar em melhorar a civilidade e reduzir as violações de políticas na nossa plataforma. Isso tem um impacto significativo na experiência geral do usuário. Em segundo lugar, devemos considerar cuidadosamente como implementaremos esses novos recursos. Precisamos estar atentos aos falsos positivos (por exemplo, marcar algo incorretamente como abuso) no modelo e evitar penalizar incorretamente os usuários. Monitorar o desempenho dos nossos modelos e seu impacto no envolvimento do usuário é crucial.

O que mais te entusiasma sobre o rumo que Roblox e sua equipe estão tomando?

Fizemos progressos significativos na melhoria da comunicação de voz pública, mas ainda há muito mais a ser feito. A comunicação privada é uma área interessante para explorar. Acho que há uma grande oportunidade de melhorar a comunicação privada, de permitir que os usuários se expressem com amigos próximos, de fazer uma chamada de voz durante experiências ou durante uma experiência enquanto interagem com seus amigos. Acho que também há uma oportunidade de promover essas comunidades com melhores ferramentas para permitir que os usuários se auto-organizem, participem de comunidades, compartilhem conteúdo e compartilhem ideias.

À medida que continuamos a crescer, como dimensionamos a nossa tecnologia de chat para apoiar estas comunidades em expansão? Estamos apenas a arranhar a superfície de muito do que podemos fazer e penso que há uma oportunidade de melhorar a civilidade da comunicação e colaboração online em toda a indústria de uma forma que nunca foi feita antes. Com a tecnologia certa e os recursos de ML, estamos em uma posição única para moldar o futuro da comunicação civil online.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://blog.roblox.com/2024/01/inside-the-tech-solving-for-safety-in-immersive-voice-communication/

- :tem

- :é

- :não

- :onde

- $UP

- 20

- a

- habilidade

- Capaz

- Sobre

- abuso

- precisão

- preciso

- exatamente

- em

- Açao Social

- ações

- endereço

- endereçando

- avanços

- Depois de

- idade

- à frente

- visar

- alinhar

- Todos os Produtos

- permitir

- quase

- já

- tb

- sempre

- an

- analisar

- e

- Andrew

- Anonimato

- qualquer

- se aproxima

- apropriado

- SOMOS

- ÁREA

- áreas

- por aí

- AS

- At

- auditivo

- Automatizado

- automaticamente

- Avatares

- evitar

- consciente

- baseado

- BE

- sido

- antes

- começar

- comportamento

- atrás

- ser

- Melhor

- entre

- Grande

- O maior

- Blog

- Prédio

- o bullying

- mas a

- by

- chamada

- CAN

- capacidades

- cuidadosamente

- Chefe executivo

- certo

- desafiar

- desafios

- desafiante

- chance

- bate-papo

- civil

- Fechar

- de perto

- conhecedor

- colaboração

- combinação

- compromisso

- Comunicação

- Comunidades

- comunidade

- integrações

- confiança

- confiante

- Contato

- Consequências

- Considerar

- considerável

- conteúdo

- continuar

- Conversa

- Casal

- crio

- cria

- Criar

- crucial

- Atual

- dados,

- David

- acordo

- mais profunda

- Dependendo

- depende

- descobrir

- Detecção

- desenvolvido

- em desenvolvimento

- diferente

- digital

- Diretor

- Discriminação

- distinguir

- do

- parece

- fazer

- feito

- dois

- durante

- e

- Cedo

- edição

- educar

- efetivamente

- outro

- Empatia

- permitir

- permite

- final

- end-to-end

- COMPROMETIMENTO

- engenheiro

- Engenharia

- Inglês

- Meio Ambiente

- episódio

- etc.

- Mesmo

- todos

- tudo

- evolução

- animado

- excita

- emocionante

- expansão

- vasta experiência

- Experiências

- explorar

- Explorando

- expresso

- enfrentando

- fatores

- falso

- Funcionalidades

- retornos

- sentir

- sente

- Primeiro nome

- Foco

- focado

- Escolha

- formas

- Promover

- amigos

- da

- frente

- Front-end

- futuro

- jogos

- dado

- Go

- meta

- vai

- vai

- Cresça:

- Crescente

- guia

- punhado

- manipular

- Manipulação

- perseguição

- Queijos duros

- Ter

- cabeça

- comandado

- ouvir

- Coração

- ajuda

- altamente

- esperança

- Como funciona o dobrador de carta de canal

- Contudo

- HTTPS

- enorme

- Humanos

- i

- idéias

- identificar

- if

- imersiva

- Impacto

- importante

- melhorar

- melhorado

- melhorar

- in

- incorretamente

- indústria

- inovadores

- dentro

- instância

- intenções

- interagir

- interações

- para dentro

- emitem

- IT

- ESTÁ

- juntar

- apenas por

- justificado

- Chave

- Rótulos

- Falta

- sem

- Idiomas

- Sobrenome

- por último

- lançado

- de lançamento

- APRENDER

- aprendido

- aprendizagem

- esquerda

- Nível

- Alavancagem

- vida

- como

- Provável

- Limitado

- limites

- olhar

- procurando

- OLHARES

- lote

- máquina

- aprendizado de máquina

- moldadas

- manutenção

- Maioria

- fazer

- Fazendo

- Gerente

- muitos

- marca��o

- me

- significa

- medidas

- mente

- ML

- modelo

- modelos

- moderada

- moderação

- monitoração

- mês

- mais

- a maioria

- na maioria das vezes

- muito

- múltiplo

- devo

- my

- eu mesmo

- você merece...

- Novo

- Novos Recursos

- normas

- notificações

- of

- Oferece

- frequentemente

- on

- ONE

- online

- jogo on line

- só

- aberto

- open source

- Oportunidade

- or

- ordem

- Outros

- Outros

- A Nossa

- Fora

- Supera o desempenho

- Acima de

- global

- próprio

- padrões

- Pessoas

- atuação

- plataforma

- Plataformas

- platão

- Inteligência de Dados Platão

- PlatãoData

- Podcast

- políticas

- Privacidade

- posição

- positivo

- possível

- potencial

- poder

- preciso

- bastante

- Diretor

- Priorizar

- privado

- Proactive

- Problema

- processo

- em processamento

- Produto

- gerente de produto

- PROFANIDADE

- Progresso

- proeminente

- a promover

- Promoção

- fornecer

- fornece

- público

- Empurrar

- colocar

- Coloca

- qualidade

- dados de qualidade

- reais

- vida real

- mundo real

- em tempo real

- realista

- clientes

- recentemente

- redução

- Relatórios

- responder

- rever

- certo

- Roblox

- Rolo

- seguro

- Segurança

- Sarcasmo

- Escala

- Segundo

- Vejo

- visto

- parece

- senior

- Série

- conjunto

- Shape

- Partilhar

- Signal

- periodo

- de forma considerável

- desde

- So

- Redes Sociais

- Soluções

- RESOLVER

- Resolvendo

- alguns

- Alguém

- algo

- fonte

- Espaço

- Espacial

- falar

- falado

- Estágio

- de pé

- Ainda

- tal

- ajuda

- certo

- superfície

- Interruptor

- .

- sistemas

- equipamento

- abordando

- Tire

- tomar

- negociações

- Profissionais

- tecnologia

- Dados Técnicos:

- Tecnologias

- Tecnologia

- vontade

- do que

- que

- A

- O Futuro

- deles

- si mesmos

- então

- Lá.

- Este

- deles

- coisas

- think

- isto

- aqueles

- pensamento

- Através da

- todo

- tempo

- para

- TOM

- Tom de voz

- ferramentas

- topo

- Trem

- Training

- traduzir

- dois

- tipo

- tipos

- final

- compreender

- compreensão

- único

- us

- usava

- Utilizador

- Experiência do Usuário

- usuários

- utilização

- valor

- variedade

- Violações

- voz

- queremos

- Caminho..

- maneiras

- we

- foram

- O Quê

- O que é a

- quando

- se

- qual

- enquanto

- de

- dentro

- testemunhado

- Word

- Atividades:

- trabalhou

- trabalhar

- trabalho

- mundo

- Você

- investimentos

- zefirnet