Generacyjni agenci AI są w stanie generować reakcje podobne do ludzkich i angażować się w rozmowy w języku naturalnym, organizując łańcuch połączeń z modelami podstawowymi (FM) i innymi narzędziami rozszerzającymi w oparciu o wkład użytkownika. Zamiast jedynie realizować z góry określone cele za pomocą statycznego drzewa decyzyjnego, agenci są autonomiczni w kontekście zestawu dostępnych narzędzi. Amazońska skała macierzysta to w pełni zarządzana usługa, która udostępnia wiodących FM z firm zajmujących się sztuczną inteligencją za pośrednictwem interfejsu API wraz z narzędziami programistycznymi pomagającymi w tworzeniu i skalowaniu generatywnych aplikacji AI.

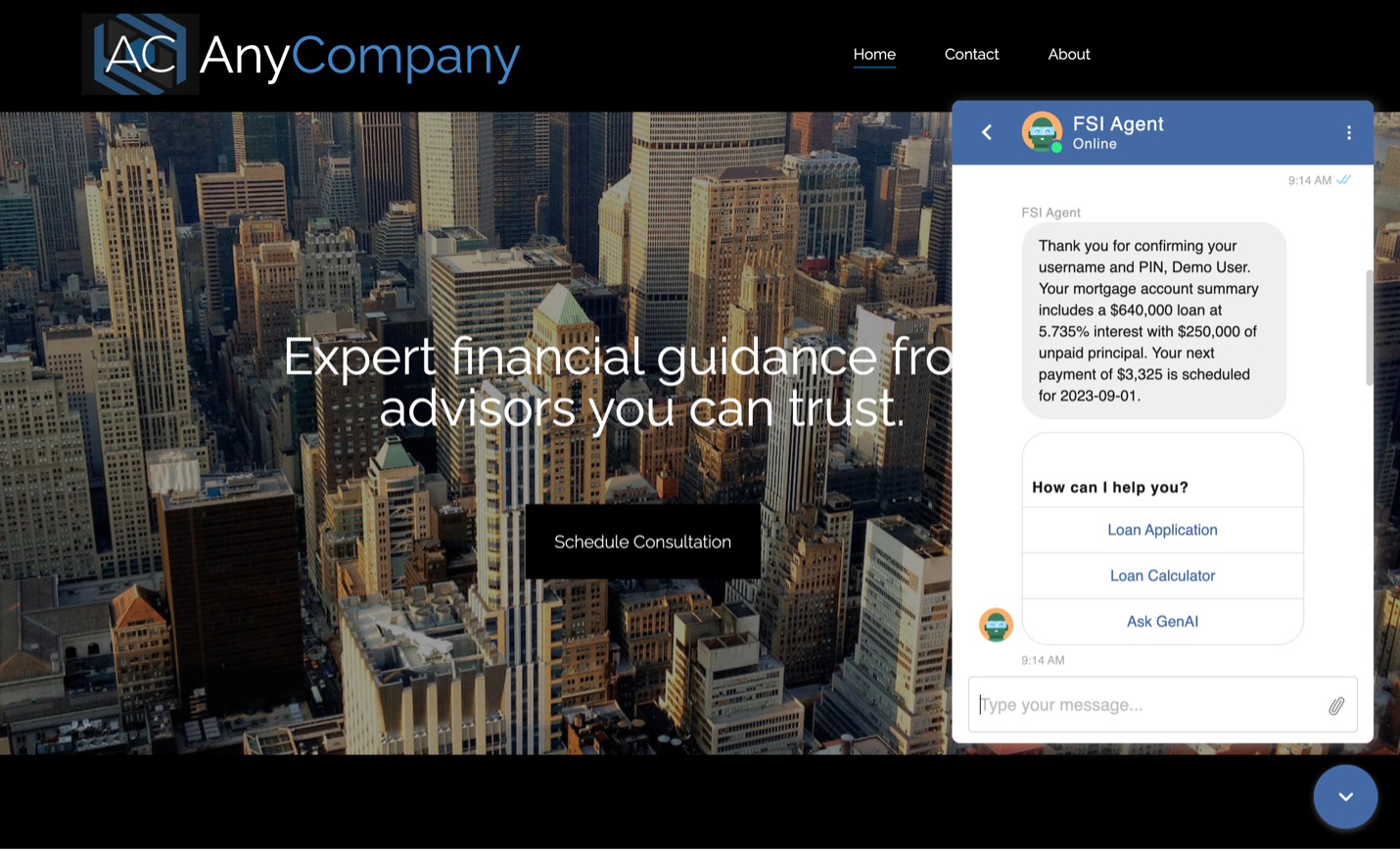

W tym poście pokazujemy, jak zbudować generatywnego agenta usług finansowych AI opartego na Amazon Bedrock. Agent może pomóc użytkownikom w znalezieniu informacji o koncie, wypełnieniu wniosku o pożyczkę lub udzieleniu odpowiedzi na pytania w języku naturalnym, podając jednocześnie źródła udzielonych odpowiedzi. Rozwiązanie to ma pełnić funkcję startera dla programistów do tworzenia własnych, spersonalizowanych agentów konwersacyjnych do różnych zastosowań, takich jak wirtualni pracownicy i systemy obsługi klienta. Kod rozwiązania i zasoby wdrożeniowe można znaleźć w pliku Repozytorium GitHub.

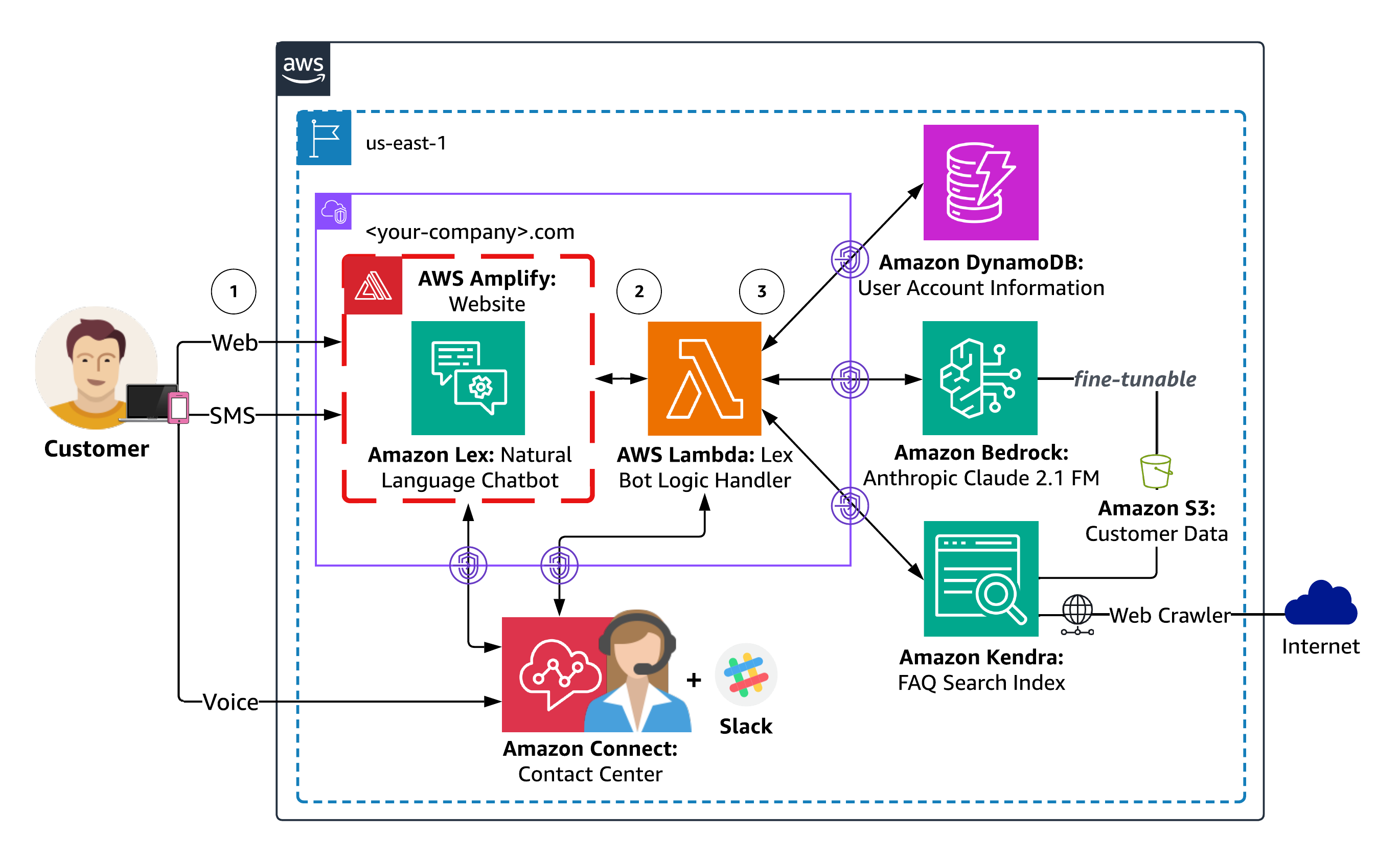

Amazonka Lex dostarcza interfejs rozumienia języka naturalnego (NLU) i przetwarzania języka naturalnego (NLP) dla oprogramowania typu open source Agent konwersacyjny LangChain osadzony w Wzmocnienie AWS strona internetowa. Agent jest wyposażony w narzędzia, które obejmują Anthropic Claude 2.1 FM hostowane na Amazon Bedrock i syntetyczne dane klientów przechowywane na Amazon DynamoDB i Amazonka Kendra aby zapewnić następujące możliwości:

- Udzielaj spersonalizowanych odpowiedzi – Zapytaj DynamoDB o informacje o koncie klienta, takie jak szczegóły podsumowania kredytu hipotecznego, saldo należności i data następnej płatności

- Dostęp do wiedzy ogólnej – Wykorzystaj logikę rozumowania agenta w połączeniu z ogromnymi ilościami danych wykorzystywanych do wstępnego szkolenia różnych FM dostarczanych za pośrednictwem Amazon Bedrock w celu tworzenia odpowiedzi na wszelkie monity klientów

- Udzielaj przemyślanych odpowiedzi – Informuj odpowiedzi agentów za pomocą indeksu Amazon Kendra skonfigurowanego z wiarygodnymi źródłami danych: dokumentami klientów przechowywanymi w Usługa Amazon Simple Storage (Amazon S3) i Przeszukiwacz sieci Amazon Kendra skonfigurowany dla strony internetowej klienta

Omówienie rozwiązania

Nagranie demonstracyjne

Poniższe nagranie demonstracyjne przedstawia funkcjonalność agenta i szczegóły techniczne implementacji.

Architektura rozwiązania

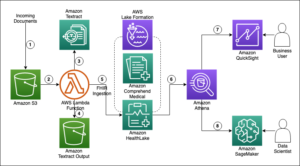

Poniższy schemat ilustruje architekturę rozwiązania.

Przebieg odpowiedzi agenta obejmuje następujące kroki:

- Użytkownicy prowadzą dialog z agentem w języku naturalnym poprzez wybór kanałów internetowych, SMS lub głosowych. Kanał internetowy obejmuje witrynę hostowaną przez Amplify z wbudowanym chatbotem Amazon Lex dla fikcyjnego klienta. Opcjonalnie można skonfigurować kanały SMS i głosowe za pomocą Amazon Połącz i integracje wiadomości dla Amazona Lexa. Każde żądanie użytkownika jest przetwarzane przez Amazon Lex w celu określenia jego intencji poprzez proces zwany rozpoznawaniem intencji, który obejmuje analizę i interpretację danych wejściowych użytkownika (tekstu lub mowy) w celu zrozumienia zamierzonego działania lub celu użytkownika.

- Następnie Amazon Lex wywołuje plik AWS Lambda moduł obsługi służący do realizacji intencji użytkownika. Funkcja Lambda powiązana z chatbotem Amazon Lex zawiera logikę i reguły biznesowe niezbędne do przetworzenia intencji użytkownika. Lambda wykonuje określone działania lub pobiera informacje na podstawie danych wprowadzonych przez użytkownika, podejmując decyzje i generując odpowiednie odpowiedzi.

- Lambda wykorzystuje logikę agenta usług finansowych jako agenta konwersacyjnego LangChain, który może uzyskać dostęp do danych specyficznych dla klienta przechowywanych w DynamoDB, wybierać oparte na opiniach odpowiedzi na podstawie dokumentów i stron internetowych indeksowanych przez Amazon Kendra oraz zapewniać odpowiedzi na podstawie wiedzy ogólnej za pośrednictwem FM na Amazon Bedrock. Odpowiedzi wygenerowane przez Amazon Kendra obejmują podanie źródła, co pokazuje, w jaki sposób możesz przekazać agentowi dodatkowe informacje kontekstowe za pośrednictwem Odzyskanie Augmented Generation (SZMATA). RAG pozwala zwiększyć zdolność agenta do generowania dokładniejszych i odpowiednich kontekstowo odpowiedzi przy użyciu własnych danych.

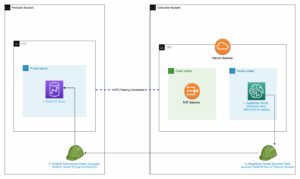

Architektura agenta

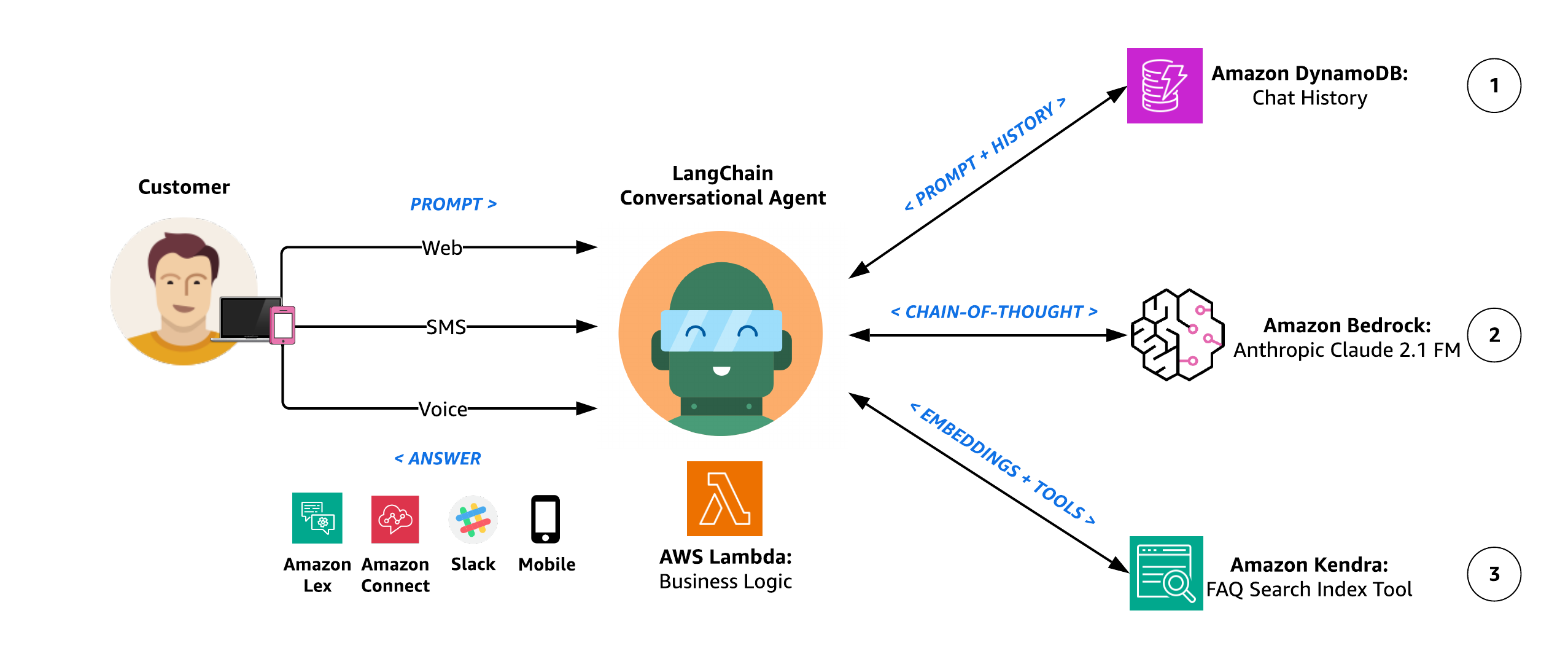

Poniższy diagram ilustruje architekturę agenta.

Proces rozumowania agenta obejmuje następujące kroki:

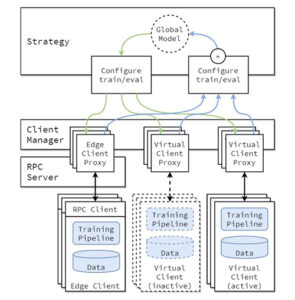

- Agent konwersacyjny LangChain zawiera pamięć konwersacji, dzięki czemu może odpowiadać na wiele zapytań poprzez generowanie kontekstowe. Pamięć ta pozwala agentowi udzielać odpowiedzi uwzględniających kontekst toczącej się rozmowy. Osiąga się to poprzez generowanie kontekstowe, podczas którego agent generuje odpowiedzi, które są istotne i odpowiednie do kontekstu, w oparciu o informacje, które zapamiętał z rozmowy. Mówiąc prościej, agent zapamiętuje to, co zostało powiedziane wcześniej i wykorzystuje te informacje, aby odpowiedzieć na wiele pytań w sposób, który ma sens w toczącej się dyskusji. Nasz agent używa Klasa historii wiadomości czatu DynamoDB w LangChain jako bufor pamięci konwersacji, dzięki czemu może przywoływać przeszłe interakcje i poprawiać komfort użytkownika dzięki bardziej znaczącym, uwzględniającym kontekst odpowiedziom.

- Agent korzysta z Anthropic Claude 2.1 na Amazon Bedrock, aby wykonać żądane zadanie za pomocą serii starannie wygenerowanych tekstów, tzw. monity. Podstawowym celem szybkiej inżynierii jest uzyskanie konkretnych i dokładnych odpowiedzi od FM. Różne szybkie techniki inżynieryjne obejmują:

- Zerowy strzał – Modelowi zadawane jest jedno pytanie bez żadnych dodatkowych wskazówek. Oczekuje się, że model wygeneruje odpowiedź wyłącznie na podstawie zadanego pytania.

- Kilka strzałów – Przed właściwym pytaniem znajduje się zestaw przykładowych pytań i odpowiadających im odpowiedzi. Wystawiając model na te przykłady, uczy się on reagować w podobny sposób.

- Łańcuch myśli – Specyficzny styl podpowiedzi składający się z kilku strzałów, w którym zachęta zawiera serię pośrednich etapów rozumowania, prowadzących model przez logiczny proces myślowy, ostatecznie prowadzący do pożądanej odpowiedzi.

Nasz agent wykorzystuje rozumowanie oparte na łańcuchu myślowym, uruchamiając zestaw działań po otrzymaniu żądania. Po każdej akcji agent wchodzi w etap obserwacji, w którym wyraża swoją myśl. Jeśli ostateczna odpowiedź nie została jeszcze osiągnięta, agent powtarza, wybierając różne działania, aby osiągnąć ostateczną odpowiedź. Zobacz następujący przykładowy kod:

Pomyślałem: czy muszę używać narzędzia? Tak

Akcja: Akcja, którą należy podjąć

Wejście akcji: Wejście do akcji

Obserwacja: Wynik działania

Pomyślałem: czy muszę używać narzędzia? NIE

Agent FSI: [odpowiedź i dokumenty źródłowe]

- W ramach różnych ścieżek rozumowania agenta i dokonywania samooceny wyborów w celu podjęcia decyzji o kolejnym sposobie działania, agent ma możliwość dostępu do syntetycznych źródeł danych klientów poprzez Narzędzie Amazon Kendra Index Retriever. Korzystając z Amazon Kendra, agent przeprowadza wyszukiwanie kontekstowe w szerokim zakresie typów treści, w tym w dokumentach, często zadawanych pytaniach, bazach wiedzy, podręcznikach i stronach internetowych. Aby uzyskać więcej informacji na temat obsługiwanych źródeł danych, zobacz Źródła danych. Agent ma prawo używać tego narzędzia do udzielania opartych na opiniach odpowiedzi na pytania użytkowników, na które należy odpowiedzieć, korzystając z wiarygodnej biblioteki wiedzy dostarczonej przez klienta, zamiast z bardziej ogólnego korpusu wiedzy wykorzystywanego do wstępnego szkolenia Amazon Bedrock FM.

Przewodnik wdrażania

W poniższych sekcjach omówiono kluczowe kroki wdrażania rozwiązania, w tym etapy przed i po wdrożeniu.

Przed wdrożeniem

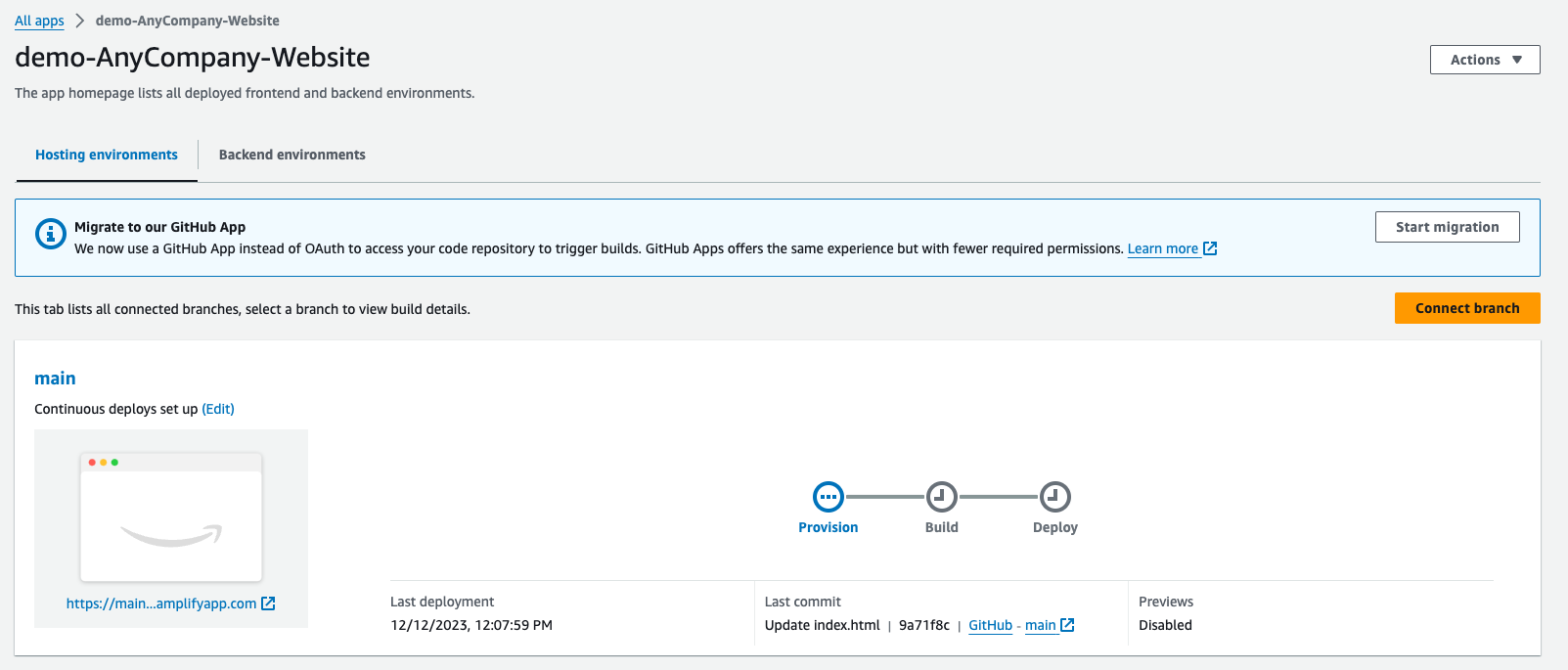

Przed wdrożeniem rozwiązania musisz utworzyć własną rozwidloną wersję repozytorium rozwiązań z zabezpieczonym tokenem webhookiem, aby zautomatyzować ciągłe wdrażanie witryny Amplify. Konfiguracja Amplify wskazuje na repozytorium źródłowe GitHub, z którego zbudowany jest frontend naszej witryny.

Widelec i klon generative-ai-amazon-bedrock-langchain-agent-example składnica

- Aby kontrolować kod źródłowy, z którego zbudowana jest Twoja witryna Amplify, postępuj zgodnie z instrukcjami w Forkuj repozytorium aby rozwidlić repozytorium generative-ai-amazon-bedrock-langchain-agent-example. Spowoduje to utworzenie kopii repozytorium odłączonej od oryginalnej bazy kodu, dzięki czemu będzie można wprowadzić odpowiednie modyfikacje.

- Zanotuj rozwidlony adres URL repozytorium, którego użyjesz do sklonowania repozytorium w następnym kroku i do skonfigurowania zmiennej środowiskowej GITHUB_PAT używanej w skrypcie automatyzacji wdrażania rozwiązania.

- Sklonuj rozwidlone repozytorium za pomocą polecenia git clone:

Utwórz osobisty token dostępu GitHub

Witryna hostowana przez firmę Amplify korzysta z Osobisty token dostępu GitHub (PAT) jako token OAuth do zewnętrznej kontroli źródła. Token OAuth służy do tworzenia elementu webhook i klucza wdrażania tylko do odczytu przy użyciu klonowania SSH.

- Aby utworzyć swój PAT, postępuj zgodnie z instrukcjami w Tworzenie osobistego tokena dostępu (klasyczny). Możesz preferować użycie a Aplikacja GitHub aby uzyskać dostęp do zasobów w imieniu organizacji lub w celu długotrwałych integracji.

- Zanotuj swój PAT przed zamknięciem przeglądarki — użyjesz go do skonfigurowania zmiennej środowiskowej GITHUB_PAT używanej w skrypcie automatyzacji wdrażania rozwiązania. Skrypt opublikuje Twój PAT w Menedżer tajemnic AWS za pomocą Interfejs wiersza poleceń AWS (AWS CLI), a tajna nazwa zostanie użyta jako GitHubTokenSecretName Tworzenie chmury AWS parametr.

Rozlokowanie

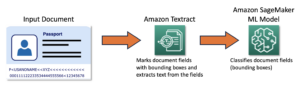

Skrypt automatyzacji wdrażania rozwiązania wykorzystuje sparametryzowany szablon CloudFormation, GenAI-FSI-Agent.yml, aby zautomatyzować udostępnianie następujących zasobów rozwiązania:

- Witryna Amplify służąca do symulacji środowiska front-end.

- Bot Amazon Lex skonfigurowany za pomocą pakietu wdrożeniowego importu bota.

- Cztery tabele DynamoDB:

- Tabela kont użytkowników oczekujących – Rejestruje oczekujące transakcje (na przykład wnioski o pożyczkę).

- Tabela istniejących kont użytkowników – Zawiera informacje o koncie użytkownika (na przykład podsumowanie konta hipotecznego).

- Tabela indeksów konwersacji – Śledzi stan rozmowy.

- Tabela rozmów - Przechowuje historię rozmów.

- Wiadro S3 zawierające moduł obsługi agenta Lambda, moduł ładowania danych Lambda i pakiety wdrożeniowe Amazon Lex, wraz z często zadawanymi pytaniami klientów i przykładowymi dokumentami dotyczącymi wniosków o kredyt hipoteczny.

- Dwie funkcje Lambdy:

- Opiekun agenta – Zawiera logikę agenta konwersacyjnego LangChain, która może inteligentnie wykorzystywać różnorodne narzędzia w oparciu o dane wejściowe użytkownika.

- Ładowarka danych – Ładuje przykładowe dane konta klienta do UserExistingAccountsTable i jest wywoływane jako niestandardowy zasób CloudFormation podczas tworzenia stosu.

- Warstwa Lambda dla bibliotek Amazon Bedrock Boto3, LangChain i pdfrw. Warstwa dostarcza bibliotekę FM LangChain z modelem Amazon Bedrock jako bazowym FM i udostępnia pdfrw jako bibliotekę PDF typu open source do tworzenia i modyfikowania plików PDF.

- Indeks Amazon Kendra, który zapewnia przeszukiwalny indeks wiarygodnych informacji o klientach, w tym dokumentów, często zadawanych pytań, baz wiedzy, podręczników, stron internetowych i innych.

- Dwa źródła danych Amazon Kendra:

- Amazon S3 – Gospodarze A przykładowy dokument z często zadawanymi pytaniami klientów.

- Przeszukiwacz sieci Amazon Kendra – Skonfigurowano z domeną główną, która emuluje witrynę internetową specyficzną dla klienta (na przykład .com).

- AWS Zarządzanie tożsamością i dostępem (IAM) uprawnienia do powyższych zasobów.

AWS CloudFormation wstępnie wypełnia parametry stosu wartościami domyślnymi podanymi w szablonie. Aby zapewnić alternatywne wartości wejściowe, można określić parametry jako zmienne środowiskowe, do których odwołują się pary `ParameterKey=,ParameterValue=` w poleceniu `aws cloudformation create-stack` skryptu powłoki.

- Zanim uruchomisz skrypt powłoki, przejdź do rozwidlonej wersji repozytorium generative-ai-amazon-bedrock-langchain-agent-example jako katalogu roboczego i zmodyfikuj uprawnienia skryptu powłoki do pliku wykonywalnego:

- Ustaw zmienne środowiskowe repozytorium Amplify i GitHub PAT utworzone podczas kroków przed wdrożeniem:

- Na koniec uruchom skrypt automatyzacji wdrażania rozwiązania, aby wdrożyć zasoby rozwiązania, w tym GenAI-FSI-Agent.yml Stos CloudFormation:

source ./create-stack.sh

Skrypt automatyzacji wdrażania rozwiązań

Poprzednie source ./create-stack.sh shell polecenie uruchamia następujące polecenia interfejsu CLI AWS w celu wdrożenia stosu rozwiązania:

Po wdrożeniu

W tej sekcji omawiamy kroki po wdrożeniu, mające na celu uruchomienie aplikacji frontendowej, która ma emulować aplikację produkcyjną klienta. Agent usług finansowych będzie działał jako wbudowany asystent w przykładowym interfejsie internetowym.

Uruchom internetowy interfejs użytkownika dla swojego chatbota

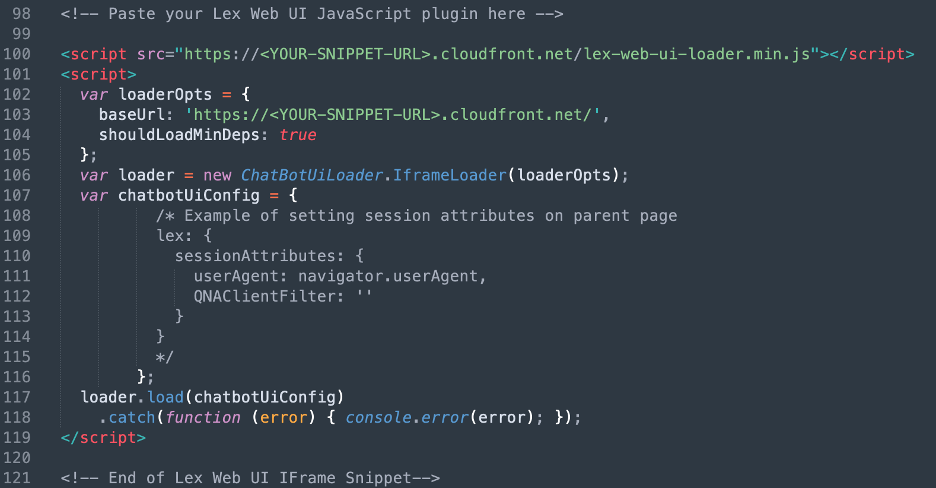

Połączenia Interfejs sieciowy Amazon Lex, znany również jako interfejs użytkownika chatbota, umożliwia szybkie udostępnienie kompleksowego klienta internetowego dla chatbotów Amazon Lex. Interfejs użytkownika integruje się z Amazon Lex, tworząc wtyczkę JavaScript, która włącza widżet czatu oparty na Amazon Lex do istniejącej aplikacji internetowej. W tym przypadku używamy interfejsu internetowego do emulacji istniejącej aplikacji internetowej klienta z wbudowanym chatbotem Amazon Lex. Wykonaj następujące kroki:

- Postępuj zgodnie z instrukcjami, aby wdrożyć stos CloudFormation interfejsu internetowego Amazon Lex.

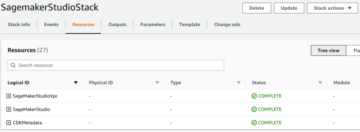

- W konsoli AWS CloudFormation przejdź do stosu Wyjścia i znajdź wartość dla

SnippetUrl.

- Skopiuj fragment kodu iframe interfejsu internetowego, który będzie przypominał format poniżej Dodanie interfejsu ChatBota do Twojej witryny jako elementu Iframe.

- Edytuj rozwidloną wersję repozytorium źródłowego Amplify GitHub, dodając wtyczkę JavaScript interfejsu internetowego do sekcji oznaczonej

<-- Paste your Lex Web UI JavaScript plugin here -->dla każdego pliku HTML w katalog front-end:index.html,contact.html,about.html.

Amplify zapewnia zautomatyzowany potok kompilacji i wydawania, który uruchamia się na podstawie nowych zatwierdzeń w rozwidlonym repozytorium i publikuje nową wersję Twojej witryny w Twojej domenie Amplify. Stan wdrożenia możesz sprawdzić na konsoli Amplify.

Wejdź na stronę internetową Amplify

Po zainstalowaniu wtyczki JavaScript interfejsu internetowego Amazon Lex możesz teraz uruchomić witrynę demonstracyjną Amplify.

- Aby uzyskać dostęp do domeny swojej witryny, przejdź do stosu CloudFormation Wyjścia i znajdź adres URL domeny Amplify. Alternatywnie użyj następującego polecenia:

- Po uzyskaniu dostępu do adresu URL domeny Amplify możesz kontynuować testowanie i weryfikację.

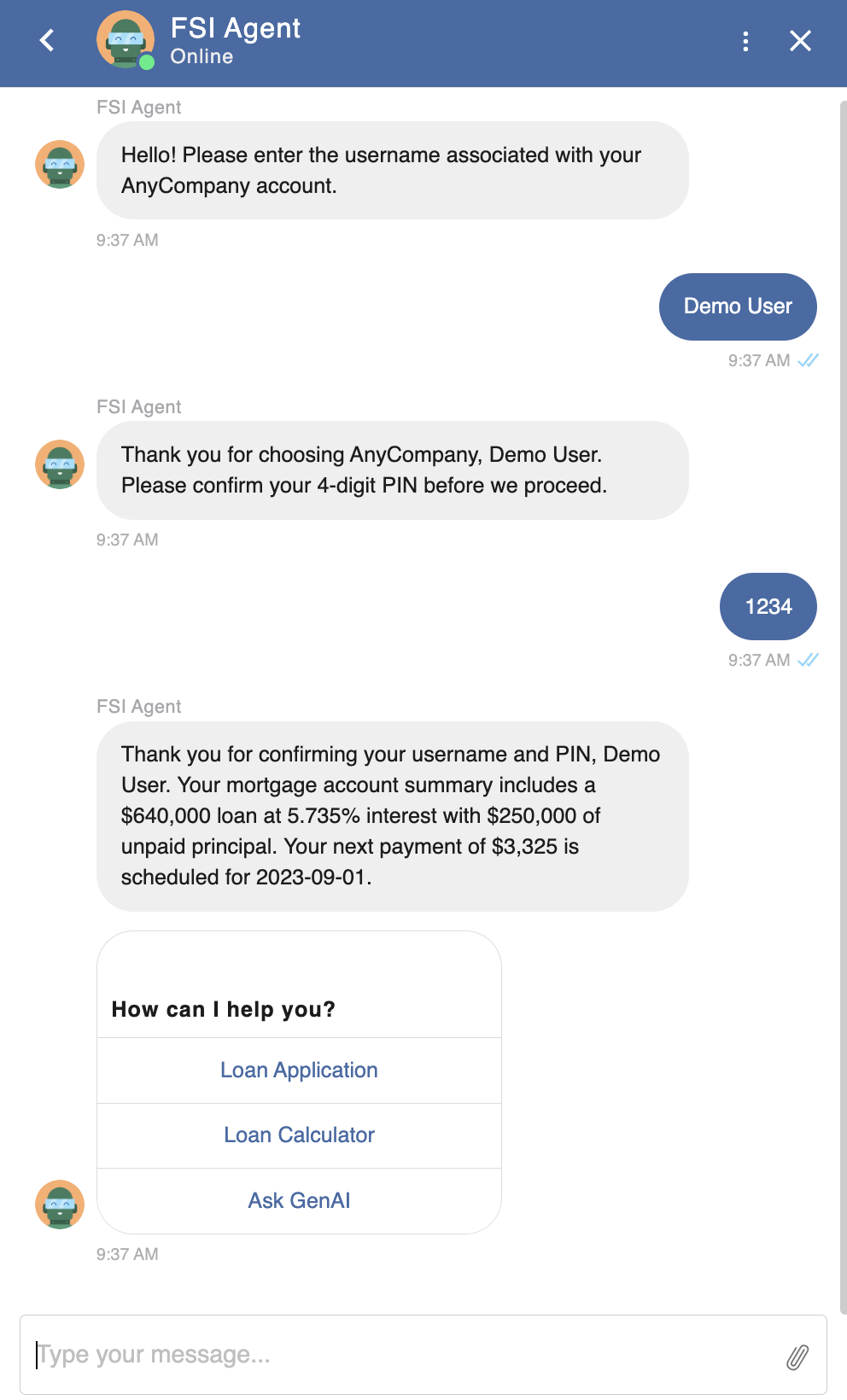

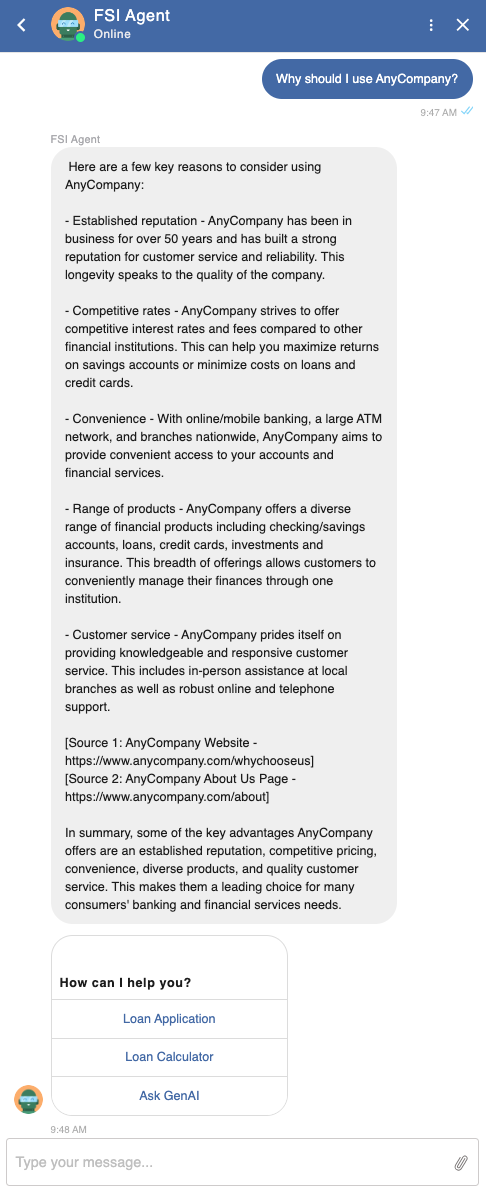

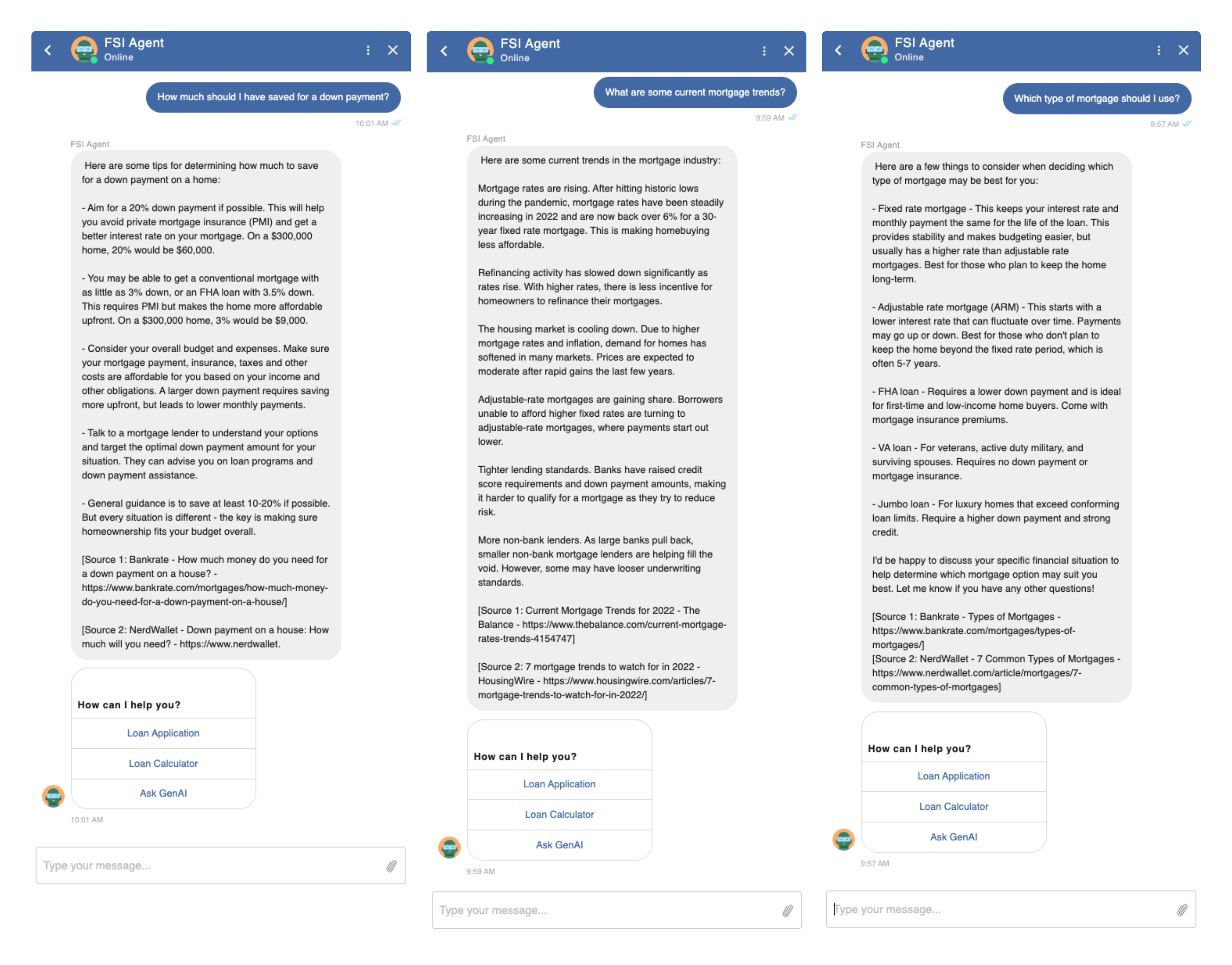

Testowanie i walidacja

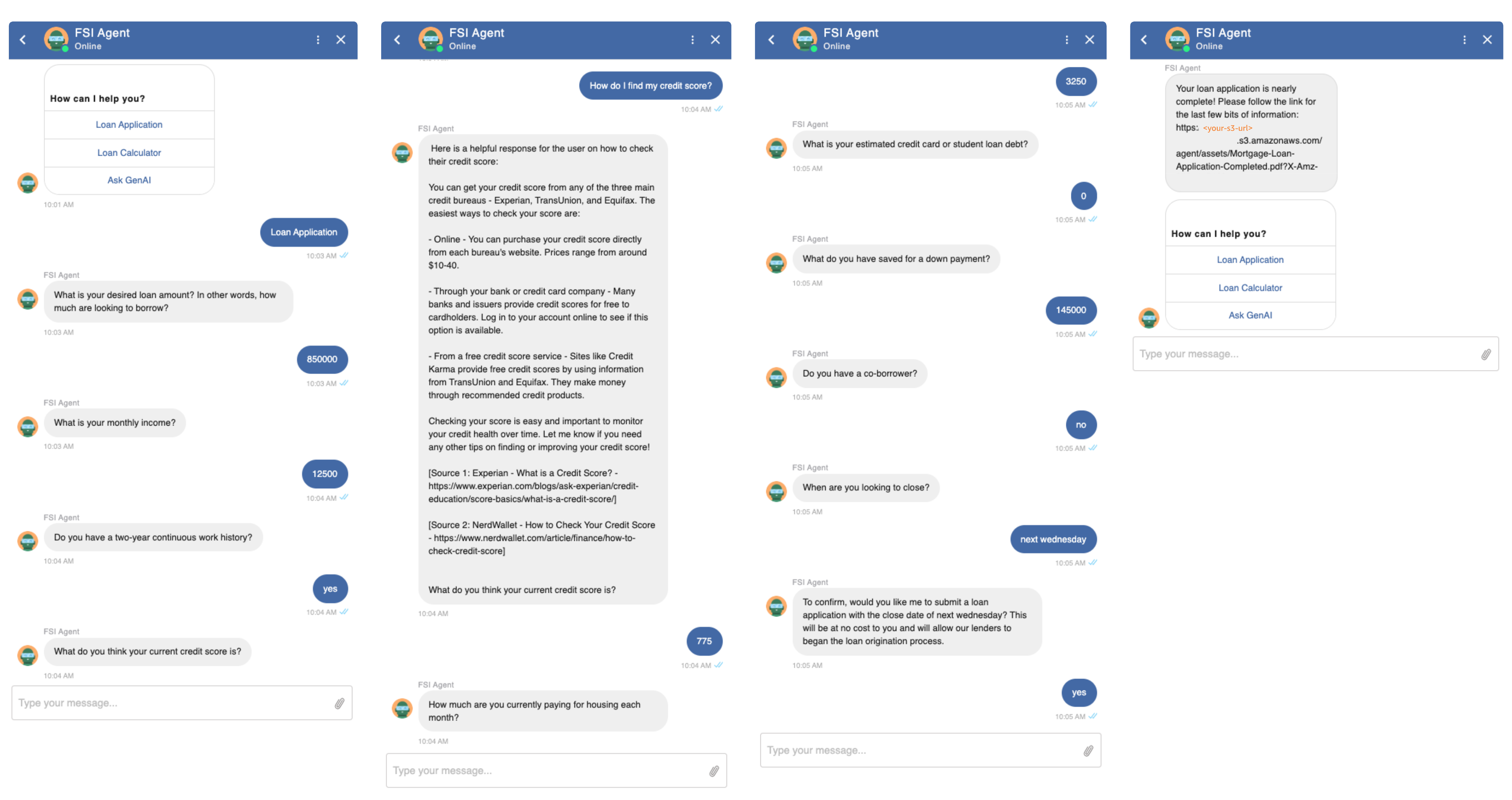

Poniższa procedura testowa ma na celu sprawdzenie, czy agent prawidłowo identyfikuje i rozumie intencje użytkownika w zakresie uzyskiwania dostępu do danych klienta (takich jak informacje o koncie), realizacji przepływów pracy w ramach wcześniej zdefiniowanych celów (takich jak wypełnianie wniosku o pożyczkę) oraz odpowiadania na ogólne zapytania, takie jak następujące przykładowe monity:

- Dlaczego powinienem używać ?

- Jak konkurencyjne są ich stawki?

- Z jakiego rodzaju kredytu hipotecznego skorzystać?

- Jakie są obecne trendy w kredytach hipotecznych?

- Ile muszę zaoszczędzić na zaliczkę?

- Jakie inne koszty poniosę przy zamknięciu?

Dokładność odpowiedzi jest określana poprzez ocenę trafności, spójności i ludzkiego charakteru odpowiedzi generowanych przez Amazon Bedrock zapewnianą przez Anthropic Claude 2.1 FM. Linki źródłowe podawane w każdej odpowiedzi (na przykład .com w oparciu o konfigurację robota Amazon Kendra Web Crawler) również należy potwierdzić jako wiarygodne.

Udzielaj spersonalizowanych odpowiedzi

Sprawdź, czy agent pomyślnie uzyskuje dostęp do odpowiednich informacji o klientach w DynamoDB i je wykorzystuje, aby dostosować odpowiedzi specyficzne dla użytkownika.

Należy pamiętać, że uwierzytelnianie PIN w agencie służy wyłącznie celom demonstracyjnym i nie powinno być wykorzystywane w żadnym wdrożeniu produkcyjnym.

Udzielaj przemyślanych odpowiedzi

Sprawdź, czy agent ma wiarygodne odpowiedzi na oparte na opiniach pytania i czy prawidłowo pozyskuje odpowiedzi w oparciu o wiarygodne dokumenty klientów i strony internetowe indeksowane przez Amazon Kendra.

Zapewnij generowanie kontekstowe

Określ zdolność agenta do udzielania odpowiedzi odpowiednich kontekstowo na podstawie historii poprzednich rozmów.

Dostęp do wiedzy ogólnej

Potwierdź dostęp agenta do informacji o wiedzy ogólnej w przypadku zapytań niezwiązanych z konkretnym klientem i niezawierających opinii, które wymagają dokładnych i spójnych odpowiedzi w oparciu o dane szkoleniowe Amazon Bedrock FM i RAG.

Uruchom predefiniowane intencje

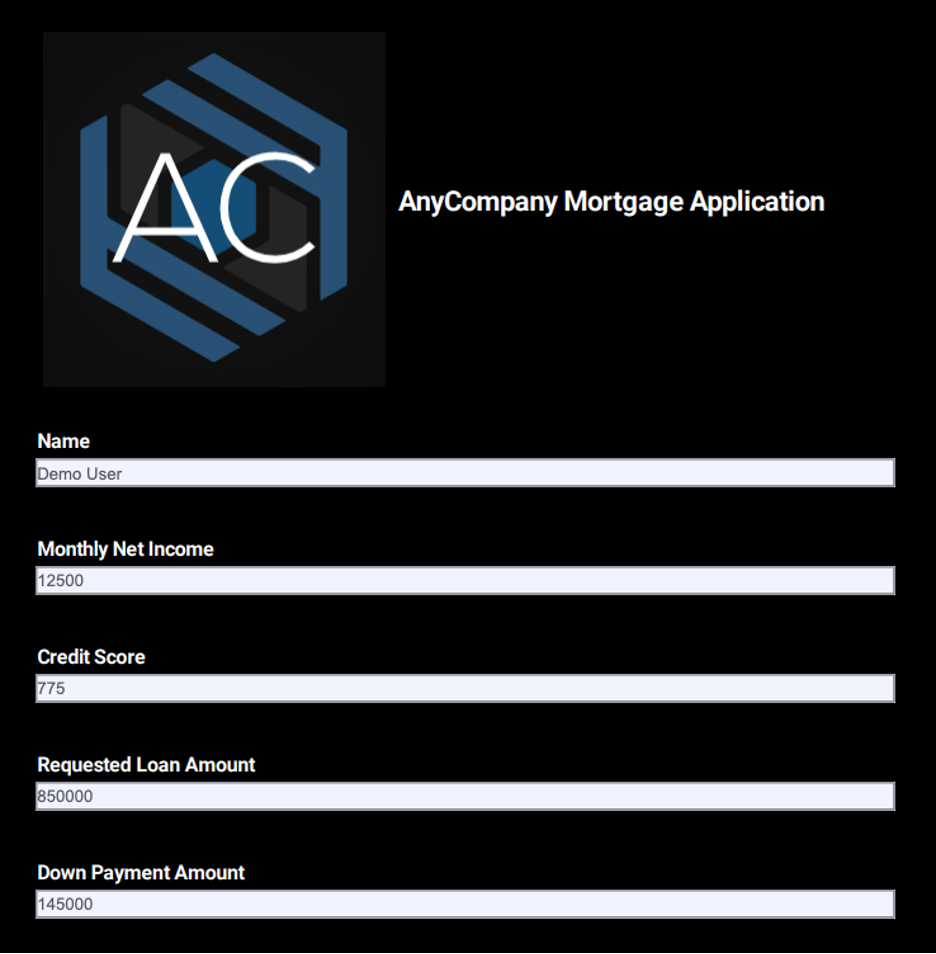

Upewnij się, że agent poprawnie interpretuje i konwersacyjnie wypełnia podpowiedzi użytkownika, które mają być kierowane do wcześniej zdefiniowanych celów, takich jak wypełnienie wniosku o pożyczkę w ramach przepływu pracy biznesowej.

Poniżej znajduje się wynikowy dokument wniosku o pożyczkę wypełniony w drodze konwersacji.

Funkcjonalność wsparcia wielokanałowego można przetestować w połączeniu z powyższymi środkami oceny w kanałach internetowych, SMS i głosowych. Więcej informacji na temat integracji chatbota z innymi usługami znajdziesz w artykule Integracja bota Amazon Lex V2 z Twilio SMS i Dodaj bota Amazon Lex do Amazon Connect.

Sprzątać

Aby uniknąć opłat na koncie AWS, wyczyść udostępnione zasoby rozwiązania.

- Unieważnij osobisty token dostępu GitHub. Pliki PAT GitHub są skonfigurowane z wartością wygaśnięcia. Jeśli chcesz mieć pewność, że Twój PAT nie będzie mógł zostać użyty do programowego dostępu do rozwidlonego repozytorium Amplify GitHub przed jego wygaśnięciem, możesz odwołać PAT, postępując zgodnie z instrukcją Instrukcje repozytorium GitHub.

- Usuń stos GenAI-FSI-Agent.yml CloudFormation i inne zasoby rozwiązania, korzystając ze skryptu automatyzacji usuwania rozwiązania. Poniższe polecenia używają domyślnej nazwy stosu. Jeśli dostosowałeś nazwę stosu, dostosuj odpowiednio polecenia.

# export STACK_NAME=<YOUR-STACK-NAME>./delete-stack.sh

Skrypt automatyzacji usuwania rozwiązań

Połączenia

delete-stack.sh shellskrypt usuwa zasoby, które zostały pierwotnie udostępnione przy użyciu skryptu automatyzacji wdrażania rozwiązania, w tym stos GenAI-FSI-Agent.yml CloudFormation.

rozważania

Chociaż rozwiązanie opisane w tym poście prezentuje możliwości generatywnego agenta usług finansowych opartego na sztucznej inteligencji obsługiwanego przez Amazon Bedrock, należy pamiętać, że to rozwiązanie nie jest gotowe do wdrożenia w środowisku produkcyjnym. Służy raczej jako ilustrujący przykład dla programistów, których celem jest tworzenie spersonalizowanych agentów konwersacyjnych do różnorodnych zastosowań, takich jak wirtualni pracownicy i systemy obsługi klienta. Ścieżka programisty do produkcji obejmowałaby iterację tego przykładowego rozwiązania, biorąc pod uwagę następujące kwestie.

Bezpieczeństwo i prywatność

Zapewnij bezpieczeństwo danych i prywatność użytkowników przez cały proces wdrożenia. Wdróż odpowiednią kontrolę dostępu i mechanizmy szyfrowania, aby chronić poufne informacje. Rozwiązania takie jak generatywny agent usług finansowych AI będą korzystać z danych, które nie są jeszcze dostępne dla bazowego FM, co często oznacza, że będziesz chciał wykorzystać własne prywatne dane, aby uzyskać największy skok w zakresie możliwości. Weź pod uwagę następujące najlepsze praktyki:

- Zachowaj to w tajemnicy, chroń to – Będziesz chciał, aby te dane pozostały całkowicie chronione, bezpieczne i prywatne podczas procesu generowania, a także chcesz mieć kontrolę nad sposobem udostępniania i wykorzystywania tych danych.

- Ustal poręcze użytkowe – Dowiedz się, w jaki sposób dane są wykorzystywane przez usługę, zanim udostępnisz je swoim zespołom. Twórz i rozpowszechniaj reguły określające, jakie dane mogą być używane w jakiej usłudze. Wyjaśnij je swoim zespołom, aby mogły szybko działać i bezpiecznie tworzyć prototypy.

- Zaangażuj się w sprawy prawne raczej wcześniej niż później – Poproś zespoły prawne o sprawdzenie warunków i kart usług usług, z których planujesz korzystać, zanim zaczniesz przesyłać przez nie jakiekolwiek wrażliwe dane. Twoi partnerzy prawni nigdy nie byli ważniejsi niż dzisiaj.

Oto przykład tego, jak myślimy o tym w AWS z Amazon Bedrock: wszystkie dane są szyfrowane i nie opuszczają Twojego VPC, a Amazon Bedrock tworzy osobną kopię podstawowego FM, która jest dostępna tylko dla klienta i dostraja lub trenuje tę prywatną kopię modelu.

Testy akceptacji użytkownika

Przeprowadź testy akceptacji użytkowników (UAT) z prawdziwymi użytkownikami, aby ocenić wydajność, użyteczność i satysfakcję agenta generatywnych usług finansowych AI. Zbieraj opinie i wprowadzaj niezbędne ulepszenia w oparciu o uwagi użytkowników.

Wdrożenie i monitorowanie

Wdróż w pełni przetestowanego agenta na AWS oraz zaimplementuj monitorowanie i rejestrowanie, aby śledzić jego wydajność, identyfikować problemy i optymalizować system w razie potrzeby. Funkcje monitorowania lambda i rozwiązywania problemów są domyślnie włączone dla procedury obsługi Lambda agenta.

Konserwacja i aktualizacje

Regularnie aktualizuj agenta o najnowsze wersje i dane FM, aby zwiększyć jego dokładność i skuteczność. Monitoruj dane specyficzne dla klienta w DynamoDB i w razie potrzeby synchronizuj indeksowanie źródła danych Amazon Kendra.

Wnioski

W tym poście zagłębiliśmy się w ekscytujący świat generatywnych agentów AI i ich zdolność do ułatwiania interakcji na poziomie ludzkim poprzez koordynację połączeń z FM i innymi uzupełniającymi narzędziami. Postępując zgodnie z tym przewodnikiem, możesz wykorzystać Bedrock, LangChain i istniejące zasoby klientów, aby pomyślnie wdrożyć, przetestować i zweryfikować niezawodnego agenta, który zapewnia użytkownikom dokładną i spersonalizowaną pomoc finansową poprzez rozmowy w języku naturalnym.

W nadchodzącym poście pokażemy, jak tę samą funkcjonalność można dostarczyć przy użyciu alternatywnego podejścia Agenci Amazon Bedrock i Baza wiedzy dla Amazon Bedrock. Ta w pełni zarządzana implementacja AWS będzie dalej badać, jak oferować inteligentne możliwości automatyzacji i wyszukiwania danych za pośrednictwem spersonalizowanych agentów, które zmieniają sposób, w jaki użytkownicy wchodzą w interakcję z aplikacjami, czyniąc interakcje bardziej naturalnymi, wydajnymi i skutecznymi.

O autorze

Kyle’a T. Blocksoma jest starszym architektem rozwiązań w AWS z siedzibą w południowej Kalifornii. Pasją Kyle’a jest łączenie ludzi i wykorzystywanie technologii do dostarczania rozwiązań, które kochają klienci. Poza pracą lubi surfować, jeść, mocować się z psem i rozpieszczać swoją siostrzenicę i siostrzeńca.

Kyle’a T. Blocksoma jest starszym architektem rozwiązań w AWS z siedzibą w południowej Kalifornii. Pasją Kyle’a jest łączenie ludzi i wykorzystywanie technologii do dostarczania rozwiązań, które kochają klienci. Poza pracą lubi surfować, jeść, mocować się z psem i rozpieszczać swoją siostrzenicę i siostrzeńca.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://aws.amazon.com/blogs/machine-learning/build-generative-ai-agents-with-amazon-bedrock-amazon-dynamodb-amazon-kendra-amazon-lex-and-langchain/

- :ma

- :Jest

- :nie

- :Gdzie

- $W GÓRĘ

- 1

- 10

- 100

- 11

- 32

- 7

- 799

- 8

- 9

- a

- zdolność

- O nas

- akceptacja

- dostęp

- dostępny

- Dostęp

- odpowiednio

- Konto

- precyzja

- dokładny

- osiągnięty

- w poprzek

- działać

- Działania

- działania

- rzeczywisty

- dodanie

- Dodatkowy

- dostosować

- Agent

- agentów

- AI

- Cel

- Cele

- Wszystkie kategorie

- pozwala

- wzdłuż

- już

- również

- alternatywny

- Amazonka

- Amazonka Kendra

- Amazonka Lex

- Amazon Web Services

- kwoty

- wzmacniać

- an

- Analizując

- i

- odpowiedź

- odpowiedzi

- Antropiczny

- każdy

- api

- Zastosowanie

- aplikacje

- podejście

- właściwy

- architektura

- SĄ

- AS

- oszacowanie

- Aktywa

- pomagać

- Wsparcie

- Asystent

- powiązany

- At

- zwiększona

- Uwierzytelnianie

- zautomatyzować

- zautomatyzowane

- Automatyzacja

- autonomiczny

- dostępny

- uniknąć

- AWS

- Tworzenie chmury AWS

- AWS Lambda

- Bilans

- baza

- na podstawie

- BE

- być

- zanim

- w imieniu

- korzyści

- BEST

- Najlepsze praktyki

- Najwyższa

- Bot

- przynieść

- bufor

- budować

- Buduje

- wybudowany

- biznes

- by

- California

- nazywa

- Połączenia

- CAN

- możliwości

- zdolność

- zdolny

- Kartki okolicznosciowe

- ostrożnie

- walizka

- CD

- łańcuch

- zmiana

- Kanał

- kanały

- Opłaty

- pogawędzić

- chatbot

- nasze chatboty

- wybór

- wybory

- cytując

- klasyczny

- kleń

- jasny

- klient

- zamknięcie

- kod

- podstawa kodu

- ZGODNY

- COM

- popełnia

- Firmy

- konkurencyjny

- uzupełniający

- kompletny

- Zakończony

- całkowicie

- wypełniając

- wszechstronny

- Warunki

- systemu

- skonfigurowany

- ZATWARDZIAŁY

- spójnik

- Rozważać

- Rozważania

- Konsola

- zawierać

- zawiera

- zawartość

- Typy treści

- kontekst

- kontekstowy

- ciągły

- kontrola

- kontroli

- Konwencja

- Rozmowa

- konwersacyjny

- rozmowy

- prawidłowo

- Odpowiedni

- Koszty:

- kurs

- crawler

- Stwórz

- stworzony

- tworzy

- Tworzenie

- tworzenie

- wiarygodny

- Aktualny

- zwyczaj

- klient

- dane klienta

- Obsługa klienta

- Klientów

- dostosowane

- dane

- bezpieczeństwo danych

- zdecydować

- decyzja

- drzewo decyzyjne

- Decyzje

- Domyślnie

- dostarczyć

- dostarczona

- Demo

- wykazać

- demonstrowanie

- rozwijać

- Wdrożenie

- zaprojektowany

- życzenia

- detale

- Ustalać

- ustalona

- Deweloper

- deweloperzy

- Dialog

- różne

- odłączony

- dyskutować

- dyskusja

- rozprowadzać

- inny

- do

- dokument

- dokumenty

- robi

- Pies

- domena

- na dół

- projekt

- z powodu

- podczas

- e

- każdy

- Wcześniej

- przegapić

- Efektywne

- skuteczność

- wydajny

- osadzone

- włączony

- szyfrowane

- szyfrowanie

- ujmujący

- Inżynieria

- wzmacniać

- zapewnić

- Wchodzi

- Środowisko

- wyposażony

- niezbędny

- Eter (ETH)

- oceniać

- oceny

- przykład

- przykłady

- ekscytujący

- Przede wszystkim system został opracowany

- spodziewany

- doświadczenie

- wygaśnięcie

- wygaśnięcie

- odkryj

- eksport

- wyraża

- ułatwiać

- FAQ

- informacja zwrotna

- filet

- Akta

- finał

- budżetowy

- usługi finansowe

- znalezieniu

- w porządku

- pływ

- obserwuj

- następujący

- W razie zamówieenia projektu

- widelec

- format

- znaleziono

- Fundacja

- od

- frontend

- spełnianie

- spełnienie

- w pełni

- funkcjonować

- Funkcjonalność

- Funkcje

- dalej

- zbierać

- Ogólne

- Generować

- wygenerowane

- generuje

- generujący

- generacja

- generatywny

- generatywna sztuczna inteligencja

- git

- GitHub

- dany

- poprowadzi

- przewodnictwo

- uprząż

- Have

- he

- pomoc

- tutaj

- pasemka

- jego

- historia

- hostowane

- gospodarze

- W jaki sposób

- How To

- HTML

- http

- HTTPS

- i

- IAM

- identyfikuje

- zidentyfikować

- tożsamość

- if

- ilustruje

- wdrożenia

- realizacja

- importować

- ważny

- ulepszenia

- in

- zawierać

- włączony

- obejmuje

- Włącznie z

- włączać

- zawiera

- wskaźnik

- zindeksowane

- informować

- Informacja

- wkład

- Wejścia

- zamiast

- instrukcje

- instrumenty

- Integruje się

- Integracja

- integracje

- Inteligentny

- Inteligentna automatyzacja

- zamierzony

- zamiar

- interakcji

- Interakcje

- Interfejs

- Pośredni

- wewnętrzny

- najnowszych

- przywołany

- inwokuje

- dotyczy

- problemy

- IT

- JEGO

- JAVASCRIPT

- jpg

- skok

- Trzymać

- Klawisz

- wiedza

- znany

- język

- firmy

- uruchomić

- wodowanie

- Launchpad

- warstwa

- prowadzący

- Pozostawiać

- Regulamin

- Dźwignia

- biblioteki

- Biblioteka

- lubić

- Linia

- linki

- ładowarka

- masa

- pożyczka

- zalogowaniu

- logika

- logiczny

- miłość

- niższy

- robić

- WYKONUJE

- Dokonywanie

- zarządzane

- kierownik

- sposób

- Może..

- wymowny

- znaczy

- środków

- Mechanizmy

- Pamięć

- wiadomość

- spełnione

- MIT

- model

- modele

- Modyfikacje

- modyfikować

- monitor

- monitorowanie

- jeszcze

- Hipoteka

- ruch

- dużo

- wielokrotność

- musi

- Nazwa

- nazywania

- Naturalny

- Język naturalny

- Przetwarzanie języka naturalnego

- Zrozumienie naturalnego języka

- Natura

- Nawigacja

- niezbędny

- Potrzebować

- potrzebne

- nigdy

- Nowości

- Następny

- nlp

- nie

- Nie

- noty

- już dziś

- przysięgać

- cel

- obserwacja

- of

- oferta

- często

- on

- trwający

- tylko

- koncepcja

- open source

- działać

- Uparty

- Optymalizacja

- or

- orkiestracja

- orkiestracja

- organizacja

- oryginalny

- pierwotnie

- Inne

- ludzkiej,

- Wyjścia

- zewnętrzne

- koniec

- przegląd

- własny

- pakiet

- Pakiety

- par

- parametr

- parametry

- część

- wzmacniacz

- pasja

- Przeszłość

- ścieżka

- ścieżki

- Zapłacić

- płatność

- w oczekiwaniu

- Ludzie

- wykonać

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonuje

- uprawnienia

- osobisty

- Personalizowany

- rurociąg

- Miejsce

- krok po kroku

- plato

- Analiza danych Platona

- PlatoDane

- Proszę

- wtyczka

- zwrotnica

- Post

- power

- powered

- praktyki

- poprzedzający

- predefiniowane

- woleć

- przedstawione

- poprzedni

- pierwotny

- prywatność

- prywatny

- procedura

- kontynuować

- wygląda tak

- obrobiony

- przetwarzanie

- produkować

- produkcji

- Produkcja

- programowy

- Postęp

- monity

- chronić

- chroniony

- prototyp

- zapewniać

- pod warunkiem,

- zapewnia

- zaopatrzenie

- publiczny

- publikować

- Publikuje

- cel

- cele

- zapytania

- pytanie

- pytania

- szybko

- zasięg

- ceny

- raczej

- Osiąga

- osiągnięcie

- gotowy

- real

- odbieranie

- uznanie

- rozpoznać

- nagranie

- dokumentacja

- odnosić się

- zwolnić

- rzetelny

- zdalny

- składnica

- zażądać

- wymagać

- wymagany

- Zasób

- Zasoby

- Odpowiadać

- odpowiedź

- Odpowiedzi

- dalsze

- wynikowy

- przeglądu

- korzeń

- reguły

- run

- bieganie

- działa

- bezpiecznie

- Powiedział

- taki sam

- klientów

- zapisywane

- Skala

- scenariusz

- Szukaj

- Tajemnica

- tajniki

- Sekcja

- działy

- bezpieczne

- bezpieczeństwo

- widzieć

- wybierając

- rozsądek

- wrażliwy

- oddzielny

- Serie

- służy

- usługa

- Usługi

- zestaw

- shared

- Powłoka

- powinien

- podobny

- Prosty

- prostsze

- pojedynczy

- SMS

- skrawek

- So

- Wyłącznie

- rozwiązanie

- Rozwiązania

- Źródło

- Kod źródłowy

- Źródła

- Sourcing

- Południowy

- specyficzny

- przemówienie

- stos

- początek

- Stan

- Rynek

- pobyt

- Ewolucja krok po kroku

- Cel

- przechowywanie

- przechowywany

- sklep

- styl

- Z powodzeniem

- taki

- apartament

- PODSUMOWANIE

- zaopatrzenie

- wsparcie

- Systemy wsparcia

- Utrzymany

- syntetyczny

- system

- systemy

- T

- Brać

- Tandem

- Zadanie

- Zespoły

- Techniczny

- Techniki

- Technologia

- szablon

- REGULAMIN

- Regulamin

- test

- przetestowany

- Testowanie

- XNUMX

- niż

- że

- Połączenia

- Informacje

- Źródło

- ich

- Im

- następnie

- Te

- one

- Myślący

- innych firm

- to

- myśl

- Przez

- poprzez

- do

- już dziś

- razem

- żeton

- narzędzie

- narzędzia

- w kierunku

- śledzić

- Trening

- pociągi

- transakcje

- Przekształcać

- drzewo

- Trendy

- prawdziwy

- tunes

- Twilio

- rodzaj

- typy

- ui

- Ostatecznie

- dla

- zasadniczy

- zrozumieć

- zrozumienie

- rozumie

- zbliżających

- Aktualizacja

- na

- URL

- użyteczność

- Stosowanie

- posługiwać się

- używany

- Użytkownik

- Doświadczenie użytkownika

- prywatność użytkownika

- Użytkownicy

- zastosowania

- za pomocą

- wykorzystuje

- UPRAWOMOCNIĆ

- uprawomocnienie

- wartość

- Wartości

- zmienna

- różnorodność

- różnorodny

- Naprawiono

- zweryfikować

- wersja

- przez

- Zobacz i wysłuchaj

- Wirtualny

- Głos

- czekać

- chcieć

- była

- Droga..

- we

- sieć

- Aplikacja internetowa

- usługi internetowe

- Strona internetowa

- strony internetowe

- były

- Co

- który

- Podczas

- szeroki

- Szeroki zasięg

- będzie

- w

- w ciągu

- bez

- Praca

- pracowników

- workflow

- przepływów pracy

- pracujący

- świat

- by

- tak

- jeszcze

- ty

- Twój

- zefirnet

- Zamek błyskawiczny