I dagens verden er vi omgitt av ulike kilder til skriftlig informasjon, informasjon som vi generelt antar er skrevet av andre mennesker. Enten dette er i form av bøker, blogger, nyhetsartikler, foruminnlegg, tilbakemeldinger på en produktside eller diskusjoner på sosiale medier og i kommentarfelt, er antagelsen at teksten vi leser er skrevet av en annen person. I løpet av årene har imidlertid denne antagelsen blitt stadig mer sannsynlig å være falsk, sist på grunn av store språkmodeller (LLMs) som GPT-2 og GPT-3 som kan churne ut plausible avsnitt om omtrent alle emner når de blir bedt om det.

Dette reiser spørsmålet om vi er i ferd med å nå et punkt hvor vi ikke lenger kan være rimelig sikre på at en nettkommentar, en nyhetsartikkel eller til og med hele bøker og filmmanus ikke ble trukket ut av en algoritme, eller kanskje til og med hvor en nettprat med en ny sizzling kamp viser seg å være akkurat deg som får det på med en følelsesløs samling av kode som er trent og tilpasset for maksimalt engasjement med kundene. (Redaktørens merknad: nei, vi spiller ikke det spillet her.)

Ettersom slikt maskingenerert innhold og interaksjoner begynner å spille en stadig større rolle, reiser det både spørsmålet om hvordan du kan oppdage slikt generert innhold, samt om det har noen betydning at innholdet ble generert av en algoritme i stedet for av et menneske .

Kjedsomhet mot ondskap

Hos George Orwell Nitten åtti fire, Winston Smith beskriver en avdeling i Sannhetsdepartementet kalt fiksjonsavdelingen, hvor maskiner hele tiden lager ut nyskapte romaner basert på bestemte temaer. I mellomtiden i musikkavdelingen blir ny musikk generert av et annet system kalt en versificator.

Likevel så dystopisk som denne fiktive verdenen er, er dette maskingenererte innholdet i hovedsak harmløst, som Winston bemerker senere i boken, når han observerer en kvinne i proleområdet i byen som synger det siste, og legger til sin egen følelsesmessige intensitet til en kjærlighetssang som ble spyttet ut av en følelsesløs, tankeløs maskin. Dette bringer oss til den vanligste bruken av maskingenerert innhold, som mange vil hevde bare er en form for automatisering.

Det omfattende begrepet her er 'automatisert journalistikk', og har vært i bruk med respekterte journalistiske utsalgssteder som Reuters, AP og andre i årevis nå. Brukstilfellene her er enkle og greie: Dette er systemer som er konfigurert til å ta inn informasjon om aksjeresultater, på selskapets kvartalsrapporter, om resultater fra idrettskamper eller lokale valg, og churner ut en artikkel etter et forhåndsinnstilt mønster. Den åpenbare fordelen er at rom fulle av journalister som kjedelig kopierer poeng og ytelsesmålinger til artikkelmaler, kan erstattes av en datamaskinalgoritme.

I disse tilfellene blir arbeid som involverer den journalistiske eller kunstneriske ekvivalenten med å snu burgere på et gatekjøkken erstattet av en algoritme som aldri blir lei eller distrahert, mens menneskene kan gjøre mer intellektuelt utfordrende arbeid. Få vil hevde at det er et problem med denne typen automatisering, siden den i utgangspunktet gjør akkurat det vi ble lovet at den ville gjøre.

Der ting blir lyssky er når det brukes til uhyggelige formål, for eksempel å trekke inn søketrafikk med maskingenererte artikler som prøver å selge leseren noe. Selv om dette nylig har ført til betydelig forargelse når det gjelder CNET, er saken at dette er en utrolig lønnsom tilnærming, så vi kan se mer av det i fremtiden. Tross alt kan en stor språkmodell generere en hel stabel med artikler på den tiden det tar en menneskelig forfatter å legge ned noen avsnitt med tekst.

Mer en gråsone er når det gjelder å bistå en menneskelig forfatter, noe som er i ferd med å bli et problem i vitenskapelig publiserings verden, som nylig dekket by The Guardian, som selv gjorde litt av et stunt i september 2020 da de publisert en artikkel som hadde blitt generert av GPT-3 LLM. Forbeholdet der var at det ikke var den rette utgangen fra LLM, men hva en menneskelig redaktør hadde puslet sammen fra flere utganger generert av GPT-3. Dette er snarere en indikasjon på hvordan LLM-er generelt brukes, og antyder noen av deres største svakheter.

Ingen feil svar

I kjernen en LLM som GPT-3 er en sterkt sammenkoblet database med verdier som ble generert fra inngangstekster som utgjør treningsdatasettet. I tilfellet med GPT-3 gir dette en database (modell) som er omtrent 800 GB i størrelse. For å søke i denne databasen, er det gitt en spørringsstreng – vanligvis som et spørsmål eller ledende setning – som etter prosessering danner input til en kurvetilpasningsalgoritme. Dette bestemmer i hovedsak sannsynligheten for at inndataspørringen er relatert til en del av modellen.

Når et sannsynlig samsvar er funnet, kan utdata genereres basert på hva som er den mest sannsynlige neste forbindelsen i modellens database. Dette gjør det mulig for en LLM å finne spesifikk informasjon i et stort datasett og å lage teoretisk uendelig lange tekster. Det den imidlertid ikke kan gjøre, er å avgjøre om inndataspørringen gir mening, eller om utdataene den genererer gir logisk mening. Alt algoritmen kan avgjøre er om den følger den mest sannsynlige kursen, med muligens noen induserte variasjoner for å blande opp utdataene.

Noe som fortsatt anses som et problem med LLM-genererte tekster er repetisjon, selv om dette kan løses med noen justeringer som gir utdataene et "minne" for å kutte ned på antall ganger et spesifikt ord brukes. Det som er vanskeligere å løse er den absolutte tilliten til LLM-utdata, siden den ikke har noen måte å finne ut om den bare produserer tull og vil gjerne fortsette å pludre.

Til tross for dette, når menneskelige subjekter blir utsatt for GPT-3- og GPT-2-genererte tekster som i en 2021 studie av Elizabeth Clark et al., er sannsynligheten for at de gjenkjenner tekster generert av disse LLM-ene – selv etter litt trening – ikke over 55 %, noe som gjør det omtrent beslektet med ren tilfeldighet. Akkurat hvorfor er det slik at mennesker er så forferdelige til å gjenkjenne disse LLM-genererte tekstene, og kan kanskje datamaskiner hjelpe oss her?

Statistikk versus intuisjon

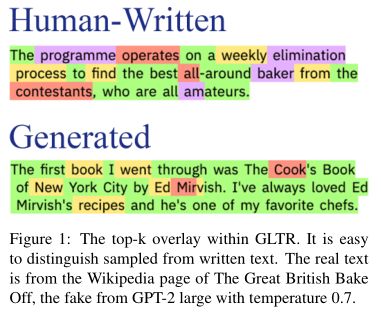

(Kreditt: Gehrmann et al., 2019)

Når et menneske blir spurt om en gitt tekst er skapt av et menneske eller generert av en maskin, vil de sannsynligvis gjette basert på egne erfaringer, en "magefølelse" og muligens en rekke ledetråder. I en 2019 papir av Sebastian Gehrmann et al., er en statistisk tilnærming for å oppdage maskingenerert tekst foreslått, i tillegg til å identifisere en rekke uhyggelige forekomster av autogenerert tekst. Disse inkluderer falske kommentarer i motsetning til USAs nettnøytralitet og villedende anmeldelser.

Den statistiske tilnærmingen beskrevet av Gehrmann et al. kalles Giant Language model Test Room (GLTR, GitHub-kilde) innebærer å analysere en gitt tekst for dens forutsigbarhet. Dette er et kjennetegn som ofte beskrives av lesere som "grunnhet" i en maskingenerert tekst, ved at den fortsetter å vafle i avsnitt uten egentlig å si så mye. Med et verktøy som GLTR vil en slik tekst lyse for det meste grønt i den visuelle representasjonen, siden den bruker et begrenset og forutsigbart ordforråd.

In en artikkel presentert av Daphne Ippolito et al. (PDF) på 2020-møtet til Association for Computational Linguistics dekkes de ulike tilnærmingene til å oppdage maskingenerert tekst, sammen med effektiviteten til disse metodene brukt isolert versus på en kombinert måte. Top-k-analysetilnærmingen som brukes av GLTR er inkludert i disse metodene, med alternative tilnærminger til kjerneprøvetaking (top-p) og andre også adressert.

Til syvende og sist, i denne studien scoret de menneskelige forsøkspersonene en median på 74 % når de klassifiserte GPT-2-tekster, med det automatiserte diskriminatorsystemet generelt bedre. Bemerkelsesverdig er studien av Ari Holtzman et al. som refereres til i konklusjonen, der det bemerkes at menneskeskreven tekst generelt har en tråkkfrekvens som faller inn og ut av en lav sannsynlighetssone. Dette gjør ikke bare det som gjør en tekst interessant å lese, men gir også en pekepinn på hva som får tekst til å virke naturlig for en menneskelig leser.

Med moderne LLM-er som GPT-3, en tilnærming som kjerneprøvetakingen foreslått av Holtzman et al. er det som gir den mer naturlige kadensen som kan forventes av en tekst skrevet av et menneske. I stedet for å velge fra en topp-k-liste med alternativer, velger man i stedet fra en dynamisk endret størrelse av kandidater: sannsynlighetsmassen. Den resulterende listen over alternativer, top-p, gir da en mye rikere utgang enn med top-k-tilnærmingen som ble brukt med GPT-2 og familie.

Hva dette også betyr er at i den automatiske analysen av en tekst, må flere tilnærminger vurderes. For analysen av en menneskelig leser, vil skillet mellom en top-k (GPT-2) og top-p (GPT-3) tekst være sterk, med den sistnevnte typen som sannsynligvis vil bli identifisert som skrevet av et menneske.

Usikre tider

Det ser dermed ut til at svaret på spørsmålet om en gitt tekst ble generert av et menneske eller ikke er et definitivt "kanskje". Selv om statistisk analyse kan gi noen hint om sannsynligheten for at en tekst blir generert av en LLM, må den endelige dommen til syvende og sist være hos et menneske, som ikke bare kan avgjøre om teksten passerer semantisk og kontekstuelt, men også sjekke den antatte kilden til en tekst for å være ekte.

Naturligvis er det nok av situasjoner der det kanskje ikke spiller noen rolle hvem som har skrevet en tekst, så lenge informasjonen i den er faktisk korrekt. Men når det er mulig ondsinnet hensikt, eller hensikten å lure, er det nødvendig å praktisere due diligence. Selv med auto-deteksjonsalgoritmer på plass, og med en trent og forsiktig bruker, er det leseren som har ansvaret for å kryssreferanser informasjon og finne ut om en uttalelse fra en tilfeldig konto på sosiale medier kan være ekte.

(Redaktørens merknad: Dette innlegget om OpenAIs forsøk på å oppdage sin egen prosa kom ut mellom denne artikkelen ble skrevet og publisert. Resultatene deres er ikke så gode, og som med alt fra "Open" AI, blir metodene deres ikke offentliggjort. Du kan imidlertid prøve klassifisereren.)

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- Platoblokkkjede. Web3 Metaverse Intelligence. Kunnskap forsterket. Tilgang her.

- kilde: https://hackaday.com/2023/02/01/detecting-machine-generated-content-an-easier-task-for-machine-or-human/

- 1

- 2019

- 2020

- a

- Om oss

- Absolute

- Logg inn

- tillegg

- Fordel

- Etter

- algoritme

- algoritmer

- Alle

- tillater

- Selv

- analyse

- analyserer

- og

- En annen

- besvare

- tilnærming

- tilnærminger

- AREA

- argumentere

- rundt

- Artikkel

- artikler

- kunstnerisk

- Association

- forutsetningen

- Automatisert

- Automatisk

- Automatisering

- basert

- I utgangspunktet

- Bears

- bli

- bli

- være

- Bedre

- mellom

- større

- Biggest

- Bit

- blogger

- bok

- bøker

- Bored

- Bringer

- Cadence

- som heter

- kandidater

- kan ikke

- saken

- saker

- forsiktige

- viss

- utfordrende

- sjanse

- karakteristisk

- sjekk

- City

- CNET

- kode

- samling

- kombinert

- kommentere

- kommentarer

- Felles

- Selskapet

- datamaskin

- datamaskiner

- bekymringer

- konklusjon

- selvtillit

- tilkobling

- ansett

- stadig

- innhold

- kopiering

- Kjerne

- kurs

- dekket

- skape

- opprettet

- kreditt

- skjøger

- Kunder

- Kutt

- dato

- datasett

- Database

- definitive

- Avdeling

- beskrevet

- Til tross for

- detaljert

- Bestem

- bestemmes

- aktsomhet

- diskusjoner

- ikke

- ned

- dystopisk

- enklere

- redaktør

- effektivitet

- Valg

- altomfattende

- engasjement

- Hele

- Tilsvarende

- hovedsak

- Eter (ETH)

- Selv

- NOEN GANG

- alt

- nøyaktig

- stige

- forventet

- Erfaringer

- forfalskning

- Mote

- FAST

- tilbakemelding

- Noen få

- Fiction

- fiktiv

- Film

- slutt~~POS=TRUNC

- Finn

- fitting

- etter

- følger

- mat

- Forbes

- skjema

- skjemaer

- Forum

- funnet

- fra

- fullt

- framtid

- spill

- generelt

- generere

- generert

- genererer

- George

- få

- få

- giganten

- Gi

- gitt

- flott

- Grønn

- å ha

- tungt

- hjelpe

- her.

- hint

- Hvordan

- Men

- HTTPS

- menneskelig

- Mennesker

- identifisert

- identifisering

- in

- inkludere

- inkludert

- utrolig

- informasjon

- inngang

- i stedet

- hensikt

- interaksjoner

- sammenhengende

- interessant

- isolasjon

- utstedelse

- IT

- ledd

- Journalister

- Hold

- Kin

- Type

- Språk

- stor

- siste

- ledende

- Led

- lett

- Sannsynlig

- Begrenset

- lingvistikk

- Liste

- lokal

- Lang

- lenger

- elsker

- Lav

- maskin

- maskiner

- laget

- GJØR AT

- Making

- mange

- Mass

- Match

- Saken

- Saker

- max bredde

- maksimal

- midler

- Mellomtiden

- Media

- møte

- bare

- metoder

- Metrics

- kunne

- departement

- modell

- modeller

- Moderne

- mer

- mest

- flere

- musikk

- Naturlig

- nett

- nettnøytralitet

- Ny

- nyheter

- neste

- bemerket

- Antall

- Observerer

- Åpenbare

- ONE

- på nett

- opposisjon

- alternativer

- rekkefølge

- Annen

- andre

- Utsalgssteder

- egen

- Papir

- passerer

- Mønster

- ytelse

- kanskje

- person

- Sted

- plato

- Platon Data Intelligence

- PlatonData

- plausibel

- Spille

- spiller

- Plenty

- Point

- basseng

- Post

- innlegg

- praksis

- Forutsigbar

- presentert

- sannsynlighet

- Problem

- prosessering

- Produkt

- lønnsom

- lovet

- foreslått

- gi

- forutsatt

- gir

- offentlig

- publisert

- Publisering

- formål

- sette

- spørsmål

- hever

- tilfeldig

- område

- å nå

- Lese

- Reader

- lesere

- Lesning

- nylig

- i slekt

- forblir

- erstattet

- Rapporter

- representasjon

- Forespurt

- løst

- respektert

- resulterende

- Resultater

- Reuters

- Anmeldelser

- Rolle

- rom

- Rom

- omtrent

- scoring

- skript

- Søk

- Seksjon

- seksjoner

- selger

- forstand

- September

- sett

- Enkelt

- situasjoner

- Størrelse

- So

- selskap

- sosiale medier

- noen

- noe

- kilde

- Kilder

- spesifikk

- Sport

- stable

- stark

- Uttalelse

- statistisk

- Still

- lager

- rett

- rett fram

- Studer

- slik

- omgitt

- system

- Systemer

- Ta

- tar

- Oppgave

- maler

- test

- De

- Fremtiden

- informasjonen

- verden

- deres

- seg

- ting

- tid

- ganger

- til

- dagens

- sammen

- verktøy

- Tema

- trafikk

- trent

- Kurs

- Til syvende og sist

- us

- bruke

- Bruker

- Verdier

- ulike

- Versus

- Hva

- Hva er

- om

- hvilken

- mens

- HVEM

- Wikipedia

- vil

- innenfor

- uten

- kvinne

- ord

- Arbeid

- verden

- ville

- forfatter

- skrevet

- Feil

- år

- zephyrnet