Bilde fra Bing Image Creator

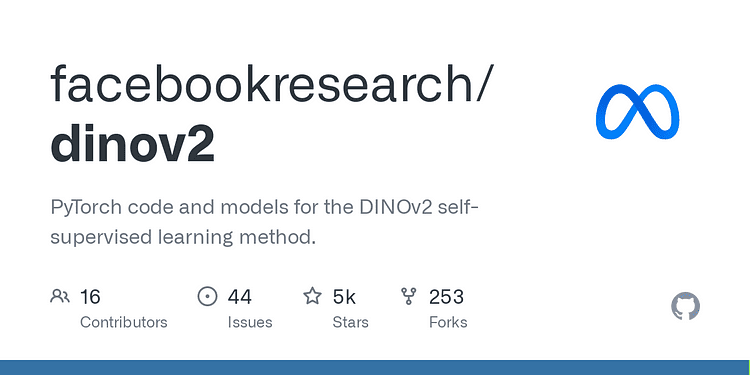

Meta AI har nettopp sluppet åpen kildekode DINOv2-modeller den første metoden som bruker selvovervåket læring for å trene datasynsmodeller. DINOv2-modellene oppnår resultater som samsvarer med eller er enda bedre enn standardtilnærmingen og modellene i feltet.

Modellene oppnådde sterk ytelse uten behov for finjustering, noe som er et perfekt valg for mange forskjellige datasynsoppgaver og applikasjoner. DINOv2 kan lære av ulike samlinger av bilder og funksjoner som dybdeestimering uten behov for eksplisitt opplæring takket være den selvstyrte treningsmetoden.

Figur 1: DINOv2: Self-Supervised Computer Vision Models by Meta AI

1.1. Ingen finjustering er nødvendig

Selvovervåket læring er en kraftig metode som brukes til å trene maskinlæringsmodeller uten behov for store mengder merkede data. DINOv2-modeller kan trenes på bildekorpus uten behov for relaterte metadata, spesifikk hashtag eller bildetekst. DinoV2-modeller, i motsetning til flere nyere selvovervåkede læringstilnærminger, krever ikke finjustering, og produserer dermed funksjoner med høy ytelse for forskjellige datasynsapplikasjoner.

1.2. Overvinne menneskelige merknadsbegrensninger

I løpet av de siste årene, bilde-tekst føropplæring har blitt den dominerende metoden for ulike datasynsapplikasjoner. Men på grunn av sin avhengighet av menneskemerkede bildetekster for å lære den semantiske betydningen av bilder. Denne tilnærmingen overser ofte viktig informasjon som ikke er eksplisitt inkludert i disse bildetekstene. For eksempel kan en menneskelig etiketttekst av et bilde av et rødt bord i et gult rom være "Et rødt trebord". Denne bildeteksten vil gå glipp av viktig informasjon om bakgrunnen, plasseringen og størrelsen på bordet. Dette vil føre til manglende forståelse av lokal informasjon og vil resultere i dårlig ytelse på oppgaver som krever detaljert lokaliseringsinformasjon.

Behovet for menneskelige merker og merknader vil også begrense mengden data vi kan samle inn for å trene modellene. Dette blir mye vanskeligere for visse applikasjoner, for eksempel å kommentere en celle krever et visst nivå av menneskelig ekspertise som ikke vil være tilgjengelig i den skalaen som kreves. Å bruke en selvovervåket treningstilnærming på mobilbilder åpner veien for en mer grunnleggende modell og vil som et resultat bli bedre biologisk funn. Det samme gjelder tilsvarende avanserte felt som estimeringen av dyretetthet.

Å flytte fra DINO til DINOv2 krevde å overvinne flere utfordringer som f.eks

- Opprette et stort og kuratert opplæringsdatasett

- Forbedre treningsalgoritmen og implementeringen

- Utforming av en funksjonell destillasjonsrørledning.

Figur 2: DINO v1 Vs v2 sammenligning av segmenteringspresisjon

2.1. Opprette et stort, kuratert og mangfoldig bildedatasett

Et av hovedtrinnene for å bygge DINOv2 er å trene opp større arkitekturer og modeller for å forbedre modellens ytelse. Imidlertid krever større modeller store datasett for å bli effektivt trent. Siden det ikke var store datasett tilgjengelig som oppfyller kravene, utnyttet forskere offentlig gjennomsøkte nettdata og bygget en pipeline for å velge bare nyttige data som i LASER.

Imidlertid bør to hovedoppgaver gjøres for å kunne bruke disse datasettene:

- Balanser dataene på tvers av ulike konsepter og oppgaver

- Fjern irrelevante bilder

Siden denne oppgaven kan utføres manuelt, kuraterte de et sett med frøbilder fra omtrent 25 tredjepartsdatasett og utvidet det ved å hente bilder som er nært relatert til disse frøbildene. Denne tilnærmingen tillot dem å produsere et tilhørende datasett med totalt 142 millioner bilder av 1.2 milliarder bilder.

2.2. Algoritmiske og tekniske forbedringer

Selv om bruk av større modeller og datasett vil føre til bedre resultater, medfører det store utfordringer. To av hovedutfordringene er potensiell ustabilitet og å forbli håndterbar under trening. For å gjøre treningen mer stabil inkluderer DINOv2 ytterligere regulariseringsmetoder som er inspirert av likhetssøk og klassifisering litteratur.

Opplæringsprosessen til DINOv2 integrerer de siste implementeringene med blandet presisjon og distribuert opplæring levert av banebrytende PyTorch 2. Dette tillot raskere implementering av kodene og bruk av samme maskinvare for å trene DINO-modeller resulterte i dobbel hastighet og en tredjedel av minnebruken som tillot skalering i data og modellstørrelse.

2.3. Redusere slutningstid ved bruk av modelldestillasjon

Å kjøre store modeller i inferens krever kraftig maskinvare som vil begrense den praktiske bruken av metodene for ulike brukstilfeller. For å overvinne dette problemet brukte forskerne modelldestillasjon for å komprimere kunnskapen om de store modellene til mindre. Ved å bruke denne tilnærmingen, var forskere i stand til å kondensere høyytelsesarkitekturer til mindre med ubetydelige ytelseskostnader. Dette resulterte i sterke ViT-Small-, ViT-Base- og ViT-Large-modeller.

Opplærings- og evalueringskoden krever PyTorch 2.0 og xFormers 0.0.18 samt mange andre tredjepartspakker og også koden forventer et Linux-miljø. Følgende instruksjoner skisserer hvordan du konfigurerer alle nødvendige avhengigheter for opplærings- og evalueringsformål:

- Installer PyTorch ved å bruke instruksjonene her.. Det anbefales å installere PyTorch med CUDA-støtte.

- Last ned leilighet

- Klon DINOv2-depotet ved å bruke følgende kommando:

Kode etter forfatter

- Fortsett med å opprette og aktivere et Conda-miljø kalt "dinov2" ved å bruke den angitte miljødefinisjonen:

Kode etter forfatter

- For å installere avhengighetene som kreves for dette prosjektet, bruk den medfølgende filen requirements.txt.

Kode etter forfatter

- Til slutt kan du laste inn modellene ved å bruke koden nedenfor:

Kode etter forfatter

Avslutningsvis markerer utgivelsen av DINOv2-modeller av Meta AI en betydelig milepæl. Den selvovervåkede læringstilnærmingen som brukes av DINOv2-modeller gir en kraftig måte å trene maskinlæringsmodeller uten behov for store mengder merkede data. Med muligheten til å oppnå høy nøyaktighet uten behov for finjustering, er disse modellene egnet for ulike datasynsoppgaver og applikasjoner. I tillegg kan DINOv2 lære av forskjellige samlinger av bilder og kan lære av funksjoner som dybdeestimering uten eksplisitt opplæring. Tilgjengeligheten av DINOv2 som en åpen kildekode-modell åpner dørene for forskere og utviklere til å utforske nye muligheter innen datasynsoppgaver og applikasjoner.

Referanser

Youssef Rafaat er en datasynsforsker og dataforsker. Forskningen hans fokuserer på å utvikle sanntidsdatasynsalgoritmer for helsetjenester. Han jobbet også som dataforsker i mer enn 3 år innen markedsføring, finans og helsevesen.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoAiStream. Web3 Data Intelligence. Kunnskap forsterket. Tilgang her.

- Minting the Future med Adryenn Ashley. Tilgang her.

- Kjøp og selg aksjer i PRE-IPO-selskaper med PREIPO®. Tilgang her.

- kilde: https://www.kdnuggets.com/2023/05/dinov2-selfsupervised-computer-vision-models-meta-ai.html?utm_source=rss&utm_medium=rss&utm_campaign=dinov2-self-supervised-computer-vision-models-by-meta-ai

- : har

- :er

- :ikke

- 1

- 1.2 milliarder

- 3.

- a

- evne

- I stand

- Om oss

- oppnådd

- Oppnå

- oppnådd

- tvers

- Ytterligere

- avansert

- AI

- algoritme

- algoritmisk

- algoritmer

- Alle

- også

- beløp

- beløp

- an

- og

- dyr

- søknader

- tilnærming

- tilnærminger

- ca

- ER

- AS

- At

- tilgjengelighet

- tilgjengelig

- bakgrunn

- BE

- bli

- blir

- under

- Bedre

- Milliarder

- Bing

- Bygning

- bygget

- by

- CAN

- teksting

- saker

- Årsak

- viss

- utfordringer

- valg

- tett

- kode

- samle

- samlinger

- kommer

- sammenligning

- datamaskin

- Datamaskin syn

- Datasynsapplikasjoner

- konsepter

- konklusjon

- Kostnader

- skape

- Opprette

- avgjørende

- kuratert

- dato

- dataforsker

- datasett

- Etterspørsel

- avhengighet

- dybde

- detaljert

- utviklere

- utvikle

- forskjellig

- distribueres

- distribuert opplæring

- diverse

- do

- domene

- gjort

- dører

- dobbelt

- to

- under

- effektivt

- forbedre

- Miljø

- Eter (ETH)

- evaluering

- Selv

- eksempel

- utvidet

- forventer

- ekspertise

- utforske

- raskere

- Egenskaper

- Noen få

- felt

- Felt

- filet

- finansiere

- Først

- fokuserer

- etter

- Til

- fra

- funksjonelle

- gif

- maskinvare

- hashtag

- he

- helsetjenester

- Høy

- høy ytelse

- hans

- Hvordan

- Hvordan

- Men

- HTML

- HTTPS

- menneskelig

- bilde

- bilder

- gjennomføring

- viktig

- in

- inkludert

- inkluderer

- informasjon

- inspirert

- ustabilitet

- installere

- instruksjoner

- Integrerer

- inn

- IT

- DET ER

- bare

- KDnuggets

- kunnskap

- Etiketten

- etiketter

- maling

- stor

- større

- siste

- føre

- LÆRE

- læring

- Nivå

- BEGRENSE

- linux

- litteratur

- laste

- lokal

- Lokalisering

- maskin

- maskinlæring

- Hoved

- større

- gjøre

- GJØR AT

- manuelt

- mange

- Marketing

- Match

- betyr

- Møt

- Minne

- Meta

- metadata

- metode

- metoder

- kunne

- milepæl

- millioner

- modell

- modeller

- mer

- Videre

- mye

- oppkalt

- nødvendig

- Trenger

- Ny

- Nei.

- of

- ofte

- on

- seg

- bare

- åpen kildekode

- åpner

- or

- Annen

- ut

- omriss

- Overcome

- pakker

- parti

- Past

- perfekt

- ytelse

- PHP

- bilde

- rørledning

- plato

- Platon Data Intelligence

- PlatonData

- dårlig

- posisjon

- muligheter

- potensiell

- kraftig

- Praktisk

- Problem

- prosess

- produsere

- prosjekt

- forutsatt

- gir

- offentlig

- formål

- pytorch

- sanntids

- nylig

- Rød

- i slekt

- slipp

- utgitt

- gjenværende

- Repository

- krever

- påkrevd

- Krav

- Krever

- forskning

- forsker

- forskere

- resultere

- Resultater

- rom

- s

- samme

- Skala

- skalering

- Forsker

- seed

- segmentering

- sett

- flere

- bør

- signifikant

- lignende

- siden

- Størrelse

- mindre

- noen

- spesifikk

- fart

- stabil

- Standard

- Steps

- sterk

- slik

- egnet

- støtte

- bord

- Oppgave

- oppgaver

- Teknisk

- enn

- Takk

- Det

- De

- Dem

- Der.

- Disse

- de

- Tredje

- tredjeparts

- denne

- De

- tid

- til

- Totalt

- Tog

- trent

- Kurs

- to

- forståelse

- I motsetning til

- bruk

- bruke

- brukt

- ved hjelp av

- bruke

- utnytte

- v1

- ulike

- syn

- vs

- Vei..

- we

- web

- VI VIL

- var

- hvilken

- vil

- med

- uten

- tre

- arbeidet

- år

- du

- zephyrnet