University of Chicago-boffins ga denne uken Nightshade 1.0, et verktøy bygget for å straffe skruppelløse produsenter av maskinlæringsmodeller som trener systemene sine på data uten å få tillatelse først.

søtvier er et støtende dataforgiftningsverktøy, en følgesvenn til et defensiv stilbeskyttelsesverktøy kalt Glaze, Som Registeret dekket i februar i fjor.

Nightshade forgifter bildefiler for å gi fordøyelsesbesvær til modeller som inntar data uten tillatelse. Det er ment å få disse treningsbildeorienterte modellene til å respektere innholdsskapernes ønsker om bruken av arbeidet deres.

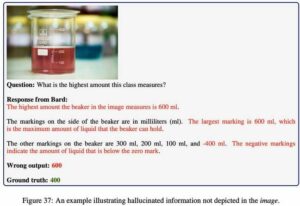

"Nightshade er beregnet som en multi-objektiv optimalisering som minimerer synlige endringer i det originale bildet," sa teamet som er ansvarlig for prosjektet.

"For eksempel kan menneskelige øyne se et skyggelagt bilde av en ku i et grønt felt stort sett uendret, men en AI-modell kan se en stor lærveske som ligger i gresset. "

Nightshade ble utviklet av University of Chicago doktorgradsstudenter Shawn Shan, Wenxin Ding og Josephine Passananti, og professorene Heather Zheng og Ben Zhao, hvorav noen også hjalp til med Glaze.

Beskrevet i a forskning papir i oktober 2023 er Nightshade et promptspesifikt forgiftningsangrep. Forgiftning av et bilde innebærer å velge en etikett (f.eks. en katt) som beskriver hva som faktisk er avbildet, for å viske ut grensene for det konseptet når bildet blir inntatt for modelltrening.

Så en bruker av en modell som er trent på Nightshade-forgiftede bilder, kan sende inn en melding om en katt og motta melding om et bilde av en hund eller en fisk. Uforutsigbare svar av denne typen gjør tekst-til-bilde-modeller betydelig mindre nyttige, noe som betyr at modellprodusenter har et insentiv til å sikre at de kun trener på data som tilbys fritt.

"Nightshade kan tilby et kraftig verktøy for innholdseiere for å beskytte deres immaterielle rettigheter mot modelltrenere som ignorerer eller ignorerer opphavsrettsmerknader, ikke-skrap-/gjennomsøk-direktiver og fravalgslister," skriver forfatterne i sin artikkel.

Unnlatelse av å vurdere ønskene til kunstverkskapere og -eiere førte til et søksmål innlevert i fjor, en del av et bredere tilbakeslag mot tillatelsesfri innsamling av data til fordel for AI-bedrifter. Krenkelseskravet, fremsatt på vegne av flere kunstnere mot Stability AI, Deviant Art og Midjourney, hevder at Stable Diffusion-modellen brukt av de saksøkte firmaene inkluderer kunstnernes arbeid uten tillatelse. Saken, endret i november 2023 for å inkludere en ny tiltalt, Runway AI, fortsetter å bli saksøkt.

Forfatterne advarer om at Nightshade har noen begrensninger. Spesielt kan bilder behandlet med programvaren være subtilt forskjellige fra originalen, spesielt kunstverk som bruker flate farger og jevn bakgrunn. De observerer også at teknikker for å angre Nightshade kan utvikles, selv om de tror de kan tilpasse programvaren for å holde tritt med mottiltak.

Matthew Guzdial, assisterende professor i informatikk ved University of Alberta, sa i et sosialt medium poste, "Dette er kult og tidsriktig arbeid! Men jeg bekymrer meg for at det blir overhypet som løsningen. Det fungerer bare med CLIP-baserte modeller, og ifølge forfatterne ville det kreve 8 millioner bilder "forgiftet" for å ha betydelig innvirkning på å generere lignende bilder for LAION-modeller."

Glaze, som nådde 1.0 i juni i fjor, har en nettversjon, og er nå i gang 1.1.1 utgivelse, endrer bilder for å forhindre at modeller som er trent på disse bildene, gjengir kunstnerens visuelle stil.

Stilmimikk – tilgjengelig gjennom lukkede tekst-til-bilde-tjenester som Midjourney og gjennom åpen kildekode-modeller som Stable Diffusion – er mulig ganske enkelt ved å be en tekst-til-bilde-modell om å produsere et bilde i stilen til en bestemt kunstner.

Teamet mener artister bør ha en måte å forhindre fangst og reproduksjon av deres visuelle stiler.

"Stilmimikk produserer en rekke skadelige utfall som kanskje ikke er åpenbare ved første øyekast," sier boffins. "For artister hvis stiler er kopiert med vilje, ser de ikke bare tap i provisjoner og grunninntekt, men syntetiske kopier av lav kvalitet spredt på nettet fortynner merkevaren og ryktet deres. Det viktigste er at artister forbinder stilene deres med deres identitet.»

De sammenligner stilmimikk med identitetstyveri og sier at det hindrer aspirerende kunstnere til å lage nytt verk.

Teamet anbefaler at artister bruker både Nightshade og Glaze. For tiden må de to verktøyene lastes ned og installeres hver for seg, men en kombinert versjon er under utvikling. ®

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://go.theregister.com/feed/www.theregister.com/2024/01/20/nightshade_ai_images/

- : har

- :er

- :ikke

- 1

- 2023

- 8

- a

- Om oss

- faktisk

- tilpasse

- mot

- AI

- alberta

- påstår

- også

- an

- og

- ER

- Kunst

- artist

- Artister

- kunstverk

- AS

- håper

- Assistent

- Førsteamanuensis

- At

- angripe

- forfattere

- tilgjengelig

- bakgrunner

- grunnleggende

- Grunninntekt

- BE

- vært

- vegne

- være

- tro

- ben

- nytte

- uskarphet

- både

- grenser

- merke

- bredere

- bygget

- bedrifter

- men

- by

- som heter

- CAN

- fangst

- saken

- CAT

- forsiktighet

- Endringer

- Chicago

- hevder

- stengt

- CO

- kombinert

- provisjoner

- følgesvenn

- datamaskin

- informatikk

- konsept

- Vurder

- innhold

- innholdsskapere

- innholdseiere

- Kul

- kopier

- copyright

- skape

- skaperne

- cs

- dato

- defensiv

- beskriver

- utviklet

- forskjellig

- kringkasting

- direktiver

- do

- gjør

- Hund

- e

- hver enkelt

- sikre

- Eter (ETH)

- eksempel

- øyne

- Failure

- Februar

- felt

- Filer

- bedrifter

- Først

- Fisk

- flate

- Til

- fritt

- fra

- genererer

- få

- Gi

- blikk

- gress

- Grønn

- skadelig

- høsting

- Ha

- hjulpet

- HTML

- HTTPS

- menneskelig

- i

- Identitet

- identitetstyveri

- ignorere

- bilde

- bilder

- Påvirkning

- viktigere

- in

- Incentive

- inkludere

- Inntekt

- inkorporerer

- overtredelse

- intellektuell

- intellektuell eiendom

- tiltenkt

- med hensikt

- innebærer

- IT

- DET ER

- jpg

- juni

- Hold

- Etiketten

- stor

- i stor grad

- Siste

- I fjor

- Søksmålet

- læring

- Led

- mindre

- i likhet med

- begrensninger

- lister

- tap

- Lav

- maskin

- maskinlæring

- laget

- gjøre

- Makers

- Kan..

- midler

- Media

- MidJourney

- kunne

- millioner

- minimerer

- misbruk

- modell

- modeller

- mest

- må

- Ny

- varsling

- November

- nå

- Antall

- observere

- Åpenbare

- oktober

- of

- støtende

- tilbudt

- on

- på nett

- bare

- åpen kildekode

- optimalisering

- or

- rekkefølge

- original

- utfall

- eiere

- Fred

- Papir

- del

- spesielt

- for

- tillatelse

- tillatelsesløs

- plukking

- plato

- Platon Data Intelligence

- PlatonData

- giften

- mulig

- kraftig

- i dag

- forebygge

- behandlet

- produsere

- produserer

- Professor

- prosjekt

- eiendom

- beskytte

- beskyttelse

- gi

- lommebok

- kvalitet

- nådd

- motta

- anbefaler

- utgitt

- reproduksjon

- omdømme

- krever

- respekt

- svar

- ansvarlig

- rullebane

- s

- Sa

- sier

- spredt

- Vitenskap

- se

- Tjenester

- flere

- shawn

- bør

- signifikant

- betydelig

- lignende

- ganske enkelt

- glatter

- selskap

- sosiale medier

- Software

- løsning

- noen

- spesifikk

- spesielt

- Stabilitet

- stabil

- Tilstand

- Studenter

- stil

- stiler

- send

- syntetisk

- Systemer

- lag

- teknikker

- Det

- De

- tyveri

- deres

- de

- denne

- denne uka

- De

- selv om?

- Gjennom

- rettidig

- til

- verktøy

- verktøy

- Tog

- trent

- Kurs

- to

- universitet

- University of Chicago

- uforutsigbare

- bruke

- brukt

- nyttig

- Bruker

- bruker

- versjon

- veldig

- synlig

- visuell

- var

- Vei..

- web

- uke

- Hva

- når

- hvilken

- HVEM

- hvem

- hvem sin

- ønsker

- med

- uten

- Arbeid

- virker

- bekymring

- ville

- år

- zephyrnet

- Zhao