Josh Lospinosos første cybersecurity-oppstart ble kjøpt opp i 2017 av Raytheon/Forcepoint. Hans andre, Shift5, jobber med det amerikanske militæret, jernbaneoperatører og flyselskaper inkludert JetBlue. En 2009-utdannet West Point og Rhodes Scholar, den 36 år gamle tidligere hærkapteinen tilbrakte mer enn et tiår forfattere av hackingverktøy for National Security Agency og US Cyber Command.

Lospinoso fortalte nylig en underutvalg for væpnede tjenester i Senatet hvordan kunstig intelligens kan bidra til å beskytte militære operasjoner. Administrerende direktør/programmerer diskuterte emnet med The Associated Press også hvordan programvaresårbarheter i våpensystemer er en stor trussel mot det amerikanske militæret. Intervjuet er redigert for klarhet og lengde.

Spørsmål: I ditt vitnesbyrd beskrev du to hovedtrusler mot AI-aktiverte teknologier: Den ene er tyveri. Det er selvforklarende. Den andre er dataforgiftning. Kan du forklare det?

A: En måte å tenke på dataforgiftning er som digital desinformasjon. Hvis motstandere er i stand til å lage dataene som AI-aktiverte teknologier ser, kan de ha stor innvirkning på hvordan teknologien fungerer.

Spørsmål: Skjer dataforgiftning?

A: Vi ser det ikke bredt. Men det har skjedd. En av de mest kjente sakene skjedde i 2016. Microsoft ga ut en Twitter-chatbot den kalte Tay som lærte fra samtaler den hadde på nettet. Ondsinnede brukere konspirerte for å tweete støtende, støtende språk på den. Tay begynte å generere inflammatorisk innhold. Microsoft tok det offline.

Spørsmål: AI er ikke bare chatbots. Det har lenge vært en integrert del av cybersikkerhet, ikke sant?

A: AI brukes i e-postfiltre for å prøve å flagge og adskille søppelpost og phishing-lokker. Et annet eksempel er endepunkter, som antivirusprogrammet på den bærbare datamaskinen – eller programvare for oppdagelse av skadelig programvare som kjører på nettverk. Selvfølgelig bruker støtende hackere også AI for å prøve å beseire disse klassifiseringssystemene. Det kalles motstridende AI.

Spørsmål: La oss snakke om militære programvaresystemer. Et skremmende 2018 Rapport fra myndighetens ansvarlighetskontor sa at nesten alle nyutviklede våpensystemer hadde oppdragskritiske sårbarheter. Og Pentagon tenker på å sette AI inn i slike systemer?

A: Det er to problemer her. For det første må vi sikre eksisterende våpensystemer tilstrekkelig. Dette er en teknisk gjeld vi har som kommer til å ta veldig lang tid å betale. Så er det en ny grense for å sikre AI-algoritmer – nye ting som vi ville installere. GAO-rapporten snakket egentlig ikke om AI. Så glem AI et øyeblikk. Hvis disse systemene bare forble slik de er, er de fortsatt dypt sårbare.

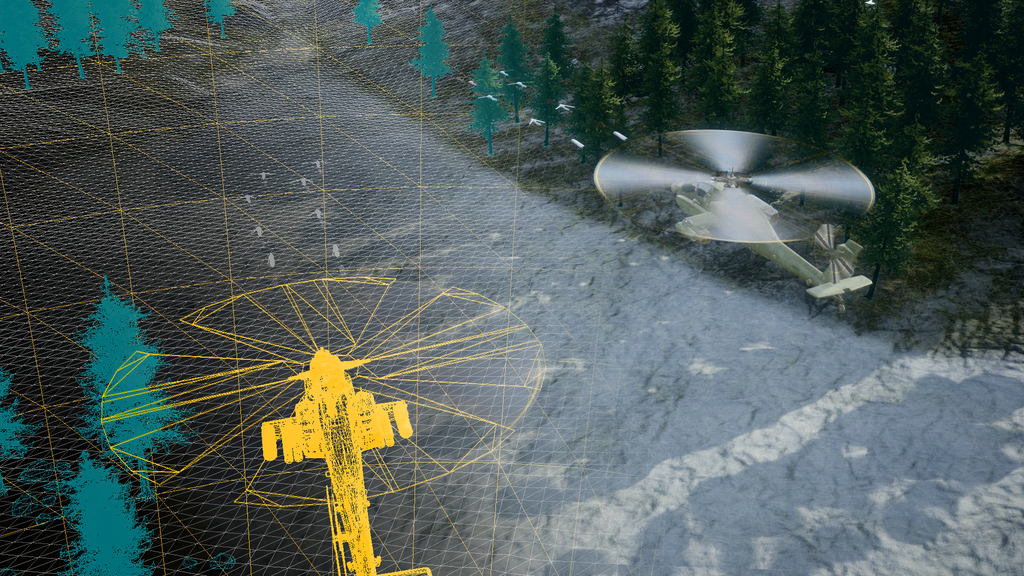

Vi diskuterer å forskyve rammen og legge til AI-aktiverte funksjoner for ting som forbedret vedlikehold og operasjonell intelligens. Alt flott. Men vi bygger på toppen av et korthus. Mange systemer er flere tiår gamle, ettermontert med digitale teknologier. Fly, bakkekjøretøyer, romressurser, ubåter. De er nå sammenkoblet. Vi bytter data inn og ut. Systemene er porøse, vanskelige å oppgradere og kan bli angrepet. Når en angriper får tilgang, er spillet over.

Noen ganger er det lettere å bygge en ny plattform enn å redesigne eksisterende systems digitale komponenter. Men det er en rolle for AI i å sikre disse systemene. AI kan brukes til å forsvare hvis noen prøver å kompromittere dem.

Spørsmål: Du vitnet om at å sette AI-forskning på pause, som noen har oppfordret til, ville være en dårlig idé fordi det ville favorisere Kina og andre konkurrenter. Men du er også bekymret for det hodestupe hastverket til AI-produkter. Hvorfor?

A: Jeg hater å høres fatalistisk ut, men den såkalte "brennende bruk"-saken ser ut til å gjelde. Et produkt som haste til markedet tar ofte fyr (blir hacket, feiler, gjør utilsiktet skade). Og vi sier: 'Gutt, vi burde ha bygget inn sikkerhet.' Jeg forventer at tempoet i AI-utviklingen vil akselerere, og vi vil kanskje ikke stoppe nok til å gjøre dette på en sikker og ansvarlig måte. Det hvite hus og kongressen diskuterer i det minste disse spørsmålene.

Spørsmål: Det virker som om en haug med selskaper – inkludert i forsvarssektoren – skynder seg å annonsere halvferdige AI-produkter.

A: Hvert teknologiselskap og mange ikke-teknologiske selskaper har gjort nesten en skurrende dreining mot AI. Økonomiske dislokasjoner kommer. Forretningsmodeller kommer til å endre seg fundamentalt. Dislokasjoner skjer allerede eller er i horisonten - og bedriftsledere prøver å ikke bli tatt på flatfot.

Spørsmål: Hva med bruken av kunstig intelligens i militære beslutninger som målretting?

A: Jeg tror ikke, kategorisk sett ikke, at kunstig intelligens-algoritmer – dataene vi samler inn – er klare for beste sendetid for et dødelig våpensystem for å ta avgjørelser. Vi er bare så langt unna det.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoAiStream. Web3 Data Intelligence. Kunnskap forsterket. Tilgang her.

- Minting the Future med Adryenn Ashley. Tilgang her.

- Kjøp og selg aksjer i PRE-IPO-selskaper med PREIPO®. Tilgang her.

- kilde: https://www.defensenews.com/artificial-intelligence/2023/05/29/adversarial-ai-a-threat-to-military-systems-shift5s-lospinoso-says/

- : har

- :er

- :ikke

- 2016

- 2017

- 2018

- 70

- a

- I stand

- Om oss

- akselerere

- adgang

- ansvarlighet

- ervervet

- legge

- tilstrekkelig

- motstandere

- byrå

- AI

- ai forskning

- luftfartøy

- Flyselskaper

- algoritmer

- Alle

- allerede

- også

- an

- og

- Kunngjøre

- En annen

- antivirus

- Påfør

- ER

- væpnet

- Army

- kunstig

- kunstig intelligens

- AS

- Eiendeler

- assosiert

- At

- dårlig

- BE

- fordi

- vært

- begynte

- bredt

- bygge

- Bygning

- bygget

- Bunch

- virksomhet

- men

- by

- som heter

- CAN

- evner

- Kort

- saken

- saker

- fanget

- endring

- chatbot

- chatbots

- Kina

- klarhet

- klassifisering

- Samle

- kommer

- Selskaper

- Selskapet

- konkurrenter

- komponenter

- kompromiss

- bekymringer

- Kongressen

- innhold

- samtaler

- kunne

- kurs

- lage

- kritisk

- cyber

- Cybersecurity

- dato

- Gjeld

- tiår

- tiår

- Beslutningstaking

- avgjørelser

- Forsvar

- beskrevet

- Gjenkjenning

- utviklet

- Utvikling

- digitalt

- diskutert

- diskutere

- desinformasjon

- do

- gjør

- enklere

- økonomisk

- emalje

- nok

- Hver

- eksempel

- eksisterende

- forvente

- Forklar

- mislykkes

- langt

- favorisere

- filtre

- Brann

- Først

- Til

- Tidligere

- fra

- Frontier

- fundamentalt

- inntjening

- spill

- GAO

- generere

- få

- skal

- flott

- Ground

- hacket

- hackere

- hacking

- HAD

- skjedde

- Skjer

- Hard

- Ha

- på hodet

- hjelpe

- her.

- hans

- horisont

- hus

- Hvordan

- HTTPS

- i

- Tanken

- if

- bilder

- Påvirkning

- forbedret

- in

- Inkludert

- installere

- integrert

- Intelligens

- sammenhengende

- Intervju

- inn

- saker

- IT

- jetBlue

- bare

- Språk

- laptop

- ledere

- lært

- minst

- Lengde

- i likhet med

- Lang

- lang tid

- laget

- vedlikehold

- større

- Making

- malware

- malware gjenkjenning

- mange

- marked

- Microsoft

- kunne

- Militær

- Oppdrag

- modeller

- mer

- oppkalt

- nasjonal

- nasjonal sikkerhet

- National Security Agency

- nesten

- Trenger

- nettverk

- Ny

- Ny plattform

- roman

- nå

- forekom

- of

- støtende

- Office

- offline

- ofte

- Gammel

- on

- gang

- ONE

- på nett

- opererer

- operasjonell

- Drift

- operatører

- or

- Annen

- ut

- enn

- Fred

- pause

- Betale

- Pentagon

- phishing

- Pivot

- plattform

- plato

- Platon Data Intelligence

- PlatonData

- Point

- trykk

- Prime

- Principal

- Produkt

- Produkter

- program

- beskytte

- Skyver

- Sette

- rail

- klar

- virkelig

- nylig

- redesign

- utgitt

- rapporterer

- forskning

- ansvarlig

- ikke sant

- Rolle

- jag

- s

- Sa

- sier

- sier

- Sekund

- sektor

- sikre

- sikring

- sikkerhet

- se

- se

- synes

- Senatet

- Tjenester

- bør

- So

- så langt

- Software

- noen

- Noen

- Lyd

- Rom

- brukt

- oppstart

- oppholdt seg

- Still

- underutvalg

- emne

- slik

- swapping

- system

- Systemer

- Ta

- Snakk

- rettet mot

- tech

- Tech Company

- Teknisk

- Technologies

- Teknologi

- vitnet

- vitnesbyrd

- enn

- Det

- De

- tyveri

- Dem

- deretter

- Der.

- Disse

- de

- ting

- tror

- tenker

- denne

- De

- trussel

- trusler

- tid

- til

- tok

- topp

- mot

- prøve

- tweet

- to

- oss

- oppgradering

- bruke

- brukt

- Brukere

- Kjøretøy

- veldig

- Sikkerhetsproblemer

- Sårbar

- var

- Vei..

- we

- Våpen

- VI VIL

- Vest

- Hva

- hvit

- White House

- hvorfor

- med

- virker

- ville

- du

- Din

- zephyrnet