Forfatter: Vitalik Buterin via Vitalik Buterin-bloggen

Spesiell takk til Worldcoin- og Modulus Labs-teamene, Xinyuan Sun, Martin Koeppelmann og Illia Polosukhin for tilbakemelding og diskusjon.

Mange mennesker i løpet av årene har stilt meg et lignende spørsmål: hva er det kryss mellom krypto og AI som jeg anser som det mest fruktbare? Det er et rimelig spørsmål: krypto og AI er de to viktigste dype (programvare) teknologitrendene det siste tiåret, og det føles bare som det må være en slags forbindelse mellom de to. Det er lett å komme opp med synergier på et overfladisk vibenivå: kryptodesentralisering kan balansere AI sentralisering, AI er ugjennomsiktig og krypto gir åpenhet, AI trenger data og blokkjeder er bra for lagring og sporing av data. Men i løpet av årene, når folk ba meg grave et nivå dypere og snakke om spesifikke applikasjoner, har svaret mitt vært skuffende: "ja, det er et par ting, men ikke så mye".

I de siste tre årene, med fremveksten av mye kraftigere AI i form av moderne LLM-er, og fremveksten av mye kraftigere krypto i form av ikke bare blokkjedeskaleringsløsninger, men også ZKPs, FHE, (to-parti og N-parti) MPC, jeg begynner å se denne endringen. Det er faktisk noen lovende anvendelser av AI inne i blokkjedeøkosystemer, eller AI sammen med kryptografi, selv om det er viktig å være forsiktig med hvordan AI brukes. En spesiell utfordring er: i kryptografi er åpen kildekode den eneste måten å gjøre noe virkelig sikkert på, men i AI er en modell (eller til og med dens treningsdata) åpen øker sterkt dens sårbarhet overfor kontroversiell maskinlæring angrep. Dette innlegget vil gå gjennom en klassifisering av forskjellige måter krypto + AI kan krysse, og utsiktene og utfordringene for hver kategori.

En oppsummering på høyt nivå av krypto+AI-kryss fra en uETH blogginnlegg. Men hva skal til for å faktisk realisere noen av disse synergiene i en konkret applikasjon?

De fire hovedkategoriene

AI er et veldig bredt konsept: du kan tenke på "AI" som settet med algoritmer du lager ikke ved å spesifisere dem eksplisitt, men snarere ved å røre en stor beregningssuppe og legge inn et slags optimaliseringspress som dytter suppen mot produsere algoritmer med de egenskapene du ønsker. Denne beskrivelsen bør definitivt ikke tas avvisende: den inkluderer de prosess Det opprettet oss mennesker i utgangspunktet! Men det betyr at AI-algoritmer har noen felles egenskaper: deres evne til å gjøre ting som er ekstremt kraftige, sammen med begrensninger i vår evne til å vite eller forstå hva som foregår under panseret.

Det er mange måter å kategorisere AI på; for formålet med dette innlegget, som snakker om interaksjoner mellom AI og blokkjeder (som har blitt beskrevet som en plattform for lage "spill"), vil jeg kategorisere det som følger:

- AI som spiller i et spill [høyest levedyktighet]: AIer som deltar i mekanismer der den ultimate kilden til insentivene kommer fra en protokoll med menneskelige input.

- AI som grensesnitt til spillet [høyt potensial, men med risiko]: AI hjelper brukere med å forstå kryptoverdenen rundt dem, og å sikre at deres oppførsel (dvs. signerte meldinger og transaksjoner) samsvarer med intensjonene deres og at de ikke blir lurt eller svindlet.

- AI som spillereglene [trå veldig forsiktig]: blokkkjeder, DAO-er og lignende mekanismer som kaller direkte inn AI-er. Tenk f.eks. "AI-dommere"

- AI som målet med spillet [langsiktig, men spennende]: designe blokkjeder, DAO-er og lignende mekanismer med mål om å konstruere og vedlikeholde en AI som kan brukes til andre formål, ved å bruke kryptobitene enten for å stimulere til trening bedre eller for å forhindre AI fra å lekke private data eller bli misbrukt.

La oss gå gjennom disse en etter en.

AI som spiller i et spill

Dette er faktisk en kategori som har eksistert i nesten et tiår, i hvert fall siden on-chain desentraliserte børser (DEXer) begynte å se betydelig bruk. Hver gang det er en utveksling, er det en mulighet til å tjene penger gjennom arbitrage, og roboter kan gjøre arbitrage mye bedre enn mennesker kan. Denne brukssaken har eksistert lenge, selv med mye enklere AIer enn det vi har i dag, men til syvende og sist er det et veldig ekte AI + kryptokryss. Nylig har vi sett MEV-arbitrasjeroboter ofte utnytter hverandre. Hver gang du har en blokkjedeapplikasjon som involverer auksjoner eller handel, kommer du til å ha arbitrasjeroboter.

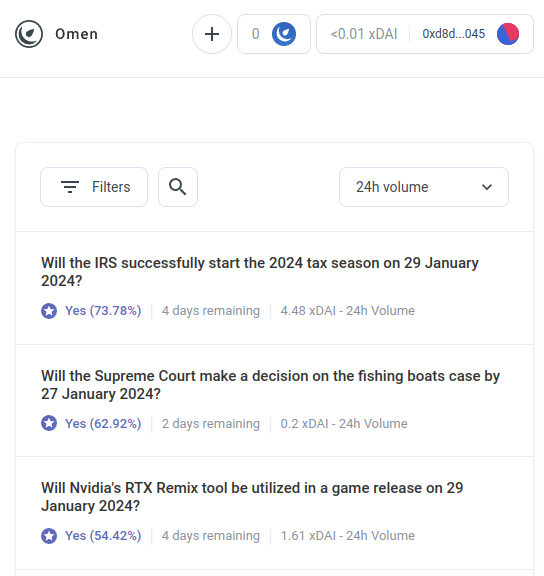

Men AI-arbitrasjeroboter er bare det første eksemplet på en mye større kategori, som jeg forventer snart vil begynne å inkludere mange andre applikasjoner. Møt AIOmen, en demo av et prediksjonsmarked der AI-er er spillere:

Et svar på dette er å peke på pågående UX-forbedringer i Polymarked eller andre nye prediksjonsmarkeder, og håper at de vil lykkes der tidligere iterasjoner har mislyktes. Tross alt, forteller historien, er folk villige til å satse titalls milliarder på sport, så hvorfor ville ikke folk kaste inn nok penger ved å satse på amerikanske valg eller LK99 at det begynner å gi mening at de seriøse aktørene begynner å komme inn? Men dette argumentet må kjempe med det faktum at, vel, tidligere iterasjoner ha klarte ikke å komme til dette skalanivået (i det minste sammenlignet med sine talsmenns drømmer), og så det virker som du trenger noe nytt for å få prediksjonsmarkedene til å lykkes. Og så en annen respons er å peke på ett spesifikt trekk ved prognosemarkedsøkosystemer som vi kan forvente å se på 2020-tallet som vi ikke så på 2010-tallet: muligheten for allestedsnærværende deltakelse fra AIer.

AI-er er villige til å jobbe for mindre enn $1 per time, og har kunnskap om et leksikon – og hvis det ikke er nok, kan de til og med integreres med nettsøk i sanntid. Hvis du lager et marked, og legger opp til et likviditetstilskudd på $50, vil ikke mennesker bry seg nok til å by, men tusenvis av AI-er vil lett sverme over hele spørsmålet og gjette det beste de kan. Incitamentet til å gjøre en god jobb på ethvert spørsmål kan være lite, men insentivet til å lage en AI som gir gode spådommer generelt kan være i millioner. Merk at potensielt, du trenger ikke engang menneskene til å bedømme de fleste spørsmål: du kan bruke et flerrundt tvistesystem som ligner på augur eller Kleros, hvor AIer også ville være de som deltok i tidligere runder. Mennesker trenger bare å reagere i de få tilfellene der en rekke eskaleringer har funnet sted og store mengder penger har blitt begått av begge sider.

Dette er en kraftig primitiv, fordi når et "prediksjonsmarked" kan fås til å fungere i en slik mikroskopisk skala, kan du gjenbruke "prediksjonsmarkedet"-primitiven for mange andre typer spørsmål:

- Er dette innlegget på sosiale medier akseptabelt under [bruksvilkårene]?

- Hva vil skje med prisen på aksje X (se f.eks Numerai)

- Er denne kontoen som sender meg meldinger for øyeblikket, faktisk Elon Musk?

- Er denne arbeidsinnleveringen på en online oppgavemarkedsplass akseptabel?

- Er dappen på https://examplefinance.network en svindel?

- Is

0x1b54....98c3faktisk adressen til "Casinu Inu" ERC20-tokenet?

Du legger kanskje merke til at mange av disse ideene går i retning av det jeg kalte "info forsvar"i . Bredt definert er spørsmålet: hvordan hjelper vi brukere med å skille sann og usann informasjon og oppdage svindel, uten å gi en sentralisert autoritet mulighet til å bestemme rett og galt hvem som da kan misbruke denne posisjonen? På mikronivå kan svaret være "AI". Men på makronivå er spørsmålet: hvem bygger AI? AI er en refleksjon av prosessen som skapte den, og kan derfor ikke unngå å ha skjevheter. Derfor er det behov for et spill på høyere nivå som avgjør hvor godt de forskjellige AI-ene gjør det, der AI-er kan delta som spillere i spillet.

Denne bruken av AI, der AI-er deltar i en mekanisme der de til slutt blir belønnet eller straffet (sannsynligvis) av en kjedemekanisme som samler inn input fra mennesker (kall det desentralisert markedsbasert RLHF?), er noe jeg synes er virkelig verdt å se nærmere på. Nå er det rette tidspunktet for å se nærmere på brukstilfeller som dette, fordi blokkjedeskalering endelig lykkes, noe som gjør "mikro-" noe til slutt levedyktig på kjeden når det ofte ikke var før.

En relatert kategori av applikasjoner går i retning av svært autonome agenter bruke blokkjeder for å bedre samarbeide, enten gjennom betalinger eller ved å bruke smarte kontrakter for å gjøre troverdige forpliktelser.

AI som et grensesnitt til spillet

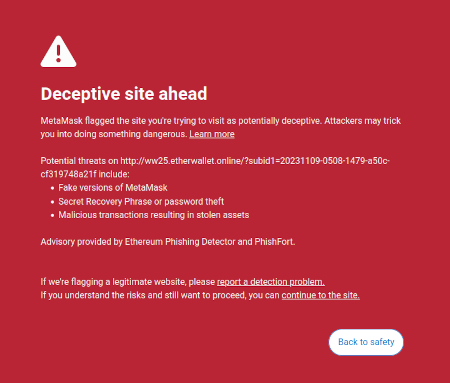

En idé som jeg tok opp i min skrifter på er ideen om at det er en markedsmulighet for å skrive brukervendt programvare som vil beskytte brukernes interesser ved å tolke og identifisere farer i den elektroniske verden som brukeren navigerer i. Et allerede eksisterende eksempel på dette er Metamask sin svindeldeteksjonsfunksjon:

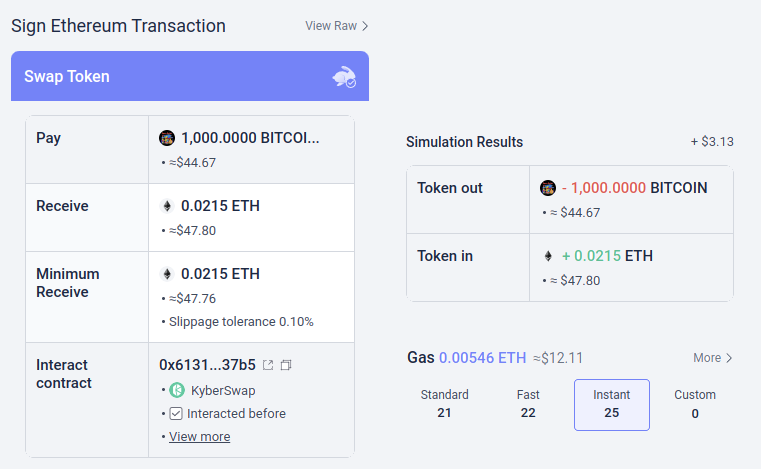

Potensielt kan denne typen verktøy bli superladet med AI. AI kan gi en mye rikere menneskevennlig forklaring på hva slags dapp du deltar i, konsekvensene av mer kompliserte operasjoner som du signerer, om et bestemt token er ekte eller ikke (f.eks. BITCOIN er ikke bare en streng med tegn, det er navnet på en faktisk kryptovaluta, som ikke er et ERC20-token og som har en pris som er høyere enn $0.045, og en moderne LLM ville vite det), og så videre. Det er prosjekter som begynner å gå helt ut i denne retningen (f.eks LangChain lommebok, som bruker AI som en primære grensesnitt). Min egen mening er at rene AI-grensesnitt sannsynligvis er for risikabelt for øyeblikket da det øker risikoen for annen typer feil, men AI som komplementerer et mer konvensjonelt grensesnitt blir veldig levedyktig.

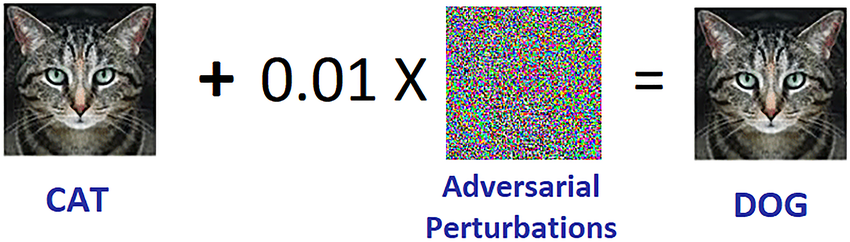

Det er en spesiell risiko som er verdt å nevne. Jeg vil komme mer inn på dette i avsnittet om "AI som spilleregler" nedenfor, men det generelle problemet er motstridende maskinlæring: hvis en bruker har tilgang til en AI-assistent inne i en åpen kildekode-lommebok, vil de slemme gutta også ha tilgang til den AI-assistenten, og så vil de ha ubegrensede muligheter til å optimalisere svindelene sine for ikke å utløse den lommebokens forsvar. Alle moderne AI-er har feil et sted, og det er ikke for vanskelig for en treningsprosess, selv en med bare begrenset tilgang til modellen, for å finne dem.

Det er her "AI-er som deltar i mikromarkeder i kjeden" fungerer bedre: hver enkelt AI er sårbar for de samme risikoene, men du skaper med vilje et åpent økosystem med dusinvis av mennesker som stadig itererer og forbedrer dem på en kontinuerlig basis. Videre er hver enkelt AI lukket: sikkerheten til systemet kommer fra åpenheten til reglene for spill, ikke den interne funksjonen til hver enkelt spiller.

Sammendrag: AI kan hjelpe brukere med å forstå hva som skjer på vanlig språk, den kan fungere som en sanntidsveileder, den kan beskytte brukere mot feil, men bli advart når du prøver å bruke den direkte mot ondsinnede feilinformere og svindlere.

AI som spillereglene

Nå kommer vi til applikasjonen som mange mennesker er begeistret for, men som jeg tror er den mest risikable, og hvor vi må trå mest forsiktig: det jeg kaller AI er å være en del av spillereglene. Dette knytter seg til begeistring blant mainstream politiske eliter om "AI-dommere" (se f.eks denne artikkelen på nettstedet til "World Government Summit"), og det er analoger av disse ønskene i blokkjedeapplikasjoner. Hvis en blokkjedebasert smart kontrakt eller en DAO trenger å ta en subjektiv avgjørelse (er f.eks. et bestemt arbeidsprodukt akseptabelt i en arbeid-for-hire-kontrakt? Hvilken er den riktige tolkningen av en naturlig språkkonstitusjon som Optimismen Lov om kjeder?), kan du få en AI til å være en del av kontrakten eller DAO for å hjelpe til med å håndheve disse reglene?

Dette er hvor kontroversiell maskinlæring kommer til å bli en ekstremt tøff utfordring. Det grunnleggende argumentet med to setninger hvorfor er som følger:

Hvis en AI-modell som spiller en nøkkelrolle i en mekanisme er lukket, kan du ikke verifisere dens indre funksjoner, og derfor er den ikke bedre enn en sentralisert applikasjon. Hvis AI-modellen er åpen, kan en angriper laste ned og simulere den lokalt, og designe sterkt optimaliserte angrep for å lure modellen, som de deretter kan spille av på live-nettverket.

Nå kan hyppige lesere av denne bloggen (eller innbyggere av kryptooverveien) kanskje allerede gå foran meg og tenke: men vent! Vi har fancy null kunnskapsbevis og andre virkelig kule former for kryptografi. Vi kan sikkert gjøre litt krypto-magi, og skjule den indre funksjonen til modellen slik at angripere ikke kan optimalisere angrep, men samtidig bevise at modellen blir utført på riktig måte, og ble konstruert ved hjelp av en rimelig treningsprosess på et rimelig sett med underliggende data!

Normalt er dette nøyaktig den type tenkning som jeg forfekter både på denne bloggen og i mine andre skrifter. Men når det gjelder AI-relatert beregning, er det to store innvendinger:

- Kryptografisk overhead: det er mye mindre effektivt å gjøre noe inne i en SNARK (eller MPC eller ...) enn det er å gjøre det "i det klare". Gitt at AI allerede er veldig beregningsintensiv, er det da til og med beregningsmessig levedyktig å gjøre AI inne i kryptografiske svarte bokser?

- Black-box-motstridende maskinlæringsangrep: det finnes måter å optimalisere angrep mot AI-modeller på selv uten å vite så mye om modellens interne virkemåte. Og hvis du gjemmer deg for mye, risikerer du å gjøre det for enkelt for den som velger treningsdataene å korrumpere modellen med forgiftning angrep.

Begge disse er kompliserte kaninhull, så la oss komme inn på hver av dem etter tur.

Kryptografisk overhead

Kryptografiske gadgets, spesielt generelle som ZK-SNARKs og MPC, har høye kostnader. En Ethereum-blokk tar noen hundre millisekunder for en klient å verifisere direkte, men å generere en ZK-SNARK for å bevise riktigheten til en slik blokk kan ta timer. Den typiske overheaden til andre kryptografiske gadgets, som MPC, kan være enda verre. AI-beregning er allerede dyrt: de kraftigste LLM-ene kan skrive ut enkeltord bare litt raskere enn mennesker kan lese dem, for ikke å nevne beregningskostnadene på mange millioner dollar. trening modellene. Kvalitetsforskjellen mellom toppmodellene og modellene som prøver å spare mye mer på treningskostnad or parameterantall er stor. Ved første øyekast er dette en veldig god grunn til å være mistenksom overfor hele prosjektet med å prøve å legge til garantier til AI ved å pakke det inn i kryptografi.

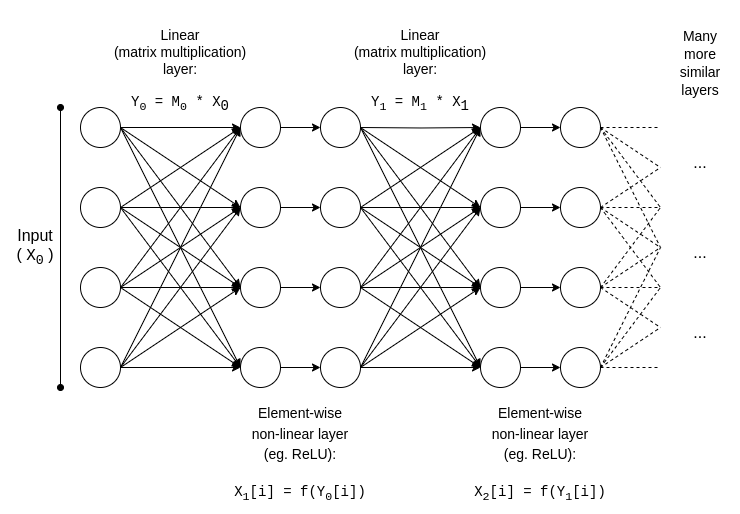

Heldigvis, skjønt, AI er en veldig spesifikk type av beregning, noe som gjør den tilgjengelig for alle typer optimaliseringer som mer "ustrukturerte" typer beregninger som ZK-EVMer ikke kan dra nytte av. La oss undersøke den grunnleggende strukturen til en AI-modell:

y = max(x, 0)). Asymptotisk tar matrisemultiplikasjoner opp det meste av arbeidet: å multiplisere to N*N matriser tar �(�2.8) tid, mens antallet ikke-lineære operasjoner er mye mindre. Dette er veldig praktisk for kryptografi, fordi mange former for kryptografi kan utføre lineære operasjoner (som matrisemultiplikasjoner er, i det minste hvis du krypterer modellen, men ikke inngangene til den) nesten "gratis"..

Hvis du er en kryptograf, har du sannsynligvis allerede hørt om et lignende fenomen i sammenheng med homomorf kryptering: utfører tilleggene på krypterte chiffertekster er veldig enkelt, men multiplikasjoner er utrolig vanskelige, og vi fant ikke ut noen måte å gjøre det på med ubegrenset dybde før i 2009.

For ZK-SNARKs er det tilsvarende protokoller som denne fra 2013, som viser en mindre enn 4x overhead på å bevise matrisemultiplikasjoner. Dessverre ender overheaden på de ikke-lineære lagene fortsatt opp med å være betydelig, og de beste implementeringene i praksis viser overhead på rundt 200x. Men det er håp om at dette kan reduseres kraftig gjennom videre forskning; se denne presentasjonen fra Ryan Cao for en nylig tilnærming basert på GKR, og min egen forenklet forklaring på hvordan hovedkomponenten i GKR fungerer.

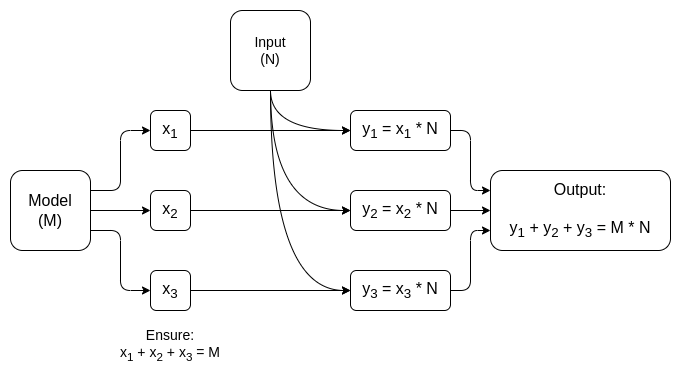

Men for mange applikasjoner vil vi ikke bare bevise at en AI-utgang ble beregnet riktig, ønsker vi også skjule modellen. Det er naive tilnærminger til dette: du kan dele opp modellen slik at et annet sett med servere redundant lagrer hvert lag, og håper at noen av serverne som lekker noen av lagene ikke lekker for mye data. Men det finnes også overraskende effektive former for spesialisert flerpartsberegning.

I begge tilfeller er moralen i historien den samme: den største delen av en AI-beregning er matrisemultiplikasjoner, som det er mulig å gjøre veldig effektiv ZK-SNARK-er eller MPC-er (eller til og med FHE), og derfor er den totale overheaden ved å plassere AI i kryptografiske bokser overraskende lav. Generelt er det de ikke-lineære lagene som er den største flaskehalsen til tross for deres mindre størrelse; kanskje nyere teknikker som oppslagsargumenter kan hjelpe.

Black-box motstandsdyktig maskinlæring

La oss nå komme til det andre store problemet: hvilke typer angrep du kan gjøre selv om innholdet i modellen holdes privat og du har kun "API-tilgang" til modellen. Siterer en papir fra 2016:

Mange maskinlæringsmodeller er sårbare for motstridende eksempler: input som er spesielt laget for å få en maskinlæringsmodell til å produsere feil utdata. Motstridende eksempler som påvirker en modell påvirker ofte en annen modell, selv om de to modellene har forskjellige arkitekturer eller ble trent på forskjellige treningssett, så lenge begge modellene ble opplært til å utføre samme oppgave. En angriper kan derfor trene opp sin egen vikarmodell, lage motstandseksempler mot vikaren og overføre dem til en offermodell, med svært lite informasjon om offeret.

Potensielt kan du til og med lage angrep vel vitende bare treningsdataene, selv om du har svært begrenset eller ingen tilgang til modellen du prøver å angripe. Fra og med 2023 fortsetter denne typen angrep å være et stort problem.

For å effektivt begrense denne typen black-box-angrep, må vi gjøre to ting:

- Really begrense hvem eller hva som kan spørre etter modellen og hvor mye. Svarte bokser med ubegrenset API-tilgang er ikke sikre; svarte bokser med svært begrenset API-tilgang kan være.

- Skjul treningsdataene, samtidig som du bevarer selvtilliten at prosessen som brukes til å lage treningsdataene ikke er ødelagt.

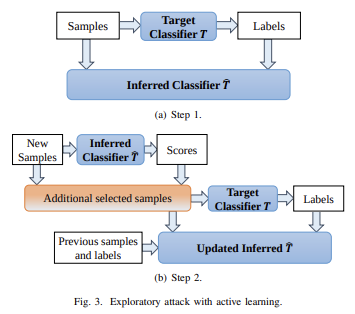

Prosjektet som har gjort mest på førstnevnte er kanskje Worldcoin, hvorav jeg analyserer en tidligere versjon (blant andre protokoller) grundig her.. Worldcoin bruker AI-modeller mye på protokollnivå, for å (i) konvertere irisskanninger til korte "iriskoder" som er enkle å sammenligne for likhet, og (ii) bekrefte at tingen den skanner faktisk er et menneske. Det viktigste forsvaret som Worldcoin er avhengig av er det faktum at den lar ikke noen bare ringe inn AI-modellen: snarere bruker den pålitelig maskinvare for å sikre at modellen bare aksepterer innganger digitalt signert av kulens kamera.

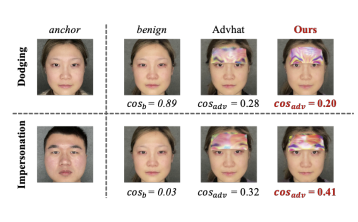

Denne tilnærmingen er ikke garantert å fungere: det viser seg at du kan gjøre motstridende angrep mot biometrisk AI som kommer i form av fysiske lapper eller smykker som du kan sette på ansiktet ditt:

Men håpet er at hvis du kombinere alle forsvarene sammen, skjuler selve AI-modellen, begrenser antallet spørringer sterkt og krever at hver spørring på en eller annen måte autentiseres, kan du motstridende angrep vanskelig nok til at systemet kan være sikkert.

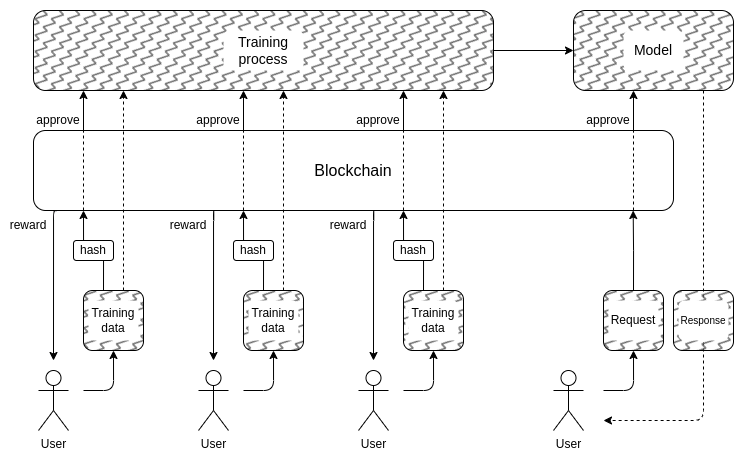

Og dette får oss til den andre delen: hvordan kan vi skjule treningsdataene? Dette er hvor "DAOs for demokratisk styre AI" kan faktisk være fornuftig: vi kan lage en on-chain DAO som styrer prosessen for hvem som har lov til å sende inn treningsdata (og hvilke attester som kreves på selve dataene), hvem som har lov til å stille spørsmål, og hvor mange, og bruke kryptografiske teknikker som MPC for å kryptere hele pipelinen for å lage og kjøre AI fra hver enkelt brukers treningsinngang hele veien til den endelige utgangen av hver spørring. Denne DAO kan samtidig tilfredsstille det svært populære målet om å kompensere folk for å sende inn data.

- Kryptografisk overhead kan fortsatt bli for høyt for at denne typen fullstendig svart-boks-arkitektur skal være konkurransedyktig med tradisjonelle lukkede "stoler på meg"-tilnærminger.

- Det kan det vise seg det er ingen god måte å gjøre innsendingsprosessen for opplæringsdata desentralisert og beskyttet mot forgiftningsangrep.

- Beregningsdingser fra flere parter kan gå i stykker deres sikkerhet eller personverngarantier pga deltakere som samarbeider: Tross alt har dette skjedd med krysskjedede kryptovalutabroer en gang til og en gang til.

En grunn til at jeg ikke startet denne delen med flere store røde advarselsetiketter som sa "Ikke GJØR AI-DØMMER, DET ER DYSTOPISK", er at samfunnet vårt allerede er svært avhengig av uansvarlige sentraliserte AI-dommere: algoritmene som bestemmer hvilke typer innlegg og politiske meninger blir boostet og deboostet, eller til og med sensurert, på sosiale medier. Jeg tror det utvider denne trenden videre på dette stadiet er en ganske dårlig idé, men jeg tror ikke det er noen stor sjanse for det blockchain-fellesskapet eksperimenterer med AI er mer vil være det som bidrar til å gjøre det verre.

Faktisk er det noen ganske grunnleggende lavrisiko-måter som kryptoteknologi kan gjøre selv disse eksisterende sentraliserte systemene bedre som jeg er ganske sikker på. En enkel teknikk er verifisert AI med forsinket publisering: når et nettsted på sosiale medier lager en AI-basert rangering av innlegg, kan det publisere en ZK-SNARK som beviser hasjen til modellen som genererte den rangeringen. Nettstedet kan forplikte seg til å avsløre sine AI-modeller etter f.eks. ett års forsinkelse. Når en modell er avslørt, kan brukere sjekke hashen for å bekrefte at den riktige modellen ble utgitt, og fellesskapet kan kjøre tester på modellen for å bekrefte at den er rettferdig. Publiseringsforsinkelsen vil sikre at når modellen blir avslørt, er den allerede utdatert.

Så sammenlignet med sentralisert verden, spørsmålet er ikke if vi kan gjøre det bedre, men med hvor mye. For desentralisert verden, men det er viktig å være forsiktig: hvis noen bygger f.eks. et prediksjonsmarked eller en stablecoin som bruker et AI-orakel, og det viser seg at oraklet kan angripes, det er en enorm sum penger som kan forsvinne på et øyeblikk.

AI som målet med spillet

Hvis teknikkene ovenfor for å lage en skalerbar desentralisert privat AI, hvis innhold er en svart boks som ikke er kjent av noen, faktisk kan fungere, kan dette også brukes til å lage AI-er med nytte som går utover blokkjeder. NEAR-protokollteamet gjør dette til en hovedmålet for deres pågående arbeid.

Det er to grunner til å gjøre dette:

- Hvis du kan gjøre "pålitelige black-box AI-er” ved å kjøre opplærings- og slutningsprosessen ved å bruke en kombinasjon av blokkjeder og MPC, så kan mange applikasjoner der brukere er bekymret for at systemet er partisk eller jukse dem dra nytte av det. Mange har uttrykt ønske om demokratisk styresett av systemviktige AI-er som vi vil være avhengige av; kryptografiske og blokkjedebaserte teknikker kan være en vei mot å gjøre det.

- Fra en AI-sikkerhet perspektiv, ville dette være en teknikk for å lage en desentralisert AI som også har en naturlig drepebryter, og som kan begrense spørringer som søker å bruke AI for ondsinnet oppførsel.

Det er også verdt å merke seg at "å bruke kryptoinsentiver for å stimulere til å lage bedre AI" kan gjøres uten å gå ned i hele kaninhullet med å bruke kryptografi for å fullstendig kryptere det: tilnærminger som BitTensor faller inn i denne kategorien.

Konklusjoner

Nå som både blokkjeder og AI-er blir kraftigere, er det et økende antall brukstilfeller i skjæringspunktet mellom de to områdene. Noen av disse brukstilfellene gir imidlertid mye mer mening og er mye mer robuste enn andre. Generelt bruk tilfeller der den underliggende mekanismen fortsetter å være utformet omtrent som før, men individet spillere bli AI-er, som lar mekanismen fungere effektivt i mye mer mikroskala, er de mest umiddelbart lovende og de enkleste å få til.

Det mest utfordrende å få riktig er applikasjoner som prøver å bruke blokkjeder og kryptografiske teknikker for å lage en "singleton": en enkelt desentralisert pålitelig AI som noen applikasjoner vil stole på for et eller annet formål. Disse applikasjonene har løfter, både for funksjonalitet og for å forbedre AI-sikkerheten på en måte som unngår sentraliseringsrisikoen forbundet med mer vanlige tilnærminger til dette problemet. Men det er også mange måter de underliggende forutsetningene kan svikte på; derfor er det verdt å trå forsiktig, spesielt når du distribuerer disse applikasjonene i høyverdi- og høyrisikosammenhenger.

Jeg ser frem til å se flere forsøk på konstruktive brukstilfeller av AI i alle disse områdene, slik at vi kan se hvilke av dem som virkelig er levedyktige i stor skala.

Forfatter: Vitalik Buterin

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- BlockOffsets. Modernisering av eierskap for miljøkompensasjon. Tilgang her.

- kilde: Platon Data Intelligence.