Het belang van datawarehouses en analyses uitgevoerd op datawarehouse-platforms is in de loop der jaren gestaag toegenomen, waarbij veel bedrijven op deze systemen zijn gaan vertrouwen als bedrijfskritisch voor zowel operationele besluitvorming op korte termijn als strategische planning op lange termijn. Traditioneel worden datawarehouses in batchcycli vernieuwd, bijvoorbeeld maandelijks, wekelijks of dagelijks, zodat bedrijven er verschillende inzichten uit kunnen halen.

Veel organisaties realiseren zich dat bijna-realtime data-opname in combinatie met geavanceerde analyses nieuwe kansen biedt. Een financiële instelling kan bijvoorbeeld voorspellen of een creditcardtransactie frauduleus is door een afwijkingsdetectieprogramma in bijna realtime-modus uit te voeren in plaats van in batchmodus.

In dit bericht laten we zien hoe Amazon roodverschuiving kan streaming-opname en machine learning (ML)-voorspellingen leveren, allemaal op één platform.

Amazon Redshift is een snel, schaalbaar, veilig en volledig beheerd datawarehouse in de cloud dat het eenvoudig en kosteneffectief maakt om al je gegevens te analyseren met behulp van standaard SQL.

Amazon RedshiftML maakt het voor data-analisten en database-ontwikkelaars gemakkelijk om ML-modellen te maken, te trainen en toe te passen met behulp van bekende SQL-opdrachten in Amazon Redshift-datawarehouses.

We zijn verheugd om te lanceren Amazon Redshift streaming-opname For Amazon Kinesis-gegevensstromen en Amazon Managed Streaming voor Apache Kafka (Amazon MSK), waarmee u gegevens rechtstreeks vanuit een Kinesis-gegevensstroom of Kafka-onderwerp kunt opnemen zonder de gegevens in Amazon eenvoudige opslagservice (Amazone S3). Met Amazon Redshift-streamingopname kunt u een lage latentie in de orde van seconden bereiken terwijl u honderden megabytes aan gegevens in uw datawarehouse opneemt.

Dit bericht laat zien hoe Amazon Redshift, het datawarehouse in de cloud, je in staat stelt bijna-realtime ML-voorspellingen te maken door gebruik te maken van Amazon Redshift streaming-opname en Redshift ML-functies met bekende SQL-taal.

Overzicht oplossingen

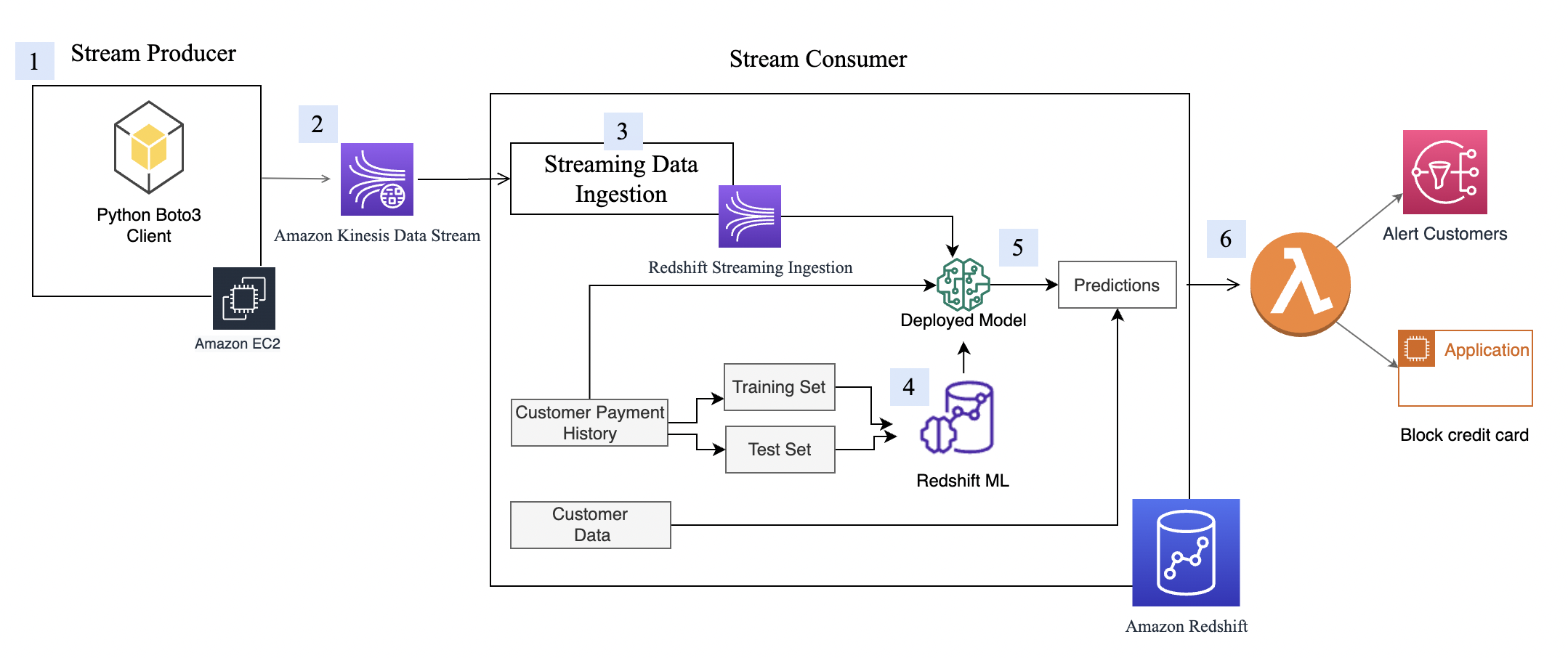

Door de stappen in dit bericht te volgen, kun je een producer streamer-applicatie opzetten op een Amazon Elastic Compute-cloud (Amazon EC2) instantie die creditcardtransacties simuleert en gegevens in realtime naar Kinesis Data Streams pusht. U stelt een gematerialiseerde weergave van Amazon Redshift Streaming Ingestion in op Amazon Redshift, waar streaminggegevens worden ontvangen. Je traint en bouwt een Redshift ML-model om real-time gevolgtrekkingen te genereren tegen de streaminggegevens.

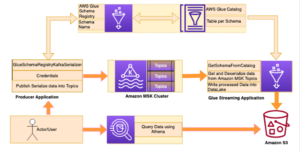

Het volgende diagram illustreert de architectuur en de processtroom.

Het stapsgewijze proces is als volgt:

- De EC2-instantie simuleert een toepassing voor creditcardtransacties, die creditcardtransacties in de Kinesis-gegevensstroom invoegt.

- De gegevensstroom slaat de inkomende creditcardtransactiegegevens op.

- Er wordt een gematerialiseerde weergave van Amazon Redshift Streaming Ingestion gemaakt bovenop de gegevensstroom, die automatisch streaminggegevens opneemt in Amazon Redshift.

- Je bouwt, traint en implementeert een ML-model met behulp van Redshift ML. Het Redshift ML-model is getraind met behulp van historische transactiegegevens.

- Je transformeert de streaming data en genereert ML-voorspellingen.

- U kunt klanten waarschuwen of de toepassing bijwerken om risico's te beperken.

Deze walkthrough maakt gebruik van streaminggegevens voor creditcardtransacties. De creditcardtransactiegegevens zijn fictief en zijn gebaseerd op een simulator. De klantgegevensset is ook fictief en wordt gegenereerd met enkele willekeurige gegevensfuncties.

Voorwaarden

- Een Amazon Redshift-cluster maken.

- Configureer het cluster voor het gebruik van Redshift ML.

- creëren an AWS Identiteits- en toegangsbeheer (IAM) gebruiker.

- Werk de IAM-rol bij die is gekoppeld aan het Redshift-cluster om machtigingen op te nemen voor toegang tot de Kinesis-gegevensstroom. Voor meer informatie over het vereiste beleid, zie Aan de slag met streaming-opname.

- Maak een m5.4xlarge EC2-instantie. We hebben de Producer-applicatie getest met de m5.4xlarge-instantie, maar het staat u vrij om een ander instantietype te gebruiken. Gebruik bij het maken van de instantie de amzn2-ami-kernel-5.10-hvm-2.0.20220426.0-x86_64-gp2 VRIEND.

- Om ervoor te zorgen dat Python3 is geïnstalleerd in de EC2-instantie, voert u de volgende opdracht uit om uw Python-versie te verifiëren (merk op dat het script voor gegevensextractie alleen werkt op Python 3):

- Installeer de volgende afhankelijke pakketten om het simulatorprogramma uit te voeren:

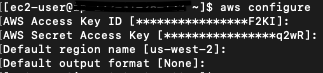

- Configureer Amazon EC2 met behulp van de variabelen zoals AWS-referenties die zijn gegenereerd voor IAM-gebruikers die in stap 3 hierboven zijn gemaakt. De volgende schermafbeelding toont een voorbeeld met behulp van aws configureren.

Stel Kinesis-gegevensstromen in

Amazon Kinesis Data Streams is een enorm schaalbare en duurzame real-time datastreamingservice. Het kan continu gigabytes aan gegevens per seconde vastleggen uit honderdduizenden bronnen, zoals website-clickstreams, database-eventstreams, financiële transacties, social media-feeds, IT-logboeken en locatietracking-gebeurtenissen. De verzamelde gegevens zijn beschikbaar in milliseconden om real-time analytische gebruiksscenario's mogelijk te maken, zoals real-time dashboards, real-time afwijkingsdetectie, dynamische prijzen en meer. We gebruiken Kinesis Data Streams omdat het een serverloze oplossing is die kan worden geschaald op basis van gebruik.

Een Kinesis-gegevensstroom maken

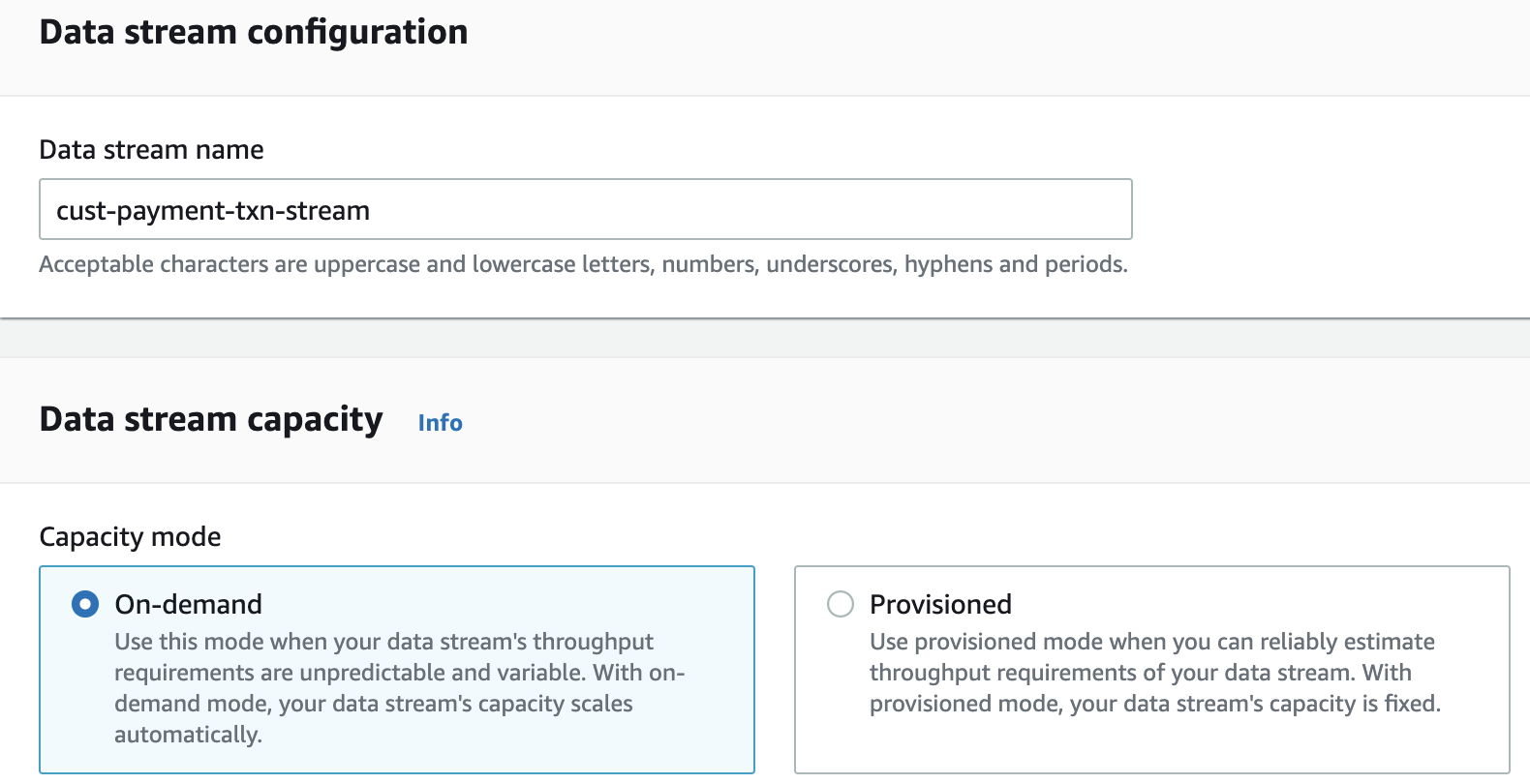

Eerst moet u een Kinesis-gegevensstroom maken om de streaminggegevens te ontvangen:

- Kies op de Amazon Kinesis-console Gegevensstromen in het navigatievenster.

- Kies Maak een datastroom.

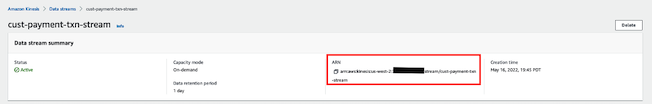

- Voor Naam gegevensstroom, ga naar binnen

cust-payment-txn-stream. - Voor Capaciteitsmodusselecteer Op aanvraag.

- Kies voor de rest van de opties de standaardopties en volg de aanwijzingen om de installatie te voltooien.

- Leg de ARN vast voor de gemaakte gegevensstroom om te gebruiken in de volgende sectie bij het definiëren van uw IAM-beleid.

Machtigingen instellen

Om ervoor te zorgen dat een streamingtoepassing naar Kinesis-gegevensstromen kan schrijven, moet de toepassing toegang hebben tot Kinesis. U kunt de volgende beleidsverklaring gebruiken om het simulatorproces dat u in de volgende sectie instelt toegang te verlenen tot de gegevensstroom. Gebruik de ARN van de gegevensstroom die u in de vorige stap hebt opgeslagen.

Configureer de streamproducent

Voordat we streaminggegevens in Amazon Redshift kunnen consumeren, hebben we een streaminggegevensbron nodig die gegevens naar de Kinesis-gegevensstroom schrijft. Dit bericht maakt gebruik van een op maat gemaakte gegevensgenerator en de AWS SDK voor Python (Boto3) om de gegevens naar de gegevensstroom te publiceren. Raadpleeg voor installatie-instructies Producer-simulator. Dit simulatorproces publiceert streaminggegevens naar de gegevensstroom die in de vorige stap is gemaakt (cust-payment-txn-stream).

Configureer de streamconsument

In dit gedeelte wordt gesproken over het configureren van de streamconsument (de Amazon Redshift streaming-opnameweergave).

Amazon Redshift Streaming Ingestion zorgt voor low-latency, high-speed opname van streaming data van Kinesis Data Streams in een Amazon Redshift gematerialiseerde weergave. U kunt uw Amazon Redshift-cluster configureren om streaming-opname mogelijk te maken en een gerealiseerde weergave te maken met automatisch vernieuwen, met behulp van SQL-instructies, zoals beschreven in Gematerialiseerde weergaven maken in Amazon Redshift. Het automatisch gerealiseerde weergavevernieuwingsproces zal streaminggegevens met honderden megabytes aan gegevens per seconde van Kinesis Data Streams opnemen in Amazon Redshift. Dit resulteert in snelle toegang tot externe gegevens die snel worden ververst.

Nadat u de gerealiseerde weergave hebt gemaakt, hebt u toegang tot uw gegevens vanuit de gegevensstroom met behulp van SQL en kunt u uw gegevenspijplijnen vereenvoudigen door rechtstreeks boven op de stroom gerealiseerde weergaven te maken.

Voer de volgende stappen uit om een Amazon Redshift streaming gematerialiseerde weergave te configureren:

- Kies beleid in het navigatievenster op de IAM-console.

- Kies Maak beleid.

- Maak een nieuw IAM-beleid met de naam

KinesisStreamPolicy. Zie voor de definitie van het streamingbeleid Aan de slag met streaming-opname. - Kies in het navigatievenster rollen.

- Kies Rol maken.

- kies AWS-service En kies Roodverschuiving en roodverschuiving aanpasbaar.

- Maak een nieuwe rol aan met de naam

redshift-streaming-roleen voeg het beleid toeKinesisStreamPolicy. - Maak een extern schema om toe te wijzen aan Kinesis-gegevensstromen:

Nu kunt u een gerealiseerde weergave maken om de streamgegevens te gebruiken. U kunt het gegevenstype SUPER gebruiken om de payload op te slaan zoals deze is, in JSON-indeling, of Amazon Redshift JSON-functies gebruiken om de JSON-gegevens in afzonderlijke kolommen te ontleden. Voor dit bericht gebruiken we de tweede methode omdat het schema goed gedefinieerd is.

- Maak de gematerialiseerde weergave voor streamingopname

cust_payment_tx_stream. Door AUTO REFRESH YES op te geven in de volgende code, kunt u automatisch vernieuwen van de streaming-opnameweergave inschakelen, wat tijd bespaart door het bouwen van gegevenspijplijnen te vermijden:

Merk op dat json_extract_path_text heeft een lengtebeperking van 64 KB. Ook filtert from_varbye records die groter zijn dan 65KB.

- Vernieuw de gegevens.

De gematerialiseerde weergave van Amazon Redshift streaming wordt automatisch voor u vernieuwd door Amazon Redshift. Op deze manier hoeft u zich geen zorgen te maken over verouderde gegevens. Met automatisch vernieuwen van gematerialiseerde weergave worden gegevens automatisch in Amazon Redshift geladen zodra deze beschikbaar komen in de stream. Als u ervoor kiest om deze bewerking handmatig uit te voeren, gebruikt u de volgende opdracht:

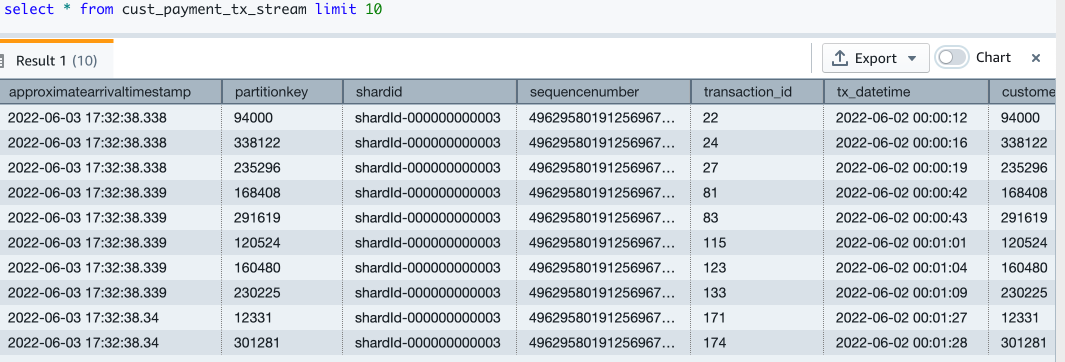

- Laten we nu een query uitvoeren op de streaming gematerialiseerde weergave om voorbeeldgegevens te zien:

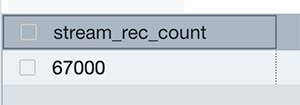

- Laten we eens kijken hoeveel records er nu in de streamingweergave zijn:

Nu ben je klaar met het instellen van de Amazon Redshift streaming opnameweergave, die continu wordt bijgewerkt met inkomende creditcardtransactiegegevens. In mijn opstelling zie ik dat er ongeveer 67,000 records in de streamingweergave zijn getrokken op het moment dat ik mijn select count-query uitvoerde. Dit nummer kan voor u anders zijn.

Roodverschuiving ML

Met Redshift ML kunt u een vooraf getraind ML-model meenemen of er een native bouwen. Voor meer informatie, zie Machine learning gebruiken in Amazon Redshift.

In dit bericht trainen en bouwen we een ML-model met behulp van een historische dataset. De gegevens bevatten een tx_fraud veld dat een historische transactie markeert als frauduleus of niet. We bouwen een gesuperviseerd ML-model met behulp van Redshift Auto ML, dat leert van deze dataset en binnenkomende transacties voorspelt wanneer deze door de voorspellingsfuncties worden geleid.

In de volgende secties laten we zien hoe u de historische dataset en klantgegevens instelt.

Laad de historische dataset

De historische tabel heeft meer velden dan de streaminggegevensbron. Deze velden bevatten de meest recente uitgaven van de klant en de terminalrisicoscore, zoals het aantal frauduleuze transacties dat is berekend door streaminggegevens te transformeren. Er zijn ook categorische variabelen zoals weekendtransacties of nachtelijke transacties.

Om de historische gegevens te laden, voert u de opdrachten uit met behulp van de Amazon Redshift-zoekopdrachteditor.

Maak de transactiegeschiedenistabel met de volgende code. De DDL is ook te vinden op GitHub.

Laten we eens kijken hoeveel transacties er zijn geladen:

Controleer de trend van maandelijkse fraude- en niet-fraudetransacties:

Creëer en laad klantgegevens

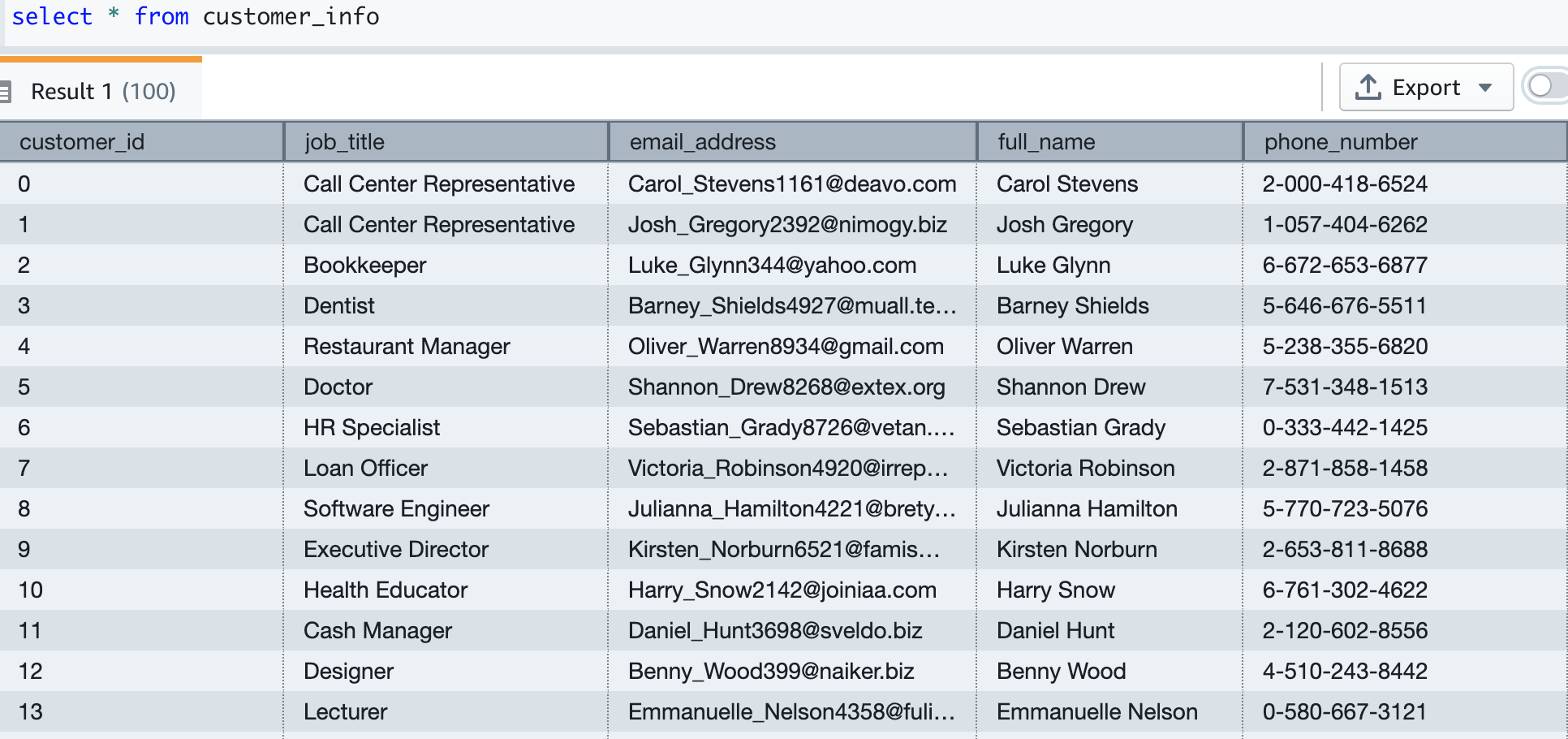

Nu maken we de klantentabel en laden we gegevens in, die het e-mailadres en telefoonnummer van de klant bevatten. De volgende code maakt de tabel, laadt de gegevens en neemt monsters van de tabel. De tafel DDL is beschikbaar op GitHub.

Onze testgegevens hebben ongeveer 5,000 klanten. De volgende schermafbeelding toont voorbeelden van klantgegevens.

Bouw een ML-model

Onze historische kaarttransactietabel bevat gegevens voor 6 maanden, die we nu gebruiken om het ML-model te trainen en te testen.

Het model neemt de volgende velden als invoer:

We krijgen tx_fraud als output.

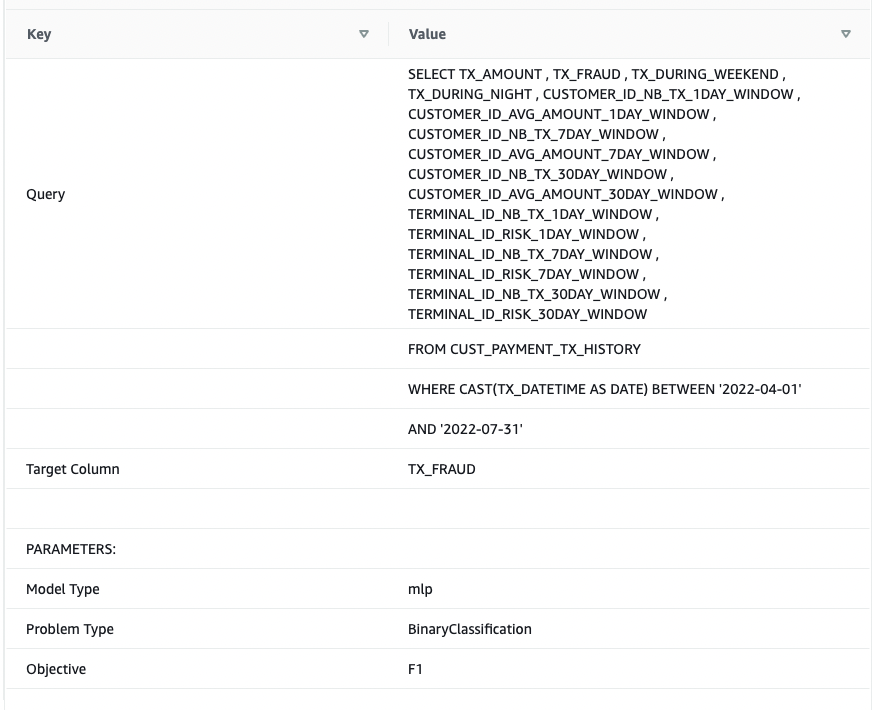

We splitsen deze data op in trainings- en testdatasets. Transacties van 2022-04-01 tot 2022-07-31 zijn voor de trainingsset. Transacties van 2022-08-01 tot 2022-09-30 worden gebruikt voor de testset.

Laten we het ML-model maken met behulp van de bekende SQL CREATE MODEL-instructie. We gebruiken een basisvorm van het Redshift ML-commando. De volgende methode gebruikt Amazon SageMaker-stuurautomaat, dat gegevensvoorbereiding, functie-engineering, modelselectie en training automatisch voor u uitvoert. Geef de naam op van uw S3-bucket met de code.

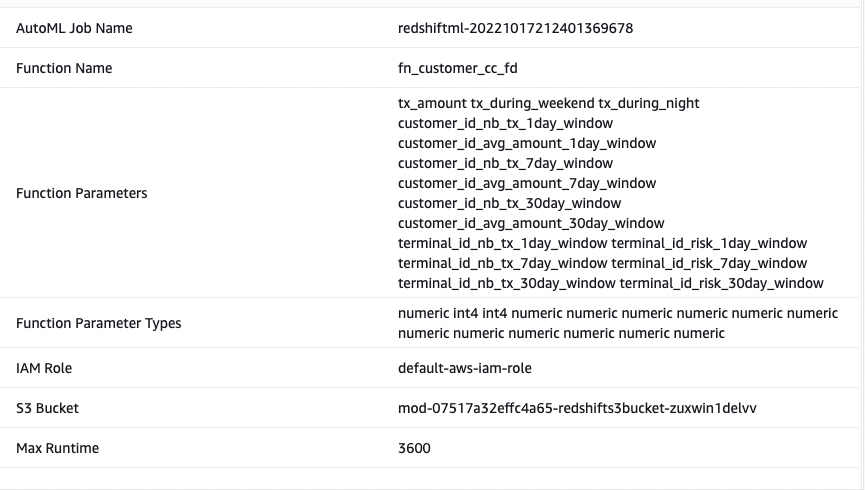

Ik noem het ML-model as Cust_cc_txn_fd, en de voorspellingsfunctie als fn_customer_cc_fd. De component FROM toont de invoerkolommen uit de historische tabel public.cust_payment_tx_history. De doelparameter is ingesteld op tx_fraud, wat de doelvariabele is die we proberen te voorspellen. IAM_Role is standaard ingesteld omdat het cluster is geconfigureerd met deze rol; zo niet, dan moet u uw Amazon Redshift-cluster IAM-rol ARN opgeven. Ik stel de max_runtime tot 3,600 seconden, wat de tijd is die we aan SageMaker geven om het proces te voltooien. Redshift ML implementeert het beste model dat in dit tijdsbestek is geïdentificeerd.

Afhankelijk van de complexiteit van het model en de hoeveelheid data kan het enige tijd duren voordat het model beschikbaar is. Als u merkt dat uw modelselectie niet compleet is, verhoog dan de waarde voor max_runtime. U kunt een maximale waarde van 9999 instellen.

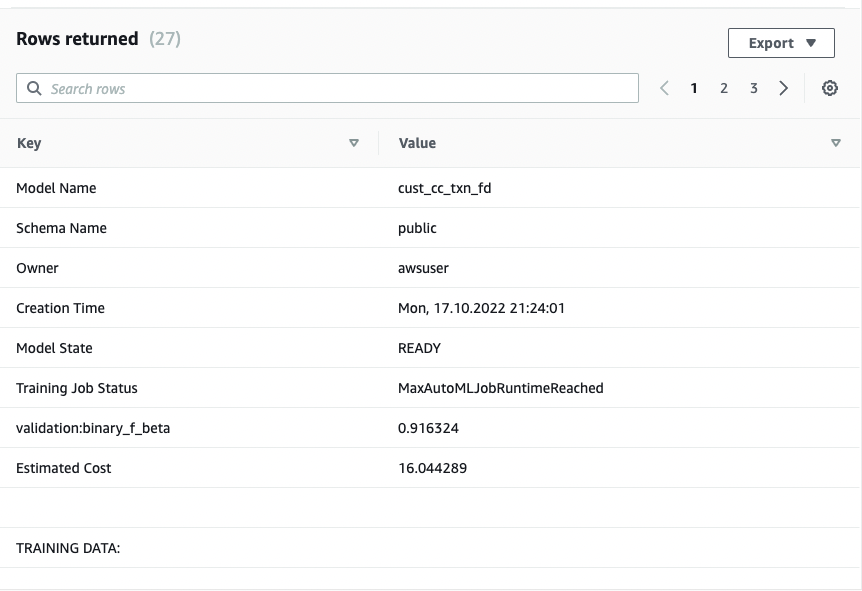

De opdracht CREATE MODEL wordt asynchroon uitgevoerd, wat betekent dat deze op de achtergrond wordt uitgevoerd. U kunt de TOON MODEL commando om de status van het model te zien. Wanneer de status Gereed weergeeft, betekent dit dat het model is getraind en geïmplementeerd.

De volgende schermafbeeldingen tonen onze uitvoer.

Uit de uitvoer zie ik dat het model correct is herkend als BinaryClassification, en F1 is geselecteerd als doel. De F1-score is een metriek die beide beschouwt precisie en herinnering. Het retourneert een waarde tussen 1 (perfecte precisie en herinnering) en 0 (laagst mogelijke score). In mijn geval is het 0.91. Hoe hoger de waarde, hoe beter de prestaties van het model.

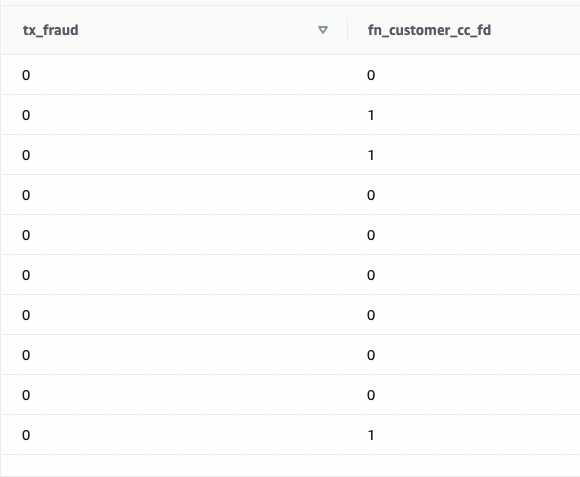

Laten we dit model testen met de testdataset. Voer de volgende opdracht uit, waarmee voorbeeldvoorspellingen worden opgehaald:

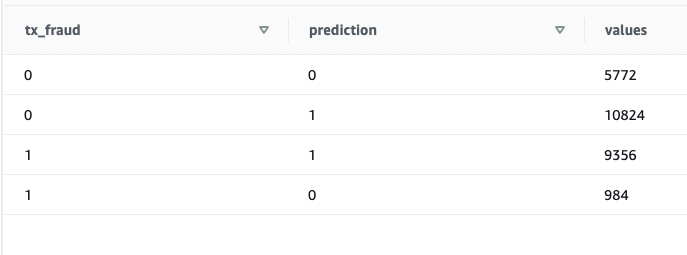

We zien dat sommige waarden overeenkomen en andere niet. Laten we voorspellingen vergelijken met de grondwaarheid:

We hebben gevalideerd dat het model werkt en dat de F1-score goed is. Laten we verder gaan met het genereren van voorspellingen over streaminggegevens.

Voorspel frauduleuze transacties

Omdat het Redshift ML-model klaar is voor gebruik, kunnen we het gebruiken om de voorspellingen uit te voeren op basis van streaming gegevensopname. De historische dataset heeft meer velden dan wat we in de streaming-gegevensbron hebben, maar het zijn slechts recentheids- en frequentiestatistieken rond het klant- en terminalrisico voor een frauduleuze transactie.

We kunnen de transformaties heel eenvoudig bovenop de streaminggegevens toepassen door de SQL in de weergaven in te sluiten. Maak de eerste weergave, die streaminggegevens op klantniveau verzamelt. Maak dan de tweede mening, dat streaminggegevens op terminalniveau verzamelt, en de derde zicht, dat binnenkomende transactiegegevens combineert met geaggregeerde klant- en terminalgegevens en de voorspellingsfunctie allemaal op één plek aanroept. De code voor de derde weergave is als volgt:

Voer een SELECT-instructie uit op de weergave:

Terwijl u de SELECT-instructie herhaaldelijk uitvoert, ondergaan de nieuwste creditcardtransacties vrijwel realtime transformaties en ML-voorspellingen.

Dit demonstreert de kracht van Amazon Redshift: met eenvoudig te gebruiken SQL-commando's kun je streaming data transformeren door complexe vensterfuncties toe te passen en een ML-model toepassen om frauduleuze transacties te voorspellen, allemaal in één stap, zonder complexe datapijplijnen te bouwen of te bouwen en te beheren extra infrastructuur.

Breid de oplossing uit

Omdat de gegevensstromen die binnenkomen en de ML-voorspellingen bijna in realtime worden gemaakt, kunt u bedrijfsprocessen bouwen om uw klant te waarschuwen met behulp van Amazon eenvoudige meldingsservice (Amazon SNS), of u kunt de creditcardrekening van de klant vergrendelen in een operationeel systeem.

Dit bericht gaat niet in op de details van deze bewerkingen, maar als je meer wilt weten over het bouwen van gebeurtenisgestuurde oplossingen met behulp van Amazon Redshift, raadpleeg dan het volgende GitHub-repository.

Opruimen

Om te voorkomen dat er in de toekomst kosten in rekening worden gebracht, verwijdert u de bronnen die zijn gemaakt als onderdeel van dit bericht.

Conclusie

In dit bericht hebben we gedemonstreerd hoe je een Kinesis-gegevensstroom opzet, een producent configureert en gegevens naar streams publiceert, en vervolgens een Amazon Redshift Streaming Ingestion-weergave maakt en de gegevens in Amazon Redshift opvraagt. Nadat de gegevens in het Amazon Redshift-cluster waren, hebben we gedemonstreerd hoe we een ML-model kunnen trainen en een voorspellingsfunctie kunnen bouwen en deze kunnen toepassen op de streaminggegevens om voorspellingen in bijna realtime te genereren.

Als je feedback of vragen hebt, laat ze dan achter in de comments.

Over de auteurs

Bhanu Pittamally is een Analytics Specialist Solutions Architect gevestigd in Dallas. Hij is gespecialiseerd in het bouwen van analytische oplossingen. Zijn achtergrond ligt in datawarehouses: architectuur, ontwikkeling en administratie. Hij is al meer dan 15 jaar actief op het gebied van data en analyse.

Bhanu Pittamally is een Analytics Specialist Solutions Architect gevestigd in Dallas. Hij is gespecialiseerd in het bouwen van analytische oplossingen. Zijn achtergrond ligt in datawarehouses: architectuur, ontwikkeling en administratie. Hij is al meer dan 15 jaar actief op het gebied van data en analyse.

Praveen Kadipikonda is een Senior Analytics Specialist Solutions Architect bij AWS in Dallas. Hij helpt klanten bij het bouwen van efficiënte, performante en schaalbare analytische oplossingen. Hij heeft meer dan 15 jaar gewerkt aan het bouwen van databases en datawarehouse-oplossingen.

Praveen Kadipikonda is een Senior Analytics Specialist Solutions Architect bij AWS in Dallas. Hij helpt klanten bij het bouwen van efficiënte, performante en schaalbare analytische oplossingen. Hij heeft meer dan 15 jaar gewerkt aan het bouwen van databases en datawarehouse-oplossingen.

Ritesh Kumar Sinha is een Analytics Specialist Solutions Architect gevestigd in San Francisco. Hij heeft klanten al meer dan 16 jaar geholpen bij het bouwen van schaalbare datawarehousing en big data-oplossingen. Hij ontwerpt en bouwt graag efficiënte end-to-end-oplossingen op AWS. In zijn vrije tijd houdt hij van lezen, wandelen en yoga.

Ritesh Kumar Sinha is een Analytics Specialist Solutions Architect gevestigd in San Francisco. Hij heeft klanten al meer dan 16 jaar geholpen bij het bouwen van schaalbare datawarehousing en big data-oplossingen. Hij ontwerpt en bouwt graag efficiënte end-to-end-oplossingen op AWS. In zijn vrije tijd houdt hij van lezen, wandelen en yoga.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- Platoblockchain. Web3 Metaverse Intelligentie. Kennis versterkt. Toegang hier.

- Bron: https://aws.amazon.com/blogs/big-data/near-real-time-fraud-detection-using-amazon-redshift-streaming-ingestion-with-amazon-kinesis-data-streams-and-amazon-redshift-ml/

- 000

- 000 klanten

- 1

- 10

- 100

- 11

- 15 jaar

- 67

- 7

- 9

- a

- in staat

- Over

- boven

- toegang

- Account

- Bereiken

- Actie

- Extra

- administratie

- vergevorderd

- Na

- tegen

- Alarm

- Alles

- toestaat

- Amazone

- Amazon EC2

- Amazon Kinesis

- bedragen

- analisten

- analytisch

- analytics

- analyseren

- en

- onregelmatigheidsdetectie

- apache

- Aanvraag

- Solliciteer

- Het toepassen van

- architectuur

- rond

- hechten

- auto

- Automatisch

- webmaster.

- Beschikbaar

- het vermijden van

- AWS

- achtergrond

- gebaseerde

- basis-

- omdat

- wordt

- BEST

- Betere

- tussen

- Groot

- Big data

- brengen

- bouw

- Gebouw

- bedrijfsdeskundigen

- bedrijfsprocessen

- ondernemingen

- Bellen

- Dit betekent dat we onszelf en onze geliefden praktisch vergiftigen.

- oproepen

- vangen

- kaart

- geval

- gevallen

- karakter

- lasten

- controle

- Kies

- Plaats

- Cloud

- TROS

- code

- columns

- combines

- komst

- opmerkingen

- vergelijken

- compleet

- het invullen van

- complex

- ingewikkeldheid

- Berekenen

- beschouwt

- troosten

- consumeren

- consument

- bevat

- kostenefficient

- kon

- en je merk te creëren

- aangemaakt

- creëert

- Wij creëren

- Geloofsbrieven

- Credits

- creditkaart

- klant

- klantgegevens

- Klanten

- cycli

- dagelijks

- Dallas

- gegevens

- Data voorbereiding

- datawarehouse

- data warehouses

- Database

- databanken

- datasets

- Datum

- Besluitvorming

- Standaard

- het definiëren van

- leveren

- gedemonstreerd

- afhankelijk

- implementeren

- ingezet

- ontplooit

- beschreven

- Design

- gegevens

- Opsporing

- ontwikkelaars

- Ontwikkeling

- anders

- direct

- Nee

- doen

- Dont

- dow

- dynamisch

- gemakkelijk

- gemakkelijk te gebruiken

- effect

- doeltreffend

- in staat stellen

- maakt

- eind tot eind

- Engineering

- Enter

- Ether (ETH)

- Event

- EVENTS

- voorbeeld

- opgewonden

- extern

- extractie

- f1

- vertrouwd

- SNELLE

- Kenmerk

- Voordelen

- feedback

- veld-

- Velden

- filters

- financieel

- VIND DE PLEK DIE PERFECT VOOR JOU IS

- vlaggen

- stroom

- volgen

- volgend

- volgt

- formulier

- formaat

- gevonden

- FRAME

- Francisco

- bedrog

- fraude detectie

- Gratis

- Frequentie

- oppompen van

- geheel

- functie

- functies

- toekomst

- voortbrengen

- gegenereerde

- het genereren van

- generator

- krijgen

- Geven

- Go

- goed

- toe te kennen

- Ground

- Groep

- met

- geholpen

- helpt

- hoger

- Markeer

- historisch

- geschiedenis

- Hoe

- How To

- HTML

- HTTPS

- Honderden

- IAM

- geïdentificeerd

- Identiteit

- belang

- in

- omvatten

- Inkomend

- Laat uw omzet

- meer

- individueel

- informatie

- Infrastructuur

- invoer

- Inzetstukken

- inzichten

- installeren

- instantie

- Instituut

- instructies

- geïnteresseerd

- IT

- mee

- json

- kafka

- Kinesis-gegevensstromen

- taal

- groter

- Wachttijd

- laatste

- lancering

- leren

- Verlof

- Lengte

- Niveau

- LIMIT

- beperking

- laden

- ladingen

- langdurig

- Laag

- machine

- machine learning

- gemaakt

- maken

- MERKEN

- beheerd

- beheren

- handmatig

- veel

- kaart

- massief

- matching

- matplotlib

- max

- middel

- Media

- methode

- metriek

- Metriek

- Verzachten

- ML

- Mode

- model

- modellen

- maandelijks

- maanden

- meer

- meest

- beweging

- naam

- Navigatie

- Noodzaak

- behoeften

- New

- volgende

- notificatie

- aantal

- numpy

- doel van de persoon

- EEN

- opent

- operatie

- operationele

- Operations

- Kansen

- Opties

- bestellen

- organisaties

- Overige

- geschetst

- Paketten

- panda's

- brood

- parameter

- deel

- uitvoeren

- prestatie

- presteert

- permissies

- phone

- plaats

- planning

- platform

- platforms

- Plato

- Plato gegevensintelligentie

- PlatoData

- dan

- beleidsmaatregelen door te lezen.

- beleidsmaatregelen

- mogelijk

- Post

- energie

- precisie

- voorspellen

- voorspelling

- Voorspellingen

- voorspelt

- vorig

- prijsstelling

- processen

- producent

- Programma

- zorgen voor

- biedt

- publiek

- publiceren

- Python

- Contact

- snel

- willekeurige

- lezing

- klaar

- vast

- real-time

- realtime gegevens

- realiseren

- ontvangen

- ontvangen

- recent

- erkend

- archief

- HERHAALDELIJK

- vervangen

- nodig

- hulpbron

- Resources

- REST

- Resultaten

- Retourneren

- Risico

- Rol

- lopen

- lopend

- sagemaker

- heilige

- San Francisco

- schaalbare

- Scale

- screenshots

- sdk

- Seaborn

- Tweede

- seconden

- sectie

- secties

- beveiligen

- gekozen

- selectie

- Serverless

- service

- reeks

- het instellen van

- settings

- setup

- korte termijn

- tonen

- Shows

- Eenvoudig

- vereenvoudigen

- simulator

- So

- Social

- social media

- oplossing

- Oplossingen

- sommige

- bron

- bronnen

- specialist

- specialiseert

- besteden

- spleet

- SQL

- Stadium

- standaard

- gestart

- Land

- Statement

- verklaringen

- Status

- Stap voor

- Stappen

- mediaopslag

- shop

- winkels

- strategisch

- stream

- streaming

- streaming service

- streams

- dergelijk

- Super

- system

- Systems

- tafel

- Nemen

- neemt

- Talks

- doelwit

- terminal

- proef

- De

- Derde

- duizenden kosten

- Door

- niet de tijd of

- tijdstempel

- naar

- top

- onderwerp

- traditioneel

- Trainen

- getraind

- Trainingen

- transactie

- transactionele

- Transacties

- Transformeren

- transformaties

- transformeren

- trend

- bijwerken

- bijgewerkt

- Gebruik

- .

- Gebruiker

- gevalideerd

- waarde

- Values

- divers

- Waarheid

- versie

- Bekijk

- .

- wandel

- walkthrough

- Magazijn

- Warehousing

- Website

- weekend

- per week

- Wat

- welke

- en

- Wikipedia

- wil

- zonder

- werkte

- werkzaam

- Bedrijven

- schrijven

- jaar

- Yoga

- Your

- zephyrnet