데이터 웨어하우스 플랫폼에서 수행되는 데이터 웨어하우스 및 분석의 중요성은 수년에 걸쳐 꾸준히 증가해 왔으며 많은 기업이 단기 운영 의사 결정 및 장기 전략 계획 모두에서 미션 크리티컬 시스템으로 이러한 시스템에 의존하게 되었습니다. 전통적으로 데이터 웨어하우스는 배치 주기(예: 월별, 주별 또는 매일)로 새로 고쳐지므로 기업은 데이터 웨어하우스에서 다양한 통찰력을 얻을 수 있습니다.

많은 조직이 고급 분석과 함께 실시간에 가까운 데이터 수집이 새로운 기회를 열어준다는 사실을 깨닫고 있습니다. 예를 들어 금융 기관은 이상 탐지 프로그램을 배치 모드가 아닌 거의 실시간 모드로 실행하여 신용 카드 거래가 사기인지 예측할 수 있습니다.

이 게시물에서는 방법을 보여줍니다. 아마존 레드 시프트 하나의 플랫폼에서 스트리밍 수집 및 기계 학습(ML) 예측을 모두 제공할 수 있습니다.

Amazon Redshift는 표준 SQL을 사용하여 모든 데이터를 간단하고 비용 효율적으로 분석할 수 있는 빠르고 확장 가능하며 안전하고 완벽하게 관리되는 클라우드 데이터 웨어하우스입니다.

아마존 레드시프트 ML 데이터 분석가와 데이터베이스 개발자가 Amazon Redshift 데이터 웨어하우스에서 친숙한 SQL 명령을 사용하여 ML 모델을 쉽게 생성, 교육 및 적용할 수 있습니다.

출시하게 되어 기쁩니다. Amazon Redshift 스트리밍 수집 for Amazon Kinesis 데이터 스트림 과 Apache Kafka 용 Amazon Managed Streaming (Amazon MSK): 데이터를 스테이징할 필요 없이 Kinesis 데이터 스트림 또는 Kafka 주제에서 직접 데이터를 수집할 수 있습니다. 아마존 단순 스토리지 서비스 (아마존 S3). Amazon Redshift 스트리밍 수집을 사용하면 수백 메가바이트의 데이터를 데이터 웨어하우스로 수집하면서 몇 초 안에 짧은 지연 시간을 달성할 수 있습니다.

이 게시물은 클라우드 데이터 웨어하우스인 Amazon Redshift가 익숙한 SQL 언어로 Amazon Redshift 스트리밍 수집 및 Redshift ML 기능을 사용하여 실시간에 가까운 ML 예측을 구축하는 방법을 보여줍니다.

솔루션 개요

이 게시물에 설명된 단계를 따르면 다음에서 생산자 스트리머 애플리케이션을 설정할 수 있습니다. 아마존 엘라스틱 컴퓨트 클라우드 (Amazon EC2) 신용 카드 거래를 시뮬레이션하고 데이터를 Kinesis Data Streams에 실시간으로 푸시하는 인스턴스. 스트리밍 데이터가 수신되는 Amazon Redshift에서 Amazon Redshift Streaming Ingestion 구체화된 보기를 설정합니다. Redshift ML 모델을 훈련 및 구축하여 스트리밍 데이터에 대한 실시간 추론을 생성합니다.

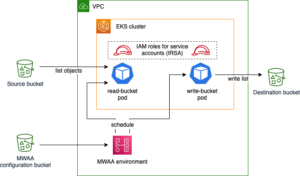

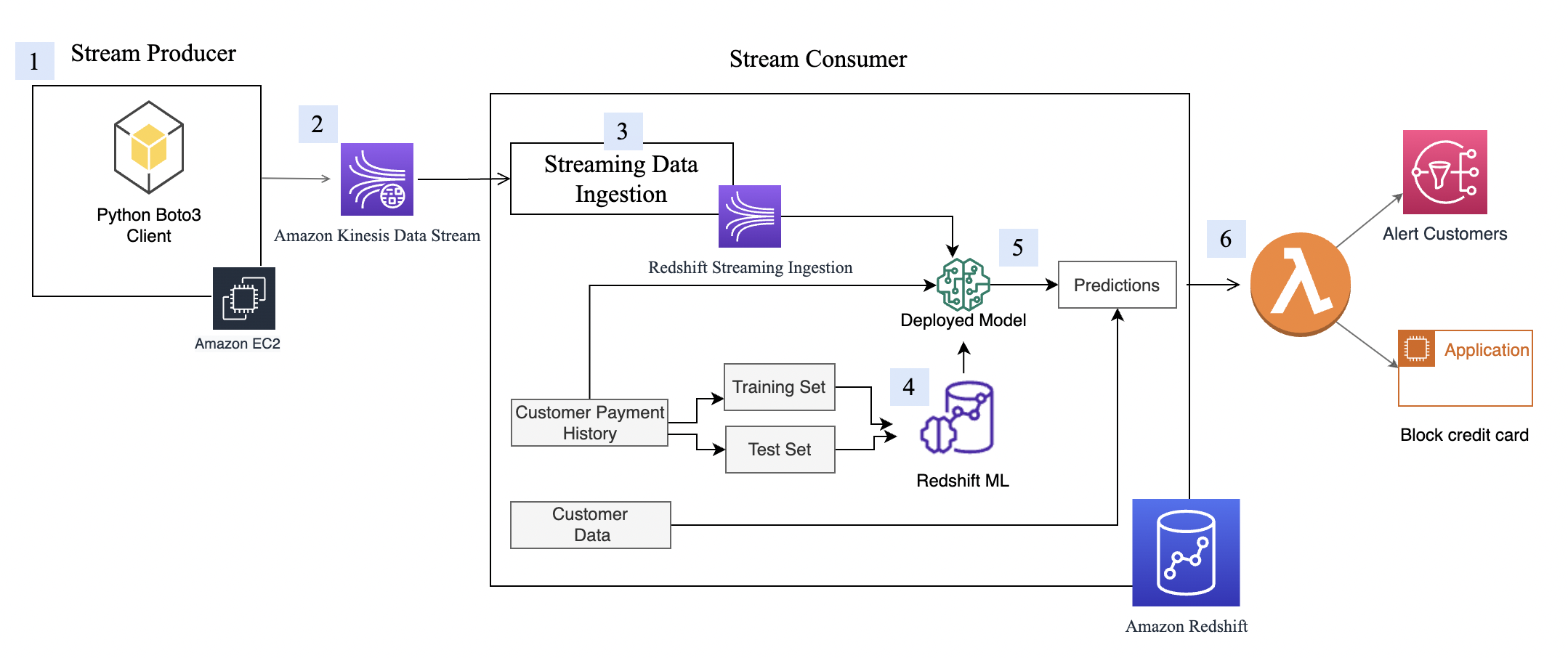

다음 다이어그램은 아키텍처 및 프로세스 흐름을 보여줍니다.

단계별 프로세스는 다음과 같습니다.

- EC2 인스턴스는 신용 카드 거래를 Kinesis 데이터 스트림에 삽입하는 신용 카드 거래 애플리케이션을 시뮬레이션합니다.

- 데이터 스트림은 들어오는 신용 카드 트랜잭션 데이터를 저장합니다.

- Amazon Redshift Streaming Ingestion 구체화된 보기는 스트리밍 데이터를 Amazon Redshift로 자동으로 수집하는 데이터 스트림 위에 생성됩니다.

- Redshift ML을 사용하여 ML 모델을 구축, 교육 및 배포합니다. Redshift ML 모델은 과거 트랜잭션 데이터를 사용하여 훈련됩니다.

- 스트리밍 데이터를 변환하고 ML 예측을 생성합니다.

- 고객에게 알리거나 애플리케이션을 업데이트하여 위험을 완화할 수 있습니다.

이 연습에서는 신용 카드 트랜잭션 스트리밍 데이터를 사용합니다. 신용 카드 거래 데이터는 가상이며 시뮬레이터. 고객 데이터 세트도 가상이며 일부 임의 데이터 함수로 생성됩니다.

사전 조건

- Amazon Redshift 클러스터 생성.

- Redshift ML을 사용하도록 클러스터 구성.

- 만들기 an AWS 자격 증명 및 액세스 관리 (IAM) 사용자.

- Kinesis 데이터 스트림에 액세스할 수 있는 권한을 포함하도록 Redshift 클러스터에 연결된 IAM 역할을 업데이트합니다. 필수 정책에 대한 자세한 내용은 다음을 참조하십시오. 스트리밍 수집 시작하기.

- m5.4xlarge EC2 인스턴스 생성. m5.4xlarge 인스턴스로 Producer 애플리케이션을 테스트했지만 다른 인스턴스 유형을 자유롭게 사용할 수 있습니다. 인스턴스를 생성할 때 amzn2-ami-kernel-5.10-hvm-2.0.20220426.0-x86_64-gp2 아미.

- Python3이 EC2 인스턴스에 설치되어 있는지 확인하려면 다음 명령을 실행하여 Python 버전을 확인합니다(데이터 추출 스크립트는 Python 3에서만 작동함).

- 시뮬레이터 프로그램을 실행하려면 다음 종속 패키지를 설치하십시오.

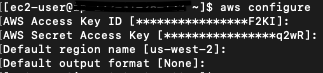

- 위의 2단계에서 생성한 IAM 사용자에 대해 생성된 AWS 자격 증명과 같은 변수를 사용하여 Amazon EC3를 구성합니다. 다음 스크린샷은 다음을 사용하는 예를 보여줍니다. aws configure.

Kinesis Data Streams 설정

Amazon Kinesis Data Streams는 확장성과 내구성이 뛰어난 실시간 데이터 스트리밍 서비스입니다. 웹 사이트 클릭 스트림, 데이터베이스 이벤트 스트림, 금융 거래, 소셜 미디어 피드, IT 로그 및 위치 추적 이벤트와 같은 수십만 개의 소스에서 초당 기가바이트의 데이터를 지속적으로 캡처할 수 있습니다. 수집된 데이터는 실시간 대시보드, 실시간 이상 탐지, 동적 가격 책정 등과 같은 실시간 분석 사용 사례를 활성화하기 위해 밀리초 단위로 제공됩니다. 사용량에 따라 확장할 수 있는 서버리스 솔루션이기 때문에 Kinesis Data Streams를 사용합니다.

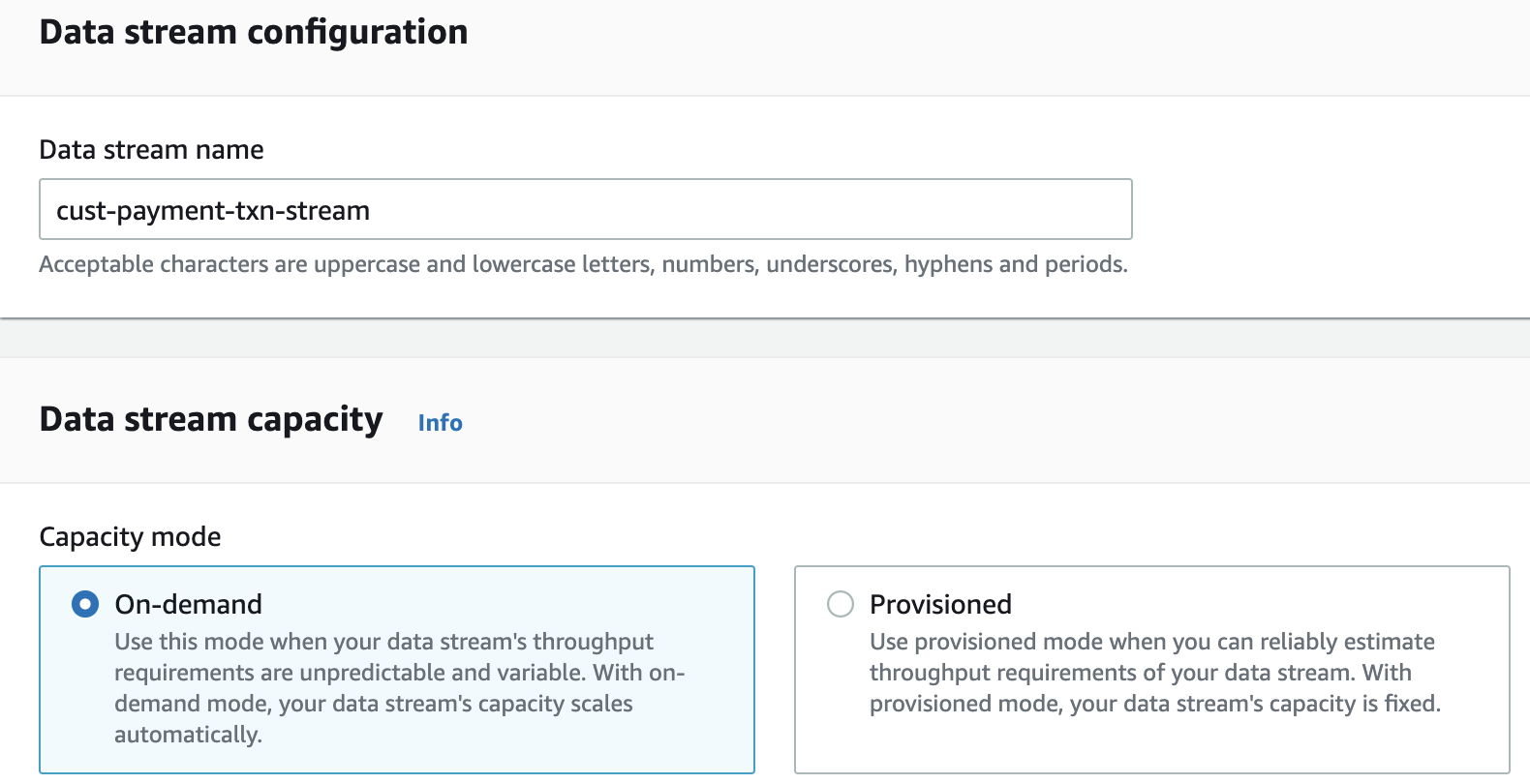

Kinesis 데이터 스트림 생성

먼저 스트리밍 데이터를 수신할 Kinesis 데이터 스트림을 생성해야 합니다.

- Amazon Kinesis 콘솔에서 데이터 스트림 탐색 창에서

- 왼쪽 메뉴에서 데이터 스트림 생성.

- 럭셔리 데이터 스트림 이름, 입력

cust-payment-txn-stream. - 럭셔리 용량 모드, 고르다 온 디맨드.

- 나머지 옵션의 경우 기본 옵션을 선택하고 프롬프트에 따라 설정을 완료합니다.

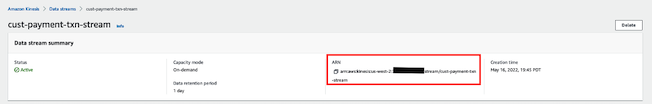

- IAM 정책을 정의할 때 다음 섹션에서 사용할 생성된 데이터 스트림의 ARN을 캡처합니다.

권한 설정

스트리밍 애플리케이션이 Kinesis Data Streams에 쓰려면 애플리케이션이 Kinesis에 액세스할 수 있어야 합니다. 다음 정책 설명을 사용하여 다음 섹션에서 설정하는 시뮬레이터 프로세스에 데이터 스트림에 대한 액세스 권한을 부여할 수 있습니다. 이전 단계에서 저장한 데이터 스트림의 ARN을 사용합니다.

스트림 생산자 구성

Amazon Redshift에서 스트리밍 데이터를 사용하려면 Kinesis 데이터 스트림에 데이터를 쓰는 스트리밍 데이터 원본이 필요합니다. 이 게시물은 맞춤형 데이터 생성기와 Python 용 AWS SDK (Boto3) 데이터를 데이터 스트림에 게시합니다. 설정 지침은 다음을 참조하십시오. 생산자 시뮬레이터. 이 시뮬레이터 프로세스는 스트리밍 데이터를 이전 단계에서 생성된 데이터 스트림에 게시합니다(cust-payment-txn-stream).

스트림 소비자 구성

이 섹션에서는 스트림 소비자(Amazon Redshift 스트리밍 수집 보기) 구성에 대해 설명합니다.

Amazon Redshift Streaming Ingestion은 Kinesis Data Streams에서 Amazon Redshift 구체화 보기로 스트리밍 데이터의 지연 시간이 짧은 고속 수집을 제공합니다. 에 설명된 대로 SQL 문을 사용하여 스트리밍 수집을 활성화하고 자동 새로 고침으로 구체화된 보기를 생성하도록 Amazon Redshift 클러스터를 구성할 수 있습니다. Amazon Redshift에서 구체화된 보기 생성. 자동 구체화된 보기 새로 고침 프로세스는 Kinesis Data Streams에서 Amazon Redshift로 초당 수백 메가바이트의 스트리밍 데이터를 수집합니다. 그 결과 빠르게 새로 고쳐지는 외부 데이터에 빠르게 액세스할 수 있습니다.

구체화된 뷰를 생성한 후 SQL을 사용하여 데이터 스트림에서 데이터에 액세스하고 스트림 위에 직접 구체화된 뷰를 생성하여 데이터 파이프라인을 단순화할 수 있습니다.

Amazon Redshift 스트리밍 구체화된 보기를 구성하려면 다음 단계를 완료하십시오.

- IAM 콘솔의 탐색 창에서 정책을 선택합니다.

- 왼쪽 메뉴에서 정책 만들기.

- 라는 새 IAM 정책을 만듭니다.

KinesisStreamPolicy. 스트리밍 정책 정의는 다음을 참조하세요. 스트리밍 수집 시작하기. - 탐색 창에서 역할.

- 역할 생성을 선택합니다.

- 선택 AWS 서비스 선택하고 Redshift 및 Redshift 사용자 지정 가능.

- 이라는 새 역할을 만듭니다.

redshift-streaming-role정책을 첨부합니다.KinesisStreamPolicy. - Kinesis Data Streams에 매핑할 외부 스키마를 생성합니다.

이제 구체화된 보기를 생성하여 스트림 데이터를 사용할 수 있습니다. SUPER 데이터 유형을 사용하여 페이로드를 있는 그대로 JSON 형식으로 저장하거나 Amazon Redshift JSON 함수를 사용하여 JSON 데이터를 개별 열로 구문 분석할 수 있습니다. 이 게시물에서는 스키마가 잘 정의되어 있기 때문에 두 번째 방법을 사용합니다.

- 스트리밍 수집 구체화 보기 만들기

cust_payment_tx_stream. 다음 코드에서 AUTO REFRESH YES를 지정하면 데이터 파이프라인 빌드를 방지하여 시간을 절약하는 스트리밍 수집 보기의 자동 새로 고침을 활성화할 수 있습니다.

참고 json_extract_path_text 길이 제한은 64KB입니다. 또한 from_varbye 필터는 65KB보다 큰 레코드를 필터링합니다.

- 데이터를 새로 고칩니다.

Amazon Redshift 스트리밍 구체화 보기는 Amazon Redshift에서 자동으로 새로 고쳐집니다. 이렇게 하면 데이터 부실에 대해 걱정할 필요가 없습니다. 구체화된 보기 자동 새로 고침을 사용하면 데이터가 스트림에서 사용 가능해지면 자동으로 Amazon Redshift에 로드됩니다. 이 작업을 수동으로 수행하도록 선택한 경우 다음 명령을 사용합니다.

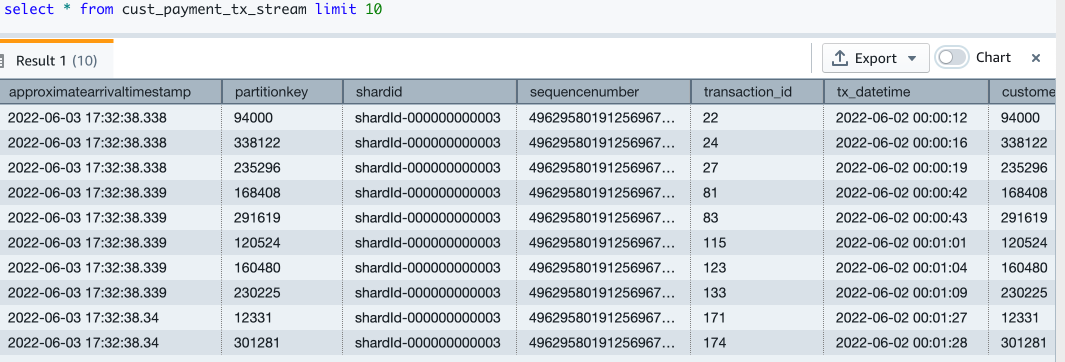

- 이제 스트리밍 구체화된 보기를 쿼리하여 샘플 데이터를 확인하겠습니다.

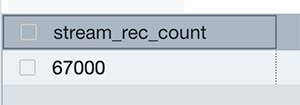

- 이제 스트리밍 보기에 몇 개의 레코드가 있는지 확인하겠습니다.

이제 수신 신용 카드 트랜잭션 데이터로 지속적으로 업데이트되는 Amazon Redshift 스트리밍 수집 보기 설정을 완료했습니다. 내 설정에서 내가 셀렉트 카운트 쿼리를 실행했을 때 약 67,000개의 레코드가 스트리밍 보기로 가져온 것을 볼 수 있습니다. 이 번호는 귀하에게 다를 수 있습니다.

레드시프트 ML

Redshift ML을 사용하면 사전 학습된 ML 모델을 가져오거나 기본적으로 구축할 수 있습니다. 자세한 내용은 다음을 참조하십시오. Amazon Redshift에서 기계 학습 사용.

이 게시물에서는 과거 데이터 세트를 사용하여 ML 모델을 훈련하고 구축합니다. 데이터에는 tx_fraud 과거 거래를 사기성 여부로 표시하는 필드입니다. Redshift Auto ML을 사용하여 감독된 ML 모델을 구축합니다. 이 데이터 세트는 이 데이터 세트에서 학습하고 예측 기능을 통해 들어오는 트랜잭션을 예측합니다.

다음 섹션에서는 과거 데이터 세트와 고객 데이터를 설정하는 방법을 보여줍니다.

기록 데이터 세트 로드

기록 테이블에는 스트리밍 데이터 원본에 있는 것보다 더 많은 필드가 있습니다. 이러한 필드에는 스트리밍 데이터를 변환하여 계산된 사기 거래 수와 같은 고객의 가장 최근 지출 및 최종 위험 점수가 포함됩니다. 주말 거래 또는 야간 거래와 같은 범주형 변수도 있습니다.

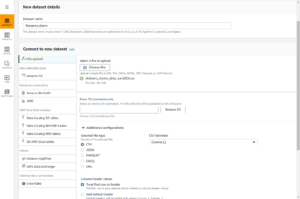

히스토리 데이터를 로드하려면 다음을 사용하여 명령을 실행하십시오. Amazon Redshift 쿼리 편집기.

다음 코드를 사용하여 트랜잭션 기록 테이블을 만듭니다. DDL은 다음에서도 찾을 수 있습니다. GitHub의.

얼마나 많은 트랜잭션이 로드되었는지 확인해 보겠습니다.

월별 사기 및 비사기 거래 동향 확인:

고객 데이터 생성 및 로드

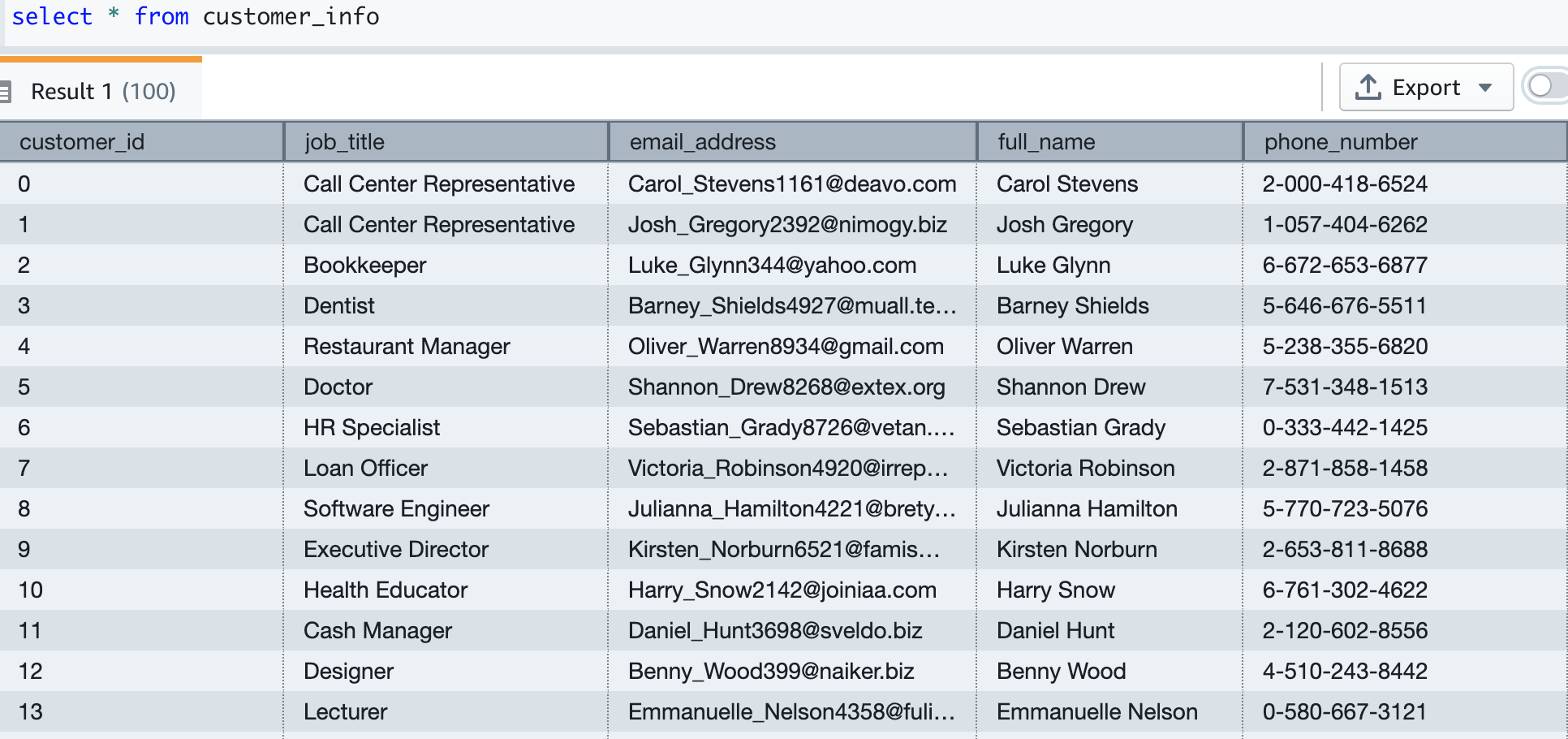

이제 고객 테이블을 만들고 고객의 이메일과 전화번호가 포함된 데이터를 로드합니다. 다음 코드는 테이블을 만들고, 데이터를 로드하고, 테이블을 샘플링합니다. 테이블 DDL은 다음에서 사용할 수 있습니다. GitHub의.

테스트 데이터에는 약 5,000명의 고객이 있습니다. 다음 스크린샷은 샘플 고객 데이터를 보여줍니다.

ML 모델 구축

과거 카드 거래 테이블에는 6개월의 데이터가 있으며 이제 ML 모델을 훈련하고 테스트하는 데 사용합니다.

모델은 다음 필드를 입력으로 사용합니다.

우리는 얻는다 tx_fraud 출력으로.

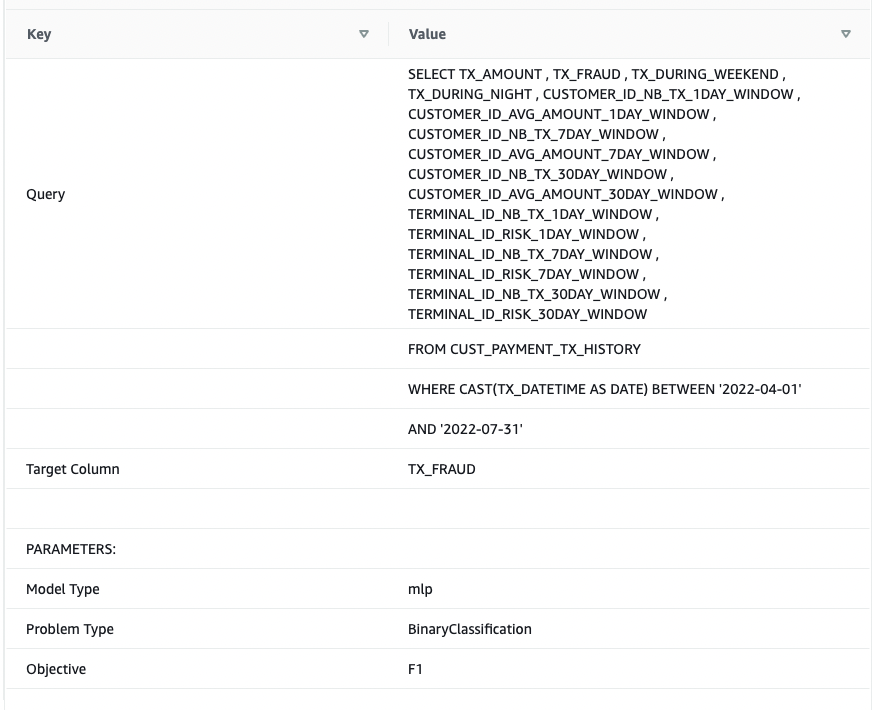

이 데이터를 교육 및 테스트 데이터 세트로 분할합니다. 2022-04-01부터 2022-07-31까지의 트랜잭션은 훈련 세트에 대한 것입니다. 2022-08-01부터 2022-09-30까지의 트랜잭션이 테스트 세트에 사용됩니다.

익숙한 SQL을 사용하여 ML 모델을 만들어 봅시다. CREATE MODEL 문. Redshift ML 명령의 기본 형식을 사용합니다. 다음 방법은 Amazon SageMaker 자동 조종 장치, 데이터 준비, 기능 엔지니어링, 모델 선택 및 교육을 자동으로 수행합니다. 코드가 포함된 S3 버킷의 이름을 제공합니다.

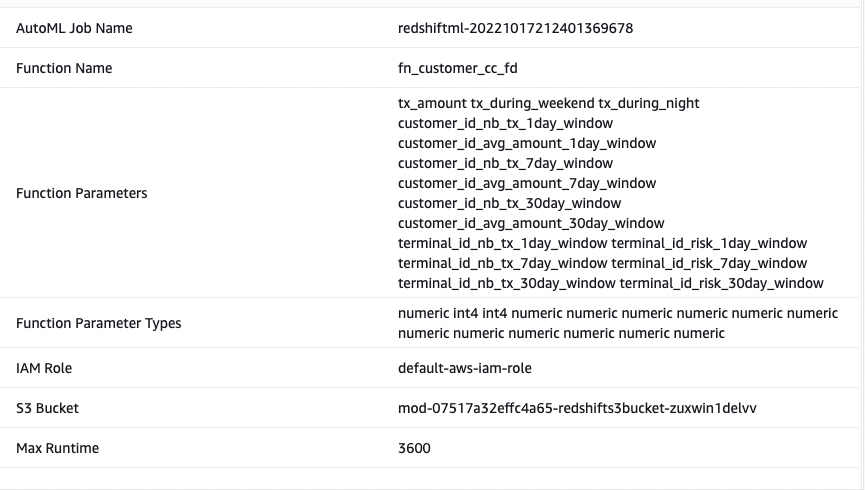

ML 모델을 다음과 같이 호출합니다. Cust_cc_txn_fd, 예측 함수는 다음과 같습니다. fn_customer_cc_fd. FROM 절은 기록 테이블의 입력 열을 보여줍니다. public.cust_payment_tx_history. 대상 매개변수는 다음으로 설정됩니다. tx_fraud, 우리가 예측하려는 대상 변수입니다. IAM_Role 클러스터가 이 역할로 구성되었기 때문에 기본값으로 설정됩니다. 그렇지 않은 경우 Amazon Redshift 클러스터 IAM 역할 ARN을 제공해야 합니다. 내가 설정 max_runtime 프로세스를 완료하기 위해 SageMaker에 제공하는 시간인 3,600초로 설정합니다. Redshift ML은 이 기간에 식별된 최상의 모델을 배포합니다.

모델의 복잡성과 데이터 양에 따라 모델을 사용할 수 있는 데 시간이 걸릴 수 있습니다. 모델 선택이 완료되지 않은 경우 값을 늘리십시오. max_runtime. 최대 값을 9999로 설정할 수 있습니다.

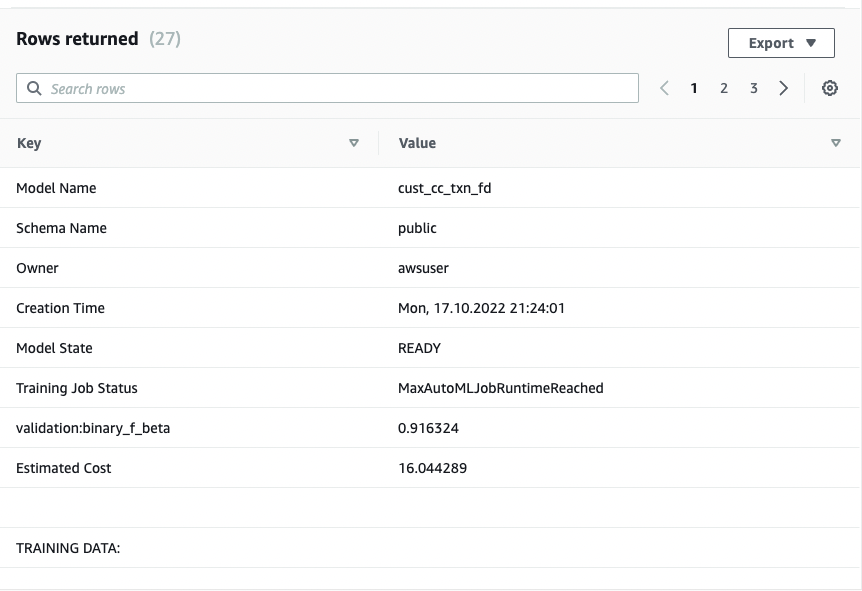

CREATE MODEL 명령은 비동기식으로 실행되며 이는 백그라운드에서 실행됨을 의미합니다. 당신은 사용할 수 있습니다 모델보기 모델의 상태를 확인하는 명령입니다. 상태가 준비됨으로 표시되면 모델이 학습 및 배포되었음을 의미합니다.

다음 스크린샷은 출력을 보여줍니다.

출력에서 모델이 다음과 같이 올바르게 인식되었음을 알 수 있습니다. BinaryClassification, F1이 목표로 선택되었습니다. 그만큼 F1 점수 두 가지를 모두 고려한 측정항목입니다. 정밀도와 재현율. 1(완벽한 정밀도 및 재현율)과 0(가장 낮은 점수) 사이의 값을 반환합니다. 제 경우에는 0.91입니다. 값이 높을수록 모델 성능이 좋습니다.

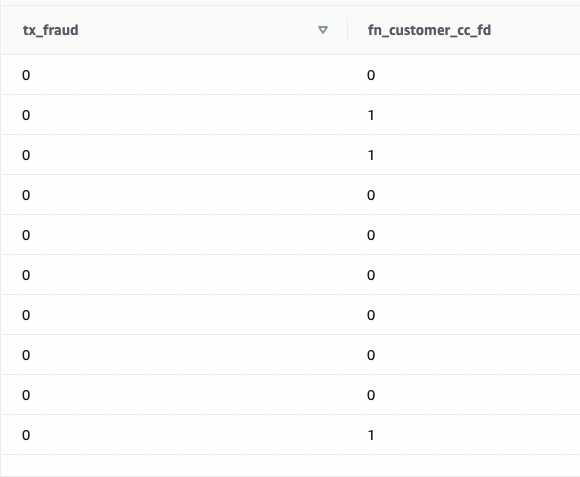

테스트 데이터 세트로 이 모델을 테스트해 보겠습니다. 샘플 예측을 검색하는 다음 명령어를 실행합니다.

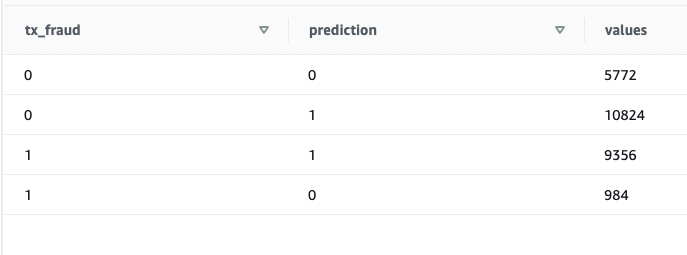

일부 값은 일치하고 일부는 일치하지 않는 것을 볼 수 있습니다. 예측을 실측과 비교해 봅시다.

모델이 작동하고 F1 점수가 좋은지 확인했습니다. 스트리밍 데이터에 대한 예측 생성으로 이동하겠습니다.

사기 거래 예측

Redshift ML 모델은 사용할 준비가 되었기 때문에 이를 사용하여 스트리밍 데이터 수집에 대한 예측을 실행할 수 있습니다. 기록 데이터 세트에는 스트리밍 데이터 원본에 있는 것보다 더 많은 필드가 있지만 사기 거래에 대한 고객 및 터미널 위험에 대한 최신성 및 빈도 메트릭일 뿐입니다.

뷰 내부에 SQL을 내장하여 매우 쉽게 스트리밍 데이터 위에 변환을 적용할 수 있습니다. 만들기 첫 번째 보기, 고객 수준에서 스트리밍 데이터를 집계합니다. 그런 다음 두 번째보기, 터미널 수준에서 스트리밍 데이터를 집계하고 세 번째 보기, 들어오는 트랜잭션 데이터를 고객 및 터미널 집계 데이터와 결합하고 예측 기능을 모두 한 곳에서 호출합니다. 세 번째 보기의 코드는 다음과 같습니다.

뷰에서 SELECT 문을 실행합니다.

SELECT 문을 반복적으로 실행하면 최신 신용 카드 거래가 거의 실시간으로 변환 및 ML 예측을 거칩니다.

이는 Amazon Redshift의 강력한 기능을 보여줍니다. 사용하기 쉬운 SQL 명령을 사용하면 복잡한 창 기능을 적용하여 스트리밍 데이터를 변환하고 ML 모델을 적용하여 복잡한 데이터 파이프라인을 구축하거나 구축 및 관리할 필요 없이 한 번에 사기 거래를 예측할 수 있습니다. 추가 인프라.

솔루션 확장

데이터 스트림 및 ML 예측이 거의 실시간으로 이루어지기 때문에 다음을 사용하여 고객에게 경고하는 비즈니스 프로세스를 구축할 수 있습니다. 아마존 단순 알림 서비스 (Amazon SNS) 또는 운영 시스템에서 고객의 신용 카드 계정을 잠글 수 있습니다.

이 게시물에서는 이러한 작업에 대해 자세히 다루지 않지만 Amazon Redshift를 사용하여 이벤트 기반 솔루션을 구축하는 방법에 대해 자세히 알아보려면 다음을 참조하십시오. GitHub 저장소.

정리

향후 비용이 발생하지 않도록 하려면 이 게시물의 일부로 생성된 리소스를 삭제하십시오.

결론

이 게시물에서는 Kinesis 데이터 스트림을 설정하고 생산자를 구성하고 스트림에 데이터를 게시한 다음 Amazon Redshift Streaming Ingestion 보기를 생성하고 Amazon Redshift에서 데이터를 쿼리하는 방법을 시연했습니다. 데이터가 Amazon Redshift 클러스터에 있는 후, 우리는 ML 모델을 교육하고 예측 함수를 구축하고 이를 스트리밍 데이터에 적용하여 거의 실시간으로 예측을 생성하는 방법을 시연했습니다.

피드백이나 질문이 있으면 댓글에 남겨주세요.

저자에 관하여

바누 핏탐펄리 댈러스에 기반을 둔 Analytics Specialist Solutions Architect입니다. 그는 분석 솔루션 구축을 전문으로 합니다. 그의 배경은 데이터 웨어하우스(아키텍처, 개발 및 관리)에 있습니다. 그는 15년 이상 데이터 및 분석 분야에 있었습니다.

바누 핏탐펄리 댈러스에 기반을 둔 Analytics Specialist Solutions Architect입니다. 그는 분석 솔루션 구축을 전문으로 합니다. 그의 배경은 데이터 웨어하우스(아키텍처, 개발 및 관리)에 있습니다. 그는 15년 이상 데이터 및 분석 분야에 있었습니다.

프라빈 카디피콘다 댈러스에 기반을 둔 AWS의 선임 분석 전문가 솔루션 아키텍트입니다. 그는 고객이 효율적이고 성능이 뛰어나며 확장 가능한 분석 솔루션을 구축하도록 돕습니다. 그는 15년 이상 데이터베이스 및 데이터 웨어하우스 솔루션을 구축하는 일을 했습니다.

프라빈 카디피콘다 댈러스에 기반을 둔 AWS의 선임 분석 전문가 솔루션 아키텍트입니다. 그는 고객이 효율적이고 성능이 뛰어나며 확장 가능한 분석 솔루션을 구축하도록 돕습니다. 그는 15년 이상 데이터베이스 및 데이터 웨어하우스 솔루션을 구축하는 일을 했습니다.

리테시 쿠마르 신하 샌프란시스코에 기반을 둔 Analytics Specialist Solutions Architect입니다. 그는 고객이 16년 이상 확장 가능한 데이터 웨어하우징 및 빅 데이터 솔루션을 구축하도록 도왔습니다. 그는 AWS에서 효율적인 종단 간 솔루션을 설계하고 구축하는 것을 좋아합니다. 여가 시간에는 독서, 걷기, 요가를 좋아합니다.

리테시 쿠마르 신하 샌프란시스코에 기반을 둔 Analytics Specialist Solutions Architect입니다. 그는 고객이 16년 이상 확장 가능한 데이터 웨어하우징 및 빅 데이터 솔루션을 구축하도록 도왔습니다. 그는 AWS에서 효율적인 종단 간 솔루션을 설계하고 구축하는 것을 좋아합니다. 여가 시간에는 독서, 걷기, 요가를 좋아합니다.

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- 플라토 블록체인. Web3 메타버스 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 출처: https://aws.amazon.com/blogs/big-data/near-real-time-fraud-detection-using-amazon-redshift-streaming-ingestion-with-amazon-kinesis-data-streams-and-amazon-redshift-ml/

- 000

- 000 명의 고객

- 1

- 10

- 100

- 11

- 15년

- 67

- 7

- 9

- a

- 할 수 있는

- 소개

- 위의

- ACCESS

- 계정

- 달성

- 동작

- 추가

- 관리

- 많은

- 후

- 반대

- 경보

- All

- 수

- 아마존

- Amazon EC2

- 아마존 키네 시스

- 양

- 애널리스트

- 분석

- 분석

- 분석하다

- 과

- 이상 감지

- 아파치

- 어플리케이션

- 신청

- 적용

- 아키텍처

- 약

- 붙이다

- 자동

- Automatic

- 자동적으로

- 가능

- 피하고

- AWS

- 배경

- 기반으로

- 기본

- 때문에

- 된다

- BEST

- 더 나은

- 사이에

- 큰

- 빅 데이터

- 가져

- 빌드

- 건물

- 사업

- 비즈니스 프로세스

- 사업

- 전화

- 라는

- 통화

- 포착

- 카드

- 케이스

- 가지 경우

- 문자

- 요금

- 검사

- 왼쪽 메뉴에서

- City

- 클라우드

- 클러스터

- 암호

- 열

- 결합

- 오는

- 댓글

- 비교

- 완전한

- 완료

- 복잡한

- 복잡성

- 계산

- 고려하다

- 콘솔에서

- 소비

- 소비자

- 이 포함되어 있습니다

- 비용 효율적인

- 수

- 만들

- 만든

- 생성

- 만들기

- 신임장

- 신용

- 크레디트 카드

- 고객

- 고객 데이터

- 고객

- 주기

- 매일

- 달라스

- 데이터

- 데이터 준비

- 데이터웨어 하우스

- 데이터웨어 하우스

- 데이터베이스

- 데이터베이스

- 데이터 세트

- 날짜

- 의사 결정

- 태만

- 정의

- 배달하다

- 시연

- 의존하는

- 배포

- 배포

- 배치하다

- 기술 된

- 디자인

- 세부설명

- Detection System

- 개발자

- 개발

- 다른

- 직접

- 하지 않습니다

- 하기

- 말라

- 다우 지수

- 동적

- 용이하게

- 사용하기 쉬운

- 효과

- 효율적인

- 이메일

- 가능

- 수

- 끝으로 종료

- 엔지니어링

- 엔터 버튼

- 에테르 (ETH)

- 이벤트

- 이벤트

- 예

- 흥분한

- 외부

- 추출

- f1

- 익숙한

- FAST

- 특색

- 특징

- 피드백

- 들

- Fields

- 필터

- 금융

- Find

- 플래그

- 흐름

- 따라

- 수행원

- 다음

- 형태

- 체재

- 발견

- FRAME

- 시스코

- 사기

- 사기 탐지

- 무료

- 진동수

- 에

- 충분히

- 기능

- 기능

- 미래

- 생성

- 생성

- 생성

- 발전기

- 얻을

- 주기

- Go

- 좋은

- 부여

- 육로

- 그룹

- 데

- 도움

- 도움이

- 더 높은

- 강조

- 역사적인

- history

- 방법

- How To

- HTML

- HTTPS

- 수백

- IAM

- 확인

- 통합 인증

- 중요성

- in

- 포함

- 들어오는

- 증가

- 증가

- 개인

- 정보

- 인프라

- 입력

- 삽입물

- 통찰력

- 설치

- 예

- 학회

- 명령

- 관심있는

- IT

- 어울리다

- JSON

- 카프카

- Kinesis 데이터 스트림

- 언어

- 큰

- 숨어 있음

- 최근

- 시작

- 배우기

- 휴가

- 길이

- 레벨

- 제한

- 한정

- 하중

- 잔뜩

- 장기

- 낮은

- 기계

- 기계 학습

- 만든

- 확인

- 제작

- 관리

- 관리

- 수동으로

- .

- 지도

- 거대한

- 어울리는

- 매트플롯립

- 최대

- 방법

- 미디어

- 방법

- 메트릭

- 통계

- 완화

- ML

- 모드

- 모델

- 모델

- 월

- 개월

- 배우기

- 가장

- 움직임

- name

- 카테고리

- 필요

- 요구

- 신제품

- 다음 것

- 공고

- 번호

- numpy

- 목표

- ONE

- 열립니다

- 조작

- 운영

- 행정부

- 기회

- 옵션

- 주문

- 조직

- 기타

- 설명

- 패키지

- 팬더

- 빵

- 매개 변수

- 부품

- 완전한

- 수행

- 성능

- 수행하다

- 권한

- 전화

- 장소

- 계획

- 플랫폼

- 플랫폼

- 플라톤

- 플라톤 데이터 인텔리전스

- 플라토데이터

- 부디

- 정책

- 정책

- 가능한

- 게시하다

- 힘

- Precision

- 예측

- 예측

- 예측

- 예측

- 너무 이른

- 가격

- 방법

- 프로세스

- 제작자

- 프로그램

- 제공

- 제공

- 공개

- 게시

- Python

- 문의

- 빨리

- 닥치는대로의

- 읽기

- 준비

- 현실

- 실시간

- 실시간 데이터

- 실현

- 받다

- 접수

- 최근

- 인정

- 기록

- 자꾸

- 교체

- 필수

- 의지

- 자료

- REST

- 결과

- 반품

- 위험

- 직위별

- 달리기

- 달리는

- 현자

- 산

- 샌프란시스코

- 확장성

- 규모

- 스크린 샷

- SDK

- Seaborn

- 둘째

- 초

- 섹션

- 섹션

- 안전해야합니다.

- 선택된

- 선택

- 서버리스

- 서비스

- 세트

- 설정

- 설정

- 설치

- 단기간의

- 표시

- 쇼

- 단순, 간단, 편리

- 단순화

- 시뮬레이터

- So

- 사회적

- 소셜 미디어

- 해결책

- 솔루션

- 일부

- 출처

- 지우면 좋을거같음 . SM

- 전문가

- 전문적으로

- 지출

- 분열

- SQL

- 단계

- 표준

- 시작

- 주 정부

- 성명서

- 문

- Status

- 단계

- 단계

- 저장

- 저장

- 상점

- 전략의

- 흐름

- 스트리밍

- 스트리밍 서비스

- 스트림

- 이러한

- 감독자

- 체계

- 시스템은

- 테이블

- 받아

- 소요

- 회담

- 목표

- 단말기

- test

- XNUMXD덴탈의

- 제삼

- 수천

- 을 통하여

- 시간

- 따라서 오른쪽 하단에

- 에

- 상단

- 화제

- 전통적으로

- Train

- 훈련 된

- 트레이닝

- 거래

- 거래상의

- 거래 내역

- 변환

- 변환

- 변화

- 경향

- 업데이트

- 업데이트

- 용법

- 사용

- 사용자

- 검증 된

- 가치

- 마케팅은:

- 여러

- 진실성

- 버전

- 관측

- 보기

- 걷기

- 연습

- 창고

- 창고

- 웹 사이트

- 주말

- 주간

- 뭐

- 어느

- 동안

- 위키 백과

- 의지

- 없이

- 일

- 일하는

- 일

- 쓰다

- 년

- 요가

- 너의

- 제퍼 넷