Meta는 이번에는 소프트웨어 소스 코드 생성을 위해 조정된 또 다른 종류의 개방형 기계 학습 모델을 출시했습니다.

코드 라마 Llama 2 모델을 기반으로 하는 대규모 언어 모델 제품군입니다. 따라서 가끔 대문자로 "LLaMA"를 사용합니다. 출시 XNUMX월에. 선조와 같은 산문 대신 텍스트 프롬프트에 대한 응답으로 소스 코드를 제공하고 논의하도록 미세 조정되고 훈련되었습니다.

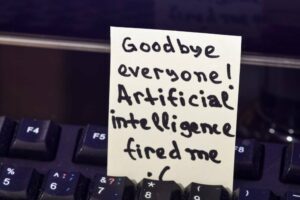

모든 최첨단 기술과 마찬가지로 Code Llama에도 위험이 따릅니다.

Meta는 "Code Llama는 프로그래머가 더욱 강력하고 잘 문서화된 소프트웨어를 작성하는 데 도움이 되는 생산성 및 교육 도구로 사용될 수 있는 잠재력을 가지고 있습니다."라고 주장했습니다. 발표 목요일.

Code Llama에게 피보나치 수열을 생성하는 함수를 작성하도록 요청하면 모델은 소스를 설명하는 코드와 자연어를 모두 생성한다고 Meta는 말합니다. 그리고 AI 모델은 Python, C++, Java, PHP, Typescript(Javascript), C#, Bash 및 기타 언어로 이를 수행할 수 있습니다.

그러나 모델은 다른 언어로 안전 테스트를 거치지 않았으므로 사용자는 Code Llama를 영어로 설명하도록 안내됩니다. 범위 밖 언어.

Meta는 “모든 최첨단 기술과 마찬가지로 Code Llama에도 위험이 따른다”고 설명하면서 악성 코드 생성을 요청하기 위한 자체 레드팀 테스트 중에 Code Llama가 ChatGPT(GPT3.5 Turbo)보다 더 안전한 답변으로 응답했다고 언급했습니다.

Meta에 따르면 Code Llama는 두 가지 벤치마크에서 오픈 소스, 코드별 LLM 및 상위 Llama 2보다 성능이 뛰어납니다. 인간평가 그리고 대부분 기본적인 Python 프로그래밍(MBPP) – OpenAI의 ChatGPT 성능과 일치합니다.

Code Llama는 7B, 13B, 34B 매개변수의 세 가지 크기로 제공되며 각 변형은 코드 및 코드 관련 데이터의 500B 토큰으로 훈련되었습니다. 하나의 토큰은 대략 영어로 XNUMX자입니다. OpenAI Codex의 가장 큰 버전이 출시되었을 때 12B 매개변수.

Meta에 따르면 가장 작은 두 가지 Code Llama 모델은 누락된 소스를 채우도록 훈련되어 추가 미세 조정 없이 코드 완성에 사용할 수 있습니다. 34B 버전은 최상의 결과를 제공한다고 알려져 있지만 더 작은 두 버전이 더 빠르게 응답하므로 대기 시간이 눈에 띄는 코드 완성과 같은 작업에 더 좋습니다.

Code Llama – Python과 Code Llama – Instruct의 두 가지 변형도 있습니다. 전자는 추가로 100억 개의 Python 코드 토큰을 사용하여 Code Llama를 미세 조정한 결과입니다. 후자는 입력 및 출력 패턴을 준수하도록 미세 조정되어 코드 생성에 더 적합합니다.

신뢰성, 누구?

LLM은 종종 다음을 제공합니다. 부정 확한 답변 그럼에도 불구하고 많은 개발자는 암기적인 패턴과 API 매개변수를 기억하거나 검색 쿼리 및 문서 확인을 피하기 위해 사용합니다.

Code Llama의 판매 포인트 중 하나는 최대 100,000개의 토큰으로 구성된 코드 시퀀스의 입력 및 출력을 처리할 수 있다는 것입니다. 즉, 많은 코드 줄을 사용하여 모델에 메시지를 표시할 수 있으며 자세한 응답을 얻을 수 있습니다.

Meta는 "더 긴 프로그램을 생성하기 위한 전제 조건 외에도 더 긴 입력 시퀀스를 사용하면 코드 LLM에 대한 흥미롭고 새로운 사용 사례를 열 수 있습니다."라고 설명했습니다. “예를 들어 사용자는 코드베이스에서 더 많은 컨텍스트를 모델에 제공하여 세대의 관련성을 더욱 높일 수 있습니다. 또한 구체적인 문제와 관련된 모든 코드를 파악하는 것이 개발자에게 어려울 수 있는 대규모 코드베이스의 디버깅 시나리오에도 도움이 됩니다."

사용자는 코드베이스에서 더 많은 컨텍스트를 모델에 제공하여 세대의 관련성을 더욱 높일 수 있습니다.

Code Llama는 처음에 OpenAI의 Codex 및 GitHub의 관련 모델에서 시드된 코드 변환 모델 분야에 합류했습니다. 소송으로 인한 부담 Copilot(2021) 프로그래밍 제안 서비스입니다. 뒤따르는 프로그래밍 긍정적 모델에는 DeepMind가 포함됩니다. 알파코드 (2022), OpenAI의 GPT-4 (2023), 아마존 코드 위스퍼러 (2023), Google의 Bard(2023), XNUMX월 조정 생성하는 소스 코드.

또한 다음과 같은 다양한 오픈 소스(또는 일종의 오픈) LLM이 있습니다. 스타코더 및 XGen, 이름 XNUMX입니다.

Meta는 동일한 이름으로 Code Llama를 출시했습니다. 커뮤니티 라이센스 Llama 2에서는 혁신적이고 안전하며 책임감 있는 도구를 개발하는 최선의 방법으로 'AI에 대한 개방형 접근 방식'에 대한 거대 기업의 신념을 인용했습니다.

그러나 Llama 2에서 널리 알려진 것처럼 커뮤니티 라이선스는 다음과 같습니다. 오픈소스 라이선스가 아니다. AI에 대한 Meta의 "개방형 접근 방식"은 경쟁에 폐쇄적입니다. 라이선스는 "다른 대규모 언어 모델을 개선하기 위해" 소프트웨어를 사용하는 것을 명시적으로 금지합니다.

그리고 Meta의 커뮤니티 라이센스는 다양한 라마의 상업적 사용을 허용하지만 "700억 명 이상의 월간 활성 사용자"를 갖춘 서비스에 한계를 긋습니다.

그보다는 그룹 선택 Meta가 아직 운영하지 않는 소셜 미디어 플랫폼 중 YouTube, WeChat, TikTok, LinkedIn, Telegram, Snapchat 및 Douyin과 같은 메가 서비스와 아마도 Apple, Google, Microsoft와 같은 운영 체제 기반 플랫폼을 운영하는 회사는 "요구해야 합니다. Meta가 단독 재량으로 귀하에게 부여할 수 있는 라이센스…” ®

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- PlatoData.Network 수직 생성 Ai. 자신에게 권한을 부여하십시오. 여기에서 액세스하십시오.

- PlatoAiStream. 웹3 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 플라톤ESG. 자동차 / EV, 탄소, 클린테크, 에너지, 환경, 태양광, 폐기물 관리. 여기에서 액세스하십시오.

- PlatoHealth. 생명 공학 및 임상 시험 인텔리전스. 여기에서 액세스하십시오.

- 차트프라임. ChartPrime으로 트레이딩 게임을 향상시키십시오. 여기에서 액세스하십시오.

- BlockOffsets. 환경 오프셋 소유권 현대화. 여기에서 액세스하십시오.

- 출처: https://go.theregister.com/feed/www.theregister.com/2023/08/25/meta_lets_code_llama_run/

- :있다

- :이다

- :아니

- :어디

- $UP

- 000

- 100

- 2021

- 2022

- 2023

- 700

- a

- 활동적인

- 또한

- 주소

- 가입 한

- AI

- All

- 수

- 이미

- 또한

- 아마존

- 중

- an

- 및

- 다른

- 답변

- 어떤

- 누군가

- API를

- Apple

- 접근

- Apr

- 있군요

- AS

- 관련

- At

- 피하고

- 기반으로

- 세게 때리다

- 기본

- BE

- 된

- 존재

- 믿음

- 벤치 마크

- BEST

- 더 나은

- 두

- 비자 면제 프로그램에 해당하는 국가의 시민권을 가지고 있지만

- by

- C + +

- CAN

- 자본화

- 가지 경우

- 도전

- 문자

- ChatGPT

- 확인하는 것이 좋다.

- 주장

- 닫은

- CO

- 암호

- 코드베이스

- 제공

- 상업

- 커뮤니티

- 기업

- 경쟁

- 완성

- 문맥

- 창조

- 절단

- 데이터

- Deepmind

- 개발

- 개발자

- DID

- 토론

- do

- 선적 서류 비치

- 두인

- 무승부

- ...동안

- 마다

- Edge

- 교육적인

- 영어

- 에테르 (ETH)

- 예

- 흥미 진진한

- 설명

- 설명

- 설명

- 여분의

- 가족

- 빠른

- FB

- 피보 나찌

- 들

- 채우기

- 끝

- 다음에

- 럭셔리

- 이전

- 사

- 에

- 기능

- 추가

- 생성

- 생성

- 세대

- 세대

- 얻을

- GitHub의

- 구글

- 부여

- 큰

- 성장하는

- 했다

- 핸들

- 있다

- 데

- 도움

- 도움이

- 금후

- 그러나

- HTTPS

- if

- 개선

- in

- 기타의

- 포함

- 처음에는

- 혁신적인

- 입력

- 를 받아야 하는 미국 여행자

- 발행물

- IT

- 그

- 자바

- 자바 스크립트

- 조인

- JPG

- 7월

- 다만

- 언어

- 언어

- 넓은

- 큰

- 가장 큰

- 숨어 있음

- 배우기

- 수

- 특허

- 처럼

- 라인

- 라인

- 링크드인

- 야마

- 이상

- 기계

- 기계 학습

- 확인

- 유튜브 영상을 만드는 것은

- .

- XNUMX월..

- 미디어

- 메타

- Microsoft

- 수도

- 백만

- 누락

- 모델

- 모델

- 월

- 배우기

- 대개

- 절대로 필요한 것

- name

- 자연의

- 자연어

- 신제품

- 유명한

- 지적

- 가끔

- of

- 자주

- on

- ONE

- 열 수

- 오픈 소스

- OpenAI

- 운영

- or

- 기타

- 초과 수익률

- 출력

- 자신의

- 매개 변수

- 패턴

- 성능

- PHP

- 플랫폼

- 플라톤

- 플라톤 데이터 인텔리전스

- 플라토데이터

- 전철기

- 가능성

- 생산하다

- 생산력

- 선조

- 프로그래머

- 프로그램 작성

- 프로그램

- 제공

- 놓다

- Python

- 쿼리

- 차라리

- RE

- 빨간색

- 관련

- 출시

- 관련된

- 의뢰

- 응답

- 응답

- 책임

- 결과

- 폭동

- 위험

- 강력한

- 거칠게

- 달리기

- 달리는

- s

- 가장 안전한 따뜻함

- 안전

- 안전

- 말했다

- 같은

- 라고

- 라고

- 시나리오

- 검색

- 판매

- 순서

- 서비스

- 서비스

- 크기

- 작은

- Snapchat에서

- So

- 사회적

- 소셜 미디어

- 소셜 미디어 플랫폼

- 소프트웨어

- 무언가

- 출처

- 소스 코드

- T

- 작업

- 팀

- Technology

- 텔레그램

- 조건

- 지원

- 보다

- 그

- XNUMXD덴탈의

- 소스

- 그들의

- 그들

- 그곳에.

- 그들

- 이

- 그래도?

- 세

- 을 통하여

- 목요일

- Tik의 톡

- 시간

- 에

- 토큰

- 토큰

- 수단

- 검색을

- 상단

- 훈련 된

- 두

- 타이프 스크립트

- 아래에

- 잠금 해제

- 사용

- 익숙한

- 사용자

- 사용

- 변형

- 여러

- 버전

- 였다

- 방법..

- 언제

- 어느

- 동안

- 크게

- 위키 백과

- 의지

- 과

- 없이

- 쓰다

- 아직

- 당신

- 유튜브

- 제퍼 넷