오늘날의 세계에서 우리는 다양한 종류의 서면 정보, 즉 일반적으로 다른 사람이 작성한 정보라고 가정하는 정보에 둘러싸여 있습니다. 책, 블로그, 뉴스 기사, 포럼 게시물, 제품 페이지에 대한 피드백, 소셜 미디어 및 댓글 섹션에 대한 토론 등의 형태에서 우리가 읽고 있는 텍스트는 다른 사람이 쓴 것이라고 가정합니다. 그러나 수년에 걸쳐 이 가정은 거짓일 가능성이 점점 더 커졌습니다. 가장 최근에는 요청 시 거의 모든 주제에 대해 그럴듯한 단락을 대량으로 생성할 수 있는 GPT-2 및 GPT-3와 같은 대규모 언어 모델(LLM)로 인해 발생했습니다.

이는 우리가 온라인 댓글, 뉴스 기사, 심지어 전체 책과 영화 대본이 알고리즘에 의해 만들어지지 않았는지 더 이상 합리적으로 확신할 수 없는 지점에 도달하려고 하는지에 대한 질문을 제기합니다. 새로운 뜨거운 경기가 있는 온라인 채팅은 고객과의 최대 참여를 위해 훈련되고 조정된 무감각한 코드 컬렉션을 사용하여 시작하는 것으로 밝혀졌습니다. (편집자 주: 아니요, 여기서는 해당 게임을 플레이하는 것이 아닙니다.)

이러한 기계 생성 콘텐츠와 상호 작용이 점점 더 큰 역할을 하기 시작하면서 생성된 콘텐츠를 어떻게 감지할 수 있는지에 대한 의문과 콘텐츠가 인간이 아닌 알고리즘에 의해 생성되었는지 여부가 중요한지 여부에 대한 의문이 제기됩니다. .

지루함 대 악의

조지 오웰의 1984, 윈스턴 스미스(Winston Smith)는 진실부 내의 소설부(Fiction Department)라는 부서에 대해 설명합니다. 이 부서에서는 기계가 특정 주제를 기반으로 새로 생성된 소설을 지속적으로 생산하고 있습니다. 한편 음악부에서는 검증기(versificator)라는 또 다른 시스템에 의해 새로운 음악이 생성되고 있습니다.

그러나 이 허구의 세계가 디스토피아적인 만큼, 이 기계 생성 콘텐츠는 본질적으로 무해합니다. Winston은 책 뒷부분에서 도시의 프롤레 지역에 있는 여성이 최신 노래를 부르며 그녀 자신의 감정적 강렬함을 더하는 것을 관찰했을 때 말했습니다. 무감각하고 생각도 없는 기계가 뱉어낸 사랑노래. 이는 기계 생성 콘텐츠의 가장 일반적인 사용으로 이어지며, 많은 사람들은 이것이 단지 자동화의 한 형태일 뿐이라고 주장합니다.

여기서 포괄적인 용어는 '자동화된 저널리즘', 그리고 사용 중 Reuters, AP 및 기타 유명 언론 매체와 수년간 협력해 왔습니다. 여기서 사용 사례는 간단하고 간단합니다. 이는 주식 실적, 회사 분기별 보고서, 스포츠 경기 결과 또는 지방 선거에 대한 정보를 수집하고 미리 설정된 패턴에 따라 기사를 대량으로 생성하도록 구성된 시스템입니다. 분명한 이점은 점수와 성과 지표를 기사 템플릿에 지루하게 복사하는 기자들로 가득 찬 방을 컴퓨터 알고리즘으로 대체할 수 있다는 것입니다.

이러한 경우 패스트푸드점에서 버거를 뒤집는 것과 같은 저널리즘적 또는 예술적 작업과 관련된 작업은 결코 지루하거나 산만해지지 않는 알고리즘으로 대체되는 반면, 인간은 지적으로 더 어려운 작업을 수행할 수 있습니다. 이러한 종류의 자동화에 문제가 있다고 주장하는 사람은 거의 없습니다. 기본적으로 우리가 약속한 대로 정확하게 작동하기 때문입니다.

문제가 되는 부분은 검색 트래픽을 유인하는 등 악의적인 목적으로 사용되는 경우입니다. 기계 생성 기사 독자에게 무언가를 팔려고 노력하는 것입니다. 비록 이것이 최근에 발생했지만 상당한 분노 CNET의 경우 문제는 이것이 엄청나게 수익성이 높은 접근 방식이므로 앞으로 더 많이 볼 수 있다는 것입니다. 결국, 대규모 언어 모델은 인간 작가가 텍스트 몇 단락을 적는 데 걸리는 시간 안에 전체 기사 스택을 생성할 수 있습니다.

회색지대에 더 가까운 것은 인간 작가를 돕는 것과 관련이 있는 곳인데, 이는 과학 출판계에서 문제가 되고 있습니다. 최근에 덮여 by 가디언, 그는 2020년 XNUMX월에 약간의 묘기를 선보였습니다. 기사를 게시 GPT-3 LLM에 의해 생성되었습니다. 주의할 점은 그것이 LLM의 직접적인 출력이 아니라 인간 편집자가 GPT-3에서 생성된 여러 출력에서 함께 의아해한 결과라는 것입니다. 이는 LLM이 일반적으로 사용되는 방식을 나타내며 LLM의 가장 큰 약점 중 일부를 암시합니다.

오답 없음

그 핵심에는 다음과 같은 LLM이 있습니다. GPT-3 훈련 데이터 세트를 형성하는 입력 텍스트에서 생성된 값의 밀접하게 상호 연결된 데이터베이스입니다. GPT-3의 경우 약 800GB 크기의 데이터베이스(모델)가 됩니다. 이 데이터베이스에서 검색하기 위해 일반적으로 질문 또는 선행 문구로 쿼리 문자열이 제공되며, 처리 후 곡선 피팅 알고리즘에 대한 입력을 형성합니다. 기본적으로 이는 입력 쿼리가 모델 섹션과 관련될 확률을 결정합니다.

가능한 일치 항목이 발견되면 모델 데이터베이스 내에서 가장 가능성이 높은 다음 연결을 기반으로 출력이 생성될 수 있습니다. 이를 통해 LLM은 대규모 데이터 세트 내에서 특정 정보를 찾고 이론적으로 무한히 긴 텍스트를 생성할 수 있습니다. 그러나 입력 쿼리가 의미가 있는지 또는 생성된 출력이 논리적인지 여부를 판단하는 것은 불가능합니다. 알고리즘이 결정할 수 있는 모든 것은 출력을 혼합하기 위해 유도된 변형이 있을 수 있는 가능성이 가장 높은 코스를 따르는지 여부입니다.

LLM 생성 텍스트에서 여전히 문제로 간주되는 것은 반복이지만, 특정 단어가 사용되는 횟수를 줄이기 위해 출력에 '메모리'를 제공하는 일부 조정을 통해 이 문제를 해결할 수 있습니다. 해결하기 더 어려운 것은 LLM 출력의 절대적인 신뢰입니다. LLM 출력이 단지 말도 안되는 소리를 생산하고 있는지 확인하고 행복하게 계속 옹알이를 할 것인지 확인할 방법이 없기 때문입니다.

그럼에도 불구하고 인간 피험자가 GPT-3 및 GPT-2 생성 텍스트를 받게 되면 2021 연구 Elizabeth Clark 등의 연구에 따르면, 일부 교육 후에도 LLM에서 생성된 텍스트를 인식할 가능성은 55%를 초과하지 않아 순전히 우연과 거의 유사합니다. 인간이 이러한 LLM에서 생성된 텍스트를 인식하는 데 그토록 형편없는 이유는 무엇이며, 컴퓨터가 여기서 우리를 도울 수 있을까요?

통계 대 직관

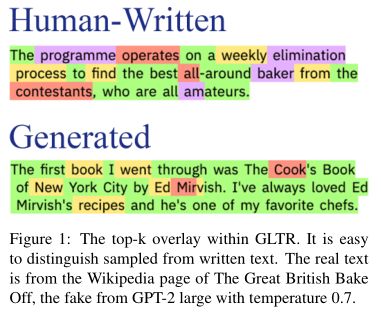

(제공: Gehrmann et al., 2019)

인간에게 주어진 텍스트가 인간에 의해 생성되었는지 아니면 기계에 의해 생성되었는지 물을 때, 그들은 본질적으로 자신의 경험, '직감' 및 다양한 단서를 기반으로 추측할 가능성이 높습니다. 안에 2019 용지 Sebastian Gehrmann et al.은 자동 생성 텍스트의 다양한 사악한 사례를 식별하는 것 외에도 기계 생성 텍스트를 탐지하는 통계적 접근 방식을 제안했습니다. 여기에는 미국의 망 중립성에 반대하는 가짜 댓글과 오해의 소지가 있는 리뷰가 포함됩니다.

Gehrmann et al.이 자세히 설명한 통계적 접근 방식. Giant Language Model Test Room(GLTR, GitHub 소스)는 주어진 텍스트의 예측 가능성을 분석하는 작업을 포함합니다. 이것은 독자들이 기계 생성 텍스트의 '얕음'이라고 자주 설명하는 특징입니다. 실제로 많은 말을 하지 않고 문단을 계속 맴돌고 있다는 점입니다. GLTR과 같은 도구를 사용하면 이러한 텍스트는 제한적이고 예측 가능한 어휘를 사용하므로 시각적 표현에서 대부분 녹색으로 켜집니다.

In Daphne Ippolito et al.이 발표한 논문. (PDF) 2020년 전산 언어학 협회 회의에서는 기계 생성 텍스트를 탐지하는 다양한 접근 방식과 함께 단독으로 사용되는 방법과 결합된 방식으로 사용되는 방법의 효율성을 다룹니다. GLTR에서 사용하는 top-k 분석 접근 방식이 이러한 방법에 포함되어 있으며, 핵 샘플링(top-p)의 대체 접근 방식과 다른 접근 방식도 설명되어 있습니다.

궁극적으로 이 연구에서 인간 피험자는 GPT-74 텍스트를 분류할 때 중앙값 2%를 기록했으며 자동화된 판별기 시스템은 일반적으로 더 나은 점수를 받았습니다. 주목할 만한 연구는 Ari Holtzmanet al. 이는 결론에서 언급되며, 인간이 작성한 텍스트는 일반적으로 낮은 확률 영역에 들락날락하는 흐름을 가지고 있다는 점에 주목합니다. 이는 텍스트를 읽기 흥미롭게 만드는 요소일 뿐만 아니라 인간 독자에게 텍스트를 자연스럽게 보이게 만드는 요소에 대한 단서를 제공합니다.

GPT-3과 같은 최신 LLM을 사용하면 Holtzman et al.이 제안한 핵 샘플링과 같은 접근 방식이 가능합니다. 인간이 쓴 텍스트에서 기대할 수 있는 보다 자연스러운 흐름을 제공하는 것입니다. 상위 k 옵션 목록에서 선택하는 대신 동적으로 크기가 조정된 후보 풀에서 확률 질량을 선택합니다. 결과 옵션 목록인 top-p는 GPT-2 및 kin에 사용된 top-k 접근 방식보다 훨씬 더 풍부한 출력을 제공합니다.

이것이 의미하는 바는 텍스트의 자동 분석에서 다양한 접근 방식을 고려해야 한다는 것입니다. 인간 독자에 의한 분석의 경우, top-k(GPT-2) 텍스트와 top-p(GPT-3) 텍스트 간의 차이는 극명하며 후자 유형은 인간이 작성한 것으로 식별될 가능성이 높습니다.

불확실한 시간

따라서 주어진 텍스트가 인간에 의해 생성되었는지 여부에 대한 질문에 대한 대답은 결정적인 '아마도'인 것처럼 보입니다. 통계 분석은 LLM에 의해 생성된 텍스트의 가능성에 대한 몇 가지 힌트를 제공할 수 있지만 궁극적으로 최종 판단은 텍스트가 의미론적으로나 문맥적으로 통과 여부를 판단할 수 있을 뿐만 아니라 확인도 할 수 있는 사람에 의해 이루어져야 합니다. 진짜 텍스트의 추정 출처.

당연히, 그 안에 있는 정보가 사실적으로 정확하다면 누가 글을 썼는지가 중요하지 않은 상황이 많이 있습니다. 그러나 사악한 의도나 속이려는 의도가 있는 경우에는 상당한 주의를 기울여야 합니다. 자동 감지 알고리즘이 있고 훈련되고 주의 깊은 사용자가 있더라도 정보를 상호 참조하고 소셜 미디어에서 임의의 계정이 작성한 진술이 진짜인지 확인해야 하는 책임은 독자에게 있습니다.

(편집자 주: OpenAI가 자체 산문을 감지하려는 시도에 대한 이 게시물 이 기사가 작성되고 출판되는 사이에 나왔습니다. 그들의 결과는 그다지 좋지 않으며 "Open"AI의 모든 것과 마찬가지로 그들의 방법도 공개되지 않습니다. 하지만 분류기를 시험해 볼 수는 있습니다.)

- SEO 기반 콘텐츠 및 PR 배포. 오늘 증폭하십시오.

- 플라토 블록체인. Web3 메타버스 인텔리전스. 지식 증폭. 여기에서 액세스하십시오.

- 출처: https://hackaday.com/2023/02/01/detecting-machine-generated-content-an-easier-task-for-machine-or-human/

- 1

- 2019

- 2020

- a

- 소개

- 절대

- 계정

- 또한

- 이점

- 후

- 연산

- 알고리즘

- All

- 수

- 이기는하지만

- 분석

- 분석하는

- 및

- 다른

- 답변

- 접근

- 구혼

- 지역

- 논쟁

- 약

- 기사

- 기사

- 예술적인

- 협회

- 가정

- 자동화

- Automatic

- 자동화

- 기반으로

- 원래

- 곰들

- 가

- 되고

- 존재

- 더 나은

- 사이에

- 더 큰

- 가장 큰

- 비트

- 블로그

- 책

- 도서

- 지루한

- 돋보이게

- 운율

- 라는

- 후보자

- 케이스

- 가지 경우

- 조심성 있는

- 어떤

- 도전

- 기회

- 특성

- 검사

- City

- CNET

- 암호

- 수집

- 결합 된

- 본문

- 댓글

- 공통의

- 회사

- 컴퓨터

- 컴퓨터

- 우려 사항

- 결론

- 자신

- 연결

- 고려

- 끊임없이

- 함유량

- 사자

- 핵심

- 코스

- 적용

- 만들

- 만든

- 신용

- 곡선

- 고객

- 절단

- 데이터

- 데이터 세트

- 데이터베이스

- 결정적인

- 학과

- 기술 된

- 무례

- 상세한

- 결정

- 결정하다

- 근민

- 토론

- 하지 않습니다

- 아래 (down)

- 디스토피아

- 쉽게

- 편집자

- 유효성

- 선거

- 포함

- 약혼

- 전체의

- 동등한

- 본질적으로

- 에테르 (ETH)

- 조차

- EVER

- 모두

- 정확하게

- 넘다

- 기대하는

- 체험

- 모조품

- 패션

- FAST

- 피드백

- 를

- 소설

- 꾸며낸

- Film

- 최후의

- Find

- 입어 보기

- 수행원

- 다음

- 식품

- 포브스

- 형태

- 양식

- 포럼

- 발견

- 에

- 가득 찬

- 미래

- 경기

- 일반적으로

- 생성

- 생성

- 생성

- 조지

- 얻을

- 점점

- 거대한

- 주기

- 주어진

- 큰

- 초록색

- 데

- 무겁게

- 도움

- 여기에서 지금 확인해 보세요.

- 힌트

- 방법

- 그러나

- HTTPS

- 사람의

- 인간

- 확인

- 식별

- in

- 포함

- 포함

- 엄청나게

- 정보

- 입력

- 를 받아야 하는 미국 여행자

- 의지

- 상호 작용

- 상호 연결된

- 흥미있는

- 격리

- 발행물

- IT

- 관절

- 기자

- 유지

- 혈연

- 종류

- 언어

- 넓은

- 최근

- 지도

- 지도

- 빛

- 아마도

- 제한된

- 언어학

- 명부

- 지방의

- 긴

- 이상

- 애정

- 낮은

- 기계

- 기계

- 만든

- 제작

- 유튜브 영상을 만드는 것은

- .

- 질량

- 경기

- 문제

- 사항

- 최대 폭

- 최고

- 방법

- 그 동안에

- 미디어

- 회의

- 단지

- 방법

- 통계

- 수도

- 내각

- 모델

- 모델

- 현대

- 배우기

- 가장

- 여러

- 음악

- 자연의

- 그물

- 망 중립성

- 신제품

- news

- 다음 것

- 유명한

- 번호

- 관찰

- 분명한

- ONE

- 온라인

- 반대

- 옵션

- 주문

- 기타

- 기타

- 아웃렛

- 자신의

- 서

- 패스

- 무늬

- 성능

- 혹시

- 사람

- 장소

- 플라톤

- 플라톤 데이터 인텔리전스

- 플라토데이터

- 그럴듯한

- 연극

- 연주

- 많은

- 포인트 적립

- 풀

- 게시하다

- 게시물

- 연습

- 예측 가능

- 제시

- 확률

- 문제

- 처리

- 프로덕트

- 수익성

- 약속 한

- 제안 된

- 제공

- 제공

- 제공

- 공개적으로

- 출판

- 출판

- 목적

- 놓다

- 문제

- 제기

- 닥치는대로의

- 범위

- 도달

- 읽기

- 리더

- 독자들

- 읽기

- 최근에

- 관련

- 유적

- 대체

- 보고서

- 대표

- 요청하신

- 해결

- 존경받는

- 결과

- 결과

- 로이터

- 리뷰

- 직위별

- 방

- 객실

- 거칠게

- 점수

- 스크립트

- 검색

- 섹션

- 섹션

- 팔다

- 감각

- XNUMX월

- 세트

- 단순, 간단, 편리

- 상황

- 크기

- So

- 사회적

- 소셜 미디어

- 일부

- 무언가

- 출처

- 지우면 좋을거같음 . SM

- 구체적인

- 스포츠

- 스택

- 뚜렷한

- 성명서

- 통계적인

- 아직도

- 재고

- 직진

- 똑 바른

- 교육과정

- 이러한

- 둘러싸인

- 체계

- 시스템은

- 받아

- 소요

- 태스크

- 템플릿

- test

- XNUMXD덴탈의

- 미래

- 정보

- 세계

- 그들의

- 그들 자신

- 일

- 시간

- 시대

- 에

- 오늘의

- 함께

- 수단

- 화제

- 교통

- 훈련 된

- 트레이닝

- 궁극적으로

- us

- 사용

- 사용자

- 마케팅은:

- 여러

- 대

- 뭐

- 여부

- 어느

- 동안

- 누구

- 위키 백과

- 의지

- 이내

- 없이

- 여자

- 워드

- 작업

- 세계

- 겠지

- 작가

- 쓴

- 잘못된

- 년

- 제퍼 넷