データ ウェアハウス プラットフォームで実行されるデータ ウェアハウスと分析の重要性は、長年にわたって着実に増加しており、多くの企業がこれらのシステムを短期的な運用上の意思決定と長期的な戦略計画の両方でミッション クリティカルなものとして依存するようになっています。 従来、データ ウェアハウスは、毎月、毎週、または毎日などのバッチ サイクルで更新されるため、企業はデータ ウェアハウスからさまざまな洞察を得ることができます。

多くの組織は、高度な分析とほぼリアルタイムのデータ取り込みによって新しい機会が開かれることを認識しています。 たとえば、金融機関は、異常検出プログラムをバッチ モードではなくほぼリアルタイム モードで実行することにより、クレジット カード取引が不正かどうかを予測できます。

この投稿では、その方法を示します Amazonレッドシフト ストリーミング インジェストと機械学習 (ML) 予測をすべて XNUMX つのプラットフォームで提供できます。

Amazon Redshift は、標準 SQL を使用してすべてのデータを簡単かつ費用対効果の高い方法で分析できる、高速でスケーラブルで安全な完全マネージド型のクラウド データ ウェアハウスです。

Amazon Redshift ML データ アナリストやデータベース開発者は、Amazon Redshift データ ウェアハウスで使い慣れた SQL コマンドを使用して、ML モデルを簡単に作成、トレーニング、適用できます。

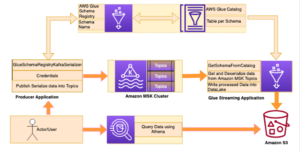

ローンチできることに興奮しています AmazonRedshiftストリーミングの取り込み for Amazon Kinesisデータストリーム および ApacheKafkaのAmazonマネージドストリーミング (Amazon MSK)。データをステージングすることなく、Kinesis データストリームまたは Kafka トピックから直接データを取り込むことができます。 Amazon シンプル ストレージ サービス (アマゾン S3)。 Amazon Redshift ストリーミング インジェストを使用すると、数百メガバイトのデータをデータ ウェアハウスに取り込みながら、数秒単位の低レイテンシーを実現できます。

この投稿では、クラウド データ ウェアハウスである Amazon Redshift で、使い慣れた SQL 言語で Amazon Redshift ストリーミング インジェストと Redshift ML 機能を使用して、ほぼリアルタイムの ML 予測を構築する方法を示します。

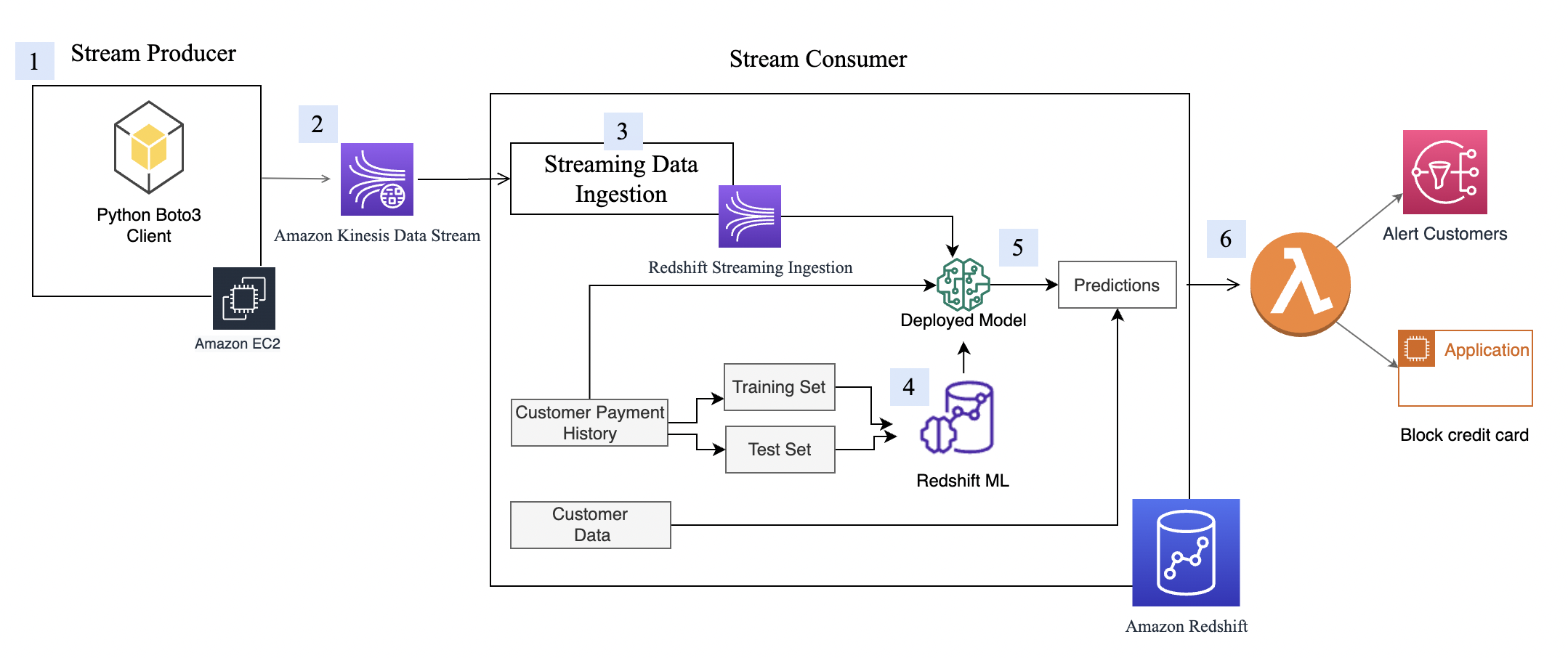

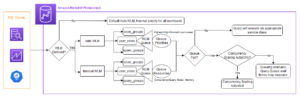

ソリューションの概要

この投稿で概説されている手順に従うことで、プロデューサー ストリーマー アプリケーションを アマゾン エラスティック コンピューティング クラウド クレジットカード取引をシミュレートし、リアルタイムでデータを Kinesis Data Streams にプッシュする (Amazon EC2) インスタンス。 ストリーミング データが受信される Amazon Redshift で、Amazon Redshift ストリーミング インジェスト マテリアライズド ビューをセットアップします。 Redshift ML モデルをトレーニングして構築し、ストリーミング データに対してリアルタイムの推論を生成します。

段階的なプロセスは次のとおりです。

- EC2 インスタンスは、クレジット カード トランザクションを Kinesis データ ストリームに挿入するクレジット カード トランザクション アプリケーションをシミュレートします。

- データ ストリームには、着信クレジット カード トランザクション データが格納されます。

- Amazon Redshift Streaming Ingestion マテリアライズド ビューがデータ ストリームの上に作成され、ストリーミング データが Amazon Redshift に自動的に取り込まれます。

- Redshift ML を使用して ML モデルを構築、トレーニング、デプロイします。 Redshift ML モデルは、過去のトランザクション データを使用してトレーニングされます。

- ストリーミング データを変換し、ML 予測を生成します。

- リスクを軽減するために、顧客に警告したり、アプリケーションを更新したりできます。

このチュートリアルでは、クレジット カード トランザクションのストリーミング データを使用します。 クレジット カードの取引データは架空のものであり、 シミュレータ. 顧客データセットも架空のものであり、いくつかのランダム データ関数で生成されます。

前提条件

- AmazonRedshiftクラスターを作成する.

- Redshift ML を使用するようにクラスターを構成する.

- 創造する an AWS IDおよびアクセス管理 (IAM) ユーザー。

- Redshift クラスターにアタッチされた IAM ロールを更新して、Kinesis データ ストリームにアクセスするためのアクセス許可を含めます。 必要なポリシーの詳細については、次を参照してください。 ストリーミング取り込みの開始.

- m5.4xlarge EC2 インスタンスを作成する. Producer アプリケーションを m5.4xlarge インスタンスでテストしましたが、他のインスタンス タイプを自由に使用できます。 インスタンスを作成するときは、 amzn2-ami-kernel-5.10-hvm-2.0.20220426.0-x86_64-gp2 あみ。

- Python3 が EC2 インスタンスにインストールされていることを確認するには、次のコマンドを実行して Python のバージョンを確認します (データ抽出スクリプトは Python 3 でのみ機能することに注意してください)。

- 次の依存パッケージをインストールして、シミュレーター プログラムを実行します。

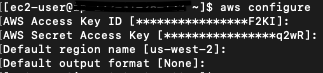

- 上記のステップ 2 で作成した IAM ユーザー用に生成された AWS 認証情報などの変数を使用して、Amazon EC3 を設定します。 次のスクリーンショットは、 aws configure.

Kinesis Data Streams をセットアップする

Amazon Kinesis Data Streams は、非常にスケーラブルで耐久性のあるリアルタイム データ ストリーミング サービスです。 Web サイトのクリックストリーム、データベース イベント ストリーム、金融取引、ソーシャル メディア フィード、IT ログ、位置追跡イベントなど、何十万ものソースから毎秒ギガバイトのデータを継続的にキャプチャできます。 収集されたデータはミリ秒単位で利用できるため、リアルタイム ダッシュボード、リアルタイムの異常検出、動的価格設定などのリアルタイム分析のユース ケースが可能になります。 Kinesis Data Streams を使用しているのは、使用状況に基づいてスケーリングできるサーバーレス ソリューションだからです。

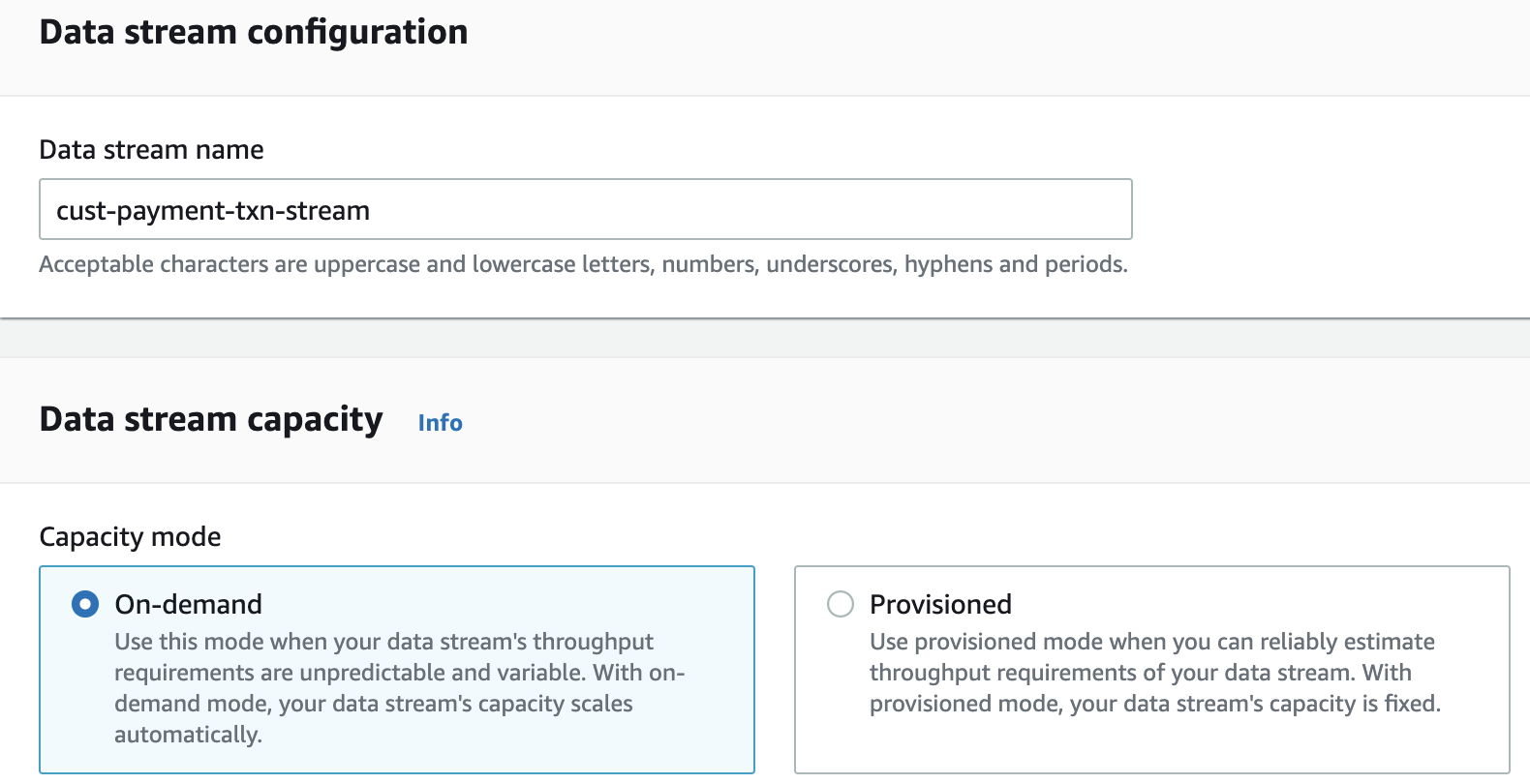

Kinesisデータストリームを作成する

まず、ストリーミング データを受信するための Kinesis データ ストリームを作成する必要があります。

- Amazon Kinesisコンソールで、 データストリーム ナビゲーションペインに表示されます。

- 選択する データストリームを作成する.

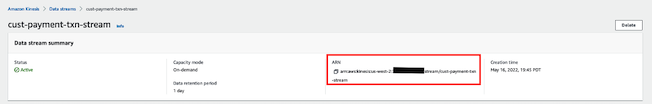

- データストリーム名、 入る

cust-payment-txn-stream. - 容量モード選択 オンデマンドセミナー.

- 残りのオプションについては、デフォルトのオプションを選択し、プロンプトに従ってセットアップを完了します。

- 作成したデータ ストリームの ARN をキャプチャして、IAM ポリシーを定義するときに次のセクションで使用します。

権限を設定する

ストリーミングアプリケーションが Kinesis Data Streams に書き込むには、アプリケーションが Kinesis にアクセスできる必要があります。 次のポリシー ステートメントを使用して、次のセクションで設定するシミュレーター プロセスにデータ ストリームへのアクセスを許可できます。 前のステップで保存したデータ ストリームの ARN を使用します。

ストリーム プロデューサーを構成する

Amazon Redshift でストリーミング データを使用する前に、Kinesis データ ストリームにデータを書き込むストリーミング データ ソースが必要です。 この投稿では、カスタムビルドのデータ ジェネレーターと AWS SDK for Python(Boto3) データをデータ ストリームにパブリッシュします。 セットアップ手順については、を参照してください。 プロデューサー シミュレーター. このシミュレーター プロセスは、前の手順で作成したデータ ストリームにストリーミング データをパブリッシュします (cust-payment-txn-stream).

ストリーム コンシューマーを構成する

このセクションでは、ストリーム コンシューマー (Amazon Redshift ストリーミング インジェスト ビュー) の設定について説明します。

Amazon Redshift Streaming Ingestion は、Kinesis Data Streams から Amazon Redshift マテリアライズド ビューへのストリーミング データの低レイテンシーで高速な取り込みを提供します。 で説明されているように、SQL ステートメントを使用して、Amazon Redshift クラスターを設定してストリーミング取り込みを有効にし、自動更新でマテリアライズド ビューを作成できます。 AmazonRedshiftでマテリアライズドビューを作成する. マテリアライズド ビューの自動更新プロセスは、Kinesis Data Streams から Amazon Redshift に XNUMX 秒あたり数百メガバイトのデータでストリーミング データを取り込みます。 これにより、すばやく更新される外部データにすばやくアクセスできます。

マテリアライズド ビューを作成したら、SQL を使用してデータ ストリームからデータにアクセスし、ストリーム上にマテリアライズド ビューを直接作成してデータ パイプラインを簡素化できます。

Amazon Redshift ストリーミング マテリアライズド ビューを設定するには、次の手順を実行します。

- IAM コンソールのナビゲーションペインでポリシーを選択します。

- 選択する ポリシーを作成する.

- という名前の新しい IAM ポリシーを作成します。

KinesisStreamPolicy. ストリーミング ポリシーの定義については、を参照してください。 ストリーミング取り込みの開始. - ナビゲーションペインで、 役割.

- ロールの作成を選択します。

- 選択 AWSサービス 選択して Redshift と Redshift のカスタマイズ可能.

- という新しい役割を作成します。

redshift-streaming-roleポリシーを添付しますKinesisStreamPolicy. - Kinesis Data Streams にマッピングする外部スキーマを作成します。

これで、ストリーム データを使用するマテリアライズド ビューを作成できるようになりました。 SUPER データ型を使用してペイロードをそのまま JSON 形式で保存するか、Amazon Redshift JSON 関数を使用して JSON データを個々の列に解析できます。 この投稿では、スキーマが適切に定義されているため、XNUMX 番目の方法を使用します。

- ストリーミング インジェストのマテリアライズド ビューを作成する

cust_payment_tx_stream. 次のコードで AUTO REFRESH YES を指定すると、ストリーミング インジェスト ビューの自動更新を有効にできます。これにより、データ パイプラインの構築を回避して時間を節約できます。

注意してください json_extract_path_text 長さの制限は 64 KB です。 また、from_varbye は 65KB を超えるレコードをフィルター処理します。

- データを更新します。

Amazon Redshift ストリーミング マテリアライズド ビューは、Amazon Redshift によって自動更新されます。 このように、データの古さについて心配する必要はありません。 マテリアライズド ビューの自動更新では、データがストリームで利用可能になると、データが自動的に Amazon Redshift にロードされます。 この操作を手動で実行する場合は、次のコマンドを使用します。

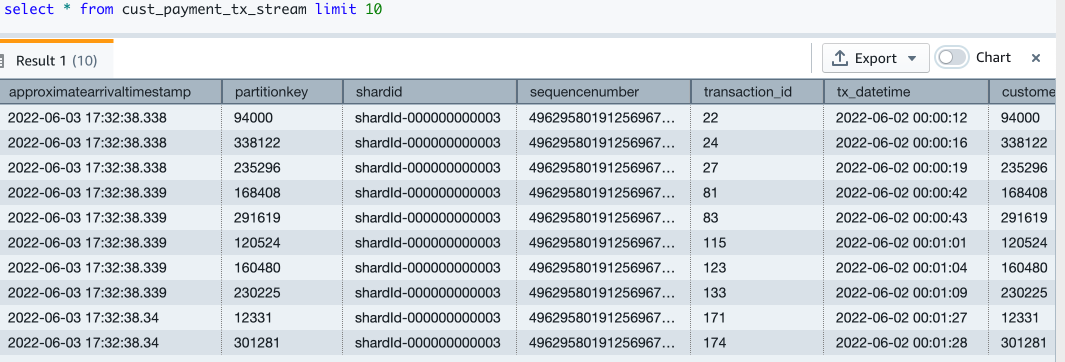

- 次に、ストリーミング マテリアライズド ビューにクエリを実行して、サンプル データを表示します。

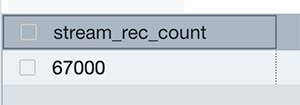

- ストリーミング ビューに含まれるレコードの数を確認してみましょう。

これで、Amazon Redshift ストリーミング インジェスト ビューの設定が完了しました。これは、着信するクレジット カード トランザクション データで継続的に更新されます。 私の設定では、select count クエリを実行した時点で、約 67,000 レコードがストリーミング ビューに取り込まれていることがわかりました。 この番号は、あなたにとって異なる場合があります。

赤方偏移ML

Redshift ML を使用すると、事前トレーニング済みの ML モデルを使用したり、ネイティブに構築したりできます。 詳細については、次を参照してください。 Amazon Redshift での機械学習の使用.

この投稿では、履歴データセットを使用して ML モデルをトレーニングおよび構築します。 データには tx_fraud 過去の取引に不正かどうかのフラグを立てるフィールド。 Redshift Auto ML を使用して教師あり ML モデルを構築します。このモデルは、このデータセットから学習し、予測関数によって実行されるときに着信トランザクションを予測します。

次のセクションでは、履歴データセットと顧客データを設定する方法を示します。

履歴データセットを読み込む

履歴テーブルには、ストリーミング データ ソースよりも多くのフィールドがあります。 これらのフィールドには、ストリーミング データの変換によって計算された不正なトランザクションの数など、顧客の最新の支出とターミナル リスク スコアが含まれています。 週末の取引や夜間の取引などのカテゴリ変数もあります。

履歴データをロードするには、 Amazon Redshiftクエリエディター.

次のコードを使用して、トランザクション履歴テーブルを作成します。 DDL は次の場所にもあります。 GitHubの.

読み込まれたトランザクションの数を確認してみましょう。

毎月の不正取引と非不正取引の傾向を確認します。

顧客データの作成とロード

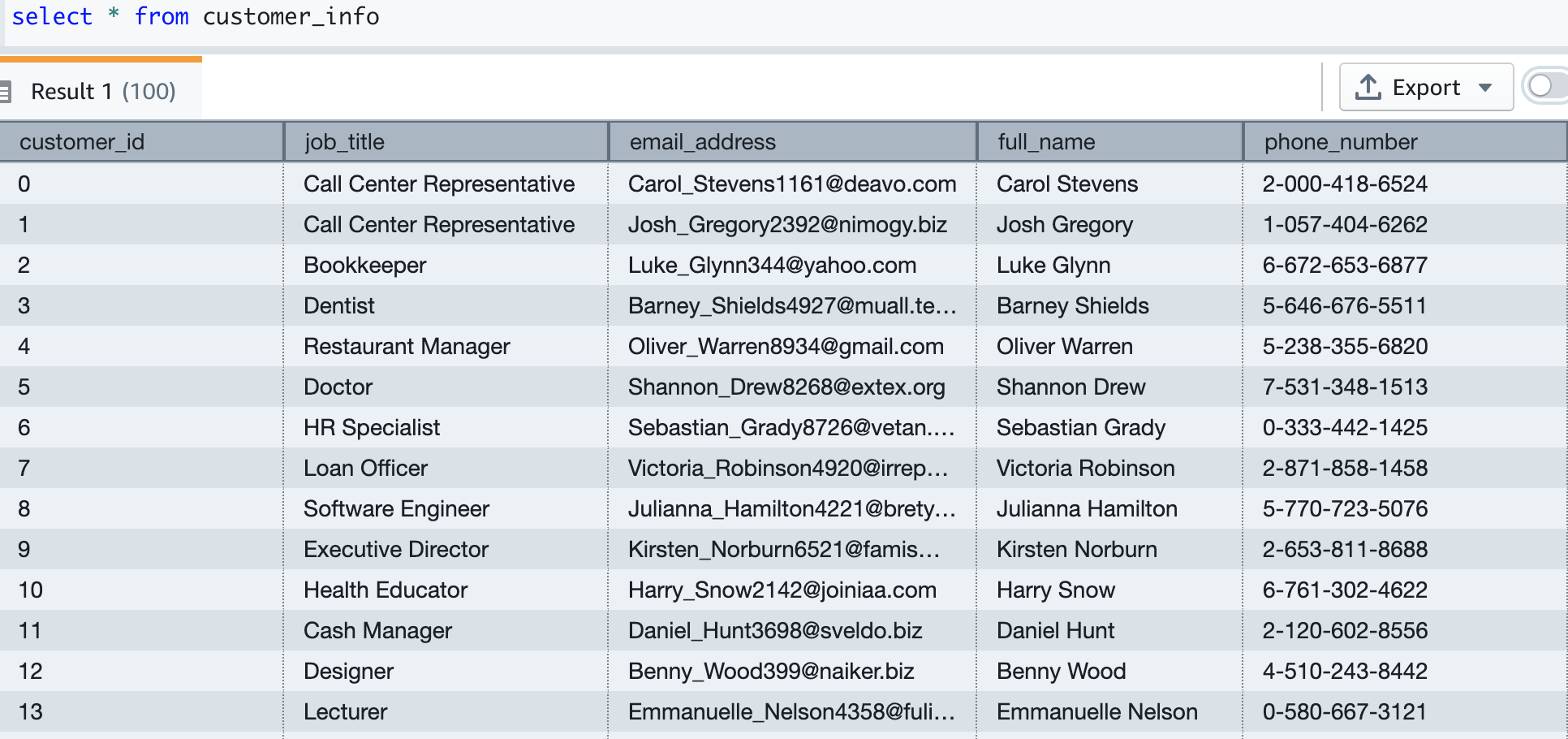

次に、顧客テーブルを作成し、顧客の電子メールと電話番号を含むデータをロードします。 次のコードは、テーブルを作成し、データをロードして、テーブルをサンプリングします。 テーブル DDL は、 GitHubの.

私たちのテスト データには、約 5,000 人の顧客が含まれています。 次のスクリーンショットは、サンプルの顧客データを示しています。

MLモデルを構築する

過去のカード取引テーブルには 6 か月分のデータがあり、ML モデルのトレーニングとテストに使用しています。

このモデルは、次のフィールドを入力として受け取ります。

我々が得る tx_fraud 出力として。

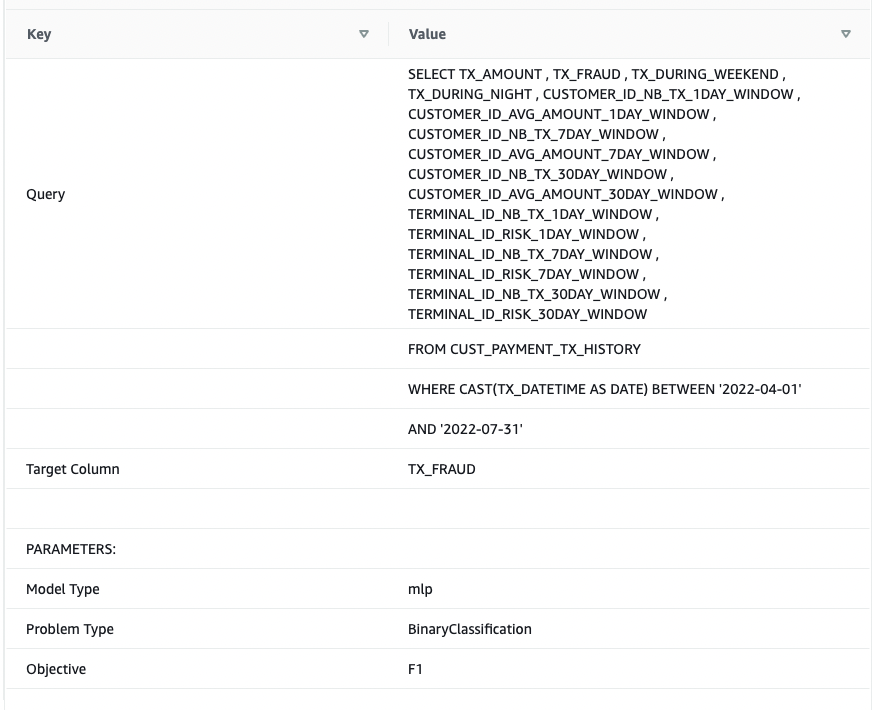

このデータをトレーニング データセットとテスト データセットに分割します。 2022 年 04 月 01 日から 2022 年 07 月 31 日までのトランザクションはトレーニング セット用です。 2022-08-01 から 2022-09-30 までのトランザクションがテスト セットに使用されます。

使い慣れた SQL を使用して ML モデルを作成しましょう CREATE MODEL ステートメント. Redshift ML コマンドの基本的な形式を使用します。 次のメソッドは Amazon SageMakerオートパイロット、データの準備、特徴量エンジニアリング、モデルの選択、およびトレーニングを自動的に実行します。 コードを含む S3 バケットの名前を指定します。

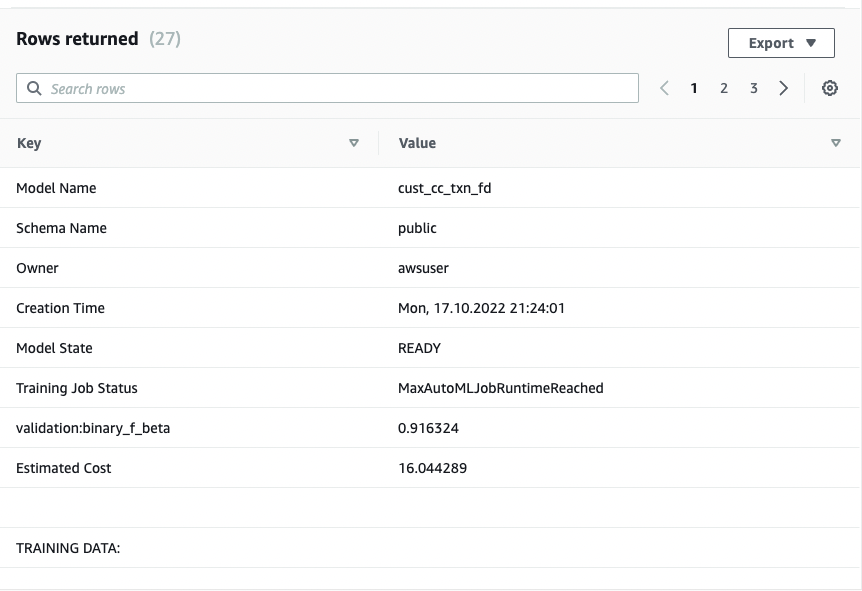

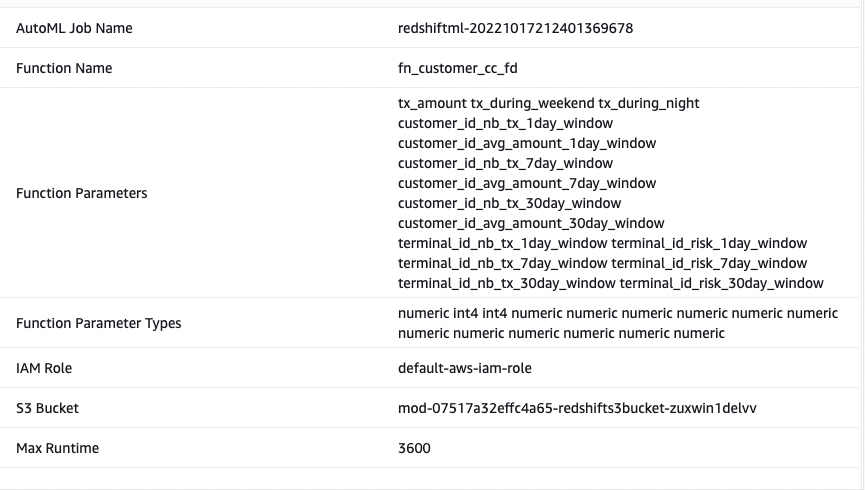

私はMLモデルを次のように呼んでいます Cust_cc_txn_fd、および予測関数は fn_customer_cc_fd. FROM 句は、履歴テーブルからの入力列を示します public.cust_payment_tx_history. ターゲットパラメータはに設定されています tx_fraud、これは予測しようとしているターゲット変数です。 IAM_Role クラスタがこのロールで構成されているため、デフォルトに設定されています。 そうでない場合は、Amazon Redshift クラスター IAM ロール ARN を提供する必要があります。 私は max_runtime 3,600 秒まで。これは、プロセスを完了するために SageMaker に与える時間です。 Redshift ML は、この時間枠で特定された最適なモデルをデプロイします。

モデルの複雑さとデータ量によっては、モデルが利用可能になるまでに時間がかかる場合があります。 モデルの選択が完了していない場合は、値を増やしてください max_runtime. 9999 の最大値を設定できます。

CREATE MODEL コマンドは非同期で実行されます。つまり、バックグラウンドで実行されます。 を使用できます。 モデルを表示 コマンドを実行して、モデルのステータスを確認します。 ステータスが Ready と表示されている場合、モデルがトレーニングされてデプロイされていることを意味します。

次のスクリーンショットは、出力を示しています。

出力から、モデルが正しく認識されていることがわかります BinaryClassification、そしてF1が目的として選択されました。 の F1スコア 両方を考慮した指標です 適合率と再現率. 1 (完全な適合率と再現率) から 0 (可能な限り低いスコア) までの値を返します。 私の場合は0.91です。 値が高いほど、モデルのパフォーマンスが向上します。

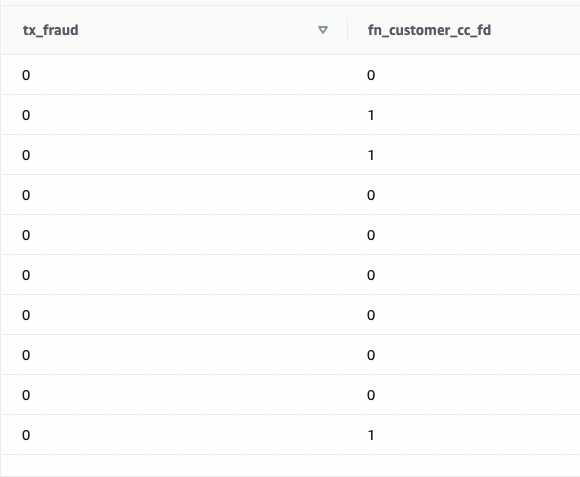

このモデルをテスト データセットでテストしてみましょう。 サンプル予測を取得する次のコマンドを実行します。

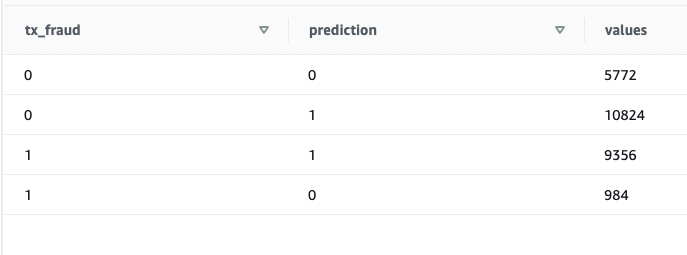

一致する値と一致しない値があることがわかります。 予測をグラウンド トゥルースと比較してみましょう。

モデルが機能しており、F1 スコアが良好であることを検証しました。 ストリーミング データの予測の生成に移りましょう。

不正取引の予測

Redshift ML モデルはすぐに使用できるため、これを使用してストリーミング データの取り込みに対する予測を実行できます。 履歴データセットには、ストリーミング データ ソースにあるものよりも多くのフィールドがありますが、それらは、顧客に関する最新性と頻度の指標であり、不正なトランザクションの最終的なリスクです。

ビュー内に SQL を埋め込むことで、ストリーミング データの上に非常に簡単に変換を適用できます。 を作成します 最初のビュー、ストリーミング データを顧客レベルで集約します。 次に、 セカンドビュー端末レベルでストリーミング データを集約し、 サードビューこれは、着信トランザクション データを顧客および端末の集計データと組み合わせ、予測関数をすべて XNUMX か所で呼び出します。 XNUMX 番目のビューのコードは次のとおりです。

ビューで SELECT ステートメントを実行します。

SELECT ステートメントを繰り返し実行すると、最新のクレジット カード トランザクションがほぼリアルタイムで変換および ML 予測されます。

これは Amazon Redshift の威力を示しています。使いやすい SQL コマンドを使用すると、複雑なウィンドウ関数を適用してストリーミング データを変換し、ML モデルを適用して不正なトランザクションを予測することができます。複雑なデータ パイプラインを構築したり、構築および管理したりする必要はありません。追加のインフラストラクチャ。

ソリューションを拡張する

データがストリーミングされ、ML 予測がほぼリアルタイムで行われるため、 Amazon シンプル通知サービス (Amazon SNS)、または運用システムで顧客のクレジット カード アカウントをロックできます。

この投稿では、これらの操作の詳細については説明しませんが、Amazon Redshift を使用したイベント駆動型ソリューションの構築について詳しく知りたい場合は、以下を参照してください。 GitHubリポジトリ.

クリーンアップ

今後料金が発生しないようにするには、この投稿の一部として作成されたリソースを削除してください。

まとめ

この投稿では、Kinesis データ ストリームを設定し、プロデューサーを設定してデータをストリームに発行し、Amazon Redshift ストリーミング インジェスト ビューを作成して Amazon Redshift でデータをクエリする方法を示しました。 データが Amazon Redshift クラスターに配置された後、ML モデルをトレーニングして予測関数を構築し、それをストリーミング データに適用して、ほぼリアルタイムで予測を生成する方法を示しました。

フィードバックや質問がある場合は、コメントに残してください。

著者について

バヌピタンパリー ダラスを拠点とするアナリティクススペシャリストソリューションアーキテクトです。 彼は分析ソリューションの構築を専門としています。 彼の経歴は、アーキテクチャ、開発、および管理のデータウェアハウスにあります。 彼は15年以上データと分析の分野に携わっています。

バヌピタンパリー ダラスを拠点とするアナリティクススペシャリストソリューションアーキテクトです。 彼は分析ソリューションの構築を専門としています。 彼の経歴は、アーキテクチャ、開発、および管理のデータウェアハウスにあります。 彼は15年以上データと分析の分野に携わっています。

プラヴィーン・カディピコンダ ダラスを拠点とする AWS のシニア アナリティクス スペシャリスト ソリューション アーキテクトです。 彼は、顧客が効率的でパフォーマンスが高く、スケーラブルな分析ソリューションを構築するのを支援しています。 彼は 15 年以上にわたってデータベースとデータ ウェアハウス ソリューションの構築に携わってきました。

プラヴィーン・カディピコンダ ダラスを拠点とする AWS のシニア アナリティクス スペシャリスト ソリューション アーキテクトです。 彼は、顧客が効率的でパフォーマンスが高く、スケーラブルな分析ソリューションを構築するのを支援しています。 彼は 15 年以上にわたってデータベースとデータ ウェアハウス ソリューションの構築に携わってきました。

リテシュ・クマール・シンハ サンフランシスコを拠点とするアナリティクス スペシャリスト ソリューション アーキテクトです。 彼は 16 年以上にわたり、顧客がスケーラブルなデータ ウェアハウジングとビッグ データ ソリューションを構築するのを支援してきました。 彼は、AWS で効率的なエンドツーエンドのソリューションを設計および構築するのが大好きです。 余暇には、読書、ウォーキング、ヨガが大好きです。

リテシュ・クマール・シンハ サンフランシスコを拠点とするアナリティクス スペシャリスト ソリューション アーキテクトです。 彼は 16 年以上にわたり、顧客がスケーラブルなデータ ウェアハウジングとビッグ データ ソリューションを構築するのを支援してきました。 彼は、AWS で効率的なエンドツーエンドのソリューションを設計および構築するのが大好きです。 余暇には、読書、ウォーキング、ヨガが大好きです。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- Platoblockchain。 Web3メタバースインテリジェンス。 知識の増幅。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/big-data/near-real-time-fraud-detection-using-amazon-redshift-streaming-ingestion-with-amazon-kinesis-data-streams-and-amazon-redshift-ml/

- 000

- 000のお客様

- 1

- 10

- 100

- 11

- 15年

- 67

- 7

- 9

- a

- できる

- 私たちについて

- 上記の.

- アクセス

- 達成する

- Action

- NEW

- 管理

- 高度な

- 後

- に対して

- 警告

- すべて

- ことができます

- Amazon

- Amazon EC2

- アマゾンキネシス

- 量

- アナリスト

- 分析的

- 分析論

- 分析します

- および

- 異常検出

- アパッチ

- 申し込み

- 申し込む

- 適用

- 建築

- 周りに

- アタッチ

- オート

- オートマチック

- 自動的に

- 利用できます

- 回避

- AWS

- 背景

- ベース

- 基本

- なぜなら

- になる

- BEST

- より良いです

- の間に

- ビッグ

- ビッグデータ

- 持って来る

- ビルド

- 建物

- ビジネス

- ビジネスプロセス

- ビジネス

- コール

- 呼ばれます

- コール

- キャプチャー

- カード

- 場合

- 例

- 文字

- 課金

- チェック

- 選択する

- 市町村

- クラウド

- クラスタ

- コード

- コラム

- 組み合わせ

- 到来

- 注釈

- 比較します

- コンプリート

- 完了

- 複雑な

- 複雑さ

- 計算

- 考慮する

- 領事

- 消費する

- consumer

- 含まれています

- コスト効率の良い

- 可能性

- 作ります

- 作成した

- 作成します。

- 作成

- Credentials

- クレジット

- クレジットカード

- 顧客

- 顧客データ

- Customers

- サイクル

- daily

- ダラス

- データ

- データの準備

- データウェアハウス

- データウェアハウス

- データベース

- データベースを追加しました

- データセット

- 日付

- 意思決定

- デフォルト

- 定義

- 配信する

- 実証

- 依存

- 展開します

- 展開

- 配備する

- 記載された

- 設計

- 細部

- 検出

- 開発者

- 開発

- 異なります

- 直接に

- そうではありません

- すること

- ドント

- ダウ

- ダイナミック

- 簡単に

- 使いやすい

- 効果

- 効率的な

- enable

- 可能

- 端から端まで

- エンジニアリング

- 入力します

- エーテル(ETH)

- イベント

- イベント

- 例

- 興奮した

- 外部

- 抽出

- f1

- おなじみの

- スピーディー

- 特徴

- 特徴

- フィードバック

- フィールド

- フィールズ

- フィルター

- ファイナンシャル

- もう完成させ、ワークスペースに掲示しましたか?

- フラグ

- フロー

- フォロー中

- 次

- フォーム

- 形式でアーカイブしたプロジェクトを保存します.

- 発見

- FRAME

- フランシスコ

- 詐欺

- 不正検出

- 無料版

- 周波数

- から

- 完全に

- function

- 機能

- 未来

- 生成する

- 生成された

- 生成

- ジェネレータ

- 取得する

- 与える

- Go

- 良い

- 助成金

- 陸上

- グループ

- 持って

- 助けました

- ことができます

- より高い

- 特徴

- 歴史的

- history

- 認定条件

- How To

- HTML

- HTTPS

- 何百

- IAM

- 特定され

- アイデンティティ

- 重要性

- in

- include

- 入ってくる

- 増える

- の増加

- 個人

- 情報

- インフラ

- インサート

- 洞察

- install

- 機関

- 説明書

- 興味がある

- IT

- join

- JSON

- カフカ

- Kinesisデータストリーム

- 言語

- より大きい

- レイテンシ

- 最新の

- 起動する

- 学習

- コメントを残す

- 長さ

- レベル

- LIMIT

- 制限

- 負荷

- 負荷

- 長期的

- ロー

- 機械

- 機械学習

- 製

- make

- 作る

- マネージド

- 管理する

- 手動で

- 多くの

- 地図

- 大規模

- マッチング

- matplotlib

- マックス

- 手段

- メディア

- 方法

- メトリック

- メトリック

- 軽減する

- ML

- モード

- モデル

- monthly

- ヶ月

- 他には?

- 最も

- 名

- ナビゲーション

- 必要

- ニーズ

- 新作

- 次の

- 通知

- 数

- numpy

- 客観

- ONE

- 開きます

- 操作

- オペレーショナル

- 業務執行統括

- 機会

- オプション

- 注文

- 組織

- その他

- 概説

- パッケージ

- パンダ

- ペイン

- パラメーター

- 部

- 完璧

- 実行する

- パフォーマンス

- 実行する

- パーミッション

- 電話

- 場所

- 計画

- プラットフォーム

- プラットフォーム

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- お願いします

- ポリシー

- 方針

- 可能

- ポスト

- 電力

- 精度

- 予測する

- 予測

- 予測

- 予測

- 前

- 価格設定

- プロセス

- ラボレーション

- プロデューサー

- 演奏曲目

- 提供します

- は、大阪で

- 公共

- パブリッシュ

- Python

- 質問

- すぐに

- ランダム

- リーディング

- 準備

- リアル

- への

- リアルタイムデータ

- 実現

- 受け取ります

- 受け

- 最近

- 認識

- 記録

- 繰り返し

- replace

- の提出が必要です

- リソースを追加する。

- リソース

- REST

- 結果

- 収益

- リスク

- 職種

- ラン

- ランニング

- セージメーカー

- サン

- サンフランシスコ

- ド電源のデ

- 規模

- スクリーンショット

- SDDK

- 海生まれ

- 二番

- 秒

- セクション

- セクション

- 安全に

- 選択

- 選択

- サーバレス

- サービス

- セッションに

- 設定

- 設定

- 短期

- 表示する

- 作品

- 簡単な拡張で

- 簡素化する

- シミュレータ

- So

- 社会

- ソーシャルメディア

- 溶液

- ソリューション

- 一部

- ソース

- ソース

- 専門家

- 専門にする

- 過ごす

- split

- SQL

- ステージ

- 標準

- 開始

- 都道府県

- ステートメント

- 文

- Status:

- 手順

- ステップ

- ストレージ利用料

- 店舗

- 店舗

- 戦略的

- 流れ

- ストリーミング

- ストリーミングサービス

- ストリーム

- そのような

- スーパー

- システム

- テーブル

- 取る

- 取り

- トーク

- ターゲット

- ターミナル

- test

- 三番

- 数千

- 介して

- 時間

- タイムスタンプ

- 〜へ

- top

- トピック

- 伝統的に

- トレーニング

- 訓練された

- トレーニング

- トランザクション

- トランザクションの

- 取引

- 最適化の適用

- 変換

- 変換

- トレンド

- アップデイト

- 更新しました

- 使用法

- つかいます

- ユーザー

- 検証済み

- 値

- 価値観

- さまざまな

- Verity

- バージョン

- 詳しく見る

- ビュー

- ウォーキング

- ウォークスルー

- 倉庫

- 倉庫保管

- ウェブサイト

- 週末

- weekly

- この試験は

- which

- while

- Wikipedia

- 意志

- 無し

- 働いていました

- ワーキング

- 作品

- 書きます

- 年

- ヨガ

- あなたの

- ゼファーネット