私たちは、生成 AI には、私たちが知っているほぼすべての顧客エクスペリエンスを時間の経過とともに変革する可能性があると信じています。 ほんの数例を挙げると、adidas、Booking.com、Bridgewater Associates、Clariant、Cox Automotive、GoDaddy、LexisNexis Legal & Professional など、AWS で生成 AI アプリケーションを立ち上げている企業の数は膨大であり、急速に増えています。 Perplexity AI のような革新的なスタートアップ企業は、生成 AI に関して AWS に全力で取り組んでいます。 Anthropic のような大手 AI 企業は、ミッションクリティカルなワークロードの主要クラウドプロバイダーとして、また将来のモデルをトレーニングする場所として AWS を選択しています。 そして、アクセンチュアのようなグローバルなサービスおよびソリューションプロバイダーは、社内開発者に以下の機能を提供することで、カスタマイズされた生成 AI アプリケーションのメリットを享受しています。 アマゾン コード ウィスパラー.

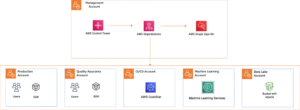

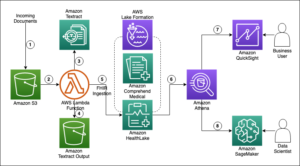

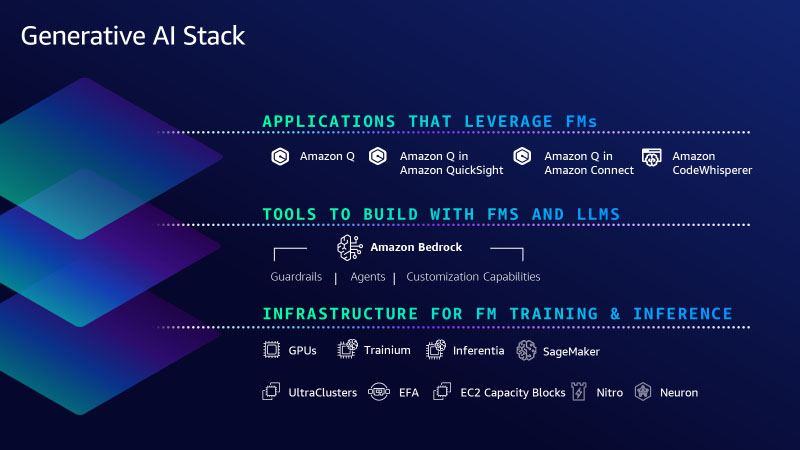

これらのお客様が AWS を選んでいるのは、私たちがこれまでやってきたこと、つまりカスタマーエクスペリエンスとビジネスを変革できる複雑で高価なテクノロジーを採用し、あらゆる規模と技術能力のお客様向けにそれを民主化することに重点を置いているからです。 これを実現するために、私たちは生成 AI スタックの XNUMX つの層にわたって最も包括的な機能セットを提供するために投資し、急速に革新を進めています。 最下層は、大規模言語モデル (LLM) およびその他の基盤モデル (FM) をトレーニングし、推論や予測を生成するためのインフラストラクチャです。 中間層では、顧客が AWS サービスに期待するのと同じセキュリティ、アクセス制御、その他の機能を備えた生成 AI アプリケーションを構築および拡張するために必要なすべてのモデルとツールに簡単にアクセスできます。 そして最上層では、生成 AI ベースのコーディングなどの主要分野で革新的なアプリケーションに投資してきました。 お客様は、選択肢と、私たちに期待されているすべてのレイヤーにわたる機能の幅広さと深さを提供することに加えて、私たちのデータファーストのアプローチを高く評価し、私たちがエンタープライズですべてをゼロから構築したことを信頼しているとも言っています。グレードのセキュリティとプライバシー。

今週、私たちは大きな一歩を踏み出し、お客様がビジネスに広く生成 AI を使用できるようにするために、スタックの XNUMX つのレイヤーすべてにわたって多くの重要な新機能を発表しました。

スタックの最下層: AWS Trainium2 は、生成 AI 用の最先端のクラウド インフラストラクチャを提供する最新の追加製品です。

スタックの最下層は、LLM やその他の FM のトレーニングと実行に必要なインフラストラクチャ (コンピューティング、ネットワーキング、フレームワーク、サービス) です。 AWS は、ML 用の最先端のインフラストラクチャを提供するために革新を行っています。 NVIDIA との長年にわたる協力を通じて、AWS は 12 年以上前に初めて GPU をクラウドに導入し、最近では、NVIDIA H100 GPU を P5 インスタンスで利用できるようにした最初の大手クラウドプロバイダーとなりました。 当社は、AWS を GPU を実行するのに最適なクラウドにする独自のイノベーションへの投資を続けています。これには、最先端の仮想化システム (AWS Nitro) による価格パフォーマンスの利点、Elastic Fabric Adaptor (EFA) による強力なペタビット規模のネットワーキング、ハイパーAmazon EC2 UltraClusters を使用してクラスタリングをスケールします (数千の高速化されたインスタンスがアベイラビリティーゾーンに同じ場所に配置され、大規模な ML トレーニングに最大 3,200 Gbps を提供できるノンブロッキング ネットワークで相互接続されます)。 また、Amazon EC2 Capacity Blocks for ML を使用して、あらゆるお客様が、需要の高い生成 AI 用の GPU コンピューティング容量に簡単にアクセスできるようにしています。これは、お客様が将来の使用のために GPU を予約できる、業界初で唯一の消費モデルです (最大 500 個) EC2 UltraClusters にデプロイされます) 短期間の ML ワークロード向け。

数年前、私たちは価格パフォーマンスの限界を押し上げ続けるにはシリコンに至るまで革新する必要があることに気づき、独自のチップへの投資を開始しました。 特に ML に関しては、専用の推論チップである AWS Inferentia から始めました。 現在、私たちは Amazon EC2 Inf2 インスタンスを備えた第 2 世代の AWS Inferentia を使用しています。このインスタンスは、数千億のパラメータを含むモデルを備えた大規模な生成 AI アプリケーション向けに特に最適化されています。 Inf1 インスタンスは、クラウドでの推論コストを最も低く抑えながら、Inf12 インスタンスと比較して最大 2 倍高いスループットと最大 2 倍低いレイテンシを実現します。 最大 2 個の Inferentia2 チップを搭載した InfXNUMX は、アクセラレータ間の高速接続を備えた唯一の推論に最適化された ECXNUMX インスタンスであるため、顧客は超大規模モデルを分散することでパフォーマンスやレイテンシーを犠牲にすることなく、より高速かつ効率的に (低コストで) 推論を実行できます。複数のアクセラレータにわたって。 Adobe、Deutsche Telekom、Leonardo.ai などの顧客は、初期段階で素晴らしい成果を上げており、InfXNUMX 上でモデルを大規模に展開することに興奮しています。

トレーニング面では、AWS の専用 ML トレーニング チップである AWS Trainium を利用した Trn1 インスタンスは、EFA ネットワーキングに接続された複数のサーバーにトレーニングを分散するように最適化されています。 リコーのような顧客は、わずか数日で数十億のパラメータを使用して日本の LLM をトレーニングしました。 Databricks は、大規模なディープ ラーニング モデルをトレーニングするための Trainium ベースのインスタンスにより、価格パフォーマンスが最大 40% 向上しています。 しかし、より高性能な新しいモデルがほぼ毎週登場するため、当社はパフォーマンスとスケールの限界を押し広げ続けており、この発表をできることをうれしく思います。 AWS Trainium2、数千億から数兆のパラメータを持つトレーニング モデルに対して、さらに優れたコスト パフォーマンスを提供するように設計されています。。 Trainium2 は、第 2 世代の Trainium よりも最大 65 倍高速なトレーニング パフォーマンスを実現し、EC300 UltraClusters で使用すると、最大 2 エクサフロップスの集計コンピューティングを実現できます。 これは、顧客が 2 億パラメータの LLM を数か月ではなく数週間でトレーニングできることを意味します。 Trainium2 のパフォーマンス、スケール、エネルギー効率は、Anthropic が AWS でモデルをトレーニングすることを選択し、将来のモデルに Trainium2024 を使用する理由の一部です。 そして、私たちは Anthropic と協力して、Trainium と Inferentia の両方で継続的なイノベーションを行っています。 最初の TrainiumXNUMX インスタンスは XNUMX 年にお客様に提供される予定です。

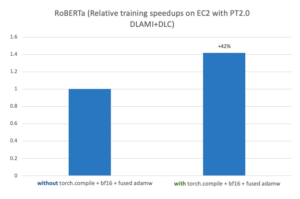

また、当社は ML シリコンのソフトウェア ツール チェーンを強化しており、特に顧客が Trainium と Inferentia から最大のパフォーマンスを引き出すのに役立つソフトウェア開発キット (SDK) である AWS Neuron の進化に取り組んでいます。 2019 年に Neuron を導入して以来、私たちはコンパイラーとフレームワーク テクノロジーに多額の投資を行ってきました。現在、Neuron は、Meta の Llama 2、Databricks の MPT、Stability AI の Stable Diffusion など、最も人気のある公開モデルの多くをサポートしています。人気モデル リポジトリ Hugging Face の上位 93 モデルのうち 100 モデル。 Neuron は PyTorch や TensorFlow などの人気のある ML フレームワークに接続されており、JAX のサポートは来年初めに予定されています。 お客様からは、Neuron を使用することで、わずか数行のコードで既存のモデルのトレーニングおよび推論パイプラインを Trainium および Inferentia に簡単に切り替えることができるようになったとの声が寄せられています。

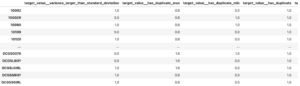

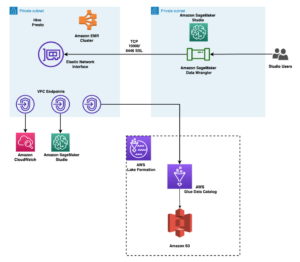

最高の ML チップ、超高速ネットワーキング、仮想化、ハイパースケール クラスターの選択というこれと同じ組み合わせを提供している企業は他にありません。 したがって、AI21 Labs、Anthropic、Hugging Face、Perplexity AI、Runway、Stability AI などの最も有名な生成 AI スタートアップの一部が AWS で実行されているのは驚くことではありません。 ただし、このコンピューティングを効果的に活用して、LLM やその他の FM を効率的かつコスト効率よく構築、トレーニング、実行するには、適切なツールが依然として必要です。 そして、これらのスタートアップの多くにとって、 アマゾンセージメーカー が答えです。 新しい独自のモデルを最初から構築してトレーニングする場合でも、一般に公開されている多くの人気モデルの 21 つから始める場合でも、トレーニングは複雑で費用のかかる作業です。 これらのモデルをコスト効率よく実行することも簡単ではありません。 お客様は大量のデータを取得して準備する必要があります。 これには通常、データのクリーニング、重複の削除、強化および変換という多くの手作業が必要になります。 次に、GPU/アクセラレータの大規模なクラスターを作成して維持し、モデルのトレーニングをクラスター間で効率的に分散するコードを作成し、モデルのチェックポイント、一時停止、検査と最適化を頻繁に行い、クラスター内のハードウェアの問題を手動で介入して修復する必要があります。 これらの課題の多くは新しいものではありませんが、モデルのトレーニングとデプロイメントに関わる多くの障壁を打ち破り、開発者にはるかに簡単な方法を提供するために、私たちが 180 年前に SageMaker を立ち上げた理由の一部です。 数万の顧客が Amazon SageMaker を使用しており、LG AI Research、Perplexity AI、AIXNUMX、Hugging Face、Stability AI などの顧客の数が増加しており、LLM やその他の FM を SageMaker でトレーニングしています。 つい最近、Technology Innovation Institute (人気のある Falcon LLM の作成者) は、公開されている最大のモデルである Falcon XNUMXB を SageMaker でトレーニングしました。 モデルのサイズと複雑さが増大するにつれて、SageMaker の範囲も拡大しました。

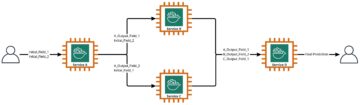

長年にわたり、私たちは自動モデルチューニング、分散トレーニング、柔軟なモデル展開オプション、ML OP 用ツール、データ準備用ツール、機能ストア、ノートブック、シームレスな統合など、380 以上の革新的な機能を Amazon SageMaker に追加してきました。 ML ライフサイクル全体にわたる人間参加型の評価と、責任ある AI のための組み込み機能を備えています。 私たちは、SageMaker の顧客が LLM やその他の FM を含むすべてのモデルの推論を構築、トレーニング、実行し続けることができるように、迅速な革新を続けています。 また、XNUMX つの新しい機能により、お客様が大規模なモデルをトレーニングしてデプロイできるよう、さらに簡単かつコスト効率が高くなります。 まず、トレーニングを簡素化するために、 導入 Amazon SageMaker ハイパーポッド これにより、大規模なフォールトトレラントな分散トレーニングに必要なプロセスの多くが自動化されます。 (分散トレーニング ライブラリの構成、数千のアクセラレータにわたるトレーニング ワークロードのスケーリング、障害のあるインスタンスの検出と修復など)、トレーニングを 40% も高速化します。 その結果、Perplexity AI、Hugging Face、Stability、Hippocratic、Alkaid などの顧客が SageMaker HyperPod を使用してモデルを構築、トレーニング、または進化させています。 XNUMX番、 レイテンシーを削減しながら推論のコスト効率を高めるための新機能を導入しています。 SageMaker は、顧客が複数のモデルを同じインスタンスにデプロイしてコンピューティング リソースを共有できるように支援し、推論コストを (平均) 50% 削減します。 また、SageMaker は、推論リクエストを処理しているインスタンスをアクティブに監視し、どのインスタンスが利用可能であるかに基づいてリクエストをインテリジェントにルーティングし、(平均で) 20% 低い推論レイテンシーを達成します。 これらの推論の最適化により、Conjecture、Salesforce、Slack はすでにモデルのホスティングに SageMaker を使用しています。

スタックの中間層: Amazon Bedrock に新しいモデルが追加され、一連の新機能により、顧客は生成 AI アプリケーションを安全に構築および拡張することがさらに容易になります。

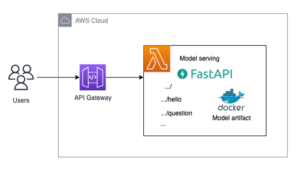

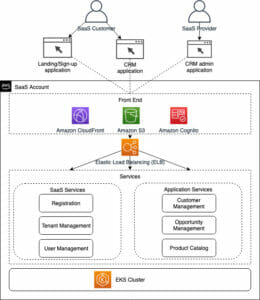

多くの顧客は独自の LLM やその他の FM を構築したり、公的に利用可能なオプションをいくつでも進化させたりしますが、多くの顧客はこれにリソースと時間を費やしたくないでしょう。 彼らにとって、スタックの中間層はこれらのモデルをサービスとして提供します。 ここでの私たちのソリューションは、 アマゾンの岩盤を使用すると、顧客は Anthropic、Stability AI、Meta、Cohere、AI21、Amazon の業界をリードするモデルから選択し、独自のデータでカスタマイズし、これまでと同じ最先端のセキュリティ、アクセス制御、機能をすべて活用できます。 AWS ではすべてマネージド サービスを通じて行われます。 Amazon Bedrock は XNUMX 月下旬に一般提供を開始しましたが、顧客の反応は圧倒的に良好です。 世界中のほぼすべての業界の顧客が、Amazon Bedrock の使用に興奮しています。 アディダスは、開発者が「入門」に関する情報からより深い技術的な質問に至るまで、あらゆることについて迅速に回答できるようにしています。 Booking.com は、生成 AI を使用して、すべての顧客に合わせた旅行の推奨事項を作成する予定です。 Bridgewater Associates は、チャートの生成、財務指標の計算、結果の要約を支援する、LLM を利用した投資アナリスト アシスタントを開発しています。 Carrier は、より正確なエネルギー分析と洞察を顧客が利用できるようにして、エネルギー消費を削減し、二酸化炭素排出量を削減します。 クラリアントは、社内の生成型 AI チャットボットをチーム メンバーに提供して、研究開発プロセスを加速し、営業チームの会議の準備をサポートし、顧客の電子メールを自動化できるようにしています。 GoDaddy は、生成 AI を使用して Web サイトの構築、サプライヤーの検索、顧客とのつながりなどを行うことで、顧客がオンラインで簡単にビジネスを立ち上げられるよう支援しています。 Lexis Nexis Legal & Professional は、Lexis+ AI の会話型検索、要約、文書作成および分析機能によって弁護士の法務業務を変革し、生産性を向上させています。 ナスダックは、不審な取引の調査ワークフローを自動化し、金融犯罪対策と監視機能を強化することに貢献しています。 これらすべて、そしてさらに多くの多様な生成 AI アプリケーションが AWS 上で実行されています。

私たちは Amazon Bedrock の勢いに興奮していますが、まだ初期の段階です。 お客様と協力して私たちが目にしたのは、誰もが急速に進んでいますが、生成 AI の進化は速いペースで続いており、新しいオプションやイノベーションがほぼ毎日起こっているということです。 お客様は、さまざまなユースケースやさまざまなデータセットに適したさまざまなモデルがあることに気づき始めています。 いくつかのモデルは要約に最適であり、他のモデルは推論と統合に最適であり、さらに他のモデルは非常に優れた言語サポートを備えています。 さらに、画像生成、検索ユースケースなどがあり、これらはすべて独自のモデルと誰でも公開されているモデルの両方から来ています。 そして、未知のことがたくさんある時代には、適応する能力がおそらく最も価値のあるツールです。 それらすべてを支配する 10 つのモデルは存在しません。 そしてもちろん、誰もが使用するモデルを提供しているのは XNUMX つのテクノロジー企業だけではありません。 顧客はさまざまなモデルを試す必要があります。 同じユースケース内でそれらを切り替えたり、組み合わせたりできる必要があります。 これは、モデルプロバイダーを実際に選択する必要があることを意味します (過去 XNUMX 日間の出来事により、そのことがさらに明確になりました)。 これが、私たちが Amazon Bedrock を発明した理由であり、それが顧客の共感を呼ぶ理由であり、API 呼び出しと同じくらい簡単にさまざまなモデルを使用して構築 (およびモデル間の移行) できるように、最新の技術を導入して迅速な革新と反復を続けている理由です。すべての開発者がモデルをカスタマイズできるようにし、顧客の安全とデータのプライバシーを確保します。 お客様による生成 AI アプリケーションの構築と拡張をさらに容易にするいくつかの新機能を導入できることを嬉しく思います。

- Anthropic Claude 2.1、Meta Llama 2 70B、および Amazon Titan ファミリーへの追加により、モデルの選択肢が拡大します。 初期の段階では、顧客はさまざまな目的にどのモデルを使用するかを決定するために、さまざまなモデルを学習および実験し続けています。 彼らは、最新モデルを簡単に試し、どの機能や機能が自社のユースケースに最適な結果とコスト特性をもたらすかをテストできることを望んでいます。 Amazon Bedrock を使用すると、顧客は XNUMX 回の API 呼び出しだけで新しいモデルを入手できます。 過去数か月間、顧客が経験した最も印象的な結果の一部は、次のような LLM によるものです。 Anthropicのクロードモデル、高度な信頼性と予測可能性を維持しながら、洗練されたダイアログやコンテンツの生成から複雑な推論まで、幅広いタスクに優れています。 お客様からは、Claude は他の FM に比べて有害な出力を生成する可能性がはるかに低く、会話が容易で、操作性が高いため、開発者は少ない労力で目的の出力を得ることができると報告されています。 Anthropic の最先端モデルである Claude 2 は、GRE の読み書き試験で 90 パーセンタイルを超えるスコアを獲得し、同様に定量的推論でもスコアを獲得しました。 そして 現在、新しくリリースされた Claude 2.1 モデルが Amazon Bedrock で入手可能です。 Claude 2.1 は、業界をリードする 200K トークン コンテキスト ウィンドウ (Claude 2 のコンテキストの 2.0 倍)、幻覚率の低減、非常に長いコンテキスト長でも精度の大幅な向上などの重要な機能を企業に提供します。 Claude 2.1 には、改良されたシステム プロンプト (エンド ユーザーにより良いエクスペリエンスを提供するモデル手順) も含まれており、同時にプロンプトと完了にかかるコストも 25% 削減されます。

Meta の公開されている Llama 2 モデルのマネージド バージョンの使用を希望する顧客が増えているため、Amazon Bedrock は Llama 2 13B を提供しています。 ラマ 2 70B を追加します。 Llama 2 70B は、言語モデリング、テキスト生成、対話システムなどの大規模なタスクに適しています。 公開されている Llama モデルは 30 万回以上ダウンロードされており、顧客は、インフラストラクチャについて心配したり、チームに ML に関する深い専門知識を持たせる必要がないマネージドサービスの一部として Amazon Bedrock が提供することを気に入っています。 さらに、画像生成のために、Stability AI は一般的なテキストから画像へのモデルのスイートを提供します。 Stable Diffusion XL 1.0 (SDXL 1.0) はこれらの中で最も先進的なもので、現在 Amazon Bedrock で一般入手可能です。。 この人気のある画像モデルの最新版では、精度が向上し、フォトリアリズムが向上し、解像度が向上しました。

お客様もご利用いただいております アマゾンタイタン AWS によって作成および事前トレーニングされたモデルは、さまざまなユースケースに優れた経済性を備えた強力な機能を提供します。 Amazon には、ML と AI (当社のビジネス全体で使用しているテクノロジー) において 25 年の実績があり、モデルの構築とデプロイについて多くのことを学んできました。 私たちはモデルをトレーニングする方法とそれに使用するデータを慎重に選択しました。 当社は、当社のモデルまたはその出力が誰かの著作権を侵害しているという申し立てに対してお客様を補償します。 今年のXNUMX月に最初のTitanモデルを発表しました。 タイタンテキストライト—現在一般提供中—チャットボット、テキストの要約、コピーライティングなどのユースケース向けの簡潔でコスト効率の高いモデルであり、微調整が必要なモデルでもあります。 Titan Text Express — こちらも一般提供開始- より拡張性があり、自由形式のテキスト生成や会話型チャットなど、より広範囲のテキストベースのタスクに使用できます。 当社はこれらのテキスト モデル オプションを提供し、お客様がユースケースやビジネス要件に応じて精度、パフォーマンス、コストを最適化できるようにします。 Nexxiot、PGA Tour、Ryanair などの顧客は、9,000 つの Titan Text モデルを使用しています。 検索ユースケースとパーソナライゼーション用の埋め込みモデル Titan Text Embeddings もあります。 Nasdaq のような顧客は、Titan Text Embeddings を使用して Nasdaq IR Insight の機能を強化し、サステナビリティ、法務、会計チーム向けに XNUMX 社以上の世界的企業の文書から洞察を生成することで素晴らしい成果を上げています。 そして、今後も時間の経過とともにさらに多くのモデルを Titan ファミリーに追加していく予定です。 新しい埋め込みモデル、Titan Multimodal Embeddings を導入します。、画像とテキスト (または両方の組み合わせ) を入力として使用するユーザーのマルチモーダル検索と推奨エクスペリエンスを強化します。 そして私たちは 新しいテキストから画像へのモデルである Amazon Titan Image Generator の導入。 Titan Image Generator を使用すると、広告、電子商取引、メディアやエンターテイメントなどの業界の顧客がテキスト入力を使用して、リアルなスタジオ品質の画像を大量かつ低コストで生成できます。 お客様が Titan モデルにどのような反応を示しているかを私たちは嬉しく思っており、今後も私たちが革新を続けることを期待していただけます。

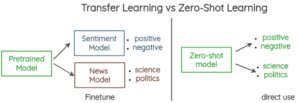

- 独自のデータを使用して生成 AI アプリケーションを安全にカスタマイズする新機能: Amazon Bedrock の最も重要な機能の 3 つは、モデルのカスタマイズがいかに簡単であるかです。 これは、生成 AI が自社の主要な差別化要因であるデータと出会う場所であるため、顧客にとって非常に興味深いものになります。 ただし、データが安全に保たれること、途中でデータを制御できること、モデルの改善が個人的に行われることが非常に重要です。 これを行うにはいくつかの方法があり、Amazon Bedrock は複数のモデルにわたるカスタマイズ オプションの最も幅広い選択肢を提供します)。 XNUMXつ目は微調整です。 Amazon Bedrock でモデルを微調整するのは簡単です。 モデルを選択するだけで、Amazon Bedrock がそのコピーを作成します。 次に、Amazon Simple Storage Service (Amazon SXNUMX) に保存されているラベル付きのいくつかの例 (一連の優れた質問と回答のペアなど) を指定すると、Amazon Bedrock が「増分トレーニング」します (コピーされたモデルに新しい情報を追加します)。これらの例に基づいて分析すると、その結果、より適切でカスタマイズされた応答を提供する、プライベートでより正確な微調整されたモデルが得られます。 Cohere Command、Meta Llama 2、Amazon Titan Text (Lite および Express)、Amazon Titan Multimodal Embeddings の微調整が一般提供され、Amazon Titan Image Generator のプレビューが開始されたことを発表できることを嬉しく思います。 また、Anthropic との協力を通じて、AWS の顧客がモデルのカスタマイズと最先端モデル Claude の微調整のための独自の機能に早期にアクセスできるようにする予定です。

ビジネスに合わせて LLM およびその他の FM をカスタマイズするための XNUMX 番目の手法は、検索拡張生成 (RAG) です。これにより、ドキュメント リポジトリ、データベース、API などの複数のソースからのデータでプロンプトを拡張することで、モデルの応答をカスタマイズできます。 XNUMX 月に、私たちは RAG 機能である Knowledge Bases for Amazon Bedrock を導入しました。これは、モデルを独自のデータソースに安全に接続し、より多くの情報でプロンプトを補足し、アプリケーションがより関連性があり、状況に応じた正確な応答を提供できるようにします。 知識ベース RAG ワークフロー全体を実行する API が一般提供されるようになりました。 プロンプトを拡張するために必要なテキストの取得から、プロンプトのモデルへの送信、応答の返しまで。 ナレッジベースは、Amazon OpenSearch Service や、Pinecone や Redis Enterprise Cloud などの他の一般的なデータベース (Amazon Aurora および MongoDB ベクトルのサポートが予定されています) など、RAG のこのデータにアクセスするためにモデルが使用するデータ (エンベディング) の数値表現を保存するベクトル機能を備えたデータベースをサポートします。すぐ)。

Amazon Bedrock でモデルをカスタマイズする XNUMX 番目の方法は、事前トレーニングを継続することです。 この方法では、モデルは一般的な言語を理解するための元の事前トレーニングに基づいて、ドメイン固有の言語と用語を学習します。 このアプローチは、ラベルのないドメイン固有の情報を大量に保有しており、自社の世界 (およびビジネス) に特有の言語、フレーズ、略語、概念、定義、専門用語を LLM が理解できるようにしたいと考えている顧客向けです。 かなり少量のデータしか必要としない微調整とは異なり、継続的な事前トレーニングは大規模なデータセット (たとえば、数千のテキストドキュメント) に対して実行されます。 Amazon Bedrock では、Titan Text Lite および Titan Text Express の事前トレーニング機能が利用できるようになりました。

- 一般提供 Amazon Bedrock のエージェント システム、データ ソース、企業の知識を使用して複数のステップからなるタスクを実行できるようにします。 LLM は会話やコンテンツの生成に優れていますが、顧客はアプリケーションが次のことを実行できることを望んでいます。 do さらに、行動を起こし、問題を解決し、さまざまなシステムと対話して、旅行の予約、保険請求の提出、交換部品の注文などの複数のステップのタスクを完了することも可能です。 そして、Amazon Bedrock がこの課題を解決できます。 エージェントの場合、開発者はモデルを選択し、「あなたは陽気なカスタマー サービス エージェントです」や「在庫システムで製品の在庫状況を確認してください」などの基本的な指示をいくつか書き、選択したモデルが適切なデータ ソースとエンタープライズ システム (CRM など) を指すようにします。または ERP アプリケーション)、API を実行するための AWS Lambda 関数をいくつか作成します(例:ERP インベントリ内のアイテムの在庫状況の確認など)。 Amazon Bedrock はリクエストを自動的に分析し、選択したモデルの推論機能を使用してリクエストを論理シーケンスに分解し、どのような情報が必要か、どの API を呼び出すか、ステップを完了するかタスクを解決するためにいつ呼び出すかを決定します。 現在一般提供されているこのサービスでは、エージェントは、製品の在庫状況に関する顧客の質問への回答から注文の受け付けまで、ほとんどのビジネス タスクを計画して実行できます。開発者は、機械学習、プロンプトの設計、モデルのトレーニング、システムの手動接続に精通している必要はありません。 そして、Bedrock はこれらすべてを安全かつ非公開で実行しており、Druva や Athene などの顧客はすでにそれらを使用して、生成 AI アプリケーションの開発の精度と速度を向上させています。

- 紹介 Amazon Bedrock のガードレール そのため、ユースケースの要件と責任ある AI ポリシーに基づいて安全対策を適用できます。 顧客は、AI アプリケーションとのやり取りが安全であることを確認し、有害な言葉や攻撃的な言葉を避け、ビジネスとの関連性を維持し、責任ある AI ポリシーに従うことを望んでいます。 ガードレールを使用すると、顧客は避けるべきトピックを指定でき、Amazon Bedrock は、それらの制限されたカテゴリに該当する質問に対する承認済みの回答のみをユーザーに提供します。 たとえば、オンライン バンキング アプリケーションは、投資アドバイスの提供を回避したり、不適切なコンテンツ (ヘイトスピーチや暴力など) を削除したりするように設定できます。 2024 年初頭には、顧客は模範回答で個人を特定できる情報 (PII) を編集できるようになります。 たとえば、顧客がコールセンターのエージェントと対話した後、顧客サービスでの会話は記録保持のために要約されることがよくありますが、ガードレールによってそれらの要約から PII を削除できます。 ガードレールは、Amazon Bedrock のモデル全体 (微調整されたモデルを含む)、および Agents for Amazon Bedrock とともに使用できるため、お客様はすべての生成 AI アプリケーションに一貫したレベルの保護をもたらすことができます。

スタックの最上層: 継続的なイノベーションにより、より多くのユーザーが生成 AI にアクセスできるようになります

スタックの最上位層には、LLM やその他の FM を活用するアプリケーションがあり、仕事で生成 AI を活用できるようになります。 生成 AI がすでに状況を変えつつある分野の 50,000 つはコーディングです。 昨年、私たちは Amazon CodeWhisperer を導入しました。これは、ほぼリアルタイムでコードの提案と推奨事項を生成することで、アプリケーションをより迅速かつ安全に構築できるようにします。 Accenture、Boeing、Bundesliga、The Cigna Group、Kone、Warner Music Group などの顧客は CodeWhisperer を使用して開発者の生産性を向上させており、Accenture は最大 XNUMX 人のソフトウェア開発者と IT プロフェッショナルが Amazon CodeWhisperer を利用できるようにしています。 私たちは、できるだけ多くの開発者が生成 AI の生産性のメリットを享受できるようにしたいと考えています。そのため、CodeWhisperer はすべての個人に無料で推奨事項を提供しています。

ただし、AI コーディング ツールは開発者の作業を容易にするために多くの機能を果たしますが、内部コード ベース、内部 API、ライブラリ、パッケージ、クラスに関する知識が不足しているため、生産性の利点は限られています。 これについて考える XNUMX つの方法は、新しい開発者を雇った場合、たとえ世界クラスの開発者であっても、ベスト プラクティスとコードを理解するまでは、会社でそれほど生産性を発揮できないということです。 今日の AI を活用したコーディング ツールは、その新入社員開発者のようなものです。 これを支援するために、私たちは最近新しいプレビューを行いました。 カスタマイズ機能 Amazon CodeWhisperer では、顧客の内部コードベースを安全に活用して、より関連性の高い有用なコードの推奨事項を提供します。 この機能により、CodeWhisperer は次の専門家になります。 コードを作成し、さらに時間を節約するために、より関連性の高い推奨事項を提供します。 世界的なデジタル エンジニアリングおよびエンタープライズ最新化企業である Persistent と行った調査では、カスタマイズにより開発者が CodeWhisperer の一般的な機能よりも最大 28% 早くタスクを完了できることがわかりました。 ヘルスケア テクノロジー企業の開発者は、CodeWhisperer に「顧客 ID に関連付けられた MRI 画像をインポートし、画像分類器を通して実行」して異常を検出するように依頼できるようになりました。 CodeWhisperer はコード ベースにアクセスできるため、MRI 画像のインポート場所や顧客 ID など、より関連性の高い提案を提供できます。 CodeWhisperer はカスタマイズを完全にプライベートに保ち、基盤となる FM がカスタマイズをトレーニングに使用しないため、顧客の貴重な知的財産が保護されます。 AWS は、このような機能をすべての人に提供している唯一の大手クラウドプロバイダーです。

紹介 アマゾンQ、仕事に合わせてカスタマイズされた生成 AI 搭載アシスタント

生成 AI に実際に取り組んでいるのは開発者だけではありません。何百万人もの人々が生成 AI チャット アプリケーションを使用しています。 初期のプロバイダーがこの分野で行ったことは消費者にとって刺激的で非常に便利ですが、多くの点で仕事ではまったく「機能」していません。 彼らの一般的な知識と能力は優れていますが、あなたの会社、データ、顧客、業務、ビジネスについては知りません。 それにより、彼らがあなたを助けることができる範囲が制限されます。 また、彼らはあなたの役割、つまりあなたがどのような仕事をしているのか、誰と協力しているのか、どのような情報を使用しているのか、何にアクセスできるのかなどについてもほとんど知りません。 これらの制限は、これらのアシスタントが会社の個人情報にアクセスできず、企業がアシスタントにこのアクセスを許可する必要があるデータ プライバシーとセキュリティの要件を満たすように設計されていないため、当然のことです。 事後的にセキュリティを強化し、それがうまく機能することを期待するのは困難です。 私たちは、あらゆる組織のすべての人が日常業務で生成 AI を安全に使用できる、より良い方法があると考えています。

Wご紹介できることに興奮しています Amazon Q は、ビジネスに合わせてカスタマイズできる、仕事専用の新しいタイプの AI を活用した生成アシスタントです。 Q は、会社の情報リポジトリ、コード、エンタープライズ システムにあるデータと専門知識を使用して、差し迫った質問に対する関連性の高い回答を迅速に取得し、問題を解決し、コンテンツを生成し、アクションを実行するのに役立ちます。 Amazon Q とチャットすると、タスクを合理化し、意思決定を迅速化し、職場での創造性とイノベーションを促進するのに役立つ関連情報とアドバイスが即座に提供されます。 Amazon Q は安全かつプライベートになるように構築されており、ユーザーの既存の ID、ロール、アクセス許可を理解して尊重し、この情報を使用して対話をパーソナライズできます。 ユーザーが Q を使用せずに特定のデータにアクセスする権限を持っていない場合、Q を使用してそのデータにアクセスすることもできません。 私たちは Amazon Q を、初日から企業顧客の厳しい要件を満たすように設計しました。基盤となるモデルを改善するためにそのコンテンツは一切使用されません。

Amazon Q はあなたのエキスパートアシスタントです AWS 上で構築する場合: 私たちは 17 年分の AWS の知識と経験に基づいて Amazon Q をトレーニングしてきました。これにより、AWS でアプリケーションとワークロードを構築、デプロイ、運用する方法を変革できます。 Amazon Q には、AWS マネジメントコンソールとドキュメント、IDE (CodeWhisperer 経由)、および Slack または他のチャットアプリのチームチャットルームにチャットインターフェイスがあります。 Amazon Q は、AWS の新しい機能の探索、より迅速な開始、なじみのないテクノロジーの学習、ソリューションの設計、トラブルシューティング、アップグレードなどを支援します。Amazon Q は、AWS の適切に設計されたパターン、ベストプラクティス、ドキュメント、およびソリューションの実装の専門家です。 新しい AWS Expert Assistant でできることの例をいくつか示します。

- AWS の機能、サービス、ソリューションに関する明確な回答とガイダンスが得られます。 Amazon Q に「Agents for Amazon Bedrock について教えてください」と尋ねると、Q は機能の説明と関連資料へのリンクを提供します。 また、AWS のサービスがどのように機能するかに関する事実上あらゆる質問 (例: 「DynamoDB テーブルのスケーリング制限は何ですか?」「Redshift マネージドストレージとは何ですか?」) や、任意の数のソリューションを最適に設計する方法について Amazon Q に質問することもできます ( 「イベント駆動型アーキテクチャを構築するためのベスト プラクティスは何ですか?」)。 そして、Amazon Q は簡潔な回答をまとめ、常にその出典を引用 (およびリンク) します。

- ユースケースに最適な AWS サービスを選択して、すぐに使い始めてください。 Amazon Q に質問してください。「AWS で Web アプリを構築するにはどのような方法がありますか?」 ” そして、次のような潜在的なサービスのリストが提供されます。 AWS 増幅, AWSラムダ, Amazon EC2 それぞれの利点を備えています。 そこから、Q が要件、好み、制約を理解できるように支援することで、オプションを絞り込むことができます (たとえば、「コンテナーを使用する場合、これらのどれが最適ですか?」または「リレーショナル データベースと非リレーショナル データベースを使用する必要がありますか?」など)。 ”)。 最後に「どうやって始めればいいですか?」 Amazon Q では、いくつかの基本的な手順を概説し、追加のリソースを示します。

- コンピューティング リソースを最適化します。 Amazon Q は、Amazon EC2 インスタンスの選択に役立ちます。 「最高のパフォーマンスでゲーム アプリのビデオ エンコーディング ワークロードをデプロイするための適切な EC2 インスタンスを見つけるのを手伝ってください」と依頼すると、Q はインスタンス ファミリーのリストと各提案の理由を取得します。 また、ワークロードに最適な選択を見つけるために、フォローアップの質問をいくつでもすることができます。

- コードのデバッグ、テスト、最適化を支援します。 IDE でのコーディング中にエラーが発生した場合は、Amazon Q に「コードに IO エラーがあります。修正を提供してもらえますか?」と尋ねることができます。 Q がコードを生成します。 この提案が気に入った場合は、Amazon Q に修正をアプリケーションに追加するよう依頼できます。 Amazon Q は IDE 内にあるため、作業中のコードを理解し、修正を挿入する場所を認識します。 Amazon Q は、コードに挿入して実行できる単体テスト (「選択した関数の単体テストを作成する」) を作成することもできます。 最後に、Amazon Q は、コードを最適化してパフォーマンスを向上させる方法を教えてくれます。 Q に「選択した DynamoDB クエリを最適化してください」と依頼すると、コードの理解に基づいて、ワンクリックで実装できる付随コードとともに、修正すべき点に関する自然言語の提案が提供されます。

- 問題の診断とトラブルシューティング: AWS マネジメントコンソールで EC2 アクセス許可エラーや Amazon S3 設定エラーなどの問題が発生した場合は、「Amazon Q でトラブルシューティング」ボタンを押すだけで、エラーの種類とエラーが発生しているサービスの理解が利用されます。修正のための提案を提供します。 Amazon Q にネットワークのトラブルシューティングを依頼することもできます (例: 「SSH を使用して EC2 インスタンスに接続できないのはなぜですか?」)。Q はエンドツーエンドの設定を分析し、診断を提供します (例: 「このインスタンス」プライベート サブネット内にあると思われるため、パブリック アクセスを確立する必要がある可能性があります。」)

- 新しいコードベースをすぐに強化します。 IDE で Amazon Q とチャットすると、ソフトウェア構築の専門知識とコードの理解が組み合わされ、強力な組み合わせとなります。 以前は、他の人からプロジェクトを引き継いだ場合、またはチームに初めて参加した場合、コードとドキュメントを手動で確認して、コードがどのように機能し、何を行うのかを理解するために何時間も費やす必要がありました。 Amazon Q は IDE のコードを理解するので、Amazon Q にコードの説明を求めるだけで (「このアプリケーションが何を行うのか、どのように機能するのか説明してください」)、Q はどのサービスがどのようなサービスを実行するのかなどの詳細を教えてくれます。コードが使用するものと、さまざまな関数が何を行うか (たとえば、Q は「このアプリケーションは Python Flask と AWS Lambda を使用して基本的なサポート チケット システムを構築しています」などと答えて、それぞれのコア機能、その実装方法、などなど)。

- 機能のバックログをより迅速にクリアします。 Amazon Q にガイドを依頼し、アプリケーションに機能を追加するエンドツーエンドのプロセスの多くを自動化することもできます。 Amazon コードカタリスト、チーム向けの統合ソフトウェア開発サービス。 これを行うには、チームメイトと同じように、問題リストからバックログ タスクを Q に割り当てるだけで、Q は機能を構築して実装する方法について段階的な計画を生成します。 計画を承認すると、Q がコードを作成し、コード レビューとして提案された変更を提示します。 (必要に応じて) 再作業をリクエストしたり、承認したり、デプロイしたりできます。

- ほんの少しの時間でコードをアップグレードします。 ほとんどの開発者は、実際には、新しいコードの作成や新しいアプリケーションの構築に費やす時間のほんの一部だけです。 彼らはサイクルの多くを、メンテナンスやアップグレードなどの面倒で時間がかかる分野に費やします。 言語バージョンのアップグレードを行ってください。 アップグレードには数か月、場合によっては数年かかり、開発者には数千時間の時間がかかるため、多くの顧客が古いバージョンの Java を使い続けています。 これを先延ばしにすると、実際のコストとリスクが伴います。パフォーマンスの向上を逃すことになり、セキュリティの問題に対して脆弱になります。 私たちは Amazon Q がここで大きな変革をもたらす可能性があると考えており、それに興奮しています。 Amazon Qコード変換、この機能により、この重労働の多くが削除され、アプリケーションのアップグレードにかかる時間を数日から数分に短縮できます。 IDE で更新したいコードを開き、Amazon Q にコードを「/transform」するよう依頼するだけです。 Amazon Q は、アプリケーションのソースコード全体を分析し、ターゲット言語とバージョンでコードを生成し、テストを実行して、最新の言語バージョンのセキュリティとパフォーマンスの強化を実現するのに役立ちます。 最近、Amazon 開発者の非常に小規模なチームが Amazon Q Code Transformation を使用して、わずか 1,000 日で 8 個の実稼働アプリケーションを Java 17 から Java 10 にアップグレードしました。 8 回のアプリケーションあたりの平均時間は 11 分未満でした。 現在、Amazon Q Code Transformation は、Java 17 または Java XNUMX から Java XNUMX への Java 言語アップグレードを実行します。次に (そしてすぐに) 登場するのは、.NET Framework をクロスプラットフォーム .NET に変換する機能です (将来的にはさらに多くの変換が続く予定です)。 。

Amazon Q はあなたのビジネスエキスパートです: Amazon Q をビジネスデータ、情報、システムに接続すると、すべてを統合し、人々が問題を解決し、コンテンツを生成し、ビジネスに関連するアクションを実行できるように、カスタマイズされた支援を提供できます。 Amazon Q をビジネスに導入するのは簡単です。 Amazon S40、Microsoft 3、Salesforce、ServiceNow、Slack、Atlassian、Gmail、Google Drive、Zendesk などの一般的なエンタープライズ システムへの 365 以上のコネクタが組み込まれています。 また、社内イントラネット、Wiki、ランブックに接続することもでき、Amazon Q SDK を使用すると、任意の内部アプリケーションへの接続を構築できます。 これらのリポジトリに Amazon Q を指定すると、ビジネスが「強化」され、会社をユニークなものにするセマンティック情報が取得および理解されます。 次に、独自のフレンドリーでシンプルな Amazon Q ウェブアプリケーションを入手して、社内の従業員が会話型インターフェイスを操作できるようにします。 また、Amazon Q はアイデンティティプロバイダーに接続して、ユーザー、そのロール、アクセスが許可されているシステムを理解することで、ユーザーが詳細で微妙な質問をして、表示を許可されている情報のみを含む調整された結果を取得できるようにします。 Amazon Q は、提供された資料や知識に正確かつ忠実な回答と洞察を生成します。また、機密トピックを制限したり、キーワードをブロックしたり、不適切な質問や回答を除外したりすることができます。 ビジネスの新しいエキスパート アシスタントを使用してできることの例をいくつか示します。

- ビジネス データと情報に基づいて、明確で関連性の高い回答を入手します。 従業員は、これまであらゆる種類のソースを調べ回らなければならなかったかもしれないことについて、Amazon Q に質問できます。 「ロゴ使用に関する最新のガイドラインは何ですか?」または「会社のクレジット カードを申請するにはどうすればよいですか?」と質問すると、Amazon Q は見つけたすべての関連コンテンツを合成し、迅速な回答と関連するコンテンツへのリンクを返します。ソース (ブランド ポータルやロゴ リポジトリ、企業の T&E ポリシー、カード アプリケーションなど)。

- 日常のコミュニケーションを合理化します。 質問するだけで、Amazon Q はコンテンツを生成し (「このドキュメントで説明されている製品を発表するブログ投稿と 3 つのソーシャル メディアのヘッドラインを作成する」)、エグゼクティブ サマリーを作成します (「実行項目の箇条書きリストを含む会議記録の概要を書く」)。 )、電子メールで最新情報を提供し(「インドのお客様向けの第 XNUMX 四半期トレーニング プログラムを紹介する電子メールの草案を作成する」)、会議の構成を支援します(「最新の顧客満足度レポートについて話すための会議の議題を作成する」)。

- タスクを完了します。 Amazon Q は特定のタスクの完了を支援し、従業員がチケットの提出などの反復作業に費やす時間を削減します。 Amazon Q に「新しい価格オファーに関する顧客のフィードバックを Slack で要約してください」と依頼し、Q がその情報を取得して Jira でチケットを開き、マーケティング チームに最新情報を提供するようにリクエストします。 Q に「この通話記録を要約してください」と依頼し、「Salesforce で顧客 A の新しいケースをオープンしてください」と依頼できます。 Amazon Q は、Zendesk や Service Now などの他の人気のある作業自動化ツールをサポートしています。

Amazon Q は Amazon QuickSight にあります。 QuickSight の Amazon Q, AWS のビジネス インテリジェンス サービスでは、ユーザーはダッシュボードで「先月注文数が増加したのはなぜですか?」などの質問をすることができます。 増加に影響を与えた要因を視覚化して説明します。 また、アナリストは Amazon Q を使用して、「月ごとの地域別の売上を積み上げ棒グラフで表示してください」などの簡単なプロンプトを表示するだけで、ダッシュボードの構築にかかる時間を数日から数分に短縮できます。 Q はその図をすぐに返してくるので、それをダッシュボードに簡単に追加したり、Q とさらにチャットして視覚化を調整したりすることができます (例: 「棒グラフをサンキー図に変更する」または「地域の代わりに国を表示する」)。 また、QuickSight の Amazon Q を使用すると、既存のダッシュボードを使用してビジネス関係者に情報を提供し、重要な洞察を抽出し、データストーリーを使用して意思決定を簡素化することが容易になります。 たとえば、ユーザーは Amazon Q に「上級幹部によるビジネスレビューのために、先月ビジネスがどのように変化したかについてのストーリーを作成してください」と指示すると、Amazon Q は数秒で、視覚的に説得力があり、魅力的なデータ駆動型のストーリーを提供します。完全にカスタマイズ可能。 これらのストーリーは組織全体で安全に共有できるため、利害関係者の調整を図り、より良い意思決定を促進することができます。

Amazon Q は Amazon Connect にあります。 弊社のコンタクトセンターサービスである Amazon Connect では、Amazon Q はカスタマーサービスエージェントがより良いカスタマーサービスを提供できるように支援します。 Amazon Q は、エージェントが顧客向けの情報を取得するために通常使用するナレッジリポジトリを活用し、エージェントは Connect で Amazon Q と直接チャットして回答を得ることができ、ドキュメントを自分で検索する必要なく、顧客のリクエストにより迅速に対応するのに役立ちます。 また、Amazon Q とのチャットで非常に迅速な回答が得られるのは素晴らしいことですが、カスタマー サービスでは速すぎるということはありません。 それが理由です Amazon Qインコネクト エージェントとの顧客とのライブ会話をプロンプトに変換し、エージェントに考えられる応答、推奨アクション、リソースへのリンクを自動的に提供します。 たとえば、Amazon Q は、顧客が予約を変更するためにレンタカー会社に連絡していることを検出し、エージェントに応答を生成して、会社の変更料金ポリシーがどのように適用されるかを迅速に伝え、エージェントに予約の更新に必要な手順を案内します。予約。

Amazon Q は AWS サプライチェーンに含まれます (近日公開予定): サプライチェーン洞察サービスである AWS Supply Chain では、Amazon Q は、需給プランナー、在庫管理者、取引パートナーが潜在的な在庫切れまたは在庫過剰のリスクを要約して強調表示し、問題を解決するシナリオを視覚化することでサプライチェーンを最適化するのに役立ちます。 ユーザーは Amazon Q にサプライチェーンデータに関する「何を」、「なぜ」、「どうしたら」の質問をし、複雑なシナリオやサプライチェーンのさまざまな意思決定間のトレードオフを通じてチャットすることができます。 たとえば、顧客が「出荷の遅れの原因は何ですか?どうすれば早くできるでしょうか?」と尋ねるかもしれません。 これに対し、Amazon Q は次のように答えるかもしれません。「ご注文の 90% は東海岸で、南東部での大嵐により 24 時間の遅れが発生しています。 マイアミではなくニューヨーク港に発送すれば、配達が迅速化され、コストが 50% 削減されます。」

当社のお客様は生成 AI を急速に導入しており、AWS で画期的なモデルをトレーニングし、Amazon Bedrock を使用して記録的な速度で生成 AI アプリケーションを開発し、Amazon Q のような革新的なアプリケーションを組織全体にデプロイしています。最新の発表により、AWS はは、スタックのすべての層でさらに多くのパフォーマンス、選択肢、イノベーションをお客様に提供します。 私たちが re:Invent で提供しているすべての機能の総合的な影響は、エキサイティングで有意義な目標の達成に向けた大きなマイルストーンです。私たちは、あらゆる規模や技術能力の顧客が生成 AI にアクセスできるようにして、顧客が何を再発明して変革できるようにしています。可能だ。

リソース

著者について

スワミ・シバスブラマニアン AWS のデータおよび機械学習担当副社長です。 この役割で、Swami はすべての AWS データベース、分析、AI および機械学習サービスを監督しています。 彼のチームの使命は、組織がデータを完全なエンド ツー エンドのデータ ソリューションで活用し、保存、アクセス、分析、視覚化、予測できるよう支援することです。

スワミ・シバスブラマニアン AWS のデータおよび機械学習担当副社長です。 この役割で、Swami はすべての AWS データベース、分析、AI および機械学習サービスを監督しています。 彼のチームの使命は、組織がデータを完全なエンド ツー エンドのデータ ソリューションで活用し、保存、アクセス、分析、視覚化、予測できるよう支援することです。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- :持っている

- :は

- :not

- :どこ

- $UP

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 300

- 視聴者の38%が

- 40

- 50

- 500

- 65

- 8

- 9

- a

- 能力

- 能力

- できる

- 私たちについて

- 上記の.

- 加速する

- 加速された

- 加速器

- アクセンチュア

- アクセス

- 接近性

- アクセス可能な

- 会計

- 精度

- 正確な

- 取得する

- 越えて

- Action

- 行動

- 積極的に

- 実際に

- 適応する

- 加えます

- 追加されました

- 追加

- 添加

- NEW

- さらに

- 追加

- 追加

- アディダス

- Adobe

- 採用

- 高度な

- 前進

- 利点

- 利点

- 広告運用

- アドバイス

- 後

- に対して

- 議題

- エージェント

- エージェント

- 集計

- 前

- AI

- AIと機械学習

- AIチャットボット

- 愛の研究

- AI電源

- 整列する

- すべて

- 許す

- ことができます

- 沿って

- 既に

- また

- 常に

- Amazon

- アマゾン コード ウィスパラー

- Amazon EC2

- アマゾンクイックサイト

- アマゾンセージメーカー

- Amazon Webサービス

- 量

- 金額

- an

- 分析

- アナリスト

- アナリスト

- 分析論

- 分析します

- 分析

- および

- アナウンス

- お知らせ

- 発表

- 回答

- 回答

- 人間原理

- どれか

- 誰も

- 何でも

- API

- API

- アプリ

- 登場する

- 申し込み

- 申し込む

- 認める

- アプローチ

- 承認する

- 承認された

- アプリ

- 4月

- です

- AREA

- エリア

- 間違いなく

- 周りに

- AS

- 頼む

- 援助

- アシスタント

- アシスタント

- 関連する

- 仲間

- At

- アトラシアン

- 増強

- 増強された

- 補強します

- オーロラ

- 許可

- 自動化する

- 自動化する

- オートマチック

- 自動的に

- オートメーション

- 自動車

- 賃貸条件の詳細・契約費用のお見積り等について

- 利用できます

- 平均

- 避ける

- 離れて

- AWS

- AWSインフェレンティア

- AWSラムダ

- AWSマネジメントコンソール

- バック

- バンキング

- バー

- 障壁

- ベース

- ベース

- 基本

- BE

- なぜなら

- になる

- き

- 始まった

- 信じる

- 利点

- BEST

- ベストプラクティス

- より良いです

- の間に

- ビッグ

- 10億

- 億

- ブロック

- ブロック

- ブログ

- ボーイング

- ボルト

- 予約

- Booking.com

- 本

- 両言語で

- ボトム

- 境界

- ブランド

- ブレーク

- 休憩

- 持って来る

- 持参

- ビルド

- 建物

- 構築します

- 内蔵

- 内蔵

- ビジネス

- ビジネス・インテリジェンス

- ビジネス

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- (Comma Separated Values) ボタンをクリックして、各々のジョブ実行の詳細(開始/停止時間、変数値など)のCSVファイルをダウンロードします。

- by

- コール

- コールセンター

- 缶

- 取得することができます

- 機能

- 機能

- できる

- 容量

- キャプチャ

- 自動車

- カーボン

- 炭素排出量

- カード

- 慎重に

- 場合

- 例

- カテゴリ

- 原因

- センター

- 一定

- 確かに

- チェーン

- 挑戦する

- 課題

- 変化する

- 変更

- チェンジャー

- 変更

- 変化

- 特性

- チャート

- チャート

- チャットルーム

- チャットボット

- チャットボット

- チャット

- チェック

- チップ

- チップ

- 選択

- 選択する

- 選択する

- 選ばれた

- クレーム

- クラス

- クリーニング

- クリア

- クリック

- クラウド

- クラウドインフラ

- クラスタ

- クラスタリング

- 海岸

- コード

- コードベース

- コードレビュー

- コーディング

- 協業

- 環境、テクノロジーを推奨

- COM

- 組み合わせ

- 組み合わせる

- 組み合わせた

- 組み合わせ

- 来ます

- comes

- 到来

- 近日公開

- 伝える

- 通信部

- 企業

- 会社

- 会社の

- 比べ

- 説得力のある

- コンプリート

- 完全に

- 複雑な

- 複雑さ

- 包括的な

- 計算

- コンセプト

- 構成する

- 推測

- お問合せ

- 交流

- 接続

- 接続性

- コネクト

- 整合性のある

- 領事

- 制約

- 消費者

- 消費

- 接触

- コンタクトセンター

- コンテナ

- コンテンツ

- コンテキスト

- 文脈上の

- 続ける

- 継続します

- 続ける

- 連続

- コントロール

- controls

- 会話

- 会話

- 会話

- 著作権

- 広告文案作成

- 基本

- 費用

- コスト効率の良い

- コスト

- 国

- コックス

- 作ります

- 作成した

- 創造性

- クリエイター

- クレジット

- クレジットカード

- 犯罪

- CRISP

- CRM

- クロスプラットフォームの

- 顧客

- 顧客満足体験

- 顧客満足

- 顧客サービス

- Customers

- カスタマイズ可能な

- カスタム化

- カスタマイズ

- カスタマイズ

- カット

- サイクル

- daily

- ダッシュボード

- ダッシュボード

- データ

- データの準備

- データプライバシー

- データのプライバシーとセキュリティ

- データセット

- データ駆動型の

- データベース

- データベースを追加しました

- データブリック

- 中

- 日々

- 日

- 意思決定

- 決定

- 深いです

- 深い学習

- より深い

- 定義

- 度

- 遅らせる

- 配信する

- 配達

- 配信する

- 提供します

- 需要

- 民主化

- によっては

- 展開します

- 展開

- 展開する

- 展開

- 深さ

- 説明する

- 記載された

- 説明

- 設計

- 希望

- 詳細な

- 細部

- 検出

- 決定する

- ドイツテレコム

- Developer

- 開発者

- 開発

- 開発

- 診断

- 対話

- 対話

- DID

- 異なります

- デジタル

- 直接に

- 分配します

- 配布

- 分散トレーニング

- 配布する

- do

- ドキュメント

- ドキュメント

- ドキュメント

- ありません

- そうではありません

- すること

- 行われ

- ドント

- 倍増し

- ダウン

- ドライブ

- 原因

- 複製

- デュレーション

- e

- eコマース

- 各

- 早い

- 容易

- 簡単に

- 東

- 東海岸

- 簡単に

- Economics

- エディション

- 効果的に

- 効率

- 効率良く

- 努力

- どちら

- ほかに

- メール

- 排出量

- 社員

- エンパワー

- エンパワーメント

- enable

- 有効にする

- エンコーディング

- 出会い

- end

- 端から端まで

- エネルギー

- エネルギー消費

- エネルギー効率

- エンジニア

- エンジニアリング

- 高めます

- 強化

- 濃縮

- Enterprise

- エンタープライズグレード

- 企業

- エンターテインメント

- 全体

- 封筒

- 時代

- ERP

- エラー

- エラー

- エーテル(ETH)

- 評価

- さらに

- イベント

- EVER

- あらゆる

- 誰も

- すべてのもの

- 進化

- 進化

- 例

- 例

- 興奮した

- エキサイティング

- 実行します

- エグゼクティブ

- 既存の

- 広大な

- 期待する

- 迅速化する

- 高価な

- 体験

- 経験豊かな

- エクスペリエンス

- エキスパート

- 専門知識

- 説明する

- 探る

- 表現します

- ファブリック

- 顔

- 実際

- 要因

- かなり

- 忠実な

- ファルコン

- 秋

- おなじみの

- 家族

- 家族

- スピーディー

- 速いです

- 欠陥のある

- 特徴

- 特徴

- 代

- フィードバック

- 少数の

- ファイリング

- filter

- 最後に

- ファイナンシャル

- もう完成させ、ワークスペースに掲示しましたか?

- 発見

- 発見

- 終わり

- 仕上げ

- 名

- 修正する

- フレキシブル

- 焦点を当て

- 消費者向け

- フォワード

- 発見

- Foundation

- 4

- 分数

- フレームワーク

- フレームワーク

- 無料版

- 頻繁に

- 優しい

- から

- 機能

- さらに

- 未来

- ゲーム

- ゲームチェンジャー

- 賭博

- 一般に

- 生成する

- 生成

- 生成

- 世代

- 生々しい

- 生成AI

- ジェネレータ

- 取得する

- 受け

- 与える

- グローバル

- グローバルデジタル

- Gmailの

- Go

- 目標

- 行く

- 良い

- でログイン

- GPU

- GPU

- 素晴らしい

- 陸上

- 画期的な

- グループ

- 成長

- 成長した

- ガイダンス

- ガイド

- ガイドライン

- 持っていました

- ハンド

- 出来事

- ハード

- Hardware

- 有害な

- 嫌い

- ヘイト·スピーチ

- 持ってる

- 持って

- ヘッドライン

- ヘルスケア

- ヘビー

- 重いもの

- 助けます

- 助け

- ことができます

- こちら

- ハイ

- より高い

- 最高

- 強調表示

- 非常に

- 雇う

- 彼の

- ホスティング

- HOURS

- 認定条件

- How To

- しかしながら

- HTTPS

- 何百

- i

- ID

- アイデンティティ

- アイデンティティ

- イド

- if

- 画像

- 画像生成

- 画像

- 即時の

- 影響

- 実装する

- 実装

- 実装

- import

- 重要

- 印象的

- 改善します

- 改善されました

- 改善

- in

- include

- 含ま

- 含めて

- 増える

- 増加した

- の増加

- インジケータ

- 個人

- 産業

- 産業を変えます

- 業界をリードする

- 影響を受け

- info

- 知らせます

- 情報

- インフラ

- 革新します

- 革新的

- 革新的手法

- イノベーション

- 革新的な

- 入力

- 洞察力

- 洞察

- インスタンス

- を取得する必要がある者

- 機関

- 説明書

- 保険

- 統合

- 知的

- 知的財産

- インテリジェンス

- 意図する

- 対話

- 相互作用

- 相互作用する

- 相互接続

- インタフェース

- 内部

- 介入する

- に

- 紹介する

- 導入

- 導入

- 発明された

- インベントリー

- 投資する

- 調査的

- 投資

- 投資

- インベストメント

- 関係する

- 関与

- 問題

- IT

- ITプロフェッショナル

- ITS

- 日本語

- 専門用語

- Java

- JPG

- ただ

- 一つだけ

- キープ

- 保管

- キー

- 重要な場所

- キーワード

- キット

- キット(SDK)

- 知っている

- 知識

- 知っている

- ラボ

- 欠如

- 言語

- 大

- 大規模

- 最大の

- 姓

- 昨年

- 遅く

- レイテンシ

- 最新の

- 打ち上げ

- 発射

- 弁護士

- 層

- 層

- リーダーシップ

- 主要な

- LEARN

- 学んだ

- 学習

- リーガルポリシー

- less

- ことができます

- レベル

- 活用します

- レバレッジ

- レクシスネクシス

- LG

- ライブラリ

- wifecycwe

- フェイスリフト

- ような

- 可能性が高い

- 制限

- 限定的

- 制限

- ライン

- LINK

- リンク

- リスト

- ライブ

- 命

- ラマ

- 位置して

- 場所

- 論理的な

- ロゴ

- 長い

- 長年の

- たくさん

- 愛

- ロー

- 下側

- 最低

- 機械

- 機械学習

- 製

- 維持する

- 保守

- メンテナンス

- 主要な

- make

- 作る

- 作成

- マネージド

- 管理

- マネージャー

- マニュアル

- 手仕事

- 手動で

- 多くの

- マーケティング

- 材料

- 材料

- 五月..

- me

- 意味のある

- 手段

- メディア

- 大会

- ご相談

- ミーティング

- ミーツ

- メンバー

- 単なる

- Meta

- 方法

- マイアミ

- Microsoft

- Microsoft 365

- 真ん中

- かもしれない

- マイルストーン

- 分

- ミス

- ミッション

- ML

- モデリング

- モデル

- 近代化

- 弾み

- MongoDBの

- モニター

- 月

- ヶ月

- 他には?

- 最も

- 一番人気

- 移動する

- MRI検査

- ずっと

- の試合に

- 音楽を聴く際のスピーカーとして

- しなければなりません

- my

- 名

- ナスダック

- ナチュラル

- 自然言語

- 近く

- 必要

- 必要

- 必要とされる

- 必要

- net

- ネットワーク

- ネットワーキング

- 新作

- ニューヨーク

- 新しく

- 次の

- Nitro

- いいえ

- ノートPC

- 今

- 数

- Nvidia

- of

- オフ

- 攻撃

- 提供

- 提供すること

- オファー

- 頻繁に

- 古い

- on

- かつて

- ONE

- もの

- オンライン

- オンラインバンキング

- の

- 開いた

- 操作する

- 業務執行統括

- 最適化

- 最適化

- 最適化

- オプション

- or

- 受注

- 組織

- 組織

- オリジナル

- その他

- その他

- 私たちの

- でる

- アウトライン

- 出力

- outputs

- が

- オーバーストック

- 圧倒的に

- 自分の

- 平和

- パッケージ

- 痛みを伴う

- 足

- パラメーター

- パラメータ

- 部

- パートナー

- 部品

- 過去

- パターン

- 一時停止

- のワークプ

- 以下のために

- 実行する

- パフォーマンス

- 実行

- 実行する

- 許可

- パーミッション

- 人

- 個人化

- 個人

- 個人的に

- PGAツアー

- フレーズ

- 敬虔な

- 場所

- 計画

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- さらに

- ポイント

- ポリシー

- 人気

- 正の

- 可能

- ポスト

- 潜在的な

- 電力

- パワード

- 強力な

- 実用的

- 事実上

- プラクティス

- 正確な

- 予測する

- 予測

- プ

- 準備

- 準備

- 現在

- 社長

- を押す

- プレビュー

- 前に

- ブランド

- 価格設定

- 主要な

- プライバシー

- プライバシーとセキュリティ

- プライベート

- 個人情報

- 問題

- 問題

- プロセス

- ラボレーション

- 処理

- 作り出す

- プロダクト

- 生産

- 生産性の高い

- 生産性

- プロ

- 専門家

- プログラム

- プロジェクト

- プロンプト

- 財産

- 所有権

- 保護

- 保護

- 提供します

- プロバイダー

- プロバイダ

- は、大阪で

- 提供

- 公共

- 公然と

- 目的

- プッシュ

- 押す

- 置きます

- パッティング

- Python

- パイトーチ

- Q3

- 質問

- 質問

- クイック

- すぐに

- 非常に

- R&D

- 範囲

- 急速な

- 急速に

- 価格表

- RE

- リーディング

- リアル

- への

- 現実的な

- 実現する

- 実現

- 本当に

- 収穫

- 理由は

- 最近

- おすすめ

- 提言

- 記録

- 減らします

- 電話代などの費用を削減

- 縮小

- リファイン

- 地域

- リリース

- 関連した

- 信頼性

- 残っている

- 削除します

- 除去

- 修理

- 反復的な

- 置換

- 返信

- レポート

- 倉庫

- 要求

- リクエスト

- の提出が必要です

- 要件

- 研究

- 予約

- ご予約

- 解像度

- 共鳴する

- リソース

- 尊重

- 反応します

- 応答

- 応答

- 回答

- 責任

- 制限する

- 制限されました

- 結果

- 結果

- 返す

- レビュー

- レビュー

- 右

- リスク

- 職種

- 役割

- 客室

- ルート

- ルール

- ラン

- ランニング

- 滑走路

- 犠牲にする

- 安全な

- 保障措置

- 安全に

- セージメーカー

- セールス

- salesforce

- 同じ

- 満足

- Save

- 格言

- 規模

- スケーリング

- シナリオ

- スコープ

- スコア

- スクラッチ

- SDDK

- シームレス

- を検索

- 二番

- 第2世代

- 秒

- 安全に

- しっかりと

- セキュリティ

- 見ること

- 見て

- select

- 選択

- 選択

- 送信

- シニア

- 上級指導者

- 敏感な

- 9月

- シーケンス

- シリーズ

- サーバ

- サービス

- ServiceNow

- サービス

- セッションに

- セット

- いくつかの

- シェアする

- shared

- 船

- ショート

- すべき

- 側

- 重要

- シリコン

- 同様に

- 簡単な拡張で

- 簡素化する

- 単に

- から

- SIX

- サイズ

- スラック

- 小さい

- So

- 社会

- ソーシャルメディア

- ソフトウェア

- ソフトウェア開発者

- ソフトウェア開発

- ソフトウェア開発キット

- 溶液

- ソリューション

- 解決する

- 一部

- 誰か

- 何か

- すぐに

- 洗練された

- ソース

- ソースコード

- ソース

- 南東

- スペース

- スパーク

- 特に

- スピーチ

- スピード

- 過ごす

- 安定性

- 安定した

- スタック

- 積み上げ

- ステークホルダー

- 開始

- 起動

- スタートアップ

- 最先端の

- 滞在

- 手順

- ステップ

- まだ

- ストレージ利用料

- 店舗

- 店舗

- ストーリー

- ストーム

- ストーリー

- 流線

- 強化する

- 厳しい

- 構造

- 勉強

- サブネット

- かなりの

- そのような

- 適当

- スイート

- まとめる

- 概要

- スーパー

- 補足

- サプライヤー

- 供給

- 需要と供給

- サプライチェーン

- サポート

- サポート

- 確か

- 驚くべき

- 監視

- 疑わしい

- 3つの柱

- スイッチ

- 合成する

- システム

- テーブル

- テーラード

- 取る

- 取り

- 取得

- Talk

- ターゲット

- 仕事

- タスク

- チーム

- チームメンバー

- チーム

- 技術的

- 技術

- テクニック

- テクノロジー

- テクノロジー

- 技術革新

- 言う

- 占い

- 10

- 十

- テンソルフロー

- 用語

- test

- テスト

- テスト

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- テキスト生成

- より

- それ

- 未来

- 世界

- アプリ環境に合わせて

- それら

- 自分自身

- その後

- そこ。

- ボーマン

- 彼ら

- もの

- 物事

- 考える

- 三番

- この

- 今年

- それらの

- 数千

- 三

- 介して

- 全体

- スループット

- チケット

- チケット

- 時間

- <font style="vertical-align: inherit;">回数</font>

- タイタン

- 〜へ

- 今日

- 今日の

- 一緒に

- トークン

- あまりに

- 取った

- ツール

- 豊富なツール群

- top

- トピック

- ツアー

- に向かって

- に向かって

- 追跡する

- トレーディング

- トレーニング

- 訓練された

- トレーニング

- 取引

- 成績証明書(トランスクリプト)

- 最適化の適用

- 変換

- 変換

- 変換

- 旅行

- 数兆

- 旅行

- 真に

- 信頼

- 試します

- しよう

- ターン

- 2

- type

- 一般的に

- 根本的な

- わかる

- 理解できる

- 理解する

- 理解する

- 未知

- 統一

- ユニーク

- ユニークな機能

- 単位

- 異なり、

- まで

- アップデイト

- 更新版

- アップグレード

- アップグレード

- us

- 使用法

- つかいます

- 使用事例

- 中古

- ユーザー

- users

- 使用されます

- 貴重な

- 多様

- さまざまな

- バージョン

- 対

- 非常に

- 、

- バイス

- 副会長

- ビデオ

- 事実上

- 可視化

- 視覚化する

- 視覚的に

- ボリューム

- 脆弱な

- 欲しいです

- ワーナー

- ワーナーミュージックグループ

- ました

- ウェーブ

- 仕方..

- 方法

- we

- ウェブ

- ウェブアプリケーション

- Webサービス

- ウェブサイト

- 週間

- ウィークス

- 歓迎

- WELL

- 周知

- した

- この試験は

- 何ですか

- いつ

- かどうか

- which

- while

- 誰

- なぜ

- ワイド

- 広い範囲

- より広い

- 意志

- ウィンドウを使用して入力ファイルを追加します。

- 以内

- 無し

- 仕事

- 働いていました

- ワークフロー

- ワーキング

- 作品

- 世界

- ワールドクラス

- 不安

- 価値

- でしょう

- 書きます

- コードを書く

- 書き込み

- 年

- 年

- ヨーク

- 貴社

- あなたの

- のZendesk

- ゼファーネット