L'importanza dei data warehouse e dell'analisi eseguita sulle piattaforme di data warehouse è aumentata costantemente nel corso degli anni, con molte aziende che si affidano a questi sistemi come mission-critical sia per il processo decisionale operativo a breve termine che per la pianificazione strategica a lungo termine. Tradizionalmente, i data warehouse vengono aggiornati in cicli batch, ad esempio mensili, settimanali o giornalieri, in modo che le aziende possano ricavarne varie informazioni.

Molte organizzazioni si stanno rendendo conto che l'acquisizione di dati quasi in tempo reale insieme all'analisi avanzata apre nuove opportunità. Ad esempio, un istituto finanziario può prevedere se una transazione con carta di credito è fraudolenta eseguendo un programma di rilevamento delle anomalie in modalità quasi in tempo reale anziché in modalità batch.

In questo post, mostriamo come Amazon RedShift può fornire previsioni di streaming ingestion e machine learning (ML) in un'unica piattaforma.

Amazon Redshift è un data warehouse su cloud veloce, scalabile, sicuro e completamente gestito che rende semplice e conveniente analizzare tutti i tuoi dati utilizzando SQL standard.

Amazon RedshiftML semplifica agli analisti di dati e agli sviluppatori di database la creazione, il training e l'applicazione di modelli ML utilizzando comandi SQL familiari nei data warehouse di Amazon Redshift.

Siamo entusiasti di lanciare Importazione streaming Amazon Redshift per Flussi di dati di Amazon Kinesis ed Streaming gestito da Amazon per Apache Kafka (Amazon MSK), che consente di importare i dati direttamente da un flusso di dati Kinesis o da un argomento Kafka senza dover mettere in scena i dati Servizio di archiviazione semplice Amazon (Amazon S3). L'acquisizione di streaming di Amazon Redshift ti consente di ottenere una bassa latenza nell'ordine di secondi durante l'acquisizione di centinaia di megabyte di dati nel tuo data warehouse.

Questo post dimostra come Amazon Redshift, il data warehouse nel cloud, ti consenta di creare previsioni ML quasi in tempo reale utilizzando l'importazione di streaming di Amazon Redshift e le funzionalità di Redshift ML con il familiare linguaggio SQL.

Panoramica della soluzione

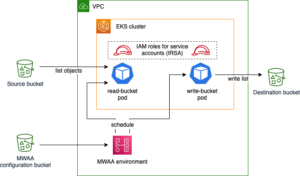

Seguendo i passaggi descritti in questo post, sarai in grado di configurare un'applicazione streamer produttore su un Cloud di calcolo elastico di Amazon (Amazon EC2) che simula le transazioni con carta di credito e invia i dati a Kinesis Data Streams in tempo reale. Configura una vista materializzata di Amazon Redshift Streaming Ingestion su Amazon Redshift, dove vengono ricevuti i dati in streaming. Addestra e costruisci un modello Redshift ML per generare inferenze in tempo reale rispetto ai dati in streaming.

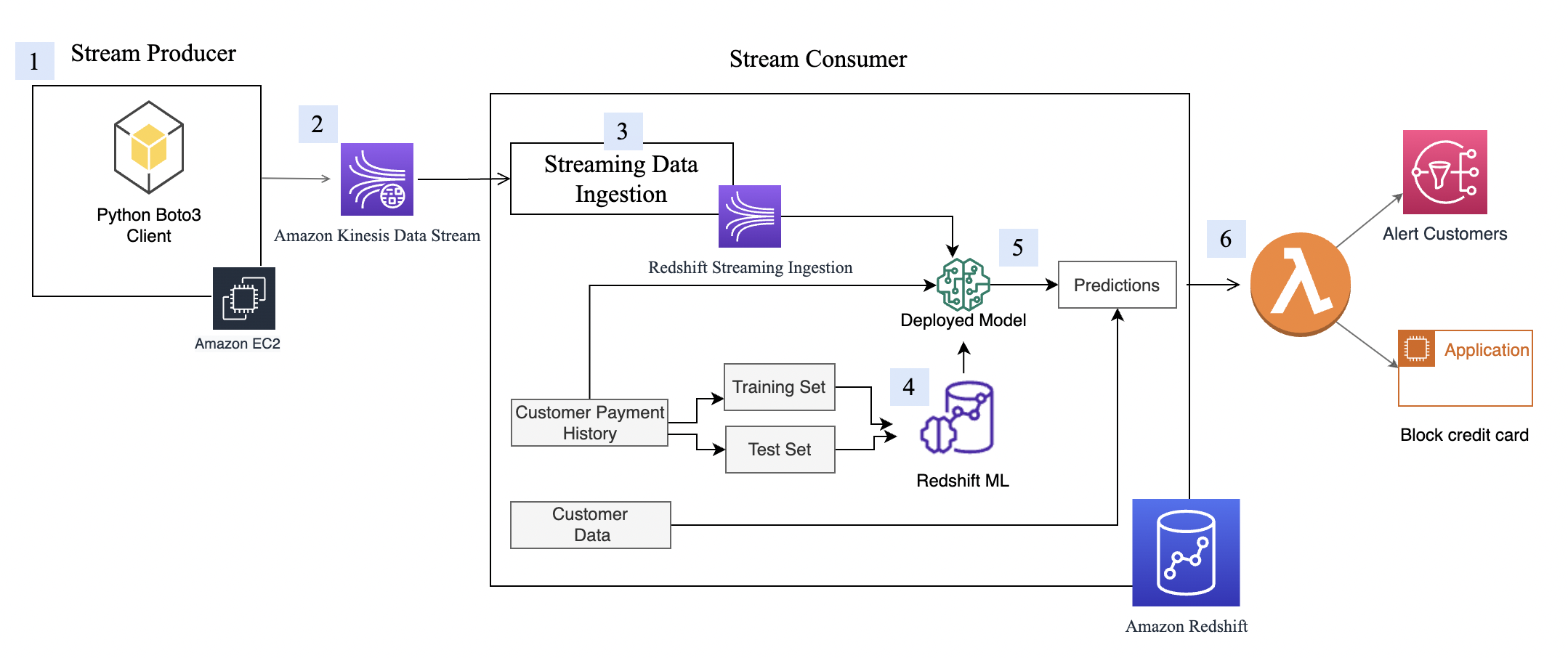

Il diagramma seguente illustra l'architettura e il flusso di processo.

Il processo passo passo è il seguente:

- L'istanza EC2 simula un'applicazione di transazione con carta di credito, che inserisce le transazioni con carta di credito nel flusso di dati Kinesis.

- Il flusso di dati memorizza i dati delle transazioni con carta di credito in entrata.

- Sopra il flusso di dati viene creata una vista materializzata di Amazon Redshift Streaming Ingestion, che inserisce automaticamente i dati in streaming in Amazon Redshift.

- Costruisci, addestra e distribuisci un modello ML utilizzando Redshift ML. Il modello Redshift ML viene addestrato utilizzando dati transazionali storici.

- Trasforma i dati in streaming e generi previsioni ML.

- Puoi avvisare i clienti o aggiornare l'applicazione per mitigare i rischi.

Questa procedura dettagliata usa i dati di streaming delle transazioni con carta di credito. I dati della transazione con carta di credito sono fittizi e si basano su a simulatore. Anche il set di dati del cliente è fittizio e viene generato con alcune funzioni di dati casuali.

Prerequisiti

- Crea un cluster Amazon Redshift.

- Configura il cluster per utilizzare Redshift ML.

- Creare an Gestione dell'identità e dell'accesso di AWS (IAM) utente.

- Aggiorna il ruolo IAM collegato al cluster Redshift per includere le autorizzazioni per accedere al flusso di dati Kinesis. Per ulteriori informazioni sulla politica richiesta, fare riferimento a Iniziare con l'importazione dello streaming.

- Crea un'istanza EC5.4 m2xlarge. Abbiamo testato l'applicazione Producer con l'istanza m5.4xlarge ma sei libero di utilizzare altri tipi di istanza. Quando si crea l'istanza, utilizzare il file amzn2-ami-kernel-5.10-hvm-2.0.20220426.0-x86_64-gp2 AMICO.

- Per assicurarti che Python3 sia installato nell'istanza EC2, esegui il seguente comando per verificare la tua versione di Python (tieni presente che lo script di estrazione dei dati funziona solo su Python 3):

- Installa i seguenti pacchetti dipendenti per eseguire il programma di simulazione:

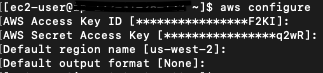

- Configura Amazon EC2 utilizzando le variabili come le credenziali AWS generate per l'utente IAM creato nella fase 3 precedente. Lo screenshot seguente mostra un esempio di utilizzo aws configura.

Configura Kinesis Data Streams

Amazon Kinesis Data Streams è un servizio di streaming di dati in tempo reale altamente scalabile e duraturo. Può acquisire continuamente gigabyte di dati al secondo da centinaia di migliaia di fonti, come flussi di clic di siti Web, flussi di eventi di database, transazioni finanziarie, feed di social media, registri IT ed eventi di tracciamento della posizione. I dati raccolti sono disponibili in millisecondi per consentire casi d'uso di analisi in tempo reale come dashboard in tempo reale, rilevamento di anomalie in tempo reale, prezzi dinamici e altro ancora. Utilizziamo Kinesis Data Streams perché è una soluzione serverless in grado di scalare in base all'utilizzo.

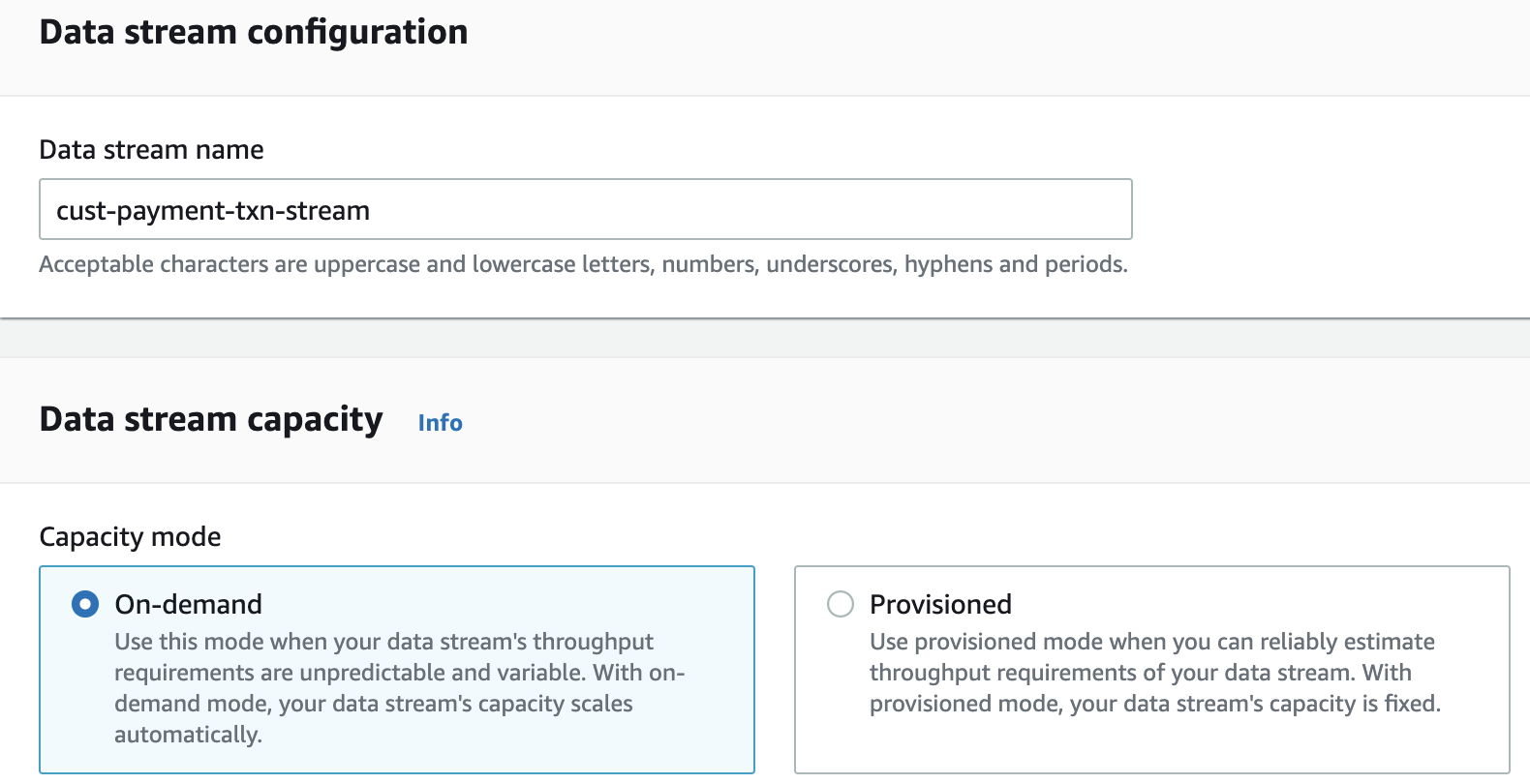

Crea un flusso di dati Kinesis

Innanzitutto, devi creare un flusso di dati Kinesis per ricevere i dati di streaming:

- Sulla console Amazon Kinesis, selezionare Flussi di dati nel pannello di navigazione.

- Scegli Crea flusso di dati.

- Nel Nome del flusso di dati, accedere

cust-payment-txn-stream. - Nel Modalità capacità, selezionare Su richiesta.

- Per il resto delle opzioni, scegli le opzioni predefinite e segui le istruzioni per completare la configurazione.

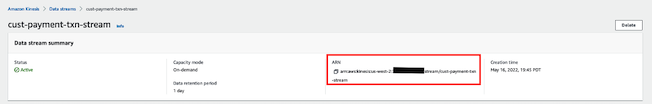

- Acquisisci l'ARN per il flusso di dati creato da utilizzare nella sezione successiva durante la definizione della policy IAM.

Imposta i permessi

Affinché un'applicazione di streaming possa scrivere su Kinesis Data Streams, l'applicazione deve avere accesso a Kinesis. È possibile utilizzare la seguente dichiarazione di policy per concedere al processo del simulatore configurato nella sezione successiva l'accesso al flusso di dati. Utilizza l'ARN del flusso di dati che hai salvato nel passaggio precedente.

Configura il produttore del flusso

Prima di poter consumare dati in streaming in Amazon Redshift, abbiamo bisogno di un'origine dati in streaming che scriva i dati nel flusso di dati Kinesis. Questo post utilizza un generatore di dati personalizzato e il file SDK AWS per Python (Boto3) per pubblicare i dati nel flusso di dati. Per istruzioni sulla configurazione, fare riferimento a Simulatore di produttore. Questo processo di simulazione pubblica i dati in streaming nel flusso di dati creato nel passaggio precedente (cust-payment-txn-stream).

Configura il consumatore del flusso

Questa sezione parla della configurazione del consumatore del flusso (la vista di importazione del flusso di Amazon Redshift).

Amazon Redshift Streaming Ingestion fornisce l'acquisizione a bassa latenza e ad alta velocità di flussi di dati da Kinesis Data Streams in una vista materializzata di Amazon Redshift. Puoi configurare il tuo cluster Amazon Redshift per abilitare l'acquisizione di streaming e creare una vista materializzata con aggiornamento automatico, utilizzando istruzioni SQL, come descritto in Creazione di viste materializzate in Amazon Redshift. Il processo di aggiornamento automatico della vista materializzata ingerirà dati in streaming a centinaia di megabyte di dati al secondo da Kinesis Data Streams in Amazon Redshift. Ciò si traduce in un rapido accesso ai dati esterni che vengono rapidamente aggiornati.

Dopo aver creato la vista materializzata, puoi accedere ai tuoi dati dal flusso di dati utilizzando SQL e semplificare le tue pipeline di dati creando viste materializzate direttamente sopra il flusso.

Completa i passaggi seguenti per configurare una vista materializzata in streaming di Amazon Redshift:

- Nella console IAM, scegli le policy nel riquadro di navigazione.

- Scegli Crea politica.

- Crea una nuova policy IAM chiamata

KinesisStreamPolicy. Per la definizione dei criteri di streaming, vedere Iniziare con l'importazione dello streaming. - Nel pannello di navigazione, scegli Ruoli.

- Scegli Crea ruolo.

- Seleziona Servizio AWS e scegli Redshift e Redshift personalizzabili.

- Crea un nuovo ruolo chiamato

redshift-streaming-rolee allegare la polizzaKinesisStreamPolicy. - Crea uno schema esterno da mappare a Kinesis Data Streams:

Ora puoi creare una vista materializzata per utilizzare i dati del flusso. Puoi utilizzare il tipo di dati SUPER per archiviare il payload così com'è, in formato JSON, oppure utilizzare le funzioni JSON di Amazon Redshift per analizzare i dati JSON in singole colonne. Per questo post, usiamo il secondo metodo perché lo schema è ben definito.

- Crea la vista materializzata per l'importazione dello streaming

cust_payment_tx_stream. Specificando AUTO REFRESH YES nel codice seguente, puoi abilitare l'aggiornamento automatico della vista di importazione del flusso, che consente di risparmiare tempo evitando di creare pipeline di dati:

Si noti che json_extract_path_text ha un limite di lunghezza di 64 KB. Anche from_varbye filtra i record più grandi di 65KB.

- Aggiorna i dati.

La vista materializzata in streaming di Amazon Redshift viene aggiornata automaticamente da Amazon Redshift per te. In questo modo, non devi preoccuparti dell'obsolescenza dei dati. Con l'aggiornamento automatico della vista materializzata, i dati vengono caricati automaticamente in Amazon Redshift non appena diventano disponibili nel flusso. Se scegli di eseguire manualmente questa operazione, utilizza il seguente comando:

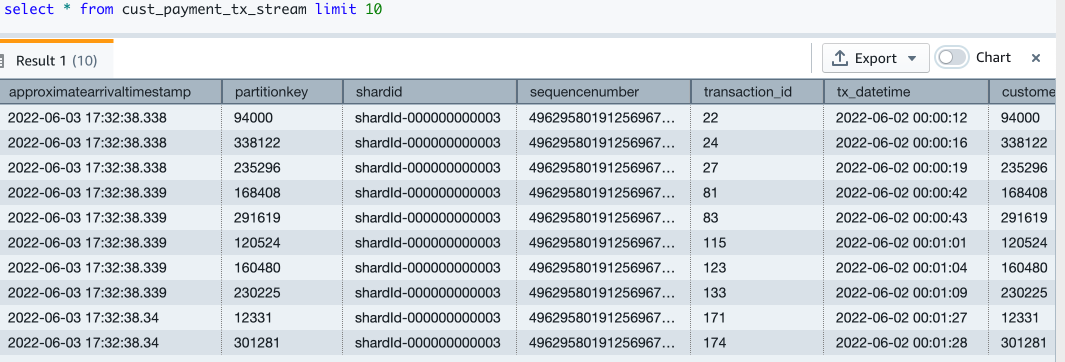

- Ora interroghiamo la vista materializzata in streaming per vedere i dati di esempio:

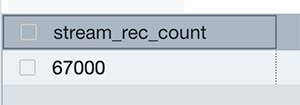

- Controlliamo ora quanti record sono presenti nella visualizzazione in streaming:

Ora hai finito di configurare la vista di importazione dello streaming di Amazon Redshift, che viene continuamente aggiornata con i dati delle transazioni con carta di credito in entrata. Nella mia configurazione, vedo che circa 67,000 record sono stati inseriti nella visualizzazione in streaming nel momento in cui ho eseguito la mia query di conteggio selezionato. Questo numero potrebbe essere diverso per te.

Spostamento verso il rosso ML

Con Redshift ML, puoi portare un modello ML pre-addestrato o crearne uno in modo nativo. Per ulteriori informazioni, fare riferimento a Utilizzo del machine learning in Amazon Redshift.

In questo post, addestriamo e costruiamo un modello ML utilizzando un set di dati storici. I dati contengono un tx_fraud campo che contrassegna una transazione storica come fraudolenta o meno. Costruiamo un modello ML supervisionato utilizzando Redshift Auto ML, che apprende da questo set di dati e prevede le transazioni in entrata quando queste vengono eseguite attraverso le funzioni di previsione.

Nelle sezioni seguenti, viene mostrato come impostare il set di dati storici e i dati dei clienti.

Carica il set di dati storici

La tabella cronologica ha più campi rispetto a quelli dell'origine dati di streaming. Questi campi contengono la spesa più recente del cliente e il punteggio di rischio terminale, come il numero di transazioni fraudolente calcolate trasformando i dati in streaming. Esistono anche variabili categoriche come le transazioni del fine settimana o le transazioni notturne.

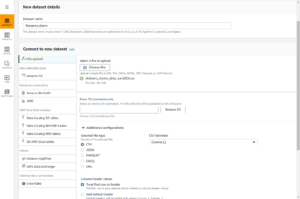

Per caricare i dati storici eseguire i comandi utilizzando il file Editor di query di Amazon Redshift.

Crea la tabella della cronologia delle transazioni con il codice seguente. Il DDL si trova anche su GitHub.

Controlliamo quante transazioni vengono caricate:

Controlla l'andamento mensile delle transazioni fraudolente e non fraudolente:

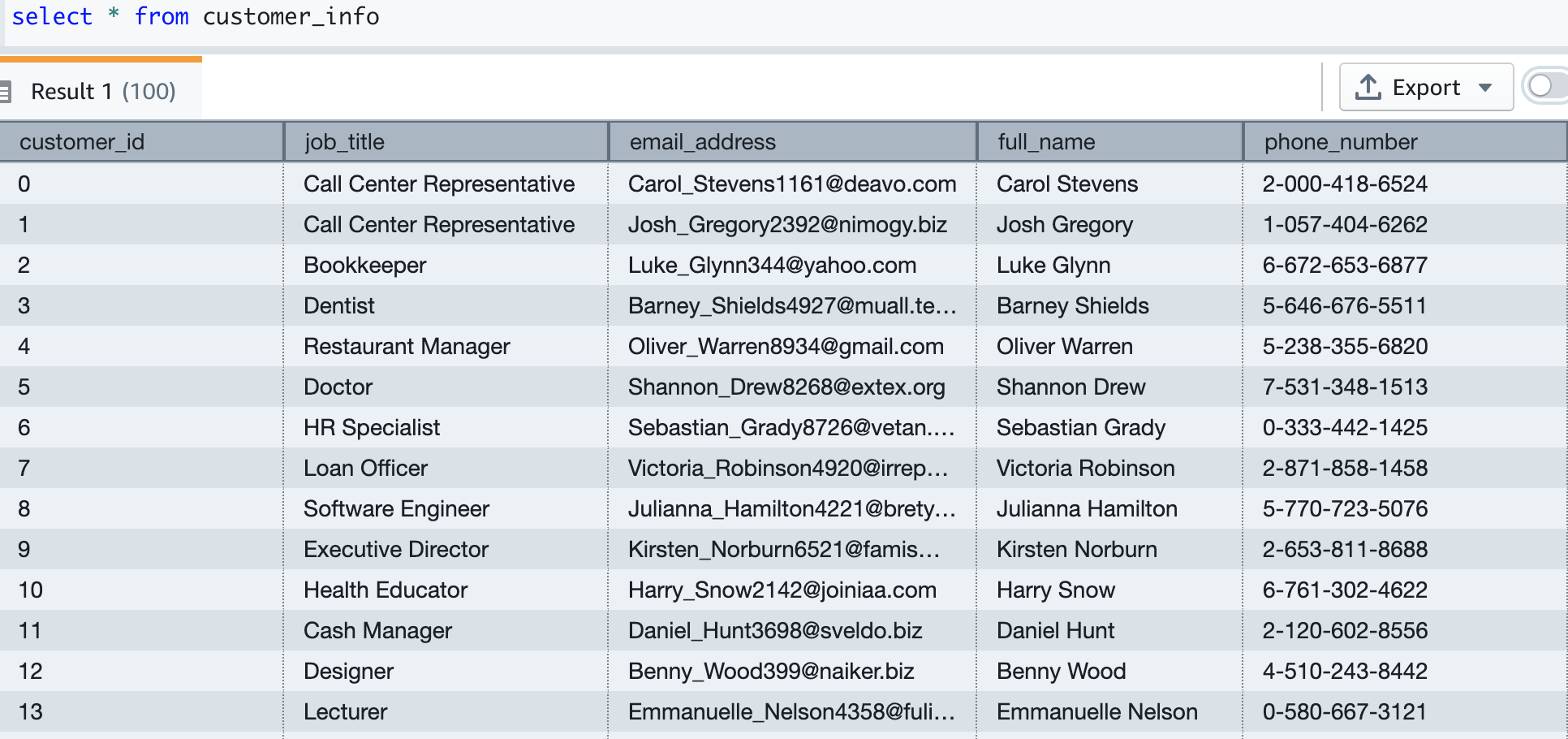

Crea e carica i dati dei clienti

Ora creiamo la tabella del cliente e carichiamo i dati, che contengono l'e-mail e il numero di telefono del cliente. Il codice seguente crea la tabella, carica i dati e campiona la tabella. Il tavolo DDL è disponibile su GitHub.

I nostri dati di test hanno circa 5,000 clienti. Lo screenshot seguente mostra i dati dei clienti di esempio.

Costruisci un modello ML

La nostra tabella storica delle transazioni con carta contiene 6 mesi di dati, che ora utilizziamo per addestrare e testare il modello ML.

Il modello accetta i seguenti campi come input:

Noi abbiamo tx_fraud come output.

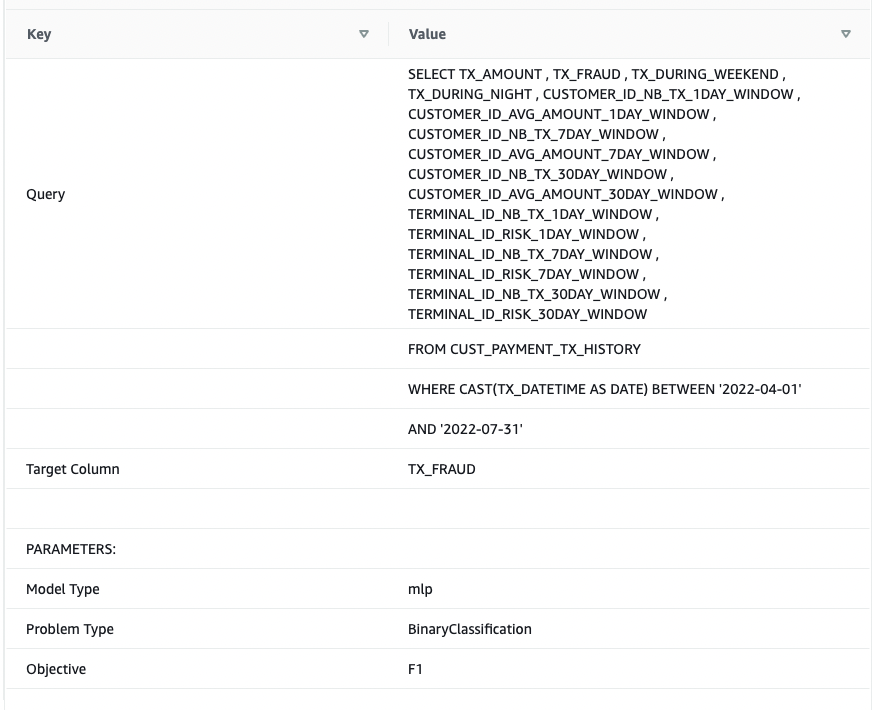

Abbiamo suddiviso questi dati in set di dati di addestramento e test. Le transazioni dal 2022-04-01 al 2022-07-31 sono per il training set. Le transazioni dal 2022-08-01 al 2022-09-30 vengono utilizzate per il set di test.

Creiamo il modello ML usando il familiare SQL Istruzione CREATE MODEL. Usiamo una forma base del comando Redshift ML. Il seguente metodo utilizza Pilota automatico Amazon SageMaker, che esegue automaticamente per te la preparazione dei dati, la progettazione delle funzionalità, la selezione dei modelli e l'addestramento. Fornisci il nome del tuo bucket S3 contenente il codice.

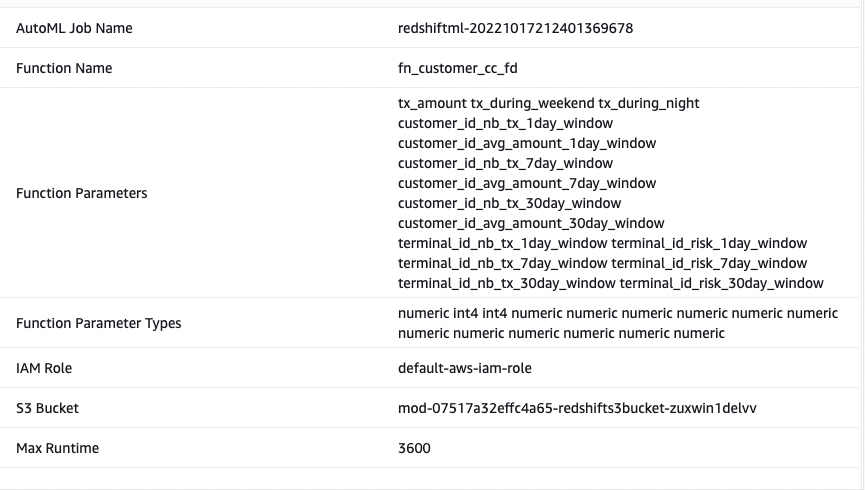

Chiamo il modello ML come Cust_cc_txn_fd, e la funzione di predizione as fn_customer_cc_fd. La clausola FROM mostra le colonne di input dalla tabella cronologica public.cust_payment_tx_history. Il parametro di destinazione è impostato su tx_fraud, che è la variabile target che stiamo cercando di prevedere. IAM_Role è impostato su default perché il cluster è configurato con questo ruolo; in caso contrario, devi fornire l'ARN del ruolo IAM del cluster Amazon Redshift. Ho impostato il max_runtime a 3,600 secondi, che è il tempo che diamo a SageMaker per completare il processo. Redshift ML distribuisce il miglior modello identificato in questo lasso di tempo.

A seconda della complessità del modello e della quantità di dati, la disponibilità del modello può richiedere del tempo. Se ritieni che la selezione del modello non sia completa, aumenta il valore per max_runtime. È possibile impostare un valore massimo di 9999.

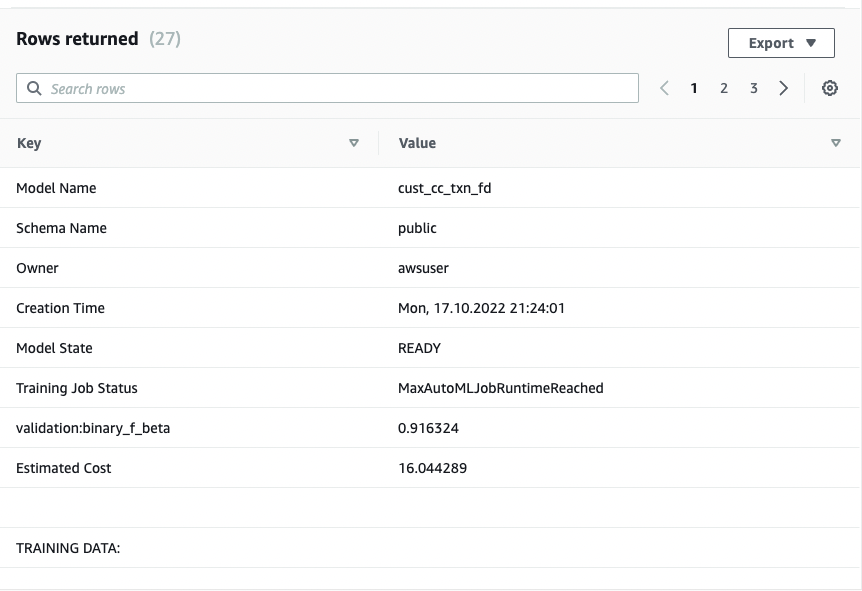

Il comando CREATE MODEL viene eseguito in modo asincrono, il che significa che viene eseguito in background. Puoi usare il MOSTRA MODELLO comando per vedere lo stato del modello. Quando lo stato viene visualizzato come Pronto, significa che il modello è stato addestrato e distribuito.

Gli screenshot seguenti mostrano il nostro output.

Dall'output, vedo che il modello è stato correttamente riconosciuto come BinaryClassification, e F1 è stato selezionato come obiettivo. Il punteggio F1 è una metrica che considera entrambi precisione e richiamo. Restituisce un valore compreso tra 1 (precisione e richiamo perfetti) e 0 (punteggio minimo possibile). Nel mio caso, è 0.91. Maggiore è il valore, migliori sono le prestazioni del modello.

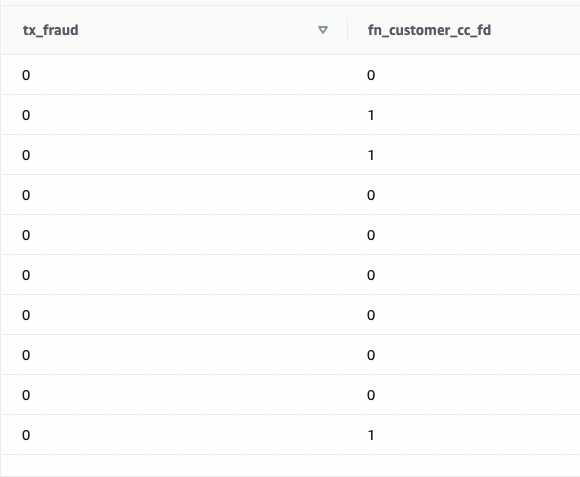

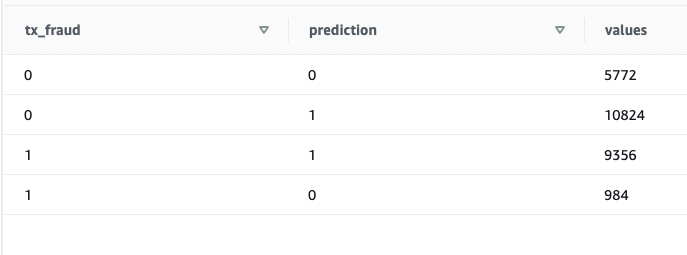

Testiamo questo modello con il set di dati di test. Eseguire il comando seguente, che recupera le previsioni di esempio:

Vediamo che alcuni valori corrispondono e altri no. Confrontiamo le previsioni con la verità fondamentale:

Abbiamo verificato che il modello funziona e che il punteggio F1 è buono. Passiamo alla generazione di previsioni sui dati in streaming.

Prevedi transazioni fraudolente

Poiché il modello Redshift ML è pronto per l'uso, possiamo utilizzarlo per eseguire le previsioni rispetto all'importazione di dati in streaming. Il set di dati storici ha più campi di quelli che abbiamo nell'origine dati in streaming, ma sono solo metriche di recency e frequenza relative al cliente e al rischio terminale per una transazione fraudolenta.

Possiamo applicare le trasformazioni in cima ai dati in streaming molto facilmente incorporando l'SQL all'interno delle viste. Crea il prima vista, che aggrega i dati in streaming a livello di cliente. Quindi crea il file seconda vista, che aggrega i dati in streaming a livello di terminale, e il file terza vista, che combina i dati transazionali in entrata con i dati aggregati del cliente e del terminale e chiama la funzione di previsione in un'unica posizione. Il codice per la terza vista è il seguente:

Esegui un'istruzione SELECT sulla vista:

Mentre esegui ripetutamente l'istruzione SELECT, le ultime transazioni con carta di credito passano attraverso trasformazioni e previsioni ML quasi in tempo reale.

Ciò dimostra la potenza di Amazon Redshift: con comandi SQL di facile utilizzo, puoi trasformare i flussi di dati applicando complesse funzioni di finestra e applicare un modello ML per prevedere transazioni fraudolente tutto in un unico passaggio, senza creare complesse pipeline di dati o creare e gestire infrastrutture aggiuntive.

Espandi la soluzione

Poiché i flussi di dati e le previsioni ML vengono effettuati quasi in tempo reale, puoi creare processi aziendali per avvisare il tuo cliente utilizzando Servizio di notifica semplice Amazon (Amazon SNS) oppure puoi bloccare il conto della carta di credito del cliente in un sistema operativo.

Questo post non entra nei dettagli di queste operazioni, ma se sei interessato a saperne di più sulla creazione di soluzioni basate su eventi utilizzando Amazon Redshift, fai riferimento a quanto segue Repository GitHub.

ripulire

Per evitare di incorrere in addebiti futuri, elimina le risorse create come parte di questo post.

Conclusione

In questo post, abbiamo dimostrato come configurare un flusso di dati Kinesis, configurare un produttore e pubblicare i dati nei flussi, quindi creare una vista di importazione di flussi di Amazon Redshift ed eseguire query sui dati in Amazon Redshift. Dopo che i dati erano nel cluster Amazon Redshift, abbiamo dimostrato come addestrare un modello ML e creare una funzione di previsione e applicarla ai dati in streaming per generare previsioni quasi in tempo reale.

Se hai commenti o domande, lasciali nei commenti.

Informazioni sugli autori

Bhanu Pittampally è un architetto di soluzioni specializzato in analisi con sede a Dallas. È specializzato nella creazione di soluzioni analitiche. Il suo background è nei data warehouse: architettura, sviluppo e amministrazione. Lavora nel campo dei dati e dell'analisi da oltre 15 anni.

Bhanu Pittampally è un architetto di soluzioni specializzato in analisi con sede a Dallas. È specializzato nella creazione di soluzioni analitiche. Il suo background è nei data warehouse: architettura, sviluppo e amministrazione. Lavora nel campo dei dati e dell'analisi da oltre 15 anni.

Praven Kadipikonda è Senior Analytics Specialist Solutions Architect presso AWS con sede a Dallas. Aiuta i clienti a creare soluzioni analitiche efficienti, performanti e scalabili. Ha lavorato con la creazione di database e soluzioni di data warehouse per oltre 15 anni.

Praven Kadipikonda è Senior Analytics Specialist Solutions Architect presso AWS con sede a Dallas. Aiuta i clienti a creare soluzioni analitiche efficienti, performanti e scalabili. Ha lavorato con la creazione di database e soluzioni di data warehouse per oltre 15 anni.

Ritesh Kumar Sinha è un Analytics Specialist Solutions Architect con sede a San Francisco. Da oltre 16 anni aiuta i clienti a creare soluzioni scalabili di data warehousing e big data. Ama progettare e creare soluzioni end-to-end efficienti su AWS. Nel tempo libero ama leggere, camminare e fare yoga.

Ritesh Kumar Sinha è un Analytics Specialist Solutions Architect con sede a San Francisco. Da oltre 16 anni aiuta i clienti a creare soluzioni scalabili di data warehousing e big data. Ama progettare e creare soluzioni end-to-end efficienti su AWS. Nel tempo libero ama leggere, camminare e fare yoga.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- Platoblockchain. Web3 Metaverse Intelligence. Conoscenza amplificata. Accedi qui.

- Fonte: https://aws.amazon.com/blogs/big-data/near-real-time-fraud-detection-using-amazon-redshift-streaming-ingestion-with-amazon-kinesis-data-streams-and-amazon-redshift-ml/

- 000

- 000 clienti

- 1

- 10

- 100

- 11

- 15 anni

- 67

- 7

- 9

- a

- capace

- Chi siamo

- sopra

- accesso

- Il mio account

- Raggiungere

- Action

- aggiuntivo

- amministrazione

- Avanzate

- Dopo shavasana, sedersi in silenzio; saluti;

- contro

- Mettere in guardia

- Tutti

- consente

- Amazon

- Amazon EC2

- Cinesi amazzonica

- quantità

- Gli analisti

- Analitico

- analitica

- analizzare

- ed

- rilevamento anomalie

- Apache

- Applicazioni

- APPLICA

- AMMISSIONE

- architettura

- in giro

- allegare

- auto

- Automatico

- automaticamente

- disponibile

- evitando

- AWS

- sfondo

- basato

- basic

- perché

- diventa

- MIGLIORE

- Meglio

- fra

- Big

- Big Data

- portare

- costruire

- Costruzione

- affari

- i processi di business

- aziende

- chiamata

- detto

- Bandi

- catturare

- carta

- Custodie

- casi

- carattere

- oneri

- dai un'occhiata

- Scegli

- Città

- Cloud

- Cluster

- codice

- colonne

- combina

- arrivo

- Commenti

- confrontare

- completamento di una

- completando

- complesso

- complessità

- Calcolare

- ritiene

- consolle

- consumare

- Consumer

- contiene

- costo effettivo

- potuto

- creare

- creato

- crea

- Creazione

- Credenziali

- credito

- carta di credito

- cliente

- dati dei clienti

- Clienti

- cicli

- alle lezioni

- Dallas

- dati

- Preparazione dei dati

- data warehouse

- data warehouse

- Banca Dati

- banche dati

- dataset

- Data

- Decision Making

- Predefinito

- definizione

- consegnare

- dimostrato

- dipendente

- schierare

- schierato

- Distribuisce

- descritta

- Design

- dettagli

- rivelazione

- sviluppatori

- Mercato

- diverso

- direttamente

- non

- fare

- Dont

- dow

- dinamico

- facilmente

- facile da usare

- effetto

- efficiente

- enable

- Abilita

- da un capo all'altro

- Ingegneria

- entrare

- Etere (ETH)

- Evento

- eventi

- esempio

- eccitato

- esterno

- estrazione

- f1

- familiare

- FAST

- caratteristica

- Caratteristiche

- feedback

- campo

- campi

- filtri

- finanziario

- Trovare

- bandiere

- flusso

- seguire

- i seguenti

- segue

- modulo

- formato

- essere trovato

- TELAIO

- Francisco

- frode

- rilevazione di frodi

- Gratis

- Frequenza

- da

- completamente

- function

- funzioni

- futuro

- generare

- generato

- la generazione di

- generatore

- ottenere

- Dare

- Go

- buono

- concedere

- Terra

- Gruppo

- avendo

- aiutato

- aiuta

- superiore

- Highlight

- storico

- storia

- Come

- Tutorial

- HTML

- HTTPS

- centinaia

- IAM

- identificato

- Identità

- importanza

- in

- includere

- In arrivo

- Aumento

- crescente

- individuale

- informazioni

- Infrastruttura

- ingresso

- Inserti

- intuizioni

- install

- esempio

- Istituto

- istruzioni

- interessato

- IT

- join

- json

- kafka

- Flussi di dati Kinesis

- Lingua

- superiore, se assunto singolarmente.

- Latenza

- con i più recenti

- lanciare

- apprendimento

- Lasciare

- Lunghezza

- Livello

- LIMITE

- limitazione

- caricare

- carichi

- a lungo termine

- Basso

- macchina

- machine learning

- fatto

- make

- FA

- gestito

- gestione

- manualmente

- molti

- carta geografica

- massicciamente

- corrispondenza

- matplotlib

- max

- si intende

- Media

- metodo

- metrico

- Metrica

- Ridurre la perdita dienergia con una

- ML

- Moda

- modello

- modelli

- mensile

- mese

- Scopri di più

- maggior parte

- cambiano

- Nome

- Navigazione

- Bisogno

- esigenze

- New

- GENERAZIONE

- notifica

- numero

- numpy

- obiettivo

- ONE

- apre

- operazione

- operativa

- Operazioni

- Opportunità

- Opzioni

- minimo

- organizzazioni

- Altro

- delineato

- Packages

- panda

- vetro

- parametro

- parte

- perfetta

- eseguire

- performance

- esegue

- permessi

- telefono

- posto

- pianificazione

- piattaforma

- Piattaforme

- Platone

- Platone Data Intelligence

- PlatoneDati

- per favore

- Termini e Condizioni

- politica

- possibile

- Post

- energia

- Precisione

- predire

- predizione

- Previsioni

- predice

- precedente

- prezzi

- processi

- i processi

- produttore

- Programma

- fornire

- fornisce

- la percezione

- pubblicare

- Python

- Domande

- rapidamente

- casuale

- Lettura

- pronto

- di rose

- tempo reale

- dati in tempo reale

- realizzando

- ricevere

- ricevuto

- recente

- riconosciuto

- record

- RIPETUTAMENTE

- sostituire

- necessario

- risorsa

- Risorse

- REST

- Risultati

- problemi

- Rischio

- Ruolo

- Correre

- running

- sagemaker

- San

- San Francisco

- scalabile

- Scala

- screenshot

- sdk

- Seaborn

- Secondo

- secondo

- Sezione

- sezioni

- sicuro

- selezionato

- prodotti

- serverless

- servizio

- set

- regolazione

- impostazioni

- flessibile.

- a breve scadenza

- mostrare attraverso le sue creazioni

- Spettacoli

- Un'espansione

- semplificare

- simulatore

- So

- Social

- Social Media

- soluzione

- Soluzioni

- alcuni

- Fonte

- fonti

- specialista

- specializzata

- spendere

- dividere

- SQL

- Stage

- Standard

- iniziato

- Regione / Stato

- dichiarazione

- dichiarazioni

- Stato dei servizi

- step

- Passi

- conservazione

- Tornare al suo account

- negozi

- Strategico

- ruscello

- Streaming

- servizio di streaming

- flussi

- tale

- Super

- sistema

- SISTEMI DI TRATTAMENTO

- tavolo

- Fai

- prende

- trattativa

- Target

- terminal

- test

- I

- Terza

- migliaia

- Attraverso

- tempo

- timestamp

- a

- top

- argomento

- tradizionalmente

- Treni

- allenato

- Training

- delle transazioni

- transazionale

- Le transazioni

- Trasformare

- trasformazioni

- trasformazione

- Trend

- Aggiornanento

- aggiornato

- Impiego

- uso

- Utente

- convalidato

- APPREZZIAMO

- Valori

- vario

- Verità

- versione

- Visualizza

- visualizzazioni

- a piedi

- walkthrough

- Magazzino

- Magazzinaggio

- Sito web

- fine settimana

- settimanale

- Che

- quale

- while

- wikipedia

- volere

- senza

- lavorato

- lavoro

- lavori

- scrivere

- anni

- Yoga

- Trasferimento da aeroporto a Sharm

- zefiro