Pawel Malinowski, program manager di imec, ha incontrato Semiconductor Engineering per discutere cosa sta cambiando nella tecnologia dei sensori e perché. Quelli che seguono sono estratti di quella discussione.

SE: Qual è il futuro della tecnologia dei sensori?

Malinowski: Stiamo cercando di trovare un nuovo modo di realizzare sensori di immagine perché vogliamo uscire dai limiti di  fotodiodi al silicio. Il silicio è un materiale perfetto, soprattutto se vuoi riprodurre la visione umana perché è sensibile alle lunghezze d'onda visibili della luce, il che significa che puoi fare ciò che fa l'occhio umano. E il campo ora è in una fase molto matura. Ogni anno vengono venduti circa 6 miliardi di sensori di immagine. Questi sono i chip che finiscono nelle fotocamere degli smartphone, delle automobili e di altre applicazioni. Sono tipici sensori di immagine standard, in cui sono presenti i circuiti a base di silicio o l'elettronica e il fotodiodo al silicio. Fondamentalmente realizzano la riproduzione rosso/verde/blu (RGB) in modo da poter avere belle immagini. Ma se guardi altre lunghezze d’onda – ad esempio, vai ai raggi UV o agli infrarossi – hai fenomeni o informazioni che non puoi ottenere nella luce visibile. Stiamo esaminando soprattutto la gamma degli infrarossi. Qui ci occupiamo di un intervallo specifico, compreso tra uno e due micron, che chiamiamo infrarossi a onde corte. Con questa gamma puoi vedere attraverso le cose. Ad esempio, puoi vedere attraverso la nebbia, il fumo o le nuvole. Ciò è particolarmente interessante per le applicazioni automobilistiche.

fotodiodi al silicio. Il silicio è un materiale perfetto, soprattutto se vuoi riprodurre la visione umana perché è sensibile alle lunghezze d'onda visibili della luce, il che significa che puoi fare ciò che fa l'occhio umano. E il campo ora è in una fase molto matura. Ogni anno vengono venduti circa 6 miliardi di sensori di immagine. Questi sono i chip che finiscono nelle fotocamere degli smartphone, delle automobili e di altre applicazioni. Sono tipici sensori di immagine standard, in cui sono presenti i circuiti a base di silicio o l'elettronica e il fotodiodo al silicio. Fondamentalmente realizzano la riproduzione rosso/verde/blu (RGB) in modo da poter avere belle immagini. Ma se guardi altre lunghezze d’onda – ad esempio, vai ai raggi UV o agli infrarossi – hai fenomeni o informazioni che non puoi ottenere nella luce visibile. Stiamo esaminando soprattutto la gamma degli infrarossi. Qui ci occupiamo di un intervallo specifico, compreso tra uno e due micron, che chiamiamo infrarossi a onde corte. Con questa gamma puoi vedere attraverso le cose. Ad esempio, puoi vedere attraverso la nebbia, il fumo o le nuvole. Ciò è particolarmente interessante per le applicazioni automobilistiche.

SE: Ci sono sfide imminenti o nuove applicazioni per questa tecnologia?

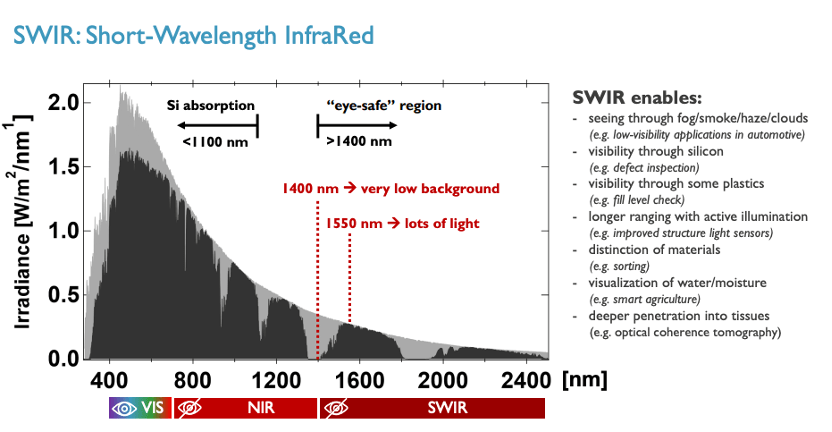

Malinowski: Non è possibile utilizzare il silicio per questa lunghezza d'onda perché diventa trasparente. Ciò è interessante, ad esempio, per l'ispezione dei difetti quando si osservano crepe nelle celle solari in silicio. Hai contrasti diversi di alcuni materiali. I materiali che appaiono esattamente uguali nella gamma visibile possono avere una riflettività diversa nell'infrarosso a onde corte, il che significa che puoi avere un contrasto migliore, ad esempio, quando selezioni la plastica o quando selezioni il cibo. Esistono altre applicazioni, come mostrato nella figura 1 (sotto). È il potere della luce che proviene dal sole attraverso l’atmosfera. Il grigio è al di sopra dell'atmosfera e quello vuoto è ciò che arriva sulla terra. E vedi che ci sono dei massimi e dei minimi. I minimi sono legati all’assorbimento di acqua nell’atmosfera. Puoi utilizzare questi minimi quando lavori, ad esempio, con sistemi di eliminazione attivi, il che significa che emetti un po' di luce e controlli cosa ritorna indietro. Ecco come funziona il Face ID sull'iPhone: emetti luce e controlli cosa ritorna. Operano a circa 940 nanometri. Se andassi a lunghezze d'onda più lunghe, ad esempio 1,400, avrai uno sfondo molto più basso, il che significa che puoi avere un contrasto molto migliore. Se poi vai a lunghezze d'onda dove c'è ancora molta luce, puoi usarla con l'illuminazione passiva per ottenere informazioni extra, come l'imaging in condizioni di scarsa illuminazione, dove sono ancora presenti alcuni fotoni.

Fig. 1: Le possibilità dell'infrarosso a onde corte. Fonte: imec

SE: Come lo hai determinato?

Malinowski: Ciò che abbiamo controllato è come accedere a queste lunghezze d'onda. Il silicio, a causa delle sue proprietà fisiche, non va bene per questo. Il modo tradizionale è il collegamento, in cui si prende un altro materiale, ad esempio l'arseniuro di indio e gallio o il tellururo di mercurio e cadmio, e lo si lega al circuito di lettura. Questa è la tecnologia dominante. È molto utilizzato per applicazioni di difesa, militari e industriali o scientifiche di fascia alta. È costoso. I sensori realizzati con questa tecnologia in genere costano qualche migliaio di euro, a causa del processo di incollaggio e dei costi di produzione. Puoi coltivare il materiale di cui hai bisogno, come il germanio, ma questo è abbastanza difficile e ci sono alcuni problemi nel mantenere il rumore sufficientemente basso. Stiamo seguendo la terza via, ovvero depositare materiale. In questo caso, stiamo utilizzando materiali organici o punti quantici. Prendiamo materiale in grado di assorbire questa luce infrarossa a onde corte o vicino infrarosso, e lo depositiamo con metodi standard, come lo spin-coating, e otteniamo strati molto sottili. Ecco perché chiamiamo questa categoria di sensori “sensori fotorilevatori a film sottile”, in cui il materiale è molto più assorbente del silicio. Sembra una frittella sopra il circuito di lettura.

SE: Come si confronta con altri materiali?

Malinowski: Se lo paragoni ai diodi al silicio, necessitano di un volume molto maggiore e di una profondità molto maggiore. E soprattutto per queste lunghezze d'onda più lunghe, diventano semplicemente trasparenti. Al contrario, i sensori di immagine del fotorilevatore a film sottile (TFPD) hanno una pila di materiali, inclusi materiali fotoattivi come materiali organici a punti quantici, integrati monoliticamente, il che significa che è un chip. Non c'è alcun legame sopra il silicio. Il problema con questo approccio era che quando si ha un fotodiodo integrato sopra questo elettrodo metallico, è molto difficile ottenere un rumore sufficientemente basso perché ci sono alcune fonti di rumore intrinseche di cui non è possibile eliminare.

Fig. 2: Fotorilevatore a film sottile. Fonte: imec

SE: Come hai risolto questo problema?

Malinowski: Abbiamo seguito il progresso dei sensori di immagine al silicio alla fine degli anni '1980 e negli anni '1990, quando hanno introdotto i fotodiodi fissati. Si disaccoppia l'area del fotodiodo in cui vengono convertiti i fotoni e la lettura. Invece di avere un solo contatto di questo assorbitore a film sottile per la lettura, introduciamo un transistor aggiuntivo. Questo è il TFT, che si occupa di avere la struttura completamente svuotata in modo che possiamo trasferire tutte le cariche create in questo assorbitore a film sottile e trasferirle con questa struttura a transistor alla lettura. In questo modo limitiamo notevolmente le fonti di rumore.

SE: Perché il rumore è un problema per la progettazione dei sensori?

Malinowski: Esistono diverse fonti di rumore. Il rumore può essere il numero totale di elettroni indesiderati, ma questi elettroni possono provenire da fonti diverse o per ragioni diverse. Alcuni sono legati alla temperatura, altri alla non uniformità del chip, altri alla perdita dei transistor e così via. Con questo approccio, stiamo lavorando su alcune delle fonti di rumore legate alla lettura. Per tutti i sensori di immagine, c'è rumore, ma hai modi diversi di gestirlo. Ad esempio, i sensori a base di silicio dell’iPhone trattano le sorgenti di rumore con un design specifico del circuito di lettura, con architetture le cui fondamenta risalgono agli anni ’80 e ’90. Questo è un po' quello che abbiamo cercato di replicare con questa nuova categoria di sensori di immagine utilizzando i fotorilevatori a campo sottile. È un’applicazione di vecchi trucchi di progettazione in una nuova categoria di sensori.

SE: Dove prevedi che verrà utilizzato? Hai menzionato il settore automobilistico. Funzionerebbe anche per i dispositivi medici?

Malinowski: L’attrazione maggiore per questa tecnologia proviene dall’elettronica di consumo, come gli smartphone. Se vai a lunghezze d'onda più lunghe, puoi avere un contrasto inferiore, perché semplicemente c'è meno luce a quella lunghezza d'onda, oppure puoi vedere questa luce di quel colore nell'atmosfera. È una visione aumentata, il che significa vedere più di quanto l'occhio umano possa vedere, quindi ci sono informazioni aggiuntive per la tua fotocamera. L'altro motivo è che le lunghezze d'onda più lunghe passano più facilmente attraverso alcuni display. La promessa è che se si dispone di questo tipo di soluzione, è possibile posizionare il sensore, ad esempio Face ID, dietro l'altro display, aumentando così l'area di visualizzazione.

Fig. 3: Visione aumentata per una maggiore sicurezza. Fonte: imec

L’altro motivo è che se utilizzi lunghezze d’onda più lunghe, il tuo occhio è molto meno sensibile – circa cinque o sei ordini di grandezza rispetto alle lunghezze d’onda del vicino infrarosso, il che significa che puoi utilizzare fonti di luce più potenti. Quindi puoi sparare più potenza, il che significa che puoi avere distanze più lunghe. Per il settore automobilistico, puoi avere una visibilità aggiuntiva, soprattutto in condizioni meteorologiche avverse, come la visibilità attraverso la nebbia. Per quanto riguarda la medicina, potrebbe aiutare a promuovere la miniaturizzazione. In alcune applicazioni, come l'endoscopia, la tecnologia dominante utilizza altri materiali e un'integrazione più complessa, e quindi la miniaturizzazione è piuttosto difficile. Con un approccio a punti quantici, puoi creare pixel molto piccoli, il che significa una risoluzione più elevata in un fattore di forma compatto. Ciò consente un'ulteriore miniaturizzazione mantenendo un'elevata risoluzione. Inoltre, a seconda della lunghezza d'onda target, possiamo avere un contrasto dell'acqua molto elevato, il che è uno dei motivi per cui l'industria alimentare potrebbe essere interessata. È possibile rilevare meglio l'umidità, ad esempio, nei prodotti a base di cereali come i cereali.

Fig. 4: Potenziali applicazioni Fonte: imec

SE: Con la maggiore visione in condizioni di scarsa illuminazione, potrebbe avere applicazioni militari?

Malinowski: Questi tipi di sensori vengono già utilizzati dai militari, ad esempio, per rilevare i telemetri laser. La differenza è che ai militari va bene pagare 20,000 euro per una macchina fotografica. Nell’automotive o nel consumer non stanno nemmeno prendendo in considerazione questa tecnologia, proprio per questo motivo.

SE: Quindi la svolta qui è che puoi avere qualcosa che già esiste, ma puoi averlo a prezzi su scala consumer?

Malinowski: Esattamente. A causa della miniaturizzazione e anche del modo in cui l’integrazione monolitica consente di migliorare la tecnologia, è possibile ottenere volumi e prezzi su scala consumer.

SE: Quali altre tendenze vedi nella tecnologia dei sensori?

Malinowski: Uno degli attuali punti di discussione è proprio questo: oltre l’immagine visibile. La tecnologia esistente è già fantastica per scattare foto. La nuova tendenza sono i sensori più dedicati all'applicazione. L’output non deve necessariamente essere una bella immagine. Possono essere informazioni specifiche. Con Face ID, l'output può essere effettivamente uno o zero. O il telefono è sbloccato oppure no. Non è necessario vedere l'immagine del viso. Ci sono anche alcune modalità interessanti in arrivo, come gli imager polarizzati, che sono come occhiali polarizzanti. Vedono meglio per alcune riflessioni. Esistono imager basati sugli eventi, che osservano solo il cambiamento della scena, ad esempio se si studiano le vibrazioni di una macchina o si contano le persone che passano davanti a un negozio. Se disponi di un sistema di guida autonoma, hai bisogno di un avviso che indica la presenza di un ostacolo imminente e che dovresti frenare. Non hai bisogno di una bella foto. Questa tendenza significa molta più frammentazione, perché è molto più specifica per l’applicazione. Cambia il modo in cui le persone progettano i sensori di immagine perché guardano ciò che è abbastanza buono per una particolare applicazione piuttosto che ottimizzare la qualità dell'immagine. La qualità dell'immagine è sempre importante, ma a volte hai bisogno di qualcosa di semplice che faccia semplicemente il suo lavoro.

SE: È importante sapere se si tratta di un essere umano o di un albero, o è sufficiente sapere che devi frenare adesso?

Malinowski: Nell'industria automobilistica è ancora in corso un dibattito. Alcune persone vogliono classificare tutti gli oggetti. Vogliono sapere se è un bambino, un motociclista o un albero. Alcuni dicono: “Ho solo bisogno di sapere se è d’intralcio, perché devo azionare i freni”. Quindi non c’è una risposta.

- Distribuzione di contenuti basati su SEO e PR. Ricevi amplificazione oggi.

- PlatoData.Network Generativo verticale Ai. Potenzia te stesso. Accedi qui.

- PlatoAiStream. Intelligenza Web3. Conoscenza amplificata. Accedi qui.

- PlatoneESG. Carbonio, Tecnologia pulita, Energia, Ambiente, Solare, Gestione dei rifiuti. Accedi qui.

- Platone Salute. Intelligence sulle biotecnologie e sulle sperimentazioni cliniche. Accedi qui.

- Fonte: https://semiengineering.com/a-new-approach-for-sensor-design/

- :È

- :non

- :Dove

- $ SU

- 000

- 1

- 20

- 400

- 420

- a

- WRI

- sopra

- accesso

- attivo

- effettivamente

- aggiunta

- aggiuntivo

- Informazioni aggiuntive

- indirizzo

- avanzare

- avverso

- Tutti

- consente

- già

- anche

- sempre

- an

- ed

- Un altro

- rispondere

- anticipare

- in qualsiasi

- apparire

- Applicazioni

- applicazioni

- approccio

- SONO

- RISERVATA

- in giro

- AS

- At

- Atmosfera

- aumentata

- settore automobilistico

- industria automobilistica

- autonomo

- precedente

- sfondo

- fondamentalmente

- BE

- perché

- diventare

- diventa

- dietro

- essendo

- sotto

- Meglio

- fra

- Al di là di

- Maggiore

- Miliardo

- Po

- vuoto

- legame

- sfondamento

- ma

- by

- chiamata

- stanza

- telecamere

- Materiale

- Può ottenere

- non può

- che

- auto

- Custodie

- Categoria

- Celle

- sfide

- il cambiamento

- Modifiche

- cambiando

- oneri

- dai un'occhiata

- controllato

- bambino

- patata fritta

- Chips

- classificare

- colore

- Venire

- viene

- arrivo

- compatto

- confrontare

- rispetto

- complesso

- condizioni

- considerando

- Consumer

- Elettronica di consumo

- contatti

- contrasto

- contrasti

- convertito

- Costo

- Costi

- potuto

- creato

- Corrente

- affare

- trattare

- dibattito

- dedicato

- Difesa

- Dipendente

- deposito

- profondità

- Design

- individuare

- Determinare

- dispositivi

- DID

- differenza

- diverso

- difficile

- discutere

- discussione

- Dsiplay

- display

- do

- effettua

- non

- Dont

- DOT

- giù

- guida

- dovuto

- terra

- più facile

- o

- Elettronica

- elettroni

- Abilita

- fine

- Ingegneria

- abbastanza

- particolarmente

- euro

- Anche

- di preciso

- esempio

- esiste

- costoso

- extra

- occhio

- Faccia

- fattore

- fantastico

- pochi

- campo

- figura

- Film

- Trovate

- sottile

- cinque

- Nebbia

- seguito

- i seguenti

- segue

- cibo

- Nel

- modulo

- Fondazione

- frammentazione

- da

- completamente

- ulteriormente

- ottenere

- ottenere

- occhiali

- Go

- va

- buono

- grigio

- Crescere

- Avere

- avendo

- Aiuto

- qui

- Alta

- High-End

- superiore

- Come

- Tutorial

- HTTPS

- umano

- i

- ID

- if

- Immagine

- Imaging

- importante

- in

- Compreso

- Aumento

- è aumentato

- in carica

- industriale

- industria

- informazioni

- inerente

- invece

- integrato

- integrazione

- interessato

- interessante

- introdurre

- introdotto

- iPhone

- sicurezza

- IT

- SUO

- Lavoro

- ad appena

- solo uno

- conservazione

- Genere

- Sapere

- superiore, se assunto singolarmente.

- laser

- galline ovaiole

- meno

- leggera

- piace

- LIMITE

- limiti

- piccolo

- più a lungo

- Guarda

- cerca

- SEMBRA

- lotto

- Basso

- inferiore

- macchina

- fatto

- make

- Fare

- direttore

- consigliato per la

- materiale

- Materiale

- alunni

- max-width

- si intende

- medicale

- dispositivi medici

- menzionato

- mercurio

- metallo

- metodi

- micron

- forza

- Militare

- Applicazioni militari

- modalità

- Monolitico

- Scopri di più

- molti

- Vicino

- Bisogno

- New

- GENERAZIONE

- bello

- no

- Rumore

- adesso

- numero

- oggetti

- ostacolo

- of

- Vecchio

- on

- ONE

- esclusivamente

- operare

- ottimizzazione

- or

- ordini

- biologico

- Altro

- su

- produzione

- frittella

- particolare

- passare

- Di passaggio

- passivo

- pagamento

- Persone

- per

- perfetta

- telefono

- foto

- fotone

- Fisico

- immagine

- Immagini

- posto

- plastica

- Platone

- Platone Data Intelligence

- PlatoneDati

- punti

- possibilità

- potenziale

- energia

- potente

- piuttosto

- Prezzi

- prezzi

- Problema

- processi

- Prodotti

- Programma

- progredito

- PROMETTIAMO

- proprietà

- qualità

- Quantistico

- Punto quantico

- Punti quantici

- abbastanza

- gamma

- piuttosto

- ragione

- motivi

- Qualche riflessione

- relazionato

- riproduzione

- Risoluzione

- risolvere

- RGB

- Rid

- Sicurezza

- stesso

- dire

- scena

- scientifico

- vedere

- vedendo

- semiconduttore

- delicata

- sensore

- sensore

- Sparare

- Shop

- dovrebbero

- mostrato

- significativamente

- Silicio

- Un'espansione

- semplicemente

- SIX

- piccole

- smartphone

- Fumo

- So

- solare

- Celle solari

- venduto

- soluzione

- alcuni

- qualcosa

- a volte

- Fonte

- fonti

- specifico

- Spin

- pila

- Stage

- Standard

- Ancora

- La struttura

- Studio

- tale

- Dom.

- sistema

- SISTEMI DI TRATTAMENTO

- Fai

- prende

- presa

- Target

- Tecnologia

- di

- che

- Il

- Li

- poi

- Là.

- Strumenti Bowman per analizzare le seguenti finiture:

- di

- cose

- Terza

- questo

- mille

- Attraverso

- così

- a

- top

- Totale

- tradizionale

- trasferimento

- trasparente

- albero

- Trend

- tendenze

- provato

- innescare

- cerca

- seconda

- tipico

- tipicamente

- non desiderato

- imminenti

- uso

- utilizzato

- utilizzando

- Utilizzando

- molto

- visibilità

- visibile

- visione

- volume

- volumi

- volere

- identificazione dei warning

- Prima

- Water

- lunghezze d'onda

- Modo..

- modi

- we

- Tempo

- è andato

- Che

- Che cosa è l'

- quando

- se

- quale

- while

- di chi

- perché

- volere

- con

- Lavora

- lavoro

- sarebbe

- anno

- Tu

- Trasferimento da aeroporto a Sharm

- zefiro

- zero