Kami percaya AI generatif memiliki potensi dari waktu ke waktu untuk mengubah hampir setiap pengalaman pelanggan yang kami ketahui. Jumlah perusahaan yang meluncurkan aplikasi AI generatif di AWS sangat besar dan berkembang dengan cepat, termasuk adidas, Booking.com, Bridgewater Associates, Clariant, Cox Automotive, GoDaddy, dan LexisNexis Legal & Professional, dan masih banyak lagi. Startup inovatif seperti Perplexity AI memanfaatkan AWS untuk AI generatif. Perusahaan AI terkemuka seperti Anthropic telah memilih AWS sebagai penyedia cloud utama mereka untuk beban kerja yang sangat penting, dan tempat untuk melatih model masa depan mereka. Dan penyedia layanan dan solusi global seperti Accenture memperoleh manfaat dari aplikasi AI generatif yang disesuaikan dengan memberdayakan pengembang internal mereka dengan Pembisik Kode Amazon.

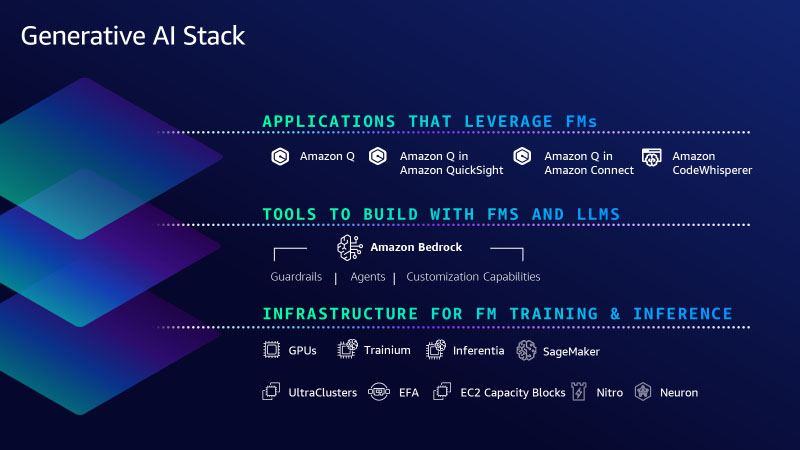

Para pelanggan ini memilih AWS karena kami fokus melakukan apa yang selalu kami lakukan—menggunakan teknologi kompleks dan mahal yang dapat mengubah pengalaman pelanggan dan bisnis serta mendemokratisasikannya untuk pelanggan dari semua ukuran dan kemampuan teknis. Untuk melakukan hal ini, kami berinvestasi dan berinovasi dengan cepat untuk memberikan serangkaian kemampuan terlengkap di tiga lapisan tumpukan AI generatif. Lapisan terbawah adalah infrastruktur untuk melatih Model Bahasa Besar (LLM) dan Model Dasar (FM) lainnya serta menghasilkan kesimpulan atau prediksi. Lapisan tengah adalah akses mudah ke semua model dan alat yang dibutuhkan pelanggan untuk membangun dan menskalakan aplikasi AI generatif dengan keamanan, kontrol akses, dan fitur lain yang sama yang diharapkan pelanggan dari layanan AWS. Dan pada lapisan teratas, kami telah berinvestasi dalam aplikasi-aplikasi yang mengubah permainan di bidang-bidang utama seperti pengkodean berbasis AI generatif. Selain menawarkan kepada mereka pilihan dan—seperti yang mereka harapkan dari kami—keluasan dan kedalaman kemampuan di semua lapisan, pelanggan juga memberi tahu kami bahwa mereka menghargai pendekatan kami yang mengutamakan data, dan percaya bahwa kami telah membangun segalanya dari awal dengan dukungan perusahaan. keamanan tingkat dan privasi.

Minggu ini kami mengambil langkah maju yang besar, dengan mengumumkan banyak kemampuan baru yang signifikan di ketiga lapisan tumpukan untuk memudahkan dan praktis bagi pelanggan kami dalam menggunakan AI generatif secara luas dalam bisnis mereka.

Lapisan paling bawah dari tumpukan: AWS Trainium2 adalah tambahan terbaru yang menghadirkan infrastruktur cloud tercanggih untuk AI generatif

Lapisan paling bawah dari tumpukan adalah infrastruktur—komputasi, jaringan, kerangka kerja, layanan—yang diperlukan untuk melatih dan menjalankan LLM dan FM lainnya. AWS berinovasi untuk menawarkan infrastruktur tercanggih untuk ML. Melalui kolaborasi jangka panjang kami dengan NVIDIA, AWS adalah yang pertama menghadirkan GPU ke cloud lebih dari 12 tahun yang lalu, dan baru-baru ini kami menjadi penyedia cloud besar pertama yang menyediakan GPU NVIDIA H100 dengan instans P5 kami. Kami terus berinvestasi dalam inovasi unik yang menjadikan AWS cloud terbaik untuk menjalankan GPU, termasuk manfaat harga-kinerja dari sistem virtualisasi paling canggih (AWS Nitro), jaringan skala petabit yang kuat dengan Elastic Fabric Adapter (EFA), dan hyper- pengelompokan skala dengan Amazon EC2 UltraClusters (ribuan instans yang dipercepat ditempatkan bersama di Availability Zone dan saling terhubung dalam jaringan non-pemblokiran yang dapat memberikan hingga 3,200 Gbps untuk pelatihan ML skala besar). Kami juga mempermudah pelanggan mana pun untuk mengakses kapasitas komputasi GPU yang sangat dicari untuk AI generatif dengan Blok Kapasitas Amazon EC2 untuk ML—model konsumsi pertama dan satu-satunya di industri yang memungkinkan pelanggan memesan GPU untuk penggunaan di masa mendatang (hingga 500 diterapkan di UltraClusters EC2) untuk beban kerja ML berdurasi singkat.

Beberapa tahun yang lalu, kami menyadari bahwa untuk terus meningkatkan kinerja harga, kami perlu berinovasi hingga ke silikon, dan kami mulai berinvestasi pada chip kami sendiri. Khusus untuk ML, kami memulai dengan AWS Inferentia, chip inferensi yang dibuat khusus untuk kami. Saat ini, kami menggunakan AWS Inferentia generasi kedua dengan instans Inf2 Amazon EC2 yang dioptimalkan secara khusus untuk aplikasi AI generatif skala besar dengan model yang berisi ratusan miliar parameter. Instans Inf2 menawarkan biaya terendah untuk inferensi di cloud sekaligus memberikan throughput hingga empat kali lebih tinggi dan latensi hingga sepuluh kali lebih rendah dibandingkan dengan instans Inf1. Didukung hingga 12 chip Inferentia2, Inf2 adalah satu-satunya instans EC2 yang dioptimalkan untuk inferensi yang memiliki konektivitas berkecepatan tinggi antar akselerator sehingga pelanggan dapat menjalankan inferensi lebih cepat dan lebih efisien (dengan biaya lebih rendah) tanpa mengorbankan kinerja atau latensi dengan mendistribusikan model ultra-besar di beberapa akselerator. Pelanggan seperti Adobe, Deutsche Telekom, dan Leonardo.ai telah melihat hasil awal yang luar biasa dan bersemangat untuk menerapkan model mereka dalam skala besar di Inf2.

Di sisi pelatihan, instans Trn1—didukung oleh chip pelatihan ML yang dibuat khusus dari AWS, AWS Trainium—dioptimalkan untuk mendistribusikan pelatihan di beberapa server yang terhubung dengan jaringan EFA. Pelanggan seperti Ricoh telah melatih LLM Jepang dengan miliaran parameter hanya dalam beberapa hari. Databricks mendapatkan kinerja harga hingga 40% lebih baik dengan instans berbasis Trainium untuk melatih model pembelajaran mendalam berskala besar. Namun dengan hadirnya model-model baru yang lebih mumpuni hampir setiap minggunya, kami terus mendorong batas-batas dalam performa dan skala, dan kami dengan senang hati mengumumkannya Pelatihan AWS2, dirancang untuk memberikan performa harga yang lebih baik lagi untuk model pelatihan dengan ratusan miliar hingga triliunan parameter. Trainium2 akan memberikan kinerja pelatihan hingga empat kali lebih cepat dibandingkan Trainium generasi pertama, dan ketika digunakan dalam EC2 UltraClusters akan menghasilkan hingga 65 exaflops komputasi agregat. Ini berarti pelanggan akan dapat melatih 300 miliar parameter LLM dalam hitungan minggu versus bulan. Performa, skala, dan efisiensi energi Trainium2 adalah beberapa alasan mengapa Anthropic memilih untuk melatih modelnya di AWS, dan akan menggunakan Trainium2 untuk model masa depannya. Dan kami berkolaborasi dengan Anthropic untuk melanjutkan inovasi dengan Trainium dan Inferentia. Kami berharap instans Trainium2 pertama kami akan tersedia bagi pelanggan pada tahun 2024.

Kami juga telah menggandakan rantai alat perangkat lunak untuk silikon ML kami, khususnya dalam memajukan AWS Neuron, perangkat pengembangan perangkat lunak (SDK) yang membantu pelanggan mendapatkan kinerja maksimum dari Trainium dan Inferentia. Sejak memperkenalkan Neuron pada tahun 2019, kami telah melakukan investasi besar dalam teknologi compiler dan kerangka kerja, dan saat ini Neuron mendukung banyak model paling populer yang tersedia untuk umum, termasuk Llama 2 dari Meta, MPT dari Databricks, dan Difusi Stabil dari Stability AI, serta 93 dari 100 model teratas di repositori model populer Hugging Face. Neuron dihubungkan ke framework ML populer seperti PyTorch dan TensorFlow, dan dukungan untuk JAX akan hadir awal tahun depan. Pelanggan memberi tahu kami bahwa Neuron telah memudahkan mereka untuk mengalihkan pelatihan model dan jalur inferensi yang ada ke Trainium dan Inferentia hanya dengan beberapa baris kode.

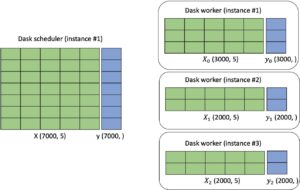

Tidak ada orang lain yang menawarkan kombinasi pilihan chip ML terbaik, jaringan super cepat, virtualisasi, dan cluster berskala hiper yang sama. Oleh karena itu, tidak mengherankan jika beberapa startup AI generatif paling terkenal seperti AI21 Labs, Anthropic, Hugging Face, Perplexity AI, Runway, dan Stability AI dijalankan di AWS. Namun, Anda masih memerlukan alat yang tepat untuk memanfaatkan komputasi ini secara efektif untuk membangun, melatih, dan menjalankan LLM dan FM lainnya secara efisien dan hemat biaya. Dan bagi banyak dari startup ini, Amazon SageMaker adalah jawabannya. Baik membangun dan melatih model baru yang dimiliki dari awal atau memulai dengan salah satu dari banyak model populer yang tersedia untuk umum, pelatihan adalah pekerjaan yang rumit dan mahal. Menjalankan model ini dengan biaya yang efektif juga tidak mudah. Pelanggan harus memperoleh data dalam jumlah besar dan menyiapkannya. Ini biasanya melibatkan banyak pekerjaan manual membersihkan data, menghapus duplikat, memperkaya dan mengubahnya. Kemudian mereka harus membuat dan memelihara cluster GPU/akselerator yang besar, menulis kode untuk mendistribusikan pelatihan model secara efisien ke seluruh cluster, sering melakukan pemeriksaan, menjeda, memeriksa dan mengoptimalkan model, serta secara manual melakukan intervensi dan memperbaiki masalah perangkat keras di cluster. Banyak dari tantangan ini bukanlah hal baru, itulah beberapa alasan mengapa kami meluncurkan SageMaker enam tahun lalu—untuk mendobrak banyak hambatan yang terkait dengan pelatihan dan penerapan model serta memberi pengembang cara yang lebih mudah. Puluhan ribu pelanggan menggunakan Amazon SageMaker, dan semakin banyak dari mereka seperti LG AI Research, Perplexity AI, AI21, Hugging Face, dan Stability AI yang melatih LLM dan FM lainnya tentang SageMaker. Baru-baru ini, Technology Innovation Institute (pencipta Falcon LLM yang populer) melatih model terbesar yang tersedia untuk umum—Falcon 180B—di SageMaker. Seiring dengan berkembangnya ukuran dan kompleksitas model, cakupan SageMaker juga meningkat.

Selama bertahun-tahun, kami telah menambahkan lebih dari 380 fitur dan kemampuan yang mengubah permainan ke Amazon SageMaker seperti penyetelan model otomatis, pelatihan terdistribusi, opsi penerapan model yang fleksibel, alat untuk OP ML, alat untuk persiapan data, penyimpanan fitur, notebook, integrasi yang lancar dengan evaluasi human-in-the-loop di seluruh siklus hidup ML, dan fitur bawaan untuk AI yang bertanggung jawab. Kami terus berinovasi dengan cepat untuk memastikan pelanggan SageMaker dapat terus membangun, melatih, dan menjalankan inferensi untuk semua model—termasuk LLM dan FM lainnya. Dan kami menjadikannya lebih mudah dan hemat biaya bagi pelanggan untuk melatih dan menerapkan model besar dengan dua kemampuan baru. Pertama, untuk menyederhanakan pelatihan kita memperkenalkan HyperPod Amazon SageMaker yang mengotomatiskan lebih banyak proses yang diperlukan untuk pelatihan terdistribusi yang toleran terhadap kesalahan berskala tinggi (misalnya, mengonfigurasi perpustakaan pelatihan terdistribusi, menskalakan beban kerja pelatihan di ribuan akselerator, mendeteksi dan memperbaiki instance yang salah), mempercepat pelatihan sebanyak 40%. Hasilnya, pelanggan seperti Perplexity AI, Hugging Face, Stability, Hippocratic, Alkaid, dan lainnya menggunakan SageMaker HyperPod untuk membuat, melatih, atau mengembangkan model. Kedua, kami memperkenalkan kemampuan baru untuk membuat inferensi lebih hemat biaya sekaligus mengurangi latensi. SageMaker kini membantu pelanggan menerapkan beberapa model ke instans yang sama sehingga mereka dapat berbagi sumber daya komputasi—mengurangi biaya inferensi sebesar 50% (rata-rata). SageMaker juga secara aktif memantau instans yang memproses permintaan inferensi dan secara cerdas merutekan permintaan berdasarkan instans mana yang tersedia—mencapai latensi inferensi (rata-rata) 20% lebih rendah. Conjecture, Salesforce, dan Slack sudah menggunakan SageMaker untuk model hosting karena pengoptimalan inferensi ini.

Lapisan tengah tumpukan: Amazon Bedrock menambahkan model baru dan gelombang kemampuan baru yang semakin memudahkan pelanggan membangun dan menskalakan aplikasi AI generatif dengan aman

Meskipun sejumlah pelanggan akan membangun LLM dan FM lainnya sendiri, atau mengembangkan sejumlah opsi yang tersedia secara publik, banyak yang tidak ingin menghabiskan sumber daya dan waktu untuk melakukan hal ini. Bagi mereka, lapisan tengah tumpukan menawarkan model ini sebagai layanan. Solusi kami di sini, Batuan Dasar Amazon, memungkinkan pelanggan memilih model-model terdepan di industri mulai dari Anthropic, Stability AI, Meta, Cohere, AI21, dan Amazon, menyesuaikannya dengan data mereka sendiri, dan memanfaatkan semua keamanan terkemuka, kontrol akses, dan fitur yang sama seperti yang biasa mereka gunakan. di AWS—semuanya melalui layanan terkelola. Kami menyediakan Amazon Bedrock secara umum pada akhir September, dan tanggapan pelanggan sangat positif. Pelanggan dari seluruh dunia dan hampir semua industri bersemangat menggunakan Amazon Bedrock. adidas memungkinkan pengembang mendapatkan jawaban cepat tentang segala hal mulai dari info “permulaan” hingga pertanyaan teknis yang lebih mendalam. Booking.com bermaksud menggunakan AI generatif untuk menulis rekomendasi perjalanan yang disesuaikan untuk setiap pelanggan. Bridgewater Associates sedang mengembangkan Asisten Analis Investasi yang didukung LLM untuk membantu menghasilkan grafik, menghitung indikator keuangan, dan merangkum hasil. Carrier membuat analisis dan wawasan energi yang lebih tepat dapat diakses oleh pelanggan sehingga mereka mengurangi konsumsi energi dan mengurangi emisi karbon. Clariant memberdayakan anggota timnya dengan chatbot AI generatif internal untuk mempercepat proses penelitian dan pengembangan, mendukung tim penjualan dalam persiapan rapat, dan mengotomatiskan email pelanggan. GoDaddy membantu pelanggan menyiapkan bisnis online mereka dengan mudah menggunakan AI generatif untuk membangun situs web, menemukan pemasok, terhubung dengan pelanggan, dan banyak lagi. Lexis Nexis Legal & Professional mentransformasi pekerjaan hukum untuk pengacara dan meningkatkan produktivitas mereka dengan pencarian percakapan Lexis+ AI, ringkasan, serta kemampuan penyusunan dan analisis dokumen. Nasdaq membantu mengotomatisasi alur kerja investigasi pada transaksi mencurigakan dan memperkuat kemampuan anti-kejahatan keuangan dan pengawasannya. Semua ini—dan masih banyak lagi—beragam aplikasi AI generatif berjalan di AWS.

Kami gembira dengan momentum Amazon Bedrock, namun ini masih tahap awal. Apa yang kami lihat selama bekerja dengan pelanggan adalah bahwa semua orang bergerak cepat, namun evolusi AI generatif terus berlanjut dengan pesat dengan opsi dan inovasi baru yang terjadi hampir setiap hari. Pelanggan menemukan bahwa terdapat beberapa model berbeda yang berfungsi lebih baik untuk kasus penggunaan berbeda, atau pada kumpulan data berbeda. Beberapa model bagus untuk meringkas, model lainnya bagus untuk penalaran dan integrasi, dan model lainnya memiliki dukungan bahasa yang sangat bagus. Lalu ada pembuatan gambar, kasus penggunaan penelusuran, dan banyak lagi—semuanya berasal dari model kepemilikan dan model yang tersedia untuk umum bagi siapa saja. Dan pada saat ada begitu banyak hal yang tidak diketahui, kemampuan untuk beradaptasi bisa dibilang merupakan alat yang paling berharga. Tidak akan ada satu model yang bisa mengatur semuanya. Dan tentunya tidak hanya satu perusahaan teknologi yang menyediakan model yang dapat digunakan semua orang. Pelanggan perlu mencoba model yang berbeda. Mereka harus dapat beralih di antara keduanya atau menggabungkannya dalam kasus penggunaan yang sama. Ini berarti mereka memerlukan pilihan penyedia model yang nyata (yang semakin jelas terlihat dari kejadian 10 hari terakhir). Inilah sebabnya kami menciptakan Amazon Bedrock, mengapa Amazon Bedrock sangat disukai pelanggan, dan mengapa kami terus berinovasi dan melakukan iterasi dengan cepat untuk membuat pembangunan dengan (dan berpindah antar) berbagai model semudah panggilan API, dengan menggunakan teknik terbaru untuk penyesuaian model di tangan semua pengembang, dan menjaga keamanan pelanggan dan privasi data mereka. Kami sangat bersemangat untuk memperkenalkan beberapa kemampuan baru yang akan semakin memudahkan pelanggan dalam membangun dan menskalakan aplikasi AI generatif:

- Memperluas pilihan model dengan Anthropic Claude 2.1, Meta Llama 2 70B, dan tambahan pada keluarga Amazon Titan. Pada masa-masa awal ini, pelanggan masih belajar dan bereksperimen dengan berbagai model untuk menentukan model mana yang ingin mereka gunakan untuk berbagai tujuan. Mereka ingin dapat dengan mudah mencoba model terbaru, dan juga menguji untuk melihat kemampuan dan fitur mana yang akan memberikan hasil dan karakteristik biaya terbaik untuk kasus penggunaan mereka. Dengan Amazon Bedrock, pelanggan hanya perlu satu panggilan API untuk mendapatkan model baru. Beberapa hasil paling mengesankan yang dialami pelanggan beberapa bulan terakhir ini berasal dari LLM seperti Model Claude Antropik, yang unggul dalam berbagai tugas mulai dari dialog canggih dan pembuatan konten hingga penalaran kompleks dengan tetap menjaga tingkat keandalan dan prediktabilitas yang tinggi. Pelanggan melaporkan bahwa Claude jauh lebih kecil kemungkinannya untuk menghasilkan keluaran yang berbahaya, lebih mudah diajak berkomunikasi, dan lebih mudah dikendalikan dibandingkan dengan FM lainnya, sehingga pengembang bisa mendapatkan keluaran yang diinginkan dengan lebih sedikit usaha. Model canggih Anthropic, Claude 2, mendapat nilai di atas persentil ke-90 pada ujian membaca dan menulis GRE, dan juga pada penalaran kuantitatif. Dan sekarang, model Claude 2.1 yang baru dirilis tersedia di Amazon Bedrock. Claude 2.1 memberikan kemampuan utama bagi perusahaan seperti jendela konteks token 200 ribu yang terdepan di industri (2x konteks Claude 2.0), mengurangi tingkat halusinasi, dan peningkatan akurasi yang signifikan, bahkan pada konteks yang sangat panjang. Claude 2.1 juga menyertakan perintah sistem yang ditingkatkan – yang merupakan instruksi model yang memberikan pengalaman lebih baik bagi pengguna akhir – sekaligus mengurangi biaya perintah dan penyelesaian sebesar 25%.

Untuk semakin banyak pelanggan yang ingin menggunakan versi terkelola model Llama 2 Meta yang tersedia untuk umum, Amazon Bedrock menawarkan Llama 2 13B, dan kami menambahkan Llama 2 70B. Llama 2 70B cocok untuk tugas berskala besar seperti pemodelan bahasa, pembuatan teks, dan sistem dialog. Model Llama yang tersedia untuk umum telah diunduh lebih dari 30 juta kali, dan pelanggan menyukai Amazon Bedrock yang menawarkannya sebagai bagian dari layanan terkelola sehingga mereka tidak perlu mengkhawatirkan infrastruktur atau memiliki keahlian ML yang mendalam di tim mereka. Selain itu, untuk pembuatan gambar, Stability AI menawarkan serangkaian model teks-ke-gambar yang populer. Stable Diffusion XL 1.0 (SDXL 1.0) adalah yang paling canggih, dan sekarang tersedia secara umum di Amazon Bedrock. Edisi terbaru dari model gambar populer ini memiliki peningkatan akurasi, fotorealisme yang lebih baik, dan resolusi yang lebih tinggi.

Pelanggan juga menggunakan Titan Amazon model, yang dibuat dan dilatih sebelumnya oleh AWS untuk menawarkan kemampuan canggih dengan penghematan besar untuk berbagai kasus penggunaan. Amazon memiliki rekam jejak selama 25 tahun dalam ML dan AI—teknologi yang kami gunakan di seluruh bisnis kami—dan kami telah belajar banyak tentang pembuatan dan penerapan model. Kami telah memilih dengan cermat cara kami melatih model dan data yang kami gunakan untuk melakukannya. Kami mengganti kerugian pelanggan terhadap klaim bahwa model kami atau keluarannya melanggar hak cipta siapa pun. Kami memperkenalkan model Titan pertama kami pada bulan April tahun ini. Teks Titan Lite—Sekarang tersedia secara umum—adalah model yang ringkas dan hemat biaya untuk kasus penggunaan seperti chatbot, peringkasan teks, atau copywriting, dan juga menarik untuk disesuaikan. Titan Text Express—kini juga tersedia secara umum—Lebih luas, dan dapat digunakan untuk tugas berbasis teks yang lebih luas, seperti pembuatan teks terbuka dan obrolan percakapan. Kami menawarkan opsi model teks ini untuk memberi pelanggan kemampuan mengoptimalkan akurasi, kinerja, dan biaya bergantung pada kasus penggunaan dan kebutuhan bisnis mereka. Pelanggan seperti Nexxiot, PGA Tour, dan Ryanair menggunakan dua model Titan Text kami. Kami juga memiliki model penyematan, Titan Text Embeddings, untuk kasus penggunaan penelusuran dan personalisasi. Pelanggan seperti Nasdaq melihat hasil luar biasa menggunakan Titan Text Embeddings untuk meningkatkan kemampuan Nasdaq IR Insight guna menghasilkan wawasan dari 9,000+ dokumen perusahaan global untuk tim keberlanjutan, hukum, dan akuntansi. Dan kami akan terus menambahkan lebih banyak model ke keluarga Titan seiring berjalannya waktu. Kami memperkenalkan model penyematan baru, Titan Multimodal Embeddings, untuk mendukung pengalaman penelusuran dan rekomendasi multimodal bagi pengguna yang menggunakan gambar dan teks (atau kombinasi keduanya) sebagai masukan. Dan kami adalah memperkenalkan model teks-ke-gambar baru, Amazon Titan Image Generator. Dengan Titan Image Generator, pelanggan di berbagai industri seperti periklanan, e-commerce, serta media dan hiburan dapat menggunakan input teks untuk menghasilkan gambar berkualitas studio yang realistis dalam volume besar dan dengan biaya rendah. Kami sangat antusias dengan tanggapan pelanggan terhadap Model Titan, dan Anda dapat berharap bahwa kami akan terus berinovasi di sini.

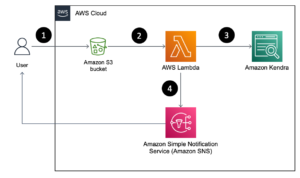

- Kemampuan baru untuk menyesuaikan aplikasi AI generatif Anda secara aman dengan data milik Anda: Salah satu kemampuan terpenting Amazon Bedrock adalah betapa mudahnya menyesuaikan model. Hal ini menjadi sangat menarik bagi pelanggan karena di sinilah AI generatif bertemu dengan pembeda inti mereka—data mereka. Namun, yang terpenting adalah data mereka tetap aman, mereka dapat mengontrol data tersebut selama prosesnya, dan penyempurnaan model bersifat pribadi bagi mereka. Ada beberapa cara untuk melakukan ini, dan Amazon Bedrock menawarkan pilihan opsi penyesuaian terluas di berbagai model). Yang pertama adalah penyempurnaan. Menyempurnakan model di Amazon Bedrock itu mudah. Anda cukup memilih modelnya dan Amazon Bedrock membuat salinannya. Kemudian Anda menunjuk ke beberapa contoh berlabel (misalnya, serangkaian pasangan pertanyaan-jawaban yang bagus) yang Anda simpan di Amazon Simple Storage Service (Amazon S3), dan Amazon Bedrock “melatih secara bertahap” (menambah model yang disalin dengan informasi baru) berdasarkan contoh-contoh ini, dan hasilnya adalah model yang lebih pribadi dan lebih akurat sehingga memberikan respons yang lebih relevan dan disesuaikan. Kami dengan senang hati mengumumkan bahwa penyesuaian secara umum tersedia untuk Cohere Command, Meta Llama 2, Amazon Titan Text (Lite dan Express), Amazon Titan Multimodal Embeddings, dan dalam pratinjau untuk Amazon Titan Image Generator. Dan, melalui kolaborasi kami dengan Anthropic, kami akan segera memberikan pelanggan AWS akses awal ke fitur unik untuk penyesuaian model dan penyempurnaan model Claude yang canggih.

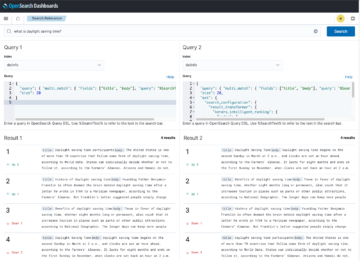

Teknik kedua untuk menyesuaikan LLM dan FM lainnya untuk bisnis Anda adalah pengambilan augmented generation (RAG), yang memungkinkan Anda menyesuaikan respons model dengan menambah permintaan Anda dengan data dari berbagai sumber, termasuk repositori dokumen, database, dan API. Pada bulan September, kami memperkenalkan kemampuan RAG, Basis Pengetahuan untuk Amazon Bedrock, yang secara aman menghubungkan model ke sumber data milik Anda untuk melengkapi perintah Anda dengan lebih banyak informasi sehingga aplikasi Anda memberikan respons yang lebih relevan, kontekstual, dan akurat. Basis Pengetahuan sekarang tersedia secara umum dengan API yang menjalankan seluruh alur kerja RAG mulai dari mengambil teks yang diperlukan untuk menambah prompt, mengirimkan prompt ke model, hingga mengembalikan respons. Basis Pengetahuan mendukung basis data dengan kemampuan vektor yang menyimpan representasi numerik dari data Anda (penyematan) yang digunakan model untuk mengakses data ini untuk RAG, termasuk Amazon OpenSearch Service, dan basis data populer lainnya seperti Pinecone dan Redis Enterprise Cloud (dukungan vektor Amazon Aurora dan MongoDB akan hadir segera).

Cara ketiga untuk menyesuaikan model di Amazon Bedrock adalah dengan pra-pelatihan lanjutan. Dengan metode ini, model dibangun berdasarkan pra-pelatihan aslinya untuk pemahaman bahasa umum guna mempelajari bahasa dan terminologi khusus domain. Pendekatan ini ditujukan untuk pelanggan yang memiliki banyak informasi khusus domain yang tidak berlabel dan ingin memungkinkan LLM mereka memahami bahasa, frasa, singkatan, konsep, definisi, dan jargon yang unik untuk dunia (dan bisnis) mereka. Tidak seperti dalam fine-tuning, yang membutuhkan sejumlah kecil data, pra-pelatihan lanjutan dilakukan pada kumpulan data yang besar (misalnya, ribuan dokumen teks). Kini, kemampuan pra-pelatihan tersedia di Amazon Bedrock untuk Titan Text Lite dan Titan Text Express.

- Ketersediaan umum Agen untuk Amazon Bedrock untuk membantu melaksanakan tugas multilangkah menggunakan sistem, sumber data, dan pengetahuan perusahaan. LLM hebat dalam melakukan percakapan dan menghasilkan konten, namun pelanggan ingin aplikasi mereka mampu melakukannya do bahkan lebih banyak lagi—seperti mengambil tindakan, menyelesaikan masalah, dan berinteraksi dengan berbagai sistem untuk menyelesaikan tugas multi-langkah seperti memesan perjalanan, mengajukan klaim asuransi, atau memesan suku cadang pengganti. Dan Amazon Bedrock dapat membantu mengatasi tantangan ini. Dengan agen, pengembang memilih model, menulis beberapa instruksi dasar seperti “Anda adalah agen layanan pelanggan yang ceria” dan “memeriksa ketersediaan produk dalam sistem inventaris”, mengarahkan model yang dipilih ke sumber data dan sistem perusahaan yang tepat (misalnya, CRM atau aplikasi ERP), dan tulis beberapa fungsi AWS Lambda untuk menjalankan API (misalnya, memeriksa ketersediaan item dalam inventaris ERP). Amazon Bedrock secara otomatis menganalisis permintaan dan memecahnya menjadi urutan logis menggunakan kemampuan penalaran model yang dipilih untuk menentukan informasi apa yang diperlukan, API apa yang harus dipanggil, dan kapan harus memanggilnya untuk menyelesaikan suatu langkah atau menyelesaikan tugas. Kini tersedia secara umum, agen dapat merencanakan dan melakukan sebagian besar tugas bisnis—mulai dari menjawab pertanyaan pelanggan tentang ketersediaan produk Anda hingga menerima pesanan—dan pengembang tidak perlu memahami pembelajaran mesin, perintah insinyur, melatih model, atau menghubungkan sistem secara manual. Dan Bedrock melakukan semua ini dengan aman dan pribadi, dan pelanggan seperti Druva dan Athene sudah menggunakannya untuk meningkatkan akurasi dan kecepatan pengembangan aplikasi AI generatif mereka.

- Introducing Pagar Pembatas untuk Batuan Dasar Amazon sehingga Anda dapat menerapkan perlindungan berdasarkan persyaratan kasus penggunaan Anda dan kebijakan AI yang bertanggung jawab. Pelanggan ingin memastikan bahwa interaksi dengan aplikasi AI mereka aman, menghindari bahasa yang beracun atau menyinggung, tetap relevan dengan bisnis mereka, dan selaras dengan kebijakan AI mereka yang bertanggung jawab. Dengan pagar pembatas, pelanggan dapat menentukan topik yang harus dihindari, dan Amazon Bedrock hanya akan memberikan tanggapan yang disetujui kepada pengguna terhadap pertanyaan yang termasuk dalam kategori terbatas tersebut. Misalnya, aplikasi perbankan online dapat diatur untuk menghindari pemberian nasihat investasi, dan menghapus konten yang tidak pantas (seperti perkataan yang mendorong kebencian dan kekerasan). Pada awal tahun 2024, pelanggan juga akan dapat menyunting informasi identitas pribadi (PII) dalam respons model. Misalnya, setelah pelanggan berinteraksi dengan agen pusat panggilan, percakapan layanan pelanggan sering kali diringkas untuk pencatatan, dan pagar pembatas dapat menghapus PII dari ringkasan tersebut. Pagar pembatas dapat digunakan di seluruh model di Amazon Bedrock (termasuk model yang disempurnakan), dan dengan Agen untuk Amazon Bedrock sehingga pelanggan dapat memberikan tingkat perlindungan yang konsisten pada semua aplikasi AI generatif mereka.

Lapisan teratas: Inovasi berkelanjutan membuat AI generatif dapat diakses oleh lebih banyak pengguna

Di lapisan atas tumpukan terdapat aplikasi yang memanfaatkan LLM dan FM lainnya sehingga Anda dapat memanfaatkan AI generatif di tempat kerja. Salah satu bidang di mana AI generatif telah mengubah permainan adalah dalam pengkodean. Tahun lalu, kami memperkenalkan Amazon CodeWhisperer, yang membantu Anda membangun aplikasi lebih cepat dan aman dengan menghasilkan saran dan rekomendasi kode hampir secara real-time. Pelanggan seperti Accenture, Boeing, Bundesliga, The Cigna Group, Kone, dan Warner Music Group menggunakan CodeWhisperer untuk meningkatkan produktivitas pengembang—dan Accenture memungkinkan hingga 50,000 pengembang perangkat lunak dan profesional TI mereka dengan Amazon CodeWhisperer. Kami ingin sebanyak mungkin pengembang bisa mendapatkan manfaat produktivitas AI generatif, itulah sebabnya CodeWhisperer menawarkan rekomendasi gratis untuk semua individu.

Namun, meskipun alat pengkodean AI melakukan banyak hal untuk membuat hidup pengembang lebih mudah, manfaat produktivitasnya dibatasi oleh kurangnya pengetahuan tentang basis kode internal, API internal, perpustakaan, paket, dan kelas. Salah satu cara untuk memikirkan hal ini adalah jika Anda merekrut pengembang baru, meskipun mereka adalah pengembang kelas dunia, mereka tidak akan produktif di perusahaan Anda sampai mereka memahami praktik dan kode terbaik Anda. Alat pengkodean bertenaga AI saat ini seperti pengembang baru. Untuk membantu dalam hal ini, kami baru-baru ini meninjau yang baru kemampuan penyesuaian di Amazon CodeWhisperer yang secara aman memanfaatkan basis kode internal pelanggan untuk memberikan rekomendasi kode yang lebih relevan dan berguna. Dengan kemampuan ini, CodeWhisperer menjadi ahlinya Tujuan kode dan memberikan rekomendasi yang lebih relevan untuk menghemat lebih banyak waktu. Dalam studi yang kami lakukan dengan Persistent, sebuah perusahaan rekayasa digital dan modernisasi perusahaan global, kami menemukan bahwa penyesuaian membantu pengembang menyelesaikan tugas hingga 28% lebih cepat dibandingkan dengan kemampuan umum CodeWhisperer. Kini pengembang di perusahaan teknologi kesehatan dapat meminta CodeWhisperer untuk “mengimpor gambar MRI yang terkait dengan ID pelanggan dan menjalankannya melalui pengklasifikasi gambar” untuk mendeteksi anomali. Karena CodeWhisperer memiliki akses ke basis kode, ia dapat memberikan saran yang lebih relevan yang mencakup lokasi impor gambar MRI dan ID pelanggan. CodeWhisperer merahasiakan penyesuaian sepenuhnya, dan FM yang mendasarinya tidak menggunakannya untuk pelatihan, sehingga melindungi kekayaan intelektual pelanggan yang berharga. AWS adalah satu-satunya penyedia cloud besar yang menawarkan kemampuan seperti ini kepada semua orang.

Introducing Amazon Q, asisten generatif bertenaga AI yang dirancang untuk bekerja

Pengembang tentu bukan satu-satunya pihak yang mulai menggunakan AI generatif—jutaan orang menggunakan aplikasi obrolan AI generatif. Apa yang telah dilakukan oleh penyedia layanan awal di bidang ini sangat menarik dan sangat berguna bagi konsumen, namun dalam banyak hal mereka tidak cukup “berhasil” di tempat kerja. Pengetahuan umum dan kemampuan mereka sangat bagus, namun mereka tidak mengetahui perusahaan Anda, data Anda, pelanggan Anda, operasi Anda, atau bisnis Anda. Itu membatasi seberapa banyak mereka dapat membantu Anda. Mereka juga tidak mengetahui banyak tentang peran Anda—pekerjaan apa yang Anda lakukan, dengan siapa Anda bekerja, informasi apa yang Anda gunakan, dan apa saja yang dapat Anda akses. Keterbatasan ini dapat dimengerti karena asisten ini tidak memiliki akses ke informasi pribadi perusahaan Anda, dan mereka tidak dirancang untuk memenuhi persyaratan privasi dan keamanan data yang harus diberikan perusahaan kepada mereka akses ini. Sulit untuk meningkatkan keamanan setelah kejadian tersebut dan mengharapkannya berfungsi dengan baik. Kami pikir kami memiliki cara yang lebih baik, yang memungkinkan setiap orang di setiap organisasi menggunakan AI generatif dengan aman dalam pekerjaan mereka sehari-hari.

WKami sangat bersemangat untuk memperkenalkannya Amazon Q, asisten generatif bertenaga AI jenis baru yang khusus untuk pekerjaan dan dapat disesuaikan dengan bisnis Anda. Q dapat membantu Anda mendapatkan jawaban yang cepat dan relevan terhadap pertanyaan-pertanyaan mendesak, memecahkan masalah, menghasilkan konten, dan mengambil tindakan menggunakan data dan keahlian yang ditemukan dalam repositori informasi, kode, dan sistem perusahaan perusahaan Anda. Saat Anda mengobrol dengan Amazon Q, Amazon Q memberikan informasi dan saran langsung dan relevan untuk membantu menyederhanakan tugas, mempercepat pengambilan keputusan, dan membantu memicu kreativitas dan inovasi di tempat kerja. Kami telah membangun Amazon Q agar aman dan pribadi, dan Amazon Q dapat memahami dan menghormati identitas, peran, dan izin Anda yang ada serta menggunakan informasi ini untuk mempersonalisasi interaksinya. Jika pengguna tidak memiliki izin untuk mengakses data tertentu tanpa Q, mereka juga tidak dapat mengaksesnya menggunakan Q. Kami telah merancang Amazon Q untuk memenuhi persyaratan ketat pelanggan perusahaan sejak hari pertama—tidak ada konten mereka yang digunakan untuk meningkatkan model dasar.

Amazon Q adalah asisten ahli Anda untuk membangun di AWS: Kami telah melatih Amazon Q berdasarkan pengetahuan dan pengalaman AWS selama 17 tahun sehingga dapat mengubah cara Anda membangun, menerapkan, dan mengoperasikan aplikasi dan beban kerja di AWS. Amazon Q memiliki antarmuka obrolan di AWS Management Console dan dokumentasi, IDE Anda (melalui CodeWhisperer), dan ruang obrolan tim Anda di Slack atau aplikasi obrolan lainnya. Amazon Q dapat membantu Anda menjelajahi kemampuan AWS baru, memulai lebih cepat, mempelajari teknologi asing, merancang solusi, memecahkan masalah, meningkatkan, dan banyak lagi — Amazon Q ahli dalam pola, praktik terbaik, dokumentasi, dan implementasi solusi AWS yang dirancang dengan baik. Berikut beberapa contoh hal yang dapat Anda lakukan dengan asisten ahli AWS baru Anda:

- Dapatkan jawaban dan panduan tajam mengenai kemampuan, layanan, dan solusi AWS: Minta Amazon Q untuk “Beri tahu saya tentang Agen Amazon Bedrock,” dan Q akan memberi Anda deskripsi fitur serta tautan ke materi yang relevan. Anda juga dapat menanyakan hampir semua pertanyaan kepada Amazon Q tentang cara kerja layanan AWS (misalnya, “Berapa batas penskalaan pada tabel DynamoDB?” “Apa itu Redshift Managed Storage?”), atau cara terbaik merancang sejumlah solusi ( “Apa praktik terbaik untuk membangun arsitektur berbasis peristiwa?”). Dan Amazon Q akan mengumpulkan jawaban singkat dan selalu mengutip (dan menautkan ke) sumbernya.

- Pilih layanan AWS terbaik untuk kasus penggunaan Anda, dan mulailah dengan cepat: Tanyakan pada Amazon Q “Apa saja cara membangun aplikasi Web di AWS? ” dan itu akan memberikan daftar layanan potensial seperti Amplifikasi AWS, AWS Lambda, dan Amazon EC2 dengan kelebihan masing-masing. Dari sana Anda dapat mempersempit pilihan dengan membantu Q memahami kebutuhan, preferensi, dan batasan Anda (misalnya, “Manakah dari berikut ini yang terbaik jika saya ingin menggunakan container?” atau “Haruskah saya menggunakan database relasional atau non-relasional? ”). Akhiri dengan “Bagaimana cara memulainya?” dan Amazon Q akan menguraikan beberapa langkah dasar dan mengarahkan Anda ke sumber daya tambahan.

- Optimalkan sumber daya komputasi Anda: Amazon Q dapat membantu Anda memilih instans Amazon EC2. Jika Anda memintanya untuk “Bantu saya menemukan instans EC2 yang tepat untuk menerapkan beban kerja pengkodean video untuk aplikasi game saya dengan kinerja tertinggi”, Q akan memberi Anda daftar keluarga instans beserta alasan untuk setiap saran. Dan, Anda dapat mengajukan sejumlah pertanyaan lanjutan untuk membantu menemukan pilihan terbaik untuk beban kerja Anda.

- Dapatkan bantuan dalam men-debug, menguji, dan mengoptimalkan kode Anda: Jika Anda mengalami kesalahan saat melakukan pengkodean di IDE, Anda dapat meminta bantuan Amazon Q dengan mengatakan, “Kode saya mengalami kesalahan IO, dapatkah Anda memberikan perbaikan?” dan Q akan membuatkan kode untuk Anda. Jika Anda menyukai sarannya, Anda dapat meminta Amazon Q untuk menambahkan perbaikan ke aplikasi Anda. Karena Amazon Q ada di IDE Anda, Amazon Q memahami kode yang sedang Anda kerjakan dan mengetahui di mana harus memasukkan perbaikan. Amazon Q juga dapat membuat pengujian unit (“Tulis pengujian unit untuk fungsi yang dipilih”) yang dapat dimasukkan ke dalam kode Anda dan dapat Anda jalankan. Terakhir, Amazon Q dapat memberi tahu Anda cara mengoptimalkan kode Anda untuk kinerja yang lebih tinggi. Minta Q untuk “Optimalkan kueri DynamoDB yang saya pilih,” dan pemahamannya tentang kode Anda akan digunakan untuk memberikan saran bahasa alami tentang apa yang harus diperbaiki beserta kode yang menyertainya yang dapat Anda terapkan dalam satu klik.

- Mendiagnosis dan memecahkan masalah: Jika Anda mengalami masalah di AWS Management Console, seperti kesalahan izin EC2 atau kesalahan konfigurasi Amazon S3, Anda cukup menekan tombol “Pemecahan Masalah dengan Amazon Q”, dan pemahamannya tentang jenis kesalahan dan layanan di mana kesalahan berada akan digunakan. untuk memberi Anda saran untuk perbaikan. Anda bahkan dapat meminta Amazon Q untuk memecahkan masalah jaringan Anda (misalnya, “Mengapa saya tidak dapat terhubung ke instans EC2 saya menggunakan SSH?”) dan Q akan menganalisis konfigurasi end-to-end Anda dan memberikan diagnosis (misalnya, “Instans ini tampaknya berada di subnet pribadi, jadi aksesibilitas publik mungkin perlu dibuat”).

- Tingkatkan basis kode baru dalam waktu singkat: Saat Anda mengobrol dengan Amazon Q di IDE Anda, Amazon Q menggabungkan keahliannya dalam membangun perangkat lunak dengan pemahaman tentang kode Anda—sebuah pasangan yang hebat! Sebelumnya, jika Anda mengambil alih proyek dari orang lain, atau Anda masih baru di tim, Anda mungkin harus menghabiskan waktu berjam-jam meninjau kode dan dokumentasi secara manual untuk memahami cara kerja dan fungsinya. Sekarang, karena Amazon Q memahami kode di IDE Anda, Anda cukup meminta Amazon Q untuk menjelaskan kode tersebut (“Beri saya deskripsi tentang fungsi aplikasi ini dan cara kerjanya”) dan Q akan memberi Anda detail seperti layanan mana yang penggunaan kode dan fungsi berbeda apa yang dilakukan (misalnya, Q mungkin menjawab dengan sesuatu seperti, “Aplikasi ini sedang membangun sistem tiket dukungan dasar menggunakan Python Flask dan AWS Lambda” dan selanjutnya menjelaskan setiap kemampuan intinya, bagaimana penerapannya, dan banyak lagi).

- Hapus simpanan fitur Anda lebih cepat: Anda bahkan dapat meminta Amazon Q untuk memandu Anda melalui dan mengotomatisasi sebagian besar proses end-to-end penambahan fitur ke aplikasi Anda di Amazon CodeCatalyst, layanan pengembangan perangkat lunak terpadu kami untuk tim. Untuk melakukan hal ini, Anda cukup menugaskan Q tugas simpanan dari daftar masalah Anda – seperti yang Anda lakukan pada rekan satu tim – dan Q membuat rencana langkah demi langkah tentang cara membangun dan mengimplementasikan fitur tersebut. Setelah Anda menyetujui rencana tersebut, Q akan menulis kode dan menyajikan perubahan yang disarankan kepada Anda sebagai tinjauan kode. Anda dapat meminta pengerjaan ulang (jika perlu), menyetujui dan/atau menerapkan!

- Tingkatkan kode Anda dalam waktu singkat: Kebanyakan pengembang sebenarnya hanya menghabiskan sebagian kecil waktunya untuk menulis kode baru dan membangun aplikasi baru. Mereka menghabiskan lebih banyak siklusnya pada area yang sulit dan lamban seperti pemeliharaan dan peningkatan. Ambil peningkatan versi bahasa. Banyak pelanggan yang terus menggunakan Java versi lama karena memerlukan waktu berbulan-bulan—bahkan bertahun-tahun—dan ribuan jam waktu pengembang untuk melakukan upgrade. Menunda hal ini mempunyai dampak dan risiko yang besar—Anda akan kehilangan peningkatan kinerja dan rentan terhadap masalah keamanan. Kami pikir Amazon Q dapat menjadi terobosan baru di sini, dan kami sangat gembira akan hal ini Transformasi Kode Amazon Q, sebuah fitur yang dapat menghilangkan banyak pekerjaan berat ini dan mengurangi waktu yang diperlukan untuk meningkatkan versi aplikasi dari hitungan hari menjadi menit. Anda cukup membuka kode yang ingin Anda perbarui di IDE Anda, dan meminta Amazon Q untuk “/ mengubah” kode Anda. Amazon Q akan menganalisis seluruh kode sumber aplikasi, menghasilkan kode dalam bahasa dan versi target, dan menjalankan pengujian, membantu Anda mewujudkan peningkatan keamanan dan kinerja versi bahasa terbaru. Baru-baru ini, tim pengembang Amazon yang sangat kecil menggunakan Amazon Q Code Transformation untuk meningkatkan 1,000 aplikasi produksi dari Java 8 ke Java 17 hanya dalam dua hari. Waktu rata-rata per aplikasi kurang dari 10 menit. Saat ini Amazon Q Code Transformation melakukan peningkatan bahasa Java dari Java 8 atau Java 11 ke Java 17. Yang berikutnya (dan segera) adalah kemampuan untuk mengubah .NET Framework menjadi .NET lintas platform (dengan lebih banyak transformasi yang akan menyusul di masa depan) .

Amazon Q adalah pakar bisnis Anda: Anda dapat menghubungkan Amazon Q ke data, informasi, dan sistem bisnis Anda sehingga Amazon Q dapat mensintesis semuanya dan memberikan bantuan yang disesuaikan untuk membantu orang memecahkan masalah, menghasilkan konten, dan mengambil tindakan yang relevan dengan bisnis Anda. Menghadirkan Amazon Q ke bisnis Anda sangatlah mudah. Ini memiliki 40+ konektor bawaan ke sistem perusahaan populer seperti Amazon S3, Microsoft 365, Salesforce, ServiceNow, Slack, Atlassian, Gmail, Google Drive, dan Zendesk. Itu juga dapat terhubung ke intranet internal, wiki, dan run books Anda, dan dengan Amazon Q SDK, Anda dapat membangun koneksi ke aplikasi internal mana pun yang Anda inginkan. Arahkan Amazon Q ke repositori ini, dan repositori ini akan “meningkatkan” bisnis Anda, menangkap dan memahami informasi semantik yang menjadikan perusahaan Anda unik. Kemudian, Anda mendapatkan aplikasi web Amazon Q yang ramah dan sederhana sehingga karyawan di seluruh perusahaan Anda dapat berinteraksi dengan antarmuka percakapan. Amazon Q juga terhubung ke penyedia identitas Anda untuk memahami pengguna, peran mereka, dan sistem apa yang boleh mereka akses sehingga pengguna dapat mengajukan pertanyaan mendetail dan beragam serta mendapatkan hasil yang disesuaikan yang hanya menyertakan informasi yang diizinkan untuk mereka lihat. Amazon Q menghasilkan jawaban dan wawasan yang akurat dan sesuai dengan materi dan pengetahuan yang Anda berikan, dan Anda dapat membatasi topik sensitif, memblokir kata kunci, atau memfilter pertanyaan dan jawaban yang tidak pantas. Berikut beberapa contoh hal yang dapat Anda lakukan dengan asisten ahli baru di bisnis Anda:

- Dapatkan jawaban yang tajam dan sangat relevan berdasarkan data dan informasi bisnis Anda: Karyawan dapat bertanya kepada Amazon Q tentang apa pun yang sebelumnya harus mereka cari di berbagai sumber. Tanyakan “Apa pedoman terbaru untuk penggunaan logo?”, atau “Bagaimana cara mengajukan permohonan kartu kredit perusahaan?”, dan Amazon Q akan menyatukan semua konten relevan yang ditemukannya dan memberikan jawaban cepat serta tautan ke konten relevan sumber (misalnya, portal merek dan repositori logo, kebijakan T&E perusahaan, dan aplikasi kartu).

- Menyederhanakan komunikasi sehari-hari: Tanyakan saja, dan Amazon Q dapat menghasilkan konten (“Buat postingan blog dan tiga berita utama media sosial yang mengumumkan produk yang dijelaskan dalam dokumentasi ini”), buat ringkasan eksekutif (“Tulis ringkasan transkrip pertemuan kami dengan daftar poin tindakan” ), memberikan pembaruan email (“Buat draf email yang menyoroti program pelatihan Q3 kami untuk pelanggan di India”), dan membantu menyusun pertemuan (“Buat agenda pertemuan untuk membicarakan laporan kepuasan pelanggan terbaru”).

- Selesaikan tugas: Amazon Q dapat membantu menyelesaikan tugas-tugas tertentu, mengurangi jumlah waktu yang dihabiskan karyawan untuk pekerjaan berulang seperti pengajuan tiket. Minta Amazon Q untuk “Ringkas umpan balik pelanggan tentang penawaran harga baru di Slack,” lalu minta Q mengambil informasi tersebut dan membuka tiket di Jira untuk memperbarui tim pemasaran. Anda dapat meminta Q untuk “Ringkas transkrip panggilan ini”, lalu “Buka kasus baru untuk Pelanggan A di Salesforce”. Amazon Q mendukung alat otomatisasi kerja populer lainnya seperti Zendesk dan Service Now.

Amazon Q ada di Amazon QuickSight: Dengan Amazon Q di QuickSight, layanan intelijen bisnis AWS, pengguna dapat mengajukan pertanyaan di dasbor mereka seperti “Mengapa jumlah pesanan meningkat bulan lalu?” dan mendapatkan visualisasi serta penjelasan faktor-faktor yang mempengaruhi peningkatan tersebut. Dan, analis dapat menggunakan Amazon Q untuk mengurangi waktu yang diperlukan untuk membuat dasbor dari hitungan hari menjadi hitungan menit dengan perintah sederhana seperti “Tunjukkan penjualan berdasarkan wilayah per bulan dalam bentuk diagram batang bertumpuk.” Q segera hadir kembali dengan diagram tersebut, dan Anda dapat dengan mudah menambahkannya ke dasbor atau mengobrol lebih jauh dengan Q untuk menyempurnakan visualisasinya (misalnya, “Ubah diagram batang menjadi diagram Sankey,” atau “Tampilkan negara, bukan wilayah”). Amazon Q di QuickSight juga mempermudah penggunaan dasbor yang ada untuk memberi informasi kepada pemangku kepentingan bisnis, menyaring wawasan utama, dan menyederhanakan pengambilan keputusan menggunakan cerita data. Misalnya, pengguna dapat meminta Amazon Q untuk “Membuat cerita tentang bagaimana bisnis telah berubah selama sebulan terakhir untuk tinjauan bisnis dengan pimpinan senior,” dan dalam hitungan detik, Amazon Q memberikan cerita berdasarkan data yang menarik secara visual dan menarik. sepenuhnya dapat disesuaikan. Kisah-kisah ini dapat dibagikan dengan aman ke seluruh organisasi untuk membantu menyelaraskan pemangku kepentingan dan mendorong keputusan yang lebih baik.

Amazon Q ada di Amazon Connect: Di Amazon Connect, layanan pusat kontak kami, Amazon Q membantu agen layanan pelanggan Anda memberikan layanan pelanggan yang lebih baik. Amazon Q memanfaatkan repositori pengetahuan yang biasanya digunakan agen Anda untuk mendapatkan informasi bagi pelanggan, dan kemudian agen dapat mengobrol dengan Amazon Q langsung di Connect untuk mendapatkan jawaban yang membantu mereka merespons permintaan pelanggan dengan lebih cepat tanpa perlu mencari sendiri dokumentasinya. Dan, meskipun mengobrol dengan Amazon Q untuk mendapatkan jawaban super cepat adalah hal yang bagus, dalam layanan pelanggan tidak ada yang namanya terlalu cepat. Itu sebabnya Amazon Q Dalam Koneksi mengubah percakapan pelanggan langsung dengan agen menjadi cepat, dan secara otomatis memberikan kemungkinan respons, tindakan yang disarankan, dan tautan ke sumber daya kepada agen. Misalnya, Amazon Q dapat mendeteksi bahwa pelanggan menghubungi perusahaan persewaan mobil untuk mengubah reservasi mereka, menghasilkan respons bagi agen untuk dengan cepat mengkomunikasikan bagaimana kebijakan biaya perubahan perusahaan berlaku, dan memandu agen melalui langkah-langkah yang mereka perlukan untuk memperbarui reservasi.

Amazon Q ada di AWS Supply Chain (Segera Hadir): Di AWS Supply Chain, layanan wawasan rantai pasokan kami, Amazon Q membantu perencana pasokan dan permintaan, manajer inventaris, dan mitra dagang mengoptimalkan rantai pasokan mereka dengan merangkum dan menyoroti potensi risiko kehabisan stok atau kelebihan stok, dan memvisualisasikan skenario untuk memecahkan masalah. Pengguna dapat mengajukan pertanyaan “apa”, “mengapa”, dan “bagaimana jika” kepada Amazon Q tentang data rantai pasokan mereka dan mengobrol tentang skenario kompleks dan trade-off antara berbagai keputusan rantai pasokan. Misalnya, pelanggan mungkin bertanya, “Apa yang menyebabkan keterlambatan pengiriman saya dan bagaimana cara mempercepatnya?” yang mungkin dibalas oleh Amazon Q, “90% pesanan Anda berada di pantai timur, dan badai besar di Tenggara menyebabkan penundaan selama 24 jam. Jika Anda mengirim ke pelabuhan New York dan bukan ke Miami, Anda akan mempercepat pengiriman dan mengurangi biaya sebesar 50%.”

Pelanggan kami mengadopsi AI generatif dengan cepat—mereka melatih model-model inovatif di AWS, mereka mengembangkan aplikasi AI generatif dengan kecepatan tinggi menggunakan Amazon Bedrock, dan mereka menerapkan aplikasi yang mengubah permainan di seluruh organisasi mereka seperti Amazon Q. Dengan pengumuman terbaru kami, AWS menghadirkan lebih banyak kinerja, pilihan, dan inovasi kepada pelanggan di setiap lapisannya. Dampak gabungan dari semua kemampuan yang kami berikan di re:Invent menandai tonggak penting dalam mencapai tujuan yang menarik dan bermakna: Kami membuat AI generatif dapat diakses oleh pelanggan dari semua ukuran dan kemampuan teknis sehingga mereka dapat menemukan kembali dan mentransformasikan apa yang mereka miliki. adalah mungkin.

Sumber

tentang Penulis

Swami Sivasubramanian adalah Wakil Presiden Data dan Pembelajaran Mesin di AWS. Dalam peran ini, Swami mengawasi semua layanan AWS Database, Analytics, dan AI & Machine Learning. Misi timnya adalah membantu organisasi menempatkan data mereka untuk bekerja dengan solusi data yang lengkap dan menyeluruh untuk disimpan, diakses, dianalisis, dan divisualisasikan, serta diprediksi.

Swami Sivasubramanian adalah Wakil Presiden Data dan Pembelajaran Mesin di AWS. Dalam peran ini, Swami mengawasi semua layanan AWS Database, Analytics, dan AI & Machine Learning. Misi timnya adalah membantu organisasi menempatkan data mereka untuk bekerja dengan solusi data yang lengkap dan menyeluruh untuk disimpan, diakses, dianalisis, dan divisualisasikan, serta diprediksi.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 300

- 35%

- 40

- 50

- 500

- 65

- 8

- 9

- a

- kemampuan

- kemampuan

- Sanggup

- Tentang Kami

- atas

- mempercepat

- dipercepat

- akselerator

- Accenture

- mengakses

- aksesibilitas

- dapat diakses

- akuntansi

- ketepatan

- tepat

- memperoleh

- di seluruh

- Tindakan

- tindakan

- aktif

- sebenarnya

- menyesuaikan

- menambahkan

- menambahkan

- menambahkan

- tambahan

- Tambahan

- Selain itu

- tambahan

- Menambahkan

- Adidas

- Adobe

- Mengadopsi

- maju

- maju

- Keuntungan

- keuntungan

- pengiklanan

- nasihat

- Setelah

- terhadap

- agenda

- Agen

- agen

- agregat

- silam

- AI

- AI & Pembelajaran Mesin

- AI chatbot

- ai penelitian

- Bertenaga AI

- meluruskan

- Semua

- mengizinkan

- memungkinkan

- sepanjang

- sudah

- juga

- selalu

- Amazon

- Pembisik Kode Amazon

- Amazon EC2

- Amazon QuickSight

- Amazon SageMaker

- Amazon Web Services

- jumlah

- jumlah

- an

- analisis

- analis

- Analis

- analisis

- menganalisa

- analisis

- dan

- Mengumumkan

- Pengumuman

- Mengumumkan

- menjawab

- jawaban

- Antropik

- Apa pun

- siapapun

- apa saja

- api

- Lebah

- aplikasi

- muncul

- Aplikasi

- aplikasi

- Mendaftar

- menghargai

- pendekatan

- menyetujui

- disetujui

- aplikasi

- April

- ADALAH

- DAERAH

- daerah

- bisa dibilang

- sekitar

- AS

- meminta

- Bantuan

- Asisten

- asisten

- terkait

- asosiasi

- At

- Atlassian

- menambah

- ditambah

- menambah

- Aurora

- berwenang

- mengotomatisasikan

- mengotomatiskan

- secara otomatis

- secara otomatis

- Otomatisasi

- otomotif

- tersedianya

- tersedia

- rata-rata

- menghindari

- jauh

- AWS

- Inferensi AWS

- AWS Lambda

- Konsol Manajemen AWS

- kembali

- Perbankan

- bar

- hambatan

- mendasarkan

- berdasarkan

- dasar

- BE

- karena

- menjadi

- menjadi

- mulai

- Percaya

- Manfaat

- TERBAIK

- Praktik Terbaik

- Lebih baik

- antara

- Besar

- Milyar

- miliaran

- Memblokir

- Blok

- Blog

- Boeing

- Bolt

- pemesanan

- Booking.com

- Buku-buku

- kedua

- Bawah

- batas-batas

- merek

- Istirahat

- istirahat

- membawa

- Membawa

- membangun

- Bangunan

- membangun

- dibangun di

- built-in

- bisnis

- intelijen bisnis

- bisnis

- tapi

- tombol

- by

- panggilan

- call center

- CAN

- Bisa Dapatkan

- kemampuan

- kemampuan

- mampu

- Kapasitas

- Menangkap

- mobil

- karbon

- emisi karbon

- kartu

- hati-hati

- kasus

- kasus

- kategori

- menyebabkan

- pusat

- tertentu

- Pasti

- rantai

- menantang

- tantangan

- perubahan

- berubah

- Changer

- Perubahan

- mengubah

- karakteristik

- Grafik

- Charts

- ruang obrolan

- ChatBot

- chatbots

- mengobrol

- memeriksa

- keping

- Keripik

- pilihan

- Pilih

- memilih

- terpilih

- klaim

- kelas-kelas

- Pembersihan

- jelas

- Klik

- awan

- infrastruktur cloud

- Kelompok

- kekelompokan

- Pantai

- kode

- basis kode

- Ulasan kode

- Pengkodean

- berkolaborasi

- kolaborasi

- COM

- kombinasi

- menggabungkan

- bergabung

- menggabungkan

- bagaimana

- datang

- kedatangan

- Coming Soon

- menyampaikan

- komunikasi

- Perusahaan

- perusahaan

- Perusahaan

- dibandingkan

- menarik

- lengkap

- sama sekali

- kompleks

- kompleksitas

- luas

- menghitung

- konsep

- konfigurasi

- mengkonfigurasi

- dugaan

- Terhubung

- terhubung

- koneksi

- Konektivitas

- menghubungkan

- konsisten

- konsul

- kendala

- Konsumen

- konsumsi

- kontak

- contact center

- Wadah

- Konten

- konteks

- kontekstual

- terus

- terus

- terus

- terus-menerus

- kontrol

- kontrol

- Percakapan

- percakapan

- percakapan

- hak cipta

- copywriting

- Core

- Biaya

- hemat biaya

- Biaya

- negara

- Pengemudi

- membuat

- dibuat

- kreativitas

- pencipta

- kredit

- kartu kredit

- Kejahatan

- GARING

- CRM

- cross-platform

- pelanggan

- pengalaman pelanggan

- Kepuasan pelanggan

- Layanan Pelanggan

- pelanggan

- disesuaikan

- kustomisasi

- menyesuaikan

- disesuaikan

- Memotong

- siklus

- harian

- dasbor

- dasbor

- data

- Persiapan data

- privasi data

- Privasi dan Keamanan Data

- set data

- Data-driven

- Basis Data

- database

- batu bata data

- hari

- hari ke hari

- Hari

- Pengambilan Keputusan

- keputusan

- mendalam

- belajar mendalam

- lebih dalam

- definisi

- Derajat

- menunda

- menyampaikan

- Pengiriman

- mengantarkan

- memberikan

- Permintaan

- Demokratisasi

- Tergantung

- menyebarkan

- dikerahkan

- penggelaran

- penyebaran

- kedalaman

- menggambarkan

- dijelaskan

- deskripsi

- dirancang

- diinginkan

- terperinci

- rincian

- menemukan

- Menentukan

- TELEKOMUNIKASI DEUTSCHE

- Pengembang

- pengembang

- berkembang

- Pengembangan

- diagnosa

- dialog

- Dialog

- MELAKUKAN

- berbeda

- Difusi

- digital

- langsung

- mendistribusikan

- didistribusikan

- pelatihan terdistribusi

- mendistribusikan

- do

- dokumen

- dokumentasi

- dokumen

- tidak

- Tidak

- melakukan

- dilakukan

- Dont

- dua kali lipat

- turun

- mendorong

- dua

- duplikat

- lamanya

- e

- e-commerce

- setiap

- Awal

- mudah

- mudah

- Timur

- pantai timur

- Mudah

- Ekonomi

- edisi

- efektif

- efisiensi

- efisien

- usaha

- antara

- lain

- emisi

- karyawan

- memberdayakan

- memberdayakan

- aktif

- memungkinkan

- encoding

- pertemuan

- akhir

- ujung ke ujung

- energi

- Konsumsi Energi

- efisiensi energi

- insinyur

- Teknik

- mempertinggi

- Perangkat tambahan

- memperkaya

- Enterprise

- kelas perusahaan

- perusahaan

- Menghibur

- Seluruh

- amplop

- Era

- ERP

- kesalahan

- kesalahan

- Eter (ETH)

- evaluasi

- Bahkan

- peristiwa

- pERNAH

- Setiap

- semua orang

- segala sesuatu

- evolusi

- berkembang

- contoh

- contoh

- gembira

- menarik

- menjalankan

- eksekutif

- ada

- ekspansif

- mengharapkan

- mempercepat

- mahal

- pengalaman

- berpengalaman

- Pengalaman

- ahli

- keahlian

- Menjelaskan

- menyelidiki

- ekspres

- kain

- Menghadapi

- fakta

- faktor

- hampir

- setia

- elang

- Jatuh

- akrab

- keluarga

- keluarga

- FAST

- lebih cepat

- salah

- Fitur

- Fitur

- biaya

- umpan balik

- beberapa

- Filing

- menyaring

- Akhirnya

- keuangan

- Menemukan

- temuan

- menemukan

- akhir

- menyelesaikan

- Pertama

- Memperbaiki

- fleksibel

- terfokus

- mengikuti

- Untuk

- Untuk Konsumen

- Depan

- ditemukan

- Prinsip Dasar

- empat

- pecahan

- Kerangka

- kerangka

- Gratis

- sering

- ramah

- dari

- fungsi

- lebih lanjut

- masa depan

- permainan

- game-changer

- game

- Umum

- umumnya

- menghasilkan

- menghasilkan

- menghasilkan

- generasi

- generatif

- AI generatif

- generator

- mendapatkan

- mendapatkan

- Memberikan

- Aksi

- digital global

- gmail

- Go

- tujuan

- akan

- baik

- GPU

- GPU

- besar

- Tanah

- groundbreaking

- Kelompok

- Pertumbuhan

- dewasa

- bimbingan

- membimbing

- pedoman

- memiliki

- tangan

- Kejadian

- Sulit

- Perangkat keras

- berbahaya

- benci

- kebencian

- Memiliki

- memiliki

- Headlines

- kesehatan

- berat

- angkat berat

- membantu

- membantu

- membantu

- di sini

- High

- lebih tinggi

- paling tinggi

- menyoroti

- sangat

- menyewa

- -nya

- tuan

- JAM

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- Namun

- HTTPS

- Ratusan

- i

- ID

- identitas

- identitas

- id

- if

- gambar

- generasi gambar

- gambar

- Segera

- Dampak

- melaksanakan

- implementasi

- diimplementasikan

- mengimpor

- penting

- impresif

- memperbaiki

- ditingkatkan

- perbaikan

- in

- memasukkan

- termasuk

- Termasuk

- Meningkatkan

- Pada meningkat

- meningkatkan

- indikator

- individu

- industri

- industri

- industri terkemuka

- terpengaruh

- Info

- memberitahu

- informasi

- Infrastruktur

- berinovasi

- berinovasi

- Innovation

- inovasi

- inovatif

- memasukkan

- input

- wawasan

- wawasan

- contoh

- contoh

- sebagai gantinya

- Lembaga

- instruksi

- asuransi

- integrasi

- cendekiawan

- kekayaan intelektual

- Intelijen

- bermaksud

- berinteraksi

- interaksi

- interaktif

- saling berhubungan

- Antarmuka

- intern

- campur tangan

- ke

- memperkenalkan

- diperkenalkan

- memperkenalkan

- Jadian

- inventaris

- Menginvestasikan

- penyelidikan

- investasi

- investasi

- Investasi

- terlibat

- melibatkan

- masalah

- IT

- Profesional TI

- NYA

- Jepang

- jargon

- Jawa

- jpg

- hanya

- hanya satu

- Menjaga

- pemeliharaan

- kunci

- Area Utama

- kata kunci

- kit

- Paket (SDK)

- Tahu

- pengetahuan

- tahu

- Labs

- Kekurangan

- bahasa

- besar

- besar-besaran

- terbesar

- Terakhir

- Tahun lalu

- Terlambat

- Latensi

- Terbaru

- diluncurkan

- peluncuran

- Pengacara

- lapisan

- lapisan

- Kepemimpinan

- terkemuka

- BELAJAR

- belajar

- pengetahuan

- Informasi

- kurang

- Lets

- Tingkat

- Leverage

- memanfaatkan

- LexisNexis

- LG

- perpustakaan

- siklus hidup

- pengangkatan

- 'like'

- Mungkin

- keterbatasan

- Terbatas

- batas

- baris

- LINK

- link

- Daftar

- hidup

- hidup

- Llama

- terletak

- lokasi

- logis

- logo

- Panjang

- lama berdiri

- Lot

- cinta

- Rendah

- menurunkan

- terendah

- mesin

- Mesin belajar

- terbuat

- memelihara

- mempertahankan

- pemeliharaan

- utama

- membuat

- MEMBUAT

- Membuat

- berhasil

- pengelolaan

- Manajer

- panduan

- pekerjaan manual

- manual

- banyak

- Marketing

- bahan

- bahan

- maksimum

- Mungkin..

- me

- berarti

- cara

- Media

- Pelajari

- pertemuan

- pertemuan

- Memenuhi

- Anggota

- mer

- meta

- metode

- Miami

- Microsoft

- Microsoft 365

- Tengah

- mungkin

- batu

- menit

- kehilangan

- Misi

- ML

- model

- pemodelan

- model

- modernisasi

- Momentum

- MongoDB

- monitor

- Bulan

- bulan

- lebih

- paling

- Paling Populer

- bergerak

- MRI

- banyak

- beberapa

- musik

- harus

- my

- nama

- Nasdaq

- Alam

- Bahasa Alami

- Dekat

- perlu

- Perlu

- dibutuhkan

- membutuhkan

- bersih

- jaringan

- jaringan

- New

- NY

- baru saja

- berikutnya

- Nitro

- tidak

- laptop

- sekarang

- jumlah

- Nvidia

- of

- lepas

- serangan

- menawarkan

- menawarkan

- Penawaran

- sering

- lebih tua

- on

- sekali

- ONE

- yang

- secara online

- online banking

- hanya

- Buka

- beroperasi

- Operasi

- Optimize

- dioptimalkan

- mengoptimalkan

- Opsi

- or

- perintah

- organisasi

- organisasi

- asli

- Lainnya

- Lainnya

- kami

- di luar

- garis besar

- keluaran

- output

- lebih

- Terlalu banyak menimbun

- sangat

- sendiri

- Perdamaian

- paket

- menyakitkan

- pasang

- parameter

- parameter

- bagian

- rekan

- bagian

- lalu

- pola

- berhenti sebentar

- Konsultan Ahli

- untuk

- melakukan

- prestasi

- dilakukan

- melakukan

- izin

- Izin

- orang

- Personalisasi

- Personalisasi

- Sendiri

- Tur PGA

- frase

- saleh

- Tempat

- rencana

- plato

- Kecerdasan Data Plato

- Data Plato

- plus

- Titik

- Kebijakan

- Populer

- positif

- mungkin

- Pos

- potensi

- kekuasaan

- didukung

- kuat

- Praktis

- praktis

- praktek

- perlu

- meramalkan

- Prediksi

- preferensi

- persiapan

- Mempersiapkan

- menyajikan

- presiden

- pers

- mendesak

- Preview

- sebelumnya

- harga pompa cor beton mini

- di harga

- primer

- pribadi

- Keamanan dan Privasi

- swasta

- informasi pribadi

- Masalah

- masalah

- proses

- proses

- pengolahan

- menghasilkan

- Produk

- Produksi

- produktif

- produktifitas

- profesional

- profesional

- program

- proyek

- meminta

- milik

- hak milik

- melindungi

- perlindungan

- memberikan

- pemberi

- penyedia

- menyediakan

- menyediakan

- publik

- di depan umum

- tujuan

- Dorong

- Mendorong

- menempatkan

- Puting

- Ular sanca

- pytorch

- Q3

- kuantitatif

- pertanyaan

- Pertanyaan

- Cepat

- segera

- agak

- R & D

- jarak

- cepat

- cepat

- Tarif

- RE

- Bacaan

- nyata

- real-time

- realistis

- menyadari

- menyadari

- benar-benar

- menuai

- alasan

- baru-baru ini

- Rekomendasi

- rekomendasi

- catatan

- menurunkan

- mengurangi

- mengurangi

- memperhalus

- wilayah

- dirilis

- relevan

- keandalan

- sisa

- menghapus

- menghapus

- memperbaiki

- berulang-ulang

- penggantian

- balasan

- melaporkan

- gudang

- permintaan

- permintaan

- wajib

- Persyaratan

- penelitian

- Pemesanan

- Cadangan

- Resolusi

- beresonansi

- Sumber

- menghormati

- Menanggapi

- menanggapi

- tanggapan

- tanggapan

- tanggung jawab

- membatasi

- terbatas

- mengakibatkan

- Hasil

- kembali

- ulasan

- meninjau

- benar

- risiko

- Peran

- peran

- kamar

- rute

- Aturan

- Run

- berjalan

- landasan pacu

- berkorban

- aman

- pengamanan

- aman

- pembuat bijak

- penjualan

- tenaga penjualan

- sama

- kepuasan

- Save

- mengatakan

- Skala

- skala

- skenario

- cakupan

- skor

- menggaruk

- SDK

- mulus

- Pencarian

- Kedua

- Generasi kedua

- detik

- aman

- aman

- keamanan

- melihat

- melihat

- terlihat

- memilih

- terpilih

- seleksi

- mengirim

- senior

- pemimpin senior

- peka

- September

- Urutan

- Seri

- server

- layanan

- Sekarang Layanan

- Layanan

- set

- set

- beberapa

- Share

- berbagi

- kapal

- Pendek

- harus

- sisi

- penting

- Silikon

- Demikian pula

- Sederhana

- menyederhanakan

- hanya

- sejak

- ENAM

- ukuran

- kendur

- kecil

- So

- Sosial

- media sosial

- Perangkat lunak

- Pengembang Perangkat Lunak

- pengembangan perangkat lunak

- kit pengembangan perangkat lunak

- larutan

- Solusi

- MEMECAHKAN

- beberapa

- Seseorang

- sesuatu

- Segera

- mutakhir

- sumber

- kode sumber

- sumber

- tenggara

- Space

- percikan

- Secara khusus

- pidato

- kecepatan

- menghabiskan

- Stabilitas

- stabil

- tumpukan

- ditumpuk

- stakeholder

- mulai

- Mulai

- Startups

- state-of-the-art

- tinggal

- Langkah

- Tangga

- Masih

- penyimpanan

- menyimpan

- toko

- cerita

- badai

- Cerita

- mempersingkat

- Memperkuat

- ketat

- struktur

- Belajar

- subnet

- besar

- seperti itu

- cocok

- rangkaian

- meringkaskan

- RINGKASAN

- besar

- suplemen

- pemasok

- menyediakan

- Penawaran dan Permintaan

- supply chain

- mendukung

- Mendukung

- yakin

- mengherankan

- pengawasan

- mencurigakan

- Keberlanjutan

- Beralih

- mempersatukan

- sistem

- sistem

- tabel

- disesuaikan

- Mengambil

- Dibutuhkan

- pengambilan

- Berbicara

- target

- tugas

- tugas

- tim

- Anggota tim

- tim

- Teknis

- teknik

- teknik

- Teknologi

- Teknologi

- inovasi teknologi

- mengatakan

- jitu

- sepuluh

- memiliki

- tensorflow

- terminologi

- uji

- pengujian

- tes

- teks

- pembuatan teks

- dari

- bahwa

- Grafik

- Masa depan

- Dunia

- mereka

- Mereka

- diri

- kemudian

- Sana.

- Ini

- mereka

- hal

- hal

- berpikir

- Ketiga

- ini

- tahun ini

- itu

- ribuan

- tiga

- Melalui

- di seluruh

- keluaran

- tiket

- tiket

- waktu

- kali

- titan

- untuk

- hari ini

- hari ini

- bersama

- token

- terlalu

- mengambil

- alat

- alat

- puncak

- Topik

- Tour

- terhadap

- terhadap

- jalur

- Trading

- Pelatihan VE

- terlatih

- Pelatihan

- Transaksi

- Salinan

- Mengubah

- Transformasi

- transformasi

- mengubah

- perjalanan

- triliunan

- perjalanan

- benar-benar

- Kepercayaan

- mencoba

- mencoba

- ternyata

- dua

- mengetik

- khas

- pokok

- memahami

- dimengerti

- pemahaman

- mengerti

- tidak biasa

- terpadu

- unik

- fitur unik

- satuan

- tidak seperti

- sampai

- Memperbarui

- Pembaruan

- meningkatkan

- upgrade

- us

- penggunaan

- menggunakan

- gunakan case

- bekas

- Pengguna

- Pengguna

- kegunaan

- menggunakan

- Berharga

- variasi

- berbagai

- versi

- Lawan

- sangat

- melalui

- wakil

- Wakil Presiden

- Video

- sebenarnya

- visualisasi

- membayangkan

- visual

- volume

- Rentan

- ingin

- Warner

- grup musik pemberi peringatan

- adalah

- Gelombang

- Cara..

- cara

- we

- jaringan

- aplikasi web

- layanan web

- situs web

- minggu

- minggu

- selamat datang

- BAIK

- terkenal

- adalah

- Apa

- Apa itu

- ketika

- apakah

- yang

- sementara

- SIAPA

- mengapa

- lebar

- Rentang luas

- lebih luas

- akan

- jendela

- dengan

- dalam

- tanpa

- Kerja

- bekerja

- Alur kerja

- kerja

- bekerja

- dunia

- kelas dunia

- kuatir

- bernilai

- akan

- menulis

- tulis kode

- penulisan

- tahun

- tahun

- York

- kamu

- Anda

- Zendesk

- zephyrnet.dll