Pesatnya pertumbuhan AI generatif menghadirkan inovasi baru yang menjanjikan, sekaligus memunculkan tantangan baru. Tantangan-tantangan ini mencakup beberapa tantangan yang umum terjadi sebelum AI generatif, seperti bias dan kemampuan menjelaskan, dan yang baru yang unik untuk model pondasi (FM), termasuk halusinasi dan toksisitas. Di AWS, kami berkomitmen untuk itu mengembangkan AI generatif secara bertanggung jawab, mengambil pendekatan yang berpusat pada manusia yang memprioritaskan pendidikan, sains, dan pelanggan kami, untuk mengintegrasikan AI yang bertanggung jawab di seluruh siklus hidup AI end-to-end.

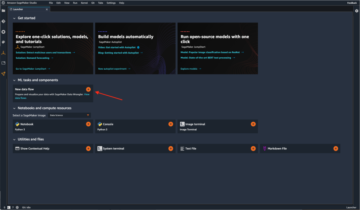

Selama setahun terakhir, kami telah memperkenalkan kemampuan baru dalam aplikasi dan model AI generatif kami seperti pemindaian keamanan bawaan Pembisik Kode Amazon, pelatihan untuk mendeteksi dan memblokir konten berbahaya Titan Amazon, dan perlindungan privasi data di Batuan Dasar Amazon. Investasi kami pada AI generatif yang aman, transparan, dan bertanggung jawab mencakup kolaborasi dengan komunitas global dan pembuat kebijakan seiring kami mendorong dan mendukung kedua hal tersebut. Komitmen AI Sukarela Gedung Putih dan KTT Keamanan AI di Inggris. Dan kami terus bekerja sama dengan pelanggan untuk mengoperasionalkan AI yang bertanggung jawab dengan alat yang dibuat khusus seperti Memperjelas Amazon SageMaker, Tata Kelola ML dengan Amazon SageMaker, Dan banyak lagi.

Memperkenalkan inovasi AI baru yang bertanggung jawab

Seiring dengan berkembangnya AI generatif ke industri, organisasi, dan kasus penggunaan baru, pertumbuhan ini harus dibarengi dengan investasi berkelanjutan dalam pengembangan FM yang bertanggung jawab. Pelanggan ingin FM mereka dibangun dengan mempertimbangkan keselamatan, keadilan, dan keamanan, sehingga mereka dapat menerapkan AI secara bertanggung jawab. Di AWS re:Invent tahun ini, kami dengan gembira mengumumkan kemampuan baru untuk mendorong inovasi AI generatif yang bertanggung jawab di seluruh rangkaian kemampuan dengan alat bawaan baru, perlindungan pelanggan, sumber daya untuk meningkatkan transparansi, dan alat untuk memerangi disinformasi. Kami bertujuan untuk memberikan informasi yang dibutuhkan pelanggan untuk mengevaluasi FM berdasarkan pertimbangan utama AI yang bertanggung jawab, seperti toksisitas dan ketahanan, serta memperkenalkan batasan untuk menerapkan perlindungan berdasarkan kasus penggunaan pelanggan dan kebijakan AI yang bertanggung jawab. Pada saat yang sama, pelanggan kami ingin mendapatkan informasi yang lebih baik tentang keselamatan, keadilan, keamanan, dan properti lainnya, dari layanan AI dan FM, saat mereka menggunakannya dalam organisasi mereka sendiri. Kami sangat bersemangat untuk mengumumkan lebih banyak sumber daya untuk membantu pelanggan lebih memahami layanan AWS AI kami dan memberikan transparansi yang mereka minta.

Menerapkan pengamanan: Pagar Pembatas untuk Amazon Bedrock

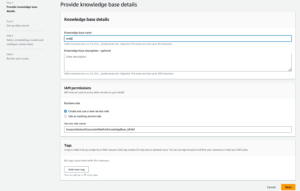

Keselamatan adalah prioritas dalam memperkenalkan AI generatif dalam skala besar. Organisasi ingin mendorong interaksi yang aman antara pelanggan mereka dan aplikasi AI generatif yang menghindari bahasa yang berbahaya atau menyinggung dan selaras dengan kebijakan perusahaan. Cara termudah untuk melakukannya adalah dengan menerapkan perlindungan yang konsisten di seluruh organisasi sehingga setiap orang dapat berinovasi dengan aman. Kemarin kami mengumumkan pratinjaunya Pagar Pembatas untuk Batuan Dasar Amazon—kemampuan baru yang memudahkan penerapan perlindungan khusus aplikasi berdasarkan kasus penggunaan pelanggan dan kebijakan AI yang bertanggung jawab.

Pagar pembatas mendorong konsistensi dalam cara FM di Amazon Bedrock merespons konten yang tidak diinginkan dan berbahaya dalam aplikasi. Pelanggan dapat menerapkan pagar pembatas pada model bahasa besar di Amazon Bedrock serta model yang disempurnakan dan dikombinasikan dengan Agen untuk Amazon Bedrock. Pagar pembatas memungkinkan Anda menentukan topik yang harus dihindari, dan layanan secara otomatis mendeteksi dan mencegah pertanyaan dan tanggapan yang termasuk dalam kategori terbatas. Pelanggan juga dapat mengonfigurasi ambang batas filter konten di seluruh kategori termasuk perkataan yang mendorong kebencian, penghinaan, bahasa seksual, dan kekerasan untuk menyaring konten berbahaya ke tingkat yang diinginkan. Misalnya, aplikasi perbankan online dapat diatur untuk menghindari pemberian nasihat investasi dan membatasi konten yang tidak pantas (seperti perkataan yang mendorong kebencian, penghinaan, dan kekerasan). Dalam waktu dekat, pelanggan juga akan dapat menyunting informasi identitas pribadi (PII) dalam masukan pengguna dan tanggapan FM, menetapkan filter kata-kata kotor, dan memberikan daftar kata-kata khusus untuk diblokir dalam interaksi antara pengguna dan FM, meningkatkan kepatuhan dan lebih jauh lagi. melindungi pengguna. Dengan Guardrails, Anda dapat berinovasi lebih cepat dengan AI generatif sambil menjaga perlindungan dan pengamanan sesuai dengan kebijakan perusahaan.

Mengidentifikasi FM terbaik untuk kasus penggunaan tertentu: Evaluasi Model di Amazon Bedrock

Saat ini, organisasi memiliki beragam pilihan FM untuk mendukung aplikasi AI generatif mereka. Untuk mencapai keseimbangan yang tepat antara akurasi dan kinerja dalam kasus penggunaannya, organisasi harus membandingkan model secara efisien dan menemukan opsi terbaik berdasarkan AI utama yang bertanggung jawab dan metrik kualitas yang penting bagi mereka. Untuk mengevaluasi model, organisasi harus terlebih dahulu menghabiskan waktu berhari-hari untuk mengidentifikasi tolok ukur, menyiapkan alat evaluasi, dan menjalankan penilaian, yang semuanya memerlukan keahlian mendalam dalam ilmu data. Selain itu, pengujian ini tidak berguna untuk mengevaluasi kriteria subjektif (misalnya, suara merek, relevansi, dan gaya) yang memerlukan penilaian melalui alur kerja peninjauan manusia yang membosankan dan memakan waktu. Waktu, keahlian, dan sumber daya yang diperlukan untuk evaluasi ini—untuk setiap kasus penggunaan baru—menyulitkan organisasi untuk mengevaluasi model berdasarkan dimensi AI yang bertanggung jawab dan membuat pilihan yang tepat mengenai model mana yang akan memberikan pengalaman paling akurat dan aman bagi pelanggan mereka.

Sekarang tersedia dalam pratinjau, Evaluasi Model di Amazon Bedrock membantu pelanggan mengevaluasi, membandingkan, dan memilih FM terbaik untuk kasus penggunaan spesifik mereka berdasarkan metrik khusus, seperti akurasi dan keamanan, menggunakan evaluasi otomatis atau manusia. Di konsol Amazon Bedrock, pelanggan memilih FM yang ingin mereka bandingkan untuk tugas tertentu, seperti menjawab pertanyaan atau meringkas konten. Untuk evaluasi otomatis, pelanggan memilih kriteria evaluasi yang telah ditentukan sebelumnya (misalnya akurasi, ketahanan, dan toksisitas) dan mengunggah kumpulan data pengujian mereka sendiri atau memilih dari kumpulan data bawaan yang tersedia untuk umum. Untuk kriteria subjektif atau konten berbeda yang memerlukan penilaian, pelanggan dapat dengan mudah mengatur alur kerja evaluasi berbasis manusia hanya dengan beberapa klik. Alur kerja ini memanfaatkan tim kerja internal pelanggan, atau menggunakan tenaga kerja terkelola yang disediakan oleh AWS, untuk mengevaluasi respons model. Selama evaluasi berbasis manusia, pelanggan menentukan metrik kasus penggunaan tertentu (misalnya, relevansi, gaya, dan suara merek). Setelah pelanggan menyelesaikan proses penyiapan, Amazon Bedrock menjalankan evaluasi dan menghasilkan laporan, sehingga pelanggan dapat dengan mudah memahami bagaimana kinerja model di seluruh kriteria keamanan dan akurasi utama serta memilih model terbaik untuk kasus penggunaan mereka.

Kemampuan untuk mengevaluasi model tidak terbatas pada Amazon Bedrock, pelanggan juga dapat menggunakan evaluasi model di Amazon SageMaker Clarify untuk dengan mudah mengevaluasi, membandingkan, dan memilih opsi FM terbaik di seluruh metrik kualitas dan tanggung jawab utama seperti akurasi, ketahanan, dan toksisitas – di seluruh semua FM.

Memerangi disinformasi: Pemberian tanda air di Amazon Titan

Hari ini, kami mengumumkan Pembuat Gambar Amazon Titan dalam pratinjau, yang memberdayakan pelanggan untuk dengan cepat menghasilkan dan menyempurnakan gambar berkualitas tinggi dalam skala besar. Kami mempertimbangkan AI yang bertanggung jawab dalam setiap tahap proses pengembangan model, termasuk pemilihan data pelatihan, membangun kemampuan pemfilteran untuk mendeteksi dan menghapus masukan pengguna dan keluaran model yang tidak sesuai, serta meningkatkan keragaman demografi keluaran model kami. Semua gambar yang dihasilkan Amazon Titan berisi tanda air yang tidak terlihat secara default, yang dirancang untuk membantu mengurangi penyebaran disinformasi dengan menyediakan mekanisme rahasia untuk mengidentifikasi gambar yang dihasilkan AI. AWS adalah salah satu penyedia model pertama yang merilis secara luas tanda air tak kasat mata bawaan yang diintegrasikan ke dalam keluaran gambar dan dirancang agar tahan terhadap perubahan.

Membangun kepercayaan: Mendukung model dan aplikasi kami dengan memberikan ganti rugi

Membangun kepercayaan pelanggan adalah inti AWS. Kami telah melakukan perjalanan bersama pelanggan sejak awal, dan dengan pertumbuhan AI generatif, kami tetap berkomitmen untuk bersama-sama membangun teknologi inovatif. Agar pelanggan dapat memanfaatkan kekuatan AI generatif kami, mereka perlu mengetahui bahwa mereka terlindungi. AWS menawarkan perlindungan ganti rugi hak cipta untuk keluaran layanan AI generatif Amazon berikut: Amazon Titan Text Express, Amazon Titan Text Lite, Amazon Titan Embeddings, Amazon Titan Multimodal Embeddings, Amazon CodeWhisperer Professional, AWS HealthScribe, AmazonLex, dan Amazon Personalisasi. Ini berarti bahwa pelanggan yang menggunakan layanan secara bertanggung jawab dilindungi dari klaim pihak ketiga yang menuduh adanya pelanggaran hak cipta atas keluaran yang dihasilkan oleh layanan tersebut (lihat Bagian 50.10 dari Ketentuan Layanan). Selain itu, ganti rugi IP standar kami untuk penggunaan layanan melindungi pelanggan dari klaim pihak ketiga yang menuduh pelanggaran IP oleh layanan dan data yang digunakan untuk melatih mereka. Dengan kata lain, jika Anda menggunakan layanan AI generatif Amazon yang tercantum di atas dan seseorang menuntut Anda atas pelanggaran IP, AWS akan membela gugatan tersebut, termasuk menanggung segala penilaian terhadap Anda atau biaya penyelesaian.

Kami mendukung layanan AI generatif kami dan berupaya untuk terus meningkatkannya. Saat AWS meluncurkan layanan baru dan AI generatif terus berkembang, AWS akan terus fokus tanpa henti untuk mendapatkan dan mempertahankan kepercayaan pelanggan.

Meningkatkan transparansi: AWS AI Service Card untuk Amazon Titan Text

We memperkenalkan AWS AI Service Cards di re:Invent 2022 sebagai sumber daya transparansi untuk membantu pelanggan lebih memahami layanan AWS AI kami. Kartu Layanan AI adalah bentuk dokumentasi AI yang bertanggung jawab yang memberi pelanggan satu tempat untuk menemukan informasi tentang kasus penggunaan dan batasan yang dimaksudkan, pilihan desain AI yang bertanggung jawab, serta praktik terbaik penerapan dan optimalisasi kinerja untuk layanan AI kami. Hal ini merupakan bagian dari proses pengembangan komprehensif yang kami lakukan untuk membangun layanan kami dengan cara yang bertanggung jawab yang memperhatikan keadilan, penjelasan, kebenaran dan ketahanan, tata kelola, transparansi, privasi dan keamanan, keselamatan, dan pengendalian.

Di re:Invent tahun ini kami mengumumkan a Kartu Layanan AI baru untuk Amazon Titan Text untuk meningkatkan transparansi dalam model pondasi. Kami juga meluncurkan empat Kartu Layanan AI baru termasuk: Amazon Memahami Deteksi PII, Deteksi Toksisitas Transkripsi Amazon, Pengakuan Amazon Menghadapi Keaktifan, dan AWS HealthScribe. Anda dapat menjelajahi masing-masing kartu ini di situs web AWS. Ketika AI generatif terus tumbuh dan berkembang, transparansi tentang bagaimana teknologi dikembangkan, diuji, dan digunakan akan menjadi komponen penting untuk mendapatkan kepercayaan dari organisasi dan pelanggan mereka. Di AWS, kami berkomitmen untuk terus menghadirkan sumber daya transparansi seperti AI Service Cards ke komunitas yang lebih luas—dan mengulangi serta mengumpulkan masukan tentang cara terbaik ke depan.

Berinvestasi pada AI yang bertanggung jawab di seluruh siklus hidup AI generatif

Kami sangat antusias dengan inovasi baru yang diumumkan di re:Invent minggu ini yang memberi pelanggan kami lebih banyak alat, sumber daya, dan perlindungan bawaan untuk membangun dan menggunakan AI generatif dengan aman. Mulai dari evaluasi model, pagar pembatas, hingga watermarking, pelanggan kini dapat menghadirkan AI generatif ke organisasi mereka dengan lebih cepat, sekaligus memitigasi risiko. Perlindungan baru bagi pelanggan seperti cakupan ganti rugi kekayaan intelektual dan sumber daya baru untuk meningkatkan transparansi seperti Kartu Layanan AI tambahan juga merupakan contoh utama komitmen kami untuk membangun kepercayaan di seluruh perusahaan teknologi, pembuat kebijakan, kelompok komunitas, ilmuwan, dan banyak lagi. Kami terus melakukan investasi yang berarti pada AI yang bertanggung jawab di seluruh siklus hidup model dasar—untuk membantu pelanggan kami menskalakan AI dengan cara yang aman, terjamin, dan bertanggung jawab.

Tentang Penulis

Peter Hallinan memimpin inisiatif dalam sains dan praktik AI yang Bertanggung Jawab di AWS AI, bersama tim pakar AI yang bertanggung jawab. Dia memiliki keahlian mendalam di bidang AI (PhD, Harvard) dan kewirausahaan (Blindsight, dijual ke Amazon). Kegiatan sukarelanya termasuk melayani sebagai profesor konsultan di Fakultas Kedokteran Universitas Stanford, dan sebagai presiden Kamar Dagang Amerika di Madagaskar. Jika memungkinkan, dia pergi ke pegunungan bersama anak-anaknya: bermain ski, mendaki, hiking, dan arung jeram

Peter Hallinan memimpin inisiatif dalam sains dan praktik AI yang Bertanggung Jawab di AWS AI, bersama tim pakar AI yang bertanggung jawab. Dia memiliki keahlian mendalam di bidang AI (PhD, Harvard) dan kewirausahaan (Blindsight, dijual ke Amazon). Kegiatan sukarelanya termasuk melayani sebagai profesor konsultan di Fakultas Kedokteran Universitas Stanford, dan sebagai presiden Kamar Dagang Amerika di Madagaskar. Jika memungkinkan, dia pergi ke pegunungan bersama anak-anaknya: bermain ski, mendaki, hiking, dan arung jeram

Vasi Filomin saat ini menjabat sebagai Wakil Presiden AI Generatif di AWS. Dia memimpin upaya AI generatif termasuk Amazon Bedrock, Amazon Titan, dan Amazon CodeWhisperer.

Vasi Filomin saat ini menjabat sebagai Wakil Presiden AI Generatif di AWS. Dia memimpin upaya AI generatif termasuk Amazon Bedrock, Amazon Titan, dan Amazon CodeWhisperer.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/announcing-new-tools-and-capabilities-to-enable-responsible-ai-innovation/

- :memiliki

- :adalah

- :bukan

- $NAIK

- 10

- 100

- 125

- 2022

- 50

- a

- kemampuan

- Sanggup

- Tentang Kami

- atas

- disertai

- ketepatan

- tepat

- di seluruh

- kegiatan

- tambahan

- Tambahan

- alamat

- nasihat

- terhadap

- AI

- Layanan AI

- tujuan

- meluruskan

- sama

- Semua

- di samping

- juga

- Amazon

- Pembisik Kode Amazon

- Amazon SageMaker

- Amazon Web Services

- Amerika

- antara

- an

- dan

- Mengumumkan

- mengumumkan

- Mengumumkan

- Lain

- Apa pun

- Aplikasi

- aplikasi

- Mendaftar

- pendekatan

- ADALAH

- sekitar

- AS

- meminta

- penilaian

- At

- secara otomatis

- secara otomatis

- tersedia

- menghindari

- dihindari

- AWS

- AWS re: Temukan

- Saldo

- Perbankan

- berdasarkan

- BE

- menjadi

- sebelum

- di belakang

- Benchmark

- TERBAIK

- Praktik Terbaik

- Lebih baik

- antara

- prasangka

- Memblokir

- kedua

- merek

- membawa

- Membawa

- luas

- lebih luas

- membangun

- membangun kepercayaan

- Bangunan

- dibangun di

- built-in

- by

- CAN

- kemampuan

- kemampuan

- kartu

- Kartu-kartu

- kasus

- kasus

- kategori

- tantangan

- Ruang

- anak-anak

- pilihan

- pilihan

- Pilih

- klaim

- Pendakian

- kolaborasi

- memerangi

- kombinasi

- datang

- Perdagangan

- komitmen

- berkomitmen

- Umum

- masyarakat

- Perusahaan

- perusahaan

- membandingkan

- pemenuhan

- komponen

- memahami

- luas

- pertimbangan

- dianggap

- konsisten

- konsul

- konsultasi

- mengandung

- Konten

- terus-menerus

- terus

- terus

- terus-menerus

- hak cipta

- pelanggaran hak cipta

- Core

- Biaya

- liputan

- penutup

- kriteria

- Sekarang

- adat

- pelanggan

- pelanggan

- data

- privasi data

- ilmu data

- kumpulan data

- Hari

- mendalam

- keahlian yang mendalam

- Default

- menetapkan

- menyampaikan

- demografis

- menyebarkan

- penyebaran

- Mendesain

- dirancang

- diinginkan

- menemukan

- dikembangkan

- Pengembangan

- sulit

- ukuran

- disinformasi

- Keragaman

- do

- dokumentasi

- mendorong

- selama

- e

- setiap

- mendapatkan

- Produktif

- termudah

- mudah

- Mudah

- Pendidikan

- efisien

- upaya

- antara

- memberdayakan

- aktif

- didorong

- ujung ke ujung

- mempertinggi

- Seluruh

- kewiraswastaan

- Eter (ETH)

- mengevaluasi

- mengevaluasi

- evaluasi

- evaluasi

- Setiap

- semua orang

- berkembang

- contoh

- contoh

- gembira

- pengalaman

- keahlian

- ahli

- Dapat dijelaskan

- menyelidiki

- ekspres

- Menghadapi

- keadilan

- Jatuh

- lebih cepat

- umpan balik

- beberapa

- menyaring

- penyaringan

- filter

- Menemukan

- menyelesaikan

- Pertama

- Fokus

- berikut

- Untuk

- bentuk

- Depan

- Membantu perkembangan

- Prinsip Dasar

- empat

- dari

- lebih lanjut

- Selanjutnya

- masa depan

- mengumpulkan

- dihasilkan

- menghasilkan

- generatif

- AI generatif

- diberikan

- memberikan

- Aksi

- pemerintahan

- Grup

- Tumbuh

- Pertumbuhan

- berbahaya

- memanfaatkan

- harvard

- benci

- kebencian

- Memiliki

- he

- membantu

- membantu

- berkualitas tinggi

- mendaki

- -nya

- Rumah

- Seterpercayaapakah Olymp Trade? Kesimpulan

- HTTPS

- manusia

- mengenali

- mengidentifikasi

- if

- gambar

- gambar

- melaksanakan

- penting

- memperbaiki

- meningkatkan

- in

- lahirnya

- memasukkan

- termasuk

- termasuk

- Termasuk

- Meningkatkan

- industri

- informasi

- informasi

- pelanggaran

- inisiatif

- berinovasi

- Innovation

- inovasi

- inovatif

- teknologi inovatif

- input

- mengintegrasikan

- terpadu

- dimaksudkan

- interaksi

- ke

- memperkenalkan

- diperkenalkan

- memperkenalkan

- investasi

- Investasi

- gaib

- IP

- IT

- perjalanan

- jpg

- hanya

- kunci

- Tahu

- bahasa

- besar

- meluncurkan

- peluncuran

- perkara hukum

- Memimpin

- Lets

- Tingkat

- Leverage

- siklus hidup

- 'like'

- MEMBATASI

- keterbatasan

- Terbatas

- Daftar

- Daftar

- mempertahankan

- membuat

- MEMBUAT

- berhasil

- berarti

- cara

- mekanisme

- obat

- Metrik

- keberatan

- meringankan

- model

- model

- lebih

- paling

- harus

- Dekat

- Perlu

- New

- sekarang

- of

- lepas

- serangan

- Penawaran

- on

- sekali

- yang

- secara online

- online banking

- optimasi

- pilihan

- Opsi

- or

- organisasi

- organisasi

- Lainnya

- kami

- di luar

- output

- sendiri

- bagian

- lalu

- prestasi

- dilakukan

- Sendiri

- phd

- saleh

- Tempat

- plato

- Kecerdasan Data Plato

- Data Plato

- Kebijakan

- kebijakan

- mungkin

- kekuasaan

- praktek

- praktek

- presiden

- mencegah

- Preview

- memprioritaskan

- prioritas

- pribadi

- Keamanan dan Privasi

- proses

- menghasilkan

- kata-kata kotor

- profesional

- Profesor

- menjanjikan

- mendorong

- properties

- terlindung

- melindungi

- melindungi

- memberikan

- disediakan

- penyedia

- menyediakan

- di depan umum

- menempatkan

- kualitas

- query

- meningkatkan

- jarak

- cepat

- cepat

- RE

- menurunkan

- melepaskan

- relevansi

- tinggal

- menghapus

- melaporkan

- wajib

- membutuhkan

- tahan

- sumber

- Sumber

- Menanggapi

- tanggapan

- tanggung jawab

- tanggung jawab

- bertanggung jawab

- terbatas

- benar

- Risiko

- kesegaran

- berjalan

- berjalan

- aman

- pengamanan

- aman

- Safety/keselamatan

- pembuat bijak

- sama

- Skala

- skala ai

- sisik

- pemindaian

- Sekolah

- Ilmu

- ilmuwan

- Bagian

- aman

- keamanan

- melihat

- memilih

- seleksi

- layanan

- Layanan

- porsi

- set

- pengaturan

- penyelesaian

- penyiapan

- sejak

- tunggal

- So

- terjual

- beberapa

- Seseorang

- tertentu

- pidato

- menghabiskan

- penyebaran

- Tahap

- berdiri

- standar

- kedudukan

- Stanford

- Universitas Stanford

- menyerang

- gaya

- seperti itu

- Menggugat

- Didukung

- berkelanjutan

- pengambilan

- tugas

- tim

- Teknologi

- perusahaan teknologi

- diuji

- pengujian

- tes

- teks

- bahwa

- Grafik

- informasi

- Inggris

- mereka

- Mereka

- Ini

- mereka

- pihak ketiga

- ini

- minggu ini

- tahun ini

- itu

- Melalui

- waktu

- titan

- untuk

- bersama

- alat

- Topik

- Pelatihan VE

- Pelatihan

- Transparansi

- jelas

- Kepercayaan

- MENGHIDUPKAN

- Uk

- memahami

- melakukan

- unik

- universitas

- menggunakan

- gunakan case

- bekas

- Pengguna

- Pengguna

- menggunakan

- vital

- Suara

- sukarela

- sukarelawan

- vp

- ingin

- cap air

- Watermarking

- watermark

- Cara..

- cara

- we

- jaringan

- layanan web

- Situs Web

- minggu

- BAIK

- adalah

- Apa

- ketika

- yang

- sementara

- SIAPA

- seluruh

- lebar

- Rentang luas

- sangat

- akan

- dengan

- dalam

- kata

- Kerja

- Alur kerja

- Tenaga kerja

- tahun

- kemarin

- kamu

- zephyrnet.dll