Dengan munculnya AI generatif, model dasar (FM) saat ini, seperti model bahasa besar (LLM) Claude 2 dan Llama 2, dapat melakukan berbagai tugas generatif seperti menjawab pertanyaan, meringkas, dan membuat konten pada data teks. Namun, data dunia nyata tersedia dalam berbagai bentuk, seperti teks, gambar, video, dan audio. Ambil dek slide PowerPoint, misalnya. Itu bisa berisi informasi dalam bentuk teks, atau tertanam dalam grafik, tabel, dan gambar.

Dalam postingan kali ini, kami menyajikan solusi yang menggunakan FM multimodal seperti Penyematan Multimodal Amazon Titan model dan LLaVA 1.5 dan layanan AWS termasuk Batuan Dasar Amazon dan Amazon SageMaker untuk melakukan tugas generatif serupa pada data multimodal.

Ikhtisar solusi

Solusinya memberikan implementasi untuk menjawab pertanyaan menggunakan informasi yang terkandung dalam teks dan elemen visual dari slide deck. Perancangannya mengandalkan konsep Retrieval Augmented Generation (RAG). Secara tradisional, RAG telah dikaitkan dengan data tekstual yang dapat diproses oleh LLM. Dalam postingan ini, kami memperluas RAG untuk menyertakan gambar juga. Ini memberikan kemampuan pencarian yang kuat untuk mengekstrak konten yang relevan secara kontekstual dari elemen visual seperti tabel dan grafik serta teks.

Ada berbagai cara untuk merancang solusi RAG yang menyertakan gambar. Kami telah menyajikan satu pendekatan di sini dan akan menindaklanjuti dengan pendekatan alternatif di postingan kedua dari seri tiga bagian ini.

Solusi ini mencakup komponen berikut:

- Model Penyematan Multimodal Amazon Titan – FM ini digunakan untuk menghasilkan penyematan untuk konten di dek slide yang digunakan dalam posting ini. Sebagai model multimodal, model Titan ini dapat memproses teks, gambar, atau kombinasinya sebagai masukan dan menghasilkan embeddings. Model Titan Multimodal Embeddings menghasilkan vektor (embeddings) sebanyak 1,024 dimensi dan diakses melalui Amazon Bedrock.

- Asisten Bahasa dan Penglihatan Besar (LLaVA) – LLaVA adalah model multimodal sumber terbuka untuk pemahaman visual dan bahasa dan digunakan untuk menafsirkan data dalam slide, termasuk elemen visual seperti grafik dan tabel. Kami menggunakan versi parameter 7 miliar LLaVA 1.5-7b dalam solusi ini.

- Amazon SageMaker – Model LLaVA diterapkan pada titik akhir SageMaker menggunakan layanan hosting SageMaker, dan kami menggunakan titik akhir yang dihasilkan untuk menjalankan inferensi terhadap model LLaVA. Kami juga menggunakan notebook SageMaker untuk mengatur dan mendemonstrasikan solusi ini secara menyeluruh.

- Amazon OpenSearch Tanpa Server – OpenSearch Serverless adalah konfigurasi tanpa server berdasarkan permintaan Layanan Pencarian Terbuka Amazon. Kami menggunakan OpenSearch Serverless sebagai database vektor untuk menyimpan embeddings yang dihasilkan oleh model Titan Multimodal Embeddings. Indeks yang dibuat dalam koleksi OpenSearch Serverless berfungsi sebagai penyimpanan vektor untuk solusi RAG kami.

- Penyerapan Amazon OpenSearch (OSI) – OSI adalah pengumpul data tanpa server yang terkelola sepenuhnya yang mengirimkan data ke domain OpenSearch Service dan koleksi OpenSearch Serverless. Dalam postingan ini, kami menggunakan pipeline OSI untuk mengirimkan data ke penyimpanan vektor OpenSearch Serverless.

Arsitektur solusi

Desain solusi terdiri dari dua bagian: penyerapan dan interaksi pengguna. Selama penyerapan, kami memproses kumpulan slide masukan dengan mengonversi setiap slide menjadi gambar, membuat penyematan untuk gambar tersebut, lalu mengisi penyimpanan data vektor. Langkah-langkah ini diselesaikan sebelum langkah-langkah interaksi pengguna.

Pada fase interaksi pengguna, pertanyaan dari pengguna diubah menjadi penyematan dan pencarian kesamaan dijalankan pada database vektor untuk menemukan slide yang berpotensi berisi jawaban atas pertanyaan pengguna. Kami kemudian menyediakan slide ini (dalam bentuk file gambar) ke model LLaVA dan pertanyaan pengguna sebagai prompt untuk menghasilkan jawaban atas pertanyaan tersebut. Semua kode untuk posting ini tersedia di GitHub istirahat.

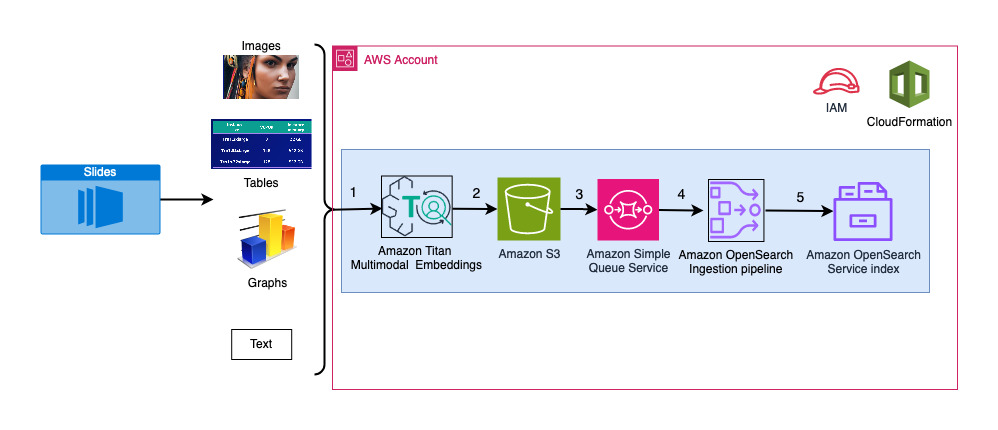

Diagram berikut menggambarkan arsitektur penyerapan.

Langkah-langkah alur kerjanya adalah sebagai berikut:

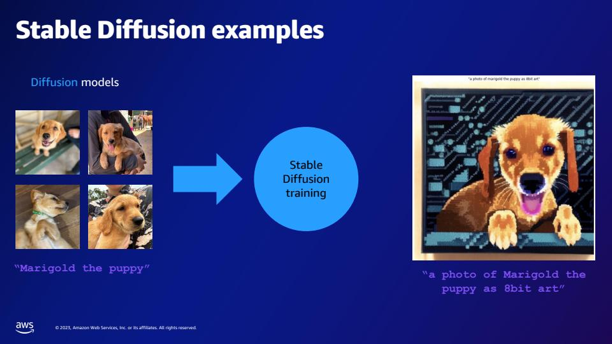

- Slide dikonversi menjadi file gambar (satu per slide) dalam format JPG dan diteruskan ke model Titan Multimodal Embeddings untuk menghasilkan embeddings. Dalam posting ini, kami menggunakan slide deck berjudul Latih dan terapkan Difusi Stabil menggunakan AWS Trainium & AWS Inferentia dari AWS Summit di Toronto, Juni 2023, untuk mendemonstrasikan solusinya. Dek sampel memiliki 31 slide, jadi kami menghasilkan 31 set penyematan vektor, masing-masing dengan 1,024 dimensi. Kami menambahkan bidang metadata tambahan ke penyematan vektor yang dihasilkan ini dan membuat file JSON. Bidang metadata tambahan ini dapat digunakan untuk melakukan kueri penelusuran kaya menggunakan kemampuan penelusuran OpenSearch yang canggih.

- Penyematan yang dihasilkan disatukan dalam satu file JSON yang diunggah Layanan Penyimpanan Sederhana Amazon (Amazon S3).

- melalui Pemberitahuan Peristiwa Amazon S3, suatu peristiwa dimasukkan ke dalam sebuah Layanan Antrian Sederhana Amazon (Amazon SQS).

- Peristiwa dalam antrean SQS ini bertindak sebagai pemicu untuk menjalankan alur OSI, yang pada gilirannya menyerap data (file JSON) sebagai dokumen ke dalam indeks OpenSearch Serverless. Perhatikan bahwa indeks OpenSearch Serverless dikonfigurasi sebagai sink untuk alur ini dan dibuat sebagai bagian dari koleksi OpenSearch Serverless.

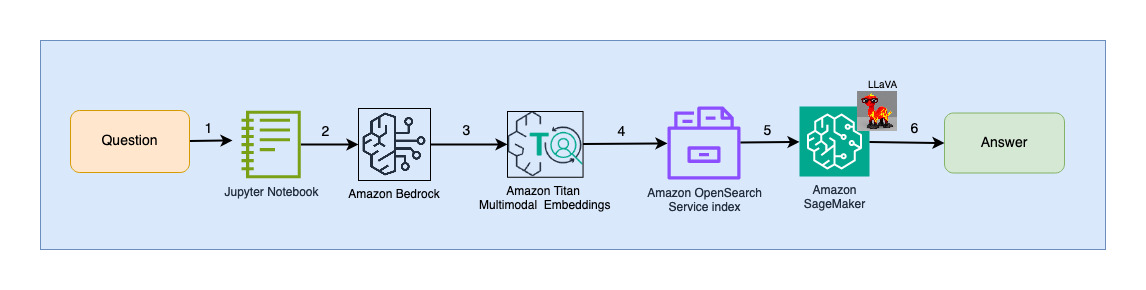

Diagram berikut menggambarkan arsitektur interaksi pengguna.

Langkah-langkah alur kerjanya adalah sebagai berikut:

- Seorang pengguna mengajukan pertanyaan terkait dengan dek slide yang telah diserap.

- Input pengguna diubah menjadi embeddings menggunakan model Titan Multimodal Embeddings yang diakses melalui Amazon Bedrock. Pencarian vektor OpenSearch dilakukan menggunakan embeddings ini. Kami melakukan pencarian k-tetangga terdekat (k=1) untuk mengambil penyematan paling relevan yang cocok dengan kueri pengguna. Pengaturan k=1 mengambil slide paling relevan dengan pertanyaan pengguna.

- Metadata respons dari OpenSearch Serverless berisi jalur ke gambar yang sesuai dengan slide yang paling relevan.

- Prompt dibuat dengan menggabungkan pertanyaan pengguna dan jalur gambar dan diberikan ke LLaVA yang dihosting di SageMaker. Model LLaVA mampu memahami pertanyaan pengguna dan menjawabnya dengan memeriksa data pada gambar.

- Hasil inferensi ini dikembalikan ke pengguna.

Langkah-langkah ini dibahas secara rinci di bagian berikut. Lihat Hasil bagian untuk tangkapan layar dan detail keluaran.

Prasyarat

Untuk mengimplementasikan solusi yang diberikan dalam posting ini, Anda harus memiliki Akun AWS dan keakraban dengan FM, Amazon Bedrock, SageMaker, dan OpenSearch Service.

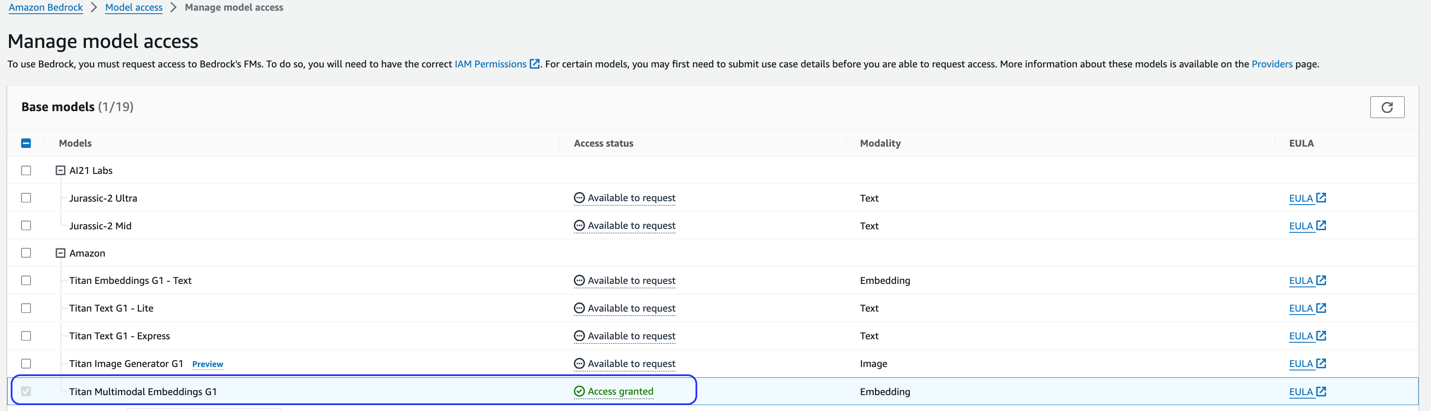

Solusi ini menggunakan model Titan Multimodal Embeddings. Pastikan model ini diaktifkan untuk digunakan di Amazon Bedrock. Di konsol Amazon Bedrock, pilih Akses model di panel navigasi. Jika Titan Multimodal Embeddings diaktifkan, status akses akan dinyatakan Akses diberikan.

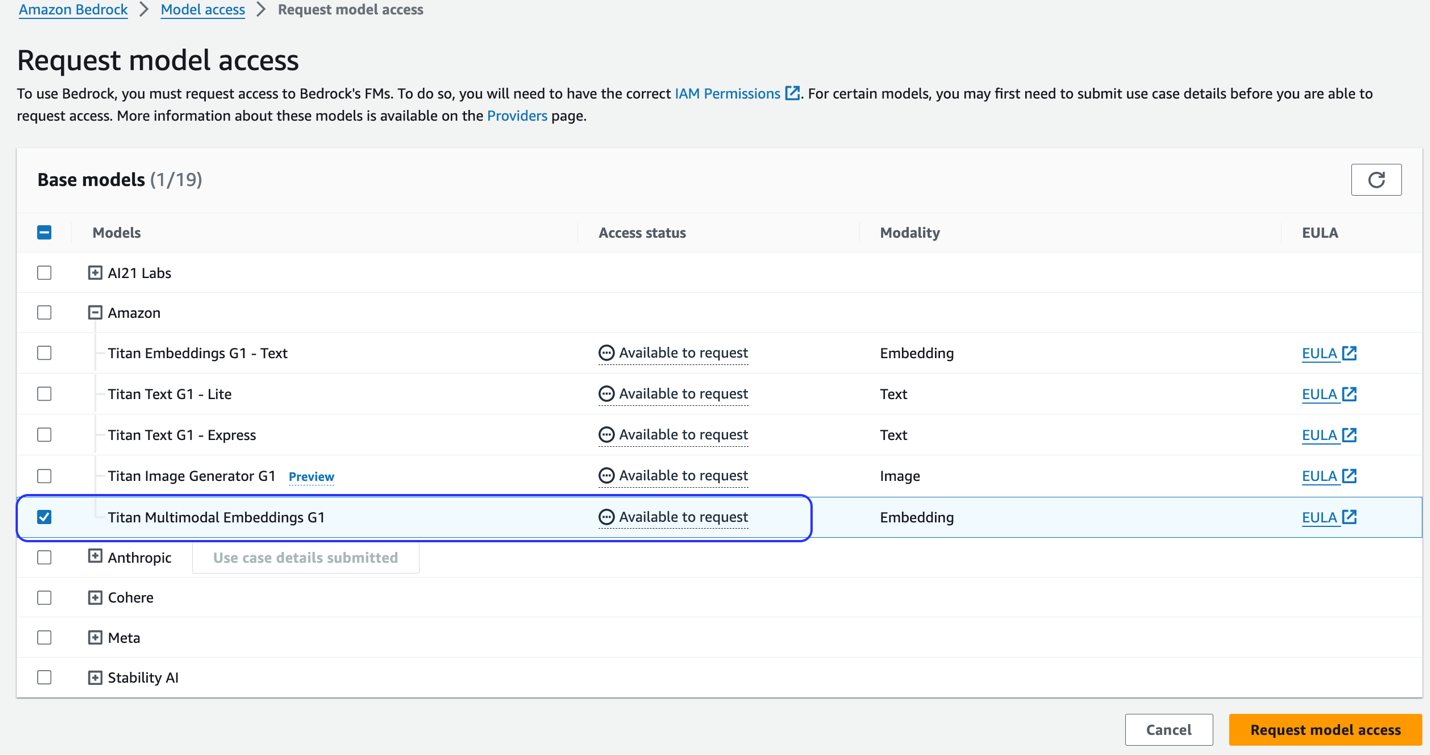

Jika model tidak tersedia, aktifkan akses ke model dengan memilih Kelola Akses Model, memilih Penyematan Multimoda Titan G1, dan memilih Minta akses model. Model ini segera diaktifkan untuk digunakan.

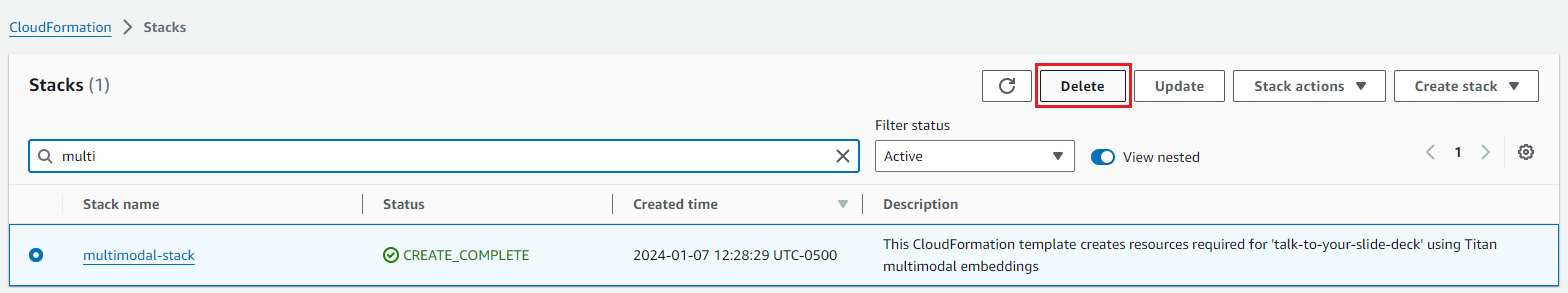

Gunakan templat AWS CloudFormation untuk membuat tumpukan solusi

Gunakan salah satu dari yang berikut ini Formasi AWS Cloud templat (tergantung Wilayah Anda) untuk meluncurkan sumber daya solusi.

| Wilayah AWS | Link |

|---|---|

us-east-1 |

|

us-west-2 |

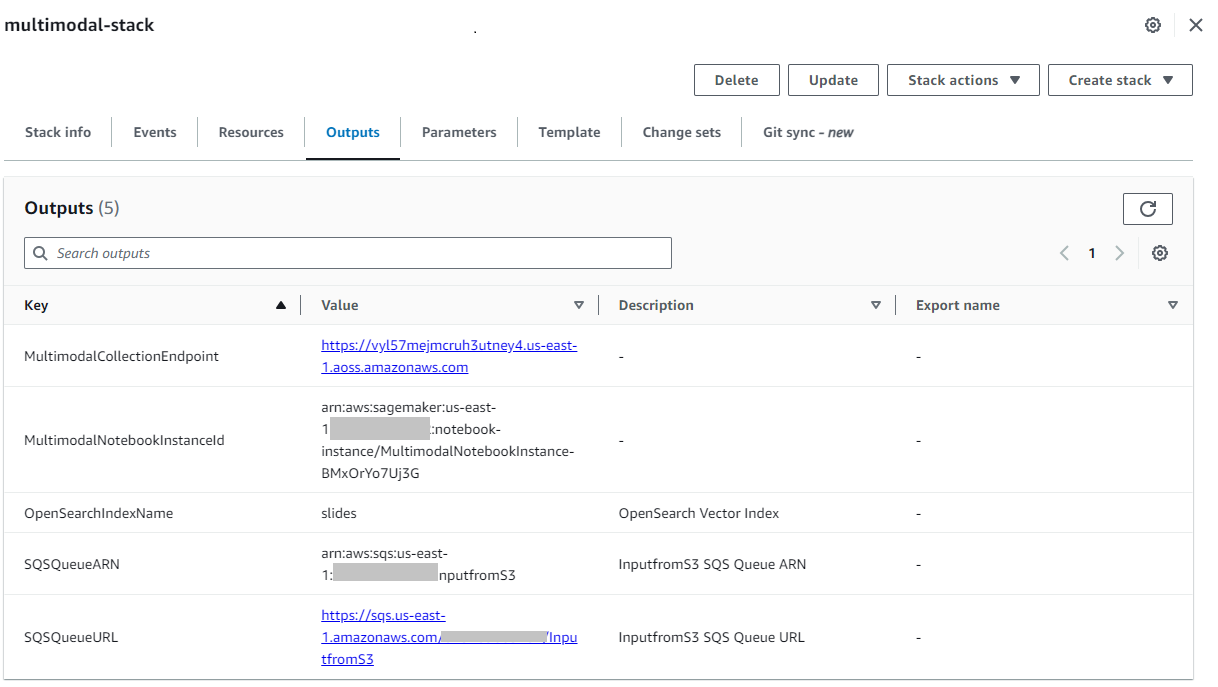

Setelah tumpukan berhasil dibuat, navigasikan ke tumpukan Output tab di konsol AWS CloudFormation dan catat nilainya MultimodalCollectionEndpoint, yang kami gunakan pada langkah selanjutnya.

Template CloudFormation membuat sumber daya berikut:

- Peran IAM - Pengikut Identitas AWS dan Manajemen Akses (IAM) peran dibuat. Perbarui peran ini untuk diterapkan izin dengan hak istimewa paling rendah.

SMExecutionRoledengan Amazon S3, SageMaker, OpenSearch Service, dan akses penuh Bedrock.OSPipelineExecutionRoledengan akses ke tindakan Amazon SQS dan OSI tertentu.

- Buku catatan SageMaker – Semua kode untuk postingan ini dijalankan melalui notebook ini.

- Koleksi Tanpa Server OpenSearch – Ini adalah database vektor untuk menyimpan dan mengambil embeddings.

- Pipa OSI – Ini adalah alur untuk menyerap data ke OpenSearch Tanpa Server.

- Ember S3 – Semua data untuk postingan ini disimpan di bucket ini.

- antrian SQS – Peristiwa yang memicu proses pipeline OSI dimasukkan ke dalam antrean ini.

Templat CloudFormation mengonfigurasi alur OSI dengan pemrosesan Amazon S3 dan Amazon SQS sebagai sumber dan indeks OpenSearch Serverless sebagai sink. Objek apa pun yang dibuat dalam bucket S3 dan awalan yang ditentukan (multimodal/osi-embeddings-json) akan memicu notifikasi SQS, yang digunakan oleh pipeline OSI untuk menyerap data ke OpenSearch Serverless.

Templat CloudFormation juga dibuat jaringan, enkripsi, dan akses data kebijakan yang diperlukan untuk koleksi OpenSearch Serverless. Perbarui kebijakan ini untuk menerapkan izin dengan hak istimewa paling rendah.

Perhatikan bahwa nama templat CloudFormation direferensikan di buku catatan SageMaker. Jika nama templat default diubah, pastikan Anda memperbaruinya global.py

Uji solusinya

Setelah langkah-langkah prasyarat selesai dan tumpukan CloudFormation berhasil dibuat, Anda kini siap untuk menguji solusinya:

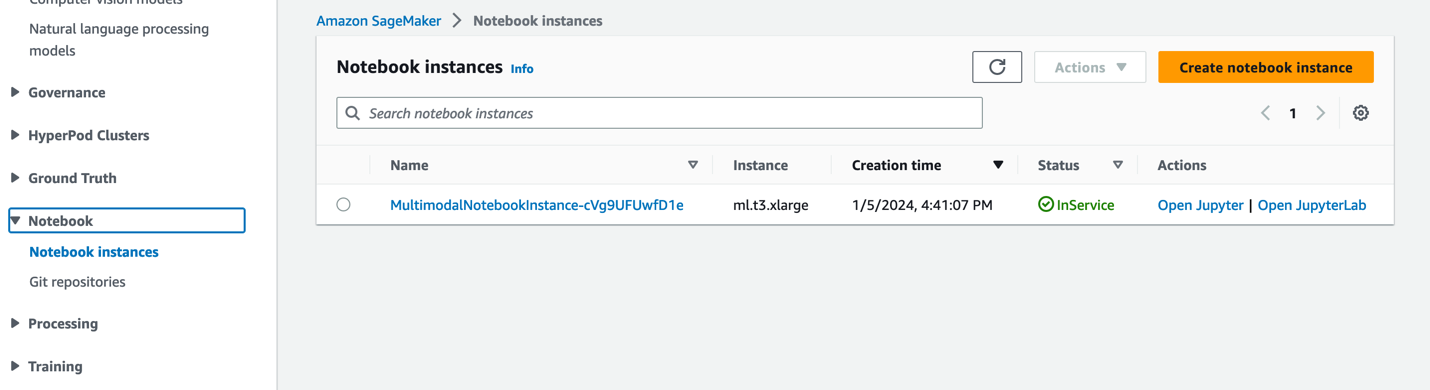

- Di konsol SageMaker, pilih notebook di panel navigasi.

- Pilih

MultimodalNotebookInstancecontoh notebook dan pilih Buka JupyterLab.

- In Browser File, buka folder notebooks untuk melihat notebook dan file pendukung.

Buku catatan diberi nomor sesuai urutan pengoperasiannya. Instruksi dan komentar di setiap buku catatan menjelaskan tindakan yang dilakukan oleh buku catatan tersebut. Kami menjalankan buku catatan ini satu per satu.

- Pilih 0_deploy_llava.ipynb untuk membukanya di JupyterLab.

- pada Run menu, pilih Jalankan Semua Sel untuk menjalankan kode di buku catatan ini.

Notebook ini menyebarkan model LLaVA-v1.5-7B ke titik akhir SageMaker. Di notebook ini, kami mengunduh model LLaVA-v1.5-7B dari HuggingFace Hub, ganti skrip inference.py dengan llava_inference.py, dan buat file model.tar.gz untuk model ini. File model.tar.gz diunggah ke Amazon S3 dan digunakan untuk menerapkan model pada titik akhir SageMaker. Itu llava_inference.py skrip memiliki kode tambahan untuk memungkinkan membaca file gambar dari Amazon S3 dan menjalankan inferensi di dalamnya.

- Pilih 1_data_prep.ipynb untuk membukanya di JupyterLab.

- pada Run menu, pilih Jalankan Semua Sel untuk menjalankan kode di buku catatan ini.

Buku catatan ini mengunduh dek geser, mengonversi setiap slide ke dalam format file JPG, dan mengunggahnya ke bucket S3 yang digunakan untuk postingan ini.

- Pilih 2_data_penyerapan.ipynb untuk membukanya di JupyterLab.

- pada Run menu, pilih Jalankan Semua Sel untuk menjalankan kode di buku catatan ini.

Kami melakukan hal berikut di buku catatan ini:

- Kami membuat indeks di koleksi OpenSearch Serverless. Indeks ini menyimpan data penyematan untuk dek slide. Lihat kode berikut:

- Kami menggunakan model Titan Multimodal Embeddings untuk mengonversi gambar JPG yang dibuat di buku catatan sebelumnya menjadi penyematan vektor. Penyematan dan metadata tambahan ini (seperti jalur S3 dari file gambar) disimpan dalam file JSON dan diunggah ke Amazon S3. Perhatikan bahwa satu file JSON dibuat, yang berisi dokumen untuk semua slide (gambar) yang diubah menjadi embeddings. Cuplikan kode berikut menunjukkan bagaimana gambar (dalam bentuk string yang dikodekan Base64) diubah menjadi embeddings:

- Tindakan ini memicu alur OpenSearch Ingestion, yang memproses file dan menyerapnya ke dalam indeks OpenSearch Serverless. Berikut contoh file JSON yang dibuat. (Vektor dengan empat dimensi ditunjukkan dalam kode contoh. Model Titan Multimodal Embeddings menghasilkan 1,024 dimensi.)

- Pilih 3_rag_inference.ipynb untuk membukanya di JupyterLab.

- pada Run menu, pilih Jalankan Semua Sel untuk menjalankan kode di buku catatan ini.

Notebook ini mengimplementasikan solusi RAG: kami mengonversi pertanyaan pengguna menjadi embeddings, menemukan gambar serupa (slide) dari database vektor, dan memberikan gambar yang diambil ke LLaVA untuk menghasilkan jawaban atas pertanyaan pengguna. Kami menggunakan templat prompt berikut:

Cuplikan kode berikut menyediakan alur kerja RAG:

Hasil

Berikut ini adalah kompilasi dari beberapa pertanyaan dan tanggapan pengguna yang dihasilkan oleh implementasi kami. Itu Pertanyaan kolom menangkap pertanyaan pengguna, dan Menjawab kolom adalah respons tekstual yang dihasilkan oleh LLaVA. Gambar adalah pencocokan slide k-terdekat (k=1) yang dikembalikan oleh pencarian vektor OpenSearch Serverless. Slide ini ditafsirkan oleh LLaVA untuk memberikan jawabannya.

Hasil RAG multimodal

| Pertanyaan | Menjawab | Gambar |

|---|---|---|

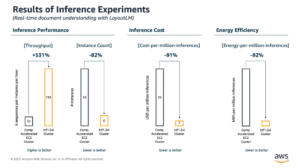

| Bagaimana kinerja Inf2 dibandingkan dengan instans EC2 yang sebanding? Saya butuh nomor. | Berdasarkan slide deck, instans Inf2 dari AWS Inferentia2 menawarkan throughput hingga 4x lebih tinggi dan latensi 10x lebih rendah dibandingkan instans EC2 yang sebanding. |  |

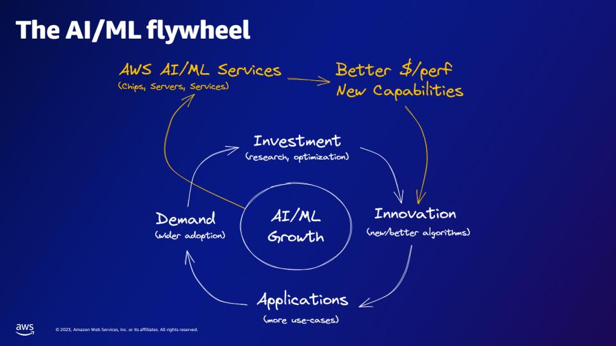

| Sesuai dengan flywheel AI/ML, apa saja yang disediakan oleh layanan AWS AI/ML? | Layanan AWS AI/ML memberikan kemampuan $/perfer yang lebih baik, kemampuan baru, dan investasi dalam inovasi. |  |

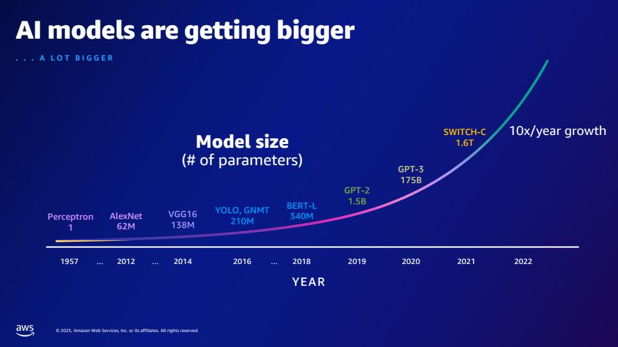

| Dibandingkan dengan GPT-2, berapa banyak lagi parameter yang dimiliki GPT-3? Berapa perbedaan numerik antara ukuran parameter GPT-2 dan GPT-3? | Berdasarkan slide tersebut, GPT-3 memiliki 175 miliar parameter, sedangkan GPT-2 memiliki 1.5 miliar parameter. Perbedaan numerik antara ukuran parameter GPT-2 dan GPT-3 adalah 173.5 miliar. |  |

| Apa yang dimaksud dengan quark dalam fisika partikel? | Saya tidak menemukan jawaban atas pertanyaan ini di slide deck. |  |

Jangan ragu untuk memperluas solusi ini ke dek slide Anda. Cukup perbarui variabel SLIDE_DECK di globals.py dengan URL ke dek slide Anda dan jalankan langkah-langkah penyerapan yang dirinci di bagian sebelumnya.

jenis

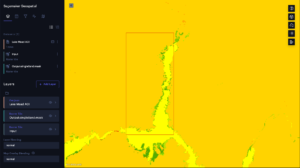

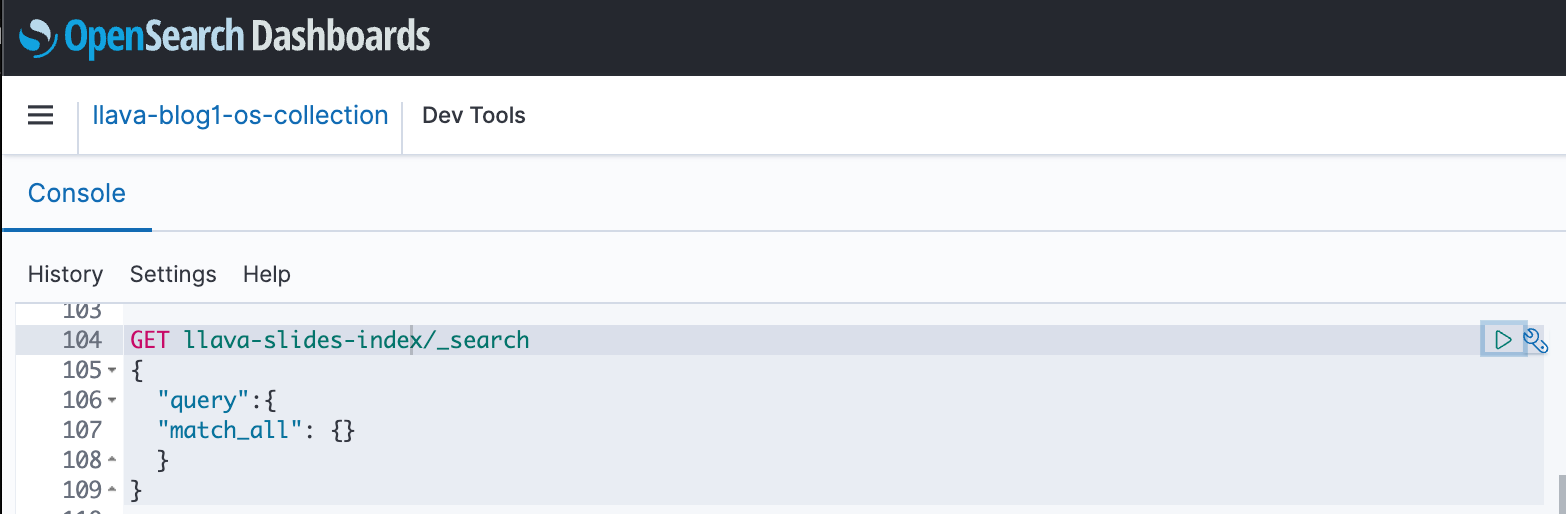

Anda dapat menggunakan Dasbor OpenSearch untuk berinteraksi dengan OpenSearch API guna menjalankan pengujian cepat pada indeks dan data yang diserap. Tangkapan layar berikut menunjukkan contoh GET dasbor OpenSearch.

Membersihkan

Untuk menghindari timbulnya biaya di masa mendatang, hapus sumber daya yang Anda buat. Anda dapat melakukan ini dengan menghapus tumpukan melalui konsol CloudFormation.

Selain itu, hapus titik akhir inferensi SageMaker yang dibuat untuk inferensi LLaVA. Anda dapat melakukan ini dengan menghapus komentar pada langkah pembersihan 3_rag_inference.ipynb dan menjalankan sel, atau dengan menghapus titik akhir melalui konsol SageMaker: pilih Kesimpulan dan Titik akhir di panel navigasi, lalu pilih titik akhir dan hapus.

Kesimpulan

Perusahaan menghasilkan konten baru setiap saat, dan slide deck adalah mekanisme umum yang digunakan untuk berbagi dan menyebarkan informasi secara internal dengan organisasi dan secara eksternal dengan pelanggan atau di konferensi. Seiring waktu, informasi yang kaya dapat tetap terkubur dan tersembunyi dalam modalitas non-teks seperti grafik dan tabel di slide deck ini. Anda dapat menggunakan solusi ini dan kekuatan FM multimodal seperti model Titan Multimodal Embeddings dan LLaVA untuk menemukan informasi baru atau mengungkap perspektif baru tentang konten dalam slide deck.

Kami mendorong Anda untuk mempelajari lebih lanjut dengan menjelajahi Mulai Lompatan Amazon SageMaker, Model Amazon Titan, Amazon Bedrock, dan OpenSearch Service, dan membangun solusi menggunakan contoh implementasi yang disediakan dalam postingan ini.

Nantikan dua postingan tambahan sebagai bagian dari seri ini. Bagian 2 membahas pendekatan lain yang dapat Anda lakukan untuk berbicara dengan dek slide Anda. Pendekatan ini menghasilkan dan menyimpan inferensi LLaVA dan menggunakan inferensi yang disimpan tersebut untuk merespons pertanyaan pengguna. Bagian 3 membandingkan kedua pendekatan tersebut.

Tentang penulis

Amit Arora adalah Arsitek Spesialis AI dan ML di Amazon Web Services, membantu pelanggan perusahaan menggunakan layanan pembelajaran mesin berbasis cloud untuk menskalakan inovasi mereka dengan cepat. Dia juga dosen tambahan di MS data science and analytics program di Georgetown University di Washington DC

Amit Arora adalah Arsitek Spesialis AI dan ML di Amazon Web Services, membantu pelanggan perusahaan menggunakan layanan pembelajaran mesin berbasis cloud untuk menskalakan inovasi mereka dengan cepat. Dia juga dosen tambahan di MS data science and analytics program di Georgetown University di Washington DC

Manju Prasad adalah Arsitek Solusi Senior dalam Akun Strategis di Amazon Web Services. Dia berfokus pada pemberian panduan teknis di berbagai domain, termasuk AI/ML kepada pelanggan M&E terkemuka. Sebelum bergabung dengan AWS, ia merancang dan membangun solusi untuk perusahaan di sektor jasa keuangan dan juga untuk startup.

Manju Prasad adalah Arsitek Solusi Senior dalam Akun Strategis di Amazon Web Services. Dia berfokus pada pemberian panduan teknis di berbagai domain, termasuk AI/ML kepada pelanggan M&E terkemuka. Sebelum bergabung dengan AWS, ia merancang dan membangun solusi untuk perusahaan di sektor jasa keuangan dan juga untuk startup.

Archana Inapudi adalah Arsitek Solusi Senior di AWS yang mendukung pelanggan strategis. Dia memiliki pengalaman lebih dari satu dekade membantu pelanggan merancang dan membangun analisis data dan solusi database. Dia bersemangat menggunakan teknologi untuk memberikan nilai kepada pelanggan dan mencapai hasil bisnis.

Archana Inapudi adalah Arsitek Solusi Senior di AWS yang mendukung pelanggan strategis. Dia memiliki pengalaman lebih dari satu dekade membantu pelanggan merancang dan membangun analisis data dan solusi database. Dia bersemangat menggunakan teknologi untuk memberikan nilai kepada pelanggan dan mencapai hasil bisnis.

Antara Raisa adalah Arsitek Solusi AI dan ML di Amazon Web Services yang mendukung pelanggan strategis yang berbasis di Dallas, Texas. Dia juga memiliki pengalaman bekerja dengan mitra perusahaan besar di AWS, di mana dia bekerja sebagai Arsitek Solusi Sukses Mitra untuk pelanggan asli digital.

Antara Raisa adalah Arsitek Solusi AI dan ML di Amazon Web Services yang mendukung pelanggan strategis yang berbasis di Dallas, Texas. Dia juga memiliki pengalaman bekerja dengan mitra perusahaan besar di AWS, di mana dia bekerja sebagai Arsitek Solusi Sukses Mitra untuk pelanggan asli digital.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/talk-to-your-slide-deck-using-multimodal-foundation-models-hosted-on-amazon-bedrock-and-amazon-sagemaker-part-1/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 1

- 10

- 100

- 13

- 15%

- 16

- 173

- 20

- 2023

- 26

- 29

- 31

- 8

- 9

- a

- Sanggup

- Tentang Kami

- mengakses

- diakses

- Akun

- Mencapai

- Tindakan

- tindakan

- tindakan

- menambahkan

- Tambahan

- tambahan

- kedatangan

- terhadap

- AI

- AI / ML

- Semua

- mengizinkan

- sepanjang

- juga

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- analisis

- dan

- Lain

- menjawab

- menjawab

- jawaban

- Apa pun

- api

- Mendaftar

- pendekatan

- pendekatan

- arsitektur

- ADALAH

- AS

- meminta

- Asisten

- terkait

- At

- audio

- ditambah

- Auth

- tersedia

- menghindari

- AWS

- Formasi AWS Cloud

- berdasarkan

- BE

- menjadi

- Lebih baik

- antara

- Milyar

- tubuh

- membangun

- Bangunan

- dibangun di

- bisnis

- by

- CAN

- kemampuan

- kemampuan

- menangkap

- sel

- berubah

- beban

- Pilih

- memilih

- klien

- kode

- koleksi

- koleksi

- pengumpul

- Kolom

- kombinasi

- menggabungkan

- komentar

- Umum

- Perusahaan

- sebanding

- membandingkan

- dibandingkan

- lengkap

- Lengkap

- komponen

- konsep

- konferensi

- konfigurasi

- dikonfigurasi

- terdiri

- konsul

- mengandung

- berisi

- mengandung

- Konten

- pembuatan konten

- mengubah

- dikonversi

- mengkonversi

- Sesuai

- bisa

- meliputi

- membuat

- dibuat

- menciptakan

- membuat

- penciptaan

- Surat kepercayaan

- pelanggan

- pelanggan

- Dallas

- dasbor

- dasbor

- data

- Data Analytics

- ilmu data

- Basis Data

- dasawarsa

- dek

- Default

- menyampaikan

- memberikan

- mendemonstrasikan

- Tergantung

- menyebarkan

- dikerahkan

- penggelaran

- menyebarkan

- menggambarkan

- Mendesain

- dirancang

- rinci

- terperinci

- rincian

- diagram

- DICT

- MELAKUKAN

- perbedaan

- berbeda

- Difusi

- digital

- Dimensi

- ukuran

- menemukan

- dibahas

- Display

- do

- dokumen

- tidak

- domain

- Download

- download

- selama

- e

- setiap

- elemen

- tertanam

- embedding

- aktif

- diaktifkan

- dikodekan

- mendorong

- akhir

- Titik akhir

- Mesin

- memastikan

- Enterprise

- pelanggan perusahaan

- kesalahan

- Eter (ETH)

- Acara

- peristiwa

- Memeriksa

- contoh

- Kecuali

- pengecualian

- ada

- pengalaman

- Menjelajahi

- memperpanjang

- secara eksternal

- ekstrak

- Keakraban

- Fields

- File

- File

- keuangan

- jasa keuangan

- Menemukan

- berfokus

- mengikuti

- berikut

- berikut

- Untuk

- bentuk

- format

- Prinsip Dasar

- empat

- Gratis

- dari

- penuh

- sepenuhnya

- masa depan

- menghasilkan

- dihasilkan

- menghasilkan

- generasi

- generatif

- AI generatif

- georgetown

- mendapatkan

- GitHub

- akan

- grafik

- bimbingan

- Memiliki

- he

- bermanfaat

- membantu

- di sini

- Tersembunyi

- lebih tinggi

- Hits

- tuan rumah

- host

- tuan

- host

- Seterpercayaapakah Olymp Trade? Kesimpulan

- Namun

- HTML

- http

- HTTPS

- Pusat

- MemelukWajah

- i

- IAM

- identitas

- if

- menggambarkan

- gambar

- gambar

- segera

- melaksanakan

- implementasi

- mengimplementasikan

- in

- memasukkan

- termasuk

- Termasuk

- indeks

- Indeks

- informasi

- Innovation

- inovasi

- memasukkan

- contoh

- contoh

- instruksi

- berinteraksi

- interaksi

- internal

- ke

- investasi

- IT

- bergabung

- jpg

- json

- Juni

- bahasa

- besar

- Latensi

- jalankan

- BELAJAR

- pengetahuan

- penceramah

- 'like'

- LINK

- Llama

- lokal

- menurunkan

- mesin

- Mesin belajar

- membuat

- mengelola

- berhasil

- banyak

- Cocok

- sesuai

- mekanisme

- menu

- Metadata

- metode

- ML

- modalitas

- model

- model

- lebih

- paling

- MS

- beberapa

- nama

- asli

- Arahkan

- Navigasi

- Perlu

- New

- None

- mencatat

- buku catatan

- laptop

- pemberitahuan

- sekarang

- bernomor

- nomor

- objek

- of

- menawarkan

- on

- Sesuai Permintaan

- ONE

- hanya

- Buka

- open source

- or

- organisasi

- OS

- kami

- di luar

- hasil

- keluaran

- lebih

- pane

- parameter

- parameter

- bagian

- partikel

- pasangan

- rekan

- bagian

- Lulus

- bergairah

- path

- untuk

- melakukan

- prestasi

- dilakukan

- Izin

- perspektif

- tahap

- Fisika

- Film

- pipa saluran

- plato

- Kecerdasan Data Plato

- Data Plato

- Kebijakan

- Pos

- Posts

- berpotensi

- kekuasaan

- kuat

- Predictor

- menyajikan

- disajikan

- sebelumnya

- Sebelumnya

- proses

- diproses

- proses

- pengolahan

- program

- properties

- memberikan

- disediakan

- menyediakan

- menyediakan

- menempatkan

- Quark

- query

- pertanyaan

- pertanyaan

- Pertanyaan

- Cepat

- lap

- jarak

- cepat

- Bacaan

- siap

- dunia nyata

- diterima

- direferensikan

- wilayah

- terkait

- relevan

- tinggal

- menggantikan

- permintaan

- wajib

- Sumber

- Menanggapi

- tanggapan

- tanggapan

- mengakibatkan

- dihasilkan

- Hasil

- pengambilan

- kembali

- Kaya

- peran

- Run

- berjalan

- pembuat bijak

- Inferensi SageMaker

- sama

- mengatakan

- Skala

- Ilmu

- screenshot

- naskah

- Pencarian

- Kedua

- Bagian

- bagian

- sektor

- melihat

- memilih

- memilih

- senior

- Urutan

- Seri

- Tanpa Server

- melayani

- layanan

- Layanan

- Sidang

- set

- pengaturan

- pengaturan

- Share

- dia

- harus

- ditunjukkan

- Pertunjukkan

- mirip

- Sederhana

- hanya

- tunggal

- Ukuran

- Meluncur

- Slides

- potongan

- So

- larutan

- Solusi

- beberapa

- sumber

- spesialis

- tertentu

- ditentukan

- stabil

- tumpukan

- startup

- Negara

- Status

- Langkah

- Tangga

- penyimpanan

- menyimpan

- tersimpan

- toko

- Strategis

- Tali

- selanjutnya

- sukses

- berhasil

- seperti itu

- Puncak

- pendukung

- yakin

- tabel

- Mengambil

- Berbicara

- tugas

- Teknis

- Teknologi

- Template

- template

- uji

- tes

- texas

- teks

- tekstual

- bahwa

- Grafik

- informasi

- mereka

- kemudian

- Ini

- ini

- itu

- keluaran

- waktu

- titan

- berjudul

- untuk

- hari ini

- bersama

- toronto

- secara tradisional

- melintasi

- memicu

- memicu

- benar

- mencoba

- MENGHIDUPKAN

- dua

- mengetik

- menemukan

- memahami

- pemahaman

- universitas

- Memperbarui

- upload

- URL

- menggunakan

- bekas

- Pengguna

- kegunaan

- menggunakan

- nilai

- variabel

- variasi

- versi

- melalui

- Video

- View

- penglihatan

- visual

- Washington

- cara

- we

- jaringan

- layanan web

- BAIK

- Apa

- Apa itu

- yang

- sementara

- akan

- dengan

- dalam

- bekerja

- alur kerja

- kerja

- kamu

- Anda

- zephyrnet.dll