Kita semua ingin melihat nilai-nilai kemanusiaan ideal kita tercermin dalam teknologi kita. Kami berharap teknologi seperti kecerdasan buatan (AI) tidak berbohong kepada kita, tidak melakukan diskriminasi, dan aman untuk digunakan oleh kita dan anak-anak kita. Namun banyak pembuat AI saat ini menghadapi reaksi balik atas bias, ketidakakuratan, dan praktik data bermasalah yang terungkap dalam model mereka. Masalah-masalah ini memerlukan lebih dari sekadar solusi teknis, algoritmik, atau berbasis AI. Pada kenyataannya, diperlukan pendekatan sosio-teknis yang holistik.

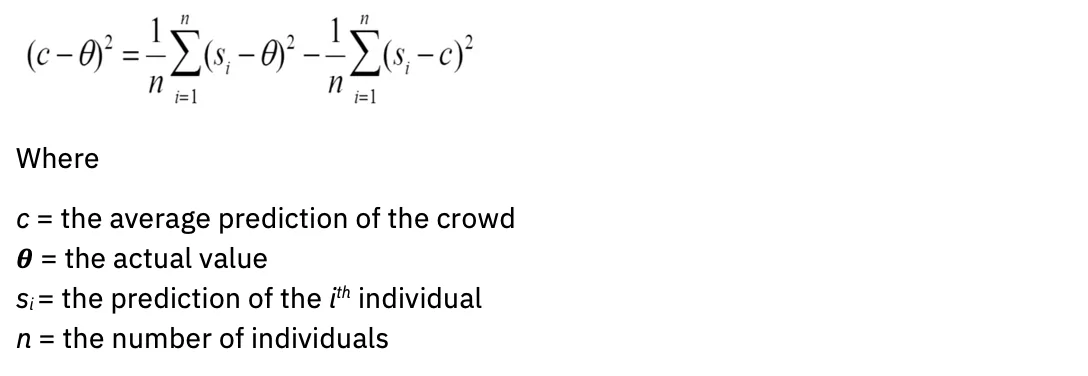

Matematika menunjukkan kebenaran yang kuat

Semua model prediktif, termasuk AI, akan lebih akurat jika menggabungkan beragam kecerdasan dan pengalaman manusia. Ini bukanlah sebuah opini; itu mempunyai validitas empiris. Pertimbangkan teorema prediksi keanekaragaman. Sederhananya, jika keberagaman dalam suatu kelompok besar, maka kesalahan yang dilakukan oleh kelompok tersebut akan kecil – hal ini mendukung konsep “kebijaksanaan kelompok”. Dalam sebuah penelitian yang berpengaruh, ditunjukkan bahwa beragam kelompok pemecah masalah berkemampuan rendah dapat mengungguli kelompok pemecah masalah berkemampuan tinggi (Hong & Halaman, 2004).

Dalam bahasa matematika: semakin luas variansnya, semakin standar rata-ratanya. Persamaannya terlihat seperti ini:

A pelajaran lanjutan memberikan lebih banyak perhitungan yang menyempurnakan definisi statistik dari kelompok yang bijaksana, termasuk ketidaktahuan terhadap prediksi anggota lain dan penyertaan mereka yang memilikinya berbeda secara maksimal (berkorelasi negatif) prediksi atau penilaian. Jadi, bukan hanya volume, namun keragaman yang meningkatkan prediksi. Bagaimana wawasan ini dapat memengaruhi evaluasi model AI?

Akurasi model (dalam).

Mengutip pepatah umum, semua model salah. Hal ini berlaku di bidang statistik, sains, dan AI. Model yang dibuat dengan kurangnya keahlian domain dapat menyebabkan keliru Output.

Saat ini, sekelompok kecil orang yang homogen menentukan data apa yang akan digunakan untuk melatih model AI generatif, yang diambil dari sumber yang sangat mewakili bahasa Inggris. “Untuk sebagian besar dari 6,000 bahasa di dunia, data teks yang tersedia tidak cukup untuk melatih model dasar skala besar” (dari “Tentang Peluang dan Risiko Model Fondasi,” Bomasani dkk., 2022).

Selain itu, modelnya sendiri dibuat dari arsitektur terbatas: “Hampir semua model NLP canggih kini diadaptasi dari salah satu dari beberapa model dasar, seperti BERT, RoBERTa, BART, T5, dll. Sementara homogenisasi ini menghasilkan leverage yang sangat tinggi (perbaikan apa pun pada model fondasi dapat memberikan manfaat langsung di seluruh NLP), ini juga merupakan liabilitas; semua sistem AI mungkin mewarisi bias bermasalah yang sama dari beberapa model dasar (Bomasani dkk.) "

Agar AI generatif dapat lebih mencerminkan beragam komunitas yang dilayaninya, data manusia yang jauh lebih beragam harus direpresentasikan dalam model.

Mengevaluasi keakuratan model berjalan seiring dengan mengevaluasi bias. Kita harus bertanya, apa maksud dari model tersebut dan untuk siapa model tersebut dioptimalkan? Misalnya, siapa yang paling diuntungkan dari algoritma rekomendasi konten dan algoritma mesin pencari. Para pemangku kepentingan mungkin mempunyai kepentingan dan tujuan yang sangat berbeda. Algoritma dan model memerlukan target atau proksi untuk kesalahan Bayes: kesalahan minimum yang harus diperbaiki oleh model. Proksi ini sering kali berupa orang, seperti pakar materi dengan keahlian domain.

Tantangan yang sangat manusiawi: Menilai risiko sebelum membuat model pengadaan atau pengembangan

Peraturan dan rencana aksi AI yang muncul semakin menekankan pentingnya formulir penilaian dampak algoritmik. Tujuan dari formulir ini adalah untuk mendapatkan informasi penting tentang model AI sehingga tim tata kelola dapat menilai dan mengatasi risikonya sebelum menerapkannya. Pertanyaan umum meliputi:

- Apa kasus penggunaan model Anda?

- Apa risiko dari dampak yang berbeda?

- Bagaimana Anda menilai keadilan?

- Bagaimana Anda membuat model Anda dapat dijelaskan?

Meskipun dirancang dengan niat baik, masalahnya adalah sebagian besar pemilik model AI tidak memahami cara mengevaluasi risiko untuk kasus penggunaan mereka. Pengulangan yang umum mungkin adalah, “Bagaimana model saya bisa menjadi tidak adil jika model saya tidak mengumpulkan informasi identitas pribadi (PII)?” Akibatnya, formulir-formulir tersebut jarang dilengkapi dengan ketelitian yang diperlukan agar sistem tata kelola dapat menandai faktor-faktor risiko secara akurat.

Dengan demikian, sifat sosio-teknis dari solusi tersebut digarisbawahi. Pemilik model—seorang individu—tidak bisa begitu saja diberikan daftar kotak centang untuk mengevaluasi apakah kasus penggunaannya akan menimbulkan kerugian. Sebaliknya, yang dibutuhkan adalah sekelompok orang dengan pengalaman hidup yang sangat beragam, berkumpul dalam komunitas yang menawarkan keamanan psikologis untuk melakukan diskusi yang sulit mengenai dampak yang berbeda-beda.

Menyambut perspektif yang lebih luas untuk AI yang dapat dipercaya

IBM® meyakini penerapan pendekatan “client zero”, yaitu menerapkan rekomendasi dan sistem yang akan dibuat untuk kliennya dalam bidang konsultasi dan solusi berbasis produk. Pendekatan ini meluas ke praktik etis, itulah sebabnya IBM menciptakan Pusat Keunggulan AI (COE) yang Dapat Dipercaya.

Seperti dijelaskan di atas, keragaman pengalaman dan keahlian sangat penting untuk mengevaluasi dampak AI dengan tepat. Namun prospek untuk berpartisipasi dalam Center of Excellence bisa jadi menakutkan jika perusahaan tersebut penuh dengan inovator AI, pakar, dan insinyur terkemuka, sehingga menumbuhkan komunitas yang memiliki keamanan psikologis sangat diperlukan. IBM mengkomunikasikan hal ini dengan jelas dengan mengatakan, “Tertarik dengan AI? Tertarik dengan etika AI? Anda dapat duduk di meja ini.”

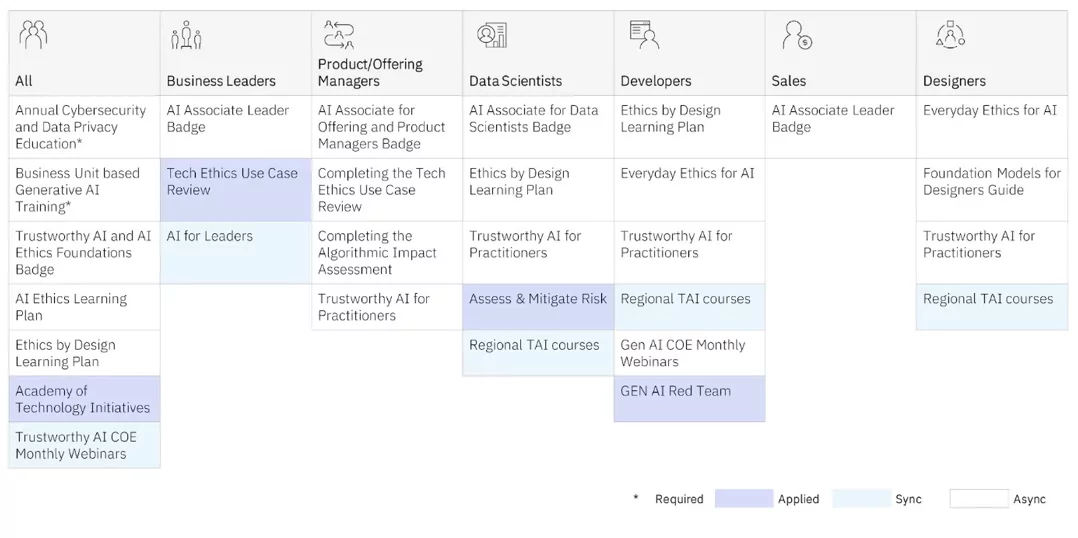

COE menawarkan pelatihan etika AI kepada praktisi di setiap tingkatan. Program pembelajaran sinkron (guru dan siswa di kelas) dan program asinkron (panduan mandiri) ditawarkan.

Tapi itu COE terapan pelatihan yang memberikan para praktisi kami wawasan terdalam, saat mereka bekerja dengan tim global, beragam, dan multidisiplin dalam proyek nyata untuk lebih memahami dampak yang berbeda. Mereka juga memanfaatkan kerangka pemikiran desain yang dimiliki IBM Desain untuk AI kelompok menggunakan secara internal dan dengan klien untuk menilai dampak yang tidak diinginkan dari model AI, sehingga mereka yang sering terpinggirkan selalu diingat. (Lihat karya Sylvia Duckworth Roda Kekuasaan dan Hak Istimewa sebagai contoh bagaimana karakteristik pribadi bersinggungan dengan hak istimewa atau marginalisasi orang.) IBM juga menyumbangkan banyak kerangka kerja tersebut kepada komunitas sumber terbuka Desain Secara Etis.

Berikut adalah beberapa laporan yang diterbitkan IBM secara publik mengenai proyek-proyek ini:

Alat tata kelola model AI otomatis diperlukan untuk mendapatkan wawasan penting tentang kinerja model AI Anda. Namun perlu diingat, menangkap risiko jauh sebelum model Anda dikembangkan dan diproduksi adalah hal yang optimal. Dengan menciptakan komunitas yang terdiri dari praktisi multidisiplin dan beragam yang menawarkan ruang aman bagi orang-orang untuk berdiskusi mengenai dampak yang berbeda-beda, Anda dapat memulai perjalanan Anda dalam mengoperasionalkan prinsip-prinsip Anda dan mengembangkan AI secara bertanggung jawab.

Dalam praktiknya, saat Anda merekrut praktisi AI, pertimbangkan bahwa lebih dari 70% upaya dalam membuat model adalah mengumpulkan data yang benar. Anda ingin mempekerjakan orang-orang yang tahu cara mengumpulkan data yang representatif dan juga dikumpulkan dengan persetujuan. Anda juga ingin orang-orang yang berpengetahuan bekerja sama dengan pakar domain untuk memastikan bahwa mereka memiliki pendekatan yang tepat. Memastikan para praktisi ini memiliki kecerdasan emosional untuk menghadapi tantangan dalam melakukan kurasi AI secara bertanggung jawab dengan kerendahan hati dan kebijaksanaan adalah kuncinya. Kita harus sungguh-sungguh mempelajari cara mengenali bagaimana dan kapan sistem AI dapat memperburuk kesenjangan, sama seperti sistem tersebut dapat meningkatkan kecerdasan manusia.

Temukan kembali cara bisnis Anda bekerja dengan AI

Apakah artikel ini berguna?

YesTidak

Lebih banyak dari kecerdasan buatan

Buletin IBM

Dapatkan buletin dan pembaruan topik kami yang menyampaikan kepemimpinan pemikiran terkini dan wawasan tentang tren yang sedang berkembang.

Berlangganan sekarang

Lebih banyak buletin

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://www.ibm.com/blog/why-we-need-diverse-multidisciplinary-coes-for-model-risk/

- :memiliki

- :adalah

- :bukan

- :Di mana

- $NAIK

- 000

- 1

- 16

- 2022

- 2024

- 23

- 25

- 28

- 29

- 30

- 300

- 32

- 39

- 40

- 400

- 65

- 7

- 9

- a

- kemampuan

- Tentang Kami

- atas

- AC

- mempercepat

- ketepatan

- tepat

- akurat

- di seluruh

- Tindakan

- disesuaikan

- alamat

- mengakui

- mengambil

- pengiklanan

- nasihat

- mempengaruhi

- agen

- AI

- Model AI

- Sistem AI

- tujuan

- AL

- algoritmik

- algoritma

- Semua

- juga

- selalu

- amp

- an

- analisis

- dan

- Apa pun

- Aplikasi

- aplikasi

- pendekatan

- ADALAH

- daerah

- artikel

- buatan

- kecerdasan buatan

- Kecerdasan buatan (AI)

- AS

- meminta

- menilai

- Menilai

- penilaian

- asisten

- membantu

- At

- audio

- menambah

- penulis

- tersedia

- menghindari

- kembali

- balancing

- BE

- menjadi

- sebelum

- mulai

- makhluk

- percaya

- Manfaat

- Lebih baik

- Luar

- prasangka

- bias

- Blog

- blog

- Biru

- boston

- kedua

- lebih luas

- Bangunan

- bisnis

- fungsi bisnis

- bisnis

- tapi

- tombol

- by

- CAN

- menangkap

- Menangkap

- karbon

- kartu

- Kartu-kartu

- yang

- kasus

- KUCING

- Kategori

- Menyebabkan

- pusat

- Pusat Keunggulan

- pusat

- tertentu

- menantang

- karakteristik

- chatbots

- memeriksa

- anak

- anak-anak

- lingkaran

- CIS

- kelas

- Jelas

- klien

- rapat

- awan

- warna

- kombinasi

- kedatangan

- Umum

- Masyarakat

- masyarakat

- Perusahaan

- perusahaan

- Lengkap

- konsep

- persetujuan

- Karena itu

- Mempertimbangkan

- konsultasi

- Wadah

- terus

- percakapan

- Core

- benar

- berkorelasi

- Biaya

- bisa

- dibuat

- membuat

- pencipta

- kritis

- orang banyak

- CSS

- kurasi

- Sekarang

- adat

- pelanggan

- pengalaman pelanggan

- pelanggan

- data

- Tanggal

- keputusan

- terdalam

- Default

- definisi

- menyampaikan

- menunjukkan

- penggelaran

- deskripsi

- Mendesain

- desain pemikiran

- dirancang

- Menentukan

- mengembangkan

- dikembangkan

- berbeda

- sulit

- digital

- Transformasi digital

- berbeda

- Terkemuka

- beberapa

- Keragaman

- do

- domain

- disumbangkan

- ditarik

- mendorong

- E&T

- efek

- usaha

- menghilangkan

- embedding

- merangkul

- muncul

- karyawan

- aktif

- menarik

- Mesin

- Insinyur

- Inggris

- cukup

- memastikan

- Enter

- kesalahan

- dll

- Eter (ETH)

- etis

- etika

- mengevaluasi

- mengevaluasi

- evaluasi

- Bahkan

- Setiap

- di mana-mana

- memperuncing

- contoh

- contoh

- Keunggulan

- Exit

- mengharapkan

- pengalaman

- Pengalaman

- ahli

- keahlian

- ahli

- menjelaskan

- terkena

- Meluas

- sangat

- facebook utusan

- memudahkan

- menghadapi

- faktor

- keadilan

- palsu

- jauh

- FAST

- beberapa

- Menemukan

- Fokus

- mengikuti

- berikut

- font

- Untuk

- garis terdepan

- bentuk

- Prinsip Dasar

- kerangka

- dari

- depan

- fungsi

- mengumpulkan

- dikumpulkan

- pertemuan

- generatif

- AI generatif

- generator

- mendapatkan

- diberikan

- memberikan

- Aksi

- tujuan

- Anda

- Pergi

- baik

- pemerintahan

- Tatabahasa

- sangat

- kisi

- Kelompok

- Grup

- Pertumbuhan

- membimbing

- membahayakan

- Memiliki

- Kepala

- mendengar

- tinggi

- membantu

- bermanfaat

- High

- dia

- menyewa

- Mempekerjakan

- -nya

- memegang

- holistik

- Beranda

- Seterpercayaapakah Olymp Trade? Kesimpulan

- How To

- HTTPS

- manusia

- kecerdasan manusia

- kerendahan hati

- Hibrida

- Awan hibrida

- i

- SAYA AKAN

- IBM

- ICO

- ICON

- ideal

- diidentifikasi

- if

- Ketidaktahuan

- gambar

- Segera

- Dampak

- dampak

- melaksanakan

- mengimplementasikan

- pentingnya

- penting

- memperbaiki

- perbaikan

- meningkatkan

- in

- memasukkan

- Termasuk

- penyertaan

- menggabungkan

- makin

- inkremental

- indeks

- industri

- Berpengaruh

- informasi

- Innovation

- inovator

- memasukkan

- wawasan

- wawasan

- segera

- sebagai gantinya

- Lembaga

- asuransi

- Perusahaan asuransi

- Intelijen

- Cerdas

- maksud

- Disengaja

- niat

- tertarik

- kepentingan

- internal

- memotong

- intervensi

- mengintimidasi

- hakiki

- adalah n

- isu

- masalah

- IT

- NYA

- Januari

- ikut

- Bergabung dengan kami

- perjalanan

- jpg

- hanya

- pemeliharaan

- kunci

- Tahu

- dikenal

- Kekurangan

- bahasa

- Bahasa

- besar

- besar-besaran

- Terbaru

- memimpin

- pemimpin

- Kepemimpinan

- pengetahuan

- membiarkan

- Tingkat

- Leverage

- kewajiban

- berbohong

- 'like'

- Terbatas

- Daftar

- lokal

- Lokal

- TERLIHAT

- membuat

- Membuat

- pengelolaan

- panduan

- banyak

- matematika

- matematis

- hal

- max-width

- Mungkin..

- me

- berarti

- Pelajari

- kurir

- mungkin

- menit

- keberatan

- minimum

- menit

- mobil

- model

- model

- modernisasi

- lebih

- paling

- pindah

- banyak

- multidisiplin

- harus

- my

- Alam

- Navigasi

- perlu

- Perlu

- dibutuhkan

- kebutuhan

- negatif

- New

- produk baru

- newsletter

- nLP

- tidak

- mencatat

- tidak ada

- sekarang

- banyak sekali

- of

- lepas

- menawarkan

- ditawarkan

- Penawaran

- sering

- on

- ONE

- open source

- Pendapat

- Peluang

- optimal

- dioptimalkan

- or

- organisasi

- Lainnya

- kami

- Mengungguli

- output

- lebih

- sendiri

- pemilik

- halaman

- berpartisipasi

- lulus

- Konsultan Ahli

- melakukan

- orang

- pribadi

- Sendiri

- perspektif

- PHP

- saleh

- rencana

- plato

- Kecerdasan Data Plato

- Data Plato

- Plugin

- kebijaksanaan

- posisi

- Pos

- potensi

- klien potensial

- kekuasaan

- kuat

- praktek

- praktek

- ramalan

- Prediksi

- prediktif

- primer

- prinsip-prinsip

- Prioritaskan

- hak istimewa

- Masalah

- pembelian

- menghasilkan

- Produksi

- produktifitas

- Produk

- program

- memprojeksikan

- tepat

- prospek

- disediakan

- menyediakan

- proxy

- wakil

- psikologis

- di depan umum

- diterbitkan

- menempatkan

- Pertanyaan

- segera

- mengutip

- jarang

- Kesiapan

- Bacaan

- nyata

- Kenyataan

- mengenali

- rekomendasi

- mengurangi

- memperhalus

- mencerminkan

- tercermin

- peraturan

- laporan

- wakil

- diwakili

- permintaan

- membutuhkan

- wajib

- penelitian

- menanggapi

- tanggung jawab

- bertanggung jawab

- responsif

- pendapatan

- Pertumbuhan pendapatan

- benar

- Risiko

- faktor risiko

- risiko

- jalan

- robot

- aman

- Safety/keselamatan

- Tersebut

- sama

- mengatakan

- Skala

- skala

- Ilmu

- Layar

- script

- Pencarian

- mesin pencari

- aman

- melihat

- SEO

- melayani

- pengaturan

- harus

- ditunjukkan

- hanya

- situs web

- kendur

- kecil

- pintar

- Pembicara Cerdas

- SMS

- So

- larutan

- Solusi

- beberapa

- sumber

- Space

- speaker

- Disponsori

- kotak

- stakeholder

- standar

- awal

- state-of-the-art

- statistik

- statistika

- Siswa

- Belajar

- subyek

- berlangganan

- seperti itu

- mendukung

- pendukung

- SVG

- sistem

- T

- tabel

- pengambilan

- target

- guru

- tim

- Teknis

- Teknologi

- tersier

- teks

- dari

- Terima kasih

- bahwa

- Grafik

- Dunia

- mereka

- Mereka

- tema

- diri

- Ini

- mereka

- berpikir

- Pikir

- ini

- itu

- pikir

- pemikiran kepemimpinan

- tiga

- Melalui

- waktu

- Judul

- untuk

- bersama

- alat

- puncak

- tema

- sulit

- Pelatihan VE

- Pelatihan

- Transformasi

- Tren

- benar

- terpercaya

- dua

- mengetik

- khas

- memahami

- tidak adil

- unik

- unlocking

- Pembaruan

- atas

- URL

- us

- menggunakan

- gunakan case

- kegunaan

- Memanfaatkan

- nilai

- Nilai - Nilai

- variasi

- bervariasi

- sangat

- maya

- volume

- W

- ingin

- adalah

- we

- BAIK

- Apa

- Apa itu

- ketika

- apakah

- yang

- sementara

- SIAPA

- siapa

- mengapa

- sangat

- lebih luas

- akan

- kebijaksanaan

- BIJAKSANA

- dengan

- Word

- WordPress

- Kerja

- bekerja

- dunia

- akan

- tertulis

- Salah

- namun

- kamu

- Anda

- zephyrnet.dll