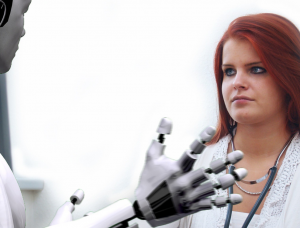

A mesterséges intelligencia (AI) számos iparágat forradalmasított, számos előnnyel és lehetőséggel. Aggályok merültek fel azonban azzal kapcsolatban, hogy a mesterséges intelligencia képes-e állandósítani a diszkriminációt és az elfogultságokat. Ez a cikk a mesterséges intelligencia megkülönböztetésének témáját tárja fel, rávilágítva az AI-rendszerekbe ágyazott torzítások azonosításának és kezelésének kihívásaira. Az iparági bennfentesek kételyeiket fejezik ki az AI morális és etikai vonatkozásait illetően, a félretájékoztatás, az algoritmusok torzítása és a félrevezető tartalom generálása miatti aggodalmakra hivatkozva. A mesterséges intelligencia körüli viták felerősödésével egyre nagyobb az igény az átláthatóság, az elszámoltathatóság és az alapvető jogok védelmét biztosító értelmes szabályozásra.

A pénzügyi iparágak kihívásai az AI-val

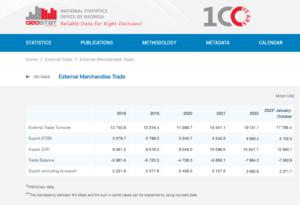

Nabil Manji, a Worldpay by FIS kripto- és web3 részlegének vezetője szerint az AI-termékek hatékonysága nagymértékben függ a képzéshez használt forrásanyag minőségétől. A CNBC-nek adott interjújában Manji kifejtette, hogy az AI teljesítményéhez két fő tényező járul hozzá: az adatok, amelyekhez hozzáfér, és a nagy nyelvi modell képességei.

Az adatok jelentőségének szemléltetésére Manji megemlítette, hogy a Reddithez hasonló vállalatok nyilvánosan korlátozzák az adatlekopást, és fizetést követelnek meg a hozzáférésért. A pénzügyi szolgáltatási szektorban kiemelte a különböző nyelveken és formátumokban megjelenő töredezett adatrendszerek kihívását. A konszolidáció és harmonizáció hiánya korlátozza az AI-vezérelt termékek hatékonyságát, különösen a szabványos és modernizált adatinfrastruktúrával rendelkező iparágakkal összehasonlítva.

Manji szerint a blokklánc vagy az elosztott főkönyvi technológia alkalmazása potenciális megoldást kínálhat a probléma kezelésére. Ez az innovatív megközelítés fokozott átláthatóságot biztosít a hagyományos bankok bonyolult rendszereiben tárolt töredezett adatok tekintetében. Ugyanakkor elismerte, hogy a bankok erősen szabályozott és lassan mozgó természete akadályozhatja az új mesterséges intelligencia eszközök gyors átvételét, ellentétben az olyan agilisabb technológiai társaságokkal, mint a Microsoft és a Google, amelyek az elmúlt néhány évben az innováció előmozdításában élen jártak. évtizedekben.

Ezeket a tényezőket figyelembe véve nyilvánvalóvá válik, hogy a pénzügyi ágazat egyedülálló kihívásokkal néz szembe az AI kihasználása terén az adatintegráció összetettsége és a bankszektor velejárója miatt.

Rumman Chowdhury, a Twitter gépi tanulási etikájával, átláthatóságával és elszámoltathatóságával foglalkozó egykori vezetője szerint a hitelezés figyelemre méltó példa arra, hogy az AI-rendszerek elfogultsága milyen hátrányosan érintheti a marginalizált közösségeket. Egy amszterdami panelbeszélgetésen Chowdhury kiemelte a chicagói „redlining” történelmi gyakorlatát az 1930-as években. A Redlining a túlnyomórészt afroamerikai városrészeknek nyújtott kölcsönök megtagadását jelentette a faji demográfiai adatok alapján.

Chowdhury kifejtette, hogy bár a modern algoritmusok nem feltétlenül tartalmazzák kifejezetten a rasszt adatpontként, a torzítások továbbra is implicit módon kódolhatók. A körzetek és egyének hitelezési célú kockázatosságának felmérésére szolgáló algoritmusok kidolgozásakor a torzításokat tartalmazó történelmi adatok akaratlanul is állandósíthatják a diszkriminációt.

Angle Bush, a fekete nők mesterséges intelligenciában mögött álló látnoka kiemelte annak fontosságát, hogy elismerjék a történelmi adatokba ágyazott torzítások reprodukálásával kapcsolatos veszélyeket, amikor mesterséges intelligencia-rendszereket alkalmaznak a hitel jóváhagyására vonatkozó döntések meghozatalához. Egy ilyen gyakorlat a marginalizált közösségek hitelkérelmének automatikus elutasításához vezethet, ami állandósítja a faji vagy nemi egyenlőtlenségeket.

Frost Li, egy tapasztalt AI fejlesztő rámutatott a személyre szabás kihívásaira AI integráció. Az „alapfunkciók” kiválasztása a mesterséges intelligenciamodellek betanításához néha nem kapcsolódó tényezőket is magában foglalhat, amelyek elfogult eredményekhez vezethetnek. Li példát mutatott be arra, hogy a külföldieket megcélzó fintech startupok hogyan szembesülhetnek más hitelbírálati kritériumokkal, mint a helyi bankok, amelyek jobban ismerik a helyi iskolákat és közösségeket.

Niklas Guske, a Taktile, a fintech-ek döntéshozatalának automatizálására szakosodott startup vezérigazgatója kifejtette, hogy a generatív mesterséges intelligencia általában nem használatos hitelpontszámok vagy fogyasztói kockázatok értékelésére. Éppen ellenkezőleg, az erőssége a strukturálatlan adatok, például a szöveges fájlok előfeldolgozásában rejlik, hogy javítsa a hagyományos biztosítási modellek adatminőségét.

Összefoglalva, a mesterséges intelligencia hitelnyújtásban és pénzügyi szolgáltatásokban való használata aggályokat vet fel az elfogultság és a diszkrimináció miatt. Az adatokba ágyazott történelmi torzítások és a nem releváns jellemzők kiválasztása a mesterséges intelligencia képzése során tisztességtelen eredményekhez vezethet. Kulcsfontosságú, hogy a bankok és pénzintézetek felismerjék és kezeljék ezeket a problémákat, hogy megakadályozzák a diszkrimináció véletlenszerű állandósulását az AI-megoldások megvalósítása során.

Az AI-diszkrimináció bizonyítása

A mesterséges intelligencia alapú diszkrimináció bizonyítása kihívást jelenthet, amint azt olyan példák is hangsúlyozzák, mint például az Apple és a Goldman Sachs esete. A New York-i állam pénzügyi szolgáltatások minisztériuma alátámasztó bizonyítékok hiányára hivatkozva visszautasította a vádakat, amelyek szerint alacsonyabb korlátokat szabtak volna a nők számára az Apple Cardra.

Kim Smouter, az Európai Rasszizmus Elleni Hálózat igazgatója rámutat, hogy a mesterséges intelligencia tömeges elterjedése átláthatatlanná teszi a döntéshozatali folyamatokat, megnehezítve az egyének számára a diszkrimináció azonosítását és kezelését.

Smouter elmagyarázza, hogy az egyének gyakran korlátozott ismeretekkel rendelkeznek az AI-rendszerek működéséről, így nehéz felismerni a diszkrimináció vagy a rendszerszintű torzítás eseteit. Még bonyolultabbá válik, ha a diszkrimináció egy szélesebb, több egyént érintő probléma része. Smouter a holland gyermekjóléti botrányra hivatkozik, ahol az intézményi elfogultság miatt sok segélykérelmet tévesen csalónak minősítettek. Az ilyen rendellenességek felfedezése kihívást jelent, és a jogorvoslat megszerzése nehéz és időigényes lehet, ami jelentős és néha visszafordíthatatlan károkhoz vezethet.

Ezek a példák szemléltetik a mesterséges intelligencia alapú megkülönböztetés alátámasztásának és a jogorvoslatok megszerzésének nehézségeit, amikor ilyen megkülönböztetés történik. A mesterséges intelligencia rendszerek összetettsége és a döntéshozatali folyamatok átláthatóságának hiánya kihívást jelent az egyének számára, hogy felismerjék és hatékonyan kezeljék a diszkrimináció eseteit.

Chowdhury szerint égető szükség van egy, az Egyesült Nemzetek Szervezetéhez hasonló globális szabályozó testületre, amely kezelni tudja az MI-vel kapcsolatos kockázatokat. Míg a mesterséges intelligencia figyelemreméltó innovációt mutatott, a technológusok és etikusok aggodalmakat vetnek fel az erkölcsi és etikai vonatkozásait illetően. Ezek az aggodalmak olyan kérdéseket foglalnak magukban, mint a félretájékoztatás, az AI-algoritmusokba ágyazott faji és nemi torzítás, valamint a félrevezető tartalom olyan eszközök általi generálása, mint a ChatGPT.

Chowdhury aggodalmát fejezi ki amiatt, hogy belép egy olyan poszt-igazság világba, ahol az online információk, beleértve a szöveget, a videót és a hangot, megbízhatatlanná válnak a generatív mesterséges intelligencia miatt. Ez kérdéseket vet fel azzal kapcsolatban, hogyan tudjuk biztosítani az információk integritását, és hogyan támaszkodhatunk rájuk a megalapozott döntések meghozatalakor. Az Európai Unió mesterséges intelligenciájáról szóló törvényre példaként, a mesterséges intelligencia érdemi szabályozása jelenleg kulcsfontosságú. Mindazonáltal aggodalomra ad okot a szabályozási javaslatok hatálybalépéséhez szükséges hosszú idő, ami esetleg késlelteti a szükséges intézkedéseket.

Smouter hangsúlyozza a nagyobb átláthatóság és elszámoltathatóság szükségességét az AI-algoritmusokban. Ez magában foglalja az algoritmusok érthetőbbé tételét a nem szakértők számára, a tesztek elvégzését és az eredmények közzétételét, a független panaszkezelési folyamatok létrehozását, az időszakos auditálást és jelentéskészítést, valamint a rasszista közösségek bevonását a technológia tervezésébe és telepítésébe. A mesterséges intelligencia törvény végrehajtása, amely alapvető jogokat szem előtt tart, és olyan fogalmakat vezet be, mint a jogorvoslat, várhatóan körülbelül két év múlva kezdődik meg. Ennek az ütemtervnek a csökkentése előnyös lenne az átláthatóság és az elszámoltathatóság fenntartása érdekében, mint az innováció szerves részeként.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Autóipar / elektromos járművek, Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- BlockOffsets. A környezetvédelmi ellentételezési tulajdon korszerűsítése. Hozzáférés itt.

- Forrás: https://www.forexnewsnow.com/fintech/the-urgency-of-addressing-ai-discrimination-transparency-accountability-and-regulatory-timelines/

- :van

- :is

- :nem

- :ahol

- a

- képesség

- Rólunk

- hozzáférés

- felelősségre vonhatóság

- elismerte

- törvény

- cselekvések

- cím

- címzés

- elfogadja

- előnyös

- hátrányosan

- érint

- afrikai

- ellen

- agilis

- AI

- AI törvény

- AI rendszerek

- AI képzés

- algoritmusok

- Állítások

- Bár

- Amerikai

- Amszterdam

- an

- és a

- várható

- Apple

- Apple kártya

- alkalmazások

- megközelítés

- jóváhagyás

- körülbelül

- VANNAK

- cikkben

- mesterséges

- mesterséges intelligencia

- AS

- szempontok

- értékeli

- értékelés

- társult

- At

- hang-

- ellenőrzések

- Automatikus

- automatizálás

- Banking

- bankszektor

- Banks

- alapján

- BE

- válik

- válik

- óta

- mögött

- haszon

- Előnyök

- előítélet

- elfogult

- torzítások

- Fekete

- blockchain

- test

- Bring

- tágabb

- by

- hívás

- TUD

- képességek

- kártya

- eset

- kihívás

- kihívások

- kihívást

- ChatGPT

- Chicago

- gyermek

- követelések

- tisztázni

- CNBC

- Közösségek

- Companies

- képest

- panasz

- bonyolult

- bonyodalmak

- bonyolultság

- fogalmak

- aggodalmak

- vezető

- konszolidáció

- Fogyasztók

- tartalmaz

- tartalom

- ellentétes

- contribuer

- hagyományos

- turbékol

- létrehozása

- hitel

- kritériumok

- kritikus

- crypto

- veszélyeket

- dátum

- adat-infrastruktúra

- adatintegráció

- adatminőség

- Viták

- évtizedek

- Döntéshozatal

- határozatok

- Demográfiai

- osztály

- függ

- bevetés

- Design

- Fejlesztő

- fejlesztése

- különböző

- nehéz

- nehézségek

- Igazgató

- felfedezés

- Megkülönböztetés

- vita

- megosztott

- Elosztott könyvtár

- elosztott főkönyvi technológia

- vezetés

- két

- alatt

- Holland

- Hatékony

- hatékonyan

- hatékonyság

- beágyazott

- alakult

- hangsúlyozza

- felölel

- végrehajtás

- növelése

- fokozott

- biztosítására

- belépés

- különösen

- létrehozó

- etikai

- etika

- európai

- Még

- bizonyíték

- nyilvánvaló

- példa

- példák

- tapasztalt

- magyarázható

- Elmagyarázza

- feltárja

- expressz

- Arc

- arcok

- tényezők

- ismerős

- Jellemzők

- kevés

- Fájlok

- pénzügyi

- pénzügyi iparágak

- Pénzintézetek

- pénzügyi szolgáltatások

- FINTECH

- fintech startupok

- fintechs

- FIS

- A

- Forefront

- Korábbi

- töredezett

- csaló

- ból ből

- alapvető

- nem

- generáció

- nemző

- Generatív AI

- Globális

- Goldman

- Goldman Sachs

- nagyobb

- Növekvő

- kárt

- Legyen

- he

- fej

- súlyosan

- Kiemelt

- nagyon

- történeti

- Hogyan

- azonban

- HTTPS

- azonosítani

- azonosító

- végrehajtási

- következményei

- fontosság

- impozáns

- in

- tartalmaz

- magában foglalja a

- Beleértve

- független

- egyének

- iparágak

- ipar

- egyenlőtlenségek

- információ

- tájékoztatták

- Infrastruktúra

- velejáró

- Innováció

- újító

- szervezeti

- intézmények

- szerves

- integráció

- sértetlenség

- Intelligencia

- Interjú

- bele

- Bemutatja

- vonja

- részt

- bevonásával

- kérdés

- kérdések

- IT

- ITS

- tudás

- hiány

- nyelv

- Nyelvek

- nagy

- vezet

- vezető

- tanulás

- Főkönyv

- hitelezési

- erőfölény

- li

- fekszik

- fény

- mint

- Korlátozott

- határértékek

- hitel

- Hitelek

- helyi

- HELYI BANKOK

- alacsonyabb

- gép

- gépi tanulás

- Fő

- csinál

- Gyártás

- Tömeg

- anyag

- Lehet..

- jelentőségteljes

- említett

- microsoft

- esetleg

- félrevezető tájékoztatás

- félrevezető

- modell

- modellek

- modern

- pillanat

- erkölcsi

- több

- többszörös

- Nemzetek

- Természet

- elengedhetetlen

- Szükség

- hálózat

- Új

- New York

- New York állam

- New York-i Pénzügyi Szolgáltatások Minisztériuma

- nem szakértők

- figyelemre méltó

- szám

- számos

- számos előnye

- megszerzése

- of

- ajánlat

- felajánlás

- gyakran

- on

- online

- működik

- Lehetőségek

- or

- ki

- eredmények

- panel

- panelbeszélgetés

- rész

- múlt

- fizetés

- teljesítmény

- időszakos

- Testreszabás

- perspektíva

- Plató

- Platón adatintelligencia

- PlatoData

- pont

- pont

- potenciális

- potenciálisan

- gyakorlat

- Főleg

- sürgős

- megakadályozása

- Probléma

- Folyamatok

- Termékek

- javaslatok

- védelem

- ad

- feltéve,

- nyilvánosan

- Kiadás

- célokra

- világítás

- Kérdések

- Futam

- rasszizmus

- emelt

- emelés

- elismerik

- csökkentő

- referenciák

- tekintettel

- szabályozott

- Szabályozás

- szabályozók

- támaszkodnak

- figyelemre méltó

- Jelentő

- korlátozások

- Eredmények

- forradalmasította

- jogok

- Kockázat

- kockázatok

- Sachs

- Botrány

- Iskolák

- pontszámok

- pontozás

- kaparás

- szektor

- kiválasztása

- kiválasztás

- Szolgáltatások

- mutatott

- jelentőség

- jelentős

- hasonló

- megoldások

- Megoldások

- forrás

- beszélő

- szakosodott

- indítás

- Startups

- Állami

- Állami Minisztérium

- Még mindig

- memorizált

- erő

- ilyen

- ÖSSZEFOGLALÓ

- környező

- gyorsan

- szisztémás

- Systems

- felszerelés

- tart

- célzás

- tech

- tech cégek

- technológusok

- Technológia

- tesztek

- hogy

- A

- The Source

- azok

- Ott.

- ezáltal

- Ezek

- ezt

- időigényes

- időrendben

- idővonalak

- nak nek

- szerszámok

- téma

- Képzések

- Átláthatóság

- kettő

- jellemzően

- érthető

- jegyzési

- tisztességtelen

- egyedi

- Egyesült

- Egyesült Nemzetek

- nem úgy mint

- helyt

- sürgősség

- használ

- használt

- különféle

- videó

- látnok

- we

- Web3

- Jólét

- voltak

- amikor

- ami

- míg

- val vel

- belül

- Női

- világ

- WorldPay

- aggódik

- lenne

- év

- york

- zephyrnet