Mindannyian szeretnénk látni, hogy ideális emberi értékeink tükröződjenek technológiáinkban. Elvárjuk az olyan technológiáktól, mint a mesterséges intelligencia (AI), hogy ne hazudjanak nekünk, ne tegyenek különbséget, és biztonságosak legyenek számunkra és gyermekeink számára. Ennek ellenére sok mesterséges intelligencia-alkotó jelenleg szembesül a modelljeikben feltárt torzítások, pontatlanságok és problémás adatgyakorlatok miatt. Ezek a problémák többet igényelnek, mint technikai, algoritmikus vagy mesterséges intelligencia alapú megoldást. Valójában holisztikus, szociotechnikai megközelítésre van szükség.

A matematika hatalmas igazságot mutat be

Minden prediktív modell, beleértve a mesterséges intelligenciát is, pontosabb, ha sokféle emberi intelligenciát és tapasztalatot tartalmaz. Ez nem vélemény; empirikus érvényessége van. Fontolja meg a diverzitás-előrejelzési tétel. Egyszerűen fogalmazva, ha egy csoportban nagy a sokféleség, a tömeg hibája kicsi – ez alátámasztja a „tömeg bölcsessége” koncepciót. Egy nagy hatású tanulmány kimutatta, hogy az alacsony képességű problémamegoldók különböző csoportjai felülmúlhatják a magas képességű problémamegoldók csoportjait (Hong és Page, 2004).

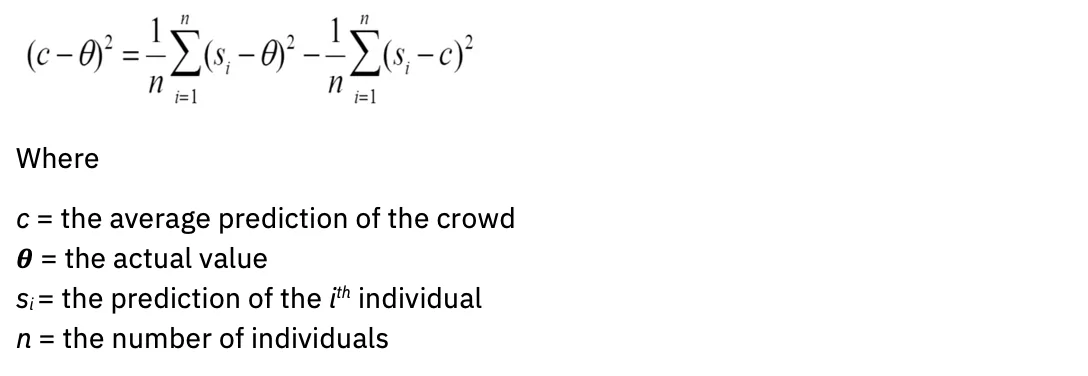

Matematikai nyelven: minél szélesebb a szórás, annál standardabb az átlag. Az egyenlet így néz ki:

A a további vizsgálat további számításokat adott, amelyek finomítják a bölcs tömeg statisztikai definícióit, beleértve a többi tag előrejelzésének tudatlanságát és a maximálisan különbözik (negatívan korrelált) előrejelzések vagy ítéletek. Tehát nem csak a mennyiség, hanem a változatosság is javítja az előrejelzéseket. Hogyan befolyásolhatja ez a betekintés az AI-modellek értékelését?

Modell (in)pontosság

Egy általános aforizmát idézve minden modell téves. Ez igaz a statisztika, a tudomány és a mesterséges intelligencia területére. A tartományi szakértelem hiányával létrehozott modellek ahhoz vezethetnek, hogy téves kimenetek.

Manapság az emberek egy apró homogén csoportja határozza meg, hogy milyen adatokat kell felhasználni a generatív mesterséges intelligencia modellek képzéséhez, amelyek olyan forrásokból származnak, amelyek túlreprezentálják az angol nyelvet. „A világ több mint 6,000 nyelvének többségében a rendelkezésre álló szöveges adatok nem elegendőek egy nagyszabású alapmodell képzéséhez” (a „Az alapozási modellek lehetőségeiről és kockázatairól”, Bommasani et al., 2022).

Ezenkívül maguk a modellek is korlátozott architektúrákból készülnek: „Ma már szinte az összes legkorszerűbb NLP-modellt néhány alapmodell egyikéből adaptálják, mint például a BERT, RoBERTa, BART, T5 stb. Míg ez a homogenizálás rendkívül magas tőkeáttétel (az alapmodellek bármilyen fejlesztése azonnali haszonhoz vezethet az egész NLP-ben), ez egyben kötelezettség is; minden mesterséges intelligencia rendszer örökölheti néhány alapmodell azonos problémás torzítását (Bommasani et al.) "

Ahhoz, hogy a generatív mesterséges intelligencia jobban tükrözze az általa kiszolgált sokszínű közösségeket, az emberi lények adatainak sokkal szélesebb skáláját kell megjeleníteni a modellekben.

A modell pontosságának értékelése kéz a kézben jár a torzítás értékelésével. Fel kell tennünk a kérdést, hogy mi a modell célja, és kire optimalizálták? Fontolja meg például, hogy ki profitál a legtöbbet a tartalom-ajánló algoritmusokból és a keresőmotor-algoritmusokból. Az érintettek érdekei és céljai nagyon eltérőek lehetnek. Az algoritmusok és modellek célokat vagy proxykat igényelnek a Bayes-hibához: ez a minimális hiba, amelyet a modellnek javítania kell. Ez a meghatalmazott gyakran egy személy, például egy szakterületi szakértő.

Nagyon emberi kihívás: A kockázat felmérése a modellbeszerzés vagy -fejlesztés előtt

A kialakulóban lévő mesterséges intelligencia szabályozások és cselekvési tervek egyre inkább hangsúlyozzák az algoritmikus hatásvizsgálati űrlapok fontosságát. Ezeknek az űrlapoknak az a célja, hogy kritikus információkat gyűjtsenek az AI-modellekről, hogy az irányítási csapatok felmérhessék és kezelhessék kockázataikat a bevezetésük előtt. A tipikus kérdések a következők:

- Mi a modelled használati esete?

- Milyen kockázatokkal jár az eltérő hatás?

- Hogyan értékeli a méltányosságot?

- Hogyan teszi magyarázhatóvá a modelljét?

Jóllehet jó szándékkal tervezték, a probléma az, hogy a legtöbb mesterséges intelligencia modell tulajdonosa nem érti, hogyan értékelje a kockázatokat a felhasználási esetükben. A gyakori refrén a következő lehet: „Hogyan lehet tisztességtelen a modellem, ha nem gyűjt személyazonosításra alkalmas információkat (PII)?” Következésképpen az űrlapokat ritkán töltik ki azzal az átgondoltsággal, amely ahhoz szükséges, hogy az irányítási rendszerek pontosan megjelöljék a kockázati tényezőket.

Így a megoldás szociotechnikai jellege hangsúlyos. A modelltulajdonosnak – egy magánszemélynek – nem lehet egyszerűen megadni egy listát a jelölőnégyzetekről, amelyekkel felmérheti, hogy a használati esete kárt okoz-e. Ehelyett olyan emberek csoportjaira van szükség, akik sokféle élettapasztalattal rendelkeznek, és olyan közösségekben jönnek össze, amelyek pszichológiai biztonságot nyújtanak, hogy nehéz beszélgetéseket folytathassanak az eltérő hatásokról.

A megbízható mesterséges intelligencia szélesebb perspektíváinak üdvözlése

Az IBM® hisz a „nullakliens” megközelítésben, és megvalósítja azokat az ajánlásokat és rendszereket, amelyeket saját ügyfelei számára készítene a tanácsadói és termékvezérelt megoldásokon keresztül. Ez a megközelítés kiterjed az etikai gyakorlatokra is, ezért az IBM létrehozta a Megbízható AI Kiválósági Központot (COE).

Amint azt fentebb kifejtettük, a tapasztalatok és készségek sokfélesége kritikus fontosságú az AI hatásainak megfelelő értékeléséhez. A kiválósági központban való részvétel lehetősége azonban megfélemlítő lehet egy olyan vállalatnál, amely tele van mesterségesintelligencia-innovátorokkal, szakértőkkel és kiváló mérnökökkel, ezért szükség van a pszichológiai biztonság közösségének ápolására. Az IBM ezt világosan közli: „Érdekli az AI? Érdekel az AI etika? Helyed van ennél az asztalnál."

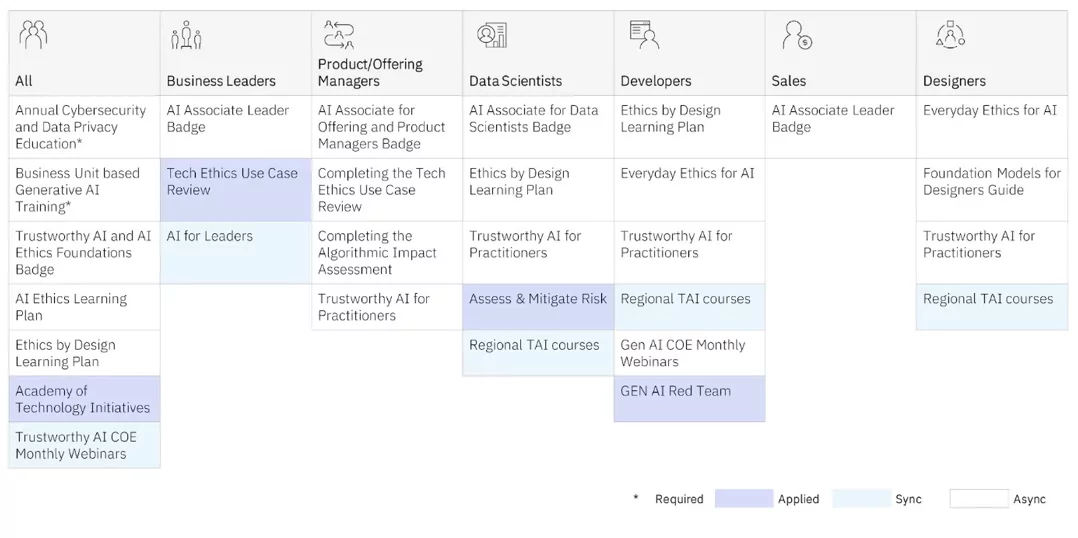

A COE a mesterséges intelligencia etikájával kapcsolatos képzést kínál minden szinten gyakorló szakemberek számára. Mind a szinkron tanulás (tanár és a tanulók az osztályban), mind az aszinkron (önvezető) programokat kínálnak.

De ez a COE alkalmazott olyan képzés, amely a legmélyebb betekintést nyújtja gyakorlóinknak, miközben globális, sokszínű, multidiszciplináris csapatokkal dolgoznak valódi projekteken, hogy jobban megértsék az eltérő hatásokat. Kihasználják az IBM tervezési gondolkodási keretrendszereit is Tervezés AI-hoz A csoport belsőleg és az ügyfelekkel együtt használja fel az AI-modellek nem kívánt hatásainak felmérésére, szem előtt tartva azokat, akik gyakran marginalizálódnak. (Lásd Sylvia Duckworth's A hatalom és a privilégiumok kereke példák arra vonatkozóan, hogy a személyes jellemzők hogyan keresztezik egymást az emberek kiváltságainak kiváltásához vagy marginalizálásához.) Az IBM a keretrendszerek nagy részét a nyílt forráskódú közösségnek adományozta. Etikus tervezés.

Az alábbiakban néhány olyan jelentés található, amelyeket az IBM nyilvánosan közzétett ezekről a projektekről:

Automatizált AI-modell-irányítási eszközökre van szükség ahhoz, hogy fontos betekintést nyerjenek az AI-modell teljesítményére vonatkozóan. De ne feledje, az optimális kockázatot jóval a modell kifejlesztése és gyártása előtt rögzíteni. Azáltal, hogy sokszínű, multidiszciplináris szakemberekből álló közösségeket hoz létre, amelyek biztonságos teret kínálnak az emberek számára, hogy kemény beszélgetéseket folytassanak az eltérő hatásokról, megkezdheti az utat az alapelvei gyakorlatba ültetése és a mesterséges intelligencia felelősségteljes fejlesztése felé.

A gyakorlatban, amikor mesterséges intelligenciával foglalkozó szakembereket vesz fel, vegye figyelembe, hogy a modellek létrehozásával kapcsolatos erőfeszítések több mint 70%-a a megfelelő adatok összegyűjtése. Olyan embereket szeretne felvenni, akik tudják, hogyan gyűjtsenek reprezentatív adatokat, de amelyeket beleegyezéssel is gyűjtenek. Azt is szeretné, ha a hozzáértő emberek szorosan együttműködnének a domain szakértőivel, hogy megbizonyosodjanak arról, hogy a megfelelő megközelítést alkalmazzák. Kulcsfontosságú, hogy ezeknek a szakembereknek rendelkezzenek olyan érzelmi intelligenciával, hogy alázattal és belátással közelítsék meg a mesterséges intelligencia felelős kezelésének kihívását. Szándékosan meg kell tanulnunk felismerni, hogy a mesterséges intelligencia rendszerek hogyan és mikor fokozhatják az egyenlőtlenséget éppúgy, mint az emberi intelligenciát.

Találja meg újra, hogyan működik vállalkozása a mesterséges intelligencia segítségével

Hasznos volt ez a cikk?

IgenNem

Többet a mesterséges intelligenciából

IBM hírlevelek

Szerezze meg hírleveleinket és témafrissítéseinket, amelyek a legújabb gondolatvezetést és betekintést nyújtanak a feltörekvő trendekre.

Kattintson ide!

További hírlevelek

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://www.ibm.com/blog/why-we-need-diverse-multidisciplinary-coes-for-model-risk/

- :van

- :is

- :nem

- :ahol

- $ UP

- 000

- 1

- 16

- 2022

- 2024

- 23

- 25

- 28

- 29

- 30

- 300

- 32

- 39

- 40

- 400

- 65

- 7

- 9

- a

- képesség

- Rólunk

- felett

- AC

- gyorsul

- pontosság

- pontos

- pontosan

- át

- Akció

- igazítani

- cím

- beismerni

- elfogadja

- Hirdetés

- tanács

- érint

- szerek

- AI

- AI modellek

- AI rendszerek

- cél

- AL

- algoritmikus

- algoritmusok

- Minden termék

- Is

- mindig

- amp

- an

- analitika

- és a

- bármilyen

- Alkalmazás

- alkalmazások

- megközelítés

- VANNAK

- területek

- cikkben

- mesterséges

- mesterséges intelligencia

- Mesterséges intelligencia (AI)

- AS

- kérdez

- értékeli

- értékelése

- értékelés

- asszisztensek

- segítő

- At

- hang-

- fokozza

- szerző

- elérhető

- elkerülése érdekében

- vissza

- kiegyensúlyozó

- BE

- óta

- előtt

- kezdődik

- hogy

- úgy gondolja,

- Előnyök

- Jobb

- Túl

- előítélet

- torzítások

- Blog

- blogok

- Kék

- Boston

- mindkét

- tágabb

- Épület

- üzleti

- üzleti funkciók

- vállalkozások

- de

- gomb

- by

- TUD

- elfog

- Rögzítése

- szén

- kártya

- Kártyák

- ami

- eset

- CAT

- Kategória

- Okoz

- Központ

- Kiválósági Központ

- központi

- bizonyos

- kihívás

- jellemzők

- chatbots

- ellenőrizze

- gyermek

- Gyerekek

- körök

- CIS

- osztály

- világosan

- ügyfél részére

- szorosan

- felhő

- szín

- kombináció

- érkező

- Közös

- Közösségek

- közösség

- Companies

- vállalat

- Befejezett

- koncepció

- beleegyezés

- Következésképpen

- Fontolja

- tanácsadó

- Konténer

- folytatódik

- beszélgetések

- Mag

- kijavítására

- korrelációs

- Költség

- tudott

- készítette

- létrehozása

- alkotók

- kritikai

- tömeg

- CSS

- kurátorképzésének

- Jelenleg

- szokás

- vevő

- Vásárlói élmény

- Ügyfelek

- dátum

- találka

- határozatok

- legmélyebb

- alapértelmezett

- definíciók

- szállít

- mutatja

- bevezetéséhez

- leírás

- Design

- tervezés gondolkodás

- tervezett

- Határozzuk meg

- Fejleszt

- fejlett

- különböző

- nehéz

- digitális

- digitális átalakítás

- eltérő

- Kiváló

- számos

- Sokféleség

- do

- domain

- adományozott

- húzott

- hajtás

- E&T

- hatások

- erőfeszítés

- megszüntetése

- beágyazás

- ölelés

- csiszolókő

- alkalmazottak

- lehetővé

- vonzó

- Motor

- Mérnökök

- Angol

- elég

- biztosítása

- belép

- hiba

- stb.

- Eter (ETH)

- etikai

- etika

- értékelni

- értékelő

- értékelés

- Még

- Minden

- mindenhol

- súlyosbíthatja

- példa

- példák

- Kiváló

- Kilépés

- vár

- tapasztalat

- Tapasztalatok

- szakértő

- szakvélemény

- szakértők

- magyarázható

- kitett

- nyúlik

- rendkívüli módon

- Facebook Messenger

- megkönnyítése

- néző

- tényezők

- méltányosság

- hamis

- messze

- GYORS

- kevés

- Találjon

- Összpontosít

- következik

- következő

- betűtípusok

- A

- Forefront

- formák

- Alapítvány

- keretek

- ból ből

- front

- funkciók

- gyűjt

- összegyűjtött

- gyűjtése

- nemző

- Generatív AI

- generátor

- kap

- adott

- ad

- Globális

- cél

- Célok

- Goes

- jó

- kormányzás

- Nyelvtan

- nagymértékben

- Rács

- Csoport

- Csoportok

- Növekedés

- útmutató

- kárt

- Legyen

- Cím

- hall

- magasság

- segít

- hasznos

- Magas

- őt

- bérel

- Kölcsönzés

- övé

- tart

- holisztikus

- Kezdőlap

- Hogyan

- How To

- HTTPS

- emberi

- humán felderítés

- alázatosság

- hibrid

- hibrid felhő

- i

- BETEG

- IBM

- ICO

- ICON

- ideális

- azonosított

- if

- Tudatlanság

- kép

- azonnali

- Hatás

- Hatások

- végre

- végrehajtási

- fontosság

- fontos

- javul

- fejlesztések

- javítja

- in

- tartalmaz

- Beleértve

- befogadás

- bele

- egyre inkább

- járulékos

- index

- ipar

- Befolyásos

- információ

- Innováció

- innovátorok

- bemenet

- Insight

- meglátások

- azonnal

- helyette

- Intézet

- biztosítás

- biztosítók

- Intelligencia

- Intelligens

- A szándék

- Szándékos

- szándékok

- érdekelt

- érdekek

- belsőleg

- keresztezik

- beavatkozás

- megfélemlítő

- belső

- Hát

- kérdés

- kérdések

- IT

- ITS

- január

- csatlakozik

- Csatlakozz hozzánk

- utazás

- jpg

- éppen

- tartás

- Kulcs

- Ismer

- ismert

- hiány

- nyelv

- Nyelvek

- nagy

- nagyarányú

- legutolsó

- vezet

- vezető

- Vezetés

- tanulás

- hadd

- szint

- Tőkeáttétel

- felelősség

- fekszik

- mint

- Korlátozott

- Lista

- helyi

- helyszín

- MEGJELENÉS

- csinál

- Gyártás

- vezetés

- kézikönyv

- sok

- matematikai

- matematikai

- Anyag

- max-width

- Lehet..

- me

- jelent

- Találkozik

- hírnök

- esetleg

- perc

- bánja

- minimum

- jegyzőkönyv

- Mobil

- modell

- modellek

- korszerűsítés

- több

- a legtöbb

- mozog

- sok

- multidiszciplináris

- kell

- my

- Természet

- Navigáció

- elengedhetetlen

- Szükség

- szükséges

- igények

- negatívan

- Új

- új termékek

- hírlevelek

- NLP

- nem

- megjegyezni

- semmi

- Most

- számos

- of

- kedvezmény

- ajánlat

- felajánlott

- Ajánlatok

- gyakran

- on

- ONE

- nyílt forráskódú

- Vélemény

- Lehetőségek

- optimálisan

- optimalizált

- or

- szervezetek

- Más

- mi

- teljesítményben felülmúl

- kimenetek

- felett

- saját

- tulajdonosok

- oldal

- részt vevő

- elhalad

- Emberek (People)

- előadó

- person

- személyes

- Személyesen

- perspektívák

- PHP

- PII

- tervek

- Plató

- Platón adatintelligencia

- PlatoData

- csatlakoztat

- politika

- pozíció

- állás

- potenciális

- potenciális ügyfelek

- hatalom

- erős

- gyakorlat

- gyakorlat

- előrejelzés

- Tippek

- jósló

- elsődleges

- elvek

- Fontossági sorrendet

- kiváltság

- Probléma

- beszerzés

- termel

- Termelés

- termelékenység

- Termékek

- Programok

- projektek

- megfelelően

- kilátás

- feltéve,

- amely

- proxy

- meghatalmazott

- pszichológiai

- nyilvánosan

- közzétett

- tesz

- Kérdések

- gyorsan

- idézet

- ritkán

- Készenlét

- Olvasás

- igazi

- Valóság

- elismerik

- ajánlások

- csökkentő

- finomítani

- tükröznie

- tükrözi

- előírások

- Jelentések

- reprezentatív

- képviselők

- kéri

- szükség

- kötelező

- kutatás

- válaszol

- felelős

- felelősségteljesen

- fogékony

- jövedelem

- bevétel növekedés

- jobb

- Kockázat

- kockázati tényezők

- kockázatok

- út

- robotok

- biztonságos

- Biztonság

- Mondott

- azonos

- mondás

- Skála

- skálázás

- Tudomány

- Képernyő

- szkriptek

- Keresés

- kereső

- biztonság

- lát

- SEO

- szolgálja

- beállítások

- kellene

- mutatott

- egyszerűen

- weboldal

- laza

- kicsi

- okos

- Intelligens hangszórók

- SMS

- So

- megoldások

- Megoldások

- néhány

- Források

- Hely

- hangszórók

- Szponzorált

- terek

- érdekeltek

- standard

- kezdet

- csúcs-

- statisztikai

- statisztika

- Diákok

- Tanulmány

- tárgy

- Iratkozz fel

- ilyen

- támogatás

- Támogató

- SVG

- Systems

- T

- táblázat

- bevétel

- célok

- tanár

- csapat

- Műszaki

- Technologies

- harmadlagos

- szöveg

- mint

- köszönöm

- hogy

- A

- a világ

- azok

- Őket

- téma

- maguk

- Ezek

- ők

- Szerintem

- Gondolkodás

- ezt

- azok

- gondoltam

- gondolkodás vezetés

- három

- Keresztül

- idő

- Cím

- nak nek

- együtt

- szerszámok

- felső

- téma

- kemény

- Vonat

- Képzések

- Átalakítás

- Trends

- igaz

- megbízható

- kettő

- típus

- tipikus

- megért

- tisztességtelen

- egyedi

- kinyitó

- Frissítés

- upon

- URL

- us

- használ

- használati eset

- használ

- kihasználva

- érték

- Értékek

- fajta

- változó

- nagyon

- Tényleges

- kötet

- W

- akar

- volt

- we

- JÓL

- Mit

- Mi

- amikor

- vajon

- ami

- míg

- WHO

- kit

- miért

- széles körben

- szélesebb

- lesz

- bölcsesség

- BÖLCS

- val vel

- szó

- WordPress

- Munka

- művek

- világ

- lenne

- írott

- Rossz

- még

- te

- A te

- zephyrnet