A kép DALL-E3-mal készült

A mesterséges intelligencia teljes forradalom volt a technológiai világban.

A legtöbbünket még mindig lenyűgöz az a képessége, hogy utánozza az emberi intelligenciát és olyan feladatokat hajt végre, amelyeket egykor kizárólag emberi területnek tekintettek.

Azonban bármennyire is jók voltak ezek a késői mesterséges intelligencia-ugrások, mindig van hova fejlődni.

És pontosan itt lép életbe a gyors mérnöki munka!

Adja meg ezt a mezőt, amely jelentősen növelheti az AI modellek termelékenységét.

Fedezzük fel együtt mindezt!

Az azonnali tervezés az AI egy gyorsan növekvő tartománya, amely a nyelvi modellek hatékonyságának és eredményességének javítására összpontosít. Ez arról szól, hogy tökéletes utasításokat készítsünk, amelyek irányítják az AI-modelleket a kívánt kimenetek előállításához.

Tekintsd úgy, hogy megtanulod, hogyan adj jobb utasításokat valakinek, hogy megbizonyosodjon arról, hogy megérti és helyesen hajtja végre a feladatot.

Miért fontos az azonnali tervezés?

- Fokozott termelékenység: A kiváló minőségű promptok használatával az AI-modellek pontosabb és relevánsabb válaszokat generálhatnak. Ez azt jelenti, hogy kevesebb időt kell a korrekciókra fordítani, és több időt kell fordítani az AI képességeinek kihasználására.

- Költséghatékonyság: Az AI modellek képzése erőforrás-igényes. Az azonnali tervezés csökkentheti az átképzés szükségességét azáltal, hogy jobb felszólítások révén optimalizálja a modell teljesítményét.

- Sokoldalúság: Egy jól kidolgozott felszólítás sokoldalúbbá teheti az AI-modelleket, lehetővé téve számukra, hogy a feladatok és kihívások szélesebb körét kezeljék.

Mielőtt belemerülnénk a legfejlettebb technikákba, idézzünk fel két leghasznosabb (és alapvető) azonnali mérnöki technikát.

Szekvenciális gondolkodás a „Gondolkodjunk lépésről lépésre” funkcióval

Ma már köztudott, hogy az LLM modellek pontossága jelentősen javul a „Gondolkozzunk lépésről lépésre” szósor hozzáadásával.

Miért… kérdezhetnéd?

Nos, ez azért van, mert arra kényszerítjük a modellt, hogy minden feladatot több lépésre bontsa, így biztosítva, hogy a modellnek elegendő ideje legyen mindegyik feldolgozására.

Például kihívhatom a GPT3.5-öt a következő prompttal:

Ha Jánosnak van 5 körte, akkor megeszik 2-t, vesz még 5-öt, majd ad 3-at a barátjának, hány körtét van?

A modell azonnal választ ad. Ha azonban hozzáadom a végső „Gondolkodjunk lépésről lépésre” szót, arra kényszerítem a modellt, hogy több lépésből álló gondolkodási folyamatot generáljon.

Néhány lövésű felszólítás

Míg a Zero-shot felszólítás arra utal, hogy a modellt kontextus vagy előzetes tudás megadása nélkül kérik meg egy feladat elvégzésére, a néhány lépéses felszólítás azt jelenti, hogy az LLM-nek néhány példát mutatunk be a kívánt kimenetre néhány konkrét kérdés mellett.

Például, ha olyan modellt akarunk kidolgozni, amely bármely kifejezést költői hangnemben határoz meg, akkor ezt meglehetősen nehéz megmagyarázni. Jobb?

Használhatjuk azonban a következő néhány lépésből álló utasításokat, hogy a kívánt irányba tereljük a modellt.

Az Ön feladata, hogy következetes stílusban válaszoljon a következő stílushoz igazodva.

: Taníts meg a rugalmasságról.

: A rugalmasság olyan, mint egy fa, amely hajlik a széllel, de nem törik el.

Ez az a képesség, hogy vissza kell ugrani a csapásokból, és folyamatosan haladni előre.

: Az Ön bevitele itt.

Ha még nem próbálta ki, kihívhatja a GPT-t.

Mivel azonban biztos vagyok benne, hogy a legtöbben már ismerik ezeket az alapvető technikákat, megpróbálom kihívni Önt néhány fejlett technikával.

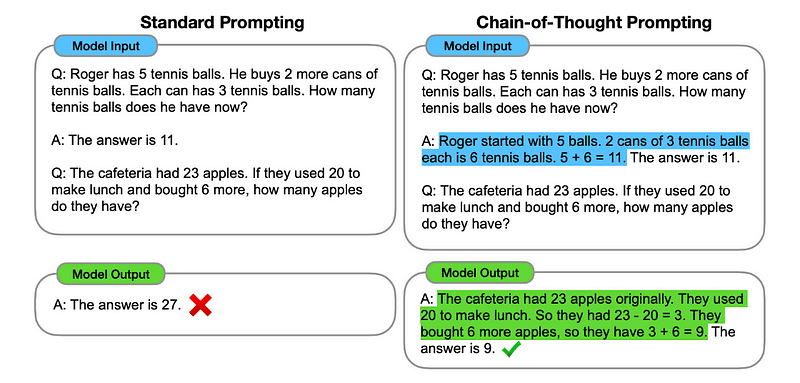

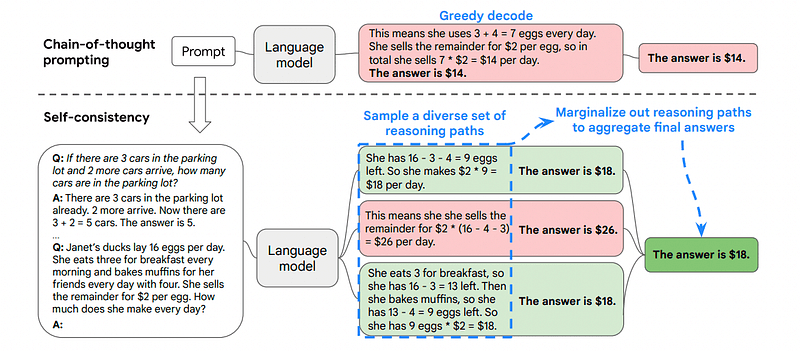

1. Gondolatlánc (CoT) felszólítás

Bevezette: A Google 2022-ban, ez a módszer azt jelenti, hogy a modellt több érvelési szakaszon kell átmenni a végső válasz megadása előtt.

Ugye ismerősen hangzik? Ha igen, akkor teljesen igazad van.

Ez olyan, mintha a szekvenciális gondolkodást és a kevés lövésű felszólítást egyesítené.

Hogyan?

Lényegében a CoT felszólítás arra utasítja az LLM-et, hogy szekvenciálisan dolgozza fel az információkat. Ez azt jelenti, hogy példát mutatunk be az első probléma megoldására többlépcsős érveléssel, majd elküldjük a modellnek a valódi feladatunkat, elvárva, hogy egy hasonló gondolati láncot emuláljon, amikor válaszol a tényleges lekérdezésre, amelyet meg akarunk oldani.

A kép a papír.

Tehát a legelső példát követve megadhatnánk egy promptot az első problémával, és egy szekvenciális magyarázatot annak megoldására. Ezután elküldhetjük véleményünket, és megnézhetjük, hogyan történik a varázslat!

Ha Jánosnak van 5 körte, akkor megeszik 2-t, vesz még 5-öt, majd ad 3-at a barátjának, hány körtét van? Gondolkozzunk lépésről lépésre.

Menjünk lépésről lépésre. János 5 körtével kezdi. 2 körtét megeszik, így 5-2 = 3 körte marad. Aztán vesz még 5 körtét. Tehát most 3 + 5 = 8 körte van. Végül 3 körtét ad a barátjának. Ezért maradt neki 8–3 = 5 körte. Tehát mindezen lépések után Johnnak 5 körte van.

Az Ön hozzászólása itt.

Azonban a legtöbben biztosan azt gondolják… Kell-e valamilyen szekvenciális módszert kitalálnom bármilyen probléma megoldására, amikor kérdezni akarok valamit a ChatGPT-n?

Hát… nem te vagy az első! És ez elvezet minket ahhoz, hogy…

2. Automatikus gondolati lánc (Auto-CoT)

A 2022, Zhang és kollégái bevezettek egy módszert a manuális folyamat elkerülésére. Két fő oka van a manuális feladatok elkerülésének:

- Unalmas lehet.

- Rossz eredménnyel járhat – például, ha rossz a mentális folyamatunk.

Azt javasolták, hogy az LLM-eket a „Gondolkozzunk lépésről lépésre” üzenettel kombinálva szekvenciális érvelési láncokat állítsanak elő minden demonstrációhoz.

Ez azt jelenti, hogy meg kell kérdezni a ChatGPT-től, hogyan oldjon meg bármilyen problémát egymás után, majd ugyanezzel a példával tanítsa meg, hogyan oldjon meg bármilyen más problémát.

3. Önkonzisztencia

Az önkonzisztencia egy másik érdekes felszólító technika, amelynek célja, hogy javítsa a gondolati láncot, amely a bonyolultabb érvelési problémákhoz vezet.

Szóval… mi a fő különbség?

Az önkonzisztencia fő gondolata az, hogy tudatában vagyunk annak, hogy a modellt rossz példával is betaníthatjuk. Képzelje el, hogy az előző problémát rossz mentális folyamattal oldottam meg:

Ha Jánosnak van 5 körte, akkor megeszik 2-t, vesz még 5-öt, majd ad 3-at a barátjának, hány körtét van? Gondolkozzunk lépésről lépésre.

Kezdje 5 körtével. János megeszik 2 körtét. Aztán 3 körtét ad a barátjának. Ezek a tevékenységek kombinálhatók: 2 (evett) + 3 (adott) = összesen 5 körte érintett. Most vonja le az összes érintett körtét a kezdeti 5 körtéből: 5 (kezdeti) – 5 (érintett) = 0 körte maradt.

Akkor minden más feladat, amit a modellnek küldök, rossz lesz.

Ez az oka annak, hogy az önkonzisztencia magában foglalja a mintavételezést különféle érvelési utakból, amelyek mindegyike tartalmaz egy gondolati láncot, majd hagyja, hogy az LLM válassza ki a legjobb és legkövetkezetesebb utat a probléma megoldásához.

A kép a papír

Ebben az esetben, és ismét a legelső példát követve, a modellnek különböző problémamegoldási módokat mutathatunk be.

Ha Jánosnak van 5 körte, akkor megeszik 2-t, vesz még 5-öt, majd ad 3-at a barátjának, hány körtét van?

Kezdje 5 körtével. János megeszik 2 körtét, marad neki 5-2 = 3 körte. Vásárol még 5 körtét, így összesen 3 + 5 = 8 körte. Végül 3 körtét ad a barátjának, így 8–3 = 5 körte marad.

Ha Jánosnak van 5 körte, akkor megeszik 2-t, vesz még 5-öt, majd ad 3-at a barátjának, hány körtét van?

Kezdje 5 körtével. Ezután vesz még 5 körtét. János most 2 körtét eszik. Ezek a műveletek kombinálhatók: 2 (megevett) + 5 (vásárolt) = összesen 7 körte. Vonjuk le a körte mennyiségét, amelyet Jon megevett, az összes körte mennyiségéből 7 (teljes mennyiség) – 2 (elfogyott) = 5 körte maradt.

Az Ön hozzászólása itt.

És itt jön az utolsó technika.

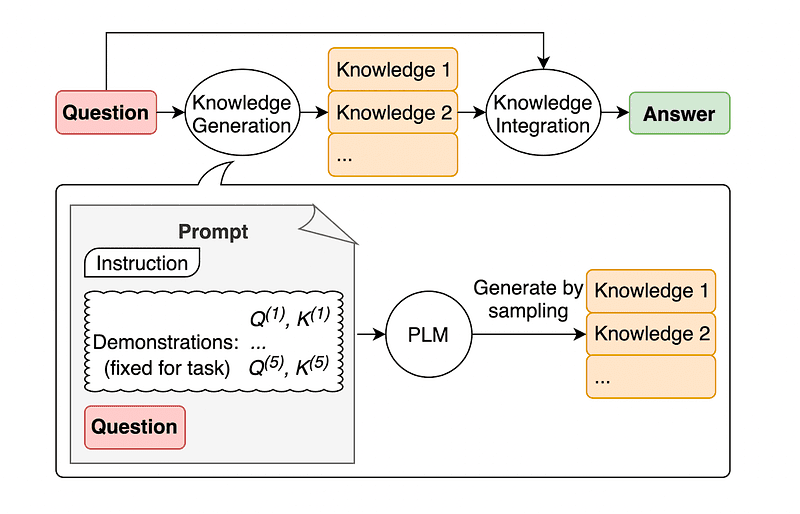

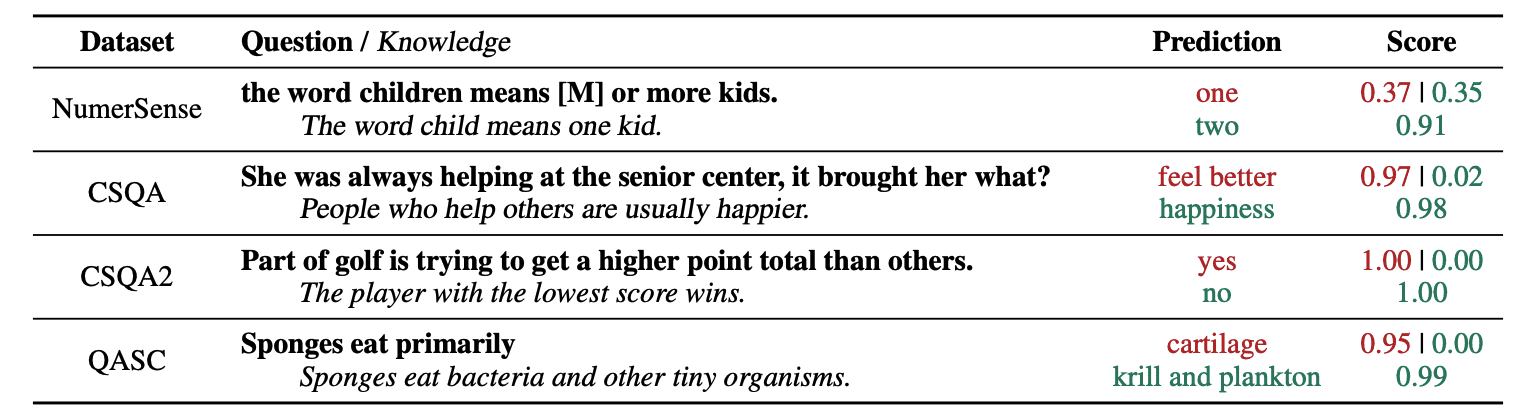

4. Általános ismeretek felszólítása

Az azonnali tervezés általános gyakorlata az, hogy a lekérdezést további ismeretekkel egészítik ki, mielőtt elküldenék a végső API-hívást a GPT-3-nak vagy a GPT-4-nek.

Szerint Jiacheng Liu és Társa, bármikor hozzátehetünk némi ismeretet bármilyen kéréshez, így az LLM jobban tud a kérdésről.

A kép a papír.

Így például, ha megkérdezzük a ChatGPT-től, hogy a golf egy része magasabb pontszámot próbál-e elérni, mint mások, akkor az érvényesíteni fog minket. A golf fő célja azonban ennek éppen az ellenkezője. Ez az oka annak, hogy hozzáadhatunk néhány korábbi tudást, amely azt mondja, hogy „Az alacsonyabb pontszámmal rendelkező játékos nyer”.

Szóval.. mi a vicces, ha pontosan megmondjuk a modellnek a választ?

Ebben az esetben ezt a technikát az LLM velünk való interakciójának javítására használják.

A cikk szerzői tehát ahelyett, hogy egy külső adatbázisból vonnának ki kiegészítő kontextust, azt javasolják, hogy az LLM készítse el saját tudását. Ezt a saját maga által generált tudást azután integrálják a promptba, hogy megerősítsék a józan ész érvelését és jobb eredményeket adjanak.

Tehát így lehet továbbfejleszteni az LLM-eket a képzési adatkészlet növelése nélkül!

Az azonnali tervezés kulcsfontosságú technikává vált az LLM képességeinek fejlesztésében. A promptok iterálásával és javításával közvetlenebb módon kommunikálhatunk az AI-modellekkel, így pontosabb és kontextus szempontjából releváns kimeneteket kaphatunk, időt és erőforrásokat megtakarítva.

A technológiai rajongók, az adattudósok és a tartalomkészítők számára egyaránt az azonnali tervezés megértése és elsajátítása értékes eszköz lehet az AI-ban rejlő lehetőségek teljes kiaknázásában.

A gondosan megtervezett beviteli promptokat ezekkel a fejlettebb technikákkal kombinálva az azonnali tervezéshez szükséges készségkészlet kétségtelenül előnyt jelent az elkövetkező években.

Josep Ferrer elemző mérnök Barcelonából. Fizikai mérnöki diplomát szerzett, jelenleg az emberi mobilitásra vonatkozó adattudományi területen dolgozik. Ő egy részmunkaidős tartalomkészítő, aki az adattudományra és a technológiára összpontosít. Felveheti vele a kapcsolatot LinkedIn, Twitter or közepes.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://www.kdnuggets.com/some-kick-ass-prompt-engineering-techniques-to-boost-our-llm-models?utm_source=rss&utm_medium=rss&utm_campaign=some-kick-ass-prompt-engineering-techniques-to-boost-our-llm-models

- :van

- :is

- :nem

- :ahol

- $ UP

- 10

- 11

- 2022

- 29

- 7

- 8

- a

- képesség

- Rólunk

- pontosság

- pontos

- cselekvések

- tényleges

- hozzá

- hozzáadásával

- További

- fejlett

- Után

- újra

- AI

- AI modellek

- célok

- igazított

- hasonló

- Minden termék

- lehetővé téve

- mentén

- már

- mindig

- am

- összeg

- an

- analitika

- és a

- Másik

- válasz

- bármilyen

- api

- alkalmazott

- VANNAK

- AS

- kérdez

- kér

- vagyontárgy

- szerzők

- Automatikus

- elkerülése érdekében

- tudatában van

- el

- vissza

- Rossz

- barcelona

- alapvető

- BE

- mert

- óta

- előtt

- hogy

- BEST

- Jobb

- párna

- fellendítésére

- Unalmas

- mindkét

- megvett

- Ugrál

- szünet

- szünetek

- Bring

- tágabb

- de

- vásárol

- by

- hívás

- TUD

- képességek

- gondosan

- eset

- lánc

- láncok

- kihívás

- kihívások

- ChatGPT

- A pop-art design, négy időzóna kijelzése egyszerre és méretének arányai azok az érvek, amelyek a NeXtime Time Zones-t kiváló választássá teszik. Válassza a

- munkatársai

- kombinált

- kombinálása

- hogyan

- jön

- érkező

- Közös

- kommunikálni

- hasonló

- teljes

- bonyolult

- figyelembe vett

- következetes

- kapcsolat

- tartalom

- tartalomkészítők

- kontextus

- Hiba

- helyesen

- tudott

- készítette

- Teremtő

- alkotók

- Jelenleg

- dátum

- adat-tudomány

- adatbázis

- Annak meghatározása,

- átadó

- tervezett

- kívánatos

- különbség

- különböző

- közvetlen

- irány

- felfedez

- búvárkodás

- do

- nem

- domain

- domainek

- le-

- minden

- él

- hatékonyság

- hatékonyság

- alakult

- mérnök

- Mérnöki

- növelése

- fokozása

- elég

- biztosítására

- rajongók

- pontosan

- példa

- példák

- kivégez

- vár

- Magyarázza

- magyarázat

- ismerős

- kevés

- mező

- utolsó

- Végül

- vezetéknév

- összpontosított

- koncentrál

- következő

- A

- kényszerítve

- Előre

- barát

- ból ből

- Tele

- vicces

- általános

- generál

- kap

- Ad

- adott

- ad

- Go

- cél

- golf

- jó

- útmutató

- Kemény

- hasznosítása

- Legyen

- tekintettel

- he

- itt

- jó minőségű

- <p></p>

- őt

- övé

- Hogyan

- How To

- azonban

- HTTPS

- emberi

- humán felderítés

- i

- ötlet

- if

- kép

- javul

- javított

- javulás

- javuló

- in

- növekvő

- információ

- kezdetben

- bemenet

- példa

- utasítás

- integrált

- Intelligencia

- kölcsönhatásba lép

- érdekes

- bele

- Bevezetett

- jár

- IT

- ITS

- János

- jon

- éppen

- KDnuggets

- Tart

- rúg

- Kicks

- Ismer

- tudás

- tudja

- nyelv

- keresztnév

- Késő

- vezetékek

- Ugrás

- tanulás

- kilépő

- balra

- kevesebb

- hadd

- bérbeadása

- erőfölény

- mint

- alacsonyabb

- mágia

- Fő

- csinál

- Gyártás

- mód

- kézikönyv

- sok

- mastering

- Anyag

- me

- eszközök

- szellemi

- egyesülő

- módszer

- esetleg

- mobilitás

- modell

- modellek

- több

- a legtöbb

- mozgó

- többszörös

- kell

- Szükség

- soha

- nem

- Most

- szerez

- of

- on

- egyszer

- szemben

- optimalizálása

- or

- Más

- Egyéb

- mi

- ki

- teljesítmény

- kimenetek

- kívül

- saját

- Papír

- rész

- ösvény

- tökéletes

- teljesít

- teljesítmény

- Fizika

- döntő

- Plató

- Platón adatintelligencia

- PlatoData

- játékos

- pont

- potenciális

- gyakorlat

- pontosan

- be

- szép

- előző

- Probléma

- problémák

- folyamat

- gyárt

- termelékenység

- ad

- amely

- vontatás

- kérdés

- egészen

- hatótávolság

- Inkább

- igazi

- miatt

- ajánl

- csökkenteni

- kifejezés

- kérni

- rugalmasság

- erőforrás-igényes

- Tudástár

- válaszol

- válasz

- válaszok

- Eredmények

- átképzés

- Forradalom

- jobb

- Szoba

- s

- azonos

- megtakarítás

- Tudomány

- Tudomány és technológia

- tudósok

- pontszám

- lát

- küld

- elküldés

- Sorozat

- készlet

- számos

- előadás

- jelentősen

- jártasság

- So

- Kizárólag

- SOLVE

- Megoldása

- néhány

- Valaki

- valami

- különleges

- költött

- állapota

- kezdet

- kezdődik

- tinó

- Lépés

- Lépései

- Még mindig

- stílus

- biztos

- felszerelés

- meghozott

- Feladat

- feladatok

- tech

- technika

- technikák

- Technológia

- sokatmondó

- kifejezés

- mint

- hogy

- A

- Őket

- akkor

- Ott.

- ebből adódóan

- Ezek

- ők

- Szerintem

- Gondolkodás

- ezt

- gondoltam

- Keresztül

- Így

- idő

- nak nek

- TONE

- Végösszeg

- TELJESEN

- Vonat

- Képzések

- fa

- kipróbált

- megpróbál

- próbál

- kettő

- végső

- alatt

- mennek

- megért

- megértés

- kétségtelenül

- us

- használ

- használt

- segítségével

- ÉRVÉNYESÍT

- Értékes

- különféle

- sokoldalú

- nagyon

- akar

- Út..

- módon

- we

- jól ismert

- voltak

- amikor

- ami

- miért

- lesz

- szél

- val vel

- belül

- nélkül

- szó

- dolgozó

- világ

- Rossz

- év

- még

- Hozam

- te

- A te

- zephyrnet