Az Intel Corporation kutatói közzétették az „Efficient LLM következtetési megoldás az Intel GPU-n” című műszaki cikket.

Absztrakt:

„A transzformátor alapú nagy nyelvi modelleket (LLM) számos területen széles körben alkalmazzák, és az LLM következtetések hatékonysága forró téma a valós alkalmazásokban. Az LLM-eket azonban általában bonyolultan tervezték modellstruktúrában, hatalmas műveletekkel, és auto-regresszív módban hajtanak végre következtetéseket, így kihívást jelent a nagy hatékonyságú rendszer tervezése.

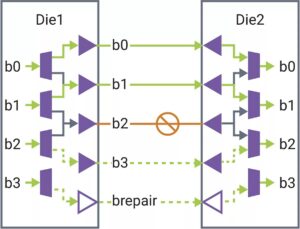

Ebben a cikkben egy hatékony LLM következtetési megoldást javasolunk alacsony késleltetéssel és nagy áteresztőképességgel. Először is leegyszerűsítjük az LLM dekóder réteget az adatmozgás és az elemenkénti műveletek egyesítésével, hogy csökkentsük a memóriaelérési gyakoriságot és a rendszer késleltetését. Javasolunk egy szegmens KV-gyorsítótár házirendet is, amely a kérés- és válaszjogkivonatok kulcsát/értékét külön fizikai memóriában tartja a hatékony eszközmemória-kezelés érdekében, elősegítve a futásidejű kötegméret növelését és a rendszer átviteli sebességének javítását. A testreszabott Scaled-Dot-Product-Attention kernelt úgy tervezték, hogy megfeleljen a szegmens KV gyorsítótár-megoldáson alapuló fúziós szabályzatunknak. LLM következtetési megoldásunkat Intel GPU-n implementáljuk, és nyilvánosan közzétesszük. A szabványos HuggingFace megvalósításhoz képest a javasolt megoldás akár 7-szer alacsonyabb token késleltetést és 27-szer nagyobb átviteli sebességet ér el néhány népszerű LLM-nél az Intel GPU-n.”

Keresse meg a műszaki papír itt. Megjelent 2023 decemberében (előnyomat).

Wu, Hui, Yi Gan, Feng Yuan, Jing Ma, Wei Zhu, Yutao Xu, Hong Zhu, Yuhua Zhu, Xiaoli Liu és Jinghui Gu. "Hatékony LLM következtetési megoldás Intel GPU-n." arXiv preprint arXiv:2401.05391 (2023).

Kapcsolódó olvasás

LLM következtetés a CPU-kra (Intel)

Az Intel kutatói megjelentettek egy műszaki cikket „Efficient LLM Inference on CPUs” címmel.

AI Races To The Edge

A következtetést és a képzést a kisebb eszközökre tolják át, ahogy az AI terjed az új alkalmazásokban.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://semiengineering.com/llm-inference-on-gpus-intel/

- :is

- $ UP

- 2023

- a

- hozzáférés

- ér

- AI

- Is

- an

- és a

- alkalmazások

- VANNAK

- AS

- At

- alapján

- válik

- óta

- hogy

- by

- cache

- kihívást

- képest

- VÁLLALAT

- szabott

- dátum

- december

- Design

- tervezett

- eszköz

- Eszközök

- Hatékony

- hatékonyság

- hatékony

- nagyít

- Fields

- A

- Frekvencia

- összeolvad

- magfúzió

- GPU

- GPU

- Legyen

- segít

- itt

- Magas

- <p></p>

- Hong

- FORRÓ

- azonban

- HTTPS

- HuggingFace

- végre

- végrehajtás

- javul

- in

- Intel

- IT

- jpg

- Tart

- nyelv

- nagy

- Késleltetés

- réteg

- llm

- Elő/Utó

- alacsonyabb

- Gyártás

- vezetés

- sok

- tömeges

- Mérkőzés

- Memory design

- Mód

- modell

- modellek

- mozgalom

- Új

- of

- on

- nyitva

- Művelet

- mi

- Papír

- teljesít

- fizikai

- Plató

- Platón adatintelligencia

- PlatoData

- politika

- Népszerű

- javasol

- javasolt

- nyilvánosan

- közzétesz

- közzétett

- meglökött

- lóverseny

- igazi

- csökkenteni

- kérni

- kutatók

- válasz

- részes

- különálló

- egyszerűsítése

- Méret

- kisebb

- megoldások

- néhány

- Kenhető

- standard

- struktúra

- rendszer

- Feladat

- Műszaki

- A

- ezt

- áteresztőképesség

- címmel

- nak nek

- jelképes

- tokenek

- téma

- Képzések

- használt

- rendszerint

- volt

- we

- széles körben

- val vel

- Yuan

- zephyrnet