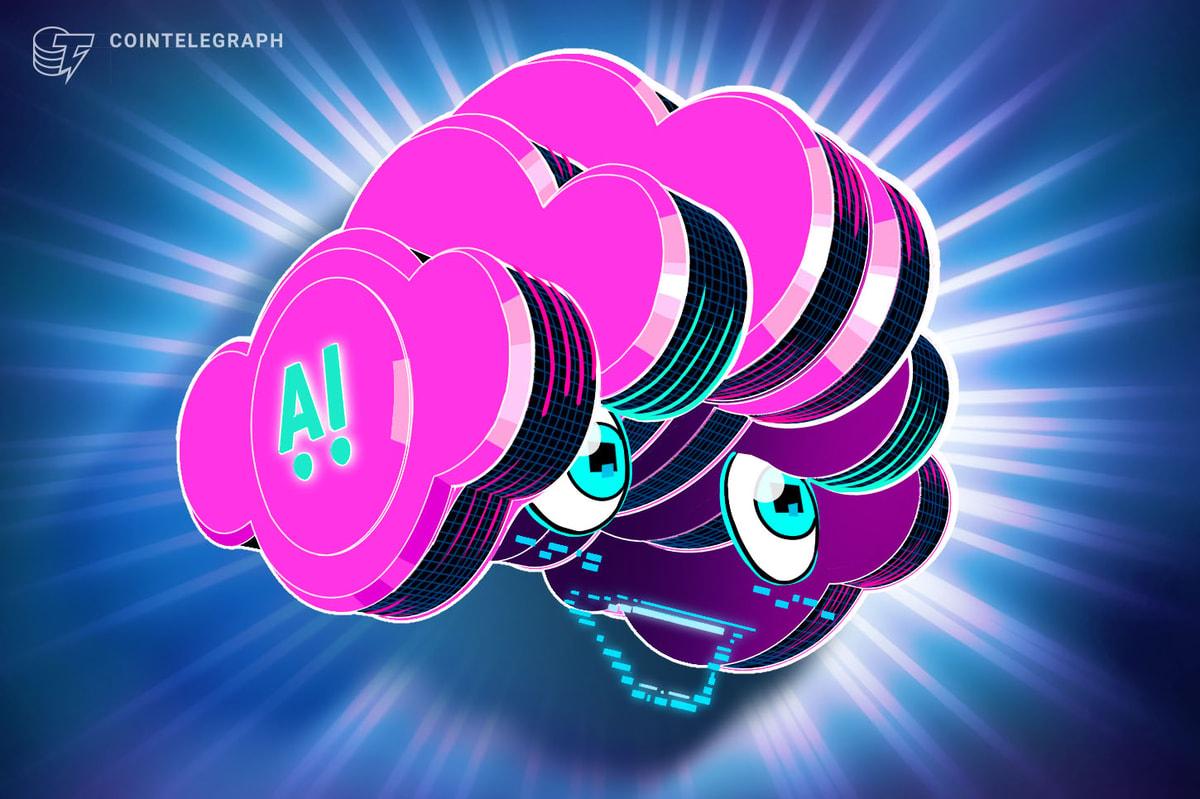

Az Egyesült Államok, az Egyesült Királyság, Ausztrália és 15 másik ország globális irányelveket adott ki, amelyek segítenek megvédeni a mesterséges intelligencia-modelleket a manipulációtól, és arra ösztönzik a vállalatokat, hogy tegyék biztonságossá modelljeit.

November 26-án a 18 ország 20 oldalas kiadványt adott ki dokumentum felvázolják, hogy az AI-cégeknek miként kell kezelniük kiberbiztonságukat AI-modellek fejlesztése vagy használata során, mivel azt állították, hogy „a biztonság gyakran másodlagos szempont lehet” a felgyorsult iparágban.

Az irányelvek többnyire általános ajánlásokat tartalmaztak, mint például a mesterséges intelligencia-modell infrastruktúrájának szoros láncolatának fenntartása, a modellek kibocsátása előtti és utáni manipulációinak megfigyelése, valamint a személyzet kiberbiztonsági kockázatokkal kapcsolatos képzése.

Izgalmas hírek! Egyesítettük erőinket @NCSC és 21 nemzetközi partnerrel az „Irányelvek a biztonságos AI-rendszerfejlesztéshez” kidolgozására! Ez egy operatív együttműködés a biztonságos mesterséges intelligencia érdekében a digitális korban: https://t.co/DimUhZGW4R#AISbiztonság #SecureByDesign pic.twitter.com/e0sv5ACiC3

– Kiberbiztonsági és Infrastruktúra-biztonsági Ügynökség (@CISAgov) November 27, 2023

Nem említettek bizonyos vitás kérdéseket a mesterséges intelligencia terén, beleértve azt sem, hogy milyen lehetséges vezérlőelemek kellenek a használat körül képgeneráló modellek és mélyhamisítványok vagy az adatgyűjtési módszerek és a képzési modellekben való felhasználás – ez a probléma látható több mesterségesintelligencia-cég beperelte a szerzői jogok megsértése miatti keresetekről.

Alejandro Mayorkas, az Egyesült Államok belbiztonsági minisztere: „A mesterséges intelligencia fejlesztésének inflexiós pontján vagyunk, amely korunk legkövetkezményesebb technológiája lehet. mondott nyilatkozatban. „A kiberbiztonság kulcsfontosságú a biztonságos, biztonságos és megbízható AI-rendszerek felépítésében.”

Az iránymutatások más kormányzati kezdeményezéseket követnek, amelyek hatással vannak az AI-ra, beleértve a kormányokat és az AI-cégeket találkozó az AI biztonsági csúcstalálkozón a hónap elején Londonban, hogy koordinálják a mesterséges intelligencia fejlesztéséről szóló megállapodást.

Eközben az Európai Unió az részletek kivonatolása A világűrt felügyelő mesterségesintelligencia-törvényben foglaltaknak megfelelően, Joe Biden amerikai elnök pedig októberben végrehajtó rendeletet adott ki, amely szabványokat határoz meg a mesterséges intelligencia biztonságára és biztonságára vonatkozóan – bár mindkettő látták a visszaszorítást az AI-ipar részéről, azt állítva, hogy elfojthatják az innovációt.

Az új „beépített biztonságos” irányelvek további aláírói közé tartozik Kanada, Franciaország, Németország, Izrael, Olaszország, Japán, Új-Zéland, Nigéria, Norvégia, Dél-Korea és Szingapúr. Az AI cégek, köztük az OpenAI, a Microsoft, a Google, az Anthropic és a Scale AI szintén hozzájárultak az irányelvek kidolgozásához.

- SEO által támogatott tartalom és PR terjesztés. Erősödjön még ma.

- PlatoData.Network Vertical Generative Ai. Erősítse meg magát. Hozzáférés itt.

- PlatoAiStream. Web3 Intelligence. Felerősített tudás. Hozzáférés itt.

- PlatoESG. Carbon, CleanTech, Energia, Környezet, Nap, Hulladékgazdálkodás. Hozzáférés itt.

- PlatoHealth. Biotechnológiai és klinikai vizsgálatok intelligencia. Hozzáférés itt.

- Forrás: https://cointelegraph.com/news/us-britain-countries-ink-ai-cybersecurity-guidelines-secure-by-design

- :is

- 15%

- 26

- 27

- a

- törvény

- Akció

- Után

- kor

- ügynökség

- Megállapodás

- AI

- AI törvény

- AI modellek

- AI rendszerek

- Is

- an

- és a

- és az infrastruktúra

- Antropikus

- bármilyen

- VANNAK

- körül

- mesterséges

- mesterséges intelligencia

- AS

- At

- Ausztrália

- Rossz

- BE

- előtt

- hogy

- Biden

- mindkét

- Britannia

- Épület

- by

- TUD

- Kanada

- bizonyos

- azt állította,

- követelő

- követelések

- koalíció

- Cointelegraph

- együttműködés

- gyűjtemény

- Companies

- következményes

- hozzájárultak

- ellenőrzések

- koordináta

- copyright

- szerzői jogok megsértése

- tudott

- országok

- crypto

- Kiberbiztonság

- Kiberbiztonsági és Infrastruktúra-biztonsági Ügynökség

- dátum

- mély

- Design

- Fejleszt

- fejlesztése

- Fejlesztés

- digitális

- digitális korban

- Korábban

- él

- EU

- európai

- európai unió

- végrehajtó

- végrehajtási utasítás

- szem

- pörgős

- cégek

- következik

- A

- erők

- Franciaország

- ból ből

- általános

- Németország

- Globális

- Kormány

- A kormányok

- irányelvek

- fogantyú

- Legyen

- segít

- haza

- Homeland Security

- Hogyan

- HTTPS

- in

- tartalmaz

- Beleértve

- ipar

- ragozás

- Inflexiós pont

- Infrastruktúra

- megsértése

- kezdeményezések

- Innováció

- Intelligencia

- Nemzetközi

- Izrael

- kérdés

- Kiadott

- kérdések

- Olaszország

- ITS

- Japán

- joe

- Joe Biden

- csatlakozott

- jpg

- Kulcs

- Királyság

- korea

- London

- fenntartása

- csinál

- Lehet..

- említett

- mód

- microsoft

- modellek

- ellenőrzés

- Hónap

- a legtöbb

- többnyire

- NCSC

- Új

- Új-Zéland

- Nigéria

- Norvégia

- november

- október

- of

- gyakran

- on

- OpenAI

- operatív

- or

- érdekében

- Más

- mi

- ki

- felvázolva

- Felügyelje

- partnerek

- Plató

- Platón adatintelligencia

- PlatoData

- pont

- lehetséges

- elnök

- elnök joe biden

- védelme

- igazi

- ajánlások

- engedje

- felszabaduló

- kockázatok

- Vetélytárs

- s

- biztonságos

- Biztonság

- Biztonság és védelem

- Skála

- skála ai

- másodlagos

- titkár

- biztonság

- biztonság

- látott

- készlet

- kellene

- Szingapúr

- Dél

- Dél-Korea

- Hely

- Személyzet

- szabványok

- nyilatkozat

- Államok

- elfojtani

- ilyen

- rendszer

- Systems

- tech

- Technológia

- hogy

- A

- azok

- Ott.

- ők

- ezt

- bár?

- idő

- nak nek

- Képzések

- megbízható

- nekünk

- unió

- Egyesült

- Egyesült Királyság

- Egyesült Államok

- sürgetve

- us

- használ

- használ

- segítségével

- figyelmeztet

- we

- mérjünk

- JÓL

- voltak

- Mit

- amikor

- ami

- lesz

- val vel

- -Zéland

- zephyrnet