Image de Bing Image Creator

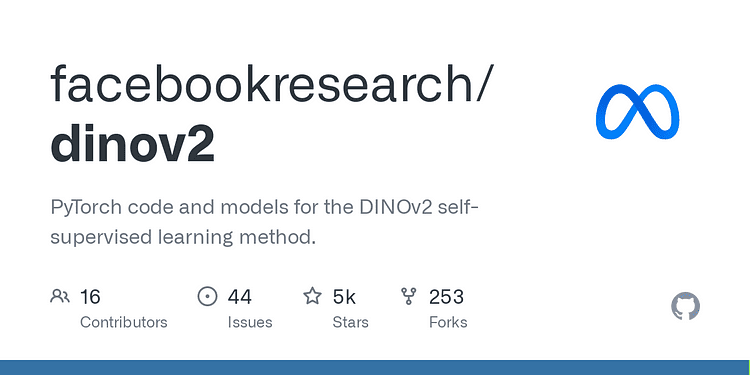

Meta AI vient de sortir l'open-source Modèles DINv2 la première méthode qui utilise l'apprentissage auto-supervisé pour former des modèles de vision par ordinateur. Les modèles DINOv2 obtiennent des résultats qui correspondent ou sont même meilleurs que l'approche standard et les modèles sur le terrain.

Les modèles ont atteint de solides performances sans qu'il soit nécessaire de les affiner, ce qui en fait un choix parfait pour de nombreuses tâches et applications de vision par ordinateur différentes. DINOv2 peut apprendre à partir de diverses collections d'images et de fonctionnalités telles que l'estimation de la profondeur sans avoir besoin d'une formation explicite grâce à la méthode de formation auto-supervisée.

Figure 1 : DINOv2 : modèles de vision par ordinateur auto-supervisés par Meta AI

1.1. Aucun réglage fin n'est nécessaire

L'apprentissage auto-supervisé est une méthode puissante utilisée pour former des modèles d'apprentissage automatique sans avoir besoin de grandes quantités de données étiquetées. Les modèles DINOv2 peuvent être formés sur un corpus d'images sans avoir besoin de métadonnées associées, de hashtag spécifique ou de légende d'image. Les modèles DinoV2, contrairement à plusieurs approches récentes d'apprentissage auto-supervisé, ne nécessitent pas de réglage fin, produisant ainsi des fonctionnalités hautes performances pour différentes applications de vision par ordinateur.

1.2. Surmonter les limites des annotations humaines

Au cours des dernières années, préformation image-texte est devenue la méthode prédominante pour diverses applications de vision par ordinateur. Cependant, en raison de sa dépendance aux légendes étiquetées par l'homme pour apprendre la signification sémantique des images. Cette approche néglige souvent des informations cruciales qui ne sont pas explicitement incluses dans ces légendes. Par exemple, une légende d'étiquette humaine d'une image d'une table rouge dans une pièce jaune pourrait être "Une table en bois rouge". Cette légende manquera des informations importantes sur l'arrière-plan, la position et la taille du tableau. Cela entraînera un manque de compréhension des informations locales et se traduira par de mauvaises performances sur les tâches qui nécessitent des informations de localisation détaillées.

De plus, le besoin d'étiquettes et d'annotations humaines limitera la quantité de données que nous pouvons collecter pour former les modèles. Cela devient beaucoup plus difficile pour certaines applications, par exemple l'annotation d'une cellule nécessite un certain niveau d'expertise humaine qui ne sera pas disponible à l'échelle requise. L'utilisation d'une approche de formation auto-supervisée sur l'imagerie cellulaire ouvre la voie à un modèle plus fondamental et, par conséquent, améliorera découverte biologique. Il en va de même pour des domaines avancés similaires, car l'estimation de densité animale.

Passer de DINO à DINOv2 a nécessité de surmonter plusieurs défis tels que

- Création d'un ensemble de données d'entraînement volumineux et organisé

- Amélioration de l'algorithme de formation et de la mise en œuvre

- Conception d'une canalisation de distillation fonctionnelle.

Figure 2 : Comparaison DINO v1 Vs v2 de la précision de segmentation

2.1. Création d'un ensemble de données d'images volumineux, organisé et diversifié

L'une des principales étapes de la construction du DINOv2 consiste à former des architectures et des modèles plus grands pour améliorer les performances du modèle. Cependant, les modèles plus grands nécessitent de grands ensembles de données pour être formés efficacement. Comme il n'y avait pas de grands ensembles de données disponibles répondant aux exigences, les chercheurs ont exploité des données Web explorées publiquement et ont construit un pipeline pour sélectionner uniquement les données utiles comme dans LASER.

Cependant, deux tâches principales doivent être effectuées pour pouvoir utiliser ces ensembles de données :

- Équilibrer les données entre différents concepts et tâches

- Supprimer les images non pertinentes

Comme cette tâche peut être accomplie manuellement, ils ont organisé un ensemble d'images de départ à partir d'environ 25 ensembles de données tiers et l'ont étendu en récupérant des images étroitement liées à ces images de départ. Cette approche leur a permis de produire un ensemble de données pertinentes d'un total de 142 millions d'images sur 1.2 milliard d'images.

2.2. Améliorations algorithmiques et techniques

Bien que l'utilisation de modèles et d'ensembles de données plus volumineux conduise à de meilleurs résultats, cela s'accompagne de défis majeurs. Deux des principaux défis sont l'instabilité potentielle et le fait de rester docile pendant l'entraînement. Pour rendre la formation plus stable, DINOv2 inclut des méthodes de régularisation supplémentaires inspirées de recherche de similitude ainsi que classification Littérature.

Le processus de formation de DINOv2 intègre les dernières implémentations de formation à précision mixte et distribuées fournies par les technologies de pointe PyTorche 2. Cela a permis une mise en œuvre plus rapide des codes et l'utilisation du même matériel pour la formation des modèles DINO a entraîné le double de la vitesse et un tiers de l'utilisation de la mémoire, ce qui a permis une mise à l'échelle des données et de la taille du modèle.

2.3. Diminution du temps d'inférence à l'aide de modèles de distillation

L'exécution de grands modèles en inférence nécessite un matériel puissant qui limitera l'utilisation pratique des méthodes pour différents cas d'utilisation. Pour surmonter ce problème, les chercheurs ont utilisé la distillation de modèles pour compresser les connaissances des grands modèles en plus petits. En utilisant cette approche, les chercheurs ont pu condenser des architectures hautes performances en architectures plus petites avec des coûts de performance négligeables. Cela a abouti à de solides modèles ViT-Small, ViT-Base et ViT-Large.

Le code de formation et d'évaluation nécessite PyTorch 2.0 et xFormers 0.0.18 ainsi que de nombreux autres packages tiers et le code attend également un environnement Linux. Les instructions suivantes expliquent comment configurer toutes les dépendances nécessaires à des fins de formation et d'évaluation :

- Installez PyTorch en suivant les instructions ici. Il est conseillé d'installer PyTorch avec le support CUDA.

- Télécharger compter

- Clonez le dépôt DINOv2 à l'aide de la commande suivante :

Code par auteur

- Procédez à la création et à l'activation d'un environnement Conda nommé "dinov2" en utilisant la définition d'environnement fournie :

Code par auteur

- Pour installer les dépendances requises pour ce projet, utilisez le fichier requirements.txt fourni.

Code par auteur

- Enfin, vous pouvez charger les modèles en utilisant le code ci-dessous :

Code par auteur

En conclusion, la sortie des modèles DINOv2 par Meta AI marque une étape importante. L'approche d'apprentissage auto-supervisé utilisée par les modèles DINOv2 fournit un moyen puissant de former des modèles d'apprentissage automatique sans avoir besoin de grandes quantités de données étiquetées. Avec la possibilité d'atteindre une grande précision sans nécessiter de réglage fin, ces modèles conviennent à diverses tâches et applications de vision par ordinateur. De plus, DINOv2 peut apprendre de différentes collections d'images et peut apprendre de fonctionnalités telles que l'estimation de la profondeur sans formation explicite. La disponibilité de DINOv2 en tant que modèle open source ouvre la porte aux chercheurs et aux développeurs pour explorer de nouvelles possibilités dans les tâches et les applications de vision par ordinateur.

Bibliographie

Youssef Rafat est un chercheur en vision par ordinateur et un scientifique des données. Ses recherches portent sur le développement d'algorithmes de vision par ordinateur en temps réel pour les applications de soins de santé. Il a également travaillé comme data scientist pendant plus de 3 ans dans le domaine du marketing, de la finance et de la santé.

- Contenu propulsé par le référencement et distribution de relations publiques. Soyez amplifié aujourd'hui.

- PlatoAiStream. Intelligence des données Web3. Connaissance Amplifiée. Accéder ici.

- Frapper l'avenir avec Adryenn Ashley. Accéder ici.

- Achetez et vendez des actions de sociétés PRE-IPO avec PREIPO®. Accéder ici.

- La source: https://www.kdnuggets.com/2023/05/dinov2-selfsupervised-computer-vision-models-meta-ai.html?utm_source=rss&utm_medium=rss&utm_campaign=dinov2-self-supervised-computer-vision-models-by-meta-ai

- :possède

- :est

- :ne pas

- 1

- 1.2 milliards

- 3rd

- a

- capacité

- Capable

- A Propos

- accompli

- atteindre

- atteint

- à travers

- Supplémentaire

- Avancée

- AI

- algorithme

- algorithmique

- algorithmes

- Tous

- aussi

- montant

- quantités

- an

- ainsi que

- animal

- applications

- une approche

- approches

- d'environ

- SONT

- AS

- At

- disponibilité

- disponibles

- fond

- BE

- devenez

- devient

- ci-dessous

- Améliorée

- Milliards

- Bing

- Développement

- construit

- by

- CAN

- légendes

- cas

- Causes

- certaines

- globaux

- le choix

- étroitement

- code

- recueillir

- collections

- vient

- Comparaison

- ordinateur

- Vision par ordinateur

- Applications de vision par ordinateur

- concepts

- conclusion

- Costs

- engendrent

- La création

- crucial

- organisée

- données

- Data Scientist

- ensembles de données

- Demande

- dépendance

- profondeur

- détaillé

- mobiles

- développement

- différent

- distribué

- formation distribuée

- plusieurs

- do

- domaine

- fait

- portes

- double

- deux

- pendant

- efficacement

- de renforcer

- Environment

- Ether (ETH)

- évaluation

- Pourtant, la

- exemple

- étendu

- attend

- nous a permis de concevoir

- explorez

- plus rapide

- Fonctionnalités:

- few

- champ

- Des champs

- Déposez votre dernière attestation

- finance

- Prénom

- se concentre

- Abonnement

- Pour

- De

- fonctionnel

- gif

- Matériel

- hashtag

- he

- la médecine

- Haute

- haute performance

- sa

- Comment

- How To

- Cependant

- HTML

- HTTPS

- humain

- image

- satellite

- la mise en oeuvre

- important

- in

- inclus

- inclut

- d'information

- inspiré

- instabilité

- installer

- Des instructions

- Intègre

- développement

- IT

- SES

- juste

- KDnuggetsGenericName

- spécialisées

- Libellé

- Etiquettes

- Peindre

- gros

- plus importantes

- Nouveautés

- conduire

- APPRENTISSAGE

- apprentissage

- Niveau

- LIMIT

- linux

- littérature

- charge

- locales

- Localisation

- click

- machine learning

- Entrée

- majeur

- a prendre une

- FAIT DU

- manuellement

- de nombreuses

- Stratégie

- Match

- sens

- Découvrez

- Mémoire

- Meta

- Métadonnées

- méthode

- méthodes

- pourrait

- étape importante

- million

- modèle

- numériques jumeaux (digital twin models)

- PLUS

- Par ailleurs

- beaucoup

- Nommé

- nécessaire

- Besoin

- Nouveauté

- aucune

- of

- souvent

- on

- et, finalement,

- uniquement

- open source

- ouvre

- or

- Autre

- ande

- contour

- Overcome

- Forfaits

- fête

- passé

- parfaite

- performant

- PHP

- image

- pipeline

- Platon

- Intelligence des données Platon

- PlatonDonnées

- pauvres

- position

- possibilités

- défaillances

- solide

- Méthode

- Problème

- processus

- produire

- Projet

- à condition de

- fournit

- publiquement

- des fins

- pytorch

- en temps réel

- récent

- Rouge

- en relation

- libérer

- libéré

- restant

- dépôt

- exigent

- conditions

- Exigences

- a besoin

- un article

- chercheur

- chercheurs

- résultat

- Résultats

- Salle

- s

- même

- Escaliers intérieurs

- mise à l'échelle

- Scientifique

- seed

- segmentation

- set

- plusieurs

- devrait

- significative

- similaires

- depuis

- Taille

- faibles

- quelques

- groupe de neurones

- vitesse

- stable

- Standard

- Étapes

- STRONG

- tel

- convient

- Support

- table

- Tâche

- tâches

- Technique

- que

- à

- qui

- La

- Les

- Là.

- Ces

- l'ont

- Troisièmement

- des tiers.

- this

- ceux

- fiable

- à

- Total

- Train

- qualifié

- Formation

- deux

- compréhension

- contrairement à

- Utilisation

- utilisé

- d'utiliser

- en utilisant

- utiliser

- Utilisant

- v1

- divers

- vision

- vs

- Façon..

- we

- web

- WELL

- ont été

- qui

- sera

- comprenant

- sans

- en bois

- travaillé

- années

- you

- zéphyrnet

![Comment accélérer les requêtes SQL à l'aide d'index [Python Edition] - KDnuggets](https://platoaistream.com/wp-content/uploads/2023/08/how-to-speed-up-sql-queries-using-indexes-python-edition-kdnuggets-300x169.png)