Kuva tekijältä

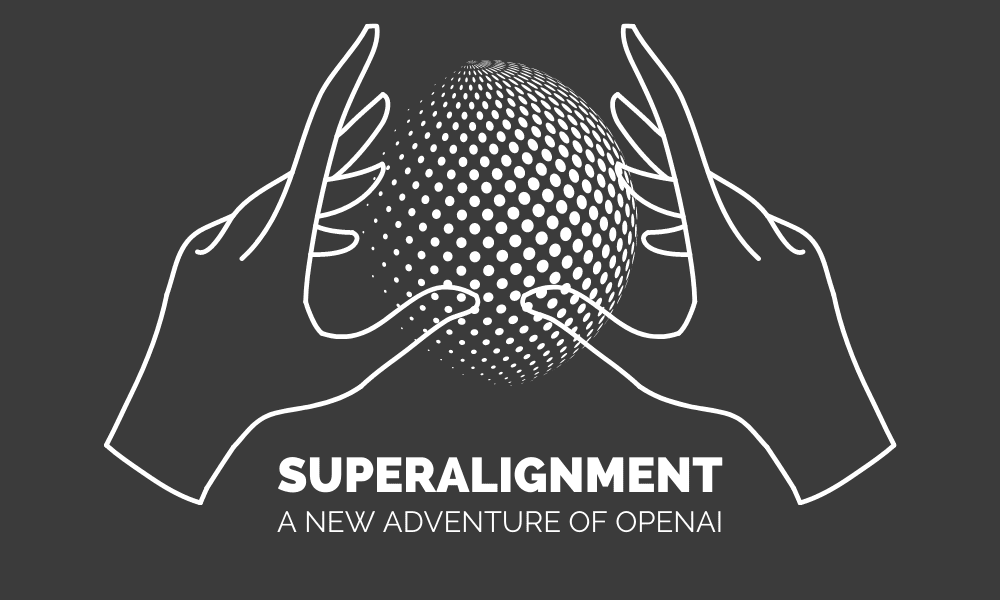

Yliälyllä on potentiaalia olla merkittävin teknologinen edistysaskel ihmiskunnan historiassa. Se voi auttaa meitä selviytymään joistakin ihmiskunnan kohtaamista kiireellisimmistä haasteista. Vaikka se voi saada aikaan uuden edistyksen aikakauden, se sisältää myös tiettyjä luontaisia riskejä, joita on käsiteltävä varoen. Yliäly voi heikentää ihmiskunnan voimaa tai jopa johtaa ihmisten sukupuuttoon, jos sitä ei käsitellä tai kohdisteta oikein.

Vaikka superäly saattaa tuntua kaukaiselta, monet asiantuntijat uskovat, että siitä voi tulla todellisuutta lähivuosina. Mahdollisten riskien hallitsemiseksi meidän on luotava uusia hallintoelimiä ja käsiteltävä superälykkyyden yhdenmukaistamisen kriittistä kysymystä. Se tarkoittaa sen varmistamista, että tekoälyjärjestelmät, jotka pian ylittävät ihmisälyn, pysyvät linjassa ihmisten tavoitteiden ja aikomusten kanssa.

Tässä blogissa opimme Superalignmnetistä ja opimme OpenAI:n lähestymistavasta ratkaisemaan superälykkyyden kohdistuksen tekniset ydinhaasteet.

Superalignmentilla tarkoitetaan sen varmistamista, että supertekoälyjärjestelmät, jotka ylittävät ihmisälyn kaikilla aloilla, toimivat inhimillisten arvojen ja tavoitteiden mukaisesti. Se on keskeinen käsite tekoälyn turvallisuuden ja hallinnan alalla, ja se pyrkii käsittelemään riskejä, jotka liittyvät erittäin kehittyneen tekoälyn kehittämiseen ja käyttöönottoon.

Tekoälyjärjestelmien muuttuessa älykkäämmiksi ihmisten voi olla haastavampaa ymmärtää, miten he tekevät päätöksiä. Se voi aiheuttaa ongelmia, jos tekoäly toimii tavalla, joka on vastoin inhimillisiä arvoja. Tämä ongelma on välttämätöntä käsitellä haitallisten seurausten välttämiseksi.

Superalignment varmistaa, että superälykkäät tekoälyjärjestelmät toimivat tavalla, joka on linjassa ihmisten arvojen ja aikomusten kanssa. Se edellyttää ihmisten mieltymysten tarkkaa määrittelyä, niitä ymmärtävien tekoälyjärjestelmien suunnittelua ja mekanismien luomista sen varmistamiseksi, että tekoälyjärjestelmät noudattavat näitä tavoitteita.

Superalignmentilla on ratkaiseva rooli superälyyn liittyvien mahdollisten riskien torjunnassa. Pohditaan syitä, miksi tarvitsemme Superalignmentin:

- Rogue AI -skenaarioiden lieventäminen: Superkohdistaminen varmistaa, että superälykkäät tekoälyjärjestelmät ovat linjassa ihmisen aikomusten kanssa, mikä vähentää hallitsemattoman käyttäytymisen ja mahdollisten haittojen riskejä.

- Inhimillisten arvojen turvaaminen: Kohdistamalla tekoälyjärjestelmät inhimillisten arvojen kanssa Superalignment estää konflikteja, joissa superälykäs tekoäly saattaa priorisoida tavoitteita, jotka ovat ristiriidassa yhteiskunnallisten normien ja periaatteiden kanssa.

- Ei-toivottujen seurausten välttäminen: Superalignment-tutkimus tunnistaa ja lieventää edistyneistä tekoälyjärjestelmistä mahdollisesti aiheutuvia tahattomia haittavaikutuksia ja minimoi mahdolliset haittavaikutukset.

- Ihmisen autonomian varmistaminen: Superalignment keskittyy suunnittelemaan tekoälyjärjestelmiä arvokkaiksi työkaluiksi, jotka lisäävät ihmisen kykyjä, säilyttävät autonomiamme ja estävät liiallista riippuvuutta tekoälypäätöksenteosta.

- Hyödyllisen tekoälyn tulevaisuuden rakentaminen: Superalignment-tutkimuksen tavoitteena on luoda tulevaisuus, jossa superälykkäät tekoälyjärjestelmät edistävät ihmisten hyvinvointia ja vastaavat globaaleihin haasteisiin ja minimoivat riskejä.

OpenAI rakentaa ihmistason automatisoitua kohdistustutkijaa, joka käyttää valtavia määriä laskentaa skaalatakseen ponnisteluja ja kohdistaakseen superälyn iteratiivisesti – Esittelyssä Superalignment (openai.com).

Ensimmäisen automaattisen kohdistustutkijan kohdistamiseksi OpenAI:n on:

- Kehitä skaalautuva harjoitusmenetelmä: OpenAI voi käyttää tekoälyjärjestelmiä arvioidakseen muita tekoälyjärjestelmiä vaikeissa tehtävissä, joita ihmisten on vaikea arvioida.

- Vahvista tuloksena oleva malli: OpenAI automatisoi ongelmallisen käyttäytymisen ja ongelmallisten sisäosien haun.

- Vastuullinen testaus: Testaa tekoälyjärjestelmää harjoittelemalla tarkoituksella väärin kohdistettuja malleja ja varmista, että käytetyillä menetelmillä voidaan tunnistaa putkilinjan vakavimmatkin kohdistusvirheet.

Joukkue

OpenAI muodostaa tiimin vastaamaan superälykkyyden mukauttamisen haasteeseen. He käyttävät 20 prosenttia laskentaresursseistaan seuraavien neljän vuoden aikana. Tiimiä johtavat Ilja Sutskever ja Jan Leike, ja siihen kuuluu jäseniä aiemmista linjausryhmistä ja muista yhtiön osastoista.

OpenAI etsii parhaillaan poikkeuksellisia tutkijoita ja insinöörejä osallistumaan tehtäväänsä. Superälyn kohdistamisen ongelma liittyy ensisijaisesti koneoppimiseen. Koneoppimisen asiantuntijat ovat ratkaisevassa roolissa ratkaisun löytämisessä, vaikka he eivät tällä hetkellä työskentelekin linjauksen parissa.

Tavoitteet

OpenAI on asettanut tavoitteekseen vastata superälykkyyden yhteensovittamisen teknisiin haasteisiin neljän vuoden sisällä. Vaikka tämä on kunnianhimoinen tavoite ja menestystä ei voida taata, OpenAI on edelleen optimistinen, että kohdennettu ja määrätietoinen ponnistelu voi johtaa ratkaisuun tähän ongelmaan.

Ongelman ratkaisemiseksi heidän on esitettävä vakuuttavia todisteita ja argumentteja koneoppimis- ja turvallisuusyhteisölle. Korkea luottamus ehdotettuihin ratkaisuihin on ratkaisevan tärkeää. Jos ratkaisut ovat epäluotettavia, yhteisö voi silti käyttää havaintoja suunnitteluun.

OpenAI:n Superalignment-aloitteella on suuri lupaus vastata superälykkyyden kohdistamisen haasteisiin. Alustavissa kokeiluissa syntyneiden lupaavien ideoiden ansiosta tiimillä on käytettävissään yhä hyödyllisempiä edistymismittareita ja se voi hyödyntää olemassa olevia tekoälymalleja tutkiakseen näitä ongelmia empiirisesti.

On tärkeää huomata, että Superalignment-tiimin ponnisteluja täydentää OpenAI:n jatkuva työ parantaakseen nykyisten mallien turvallisuutta, mukaan lukien laajalti käytetty ChatGPT. OpenAI on edelleen sitoutunut ymmärtämään ja lieventämään tekoälyyn liittyviä riskejä, kuten väärinkäyttöä, taloudellisia häiriöitä, disinformaatiota, ennakkoluuloja ja syrjintää, riippuvuutta ja liiallista riippuvuutta.

OpenAI pyrkii tasoittamaan tietä turvallisemmalle ja hyödyllisemmälle tekoälyn tulevaisuudelle omistautuneen tutkimuksen, yhteistyön ja ennakoivan lähestymistavan avulla.

Abid Ali Awan (@1abidaliawan) on sertifioitu datatieteilijä, joka rakastaa koneoppimismallien rakentamista. Tällä hetkellä hän keskittyy sisällöntuotantoon ja kirjoittaa teknisiä blogeja koneoppimisesta ja datatieteen teknologioista. Abidilla on maisterin tutkinto teknologiajohtamisesta ja kandidaatin tutkinto tietoliikennetekniikasta. Hänen visionsa on rakentaa tekoälytuote graafisen hermoverkon avulla opiskelijoille, jotka kamppailevat mielenterveysongelmista.

- SEO-pohjainen sisällön ja PR-jakelu. Vahvista jo tänään.

- PlatoData.Network Vertical Generatiivinen Ai. Vahvista itseäsi. Pääsy tästä.

- PlatoAiStream. Web3 Intelligence. Tietoa laajennettu. Pääsy tästä.

- PlatoESG. Autot / sähköautot, hiili, CleanTech, energia, ympäristö, Aurinko, Jätehuolto. Pääsy tästä.

- BlockOffsets. Ympäristövastuun omistuksen nykyaikaistaminen. Pääsy tästä.

- Lähde: https://www.kdnuggets.com/2023/07/superalignment-important.html?utm_source=rss&utm_medium=rss&utm_campaign=what-is-superalignment-why-it-is-important

- :on

- :On

- :ei

- :missä

- a

- Meistä

- pääsy

- Mukaan

- sen mukaisesti

- tarkasti

- Toimia

- säädökset

- riippuvuus

- osoite

- käsitellään

- kehittynyt

- edistäminen

- haitallinen

- vastaan

- AI

- AI-järjestelmät

- Tähtäimessä

- tavoitteet

- kohdista

- linjassa

- tasaus

- Kaikki

- jakaa

- Myös

- Vaikka

- kunnianhimoinen

- määrät

- an

- ja

- Kaikki

- lähestymistapa

- asianmukaisesti

- OVAT

- perustelut

- nousta

- keinotekoinen

- tekoäly

- Tekoäly (AI)

- AS

- arvioida

- liittyvä

- automatisoida

- Automatisoitu

- BE

- tulevat

- Uskoa

- suotuisa

- puolueellisuus

- Uutiset ja media

- blogit

- elimet

- tuoda

- rakentaa

- Rakentaminen

- by

- CAN

- kyvyt

- Aiheuttaa

- varovasti

- tietty

- Todistettu

- haaste

- haasteet

- haastava

- ChatGPT

- yhteistyö

- KOM

- sitoutunut

- yhteisö

- yritys

- Laskea

- tietojenkäsittely

- käsite

- luottamus

- Seuraukset

- pitoisuus

- sisällön luominen

- edistävät

- Ydin

- voisi

- luoda

- Luominen

- luominen

- kriittinen

- ratkaiseva

- Nykyinen

- Tällä hetkellä

- tiedot

- tietojenkäsittely

- tietojen tutkija

- Päätöksenteko

- päätökset

- omistautunut

- Aste

- osastot

- levityspinnalta

- suunnittelu

- määritetty

- kehittämällä

- vaikea

- syrjintä

- harhaanjohtavat tiedot

- Häiriö

- verkkotunnuksia

- Taloudellinen

- vaikutukset

- vaivaa

- ponnisteluja

- syntymässä

- Tekniikka

- Engineers

- varmistaa

- varmistaa

- varmistamalla

- Aikakausi

- olennainen

- Eetteri (ETH)

- arvioida

- Jopa

- näyttö

- poikkeuksellinen

- olemassa

- kokeiluja

- asiantuntijat

- asiantuntijat uskovat

- sammuminen

- kohtasi

- paljon

- harvat

- ala

- löytäminen

- tulokset

- Etunimi

- keskityttiin

- keskittyy

- tarkennus

- varten

- neljä

- alkaen

- tulevaisuutta

- saada

- Global

- Go

- tavoite

- Tavoitteet

- hallinto

- hallitseva

- kaavio

- Graafinen hermoverkko

- suuri

- taattu

- Kova

- vahingoittaa

- haitallinen

- ottaa

- he

- auttaa

- Korkea

- erittäin

- hänen

- historia

- pitää

- Miten

- HTTPS

- ihmisen

- ihmisen älykkyyttä

- Ihmiskunta

- Ihmiset

- ideoita

- tunnistaa

- tunnistaa

- if

- sairaus

- tärkeä

- parantaa

- in

- sisältää

- Mukaan lukien

- yhä useammin

- luontainen

- aloite

- Älykkyys

- Älykäs

- tahallisuus

- aikomukset

- tulee

- kysymys

- IT

- SEN

- Johannes

- KDnuggets

- johtaa

- OPPIA

- oppiminen

- Led

- Taso

- Vaikutusvalta

- rakastaa

- kone

- koneoppiminen

- tehdä

- hoitaa

- johto

- monet

- mestari

- Saattaa..

- välineet

- mekanismit

- Jäsenet

- henkinen

- Mielisairaus

- menetelmä

- menetelmät

- Metrics

- minimointia

- Tehtävä

- lieventävä

- malli

- mallit

- lisää

- eniten

- täytyy

- Tarve

- verkko

- hermo-

- neuroverkkomallien

- Uusi

- seuraava

- normit

- tavoite

- tavoitteet

- of

- pois

- on

- jatkuva

- OpenAI

- Optimistinen

- or

- Muut

- meidän

- tuloksiin

- yli

- tasoittaa

- putki

- suunnitelma

- Platon

- Platonin tietotieto

- PlatonData

- Pelaa

- soittaa

- aiheuttaa

- mahdollinen

- mieltymykset

- esittää

- säilöntä

- painamalla

- estää

- estää

- estää

- edellinen

- pääasiallisesti

- periaatteet

- Asettaa etusijalle

- Ennakoiva

- Ongelma

- ongelmia

- Tuotteet

- ammatillinen

- Edistyminen

- lupaus

- lupaava

- ehdotettu

- jatkaa

- Todellisuus

- syistä

- vähentämällä

- viittaa

- liittyvä

- jäädä

- jäännökset

- Vaatii

- tutkimus

- tutkija

- Tutkijat

- Esittelymateriaalit

- Saatu ja

- riskit

- Rooli

- s

- turvallisempaa

- Turvallisuus

- skaalautuva

- Asteikko

- skenaariot

- tiede

- Tiedemies

- Haku

- etsiä

- näyttää

- setti

- vaikea

- merkittävä

- yhteiskunnallinen

- ratkaisu

- Ratkaisumme

- SOLVE

- Solving

- jonkin verran

- Pian

- Yhä

- Struggling

- Opiskelijat

- tutkimus

- menestys

- niin

- suuri

- Yliopisto

- ylittää

- järjestelmä

- järjestelmät

- puuttua

- tehtävät

- joukkue-

- tiimit

- Tekninen

- teknologinen

- Technologies

- Elektroniikka

- tietoliikenne

- testi

- Testaus

- että

- -

- heidän

- Niitä

- Nämä

- ne

- tätä

- Kautta

- että

- työkalut

- koulutus

- ymmärtää

- ymmärtäminen

- us

- käyttää

- käytetty

- käyttämällä

- arvokas

- arvot

- eri

- valtava

- todentaa

- visio

- Tapa..

- tavalla

- we

- Mitä

- Mikä on

- joka

- vaikka

- KUKA

- miksi

- laajalti

- tulee

- with

- sisällä

- Referenssit

- työskentely

- kirjoittaminen

- vuotta

- zephyrnet