همه ما می خواهیم ارزش های انسانی ایده آل خود را در فناوری هایمان منعکس کنیم. ما انتظار داریم فناوری هایی مانند هوش مصنوعی (AI) به ما دروغ نگویند، تبعیض قائل نشوند و برای استفاده ما و فرزندانمان ایمن باشند. با این حال، بسیاری از سازندگان هوش مصنوعی در حال حاضر به دلیل سوگیریها، نادرستیها و شیوههای مشکلساز دادهای که در مدلهایشان آشکار میشود، با واکنشهای منفی مواجه هستند. این مسائل به چیزی بیش از یک راه حل فنی، الگوریتمی یا مبتنی بر هوش مصنوعی نیاز دارند. در واقع، یک رویکرد جامع، اجتماعی و فنی مورد نیاز است.

ریاضی یک حقیقت قدرتمند را نشان می دهد

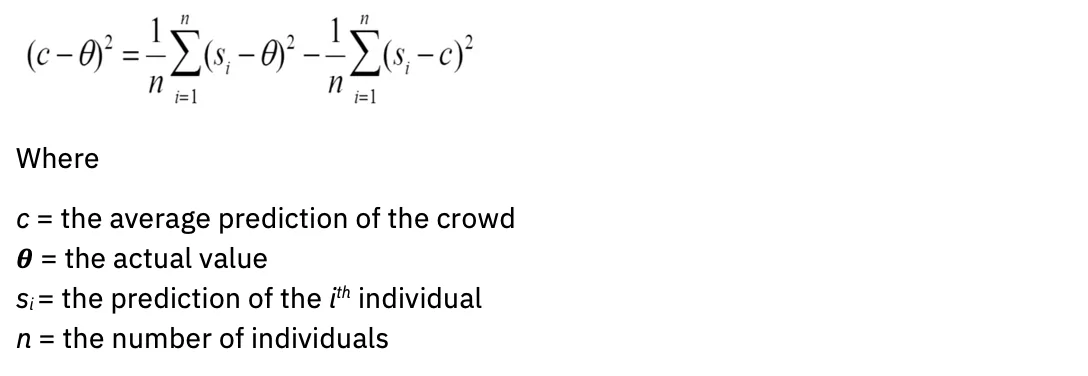

همه مدلهای پیشبینیکننده، از جمله هوش مصنوعی، زمانی دقیقتر هستند که از هوش و تجربه انسانی متنوعی استفاده کنند. این یک نظر نیست؛ اعتبار تجربی دارد. در نظر بگیرید قضیه پیش بینی تنوع. به زبان ساده، وقتی تنوع در یک گروه زیاد است، خطای جمعیت کوچک است - حمایت از مفهوم "خرد جمعیت". در یک مطالعه تاثیرگذار، نشان داده شد که گروههای متنوعی از حلکنندههای با توانایی پایین میتوانند از گروههای حلکنندههای با توانایی بالا بهتر عمل کنند.هانگ و پیج، 2004).

در زبان ریاضی: هرچه واریانس شما بیشتر باشد، میانگین شما استانداردتر است. معادله به شکل زیر است:

A مطالعه بیشتر محاسبات بیشتری ارائه کرد که تعاریف آماری یک جمعیت عاقل را اصلاح میکند، از جمله ناآگاهی از پیشبینیهای سایر اعضا و درج آنهایی که حداکثر متفاوت پیشبینیها یا قضاوتها (همبستگی منفی). بنابراین، این فقط حجم نیست، بلکه تنوع است که پیش بینی ها را بهبود می بخشد. چگونه ممکن است این بینش بر ارزیابی مدلهای هوش مصنوعی تأثیر بگذارد؟

دقت (نادرست) مدل

برای نقل قول رایج، همه مدل ها اشتباه هستند. این در زمینه های آمار، علم و هوش مصنوعی صادق است. مدل های ایجاد شده با عدم تخصص دامنه می تواند منجر به نادرست خروجی ها.

امروزه، یک گروه کوچک همگن از مردم تعیین میکنند که از چه دادههایی برای آموزش مدلهای هوش مصنوعی مولد استفاده کنند، که از منابعی گرفته میشود که تا حد زیادی انگلیسی را معرفی میکنند. "برای اکثر بیش از 6,000 زبان در جهان، داده های متنی موجود برای آموزش یک مدل پایه در مقیاس بزرگ کافی نیست" (از "در مورد فرصت ها و خطرات مدل های بنیادبومسنی و همکاران، 2022).

علاوه بر این، خود مدلها از معماریهای محدود ایجاد شدهاند: «تقریباً تمام مدلهای پیشرفته NLP اکنون از یکی از معدود مدلهای پایه، مانند BERT، RoBERTa، BART، T5 و غیره اقتباس شدهاند. اهرم بسیار بالا (هر گونه پیشرفت در مدل های پایه می تواند منجر به مزایای فوری در تمام NLP شود)، همچنین یک تعهد است. همه سیستم های هوش مصنوعی ممکن است همان سوگیری های مشکل ساز چند مدل پایه را به ارث ببرند (بومسنی و همکاران) "

برای اینکه هوش مصنوعی مولد جوامع متنوعی را که به آنها خدمت میکند منعکس کند، باید طیف گستردهتری از دادههای انسان در مدلها نشان داده شود.

ارزیابی دقت مدل با ارزیابی سوگیری همراه است. باید بپرسیم که هدف از مدل چیست و برای چه کسانی بهینه شده است؟ برای مثال در نظر بگیرید که چه کسی از الگوریتمهای توصیه محتوا و الگوریتمهای موتور جستجو بیشتر سود میبرد. ذینفعان ممکن است علایق و اهداف بسیار متفاوتی داشته باشند. الگوریتمها و مدلها به اهداف یا پروکسیهایی برای خطای Bayes نیاز دارند: حداقل خطایی که یک مدل باید بر اساس آن بهبود یابد. این پروکسی اغلب یک شخص است، مانند یک متخصص موضوع با تخصص دامنه.

یک چالش بسیار انسانی: ارزیابی ریسک قبل از تهیه یا توسعه مدل

مقررات و برنامههای اقدام در حال ظهور هوش مصنوعی به طور فزایندهای بر اهمیت فرمهای ارزیابی تأثیر الگوریتمی تأکید میکنند. هدف این فرمها جمعآوری اطلاعات حیاتی در مورد مدلهای هوش مصنوعی است تا تیمهای حاکمیتی بتوانند خطرات خود را قبل از استقرار آنها ارزیابی و رسیدگی کنند. سوالات معمولی عبارتند از:

- مورد استفاده مدل شما چیست؟

- خطرات ناشی از تأثیرات متفاوت چیست؟

- انصاف را چگونه ارزیابی می کنید؟

- چگونه مدل خود را قابل توضیح می کنید؟

اگرچه با نیت خوب طراحی شده است، اما مسئله این است که اکثر دارندگان مدل هوش مصنوعی نمیدانند که چگونه خطرات مورد استفاده خود را ارزیابی کنند. یک جملات متداول ممکن است این باشد: "اگر مدل من اطلاعات شناسایی شخصی (PII) را جمع آوری نمی کند، چگونه می تواند ناعادلانه باشد؟" در نتیجه، فرمها به ندرت با دقت لازم برای سیستمهای حاکمیتی تکمیل میشوند تا عوامل خطر را با دقت مشخص کنند.

بنابراین، ماهیت اجتماعی و فنی راه حل مورد تاکید قرار می گیرد. به صاحب مدل - یک فرد - نمی توان به سادگی فهرستی از چک باکس ها را برای ارزیابی اینکه آیا مورد استفاده آنها باعث آسیب می شود یا خیر، در اختیار او قرار داد. در عوض، آنچه مورد نیاز است این است که گروههایی از افراد با تجربیات مختلف زندگیشده در جهان در جوامعی که امنیت روانی ارائه میدهند گرد هم آیند تا گفتگوهای دشواری درباره تأثیرات متفاوت داشته باشند.

استقبال از دیدگاه های گسترده تر برای هوش مصنوعی قابل اعتماد

IBM به اتخاذ رویکرد «مشتری صفر» معتقد است، توصیهها و سیستمهایی را که برای مشتریان خود در سراسر راهحلهای مشاوره و محصول هدایت میکند، پیادهسازی میکند. این رویکرد به شیوههای اخلاقی گسترش مییابد، به همین دلیل است که IBM یک مرکز تعالی هوش مصنوعی قابل اعتماد (COE) ایجاد کرد.

همانطور که در بالا توضیح داده شد، تنوع تجربیات و مجموعه مهارتها برای ارزیابی صحیح تأثیرات هوش مصنوعی حیاتی است. اما چشم انداز شرکت در یک مرکز تعالی می تواند در شرکتی که پر از مبتکران، متخصصان و مهندسان برجسته هوش مصنوعی است، ترسناک باشد، بنابراین ایجاد جامعه ای از امنیت روانی مورد نیاز است. آیبیام این موضوع را با گفتن این جمله به وضوح بیان میکند: «به هوش مصنوعی علاقهمندی؟ به اخلاق هوش مصنوعی علاقه دارید؟ شما روی این میز یک صندلی دارید.»

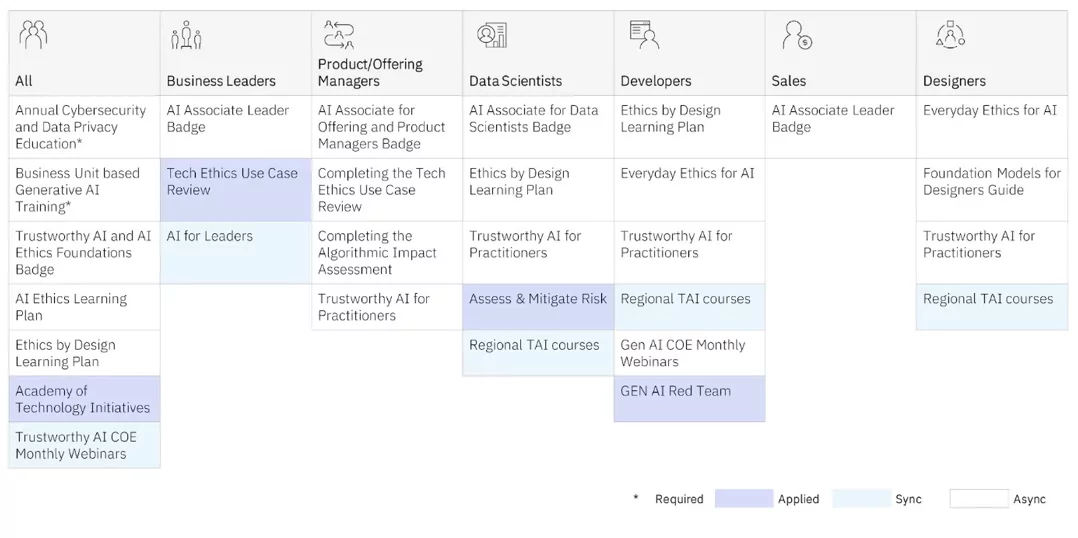

COE آموزش اخلاق هوش مصنوعی را به شاغلین در هر سطح ارائه می دهد. هم برنامه های یادگیری همزمان (معلم و دانش آموزان در محیط کلاس) و هم برنامه های ناهمزمان (خود هدایت شونده) ارائه می شود.

اما این COE است اعمال می شود آموزشهایی که به پزشکان ما عمیقترین بینشها را میدهد، زیرا آنها با تیمهای جهانی، متنوع و چند رشتهای روی پروژههای واقعی کار میکنند تا تأثیرات متفاوت را بهتر درک کنند. آنها همچنین از چارچوب های تفکر طراحی IBM استفاده می کنند طراحی برای هوش مصنوعی گروه به صورت داخلی و با مشتریان برای ارزیابی اثرات ناخواسته مدلهای هوش مصنوعی استفاده میکند و افرادی را که اغلب به حاشیه رانده میشوند، در ذهن خود نگه میدارد. (به کتاب سیلویا داکورت مراجعه کنید چرخ قدرت و امتیاز برای مثال هایی از نحوه تلاقی ویژگی های شخصی برای امتیاز دادن یا به حاشیه راندن افراد.) IBM همچنین بسیاری از چارچوب ها را به جامعه منبع باز اهدا کرد. طراحی اخلاقی.

در زیر تعدادی از گزارشاتی که IBM به صورت عمومی در مورد این پروژه ها منتشر کرده است آورده شده است:

ابزارهای مدیریت مدل هوش مصنوعی خودکار برای به دست آوردن بینش های مهم در مورد نحوه عملکرد مدل هوش مصنوعی شما مورد نیاز است. اما توجه داشته باشید، گرفتن ریسک قبل از توسعه و تولید مدل شما بهینه است. با ایجاد جوامعی از پزشکان متنوع و چند رشته ای که فضای امنی را برای افراد فراهم می کند تا مکالمات سختی در مورد تأثیرات متفاوت داشته باشند، می توانید سفر خود را برای عملیاتی کردن اصول خود آغاز کنید و هوش مصنوعی را مسئولانه توسعه دهید.

در عمل، زمانی که برای متخصصان هوش مصنوعی استخدام میکنید، در نظر بگیرید که بیش از 70 درصد تلاش برای ایجاد مدلها، تنظیم دادههای مناسب است. شما میخواهید افرادی را استخدام کنید که میدانند چگونه دادههایی را جمعآوری کنند که نماینده هستند و همچنین با رضایت جمعآوری میشوند. شما همچنین می خواهید افرادی که می دانند با کارشناسان دامنه کار کنند تا مطمئن شوند که رویکرد صحیحی دارند. اطمینان از داشتن هوش هیجانی این تمرینکنندگان برای برخورد با چالش مدیریت مسئولانه هوش مصنوعی با فروتنی و تشخیص، کلیدی است. ما باید در مورد یادگیری نحوه تشخیص اینکه چگونه و چه زمانی سیستمهای هوش مصنوعی میتوانند نابرابری را تشدید کنند، به همان اندازه که میتوانند هوش انسان را تقویت کنند، آگاه باشیم.

نحوه عملکرد کسب و کارتان با هوش مصنوعی را دوباره ابداع کنید

این مقاله به شما کمک کرد؟

بلهنه

اطلاعات بیشتر از هوش مصنوعی

خبرنامه های آی بی ام

خبرنامهها و بهروزرسانیهای موضوعی ما را دریافت کنید که جدیدترین رهبری فکری و بینش را در مورد روندهای نوظهور ارائه میدهد.

مشترک شدن در حال حاضر

خبرنامه های بیشتر

- محتوای مبتنی بر SEO و توزیع روابط عمومی. امروز تقویت شوید.

- PlatoData.Network Vertical Generative Ai. به خودت قدرت بده دسترسی به اینجا.

- PlatoAiStream. هوش وب 3 دانش تقویت شده دسترسی به اینجا.

- PlatoESG. کربن ، CleanTech، انرژی، محیط، خورشیدی، مدیریت پسماند دسترسی به اینجا.

- PlatoHealth. هوش بیوتکنولوژی و آزمایشات بالینی. دسترسی به اینجا.

- منبع: https://www.ibm.com/blog/why-we-need-diverse-multidisciplinary-coes-for-model-risk/

- : دارد

- :است

- :نه

- :جایی که

- $UP

- 000

- 1

- 16

- 2022

- 2024

- 23

- 25

- 28

- 29

- 30

- 300

- 32

- 39

- 40

- 400

- 65

- 7

- 9

- a

- توانایی

- درباره ما

- بالاتر

- AC

- شتاب دادن

- دقت

- دقیق

- به درستی

- در میان

- عمل

- سازگار

- نشانی

- اقرار کردن

- اتخاذ

- تبلیغات

- نصیحت

- اثر

- عاملان

- AI

- مدل های هوش مصنوعی

- سیستم های هوش مصنوعی

- هدف

- AL

- الگوریتمی

- الگوریتم

- معرفی

- همچنین

- همیشه

- amp

- an

- علم تجزیه و تحلیل

- و

- هر

- کاربرد

- برنامه های کاربردی

- روش

- هستند

- مناطق

- مقاله

- مصنوعی

- هوش مصنوعی

- هوش مصنوعی (AI)

- AS

- پرسیدن

- ارزیابی کنید

- ارزیابی

- ارزیابی

- دستیاران

- کمک کردن

- At

- سمعی

- تقویت کردن

- نویسنده

- در دسترس

- اجتناب از

- به عقب

- موازنه

- BE

- بوده

- قبل از

- شروع

- بودن

- معتقد است که

- مزایای

- بهتر

- خارج از

- تعصب

- تعصبات

- بلاگ

- وبلاگ ها

- آبی

- بوستون

- هر دو

- گسترده تر

- بنا

- کسب و کار

- عملکرد کسب و کار

- کسب و کار

- اما

- دکمه

- by

- CAN

- گرفتن

- ضبط

- کربن

- کارت

- کارت ها

- اهميت دادن

- مورد

- CAT

- دسته بندی

- علت

- مرکز

- مرکز عالی

- مرکزی

- معین

- به چالش

- مشخصات

- chatbots

- بررسی

- کودک

- فرزندان

- محافل

- CIS

- کلاس

- به وضوح

- مشتریان

- نزدیک

- ابر

- رنگ

- ترکیب

- آینده

- مشترک

- جوامع

- انجمن

- شرکت

- شرکت

- تکمیل شده

- مفهوم

- رضایت

- در نتیجه

- در نظر بگیرید

- مشاوره

- ظرف

- ادامه دادن

- گفتگو

- هسته

- اصلاح

- همبسته

- هزینه

- میتوانست

- ایجاد شده

- ایجاد

- سازندگان

- بحرانی

- جمعیت

- CSS

- درمان

- در حال حاضر

- سفارشی

- مشتری

- تجربه مشتری

- مشتریان

- داده ها

- تاریخ

- تصمیم گیری

- عمیق ترین

- به طور پیش فرض

- تعاریف

- ارائه

- نشان می دهد

- استقرار

- شرح

- طرح

- تفکر طراحی

- طراحی

- مشخص کردن

- توسعه

- توسعه

- مختلف

- مشکل

- دیجیتال

- دگرگونی های دیجیتال

- متفاوت

- برجسته

- مختلف

- تنوع

- do

- دامنه

- اهدا

- کشیده شده

- راندن

- E&T

- اثرات

- تلاش

- از بین بردن

- تعبیه کردن

- در اغوش گرفتن

- سنگ سنباده

- کارکنان

- قادر ساختن

- جذاب

- موتور

- مورد تأیید

- انگلیسی

- کافی

- حصول اطمینان از

- وارد

- خطا

- و غیره

- اتر (ETH)

- اخلاقی

- اصول اخلاق

- ارزیابی

- ارزیابی

- ارزیابی

- حتی

- هر

- در همه جا

- بر انگیختن

- مثال

- مثال ها

- برتری

- خروج

- انتظار

- تجربه

- تجارب

- کارشناس

- تخصص

- کارشناسان

- توضیح داده شده

- قرار گرفتن در معرض

- گسترش می یابد

- خیلی

- فیس بوک

- فیس بوک پیام رسان

- تسهیل کردن

- نما

- عوامل

- عدالت

- غلط

- بسیار

- FAST

- کمی از

- پیدا کردن

- تمرکز

- به دنبال

- پیروی

- فونت

- برای

- خط مقدم

- اشکال

- پایه

- چارچوب

- از جانب

- جلو

- توابع

- جمع آوری

- جمع آوری

- جمع آوری

- مولد

- هوش مصنوعی مولد

- ژنراتور

- دریافت کنید

- داده

- می دهد

- جهانی

- هدف

- اهداف

- می رود

- خوب

- حکومت

- دستور زبان

- تا حد زیادی

- توری

- گروه

- گروه ها

- رشد

- راهنمایی

- صدمه

- آیا

- عنوان

- شنیدن

- ارتفاع

- کمک

- مفید

- زیاد

- او را

- استخدام

- استخدام

- خود را

- دارای

- جامع

- صفحه اصلی

- چگونه

- چگونه

- HTTPS

- انسان

- هوش انسانی

- فروتنی

- ترکیبی

- ابر هیبرید

- i

- من می خواهم

- آی بی ام

- ICO

- ICON

- دلخواه

- شناسایی

- if

- جهل

- تصویر

- فوری

- تأثیر

- اثرات

- انجام

- اجرای

- اهمیت

- مهم

- بهبود

- ارتقاء

- را بهبود می بخشد

- in

- شامل

- از جمله

- گنجاندن

- ترکیب کردن

- به طور فزاینده

- افزایشی

- شاخص

- صنعت

- موثر

- اطلاعات

- ابداع

- نوآوران

- ورودی

- بینش

- بینش

- فورا

- در عوض

- موسسه

- بیمه

- بیمه گران

- اطلاعات

- هوشمند

- قصد

- عمدی

- نیت

- علاقه مند

- منافع

- داخلی

- تلاقی کردن

- مداخله

- ارعاب

- ذاتی

- نیست

- موضوع

- مسائل

- IT

- ITS

- ژانویه

- پیوستن

- به ما بپیوند

- سفر

- JPG

- تنها

- نگهداری

- کلید

- دانستن

- شناخته شده

- عدم

- زبان

- زبان ها

- بزرگ

- در مقیاس بزرگ

- آخرین

- رهبری

- رهبر

- رهبری

- یادگیری

- اجازه

- سطح

- قدرت نفوذ

- بدهی

- دروغ

- پسندیدن

- محدود شده

- فهرست

- محلی

- محل

- مطالب

- ساخت

- ساخت

- مدیریت

- کتابچه راهنمای

- بسیاری

- ریاضی

- ریاضی

- ماده

- حداکثر عرض

- ممکن است..

- me

- متوسط

- دیدار

- رسول

- قدرت

- دقیقه

- ذهن

- حد اقل

- دقیقه

- موبایل

- مدل

- مدل

- نوسازی

- بیش

- اکثر

- حرکت

- بسیار

- چند رشته ای

- باید

- my

- طبیعت

- جهت یابی

- لازم

- نیاز

- ضروری

- نیازهای

- منفی است

- جدید

- محصولات جدید

- خبرنامه

- nlp

- نه

- توجه داشته باشید

- هیچ چی

- اکنون

- متعدد

- of

- خاموش

- ارائه

- ارائه شده

- پیشنهادات

- غالبا

- on

- ONE

- منبع باز

- نظر

- فرصت ها

- بهینه

- بهینه

- or

- سازمان های

- دیگر

- ما

- بهتر از

- خروجی

- روی

- خود

- صاحبان

- با ما

- شرکت کننده

- عبور

- مردم

- انجام

- شخص

- شخصی

- شخصا

- دیدگاه

- پی اچ پی

- پی

- برنامه

- افلاطون

- هوش داده افلاطون

- PlatoData

- پلاگین

- سیاست

- موقعیت

- پست

- پتانسیل

- مشتریان بالقوه

- قدرت

- قوی

- تمرین

- شیوه های

- پیش گویی

- پیش بینی

- پیش بینی

- اصلی

- از اصول

- اولویت بندی

- امتیاز

- مشکل

- خرید

- تولید می کند

- تولید

- بهره وری

- محصولات

- برنامه ها

- پروژه ها

- به درستی

- چشم انداز

- ارائه

- ارائه

- پروکسی ها

- پروکسی

- روانی

- عمومی

- منتشر شده

- قرار دادن

- سوالات

- به سرعت

- نقل قول کردن

- به ندرت

- آمادگی

- مطالعه

- واقعی

- واقعیت

- شناختن

- توصیه

- کاهش

- خالص کردن

- بازتاب

- منعکس شده

- مقررات

- گزارش ها

- نماینده

- نمایندگی

- درخواست

- نیاز

- ضروری

- تحقیق

- پاسخ دادن

- مسئوليت

- مسئولانه

- پاسخگو

- درامد

- رشد درآمد

- راست

- خطر

- عوامل خطر

- خطرات

- جاده

- ربات ها

- امن

- ایمنی

- سعید

- همان

- گفته

- مقیاس

- مقیاس گذاری

- علم

- پرده

- اسکریپت

- جستجو

- موتور جستجو

- امن

- دیدن

- جستجوگرها

- خدمت

- تنظیمات

- باید

- نشان داده شده

- به سادگی

- سایت

- شل

- کوچک

- هوشمند

- بلندگوهای هوشمند

- SMS

- So

- راه حل

- مزایا

- برخی از

- منابع

- فضا

- سخنرانان

- حمایت مالی

- مربع

- سهامداران

- استاندارد

- شروع

- وضعیت هنر

- آماری

- ارقام

- دانشجویان

- مهاجرت تحصیلی

- موضوع

- مشترک

- چنین

- پشتیبانی

- حمایت از

- SVG

- سیستم های

- T

- جدول

- مصرف

- اهداف

- معلم

- تیم ها

- فنی

- فن آوری

- سومین

- متن

- نسبت به

- با تشکر

- که

- La

- جهان

- شان

- آنها

- موضوع

- خودشان

- اینها

- آنها

- فکر می کنم

- تفکر

- این

- کسانی که

- فکر

- رهبری فکر

- سه

- از طریق

- زمان

- عنوان

- به

- با هم

- ابزار

- بالا

- موضوع

- سخت

- قطار

- آموزش

- دگرگونی

- روند

- درست

- قابل اعتماد

- توییتر

- دو

- نوع

- نوعی

- فهمیدن

- غیر منصفانه

- منحصر به فرد

- باز کردن قفل

- به روز رسانی

- بر

- URL

- us

- استفاده کنید

- مورد استفاده

- استفاده

- با استفاده از

- ارزش

- ارزشها

- تنوع

- متفاوت است

- بسیار

- مجازی

- حجم

- W

- می خواهم

- بود

- we

- خوب

- چی

- چه شده است

- واتساپ

- چه زمانی

- چه

- که

- در حین

- WHO

- چه کسی

- چرا

- به طور گسترده ای

- گسترده تر

- اراده

- خرد

- WISE

- با

- کلمه

- وردپرس

- مهاجرت کاری

- با این نسخهها کار

- جهان

- خواهد بود

- کتبی

- اشتباه

- هنوز

- شما

- شما

- زفیرنت