La importancia de los almacenes de datos y los análisis realizados en plataformas de almacenamiento de datos ha ido en aumento constante a lo largo de los años, y muchas empresas confían en estos sistemas como una misión crítica tanto para la toma de decisiones operativas a corto plazo como para la planificación estratégica a largo plazo. Tradicionalmente, los almacenes de datos se actualizan en ciclos por lotes, por ejemplo, mensualmente, semanalmente o diariamente, para que las empresas puedan obtener diversos conocimientos de ellos.

Muchas organizaciones se están dando cuenta de que la ingesta de datos casi en tiempo real junto con el análisis avanzado abre nuevas oportunidades. Por ejemplo, una institución financiera puede predecir si una transacción con tarjeta de crédito es fraudulenta mediante la ejecución de un programa de detección de anomalías en modo casi en tiempo real en lugar de en modo por lotes.

En esta publicación, mostramos cómo Desplazamiento al rojo de Amazon puede ofrecer predicciones de ingestión de transmisión y aprendizaje automático (ML) en una sola plataforma.

Amazon Redshift es un almacén de datos en la nube rápido, escalable, seguro y completamente administrado que hace que sea simple y rentable analizar todos sus datos mediante SQL estándar.

Aprendizaje automático de Amazon Redshift facilita que los analistas de datos y los desarrolladores de bases de datos creen, entrenen y apliquen modelos de aprendizaje automático mediante comandos SQL familiares en los almacenes de datos de Amazon Redshift.

Estamos emocionados de lanzar Ingestión de streaming de Amazon Redshift para Secuencias de datos de Amazon Kinesis y Streaming administrado por Amazon para Apache Kafka (Amazon MSK), que le permite ingerir datos directamente desde un flujo de datos de Kinesis o un tema de Kafka sin tener que organizar los datos en Servicio de almacenamiento simple de Amazon (Amazon S3). La ingestión de streaming de Amazon Redshift le permite lograr una latencia baja del orden de segundos mientras ingiere cientos de megabytes de datos en su almacén de datos.

Esta publicación demuestra cómo Amazon Redshift, el almacén de datos en la nube, le permite crear predicciones de aprendizaje automático casi en tiempo real mediante el uso de la ingestión de streaming de Amazon Redshift y las funciones de aprendizaje automático de Redshift con el lenguaje SQL familiar.

Resumen de la solución

Siguiendo los pasos descritos en esta publicación, podrá configurar una aplicación de transmisión de productores en un Nube informática elástica de Amazon (Amazon EC2) instancia que simula transacciones con tarjeta de crédito y envía datos a Kinesis Data Streams en tiempo real. Configura una vista materializada de Amazon Redshift Streaming Ingestion en Amazon Redshift, donde se reciben los datos de streaming. Entrena y crea un modelo de ML de Redshift para generar inferencias en tiempo real contra los datos de transmisión.

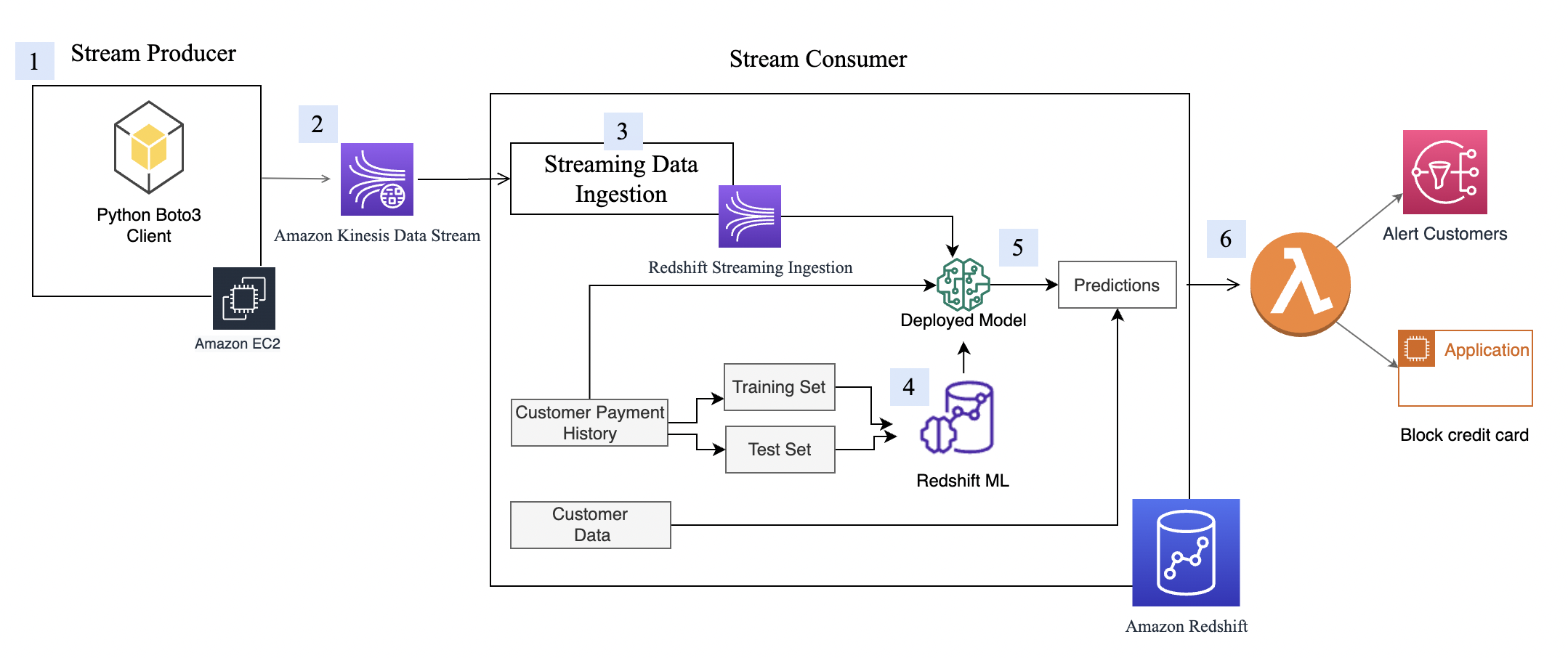

El siguiente diagrama ilustra la arquitectura y el flujo del proceso.

El proceso paso a paso es el siguiente:

- La instancia EC2 simula una aplicación de transacción de tarjeta de crédito, que inserta transacciones de tarjeta de crédito en el flujo de datos de Kinesis.

- El flujo de datos almacena los datos de transacciones de tarjetas de crédito entrantes.

- Se crea una vista materializada de Amazon Redshift Streaming Ingestion sobre el flujo de datos, que automáticamente ingiere datos de streaming en Amazon Redshift.

- Usted crea, entrena e implementa un modelo de ML con Redshift ML. El modelo Redshift ML se entrena utilizando datos transaccionales históricos.

- Usted transforma los datos de transmisión y genera predicciones de ML.

- Puede alertar a los clientes o actualizar la aplicación para mitigar el riesgo.

Este tutorial usa datos de transmisión de transacciones de tarjetas de crédito. Los datos de la transacción de la tarjeta de crédito son ficticios y se basan en un simulador. El conjunto de datos del cliente también es ficticio y se genera con algunas funciones de datos aleatorios.

Requisitos previos

- Crear un clúster de Amazon Redshift.

- Configurar el clúster para usar Redshift ML.

- Crear an Gestión de identidades y accesos de AWS (IAM) usuario.

- Actualice el rol de IAM adjunto al clúster de Redshift para incluir permisos para acceder al flujo de datos de Kinesis. Para obtener más información sobre la política requerida, consulte Primeros pasos con la ingestión de transmisión.

- Cree una instancia EC5.4 m2xlarge. Probamos la aplicación Producer con la instancia m5.4xlarge, pero puede usar otro tipo de instancia. Al crear la instancia, utilice el amzn2-ami-kernel-5.10-hvm-2.0.20220426.0-x86_64-gp2 IAM.

- Para asegurarse de que Python3 esté instalado en la instancia EC2, ejecute el siguiente comando para verificar su versión de Python (tenga en cuenta que el script de extracción de datos solo funciona en Python 3):

- Instale los siguientes paquetes dependientes para ejecutar el programa simulador:

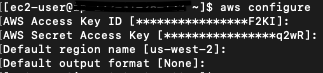

- Configure Amazon EC2 utilizando variables como las credenciales de AWS generadas para el usuario de IAM creado en el paso 3 anterior. La siguiente captura de pantalla muestra un ejemplo usando aws configure.

Configurar Kinesis Data Streams

Amazon Kinesis Data Streams es un servicio de transmisión de datos en tiempo real escalable y duradero de forma masiva. Puede capturar continuamente gigabytes de datos por segundo de cientos de miles de fuentes, como flujos de clics en sitios web, flujos de eventos de bases de datos, transacciones financieras, fuentes de redes sociales, registros de TI y eventos de seguimiento de ubicación. Los datos recopilados están disponibles en milisegundos para habilitar casos de uso de análisis en tiempo real, como paneles en tiempo real, detección de anomalías en tiempo real, precios dinámicos y más. Usamos Kinesis Data Streams porque es una solución sin servidor que puede escalar según el uso.

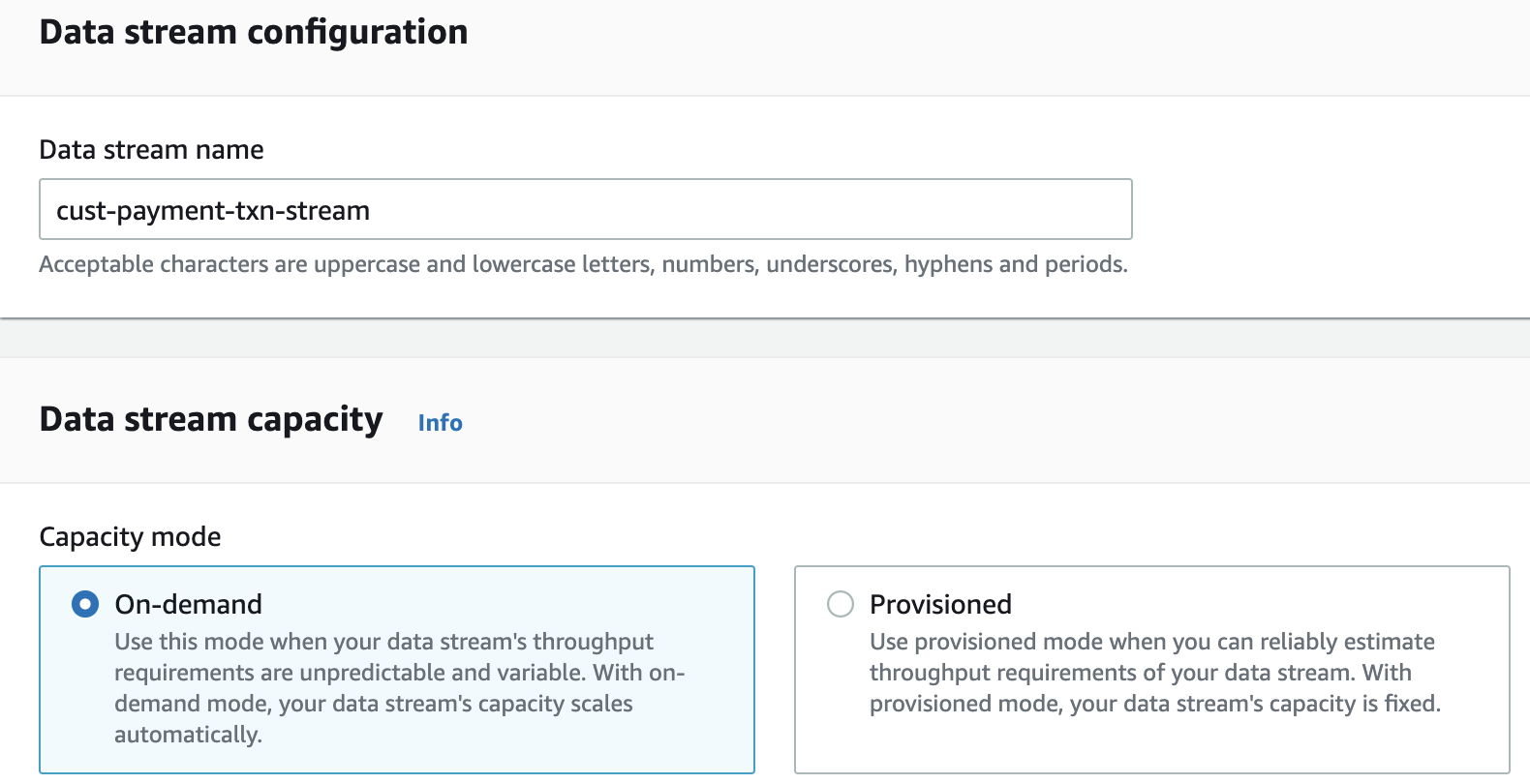

Crear un flujo de datos de Kinesis

Primero, debe crear un flujo de datos de Kinesis para recibir los datos de transmisión:

- En la consola de Amazon Kinesis, elija Flujos de datos en el panel de navegación.

- Elige Crear flujo de datos.

- Nombre del flujo de datos, introduzca

cust-payment-txn-stream. - Modo de capacidad, seleccione On-demand.

- Para el resto de las opciones, elija las opciones predeterminadas y siga las indicaciones para completar la configuración.

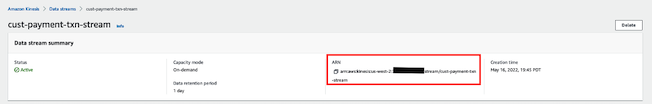

- Capture el ARN del flujo de datos creado para usarlo en la siguiente sección cuando defina su política de IAM.

Configurar permisos

Para que una aplicación de transmisión escriba en Kinesis Data Streams, la aplicación debe tener acceso a Kinesis. Puede usar la siguiente declaración de política para otorgar acceso al flujo de datos al proceso del simulador que configuró en la siguiente sección. Utilice el ARN del flujo de datos que guardó en el paso anterior.

Configurar el productor de flujo

Antes de que podamos consumir datos de transmisión en Amazon Redshift, necesitamos una fuente de datos de transmisión que escriba datos en el flujo de datos de Kinesis. Esta publicación utiliza un generador de datos personalizado y el AWS SDK para Python (Boto3) para publicar los datos en el flujo de datos. Para obtener instrucciones de configuración, consulte Simulador de Productor. Este proceso de simulador publica datos de transmisión en el flujo de datos creado en el paso anterior (cust-payment-txn-stream).

Configurar el consumidor de flujo

Esta sección trata sobre la configuración del consumidor de transmisión (la vista de ingestión de transmisión de Amazon Redshift).

Amazon Redshift Streaming Ingestion proporciona una ingesta de baja latencia y alta velocidad de datos de streaming de Kinesis Data Streams en una vista materializada de Amazon Redshift. Puede configurar su clúster de Amazon Redshift para habilitar la ingesta de transmisión y crear una vista materializada con actualización automática, utilizando instrucciones SQL, como se describe en Creación de vistas materializadas en Amazon Redshift. El proceso automático de actualización de vista materializada incorporará datos de transmisión a cientos de megabytes de datos por segundo desde Kinesis Data Streams a Amazon Redshift. Esto da como resultado un acceso rápido a datos externos que se actualizan rápidamente.

Después de crear la vista materializada, puede acceder a sus datos desde el flujo de datos mediante SQL y simplificar las canalizaciones de datos mediante la creación de vistas materializadas directamente sobre el flujo.

Complete los siguientes pasos para configurar una vista materializada de transmisión de Amazon Redshift:

- En la consola de IAM, elija políticas en el panel de navegación.

- Elige Crear política.

- Cree una nueva política de IAM llamada

KinesisStreamPolicy. Para la definición de la política de transmisión, consulte Primeros pasos con la ingestión de transmisión. - En el panel de navegación, elija Roles.

- Elija Crear rol.

- Seleccione Servicio de AWS y elige Redshift y Redshift personalizable.

- Crear un nuevo rol llamado

redshift-streaming-roley adjuntar la pólizaKinesisStreamPolicy. - Cree un esquema externo para asignar a Kinesis Data Streams:

Ahora puede crear una vista materializada para consumir los datos de transmisión. Puede usar el tipo de datos SUPER para almacenar la carga útil tal cual, en formato JSON, o usar las funciones JSON de Amazon Redshift para analizar los datos JSON en columnas individuales. Para esta publicación, usamos el segundo método porque el esquema está bien definido.

- Crear la vista materializada de ingesta de streaming

cust_payment_tx_stream. Al especificar AUTO REFRESH YES en el siguiente código, puede habilitar la actualización automática de la vista de ingesta de transmisión, lo que ahorra tiempo al evitar la creación de canalizaciones de datos:

Tenga en cuenta que json_extract_path_text tiene una limitación de longitud de 64 KB. También from_varbye filtra registros de más de 65 KB.

- Actualizar los datos.

Amazon Redshift actualiza automáticamente la vista materializada de transmisión de Amazon Redshift. De esta manera, no necesita preocuparse por la obsolescencia de los datos. Con la actualización automática de la vista materializada, los datos se cargan automáticamente en Amazon Redshift a medida que están disponibles en la transmisión. Si elige realizar esta operación manualmente, use el siguiente comando:

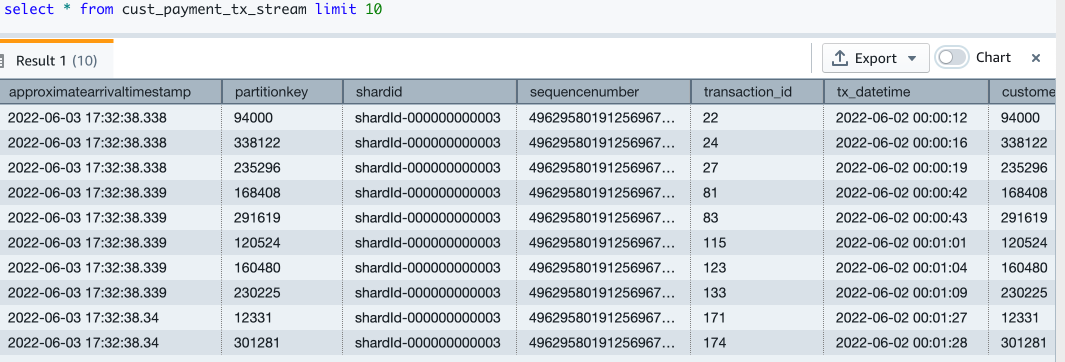

- Ahora consultemos la vista materializada de transmisión para ver datos de muestra:

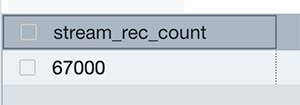

- Veamos ahora cuántos registros hay en la vista de transmisión:

Ahora ha terminado de configurar la vista de ingestión de transmisión de Amazon Redshift, que se actualiza continuamente con los datos de transacciones de tarjetas de crédito entrantes. En mi configuración, veo que se han extraído alrededor de 67,000 XNUMX registros en la vista de transmisión en el momento en que ejecuté mi consulta de selección de conteo. Este número podría ser diferente para usted.

Desplazamiento al rojo ML

Con Redshift ML, puede traer un modelo de ML previamente entrenado o crear uno de forma nativa. Para obtener más información, consulte Uso del aprendizaje automático en Amazon Redshift.

En esta publicación, entrenamos y construimos un modelo ML utilizando un conjunto de datos históricos. Los datos contienen un tx_fraud campo que marca una transacción histórica como fraudulenta o no. Construimos un modelo de ML supervisado usando Redshift Auto ML, que aprende de este conjunto de datos y predice las transacciones entrantes cuando se ejecutan a través de las funciones de predicción.

En las siguientes secciones, mostramos cómo configurar el conjunto de datos históricos y los datos del cliente.

Cargue el conjunto de datos históricos

La tabla histórica tiene más campos que los que tiene la fuente de datos de transmisión. Estos campos contienen el gasto más reciente del cliente y la puntuación de riesgo del terminal, como el número de transacciones fraudulentas calculadas mediante la transformación de datos de transmisión. También hay variables categóricas como transacciones de fin de semana o transacciones nocturnas.

Para cargar los datos históricos, ejecute los comandos usando el Editor de consultas de Amazon Redshift.

Cree la tabla del historial de transacciones con el siguiente código. El DDL también se puede encontrar en GitHub.

Veamos cuántas transacciones están cargadas:

Consulte la tendencia mensual de transacciones fraudulentas y no fraudulentas:

Crear y cargar datos de clientes

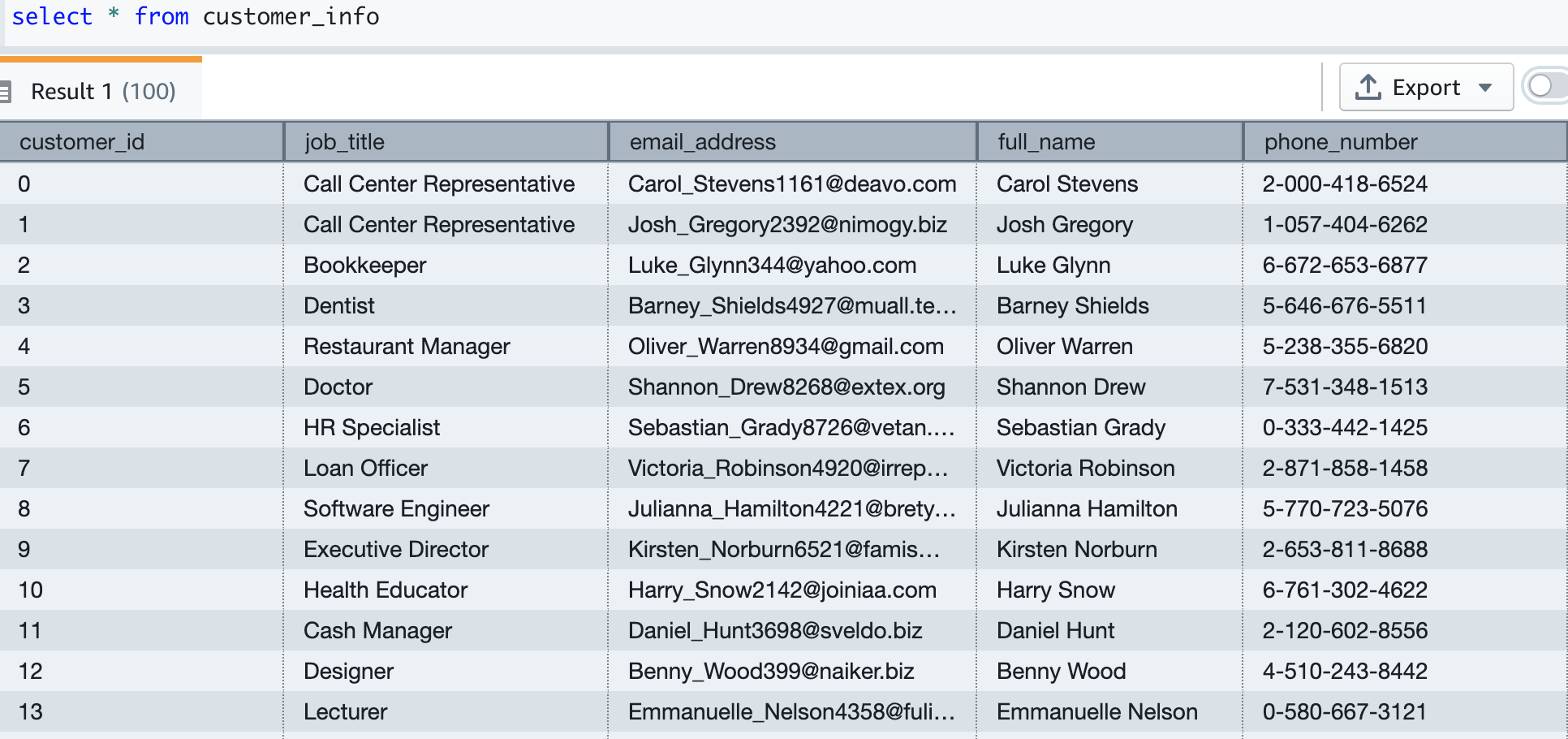

Ahora creamos la tabla de clientes y cargamos datos, que contiene el correo electrónico y el número de teléfono del cliente. El siguiente código crea la tabla, carga los datos y muestra la tabla. La tabla DDL está disponible en GitHub.

Nuestros datos de prueba tienen alrededor de 5,000 clientes. La siguiente captura de pantalla muestra datos de clientes de muestra.

Construye un modelo de AA

Nuestra tabla histórica de transacciones de tarjetas tiene 6 meses de datos, que ahora usamos para entrenar y probar el modelo ML.

El modelo toma los siguientes campos como entrada:

Obtenemos tx_fraud como salida.

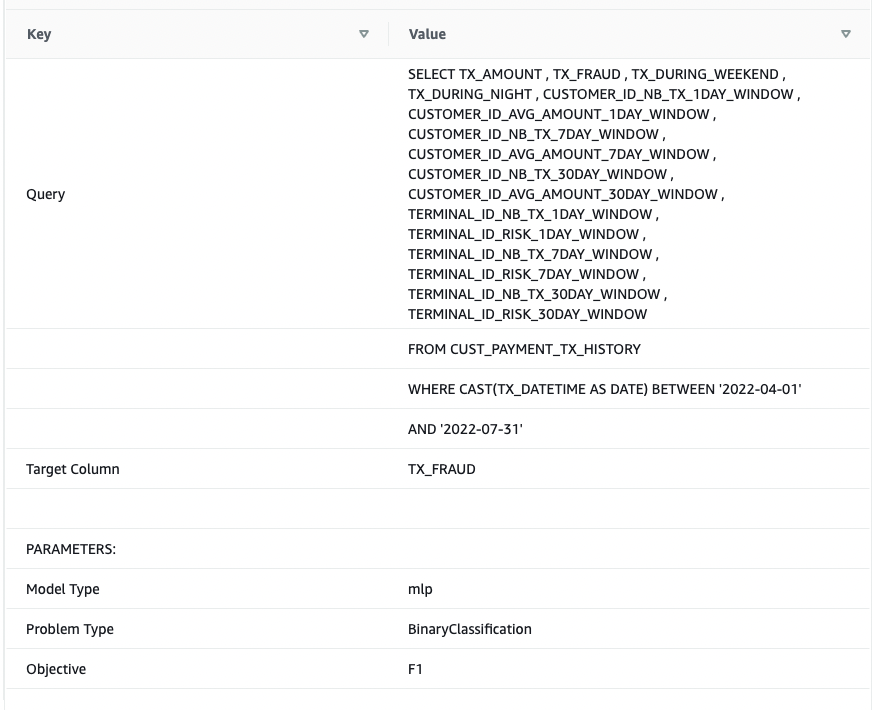

Dividimos estos datos en conjuntos de datos de entrenamiento y prueba. Las transacciones del 2022-04-01 al 2022-07-31 son para el conjunto de entrenamiento. Las transacciones del 2022-08-01 al 2022-09-30 se utilizan para el conjunto de prueba.

Vamos a crear el modelo ML usando el SQL familiar Sentencia CREAR MODELO. Usamos una forma básica del comando Redshift ML. El siguiente método utiliza Piloto automático Amazon SageMaker, que realiza la preparación de datos, la ingeniería de características, la selección de modelos y el entrenamiento automáticamente para usted. Proporcione el nombre de su depósito S3 que contiene el código.

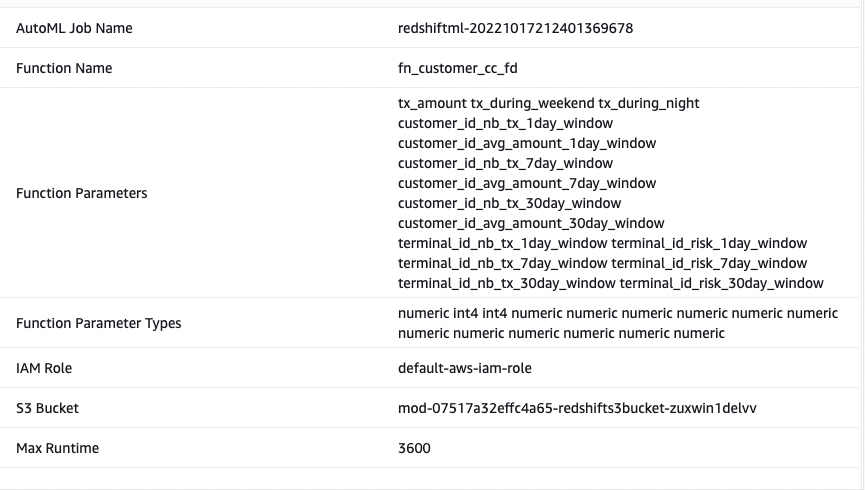

Llamo al modelo ML como Cust_cc_txn_fd, y la función de predicción como fn_customer_cc_fd. La cláusula FROM muestra las columnas de entrada de la tabla histórica public.cust_payment_tx_history. El parámetro de destino se establece en tx_fraud, que es la variable de destino que estamos tratando de predecir. IAM_Role está configurado como predeterminado porque el clúster está configurado con este rol; de lo contrario, debe proporcionar el ARN de la función de IAM del clúster de Amazon Redshift. puse el max_runtime a 3,600 segundos, que es el tiempo que le damos a SageMaker para completar el proceso. Redshift ML implementa el mejor modelo que se identifica en este marco de tiempo.

Según la complejidad del modelo y la cantidad de datos, el modelo puede tardar algún tiempo en estar disponible. Si encuentra que su selección de modelo no se está completando, aumente el valor para max_runtime. Puede establecer un valor máximo de 9999.

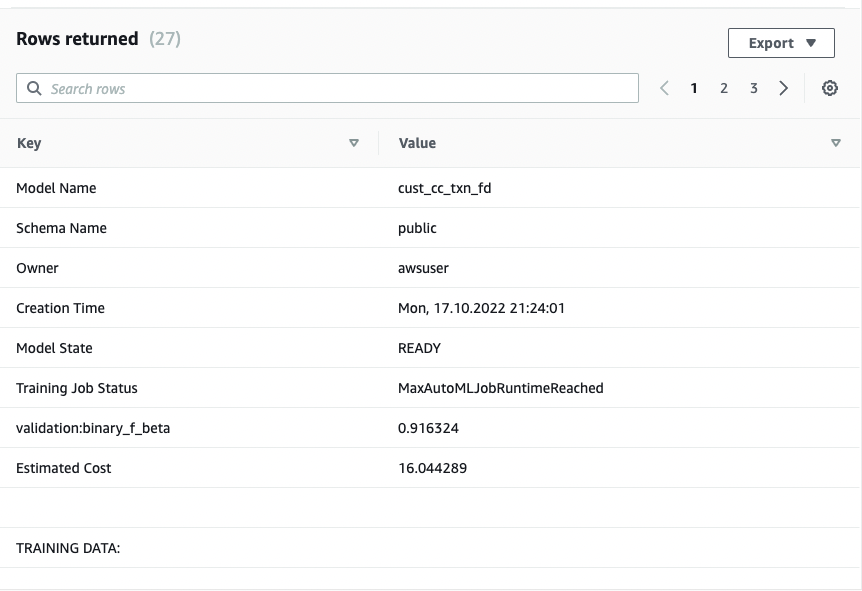

El comando CREAR MODELO se ejecuta de forma asincrónica, lo que significa que se ejecuta en segundo plano. Puedes usar el MOSTRAR MODELO comando para ver el estado del modelo. Cuando el estado se muestra como Listo, significa que el modelo está entrenado e implementado.

Las siguientes capturas de pantalla muestran nuestra salida.

De la salida, veo que el modelo ha sido reconocido correctamente como BinaryClassification, y F1 ha sido seleccionado como objetivo. Él Puntuación F1 es una métrica que considera tanto precisión y recuerdo. Devuelve un valor entre 1 (precisión y recuperación perfectas) y 0 (puntuación más baja posible). En mi caso, es 0.91. Cuanto mayor sea el valor, mejor será el rendimiento del modelo.

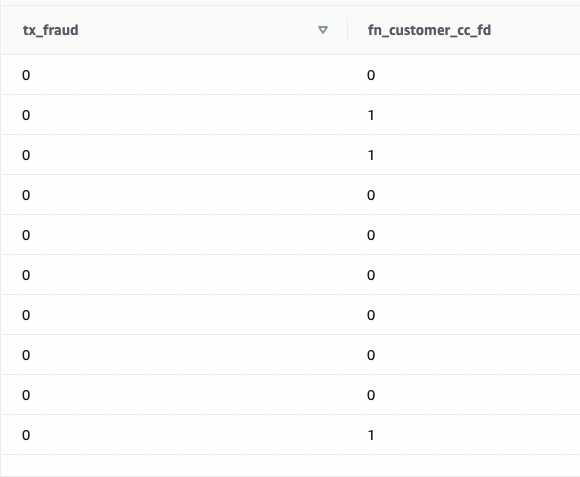

Probemos este modelo con el conjunto de datos de prueba. Ejecute el siguiente comando, que recupera predicciones de muestra:

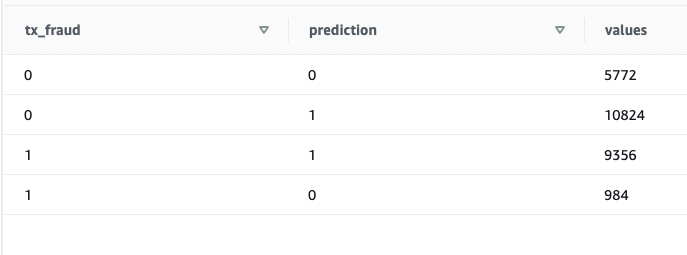

Vemos que algunos valores coinciden y otros no. Comparemos las predicciones con la verdad básica:

Validamos que el modelo funciona y que la puntuación de F1 es buena. Pasemos a generar predicciones sobre la transmisión de datos.

Predecir transacciones fraudulentas

Debido a que el modelo Redshift ML está listo para usar, podemos usarlo para ejecutar las predicciones contra la ingestión de datos de transmisión. El conjunto de datos históricos tiene más campos que los que tenemos en la fuente de datos de transmisión, pero son solo métricas de frecuencia y actualidad en torno al riesgo del cliente y la terminal de una transacción fraudulenta.

Podemos aplicar las transformaciones sobre los datos de transmisión muy fácilmente incrustando el SQL dentro de las vistas. Crear el primera vista, que agrega datos de transmisión a nivel de cliente. Luego crea el segunda vista, que agrega datos de transmisión a nivel de terminal, y el tercera vista, que combina datos transaccionales entrantes con datos agregados de clientes y terminales y llama a la función de predicción, todo en un solo lugar. El código para la tercera vista es el siguiente:

Ejecute una instrucción SELECT en la vista:

A medida que ejecuta la declaración SELECT repetidamente, las últimas transacciones con tarjeta de crédito pasan por transformaciones y predicciones de ML casi en tiempo real.

Esto demuestra el poder de Amazon Redshift: con comandos SQL fáciles de usar, puede transformar la transmisión de datos mediante la aplicación de funciones de ventana complejas y aplicar un modelo de aprendizaje automático para predecir transacciones fraudulentas, todo en un solo paso, sin crear canalizaciones de datos complejas ni crear y administrar infraestructura adicional.

Ampliar la solución

Debido a que los flujos de datos y las predicciones de ML se realizan casi en tiempo real, puede crear procesos comerciales para alertar a su cliente utilizando Servicio de notificación simple de Amazon (Amazon SNS), o puede bloquear la cuenta de la tarjeta de crédito del cliente en un sistema operativo.

Esta publicación no entra en los detalles de estas operaciones, pero si está interesado en obtener más información sobre la creación de soluciones basadas en eventos con Amazon Redshift, consulte lo siguiente Repositorio GitHub.

Limpiar

Para evitar incurrir en cargos futuros, elimine los recursos que se crearon como parte de esta publicación.

Conclusión

En esta publicación, demostramos cómo configurar un flujo de datos de Kinesis, configurar un productor y publicar datos en flujos, y luego crear una vista de ingesta de transmisión de Amazon Redshift y consultar los datos en Amazon Redshift. Después de que los datos estuvieran en el clúster de Amazon Redshift, demostramos cómo entrenar un modelo de ML y crear una función de predicción y aplicarla contra la transmisión de datos para generar predicciones casi en tiempo real.

Si tiene algún comentario o pregunta, por favor déjelos en los comentarios.

Acerca de los autores

Bhanu Pittampally es un arquitecto de soluciones especializado en análisis con sede en Dallas. Se especializa en la construcción de soluciones analíticas. Su experiencia es en almacenes de datos: arquitectura, desarrollo y administración. Ha estado en el campo de datos y análisis durante más de 15 años.

Bhanu Pittampally es un arquitecto de soluciones especializado en análisis con sede en Dallas. Se especializa en la construcción de soluciones analíticas. Su experiencia es en almacenes de datos: arquitectura, desarrollo y administración. Ha estado en el campo de datos y análisis durante más de 15 años.

Praveen Kadipikonda es un arquitecto sénior de soluciones especialista en análisis en AWS con sede en Dallas. Ayuda a los clientes a crear soluciones analíticas eficientes, eficaces y escalables. Ha trabajado en la creación de bases de datos y soluciones de almacenamiento de datos durante más de 15 años.

Praveen Kadipikonda es un arquitecto sénior de soluciones especialista en análisis en AWS con sede en Dallas. Ayuda a los clientes a crear soluciones analíticas eficientes, eficaces y escalables. Ha trabajado en la creación de bases de datos y soluciones de almacenamiento de datos durante más de 15 años.

Ritesh Kumar Sinha es un arquitecto de soluciones especializado en análisis con sede en San Francisco. Ha ayudado a los clientes a crear almacenamiento de datos escalable y soluciones de big data durante más de 16 años. Le encanta diseñar y crear soluciones integrales eficientes en AWS. En su tiempo libre, le encanta leer, caminar y hacer yoga.

Ritesh Kumar Sinha es un arquitecto de soluciones especializado en análisis con sede en San Francisco. Ha ayudado a los clientes a crear almacenamiento de datos escalable y soluciones de big data durante más de 16 años. Le encanta diseñar y crear soluciones integrales eficientes en AWS. En su tiempo libre, le encanta leer, caminar y hacer yoga.

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- Platoblockchain. Inteligencia del Metaverso Web3. Conocimiento amplificado. Accede Aquí.

- Fuente: https://aws.amazon.com/blogs/big-data/near-real-time-fraud-detection-using-amazon-redshift-streaming-ingestion-with-amazon-kinesis-data-streams-and-amazon-redshift-ml/

- 000

- Clientes de 000

- 1

- 10

- 100

- 11

- 15 años

- 67

- 7

- 9

- a

- Poder

- Sobre

- arriba

- de la máquina

- Mi Cuenta

- Lograr

- la columna Acción

- Adicionales

- administración

- avanzado

- Después

- en contra

- Alertar

- Todos

- permite

- Amazon

- Amazon EC2

- Kinesis amazónica

- cantidad

- Analistas

- Analítico

- Analytics

- analizar

- y

- Detección de anomalías

- APACHE

- Aplicación

- Aplicá

- La aplicación de

- arquitectura

- en torno a

- adjuntar

- auto

- Automático

- automáticamente

- Hoy Disponibles

- evitar

- AWS

- fondo

- basado

- básica

- porque

- se convierte en

- MEJOR

- mejores

- entre

- Big

- Big Data

- llevar

- build

- Construir la

- Procesos de negocios

- negocios

- llamar al

- , que son

- Calls

- capturar

- tarjeta

- case

- cases

- personaje

- cargos

- comprobar

- Elige

- Ciudad

- Soluciones

- Médico

- código

- Columnas

- combina

- viniendo

- comentarios

- comparar

- completar

- completando

- integraciones

- complejidad

- Calcular

- considera

- Consola

- consumir

- consumidor

- contiene

- rentable

- podría

- Para crear

- creado

- crea

- Creamos

- Referencias

- crédito

- .

- cliente

- datos de los clientes

- Clientes

- de ciclos

- todos los días

- Dallas

- datos

- Preparación de datos

- almacenamiento de datos

- almacenes de datos

- Base de datos

- bases de datos

- conjuntos de datos

- Fecha

- Toma de Decisiones

- Predeterminado

- definir

- entregamos

- demostrado

- dependiente

- desplegar

- desplegado

- despliega

- descrito

- Diseño

- detalles

- Detección

- desarrolladores

- Desarrollo

- una experiencia diferente

- directamente

- No

- "Hacer"

- No

- dow

- lugar de trabajo dinámico

- pasan fácilmente

- fácil de usar

- efecto

- eficiente

- habilitar

- permite

- de extremo a extremo

- Ingeniería

- Participar

- Éter (ETH)

- Evento

- Eventos

- ejemplo

- excitado

- externo

- Extracción

- f1

- familiar

- RÁPIDO

- Feature

- Caracteristicas

- realimentación

- campo

- Terrenos

- filtros

- financiero

- Encuentre

- banderas

- de tus señales

- seguir

- siguiendo

- siguiente

- formulario

- formato

- encontrado

- FRAME

- Francisco

- fraude

- detección de fraude

- Gratuito

- Frecuencia

- en

- completamente

- función

- funciones

- futuras

- generar

- generado

- la generación de

- generador

- obtener

- Donar

- Go

- candidato

- conceder

- Polo a Tierra

- Grupo procesos

- es

- ayudado

- ayuda

- más alto

- Destacar

- histórico

- historia

- Cómo

- Como Hacer

- HTML

- HTTPS

- Cientos

- AMI

- no haber aun identificado una solucion para el problema

- Identidad

- importancia

- in

- incluir

- Entrante

- aumente

- creciente

- INSTRUMENTO individual

- información

- EN LA MINA

- Las opciones de entrada

- Insertos

- Insights

- instalar

- ejemplo

- Innovadora

- Instrucciones

- interesado

- IT

- únete

- json

- kafka

- Flujos de datos de Kinesis

- idioma

- mayores

- Estado latente

- más reciente

- lanzamiento

- aprendizaje

- Abandonar

- Longitud Mínima

- Nivel

- LIMITE LAS

- la limitación

- carga

- cargas

- compromiso a largo plazo

- Baja

- máquina

- máquina de aprendizaje

- hecho

- para lograr

- HACE

- gestionado

- administrar

- a mano

- muchos

- mapa

- macizamente

- pareo

- matplotlib

- max

- significa

- Medios

- Método

- métrico

- Métrica

- Mitigar las

- ML

- Moda

- modelo

- modelos

- mensual

- meses

- más,

- MEJOR DE TU

- movimiento

- nombre

- Navegación

- ¿ Necesita ayuda

- Nuevo

- Next

- .

- número

- numpy

- objetivo

- ONE

- abre

- Inteligente

- operativos.

- Operaciones

- Del Mañana

- Opciones

- solicite

- para las fiestas.

- Otro

- esbozado

- paquetes

- Los pandas

- cristal

- parámetro

- parte

- perfecto

- realizar

- actuación

- realiza

- permisos

- teléfono

- Colocar

- planificar

- plataforma

- Plataformas

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- Por favor

- políticas

- política

- posible

- Publicación

- industria

- Precisión

- predecir

- predicción

- Predicciones

- Predice

- anterior

- cotización

- en costes

- productor

- Programa

- proporcionar

- proporciona un

- público

- publicar

- Python

- Preguntas

- con rapidez

- azar

- Reading

- ready

- real

- en tiempo real

- datos en tiempo real

- realización

- recepción

- recibido

- reciente

- reconocido

- archivos

- REPETIDAMENTE

- reemplazar

- Requisitos

- Recurso

- Recursos

- RESTO

- Resultados

- devoluciones

- Riesgo

- Función

- Ejecutar

- correr

- sabio

- San

- San Francisco

- escalable

- Escala

- capturas de pantalla

- Sdk

- Seaborn

- Segundo

- segundos

- Sección

- (secciones)

- seguro

- seleccionado

- selección

- Sin servidor

- de coches

- set

- pólipo

- ajustes

- Configure

- a corto plazo

- Mostrar

- Shows

- sencillos

- simplificar

- simulador

- So

- Social

- redes sociales

- a medida

- Soluciones

- algo

- Fuente

- Fuentes

- especialista

- se especializa

- pasar

- dividido

- SQL

- Etapa

- estándar

- fundó

- Estado

- Posicionamiento

- declaraciones

- Estado

- paso

- pasos

- STORAGE

- tienda

- tiendas

- Estratégico

- stream

- en streaming

- servicio de streaming

- corrientes

- tal

- súper

- te

- Todas las funciones a su disposición

- mesa

- ¡Prepárate!

- toma

- Discursos

- Target

- terminal

- test

- El

- Código

- miles

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- fecha y hora

- a

- parte superior

- tema

- tradicionalmente

- Entrenar

- entrenado

- Formación

- transaccional

- transaccional

- Transacciones

- Transformar

- transformaciones

- transformadora

- Tendencia

- Actualizar

- actualizado

- Uso

- utilizan el

- Usuario

- validado

- propuesta de

- Valores

- diversos

- Verdad

- versión

- Ver

- vistas

- a pie

- tutorial

- Manejo de

- Servicios de Almacenaje

- Página web

- fin de semana

- una vez por semana

- ¿

- que

- mientras

- Wikipedia

- seguirá

- sin

- trabajado

- trabajando

- funciona

- escribir

- años

- Yoga

- tú

- zephyrnet