Todos queremos ver nuestros valores humanos ideales reflejados en nuestras tecnologías. Esperamos que tecnologías como la inteligencia artificial (IA) no nos mientan, no discriminen y sean seguras para nosotros y nuestros hijos. Sin embargo, muchos creadores de IA se enfrentan actualmente a reacciones negativas por los sesgos, las imprecisiones y las prácticas de datos problemáticas que quedan expuestas en sus modelos. Estos problemas requieren más que una solución técnica, algorítmica o basada en inteligencia artificial. En realidad, se requiere un enfoque sociotécnico holístico.

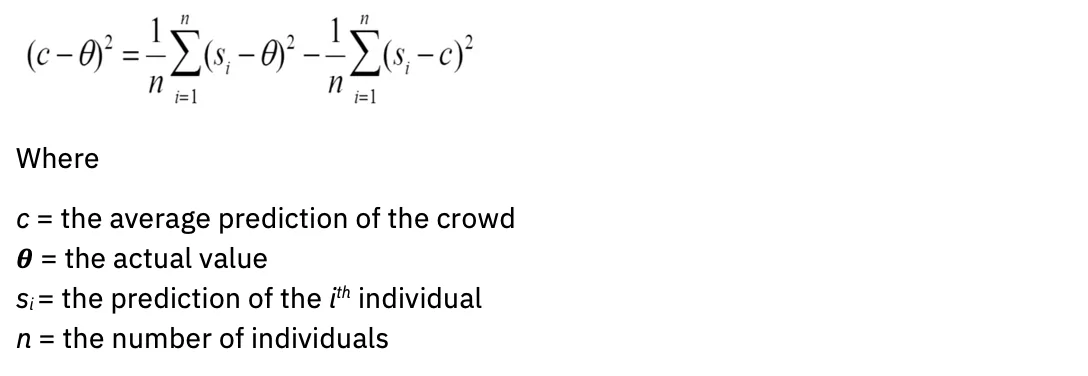

Las matemáticas demuestran una verdad poderosa

Todos los modelos predictivos, incluida la IA, son más precisos cuando incorporan inteligencia y experiencia humanas diversas. Esto no es una opinión; tiene validez empírica. Considera el teorema de predicción de la diversidad. En pocas palabras, cuando la diversidad en un grupo es grande, el error de la multitud es pequeño, lo que respalda el concepto de "la sabiduría de la multitud". En un estudio influyente, se demostró que diversos grupos de solucionadores de problemas con baja capacidad pueden superar a los grupos de solucionadores de problemas con alta capacidad (Hong y página, 2004).

En lenguaje matemático: cuanto más amplia sea su variación, más estándar será su media. La ecuación se ve así:

A estudio adicional proporcionó más cálculos que refinan las definiciones estadísticas de una multitud sabia, incluida la ignorancia de las predicciones de otros miembros y la inclusión de aquellos con maximamente diferente predicciones o juicios (negativamente correlacionados). Entonces, no es sólo el volumen, sino la diversidad lo que mejora las predicciones. ¿Cómo podría afectar esta idea a la evaluación de los modelos de IA?

Modelo (in)precisión

Para citar un aforismo común, todos los modelos están equivocados. Esto es válido en las áreas de estadística, ciencia e inteligencia artificial. Los modelos creados con una falta de experiencia en el dominio pueden llevar a erróneo salidas.

Hoy en día, un pequeño grupo homogéneo de personas determina qué datos utilizar para entrenar modelos de IA generativa, que se extraen de fuentes que sobrerrepresentan en gran medida el inglés. "Para la mayoría de los más de 6,000 idiomas del mundo, los datos de texto disponibles no son suficientes para entrenar un modelo básico a gran escala" (de "Sobre las oportunidades y riesgos de los modelos de fundación”, Bommasani et al., 2022).

Además, los modelos en sí se crean a partir de arquitecturas limitadas: “Casi todos los modelos de PNL de última generación se adaptan ahora a partir de uno de los pocos modelos básicos, como BERT, RoBERTa, BART, T5, etc. Si bien esta homogeneización produce un apalancamiento extremadamente alto (cualquier mejora en los modelos básicos puede generar beneficios inmediatos en toda la PNL), también es un pasivo; Todos los sistemas de IA pueden heredar los mismos sesgos problemáticos de algunos modelos básicos (Bommasani et al.) "

Para que la IA generativa refleje mejor las diversas comunidades a las que sirve, se debe representar en los modelos una variedad mucho más amplia de datos de seres humanos.

La evaluación de la precisión del modelo va de la mano con la evaluación del sesgo. Debemos preguntarnos ¿cuál es la intención del modelo y para quién está optimizado? Consideremos, por ejemplo, quién se beneficia más de los algoritmos de recomendación de contenidos y de los algoritmos de los motores de búsqueda. Las partes interesadas pueden tener intereses y objetivos muy diferentes. Los algoritmos y modelos requieren objetivos o sustitutos del error de Bayes: el error mínimo que un modelo debe mejorar. Este representante suele ser una persona, como un experto en la materia con experiencia en el dominio.

Un desafío muy humano: evaluar el riesgo antes de la adquisición o el desarrollo del modelo

Las regulaciones y planes de acción emergentes sobre IA subrayan cada vez más la importancia de las formas algorítmicas de evaluación del impacto. El objetivo de estos formularios es capturar información crítica sobre los modelos de IA para que los equipos de gobierno puedan evaluar y abordar sus riesgos antes de implementarlos. Las preguntas típicas incluyen:

- ¿Cuál es el caso de uso de su modelo?

- ¿Cuáles son los riesgos de un impacto dispar?

- ¿Cómo evalúa la equidad?

- ¿Cómo haces que tu modelo sea explicable?

Aunque se diseñó con buenas intenciones, el problema es que la mayoría de los propietarios de modelos de IA no entienden cómo evaluar los riesgos para su caso de uso. Un estribillo común podría ser: "¿Cómo podría mi modelo ser injusto si no recopila información de identificación personal (PII)?" En consecuencia, los formularios rara vez se completan con la consideración necesaria para que los sistemas de gobernanza señalen con precisión los factores de riesgo.

Se subraya así el carácter sociotécnico de la solución. Al propietario de un modelo (un individuo) no se le puede dar simplemente una lista de casillas de verificación para evaluar si su caso de uso causará daño. En cambio, lo que se requiere es que grupos de personas con experiencias del mundo vivido muy diversas se reúnan en comunidades que ofrezcan seguridad psicológica para tener conversaciones difíciles sobre impactos dispares.

Acogiendo con satisfacción perspectivas más amplias para una IA confiable

IBM® cree en adoptar un enfoque de “cliente cero”, implementando las recomendaciones y sistemas que haría para sus propios clientes a través de consultoría y soluciones basadas en productos. Este enfoque se extiende a las prácticas éticas, razón por la cual IBM creó un Centro de excelencia de IA confiable (COE).

Como se explicó anteriormente, la diversidad de experiencias y habilidades es fundamental para evaluar adecuadamente los impactos de la IA. Pero la perspectiva de participar en un Centro de Excelencia podría resultar intimidante en una empresa repleta de innovadores, expertos e ingenieros distinguidos en IA, por lo que es necesario cultivar una comunidad de seguridad psicológica. IBM comunica esto claramente al decir: “¿Interesado en la IA? ¿Interesado en la ética de la IA? Tienes un asiento en esta mesa”.

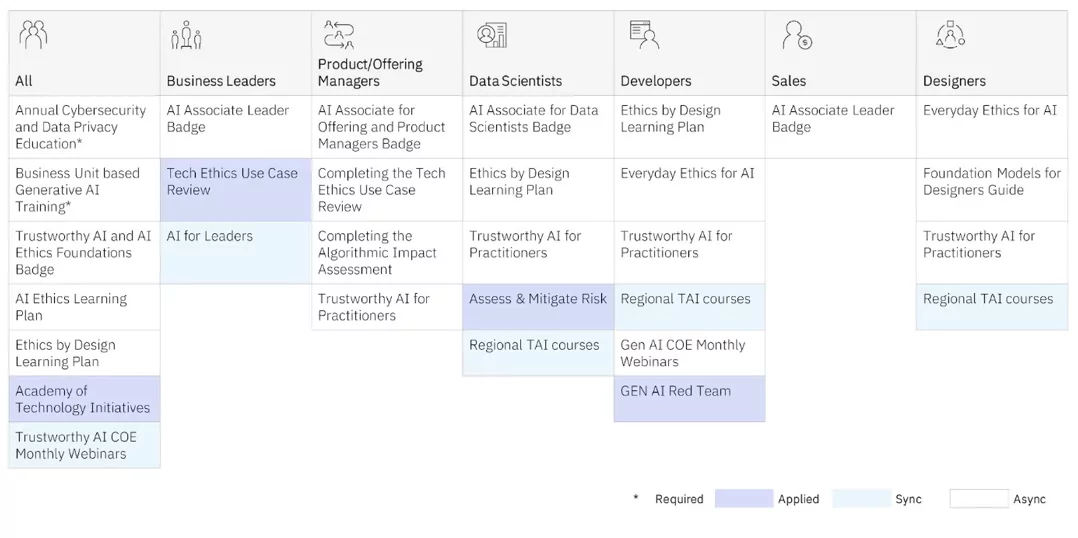

El COE ofrece formación en ética de la IA a profesionales de todos los niveles. Se ofrecen programas de aprendizaje sincrónico (profesor y estudiantes en clase) y asincrónicos (autoguiados).

Pero es del COE aplicada capacitación que brinda a nuestros profesionales los conocimientos más profundos, mientras trabajan con equipos globales, diversos y multidisciplinarios en proyectos reales para comprender mejor el impacto dispar. También aprovechan los marcos de pensamiento de diseño que IBM Diseño para IA El grupo utiliza internamente y con los clientes para evaluar los efectos no deseados de los modelos de IA, teniendo en cuenta a aquellos que a menudo son marginados. (Ver el libro de Sylvia Duckworth Rueda de poder y privilegio para ver ejemplos de cómo las características personales se cruzan para privilegiar o marginar a las personas). IBM también donó muchos de los marcos a la comunidad de código abierto. Diseñar éticamente.

A continuación se muestran algunos de los informes que IBM ha publicado públicamente sobre estos proyectos:

Se requieren herramientas automatizadas de gobernanza del modelo de IA para obtener información importante sobre el rendimiento de su modelo de IA. Pero tenga en cuenta que lo óptimo es capturar el riesgo mucho antes de que su modelo se haya desarrollado y esté en producción. Al crear comunidades de profesionales diversos y multidisciplinarios que ofrecen un espacio seguro para que las personas tengan conversaciones difíciles sobre impactos dispares, puede comenzar su viaje para poner en práctica sus principios y desarrollar la IA de manera responsable.

En la práctica, cuando contrate profesionales de IA, considere que más del 70% del esfuerzo en la creación de modelos consiste en seleccionar los datos correctos. Quiere contratar personas que sepan cómo recopilar datos que sean representativos y que también se recopilen con consentimiento. También desea que haya personas que sepan trabajar en estrecha colaboración con expertos en el campo para asegurarse de que tienen el enfoque correcto. Es clave garantizar que estos profesionales tengan la inteligencia emocional para abordar el desafío de curar la IA de manera responsable con humildad y discernimiento. Debemos ser intencionales a la hora de aprender a reconocer cómo y cuándo los sistemas de IA pueden exacerbar la desigualdad en la misma medida que pueden aumentar la inteligencia humana.

Reinventa el funcionamiento de tu negocio con IA

¿Le resultó útil este artículo?

SíNo

Más de Inteligencia artificial

Boletines informativos de IBM

Obtenga nuestros boletines y actualizaciones de temas que brindan el liderazgo intelectual más reciente y conocimientos sobre tendencias emergentes.

Subscribirme Ahora

Más boletines

- Distribución de relaciones públicas y contenido potenciado por SEO. Consiga amplificado hoy.

- PlatoData.Network Vertical Generativo Ai. Empodérate. Accede Aquí.

- PlatoAiStream. Inteligencia Web3. Conocimiento amplificado. Accede Aquí.

- PlatoESG. Carbón, tecnología limpia, Energía, Ambiente, Solar, Gestión de residuos. Accede Aquí.

- PlatoSalud. Inteligencia en Biotecnología y Ensayos Clínicos. Accede Aquí.

- Fuente: https://www.ibm.com/blog/why-we-need-diverse-multidisciplinary-coes-for-model-risk/

- :posee

- :es

- :no

- :dónde

- $ UP

- 000

- 1

- 16

- 2022

- 2024

- 23

- 25

- 28

- 29

- 30

- 300

- 32

- 39

- 40

- 400

- 65

- 7

- 9

- a

- capacidad

- Nuestra Empresa

- arriba

- AC

- acelerar

- la exactitud

- preciso

- precisamente

- a través de

- la columna Acción

- adaptado

- dirección

- admitir

- adoptar

- Publicidad

- consejos

- afectar

- agentes

- AI

- Modelos AI

- Sistemas de IA

- objetivo

- AL

- algorítmico

- algoritmos

- Todos

- también

- hacerlo

- amp

- an

- Analytics

- y

- cualquier

- Aplicación

- aplicaciones

- enfoque

- somos

- áreas

- artículo

- artificial

- inteligencia artificial

- Inteligencia Artificial (AI)

- AS

- contacta

- evaluar

- Evaluación

- evaluación

- asistentes

- ayudando

- At

- audio

- aumentar

- autor

- Hoy Disponibles

- evitar

- Atrás

- equilibrio

- BE

- esto

- antes

- comenzar

- "Ser"

- cree

- beneficios

- mejores

- Más allá de

- parcialidad

- los prejuicios

- Blog

- Blogs

- Azul

- Boston

- ambas

- más amplio

- Construir la

- funciones de negocios

- negocios

- pero

- .

- by

- PUEDEN

- capturar

- Capturando

- carbono

- tarjeta

- Tarjetas

- servicios sociales

- case

- CAT

- Categoría

- Causa

- Reubicación

- Centro de excelencia

- central

- a ciertos

- Reto

- características

- Chatbots

- comprobar

- sus hijos

- Niños

- círculos

- CIS

- clase

- con claridad.

- clientes

- de cerca

- Soluciones

- Color

- combinación

- viniendo

- Algunos

- Comunidades

- vibrante e inclusiva

- Empresas

- compañía

- Completado

- concepto

- consentimiento

- En consecuencia

- Considerar

- consultoría

- Envase

- continue

- conversaciones

- Core

- correcta

- correlacionado

- Cost

- podría

- creado

- Creamos

- creadores

- crítico

- multitud

- CO

- comisariado

- En la actualidad

- personalizado

- cliente

- experiencia del cliente

- Clientes

- datos

- Fecha

- decisiones

- más profundo

- Predeterminado

- Definiciones

- entregamos

- demuestra

- Desplegando

- descripción

- Diseño

- pensamiento de diseño

- diseñado

- Determinar

- desarrollar

- desarrollado

- una experiencia diferente

- difícil

- digital

- Transformación Digital

- dispar

- Distinguido

- diverso

- Diversidad

- do

- dominio

- donó

- dibujado

- el lado de la transmisión

- E & T

- los efectos

- esfuerzo

- eliminando

- incrustación

- Abrazar

- emergentes

- personas

- habilitar

- interactuando

- Motor

- certificados

- Inglés

- suficientes

- asegurando que

- Participar

- error

- etc.

- Éter (ETH)

- ético

- ética

- evaluar

- evaluación

- evaluación

- Incluso

- Cada

- en todas partes

- exacerbar

- ejemplo

- ejemplos

- Excelencia

- Exit

- esperar

- experience

- Experiencias

- experto

- Experiencia

- expertos

- explicado

- expuesto

- Se extiende

- extremadamente

- facebook messenger

- facilitar

- tener problemas con

- factores importantes

- justicia

- false

- muchos

- RÁPIDO

- pocos

- Encuentre

- Focus

- seguir

- siguiendo

- fuentes

- primer plano

- Formularios

- Fundación

- marcos

- Desde

- frontal o trasero

- funciones

- reunir

- reunido

- reunión

- generativo

- IA generativa

- generador

- obtener

- dado

- da

- Buscar

- objetivo

- Goals

- Va

- candidato

- gobierno

- Gramática

- muy

- Cuadrícula

- Grupo procesos

- Grupo

- Crecimiento

- guía

- daño

- Tienen

- Título

- oír

- altura

- ayuda

- serviciales

- Alta

- alquiler

- Contratación

- su

- mantiene

- holístico

- Inicio

- Cómo

- Como Hacer

- HTTPS

- humana

- Inteligencia humana

- humildad

- Híbrido

- nube híbrida

- i

- ENFERMO

- IBM

- ICO

- ICON

- ideal

- no haber aun identificado una solucion para el problema

- if

- Ignorancia

- imagen

- inmediata

- Impacto

- Impactos

- implementar

- implementación

- importancia

- importante

- mejorar

- mejoras

- mejora

- in

- incluir

- Incluye

- inclusión

- incorporar

- cada vez más

- incrementales

- índice

- energético

- Influyente

- información

- Innovation

- innovadores

- Las opciones de entrada

- penetración

- Insights

- instantáneamente

- Innovadora

- aseguradora

- Aseguradores

- Intelligence

- De Operación

- intención

- Intencional

- intenciones

- interesado

- intereses

- internamente

- intersecarse

- intervención

- intimidante

- intrínseco

- ISN

- cuestiones

- IT

- SUS

- Enero

- únete

- Unáse con nosotros

- jpg

- solo

- acuerdo

- Clave

- Saber

- conocido

- Falta

- idioma

- Idiomas

- large

- Gran escala

- más reciente

- Lead

- líder

- Liderazgo

- aprendizaje

- dejar

- Nivel

- Apalancamiento

- fiscal

- Mentir

- como

- Limitada

- Lista

- local

- local

- MIRADAS

- para lograr

- Realizar

- Management

- manual

- muchos

- las matemáticas

- matemático

- Materia

- max-ancho

- Puede..

- me

- personalizado

- Conoce a

- Messenger

- podría

- min

- mente

- mínimo

- minutos

- Móvil

- modelo

- modelos

- modernización

- más,

- MEJOR DE TU

- movimiento

- mucho más

- multidisciplinario

- debe

- my

- Naturaleza

- Navegación

- necesario

- ¿ Necesita ayuda

- negativamente

- Nuevo

- nuevos diseños y productos

- Boletines

- nlp

- no

- nota

- nada

- ahora

- numeroso

- of

- off

- LANZAMIENTO

- Ofrecido

- Ofertas

- a menudo

- on

- ONE

- de código abierto

- Opinión

- Del Mañana

- óptimo

- optimizado

- or

- para las fiestas.

- Otro

- nuestros

- Superar

- salidas

- Más de

- EL DESARROLLADOR

- los propietarios de

- página

- participativo

- pass

- (PDF)

- Personas

- realizar

- persona

- con

- Personalmente

- perspectivas

- PHP

- pii

- jubilación

- Platón

- Inteligencia de datos de Platón

- PlatónDatos

- plugin

- política

- posición

- Publicación

- posible

- Clientes potenciales

- industria

- poderoso

- prácticas

- predicción

- Predicciones

- profético

- primario

- principios

- priorizar

- privilegio

- Problema

- obtención

- produce

- Producción

- productividad

- Productos

- Programas

- proyecta

- correctamente

- perspectiva

- previsto

- proporcionando

- proxies

- apoderado

- psicológico

- en público

- publicado

- poner

- Preguntas

- con rapidez

- cotización inicial

- raramente

- Preparación

- Reading

- real

- Realidad

- reconocer

- recomendaciones

- la reducción de

- FILTRO

- reflejar

- refleja

- reglamentos

- Informes

- representante

- representado

- solicitudes

- exigir

- Requisitos

- la investigación

- responder

- responsable

- responsablemente

- sensible

- ingresos

- crecimiento de ingresos

- Derecho

- Riesgo

- factores de riesgo

- riesgos

- carretera

- los robots

- ambiente seguro

- Safety

- Said

- mismo

- decir

- Escala

- la ampliación

- Ciencia:

- Pantalla

- guiones

- Buscar

- motor de búsqueda

- seguro

- ver

- SEO

- sirve

- ajustes

- tienes

- mostrado

- simplemente

- página web

- flojo

- chica

- inteligente

- Altavoces inteligentes

- SMS

- So

- a medida

- Soluciones

- algo

- Fuentes

- Espacio

- altavoces

- Patrocinado

- cuadrados

- las partes interesadas

- estándar

- comienzo

- el estado de la técnica

- estadístico

- statistics

- Estudiantes

- ESTUDIO

- sujeto

- Suscríbase

- tal

- SOPORTE

- Apoyar

- SVG

- Todas las funciones a su disposición

- T

- mesa

- toma

- tiene como objetivo

- profesor

- equipos

- Técnico

- Tecnologías

- terciario

- texto

- que

- gracias

- esa

- La

- el mundo

- su

- Les

- tema

- sí mismos

- Estas

- ellos

- pensar

- Ideas

- así

- aquellos

- pensamiento

- liderazgo de pensamiento

- Tres

- A través de esta formación, el personal docente y administrativo de escuelas y universidades estará preparado para manejar los recursos disponibles que derivan de la diversidad cultural de sus estudiantes. Además, un mejor y mayor entendimiento sobre estas diferencias y similitudes culturales permitirá alcanzar los objetivos de inclusión previstos.

- equipo

- Título

- a

- juntos

- parte superior

- tema

- difícil

- Entrenar

- Formación

- Tendencias

- verdadero

- digno de confianza

- dos

- tipo

- principiante

- entender

- injusto

- único

- desbloqueo

- Actualizaciones

- a

- Enlance

- us

- utilizan el

- caso de uso

- usos

- Utilizando

- propuesta de

- Valores

- variedad

- variar

- muy

- Virtual

- volumen

- W

- quieres

- fue

- we

- WELL

- ¿

- Que es

- cuando

- sean

- que

- mientras

- QUIENES

- quién

- porque

- extensamente

- más ancho

- seguirá

- sabiduría

- FUNDACION

- Palabra

- WordPress

- Actividades:

- funciona

- mundo

- se

- escrito

- Mal

- aún

- Usted

- tú

- zephyrnet