Generative KI-Lösungen haben das Potenzial, Unternehmen zu verändern, indem sie die Produktivität steigern und das Kundenerlebnis verbessern, und die Verwendung großer Sprachmodelle (LLMs) mit diesen Lösungen erfreut sich immer größerer Beliebtheit. Die Erstellung von Proofs of Concept ist relativ einfach, da sie auf dem neuesten Stand sind Gründungsmodelle sind über einen einfachen API-Aufruf bei spezialisierten Anbietern verfügbar. Daher haben Unternehmen unterschiedlicher Größe und aus unterschiedlichen Branchen damit begonnen, ihre Produkte und Prozesse mithilfe generativer KI neu zu gestalten.

Trotz ihres umfangreichen Allgemeinwissens haben hochmoderne LLMs nur Zugriff auf die Informationen, auf denen sie ausgebildet wurden. Dies kann zu sachlichen Ungenauigkeiten (Halluzinationen) führen, wenn der LLM aufgefordert wird, Text auf der Grundlage von Informationen zu generieren, die er während seines Trainings nicht gesehen hat. Daher ist es wichtig, die Lücke zwischen dem allgemeinen Wissen des LLM und Ihren proprietären Daten zu schließen, um dem Modell zu helfen, genauere und kontextbezogenere Antworten zu generieren und gleichzeitig das Risiko von Halluzinationen zu verringern. Die traditionelle Methode der Feinabstimmung ist zwar effektiv, kann jedoch rechenintensiv und teuer sein und erfordert technisches Fachwissen. Eine weitere zu berücksichtigende Option ist aufgerufen Retrieval Augmented Generation (RAG), das LLMs zusätzliche Informationen aus einer externen Wissensquelle zur Verfügung stellt, die leicht aktualisiert werden können.

Darüber hinaus müssen Unternehmen die Datensicherheit beim Umgang mit proprietären und sensiblen Daten wie personenbezogenen Daten oder geistigem Eigentum gewährleisten. Dies ist besonders wichtig für Organisationen, die in stark regulierten Branchen wie Finanzdienstleistungen sowie Gesundheitswesen und Biowissenschaften tätig sind. Daher ist es wichtig, den Fluss Ihrer Daten durch die generative KI-Anwendung zu verstehen und zu steuern: Wo befindet sich das Modell? Wo werden die Daten verarbeitet? Wer hat Zugriff auf die Daten? Werden die Daten zum Trainieren von Modellen verwendet, wodurch möglicherweise die Gefahr besteht, dass sensible Daten an öffentliche LLMs weitergegeben werden?

In diesem Beitrag wird erläutert, wie Unternehmen präzise, transparente und sichere generative KI-Anwendungen erstellen und gleichzeitig die volle Kontrolle über proprietäre Daten behalten können. Bei der vorgeschlagenen Lösung handelt es sich um eine RAG-Pipeline, die einen KI-nativen Technologie-Stack nutzt, dessen Komponenten von Grund auf mit KI als Kernstück konzipiert sind, anstatt erst nachträglich KI-Funktionen hinzuzufügen. Wir demonstrieren, wie Sie mit eine End-to-End-RAG-Anwendung erstellen Coheres Sprachmodelle bis Amazonas Grundgestein und einem Weaviate-Vektordatenbank auf AWS Marketplace. Der zugehörige Quellcode ist im verfügbar zugehöriges GitHub-Repository gehostet von Weaviate. Obwohl AWS nicht für die Pflege oder Aktualisierung des Codes im Repository des Partners verantwortlich ist, empfehlen wir Kunden, sich bezüglich gewünschter Aktualisierungen direkt an Weaviate zu wenden.

Lösungsüberblick

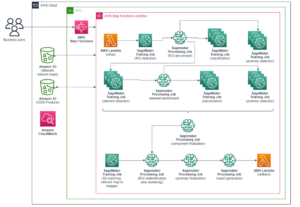

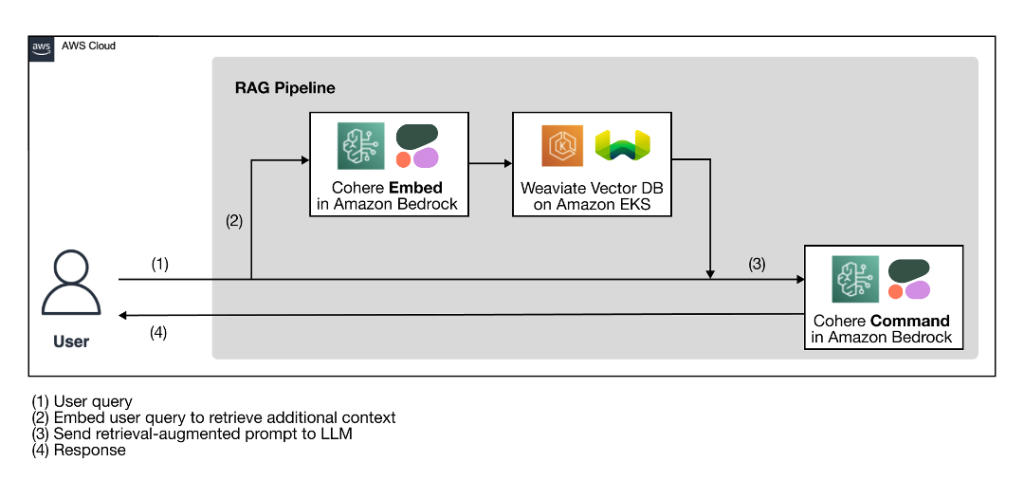

Das folgende allgemeine Architekturdiagramm veranschaulicht die vorgeschlagene RAG-Pipeline mit einem KI-nativen Technologie-Stack zum Aufbau präziser, transparenter und sicherer generativer KI-Lösungen.

Abbildung 1: RAG-Workflow unter Verwendung der Sprachmodelle von Cohere über Amazon Bedrock und einer Weaviate-Vektordatenbank auf AWS Marketplace

Als Vorbereitungsschritt für den RAG-Workflow wird eine Vektordatenbank, die als externe Wissensquelle dient, mit dem zusätzlichen Kontext aus den proprietären Daten aufgenommen. Der eigentliche RAG-Workflow folgt den vier im Diagramm dargestellten Schritten:

- Der Benutzer gibt seine Anfrage ein.

- Die Benutzerabfrage wird verwendet, um relevanten zusätzlichen Kontext aus der Vektordatenbank abzurufen. Dazu werden die Vektoreinbettungen der Benutzerabfrage mit einem Einbettungsmodell generiert, um eine Vektorsuche durchzuführen und den relevantesten Kontext aus der Datenbank abzurufen.

- Der abgerufene Kontext und die Benutzerabfrage werden zur Erweiterung einer Eingabeaufforderungsvorlage verwendet. Die durch den Abruf erweiterte Eingabeaufforderung hilft dem LLM, eine relevantere und genauere Vervollständigung zu generieren und Halluzinationen zu minimieren.

- Der Benutzer erhält eine genauere Antwort basierend auf seiner Anfrage.

Der im Architekturdiagramm dargestellte KI-native Technologie-Stack besteht aus zwei Schlüsselkomponenten: Cohere-Sprachmodellen und einer Weaviate-Vektordatenbank.

Kohärente Sprachmodelle in Amazon Bedrock

Das Cohere-Plattform stellt Unternehmen und Entwicklern über einen einfachen API-Aufruf Sprachmodelle mit modernster Leistung zur Verfügung. Es gibt zwei Haupttypen von Sprachverarbeitungsfunktionen, die die Cohere-Plattform bereitstellt – generativ und einbettend – und jede wird durch einen anderen Modelltyp bedient:

- Texterzeugung mit Befehl – Entwickler können auf Endpunkte zugreifen, die generative KI-Funktionen unterstützen und Anwendungen wie Konversation, Beantwortung von Fragen, Texterstellung, Zusammenfassung, Informationsextraktion und mehr ermöglichen.

- Textdarstellung mit Einbetten – Entwickler können auf Endpunkte zugreifen, die die semantische Bedeutung von Text erfassen und so Anwendungen wie Vektorsuchmaschinen, Textklassifizierung und -clusterung und mehr ermöglichen. Cohere Embed gibt es in zwei Formen: einem englischsprachigen Modell und einem mehrsprachigen Modell Jetzt auf Amazon Bedrock erhältlich.

Mit der Cohere-Plattform können Unternehmen ihre generative KI-Lösung privat und sicher über die Bereitstellung von Amazon Bedrock anpassen. Amazon Bedrock ist ein vollständig verwalteter Cloud-Service, der es Entwicklungsteams ermöglicht, generative KI-Anwendungen schnell zu erstellen und zu skalieren Gleichzeitig tragen Sie dazu bei, dass Ihre Daten und Anwendungen sicher und privat bleiben. Ihre Daten werden nicht für Serviceverbesserungen verwendet, niemals an Drittanbieter von Modellen weitergegeben und verbleiben in der Region wo der API-Aufruf verarbeitet wird. Die Daten werden während der Übertragung und im Ruhezustand immer verschlüsselt, und Sie können die Daten mit Ihren eigenen Schlüsseln verschlüsseln. Amazon Bedrock unterstützt Sicherheitsanforderungen, einschließlich der Berechtigung zum US Health Insurance Portability and Accountability Act (HIPAA) und der Einhaltung der Datenschutz-Grundverordnung (DSGVO). Darüber hinaus können Sie Ihre generativen KI-Anwendungen mit den AWS-Tools, mit denen Sie bereits vertraut sind, sicher integrieren und einfach bereitstellen.

Weaviate-Vektordatenbank auf AWS Marketplace

Weben ist ein KI-nativ Vektordatenbank Dies erleichtert Entwicklungsteams die Erstellung sicherer und transparenter generativer KI-Anwendungen. Weaviate wird zum Speichern und Durchsuchen sowohl von Vektordaten als auch von Quellobjekten verwendet, was die Entwicklung vereinfacht, da das Hosten und Integrieren separater Datenbanken entfällt. Weaviate bietet eine semantische Suchleistung im Sekundenbruchteil und kann für die Verarbeitung von Milliarden von Vektoren und Millionen von Mietern skaliert werden. Mit einer einzigartig erweiterbaren Architektur lässt sich Weaviate nativ in die in Amazon Bedrock bereitgestellten Cohere-Grundlagenmodelle integrieren, um die bequeme Vektorisierung von Daten zu erleichtern und deren generative Fähigkeiten innerhalb der Datenbank zu nutzen.

Die KI-native Vektordatenbank von Weaviate bietet Kunden die Flexibilität, sie als Bring-Your-Own-Cloud-Lösung (BYOC) oder als verwalteten Dienst bereitzustellen. Diese Vitrine verwendet die Weaviate Kubernetes Cluster auf AWS Marketplace, Teil des BYOC-Angebots von Weaviate, das mit nur wenigen Klicks eine containerbasierte, skalierbare Bereitstellung innerhalb Ihres AWS-Mandanten und Ihrer VPC ermöglicht AWS CloudFormation Vorlage. Dieser Ansatz stellt sicher, dass Ihre Vektordatenbank in Ihrer spezifischen Region nahe an den Grundmodellen und proprietären Daten bereitgestellt wird, um die Latenz zu minimieren, die Datenlokalität zu unterstützen und sensible Daten zu schützen und gleichzeitig mögliche regulatorische Anforderungen wie die DSGVO zu erfüllen.

Anwendungsfallübersicht

In den folgenden Abschnitten zeigen wir, wie Sie eine RAG-Lösung mithilfe des AI-nativen Technologie-Stacks mit Cohere, AWS und Weaviate erstellen, wie in der Lösungsübersicht dargestellt.

Der Beispielanwendungsfall generiert gezielte Werbung für Urlaubseinträge basierend auf einer Zielgruppe. Ziel ist es, über die Nutzeranfrage nach der Zielgruppe (z. B. „Familie mit kleinen Kindern“) das relevanteste Ferienangebot (z. B. ein Angebot mit Spielplätzen in der Nähe) abzurufen und anschließend eine Anzeige dafür zu generieren abgerufenen, auf die Zielgruppe zugeschnittenen Eintrag.

Abbildung 2: Erste Zeilen mit Ferienangeboten, die bei Inside Airbnb verfügbar sind.

Der Datensatz ist verfügbar unter Innerhalb von Airbnb und ist lizenziert unter a Creative Commons Namensnennung 4.0 Internationale Lizenz. Den zugehörigen Code finden Sie im GitHub-Repository.

Voraussetzungen:

Um dem folgenden Tutorial folgen und alle AWS-Services nutzen zu können, stellen Sie sicher, dass Sie über eine verfügen AWS-Konto.

Aktivieren Sie Komponenten des KI-nativen Technologie-Stacks

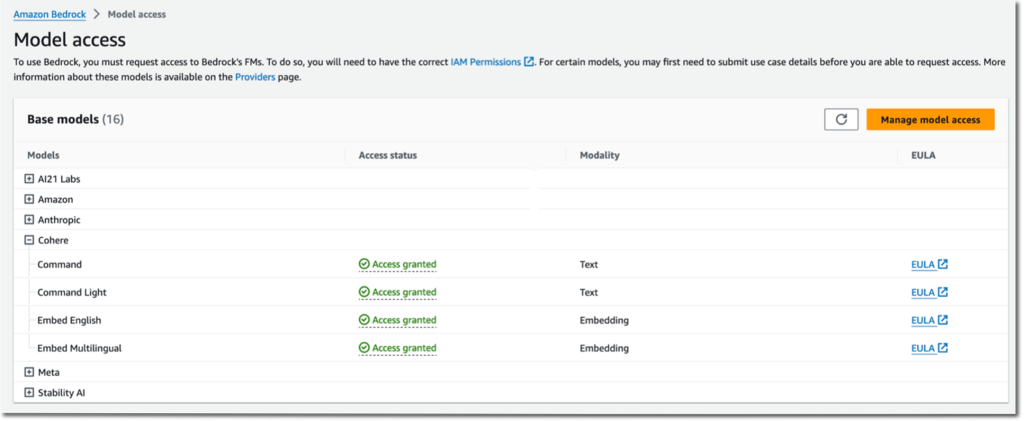

Zunächst müssen Sie die relevanten Komponenten, die in der Lösungsübersicht beschrieben werden, in Ihrem AWS-Konto aktivieren. Führen Sie die folgenden Schritte aus:

- In der linken Amazon Bedrock-Konsole, wählen Modellzugriff im Navigationsbereich.

- Auswählen Modellzugriff verwalten oben rechts.

- Wählen Sie die Fundamentmodelle Ihrer Wahl aus und fordern Sie den Zugang an.

Abbildung 3: Modellzugriff in der Amazon Bedrock-Konsole verwalten.

Als Nächstes richten Sie einen Weaviate-Cluster ein.

- Abonnieren Sie die Weaviate Kubernetes Cluster auf AWS Marketplace.

- Starten Sie die Software mit a CloudFormation-Vorlage entsprechend Ihrer bevorzugten Availability Zone.

Die CloudFormation-Vorlage ist vorab mit Standardwerten gefüllt.

- Aussichten für Stapelname, geben Sie einen Stapelnamen ein.

- Aussichten für helmauthenticationtype, wird empfohlen, die Authentifizierung per Einstellung zu aktivieren

helmauthenticationtypezuapikeyund Definieren von a helmauthenticationapikey. - Aussichten für helmauthenticationapikey, geben Sie Ihren Weaviate-API-Schlüssel ein.

- Aussichten für Helmchartversion, geben Sie Ihre Versionsnummer ein. Es muss mindestens Version 16.8.0 sein. Siehe die GitHub Repo für die neueste Version.

- Aussichten für helmenabledmodules, Stelle sicher

tex2vec-awsmachengenerative-awssind in der Liste der aktivierten Module in Weaviate vorhanden.

Abbildung 4: CloudFormation-Vorlage.

Die Fertigstellung dieser Vorlage dauert etwa 30 Minuten.

Stellen Sie eine Verbindung zu Weaviate her

Führen Sie die folgenden Schritte aus, um eine Verbindung zu Weaviate herzustellen:

- Im Amazon SageMaker-Konsole, navigiere zu Notebook-Instanzen im Navigationsbereich über Notizbuch > Notebook-Instanzen auf der Linken.

- Erstellen Sie eine neue Notebook-Instanz.

- Installieren Sie das Weaviate-Clientpaket mit den erforderlichen Abhängigkeiten:

- Stellen Sie mit dem folgenden Code eine Verbindung zu Ihrer Weaviate-Instanz her:

- Weaviate-URL – Greifen Sie über die Load-Balancer-URL auf Weaviate zu. Im Amazon Elastic Compute-Cloud (Amazon EC2) Konsole, wählen Sie Load Balancer im Navigationsbereich und suchen Sie den Load Balancer. Suchen Sie nach der Spalte „DNS-Name“ und fügen Sie sie hinzu

http://vor. - Weaviate-API-Schlüssel – Dies ist der Schlüssel, den Sie zuvor in der CloudFormation-Vorlage festgelegt haben (

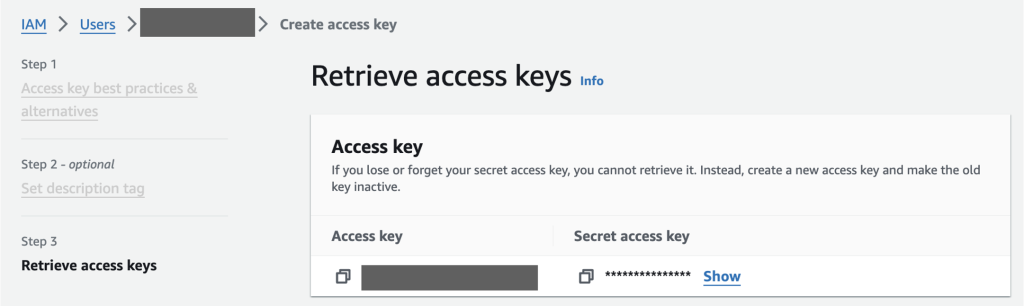

helmauthenticationapikey). - AWS-Zugriffsschlüssel und geheimer Zugriffsschlüssel – Sie können den Zugangsschlüssel und den geheimen Zugangsschlüssel für Ihren Benutzer im abrufen AWS Identity and Access Management and (IAM)-Konsole.

Abbildung 5: AWS Identity and Access Management (IAM)-Konsole zum Abrufen des AWS-Zugriffsschlüssels und des geheimen Zugriffsschlüssels.

Konfigurieren Sie das Amazon Bedrock-Modul, um Cohere-Modelle zu aktivieren

Als Nächstes definieren Sie eine Datensammlung (class) namens Listings zum Speichern der Datenobjekte der Auflistungen, was dem Erstellen einer Tabelle in einer relationalen Datenbank entspricht. In diesem Schritt konfigurieren Sie die relevanten Module, um die Nutzung der auf Amazon Bedrock gehosteten Cohere-Sprachmodelle nativ aus der Weaviate-Vektordatenbank zu ermöglichen. Der Vektorisierer („text2vec-aws„) und generatives Modul („generative-aws„) werden in der Datenerfassungsdefinition angegeben. Beide Module benötigen drei Parameter:

- "Bedienung" - Verwenden "

bedrock” für Amazon Bedrock (alternativ verwenden Sie „sagemaker" zum Amazon SageMaker-JumpStart) - "Region" – Geben Sie die Region ein, in der Ihr Modell bereitgestellt wird

- "Modell" – Geben Sie den Namen des Fundamentmodells an

Siehe folgenden Code:

Nehmen Sie Daten in die Weaviate-Vektordatenbank auf

In diesem Schritt definieren Sie die Struktur der Datensammlung, indem Sie ihre Eigenschaften konfigurieren. Neben dem Namen und dem Datentyp der Eigenschaft können Sie auch konfigurieren, ob nur das Datenobjekt oder zusammen mit seinen Vektoreinbettungen gespeichert wird. In diesem Beispiel, host_name machen property_type sind nicht vektorisiert:

Führen Sie den folgenden Code aus, um die Sammlung in Ihrer Weaviate-Instanz zu erstellen:

Sie können jetzt Objekte zu Weaviate hinzufügen. Für maximale Effizienz nutzen Sie einen Batch-Importprozess. Führen Sie den folgenden Code aus, um Daten zu importieren. Während des Imports verwendet Weaviate den definierten Vektorisierer, um für jedes Objekt eine Vektoreinbettung zu erstellen. Der folgende Code lädt Objekte, initialisiert einen Batch-Prozess und fügt der Zielsammlung nacheinander Objekte hinzu:

Augmented Generation abrufen

Sie können eine RAG-Pipeline erstellen, indem Sie eine generative Suchabfrage auf Ihrer Weaviate-Instanz implementieren. Dazu definieren Sie zunächst eine Prompt-Vorlage in Form eines F-Strings, der die Benutzeranfrage aufnehmen kann ({target_audience}) direkt und der zusätzliche Kontext ({{host_name}}, {{property_type}}, {{description}} und {{neighborhood_overview}}) aus der Vektordatenbank zur Laufzeit:

Als Nächstes führen Sie eine generative Suchabfrage aus. Dadurch wird das definierte generative Modell mit einer Eingabeaufforderung aufgefordert, die aus der Benutzerabfrage und den abgerufenen Daten besteht. Die folgende Abfrage ruft ein Auflistungsobjekt ab (.with_limit(1)) Aus dem Listings Sammlung, die der Benutzerabfrage am ähnlichsten ist (.with_near_text({"concepts": target_audience})). Dann wird die Benutzerabfrage (target_audience) und die abgerufenen Auflistungseigenschaften (["description", "neighborhood", "host_name", "property_type"]) werden in die Eingabeaufforderungsvorlage eingespeist. Siehe den folgenden Code:

Im folgenden Beispiel können Sie sehen, dass der vorhergehende Codeabschnitt für target_audience = “Family with small children” ruft eine Auflistung vom Host Marre ab. Die Eingabeaufforderungsvorlage wird durch die Eintragsdetails von Marre und die Zielgruppe ergänzt:

Basierend auf der durch den Abruf erweiterten Eingabeaufforderung generiert das Befehlsmodell von Cohere die folgende gezielte Werbung:

Alternative Anpassungen

Sie können alternative Anpassungen an verschiedenen Komponenten in der vorgeschlagenen Lösung vornehmen, wie zum Beispiel die folgenden:

- Die Sprachmodelle von Cohere sind auch über verfügbar Amazon SageMaker-JumpStart, das Zugriff auf modernste Basismodelle bietet und Entwicklern die Bereitstellung von LLMs ermöglicht Amazon Sage Maker, ein vollständig verwalteter Dienst, der eine breite Palette von Tools vereint, um leistungsstarkes und kostengünstiges maschinelles Lernen für jeden Anwendungsfall zu ermöglichen. Weaviate ist auch in SageMaker integriert.

- Eine leistungsstarke Ergänzung zu dieser Lösung ist die Cohere Rerank Endpunkt, erhältlich über SageMaker JumpStart. Reranking kann die Relevanz von Suchergebnissen aus der lexikalischen oder semantischen Suche verbessern. Rerank funktioniert, indem es semantische Relevanzwerte für Dokumente berechnet, die von einem Suchsystem abgerufen werden, und die Dokumente anhand dieser Werte in eine Rangfolge bringt. Das Hinzufügen von Rerank zu einer Anwendung erfordert nur eine einzige Codezeilenänderung.

- Um den unterschiedlichen Bereitstellungsanforderungen verschiedener Produktionsumgebungen gerecht zu werden, kann Weaviate auf verschiedene zusätzliche Arten bereitgestellt werden. Es ist beispielsweise als direkter Download verfügbar unter Weaviate-Websiteläuft weiter Amazon Elastic Kubernetes-Service (Amazon EKS) oder lokal über Docker or Kubernetes. Es ist auch als erhältlich Managed Service das sicher innerhalb einer VPC oder als öffentlicher Cloud-Dienst auf AWS mit einer 14-tägigen kostenlosen Testversion ausgeführt werden kann.

- Sie können Ihre Lösung in einer VPC mit bereitstellen Amazon Virtual Private Cloud (Amazon VPC), das es Unternehmen ermöglicht, AWS-Dienste in einem logisch isolierten virtuellen Netzwerk zu starten, das einem herkömmlichen Netzwerk ähnelt, aber die Vorteile der skalierbaren Infrastruktur von AWS bietet. Abhängig vom klassifizierten Vertraulichkeitsgrad der Daten können Organisationen auch den Internetzugang in diesen VPCs deaktivieren.

Aufräumen

Um unerwartete Kosten zu vermeiden, löschen Sie alle Ressourcen, die Sie im Rahmen dieses Beitrags bereitgestellt haben. Wenn Sie den CloudFormation-Stack gestartet haben, können Sie ihn über die AWS CloudFormation-Konsole löschen. Beachten Sie, dass möglicherweise einige AWS-Ressourcen vorhanden sind, z Amazon Elastic Block-Shop (Amazon EBS) Bände und AWS-Schlüsselverwaltungsservice (AWS KMS)-Schlüssel, die möglicherweise nicht automatisch gelöscht werden, wenn der CloudFormation-Stack gelöscht wird.

Abbildung 6: Alle Ressourcen über die AWS CloudFormation-Konsole löschen.

Zusammenfassung

In diesem Beitrag wurde erläutert, wie Unternehmen präzise, transparente und sichere generative KI-Anwendungen erstellen und gleichzeitig die volle Kontrolle über ihre Daten behalten können. Die vorgeschlagene Lösung ist eine RAG-Pipeline, die einen KI-nativen Technologie-Stack als Kombination aus Cohere-Grundlagenmodellen in Amazon Bedrock und einer Weaviate-Vektordatenbank auf AWS Marketplace verwendet. Der RAG-Ansatz ermöglicht es Unternehmen, die Lücke zwischen dem allgemeinen Wissen des LLM und den proprietären Daten zu schließen und gleichzeitig Halluzinationen zu minimieren. Ein KI-nativer Technologie-Stack ermöglicht eine schnelle Entwicklung und skalierbare Leistung.

Mithilfe der in diesem Beitrag beschriebenen Schritte können Sie mit dem Experimentieren mit RAG-Proofs of Concept für Ihre unternehmenstauglichen generativen KI-Anwendungen beginnen. Der zugehörige Quellcode ist im verfügbar zugehöriges GitHub-Repository. Vielen Dank fürs Lesen. Fühlen Sie sich frei, Kommentare oder Feedback im Kommentarbereich abzugeben.

Über die Autoren

James Yi ist Senior AI/ML Partner Solutions Architect im Technology Partners COE Tech-Team bei Amazon Web Services. Er arbeitet leidenschaftlich gerne mit Unternehmenskunden und Partnern zusammen, um KI/ML-Anwendungen zu entwerfen, bereitzustellen und zu skalieren, um einen Geschäftswert zu erzielen. Außerhalb der Arbeit spielt er gerne Fußball, reist und verbringt Zeit mit seiner Familie.

James Yi ist Senior AI/ML Partner Solutions Architect im Technology Partners COE Tech-Team bei Amazon Web Services. Er arbeitet leidenschaftlich gerne mit Unternehmenskunden und Partnern zusammen, um KI/ML-Anwendungen zu entwerfen, bereitzustellen und zu skalieren, um einen Geschäftswert zu erzielen. Außerhalb der Arbeit spielt er gerne Fußball, reist und verbringt Zeit mit seiner Familie.

Leonie Monigatti ist Developer Advocate bei Weaviate. Ihr Schwerpunkt liegt auf KI/ML und sie hilft Entwicklern, etwas über generative KI zu lernen. Außerhalb der Arbeit teilt sie ihre Erkenntnisse in Datenwissenschaft und ML auch auf ihrem Blog und auf Kaggle.

Leonie Monigatti ist Developer Advocate bei Weaviate. Ihr Schwerpunkt liegt auf KI/ML und sie hilft Entwicklern, etwas über generative KI zu lernen. Außerhalb der Arbeit teilt sie ihre Erkenntnisse in Datenwissenschaft und ML auch auf ihrem Blog und auf Kaggle.

Meor Amer ist Developer Advocate bei Cohere, einem Anbieter modernster NLP-Technologie (Natural Language Processing). Er hilft Entwicklern beim Aufbau modernster Anwendungen mit den Large Language Models (LLMs) von Cohere.

Meor Amer ist Developer Advocate bei Cohere, einem Anbieter modernster NLP-Technologie (Natural Language Processing). Er hilft Entwicklern beim Aufbau modernster Anwendungen mit den Large Language Models (LLMs) von Cohere.

Meide Mao ist Senior AI/ML Partner Solutions Architect im Emerging Technologies-Team bei Amazon Web Services. Seine Leidenschaft liegt in der Zusammenarbeit mit Unternehmenskunden und Partnern, um KI/ML-Anwendungen zu entwerfen, bereitzustellen und zu skalieren, um deren Geschäftswerte abzuleiten. Außerhalb der Arbeit geht er gerne angeln, reisen und Tischtennis spielen.

Meide Mao ist Senior AI/ML Partner Solutions Architect im Emerging Technologies-Team bei Amazon Web Services. Seine Leidenschaft liegt in der Zusammenarbeit mit Unternehmenskunden und Partnern, um KI/ML-Anwendungen zu entwerfen, bereitzustellen und zu skalieren, um deren Geschäftswerte abzuleiten. Außerhalb der Arbeit geht er gerne angeln, reisen und Tischtennis spielen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/build-enterprise-ready-generative-ai-solutions-with-cohere-foundation-models-in-amazon-bedrock-and-weaviate-vector-database-on-aws-marketplace/

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 16

- 17

- 19

- 23

- 30

- 32

- 33

- 7

- 8

- 9

- a

- Über uns

- Zugang

- Nach

- Konto

- Rechenschaftspflicht

- genau

- über

- Handlung

- präsentieren

- hinzufügen

- hinzugefügt

- Hinzufügen

- Zusatz

- Zusätzliche

- Zusätzliche Angaben

- zusätzlich

- Adressierung

- Fügt

- Erwachsene

- Werbung

- Anwalt

- AI

- AI / ML

- Airbnb

- Alle

- erlaubt

- entlang

- bereits

- ebenfalls

- Alternative

- Obwohl

- immer

- Amazon

- Amazon EC2

- Amazon Sage Maker

- Amazon Web Services

- amsterdam

- an

- machen

- Ein anderer

- Beantwortung

- jedem

- Bienen

- Anwendung

- Anwendungen

- Ansatz

- Architektur

- SIND

- Bereich

- Bereiche

- AS

- beiseite

- At

- Attraktionen

- Publikum

- vermehren

- Augmented

- Authentifizierung

- Im Prinzip so, wie Sie es von Google Maps kennen.

- Verfügbarkeit

- verfügbar

- ein Weg

- AWS

- AWS CloudFormation

- AWS Identitäts- und Zugriffsverwaltung (IAM)

- AWS-Marktplatz

- Balancer

- Riegel

- basierend

- BE

- weil

- werden

- begonnen

- Vorteile

- BESTE

- zwischen

- Milliarden

- Blockieren

- Blog

- Stärkung

- beide

- BRIDGE

- Brings

- breit

- bauen

- Building

- Geschäft

- Unternehmen

- aber

- by

- Cafés

- rufen Sie uns an!

- namens

- CAN

- Fähigkeiten

- Erfassung

- Häuser

- sorgen

- Hauptgeschäftsstelle

- Zentrum

- Übernehmen

- Gebühren

- weltweit

- Wahl

- Auswählen

- Stadt

- Klasse

- Einstufung

- eingestuft

- Auftraggeber

- Menu

- Cloud

- Cluster

- Clustering

- Code

- Sammlung

- Kolonne

- Kombination

- wie die

- kommt

- Bemerkungen

- Unterhaus

- abschließen

- Abschluss

- Compliance

- Komponenten

- Bestehend

- Berechnen

- Computing

- konzept

- Konzepte

- konfigurieren

- Vernetz Dich

- Geht davon

- Konsul (Console)

- Kontext

- kontextuelle

- Smartgeräte App

- Praktische

- bequem

- Konversations

- Copywriting

- Kernbereich

- erstellen

- Erstellen

- wichtig

- Kunde

- Kunden

- anpassen

- innovativ, auf dem neuesten Stand

- technische Daten

- Datenschutz

- Datenwissenschaft

- Datensicherheit

- Datenbase

- Datenbanken

- Standard

- definieren

- definiert

- Definition

- Definition

- liefert

- zeigen

- Abhängigkeiten

- Abhängig

- einsetzen

- Einsatz

- Einsatz

- ableiten

- Beschreibung

- Design

- entworfen

- erwünscht

- Details

- Entwickler:in / Unternehmen

- Entwickler

- Entwicklung

- Entwicklungsteams

- anders

- Ess-

- Direkt

- Direkt

- diskutiert

- dns

- Unterlagen

- erledigt

- herunterladen

- im

- jeder

- Früher

- leicht

- ebs

- Effektiv

- Effizienz

- erhöhten

- Wählbarkeit

- eliminieren

- einbetten

- Einbettung

- aufstrebenden

- aufkommende Technologien

- befähigt

- ermöglichen

- freigegeben

- ermöglicht

- ermöglichen

- ermutigen

- verschlüsselt

- End-to-End

- Endpunkte

- Motor (en)

- Englisch

- gewährleisten

- sorgt

- Enter

- Unternehmen

- Unternehmenskunden

- Unternehmen

- Tritt ein

- Ganz

- Umgebungen

- Äther (ETH)

- schließlich

- Beispiel

- teuer

- ERFAHRUNGEN

- Erfahrungen

- Expertise

- extern

- Extraktion

- erleichtern

- Sachliche

- vertraut

- Familie

- FAST

- Eigenschaften

- Einzigartige

- Fed

- Feedback

- fühlen

- wenige

- Reichen Sie das

- Revolution

- Finanzdienstleistungen

- Finden Sie

- Vorname

- Fischen

- Flexibilität

- Boden

- Fluss

- Setzen Sie mit Achtsamkeit

- folgen

- Folgende

- folgt

- Aussichten für

- unten stehende Formular

- Formen

- Foundation

- vier

- Frei

- die kostenlose Testversion.

- für

- Materials des

- voller

- voll

- weiter

- Lücke

- DSGVO

- Allgemeines

- Allgemeine Daten

- Allgemeine Datenschutzverordnung

- erzeugen

- erzeugt

- Erzeugung

- Generation

- generativ

- Generative KI

- generatives Modell

- GitHub

- gibt

- Kundenziele

- Boden

- Gruppe an

- Hälfte

- Griff

- Handling

- Haben

- mit

- he

- Überschrift

- Gesundheit

- Krankenversicherung

- Gesundheitswesen

- Herz

- schwer

- Hilfe

- Unternehmen

- hilft

- hier (auf dänisch)

- High-Level

- Hohe Leistungsfähigkeit

- seine

- Startseite

- Gastgeber

- gehostet

- Ultraschall

- Hilfe

- http

- HTTPS

- IAM

- Identitätsschutz

- Identitäts- und Zugriffsverwaltung

- Identitäts- und Zugriffsverwaltung (IAM)

- if

- zeigt

- Umsetzung

- importieren

- wichtig

- zu unterstützen,

- Verbesserungen

- Verbesserung

- in

- Einschließlich

- zunehmend

- Branchen

- Information

- Informationsextraktion

- Infrastruktur

- innerhalb

- installieren

- Instanz

- Versicherung

- integrieren

- integriert

- Integriert

- geistigen

- geistiges Eigentum

- International

- Internet

- Internetzugang

- in

- isoliert

- IT

- SEINE

- jpg

- nur

- Behalten

- Aufbewahrung

- Wesentliche

- Tasten

- Kinder

- Wissen

- Kubernetes

- Sprache

- grosse

- Latency

- neueste

- starten

- ins Leben gerufen

- führen

- umwandeln

- Leck

- LERNEN

- lernen

- am wenigsten

- links

- Niveau

- Zugelassen

- Lebensdauer

- Biowissenschaften

- Line

- Liste

- listing

- Liste

- Leben

- Belastung

- Belastungen

- aus einer regionalen

- örtlich

- located

- Standorte

- aussehen

- suchen

- kostengünstig

- Maschine

- Maschinelles Lernen

- Aufrechterhaltung

- um

- MACHT

- verwalten

- verwaltet

- Management

- Marktplatz

- Master

- maximal

- Kann..

- Bedeutung

- Mittel

- Memories

- Methode

- Millionen

- minimieren

- minimieren

- Minuten

- ML

- Modell

- für

- Modulen

- Module

- mehr

- vor allem warme

- sollen

- Name

- nativ

- Natürliche

- Natürliche Sprache

- Verarbeitung natürlicher Sprache

- Navigieren

- Navigation

- Need

- Netzwerk

- hört niemals

- Neu

- Nlp

- nicht

- beachten

- Notizbuch

- jetzt an

- Anzahl

- Objekt

- Objekte

- of

- bieten

- bieten

- on

- EINEM

- einzige

- die

- Option

- or

- Organisationen

- Andere

- UNSERE

- skizzierte

- aussen

- übrig

- Überblick

- besitzen

- Paket

- bezahlt

- Pandas

- Brot

- Parameter

- Parken

- Teil

- besonders

- Partner

- leidenschaftlich

- perfekt

- ausführen

- Leistung

- persönliche

- Daten

- Stück

- Pipeline

- Ort

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielend

- Beliebt

- Portabilität

- Post

- Potenzial

- Werkzeuge

- größte treibende

- vor

- bevorzugt

- Vorbereitung

- Gegenwart

- verhindern

- privat

- Prozessdefinierung

- verarbeitet

- anpassen

- Verarbeitung

- Produktion

- PRODUKTIVITÄT

- Produkte

- Eingabeaufforderungen

- Beweise

- immobilien

- Resorts

- vorgeschlage

- Eigentums-

- Risiken zu minimieren

- Sicherheit

- die

- Versorger

- Anbieter

- bietet

- Öffentlichkeit

- Public Cloud

- Frage

- schnell

- Lappen

- Rangliste

- lieber

- RE

- Lesen Sie mehr

- Lesebrillen

- erhält

- empfohlen

- Reduzierung

- siehe

- in Bezug auf

- Region

- geregelt

- regulierte Branchen

- Rechtliches

- Regulierungsbehörden

- verhältnismäßig

- Relevanz

- relevant

- bleibt bestehen

- Quelle

- Anforderung

- falls angefordert

- Voraussetzungen:

- erfordert

- ähnlich

- Downloads

- Antwort

- Antworten

- für ihren Verlust verantwortlich.

- REST

- Restaurants

- Folge

- Die Ergebnisse

- Recht

- Risiko

- riskieren

- Zimmer

- REIHE

- Führen Sie

- läuft

- s

- sagemaker

- skalierbaren

- Skalieren

- Wissenschaft

- WISSENSCHAFTEN

- Partituren

- Suche

- Suchmaschinen

- Die Geheime

- Abschnitt

- Abschnitte

- Verbindung

- sicher

- Sicherheitdienst

- sehen

- semantisch

- Senior

- empfindlich

- Sensitivität

- getrennte

- brauchen

- serviert

- dient

- Dienstleistungen

- kompensieren

- Einstellung

- von Locals geführtes

- Shares

- sie

- Short

- Vitrine

- ähnlich

- Einfacher

- Vereinfacht

- Single

- Größen

- klein

- Fußball

- Software

- Lösung

- Lösungen

- einige

- Quelle

- Quellcode

- Raumfahrt

- spezialisiert

- spezifisch

- angegeben

- Ausgabe

- Stapel

- Anfang

- State-of-the-art

- bleiben

- Schritt

- Shritte

- Immer noch

- speichern

- gelagert

- einfach

- Struktur

- so

- geeignet

- Support

- Unterstützt

- sicher

- System

- Tabelle

- zugeschnitten

- Nehmen

- nimmt

- Target

- gezielt

- Team

- Teams

- Tech

- Technische

- Technologies

- Technologie

- Vorlage

- Mieter

- Text

- Textklassifizierung

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- die Informationen

- ihr

- dann

- Dort.

- deswegen

- Diese

- vom Nutzer definierten

- basierte Online-to-Offline-Werbezuordnungen von anderen gab.

- fehlen uns die Worte.

- nach drei

- Durch

- Zeit

- zu

- gemeinsam

- Werkzeuge

- Top

- traditionell

- Training

- trainiert

- Ausbildung

- Transformieren

- Transit

- transparent

- Reise

- Versuch

- Lernprogramm

- XNUMX

- tippe

- Typen

- uns

- für

- verstehen

- Unerwartet

- unvergesslich

- einzigartig

- aktualisiert

- Updates

- Aktualisierung

- nach oben

- URL

- Anwendungsbereich

- -

- Anwendungsfall

- benutzt

- Mitglied

- verwendet

- Verwendung von

- Urlaub

- Wert

- Werte

- verschiedene

- Ve

- Version

- Assistent

- Volumen

- Spaziergang

- Weg..

- Wege

- we

- Reichtum

- Netz

- Web-Services

- willkommen

- GUT

- waren

- wann

- welche

- während

- WHO

- deren

- werden wir

- mit

- .

- Arbeiten

- Arbeitsablauf.

- arbeiten,

- Werk

- schreiben

- U

- Ihr

- Zephyrnet