In der Post Einführung des AWS ProServe Hadoop Migration Delivery Kit TCO-Toolshaben wir das TCO-Tool AWS ProServe Hadoop Migration Delivery Kit (HMDK) und die Vorteile der Migration von lokalen Hadoop-Workloads zu vorgestellt Amazon EMR. In diesem Beitrag tauchen wir tief in das Tool ein und gehen alle Schritte von der Protokollaufnahme über die Transformation, Visualisierung und das Architekturdesign bis hin zur Berechnung der Gesamtbetriebskosten durch.

Lösungsüberblick

Sehen wir uns kurz die Hauptfunktionen des HMDK-TCO-Tools an. Das Tool stellt einen YARN-Protokollsammler bereit, um Hadoop Resource Manager zum Sammeln von YARN-Protokollen zu verbinden. Ein Python-basierter Hadoop-Workload-Analyzer namens YARN Log Analyzer untersucht Hadoop-Anwendungen. Amazon QuickSight Dashboards präsentieren die Ergebnisse des Analysegeräts. Dieselben Ergebnisse beschleunigen auch das Design zukünftiger EMR-Instanzen. Zusätzlich generiert ein TCO-Rechner die TCO-Schätzung eines optimierten EMR-Clusters zur Erleichterung der Migration.

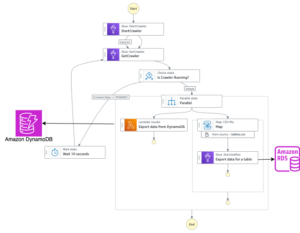

Schauen wir uns nun an, wie das Tool funktioniert. Das folgende Diagramm veranschaulicht den End-to-End-Workflow.

In den nächsten Abschnitten gehen wir durch die fünf Hauptschritte des Tools:

- Sammeln Sie YARN-Auftragsverlaufsprotokolle.

- Wandeln Sie die Auftragsverlaufsprotokolle von JSON in CSV um.

- Analysieren Sie die Auftragsverlaufsprotokolle.

- Entwerfen Sie einen EMR-Cluster für die Migration.

- Berechnen Sie die TCO.

Voraussetzungen:

Bevor Sie beginnen, stellen Sie sicher, dass die folgenden Voraussetzungen erfüllt sind:

- Klonen Sie die hadoop-migration-assessment-tco-Repository.

- Installieren Sie Python 3 auf Ihrem lokalen Computer.

- Haben Sie ein AWS-Konto mit der entsprechenden Berechtigung AWS Lambda, QuickSight (Enterprise-Edition) und AWS CloudFormation.

Sammeln Sie YARN-Auftragsverlaufsprotokolle

Zuerst führen Sie a YARN-Protokollsammler, start-collector.sh, auf Ihrem lokalen Rechner. Dieser Schritt sammelt Hadoop YARN-Protokolle und legt die Protokolle auf Ihrem lokalen Computer ab. Das Skript verbindet Ihren lokalen Computer mit dem primären Hadoop-Knoten und kommuniziert mit Resource Manager. Dann ruft es die Auftragsverlaufsinformationen (YARN-Protokolle von Anwendungsmanagern) ab, indem es die YARN ResourceManager-Anwendungs-API aufruft.

Vor dem Ausführen des YARN-Protokollsammlers müssen Sie die Verbindung konfigurieren und herstellen (HTTP: 8088 oder HTTPS: 8090; letzteres wird empfohlen), um die Zugänglichkeit von YARN ResourceManager und aktiviertem YARN Timeline Server zu überprüfen (Timeline Server v1 oder höher werden unterstützt ). Möglicherweise müssen Sie das Erfassungsintervall und die Aufbewahrungsrichtlinie der YARN-Protokolle definieren. Um sicherzustellen, dass Sie aufeinanderfolgende YARN-Protokolle sammeln, können Sie einen Cron-Job verwenden, um den Protokollsammler in einem geeigneten Zeitintervall zu planen. Beispielsweise müssen Sie für einen Hadoop-Cluster mit 2,000 täglichen Anwendungen und der auf 1,000 gesetzten Einstellung "garn.resourcemanager.max-completed-applications" den Protokollsammler theoretisch mindestens zweimal ausführen, um alle YARN-Protokolle zu erhalten. Darüber hinaus empfehlen wir, mindestens 7 Tage lang YARN-Protokolle zu sammeln, um ganzheitliche Workloads zu analysieren.

Weitere Einzelheiten zum Konfigurieren und Planen des Protokollsammlers finden Sie unter Garn-Protokoll-Sammler GitHub Repo.

Wandeln Sie die Protokolle des YARN-Auftragsverlaufs von JSON in CSV um

Nachdem Sie YARN-Protokolle erhalten haben, führen Sie einen YARN-Protokoll-Organizer, wool-log-organizer.py, aus, der ein Parser ist, um JSON-basierte Protokolle in CSV-Dateien umzuwandeln. Diese CSV-Ausgabedateien sind die Eingaben für den YARN-Protokollanalysator. Der Parser verfügt auch über andere Funktionen, darunter das Sortieren von Ereignissen nach Zeit, das Entfernen dedizierter Ereignisse und das Zusammenführen mehrerer Protokolle.

Weitere Informationen zur Verwendung des YARN-Protokoll-Organizers finden Sie unter Garn-Log-Organizer GitHub-Repo.

Analysieren Sie die Protokolle des YARN-Auftragsverlaufs

Als Nächstes starten Sie den YARN-Protokollanalysator, um die YARN-Protokolle im CSV-Format zu analysieren.

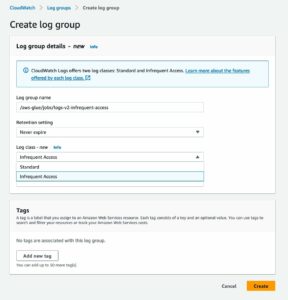

Mit QuickSight können Sie YARN-Protokolldaten visualisieren und Analysen anhand der Datensätze durchführen, die von vorgefertigten Dashboard-Vorlagen und einem Widget generiert wurden. Das Widget erstellt automatisch QuickSight-Dashboards im Ziel-AWS-Konto, das in einer CloudFormation-Vorlage konfiguriert ist.

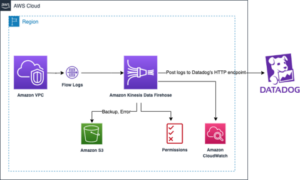

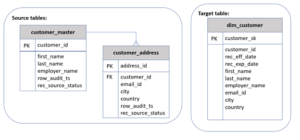

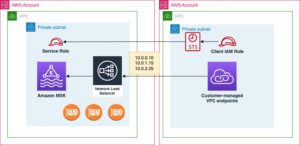

Das folgende Diagramm veranschaulicht die HMDK-TCO-Architektur.

Der YARN-Protokollanalysator bietet vier Schlüsselfunktionen:

- Hochladen von transformierten YARN-Jobverlaufsprotokollen im CSV-Format (z. B.

cluster_yarn_logs_*.csv) Um Amazon Simple Storage-Service (Amazon S3) Eimer. Diese CSV-Dateien sind die Ausgaben des YARN-Protokoll-Organizers. - Erstellen Sie eine Manifest-JSON-Datei (z. B.

yarn-log-manifest.json) für QuickSight und laden Sie es in den S3-Bucket hoch: - Stellen Sie QuickSight-Dashboards mithilfe einer CloudFormation-Vorlage bereit, die im YAML-Format vorliegt. Wählen Sie nach der Bereitstellung das Aktualisierungssymbol aus, bis der Status des Stacks als angezeigt wird

CREATE_COMPLETE. Dieser Schritt erstellt Datensätze auf QuickSight-Dashboards in Ihrem AWS-Zielkonto.

- Auf dem QuickSight-Dashboard finden Sie Einblicke in die analysierten Hadoop-Workloads aus verschiedenen Diagrammen. Diese Erkenntnisse helfen Ihnen, zukünftige EMR-Instanzen für eine Beschleunigung der Migration zu entwerfen, wie im nächsten Schritt gezeigt wird.

Entwerfen Sie einen EMR-Cluster für die Migration

Die Ergebnisse des YARN-Protokollanalysators helfen Ihnen, die tatsächlichen Hadoop-Workloads auf dem vorhandenen System zu verstehen. Dieser Schritt beschleunigt das Entwerfen zukünftiger EMR-Instanzen für die Migration durch die Verwendung einer Excel-Vorlage. Die Vorlage enthält eine Checkliste zur Durchführung von Workload-Analysen und Kapazitätsplanungen:

- Werden die auf dem Cluster ausgeführten Anwendungen mit ihrer aktuellen Kapazität angemessen genutzt?

- Ist der Cluster zu einem bestimmten Zeitpunkt unter Last oder nicht? Wenn ja, wann ist die Zeit?

- Welche Arten von Anwendungen und Engines (z. B. MR, TEZ oder Spark) werden auf dem Cluster ausgeführt, und wie hoch ist die Ressourcennutzung für jeden Typ?

- Laufen unterschiedliche Job-Laufzyklen (Echtzeit, Batch, Ad-Hoc) in einem Cluster?

- Werden Jobs in regelmäßigen Batches ausgeführt, und wenn ja, wie lauten diese Zeitplanintervalle? (Zum Beispiel alle 10 Minuten, 1 Stunde, 1 Tag.) Haben Sie Jobs, die über einen langen Zeitraum viele Ressourcen verbrauchen?

- Benötigen Jobs eine Leistungsverbesserung?

- Monopolisieren bestimmte Organisationen oder Einzelpersonen den Cluster?

- Gibt es gemischte Entwicklungs- und Betriebsjobs in einem Cluster?

Nachdem Sie die Checkliste ausgefüllt haben, haben Sie ein besseres Verständnis dafür, wie Sie die zukünftige Architektur entwerfen. Zur Optimierung der Kosteneffizienz von EMR-Clustern enthält die folgende Tabelle allgemeine Richtlinien zur Auswahl des richtigen Typs von EMR-Clustern und Amazon Elastic Compute-Cloud (Amazon EC2)-Familie.

Um den richtigen Clustertyp und die richtige Instance-Familie auszuwählen, müssen Sie anhand verschiedener Kriterien mehrere Analyserunden anhand von YARN-Protokollen durchführen. Sehen wir uns einige wichtige Kennzahlen an.

Timeline

Sie können Workload-Muster basierend auf der Anzahl von Hadoop-Anwendungen finden, die in einem Zeitfenster ausgeführt werden. Beispielsweise bieten die Tages- oder Stundendiagramme „Anzahl der Datensätze nach Startzeit“ die folgenden Einblicke:

- In täglichen Zeitreihendiagrammen vergleichen Sie die Anzahl der Anwendungsläufe zwischen Werktagen und Feiertagen sowie zwischen Kalendertagen. Wenn die Zahlen ähnlich sind, bedeutet dies, dass die tägliche Nutzung des Clusters vergleichbar ist. Ist die Abweichung hingegen groß, ist der Anteil an Ad-hoc-Jobs signifikant. Sie können auch die möglichen wöchentlichen oder monatlichen Jobs an bestimmten Tagen ermitteln. In der Situation können Sie leicht bestimmte Tage in einer Woche oder einem Monat mit hoher Arbeitskonzentration sehen.

- In stündlichen Zeitreihendiagrammen verstehen Sie besser, wie Anwendungen in stündlichen Fenstern ausgeführt werden. Sie können Spitzen- und Nebenzeiten an einem Tag finden.

Nutzer

Die YARN-Protokolle enthalten die Benutzer-ID jeder Anwendung. Diese Informationen helfen Ihnen zu verstehen, wer eine Bewerbung an eine Warteschlange übermittelt. Anhand der Statistiken einzelner und aggregierter Anwendungsläufe pro Warteschlange und pro Benutzer können Sie die vorhandene Arbeitslastverteilung nach Benutzern ermitteln. Normalerweise haben Benutzer im selben Team gemeinsame Warteschlangen. Manchmal haben mehrere Teams gemeinsame Warteschlangen. Beim Entwerfen von Warteschlangen für Benutzer haben Sie jetzt Einblicke, die Ihnen dabei helfen, Anwendungsworkloads zu entwerfen und zu verteilen, die gleichmäßiger auf Warteschlangen verteilt sind als zuvor.

Anwendungsarten

Sie können Workloads basierend auf verschiedenen Anwendungstypen (z. B. Hive, Spark, Presto oder HBase) segmentieren und Engines (z. B. MR, Spark oder Tez) ausführen. Verwenden Sie für rechenintensive Workloads wie MapReduce- oder Hive-on-MR-Jobs CPU-optimierte Instanzen. Verwenden Sie für speicherintensive Workloads wie Hive-on-TEZ-, Presto- und Spark-Jobs speicheroptimierte Instanzen.

Verstrichene Zeit

Sie können Anwendungen nach Laufzeit kategorisieren. Die eingebettete CloudFormation-Vorlage erstellt automatisch ein elapsedGroup-Feld in einem QuickSight-Dashboard. Dadurch wird eine Schlüsselfunktion aktiviert, mit der Sie Jobs mit langer Laufzeit in einem von vier Diagrammen auf QuickSight-Dashboards beobachten können. Daher können Sie für diese großen Aufgaben maßgeschneiderte zukünftige Architekturen entwerfen.

Die entsprechenden QuickSight-Dashboards enthalten vier Diagramme. Sie können jedes Diagramm, das einer Gruppe zugeordnet ist, aufschlüsseln.

| Gruppe an Nummer |

Laufzeit/Verstrichene Zeit eines Jobs |

| 1 | Weniger als 10 Minuten |

| 2 | Zwischen 10 Minuten und 30 Minuten |

| 3 | zwischen 30 Minuten und 1 Stunde |

| 4 | Länger als 1 Stunde |

Im Diagramm von Gruppe 4 können Sie sich darauf konzentrieren, große Jobs anhand verschiedener Metriken zu untersuchen, darunter Benutzer, Warteschlange, Anwendungstyp, Zeitachse, Ressourcennutzung usw. Basierend auf dieser Überlegung haben Sie möglicherweise dedizierte Warteschlangen auf einem Cluster oder einem dedizierten EMR-Cluster für große Jobs. In der Zwischenzeit können Sie kleine Jobs an gemeinsam genutzte Warteschlangen senden.

Downloads

Basierend auf Ressourcenverbrauchsmustern (CPU, Arbeitsspeicher) wählen Sie die richtige Größe und Familie von EC2-Instances für Leistung und Kosteneffizienz. Für rechenintensive Anwendungen empfehlen wir Instanzen von CPU-optimierten Familien. Für speicherintensive Anwendungen werden die speicheroptimierten Instance-Familien empfohlen.

Darüber hinaus können Sie basierend auf der Art der Anwendungsarbeitslasten und der Ressourcenauslastung im Laufe der Zeit einen dauerhaften oder vorübergehenden EMR-Cluster auswählen. Amazon EMR auf EKS, oder Amazon EMR ohne Server.

Nachdem Sie YARN-Protokolle anhand verschiedener Metriken analysiert haben, sind Sie bereit, zukünftige EMR-Architekturen zu entwerfen. Die folgende Tabelle listet Beispiele für vorgeschlagene EMR-Cluster auf. Näheres finden Sie in der Optimierter TCO-Rechner GitHub Repo.

TCO berechnen

Führen Sie schließlich auf Ihrem lokalen Computer tco-input-generator.py aus, um YARN-Auftragsverlaufsprotokolle stündlich zu aggregieren, bevor Sie eine Excel-Vorlage verwenden, um die optimierten Gesamtbetriebskosten zu berechnen. Dieser Schritt ist entscheidend, da die Ergebnisse die Hadoop-Workloads in zukünftigen EMR-Instanzen simulieren.

Voraussetzung für die TCO-Simulation ist der Betrieb tco-input-generator.py, die stündlich aggregierte Protokolle generiert. Als Nächstes öffnen Sie eine Excel-Vorlagendatei, um Makros zu aktivieren und Ihre Eingaben in grünen Zellen für die Berechnung der Gesamtbetriebskosten bereitzustellen. Bezüglich der Eingabedaten geben Sie die tatsächliche Datengröße ohne Replikation und die Hardwarespezifikationen (vCore, Mem) des Hadoop-Primärknotens und der Datenknoten ein. Sie müssen auch zuvor generierte stündlich aggregierte Protokolle auswählen und hochladen. Nachdem Sie die TCO-Simulationsvariablen wie Region, EC2-Typ, Amazon EMR-Hochverfügbarkeit, Engine-Effekt, Amazon EC2- und Amazon EBS-Rabatt (EDP), Amazon S3-Mengenrabatt, lokaler Währungskurs und EMR EC2-Task/Core-Preisverhältnis festgelegt haben und Preis/Stunde berechnet der TCO-Simulator automatisch die optimalen Kosten zukünftiger EMR-Instances auf Amazon EC2. Die folgenden Screenshots zeigen ein Beispiel für HMDK-TCO-Ergebnisse.

Weitere Informationen und Anweisungen zu HMDK-TCO-Berechnungen finden Sie unter Optimierter TCO-Rechner GitHub Repo.

Aufräumen

Nachdem Sie alle Schritte ausgeführt und die Tests abgeschlossen haben, führen Sie die folgenden Schritte aus, um Ressourcen zu löschen, um anfallende Kosten zu vermeiden:

- Wählen Sie in der AWS CloudFormation-Konsole den von Ihnen erstellten Stack aus.

- Auswählen Löschen.

- Auswählen Stapel löschen.

- Aktualisieren Sie die Seite, bis Sie den Status sehen

DELETE_COMPLETE. - Löschen Sie auf der Amazon S3-Konsole den von Ihnen erstellten S3-Bucket.

Zusammenfassung

Das AWS ProServe HMDK TCO-Tool reduziert den Aufwand für die Migrationsplanung erheblich, was die zeitaufwändigen und herausfordernden Aufgaben der Bewertung Ihrer Hadoop-Workloads sind. Mit dem HMDK-TCO-Tool dauert die Bewertung in der Regel 2–3 Wochen. Sie können auch die kalkulierten TCO zukünftiger EMR-Architekturen ermitteln. Mit dem HMDK-TCO-Tool sind Sie in der Lage, Ihre Workloads und Ressourcennutzungsmuster schnell zu verstehen. Mit den vom Tool generierten Erkenntnissen sind Sie in der Lage, optimale zukünftige EMR-Architekturen zu entwerfen. In vielen Anwendungsfällen bietet eine 1-Jahres-TCO der optimierten umgestalteten Architektur im Vergleich zu Hadoop-Migrationen mit Lift-and-Shift erhebliche Kosteneinsparungen (64–80 % Reduzierung) bei Rechenleistung und Speicher.

Weitere Informationen zum Beschleunigen Ihrer Hadoop-Migrationen zu Amazon EMR und dem HMDK-CTO-Tool finden Sie unter Hadoop Migration Delivery Kit TCO GitHub-Repository, oder wenden Sie sich an AWS-HMDK@amazon.com.

Über die Autoren

Sungyoul-Park ist Senior Practice Manager bei AWS ProServe. Er hilft Kunden, ihr Geschäft mit AWS Analytics, IoT und KI/ML-Services zu erneuern. Er hat sich auf Big-Data-Dienste und -Technologien spezialisiert und ist daran interessiert, gemeinsam Geschäftsergebnisse für Kunden zu erzielen.

Sungyoul-Park ist Senior Practice Manager bei AWS ProServe. Er hilft Kunden, ihr Geschäft mit AWS Analytics, IoT und KI/ML-Services zu erneuern. Er hat sich auf Big-Data-Dienste und -Technologien spezialisiert und ist daran interessiert, gemeinsam Geschäftsergebnisse für Kunden zu erzielen.

Jiseong Kim ist Senior Data Architect bei AWS ProServe. Er arbeitet hauptsächlich mit Unternehmenskunden zusammen, um die Migration und Modernisierung von Data Lakes zu unterstützen, und bietet Beratung und technische Unterstützung bei Big-Data-Projekten wie Hadoop, Spark, Data Warehousing, Echtzeit-Datenverarbeitung und groß angelegtem maschinellem Lernen. Er versteht es auch, Technologien anzuwenden, um Big-Data-Probleme zu lösen und eine gut gestaltete Datenarchitektur aufzubauen.

Jiseong Kim ist Senior Data Architect bei AWS ProServe. Er arbeitet hauptsächlich mit Unternehmenskunden zusammen, um die Migration und Modernisierung von Data Lakes zu unterstützen, und bietet Beratung und technische Unterstützung bei Big-Data-Projekten wie Hadoop, Spark, Data Warehousing, Echtzeit-Datenverarbeitung und groß angelegtem maschinellem Lernen. Er versteht es auch, Technologien anzuwenden, um Big-Data-Probleme zu lösen und eine gut gestaltete Datenarchitektur aufzubauen.

George Zhao ist Senior Data Architect bei AWS ProServe. Er ist ein erfahrener Analyseleiter, der mit AWS-Kunden zusammenarbeitet, um moderne Datenlösungen bereitzustellen. Er ist auch ein ProServe Amazon EMR-Domänenspezialist, der ProServe-Berater zu Best Practices und Bereitstellungskits für Hadoop-zu-Amazon-EMR-Migrationen befähigt. Sein Interessengebiet sind Data Lakes und die Bereitstellung moderner Cloud-Datenarchitekturen.

George Zhao ist Senior Data Architect bei AWS ProServe. Er ist ein erfahrener Analyseleiter, der mit AWS-Kunden zusammenarbeitet, um moderne Datenlösungen bereitzustellen. Er ist auch ein ProServe Amazon EMR-Domänenspezialist, der ProServe-Berater zu Best Practices und Bereitstellungskits für Hadoop-zu-Amazon-EMR-Migrationen befähigt. Sein Interessengebiet sind Data Lakes und die Bereitstellung moderner Cloud-Datenarchitekturen.

Kalen Zhang war der Global Segment Tech Lead of Partner Data and Analytics bei AWS. Als vertrauenswürdige Beraterin für Daten und Analysen kuratierte sie strategische Initiativen zur Datentransformation, leitete Migrations- und Modernisierungsprogramme für Daten- und Analyse-Workloads und beschleunigte Kundenmigrationsreisen mit Partnern in großem Maßstab. Sie ist auf verteilte Systeme, Enterprise Data Management, Advanced Analytics und groß angelegte strategische Initiativen spezialisiert.

Kalen Zhang war der Global Segment Tech Lead of Partner Data and Analytics bei AWS. Als vertrauenswürdige Beraterin für Daten und Analysen kuratierte sie strategische Initiativen zur Datentransformation, leitete Migrations- und Modernisierungsprogramme für Daten- und Analyse-Workloads und beschleunigte Kundenmigrationsreisen mit Partnern in großem Maßstab. Sie ist auf verteilte Systeme, Enterprise Data Management, Advanced Analytics und groß angelegte strategische Initiativen spezialisiert.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/big-data/deep-dive-into-the-aws-proserve-hadoop-migration-delivery-kit-tco-tool/

- 000

- 1

- 10

- 100

- 7

- a

- Fähig

- Über Uns

- beschleunigen

- beschleunigt

- beschleunigt

- beschleunigend

- Beschleunigung

- Zugänglichkeit

- Konto

- über

- Ad

- Zusatz

- Zusätzliche

- Zusätzliche Angaben

- zusätzlich

- advanced

- Berater

- Nach der

- gegen

- AI / ML

- Alle

- Amazon

- Amazon EC2

- Amazon EMR

- unter

- Analyse

- Analytik

- analysieren

- Analyse

- und

- Bienen

- Anwendung

- Anwendungen

- Bewerben

- passend

- Architektur

- Bereich

- Bewertung

- Hilfe

- damit verbundenen

- Im Prinzip so, wie Sie es von Google Maps kennen.

- Verfügbarkeit

- AWS

- AWS CloudFormation

- basierend

- Grundlage

- weil

- Sein

- Vorteile

- BESTE

- Best Practices

- Besser

- zwischen

- Big

- Big Data

- kurz

- bauen

- Building

- Geschäft

- Berechnen

- berechnet

- berechnet

- Berechnung

- Kalender

- namens

- Aufruf

- Fähigkeiten

- Kapazität

- Fälle

- Die Zellen

- sicher

- herausfordernd

- Chart

- Charts

- Auswählen

- Auswahl

- Cloud

- Cluster

- sammeln

- Das Sammeln

- Sammlung

- Sammler

- sammelt

- COM

- vergleichbar

- vergleichen

- verglichen

- abschließen

- Berechnen

- konzentrieren

- Konzentration

- Leiten

- Leitung

- Vernetz Dich

- Verbindung

- Connects

- aufeinanderfolgenden

- Berücksichtigung

- Konsul (Console)

- Berater

- Verbrauch

- enthält

- Dazugehörigen

- Kosten

- Einsparmaßnahmen

- Kosten

- CPU

- erstellt

- schafft

- Kriterien

- wichtig

- CTO

- kuratiert

- Währung

- Strom

- Kunde

- Kunden

- Zyklen

- Unterricht

- Armaturenbrett

- technische Daten

- Datensee

- Datenmanagement

- Datenverarbeitung

- Datensätze

- Tag

- Tage

- gewidmet

- tief

- Tieftauchgang

- Übergeben

- Lieferanten

- Synergie

- Bereitstellen

- Design

- Entwerfen

- Details

- Bestimmen

- Entwicklung

- Abweichung

- anders

- Rabatt

- verteilen

- verteilt

- verteilte Systeme

- Verteilung

- Domain

- nach unten

- im

- jeder

- leicht

- ebs

- Ausgabe

- bewirken

- Wirksamkeit

- Bemühungen

- eingebettet

- ermöglichen

- freigegeben

- ermöglicht

- End-to-End

- Motor

- Motor (en)

- gewährleisten

- Enter

- Unternehmen

- Unternehmenskunden

- ausgestattet

- etablieren

- Äther (ETH)

- Veranstaltungen

- Jedes

- Beispiel

- Beispiele

- Excel

- vorhandenen

- erfahrensten

- erleichtern

- Familien

- Familie

- Merkmal

- Eigenschaften

- Feld

- Abbildung

- Reichen Sie das

- Mappen

- Finden Sie

- Fertig

- Folgende

- Format

- für

- Funktionsumfang

- weiter

- Zukunft

- Allgemeines

- erzeugt

- erzeugt

- bekommen

- bekommen

- GitHub

- Global

- Grün

- Gruppe an

- Richtlinien

- Hadoop

- Hardware

- Hilfe

- hilft

- GUTE

- Geschichte

- Bienenstock

- Ferien

- ganzheitliche

- STUNDEN

- Ultraschall

- Hilfe

- HTML

- HTTPS

- ICON

- Verbesserung

- in

- das

- Einschließlich

- Krankengymnastik

- Einzelpersonen

- Information

- Initiativen

- wir innovieren

- Varianten des Eingangssignals:

- Einblicke

- Instanz

- Anleitung

- Interesse

- Interessen

- eingeführt

- iot

- IT

- Job

- Jobs

- Reisen

- JSON

- Wesentliche

- Ausrüstung

- See

- grosse

- großflächig

- starten

- führen

- Führer

- LERNEN

- lernen

- geführt

- Geführte Daten

- Listen

- Belastung

- aus einer regionalen

- Lang

- lange Zeit

- aussehen

- Los

- Maschine

- Maschinelles Lernen

- Makros

- Main

- um

- Management

- Manager

- Manager

- viele

- Mittel

- Mittlerweile

- Memory

- Verschmelzung

- Metrik

- Migration

- Minuten

- gemischt

- modern

- Modernisierung

- Monat

- monatlich

- mehr

- mehrere

- Natur

- Need

- weiter

- Knoten

- Fiber Node

- Anzahl

- Zahlen

- beobachten

- beschaffen

- EINEM

- XNUMXh geöffnet

- die

- Betrieb

- optimal

- optimiert

- Optimierung

- Optimum

- Organisationen

- Andere

- besondere

- Partner

- Muster

- Haupt

- ausführen

- Leistung

- Zeit

- Erlaubnis

- Länder/Regionen

- Planung

- Plato

- Datenintelligenz von Plato

- PlatoData

- Datenschutzrichtlinien

- möglich

- Post

- Praxis

- Praktiken

- Voraussetzungen

- vorher

- gebühr

- primär

- Vor

- Probleme

- Verarbeitung

- Programme

- Projekte

- ordnungsgemäße

- vorgeschlage

- die

- bietet

- Python

- schnell

- Bewerten

- Verhältnis

- erreichen

- bereit

- Echtzeit

- Echtzeitdaten

- empfehlen

- empfohlen

- Aufzeichnungen

- reduziert

- in Bezug auf

- Region

- regulär

- Entfernen

- Replikation

- Ressourcen

- Downloads

- Die Ergebnisse

- Beibehaltung

- Runde

- Führen Sie

- Laufen

- gleich

- Ersparnisse

- Skalieren

- Zeitplan

- Screenshots

- Abschnitte

- Segment

- Senior

- Modellreihe

- Lösungen

- kompensieren

- Einstellung

- mehrere

- von Locals geführtes

- erklären

- Vitrine

- signifikant

- bedeutend

- ähnlich

- Einfacher

- Simulation

- Simulator

- Situation

- Größe

- klein

- So

- Lösungen

- LÖSEN

- einige

- Spark

- Spezialist

- spezialisiert

- Spezialprodukte

- spezifisch

- Spezifikationen

- Stapel

- begonnen

- Statistiken

- Status

- Schritt

- Shritte

- Lagerung

- Strategisch

- abschicken

- so

- Unterstützte

- System

- Systeme und Techniken

- Tabelle

- zugeschnitten

- nimmt

- Target

- und Aufgaben

- Team

- Teams

- Tech

- Technische

- Technologies

- Vorlage

- Vorlagen

- Testen

- Das

- Die Zukunft

- ihr

- deswegen

- Durch

- Zeit

- Zeitfolgen

- Zeitaufwendig

- Timeline

- zu

- gemeinsam

- Werkzeug

- Transformieren

- Transformation

- verwandelt

- was immer dies auch sein sollte.

- vertraut

- Typen

- für

- verstehen

- Verständnis

- versteht

- Anwendungsbereich

- -

- Mitglied

- Nutzer

- gewöhnlich

- verschiedene

- überprüfen

- Visualisierung

- Volumen

- Gehen

- Lagerung

- Woche

- wöchentlich

- Wochen

- Was

- Was ist

- welche

- WHO

- Fenster

- ohne

- Arbeitsablauf.

- arbeiten,

- Werk

- YAML

- Ihr

- Zephyrnet