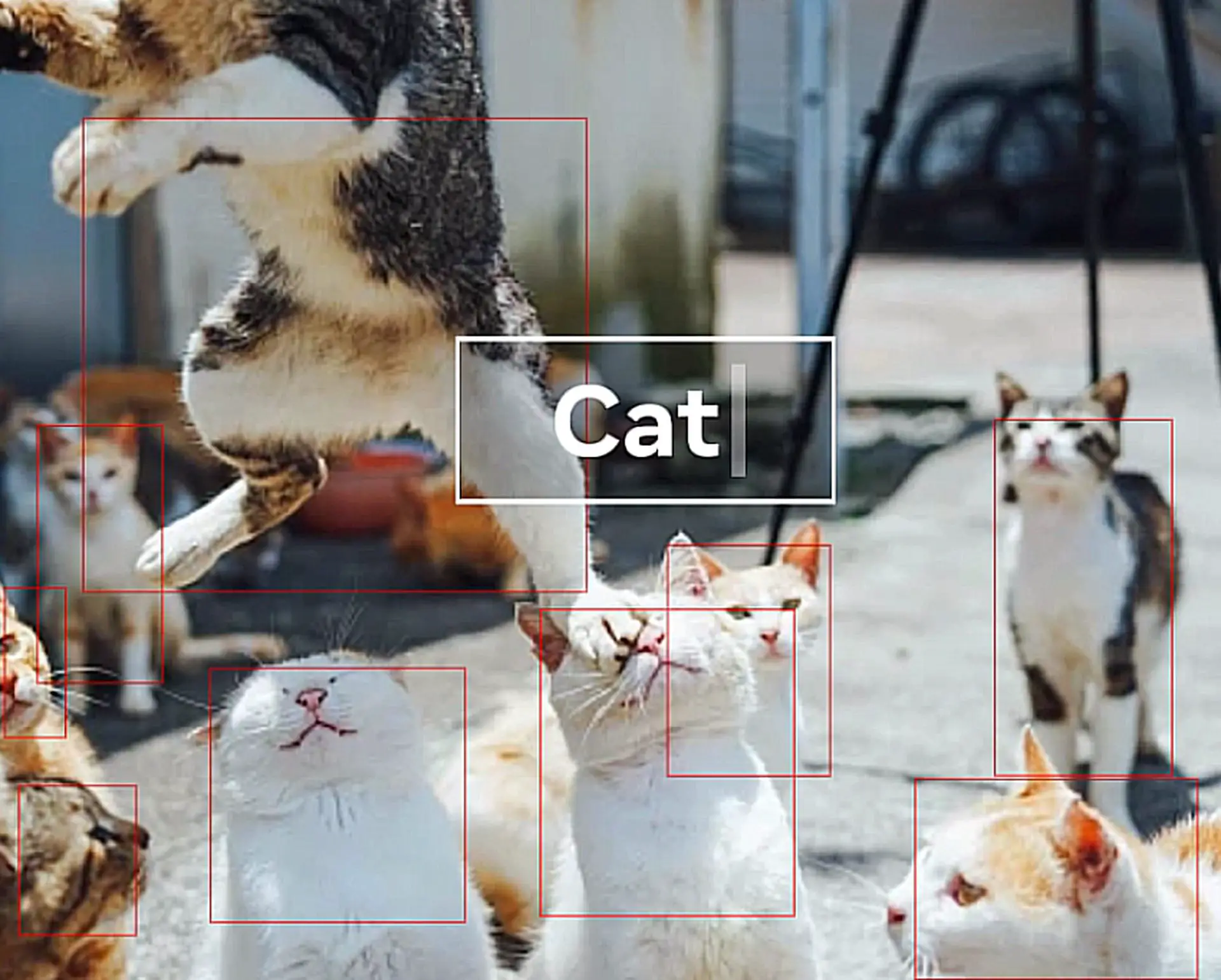

Das neue Segment Anything Model von Meta wurde enthüllt. Das SAM-Modell ist ein neuer Weg, um hochwertige Masken für die Bildsegmentierung zu erstellen.

Hinweise: Die Bildsegmentierung ist eine grundlegende Aufgabe in der Computervision, die darauf abzielt, ein Bild in Bereiche zu unterteilen, die verschiedenen Objekten oder semantischen Kategorien entsprechen, und hat viele Anwendungen, wie z. B. Objekterkennung, Szenenverständnis, Bildbearbeitung und Videoanalyse.

Die Bildsegmentierung ist jedoch auch ein herausforderndes Problem, insbesondere wenn es um komplexe Szenen geht, die mehrere Objekte mit unterschiedlichen Formen, Größen und Erscheinungen enthalten. Darüber hinaus erfordern die meisten vorhandenen Bildsegmentierungsverfahren große Mengen kommentierter Daten für das Training, deren Beschaffung kostspielig und zeitaufwändig sein kann. Dieses Problem will Meta mit dem SAM-Modell lösen.

SAM-Modell: Was ist das neue Segment-Anything-Modell von Meta?

Segment Anything Model (SAM) ist ein neues und leistungsstarkes Modell der künstlichen Intelligenz, das jedes Objekt in einem Bild oder Video mit hoher Qualität und Effizienz segmentieren kann. Segmentierung ist der Vorgang, ein Objekt von seinem Hintergrund oder anderen Objekten zu trennen und eine Maske zu erstellen, die seine Form und Grenzen umreißt. Mit dem SAM-Modell werden Ihre Bearbeitungs-, Compositing-, Tracking-, Erkennungs- und Analyseaufgaben einfacher.

SAM unterscheidet sich in mehrfacher Hinsicht von anderen Segmentierungsmodellen, wie z. B.:

- SAM ist aufforderungsfähig, was bedeutet, dass es verschiedene Eingabeaufforderungen wie Punkte oder Kästchen verwenden kann, um anzugeben, welches Objekt segmentiert werden soll. Sie können beispielsweise einen Rahmen um das Gesicht einer Person zeichnen, und das Segment Anything Model generiert eine Maske für das Gesicht. Sie können auch mehrere Eingabeaufforderungen geben, um mehrere Objekte gleichzeitig zu segmentieren. Das SAM-Modell kann komplexe Szenen mit Okklusionen, Reflexionen und Schatten handhaben.

- SAM wird auf einem riesigen Datensatz mit 11 Millionen Bildern und 1.1 Milliarden Masken trainiert, dem bisher größten Segmentierungsdatensatz. Dieser Datensatz umfasst eine breite Palette von Objekten und Kategorien wie Tiere, Pflanzen, Fahrzeuge, Möbel, Lebensmittel und mehr. Dank seiner Generalisierungsfähigkeit und Datenvielfalt kann SAM Objekte segmentieren, die es noch nie zuvor gesehen hat.

- SAM hat eine starke Zero-Shot-Leistung bei einer Vielzahl von Segmentierungsaufgaben. Zero-Shot bedeutet, dass SAM Objekte ohne zusätzliches Training oder Feinabstimmung auf eine bestimmte Aufgabe oder Domäne segmentieren kann. SAM kann beispielsweise Gesichter, Hände, Haare, Kleidung und Accessoires ohne Vorkenntnisse oder Aufsicht segmentieren. SAM kann auch Objekte in verschiedenen Modalitäten segmentieren, wie z. B. Infrarotbilder oder Tiefenkarten.

Das SAM-Modell erzielt beeindruckende Ergebnisse bei verschiedenen Bildsegmentierungs-Benchmarks wie COCO. SAM übertrifft oder entspricht auch früheren vollständig überwachten Methoden bei mehreren Zero-Shot-Segmentierungsaufgaben, wie z. B. der Segmentierung von Logos, Text, Gesichtern oder Skizzen. Es zeigt seine Vielseitigkeit und Robustheit in verschiedenen Domänen und Szenarien.

In der Zukunft: Das Projekt Segment Anything Model (SAM-Modell) steckt noch in den Kinderschuhen. Laut Meta sind dies einige der zukünftigen Anwendungen des Segment Anything Model:

- Zukünftige AR-Brillen können SAM verwenden, um alltägliche Objekte zu erkennen und hilfreiche Erinnerungen und Anweisungen bereitzustellen.

- SAM hat die Fähigkeit, viele andere Bereiche wie Landwirtschaft und Biologie zu beeinflussen. Eines Tages könnten sogar Landwirte und Wissenschaftler davon profitieren.

Das SAM-Modell kann ein Durchbruch in der Computer-Vision- und Künstliche-Intelligenz-Forschung sein. Es demonstriert das Potenzial von Grundlagenmodellen für das Sehen, also Modelle, die aus großen Datenmengen lernen und auf neue Aufgaben und Domänen übertragen werden können.

Funktionen des Segment-Anything-Modells (SAM-Modell).

Hier sind einige der Fähigkeiten des SAM-Modells:

- Unter Verwendung des SAM-Modells können Benutzer Objekte schnell und einfach segmentieren, indem sie einzelne Punkte auswählen, die in die Segmentierung aufgenommen oder weggelassen werden sollen. Eine Begrenzungsbox kann auch als Hinweis für das Modell verwendet werden.

- Wenn Unsicherheit bezüglich des zu segmentierenden Elements besteht, kann das SAM-Modell viele gültige Masken erzeugen, eine entscheidende und kritische Fähigkeit zum Lösen der Segmentierung in der realen Welt.

- Die automatische Objekterkennung und -maskierung ist jetzt mit dem Segment Anything Model ganz einfach.

- Nach der Vorberechnung der Bildeinbettung kann das Segment Anything Model sofort eine Segmentierungsmaske für jede Eingabeaufforderung bereitstellen, wodurch eine Echtzeitinteraktion mit dem Modell ermöglicht wird.

Beeindruckend, nicht wahr? Was ist also die Technologie dahinter?

Wie funktioniert das SAM-Modell?

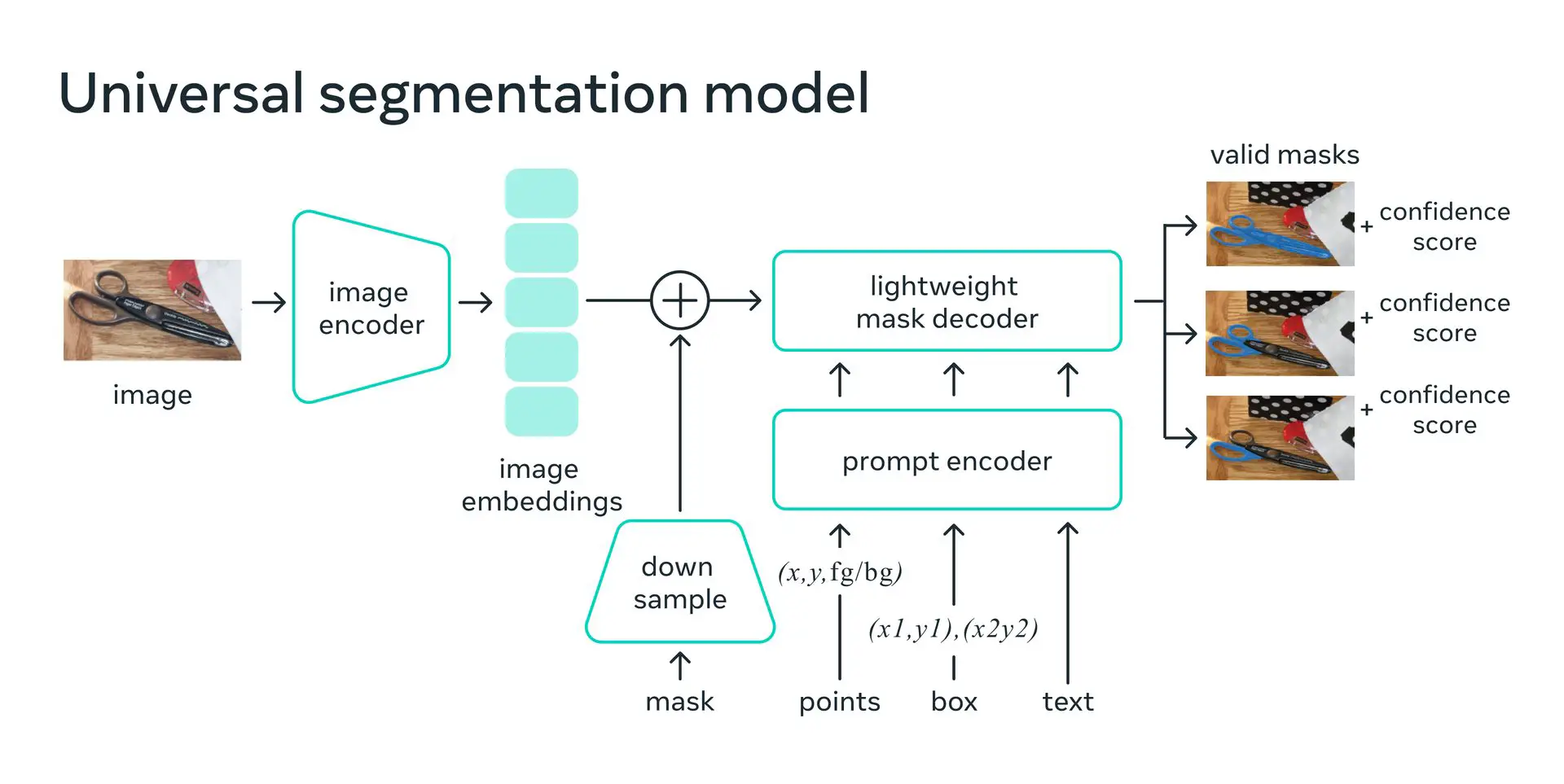

Eine der faszinierendsten Entdeckungen im NLP und in jüngerer Zeit in der Computer Vision ist die Verwendung von „Aufforderungs“-Ansätzen, um Zero-Shot- und Few-Shot-Lernen bei neuartigen Datensätzen und Aufgaben unter Verwendung von Basismodellen zu ermöglichen. Meta fand Motivation in diesem Bereich.

Wenn Vorder-/Hintergrundpunkte, ein grober Rahmen oder eine grobe Maske, Freiformtext oder andere Eingaben gegeben wurden, die angeben, was in einem Bild segmentiert werden soll, brachte das Meta-KI-Team dem Segment Anything Model bei, eine geeignete Segmentierungsmaske zu generieren. Die Notwendigkeit einer geeigneten Maske impliziert lediglich, dass die Ausgabe eine geeignete Maske für eines der Dinge sein sollte, auf die sich die Eingabeaufforderung beziehen könnte (z. B. könnte ein Punkt auf einem Hemd entweder das Hemd oder die Person darstellen, die es trägt). Diese Aufgabe wird für das Vortraining des Modells und als Leitfaden für die Lösung generischer Downstream-Segmentierungsprobleme verwendet.

Meta bemerkte, dass die Vortrainingsaufgabe und das interaktive Datensammeln der Modellkonstruktion gewisse Einschränkungen auferlegten. Insbesondere müssen ihre Annotatoren in der Lage sein, das Segment Anything Model in einem Browser interaktiv in Echtzeit auf einer CPU zu verwenden, damit es effektiv ist. Trotz der Tatsache, dass es einen Kompromiss zwischen Qualität und Geschwindigkeit geben muss, um die Laufzeitanforderungen zu erfüllen, stellen sie fest, dass ein einfacher Ansatz zufriedenstellende Ergebnisse liefert.

Am Backend erstellt ein Bild-Encoder eine einzigartige Einbettung für das Bild, während ein einfacher Encoder jede Abfrage sofort in einen Einbettungsvektor umwandeln kann. Ein leichtgewichtiger Decoder wird dann verwendet, um diese zwei Datenquellen zusammenzuführen, um Segmentierungsmasken vorwegzunehmen. Nachdem die Bildeinbettung berechnet wurde, kann SAM jede Anfrage in einem Webbrowser mit einem Segment in etwa 50 ms beantworten.

SAM ist ein nützliches Tool für kreative Profis und Enthusiasten, die Bilder und Videos einfach und flexibel bearbeiten möchten. Aber zuerst müssen Sie lernen, wie Sie darauf zugreifen und es verwenden.

Wie verwende ich das Segment Anything Model (SAM-Modell)?

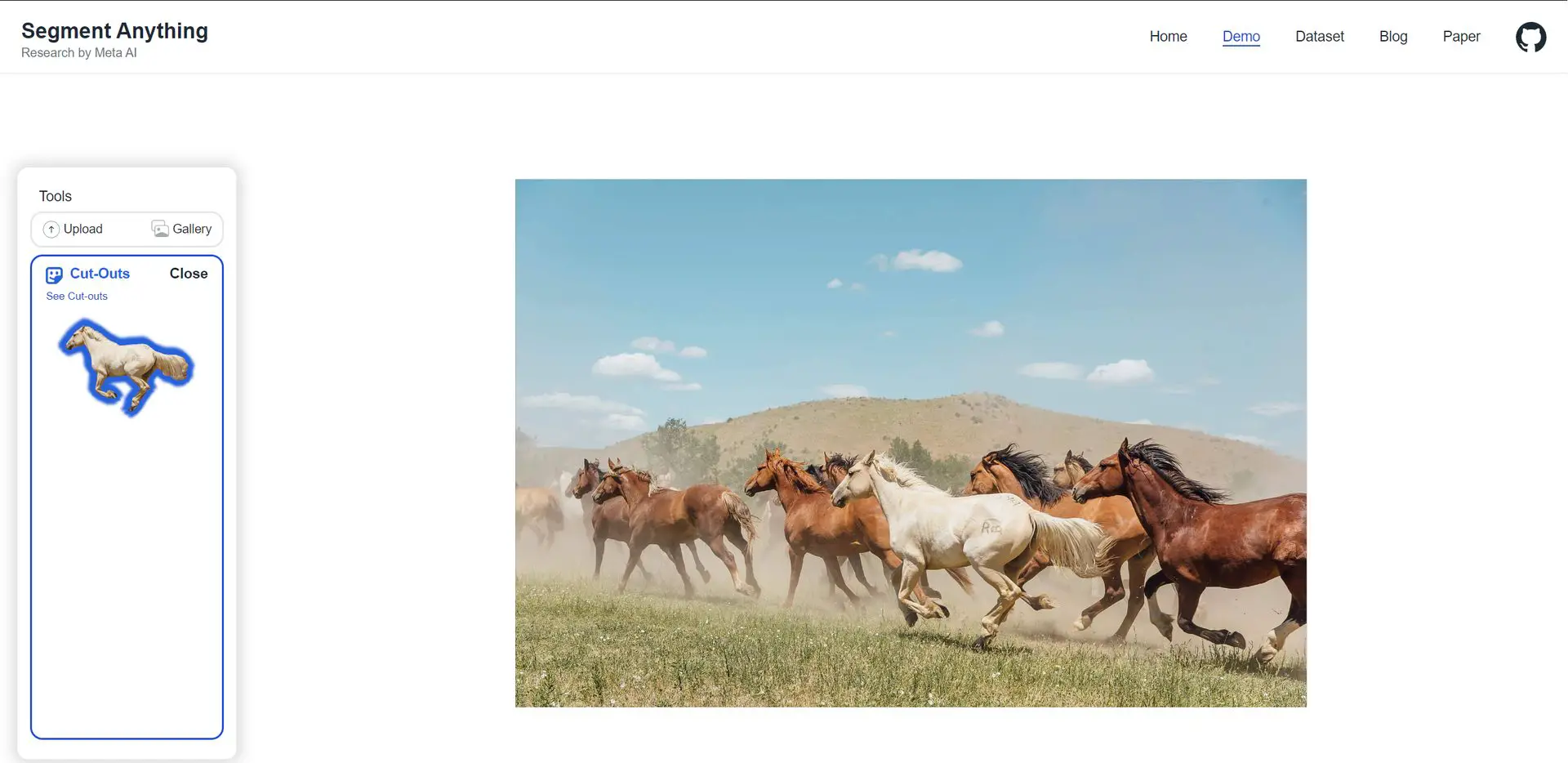

SAM wird von Meta AI Research (ehemals Facebook AI Research) entwickelt und ist öffentlich verfügbar auf GitHub. Sie können SAM auch online mit a ausprobieren Demo oder laden Sie den Datensatz (SA-1B) mit 1 Milliarde Masken und 11 Millionen Bildern herunter. Das Modell ist recht einfach zu bedienen; Folgen Sie einfach diesen Schritten:

- Laden Sie die Demo herunter oder gehen Sie zur Segment Anything Model Demo.

- Laden Sie ein Bild hoch oder wählen Sie eines in der Galerie aus.

- Hinzufügen und Themenbereiche

- Maskieren Sie Bereiche, indem Sie Punkte hinzufügen. Wählen Sie Bereich hinzufügen und dann das Objekt aus. Verfeinern Sie die Maske, indem Sie Bereich entfernen auswählen, und wählen Sie dann den Bereich aus.

Erledige dann deine Aufgabe wie du willst!

Für weitere Informationen, klicken Sie auf hier.

Bild mit freundlicher Genehmigung: Meta

AI 101

Sind Sie neu in der KI? Du kannst immer noch in den KI-Zug einsteigen! Wir haben eine ausführliche erstellt KI-Glossar für die am häufigsten verwendeten Begriffe der künstlichen Intelligenz und erklären die Grundlagen der künstlichen Intelligenz sowie Risiken und Vorteile von KI. Fühlen Sie sich frei, sie zu verwenden. Lernen wie man KI benutzt ist ein Gamechanger! KI-Modelle wird die Welt verändern.

KI-Tools, die wir überprüft haben

Fast jeden Tag taucht ein neues Tool, Modell oder Feature auf und verändert unser Leben, wie das Neue OpenAI ChatGPT-Plugins, und wir haben bereits einige der besten überprüft:

- Text-zu-Text-KI-Tools

Willst du lernen Wie nutzt man ChatGPT effektiv? Wir haben einige Tipps und Tricks für Sie, ohne zu wechseln Chatten Sie mit GPT Plus! Wenn Sie das KI-Tool verwenden möchten, können Fehler wie „ChatGPT ist derzeit voll ausgelastet“ und „zu viele Anfragen in 1 Stunde versuchen Sie es später noch einmal“. Ja, das sind wirklich lästige Fehler, aber keine Sorge; wir wissen, wie man sie repariert. Ist ChatGPT plagiatfrei? Es ist eine schwierige Frage, eine einzige Antwort zu finden. Wenn Sie Angst vor Plagiaten haben, können Sie es gerne verwenden KI-Plagiatsprüfer. Sie können auch andere überprüfen KI-Chatbots und KI-Aufsatzschreiber für bessere Ergebnisse.

- Text-zu-Bild-KI-Tools

Wobei es noch welche gibt Debatten über künstlich erzeugte Bilder, die Leute suchen immer noch nach dem beste KI-Kunstgeneratoren. Wird KI Designer ersetzen?? Lesen Sie weiter und finden Sie es heraus.

- Andere KI-Tools

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://dataconomy.com/2023/04/sam-model-meta-segment-anything-model-mask/

- :Ist

- $UP

- 1

- 11

- a

- Fähigkeit

- Fähig

- Über uns

- Zugang

- Zubehör

- Nach

- Erreicht

- über

- Zusätzliche

- beeinflussen

- Nach der

- Landwirtschaft

- AI

- Kunst

- ai Forschung

- AI-powered

- Ziel

- Algorithmen

- bereits

- Betrag

- Beträge

- Analyse

- analysieren

- und

- Tiere

- beantworten

- erwarten

- Auftritte

- Anwendungen

- Ansatz

- Ansätze

- angemessen

- AR

- AR-Gläser

- SIND

- Bereich

- Bereiche

- um

- Kunst

- künstlich

- künstliche Intelligenz

- AS

- At

- automatisieren

- verfügbar

- Zurück

- Hintergrund

- BE

- Bevor

- hinter

- Sein

- Benchmarks

- Nutzen

- Vorteile

- BESTE

- Besser

- zwischen

- Milliarde

- Biologie

- Grenzen

- Box

- Boxen

- Durchbruch

- Browser

- by

- berechnet

- CAN

- Kann bekommen

- Fähigkeiten

- Kapazität

- Kategorien

- sicher

- herausfordernd

- Übernehmen

- Änderungen

- ChatGPT

- aus der Ferne überprüfen

- Auswählen

- klicken Sie auf

- Kleider

- Das Sammeln

- häufig

- abschließen

- Komplex

- Kompromiss

- Computer

- Computer Vision

- Baugewerbe

- könnte

- deckt

- CPU

- erstellen

- erstellt

- schafft

- Erstellen

- Kreativ (Creative)

- kritischem

- wichtig

- technische Daten

- Datensätze

- Datum

- Tag

- Tage

- Behandlung

- Angebote

- Demo

- zeigt

- Tiefe

- Trotz

- detailliert

- Entdeckung

- entwickelt

- anders

- entdeckt,

- Diversität

- Domain

- Domains

- Nicht

- herunterladen

- Früh

- einfacher

- leicht

- Bearbeitung

- Effektiv

- effektiv

- Effizienz

- Anstrengung

- entweder

- ermöglichen

- ermöglichen

- Enthusiasten

- Umgebungen

- Fehler

- insbesondere

- AUFSATZ

- Äther (ETH)

- Sogar

- Jedes

- jeden Tag

- Beispiel

- vorhandenen

- existiert

- Erklären

- Gesicht

- Gesichter

- Landwirte

- Merkmal

- Eigenschaften

- Feld

- Felder

- Finden Sie

- Vorname

- Fixieren

- Flexibilität

- folgen

- Nahrung,

- Aussichten für

- früher

- gefunden

- Foundation

- Frei

- für

- voll

- fundamental

- Zukunft

- Bildergalerie

- Spiel

- Gaming

- erzeugen

- bekommen

- ABSICHT

- gegeben

- Brille

- Go

- Guide

- Haarfarbe

- Griff

- Hände

- hart

- Haben

- Hilfe

- hilfreich

- GUTE

- hochwertige

- Ultraschall

- Hilfe

- HTTPS

- human

- identifizieren

- Image

- Bildsegmentierung

- Bilder

- auferlegten

- beeindruckend

- in

- das

- Anzeige

- Krankengymnastik

- Information

- Varianten des Eingangssignals:

- Anleitung

- Intelligenz

- Interaktion

- interaktive

- Problem

- IT

- SEINE

- jpg

- Behalten

- Wissen

- Wissen

- grosse

- großflächig

- höchste

- LERNEN

- lernen

- leicht

- Gefällt mir

- Einschränkungen

- Leben

- suchen

- viele

- Landkarten

- Maske"

- Masken

- massiv

- max-width

- Mittel

- Triff

- nur

- Merge

- Meta

- Methoden

- könnte

- Million

- Modell

- für

- mehr

- Zudem zeigt

- vor allem warme

- Motivation

- MS

- mehrere

- Need

- Neu

- Nlp

- Roman

- Objekt

- Objekterkennung

- Objekte

- erhalten

- of

- on

- EINEM

- Online

- Auftrag

- Andere

- Umrissen

- Übertrifft

- Möglichkeiten für das Ausgangssignal:

- besondere

- Personen

- Leistung

- person

- Pflanzen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Points

- Punkte

- Pops

- Potenzial

- größte treibende

- Vor

- Aufgabenstellung:

- Probleme

- Prozessdefinierung

- produziert

- Profis

- Projekt

- ordnungsgemäße

- die

- öffentlich

- Zwecke

- Qualität

- Frage

- schnell

- Angebot

- Lesebrillen

- echt

- realen Welt

- Echtzeit

- realistisch

- kürzlich

- Anerkennung

- erkennen

- Reduzierung

- verfeinern

- Reflexionen

- in Bezug auf

- Regionen

- entfernen

- ersetzen

- vertreten

- Zugriffe

- erfordern

- falls angefordert

- Anforderung

- Forschungsprojekte

- Reagieren

- Die Ergebnisse

- Revealed

- bewertet

- revolutionieren

- Robustheit

- s

- Sam

- Szenarien

- Szene

- Szenen

- Wissenschaftler

- Segment

- Segmentierung

- Auswahl

- Trennung

- mehrere

- Form

- Formen

- sollte

- Einfacher

- Simulation

- Single

- Größen

- Geschicklichkeit

- So

- Lösung

- LÖSEN

- Auflösung

- einige

- Quellen

- spezifisch

- Geschwindigkeit

- Shritte

- Immer noch

- einfach

- stark

- Fach

- so

- Aufsicht

- Nehmen

- Aufgabe

- und Aufgaben

- Team

- Technologie

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Gegend

- Die Zukunft

- Die Galerie

- die Welt

- ihr

- Sie

- Diese

- Zeitaufwendig

- Tipps

- Tipps und Tricks

- zu

- Werkzeug

- Werkzeuge

- Tracking

- trainiert

- Ausbildung

- privaten Transfer

- Transformieren

- Unsicherheit

- Verständnis

- einzigartiges

- -

- Nutzer

- Nutzen

- Vielfalt

- verschiedene

- Fahrzeuge

- Video

- Videos

- Assistent

- Seh-

- Weg..

- Wege

- Netz

- Web-Browser

- GUT

- Was

- Was ist

- welche

- während

- WHO

- breit

- Große Auswahl

- werden wir

- mit

- ohne

- Arbeiten

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- Ihr

- Zephyrnet